Wpłynie na to przede wszystkim rosnąca popularność mobilnego Internetu, za pośrednictwem którego coraz więcej użytkowników korzysta z treści multimedialnych udostępnianych w ramach różnych usług, takich jak mobilna telewizja, serwisy Web 2.0, gry online itp.. Mimo że udział w ogólnym rynku telefonii komórkowej dominujących dziś standardów, czyli sieci GSM, wykorzystujących technologie GPRS i EDGE oraz sieci UMTS, opartych na HSxPA, systematycznie rośnie, prawdopodobnie za jakiś czas rozwiązania te nie będą już w stanie spełniać oczekiwań użytkowników.

Zmotywowało to przedstawicieli grupy standaryzacyjnej 3GPP (3rd Generation Partnership Project) do rozpoczęcia prac nad zupełnie nową technologią. W ten sposób powstała specyfikacja LTE (Long-Term Evolution), która ma według planów wymaganiom tym sprostać. Zgodnie z założeniami sieci LTE mają charakteryzować wysokie w porównaniu do innych technologii parametry, głównie pod względem prędkość transmisji.

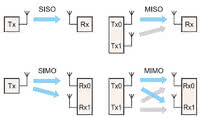

W przypadku wieloantenowej transmisji w konfiguracji 4×4 dane mają być w łączu "downlink" (w dół) przesyłane z maksymalną prędkością 300 Mb/s oraz 75 Mb/s w łączu "uplink" (w górę). Standardem w LTE mają też być różne szerokości kanału radiowego w przedziale od 1,25 do 20 MHz, opóźnienia w transmisji pakietów nieprzekraczające 10ms oraz możliwość obsługi do 200 aktywnych użytkowników w jednej komórce o paśmie 5 MHz.

Klucz do sukcesu

LTE, często określany jako standard 3,9G lub "prawie 4G", jest w całości projektowany od nowa w przeciwieństwie np. do EDGE Evolution oraz HSPA+, które są bezpośrednim rozszerzeniem już istniejących technologii, czy też mobilnego WiMaxu, który jest oparty na standardzie IEEE 802.16d. Prace nad LTE rozpoczęto w 2004 roku, a pierwszą kompletną wersję specyfikacji organizacja 3GPP przedstawiła w 2008 roku.

Jedną z ważniejszych decyzji, jakie w czasie prac nad LTE musieli podjąć przedstawiciele 3GPP, było to, czy kontynuować rozwijanie interfejsu radiowego W-CDMA wykorzystywanego w sieciach UMTS, czy też zastosować w tym zakresie nowe podejście. Ostatecznie uznano, że W-CDMA nie pozwoli w pełni zrealizować wszystkich celów projektu.

Oprócz zwiększenia przepływności oraz możliwości elastycznego korzystania z różnych pasm częstotliwości dążono również bowiem do zmniejszenia poboru mocy przez terminale mobilne, uproszczenia ich konstrukcji, a także do ograniczenia całkowitych kosztów systemu. Stąd największa różnica między LTE a aktualnie wykorzystywanymi standardami sieci komórkowych polega na technologiach, które są podstawą interfejsu radiowego.

Nowe-stare OFDM w "downlink"

W transmisji ze stacji bazowej do odbiornika specjaliści 3GPP zdecydowali się wykorzystać szerokopasmową modulację wielotonową OFDM (Orthogonal Frequency Division Multiplexing). Nie jest to nowa technika, gdyż idea OFDM była znana już w latach 60. i 70. ubiegłego wieku. Wówczas jednak możliwości realizacji tej metody modulacji w praktyce były ograniczone, w związku z czym OFDM traktowano wtedy bardziej jako naukową ciekawostkę.

Ponownie zainteresowano się OFDM pod koniec lat 80., gdy brano tę technologię pod uwagę we wczesnych etapach rozwoju sieci GSM, oraz później gdy pracowano nad standardem UMTS. W obu przypadkach nie zdecydowano się jednak na wdrożenie tego schematu modulacji. Ze względu na możliwości obliczeniowe ówczesnych procesorów główny problem stanowiła realizacja szybkiej transformaty Fouriera, która jest sercem OFDM.

Rozwój techniki pozwolił barierę tę z czasem pokonać, dzięki czemu OFDM szybko stało się jedną z popularniejszych metod modulacji, wykorzystywaną dziś w różnych technologiach transmisji bezprzewodowej i nie tylko. OFDM zaimplementowano m.in. w standardzie naziemnej telewizji cyfrowej DVB (Digital Video Broadcast), w systemach radiofonii cyfrowej DAB (Digital Audio Broadcast), w technologii transmisji danych ADSL (Assymetric Digital Subscriber Line), w technologii transmisji danych przez sieć energetyczną PLC (Powerline Communication) oraz w standardach sieci bezprzewodowych z grupy specyfikacji 802.11.

Oprócz tego OFDM wykorzystano też np. w nierozwijanym już standardzie UMB (Ultra Mobile Broadband), z którego zrezygnowano właśnie na rzecz LTE oraz w standardzie WiMax. Popularność tej techniki modulacji wynika głównie stąd, że pozwala ona uzyskać dużą szybkość transmisji przy jednoczesnym ograniczeniu spowodowanych zjawiskiem wielodrogowości zniekształceń sygnału, czyli tzw. interferencji międzysymbolowych (Intersymbol Interferences, ISI), których usunięcie bywa problemem.

Sposób na ISI

Istotą OFDM jest podział strumienia danych o dużej przepływności na kilka wolniejszych strumieni przesyłanych dalej równolegle z wykorzystaniem wielu nośnych. W ten sposób wydłuża się czas trwania jednego symbolu. Dzięki temu sygnały odbite w wyniku zjawiska wielodrogowości, które docierają do odbiornika z opóźnieniem, mają mniejszy wpływ na jakość odbieranego sygnału. Dodatkowo w OFDM zapobiega się interferencjom międzysymbolowym, wprowadzając odstęp między poszczególnymi symbolami, tzw. cykliczny prefiks (Cyclic Prefix, CP).

CP w praktyce jest skopiowaną "końcówką" danego symbolu wstawioną na jego początek. W ten sposób, jeżeli opóźnienie między sygnałem oryginalnym i odbitym nie przekroczy długości CP w odbiorniku, można przesłaną informację bez problemu odtworzyć. CP jest tak dobierane, by było nieco dłuższe niż najdłuższe spodziewane opóźnienie, które może wystąpić w danym kanale.

W LTE przyjęto, że standardowa długość CP będzie wynosić 4,69μs, co pozwoli uniknąć zniekształceń na skutek opóźnień występujących przy różnicy dróg przebytych przez sygnały docierające do odbiornika rzędu 1,4km (przy dłuższym, tzw. rozszerzonym CP o długości 33,33μs nawet do 10km).

CP

Wstawienie odstępu CP między wszystkimi symbolami ogranicza przepływność systemu w zależności od stosunku długości CP do czasu trwania symbolu. W przypadku specyfikacji LTE, w której przyjęto, że symbol trwa 66,7μs i przy CP o czasie trwania 4,69μs, przepływność maleje o 7%. Wstawienie tak długiego odstępu bezpieczeństwa nie byłoby natomiast możliwe w systemach z pojedynczą nośną. Na przykład w GSM pojedynczy symbol trwa 3,69μs, czyli jest 18-krotnie krótszy niż w LTE. Z kolei w W-CDMA w UMTS długość jednego symbolu wynosi 0,26μs, czyli jest 256 razy krótsza niż w LTE.

Wstawianie odstępu CP o długości 4,69μs między tak krótkimi symbolami powodowałoby zmniejszenie przepływności o ponad połowę w GSM i prawie 20-krotnie w W-CDMA. Dlatego w systemach, w których wykorzystuje się krótkie symbole w porównaniu do możliwych opóźnień po stronie odbiornika, polegać można głównie na układach korygujących, które pozwalają odtworzyć oryginalny sygnał. Wynika z tego kolejne ograniczenie technik z pojedynczą nośną, takich jak TDMA i CDMA.

W miarę jak rośnie prędkość przesyłanych danych, a tym samym skraca się czas trwania pojedynczego symbolu, konstrukcja układu korekcyjnego staje się bardzo skomplikowana. Na przykład rozbudowa odbiornika Rake wykorzystywanego do zmniejszania efektów propagacji wielodrogowej w systemach W-CDMA przy takiej prędkości transmisji jak w LTE i przy opóźnieniach spotykanych w rzeczywistych kanałach wiązałaby się ze zwiększeniem liczby odczepów do takiej, którą w praktyce byłoby trudno zrealizować.

OFDM nie sprawdza się w łączu "uplink"

OFDM nie jest jednak rozwiązaniem pozbawionym wad. Jedną z nich jest np. duża wrażliwość na błędy częstotliwości nośnych wywołane np. przesunięciem częstotliwości na skutek zjawiska Dopplera. Problemem jest też duża wartość współczynnika PAPR (Peak-Average Power Ratio), który jest definiowany jako stosunek mocy szczytowej do średniej mocy transmitowanego sygnału. Jest to parametr bardzo istotny w projektowaniu terminali użytkowników, gdyż wpływa on na sprawność wzmacniacza mocy w nadajniku.

Maksymalna sprawność jest uzyskiwana, gdy wzmacniacz pracuje w zakresie nasycenia swojej charakterystyki. Niska wartość PAPR umożliwia pracę wzmacniacza właśnie na tym odcinku. Przy większych wartościach tego współczynnika punkt pracy wzmacniacza przesuwa się na liniowy fragment charakterystyki wzmacniacza, by uniknąć zniekształceń sygnału, co jednak skutkuje obniżeniem sprawności.

O ile w przypadku stacji bazowych większy pobór mocy jest dopuszczalny, to w przypadku terminali mobilnych, w których dąży się do tego, by czas pracy na bateriach był możliwie najdłuższy, jest to bardzo niekorzystne.

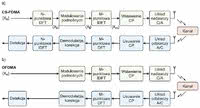

Dlatego w LTE dla łącza "uplink" zdecydowano się wykorzystać zmodyfikowaną wersję OFDMA, tzw. SC-FDMA (Single Carrier Frequency Division Multiple Access). W technice tej udało się połączyć zalety modulacji z pojedynczą nośną, czyli niski współczynnik PAPR oraz większą tolerancję na nieliniowość charakterystyki wzmacniacza mocy z odpornością na zjawisko wielodrogowości, charakteryzującą OFDM.