Komponenty do instalacji energetyki odnawialnej

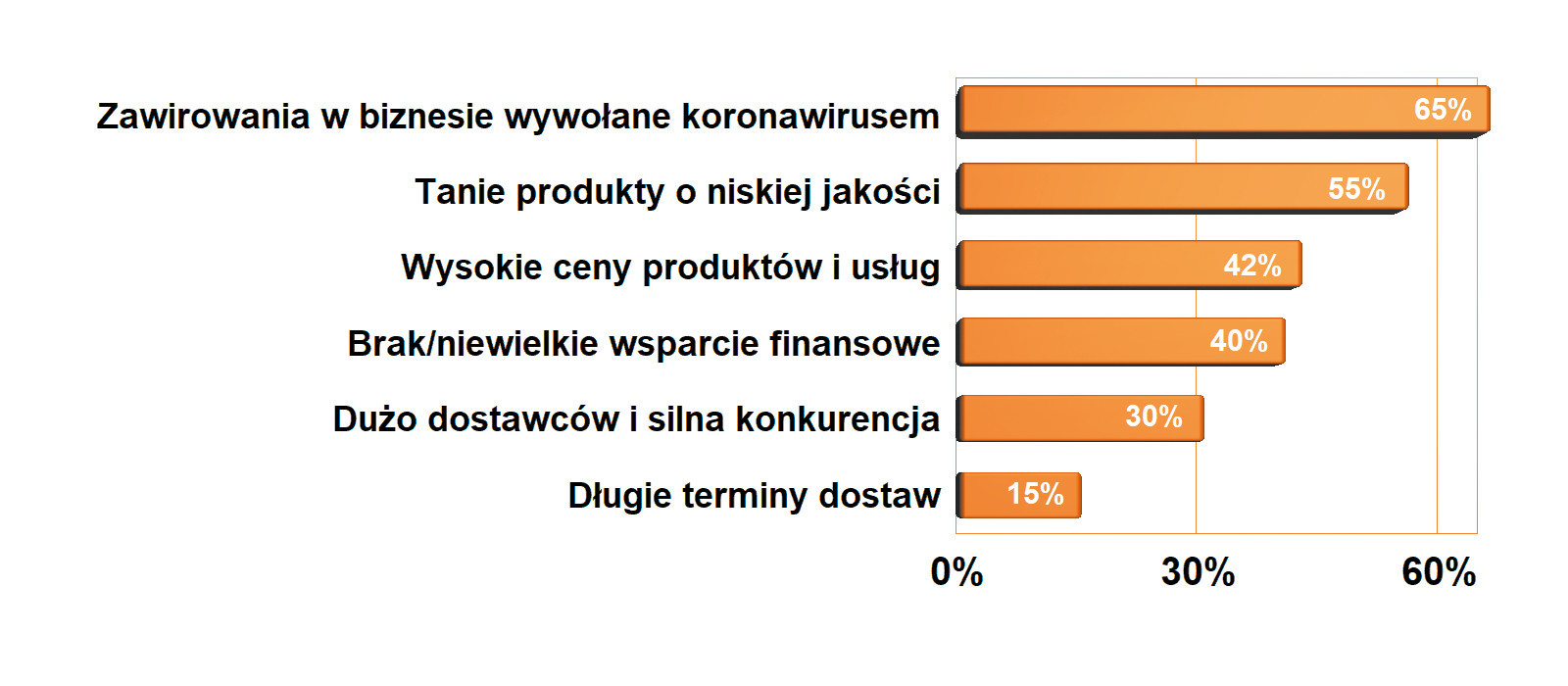

Wsparcie ze strony programów pomocowych bezsprzecznie determinuje tu popyt, bo można podać wiele przykładów na to, że za rozwój rynku OZE w dużej części odpowiadają programy wspierające rozwój za pomocą dotacji, pożyczek preferencyjnych na inwestycje oraz ułatwienia w zakresie formalnym. Jest to ważne szczególnie w zakresie tzw. mikroinstalacji, bo dla inwestorów indywidualnych wielotysięczny wydatek związany z budową jest dużym kosztem, trudnym do zrealizowania w ramach budżetu domowego. Dlatego "Czyste powietrze" oraz "Mój prąd" cieszą się w kraju powodzeniem (znacznie bardziej niż wcześniejszy "Prosument"). Aktualnie mamy w kraju ok. 65 tys. mikroinstalacji (o mocy do 10 kWp). Jest to szczególnie ważne w Polsce, gdzie energetyka odnawialna jest solą w oku lobby węglowego i źródłem tarć politycznych. Źródła OZE wymagają stabilności prawnej i biznesowej a każda niestabilność, czego przykładem może być ustawa o regulacji lokalizacji farm wiatrowych, przez lata odbija się negatywnie na sprzedaży.

PROGRAMY POMOCOWE NIOSĄ TEŻ PATOLOGIE

Programy rządowe wspierające rozwój instalacji energii odnawialnej tworzą też problemy związane z brakiem kompetencji wielu firm zajmujących się obecnie branżą fotowoltaiki. To dlatego, że rynek fotowoltaiczny przez ostatnie dwa lata wykazywał ponadprzeciętny wzrost z miesiąca na miesiąc, przez co przyciągnął wielu ludzi o profesjach niepowiązanych z techniką oraz firmy, które przebranżowiły się z kompletnie odległych tematycznie dziedzin. Im więcej jest takich przypadkowych przedsiębiorstw, tym bardzo ograniczona możliwość wyboru rzetelnego i kompetentnego dostawcy i wykonawcy z poziomu klienta. Gdy klientowi brakuje wiedzy na tematy techniczne, a dostawcy kompetencji, do głosu dochodzi niska cena. Skutkiem są także nieoptymalne instalacje lub wręcz błędne projekty, zamknięcie się na nowe technologie oraz niechęć do edukacji.

ZNACZENIE ENERGII ELEKTRYCZNEJ STALE SIĘ ZWIĘKSZA

Energia elektryczna stale drożeje, przez co opłacalność budowy instalacji odnawialnych stale się poprawia. Komponenty wykorzystywane w instalacjach są też coraz tańsze i lepsze, bo na przestrzeni lat zostały one dopracowane w szczegółach i są wytwarzanie masowo. Pojawiły się też nowe podzespoły półprzewodnikowe dużej mocy, które zapewniły w tym obszarze większą funkcjonalność, w tym głównie wyraźnie lepszą sprawność, dzięki czemu falowniki są mniejsze, a więc też tańsze. Ceny spadły także dlatego, że rynek znacznie się poszerzył, bo ekologiczne zasilanie jest dzisiaj trendem istotnym w skali całego świata.

Nasz kraj przyjął przed laty na siebie zobowiązania do tego, aby część wytwarzanej energii elektrycznej pochodziła ze źródeł ekologicznych, bo UE jest liderem w zakresie technologii źródeł odnawialnych na świecie, a Polska będąc członkiem wspólnoty, musi się dostosować do uzgodnionych progów i udziałów. Nasze zobowiązania są podwaliną biznesu dla wielu krajowych firm zajmujących się tą tematyką. Nawet jeśli w tym zobowiązaniu większością są źródła bazujące na biomasie lub elektrownie wodne, to i tak w jakimś ułamku zostaje miejsce na te technologie bliższe elektronice.

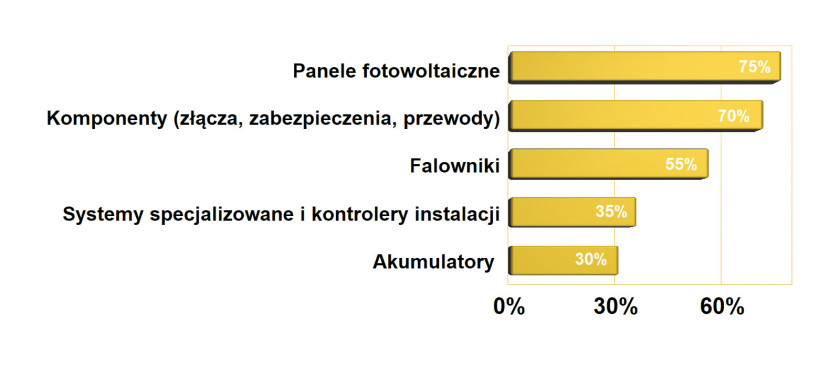

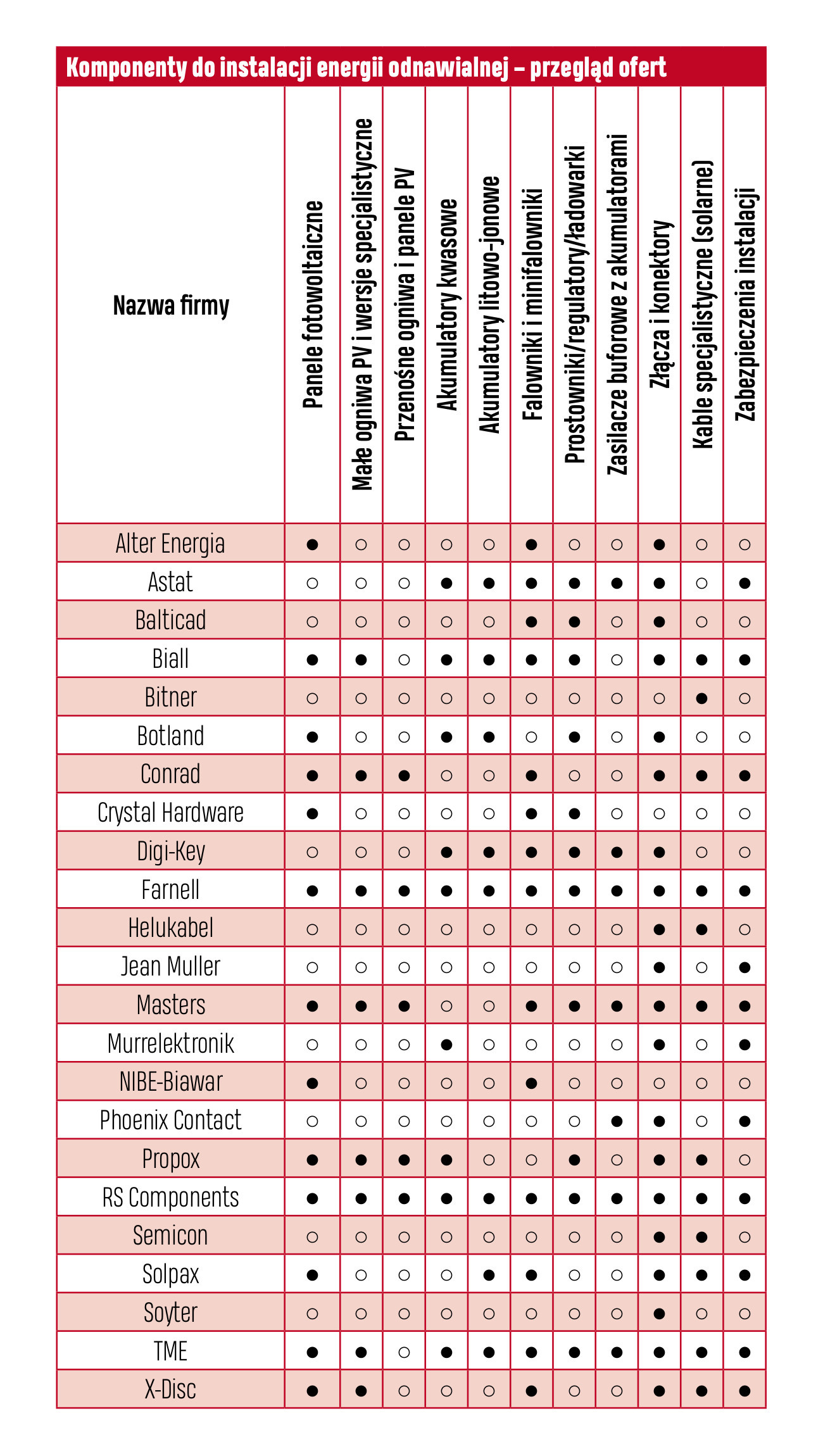

KOMPONENTY SOLARNE

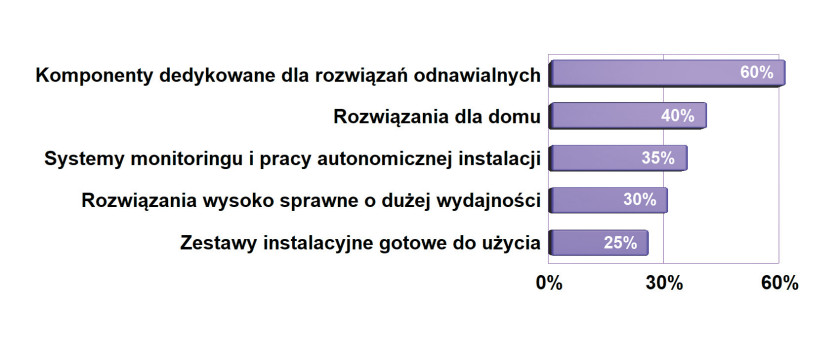

Na rynku dystrybucji jest coraz więcej komponentów specjalizowanych, a więc zaprojektowanych specjalnie pod kątem pracy w instalacjach energii odnawialnej. Głównie chodzi tutaj o wersje dla instalacji fotowoltaicznych (PV), do których potrzebne są przewody o dużym przekroju i odpornej na wpływ środowiska izolacji, po to, aby zapewnić małe straty mocy, małe upływy (a więc bezpieczeństwo) podczas wielu lat pracy. Kolejny element, gdzie widoczna jest specjalizacja aplikacyjna, to złącza o minimalnych stratach, łatwe w montażu itd. Są to złącza kabel-kabel o dużej odporności na czynniki środowiskowe. Złącza solarne mają specjalną konstrukcję mechaniczną, bo instalatorzy wykonują swoją pracę często w niewygodnych warunkach (np. na dachu). Stąd ważna jest jak najmniejsza liczba operacji wymaganych do wykonania połączenia. Oczekiwana jest także możliwość łączenia za pomocą tego samego elementu przewodów o dość szerokim zakresie przekrojów (np. 2,5‒6 mm2).

W tej grupie zawierają się ponadto przekaźniki i styczniki umożliwiające przełączanie obwodów stałoprądowych o dużej mocy. W dalszej kolejności są to komponenty sieciowe, elementy systemów pomiarowych (mierniki mocy, układy akwizycji danych, rejestratory napięć i prądów) i podobne. Łącznie całość tworzy bardzo szeroki asortyment produktów, w których pojawia się też wiele nowości.

Instalacje energii odnawialnej integrują w sobie wiele urządzeń technicznych, a jeśli skala inwestycji jest duża, jak w farmach, to także o zaawansowanej funkcjonalności. To dlatego, że duże obiekty są zarządzane i obsługiwane zdalnie za pomocą modułów i układów pomiarowych połączonych w sieć. Konieczne są do tego elementy systemów pomiarowych i urządzenia wykonawcze, urządzenia infrastruktury sieciowej w różnych standardach, konwertery protokołów, kontrolery. Takich urządzeń jest bardzo dużo, a wiele ponadto ma uniwersalny charakter i pasuje do wielu aplikacji.

Częścią instalacji PV są też komponenty zabezpieczające, głównie chodzi o ograniczniki przepięć. Następny ważny element to falownik, który zawsze był elementem specjalizowanym, ale lista zawiera też elementy drobne, niemniej cały czas wykorzystywane, jak chociażby przetwornice DC- DC małej mocy o odpornej na przebicie izolacji wykorzystywane do zasilania wydzielonych obwodów, np. tych związanych z komunikacją lub monitoringiem stanu.

ZAPEWNIENIE JAKOŚCI JEST KLUCZOWE

Opłacalność inwestycji w instalację energii odnawialnej jest zwykle definiowana w długim horyzoncie czasowym sięgającym 20‒25 lat. Dla sprzętu, który w tym czasie musi pracować na zewnątrz, jest to spore wyzwanie jakościowe, bowiem wpływ środowiska w tak długim czasie jest destrukcyjnie silny. Promieniowanie ultrafioletowe pochodzące od słońca, wilgoć i rosa, duże zmiany temperatury w cyklu dzień–noc, wszechobecny kurz, a nawet obecność zwierząt, które są w stanie zębami zniszczyć izolację przewodów, tworzą trudne warunki eksploatacji wymagające użycia produktów o gwarantowanej jakości. W tym obszarze jest to zagadnienie kluczowe, bo inwestorzy są zainteresowani zyskami przy planowej konserwacji, a nie wiecznym serwisowaniem uszkodzeń.

DUŻE INSTALACJE

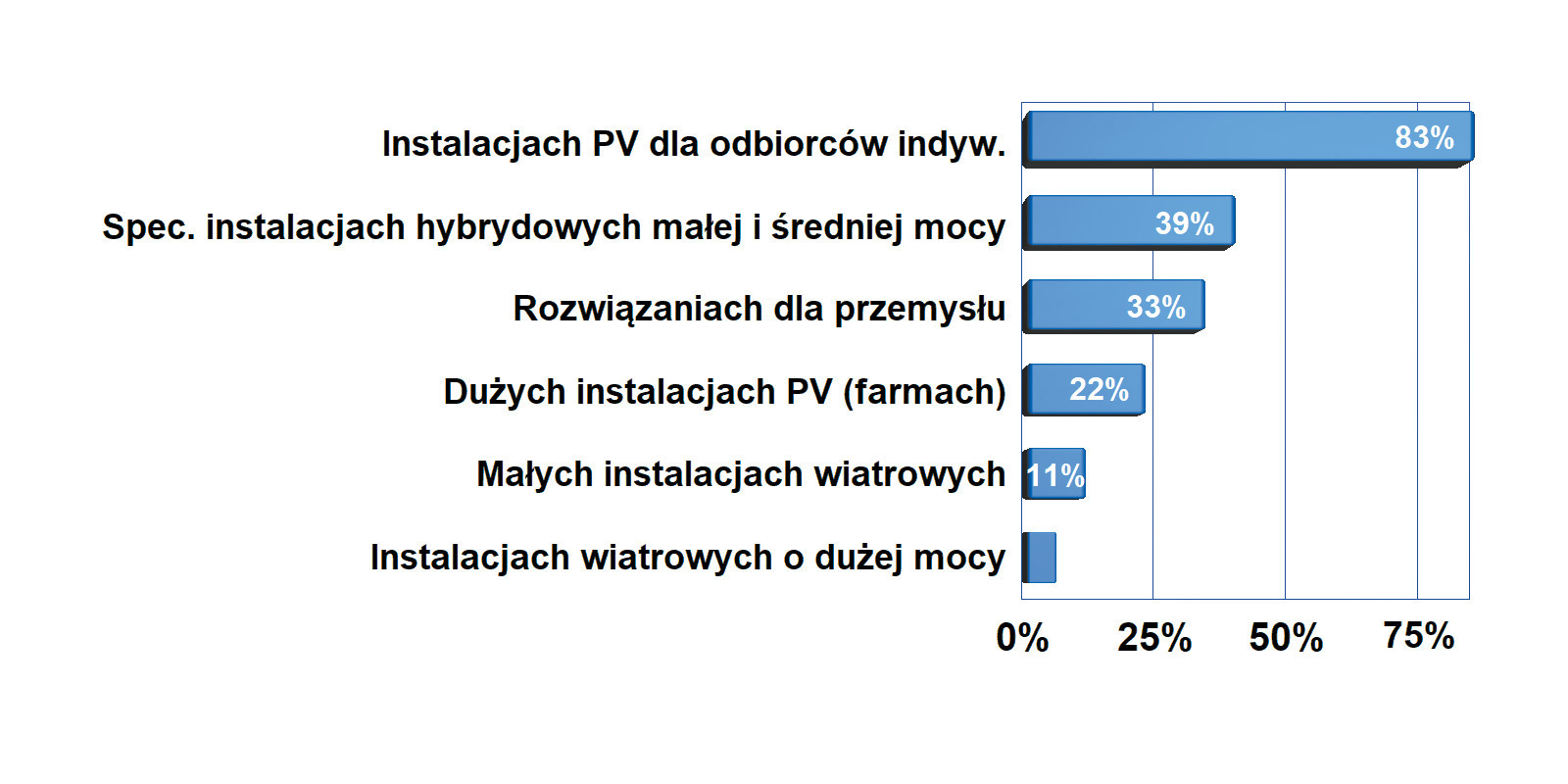

Mówiąc o rynku energii odnawialnej i produktach kierowanych do OZE, należy pamiętać, że sektor ten tworzy kilka gałęzi, które nierzadko są daleko od siebie odsunięte tak, że tworzą inne rynki. Do pierwszej grupy można zaliczyć duże instalacje PV lub wiatrowe obliczone i skonstruowane pod kątem wytwarzania dużej ilości energii elektrycznej, która trafia wyłącznie do sieci energetycznej. Takie instalacje nazwane są farmami i zwykle są budowane przez koncerny energetyczne i spółki zajmujące się wytwarzaniem energii. Z uwagi na skalę inwestycji są one poza zasięgiem rynku dystrybucji, bowiem kupno, instalacja i serwis to efekty umów na wysokim szczeblu.

Drugą kategorię tworzą instalacje działające w mniejszej skali, o mocy rzędu 10 kWp. Instalowane są one przez odbiorców indywidualnych, małe i średnie firmy, które wytwarzaną energię zużywają na własne potrzeby, a ewentualne nadwyżki sprzedają do sieci. To najbardziej perspektywiczny sektor rynku i atrakcyjny z punktu widzenia dystrybucji. Trzeci segment obejmuje najmniejsze instalacje na dachy budynków jednorodzinnych, typ. 3 kWp. One nie muszą być połączone z siecią energetyczną.

IM MNIEJSZA MOC, TYM BARDZIEJ NISZOWY CHARAKTER

Energia odnawialna to także zasilanie małych urządzeń i instalacji w warunkach braku sieci energetycznej. Takie potrzeby są domeną urządzeń specjalistycznych i nietypowych rozwiązań, od podświetlania oznakowania, reklam drogowych, przez dostarczanie zasilania do pomiarowych stacji telemetrycznych. Wystarczy się rozejrzeć po okolicy, aby dostrzec, że takie rozwiązania stają się coraz bardziej popularne: stacje wypożyczania rowerów są zasilanie z niewielkich paneli słonecznych. Podobnie jest ze znakami ostrzegającymi o nadmiernej prędkości, wskazujących kierunek ruchu lub tworzących światła obrysowe.

Takie aplikacje z reguły wykorzystują małe panele PV – systemy bazujące na niewielkich generatorach wiatrowych są statystycznie rzadkością. Zapewne powodem jest to, że energia słoneczna charakteryzuje się lepszą dostępnością, a same komponenty instalacji są trwalsze w porównaniu z rozwiązaniem mechanicznym. PV liczy się w takich zastosowaniach, bo jest najbardziej elastycznym systemem zasilania energią odnawialną, pozwala na skalowalność i integrację budynkiem.

Rozwój takich aplikacji specjalistycznych wynika też z tego, że elektronika do działania potrzebuje coraz mniej mocy zasilającej, a wydajność ledowych źródeł światła cały czas się poprawia. Faktem jest jednak to, że im mniejsza moc instalacji, tym bardziej niszowy ma ona charakter.

Z tej przyczyny zasilanie energią wolnodostępną (energy harvesting), która też zalicza się do "odnawialnej" stanowi ciekawostkę i pole do popisu dla świata nauki, a nie dla biznesu. Wydaje się, że jedyną komercyjną i masową aplikacją tworzy tutaj osprzęt instalacyjny EnOcean, gdzie budynkowe wyłączniki oświetlenia mają wbudowaną poruszaną klawiszem prądnicę z magnesem i cewką do zasilania nadajnika bezprzewodowego. Podobnie jest z ogniwami paliwowymi – dekadę temu były one zapowiadane jako technologia, która lada moment zrewolucjonizuje urządzenia mobilne, a w praktyce są domeną sprzętu wojskowego, gdzie jak wiadomo, koszty są najmniejszym problemem.

WYSOKIE NAPIĘCIE STAŁE TO DUŻE NIEBEZPIECZEŃSTWO

Instalacje fotowoltaiczne są w dużej części instalacjami stałoprądowymi. Oznacza to, że ich zabezpieczenie nadprądowe, zwarciowe i przepięciowe jest trudniejsze, niż wymagają tego równoważne mocą obwody prądu przemiennego. Powodem jest trudność w gaszeniu łuku elektrycznego powstającego na stykach, bo nie ma tutaj zjawiska jego samoczynnego wyłączenia przy przejściu sinusoidy przez zero. W efekcie styczniki, bezpieczniki i przekaźniki muszą mieć specjalną konstrukcję, np. z magnesami wydmuchującymi zjonizowaną plazmę do komór gaszeniowych i inne sprytne rozwiązania, które mają wpływ na ich cenę. Duże znaczenie zabezpieczeń przepięciowych dla instalacji PV to z kolei wynik tego, że panele są elementami półprzewodnikowymi, a więc z natury elementami podatnymi na przebicie napięciowe.

Można zgrubnie przyjąć, że jeden typowy panel wykonany z krzemu polikrystalicznego zapewnia ok. 240 watów mocy wyjściowej przy pełnym oświetleniu słonecznym, tj. ma napięcie robocze 30 V i dostarcza prąd rzędu 8 A. Taką wydajność zapewnia 60 zawartych w nim ogniw połączonych szeregowo. Typowa wartość wygenerowanego napięcia przez ogniwa krystaliczne wynosi 0,5‒0,6 V (złącze p-n), zatem 60 ogniw zapewnia mniej więcej podane wcześniej 30 V napięcia wyjściowego. Bez obciążenia napięcie jest trochę wyższe i wynosi ok. 40 V, ale w praktyce napięcie wyjściowe panelu niewiele się zmienia w funkcji oświetlenia. Wynika to z charakterystyki prądowo-napięciowej złącza p-n.

sekcje instalacji, a dalej te sekcje równolegle po to, aby zapewnić odpowiednią moc. Dzięki temu napięcie robocze na wejściu falownika jest wysokie, co jak wiadomo, ma korzystny wpływ na straty mocy w połączeniach miedzianych, ale jednocześnie wymaga użycia wysokiej jakości kabli i złączy, aby uniknąć upływności do ziemi, przebić i porażenia obsługi prądem.

Konkretne wartości, ile paneli ma być połączone w szereg, zależą od użytego falownika, a dokładniej od zakresu napięć wejściowych, które on akceptuje. Dla orientacji można powiedzieć, że zakres wahań tego napięcia to ok. 200‒1000 V, a średnia to ok. 500 V DC. Wartości te uzmysławiają, że są to poziomy niebezpieczne pod wieloma względami: obsługi i eksploatacji, bo istnieje możliwość porażenia oraz w aspekcie przeciwpożarowym, gdyż wyładowanie łukowe jest tutaj bardzo destrukcyjne. Podstawowym zadaniem inwertera jest konwersja napięcia stałego otrzymywanego z modułów fotowoltaicznych na napięcie przemienne oraz znalezienie i praca instalacji w MPP (punkcie maksymalnej wydajności).

W przypadku dużych instalacji fotowoltaicznych z inwerterem centralnym stosuje się podział farmy na sekcje załączane/odłączane stycznikami. Umożliwia to niezależne odłączenie serwisowanej sekcji paneli PV od wywarzającego energię układu. Takie rozwiązanie pozwala na efektywną pracę instalacji PV bez kosztownych przestojów. Z kolei przy małych układach PV stosuje się w układzie zasilania stycznika tradycyjny wyłącznik bezpieczeństwa, pełni on też funkcję ochrony przeciwpożarowej.

Sprawia znacznie się komplikuje, gdy instalacja nie jest oświetlona równomiernie. Jeżeli choć jedno ogniwo modułu zostanie zacienione, to napięcie na tym ogniwie zmienia kierunek polaryzacji i zostaje ono spolaryzowane zaporowo. Złącze przy polaryzacji wstecznej może ulec przebiciu już przy kilku woltach (5÷25 V). W celu uniknięcia tych zagrożeń panele zawierają diody bocznikujące chroniące ogniwa przed taką sytuacją, ale całe sekcje też wymagają zabezpieczenia, realizacji możliwości ich odłączenia oraz oczywiście zapewnienia komponentów do monitorowania warunków działania poszczególnych sekcji.

Systemy inteligentnego budynku i automatyki domowej

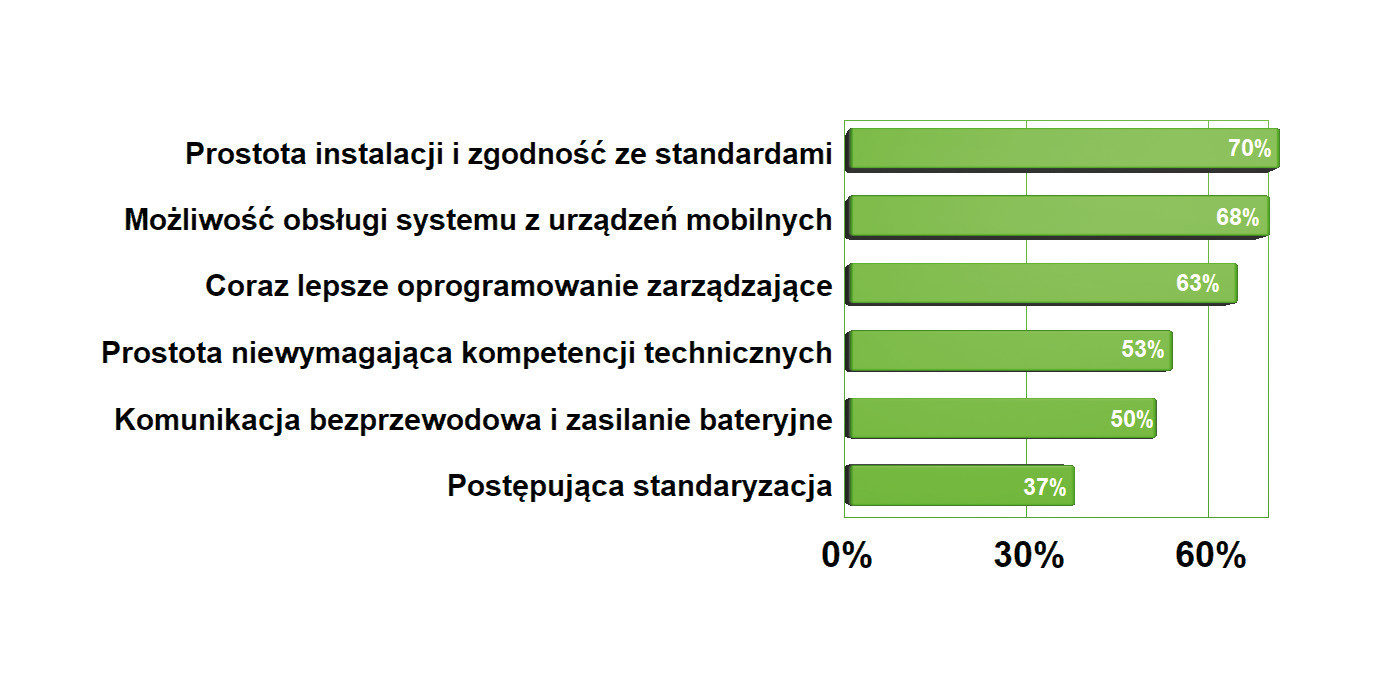

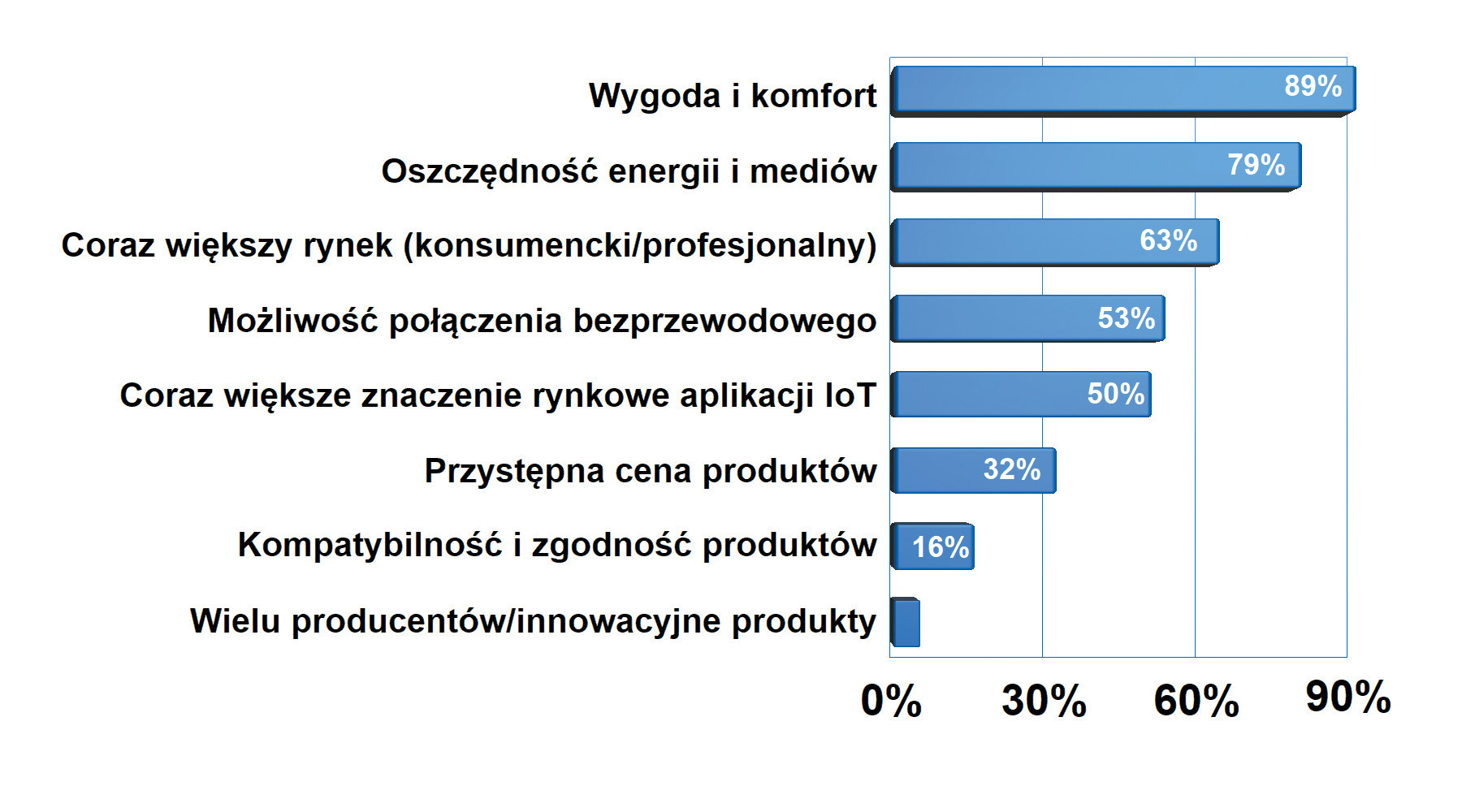

Systemy automatyki domowej zdobywają coraz większą popularność zarówno wśród użytkowników komercyjnych, jak i indywidualnych, stają się również coraz bardziej zaawansowane. Pozwalają m.in. na zdalne zarządzanie budynkiem, znacząco zwiększają jego funkcjonalność. Komfort i wygodna z pewnością zaliczają się do najważniejszych czynników sprzyjających tworzeniu instalacji, zwłaszcza tych w zakresie domu, a więc inwestycji konsumenckich. W skali budynku inwestorzy liczą ponadto na korzyści finansowe związane z oszczędnością energii elektrycznej, ogrzewania, poprawą bezpieczeństwa i podobnymi.

Systemy automatyki domowej są w stanie zarządzać pracą większości urządzeń znajdujących się w budynku oraz jego otoczeniu. Pierwsze tego typu systemy skupiały się na sterowaniu oświetleniem, kontroli temperatury pomieszczeń (sterowanie klimatyzacją i ogrzewaniem) oraz zarządzaniu zasilaniem urządzeń elektrycznych. Nowsze rozwiązania oferują więcej możliwości, cechują się ponadto wysokim poziomem autonomiczności, przez co w mniejszym stopniu wymagają interwencji użytkownika. Ponadto często korzystają z koncepcji IoT (Internet of Things), dzięki czemu mogą być obsługiwane za pomocą dowolnego urządzenia z dostępem do Internetu, jak np. smartfona czy laptopa (bardzo często producenci udostępniają w tym celu aplikacje mobilne).

PODSTAWOWE ELEMENTY SYSTEMU AUTOMATYKI DOMOWEJ

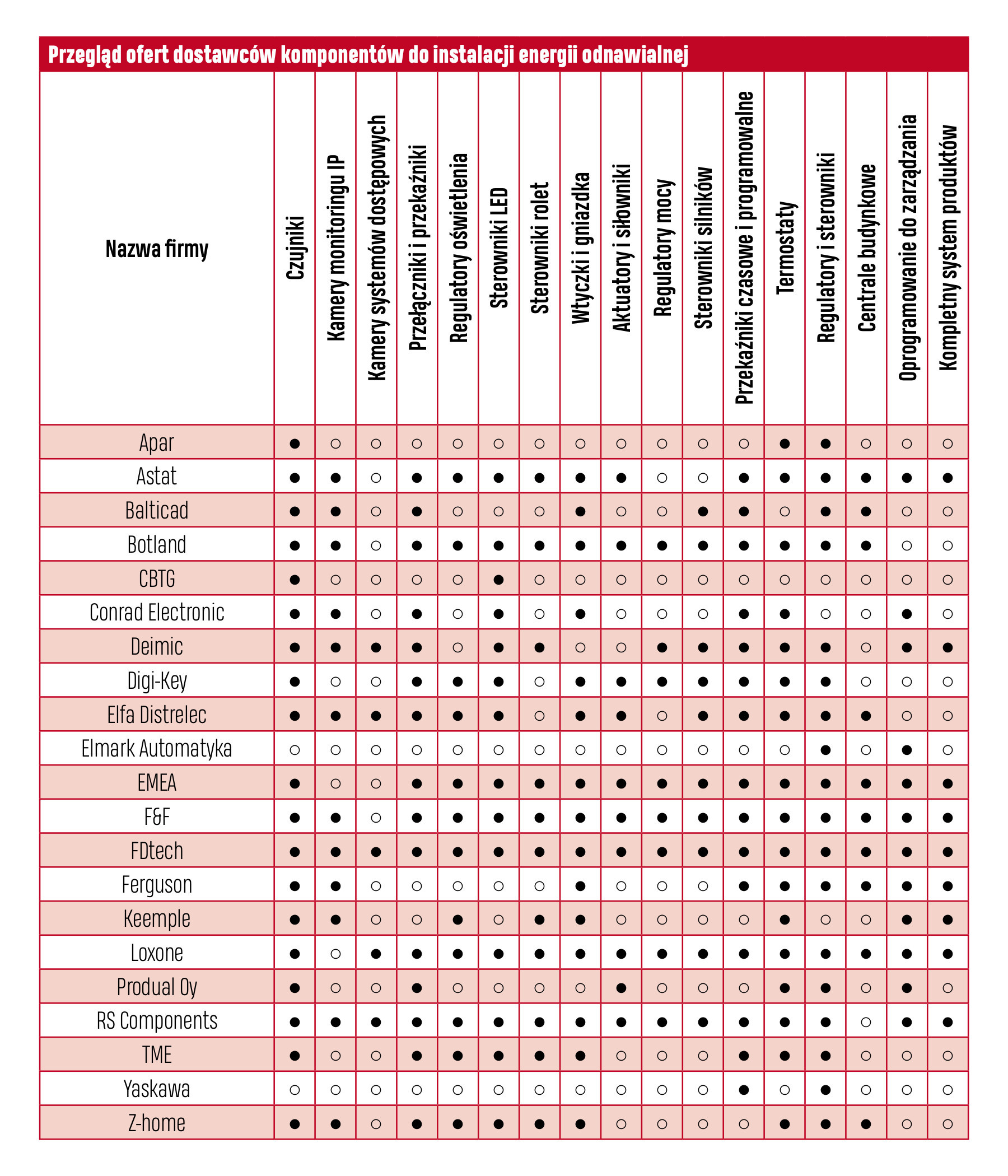

Typowy system automatyki domowej składa się z kilku grup różnych typów elementów. W zależności od rozmiaru i stopnia zaawansowania systemu dana grupa może być reprezentowana przez jeden lub więcej modułów.

Sterownik systemu (BMS) – jest zazwyczaj centralnym elementem, który pośrednio lub bezpośrednio zarządza pracą wszystkich podzespołów, obsługuje również komunikację z użytkownikiem. Może być zrealizowany m.in. w postaci systemu wbudowanego opartego na mikroprocesorze lub jako aplikacja uruchomiona na komputerze wyposażonym w system operacyjny.

Łącze komunikacyjne – zapewnia wymianę danych między poszczególnymi elementami systemu. Połączenie takie może zostać zrealizowane jako przewodowe lub bezprzewodowe.

Czujniki oraz urządzenia wejściowe – za pośrednictwem modułów umieszczonych w różnych miejscach budynku system otrzymuje informacje nt. stanu otoczenia (czujniki) oraz polecenia od użytkownika (interfejsy wejściowe). Podstawowe typy obejmują sensory klimatu, tj. temperatury, wilgotności, potem wersje alarmowe (obecności i ruchu, wstrząsów, pozycji drzwi i okien) oraz bezpieczeństwa, jak detektory gazów. Elementami wejściowymi systemów są też kamery monitoringu, czujniki głosowe, czytniki RFID i podobne. Na podstawie wskazań czujników oraz otrzymanych danych wejściowych system zarządza pracą elementów wykonawczych, takich jak np. ogrzewanie czy oświetlenie.

Urządzenia wykonawcze – a więc przełączniki i przekaźniki, sterowniki rolet, oświetlenia LED (do załączania, regulacji jasności i barwy światła). Są też zdalnie sterowane gniazdka, siłowniki, zawory do sterowania instalacją podlewania. To również termostaty i regulatory do kontroli klimatu.

Przechowywanie danych – jak np. historii wskazań czujników czy zapisu z kamer, wymaga pamięci masowej. Do tego wykorzystuje się głównie rozwiązania serwerowe (np. NAS). Wykorzystanie tego typu układów zwiększa jednak koszt uruchomienia oraz utrzymania systemu, projektanci muszą zatem często szukać kompromisu pomiędzy dostępną pojemnością pamięci a ceną systemu.

Układy zasilania – w systemach automatyki domowej wykorzystuje się różne rodzaje zasilania – od instalacji elektrycznej do zasilania bateryjnego lub akumulatorowego. Niektóre nowoczesne moduły są w stanie częściowo lub całkowicie pozyskiwać energię z otoczenia, wykorzystując np. energię świetlną czy fal radiowych. Podsystemy zasilania większości systemów mają kilka trybów pracy o różnym poziomie zużycia energii elektrycznej, jak np. czuwanie, uśpienie, czy wysoka aktywność. Przełączanie pomiędzy tymi trybami może odbywać się automatycznie lub poprzez decyzję użytkownika.

UWOLNIĆ SIĘ OD KABLI

Bezprzewodowość jest kluczowym czynnikiem przewagi rynkowej produktów do inteligentnego domu, bo przymuszenie konsumentów do instalacji urządzeń wymagających okablowania to zadanie niezwykle trudne. Instalacja musi obejmować wiele takich elementów, rozmieszczonych we wszystkich pomieszczeniach i nawet przy dobrej woli ze strony potencjalnego inwestora często nie da się wykonać okablowania w sposób nieuciążliwy. Nawet jeśli rozwiązania przewodowe bazują na pojedynczej skrętce przewodów wykorzystywanych do zasilania i komunikacji, dla wielu potencjalnych użytkowników jest to nie do przyjęcia z powodu estetyki. To z reguły jest domena dużych budynków użyteczności publicznej, biur i innych miejsc, gdzie instalację przewodów można przewidzieć na etapie budowy lub tam, gdzie są wydzielone kanały techniczne na instalacje.

Problemy te rozwiązuje komunikacja bezprzewodowa, zarówno bazująca na jakimś uznanym standardzie, jak Bluetooth LE lub ZigBee albo bez standardu, w oparciu na protokole producenta lub dostępnym w ramach chipów komunikacyjnych działających w pasmach ISM.

Najnowsze standardy, takie jak Bluetooth w wersji 5, zapewniają na tyle dużą efektywność energetyczną połączenia, że instalowane sensory mogą być z powodzeniem zasilane z baterii jednorazowych, bo starczają one na bardzo długo. Niektórzy producenci proponują nawet niektóre elementy zasilane z energii wolnodostępnej (jako tzw. energy harvesting), z tym że w praktyce dotyczy to przełączników włączających oświetlenie, które czerpią zasilanie z siły przestawiającej klawisz.

URZĄDZENIA MOBILNE

Smartfon lub tablet idealnie nadają się do tego, aby pełnić funkcję elementu sterującego i interfejsu użytkownika dla systemów automatyki budynkowej, bo urządzenia te mają doskonałej jakości wyświetlacze, łączność bezprzewodową i każdy je dzisiaj ma przy sobie. Takie są też oczekiwania użytkowników, którzy oczekują, że z dowolnego miejsca będą mogli sprawdzać stany czujników, sterować urządzeniami lub programować działanie. Nie wszyscy producenci zapewniają takie możliwości, ale wyraźnie widać, że taki jest trend na rynku, a firmy, które przygotowały aplikacje dla sprzętu mobilnego, wyraźnie punktują korzyści z nich płynące i traktują jako rynkowy atut.

Funkcjonalność takich aplikacji i rozwiązań sprzętowych, którymi one sterują, potrafi się znacznie różnić. Niestety często możliwości są niewielkie, a same aplikacje ograniczone do jednego typu działań, np. sterowania oświetleniem. Oznacza to, że jeszcze wiele czasu musi upłynąć, aby wykrystalizował się jakiś poważniejszy pomysł.

Kolejnym krokiem rozwoju interfejsu komunikacyjnego są też asystenci głosowi, czyli oprogramowanie pozwalające na sterowanie za pomocą komend głosowych. Ten obszar produktów dość szybko się rozwija i poza zapewnieniem jeszcze większego komfortu, ważnym aspektem jest tutaj pomoc w codziennym życiu osobom niedołężnym i niepełnosprawnym.

BEZPIECZEŃSTWO

Podobnie jak w przypadku aplikacji IoT, inteligentny budynek również zmaga się z problemem bezpieczeństwa. Gdyby instalacja tworząca te systemy była odcięta od łączności ze światem, pewnie nie byłoby z tym większego problemu, niemniej połączenie z Internetem jednostek zarządzających (BMS, Building Management System) jest ważne dla użytkowników, ponieważ pozwala na dostęp do wielu funkcji przez Internet, w tym z urządzeń mobilnych. Można powiedzieć, że bez dostępu z zewnątrz cała koncepcja straciłaby blask, zatem zapewnienie bezpieczeństwa staje się konieczne. A z tym bywa różnie. Luk w zabezpieczeniach może być wiele: od kiepskich produktów, po niefrasobliwych użytkowników – problemy są praktycznie takie same jak w aplikacjach IoT, bo w dużej mierze oba te obszary tematycznie się przenikają.

Obojętnie, czy problemy z bezpieczeństwem są wyolbrzymione, czy nie, faktem jest, że użytkownicy obawiają się utraty prywatności, tym bardziej że nie mają oni możliwości weryfikacji deklaracji producentów o tym, że produkty są bezpieczne. Technologie komunikacji przewodowej wewnątrz obiektów takie jak KNX są z pewnością w tym zakresie lepsze, ale instalacje kablowe są droższe i trudniejsze w realizacji.

OTWARTY CZY WŁASNOŚCIOWY?

Rozwiązania dostępne na rynku automatyki budynkowej nie są dla wielu osób zrozumiałe w sensie, konfiguracji, współpracy w ramach systemu oraz możliwości użycia produktów od innych producentów. Kryteria doboru też nie są proste. Jest wiele sposobów i dróg budowy systemu, także własnego z użyciem komputerów i oprogramowania open source i setek różnych modułów, które można dzisiaj kupić.

Wielu producentów tworzy własne systemy, hermetyczne, a więc z założenia zamknięte. Jest to po części efekt braku wiodącego standardu, który mógłby scalić produkty pod wspólnym parasolem, a po części kwestia podejścia do biznesu, w którym standard dla wielu firm oznacza "moje rozwiązanie". Kompatybilność jest pojęciem mało znanym w branży, przez co potencjalny inwestor lub użytkownik tak naprawdę nie wybiera produktu, ale decyduje się na wizję inteligentnego domu danego producenta. Ma to swoje dobre i złe strony, np. takie, że produkty wchodzące w skład całości zostały przetestowane pod kątem bezproblemowej współpracy, są obsługiwane przez spójne oprogramowanie itp. Minusem jest to, że potrzeby użytkownika muszą być zaspokojone w ramach dostępnego asortymentu, tak samo możliwości rozbudowy.

Z reguły systemy takie są tworzone jako instalacje długo działające, zatem pozycja danego producenta na rynku w perspektywie kilku lat oraz stopień zaangażowania też mają znaczenie.

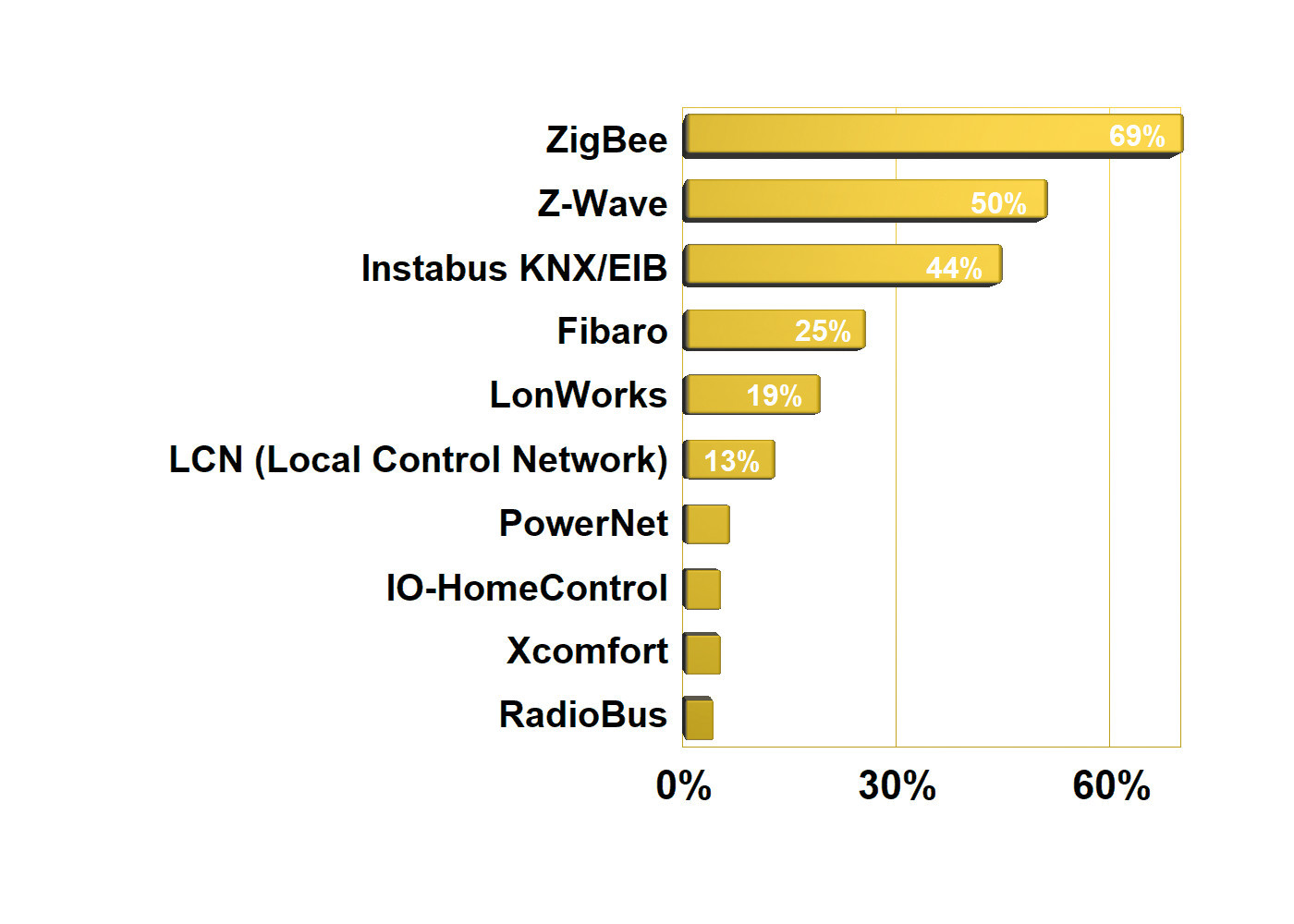

WIELE STANDARDÓW BRANŻOWYCH

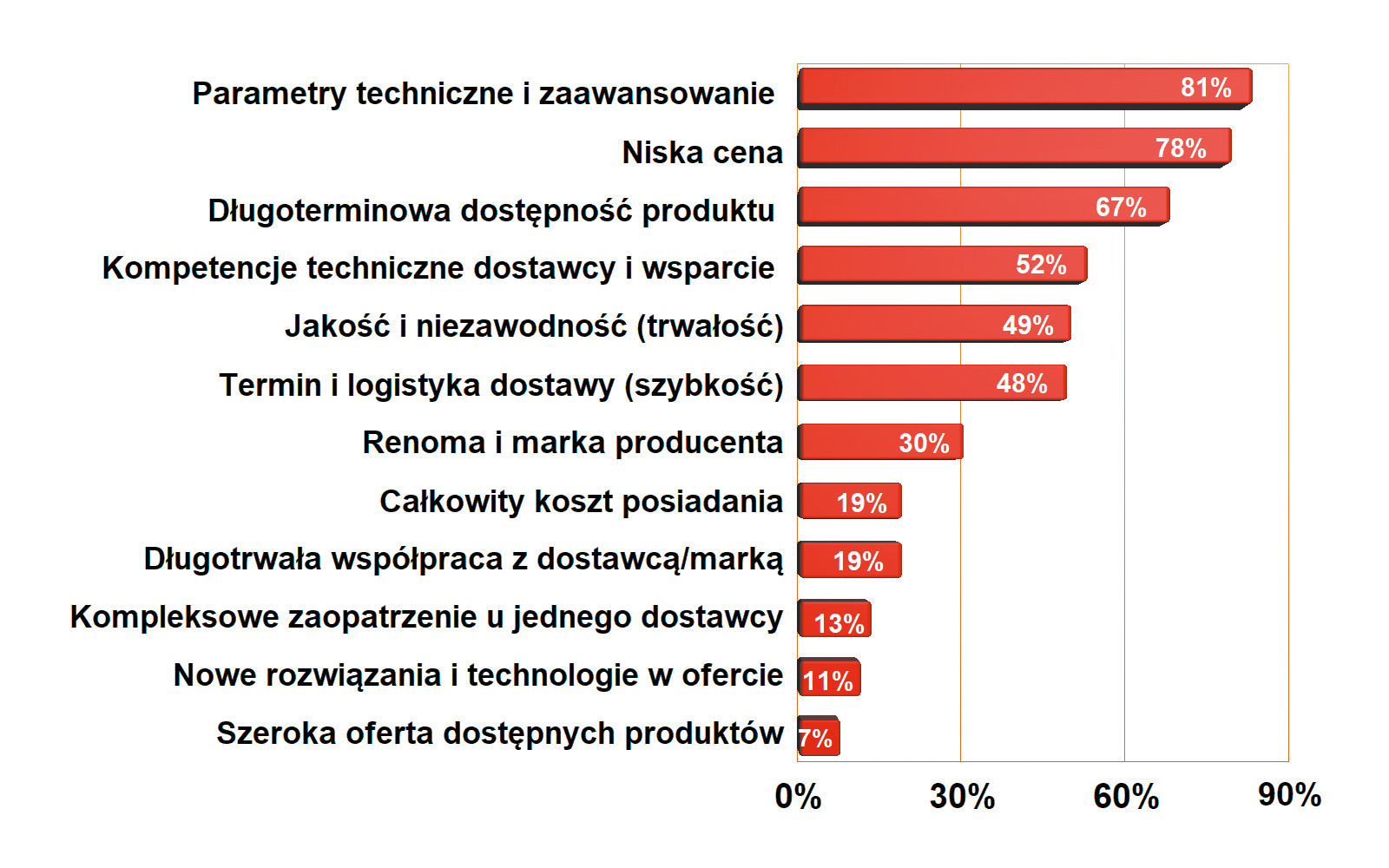

Standardów branżowych, które są wykorzystywane w systemach automatyki budynkowej, jest wiele, a poza nimi spora część rynku obsługiwana jest z użyciem rozwiązań specyficznych dla producenta. Jak można wyczytać z przedstawionych w tym opracowaniu wykresów i z innych publikacji, funkcjonujących rozwiązań jest wiele, przez co kompatybilność produktów jest niewielka lub żadna.

W zakresie rozwiązań przewodowych największą popularność ma KNX (dawniej EIB). Jest to otwarty standard powstały jako połączenie kilku protokołów i koncepcji rozwijających je organizacji: jak EIBA – European Installation Bus Association, European Home Systems Association oraz BatiBUS – BCI, Batibus Club International. KNX jest w stanie obsłużyć instalacje elektryczne, teletechniczne, HVAC, alarmowe, nagłośnienia, monitoring, zabezpieczenia budynków, opomiarowanie i wszystkie inne działające w budynku. Ma zatem duży potencjał i możliwości. Jednocześnie zapewnia energooszczędność, multimedialność i ogromną funkcjonalność. Na jego podstawie powstała europejska norma EN 50090, a w kolejności protokół ten stał się standardem międzynarodowym (ISO) w zakresie automatyzacji budynków i urządzeń – ISO/IEC 14543-3. Europejska organizacja normalizacyjna także uznała KNX za standard dla systemów automatycznego sterowania budynkami publikując specyfikację KNX jako normy EN 13321-1 i EN 13321-2. Również Chiny uznały standard KNX, publikując w 2007 roku, normę GB/Z 20965. Efekt tych działań jest taki, że KNX jest standardem wspieranym przez ponad 400 producentów sprzętu i w zakresie automatyzacji przewodowej dużych budynków może być postrzegany jako numer 1.

KNX jest systemem opartym na konwencji rozproszonej, dzięki czemu nie jest wymagana jednostka centralna. Każdy element magistralny podłączony do instalacji wyposażony jest w procesor i elementy niezbędne do samodzielnej pracy. Dzięki takiemu rozwiązaniu w przypadku awarii system – z wyjątkiem uszkodzonego elementu magistralnego – działa poprawnie, w przeciwieństwie do systemów scentralizowanych, w których podczas awarii cały system przestaje działać. Ale minusem jest to, że komponenty systemowe są bardziej rozbudowane od strony hardware.

Nie wiadomo, czy w przyszłości pozycja KNX się nie zmieni, bo szybko upowszechnia się SPE, czyli Ethernet działający na pojedynczej skrętce przewodów (KNX też jest 2-przewodowy). W zastosowaniach przemysłowych jest to już rozwiązanie popularne i doceniane, jeśli chodzi o możliwość tworzenia instalacji rozporoszonych. Ekspansja SPE w systemach automatyki budynkowej już się zaczyna i być może spowoduje to, że gwiazda KNX nieco przygaśnie, bo rozproszone systemy sterowania w przemyśle i automatyki budynkowej mają bardzo dużo wspólnych cech i transfer technologii jest nieunikniony.

Popularne rozwiązania bezprzewodowe to z kolei ZigBee i Z-Wave, doskonale znane od lat, pod kątem właśnie takich zastosowań opracowane i wreszcie zdobywające rynek. Niemniej rosnąca popularność rozwiązań IoT promuje też w omawianym obszarze Bluetooth LE, bo interfejs ten jest sprzętowo zaszyty w większości platform sprzętowych do takich zastosowań i dostaje się go praktycznie gratis. W zakresie domu istotny jest jeszcze PLC, czyli komunikacja po przewodach energetycznych.

KOSZTY

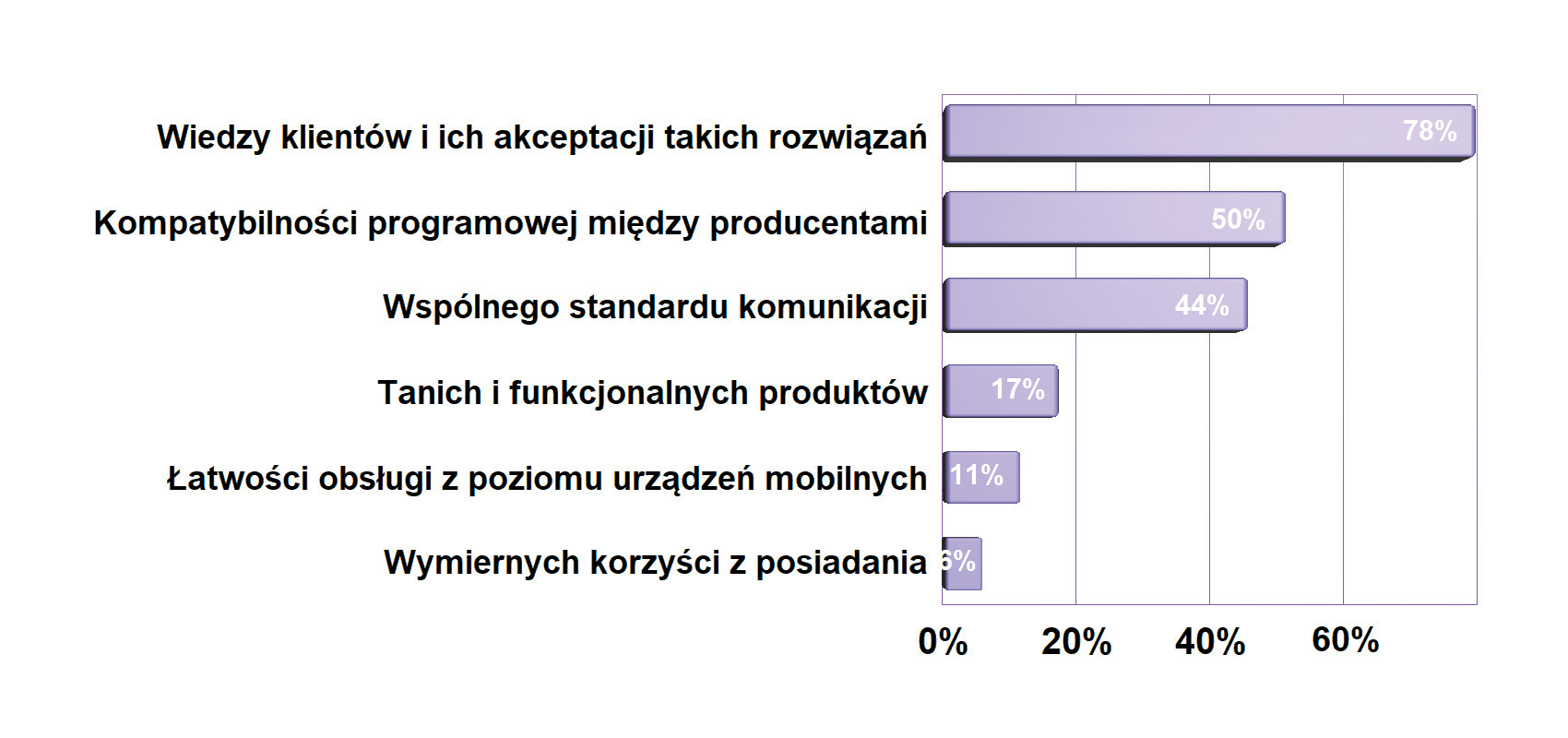

Systemy automatyki budynkowej i domowej są rozwiązaniami kosztownymi, zwłaszcza jeśli mają obejmować wiele zagadnień, cały obiekt i być zbudowane z renomowanych produktów. Wynika to z wielu czynników: cały czas małego efektu skali pozwalającego na produkowanie urządzeń masowo, a więc tanio, dużego rozproszenia rynku na wiele małych firm, braku wspólnego standardu komunikacji, protokołów wymiany danych, który pozwoliłby produkować takie komponenty jako masowy element standardowy. Powodem są także większe koszty promocji i wydatki inżynierskie związane ze stworzeniem komponentów automatyki budynkowej i ich sprzedażą. Na koniec warto zauważyć, że cały czas inteligentne domy i budynki są niszą rynkową i odnieść to do innych produktów, które w takiej fazie rozwoju były drogie, niemniej po przekroczeniu masy krytycznej ceny bardzo się zmniejszyły. Przykładem może być oświetlenie ledowe.

PROBLEM Z KOMPETENCJAMI I WIEDZĄ

Inteligentny budynek to bardzo pojemne hasło, przez co największym problemem wydaje się brak wiedzy użytkowników. Aby na poważnie zająć się automatyką budynkową, konieczna jest orientacja w tym, co jest dostępne, a więc w ofercie, możliwościach i potencjale technicznym, integracji w ramach systemu. Do tego potrzebne jest posiadanie ogólnej koncepcji, co taki system miałby robić, jaką wartość dodaną zapewnić użytkownikowi i z jakimi istniejącymi systemami powinien zostać zintegrowany. Ta druga część nie jest już wcale taka prosta, bowiem wymaga nierzadko interdyscyplinarnego podejścia, szerszych horyzontów technicznych, wykraczających poza wąski wycinek produktów z katalogu automatyki budynkowej.

Produkty takie jak czujniki, siłowniki, przekaźniki są w tym przypadku narzędziami, za pomocą których, niczym z klocków, buduje się większą całość. Takie elementy trzeba umieć rozmieścić, połączyć, zintegrować za pomocą scenariuszy działań w oprogramowaniu, czasem też skonfigurować. Te kompetencje nie są powszechnie dostępne, co niestety tworzy barierę dla rozwoju. Poza wybraniem dostawcy, produktów oraz kupnem oznacza to dużo żmudnej pracy. Im bardziej rozległy i wyrafinowany ma być system automatyki budynkowej, tym oczywiście więcej wysiłku trzeba poświęcić na jego integrację. Nie wszyscy są w stanie ponieść taki wysiłek, tak samo jak nie są w stanie przejść z działań w skali mikro (produktowej) do makro (na poziomie budynku i systemu).

Brak wiedzy przejawia się w tym, że dużo systemów automatyki budynkowej i domowej ma bardzo ograniczony zakres, czyli obejmuje jedynie wycinek dostępnych możliwości, np. tylko sterowanie oświetleniem. Tymczasem im większa integracja, im więcej czujników, tym większą funkcjonalność można uzyskać.

PRZYSZŁOŚĆ TO JESZCZE WIĘKSZA INTEGRACJA

Podstawowymi wymogami stawianymi obecnie systemom automatyki budynkowej są skalowalność i kompleksowość. Zastosowany system powinien obejmować wszystkie występujące w budynku podsystemy monitorujące i nadzorujące prace poszczególnych elementów. Chodzi zarówno o rozwiązania obejmujące: systemy przeciwpożarowe, kontroli dostępu, klimatyzacji, telewizji dozorowej i sieci komputerowej. Alians możliwości nowoczesnej automatyki z IT daje możliwości stworzenia zaawansowanej struktury o dużej autonomii.

rynek, można stwierdzić, że systemy automatyki budynkowej rozwijane są i będą głównie w kierunku możliwości integracji niezależnych systemów, takich jak systemy sygnalizacji pożaru, dźwiękowego systemu ostrzegania, itp. Ważnym elementem jest również możliwość wykorzystywania przez systemy automatyki budynkowej wspólnej platformy okablowania strukturalnego i komunikacji poprzez Ethernet.

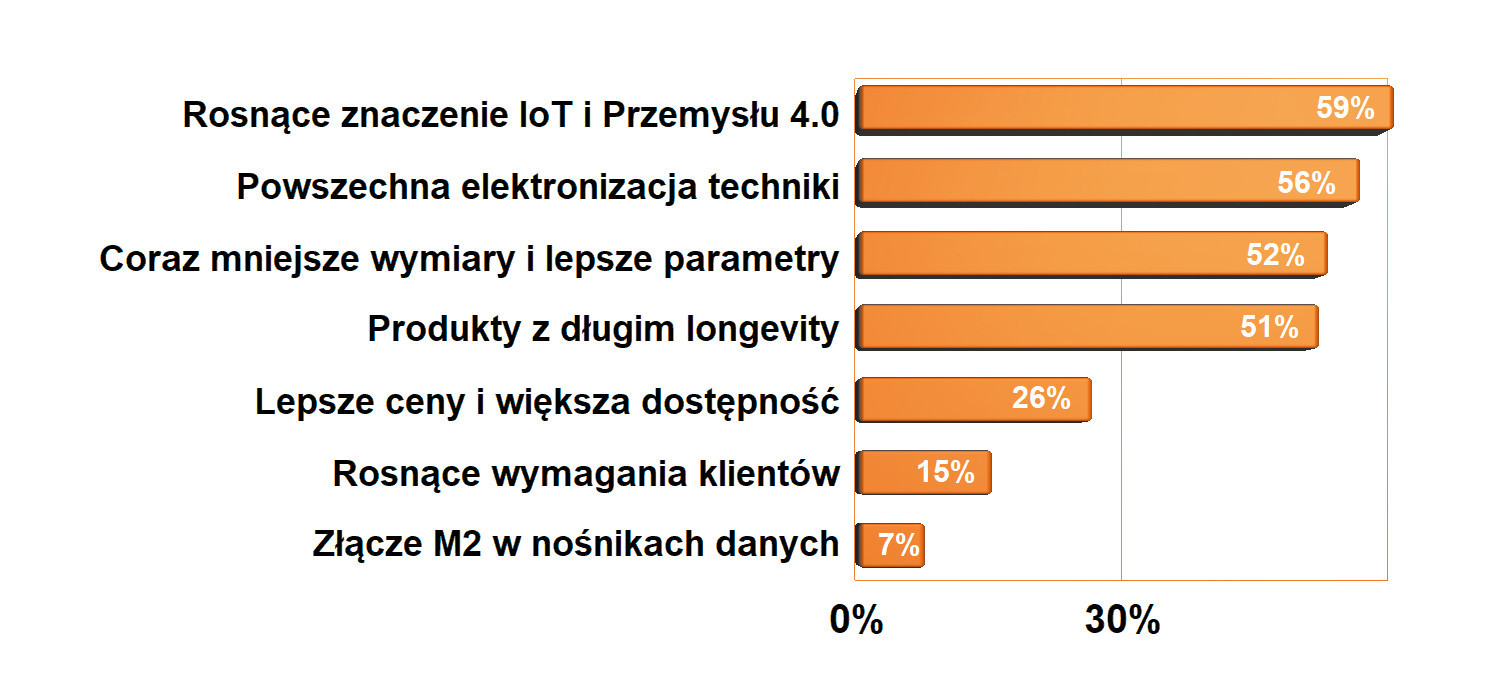

Komputery jednopłytkowe do układów embedded

Zainteresowanie komputerami jednopłytkowymi zawsze było domeną aplikacji medycznych, wojska, świata automatyki przemysłowej i transportu, a w najbliższej przyszłości będą ciągnąć je w górę także aplikacje związane przemysłowym Internetem Rzeczy, Przemysłem 4.0, a także koncepcje takie jak smart city. Maleńkie komputerki są obecnie podstawą wielu aplikacji z tego obszaru, gdyż pobierają niewiele mocy zasilającej przy dużej wydajności i dają się bezproblemowo integrować z aplikacją docelową. Zapewniają dużą szybkość realizacji projektu, bo konstruktor musi w tym przypadku zapewnić jedynie płytę bazową ze złączami interfejsów i zasilaniem.

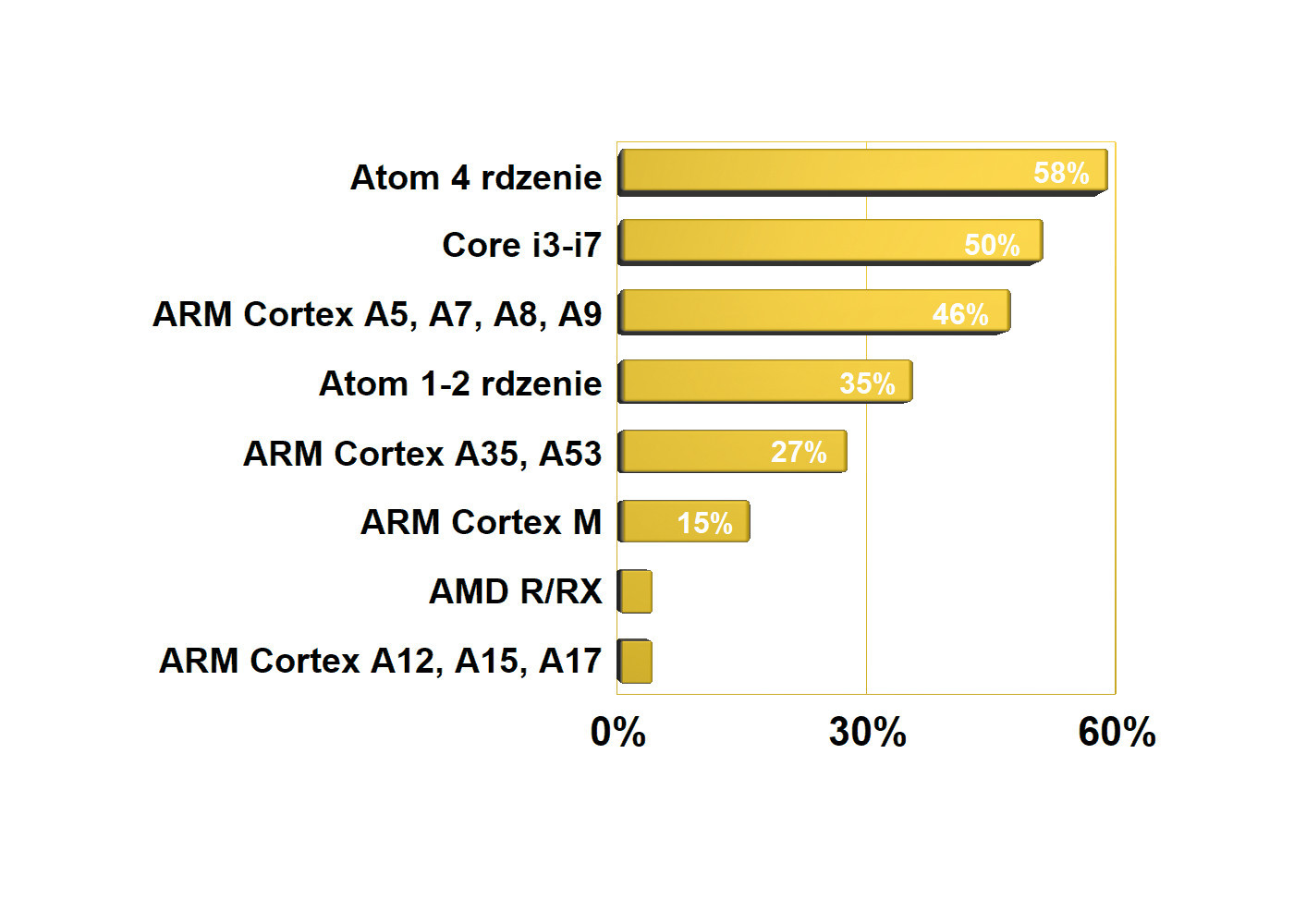

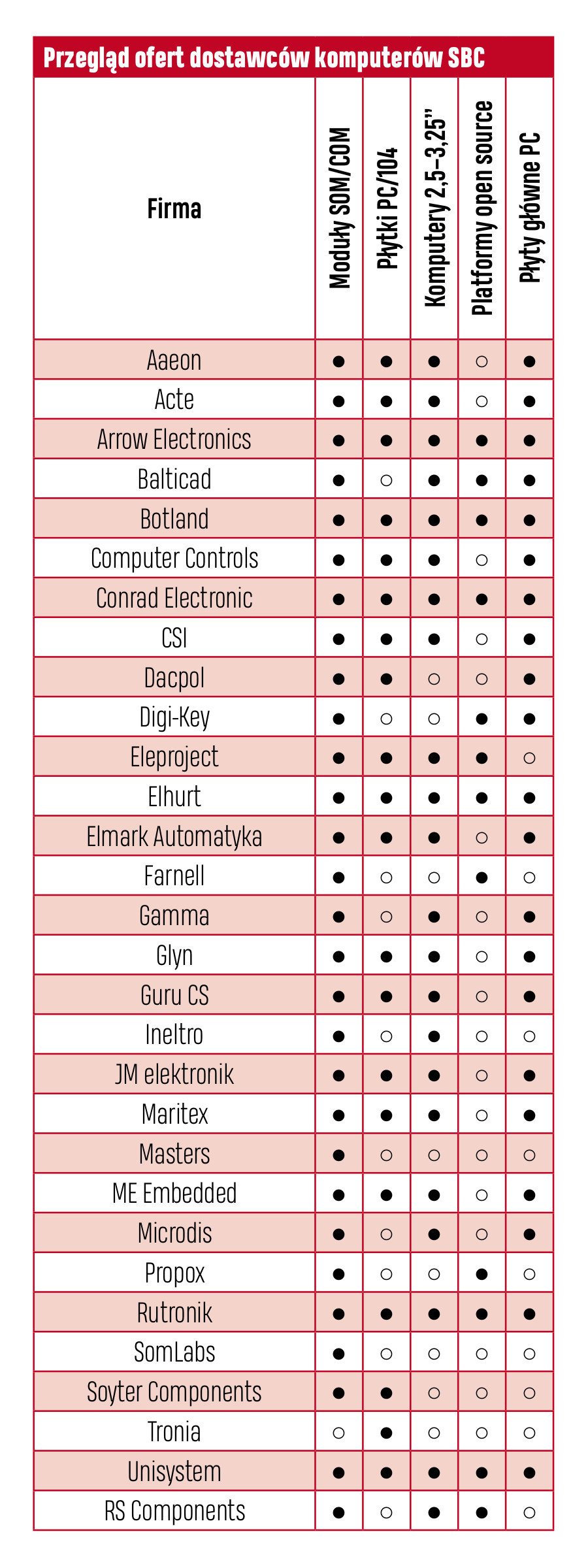

Rynek komputerów jednopłytkowych jest bardzo rozproszony i podzielony między licznych producentów skupionych wokół branżowych organizacji zajmujących się promocją i rozwijaniem standardów (wymiary, złącza, konfiguracje), jak PICMG. Konsolidacje i akwizycje ostatnich lat także zmieniają krajobraz, a nierzadko przetasowania wynikają także z tego, że na rynku pojawiają się nowi gracze. Lista producentów jest w tym przypadku bardzo długa (blisko 40 firm), co powoduje, że konkurencja jest silna, a tempo zmian i ewolucji technicznej produktów relatywnie szybkie. Takie firmy to m.in. Digi, VersaLogic, Wandboard, Eurotech, Advantech, Kontron, Adlink, Radisys, Mercury Systems, Winsonic, Syslogic, Qbic, American Portwell, Arbor Solutions, Aaeon, Diamond Systems, iEi, Avalue, Variscite, DFI, Congatec, iBase, MPL, Protech i wiele innych. Mamy też krajowe firmy, które projektują i produkują takie jednostki, jak na przykład Grinn i SomLabs.

Bezsprzecznie sektor komputerów jednopłytkowych z każdym kolejnym rokiem staje się coraz bardziej otwarty dla "przeciętnego" konstruktora, a coraz niższe ceny i większa dostępność sprawiają, że dostęp do tych rozwiązań jest praktycznie nieograniczony. Rynek SBC przenika się ponadto ze światem tradycyjnych pecetów, z których rozwiązania w postaci nowych wersji miniaturowych płyt głównych stają się bazą dla komputerów przemysłowych, jak na przykład Pico-ITX (100 × 72 mm).

Oprócz nastawienia na coraz większą miniaturyzację, producenci zwracają uwagę głównie na możliwości rozbudowy komputera o kolejne interfejsy we/wy. Poprzez specjalizowane złącze (np. na spodzie płytki SMARC) tworzą w ten sposób rozwiązania podobne do "kanapki", które do tej pory były wykorzystywane w rzadziej już stosowanych komputerach PC/ 104. Wprowadzanie kolejnych generacji energooszczędnych procesorów Intel Atom, Celeron czy Pentium spowodowało, że producenci wypuszczają na rynek nowe modele komputerów SBC z interfejsami do tej pory niewystępującymi, jak np. dla pamięci dyskowej w postaci złączy M2.

KONKURENCJA ZE STRONY PLATFORM OPEN SOURCE

Na rynku elektroniki profesjonalnej zawsze dało się wyróżnić trend polegający na używaniu sprzętu o gorszych parametrach w wymagających aplikacjach. Najczęściej dotyczyło to zakresu temperaturowego i urządzeń przeznaczonych do pracy na zewnątrz budynków, także tych działających w trudnych warunkach przemysłowych, systemach monitoringu i bezpieczeństwa oraz podobnych zastosowaniach.

Komputery, nośniki pamięci, kamery, sprzęt infrastruktury sieciowej i telekomunikacyjny do takich aplikacji musi mieć możliwość pracy w zakresie temperatur od –40 do +70°C i za ten szeroki zakres trzeba było zapłacić dużo więcej niż za równoważne rozwiązania konsumenckie (0‒40°C). Przebitka była na tyle duża, że plagą rynku było aplikowanie sprzętu konsumenckiego w takich zastosowaniach, całkowicie bezmyślnie, a więc ze złudną nadzieją, że będzie mimo to działać lub ze wspomaganiem w postaci np. termostatu, dodatkowego chłodzenia itd. To samo dotyczyło nośników pamięci Flash, gdzie tanie produkty konsumenckie trafiały do wymagających rozwiązań profesjonalnych.

Podobne działania miały miejsce w urządzeniach wojskowych, gdzie mówiło się o produktach COTS, a więc właśnie zmodernizowanych, ulepszonych urządzeniach komercyjnych, które przystosowano do pracy w sprzęcie wojskowym. To dostosowanie polegało na rozbudowie chłodzenia, hermetyzacji itd. Tematy te były bardzo nośne jeszcze dekadę temu, ale obecnie kompletnie zeszły na margines.

Powody mają charakter ekonomiczny i techniczny. Ten pierwszy wiąże się z tym, że większa konkurencja, szersza oferta rynku, większa liczba producentów i dystrybutorów aktywnych w temacie komputerów jednopłytkowych zmniejszyły różnicę między produktami różnych typów. Można powiedzieć, że to te profesjonalne są dzisiaj relatywnie tańsze, zwłaszcza w odniesieniu do zarobków, poziomu cen innego sprzętu technicznego itd. Sam rynek elektroniki jest dzisiaj znacznie większy i stąd wolumeny sprzedaży są większe, dzięki czemu koszty stałe przedsiębiorstw rozkładają się na większą liczbę sztuk.

Druga przyczyna ma charakter techniczny i wiąże się ze wzrostem zaawansowania technologii półprzewodnikowej. Nawet tanie chipy działają w szerokim zakresie temperatur i granice między tymi do zastosowań profesjonalnych i konsumenckimi nie są tak wyraźne. Procesory nie zawsze są też wydzielonymi chipami, a więc wykonywanymi w osobnym procesie i zamykane w obudowach. Wiele produktów ma je zintegrowane w ramach układu SoC razem z pamięcią, pomocniczą logiką itp. Jest to możliwe, ponieważ procesor można kupić jako kod VHDL w postaci bloku IP i zintegrować go z niezbędną resztą na jednym płatku krzemu. Takie SoC-e produkowane są na tych samych urządzeniach co inne i stąd zwykle mają doskonałe parametry temperaturowe.

Skutkiem tych procesów jest to, że tanie i popularne komputery jednopłytkowe, czego doskonałym przykładem może być Raspberry Pi, mają całkiem dobre parametry środowiskowe i są z powodzeniem aplikowane w aplikacjach komercyjnych, odbierając rynek rozwiązaniom specjalizowanym.

Platformom open source najbardziej brakuje wieloletniej dostępności, przez co ich możliwości aplikacyjne sięgają jedynie obszaru półprofesjonalnego, a więc takiego o łagodnych wymaganiach.

CUSTOMIZACJA

Komputer jednopłytkowy to dzisiaj produkt, który jest dostępny w bardzo wielu wykonanych, wersjach, typach, różniących się wyposażeniem, możliwościami i ceną. Celem jest to, aby zaproponować klientowi produkt jak najlepiej dopasowany do jego potrzeb, bez konieczności przepłacania za niewykorzystywane interfejsy, złącza, pamięć, komunikację itd. Ponieważ cena takiego produktu jest ważnym czynnikiem aplikacyjnym, takie działania sprzyjają konkurencyjności komputerów jednopłytkowych w porównaniu do innych rozwiązań.

Istotność danej cechy komputera SBC zależy od typu rynku, na jakim działa klient, czy ma dużą konkurencję oraz przeznaczenia produktu. Mnogość różnych modeli, formatów płytek, pozwala na dobór odpowiedniego rozwiązania, a przy większych zamówieniach jest możliwość modyfikacji w postaci dodania czy usunięcia interfejsów, dodania funkcjonalności BIOS-u itp). Niektórzy producenci idą jeszcze dalej i podejmują się produkcji rozwiązania typu custom lub semi- -custom nawet dla małych zamówień. Wymaga to od nich odpowiedniej organizacji, ale można podać przynajmniej jeden przykład firmy, która się tego podejmuje (Advantech).

MAŁA SERIA = DUŻY PROBLEM

W warunkach krajowych komputery jednopłytkowe są postrzegane jako istotny produkt, bo wytwarzamy krótkie serie specjalistycznych urządzeń, do których nie opłaca się tworzyć własnego sterownika. Próg opłacalności określający minimalną skalę realizowanej produkcji własnej, która jest niezbędna do tego, aby taka konstrukcja miała sens ekonomiczny, z upływem lat jest coraz mniejszy i określa się na około 4‒5 tys. sztuk rocznie. W realiach krajowych to dość dużo, co skutecznie wybija z głowy pomysły rozwijania własnych platform.

Niemniej duża część rozwiązań przemysłowych jest w Polsce realizowana jako projekty tworzone przez integratorów, firmy inżynierskie lub też producentów specjalistycznych urządzeń na zamówienie. Tak zdefiniowany obszar działania obejmuje rozwiązania liczone w pojedynczych sztukach, przez co nawet aplikacja komputerów jednopłytkowych napotyka na barierę opłacalności i czasu.

Przy takich małych ilościach w zdecydowanej większości przypadków zastosowanie komputera jednopłytkowego wiąże się z ogromem dodatkowej pracy związanej z przygotowaniem obudowy zapewniającej wymaganą ochronę przed oddziaływaniem środowiska zewnętrznego, dobrej jakości układu zasilania, wymaganych peryferii oraz przygotowania płytki bazowej. Dodatkowo takie urządzenie w celu uzyskania odpowiedniego certyfikatu musi zostać przetestowanie pod względem poprawnej pracy w różnych warunkach np. pod wpływem niskiej lub wysokiej temperatury. Cały ten proces jest kosztowny i pracochłonny. W przypadku większych projektów jest to opłacalne, bo dostarczane jest urządzenie szyte na miarę. Niemniej wielu klientów woli drogę na skróty, czyli użycie gotowego komputera z półki (typu Box). W przypadku niewielkiego projektu fakt, że dane urządzenie nie będzie idealnie dopasowane do danej aplikacji (przykładowo tylko niewielka liczba dostępnych portów będzie wykorzystana) nie jest taki istotny, ponieważ w porównaniu do rozwiązania opartego na SBC, relatywne koszy integracji będą niższe, a czas wprowadzenia produktu na rynek (time to market) zdecydowanie krótszy. Koszt pracy inżynierskiej ma coraz większy udział w przygotowaniu produktu i każde działanie, które prowadzi do oszczędności czasu i wysiłku włożonego w przygotowanie sprzedaży, ma realny wymiar kosztowy.

MINIATURYZACJA I MAŁY POBÓR MOCY

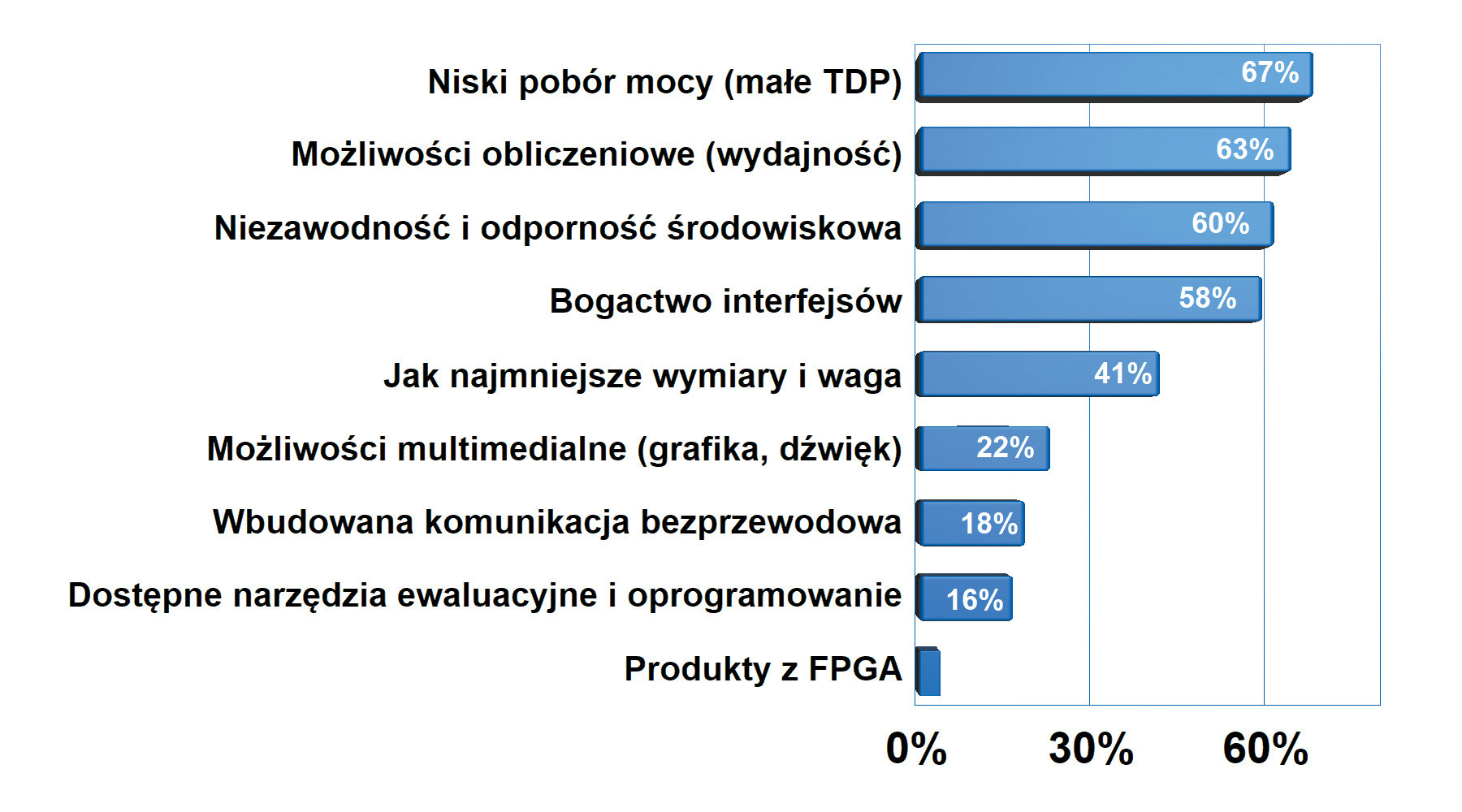

Niewielki pobór mocy przy zachowaniu dużej wydajności obliczeniowej jest najważniejszym trendem technicznym zmieniającym nie tylko rynek komputerów jednopłytkowych, ale całą elektronikę. Efektem tego procesu jest to, że wielkość komputerów głównie ograniczają złącza i obudowa, a wzrost wydajności obliczeniowej przestał być czymś, do czego się bardzo dąży. Najbardziej widać to w zakresie pecetów, ale w przypadku omawianych urządzeń też daje się to dostrzec.

Skoro można kupić peceta w obudowie wielkości pendrive’a, to także w zakresie komputerów do zastosowań embedded gotowe rozwiązania są nieduże. To po raz kolejny potwierdza, że w wielu zastosowaniach dobrym wyborem staje się wykorzystanie komputera typu Box, a więc małe jednostki w obudowie chłodzone pasywnie, bo jest ona tylko nieznacznie większa, tylko trochę droższa, ale ma już rozwiązany problem chłodzenia, zasilania, złączy i mocowania (np. na szynę DIN, VESA itd.). A do komputera jednopłytkowego, np. takiego w postaci modułu o wielkości równoważnej pamięci DRAM do komputera, trzeba jeszcze dodać płytę bazową, której przygotowanie też jest czasochłonne i kosztowne, zwłaszcza gdy seria jest mała.

IOT I PRZEMYSŁ 4.0

Przemysłowy Internet Rzeczy oraz Przemysł 4.0 to dwa ważne trendy, które zmieniają współczesny rynek elektroniki. Oba wiążą się w pewnym zakresie z obszarem komputerów jednopłytkowych, gdyż tytułowe produkty są aplikowane w takich obszarach. Niemniej granice są tu bardzo płynne – cały obszar IoT oraz przemysłowego IoT (IIoT) jest nieprecyzyjnie zdefiniowany i w praktyce wrzuca się do niego miniaturowe rozwiązania czujnikowe zasilane z baterii i bardzo wysoko zintegrowane (do jednego chipu najczęściej), a także komputery do zastosowań embedded wykorzystywane w automatyce przemysłowej, sieciach komputerowych i telekomunikacyjnych, a także wszystkich aplikacjach "smart". Jest oczywiste, że dla rynku SBC te rozwiązania najbardziej bliskie idei IoT, a więc maksymalnie zintegrowane, są niedostępne, obojętnie, kto i jak by je kategoryzował i naciągał. W omawianym temacie prędzej chodzi o koncepcję Przemysłu 4.0 oraz ogólną automatyzację i podłączanie do sieci. Myjnia samochodowa, automat sprzedaży, stacja pomiarowa monitoringu czy aparat EKG to przykłady takich rozwiązań, gdzie potrzebny jest jakiś komputer. Można dyskutować, czy w danym zastosowaniu wystarczy jeszcze mikrokontroler, czy już potrzebna jest większa wydajność, ale w praktyce decyzje są wielowymiarowym zagadnieniem. Proste zdalne sterowanie automatem sprzedaży z kontrolą przez sieć można zrealizować na kilkanaście możliwych sposobów z użyciem gotowych modułów z mikrokontrolerami, sprzęt medyczny być może będzie wymagał komputera SBC, który zapewni pamięć, wydajność i grafikę, natomiast aplikacja klasy digital signage być może najprościej powstanie z użyciem komputera Box. Bezsprzecznie mamy dzisiaj bardzo dużo możliwości realizacji urządzeń i nie ma jednego uniwersalnego podejścia.

ROLA STANDARDU

W obszarze komputerów jednopłytkowych ważną rolę odgrywają standardy zapewniające możliwość korzystania z produktów wielu producentów. Chodzi o zapewnienie zgodności mechanicznej i pinowej, użycie jednakowego złącza, zasilania itd. Korzystając z rozwiązań standardowych, można zapewnić sobie większą swobodę wyboru producenta. Standardy w tym obszarze są także istotne dla tych, którzy wytwarzają urządzenia oparte na danym typie przez wiele lat, np. w obszarze medycyny.

Za pozytywną wiadomość można uznać to, że tych standardów definiujących obszar SBC nie ma już dzisiaj wcale tak wiele, przez co funkcja jaką pełnią one w branży, się zwiększa. Być może wynika to z tego, że w mniejszym stopniu są one wynikiem narzucenia przez duże firmy swoich pomysłów, a w większym stopniu, że jest to wspólny projekt stowarzyszenia lub organizacji branżowej. Ostatnim ważniejszym wydarzeniem sprzed kilku lat był tutaj debiut SMARC, teraz nadchodzi COM- HPC. Nazwa taka w praktyce określa tzw. form factor, czyli wymiary, rozkład złączy, możliwości w zakresie chłodzenia, tak aby zapewniona była możliwość wymiany produktów kompatybilnych.

Nie da się jednak ukryć, że część producentów nie zaprząta sobie głowy normalizacją i tworzy własne konstrukcje. Popularnym formatem jest płytka o wielkości pamięci DRAM do peceta, bo łatwo do niej kupić złącza i wiele oprogramowania inżynierskiego ma takie komponenty w bibliotekach.

TDP

Jednym z ważniejszych parametrów determinujących przydatność aplikacyjną komputerów jednopłytkowych jest TDP. Skrót ten opisuje maksymalną moc strat cieplnych dla procesora, czyli taką wartość, jaka może w systemie pojawić się w najbardziej niekorzystnym przypadku. W tym chodzi o pełne obciążenie obliczeniowe i komunikacyjne tego układu. TDP jest wartością rzadko pojawiającą się w normalnym działaniu, bo wykorzystywane techniki oszczędzania energii np. poprzez wyłączanie bloków nieużywanych lub ograniczanie taktowania powodują, że podczas realizacji typowych zadań pobór mocy jest ułamkiem wartości maksymalnej. Dla komputera z TDP 15 watów typowy pobór mocy (run mode) może być na poziomie 1‒3 watów, a w czasie hibernacji poniżej 0,1 W. Ale komputer musi być zaprojektowany na to, aby taką moc ciepła rozproszyć, stąd wartość TDP jest istotna w omawianym obszarze, gdyż determinuje wielkość konstrukcji i pośrednio także wiele innych parametrów. Procesory do komputerów desktop mają TDP z przedziału 50‒100 W, wersje mobilne 20‒40 W, te dla komputerów SBC zwykle mają TDP poniżej 15 W, najlepsze poniżej 10 W.

LONGEVITY

Komputery jednopłytkowe są produktami z założenia trafiającymi do urządzeń i aplikacji profesjonalnych, a więc takich, które są używane przez wiele lat. Możliwość utrzymania w ruchu maszyny lub innego sprzętu działającego w hali produkcyjnej przez długie lata jest bardzo istotna, stąd możliwość kupienia produktu po długim czasie od rynkowego debiutu jest tutaj ważna, bo ogranicza ryzyko przeprojektowania konstrukcji lub też uzyskania nowej certyfikacji. Koszty serwisowania urządzeń są również istotne, szczególnie jeżeli producent działa na rynku międzynarodowym. W tym przypadku pojedynczy serwis urządzenia komercyjnego może wynieść więcej niż różnica w zakupie. Stąd w cechach produktu pojawia się parametr określający, przez ile lat producent gwarantuje dostępność tego modelu na rynku (longevity).

Oferta produktów, które mają gwarantowaną długą dostępność, systematycznie się zwiększa. Kiedyś było to 5 lat, potem 7, a następnie 10 lat. Dekada też nie jest jakimś rekordem, bo wystarczy poszperać chwilę, aby znaleźć na przykład wersje z gwarantowaną 15-letnią dostępnością. To na tym rynku bardzo długo.

Pomocne jest też to, że często nowe wersje wprowadzane na rynek są zgodne mechanicznie, elektrycznie i programowo ze starymi rozwiązaniami. Ta pełna kompatybilność nie zawsze obowiązuje i nie przez cały czas, ale zasada jest taka, że jeśli w nowej wersji daje się zapewnić zgodność, to zwykle producenci ją zapewniają i nie zmieniają cech tak sobie. Jest to zupełnie odmienne podejście w porównaniu do rynku konsumenckiego, gdzie niekompatybilność nowych wersji jest celowo wprowadzana przez producentów po to, aby zmusić użytkowników do wymiany.

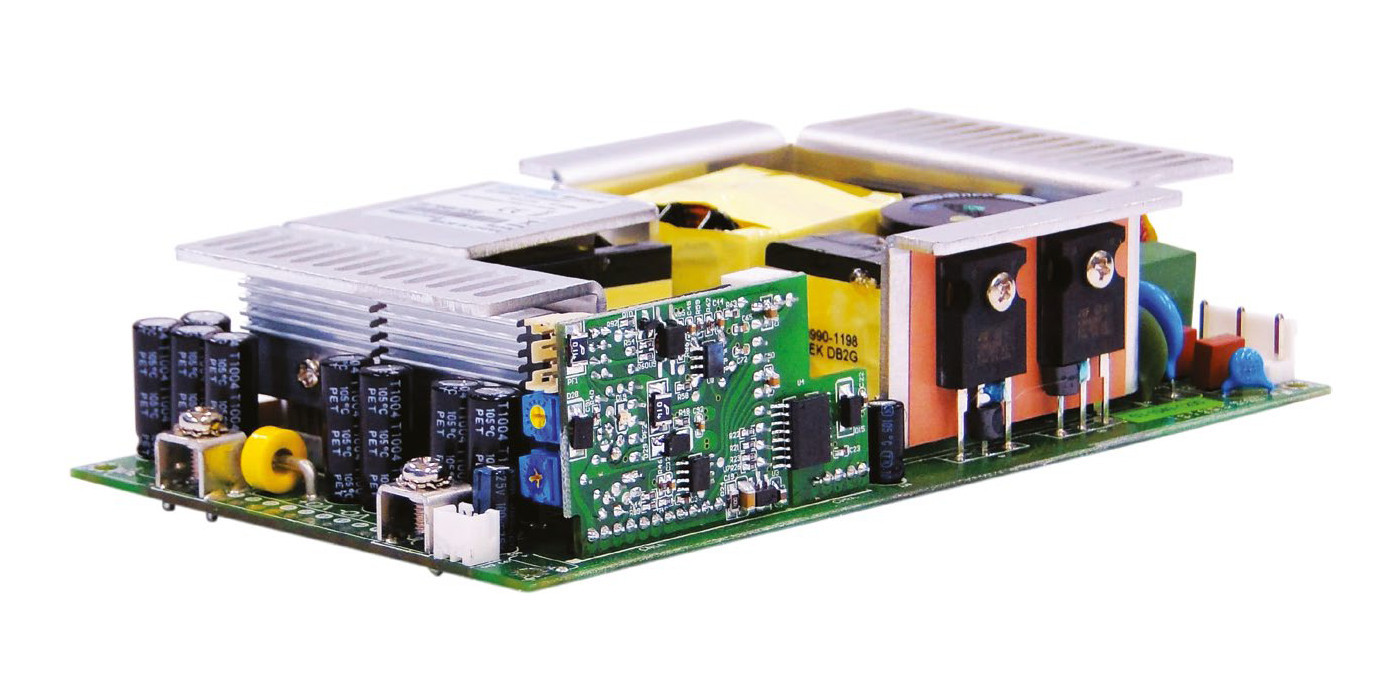

Zasilanie dla elektroniki mobilnej i IoT

Współczesny zasilacz, a zwłaszcza ten wykorzystany do zasilania urządzeń mobilnych, to taki, którego budowa opiera się na najnowszych dostępnych na rynku technologiach konwersji energii, materiałach i komponentach. Z tym bywa różnie – wystarczy otworzyć obudowę, aby przekonać się, że wiele jednostek dostępnych na rynku to konstrukcje, w których takich nowinek się nie znajdzie. Powodów tego jest wiele, ale przede wszystkim chodzi o cenę, która jest ważnym kryterium wyboru produktu. Nowe komponenty i materiały zwykle są droższe od tych popularnych, dlatego musi minąć sporo czasu, zanim nowości trafią do wnętrza zasilaczy dostępnych w handlu. Można nawet pokusić się o stwierdzenie, że im zasilacz popularniejszy, tańszy i standardowy, tym jego wewnętrzna konstrukcja częściej opiera się na dojrzałych rozwiązaniach.

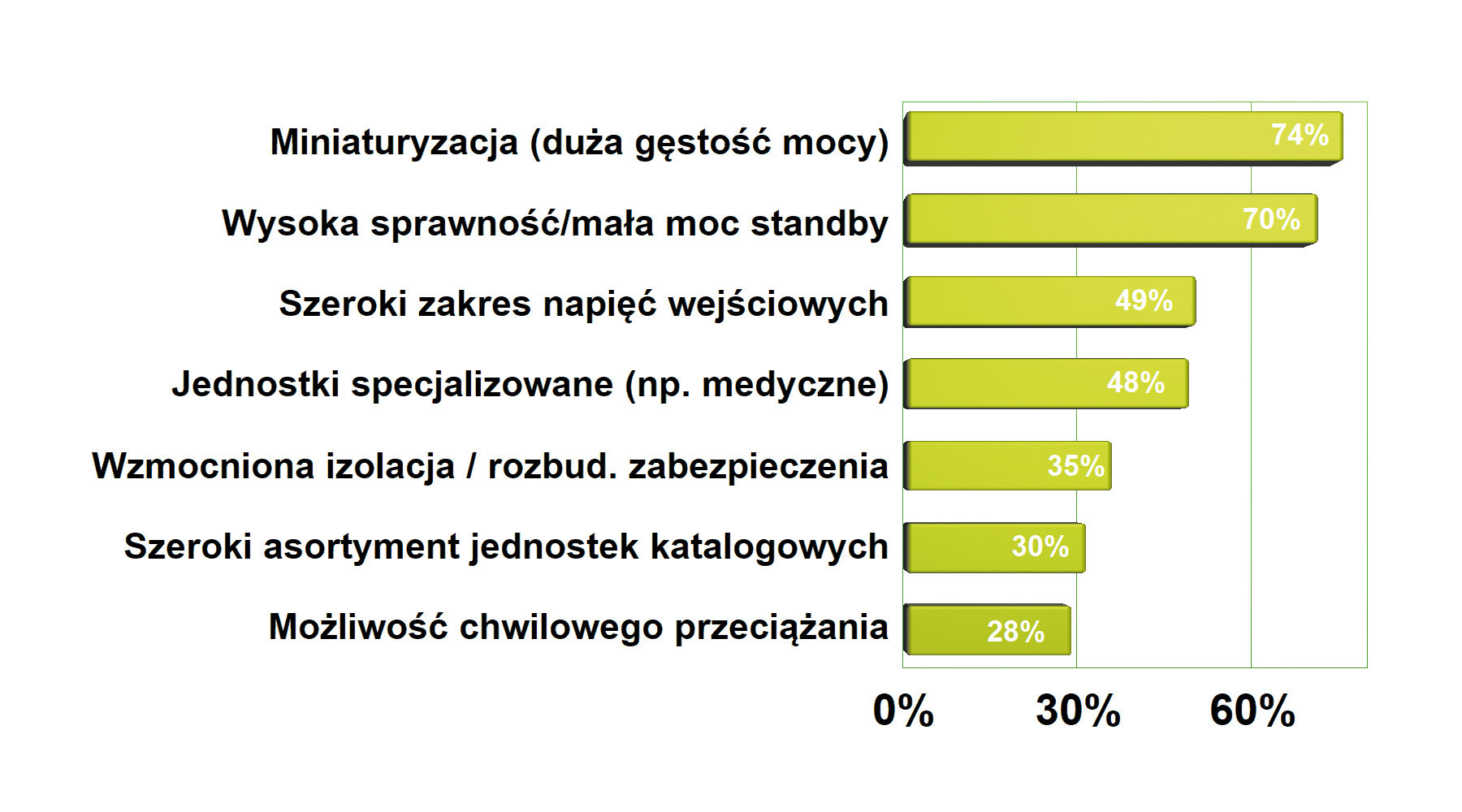

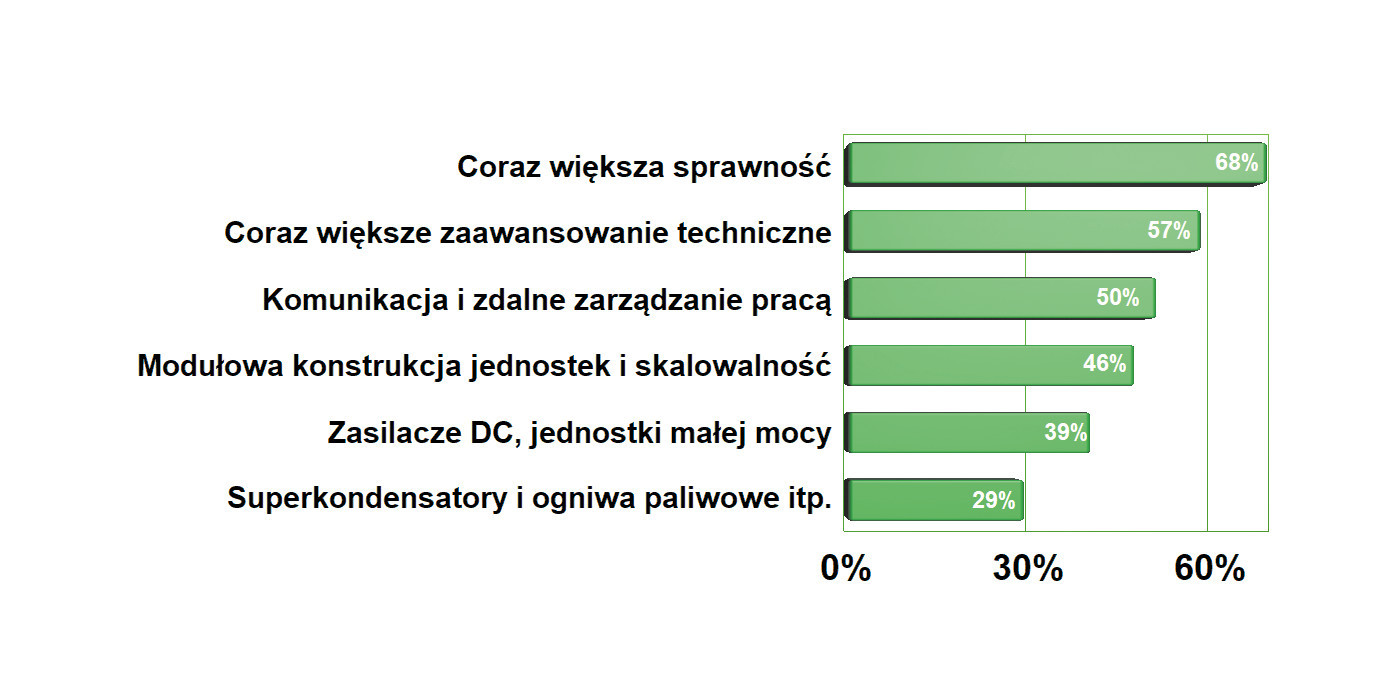

MINIATURYZACJA I DUŻA SPRAWNOŚĆ

Każda kolejna generacja zasilaczy wchodzących na rynek ma coraz większą sprawność, a w najlepszych jednostkach sięga ona 95‒96%. Wiele popularnych produktów konsumenckich o mocy wyjściowej rzędu 25 watów i napięciu 12 V ma dzisiaj sprawność rzędu 90% i jest to o min. 10% więcej, niż było dekadę temu. Wysoka sprawność to oszczędność energii zasilającej, a więc mniejsze rachunki oraz dłuższy czas pracy z akumulatora. Wysoko sprawny zasilacz mało się grzeje, a więc może też pracować w szerszym zakresie temperatur, a cała konstrukcja może być bardziej zminiaturyzowana, bo nie ma potrzeby rozpraszania tak dużej mocy cieplnej, robienia wentylowanej obudowy itd.

Wysoka sprawność oznacza często też małą awaryjność zasilaczy, a więc pośrednio wysoką jakość. Takie jednostki mało się grzeją, więc ich podzespoły nie są tak obciążone cieplnie (kondensatory elektrolityczne). Są mniejsze, a więc też mogą być tańsze w produkcji, bo nie potrzeba do nich dużych radiatorów. Także ograniczenia na moc wyjściową przy dużych temperaturach otoczenia stają się łagodniejsze. Wysoka sprawność zasilaczy lub konieczność korekcji współczynnika mocy przy dużej mocy wyjściowej jest ponadto dla coraz większej grupy produktów wymogiem prawnym.

W zakresie zasilaczy mniejszej mocy nowe zasilacze mają bardzo małą moc pobieraną bez obciążenia. Jest to parametr szczególnie ważny w jednostkach, które są podłączone do sieci przez cały czas i nie mają wyłącznika. Jest ona już mierzona w pojedynczych miliwatach, a producenci półprzewodników, czyli układów sterujących i zasilaczy, wkładają wiele wysiłku w to zagadnienie, co chwila bijąc rekordy oszczędności i ekologiczności.

NOWE WYMAGANIA EKOPROJEKTU I NORMA BEZPIECZEŃSTWA

Pierwszego kwietnia 2020 r. weszło w życie rozporządzenie Komisji Europejskiej nr 2019/1782. Jest ono bardzo ważne dla rynku zasilania, gdyż przynosi ono nową regulację w zakresie wymaganej minimalnej sprawności zewnętrznych zasilaczy impulsowych adapterowych, mocy pobieranej bez obciążenia i nakłada wymagania odpowiedniego oznaczania zasilaczy i prowadzenia ich dokumentacji technicznej. Wymogi są zgodne co do joty z amerykańskimi regulacjami DoE Level VI.

Nowością jest to, że regulacjami objęto także zasilacze wielonapięciowe, co zamyka furtkę do wprowadzania na rynek niskosprawnych jednostek, które miały dodatkowe wyjście wyłącznie po to, aby nie musieć spełniać norm. Wymagania związane z małą mocą pobieraną bez obciążenia (nie więcej niż 0,1 W) zamykają też rynek dla zasilaczy adapterowych bazujących na klasycznych transformatorach sieciowych. Rozporządzenie nakłada też dodatkowe obowiązki informacyjne na dostawców: materiały techniczne oraz opisy produktów muszą zawierać informacje o średniej (a nie maksymalnej jak do tej pory) sprawności podczas pracy, a także o sprawności przy 10-procentowym obciążeniu oraz zużyciu energii w stanie bez obciążenia. Zasilacze zewnętrzne o znamionowej mocy wyjściowej 10 W lub mniejszej są zwolnione z tego wymogu. Do tej pory takie dane były ukryte w kartach katalogowych, teraz muszą być prezentowane także w opisach drukowanych i podawanych w sklepach internetowych.

Aby tego nie było dosyć, 20 grudnia 2020 roku w życie weszły w życie nowe wymagania w zakresie oceny bezpieczeństwa użytkowania. Dotychczasową normę EN 60950-1 zastąpi IEC 62368-1 i ta nowa regulacja będzie stanowiła wzorzec oceny zasilaczy w przyszłości. Jednostki wprowadzane na rynek w przyszłym roku będą musiałby być z nią zgodne, co zmusi producentów do przeanalizowania konstrukcji i uaktualnienia dokumentacji. Nie wiadomo na razie, czy konieczne będzie wykonywanie dodatkowych badań zasilaczy będących w ofertach, czy jedynie wystarczy przegląd konstrukcji pod kątem nowej normy. To dlatego, że regulacja 62368 jest ukierunkowana na osiągnięcie pożądanych, całościowych wyników końcowych, a nie na wskazanie i opisanie sprzyjających temu wyróżnionych procesów, sposobów wytwarzania lub procedur. Nie ma ona też charakteru nakazowego jak poprzednie. Raczej pokazuje, jak identyfikować i klasyfikować źródła energii mogące stanowić zagrożenie, jak wybierać i stosować zabezpieczenia przed określonymi rodzajami energii stanowiącej zagrożenie, zamiast mówić "przerwa izolacyjna musi mieć minimum 4 mm". Bezsprzecznie dla rynku zasilania jest to duża zmiana.

JAK POZNAĆ KIEPSKĄ KONSTRUKCJĘ ZASILACZA?

Tanie i kiepskie zasilacze z reguły wyglądają tak samo, jak te markowe i na pierwszy rzut oka odróżnienie dobrego od kiepskiego nie jest łatwe. Bez rozebrania jednostki niewiele można powiedzieć na temat jakości, więc jeśli ktoś planuje kupować zasilacze po to, aby używać ich w dłuższej perspektywie, na przykład do urządzeń produkowanych w seriach, powinien poświęcić przynamniej jedną sztukę na badania.

Ocenę warto zacząć od zbadania parametrów elektrycznych, a więc poziomów napięć bez obciążenia i z obciążeniem, pomiaru sprawności i tętnień w napięciu wyjściowym. W dalszym kroku można ocenić jakość użytej izolacji przez pomiar napięcia jej przebicia oraz prądu upływu.

Dalsze badania powinny być przeprowadzone pod pełnym obciążeniem w maksymalnej temperaturze otoczenia, po to, aby ocenić stopień nagrzewania się komponentów i obudowy. Tanie zasilacze z reguły bardziej się grzeją, bo producenci oszczędzają na przekrojach przewodów, wielkości rdzenia itd. Można też sprawdzić zdolność do startu zasilacza przy minimalnym napięciu zasilania, pełnym obciążeniu i dolnej temperaturze otoczenia (np. –25°C).

W kolejnym kroku pożądane jest obejrzenie płytki drukowanej zasilacza pod kątem tego, czy ma on wbudowane w PCB filtry, ochronniki przepięciowe oraz jakie ma kondensatory elektrolityczne i ile ich jest. Puste miejsca na płytce, zwory, braki radiatorów, krzywo położone elementy, brud na PCB, pojedynczy kondensator nieznanej firmy na wyjściu przetwornicy kilkunastowatowej to znak, że w przyszłości mogą być problemy. Inspekcja dotyczy też kabla wyjściowego, bo tanie zasilacze mają ten element o zbyt cienkim przekroju. Miedź jest droga, więc z reguły chińskie kable mają grubą izolację i cienką żyłę, a użyte tworzywo sztuczne zamienia na mrozie ten plastik w twardy jak skała i sztywny jak drut polimer.

CO TO ZNACZY DOBRY ZASILACZ?

Na zasadzie przeciwieństwa, dobry zasilacz to taki, którego pomiary i inspekcja wnętrza nie zapalają w inżynierskiej głowie czerwonych lampek ostrzegawczych, taki, co się nie grzeje, ma wszystkie elementy decydujące o ochronie (MOV, filtry), dobre kondensatory i adekwatne do prądu wyjściowego przekroje przewodów nawojowych oraz kabli wyjściowych.

Poza tym minimum dobre zasilacze zawsze mają jakąś dodatkową funkcjonalność, która przynajmniej odrobinę wysuwa je poza rynkową średnią. Są to na przykład zabezpieczenia wyjścia przed odwrotną polaryzacją, blokada możliwości niekontrolowanego wzrostu napięcia w czasie uszkodzenia, dodatkowe kondensatory blokujące wyjście, które obniżają poziom szumów i zakłóceń. To także możliwość chwilowego przeciążania wyjścia, kompensacja spadku napięcia pod obciążeniem i możliwość jego regulacji trymerem.

Wartym uwagi dodatkiem jest też ferrytowy tłumik na kablu wyjściowym, który sprawdza się, gdy zasilacz służy do zasilania urządzenia zawierającego nadajnik radiowy. Dobry zasilacz ma też zabezpieczenie termiczne, które chroni jego działanie przed uszkodzeniem bądź przez czasowe wyłączenie lub lepiej przez tzw. derating, czyli obniżenie prądu wyjściowego do poziomu bezpiecznego.

Kiedyś można było porównywać zasilacze poprzez zważenie. Cięższy był lepszy, bo miał więcej elementów indukcyjnych i radiatorów, więcej miedzi i ogólnie elementów. Dzisiaj waga nie daje takiej informacji.

JAK OCENIAĆ JAKOŚĆ ŹRÓDEŁ CHEMICZNYCH?

Ocena jakości chemicznych źródeł energii, a więc baterii i akumulatorów, jest niestety o wiele trudniejsza i w wielu przypadkach niemożliwa do wykonania bez specjalistycznej aparatury. Rozebranie ogniwa nie ma sensu, bo nie dostarczy to żadnej informacji, zaś pomiar innych parametrów jak pojemność dla różnych prądów ładowania i rozładowania oraz temperatur nie dostarcza wielu informacji. Ale oczywiście lepsze to niż nic.

W przypadku akumulatorów znaczenie dokumentacji oraz certyfikatów dostarczanych przez dystrybutora lub producenta ma znacznie większe znaczenie i należy skierować swoją uwagę na ten obszar. Warto zauważyć, że niedawno weszły w życie przepisy nakładające wymagania na dostawców związane z koniecznością wykonania oceny (badań) ogniw pod kątem bezpieczeństwa ich transportu drogą powietrzną, naziemną lub statkiem oraz podczas ich przechowywania. W tym obszarze obowiązują normy IEC 62133 oraz UN38.3. Dotyczą one głównie wymagań bezpieczeństwa pojedynczej baterii i zestawów akumulatorów litowo-polimerowych, litowo-jonowych (Li-Ion), NiMH, itp. Bez certyfikatu wg UN 38.3 przewożenie akumulatorów litowych nie jest dopuszczalne, a w celu uzyskania tego dokumentu muszą być pomyślnie przeprowadzone próby akumulatorów poddanych różnym warunkom transportu. Należą do nich: symulacja wysokości, badanie termiczne, testy na drgania, uderzenie, zwarcie wewnętrzne, zderzenie, zgniatanie, przeładowanie oraz wymuszone rozładowanie.

Wymagania tych regulacji zostały w zeszłym roku rozszerzone o kolejne testy. Dodano np. nowy test poziomu naładowania akumulatora, który ma symulować czas ładowania akumulatora dłuższy niż w przypadku użycia przez producenta większej szybkości ładowania. Test ten przeprowadza się na całkowicie rozładowanych pięciu zestawach akumulatorów i ładuje się baterie prądem o wartości dwukrotnie większej od prądu znamionowego, a górny limit napięcia jest ustawiony na maksymalne napięcie dostępne z ładowarki na akumulator.

Jak widać, zakres badań jest bardzo szeroki, co z punktu widzenia zapewnienia jakości jest korzystne, bo klienci mogą wymagać dostarczenia dokumentów nt. spełnienia wymogów IEC 62133 oraz UN38.3 i zakładać, że ogniwa, które je mają, są dobrej jakości, gdyż zostały przebadane.

SZEROKI ZAKRES NAPIĘCIA WEJŚCIOWEGO

Dziesięć lat temu nowością na rynku zasilania impulsowego były wersje pozwalające na zasilanie dowolną wartością napięcia sieciowego występującą na całym świecie, a więc od ok. 86 do 240 V AC, w tym także odpowiadającą jej wartością napięcia stałego. Nietrudno zauważyć, że szybko stało się to standardem i dzisiaj w zasadzie ogromna większość zasilaczy małej i średniej mocy nie wymaga przełączania zakresu zasilania. W przypadku konwerterów DC-DC najnowsze rozwiązania umożliwiają zasilanie w zakresie 10:1, a więc np. od 10 do 100 V.

UŻYTECZNE DODATKI, CZYLI FUNKCJONALNOŚĆ

Funkcje, które pojawiają się dzisiaj często w zaawansowanych jednostkach zasilających, obejmują np. możliwość regulacji wyjściowego napięcia w niewielkim zakresie trymerem, po to, aby skompensować spadek napięcia na przewodach wyjściowych. To także wyjście sygnalizacji zaniku zasilania, gotowości zasilacza, możliwość chwilowego przeciążania, która przydaje się przy zasilaniu odbiorników takich jak silniki indukcyjne lub promienniki halogenowe. Pozwala to uniknąć przewymiarowania konstrukcji i kupowania zasilacza ze sporym zapasem mocy. Wiele aplikacji potrzebuje jej przez krótki czas, a przykładem mogą być zawory, rygle oraz siłowniki i w takiej sytuacji niewielka jednostka zasilająca z możliwością przeciążania jest w rozrachunku znacznie tańsza. Przeciążanie najczęściej bazuje na zabezpieczeniu termicznym (po kilkunastu sekundach przeciążenia następuje derating na skutek wzrostu temperatury w obudowie).

Od strony układowej zasilacze wyposaża się dzisiaj we wszechstronne układy zabezpieczające, rozbudowane filtry wejściowe, sterowniki zapewniające sygnalizację stanu zasilacza i podobne obwody ochronne na tyle skuteczne, że awaria na skutek przeciążenia, stanu nieustalonego lub zwykłego błędu podczas montażu instalacji staje się praktycznie niemożliwa. Standardem w zasilaczach adapterowych jest też kompensacja spadku napięcia na przewodzie wyjściowym, polegająca na niewielkim podbijaniu napięcia przy wzroście prądu obciążenia.

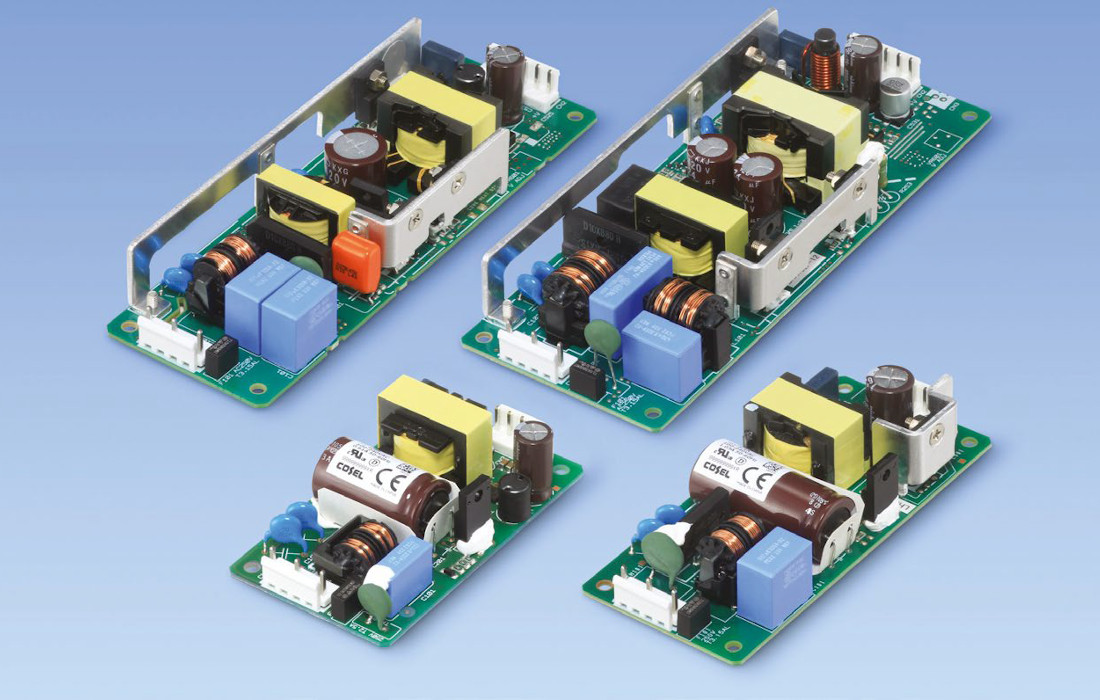

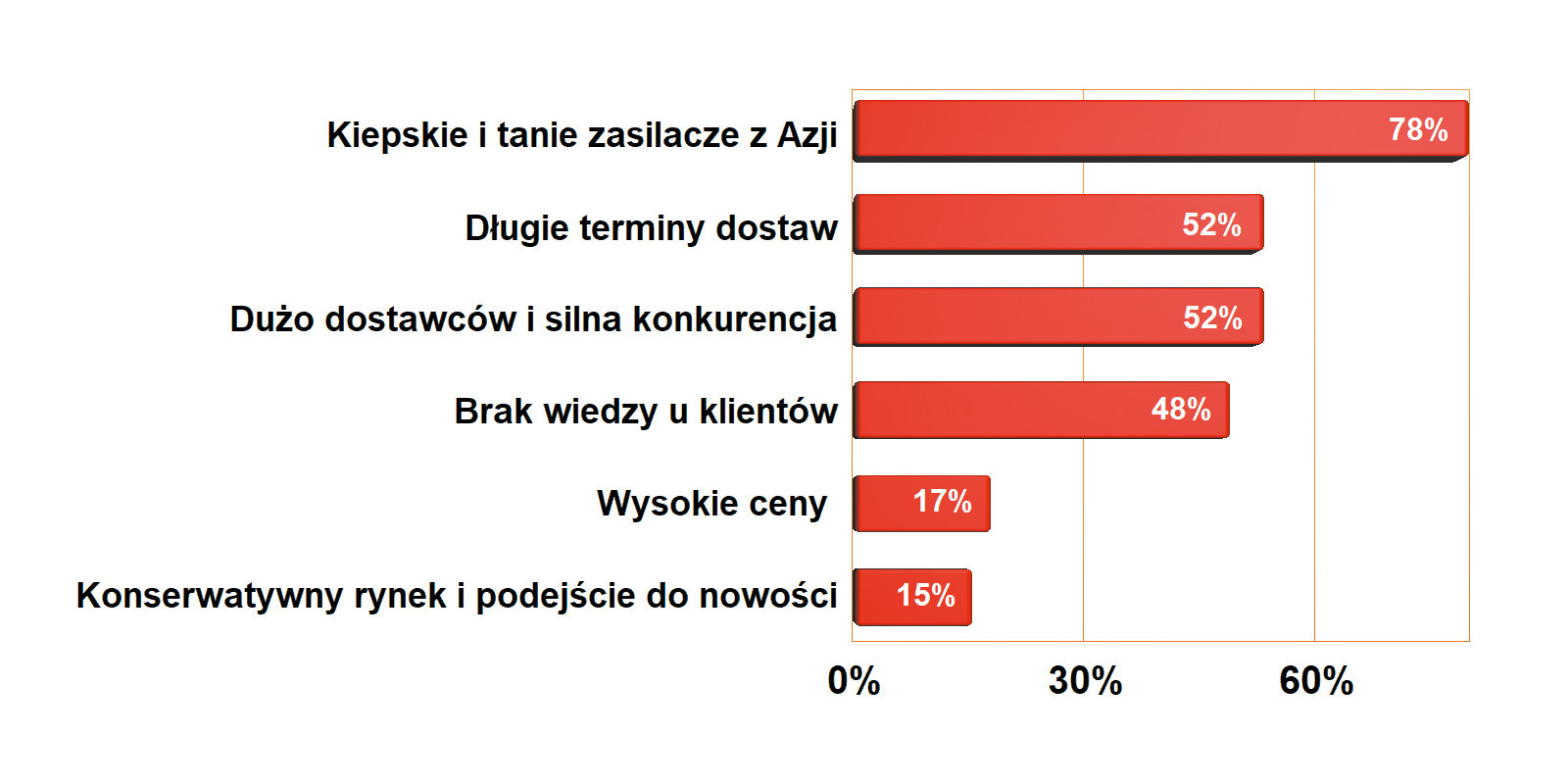

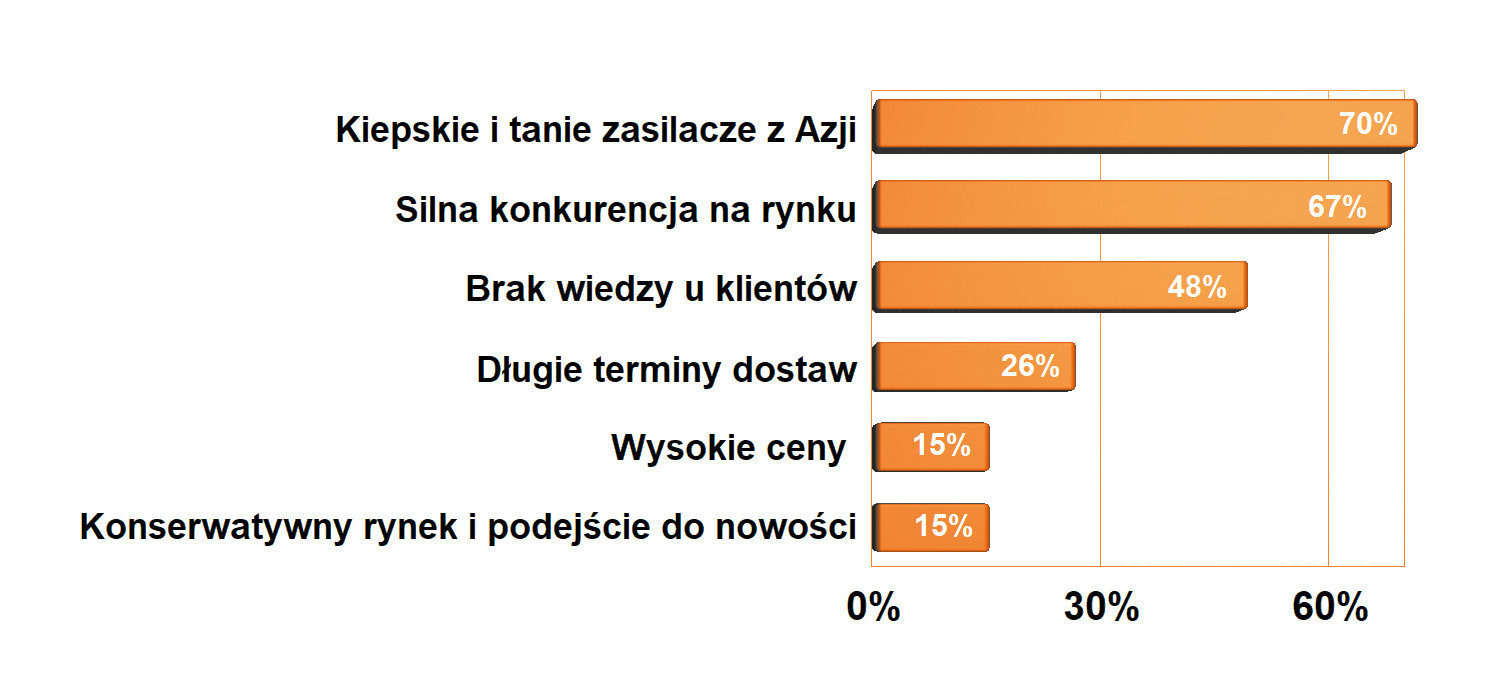

Zasilacze bezprzerwowe, buforowe i awaryjne oraz specjalistyczne

W przemyśle, a zwłaszcza w procesach realizowanych ciągle, utrata zasilania lub nawet chwilowa niestabilność to wymierne straty wywołane niekontrolowanym przestojem, dlatego gwarancja tego, że będzie ono dostępne, jest warunkiem koniecznym do zapewnienia jakości i potencjału przedsiębiorstwa. Obojętnie, o jaki typ zasilacza chodzi: UPS, buforowy czy specjalistyczny model dla medycyny lub przemysłu, wybór konkretnego modelu nie jest łatwy, bo na rynku jest wiele tandety, wiele produktów nie spełnia podstawowych parametrów, nie mówiąc już o zapewnieniu długoterminowej jakości.

Aby dobrze wybrać zasilacz do danej aplikacji i docenić walory techniczne kryjące się w zaawansowanych specjalistycznych rozwiązaniach zasilających, trzeba cokolwiek wiedzieć na temat ich funkcjonalności i parametrów. Wiedza ta pozwala na formułowanie pytań kierowanych potem do dostawców, a także na poszerzenie horyzontów na temat tego, co można osiągnąć w tworzonej aplikacji. Inaczej dyskusja sprowadzana jest do podstawowych danych takich, jak napięcie wyjściowe, moc, obudowa, złącze DC i cena, co nikomu nie daje wiele przestrzeni do manewru.

Kupujący zasilacze często nie mają wystarczających kompetencji i doświadczenia, aby umieć ocenić produkt, więc nietrudno o nadużycia. Nie każdy zna się na zasilaczach, a im aplikacja lub wytwarzane urządzenie bardziej odbiega od elektroniki, tym tej wiedzy jest w naturalny sposób mniej. Klienci z branż odległych od elektroniki z reguły nie chcą płacić więcej za produkty renomowane i o gwarantowanej jakości, raczej kupują jednostki najtańsze i nawet jak później urządzenie nie działa prawidłowo, nie są w stanie powiązać anomalii z kiepskim zasilaniem i nietrafionym wyborem. Część z nich uczy się na błędach i takie ryzyko jest dla nich nauczką na przyszłość niemniej, ponieważ temat psucia rynku przez tanie zasilacze azjatyckie od lat jest dyżurnym tematem branży, zapewne takie wpadki nie są powodem do chwały i firmy skrzętnie je ukrywają.

Warto zatem poświęcić chwilę na omówienie funkcji, które tworzą wartość dodaną do podstawowego zestawu związanego z konwersją energii elektrycznej (moc, napięcia).

W przypadku zasilaczy bezprzerwowych takim istotnym dodatkiem są możliwości diagnostyczne zasilaczy: monitorowanie stanu akumulatorów, kontrola sprawności zasilacza, parametrów sieci zasilającej, możliwość szybkiego ładowania oraz korekta napięcia ładowania w zależności od temperatury, która przedłuża żywotność akumulatorów. Zdolność do chwilowego przeciążania to z kolei cecha, która przydaje się w zastosowaniach przemysłowych i najlepiej, aby poziom dopuszczalnego przeciążenia oraz podstawowe parametry, takie jak napięcie, progi aktywacji zabezpieczeń można było programować samodzielnie z komputera (takie możliwości daje zasilacz konfigurowalny).

Wiele osób ocenia jakość zasilacza na wagę i nie jest to pozbawione sensu, bo tani produkt z małymi radiatorami, odchudzonymi filtrami i minimalnej wielkości transformatorem zawsze będzie lżejszy od tego porządnie wykonanego. Warto przyjrzeć się, ile ważą zasilacze renomowanych firm po to, aby porównać je z innymi.

Użyteczna funkcjonalność, jaka pojawia się dzisiaj często w zaawansowanych jednostkach zasilających, obejmuje ponadto takie dodatki jak np. możliwość regulacji wyjściowego napięcia w niewielkim zakresie trymerem, po to, aby skompensować spadek napięcia na przewodach wyjściowych. Do tego samego celu służą zwielokrotnione zaciski wyjściowe lub też możliwość podłączenia dwóch dodatkowych przewodów pomiarowych bezpośrednio do zacisków obciążenia (tzw. czteroprzewodowe połączenie kelwinowskie). Taki sposób zapewnia znakomite parametry napięcia wyjściowego (statyczne i dynamiczne) w zasilaczach dużej mocy i o niskim napięciu wyjściowym.

Od strony układowej zasilacze wyposaża się dzisiaj we wszechstronne układy zabezpieczające, rozbudowane filtry wejściowe, sterowniki zapewniające sygnalizację stanu zasilacza i podobne obwody ochronne na tyle skuteczne, że awaria na skutek przeciążenia, stanu nieustalonego lub zwykłe zwykłego błędu podczas montażu instalacji staje się praktycznie niemożliwa.

Szeroki zakres napięcia wejściowego to kolejny parametr, który wiele mówi o nowoczesności. Standard tanich jednostek to 100‒240 V AC, lepsze działają w zakresie 85‒265 V AC, najlepsze w jeszcze szerszych widełkach.

Nawet jeśli nie korzystamy z sieci innej niż 230 VAC, to gdy zakres dopuszczalnych napięć jest szeroki, korzystnie przekłada się to na odporność zasilacza na krótkotrwałe zaniki napięcia i przepięcia o dużej wartości.

Asortyment dostępnych na rynku zasilaczy poszerza się także o wersje ze wzmocnioną izolacją, czyli o niskiej upływności. Do niedawna były one rzadkością i wykorzystywane tylko w aplikacjach medycznych, niemniej poszerzająca się oferta wskazuje, że takie jednostki trafiają także do urządzeń przemysłowych, do precyzyjnej aparatury pomiarowej oraz rozbudowanych systemów, gdzie łączone są obwody na różnych potencjałach. W takich przypadkach zasilacz o wzmocnionej izolacji jest w stanie zapewnić stabilność i jakość działania układów pomiarowych.

Jeszcze inne rozwiązania to zasilacze czteroćwiartkowe, czyli takie, które mogą płynnie zmieniać funkcję z dostarczania energii do obciążenia na jej odbieranie (jak obciążenie elektroniczne) bez konieczności przełączania obwodów przekaźnikami.

Na koniec warto wymienić korzyści z obecności cyfrowego łącza komunikacyjnego w zasilaczach. Pozwala ono łączyć kilka jednostek równolegle, zapewniając równomierny podział mocy oraz tworzyć w ten sposób konfiguracje nadmiarowe (z redundancją), w których jest możliwość wymiany jednego zasilacza z zestawu bez wyłączania reszty.

SPRAWNOŚĆ I MINIATURYZACJA

Duża sprawność konwersji energii elektrycznej to temat zawsze istotny w obszarze zasilania, gdyż z kolejnymi procentami sprawności poprawia się wiele innych parametrów aplikacyjnych. Są to wielkość zasilacza, zakres temperatur pracy, warunki chłodzenia, żywotność, a w jakiejś części także odporność środowiskowa. Im większa sprawność, tym mniej ciepła jest tracone podczas konwersji energii, a jak mówi luźna interpretacja prawa Arrheniusa "podniesienie temperatury reakcji chemicznej o 10 stopni przyspiesza ją dwukrotnie". Taką reakcją może być proces degradacji izolacji, wysychanie elektrolitu w kondensatorach, starzenie się tworzyw sztucznych itp. 10 stopni różnicy temperatury w obudowie to inaczej mówiąc, dwukrotnie dłuższa żywotność komponentów zasilacza i taką różnicę mogą zapewnić 2‒3 punkty procentowe sprawności konwersji energii więcej.

Miniaturyzacja to kolejny po sprawności parametr zasilaczy, który zawsze jest aktualny, bo mała, ale wydajna jednostka zasilająca ułatwia instalację, pozwala na lepszą integrację z konstrukcją urządzenia lub maszyny oraz z dużym prawdopodobieństwem jest nowocześniejsza od większych (starszych) rozwiązań.

Wysoka sprawność to oszczędność energii zasilającej, a więc mniejsze rachunki, a w zasilaczach buforowych dłuższy czas pracy z danej pojemności akumulatora.

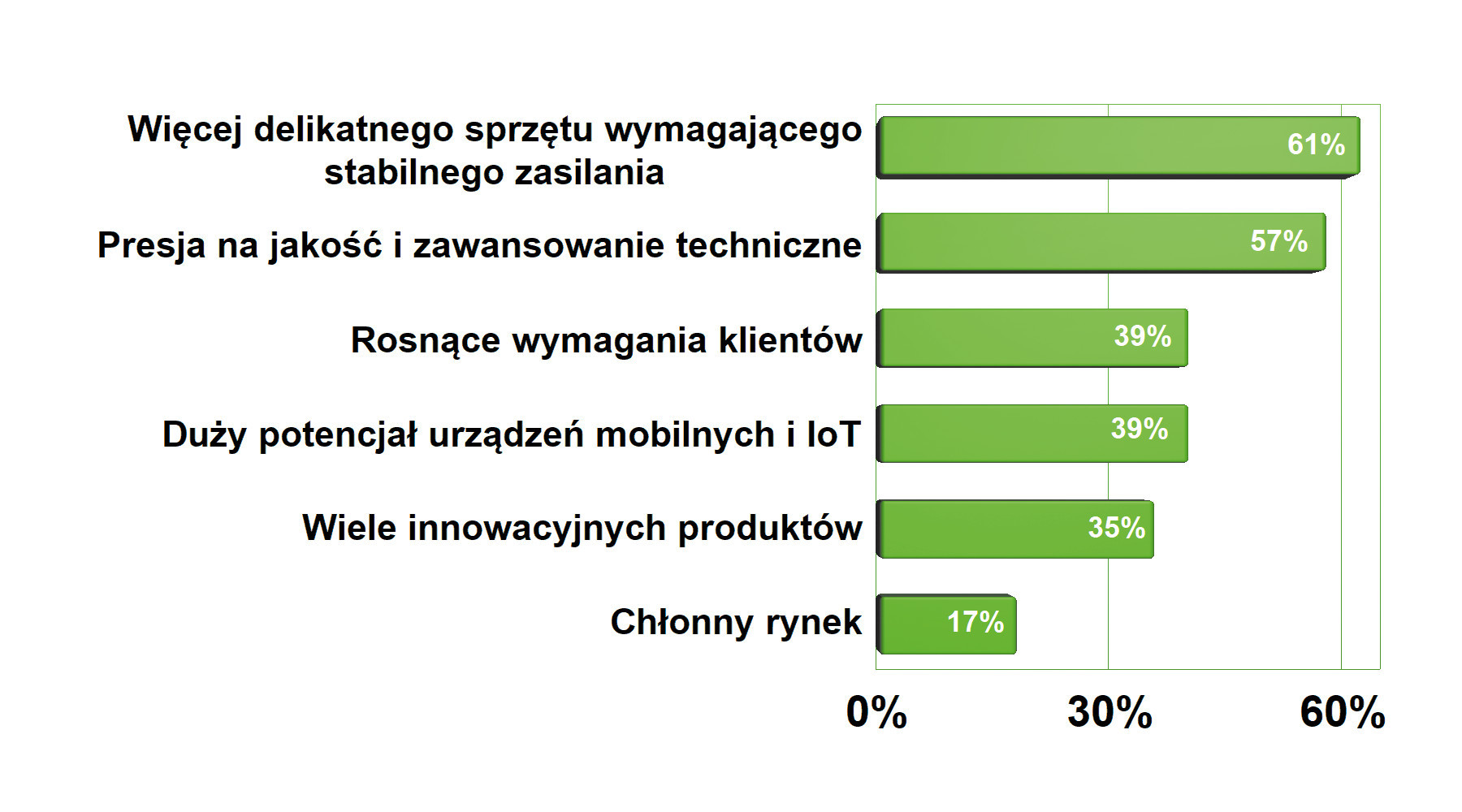

ZAGADNIENIA ZWIĄZANE Z ENERGIĄ ODNAWIALNĄ

Od lat mówiło się, że w przyszłości instalacje elektryczne nie będą już tak bardzo scentralizowane, a więc z widocznym podziałem na elektrownie, linie przesyłowe oraz odbiorców końcowych. Energia odnawialna stworzyła na rynku kategorię prosumenta, czyli specyficznego odbiorcę końcowego, który kupuje energię elektryczną oraz także produkuje ją na własne potrzeby, a nadwyżki sprzedaje do sieci. Wraz z prosumentami energetyka zaczęła się zmieniać w system rozproszony. Jako konsekwencja tego procesu rozwój i popularność instalacji PV przyspieszyły rozwój technologii zasilania dwukierunkowego, a więc takich jednostek, które są w stanie konwertować energię w dwie strony, np. zasilając silnik napędzający urządzenie i odbierając od niego energię hamowania po to, aby ładować akumulator. Są to skomplikowane rozwiązania zasilaczy, ale powoli znajdują swoje miejsce na rynku.

Bezsprzecznie w przyszłości będziemy mieć coraz więcej instalacji lokalnych generujących prąd ze słońca lub wiatru. Dużo się też mówi o lokalnych magazynach akumulatorowych do gromadzenia nadwyżek z instalacji odnawialnych lub odzysku energii z układów mechanicznych w transporcie. Oznacza to, że falowniki dwukierunkowe i zasilacze będą trafiać także pod strzechy.

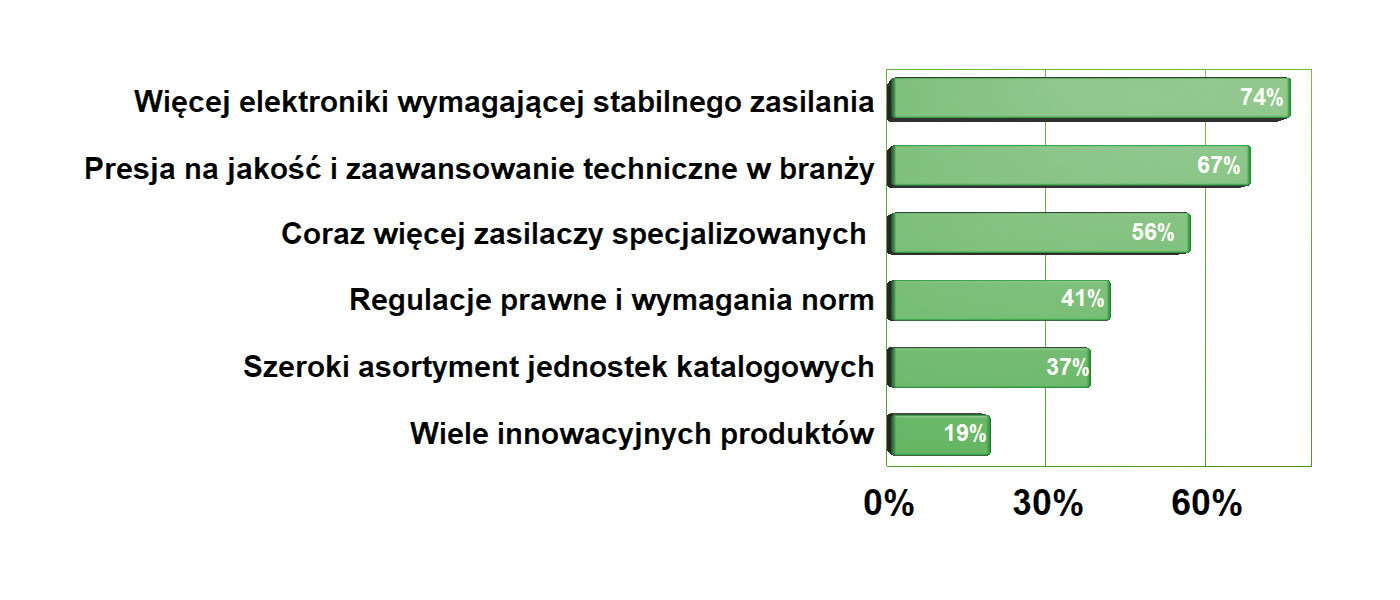

ZASILANIE GWARANTOWANE CORAZ BARDZIEJ ROZPROSZONE

Zasilanie gwarantowane zawsze było ważną częścią współczesnej techniki i można nawet wysnuć tezę, że z roku na rok funkcja, jaką pełnią te urządzenia, jeszcze bardziej się zwiększa. Powodem jest to, że liczba systemów elektronicznych, które muszą pracować non stop stale rośnie. Jednocześnie znaczenie, jaką ma taki sprzęt, staje się coraz ważniejsze, a nierzadko nawet może decydować o zdrowiu i życiu. Wymagania działania bez przerwy stawia się m.in. przed sprzętem infrastruktury telekomunikacyjnej, monitoringu, sterowania ruchem, w zakresie usług elektronicznych, e-handlu i wielu innych technologii z przedrostkiem "e". Ważnym obszarem jest także medycyna i IT.

Wymienione branże i aplikacje to przykłady, gdzie zasilanie gwarantowane charakteryzowane jest przez dużą moc jednostek, co wynika z centralizacji sprzętu o znaczeniu krytycznym w jednym obiekcie do np. serwerowni. To taki specyficzny obszar, gdzie podtrzymanie zasilania podczas awarii jest realizowane przez jeden lub kilka zasilaczy UPS pracujących razem jako system. W tym zakresie niewiele się zmienia, jeśli chodzi o koncepcję systemu zasilania. Różnice pomiędzy kolejnymi generacjami zasilaczy dotyczą głównie ich parametrów: sprawności, mocy uzyskiwanej z jednostki objętości, możliwości zarządzania zdalnego, zapewnienia redundancji poprzez łączenie wielu zasilaczy w równoległe bloki, możliwości wymiany modułów podczas pracy i podobnych.

ZASILACZE BUFOROWE

Drugi obszar, gdzie realizowane jest zasilanie gwarantowane, nie jest taki widowiskowy, ale też zyskuje na znaczeniu. Chodzi o podtrzymanie zasilania dla lokalnych instalacji małych mocy, gdzie odbiorniki są zasilane napięciem stałym o wartości 9‒24 V. Są to systemy monitoringu wizyjnego, składające się z kamer i pamięci masowej NAS do przechowywania danych wideo, routery i punkty dostępowe do Internetu, systemy alarmowe, aplikacje pomiarowe wysyłające dane do chmury, systemy oświetlenia awaryjnego i automatyki budynkowej.

takich rozwiązaniach gwarancja zasilania wymaga znacznie mniejszej mocy i stąd realizowana jest lokalnie poprzez dołączenie akumulatora lub użycie zasilacza buforowego z magazynem energii (jest to akumulator, rzadziej są to superkondensatory z uwagi na wysoki koszt). Niektóre urządzenia tego typu pozwalają na podłączenie akumulatora buforującego, ale z reguły wykorzystuje się zasilacz buforowy, a więc z akumulatorem. Są to rozwiązania o różnym poziomie zaawansowania technicznego. Od najprostszych, gdzie napięcie akumulatora jest dostarczane bezpośrednio na wyjście, po zaawansowane jednostki o napięciu wyjściowym stabilizowanym i niekoniecznie takim samym, jakie ma akumulator.

Zasilacze buforowe mogą zawierać akumulator wewnątrz obudowy i takie wersje najczęściej pojawiają się w instalacjach budynkowych. Coraz częściej jest też możliwość dołączenia akumulatora zewnętrznego o dużej pojemności w razie potrzeb. To jest bardzo elastyczne rozwiązanie, bo daje szansę ustalenia czasu podtrzymania zasilania stosownie do potrzeb.

Popularności zasilaczy buforowych sprzyja ponadto to, że od strony technicznej są to urządzenia stosunkowo proste. Wiele takich urządzeń składa się z prostszego zasilacza sieciowego, do którego dodany został akumulator na wejściu wraz z układem jego ładowania. Przy obecności zasilania sieciowego ogniwa są ładowane i utrzymywane w stanie gotowości, po zaniku sieci, zgromadzona energia kierowania jest na wyjście. Konstrukcja bardziej złożonych jednostek opiera się na przetwornicy o dużej sprawności. Mają one dodane obwody sygnalizacyjno-kontrolne i zabezpieczające oraz port USB. Dzięki niemu urządzenie zasilane może np. w kontrolowany sposób wyłączyć się przed całkowitym wyczerpaniem akumulatora.

Na rynku jest wiele dostępnych typów takich urządzeń, także jeśli chodzi o wersję wykonania mechanicznego. Obudowy zasilaczy buforowych przeznaczone są zwykle do montażu na szynie lub w skrzynce instalacyjnej. Są też wersje całkowicie open frame, a więc bez obudowy, czyli jako sama płytka drukowana. Wiele modeli ma wydzielone w obudowie zatoki pozwalające na montaż akumulatorów, przez co całość tworzy gotową do pracy jednostkę buforową skalowalną z możliwością serwisowania podczas pracy. Ogólnie liczba wariantów funkcjonujących na rynku jest spora, dzięki czemu bez problemu daje się dobrać najbardziej pasujące rozwiązanie do każdych zastosowań.

Typowy zasilacz buforowy ma jedno napięcie wyjściowe o wartości powiązanej z napięciem znamionowym akumulatora, a więc z reguły 12 lub 24 V. Na dodatek nierzadko jest to napięcie niestabilizowane, bowiem akumulator dołącza się wprost do zacisków wyjściowych.

ZASILACZE BEZPRZERWOWE UPS

Zasilacze bezprzerwowe UPS są stosowane przede wszystkim w centrach danych, systemach komunikacyjnych, w energetyce i przemyśle. Na rynku dostępne są urządzenia różnych typów, niemniej ich cechą wspólną jest to, że na wyjściu dostarczają przemiennego napięcia takiego samego, jakie jest w sieci energetycznej.

W skład większości UPS-ów, niezależnie od ich wielkości i topologii, wchodzą akumulatory, ładowarka i przetwornica (inwerter) zamieniająca napięcie stałe na przemienne. Różnice między topologiami dotyczą tego, czy przetwornica pracuje cały czas (online), czy jest załączana dopiero podczas awarii (offline). Cechą UPS-a online jest podwójna konwersja energii, z sieci do napięcia akumulatora i dalej z powrotem na sieć. Dzięki temu przetwornica zasila obciążenie czystym i dokładnie stabilizowanym przez UPS napięciem przemiennym. Oprócz tego prostownik zasilający falownik z sieci zapewnia korekcję współczynnika mocy, przez co UPS online jest w istocie też skutecznym filtrem, który chroni urządzenia przed zakłócającymi wpływami sieci energetycznej, optymalizując równocześnie obciążenie w stosunku do sieci.

W UPS-ie off line w trakcie normalnej pracy obciążenie jest zasilane bezpośrednio z sieci energetycznej. Gdy napięcie zasilania spadnie poza ustaloną granicę, zasilanie obciążenia jest przełączane przekaźnikiem na przetwornicę i akumulator. Spowodowana tym przerwa może trwać typowo kilka milisekund. Zaletą UPS- a offline jest to, że gdy zasilanie z sieci jest, falownik nie pracuje, a więc nie pobiera energii.

Komponenty do specjalistycznego oświetlenia LED

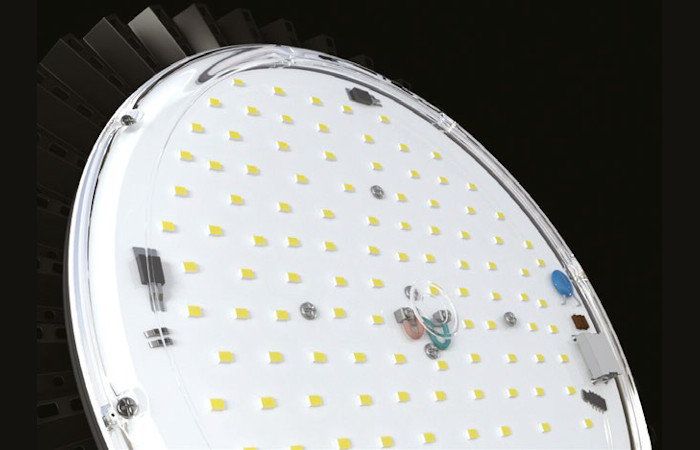

Oświetlenie LED to nie tylko diody. Nowoczesna oprawa oświetleniowa wymaga zasilania, układu optycznego, chłodzenia oraz istotnych drobiazgów, takich jak regulacja jasności, barwy lub komunikacji. W ostatnich latach coraz większe znaczenie zyskują nie tylko same źródła LED i oprawy oświetleniowe, ale przede wszystkim systemy zasilania i sterowania. Pozwalają one na dodatkowe ograniczenie zużycia energii, łatwą kontrolę stanu wszystkich instalacji oświetleniowych w danym obiekcie oraz elastyczne dostosowanie oświetlenia do różnych potrzeb i warunków.

Pozytywnym zjawiskiem wspierającym branżę oświetlenia LED jest to, że mamy w kraju wielu producentów, z czego wiele tych firm zajmuje się rozwiązaniami specjalistycznymi, o dużej funkcjonalności i jakości.

Podobnie jak w wielu innych branżach, zmagają się one z tanimi produktami importowanymi z Dalekiego Wschodu. Szansy szukają w dużej specjalizacji, produktach o atrakcyjnym wzornictwie lub tworząc projekty dopasowane ściśle do obiektów lub urządzeń. Częścią rynku oświetlenia diodowego są też firmy EMS-owe.

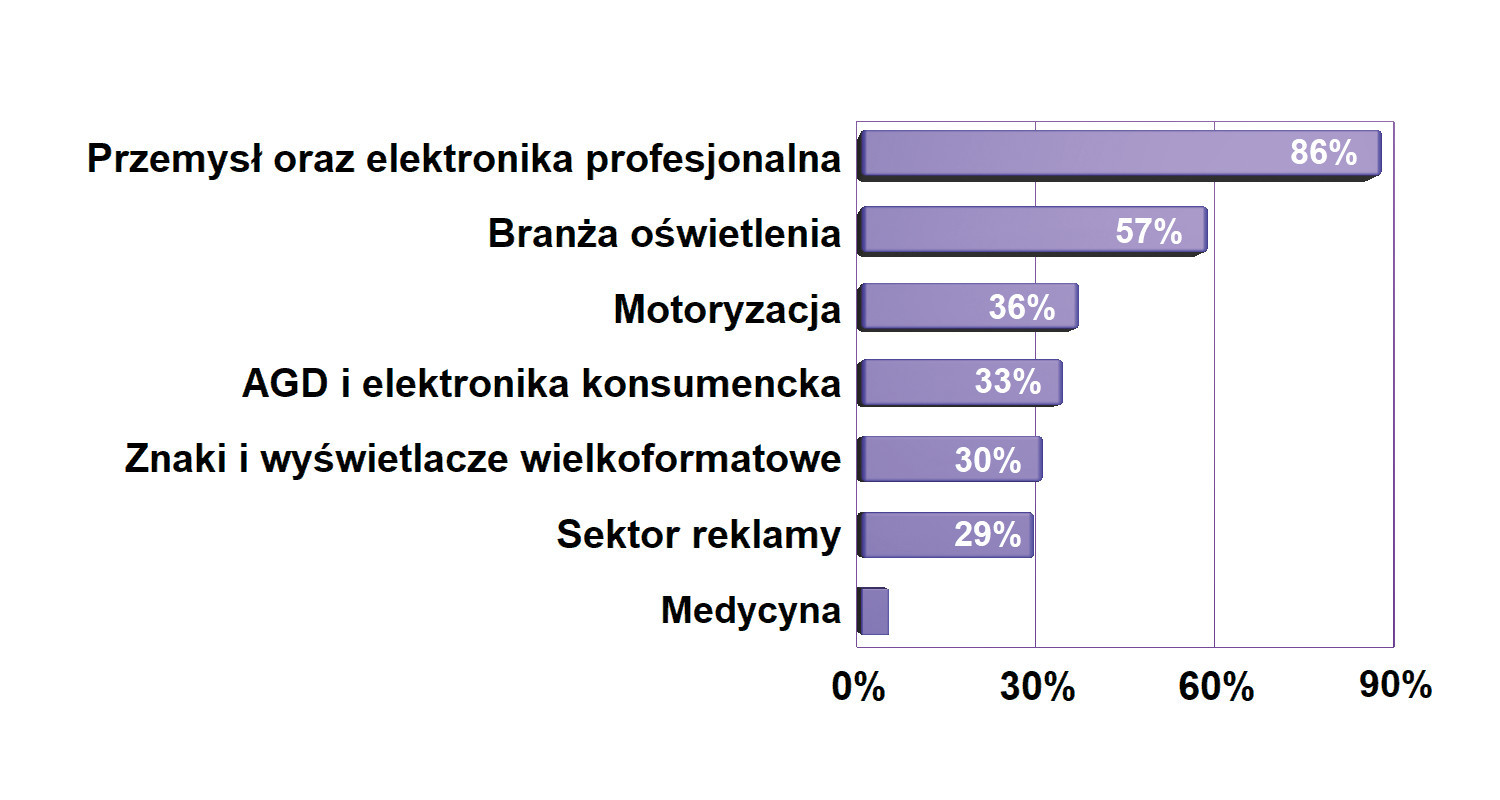

Rozwój rynku kieruje się dzisiaj w stronę zastosowań specjalistycznych, bo branża konsumencka nie daje już dużo możliwości. Coraz bardziej agresywna polityka cenowa producentów LED o wątpliwej jakości doprowadziła do znaczącego obniżenia rentowności produkcji diod LED. Liderzy rynku, tacy jak Osram, Cree, Philips, LG Innotek, stopniowo zmniejszali znaczenie tego segmentu w portfolio, najpierw odsprzedając działy produkcji opraw lub rezygnując z produkcji samych diod.

Takie procesy przenoszą się niżej na kolejne poziomy rynku i prowadzą do tego, że rynek rozwija się obecnie w zastosowaniach przemysłowych a także rolnictwie i ogrodnictwie. Doskonałym przykładem zachodzących zmian jest znaczne zwiększenie zainteresowania wydajnymi diodami UV, które mogą być wykorzystywane do sterylizacji.

Wiele innowacyjnych rozwiązań to np. lampy przemysłowe, budynkowe, z certyfikatami Atex, DNV, górniczymi, GOST- R, z wbudowaną "inteligencją" sterowania i komunikacji w sieciach Mesh, o dużej jakości światła (oddawanie kolorów, temperatura barwowa) i podobne. Spory potencjał ma oświetlenie biurowo- -budynkowe o nowoczesnym i modnym wyglądzie, które pozwala nadać pomieszczeniom indywidualny charakter i zapewnić wysoką funkcjonalność. Oprawy tego typu mają dużą powierzchnię świecącą, dzięki czemu nie wywołują cieni i nie męczą oczu, a poza tym można je wbudować sufit lub ściany.

Przeniesienie ciężaru rozwoju rynku w taką stronę jest w części efektem tego, że klienci kupujący oświetlenie LED do zastosowań poza konsumencko- domowymi stawiają na jakość i trwałość produktów i interesują się innowacyjnymi projektami. To zainteresowanie jakością i funkcjonalnością nie bierze się z przypadku, można je traktować jako odpowiedź rynku na zalew tanich produktów z Azji.

WSZYSTKO DZISIAJ JEST "SMART", OŚWIETLENIE TAKŻE

Pojawiające się na rynku oświetlenie LED-owe ma coraz wyższą funkcjonalność w porównaniu do tradycyjnych źródeł, a niektóre żarówki i oprawy można już określać mianem inteligentnych. Lampy takie można łączyć w sieć za pomocą protokołu komunikacyjnego DALI, co umożliwia dalsze oszczędności poprzez dopasowywanie parametrów oświetlenia do aktualnych potrzeb, selektywne wyłączanie/włączanie, regulację jasności. Oprawy są integrowane ze zdalnym sterowaniem opartym na transmisji przewodowej lub bezprzewodowej, co pozwala na bieżący monitoring oraz inteligentne sterowanie oświetleniem za pomocą pilota lub smartfona. Ponieważ LED-y nie mają bezwładności świetlnej, a częste gaszenie i zapalanie nie powoduje pogorszenia trwałości, mogą być tworzone systemy oświetlenia na żądanie, a więc zapalającego się tylko na chwilę i w danym miejscu, gdy jest to potrzebne, np. z wykorzystaniem zintegrowanego czujnika ruchu PIR. Inteligentne lampy pozwalają na zaprogramowanie czasu włączenia i wyłączenia, ustawienie temperatury barwowej i jasności.

BUDOWANIE ŚWIADOMOŚCI RYNKU

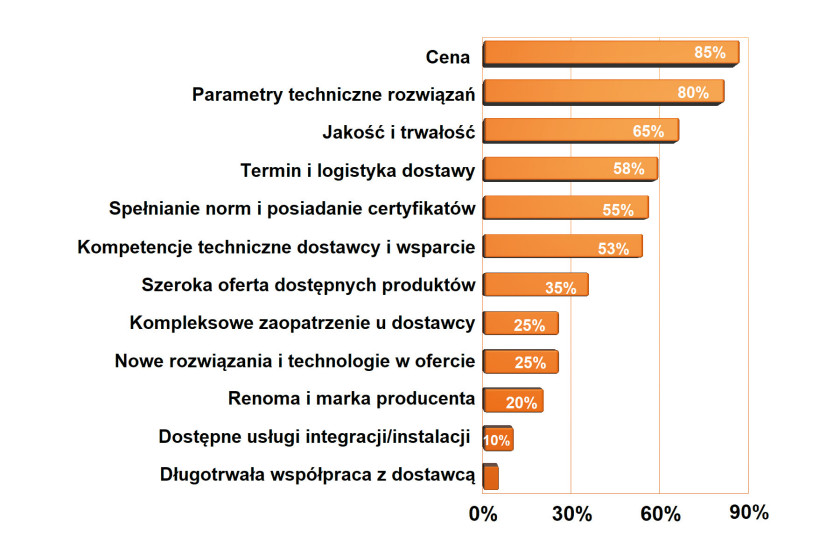

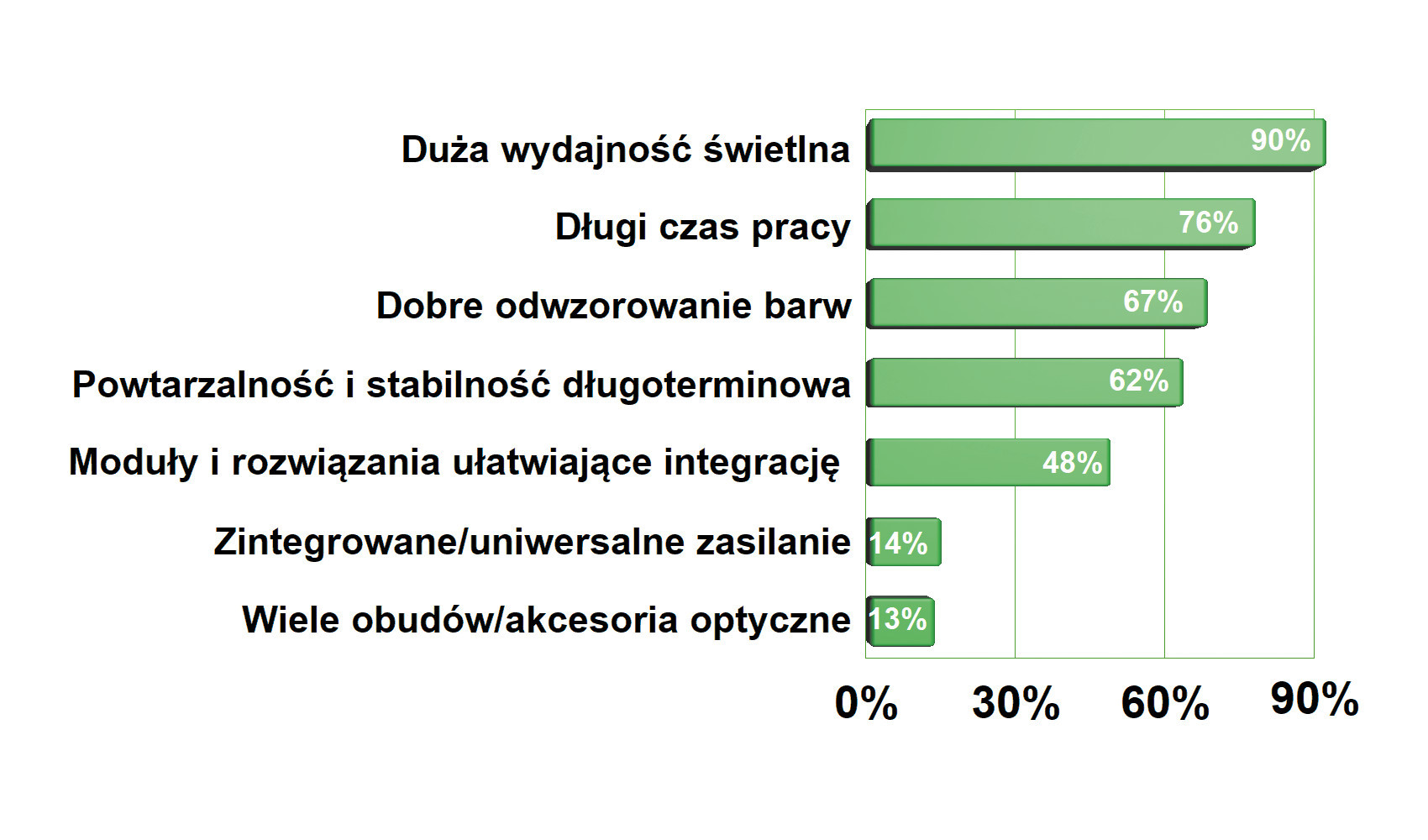

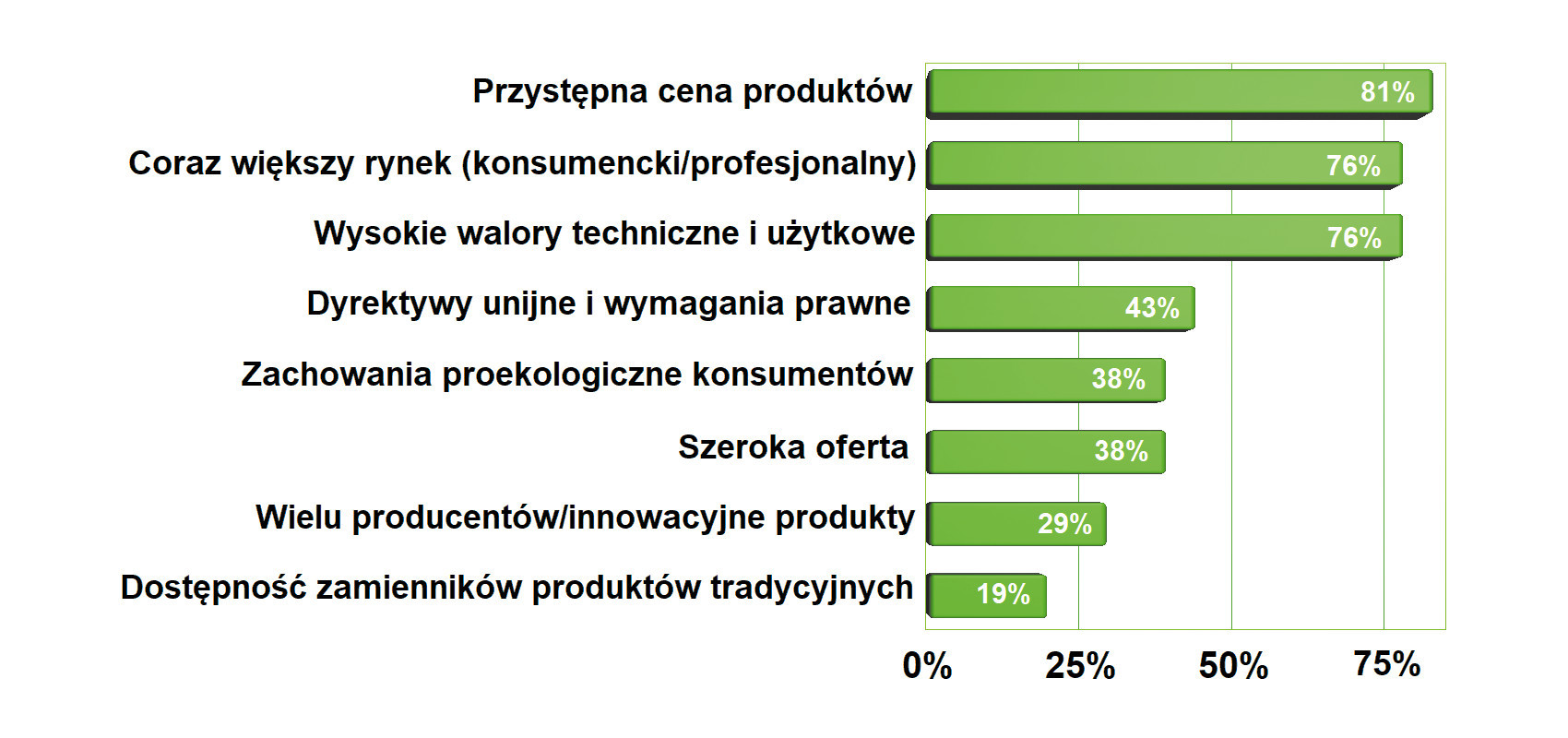

Aby zaawansowane produkty o wysokiej jakości przebijały się na rynku i były wybierane przez klientów jako te bardziej wartościowe, musi za nimi iść większa świadomość rynku, wiedza kupujących na temat, jak te dobre cechy weryfikować, na co zwracać uwagę oraz co jest istotne, a co nie. Jak wynika z naszego badania ankietowego tą świadomością nie jest najlepiej, bo czynnik ten jest wskazywany jako jeden z najważniejszych hamulców dla rozwoju (patrz wykresy). Z tej przyczyny w tym opracowaniu koncentrujemy się głównie na aspektach technicznych oświetlenia diodowego. Opisujemy mniej znane zagadnienia, wyjaśniamy prostym językiem szczegóły związane z parametrami optycznymi, bo chcemy razem z innymi specjalistami budować tę wiedzę rynku. Wiemy też, że na fachowe publikacje nie jest łatwo trafić i dlatego staramy się pomóc.

PRODUKTY ZŁEJ JAKOŚCI – TEMAT WIECZNIE AKTUALNY