Systemy automatyki domowej

Rozwiązania z zakresu automatyki domowej, określane coraz częściej mianem inteligentnych systemów sterowania budynkiem, przeszły w ostatnich latach dynamiczną transformację. Początkowo układy i instalacje tego typu sprowadzały się głównie do prostych układów sterujących oświetleniem lub ogrzewaniem budynku, obecnie coraz częściej obejmują zaś złożone sieci czujników, urządzeń wykonawczych oraz systemów komunikacji. Głównym celem tych rozwiązań jest poprawa komfortu codziennego życia, podniesienie poziomu bezpieczeństwa oraz bardziej efektywne zarządzanie zużyciem energii w gospodarstwach domowych.

Rozwój systemów typu smart home napędzany jest przez dwa kluczowe trendy technologiczne: wzrost możliwości i dostępności urządzeń wbudowanych oraz popularyzację rozwiązań Internetu Rzeczy (IoT, Internet of Things). Układy wbudowane, takie jak mikrokontrolery, moduły komunikacyjne czy jednopłytkowe minikomputery, stanowią podstawę inteligentnych domów – odpowiadają za zbieranie i przetwarzanie danych w czasie rzeczywistym oraz za sterowanie urządzeniami wykonawczymi. Z kolei technologie IoT umożliwiają integrację urządzeń w jedną sieć, komunikację między nimi i zdalne sterowanie za pomocą smartfonów, komputerów czy asystentów głosowych.

Nowoczesne systemy automatyki domowej nie ograniczają się już wyłącznie do oświetlenia czy regulacji temperatury. Ich zastosowania obejmują także:

- poprawę energooszczędności – dynamiczne dostosowanie zużycia energii w zależności od taryfy dystrybucyjnej czy produkcji z paneli fotowoltaicznych,

- monitoring zdrowia – czujniki mierzące tętno, ciśnienie czy aktywność użytkownika, wspierające opiekę nad osobami starszymi i wymagającymi pomocy,

- inteligentne bezpieczeństwo – integracja kamer, czujników ruchu, zamków elektronicznych i systemów alarmowych,

- personalizację – adaptację ustawień domu do nawyków jego mieszkańców. Możliwości te są dodatkowo zwiększane przez integrację z rozwiązaniami opartymi na sztucznej inteligencji, technikach uczenia maszynowego oraz chmurze obliczeniowej, co pozwala lepiej dopasowywać zachowanie systemu do oczekiwań i preferencji użytkowników.

Podstawowe komponenty systemu

Typowy system automatyki domowej zbudowany jest z czterech rodzajów komponentów – są to: czujniki, elementy wykonawcze, układy sterujące oraz interfejsy użytkownika. Sensory stanowią "zmysły" inteligentnego domu. Dostarczają dane niezbędne do podejmowania decyzji oraz generowania sygnałów sterujących dla elementów wykonawczych. Układy wykonawcze odpowiadają za działania podejmowane przez system. Układy sterujące są odpowiedzialne za sterowanie pracą systemu. Odpowiadają za monitorowanie statusu poszczególnych komponentów systemu, obsługę interfejsów użytkownika, zbieranie danych z czujników, wykonywanie algorytmów sterujących i wydawanie poleceń elementom wykonawczym. Coraz częściej ich działanie wspierane jest przez rozwiązania z zakresu sztucznej inteligencji oraz uczenia maszynowego np. w celu prognozowania zużycia energii czy detekcji nietypowych zdarzeń.

Efektywny system automatyki domowej wymaga obecności intuicyjnego interfejsu użytkownika, pozwalającego na zarządzanie funkcjonowaniem obiektu. Do typowych interfejsów wykorzystywanych w tego typu systemach zaliczyć można aplikacje mobilne i webowe, które pozwalają sterować oświetleniem, ogrzewaniem czy systemami bezpieczeństwa z poziomu smartfonu lub komputera, panele dotykowe montowane na ścianie, które integrują funkcje sterowania całym obiektem w jednym miejscu. Są to także asystenci głosowi (Alexa, Google Assistant, Siri), którzy dzięki rozpoznawaniu mowy umożliwiają werbalną komunikację z systemem.

Technologie komunikacyjne

Podstawą funkcjonowania każdego systemu automatyki domowej jest niezawodna komunikacja pomiędzy urządzeniami. To właśnie protokoły transmisji danych decydują o stabilności, bezpieczeństwie i elastyczności całej instalacji. Wybór odpowiedniej technologii ma bezpośredni wpływ na energooszczędność, skalowalność i łatwość integracji systemu. Poniżej przedstawiono przegląd protokołów komunikacyjnych najczęściej spotykanych w systemach automatyki domowej.

ZigBee to jeden z najczęściej stosowanych protokołów bezprzewodowych w systemach automatyki domowej. Do jego głównych cech zaliczyć można wykorzystanie topologii siatki (mesh), mały pobór energii, maksymalny zasięg pomiędzy węzłami sieci sięgający 100 metrów oraz przepustowość transmisji do 250 kb/s. Specyfikacja ZigBee dla warstwy fizycznej i łącza danych wykorzystuje standard IEEE 802.15.4, który pozwala na transmisję w pasmie 2,4 GHz (globalnie) oraz 868 MHz i 915 MHz w wybranych rejonach świata. Do zalet ZigBee zaliczyć można szerokie wsparcie producentów oraz dużą liczbę dostępnych modeli urządzeń, wadą mogą być problemy z interoperacyjnością pomiędzy urządzeniami obsługującymi starsze i nowsze wersje standardu.

Protokół Z-Wave pod wieloma względami zbliżony jest do Zigbee. Służy do tworzenia sieci opartych na topologii siatki, charakteryzuje się zasięgiem do 100 metrów oraz przepustowością nieprzekraczającą 100 kb/s. Transmisja radiowa odbywa się w pasmie poniżej 1 GHz (868 MHz w Europie), co zmniejsza podatność na zakłócenia oraz zużycie energii. Dużą zaletą standardu jest kompatybilność wsteczna pomiędzy kolejnymi generacjami protokołu, co znacząco zwiększa pulę dostępnych modeli urządzeń.

Technologia Wi-Fi jest obecna w niemal każdym domu, co bardzo upraszcza integrację urządzeń automatyki domowej i eliminuje konieczność korzystania z dodatkowych hubów. Zaletą tego rozwiązania jest bardzo duża przepustowość (z reguły znacznie przewyższająca wymagania systemu automatyki domowej) oraz łatwość konfiguracji. Bardzo istotną wadą jest jednak wysoka energochłonność, która w przypadku urządzeń zasilanych bateryjnie przekłada się na konieczność znacznie częstszej wymiany baterii. Duża liczba urządzeń w sieci domowej może ponadto przeciążyć router i negatywnie odbić się na wydajności połączenia z Internetem. Z wymienionych powodów technologia Wi-Fi wykorzystywana jest przede wszystkim w przypadku urządzeń wymagających transmisji dużej ilości danych oraz zasilanych z sieci, takich jak np. kamery IP, głośniki, urządzenia multimedialne czy inteligentne AGD.

Bluetooth Low Energy (BLE) został zaprojektowany z myślą o urządzeniach mobilnych oraz układach IoT. Charakteryzuje się małym poborem mocy, zasięgiem do 100 metrów oraz przepustowością do 2 Mb/s. Protokół ten bardzo dobrze nadaje się do realizacji połączenia point-to-point lub z niewielką liczbą węzłów, ma jednak ograniczoną skalowalność w porównaniu do sieci opartych na topologii siatki. Znajduje zastosowanie m.in. w zamkach elektronicznych oraz urządzeniach noszonych.

MQTT (Message Queuing Telemetry Transport) to protokół komunikacyjny stosowany powszechnie w rozwiązaniach IoT. W przeciwieństwie do wcześniej opisanych standardów, MQTT nie jest protokołem radiowym, lecz warstwą komunikacyjną działającą na bazie innych technologii sieciowych, w warstwie aplikacji. Oparty jest na modelu publish/subscribe – poszczególne urządzenia nie komunikują się bezpośrednio ze sobą, lecz utrzymują jedynie połączenie z centralnym elementem pełniącym funkcję koordynatora, tzw. brokerem, ten zaś odpowiada za dystrybucję treści pomiędzy węzłami. Protokół ten charakteryzuje się bardzo dobrą skalowalnością oraz małym narzutem komunikacyjnym. Dzięki swojej popularności jest również bardzo łatwy w integracji z rozwiązaniami chmurowymi. Wadą tego typu rozwiązania jest wysoka centralizacja – trwała lub chwilowa awaria brokera uniemożliwia jakąkolwiek wymianę informacji w sieci.

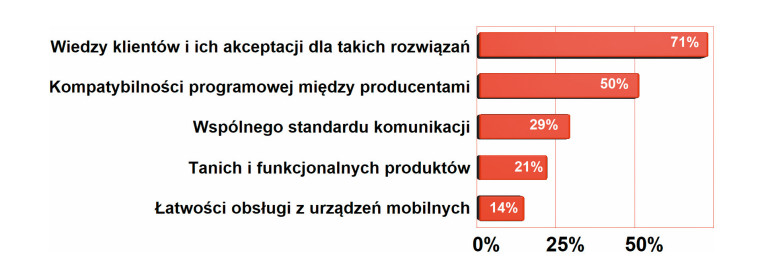

Czego najbardziej brakuje na rynku?

Zestawienie opinii wyrażonych w naszych ankietach jednoznacznie przekonuje, że na rynku automatyki budynkowej najwięcej problemów jest z brakiem wiedzy klientów na temat możliwości/ograniczeń technicznych produktów oraz tego, co można osiągnąć z ich wykorzystaniem. Drugim problemem jest kompatybilność programowa i razem te czynniki mogą być zniechęcające. Systemy automatyki budynkowej trafiają i są wybierane nie tylko przez ludzi ze świata techniki. Często mają duże możliwości w zakresie platformy sprzętowej i systemowej, ale wykorzystanie ogranicza słabe oprogramowanie. Efektem bywa rozczarowanie kupujących.

Matter – nowy standard interoperacyjności

Jednym z największych problemów współczesnych systemów automatyki domowej pozostaje brak wspólnego standardu komunikacyjnego. Skutkuje to fragmentacją rynku, koniecznością instalowania wielu hubów oraz ograniczoną kompatybilnością pomiędzy urządzeniami. Na to wyzwanie próbuje odpowiedzieć Matter – otwarty standard opracowywany przez Connectivity Standards Alliance (CSA), dawniej znane jako ZigBee Alliance, przy współpracy największych firm technologicznych, takich jak Apple, Google, Amazon czy Samsung.

Głównym celem Matter jest zapewnienie pełnej interoperacyjności urządzeń smart home, niezależnie od producenta czy technologii sprzętowej. W praktyce oznacza to, że użytkownik będzie mógł kupić czujnik jednej firmy, żarówkę innej i zamek jeszcze innego producenta, a wszystkie urządzenia będą działały w jednym, wspólnym ekosystemie – bez konieczności korzystania z oddzielnych aplikacji i bramek.

Technicznie Matter nie jest osobnym protokołem radiowym, lecz warstwą aplikacyjną, działającą na już istniejących technologiach transmisyjnych. Obsługuje komunikację przez Ethernet, Wi-Fi oraz Thread – nowoczesny protokół sieci mesh oparty na IPv6, zaprojektowany specjalnie dla urządzeń IoT o małym poborze mocy. Dzięki temu Matter zapewnia zarówno dużą przepustowość (np. dla kamer czy urządzeń multimedialnych), jak i energooszczędność, tak istotną dla czujników i wszystkich układów zasilanych bateryjnie.

Jednym z kluczowych aspektów standardu Matter jest bezpieczeństwo. Wszystkie połączenia są szyfrowane, a proces parowania urządzeń odbywa się z wykorzystaniem certyfikatów kryptograficznych. Każde urządzenie musi przejść proces certyfikacji, co pozwala zagwarantować zgodność z normami i zapewnić bezproblemową współpracę z innymi komponentami systemu.

Standard został zaprojektowany w sposób modułowy, co pozwala na jego dalszy rozwój. Pierwsze wersje Matter obejmują wsparcie dla podstawowych kategorii urządzeń, takich jak oświetlenie, zamki, termostaty, czujniki i gniazdka. W kolejnych edycjach planowane jest rozszerzenie o urządzenia AGD, systemy multimedialne, a także integrację z rozwiązaniami związanymi z energią, takimi jak ładowarki samochodowe czy magazyny energii.

Z perspektywy użytkownika Matter ma szansę stać się tym, czym standard USB stał się dla komputerów – uniwersalnym językiem komunikacji. Dla producentów oznacza to konieczność dostosowania swoich urządzeń do wymagań certyfikacji, ale jednocześnie otwiera ogromne możliwości pozyskiwania nowych klientów i użytkowników.

Wyzwania i ograniczenia

Mimo imponującego tempa rozwoju, systemy automatyki domowej wciąż napotykają pewne bariery natury technicznej i użytkowej. Jednym z największych problemów jest kwestia cyberbezpieczeństwa i ochrony prywatności danych. Inteligentny dom generuje ogromne ilości informacji, które mogą ujawniać codzienne nawyki mieszkańców, ich godziny aktywności czy preferencje związane z ogrzewaniem i oświetleniem. W wielu przypadkach są to dane wrażliwe, a ich nieodpowiednie zabezpieczenie naraża użytkowników na poważne konsekwencje. Praktyczne doświadczenia wielokrotnie udowodniły już, że źle chronione urządzenia IoT mogą stać się celem cyberataków. W przypadku urządzeń automatyki domowej bardzo groźne może być również uzyskanie nieautoryzowanego dostępu do zamków elektronicznych czy systemów alarmowych. Problem pogłębia fakt, że wiele tanich urządzeń wciąż nie stosuje zaawansowanych metod szyfrowania, a użytkownicy często na etapie konfiguracji decydują się na pozostawienie domyślnie ustawionego hasła.

Kolejną barierą jest brak standaryzacji i związane z tym trudności z interoperacyjnością urządzeń. Rynek układów smart home jest niezwykle rozdrobniony – producenci stosują różne protokoły komunikacyjne, takie jak ZigBee, Z-Wave, Wi-Fi, Bluetooth czy Thread. Z perspektywy użytkownika oznacza to konieczność instalowania wielu bramek i korzystania z kilku aplikacji, co nie tylko komplikuje obsługę, lecz także podnosi koszty wdrożenia. Brak wspólnych standardów ogranicza też skalowalność systemów i często prowadzi do sytuacji, w której użytkownik zostaje "uwięziony" w jednym ekosystemie producenta. Nadzieję na zmianę w tym obszarze daje inicjatywa Matter, która ma na celu ujednolicenie protokołów i zapewnienie pełnej kompatybilności urządzeń różnych marek, jednak jej popularyzacja wymaga jeszcze zapewne sporo czasu.

Istotnym ograniczeniem pozostaje także złożoność konfiguracji i obsługi systemów. Choć producenci coraz częściej oferują przyjazne interfejsy użytkownika, w praktyce instalacja i integracja urządzeń bywa skomplikowana. Wiele rozwiązań wymaga umiejętności programowania reguł automatyzacji czy znajomości środowisk open source, takich jak Home Assistant. Dla użytkowników mniej zaawansowanych technologicznie staje się to poważną barierą, a zbyt wysoki próg wejścia nierzadko skutkuje rezygnacją z dalszej rozbudowy systemu.

Nie bez znaczenia są również koszty wdrożenia i utrzymania. Choć ceny czujników i sterowników spadają, budowa kompleksowego systemu smart home wciąż wymaga niemałej inwestycji. Dodatkowym obciążeniem są koszty utrzymania – wymiana baterii w czujnikach, serwisowanie sprzętu czy konieczność aktualizacji oprogramowania. Problemem bywa też uzależnienie od producenta – jeśli firma wyłączy swoje serwery chmurowe, urządzenia mogą przestać działać, stając się "sierotami technologicznymi".

Na końcu warto wspomnieć o niezawodności i stabilności systemów. W praktyce zdarza się, że zakłócenia radiowe powodują utratę komunikacji z czujnikami, router Wi- Fi przeciążony setką urządzeń odmawia posłuszeństwa, a błędy w oprogramowaniu prowadzą do nieprzewidywalnego zachowania systemu. Szczególnie w dużych instalacjach – liczących setki elementów – stabilność działania pozostaje poważnym wyzwaniem.

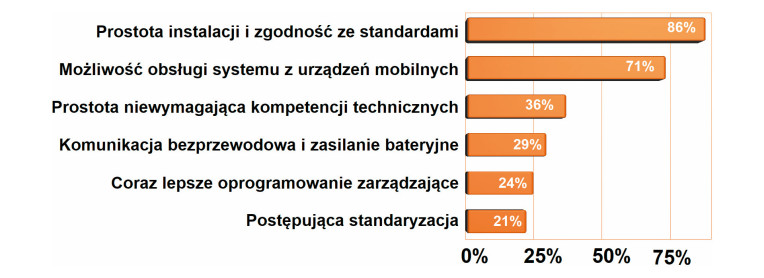

Najważniejsze trendy techniczne rynku komponentów do automatyki budynkowej

W zestawieniu najbardziej istotnych trendów zmieniających rynek automatyki budynkowej dwa kryteria wybijają się wyraźnie ponad resztę: prostota instalacji i zgodność ze standardami oraz możliwość obsługi z użyciem urządzeń mobilnych, czyli w praktyce ze smartfonu. Inaczej mówiąc, liczą się funkcjonalność i łatwość użycia z wykorzystaniem aplikacji. Rola smartfonów w systemach automatyki jest duża i z pewnością będzie jeszcze się zwiększać, bo mają one duże możliwości (obliczeniowe, komunikacyjne) i zawsze mamy je przy sobie.

Perspektywy rozwoju

Przyszłość systemów automatyki domowej rysuje się niezwykle obiecująco, a kierunki rozwoju wskazują, że w najbliższych latach będą one nie tylko bardziej zaawansowane technicznie, ale również znacznie lepiej dostosowane do indywidualnych potrzeb użytkowników. Kluczową rolę w tej ewolucji odegra sztuczna inteligencja (AI) oraz uczenie maszynowe (ML). Dzięki tym technologiom systemy będą zdolne do analizowania zachowania mieszkańców, uczenia się ich nawyków i przewidywania przyszłych potrzeb. Oznacza to, że inteligentny dom nie tylko zareaguje na obecność człowieka w pomieszczeniu, lecz także samodzielnie dostosuje temperaturę, oświetlenie czy muzykę w oparciu o wcześniejsze preferencje i kontekst sytuacyjny. W opracowaniach badawczych zwraca się uwagę, że kolejnym krokiem będzie zdolność systemów do rozumienia bardziej złożonych scenariuszy – np. automatyczne przypomnienie o konieczności wietrzenia pomieszczenia na podstawie analizy jakości powietrza i harmonogramu dnia domowników.

Równie istotnym obszarem rozwoju jest integracja automatyki domowej z inteligentnymi sieciami energetycznymi. W dobie dynamicznego rozwoju fotowoltaiki, magazynów energii i elektromobilności, systemy smart home staną się naturalnym elementem infrastruktury energetycznej. Dzięki komunikacji w czasie rzeczywistym będą mogły nie tylko redukować zużycie energii w godzinach szczytu, ale także aktywnie współpracować z siecią – np. oddając nadwyżki energii z domowego magazynu czy synchronizując ładowanie samochodu elektrycznego z produkcją energii ze słońca.

Duże nadzieje wiązane są również z rozwojem otwartych standardów komunikacyjnych. Inicjatywa Matter, wspierana przez największych producentów urządzeń, ma szansę zakończyć epokę rozdrobnienia i problemów z interoperacyjnością. Jeśli rozwiązanie to zostanie szeroko przyjęte, użytkownicy otrzymają wreszcie możliwość budowy systemów opartych na urządzeniach wielu producentów, bez konieczności stosowania licznych bramek czy dodatkowych aplikacji. Otworzy to drogę do dalszego dynamicznego rozwoju branży, obniżenia kosztów i szybszej popularyzacji inteligentnych rozwiązań w domach.

Warto również wspomnieć o rozwoju rozwiązań open source, takich jak Home Assistant czy OpenHAB, które zyskują popularność wśród bardziej zaawansowanych użytkowników i hobbystów. Projekty te, dzięki elastyczności i wsparciu społeczności, pozwalają na tworzenie systemów w pełni dostosowanych do indywidualnych potrzeb, a jednocześnie uniezależniają użytkowników od zamkniętych ekosystemów producentów.

Nie można zapominać także o rosnącym znaczeniu zastosowań zdrowotnych i opiekuńczych. Starzenie się społeczeństw sprawia, że inteligentne domy coraz częściej będą pełnić funkcję wsparcia w monitorowaniu zdrowia, przypominaniu o lekach czy wykrywaniu niebezpiecznych sytuacji, takich jak upadki. Połączenie automatyki domowej z telemedycyną i urządzeniami noszonymi może stać się jednym z kluczowych kierunków rozwoju w najbliższej dekadzie.

Można spodziewać się, że w najbliższej przyszłości inteligentne domy powoli zaczną stawać się standardem w nowoczesnym budownictwie, a ich funkcjonalności będą stopniowo przenikać także do modernizowanych starszych mieszkań. Wraz z rozwojem AI, IoT i technologii komunikacyjnych, automatyka domowa stanie się codziennością, podobnie jak niegdyś elektryczność czy Internet.

Obudowy i szafy dla elektroniki i przemysłu

Obudowy są atrakcyjnym dodatkiem do komponentów automatyki i podzespołów elektronicznych, które gdzieś trzeba nabyć: u producenta lub specjalizowanego dystrybutora, takiego, który jest w stanie dostarczyć produkt dopasowany do aplikacji o cechach indywidualnych lub też obudowę standardową z katalogu. Rynek obudów jest dziedziną, która odnotowuje ciągły wzrost. Wiąże się to z powszechnością stosowania tych produktów, bo każdy układ elektroniczny czy urządzenie musi być w czymś zamknięte, a także zastosowaniami specjalistycznymi, jak wykonanie przeciwwybuchowe. Asortyment produktów dostępnych na rynku ułatwia użytkownikom dobór właściwych rozwiązań do niemal każdej aplikacji.

Rynek obudów przemysłowych w Polsce charakteryzuje się dynamicznym rozwojem, napędzanym przez trendy w automatyzacji, cyfryzacji i rozwoju infrastruktury. Producenci muszą stale dostosowywać swoją ofertę do zmieniających się wymagań klientów i przepisów, inwestując w innowacje technologiczne i oferując rozwiązania "szyte na miarę". Wzrost znaczenia inteligentnych obudów i zrównoważonego rozwoju będzie w najbliższych latach kształtował ten rynek.

Najważniejsze czynniki negatywne dla rynku obudów

Najbardziej istotne czynniki przeszkadzające w rozwoju biznesu to rosnące koszty: produkcji, materiałów oraz pracy, które zmniejszają marżę produktową oraz wywołują konieczność podwyżek cen. Większe koszty zaostrzają też konkurencję na rynku i zmuszają wielu odbiorców do oszczędności, w tym do zmiany dostawców na tańszych, także tych z Dalekiego Wschodu. Poza czynnikami kosztowymi negatywny wpływ na rynek ma brak wiedzy klientów na temat zagadnień jakości w obudowach, a więc zdolności do wnikliwej oceny jakości produktów. Jeszcze dalej ulokowały się czynniki związane z ogromnym asortymentem tego typu produktów, w którym coraz trudniej mieć rozeznanie.

Koszty działalności nieustannie rosną

Produkcja obudów jest obszarem, w którym koszty działalności, a więc wydatki na materiały, media i koszty pracy, są dość duże a jednocześnie produkcja wymaga znacznych nakładów inwestycyjnych, m.in. na maszyny, takie jak wtryskarki i obrabiarki. Inwestycje w park maszynowy obciążają znacznie budżety firm, a jednocześnie duża część klientów końcowych kieruje się w wyborze produktu ceną. I w ten sposób warunki stają się trudne.

Ponadto czynnik kosztowy istotnie ogranicza szybkość penetracji rynku przez zaawansowane obudowy, a dodatkowo małe i średnie serie produkcyjne, wiele wariantów urządzeń, jakie są wytwarzane w ramach rodziny, nie dają wielu możliwości rozbicia bezzwrotnych kosztów stałych na produkcję. Dlatego sztuką jest zaproponowanie klientom kompromisu, czyli obudowy w miarę atrakcyjnej technicznie, ale możliwie niedrogiej. Inaczej klient kupi coś na Dalekim Wschodzie.

W naszych ankietach sygnalizowano nam napływ tanich produktów z Turcji w ostatnich miesiącach, które zyskują na znaczeniu w trudniejszych czasach, gdy klienci pod presją ekonomiczną godzą się na niższą jakość kosztem ceny. Pozytywnym zjawiskiem jest większe zainteresowanie nowoczesnymi rozwiązaniami na rynku i zwracanie uwagi na jakość produktu. Negatywnym jest nadal mała liczba nowych inwestycji w sektorze prywatnym.

Obudowa, czyli co?

Hasło "obudowy" to pojęcie bardzo ogólne, za którym kryje się ogromna liczba produktów przeznaczonych do różnych zastosowań, wykonanych z różnych materiałów, o różnej wielkości. Nawet jeśli weźmiemy pod uwagę obudowy do zastosowań w elektronice, nadal asortyment jest bardzo szeroki i co gorsza, trudny do kategoryzacji. Podział rynku jest przez to trudny, ale niestety niezbędny, aby dostawca i klient mówili wspólnym językiem. Warto zatem krótko i ogólnie opisać branżę.

Najprostszy podział obudów dla elektroniki dotyczy materiałów konstrukcyjnych, czyli mamy metale i tworzywa sztuczne (plastik). Może to być stal – zazwyczaj malowana proszkowo lub pokrywana galwaniczne, nierdzewna lub w wersji specjalnej, np. kwasoodporna. Jako metal używane jest też aluminium, zdecydowanie zaś rzadziej inne metale, jak cynk i mosiądz w postaci stopów. Stal zapewnia dużą wytrzymałość mechaniczną, dobrą izolację termiczną i elektromagnetyczną, do tego daje możliwość względnie łatwego czyszczenia, stąd też jest materiałem typowym – szczególnie do większych obudów, skrzynek instalacyjnych i szaf. Blachy stalowe są też materiałem najtańszym w tej kategorii.

Wykorzystywane tworzywa sztuczne to głównie ABS, polistyren, poliamid i poliwęglan, które różnią się głównie odpornością na temperaturę i narażenia mechaniczne. Tworzywa te są często modyfikowane za pomocą dodatków (komponentów), takich jak włókno szklane.

Najważniejsze dla klientów cechy oferty brane pod uwagę przy wyborze dostawcy obudów

W obecnych czasach ogólnej niepewności w obudowach najważniejszy jest termin wykonania lub dostawy tych produktów. To pokłosie problemów z zaopatrzeniem, zerwanymi łańcuchami dostaw oraz trwającą wojną na Ukrainie. Kolejny czynnik o mniej więcej podobnym znaczeniu to niska cena. Kilka lat temu cena była na trzeciej pozycji od góry, teraz awansowała na miejsce drugie, zapewne z uwagi na gorszą sytuację w gospodarce i oszczędności klientów. Pozostałe trzy kryteria, to jest jakość, dostępność wersji na zamówienie, marka producenta itd., mają podobne znaczenie. Niemniej faktem jest, że znaczenie dostępności kastomizacji i usług modyfikacji wyrobów katalogowych nigdy wcześniej nie było notowane tak wysoko. Prawdopodobnie klienci są dzisiaj wystarczająco świadomi, ile można zyskać w ten sposób wartości po stronie produktu i wzornictwa i sięgają po te możliwości. W czasach niepewności rynkowej dopasowanie wyrobów seryjnych jest też sposobem na to, aby mieć coś innego od katalogu bez konieczności zamawiania dużych serii.

Kolejny podział może być dokonywany pod względem wielkości obudów. Oferta obejmuje wersje małogabarytowe (głównie dla sprzętu konsumenckiego, automatyki budynkowej, małych systemów przemysłowych), w dalszej kolejności są wersje kompaktowe, a więc niewielkie szafki sterownicze i elektryczne, obudowy dla urządzeń przemysłowych. Kolejny krok to duże szafy dla potrzeb IT i systemów sterowania w przemyśle, na kompletne systemy dystrybucji energii oraz inne obudowy o charakterze specjalistycznym, czyli dopasowane do zastosowania.

Dalszy podział może być wykonywany pod względem aplikacyjnym. W tym zakresie można wyróżnić obudowy dla małych urządzeń elektronicznych, w tym elektroniki mobilnej, obudowy przemysłowe (np. na szynę), modułowe do zestawiania w większe instalacje, szafki instalacyjne do montażu systemów i instalacji, aparatury elektrycznej i elektronicznej oraz komponentów automatyki oraz duże szafy dla urządzeń przemysłowych, infrastruktury IT, a więc serwery wraz z układami chłodzenia i zasilania. Kolejna grupa to specjalistyczne rozwiązania: rackowe, z atestem przeciwybuchowym lub dla przemysłu spożywczego.

Kastomizacja – słowo klucz do rynku obudów

Z roku na rok producenci obudów biorą na swoje barki coraz więcej zadań związanych z konstrukcją urządzeń elektronicznych, a usługi indywidualizacji produktów seryjnych, takie jak frezowanie, otworowanie itp., stały się już normalną i obowiązkową częścią tytułowego biznesu. Poza obróbką mechaniczną, taką jak wiercenie otworów lub frezowanie, dotyczy to także integracji klawiatury, wyświetlacza wraz z szybą ochronną, panelu frontowego, systemu uszczelnienia i innych opcji związanych z zabezpieczeniem konstrukcji przed wpływem środowiska. W praktyce problemy z konstrukcją mechaniczną zawsze się pojawiają i nie są proste do rozwiązania, stąd możliwość skorzystania z pomocy kogoś, kto weźmie całość problemów na siebie, jest w branży cenną wartością. Można też powiedzieć, że klienci nie chcą tworzyć u siebie wyspecjalizowanych komórek organizacyjnych wykonujących personalizację obudów, wolą dopłacić i dostać produkt przygotowany pod ich specyficzne wymagania. To jest specjalizacja i koncentrowanie się na rdzeniu aktywności biznesowej.

Oferta usług oferowanych przez dostawców obudów się poszerza, bo takie oczekiwania mają dzisiaj klienci, którzy często nie dysponują parkiem maszynowym, aby takie operacje wykonywać samodzielnie oraz nie mają takich kompetencji. Kompleksowa obsługa nie jest pustym hasłem, ale dzisiaj definiuje w wielu firmach podejście do biznesu.

Najważniejsze trendy pozytywne dla rozwoju rynku obudów

Zestawienie czynników, które w pozytywny sposób oddziałują na rynek obudów, zawiera trzy kryteria o podobnym udziale, wyraźnie wybijające się nad resztę. Zainteresowanie jakością to trend zmieniający od wielu lat branżę elektroniki w Polsce. Szybki rozwój rynku elektroniki zwiększa asortyment produktów oraz liczbę klientów, a możliwość nadania projektowanemu urządzeniu cech niepowtarzalnych jest coraz bardziej istotna na silnie konkurencyjnym rynku. Takie możliwości zapewnia dzisiaj większość producentów obudów i jak widać z wykresu, są to usługi poszukiwane przez klientów. Można powiedzieć, że na przestrzeni ostatnich lat stały się dla omawianego rynku standardem.

Drugim istotnym czynnikiem związanym z popytem na indywidualizację obudów i obróbkę mechaniczną są koszty. Przygotowanie produktu o cechach indywidualnych wiąże się ze sporymi wydatkami. Trzeba wykonać projekt, uzgodnić go z klientem, potem prototypy i serie próbne. Konieczne jest wykonanie oprzyrządowania, np. formy wtryskowej. To są tzw. NRE, czyli bezzwrotne koszty inżynierskie na przygotowanie. Takie wydatki muszą być pokryte i rzadko się zdarza, aby klient pokrywał je z góry w całości. Raczej rozkłada się je na wiele części, zwiększając cenę produktu o niewielki ułamek. Aby to zadziałało, konieczne jest zdefiniowanie minimum zakupowego np. na 1000 sztuk.

Dla specjalistycznych urządzeń, krótkich serii projektowych, to minimum zakupowe jest trudne do akceptacji, stąd indywidualizacja obudów seryjnych bywa lepszym rozwiązaniem, bo uwalnia od sprostania wymaganiom dużego MOQ.

Ostatni czynnik sprzyjający indywidualizacji wyrobów seryjnych to czas, jaki jest konieczny do uruchomienia produkcji wolumenowej produktów full custom. Projekt, poprawki, prototypy, znowu poprawki, uzgodnienia, akceptacje zajmują mnóstwo czasu i przesuwają rynkową premierę. W obecnych czasach dla wielu firm długie czekanie nie wchodzi w grę.

Modułowość i systemowość to ważne zjawiska

Podobne znaczenie jak indywidualizacja wyrobów katalogowych ma jeszcze modułowość i rozwiązania systemowe obudów. Polega to na stworzeniu przez producenta serii wielu elementów składowych, które do siebie pasują i następnie pozwalają tworzyć rozwiązania dopasowane. To idea podobna do klocków Lego, z których buduje się większą całość. Modułowe rozwiązania tworzą serię i zawierają pakiet elementów podstawowych plus akcesoria montażowe, chłodzenie, przepusty lub nóżki, często w kilku wariantach kolorystycznych.

Taki zestaw elementów systemowych pozwala w wielu wypadkach złagodzić negatywne skutki wielu ograniczeń i problemów z szeroką ofertą, chęcią zapewnienia indywidualnych cech wzorniczych oraz dopasowania obudowy do wymagań aplikacyjnych. Kiedyś modułowość dotyczyła kompletnej marki i wszystkich wyrobów producenta, dzisiaj coraz częściej dotyczy ona serii lub jednej rodziny, w ramach której daje się wymiennie używać poszczególnych detali. Na rynku są producenci, u których taką modułowość widać na pierwszy rzut oka, np. Phoenix Contact lub Bopla.

Najważniejsze trendy zmieniające rynek obudów

Najważniejsze trendy zmieniające rynek obudów to usługi obróbki mechanicznej i indywidualizacji poprzez modyfikacje mechaniczne, lakierowanie, wykonywanie frontów (paneli), tak aby w efekcie otrzymać kompletny i gotowy produkt, do którego wystarczy zamontować płytkę i akcesoria. Wysoka jakość i dokładność wykonania zawsze mają znaczenie, gdyż jest to uniwersalne i ponadczasowe kryterium dla całej współczesnej techniki. Warto dostrzec, że za istotne czynniki uznano też to, aby obudowa miała charakter uniwersalny, a więc dała się przynajmniej częściowo wykorzystać do kolejnych wersji jako rozwiązanie skalowalne. W ten sposób można mieć mniejsze koszty oraz spójną koncepcję wzorniczą dla całej serii.

Jakość przede wszystkim

W perspektywie ostatniej dekady na rynku wyraźnie widoczny jest trend szybkiej ewolucji technicznej obudów, nieustannie kierującej rynek w stronę wysokiej jakości, zaawansowania technicznego (precyzji) oraz nowoczesnego wzornictwa i lepszych materiałów. Producenci zainwestowali w rozwój parku maszynowego, a więc w nowoczesne obrabiarki, wtryskarki, wykrawarki, centra CNC, drukarki 3D, a także w narzędziownie oraz rozszerzyły potencjał informatyczny w zakresie projektowania i zarządzania produkcją. Efekty tych działań są widoczne gołym okiem i podczas dotykania. Coraz mniej mamy też prostoty kształtów przejawiającej się w prostopadłościennej konstrukcji. Jeśli chodzi o wzornictwo, to także producenci nie mają się czego wstydzić.

Producenci i dystrybutorzy utrzymują też stany magazynowe pozwalające im dostarczać większość produktów praktycznie od ręki. Poszerzyli też znacznie sieć sprzedaży o dystrybutorów, nierzadko sieć dystrybucji jest bardzo rozległa. Zmiana ta może nie wydawać się aż tak istotna, ale dla firm niewielkich i tych skupionych na rynkowych niszach nierzadko oczekiwanie na dostawę było sporym ograniczeniem, głównie tych skupionych na projektach szytych na miarę, które realizuje się pod zamówienie w krótkim czasie.

Szafy przemysłowe – oddzielna kategoria produktowa

Duże szafy przemysłowe stanowią odrębną i wartościową grupę produktową, która jest wykorzystywana do montażu urządzeń do rozdziału energii, sterowników i napędów przemysłowych oraz oczywiście systemów teleinformatycznych. Produkty takie, choć często znajdziemy w ofercie dostawców sprzedających również mniejsze gabarytowo obudowy, konstrukcyjnie różnią się znacząco od tych ostatnich.

Szafy są zwykle wypakowane sprzętem, a ich typowe zastosowanie to "centrum informatyczne" firmy, zawierające serwer, sprzęt sieciowy, centralę telefoniczną, system zasilania gwarantowanego, system alarmowy, rejestrator wideo z kamer monitoringu, system archiwizacji danych i podobne urządzenia. Z punktu widzenia biznesu sprzęt taki stanowi rdzeń infrastruktury technicznej firmy, stąd obudowa, która je mieści, musi być nie tylko wysokiej jakości, ale zawierać szereg przemyślanych rozwiązań umożliwiających rozbudowę wraz z przedsiębiorstwem, wydajne chłodzenie, serwis i obsługę techniczną urządzeń i podobne czynniki. Taką obudowę kupuje się na lata, stąd szafy można traktować jako niszową na rynku obudów kategorię, ale wartościową. Widać to też po stronie producentów i dostawców. O ile małe obudowy sprzedaje i produkuje wiele firm, o tyle dostawców szaf, zwłaszcza tych najlepszych, jest znacznie mniej. Taki sprzęt bazuje na profilach metalowych tworzących szkielet, do których dołączane są ściany, podłoga, sufit – w różnych wykonaniach, aczkolwiek zazwyczaj standaryzowanych pod względem wymiarów. Pozwala to na ich modułowe zestawianie, łatwe prowadzenie ciągów elektrycznych, rozbudowę o klimatyzatory itd. Szafy wykonywane są zazwyczaj z blachy stalowej, często fosforanowanej i malowanej, dla zapewnienia lepszej odporności.

Szafy najczęściej nie mają z góry zdefiniowanej konstrukcji, a większość producentów pozwala na ich kompozycję z elementów składowych. Użytkownik może dobierać nie tylko wielkość, ale też sposób łączenia, materiał drzwi itd., a do tego często różne urządzenia dodatkowe (wentylatory, klimatyzatory, systemy rozdziału energii, panele oświetleniowe) oraz osprzęt (np. mocowania, haki, nogi, itd.).

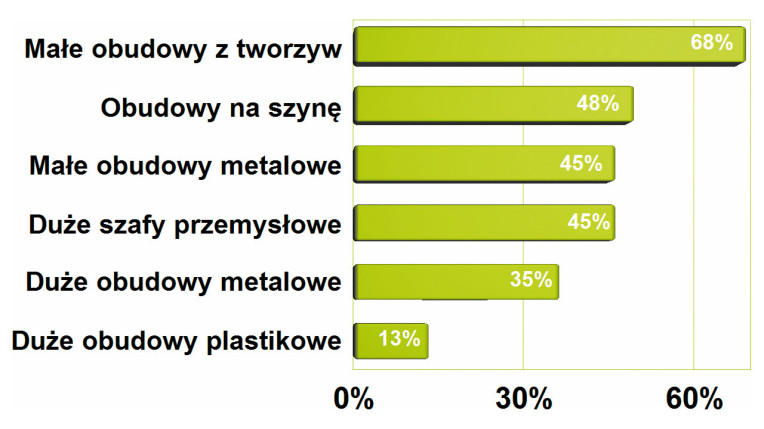

Na które typy obudów jest największy zbyt na rynku krajowym?

Najbardziej poszukiwane są obudowy małe plastikowe, w tym wersje na szynę DIN oraz małe metalowe. Mają one największą uniwersalność, pokrywają ogromną liczbę zastosowań oraz są dostępne w najszerszym zakresie spektrum typów i wersji. Obudowy na szynę DIN są bardzo popularne w systemach przemysłowych i układach automatyki budynkowej. Zapewniają one wygodę i prostotę montażu oraz są standardową konstrukcją z możliwością łączenia produktów różnych producentów. Reszta ma zdaniem ankietowanych specjalistów znacznie słabsze znaczenie rynkowe, co wynika z ich innego obszaru aplikacyjnego.

Miniaturyzacja i sprzęt mobilny sprzyjają plastikowi

W branży elektroniki miniaturyzacja i wiążące się z nią coraz większe znaczenie urządzeń mobilnych są czynnikami potęgującym zapotrzebowanie na obudowy z tworzyw sztucznych. Wersje metalowe, w tym małe obudowy metalowe, trafiają w rynkowe nisze i w zastosowania specjalne, takie, gdzie wymagana jest bardzo duża odporność środowiskowa i mechaniczna, gdzie liczy się możliwość ekranowania elektromagnetycznego oraz niewrażliwość na promieniowanie UV i długowieczność. W zasadzie wszystkie pozostałe czynniki techniczne i użytkowe przemawiają za obudowami z tworzywa sztucznego.

Obudowy metalowe sprawdzają się w urządzeniach telekomunikacyjnych pracujących na zewnątrz, w transporcie kolejowym i morskim, rozległych instalacjach przemysłowych, urządzeniach radiowych, bo tam wymagana jest najwyższa trwałość. Ale w porównaniu do całego rynku takich aplikacji nie ma tak wiele i nie są one też masowe.

Mamy w ofertach coraz więcej wersji z plastiku także dlatego, że są one coraz lepsze. Poliwęglan i inne tworzywa w wersji wzmacnianej (np. dodatkiem włókna szklanego), razem z wylewanymi uszczelkami, dają w efekcie produkt niewiele odstający funkcjonalnie od wersji metalowych. Hermetyczne obudowy plastikowe z poprawioną wytrzymałością mechaniczną są dostępne w coraz szerszym asortymencie, co dodatkowo świadczy o tym, że rynek ewoluuje w kierunku plastiku.

Producenci obudów

Producenci obudów zwykle specjalizują się w określonym typie (np. metalowe lub plastikowe), obszarze rynku, a nawet konkretnych aplikacjach i często wytwarzają produkty niszowe. Produkcja obudów to stanowczo zbyt szeroka branża, aby możliwe było jej zdominowanie przez kilka dużych firm, stąd na rynku jest wielu producentów. Równocześnie produkcja obudów to obszar kapitałochłonny od strony przygotowania produkcji, maszyn, oprzyrządowania, form wtryskowych i tym samym producenci nie są w stanie szybko poszerzać asortymentu. W branży dominuje ewolucyjne podejście do biznesu, co ogranicza konkurencję z innymi firmami i zapewnia dużą różnorodność.

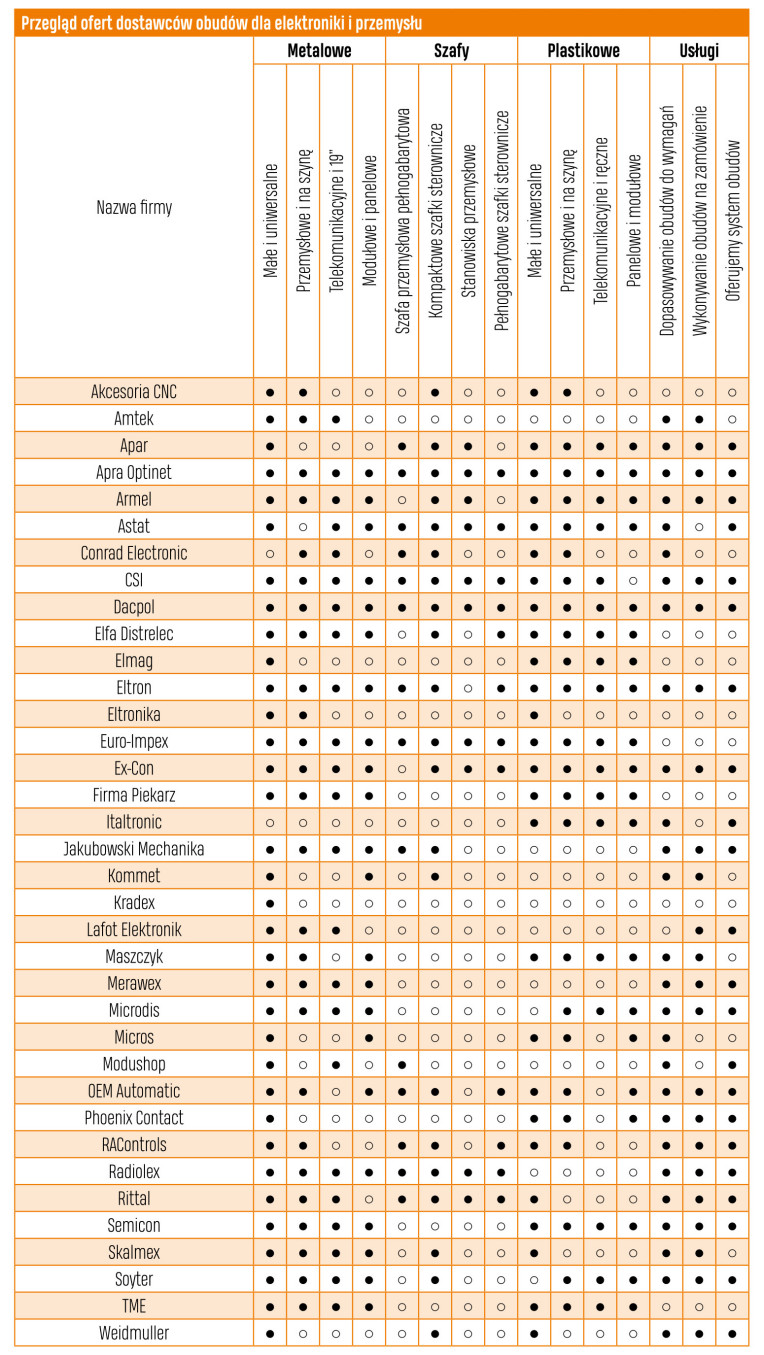

Krajowi producenci obudów to m.in. Armel, Jakubowski, Kommet, Radiolex, Elmag, Kradex, Maszczyk. Poza Kradeksem i Maszczykiem polskie firmy produkcyjne w większości zajmują się wytwarzaniem obudów metalowych, które przeznaczone są do zastosowań w telekomunikacji, sterowniach, systemach zasilania, systemach komputerowych i podobnych zastosowaniach przemysłowych, takich, gdzie zamówienia dotyczą niewielkich serii produktów, ale za to na przykład wymagających zapewnienia dużej odporności na czynniki środowiskowe, o indywidualnych cechach.

Do kluczowych na rynku producentów zagranicznych należą przedsiębiorstwa będące oddziałami producentów zagranicznych – są nimi m.in. Phoenix Contact, Rittal, Italtronic.

Dystrybutorzy obecni na rynku krajowym

Dla producentów obudowy z reguły są główną działalnością, dla dystrybutorów są fragmentem większej oferty. To ostatnie wynika z faktu, że wielu producentów ma nieraz wąską specjalizację i dystrybutor, chcąc zapewnić szeroki asortyment dla różnych odbiorców, musi pozyskiwać je z wielu źródeł. Przykładem firm dystrybucyjnych, dla których obudowy to ważna część biznesu, mogą być Apar, Dacpol, Eltron.

Drugą grupę dystrybutorów tworzą dostawcy związani z jedną lub maksymalnie dwoma producentami. Obudowy w tym przypadku są uzupełnieniem i dopełnieniem innej części biznesu i pozwalają im zwiększyć wartość dodaną. Przykładem mogą być firmy Semicon, LaFot, Eltronika, Microdis, Soyter Components lub OEM Automatic.

Obudowy sprzedają też wszyscy dystrybutorzy katalogowi. Firmy te mają szerokie spektrum produktów, co do zasady im większe, tym lepsze, najlepiej liczone w milionach.

Dobre dopasowanie obudowy do aplikacji, wybór odpowiedniego rozwiązania spośród dostępnych opcji lub z elementów systemu modułowego, weryfikacja pomysłów konstruktorów, a także przedstawienie możliwości kompozycji obudowy jako całości dla aplikacji klienta to zadanie dla producenta lub dystrybutora. Zadaniem dostawcy jest też często weryfikacja pomysłów konstruktorów, a więc ocena i wyjaśnianie sensowności przyjętych założeń, wykrywanie słabych punktów, wskazywanie pomyłek lub elementów wymagających przemyślenia. Im dziedzina jest bardziej odległa od projektowania elektroniki, tym niestety pracy w takich obszarach jest więcej.

Regulacja i pomiar temperatury

Pomiar i regulacja temperatury to kluczowe zagadnienia znacznej liczby systemów elektronicznych i przemysłowych. Wybór odpowiedniego czujnika zależy od wymagań i uwarunkowań systemu, takich jak zakres pomiarowy, oczekiwana dokładność pomiaru, czas reakcji na zmiany wartości mierzonej czy szybkość i łatwość integracji. Znajomość typów dostępnych sensorów oraz ich podstawowych właściwości pozwala na podejmowania świadomych i korzystnych decyzji projektowych. Uzupełnieniem skutecznego systemu kontroli temperatury są odpowiednio dobrane algorytmy regulacyjne. Kompleksowe podejście do pomiaru i regulacji temperatury jest bardzo często niezbędne dla zapewnienia poprawnej pracy całego systemu.

Termopara

Termopara to jeden z najstarszych i wciąż najbardziej uniwersalnych typów sensorów temperatury. Komponent ten wykorzystuje zjawisko Seebecka, polegające na powstawaniu siły elektromotorycznej (napięcia) w obwodzie zawierającym dwa metale lub półprzewodniki, jeśli ich złącza znajdują się w różnych temperaturach.

Wyróżnia się wiele różnych typów termopar (oznaczanych pojedynczą literą alfabetu, np. typ J, K, T, E, S, R, B), które różnią się zakresem pomiarowym i dokładnością pomiaru.

Do głównych zalet termopar zaliczyć można szeroki zakres pomiarowy, wysoką odporność na uszkodzenia mechaniczne, zdolność do pracy z bardzo wysokimi temperaturami, relatywnie niską cenę, a także brak konieczności stosowania dodatkowego źródła zasilania. Wśród istotnych wad wymienić można małą dokładność (rzędu ±2°C), konieczność kompensacji temperatury złącza odniesienia oraz stosowania złożonych algorytmów przetwarzania i kondycjonowania sygnału pomiarowego.

Czujnik rezystancyjny (RTD)

Czujniki rezystancyjne (RTD, Resistance Temperature Detectors) wykonane są zazwyczaj z platyny, ponieważ metal ten charakteryzuje się niemal liniową charakterystyką zmian rezystancji w funkcji temperatury. Komponent ten ma dobrze zdefiniowaną, powtarzalną i scharakteryzowaną funkcję przejścia rezystancji i temperatury, dlatego też czujniki RTD są powszechnie używane w zastosowaniach naukowych i oprzyrządowaniu pomiarowym.

W praktyce czujnik RTD to z reguły platynowy drut lub cienka folia, czasami z dodatkiem innych metali szlachetnych, takich jak rod. Charakteryzuje się znaną rezystancją nominalną i dodatnią zmianą rezystancji w funkcji temperatury (tzn. dodatnim współczynnikiem temperaturowym – PTC). Czujniki RTD mogą być produkowane z różnymi wartościami rezystancji znamionowej, przy czym najbardziej powszechne są czujniki Pt100 i Pt1000 (czasami zapisywane jako PT100 i PT1000) o rezystancji nominalnej odpowiednio 100 Ω i 1000 Ω w temperaturze 0°C.

Zaletą RTD jest duża dokładność pomiaru (rzędu ±0,1°C), bardzo dobra powtarzalność oraz długoterminowa stabilność. Zakres pomiarowy mieści się zazwyczaj w przedziale od –200°C do +800°C. Tego typu czujniki wymagają zasilania prądowego oraz układów kompensujących rezystancję przewodów. W zależności od długości przewodów łączących czujnik z resztą obwodu pomiarowego stosuje się połączenie dwu-, trój- lub czteroprzewodowe. Dodatkowe wyprowadzenia pozwalają kompensować rezystancję przewodów połączeniowych.

Termistor

Termistor to rezystor półprzewodnikowy o rezystancji silnie zależnej od temperatury, w dużo większym stopniu niż w przypadku zwykłych oporników. Wyróżnia się termistory NTC (o ujemnym współczynniku temperaturowym – rezystancja maleje wraz ze wzrostem temperatury), PTC (dodatni współczynnik temperaturowy) oraz CTR (skokowa zmiana rezystancji – wzrost temperatury powyżej określonej wartości progowej powoduje gwałtowną zmianę rezystancji).

Do głównych zalet termistorów zalicza się dużą czułość, niewielki koszt oraz małe rozmiary. Wśród największych wad wymienia się nieliniową charakterystykę temperaturową, która wymaga stosowania mechanizmów korekcji liniowej, ograniczony zakres pomiarowy, szczególnie w porównaniu z termoparami, a także podatność na zmiany starzeniowe.

Czujniki zintegrowane (scalone)

Półprzewodnikowe czujniki temperatury wykonane w formie układów scalonych to wygodne rozwiązania, oferujące kompletny system pomiarowy wyposażony w interfejs analogowy lub cyfrowy (np. I2C lub SPI). Do zalet tego typu rozwiązań zaliczyć można bardzo łatwą integrację z resztą systemu oraz dobrą dokładność pomiaru. Jedną z wad jest ograniczony zakres pomiarowy, z reguły mieszczący się w zakresie od –55°C do +150°C. Gotowe układy scalone bardzo często oferują dodatkowe funkcje, takie jak filtracja sygnału czy reakcja na przekroczenie określonych wartości granicznych.

Czujniki bezkontaktowe

Pomiar temperatury nie zawsze wymaga bezpośredniego kontaktu pomiędzy sensorem a badanym obiektem. Do najpopularniejszych bezkontaktowych metod pomiarowych zaliczyć można pomiar za pomocą promieniowania podczerwonego oraz za pomocą czujników światłowodowych.

Czujniki podczerwieni mierzą temperaturę na podstawie pomiaru natężenia promieniowania cieplnego emitowanego przez obiekt. Bardzo często stosowane są podczas pomiarów obiektów będących w ruchu lub znajdujących się w szczególnie niebezpiecznych warunkach, np. w piecach hutniczych.

Czujniki światłowodowe stosowane są z reguły tam, gdzie wymagana jest odporność na zakłócenia elektromagnetyczne lub iskrobezpieczeństwo, np. w strefach zagrożonych wybuchem.

Kryteria doboru czujnika

Dobór odpowiedniego typu czujnika temperatury powinien być poprzedzony analizą kilku kluczowych parametrów technicznych oraz warunków środowiskowych, w jakich ma pracować dany system.

Prawdopodobnie najbardziej istotnym kryterium jest zakres pomiarowy, który musi obejmować zarówno minimalne, jak i maksymalne wartości mogące wystąpić w danym systemie. Dla bardzo wysokich temperatur, np. w hutnictwie, najlepiej sprawdzają się termopary, zaś w przypadku precyzyjnych pomiarów laboratoryjnych często stosuje się czujniki RTD.

Nie mniej ważnym czynnikiem jest wymagana dokładność pomiaru. Jeśli system wymaga bardzo precyzyjnej regulacji temperatury (np. w procesach farmaceutycznych lub chemicznych), warto wybrać czujniki RTD lub zintegrowane układy scalone o niewielkiej wartości błędu pomiarowego. W rozwiązaniach, gdzie dokładność pomiaru nie jest zagadnieniem krytycznym, wystarczające mogą okazać się tanie termistory NTC.

Nie należy również ignorować wymagań dotyczących czasu reakcji czujnika, która zdecydują o tym, jak szybko system będzie w stanie reagować na zmiany temperatury. Bardzo dobrym czasem reakcji charakteryzują się termopary i termistory, co czyni je dobrymi kandydatami do pracy w środowiskach z dynamicznie zmieniającą się temperaturą. Czujniki RTD charakteryzują się dłuższym czasem odpowiedzi, oferują za to lepszą liniowość i stabilność.

Istotna jest także odporność czujnika na czynniki środowiskowe, takie jak wilgoć, drgania, pole elektromagnetyczne czy obecność gazów. W takich warunkach preferowane są czujniki światłowodowe lub IR, które nie mają części elektronicznych narażonych bezpośrednio na wpływ środowiska.

Na końcu warto uwzględnić także aspekty praktyczne: koszt zakupu i integracji czujnika, dostępność, łatwość montażu, a także możliwość jego kalibracji i ewentualnej wymiany serwisowej.

Obwody pomiarowe i przetwarzanie sygnału

Czujnik temperatury samodzielnie nie jest wystarczający do uzyskania wiarygodnych danych pomiarowych. Konieczne jest zastosowanie układów kondycjonowania i przetwarzania sygnału, które pozwolą dostosować sygnał wyjściowy czujnika do możliwości jego dalszego przetwarzana, np. przez mikroprocesor lub sterownik PLC.

W przypadku termopar generowany przez czujnik sygnał napięciowy jest bardzo niski (rzędu mikrowoltów), dlatego konieczne jest jego wzmocnienie. W tym celu stosuje się precyzyjne wzmacniacze różnicowe o dużej wartości wzmocnienia i niskim poziomie zakłóceń. Korzystanie z termopar wymaga też kompensacji złącza odniesienia. Istnieje kilka podstawowych sposobów realizacji – co do zasady podzielić je można na metody związane z utrzymywaniem stałej temperatury złącza odniesienia lub monitorowaniem i kompensacją wpływu tej temperatury na wynik pomiaru.

Przy korzystaniu z czujników RTD niezbędne jest zasilanie ich stałym prądem o małej wartości, rzędu miliamperów, co pozwala ograniczyć efekt samoogrzewania czujnika. Napięcie wygenerowane na rezystorze mierzy się za pomocą przetwornika ADC. Istotne znaczenie dla dokładności pomiaru ma wartość rezystancji przewodów. Aby zminimalizować negatywne efekty, stosuje się układy kompensacyjne w konfiguracji 3- lub 4-przewodowej.

Termistory wykorzystywane są zazwyczaj w konfiguracji dzielnika napięcia, co upraszcza konstrukcję obwodu, ale wymaga linearyzacji uzyskanego sygnału pomiarowego. Kompensacja ta realizowana jest zazwyczaj programowo, przez wykorzystanie danych tabelarycznych aproksymacje wielomianowe lub równanie Steinharta- Harta.

Czujniki zintegrowane w formie układów scalonych są z reguły bardzo proste w integracji z resztą systemu, ponieważ dostarczają przetworzony sygnał w formie cyfrowej lub analogowej. Wiele z nich ma dodatkowe funkcje, takie jak programowalne wartości alarmowe lub możliwość kalibracji.

Czujniki IR wymagają dodatkowych układów do przetwarzania sygnału optycznego na wartość temperatury, uwzględniających korekcję emisyjności i wpływu temperatury otoczenia obiektu. Z reguły, podobnie jak zintegrowane układy scalone, dostarczane są w formie gotowych rozwiązań pomiarowych, które łączy się z resztą systemu za pomocą odpowiedniego interfejsu komunikacyjnego.

Regulacja temperatury

W wielu systemach kolejnym kluczowym krokiem po zmierzeniu temperatury jest jej skuteczna regulacja. Realizacja tego zadania wymaga zastosowania odpowiedniego algorytmu sterowania oraz komponentów wykonawczych.

Najprostszym sposobem regulacji temperatury jest metoda on/off, znana również jako histerezowa. W tym trybie element grzewczy lub chłodzący jest włączany, gdy temperatura spada poniżej ustalonej wartości dolnej, a wyłączany po przekroczeniu wartości górnej. Główna zaletą tego sposobu sterowania jest prostota implementacji. Metoda ta może jednak prowadzić do cyklicznych wahań temperatury i nie nadaje się do zastosowań wymagających dużej precyzji.

Dużo bardziej zaawansowanym rozwiązaniem jest zastosowanie regulatora PID (proporcjonalno-całkująco- różniczkującego). Regulator PID uwzględnia nie tylko bieżący błąd (różnicę między temperaturą zadaną a zmierzoną), ale także jego całkowitą sumę w czasie oraz szybkość zmian. Dzięki temu możliwe jest osiągnięcie wysokiej precyzji sterowania bez przeregulowań i z minimalnym czasem stabilizacji.

Regulatory PID znajdują szerokie zastosowanie w przemyśle chemicznym, farmaceutycznym, spożywczym, a także w automatyce budynkowej i systemach HVAC (heating, ventilation, air conditioning). Współczesne sterowniki często wyposażone są w funkcje automatycznego strojenia parametrów PID, a także możliwość definiowania profili temperaturowych (np. krzywej grzania i chłodzenia, programy cykliczne).

W systemach rozproszonych lub IoT coraz częściej stosuje się metody regulacji temperatury oparte o algorytmy adaptacyjne i predykcyjne, zdolne do analizy zgromadzonych w systemie danych historycznych oraz prognozy zmian warunków zewnętrznych. Takie podejście pozwala nie tylko na lepsze dostosowanie do zmiennych warunków pracy, ale również na optymalizację zużycia energii i zwiększenie żywotności komponentów.

Elementami wykonawczymi w układach regulacji temperatury mogą być grzałki rezystancyjne, moduły Peltiera, zawory elektromagnetyczne, wentylatory, sprężarki czy pompy. Dobór odpowiedniego komponentu zależy od charakterystyki obciążenia cieplnego oraz wymagań aplikacyjnych.

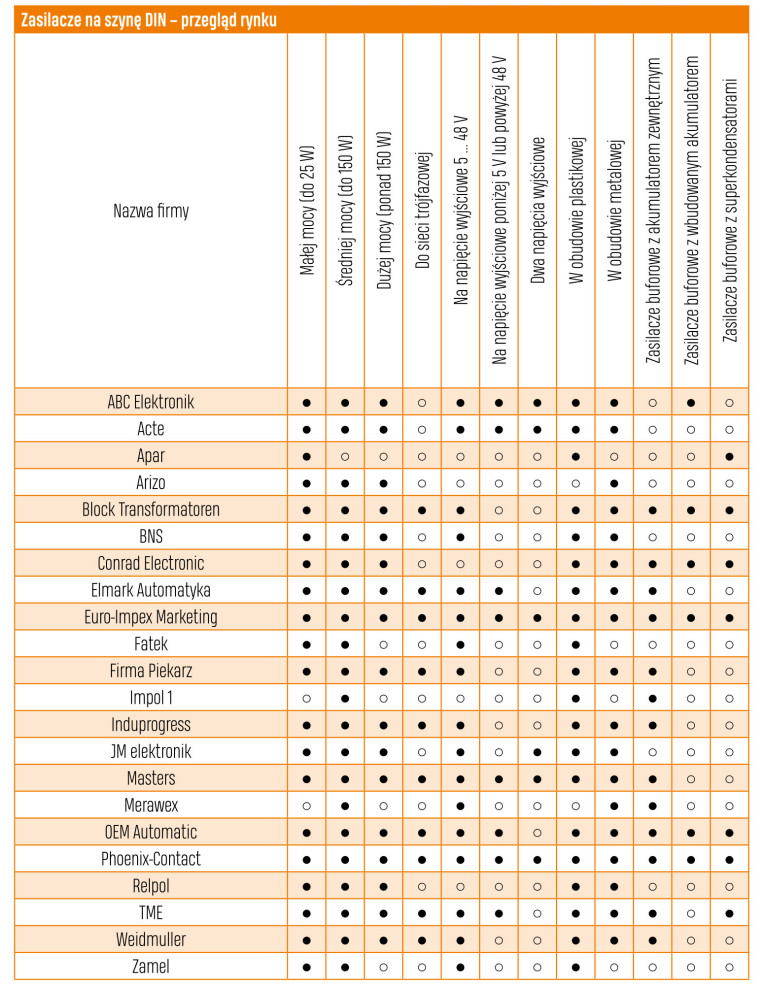

Zasilacze na szynę DIN

Zasilacze na szynę DIN to jednostki, które wyróżniają się specjalną obudową, w której tylnej części umieszczony jest zaczep pozwalający na zamocowanie jej na metalowej szynie o szerokości 35 mm. Mocowanie polega na przyciśnięciu obudowy zasilacza do szyny. Jej specjalny kształt przypominający spłaszczoną literę U – tzw. top hat i zatrzask w obudowie powodują, że zamocowanie następuje automatycznie i nie wymaga narzędzi. Rozmiar szyny i kształt zatrzasku są znormalizowane (stąd właśnie nazwa DIN od Niemieckiego Instytutu Normalizacyjnego – Deutsches Institut für Normung), dzięki czemu zasilacze w takich obudowach pasują do każdej skrzynki instalacyjnej dowolnego producenta.

Na szynie DIN mocowane są także bezpieczniki, wyłączniki, kontrolki, przekaźniki i sterowniki. Asortyment takich produktów jest bardzo szeroki, ich wybór ogromny, przez co system montażu na szynie DIN stał się bardzo popularny w ostatnich latach w aplikacjach przemysłowych, automatyce domowej i budynkowej. Poszczególne jednostki zasilające tego typu mają przyłącze śrubowe w dolnej i górnej części obudowy, a podłączenie do instalacji odbywa się za pomocą przewodów.

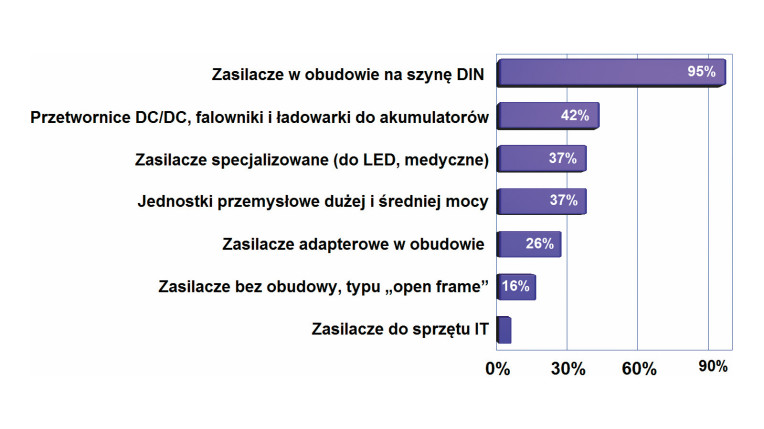

Zasilacze o największym potencjale rynkowym

Z naszego badania ankietowego wynika, że największą popularnością na rynku cieszą się zasilacze w obudowie na szynę DIN, a także falowniki, ładowarki do akumulatorów. Obudowa przeznaczona do montażu na szynie to obecnie jedno z najpopularniejszych rozwiązań technicznych wykorzystywanych w instalacjach przemysłowych. W wersji "na szynę" dostępnych jest wiele typów aparatury i urządzeń, w tym także zasilacze o mocy nawet do 500 watów. Ten segment rynku jest ukierunkowany na aplikacje przemysłowe i budynkowe, i bardzo szybko się rozwija. W kolejnych latach będziemy mogli obserwować wiele nowych produktów o zaawansowanej funkcjonalności.

Szyna DIN służy przede wszystkim do czysto mechanicznego mocowania oraz łączenia elementów, nie pełniąc zazwyczaj żadnej elektrycznej funkcji w systemie. Największą siłą systemu montażowego opartego na szynie DIN jest wysoki poziom standaryzacji. Rozwiązanie to było projektowane oraz rozwijane z myślą o całkowitej kompatybilności urządzeń pochodzących od różnych producentów. Decydując się na skorzystanie z tej technologii, zarówno projektant układu, jak i jego instalator mogą mieć praktycznie stuprocentową pewność, że poszczególne elementy systemu montażowego będą ze sobą kompatybilne, bez względu na nazwę ich producenta. Dzięki temu z ogromną łatwością korzystać można z komponentów oferowanych przez różnych wytwórców, integrując je wszystkie w jeden system.

Sytuacja na rynku krajowym

Polski rynek zasilaczy jest bardzo zróżnicowany co do wymagań i funkcjonalności zasilacza. Widać na nim wiele procesów, które są skierowane przeciwstawnie do siebie i będących źródłem dużej dynamiki zjawisk. Z jednej strony specjaliści w branży zdają sobie sprawę, że coraz bardziej wyszukana elektronika i układy sterowania oraz transmisji danych wymagają pewnego i niezawodnego zasilania, z drugiej strony istnieje ciągła presja na cenę. Stąd można powiedzieć, że mamy dwa segmenty. Jeden to rynek świadomych inżynierów szukających zaawansowanych zasilaczy dopasowanych do konkretnej aplikacji pod względem: wyśrubowanych parametrów, dopuszczeń, możliwego zdalnego dostępu oraz ich trwałości i marki producenta. Z drugiej strony mamy rynek hurtowni i przetargów publicznych, którego podstawowym kryterium jest cena.

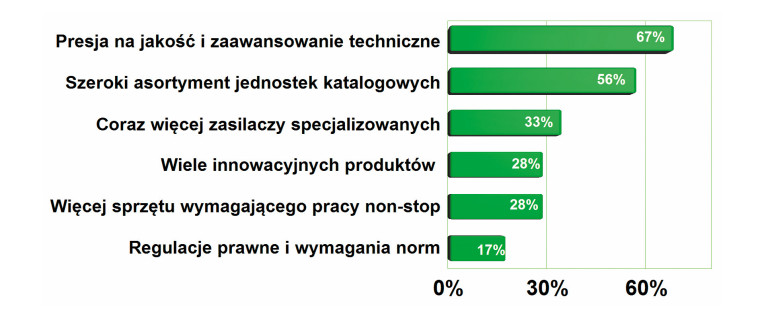

Najważniejsze zjawiska pozytywne dla rynku zasilaczy

Czynniki pozytywnie wpływające na rynek to stale zwiększająca się presja na jakość i wzrost zaawansowania technicznego urządzeń elektronicznych. W dużej mierze jest to proces powiązany z rosnącymi wymaganiami klientów, którzy mają świadomość, jak wiele zależy od dobrego zasilacza lub mają już za sobą eksperymenty z produktami z dolnej półki. Drugim ważnym aspektem jest szeroki asortyment produktów katalogowych dostępnych na rynku, w tym także jednostek specjalizowanych, co umożliwia optymalne dobranie zasilacza do aplikacji bez sięgania po kompromisy.

Liczba odbiorników energii rośnie i z tematem zapewnienia zasilania w praktyce musi się zmierzyć każdy, ale zainteresowanie tematyką, poziom wiedzy dostawców i odbiorców nie idzie z tym w parze. Im zagadnienie dotyczy zasilaczy mniejszej mocy, tym niestety negatywnych zjawisk i problemów widać więcej.

Na rynku nadal dostępne są zasilacze niskiej jakości, które mogą stanowić zagrożenie dla stabilności i bezpieczeństwa systemów. Szeroka gama dostępnych modeli zasilaczy o różnych specyfikacjach i cenach może utrudniać konsumentom dokonanie odpowiedniego wyboru, zwłaszcza bez odpowiedniej wiedzy technicznej.

Czynniki o charakterze negatywnym dla rynku zasilania

Główne problemy rynku zasilania to silna konkurencja na rynku, brak pieniędzy na inwestycje i oszczędności zakupowe oraz tanie i kiepskie zasilacze dalekowschodnie, które konkurują cenowo z lepszymi produktami markowymi. Pierwsze dwa czynniki są ze sobą oczywiście powiązane, gdyż gorsza sytuacja na rynku i oszczędności inwestycyjne znacznie zaostrzają konkurencję. Negatywny wpływ na rynek kiepskiej jakości zasilaczy polega na tym, że bazują na tanich elementach, są słabo zabezpieczone przed stanami nieustalonymi, przez co są wrażliwe na uszkodzenia, a oszczędności na materiałach prowadzą do pracy na krawędzi możliwości i podatności na awarie. Sytuacje komplikuje to, że w Chinach produkowane są zasilacze kiepskie, dobre i te czołowe markowe jednostki o znakomitej funkcjonalności. Co więcej, tamtejsi producenci mają w ofercie lepsze zasilacze dla klientów wymagających i słabe dla tych, którzy są zainteresowani niską ceną. Utrudnia to znacznie ocenę jakości.

Zasilacze na szynę DIN – cechy charakterystyczne

W uproszczeniu można założyć, że asortyment takich jednostek daje się przyporządkować do jednej z trzech grup:

- plastikowe małe o wysokości 92 mm i mocy wyjściowej 5‒150 W. Szerokość tych zasilaczy zmienia się razem z mocą wyjściową od 17,5 mm do ok. 120 mm. Głębokość to ok. 58 mm.

- plastikowe średnie o wysokości 92 mm, ale większej głębokości tj. 100 mm. Moc wyjściowa to 10‒100 W.

- duże metalowe o wysokości 125 mm, mocy wyjściowej od 75 do 500 W.

Plastikowe małe przeznaczone są do systemów automatyki domowej i budynkowej, systemów alarmowych, pozostałe kierowane są do rozwiązań automatyki przemysłowej.

Oczywiście wymiary i typ obudowy tworzą pierwszą oś selekcji produktu. W dalszej kolejności trzeba zdefiniować parametry elektryczne (moc, napięcie) oraz funkcje użytkowe, takie jak sygnalizacja stanu, regulacja, zabezpieczenia. Zasilacze różnią się typem i liczbą zacisków przyłączy, obsługiwanym zakresem napięć sieci, zakresem temperatur pracy, deratingiem parametrów w skrajnych warunkach specyfikacji, bezpieczeństwem oraz parametrami elektrycznymi.

Dwa zasilacze o identycznej specyfikacji elektrycznej mogą się różnić typem przyłączy, które w omawianych produktach pełni ważną funkcję. Zasilacze na szynę DIN są montowane w skrzynkach instalacyjnych, stąd szybkość oraz jakość montażu okablowania jest istotnym wyróżnikiem tych produktów.

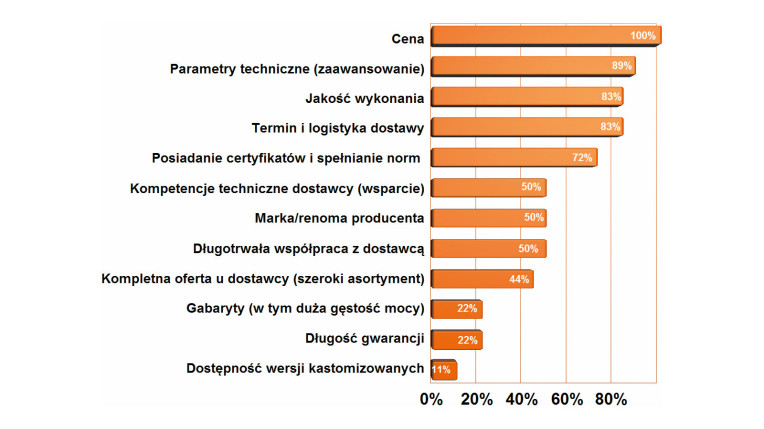

Najważniejsze cechy brane pod uwagę przy kupnie zasilaczy przez klientów

W zestawieniu najważniejszych kryteriów branych pod uwagę przez klientów przy selekcji zasilacza i dostawcy na szczycie uplasowała się cena ze wskazaniem 100%. Kolejne cztery kryteria z bardzo dużym udziałem w ankietach to parametry techniczne, jakość, termin dostawy oraz certyfikaty. Wykres stanowi doskonałe tło do tego, czym dzisiaj żyje rynek i jak podchodzi do wyboru produktu: wyłącznie utylitarnie "najlepszy zasilacz za najmniejszą cenę" i bez sentymentu do relacji ze sprzedawcą. Zestawienie pokazane na rysunku potwierdza też, że rynek zasilania ma już wyłącznie charakter katalogowy, bo zapotrzebowanie na zasilacze o indywidualnych właściwościach jest pomijalne.

Kolejnym ważnym aspektem jest sygnalizacja stanu. Omawiane jednostki działają w systemach automatyki, których działanie musi być nadzorowane. Zanik zasilania wywołany brakiem napięcia sieci lub przeciążeniem wyjścia bardzo często powinien wywołać alarm i interwencję służb utrzymania ruchu. Do tego zadania w zasilaczach instaluje się przekaźnik, którego styki są wyprowadzone na złącze wyjściowe i mogą zostać połączone z alarmem.

Standardem w jednostkach DIN jest możliwość regulacji napięcia wyjściowego w niewielkim zakresie, pozwalająca na kompensację spadku napięcia na okablowaniu. Im mniejsze napięcie wyjściowe zasilacza, tym taka regulacja jest bardziej potrzebna. W zasilaczach dużej mocy na szynę DIN pojawiają się możliwości poprawy niezawodności zasilania. Są na rynku dostępne jednostki pozwalające na podłączenie napięcia sieci z dwóch faz, na zasilanie napięciem międzyfazowym w bardzo szerokim zakresie lub na współpracę z siecią trójfazową. Zasilanie z dwóch faz jest ciekawą opcją poprawy niezawodności, gdyż przy zaniku jednej fazy dalej są w stanie dostarczać napięcie wyjściowe.

Automatycy docenią także możliwość chwilowego przeciążania ułatwiającą integrację zasilaczy z silnikami i napędami. Taka opcja pojawia się w zasilaczach większej mocy i jest to wyróżnik aplikacyjny. Wszystkie zasilacze konsumenckie i najprostsze jednostki na szynę DIN w obudowach plastikowych reagują na chwilowe przeciążenie sekundowym wyłączeniem napięcia wyjściowego. Przeciążenie aktywuje układ ochronny, który wyłącza zasilacz na moment, a potem uruchamia go ponownie z nadzieją, że przeciążenia już nie będzie.

Główne zjawiska techniczne w zasilaczach

Duża sprawność i miniaturyzacja są najważniejszymi trendami technologicznymi wyznaczającymi kierunek rozwoju branży zasilania. Duża sprawność determinuje w kolejności wiele ważnych parametrów użytkowych i technicznych zasilaczy: niższe opłaty za energię, mniejsze nagrzewanie itd. Małe wymiary to lepsza możliwość integracji jednostek, co zawsze jest w centrum zainteresowania klientów i pośrednio determinuje rozwój produktów. Duże znaczenie certyfikatów i świadectw potwierdzających spełnianie wymagań jest efektem tego, że na rynku jest wiele produktów o kiepskiej jakości, awaryjnych, niedostatecznie zabezpieczonych. Takie zasilacze konkurują cenowo z jednostkami jakościowymi, a potem stają się problemem. Stąd kupujący coraz częściej interesują się, czy zasilacz ma udokumentowaną jakość i specyfikację.

Ten tryb zabezpieczenia nazywa się terminem hiccup (czkawka), a po polsku "próbkowaniem". Zasilacze tolerujące chwilowe przeciążenie nie wyłączają się nawet na moment. Zamiast tego przechodzą w tryb stabilizacji prądu lub mocy i ich napięcie wyjściowe tylko trochę się zmniejsza. Utrzymują one ciągłość zasilania, co w automatyce bywa kluczowe.

Chwilowe przeciążanie o kilkanaście– kilkadziesiąt procent jest użyteczne przy sterowaniu maszynami wyposażonymi w silniki indukcyjne lub innymi odbiornikami, np. z dużą składową pojemnościową na wejściu. Pozwala to uniknąć przewymiarowana konstrukcji i kupowania zasilacza ze sporym zapasem mocy. Wiele aplikacji potrzebuje jej przez krótki czas, a przykładem mogą być zawory, rygle oraz siłowniki, i w takiej sytuacji niewielka jednostka zasilająca z możliwością przeciążania jest w rozrachunku znacznie tańsza. Gdy wymagane jest chwilowe silne przeciążanie zasilacza, w układzie najczęściej pojawiają się superkondensatory.

Taką funkcjonalność ma niewiele zasilaczy i można powiedzieć, że jest to cecha zaawansowanych jednostek średniej i dużej mocy na szynę DIN.

Sprawność zasilacza na szynę to najważniejszy parametr

Sprawność zasilaczy na szynę DIN jest bardzo istotnym parametrem tych jednostek z kilku powodów. Po pierwsze, im jest ona większa, tym zasilacz może dostarczać więcej mocy przy tych samych wymiarach (większa gęstość mocy), a wymiary zasilacza są w tym przypadku bardzo limitowane przez montaż. Duża sprawność jest też gwarancją niezawodności, bo warunki środowiskowe panujące w skrzynkach instalacyjnych nie są łagodne. Upakowanie komponentów, słaba wentylacja wywołują znaczący wzrost temperatury.

W klimatyzowanych halach produkcyjnych duża sprawność jest jeszcze bardziej istotna, gdyż wytwarzane ciepło wymaga usunięcia z obiektu za pomocą systemu klimatyzacji, co jest kosztowne.

Wysokosprawny zasilacz oznacza często też małą awaryjność, a więc pośrednio jakość. Takie jednostki mało się grzeją i ich podzespoły nie są tak obciążone cieplnie. Są mniejsze, a więc też mogą być tańsze w produkcji, bo nie potrzeba do nich dużych radiatorów. Mogą też działać w szerszym zakresie temperatur, nie wymagają chłodzenia wymuszonego. Także ograniczenia na moc wyjściową przy skrajnych temperaturach otoczenia stają się łagodniejsze (brak lub niewielki derating).

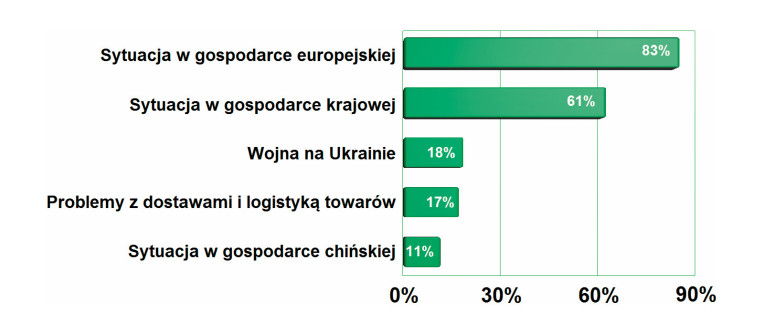

Główne problemy rynku zasilania

Głównym problemem rynku jest nienajlepsza sytuacja w gospodarce europejskiej i krajowej. Wpływ wojny na Ukrainie oraz niestabilna sytuacja w łańcuchach dostaw nie są w tym obszarze biznesu ważne. Rynek cierpi na brak popytu, wyhamowanie lub przesuwanie w czasie projektów i inwestycji oraz z powodu oszczędności. Warto dostrzec, że kiepska sytuacja w gospodarce europejskiej oceniona została oceniona jako czynnik sporo ważniejszy od rynku krajowego. Przez wiele lat sprzedaż usług i produktów na eksport, praca na rzecz kontrahentów z Europy Zachodniej były dla wielu polskich firm czynnikiem łagodzącym fluktuacje koniunktury w kraju, a dla wielu firm były osią działalności. Ten czynnik dzisiaj nie oddziałuje na rynek.

Zasilacze na szynę DIN nie są objęte wymaganiami Ekoprojektu i w praktyce sprawność minimalna nie jest wymuszana prawnie. Niemniej dla wielu jednostek tego typu i tak jest ona lepsza niż ustawowe minimum. Zasilacze o mocy ponad 100 W mają z reguły średnią sprawność 90%, a te o mocy ponad 250 W nawet 92%. Upowszechnienie się podzespołów mocy z azotku galu powinno jeszcze bardziej pozwolić na poprawę sprawności zasilaczy.

Derating – ważny termin

Derating to termin oznaczający konieczność zmniejszenia wartości znamionowych zasilacza w skrajnych warunkach działania. Chodzi o to, że znamionowe parametry, takie jak moc wyjściowa, w przypadku, gdy temperatura jest bardzo wysoka, napięcie sieci energetycznej jest niskie, są mniejsze. W przypadku zasilaczy na szynę DIN derating jest naturalną częścią specyfikacji i dotyczy bardzo wielu typów. Z reguły, im większa moc wyjściowa, tym derating jest silniejszy.

Ograniczenia deratingu podawane są w specyfikacji w różnej formie. Najczęściej są to wykresy, takie jak moc wyjściowa w funkcji temperatury otoczenia, ale zdarzają się też uwikłane wzory, np. –2% mocy znamionowej na każdy stopień temperatury otoczenia ponad 60°C.

Korekcja współczynnika mocy

Korektor współczynnika mocy jest dzisiaj częścią większości zasilaczy o mocy powyżej 100 watów, zasilaczy teleinformatycznych oraz wybranych jednostek napięciowych średniej i dużej mocy do zastosowań profesjonalnych. O konieczności korekcji kształtu prądu pobieranego z sieci decydują wymagania prawne, nakładające obowiązek minimalizacji poziomu zaburzeń (harmonicznych) wprowadzanych do sieci energetycznej oraz potrzeba minimalizacji mocy biernej, za którą się płaci dodatkowo w rachunku za prąd. Dla jednostek zasilaczy na szynę DIN korekcja PFC jest więc ważna, bo działają one w obiektach niekategoryzowanych jako prywatne, czyli tam, gdzie się za moc bierną płaci i często nie są to małe sumy.

Korekcja PFC w zasilaczach pomaga też opanować stabilność sieci energetycznej pod kątem progów i typów zabezpieczeń, co jest ważne w miejscach, w których pracuje wiele zasilaczy. Innymi słowy, jest to funkcjonalność cenna i stanowi wyróżnik produktów w zakresie zaawansowania. Minusem PFC jest większa komplikacja układowa zasilacza, co niestety przekłada się na wielkość takiej jednostki i cenę. Stąd na rynku są zasilacze z PFC lub bez. Do 100 watów mocy wyjściowej można założyć, że PFC raczej nie będzie, powyżej 150 watów można oczekiwać, że korekcja z dużym prawdopodobieństwem będzie.

Jakość zasilaczy – po czym ją poznać?

Jakościowo dobry zasilacz to taki, który się nie grzeje, jest zabezpieczony skutecznie przed przepięciami i ma dobrze działające filtry przeciwzakłóceniowe, dobre (markowe) kondensatory i trwałe złącza. Dobry zasilacz ma zabezpieczenia wyjścia przed odwrotną polaryzacją, blokadę możliwości niekontrolowanego wzrostu napięcia w czasie uszkodzenia, dodatkowe kondensatory blokujące wyjście, które obniżają poziom szumów i zakłóceń.

Zasilacze jakościowe wyposaża się dzisiaj we wszechstronne układy zabezpieczające, rozbudowane filtry wejściowe, sterowniki zapewniające sygnalizację stanu zasilacza i podobne obwody działające na tyle skutecznie, że awaria na skutek przeciążenia, stanu nieustalonego lub zwykłego błędu podczas montażu instalacji staje się praktycznie niemożliwa.

Dobry zasilacz ma też zabezpieczenie termiczne, które chroni jego działanie przed uszkodzeniem bądź przez czasowe wyłączenie lub przez derating, czyli obniżenie prądu wyjściowego do bezpiecznego poziomu.

Użyteczne są zwielokrotnione zaciski wyjściowe lub też możliwość podłączenia dwóch dodatkowych przewodów pomiarowych bezpośrednio do zacisków obciążenia w zasilaczach niskonapięciowych wysokoprądowych (tzw. czteroprzewodowe połączenie kelwinowskie).

Najbardziej zaawansowane jednostki, wyposażone w interfejsy cyfrowe, pozwalają nie tylko na wszechstronne monitorowanie aktualnego stanu czy sterowanie włączaniem/wyłączaniem, ale również ustawienie i odczyt wielu parametrów pracy, takich jak napięcie, prąd wyjściowy czy progi zadziałania zabezpieczeń. Niemniej 99% asortymentu rynkowego takich możliwości nie ma.

Więcej funkcjonalności przy większej gęstości mocy

Zasilacze impulsowe montowane na szynie DIN dostarczają energii dla wrażliwych układów i systemów, pomiarowych i przemysłowych, w tym do rozproszonych instalacji zasilanych z różnych sieci. W takich obszarach ważna jest wzmocniona izolacja, gwarantująca mały prąd upływu i niski potencjał resztkowy na masie. Zasilacz o wzmocnionej izolacji jest w stanie zapewnić stabilność i jakość działania układów pomiarowych i wiele jednostek ma dzisiaj izolację dwukrotnie bardziej odporną w stosunki do wymagań norm, a prąd upływu mniejszy od maksymalnego dopuszczalnego nawet 2…3-krotnie.

Szeroki zakres napięcia wejściowego to kolejny parametr, który wiele mówi o jakości zasilacza. Standard większości jednostek to 100‒240 V AC, te lepsze działają w zakresie 85‒265 V AC , a najlepsze w jeszcze szerszych widełkach napięcia, po to, aby można było zasilać je napięciem międzyfazowym, nawet do 500 V AC. Nawet jeśli nie korzystamy z sieci innej niż 230 V AC, to gdy zakres dopuszczalnych napięć jest szeroki, korzystnie przekłada się to na odporność zasilacza na krótkotrwałe zaniki napięcia i przepięcia.

Zasilacze na szynę DIN do zasilania gwarantowanego

Pojęcie "zasilanie gwarantowane" odnosi się w uproszczeniu do systemów, w których zanik głównego napięcia sieci energetycznej nie prowadzi do wyłączenia systemu. Zwykle takie zasilanie jest realizowane za pomocą zasilacza UPS, który jest specjalizowaną przetwornicą z akumulatorem zdolną do podtrzymania napięcia sieci. Drugi popularne rozwiązanie to zasilacz napięcia stałego, który ma na wyjściu dodany akumulator podtrzymujący stałe napięcie wyjściowe. Jest to zasilacz buforowy, który typowo dostarcza 12 V napięcia stałego i współpracuje z kwasowo-ołowiowym akumulatorem żelowym. Takie zasilacze występują też w wersji do montażu na szynie DIN. Pozwalają one w razie potrzeby dołączyć akumulator i stworzyć podtrzymanie napięcia wyjściowego. Takie specjalistyczne zasilanie gwarantowane zyskuje na popularności, bo z jednej strony rośnie liczba urządzeń wymagających podtrzymania zasilania (np. elementy infrastruktury teleinformatycznej takie jak switche lub modemy), a z drugiej strony moc pobierana przez takie urządzenia jest coraz mniejsza. Nierzadko też wymagany czas podtrzymania zasilania nie musi być długi.

Zasilacze współpracujące z akumulatorem mają rozbudowane funkcje kontrolne i sygnalizacyjne. Są to wskaźniki naładowania i rozładowania, obecności napięcia sieci, wyjścia przekaźnikowe do załączania alarmów oraz podobne.

Co do zasady akumulator jest w takim układzie elementem osobnym, dołączanym do zasilacza buforowego za pomocą kabla. To jedyne sensowne rozwiązanie przy małej ilości miejsca w obudowie na szynę i przy dość wysokiej temperaturze panującej w skrzynce instalacyjnej.

W temacie zasilania gwarantowanego na szynie DIN warto jeszcze wspomnieć o modułach redundantnych. Są to sumatory energii na diodach idealnych wykonanych na MOSFET- ach. Do sumatora można podłączyć dwa lub więcej zasilaczy. Gdy jeden przestanie działać, energię zapewni alternatywne źródło. Takie rozwiązanie może być użyteczne w instalacjach przemysłowych, gdzie mamy kilka sieci energetycznych, a więc trzy fazy. Zanik jednej linii nie musi wówczas wyłączyć krytycznej infrastruktury. Jedyny problem z takimi modułami sumującymi polega na tym, że trzeba mieć koncept na ich wykorzystanie, aby była z tego wymierna korzyść dla instalacji. Wcale nie jest to takie proste, jak się pozornie wydaje.