Dystrybucja podzespołów elektronicznych

Na rynku dystrybucji cały czas panują trudne warunki, będące splotem wielu czynników jak niestabilna sytuacja w zakresie czasów dostaw, wojna na Ukrainie oraz nienajlepsza sytuacja w gospodarce. Efektem jest widoczna niepewność, ograniczanie ryzyka działalności przez klientów, kupowanie małych partii pod bieżące zamówienia, przesuwanie projektów w czasie i wydłużanie terminu odbioru zakontraktowanego towaru. Taka jest dzisiaj branża dystrybucji. Do plusów zaliczyć można zwiększającą się innowacyjność krajowych przedsiębiorstw i rosnącą świadomość klientów co do technologii i oferty produktowej oraz dostępnych usług.

Ceny wzrosły i to znacząco

Pandemia i późniejszy okres niedoborów wywołał w konsekwencji wzrost cen elementów elektronicznych i to znaczący, w którym podwyżka ceny o 100% w ciągu dwóch lat wcale nie jest niczym rzadkim. Producenci komponentów podnieśli ceny, bo przez długi czas tego nie robili z uwagi na silną konkurencję. Ceny komponentów przez długi okres były też relatywnie niewielkie, co nie pozwalało na wiele inwestycji i szybki rozwój technologii. Alokacja stała się okazją do wyrwania się z dyktatu niskiej ceny, dlatego okres niedoborów okazał się okazją do poprawy rentowności, ale razem z większymi kosztami działalności, podwyżki są duże. Trudno też nie mieć wrażenia, że wszystkie firmy znajdujące się w łańcuchu dostaw zwiększyły swoje marże, bo mogły to zrobić i wykorzystały chwilę. W efekcie ceny zwiększyły się więcej niż wynikałoby to ze wskaźników makroekonomicznych.

Najważniejsze czynniki o charakterze negatywnym dla rynku dystrybucji

Listę najbardziej istotnych czynników negatywnie oddziałujących na rynek dystrybucji otwiera konkurencja ze strony źródeł azjatyckich. W ostatnich trzech latach znaczenie tamtejszych sprzedawców i azjatyckich platform internetowych wyraźnie wzrosło, wraz z rosnącymi cenami na rynku europejskim, kłopotami z dostępnością komponentów oraz coraz lepszymi mechanizmami logistyki towarów z Azji. Długie terminy dostaw cały czas są wymieniane jako problem i faktem jest, że te kłopoty trwają bardzo długo w porównaniu do poprzednich lat. Przeszkadza też kiepska sytuacja w gospodarce krajowej oraz zaostrzająca się konkurencja.

Źródła dalekowschodnie

Skutkiem znaczącego wzrostu cen komponentów elektronicznych w ostatnim okresie jest wzrost znaczenia źródeł dalekowschodnich. Wielu specjalistów postrzega to wręcz na naszym rynku jako inwazję, gdyż część tamtejszych firm dystrybucyjnych ma już przyczółki w postaci biur handlowych i mocno penetruje nasz rynek. Warto przez chwilę zastanowić się skąd to wynika.

Po pierwsze, wiele podzespołów trudno jest obecnie kupić u krajowych dystrybutorów. Za grupę problemów odpowiadają długie czasy dostaw i niedobory z ostatnich dwóch lat. One jeszcze nie przeminęły całkowicie i cały czas oddziałują negatywnie na rynek, zmuszając klientów do szukania alternatywnych źródeł zaopatrzenia.

Na skutek problemów w niedostępnością wiele pozycji produktowych zostało wycofane z ofert dystrybutorów lub nawet przestało być produkowanych. Dotyczy to bardzo wielu elementów mniej chodliwych lub starszej generacji.

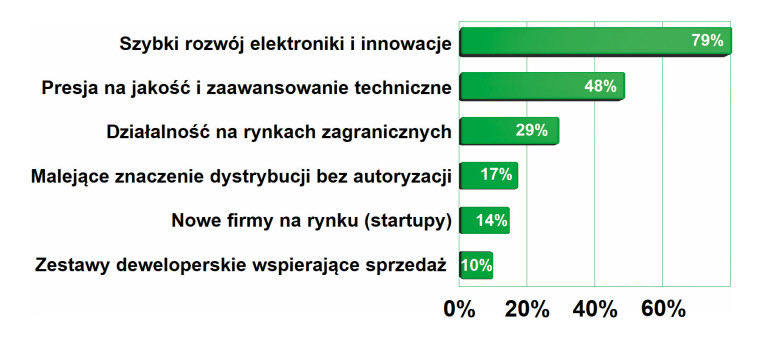

Najważniejsze zjawiska pozytywne dla rynku

Bez względu na obecne trudności w gospodarce, które dla branży elektroniki są oczywiście przejściowe, rynek dystrybucji ma przed sobą cały czas dobre perspektywy rozwojowe wynikające z szybkiego rozwoju elektroniki, dużego znaczenia innowacji oraz szybkiej ewolucji technicznej rynku w stronę coraz większej jakości i zaawansowania. Szansę rozwoju dają też rynki zagraniczne, bo pozwalają ominąć wiele ograniczeń charakterystycznych dla lokalnych uwarunkowań, takich jak duża konkurencja lub mała chłonność niszowych sektorów. Start-upy, w których nie tak dawno pokładano tak wielkie nadzieje i oczekiwania, nie wydają się tworzyć dla omawianego sektora rynku znaczącej wartości.

Dystrybutorzy ustalają wysokie ceny na wiele pozycji ofertowych mniej popularnych, rekompensując sobie koszty ich magazynowania, niemniej często wzrost ten jest niewspółmiernie duży w odniesieniu do funkcjonalności tych komponentów. Skutkiem jest to, że taki postawiony pod ścianą klient kupi potrzebną część w Chinach, bo stworzona u nas bariera cenowa okaże się nie do przejścia.

Podobnie jest z elementami mniej popularnymi, starszymi i niedawno wycofanymi z produkcji. One cały czas są w użyciu i są potrzebne. W kraju ich nie ma lub mają zaporowe ceny, które nie mają nic wspólnego z rozsądkiem. Takie sytuacje też powodują, że klienci kierują swoją uwagę na Daleki Wschód, bo jakoś tak się dzieje, że tamte elementy nie tylko są dostępne, ale często są tańsze. Najbardziej jest to widoczne na komponentach mniej typowych i starszych.

Kolejnym powodem rosnącej popularności dalekowschodnich źródeł zaopatrzenia jest coraz lepsza (szybsza i tańsza) logistyka towarów, większa kontrola rzetelności działających tam sprzedawców, możliwość zwrotu ograniczająca ryzyko transakcji. W wielu przypadkach usługi logistyczne platform chińskich są podobne jak mamy u nas, a różnica dotyczy wyłącznie czasu dostawy.

========

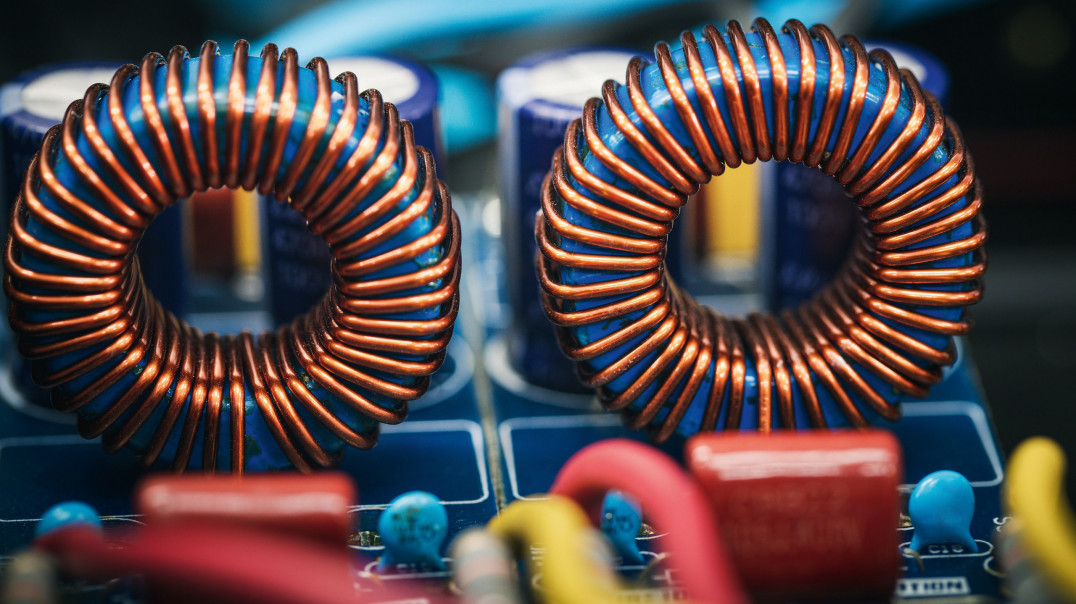

Komponenty indukcyjne

Podzespoły indukcyjne determinują osiągi urządzeń z zakresu konwersji mocy, a więc dążenie do minimalizacji strat energii, ułatwiają miniaturyzację urządzeń, a także zapewniają zgodność z wymaganiami norm w zakresie EMC. Stąd rozwój elektromobilności, systemów energii odnawialnej, elektroniki użytkowej sprzyja znacząco temu segmentowi rynku. Zapotrzebowanie na komponenty o wysokiej jakości i stabilności płynie ponadto z aplikacji IT, telekomunikacji, energoelektroniki i oczywiście sektorów specjalnych: wojska, lotnictwa.

Najważniejsze czynniki negatywne

Listę najważniejszych czynników negatywnych dla rozwoju rynku otwierają tanie produkty dalekowschodnie, czyli głównie standardowe dławiki i cewki do układów mocy i filtrów, których niska cena ogranicza możliwość rozwoju rozwiązań zaawansowanych. Tanie wersje standardowe są kłopotem dla firm dystrybucyjnych, natomiast producenci komponentów indukcyjnych zmagają się z rosnącymi kosztami pracy, cenami materiałów oraz zapewne koniecznością stałego inwestowania w maszyny do produkcji. Dla wszystkich problemem jest silna konkurencja, bo omawiany sektor rynku przyciąga coraz to nowych graczy. Długie czasy dostaw nadal są wskazywane jako czynnik negatywnie oddziałujący na rynek, a asortyment omawianych produktów jest na tyle ogromny, że wyklucza możliwość m

Wymagania jakościowe stale się zwiększają

Wymagania w elementach indukcyjnych są bardzo istotne z kilku powodów. Po pierwsze, narażenia mechaniczne, a więc wibracje i udary, wywołują naprężenia w uzwojeniach i rdzeniu, i prowadzą do pękania, rozklejania rdzeni oraz rozszczelnienia zalew i uszkodzeń izolacji. Elementy te mają nierzadko dużą masę, przez co przeciążenia mechaniczne wynikające z drgań są problemem dla jakości w aspekcie długoterminowym. Podobnie negatywnie na konstrukcję oddziałują zmiany temperatury i wilgotności, które dodatkowo są w stanie pogorszyć z czasem jakość izolacji. Zjawisk fizycznych, które w perspektywie są w stanie negatywnie wpłynąć na jakość, jest wiele, na przykład obciążenie dużą mocą uzwojeń, bo płynące duże prądy powodują nagrzewanie, wysokie napięcia niszczą izolację na skutek mikrowyładowań oraz wyładowań niezupełnych (koronowych), a wysokie wartości indukcji magnetycznej na skutek efektu magnetostrykcji mogą wywołać piski. Takie problemy są codziennością dla producentów podzespołów indukcyjnych, ale szczęśliwie coraz większa świadomość projektantów elektroniki pomaga w rozwoju rynku w kierunku tak rozumianej długoterminowej jakości.

Oczywiście im większa moc, większe upakowanie elementów, im ciaśniejszy montaż oraz dłuższy projektowany czas eksploatacji, tym zagadnienia jakościowe są bardziej istotne. Niestety nie da się wielu aspektów skontrolować podczas kupowania, bo danych na temat żywotności długoterminowej nie ma w dokumentacji lub są to zagadnienia niezweryfikowane. Efekty starzeniowe dotyczą wszystkich materiałów, niemniej niejednakowo i w różnym nasileniu, stąd estymacja matematyczna jest bardzo kłopotliwa. Zamiast niej stosuje się testy starzeniowe, a więc eksploatuje sprzęt przez pewien czas w warunkach stresu (wysoka temperatura, maksymalna moc, wilgotność, promieniowanie), a potem przelicza godziny pracy w stresie lub czas do pierwszej awarii na "zwykłe" warunki pracy.

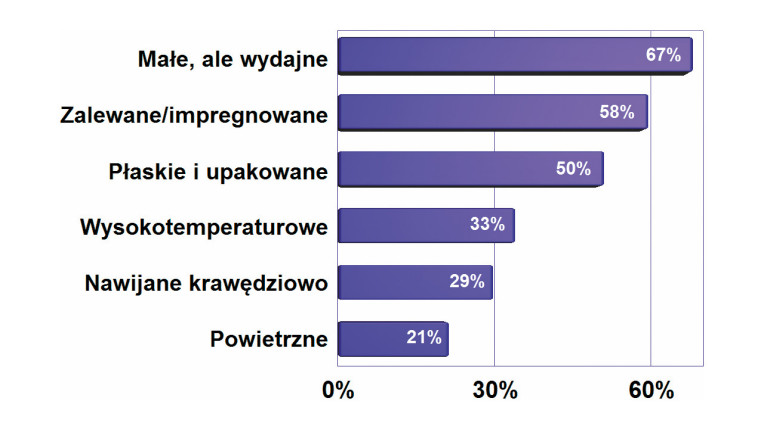

Trendy techniczne w podzespołach indukcyjnych

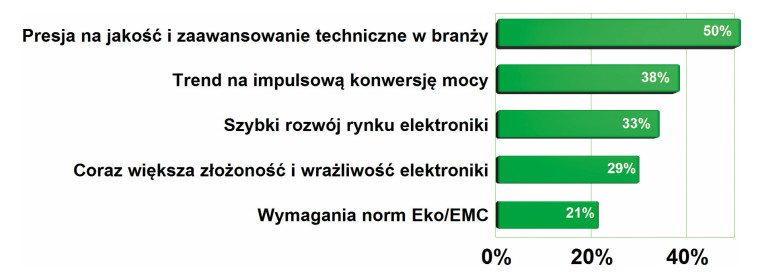

Główne trendy techniczne w elementach indukcyjnych to miniaturyzacja i wynikające z niej coraz większe zaawansowanie techniczne. Widać to najbardziej w dławikach mocy w obudowach SMD, w których nie ma karkasu ani też widocznego podziału na rdzeń i uzwojenie. Taki element jest zaprasowaną jednolitą konstrukcją o dobrym ekranowaniu, rozpraszaniu ciepła przy najmniejszych możliwych gabarytach. Podobnie nowoczesne materiały magnetyczne także sprzyjają miniaturyzacji, gdyż umożliwiają osiągnięcie większych gęstości mocy oraz działają przy wyższych częstotliwościach. Z kolei dostępność wielu gotowych rozwiązań katalogowych upraszcza konstrukcję wielu aplikacji i zmniejsza ryzyko projektowe przez dostępność scharakteryzowanych i przetestowanych elementów. Komponenty dostępne "z półki" są tańsze i można je kupić bez konieczności długiego czekania na realizację zamówienia. Dają też lepsze możliwości wyboru i zmiany dostawcy.

Takie podejście pozwala ocenić kompleksowo jakość projektu elektroniki, wskazać najsłabsze punkty konstrukcyjne, w tym także dokonać oceny jakości materiałów i komponentów. Niemniej jest to spory wysiłek, któremu może podołać producent podzespołów lub urządzenia. Badania starzeniowe urządzeń stają się w elektronice coraz bardziej powszechne i popularne, a wiele firm inwestuje w komory klimatyczne, potwierdzając zainteresowanie jakością.

Warto zauważyć, że jeśli mówimy o wpływie temperatury na działanie urządzenia, to zwykle mamy na myśli jej wysoką wartość. Pełne badania klimatyczne i ocena jakości komponentów i urządzeń wymaga jednak obserwacji działania także przy temperaturach ujemnych. Już –20ºC dla wielu kiepskich materiałów chemicznych i tworzyw jest problemem, bo wywołuje utratę plastyczności i sztywność połączeń, pękanie izolacji. W dalszej kolejności badania jakości obejmują narażenia na UV, kurz, aerozole, narażenia mechaniczne itd. Jak widzimy, kompleksowa ocena jakości to wielki wysiłek badawczy.

Elementy na zamówienie

Im bardziej wymagająca aplikacja, większa moc, poziomy napięć i prądów, tym większe znaczenie dla zapewnienia dużej funkcjonalności mają elementy indukcyjne produkowane według indywidualnej specyfikacji. Zapewniają one najlepsze parametry użytkowe poprzez dopasowanie do warunków montażu w obudowie i do wymagań elektrycznych. Elementy na zamówienie są także najmniejszym kompromisem projektowym. Głównie chodzi o transformatory impulsowe, w mniejszym stopniu, ale dalej w istotnej części o dławiki mocy. Dla większości krajowych firm produkcyjnych jest to oś aktywności biznesowej.

Standardowe elementy indukcyjne są produkowane w dużej części automatycznie, za pomocą specjalistycznych urządzeń, drogich i złożonych, ale bardzo wydajnych. Na skutek dużej konkurencji marże przy sprzedaży elementów typowych są niskie, co wymusza działanie na dużych seriach i sprzedaż w skali globalnej. Z kolei produkcja na zamówienie opiera się na małych i średnich seriach, na wyrobach niestandardowych, a więc wymaga parku maszynowego o mniejszym stopniu automatyzacji. Od strony inwestycyjnej jest to rozwiązanie tańsze, czyli znajduje się w zasięgu inwestycyjnym także mniejszych firm, bo jak wiadomo, ceny wszystkich urządzeń produkcyjnych są bardzo wysokie. W przypadku tych całkowicie automatycznych ceny liczone są w milionach i to nie złotych.

Zjawiska pozytywne dla rozwoju rynku

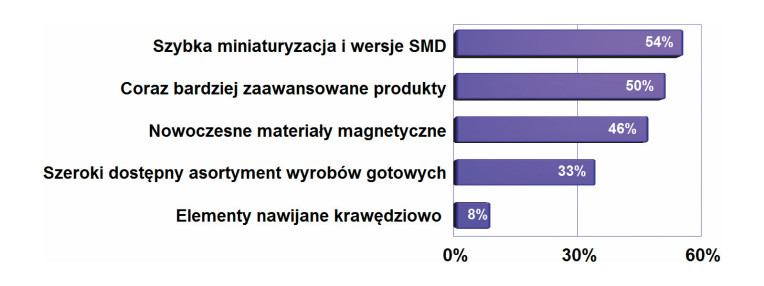

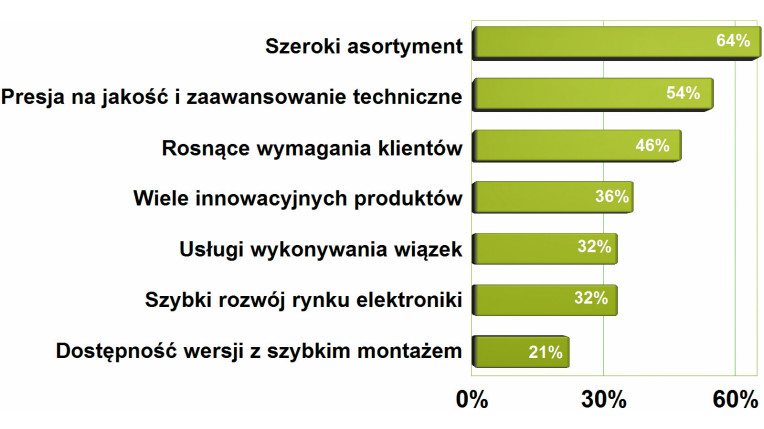

Za najważniejszy czynnik prorozwojowy dla rynku elementów indukcyjnych uznano presję na jakość i zaawansowanie techniczne w branży, co sprzyja popytowi na elementy kastomizowane i projektowane pod aplikację, wykorzystujące nowoczesne materiały magnetyczne i techniki nawijania. Takie wersje stanowią awangardę produktową rynku, są cenniejsze od typowych produktów katalogowych. Znajdująca się na drugim miejscu impulsowa konwersja energii elektrycznej jest standardem i podwaliną wielu nowoczesnych aplikacji, a rozwój tego obszaru techniki jest wprost pochodną dostępności zaawansowanych indukcyjności, stąd jej wysoka pozycja jest naturalna w takim zestawieniu. W dalszej kolejności na wykresie uplasował się szybki rozwój rynku elektroniki i związana z nim większa komplikacja, gęstość upakowania, parametry (wydajność) podzespołów indukcyjnych.

Przez lata taki pomysł na biznes dobrze się sprawdzał i zapewniał szybki rozwój, zwłaszcza że producenci krajowi równoważyli mniejszy potencjał produkcyjny większymi kompetencjami inżynierskimi. Dopiero w ostatnich dwóch latach na skutek rosnących kosztów pracy, ograniczonej dostępności kadry i dużej konkurencji na rynku ta koncepcja działalności daje nieco gorsze wyniki. Nie bez znaczenia jest to, że asortyment wersji katalogowych bardzo się rozrósł i w większej liczbie przypadków daje się użyć czegoś z półki.

W naszym kraju nawijanie transformatorów i dławików na zamówienie dostępne jest również w przypadku zamawiania małych ilości, również pojedynczych sztuk przeznaczonych do układów prototypowych, co też jest jakimś elementem przewagi, bo wiele urządzeń kierowanych na rynek przemysłowy jest z definicji małoseryjna.

Wsparcie techniczne jest bardzo istotne

W przypadku systemów konwersji energii elektrycznej bardzo istotne jest kompetentne wsparcie techniczne, faktycznie pełniące funkcję konsultacji i weryfikacji inżynierskich pomysłów. Nie da się ukryć, że osiągnięcie wysokich parametrów w przypadku systemu zasilania, przy niskim koszcie, łatwości produkcji od strony technologicznej, a także w takim aspekcie, aby projekt bazował na dostępnych bez kłopotu materiałach, nie jest łatwe. O pomyłkę, przeszacowanie lub niedopatrzenie projektowe jest bardzo łatwo, bo niezawodne przełączanie dużych mocy wymaga uwzględnienia wielu zjawisk, w tym zapanowania nad stanami nieustalonymi wynikającymi z niesymetrii, reaktancji pasożytniczych oraz pracy na krawędzi możliwości materiałów magnetycznych.

Wsparcie techniczne zawsze było i jest czynnikiem wspierającym sprzedaż w każdym sektorze, niemniej w tym obszarze jego znaczenie jest szczególne, bo tematy związane z impulsowymi systemami zasilania, materiałami magnetycznymi i zjawiskami zachodzącymi w elementach indukcyjnych są bezsprzecznie trudne.

Ważne i poszukiwane wersje

W zakresie elementów indukcyjnych za najbardziej poszukiwane wersje wykonania uznano elementy "małe, ale wydajne", a więc przeznaczone do montażu powierzchniowego, bazujące na nowoczesnych materiałach magnetycznych, które mają dużą indukcję nasycenia i mogą pracować z dużymi prądami roboczymi. Takiego typu dławiki i transformatory przeznaczone są do elektroniki dużej mocy, konwerterów, ładowarek, napędów i podobnych urządzeń, gdzie liczy się duża gęstość mocy. Na drugiej pozycji uplasowały się wersje zalewane i impregnowane, a więc odporne na czynniki środowiskowe, czyli zapewniające poszukiwaną na rynku trwałość. Zalewanie i impregnowanie poprawiają ponadto odprowadzanie ciepła i znakomicie ograniczają emisję akustyczną wywołaną efektem magnetostrykcyjnym oraz drganiem uzwojenia, co jest bardzo istotne w układach oświetleniowych. Trzeci czynnik, płaskie i upakowane, to podzbiór kryterium pierwszego, jeszcze bardziej uwypuklający znaczenie miniaturyzacji.

Miniaturyzacja

Współczesne urządzenia elektroniczne są z generacji na generację coraz mniejsze, a znaczenie elektroniki mobilnej na rynku stale się pogłębia. Trend miniaturyzacji dotyczy też systemów zasilania, elektromobilności i przemysłowych urządzeń energoelektronicznych, których gęstość mocy sukcesywnie rośnie. Nowoczesne elementy indukcyjne są bardzo istotnym elementem takich zmian, gdyż osiągnięcie wysokiej sprawności jest możliwe m.in. dzięki dostępności miniaturowych dławików i transformatorów bazujących na niskostratnych materiałach magnetycznych o zwartej konstrukcji mechanicznej, zapewniającej małe reaktancje pasożytnicze, emisję zaburzeń i takich, które mają gabaryty pozwalające na łatwą integrację w urządzeniu.

Poza układami konwersji energii cała reszta elementów indukcyjnych też jest coraz mniejsza. Dotyczy to filtrów, cewek w.cz., dławików lub transformatorów sygnałowych, które nie mogą górować gabarytami nad resztą elektroniki. Dążenie do miniaturyzacji widać w tym, jak wiele mamy dzisiaj na rynku kształtek ferrytowych o płaskiej i zwartej konstrukcji oraz karkasów z końcówkami do montażu SMT.

Miniaturyzacja zaciera też typowy podział konstrukcyjny na rdzeń, karkas i uzwojenie. Karkas i wyprowadzenia integruje się z rdzeniem, a uzwojenie umieszcza w środku zamkniętej konstrukcji magnetycznej po to, aby poprawić stopień ekranowania oraz odporność środowiskową. Tym samym wiele nowoczesnych podzespołów indukcyjnych wizualnie wygląda tak, jakby składały się wyłącznie z rdzenia. Jest to ważne z punktu zapewnienia kompatybilności elektromagnetycznej, gdyż niewielkie, ale wydajne aplikacje dużej mocy działają przy dużych częstotliwościach. Pozwala to użyć mniejszych elementów indukcyjnych, ale jednocześnie wymusza zapewnienie lepszej ochrony przed emisją zaburzeń.

Kompatybilność elektromagnetyczna

Poza miniaturyzacją na rynek pozytywnie oddziałują zagadnienia związane z kompatybilnością elektromagnetyczną. W układach impulsowych panowanie nad emisją jest ważną i niełatwą częścią pracy inżynierskiej, dlatego każde rozwiązanie układowe lub komponent, które wyraźnie w tym pomaga, jest w tych działaniach cenną pomocą. Widać to między innymi po tym, że konstrukcja elementów indukcyjnych staje się zwarta i zabudowana materiałem magnetycznym, a uzwojenia są ukrywane we wnętrzu, bo ogranicza to zaburzenia. Konstrukcje otwarte, takie jak dławiki szpulkowe, są wypierane przez rozwiązania na rdzeniach toroidalnych, można też powiedzieć, że mamy renesans rdzeni o kształtach podobnych do kubkowych – patrz też ramka.

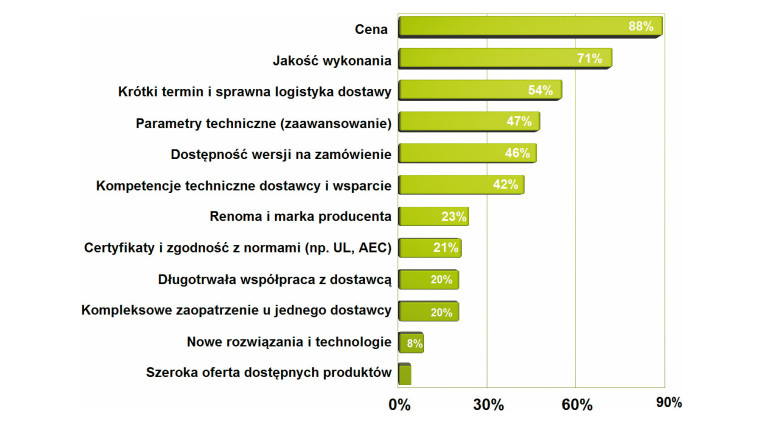

Cechy ofert brane pod uwagę przy kupowaniu elementów indukcyjnych

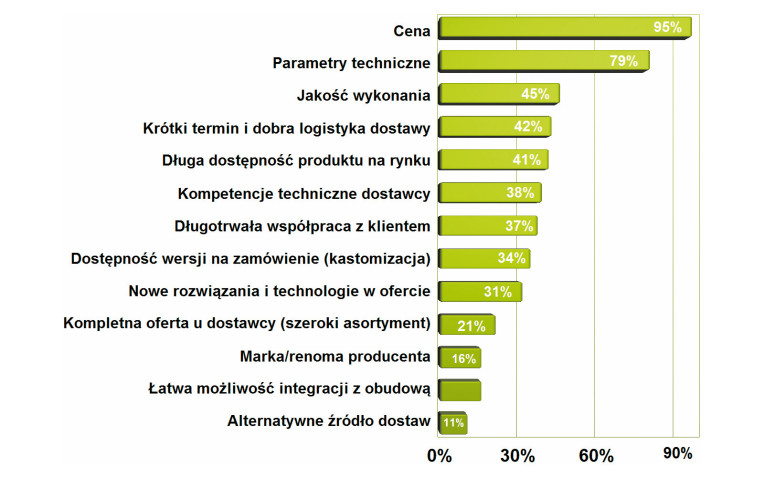

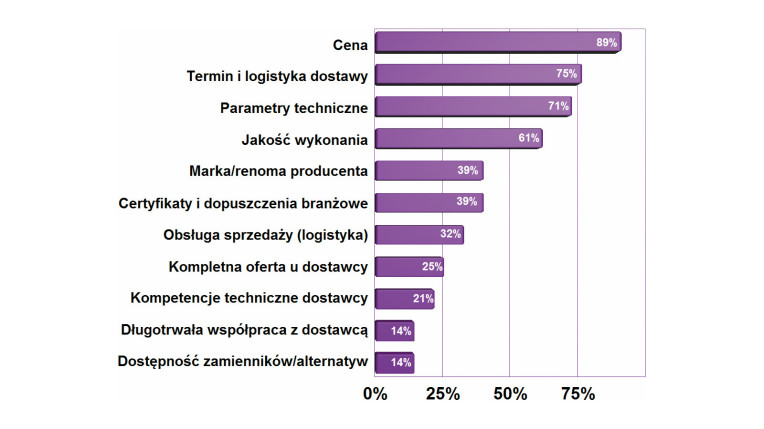

Zestawienie najważniejszych czynników ofert branych pod uwagę przez klientów poszukujących elementów indukcyjnych otwiera oczywiście cena, co jest standardem we wszystkich takich rankingach dotyczących podzespołów elektronicznych. Drugą pozycję na wykresie zajęła jakość wykonania, a trzecią termin dostawy komponentów. Kolejne pola o wskazaniu już poniżej 50% uwypuklają znaczenie wersji na zamówienie, co jest cechą szczególną rynku elementów indukcyjnych i podstawą biznesu dla producentów krajowych, znaczenie długotrwałej współpracy z dostawcą, jego kompetencje techniczne i zapewniane wsparcie techniczne. Za praktycznie nieistotne uznano kryteria takie jak długoletnia współpraca z dostawcą lub możliwość kompleksowego zaopatrzenia w jednym miejscu, co przekonuje, że nie ma dzisiaj miejsca na sentymenty. Może to być też sygnał, że dostawcy wykorzystują stałe relacje i warunki handlowe w ten sposób, że dla nowych klientów są często lepsze.

Wysoka sprawność

Postęp w miniaturyzacji urządzeń elektronicznych, w tym także systemów zasilających (zasilaczy, ładowarek, przetwornic, falowników, napędów silników), powoduje, że rośnie zainteresowanie technologiami i rozwiązaniami zapewniającymi wysoką sprawność konwersji energii elektrycznej. Im jest ona lepsza, tym mniej wydziela się ciepła i całość może być mniejsza i bardziej upakowana. Ponadto przy dużej sprawności łatwiej jest zapewnić działanie w szerokim zakresie temperatur, bez wymuszonej konwekcji itd. Duża sprawność jest też kluczem do długiego czasu działania urządzeń zasilanych z baterii oraz na drugim biegunie do ograniczenia kosztów eksploatacji systemów dużej mocy.

Sprawność to także klucz do efektywnej miniaturyzacji, gdyż im mniej wydziela się ciepła w elementach, tym ciaśniej można je umieszczać. Kluczem do uzyskania małych strat są nowoczesne półprzewodniki oraz elementy indukcyjne wykonane na małostratnych materiałach magnetycznych pracujących na wysokich częstotliwościach.

Co z transformatorami sieciowymi?

Transformatory sieciowe były i będą potrzebne we współczesnej technice, bez względu na moc wyjściową, ale bez żadnych wątpliwości ich znaczenie maleje. Ze sprzętu konsumenckiego zniknęły całkowicie, bo nie są w stanie spełnić wymagań w zakresie minimalnej sprawności i mocy standby wymaganej przez regulację prawną dotyczącą Ekoproduktu. Obecnie zapotrzebowanie rynku pochodzi z aplikacji wymagających wysokiej jakości i niezawodności oraz długoterminowej dostępności źródeł zasilania, czego przykładem mogą być systemy alarmowe, zasilacze buforowe do akumulatorów, systemy kontroli dostępu do obiektów. W takich aplikacjach transformatory zapewniają dużą odporność na zaburzenia pojawiające się w sieci zasilającej (zwłaszcza na przepięcia podczas burz) i potrafią pracować bezawaryjnie przez długie lata. Druga grupa urządzeń, która w dużej części bazuje na tradycyjnych zasilaczach z transformatorami, to wszelkiego rodzaju precyzyjna aparatura pomiarowa lub sprzęt medyczny, gdzie elementy te wybiera się z uwagi na to, że nie generują zaburzeń elektromagnetycznych i pozwalają na znaczące ograniczenie prądu upływu i potencjału dotykowego. Elementy te sprawdzają się też tam, gdzie trzeba zapewnić dobrej jakości separację galwaniczną obwodów od sieci lub zapewnić kilka separowanych od siebie obwodów zasilających. Są też używane w urządzeniach audio.

Oczywiście nie są one aplikowane we wszystkich wymienionych obszarach, tylko raczej tam jeszcze mają szansę na użycie, bo formalnie jest to już produkt niszowy.

======

Przełączniki, przyciski i klawiatury

Przełączniki, przyciski i klawiatury są ważnymi elementami interfejsu użytkownika w urządzeniach elektronicznych. Mimo coraz większego potencjału technologii dotykowych oraz poprawiającej się dostępności elementów haptycznych z przełączników w elektronice nie rezygnuje się bez powodu, zwłaszcza w aplikacjach profesjonalnych, gdyż z każdą kolejną generacją poprawia się ich trwałość oraz odporność środowiskowa. Lepsze jest wzornictwo, rośnie liczba dostępnych wersji, gama kolorów, podświetleń, opcji montażowych oraz akcesoriów.

Aktualnie pozytywne zjawiska związane z rynkiem elementów elektromechanicznych to stabilny popyt ze strony różnych branż oraz długi czas życia aplikacji, do których trafiają te elementy. Zmniejsza to ryzyko działalności u dostawców, pozwala mieć większe stany magazynowe w kontekście liczby przechowywanych indeksów wyrobów. Kolejne pozytywne aspekty to wzrost rynku przemysłowego w Polsce, który charakteryzuje się małą wrażliwością na czynniki makroekonomiczne. Pozytywną wiadomością dla rynku jest ponadto to, że wiele problemów z dostępnością i czasem dostaw komponentów i materiałów już nie ma, a rynek cieszy się postępującą stabilizacją.

Po stronie czynników negatywnych należy wymienić przede wszystkim dużą konkurencję cenową ze strony producentów chińskich oraz rosnące koszty produkcji/działalności. Kłopotem jest też przymus certyfikacji dla wielu grup sprzętu elektronicznego, który przedłuża czas realizacji projektów i zmusza do gromadzenia wielu dokumentów.

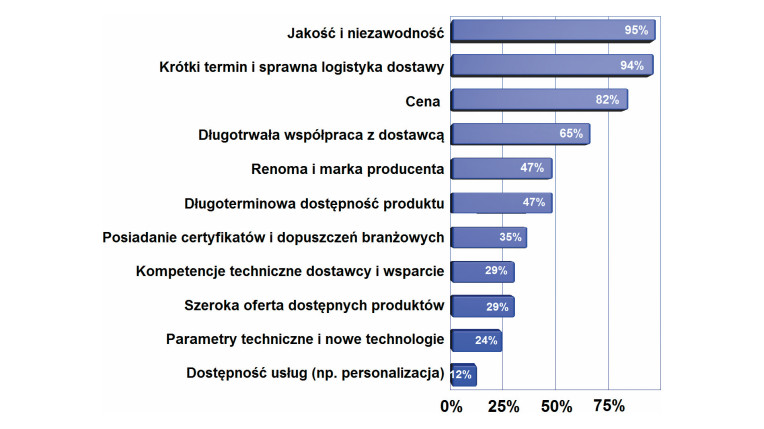

Najważniejsze dla klientów cechy ofert

Po latach nieustannej dominacji na szczycie wykresu trójki kryteriów "cena, jakość i krótki termin dostawy" nastąpiło małe przetasowanie i cena spadła na pozycję trzecią z wyraźnie mniejszym udziałem procentowym do dwóch pozostałych. Znaczenie długotrwałej współpracy z dostawcą, czyli innymi słowy, dobre relacje klientów z dostawcami, też zostały wysoko ocenione, tj. ze wskazaniem powyżej 50%. Zwykle to kryterium nie jest pozycjonowane tak wysoko. Biznes jest co do zasady wolny od sentymentów i zamówienie dostaje ten, kto w danym momencie zaproponuje lepsze warunki. Jak widać, w przełącznikach i klawiaturach jest inaczej. Niższe znaczenie ceny a wyższe jakości może być też pokłosiem problemów z chińską tandetą, którą zalewają nasz rynek tamtejsze platformy internetowe.

Źródła azjatyckie

Przełączniki to dla wielu aplikacji z obszaru automatyki i przemysłu wersje standardowe, popularne i o podobnej konstrukcji oraz funkcjonalności. Identycznie sytuacja wygląda w przypadku elementów montowanych na płytkach drukowanych, co powoduje, że rynkowa pozycja producentów z Azji jest w Polsce silna. Kiedyś tamtejsze produkty miały wiele problemów jakościowych, ale dzisiaj ich wykonanie i materiały konstrukcyjne są bez zastrzeżeń. Elementy te są dostępne w lokalnej sieci dystrybucji, a także kupowane za pośrednictwem wielu platform internetowych, które sprzedają każdemu dowolne ilości w modelu B2B i B2C. Te źródła niestety postrzegane są jako problem, bo często sprzedają kiepskie i tanie rozwiązania oraz omijają sieć dystrybucji. Przełączniki dostępne od krajowych dystrybutorów, nawet jeśli pochodzą z Chin, zwykle reprezentują dobry poziom techniczny i stosunek jakości do ceny. Inaczej sprzedaż nie miałaby sensu, bo dystrybutor brałby na siebie odium kłopotów klientów. Za tym idą wsparcie techniczne, próbki, obsługa posprzedażna i wszystkie inne usługi. Dostawy bezpośrednie z Chin omijają ten mechanizm, proponują tylko produkt i są przez to tańsze.

Konkurencję źródeł tego typu zaostrza to, że elementy pochodzące stamtąd mają preferencje transportowe, gdyż wysyłka jest dotowana, a ewentualne problemy jakościowe obciążają kupującego. Efektem jest zalewanie naszego rynku towarem z Azji, co blokuje rozwój.

Najważniejsze czynniki negatywne dla rynku

Na pierwszym miejscu w zestawieniu czynników negatywnych dla rozwoju rynku znalazły się tanie produkty azjatyckie, które odbierają rynek na komponenty standardowe czołowym graczom i prowadzą do wojen cenowych. Listę problemów uzupełnia czynnik związany z dużą konkurencją na rynku wynikającą z wielu firm aktywnych w tej branży oraz dużej popularności takich produktów. Trzecia istotna pozycja to długie czasy dostaw, co pokazuje, że problemy z zaopatrzeniem jeszcze się nie skończyły.

Z klawiatur nie rezygnujemy

Klawiatury foliowe znajdują szerokie zastosowanie w sprzęcie kontrolno- pomiarowym, systemach przemysłowych, maszynach, w motoryzacji, sprzęcie medycznym i wielu innych produktach, gdzie interfejs użytkownika nie jest wyrafinowany, ale za to musi działać pewnie w każdych warunkach. Ich duża popularność wynika z dobrej dostępności i niewielkiego skomplikowania technologii wytwarzania, co przekłada się na niskie koszty uruchomienia produkcji i jednostkowe oraz dobre własności użytkowe i jakość.

Kamil Kozłowski

COO & VP w Unisystemie

Jakie alternatywy dla tradycyjnych przełączników, przycisków i klawiatur są dziś dostępne na rynku?

Przede wszystkim technologie dotykowe. Coraz więcej urządzeń wyposażanych jest w ekrany, a naturalnym krokiem po ich wprowadzeniu staje się zastosowanie paneli dotykowych. Najczęściej korzysta się z technologii pojemnościowej, choć w niektórych aplikacjach nadal wykorzystywane są rozwiązania rezystancyjne lub oparte na podczerwieni.

Co jest ważne dla klientów korzystających z technologii dotykowych?

Z naszego doświadczenia wynika, że kluczowe są trwałość i funkcjonalność. Użytkownicy oczekują, że nasze rozwiązania będą działać bezawaryjnie nawet w najbardziej wymagających warunkach. Projektujemy urządzenia pracujące przy intensywnej eksploatacji, narażone na zakłócenia elektromagnetyczne oraz te wynikające z wibracji, drgań czy wstrząsów, ekstremalnych temperatur, a także ich gwałtownych zmian. Szczególnie istotna jest właściwa kalibracja kontrolera umożliwiająca dostosowanie działania panelu dotykowego do specyfiki konkretnej aplikacji. Dzięki temu możemy zapewnić właściwą czułość także wtedy, gdy na powierzchni ekranu pojawia się np. ciecz w postaci kropel deszczu, co skutecznie ogranicza ryzyko przypadkowych aktywacji.

I to wszystko można zrobić w Unisystemie?

Tak, i to wciąż nie wszystko, co możemy zaproponować. W ostatnim czasie rozwijamy również własne rozwiązania – jednym z nich jest pojemnościowy przycisk dotykowy, zaprojektowany z myślą o niezawodnej pracy w wymagających warunkach przemysłowych, w których kluczowe są precyzja, trwałość i odporność na trudne warunki. Zapewnia dokładną detekcję dotyku przez szkło o grubości do sześciu milimetrów nawet przy obecności wody na powierzchni, a możliwość kalibracji pozwala dopasować jego działanie do specyfiki danej aplikacji.

Przycisk można obsługiwać w rękawiczkach, co ma szczególne znaczenie w obszarach produkcyjnych, medycznych i laboratoryjnych, gdzie standardem jest praca w ochronnym wyposażeniu. Zintegrowana sygnalizacja świetlna i dźwiękowa tworzy intuicyjny, wielozmysłowy interfejs, który poprawia czytelność komunikatów i ułatwia obsługę urządzeń.

Co ważne, przycisk ten sprawdzi się nie tylko w nowych konstrukcjach – może pełnić również funkcję nowoczesnego, trwałego i bardziej higienicznego zamiennika dla tradycyjnych rozwiązań mechanicznych.

Są one produkowane na indywidualne zamówienia klientów, czyli jest to produkt elastyczny, taki, który można dopasować do wielu specyficznych wymagań aplikacyjnych. Klawiatury mogą być z klikiem klawiszy, podświetleniem, z frontem silikonowym lub foliowym, z polami przezroczystymi lub kolorowym filtrem pod wyświetlacz itd. Wraz z warstwami realizującymi ekranowanie elektromagnetyczne, konstrukcja jest zabezpieczana przed wpływem czynników środowiskowych lakierami i warstwami ochronnymi. Możliwości jest wiele, a rynek szeroki i chłonny. Klawiatury integruje się też z wyświetlaczami, sklejając je w całość tworzącą interfejs użytkownika. Produkcja indywidualnie dopasowanych do aplikacji klawiatur, w pełni zintegrowanych z obudową także w małych seriach tworzonych za pomocą druku cyfrowego, od wielu lat jest podstawą biznesu krajowych wytwórców. Firmy te inwestują w rozwój technologii, w nowe trwałe materiały, zapewniające odporność środowiskową i długotrwałe działanie, wykorzystują druk cyfrowy po to, aby dać możliwość pełnej indywidualizacji projektów, także tych określanych jako małe serie oraz łączą w ramach jednej oferty wiele rozwiązań przełączających, podświetleń i całego know-how, aby mieć ofertę dla każdego klienta.

Alternatywą dla klawiatur są oczywiście wyświetlacze z panelem dotykowym. Bezsprzecznie są coraz popularniejsze, doskonalsze techniczne, w tym także pozwalają na obsługę w rękawiczkach. Wyświetlacze z panelem dotykowym odbierają oczywiście rynek klawiaturom mechanicznym, z tym że kilka obszarów aplikacyjnych wydaje się niezagrożonych. Przykłady to środowiska, gdzie zachodzi kondensacja wilgoci, jest duży poziom zakłóceń elektromagnetycznych, gdzie panują niskie temperatury lub konieczne jest zapewnienie obsługi ręką w naprawdę grubej rękawicy. Reakcja na dotyk klawiatur i przycisków jest przewidywalna z sygnalizacją potwierdzającą naciśnięcie, co ma znaczenie w interfejsie użytkownika. Warto też zauważyć możliwość pracy przy bezpośrednim oświetleniu słonecznym.

Ważne i poszukiwane wersje

Listę ważnych i poszukiwanych wersji otwierają wersje przemysłowe przełączników, a więc do maszyn, urządzeń, grzybki awaryjne, sterownicze i podobne. W drugiej kolejności są to wersje miniaturowe do urządzeń elektronicznych, tj. głównie montowane na płytkach drukowanych. Niemniej różnice pomiędzy poszczególnymi kategoriami nie są duże i na wykresie nie ma jednej wyraźnie wybijające się nad inne grupy. Popyt jest wyrównany a ilościowo dominują przełączniki i przyciski, co jest zrozumiałe, bo na nie rynek jest wielokrotnie większy niż na klawiatury.

Jakość i wzornictwo stale się poprawiają

Kiepskiej jakości przełącznik lub klawiatura są w stanie skutecznie popsuć opinię o producencie urządzenia wśród klientów, a firmę wpędzić w kosztowne akcje serwisowe. W miarę upływu lat coraz więcej osób jest świadomych tego ryzyka i co jest również ważne, ma obecnie pieniądze na to, aby je minimalizować. Stąd niezmiennym trendem w branży jest coraz lepsza jakość komponentów elektromechanicznych w tym także ich wzornictwo (kształt, kolorystyka, ikonografika). Żywe kolory tworzyw sztucznych, funkcjonalny kształt, wielokolorowe podświetlenie ledowe, są z pewnością wyrazistym przykładem zachodzących zmian, tak samo jak ergonomia (efektywność i wygoda manipulowania klawiszem, brak zmęczenia operatora, wsparcie dla osób niepełnosprawnych). Producenci mają dzisiaj do dyspozycji lepsze materiały i sprzęt produkcyjny zapewniający większą precyzję wykonania. Druk cyfrowy o wysokiej rozdzielczości, znakowarki i obrabiarki laserowe nie są już dzisiaj luksusem dostępnym wyłącznie dla największych firm i są przez większość wytwórców wykorzystywane w produkcji i personalizacji produktów. Obrabiarki laserowe zapewniają wszystko, co jest dzisiaj potrzebne do zapewnienia jakości, a więc wysoką precyzję wykonywania oznaczeń, dowolność kształtu obróbki mechanicznej, trwałość oraz szybkość. Patrząc na całkowite koszty posiadania, obrabiarki cyfrowe CNC, wykrawarki laserowe, drukarki 3D są kosztowo efektywne, gdyż nawet jak inwestycja wymaga większych nakładów na początku, to potem jest to równoważone małymi kosztami ich użytkowania. Takie urządzenia pozwalają zapewnić możliwość wytwarzania produktów o wysokiej jakości technicznej i wizualnej w małej skali, bez konieczności sięgania po kompromisy. W warunkach krajowych jest to bardzo cenne, gdyż dobrze wpisuje się w potrzeby rynku, a więc różnorodne krótkie i średnie serie produktowe.

Na skutek tych procesów w ostatnich latach trwałość tradycyjnych przełączników i przycisków znacznie się też poprawiła. Dotyczy to zarówno trwałości mechanicznej, jak i elektrycznej.

Najważniejsze zjawiska pozytywne

Listę najważniejszych czynników pozytywnie wspierających rynek otwiera presja na jakość oraz zaawansowanie techniczne. Jakość jest pojęciem, o którym się obecnie dużo mówi i przykłada do niego dużą wagę. Kolejne miejsce z minimalnie mniejszym udziałem to szeroki asortyment dostępnych produktów, pozwalający dobrać element przełączający bez konieczności kompromisu oraz dobra koniunktura na rynku profesjonalnym (wojsko, lotnictwo, motoryzacja). To trzecie kryterium jest już zdecydowanie słabiej zarysowane w porównaniu do wymienionych poprzednich dwóch.

Ogromny asortyment elementów elektromechanicznych

Przełączników i przycisków na rynku jest mnóstwo, tak samo jak producentów i firm, które mają je w ofertach. Co więcej, wiodący producenci mają licznych naśladowców (w tym także kopistów), wiele innych firm korzysta z tego, że rynek jest chłonny i proponuje wielowariantowe rozwiązania, które w zamyśle mają pokryć większość potrzeb klientów. Brakuje standaryzacji, bo w praktyce dotyczy ona tylko tych najpopularniejszych produktów, które mają wielu producentów i tym samym standardem staje się to, co jest popularne. Doskonałym przykładem są przyciski membranowe do PCB.

W przełącznikach i przyciskach nie funkcjonuje system modułowy, który pozwala na ograniczenie liczby części składowych, taki, jaki funkcjonuje w złączach. Przeciwnie, w przypadku wielu produktów za jedną pozycją katalogową kryją się dziesiątki wersji różniących się kształtem dźwigni, kapturkiem, kolorem, stopniem ochrony, końcówkami łączeniowymi, kolorem podświetlenia. Utrudnia to dokonywanie wyborów, także zmianę produktu na inny, pochodzący od innego producenta, a także utrudnia promocję nowych rozwiązań.

Duża szerokość asortymentu jest też kłopotliwa od strony czasowej, bo stworzenie zamówienia długo trwa. Wyklikanie wszystkich elementów przełącznika zabiera dużo czasu, wymaga orientacji w tym, co pasuje do czego, które elementy tworzą daną serię produktów itd. W efekcie włożenie do koszyka jednego przełącznika z dodatkami za kilka złotych może zająć ponad pół godziny. Nie każdy ma tyle czasu, co ogranicza w jakimś kontekście promocję nowych rozwiązań.

Główne trendy techniczne

Za najważniejsze trendy techniczne ankietowani uznali dużą trwałość mechaniczną i elektryczną elementów przełączających, a w dalszej kolejności odporność środowiskową, a więc mówiąc ogólnie, zagadnienia związane z jakością. Na trzecim miejscu wypadła miniaturyzacja, która jest zjawiskiem zmieniającym całą współczesną technikę. Duża odporność środowiskowa także wiąże się z jakością i wskazuje, że rynek szybko dojrzewa, a wybory klientów są coraz bardziej świadome. Na koniec warto odnotować, że modułowość w przełącznikach, a więc możliwość komponowanie produktu przez wybór części składowych takich jak klawisz, kolor, podświetlenie, stale zyskuje na znaczeniu. Jest to już czwarta pozycja na wykresie.

Wandaloodporne przełączniki i klawiatury

Wandaloodporne przełączniki oraz klawiatury to specyficzny typ urządzeń, zaprojektowany z myślą o zastosowaniu w urządzeniach wystawionych na trudne warunki eksploatacji, obejmujące zarówno czynniki środowiskowe – kurz, wilgoć, wahania temperatur, jak i akty wandalizmu ze strony użytkowników – próby kradzieży oraz uszkodzenia. Zapotrzebowanie na tego typu komponenty pojawiło się kilka dekad temu wraz z upowszechnieniem się bankomatów oraz innego typu urządzeń elektronicznych przeznaczonych do użytku publicznego oraz wyposażonych w klawiatury. Ta sama technologia znajduje zastosowanie również w przypadku konstrukcji pojedynczych przycisków i przełączników, używanych np. w windach.

Istnieje wiele różnych sposobów konstrukcji wandaloodpornych komponentów, znakomita większość z nich ma jednak pewne cechy wspólne. Do najpowszechniejszych zaliczyć można: wytrzymałą obudowę ze stali nierdzewnej, aluminium lub wzmocnionego tworzywa sztucznego. Konstrukcja obudowy zabezpiecza elementy wewnętrzne (w tym układy elektroniczne) przed nieautoryzowanym dostępem, znacząco utrudnia też wszelkie próby uszkodzenia urządzenia. Poza tym większość wandaloodpornych układów charakteryzuje się również hermetycznością, zapewniającą odporność na czynniki środowiskowe, takie jak wilgoć oraz zapylenie. Ponadto przyciski wandaloodporne z reguły charakteryzują się małą wysokością. Jedynie nieznacznie (lub wcale) wystają ponad powierzchnię obudowy, co utrudnia wszelkiego typu manipulacje i modyfikacje ich konstrukcji. Często mają dodatkowe podświetlenie, które pozwala na korzystanie w warunkach ograniczonego oświetlenia zewnętrznego, jak również wyświetlające opis klawiszy w sposób uniemożliwiający zatarcie, zamazanie lub modyfikację poszczególnych znaków. Cechy te sprawiają, że elementy te są chętnie instalowane w aplikacjach przemysłowych i zakres ich użycia stale się poszerza. Oferta rynku też ewoluuje, mamy więcej takich elementów do wyboru, a ceny są już znacznie przystępniejsze niż dawniej.

=====

Moduły do komunikacji bezprzewodowej

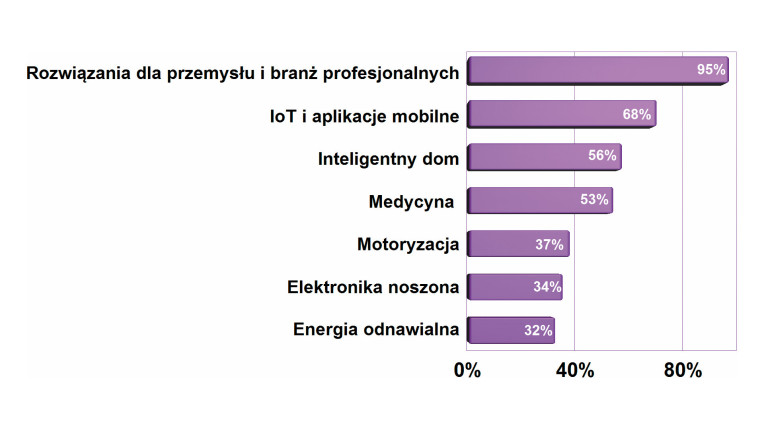

Moduły komunikacyjne odgrywają kluczową rolę w zapewnieniu łączności między urządzeniami i maszynami oraz węzłami IoT. Realizują wymianę danych, umożliwiając urządzeniom skuteczną komunikację i interakcję. Obsługują różne technologie komunikacji bezprzewodowej, takie jak Wi-Fi, Bluetooth, LoRaWAN, ZigBee i oczywiście te do sieci komórkowych. Ich wszechstronność pozwala im obsługiwać całe spektrum aplikacji, od inteligentnych domów i automatyki przemysłowej, po opiekę zdrowotną i rolnictwo.

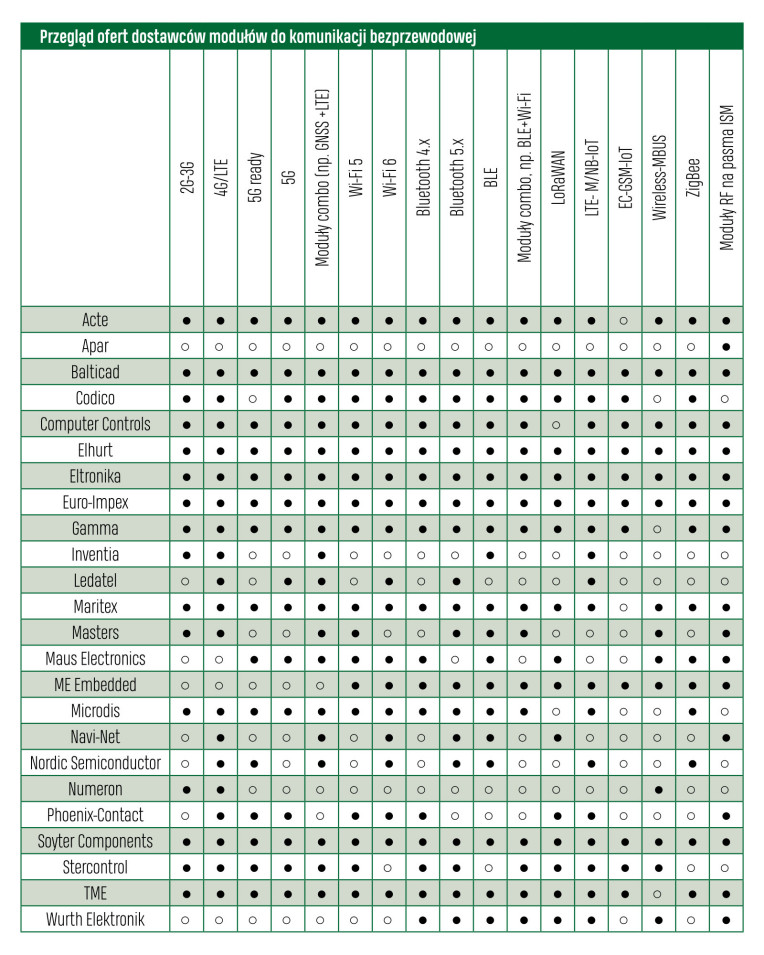

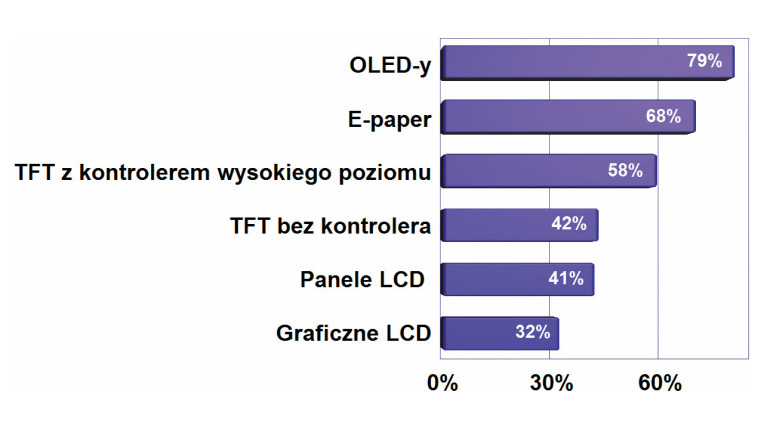

Cechą rynku modułów komunikacji bezprzewodowej jest ogromna różnorodność urządzeń, standardów, protokołów, wersji i wykonań. Co chwila pojawiają się nowe standardy i wersje, które rozwiązują problemy, które jeszcze chwilę wcześniej były dużym kłopotem (np. pobór mocy), dają lepsze parametry lub są lepiej powiązane z resztą infrastruktury w cały system. Rosnący stopień skomplikowania i zależności technologii oraz wspomniana szybka ewolucja niestety nie sprzyja dobrej orientacji klientów i utrudnia dokonywanie optymalnych wyborów. Mamy Wi-Fi, Bluetooth, moduły do sieci komórkowych, wersje RF na pasma ISM w dziesiątkach odmian i moduły do sieci LPWAN. Konstruktor ma do wyboru nie tylko kilka generacji sieci Wi-Fi i komórkowych oraz Bluetooth różniących się nie tylko przepustowością, ale i poborem mocy, z których nie wszystkie są ze sobą kompatybilne. Do dyspozycji są też inne rozwiązania otwarte i protokoły własnościowe. Wiele modułów komórkowych to wielosystemowe platformy z procesorem aplikacyjnym, pamięcią oraz wersje z wbudowanym odbiornikiem lokalizacyjnym lub Bluetooth albo Wi-Fi. Razem tworzy to ogromne możliwości i wybrać optymalne rozwiązanie do projektu staje się coraz bardziej skomplikowane.

Technologia 5G stała się faktem

Dostępność sieci komórkowej w technologii 5G w Polsce stała się faktem w ostatnich dwóch latach, gdyż po wielu problemach natury politycznej zakończyły się wielokrotnie zapowiadane i przekładane aukcje częstotliwości dla operatorów. Zmiana ta widoczna jest już w dostępnych usługach świadczonych przez operatorów, a abonamenty z opcją "5G" są codziennością. Faktem jest, że 5G w naszym kraju pojawia się stosunkowo późno, odnosząc to do innych krajów Unii Europejskiej, co ma wpływ na potencjał i tempo rozwoju rynku modułów komunikacyjnych w tym standardzie, gdyż aby rynek się rozwijała sprzedaż była możliwa, operatorzy muszą mieć gotową infrastrukturę. W tym kontekście należy pamiętać, że "5G" jest terminem bardzo pojemnym, jeśli chodzi o zakres dostępnych usług jak też o wykorzystywane pasma częstotliwości. Nie zawsze dostępność "5G" oznacza pełny zakres możliwości. Raczej, na etapie początkowym, jest to "fragment". Podobnie jest z zasięgiem, który na początku pojawia się w centrach dużych miast, potem dopiero jest rozszerzany na ich peryferia. Operatorzy podają, że docierają z usługami 5G "do połowy mieszkańców Polski" i że czekają ich dwa lata intensywnych inwestycji.

Operatorzy komórkowi w Polsce oferują usługi w sieci 5G od 2022 roku. Państwo nie udostępniło im jeszcze wtedy częstotliwości, które w Europie do tego celu wskazano (700 MHz, 3,6 GHz oraz 26 GHz), zatem w większości radzili sobie, dzieląc już posiadane zasoby od usług starszego typu np. Internetu LTE. Wyjątkiem był Polkomtel, który na 5G przeznaczył konkretne pasmo (2,6 GHz). Pasmo 3,6 GHz to tzw. pasmo pojemnościowe, co oznacza, że więcej urządzeń czy aplikacji może korzystać z nadajnika w tym samym czasie. Dopiero niedawno rozdysponowano pasmo 700 MHz między operatorów sieci komórkowych, operatora systemu łączności dla służb (PPDR, Public Protection and Disaster Relief) oraz organizatorów specjalnych wydarzeń masowych (PMSE). Pasmo 700 MHz ma inne właściwości: zapewnia zasięg sygnału na większym obszarze i potencjalnie do większej liczby domów i firm, stąd określane jest mianem "pokryciowego". Z punktu widzenia sprzedaży modułów 5G dostępność 700 MHz jest istotna, bo poszerza możliwości użycia. Sytuacja będzie jeszcze lepsza, gdy UKE rozdysponuje pasmo 800 MHz.

Istotne nowości w obszarze komunikacji bezprzewodowej

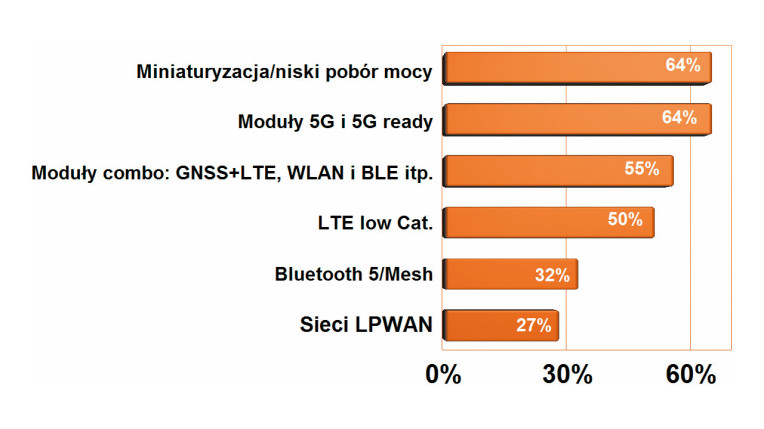

Zestawienie najbardziej istotnych trendów, produktów i technologii w zakresie komunikacji bezprzewodowej otwiera miniaturyzacja i niski pobór mocy, który jest wspólnym mianownikiem wielu nowych rozwiązań kierowanych do świata IoT, AMR i urządzeń mobilnych. Podobne wskazanie uzyskały nowe moduły do sieci 5G. Kolejne trzy pozycje o mniej więcej tym samym udziale procentowym to moduły dwa w jednym, moduły LTE niskich kategorii (a więc zapewniające mały pobór mocy kosztem wydajności) oraz nowe wersje Bluetooth.

2G/3G – decyzje operatorów są jednoznaczne

Świat telekomunikacji szybko się zmienia, stąd wielu operatorów sieci całkowicie wycofuje wsparcie dla technologii 2G. Nie jest ono używane przez zdecydowaną większość mobilnych urządzeń wykorzystywanych obecnie, a zapotrzebowanie klientów praktycznie nie istnieje poza obszarami wiejskimi. 3G szybko odchodzi do lamusa z bardzo podobnych powodów. Nowoczesne urządzenia wymagają wyższej przepustowości, niż może zapewnić 3G, a wspieranie tej technologii ma mało sensu dla nowoczesnego operatora. Chociaż wsparcie dla 3G na świecie jest znacznie większe niż dla 2G, dni tego standardu też są policzone.

Można przyjąć, że minimalny poziom możliwości komórkowych zapewniają sieci LTE, a w kolejnych latach będzie to sieć 5G. 5G zapewnia nie tylko większą wydajność, ale także pozwala na niezawodną komunikację dla wielu jednocześnie działających urządzeń, niskie opóźnienia, sieci prywatne i sieci typu NTN (z komunikacją satelitarną nie korzystające z nadajników naziemnych). 5G idzie więc wyżej, szerzej, a także zapewnia rozszerzone wsparcie dla urządzeń o ultramałym zużyciu energii i uproszczone implementacje protokołu (takie jak w LTE "niskie kategorie", NB, M).

Wiele z funkcji 5G będzie prawdopodobnie bezużytecznych do zastosowań M2M/ IoT/Embedded. Ogromna przepustowość może stanowić wyzwanie dla mikroprocesora, a pasma mikrofalowe niekoniecznie muszą zapewnić efektywność energetyczną. Prawdopodobnie minie jeszcze kilka lat, zanim na rynku pojawi się masowo produkowany, tani modem 5G o praktycznym zastosowaniu dla większości urządzeń IoT/M2M. Na razie ceny jednostek "5G" są dość wysokie.

Certyfikacja

Moduły komunikacyjne znacząco upraszczają konstrukcję urządzeń elektronicznych, gdyż dzięki nim konstruktor skupia się na zagadnieniach aplikacyjnych i użytkowych zamiast na realizacji toru radiowego, budowie protokołu, modulacjach itp. Poza wymienionymi aspektami dużą wartością dodaną jest certyfikacja, a więc zgodność modułów z wymaganiami dyrektywy RED i innych podobnych regulacji obowiązujących w pozostałych regionach świata jak FCC. Moduły muszą być też certyfikowane na zgodność ze standardem protokołu, wymaganiami sieci komórkowych, po to aby potrafiły działać z innym zgodnym sprzętem tworzącym infrastrukturę dostępową.

Z certyfikacją wiążą się opłaty, gdyż nierzadko rozwiązania związane z komunikacją są chronione patentami, których właścicielami są organizacje i firmy odpowiedzialne za rozwój standardu. Niewiele firm ma świadomość, że wprowadzając produkt na rynek, bierze odpowiedzialność za regulowanie opłat patentowych. Ze względu na tysiące zarejestrowanych patentów jest to szczególnie ważne w przypadku łączności komórkowej. Producenci modułów najczęściej lakonicznie odpowiadają na pytanie, czy prawa patentowe są przez nich opłacane (nie muszą ich opłacać, ale wtedy negocjacje z właścicielami patentów musiałby prowadzić klient końcowy, bo to on jest odpowiedzialny), najczęściej są opłacane, ale tylko ich niewielka część, o czym klient końcowy nie ma świadomości, a można zawsze ogólnie powiedzieć "tak, opłacamy".

Stan uregulowanych opłat patentowych jest zatem niełatwy do ustalenia i powinien być przedmiotem pytań do sprzedawcy oraz zawarty w treści zamówień, po to aby, w razie problemów, można było ustalić odpowiedzialność.

RedCap

Pierwsza publikacja standardu 5G skupiała się głównie na rozwiązaniu eMBB, dedykowanym przede wszystkim do urządzeń mobilnych, takich jak smartfony oraz tablety, gdzie istotne jest przede wszystkim zapewnienie wysokiej przepustowości sieci i dużej szybkości transmisji danych. Istnieje jednak duża grupa urządzeń, szczególnie istotna w rozwiązaniach przemysłowych, gdzie szybkość transmisji danych nie jest tak ważna, znacznie większe znaczenie odgrywa zaś koszt urządzenia oraz zużycie energii. Z myślą o tego typu produktach opracowany został standard Reduced Capability (RedCap). Standard ten, będący elementem technologii 5G, pozwala na osiągnięcie szybkości transmisji do 150 Mbit/s (downlink) oraz 50 Mbit/s (uplink). Stanowi swego rodzaju uzupełnienie dla trzech głównych przypadków użycia technologii 5G. Powstał z myślą o urządzeniach, które nie potrzebują tak dużej szybkości transmisji jak eMBB, ani tak niskich wartości opóźnień komunikacji jak URLLC. RedCap koncentruje się na zapewnieniu wysokiej energooszczędności oraz skalowalności sieci, jednak w sposób mniej restrykcyjny niż w przypadku mMTC. Jednym słowem, jest to swego rodzaju kompromis pomiędzy trzema skrajnymi przypadkami użycia technologii 5G.

Główna różnica pomiędzy charakterystyką standardów eMBB oraz RedCap to maksymalna szybkość transmisji danych, która jest ściśle powiązana z szerokością pasma transmisyjnego, w efekcie zaś wpływa na złożoność oraz koszt modułu komunikacyjnego. W przypadku eMBB szerokość pasma to 100 MHz (dla FR1, czyli zakresu częstotliwości poniżej 6 GHz), zaś dla RedCap jest to nie więcej niż 20 MHz. Dodatkowo, urządzenia eMBB mogą zwiększać szybkość transmisji poprzez złożone techniki modulacji (CA, Carrier Aggregation), które nie są wspierane w standardzie RedCap.

Dzięki ograniczeniu szerokości pasma komunikacyjnego oraz uproszczeniu sposobu kodowania i modulacji sygnału radiowego możliwe było znaczne ograniczenie kosztów modułów komunikacyjnych przeznaczonych dla układów RedCap w porównaniu do analogicznych komponentów w standardzie eMBB. Uproszczeniu uległ cały tor radiowy – od układu antenowego, poprzez ścieżki sygnałowe aż do układu odbiornika. Z tego powodu standard RedCap pozwala na upowszechnienie technologii 5G w urządzeniach IoT, które korzystały uprzednio ze starszych rozwiązań komunikacyjnych, jak np. technologii 4G.

Należy mieć jednak świadomość, że nie w każdym przypadku korzystanie ze standardów RedCap przyniesie wymierne korzyści. Przykładowo, jeśli urządzenie typu RedCap zostanie wykorzystane w aplikacji wymagającej cyklicznej transmisji dużej ilości danych, może to doprowadzić do znacznego wzrostu obciążenia sieci radiowej. Poprawna praca systemu może w takim przypadku wymagać rozbudowy pojemności sieci, co przełoży się na wzrost kosztów całego rozwiązania, nawet pomimo obniżenia kosztów pojedynczego urządzenia. Z tego powodu istotne jest zrozumienie możliwości i ograniczeń poszczególnych profili urządzeń opisanych w technologii 5G – w praktycznych zastosowaniach moduły standardu RedCap, szczególnie te niskobudżetowe, powinny być wykorzystywane przede wszystkim w urządzeniach przeznaczonych do wymiany ograniczonej ilości danych.

Główne trendy techniczne

Za najważniejsze trendy techniczne zmieniające rynek komunikacji bezprzewodowej uznano możliwość zdalnego zarządzania urządzeniami oraz dokonywania aktualizacji oprogramowania drogą radiową (FOTA) dzięki którym projektowanie rozproszonych sieci czujnikowych, IoT i podobnych rozwiązań staje się łatwiejsze a eksploatacja tańsza. Na drugim miejscu znalazł się niski pobór mocy, co jest uniwersalną wartością zmieniającą cały rynek elektroniki, a zwłaszcza technologie mobilne. Za znaczącą nowość uznano moduły SoM pozwalające na stworzenie aplikacji bez konieczności dodawania zewnętrznego hardware (MCU, pamięć), jak również coraz doskonalsze oprogramowanie projektowe przyspieszające i ułatwiające tworzenie aplikacji.

Do typowych obszarów zastosowań standardu RedCap zaliczyć można m.in. system typu smart home, urządzenia noszone (zegarki, opaski) oraz systemy pomiarowe.

Przyszłym kierunkiem ewolucji standardu RedCap będzie prawdopodobnie rozszerzenie wsparcia dla urządzeń o jeszcze niższych wymaganiach w zakresie pasma transmisyjnego, kosztu oraz zapotrzebowania energetycznego. Kolejnym kamieniem milowym w rozwoju tej technologii ma być standard eRedCap (enhanced RedCap), pozwalający na ograniczenie pasma radiowego wykorzystywanego przez pojedyncze urządzenie do 5 MHz. Standard ten zapewniać ma szybkość transmisji porównywalną do LTE Cat-1.

W ogólności RedCap ma na celu zapewnienie tańszej alternatywy dla modułów oferujących pełne wsparcie technologii 5G, jego zadaniem jest również zapewnienie łatwej i taniej ścieżki migracji z LTE do 5G dla wielu grup urządzeń korzystających uprzednio ze standardów LTE Cat-1 do LTE Cat-4. Istnieje jednak pewna grupa urządzeń, dla których wymagania energetyczne standardu RedCap są zbyt wysokie. Z myślą o tego typu produktach opracowywany jest nowy standard komunikacyjny w ramach technologii 5G – Ambient IoT (A-IoT).

Sieci LPWAN się rozwijają

Sieci LPWAN (Low-Power Wide-Area Network), to rozwiązania, gdzie przy małej przepustowości zapewniony został znacznie większy w porównaniu do innych standardów zasięg komunikacji. W warunkach krajowych oznacza to sieci LoRaWAN oraz LTE Cat. M / NB-IoT (Narrow-Band IoT) oraz opisane wyżej wersje 5G RedCap i LTE cat 1 Bis, które służą głównie do zbierania danych z rozległych aplikacji telemetrycznych. Typowe aplikacje, jak liczniki wody, gazu czy ciepła, systemy alarmowe, czujniki zadymienia, śledzenie ludzi i zwierząt, produkty AGD, kontrola dostępu do budynku, sterowanie oświetleniem, różnego rodzaju czujniki, np. stacje meteorologiczne itp., nie potrzebują większych wydajności, stąd LTE niskiej kategorii może być dobrym pomysłem.

======

Przekaźniki elektromagnetyczne

Zastosowanie przekaźników elektromagnetycznych jest koniecznością w rozwiązaniach inteligentnych budynków, projektach stacji ładowania samochodów elektrycznych i pomp ciepła. Niezmiennie duże zapotrzebowanie na przekaźniki generują systemy BMS, HVAC, rynek AGD, automatyka czy energetyka. Rozwój rynku przekaźników determinują głównie zastosowania przemysłowe, co wynika po prostu z tego, że niezmiennie od lat ta branża jest czołowym odbiorcą tych komponentów, wykorzystując je w instalacjach, urządzeniach i maszynach oraz systemach automatyki przemysłowej.

Wiele krajowych firm produkuje i eksportuje urządzenia dla przemysłu, takie jak sterowniki, regulatory, urządzenia pomiarowe, styczniki, systemy bezpieczeństwa i nadzoru. Rośnie nieustannie skomplikowanie procesów wytwarzania, które wykorzystują coraz więcej urządzeń i sprzętu technicznego. W ramach inwestycji i modernizacji starszych zakładów i linii produkcyjnych kupowane są nowe maszyny i budowane do nich instalacje i systemy. Takie aktywności leżą u podstaw popytu na omawiane elementy.

Najważniejsze zjawiska pozytywne dla rynku

Listę najważniejszych czynników pozytywnie wspierających rynek otwiera szeroki asortyment dostępnych produktów, pozwalający dobrać element przełączający bez konieczności kompromisu. Kolejne miejsce to coraz większe znaczenie jakości, zwiększające się wymagania (potrzeby) klientów. Czwarta pozycja to szeroki i chłonny rynek. Wysokiej jakości produkty zapewniają trwałość projektów oraz ich bezusterkowość, a co za tym idzie, reklamacje oraz ewentualne zwroty lub koszty serwisu są sprowadzone do minimum, co pokazuje, że wiele kryteriów można sprowadzić do małych kosztów posiadania.

Przepięcia, prądy udarowe, komutacja obwodów dużej mocy w sieciach trójfazowych załączanie elementów indukcyjnych, jak silniki oraz elektromagnesy, to przykłady aplikacji, które są sterowane przede wszystkim za pomocą przekaźników elektromagnetycznych. Elementy te są odporne na stany nieustalone, wyładowania, zapewniają doskonałą izolację w stanie otwartym, mają małe pojemności własne, minimalną rezystancję przejścia, a więc z punktu widzenia inżyniera i projektanta zapewniają niezawodną komutację. Co więcej, klasyczne przekaźniki zapewniają tolerancję na przeciążenia, bo przekroczenie napięć lub prądów, nawet znaczne, nie powoduje od razu uszkodzenia, ale przenosi się jedynie negatywnie na trwałość. Podczas obsługi technicznej taki naruszony element można wymienić i zapewnić nieprzerwane prawidłowe działanie przez lata.

Janusz Komecki

dyrektor zarządzający w firmie Dold

Jaka jest obecnie sytuacja w przekaźnikach, patrząc z Waszej perspektywy na rynek?

Przekaźniki produkowane przez naszą firmę to w większości przekaźniki z wymuszeniem prowadzenia styków, tzw. safety, do wymagających aplikacji, a więc tam, gdzie liczy się przede wszystkim niezawodność. Przekaźniki marki Dold trafiają do aplikacji w branży kolejowej, sterowania ruchem, budowy pojazdów specjalnych, techniki okrętowej, sterowania windami i robotyki. Jednym z najważniejszych sektorów są układy bezpieczeństwa maszyn, gdzie stosowanie przekaźników safety jest obligatoryjne.

Wraz z popularyzacją przekaźników półprzewodnikowych niektórzy prognozowali zmierzch tradycyjnych przekaźników elektromechanicznych. Okazuje się jednak, że obie technologie mają w pewnych aspektach swoje zalety i mogą koegzystować na rynku. Co więcej, dostępne są rozwiązania hybrydowe łączące zalety obu technologii, jak np. IK3070/200 produkcji firmy Dold.

Produkcja przekaźników pod względem kosztowym jest bardzo powiązana z cenami metali szlachetnych. Znaczny w ostatnich latach wzrost ceny złota oraz miedzi ma istotny wpływ na ceny produktów ze względu na duży udział tych surowców w wyrobie gotowym. Na szczęście skończyły się problemy ogólne z pozyskiwaniem surowców, z którymi mierzyliśmy się w okresie pandemii. Wiążemy duże nadzieje na wzrost rynku wysokiej jakości przekaźników w związku z realizowanymi dużymi projektami infrastrukturalnymi w kolejnictwie oraz energetyce, a także w rozwiązaniach elektromobilnych.

Rozwój rynku

Rozwój rynku przekaźników determinują głównie zastosowania przemysłowe, co wynika po prostu z tego, że niezmiennie od lat branża ta jest wiodącym odbiorcą tych komponentów, wykorzystując je w instalacjach, urządzeniach i maszynach oraz komponentach automatyki przemysłowej. Wiele krajowych firm produkuje i eksportuje urządzenia dla przemysłu, takie jak sterowniki, regulatory, urządzenia pomiarowe, systemy bezpieczeństwa i nadzoru. Rośnie nieustannie skomplikowanie procesów wytwarzania, które wykorzystują coraz więcej urządzeń i sprzętu technicznego. W ramach inwestycji i modernizacji starszych zakładów i linii produkcyjnych kupowane są nowe maszyny i budowane do nich instalacje i systemy. W wielu z nich gdzieś jest zwykle jakiś przekaźnik.

Poza przemysłem strumień sprzedaży tworzą też elektronika profesjonalna, energoelektronika, motoryzacja, systemy alarmowe. Nie są to filary rynku odpowiedzialne za zbyt, ale z pewnością mające znaczenie. Niemniej rynek AGD wyraźnie stracił na znaczeniu, co jest skutkiem ekspansji przełączników elektronicznych i popularyzacji sterowania silnikami z wykorzystaniem falowników. Motoryzacja też nie jest już tak dużym odbiorcą jak dawniej, niemniej nadal w każdym samochodzie jest ich kilkanaście. Do tego dochodzą elementy w produktach powiązanych, np. w ładowarkach.

Najważniejsze czynniki negatywne dla rynku

Listę problemów dla branży otwiera pozycja związana z silną konkurencją na rynku przekaźników w kraju wynikającą z wielu firm aktywnych w tej branży oraz dużej popularności takich elementów, a dalej oszczędności i cięcia kosztów u klientów. Negatywnym czynnikiem są też kiepskie produkty dalekowschodnie, niestabilna sytuacja geopolityczna oraz ogólny wzrost kosztów działalności gospodarczej i cen. Wspólnym mianownikiem dla prezentowanego wykresu są czynniki ekonomiczne.

Wiele parametrów do rozważenia

Podstawowe cechy przekaźników od strony technicznej to: napięcie znamionowe cewki, liczba i konfiguracja styków i ich obciążalność prądowo- -napięciowa. Ważną rzeczą jest wybór materiału, z którego wykonane są styki, gdyż wpływa to na żywotność przekaźnika i jego cenę. W dalszej kolejności przy doborze odpowiedniego komponentu liczą się takie cechy jak trwałość przełączeniowa, odporność na udary, parametry cewki (pobór mocy), minimalna moc przełączana i napięcie. Bardzo ważna jest wysoka niezawodność potwierdzona wieloma certyfikatami i uznaniami międzynarodowymi: UL, CSA, cURUs, EAC i normami branżowymi, jakimi są np. dla przemysłu stoczniowego DNV, GL.

Bartłomiej Szydłowski

dyrektor handlu i marketingu w firmie Relpol

Jakie zjawiska na rynku przekaźników warto wymienić?

W ostatnich latach rynek przekaźników rozwija się bardzo dynamicznie, a głównym trendem jest miniaturyzacja przy zachowaniu wysokich parametrów elektrycznych i mechanicznych. W branżach rozwijających się najszybciej, takich jak elektromobilność i OZE, trwa wyścig o stworzenie przekaźników łączących małe wymiary z dużymi mocami łączeniowymi, odpornością na temperaturę i długą trwałością. Równocześnie rozwijane są cewki niskomocowe i materiały stykowe o wysokiej trwałości. Coraz większe znaczenie mają certyfikaty międzynarodowe, w tym zwłaszcza UL, które potwierdzają parametry w autoryzowanych laboratoriach. Zgodność z normami środowiskowymi i bezpieczeństwa, takimi jak RoHS, REACH, staje się standardem eliminującym wyroby bez odpowiednich atestów.

Wzrosło także zapotrzebowanie na opakowania przekaźników dostosowanych do automatycznych podajników, co pozwala ograniczyć koszty i przestoje w procesach montażu. Jednocześnie rynek odczuwa coraz silniejszą presję cenową wynikającą z rosnącej liczby producentów z Dalekiego Wschodu oferujących konkurencyjne cenowo wyroby. Obecnie sukces na rynku przekaźników zależy nie tylko od samego produktu, lecz także od pakietu obejmującego innowacyjną konstrukcję, certyfikaty, dostępność, jakość oraz cenę.

Od strony aplikacyjnej ważne są wymiary przekaźnika i sposób jego montażu, obudowa, zakres temperatur pracy, a także odporność środowiskowa i zabezpieczenia konstrukcyjne przekaźnika, co można tłumaczyć jako zdolność do pracy w trudnych warunkach otoczenia, np. przy obecności wibracji.

Specjalną kategorię do rozważenia tworzą przekaźniki przeznaczone do łączenia obwodów napięcia stałego o dużej wartości, z uwagi na trudne warunki do gaszenia łuku elektrycznego w takim przypadku. Elementy takie mają styki wykonane z AgCdO i systemy wydmuchu magnetycznego łuku z grzebieniowym gasikiem, które dają gwarancję długiej i niezawodnej pracy. Kryteriów selekcji jest mnóstwo.

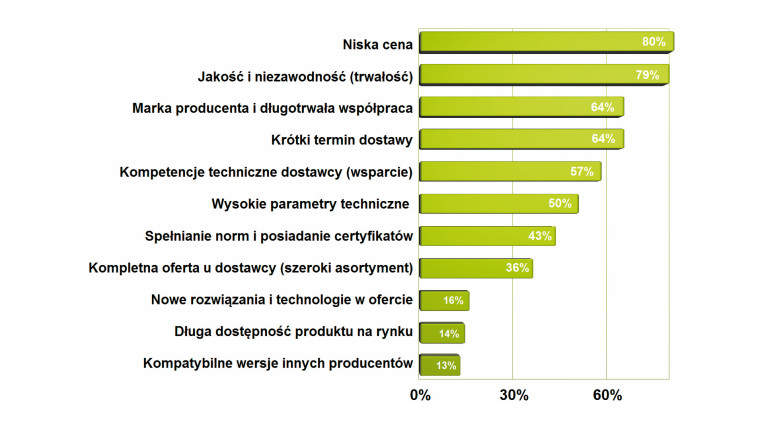

Najważniejsze cechy przekaźników brane pod uwagę przy kupnie

Trzy kryteria wyraźnie wybijają się ponad resztę w zestawieniu najważniejszych cech ofert handlowych w zakresie przekaźników elektromagnetycznych: cena oraz jakość i niezawodność. Nieco mniejsze wskazanie, ale nadal bardzo duże mają marka producenta oraz krótki termin dostawy. Cena i jakość zawsze plasują się na górnych pozycjach tego typu zestawień, stąd też wykres nie zaskakuje. Zainteresowanie jakością to efekt zmian w całej technice w ostatnich dwóch dekadach, podobnie jak marka oraz kompetencje dostawcy. Jeśli dany producent istnieje na rynku od wielu lat, ma kompetentnych dystrybutorów, jego marka jest znana i ma pewną renomę na rynku, wówczas klienci przychylniej oceniają takie produkty.

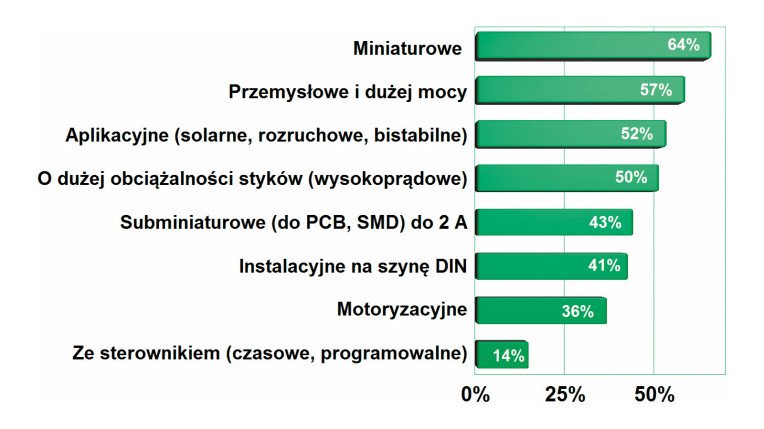

Podział produktowy i terminologia branżowa

Poszukiwanie przekaźnika oraz sprawne poruszanie się po katalogach producentów wymaga ponadto zwrócenia nieco uwagi na terminologię. Powszechnie stosowany termin "przekaźnik miniaturowy" oznacza zwykle element o średniej wielkości i obciążalności, przeznaczony do montażu na płytce drukowanej. Takie wersje przeznaczone są do załączania obciążeń od 5 do 10 A przy napięciu sieci 230 V AC i zawierają jedną lub maksymalnie dwie pary styków. Z punktu widzenia elektroników to raczej nie jest "miniaturowy" element. Te małe to "przekaźniki subminiaturowe". Są to elementy przeznaczone do montażu na płytkach drukowanych w wersjach THT i SMD. Ich prąd przewodzenia styków zawiera się typowo w zakresie do 2 A, napięcia pracy sięgają 120 V, a więc nie są to elementy przeznaczone do pracy z napięciem sieci energetycznej. To takie typowe przekaźniki do aplikacji w elektronice, do pracy z małymi sygnałami o wielkości kondensatora elektrolitycznego lub złącza.

Druga uwaga dotyczy styków. To, co elektronicy nazywają stykami, formalnie producenci nazywają zestykami. Formalnie styk to element z materiału kontaktowego, który realizuje połączenie obwodu elektrycznego. Razem z dźwignią i mechanizmem ruchu ten kontakt tworzy zestyk. W świecie elektroniki "zestyk" nie istnieje, stąd w zapytaniach ofertowych warto pamiętać o tej różnicy pojęciowej, aby uniknąć nieporozumień.

Przekaźniki o największym potencjale rynkowym

Mimo dużego znaczenia branży przemysłowej za najbardziej dochodowe typy przekaźników uznano wersje miniaturowe, które wyprzedziły rozwiązania przemysłowe i aplikacyjne. To w dużej mierze wynik specyficznej terminologii branżowej, gdyż wersje miniaturowe nie są tymi małymi przekaźnikami, które elektronicy montują na płytkach drukowanych. Takie to wersje "subminiaturowe", zaś terminem "miniaturowe" określa się większe rozwiązania, które wielu elektroników nazwałoby bez namysłu "przemysłowymi". Mówiąc o przekaźnikach (wielkości, stykach), trzeba uważać, do kogo kierujemy swój przekaz, aby zostać dobrze zrozumianym.

Jak wspomniano, bardzo ważna grupa produktowa to przekaźniki przemysłowe. Mają one jeszcze większe wymiary niż miniaturowe, zwykle są one przeznaczone do montażu w podstawce lub mają końcówki do lutowania lub pod konektory. Zawierają kilka par styków o dużej obciążalności, mogą włączać obciążenia indukcyjne, pracują przy napięciu do 400 V AC. Wyróżniają się odpornością, trwałością, użytecznymi dodatkami, takimi jak przycisk testowy lub kontrolka oraz wzmocnioną izolacją między cewką a stykami. Warto zauważyć, że przekaźniki przemysłowe zamykane są zwykle w przezroczystych obudowach po to, aby można było łatwo ocenić ich stan techniczny. W innym wykonaniu są one w wersji na szynę DIN.

Oddzielną kategorię przekaźników tworzą styczniki. Jest to specjalizowany przekaźnik dużej mocy przeznaczony do pracy w aplikacjach przemysłowych i energoelektronicznych. Styczniki są komponentami przeznaczonymi do montażu w obudowie lub na szynie DIN i mają obudowę, która pozwala na zamocowanie w chassis. Są przeznaczone do łączenia dużych obciążeń, o mocy nawet wielu kilowatów, a więc silników, grzejników, systemów oświetlenia przemysłowego i obiektowego. Styczniki są łączone przewodami o dużym przekroju i mają wyprowadzenia przystosowane do montażu grubych kabli. Ich cewka z reguły jest zasilana napięciem 24 V DC lub napięciem przemiennym 230 V AC . Zawierają kilka styków, typowo trzy duże pary styków dla trzech obwodów fazowych.

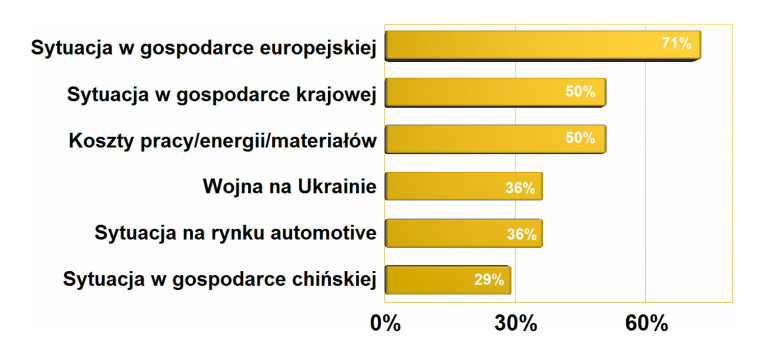

Główne problemy rynku

Największym problemem dla rynku przekaźników jest nienajlepsza sytuacja w gospodarce europejskiej i krajowej, a w dalszej kolejności rosnące koszty działalności, tj. materiałów, pracy i energii. Wpływ wojny na Ukrainie, warunków na rynku motoryzacyjnym oraz sytuacja w Chinach nie zostały w tym obszarze biznesu wskazane jako bardzo ważne. Warto zwrócić uwagę, że kiepska sytuacja w gospodarce europejskiej została oceniona jako czynnik dużo ważniejszy od rynku krajowego. Od wielu lat sprzedaż usług i produktów na eksport, praca na rzecz firm z Europy Zachodniej były dla wielu polskich firm ważną częścią biznesu i łagodziły wahania koniunktury w kraju. Ten czynnik dzisiaj nie oddziałuje tak znacząco na rynek, bo za granicą sytuacja wcale nie jest lepsza.

Rosnący asortyment wersji specjalistycznych

Do niedawna przekaźnik był postrzegany jako coś bardzo uniwersalnego, czego można było używać w zasadzie dowolnie, obecnie okazuje się, że czasem warto sięgnąć po rozwiązanie aplikacyjne. Przykładem mogą być wersje solarne, zdolne do komutacji obwodów mocy prądu stałego, rozwiązania odporne na uderzenia prądu udarowego, o podwyższonej odporności izolacji, bistabilne i podobne.

Najważniejsze trendy w przekaźnikach

Miniaturyzacja przekaźników została uznana za najważniejsze zjawisko techniczne zmieniające rynek przekaźników. Wszystkie urządzenia elektroniczne z każdą kolejną generacją są coraz mniejsze i jednocześnie bardziej złożone. Jest ich też w naszym otoczeniu coraz więcej, przez co miejsca na płytkach drukowanych, w obudowach, szafach instalacyjnych jest coraz mniej. Mamy coraz więcej sprzętu przenośnego, stąd rynek cały czas oczekuje produktów mniejszych, bez względu na obciążalność, moc wyjściową lub napięcie robocze. Mały pobór mocy przez cewkę elektromagnesu także wpisuje się w to zjawisko wraz ze zwiększającym się udziałem elektroniki mobilnej i sprzętu zasilanego z baterii. Przekaźnik ma pobierać mało mocy po to, aby się nie nagrzewać, nie wpływać negatywnie na zużycie energii i także aby w porównaniu do wersji półprzewodnikowych był możliwe najbardziej funkcjonalny.

Producenci eksperymentują też z wersjami hybrydowymi przekaźników, takimi, gdzie łączy się przekaźnik elektromechaniczny z półprzewodnikowym. Celem jest poprawa trwałości, ograniczenie nagrzewania lub zapewnienie tolerancji prądu rozruchowego o dużej wartości.

Warto też dostrzec, że rośnie liczba przekaźników z wbudowaną elektroniką do montażu na szynie DIN. W przypadku konieczności realizacji niezbyt skomplikowanych funkcji sterowania atrakcyjnym rozwiązaniem są przekaźniki programowalne, czyli znacznie tańsze i mniejsze odpowiedniki sterowników PLC i mikro PLC.

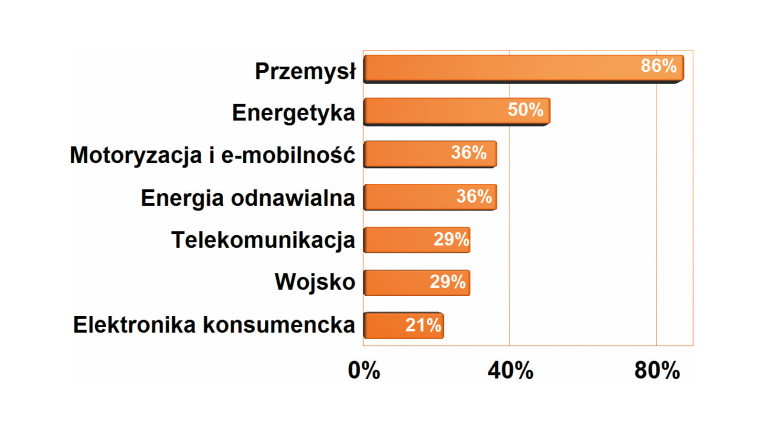

Branże o największym potencjale zakupowym

Pierwsza i wyraźnie dominująca nad całą resztą pozycja przemysłu razem z energetyką na liście branż o największym potencjale zakupowym dla przekaźników nie jest zaskoczeniem, gdyż dla tych komponentów klienci z tej grupy są najważniejsi. Kolejne trzy pozycje, tj. elektronika konsumencka, motoryzacja oraz elektronika profesjonalna (np. wojskowa), mają wyraźnie mniejsze znaczenie i zostały ocenione podobnie. Z uwagi na uniwersalność przekaźników i powszechność ich użycia w wielu aplikacjach wykres można traktować jako potencjał zakupowy poszczególnych branż w realiach Polski bez precyzowania, czego on dotyczy.

Do ich głównych zastosowań zaliczyć można systemy automatyki budynkowej (m.in. sterowanie oświetleniem, ogrzewaniem oraz klimatyzacją), kontroli dostępu oraz niewielkie instalacje przemysłowe.

To także wersje czasowe, nadzorcze, wykrywające brak fazy, włączające oświetlenie na noc itp. Są to takie rozwiązania klasy "małej automatyki". Świetnie sprawdzają się wszędzie tam, gdzie potrzebna jest realizacja prostych funkcji automatyki – przede wszystkim w systemach z ograniczoną liczbą wejść/wyjść oraz brakiem konieczności działania w sieci. Takie przekaźniki zawierają często zasoby, takie jak timery, liczniki, zegar czasu rzeczywistego, komparatory oraz potencjometr. Ograniczona funkcjonalność przełączników programowalnych z jednej strony jest ich zaletą – pozwala zredukować koszt tych urządzeń, z drugiej zaś stanowi pewną wadę – systemy oparte o tego typu urządzenia nie są zbyt otwarte na możliwości dalszej potencjalnej rozbudowy.

Mniejszy pobór mocy przez cewkę to już standard

Miarą postępu technicznego w przekaźnikach jest też coraz mniejszy pobór mocy przez cewkę elektromagnesu. Jest to stały trend, dotykający coraz szerszej grupy produktów, który wiąże się nie tylko z efektywnością energetyczną urządzeń, ale także jakością i trwałością i kluczowymi parametrami, takimi jak zakres temperatur pracy. Niski pobór mocy przez elektromagnes to wynik użycia zaawansowanych materiałów konstrukcyjnych oraz dopracowania konstrukcji mechanicznej. Mniejsza siła elektromagnesu będzie wystarczająca, gdy tor magnetyczny będzie miał jak najmniejszą szczelinę na dźwigni, a styki nie będą wymagać silnego docisku. Przykładem może być zastąpienie docisku sprężynowych styków za pomocą dźwigni (kotwicy) mechanizmem suwakowym, minimalizacja zakresu ruchu kotwicy, większa precyzja wykonania (mniejsze tolerancje wymiarowe) i podobne.

==========

Zamienniki komponentów elektronicznych

Dostępność pojedynczego elementu elektronicznego może zadecydować o sukcesie lub porażce projektu. Jeżeli jest on niezbędny, ale jest zbyt drogi w stosunku do założonego budżetu, długi czas oczekiwania na jego dostawę jest nie do zaakceptowania albo wycofano go ze sprzedaży, bo nie opłaca się go produkować lub nie ma już takiej technicznej możliwości, trzeba znaleźć zamiennik.

Łańcuchy dostaw w branży elektronicznej cechuje ciągła zmienność. Zapasy podzespołów stale się wahają, na co wpływa wiele czynników. Zaczyna ich brakować, na przykład jeżeli ich status ulega zmianie na "przestarzały" (obsolete). Oznacza to, że nie są już produkowane. Gdy komponent staje się przestarzały, stanowi to wyzwanie dla producentów urządzeń, których jest częścią, szczególnie jeżeli ma on krytyczne znaczenie dla ich funkcjonalności.

Przestarzałość elementu prowadzi do opóźnień i kosztów spowodowanych szukaniem zamienników i, jeżeli jest to konieczne, przeprojektowaniem urządzenia w celu dostosowania go do dostępnych części. Według firmy Flip Electronics, która zajmuje się dystrybucją podzespołów elektronicznych, koszt przeprojektowania urządzenia z powodu przestarzałości jego elementów może się wahać od kilkudziesięciu tysięcy do nawet kilku milionów dolarów.

Rezerwy na przestarzałość

Zwykle zmiany, których wprowadzenia wymaga zastąpienie wycofanych z rynku komponentów pasywnych, takich jak diody, są tańsze, ale wymiana mikroprocesora albo mikrokontrolera może znacząco zwiększyć koszty przeprojektowania. W związku z tym dobrą praktyką jest rezerwowanie jakiejś części budżetu projektu na zarządzanie ryzykiem przestarzałości. Przykładowo w przypadku producentów części lotniczych jest to średnio aż 10%, jak szacuje CALCE (Center for Advanced Life Cycle Engineering) na Uniwersytecie Maryland.

Kosztowne jest jednak również desperackie trzymanie się przestarzałych komponentów. Okazuje się bowiem, że ceny podzespołów elektronicznych, których produkcji już zaprzestano, ale można je jeszcze kupić, gdyż zostały "zachomikowane" przez dystrybutorów lub firmy, które specjalizują się w skupywaniu zawczasu takich zagrożonych wycofaniem elementów, są nawet kilkanaście razy wyższe. Przykładowo układy scalone, które można było kupić za 3 dol. za sztukę wtedy, kiedy były łatwo dostępne, po wycofaniu z produkcji kosztować mogą nawet 40 dol. za sztukę.

Powody wycofania z rynku

Status podzespołów może zostać zmieniony na przestarzały z kilku powodów. Producenci decydują się na wycofanie ich z rynku z powodu niskiego popytu i/albo rosnących kosztów materiałów i/lub technologii. W obu przypadkach ich produkcja przestaje być opłacalna.

Według raportu Obsolescence Trends in 2024 opracowanego przez Z2Data przeszło trzy czwarte wszystkich zmian statusu komponentów na przestarzały było skutkiem niskiego popytu na nie. To znaczny odsetek, który świadczy o tym, że to producenci OEM i inni klienci, a nie sami producenci podzespołów elektronicznych tak naprawdę napędzają ich starzenie się.

Jest ono też skutkiem postępu. Wraz z rozwojem technologii opracowywane są nowe komponenty, lepsze pod względem parametrów i/lub funkcjonalności niż te starsze.

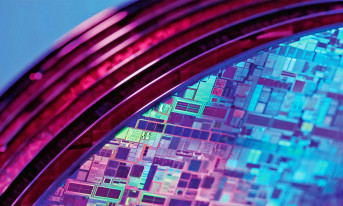

O zawrotnej szybkości postępu przypomina prawo Moore’a, zgodnie z którym liczba tranzystorów w układach scalonych podwaja się co dwa lata. Chociaż kwestionuje się, czy ta zależność wciąż obowiązuje, nie ulega wątpliwości, że technologia produkcji półprzewodników nie zwalnia tempa, o czym świadczy sukcesywnie malejący wymiar charakterystyczny, z 7 nm w 2018 roku do 2 nm w 2024.

Poza tym produkcja komponentu elektronicznego ma sens tylko wówczas, gdy produkty, w których jest używany, również są nadal w sprzedaży. Tymczasem, w reakcji na nasilającą się konkurencją i rosnące oczekiwania klientów, producenci urządzeń docelowych wprowadzają na rynek ich kolejne generacje z rosnącą częstością. Dotyczy to głównie elektroniki użytkowej, smartfonów, laptopów i konsol do gier wideo, jak również samochodów i urządzeń gospodarstwa domowego. Przykładowo Apple ogłasza nową generację iPhone’a każdego roku, a producenci samochodów wprowadzają na rynek gruntowne przeróbki modeli aut średnio co pięć lat, a nawet w jeszcze krótszych odstępach czasu. W miarę jak nowe urządzenia zastępują swoich poprzedników, wiele ich części również staje się przestarzałych.

Konkurencja i przepisy

Oprócz tego, jeżeli komponent, który jest bardzo popularny jest w sprzedaży wystarczająco długo, często konkurencyjni producenci wprowadzają na rynek jego zamiennik, sprzedając go w niższej cenie. Pozwala im na to na przykład przeniesienie zakładu produkcyjnego do tańszej lokalizacji. Dzięki temu uzyskują udział w rynku elementu osiągającego dobre wyniki sprzedaży. Skutkiem ubocznym tego jest spadek popytu na część będącą pierwowzorem, co ostatecznie prowadzi do jej wycofania z rynku.

Kolejnym czynnikiem są zmiany w przepisach. Można to było zaobserwować już wielokrotnie. Znaczący wzrost liczby komponentów wycofanych z rynku odnotowano na przykład, kiedy w 2006 roku weszła w życie dyrektywa Unii Europejskiej w sprawie ograniczenia stosowania substancji niebezpiecznych (RoHS), która ograniczyła stosowanie w elementach elektronicznych materiałów takich jak ołów, rtęć oraz kadm. Podobny skutek miało wprowadzenie unijnego rozporządzenia w sprawie rejestracji, oceny, udzielania zezwoleń i ograniczeń w zakresie chemikaliów (REACH) w 2010 roku. Można się spodziewać utrzymania tego trendu, w miarę jak przepisy będą zaostrzane.

Częstym powodem są zakłócenia w łańcuchu dostaw spowodowane klęskami żywiołowymi, takimi jak trzęsienie ziemi w Noto w Japonii w 2024 roku i sytuacją geopolityczną, która skutkuje na przykład ograniczeniami w handlu technologiami między USA a Chinami.

Według raportu Obsolescence Trends in 2024 firmy Z2Data w 2022 roku status na przestarzały zmieniono dla prawie 750 tys. części elektronicznych. W 2023 roku było ich mniej, bo ponad 328 tys., ale w zeszłym roku znów odnotowano wzrost liczby komponentów wycofanych ze sprzedaży, do ponad 470 tys. części. Generalnie zatem średnio rocznie za przestarzałe uznaje się setki tysięcy elementów, dla których trzeba znaleźć zamienniki, jeśli w projektach są wciąż niezbędne.

Rodzaje zamienników

W założeniu jest to proste – wystarczy wyszukać komponent w zastępstwie. W praktyce jednak nie zawsze jest to łatwe. Przede wszystkim należy na wstępie zdecydować, jakiego rodzaju zamiennika szukamy. Generalnie wyróżnia się trzy ich typy: komponenty równoważne, elementy alternatywne oraz zamienniki typu drop-in. Te ostatnie są wariantami wycofanego elementu, o takich samych parametrach elektrycznych, obudowie, wyprowadzeniach, co pierwowzór.

Za równoważny uznawany jest komponent o identycznych albo prawie takich samych parametrach elektrycznych, jak poszukiwany element. Może to być wariant oryginalnego podzespołu od tego samego producenta, ale o innej nazwie katalogowej, może mieć inną obudowę lub dodatkowe albo zmienione (ulepszone) funkcje.

Komponent alternatywny nie ma takich samych parametrów elektrycznych, wymiarów ani funkcji jak poszukiwany element, ale może zostać skonfigurowany tak, żeby realizował wymagane zadania w projekcie w jego zastępstwie. Jest to zatem część zamienna o innych parametrach i/albo funkcjach, która jednak pozwala zrealizować zakładaną funkcjonalność.

Zwykle, jeżeli chodzi o elementy pasywne, można znaleźć zamiennik drop-in od innego producenta lub komponent równoważny w innej obudowie. Jeśli się to jednak nie uda, zazwyczaj łączy się wiele podzespołów szeregowo lub równolegle, by uzyskać wymaganą wartość docelową. Tranzystory to z kolei przeważnie komponenty na tyle powszechne, że łatwo można znaleźć elementy równoważne w innej obudowie albo komponenty alternatywne, o lepszych parametrach elektrycznych w takiej samej obudowie. Elementy półprzewodnikowe, jak diody, również są dość popularne i występują w standardowych obudowach w ofercie wielu producentów.