Predykcyjne podejście w przemyśle, polega na ciągłym monitorowaniu stanu maszyn i urządzeń w czasie rzeczywistym oraz przewidywaniu potencjalnych awarii zanim one faktycznie wystąpią. W przeciwieństwie do klasycznego serwisowania opartego na stałych harmonogramach albo reakcji dopiero po usterce, tutaj wykorzystuje się dane z oraz algorytmy analityczne i modele AI do wykrywania anomalii i trendów zużycia.

Samo utrzymanie predykcyjne od lat stanowi pole testowe dla analityki przemysłowej. Obecnie zmiana polega przede wszystkim na przesuwaniu obliczeń bliżej źródła danych – do sterowników, bramek sieciowych oraz inteligentnych czujników – zamiast centralnych systemów analitycznych. Takie podejście pozwala ograniczyć opóźnienia, zmniejszyć ruch sieciowy i przyspieszyć reakcję systemów. Jednocześnie ujawnia fundamentalne różnice w tym, jak poszczególne segmenty rynku definiują rolę inteligencji w przemyśle. Z jednej strony stoją dostawcy automatyki przemysłowej, dla których kluczowe znaczenie mają niezawodność, przewidywalność i przede wszystkim realia starszych instalacji produkcyjnych. Z drugiej – firmy półprzewodnikowe i dostawcy rozwiązań obliczeń krawędziowych, którzy zakładają, że rozproszona architektura AI i akceleracja obliczeń w heterogenicznych układach staną się standardem. Napięcie między tymi podejściami zaczyna kształtować więc cały rynek.

Utrzymanie ruchu to zadanie operacyjne

Dla firm głęboko zakorzenionych w automatyce przemysłowej predykcyjne utrzymanie ruchu pozostaje przede wszystkim problemem operacyjnym, a nie demonstracją technologii. Samo wdrożenie AI na hali produkcyjnej nie ma dla nich żadnej wartości. Wartość prezentuje dopiero realne wykorzystanie AI przekładające się na rozwiązanie realnego i istotnego problemu. Właśnie tak wygląda podejście większości zakładów produkcyjnych, gdzie priorytetem są dostępność linii, bezpieczeństwo i stabilność procesu, a nie architektoniczna elegancja systemu. Choć możliwości Edge AI szybko rosną, wiele fabryk nadal znajduje się na wczesnym etapie wdrażania rozwiązań predykcyjnych opartych o sztuczną inteligencję. Koszty znacząco przewyższają potencjalne zyski.

Co ciekawe, olbrzymim problemem w wdrażaniu krawędziowej sztucznej inteligencji do systemów predykcyjnego utrzymywania ruchu jest brak dokumentacji i rozbudowywanie starych systemów. Większość środowisk przemysłowych to instalacje, w których współistnieją urządzenia różnych producentów i generacji. W wielu miejscach dochodzi też brak wiedzy o pierwotnym projekcie linii. Pracownik odpowiedzialny za ich pierwotny koncept bardzo często jest już na emeryturze czy pracuje w innym miejscu. A brak takiego kontekstu znacząco utrudnia budowę skutecznych modeli predykcyjnych.

Dane telemetryczne muszą być interpretowane z uwzględnieniem intencji procesu, zachowania maszyn i zmienności produkcji, których nie da się bezpośrednio odczytać z surowych pomiarów. W praktyce oznacza to wysoki poziom indywidualizacji wdrożeń. Mimo inwestycji w narzędzia MLOps i uniwersalne frameworki modeli, systemy predykcyjne nadal wymagają dostrajania do konkretnej instalacji. To jeden z głównych czynników ograniczających skalowanie rozwiązań. Koszty stają się wtedy zbyt wysokie, aby uzasadnić inwestycję, którą wielu producentów uzna za ekstrawagancką. Nadal dominują więc klasyczne sygnały diagnostyczne, takie jak drgania, prąd czy temperatura. Nowe metody są rozwijane, ale to właśnie te podstawowe dane wciąż dostarczają najbardziej stabilnych wyników w wielu zastosowaniach.

Predykcyjne utrzymanie ruchu w dobie AI

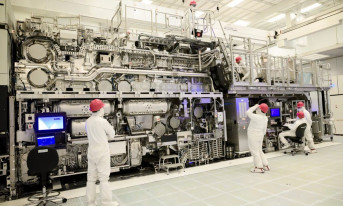

Dla firm projektujących układy edge computing perspektywa jest zupełnie inna. Kluczowe jest umożliwienie rozproszonej analizy danych i uruchamiania AI bezpośrednio na urządzeniach końcowych. W praktyce oznacza to łączenie CPU, DSP, NPU i wyspecjalizowanych akceleratorów w jednym układzie SoC. Często oznacza to pracę w systemach bez wentylacji, przy poborze mocy liczonym w pojedynczych watach. Tylko implementacja i rozwój są bardzo trudne. Ograniczeniem pozostaje dostęp do danych treningowych, ich jakość oraz konieczność dostosowania modeli do konkretnej instalacji. Dodatkową złożoność wprowadzają aktualizacje modeli oraz zarządzanie flotą urządzeń w rozproszonym środowisku.

Mimo różnych punktów wyjścia, obie strony rynku – automatyka i półprzewodniki – zaczynają dochodzić do podobnych wniosków. Predykcyjne utrzymanie ruchu nie będzie działało w jednym, centralnym miejscu. Architektura systemów będzie coraz bardziej rozproszona, obejmując czujniki, sterowniki, bramki oraz serwery edge. Ostatecznie pozostają jednak dwa kluczowe pytania: jak szybko przemysł będzie gotowy przekazać większą część decyzji systemom AI oraz czy dostawcom uda się ograniczyć poziom personalizacji, który dziś blokuje skalowanie rozwiązań.

Technologie sprzętowe dojrzewają, modele AI stają się bardziej efektywne, a platformy edge coraz bardziej zaawansowane. Jednak wdrożenia nadal ograniczają realia istniejącej infrastruktury, kwestie zaufania oraz integracja systemowa. Dopóki te elementy nie zostaną wyrównane, obserwowane dziś podziały architektoniczne będą się utrzymywać, a tempo przejścia od pilotaży do pełnoskalowej produkcji pozostanie ograniczone przez czynniki organizacyjne i systemowe, nie technologiczne.