Zarządzanie ciepłem w elektronice

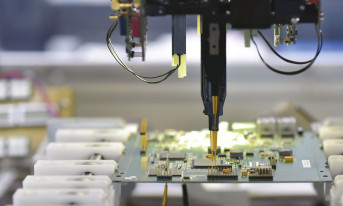

Płytka drukowana staje się radiatorem

Przy małej mocy wydzielanej do rozproszenia ciepła często wystarcza folia miedziana na płytce drukowanej. Takie chłodzenie popularyzuje się na skutek coraz lepszej dostępności i niższych cen obwodów wielowarstwowych. W ramach płytki dwustronnej na radiator tego typu można było sobie pozwolić w mało skomplikowanych układach, gdzie mozaika ścieżek była prosta i zostawało wiele pustego miejsca. To rzadki przypadek. W obwodach wielowarstwowych można wszystkie połączenia ukryć na warstwach wewnętrznych, a na dużej części zewnętrznych warstw wydzielić obszary chłodzące. Dodatkowo płytkę można połączyć termicznie z obudową mostkiem z użyciem pianki termoprzewodzącej lub zalać całość układu zalewą o takich właściwościach. W przypadku, gdy ciepła jest więcej, można też próbować sięgnąć po laminaty z grubą warstwą miedzi lub z rdzeniem metalowym (MPCB), jak w modułach LED-owych. Takie podejście jest coraz popularniejsze.

Chłodzenie całości urządzenia

Przy rozważaniach układów chłodzenia zwykle myślimy o półprzewodnikach, którym konstruktor stara się ograniczyć przyrost temperatury. Niemniej wraz z ekspansją rozwiązań impulsowych coraz częściej problem chłodzenia przestaje mieć charakter punktowy, a więc skupiony na kilku elementach mocy.

Faktem jest, że rozwój technologii półprzewodnikowej jest dzisiaj bardzo dynamiczny, a nowe wersje komponentów zapewniają znacznie większą sprawność i nie grzeją się tak bardzo, aby stanowiły w urządzeniach jeden gorący, centralny punkt. Nowe tranzystory mocy z azotku galu lub węglika krzemu nie tylko zapewniają małe straty podczas komutacji i przewodzenia, ale także mogą pracować w wyższej temperaturze niż krzemowe odpowiedniki, więc nie trzeba ich tak efektywnie chłodzić. Co więcej, elementów grzejących się jest znacznie więcej niż dawniej. Miejsce jednego, dwóch tranzystorów zajęły dzisiaj obwody, w których stopień mocy zawiera nawet kilkanaście tranzystorów. Co więcej, elementy często łączy się równolegle dla zwiększenia obciążalności. Tak jest w falownikach, napędach silników, układach BMS akumulatorów i wielu innych miejscach.

Efekt jest taki, że ciepło wydzielane jest bardziej równomiernie. Do tego grzeją się elementy indukcyjne, a więc transformatory i dławiki, kondensatory w filtrach wyjściowych, a także szybkie układy cyfrowe. Elementy są ciasno upakowane na płytkach drukowanych i każde miejsce na laminacie jest zagospodarowane. W ten sposób te cieplejsze komponenty podgrzewają całą resztę i tym samym chłodzenie przestaje być domeną podzespołów mocy – raczej nagrzewa się cała płytka. W takim przypadku trzeba zmienić podejście do chłodzenia, np. całą płytkę przykleić do radiatora lub ścianki obudowy za pomocą materiału termoprzewodzącego.

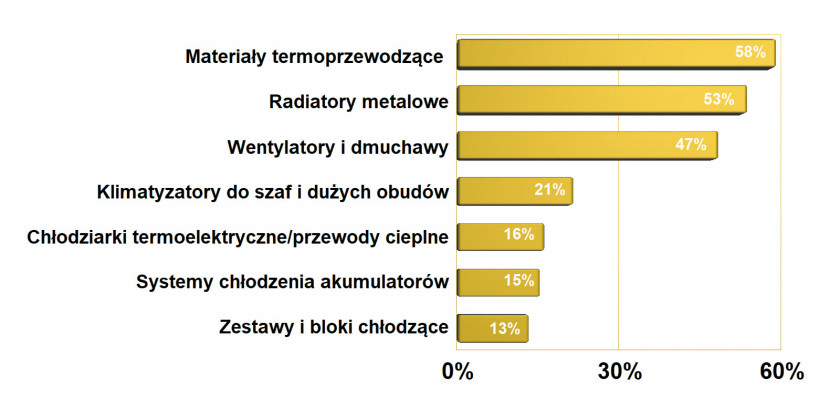

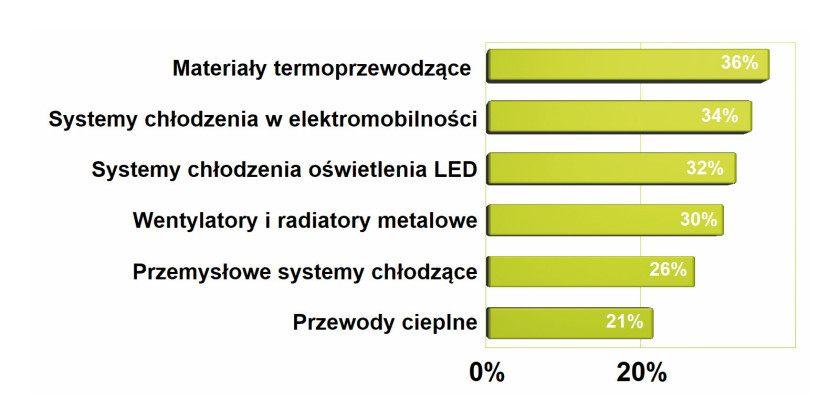

Wygoda i nieduże koszty powodują, że w ostatnich latach rynek materiałów termoprzewodzących szybko się rozwija. W tym obszarze pojawia się sporo nowości i rośnie też liczba dostawców, co sprzyja obniżkom cen oraz lepszej dostępności produktów. Poprawiają się też parametry związane z transmisją ciepła tych produktów, które są kluczowe w tym obszarze zastosowań, gdyż decydują o wydajności chłodzenia.

Materiały termoprzewodzące

Materiały termoprzewodzące to ogólnego przeznaczenia pasty o różnej rezystancji termicznej, a także wypełniacze szczelin, zalewy i żele, które różnią się pomiędzy sobą gęstością, sposobem aplikacji i także zastosowaniem. Są też materiały PCM z przemianą fazową, które mają lepsze właściwości cieplne w porównaniu do równoważnych rozwiązań tradycyjnych. Poza materiałami bezpostaciowymi są oczywiście jeszcze folie i gotowe podkładki tego typu, także grube, ale elastyczne i przypominające gąbkę wypełniacze szczelin (gap filler). Ważnym atutem taśm i folii termoprzewodzących jest to, że zapewniają potrzebną izolację galwaniczną, co pomaga w zapewnieniu bezpieczeństwa użytkowania.

Pojawiające się na rynku nowe opracowania taśm i folii termoprzewodzących, klejów, past i podkładek charakteryzują się coraz większym przewodnictwem ciepła. Jest to bardzo ważny proces, gdyż ułatwia integrację elektroniki mocy. Zmagający się z ciepłem konstruktorzy niechętnie sięgali po folie termoprzewodzące lub kleje, gdyż były one mało efektywne i nie sprawdzały się, gdy ciepła trzeba było odprowadzić dużo. To już przeszłość.

Chłodzenie cieczą

Chłodzenie wodne elektroniki w zakresie aplikacji dużych mocy jest znanym od lat sposobem chłodzenia i odprowadzania ciepła. Transformatory zanurzone w oleju, półprzewodniki mocy zamontowane na radiatorze z kanałami, przez które przepływa ciecz, to rozwiązanie wydajne, ciche i bardzo trwałe. Pozwala odprowadzić dużą ilość ciepła na dużą odległość i zapewnić stabilne warunki pracy urządzenia nawet w bardzo trudnych warunkach środowiskowych. Systemy chłodzenia wodnego są w stanie zapewnić także niezbędny kompromis po stronie kosztów rozwiązania i masy systemu chłodzącego w systemach, gdzie ilość wydzielanego ciepła jest duża. Część odbierająca ciepło wewnątrz obudowy jest niewielka, nie zajmuje więc cennego miejsca i nie ogranicza cyrkulacji powietrza.

Pomijając zastosowania dużej mocy, cała reszta związana z chłodzeniem cieczą to aplikacje niszowe i specjalistyczne, np. używane w sprzęcie medycznym, farmach serwerów i w sprzęcie telekomunikacyjnym. Gdy skala instalacji jest duża, takie rozwiązanie jest nierzadko korzystne od strony ekonomicznej, ponieważ pozwala na odbieranie ciepła od wielu elementów za pomocą jednej instalacji, która oplata wszystkie gorące punkty.

Wadą takiego chłodzenia jest skomplikowanie i duże wymiary całości, gdyż składa się ono z pompy, przewodów transportujących ciecz, chłodnicy i radiatora odbierającego ciepło. Kłopotliwe jest też napełnianie, a więc obsługa techniczna oraz serwis. Niemniej w sytuacji, gdy konieczne jest zapewnienie wydajnego chłodzenia w systemie zamkniętym, wewnątrz szczelnie zamkniętych szaf, takie rozwiązania pozwalają na zachowanie wysokiego stopnia ochrony środowiskowej tych ostatnich, są one najczęściej jedynym dostępnym wyborem.

Elektromobilność a chłodzenie cieczą

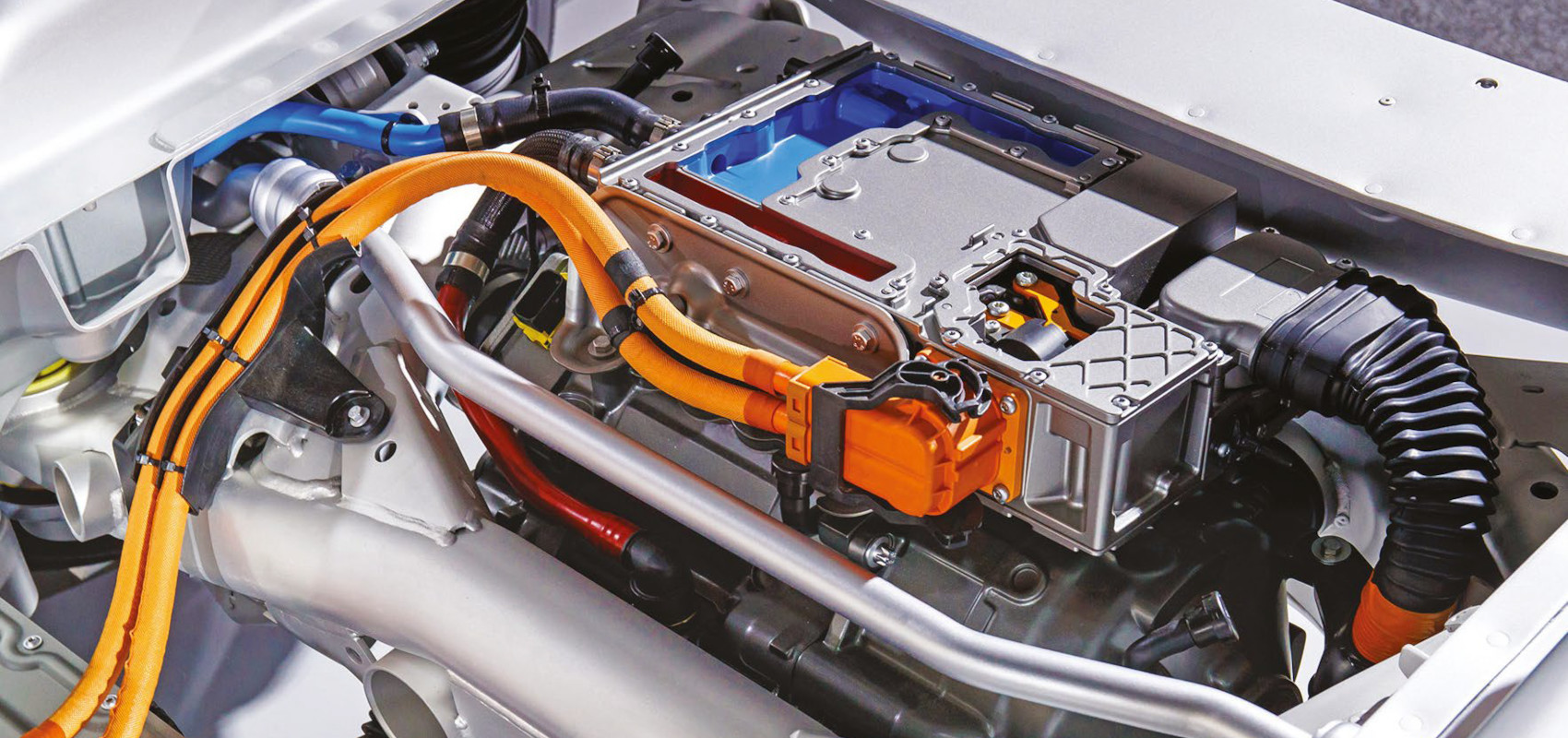

Bardzo możliwe, że nowym obszarem aplikacyjnym dla chłodzenia cieczą stanie się elektromobilność. Baterie akumulatorów montowane w pojazdach o napędzie elektrycznym wymagają dobrego chłodzenia. Ciasno upakowane ogniwa oraz duże prądy płynące w takich obwodach powodują wydzielanie ciepła, które trzeba odprowadzić. Ogniwa grzeją się podczas pracy i ładowania i to znacznie, a z punktu widzenia użytkowego bateria takich ogniw nie może być duża, gdyż nie dałoby się jej zintegrować w pojeździe.

Znalezienie kompromisu dla małej objętości, dużej wydajności prądowej zapewniającej nie tylko dynamikę samochodu, ale także możliwość szybkiego ładowania, a także dużej pojemności akumulatora, przekładającej się na zasięg, wymusza często chłodzenie cieczą. Nie bez znaczenia jest też konieczność zapewnienia bezpieczeństwa elektrycznego oraz w zakresie niekontrolowanego (lawinowego) wzrostu temperatury. Ogniwa litowe trzeba chłodzić, gdyż inaczej mogą się zapalić, z kolei w niskich temperaturach trzeba je podgrzewać, gdyż wówczas dostępna pojemność znacznie się zmniejsza.

W samochodach hybrydowych chłodzenie udaje się zrobić za pomocą strumienia powietrza i wentylatorów, gdyż bateria jest mniejsza, a gdyby się za bardzo nagrzała, to zawsze można ją odłączyć i używać wyłącznie silnika spalinowego. Chłodzenie w samochodach elektrycznych baterii ogniw coraz częściej polega na zalaniu całości układu płynem freonowym. Z jednej strony umożliwia on sprawne odprowadzanie ciepła, z drugiej zapewnia dobrą izolację elektryczną. Jest to chyba najnowsza odsłona systemów chłodzenia cieczą.

Chłodziarki termoelektryczne i przewody cieplne

Gdy konieczne jest schłodzenie małego elementu poniżej temperatury otoczenia takiego jak detektor półprzewodnikowy, a do tego ciepła nie wydziela się dużo, rozwiązaniem jest chłodziarka termoelektryczna. Nie zapewnia ona dużej wydajności transportu energii cieplnej i pobiera dużą moc zasilającą, ale nie ma ruchomych części mechanicznych i pozwala obniżyć temperaturę elementu poniżej temperatury otoczenia. To jej główna zaleta.

Kolejnym niszowym elementem do odprowadzania ciepła są przewody cieplne (heatpipe), czyli miedziane rurki wypełnione porowatym materiałem i zalane cieczą, i niskiej temperaturze wrzenia. Jest to doskonale znane rozwiązanie z laptopów, w których odbierają one ciepło od procesora i przenoszą do oddalonego wymiennika.

Wadą rurek jest ograniczona skuteczność do wąskiego zakresu temperaturowego narzucanego przez parametry cieczy znajdującej się wewnątrz miedzianej rurki oraz stosunkowo niską wydajność transmisji ciepła. Kolejna wada polega na tym, że sens ich użycia jest wówczas, gdy mamy w aplikacji jeden gorący element oddalony od ściany obudowy lub innego miejsca, które może zapewnić wymianę ciepła z otoczeniem.

Na plus należy zapisać, że oferta rynku i dostępność takich produktów poprawiła się, w ostatnich latach, a ponieważ w urządzeniach elektronicznych ciepła do odprowadzenia jest coraz mniej, nawet przy ograniczonych możliwościach jego transportu przez przewody cieplne, udaje się zapewnić skuteczność działania.

Wentylatory stosujemy z niechęcią

Wentylatory stają się produktem, od którego się stopniowo odchodzi z uwagi na ich ograniczoną trwałość, generowany hałas oraz trudność zapewnienia odporności środowiskowej. Często ciepło udaje się rozproszyć za pomocą konwekcji i przewodzenia i nie ma potrzeby sięgania po takie rozwiązania mechaniczne. Czasem wentylator jest, ale w normalnych warunkach pracy nie jest on aktywny i uruchamia się go dopiero przy dużym obciążeniu lub też przy wysokiej temperaturze otoczenia. Te procesy dotyczą urządzeń konsumenckich oraz małych aplikacji przemysłowych. Rozwiązania przemysłowe, energoelektronika, IT, medycyna nie mogą się bez nich obejść, ale stawiają tym produktom coraz większe wymagania. Stąd w ofertach dostawców tanie wentylatory zastąpiły wersje o dużej trwałości, odporne na kurz i mgłę olejową, których łopatki są wyważone, a działanie ciche. Na rynku są dostępne wersje z czasem życia powyżej 150 tys. h, zakresem temperatur pracy od –20 do +85°C. Regulacja obrotów za pomocą PWM, kontrola wirowania za pomocą czujnika obrotów też jest standardem, bo pozwala na sygnalizację awarii, czyli w praktyce zatarcia łożyska.

Zasadnicza część rynku wentylatorów to jednostki o wymiarach od 25×25 mm do 120×120 mm o kilku różnych grubościach, a więc też wydajności rozumianej jako przepływ powietrza. W ramach jednego wymiaru można jeszcze wybierać ułożyskowanie oraz napięcie zasilania. Są też wentylatory okrągłe i dmuchawy, co razem daje grubo minimum kilkadziesiąt dostępnych wersji. Mniejsze wentylatory, tj. do 20×20 mm, wykorzystywane są do chłodzenia elementów optycznych (kamer, czujników promieniowania podczerwonego), jednostki większe niż 120×120 mm, w tym rozwiązania zasilane napięciem sieci, to z kolei domena aplikacji przemysłowych. Są one montowane w szafach jako centralny element wymiany ciepła dla całego zainstalowanego systemu.

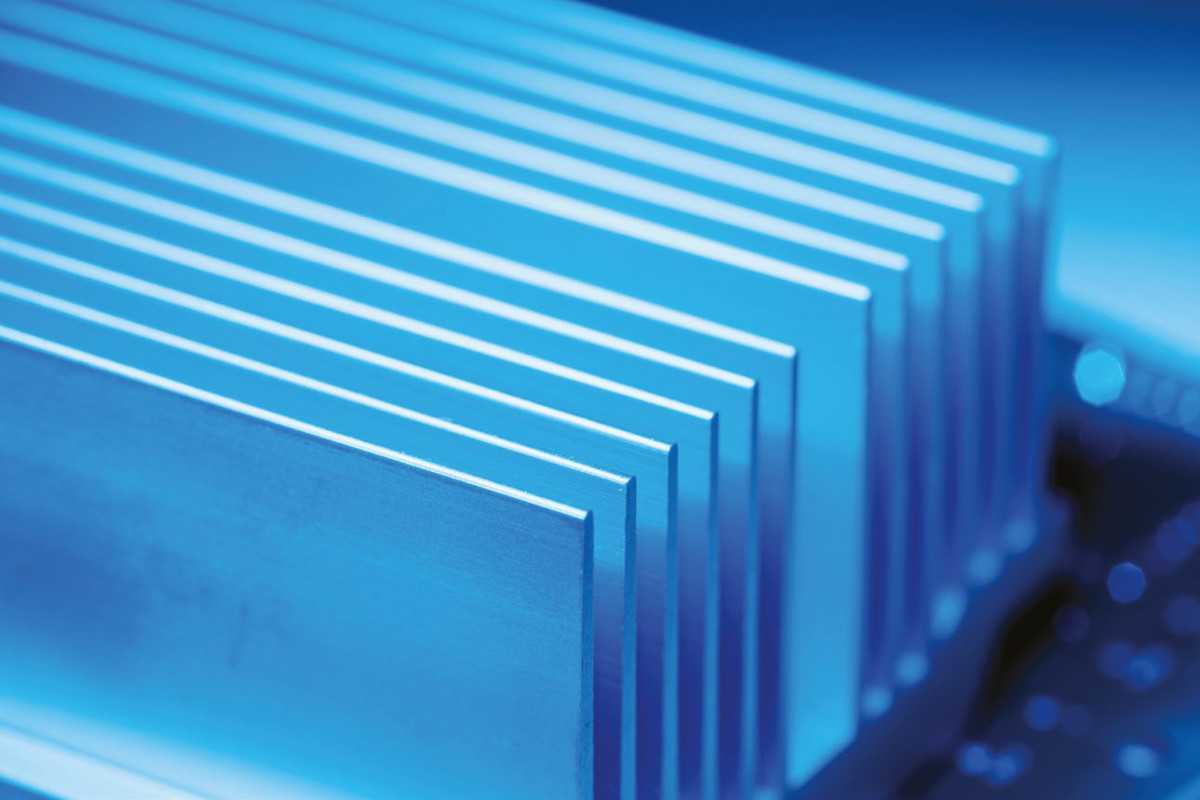

Radiatory są coraz mniejsze

Radiatory to produkt dojrzały technologicznie i doskonale znany. W przeważającej części są one wykonywane z aluminiowych profili, często czernionych galwanicznie dla wzmocnienia transportu ciepła przez emisję promieniowania. Wysokie ceny metali wyeliminowały miedź z tych produktów i obecnie radiatory są praktycznie wyłącznie wykonywane z aluminium. W ostatnich miesiącach były poważne problemy z dostępnością i jeszcze silniej rosnącymi cenami. Po ponad dwukrotnych podwyżkach cen tych sytuacja ustabilizowała się, zapewniając przewidywalność biznesu w okresie kilku tygodni, co nie zmienia tego, że produkty te stały się bardzo drogie.

Radiatory, podobnie jak wiele innych podzespołów elektronicznych, występują na rynku w bardzo wielu typach i rozmiarach, co sprawia szereg trudności w utrzymaniu przez dostawców stanów magazynowych dla całości oferty. W wielu przypadkach istotne są nawet drobne różnice w kształcie użebrowania, które pozwalają na modyfikację rezystancji termicznej w zależności od typu chłodzenia wymuszonego lub konwekcyjnego. Taka ograniczona dostępność, przekładająca się na długie czasy dostaw niektórych profilów oznacza najczęściej, że projektanci muszą z konieczności używać radiatorów, które są dostępne zamiast wybranych modeli.

Mimo że w przypadku radiatorów trudno mówić o dużej komplikacji technicznej produktu lub też o wysokim potencjale technologicznym, to jednak są to elementy przez cały czas rozwijane przez producentów i dopasowywane do potrzeb współczesnych aplikacji. Producenci sprzedają obecnie więcej małych radiatorów, które dominują w elektronice powszechnego użytku oraz duże profile przeznaczone do pracy w układach energetycznych dużej mocy.

Komponenty indukcyjne

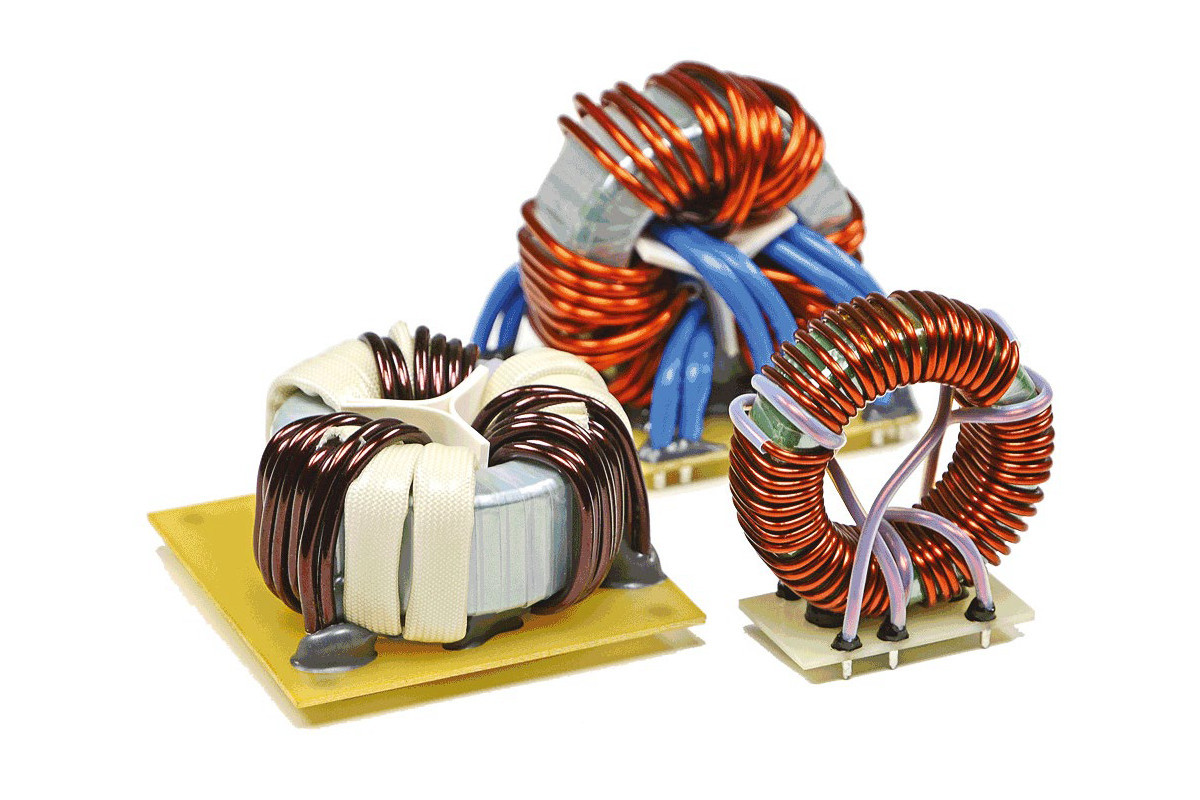

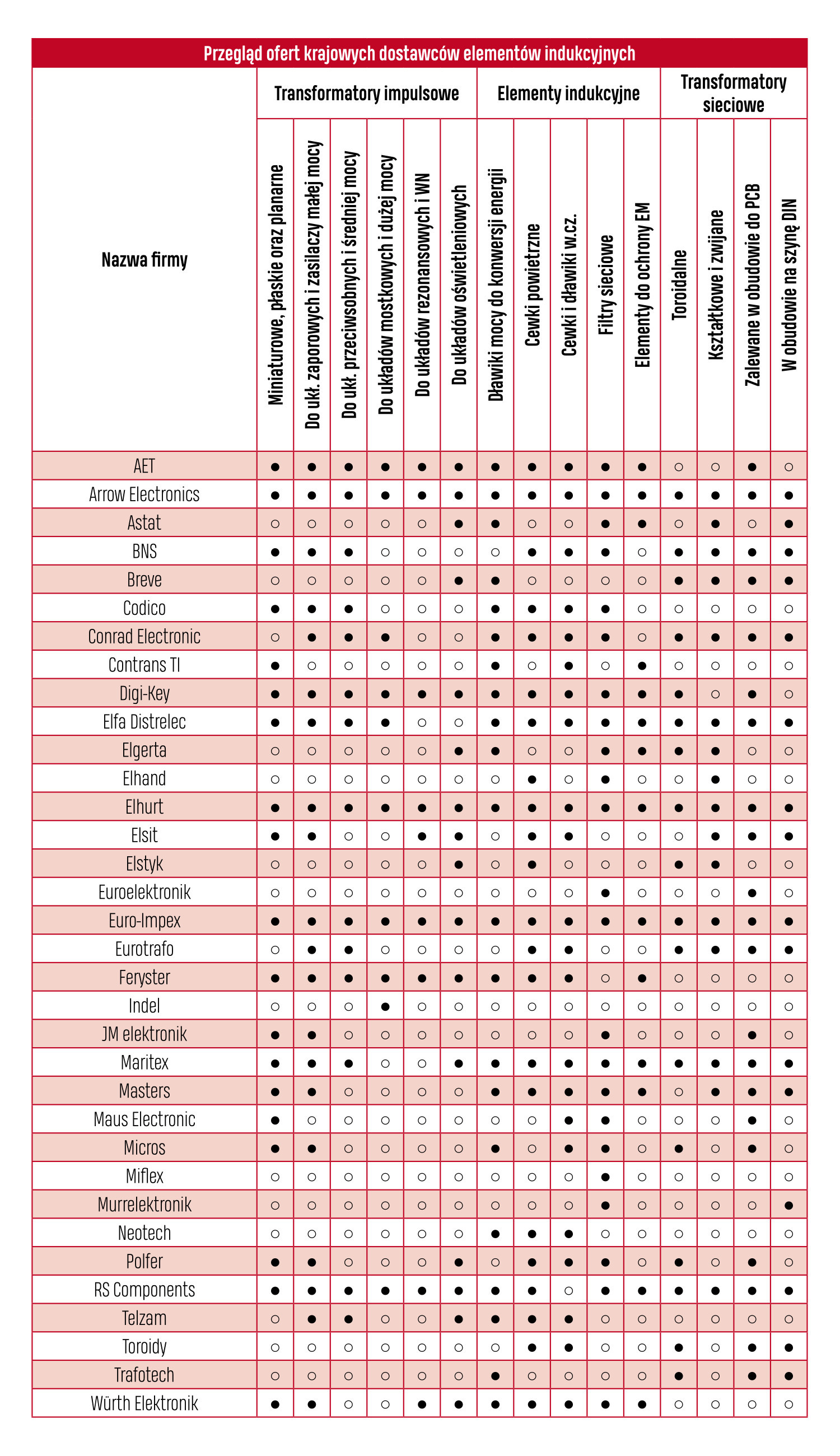

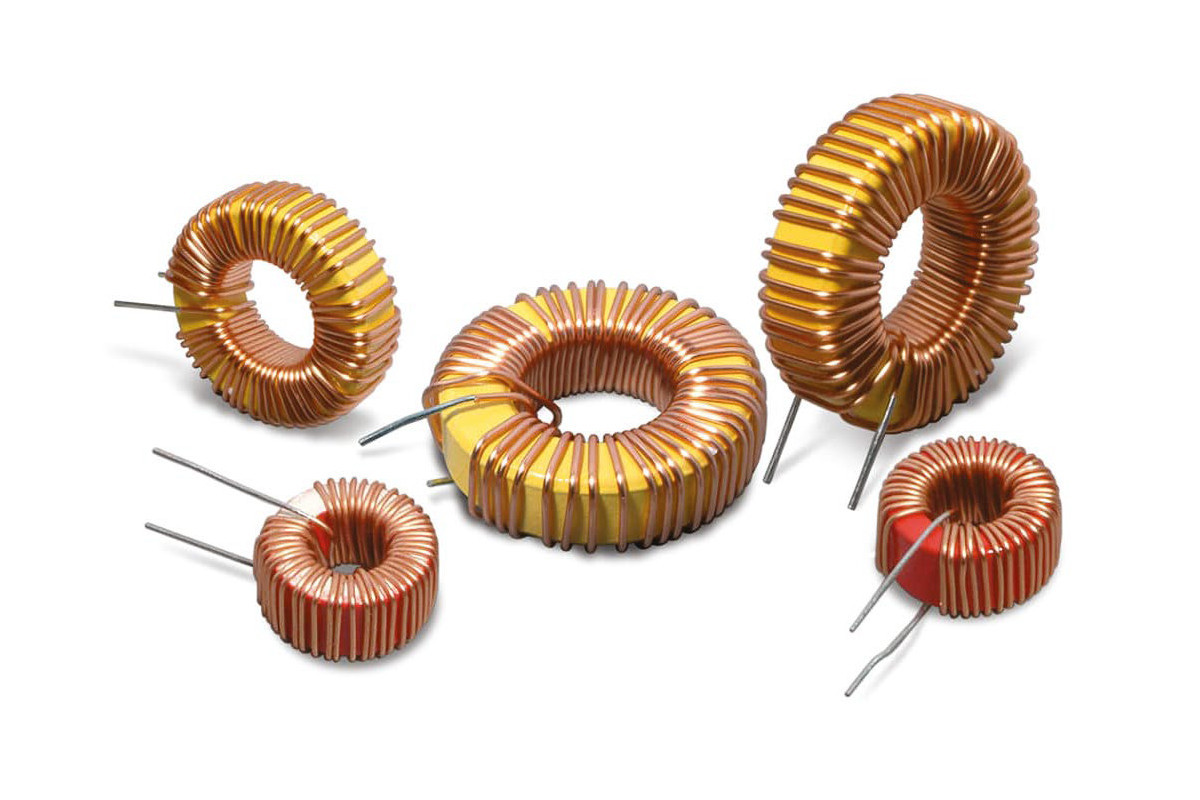

Elementy indukcyjne są kluczowym komponentem w impulsowych układach konwersji energii elektrycznej, niezbędnym składnikiem filtrów i systemów ochrony przed zakłóceniami, a także tym, co zapewnia użytkownikom sprzętu elektronicznego bezpieczeństwo oraz ochronę przed porażeniem. Komponenty te decydują o sprawności zasilaczy, wielkości, wadze urządzeń, wydajności i ogólnie pojętej jakości. Są one kluczowym podzespołem dla rynku zasilania, elektroniki przenośnej, oświetlenia LED-owego.

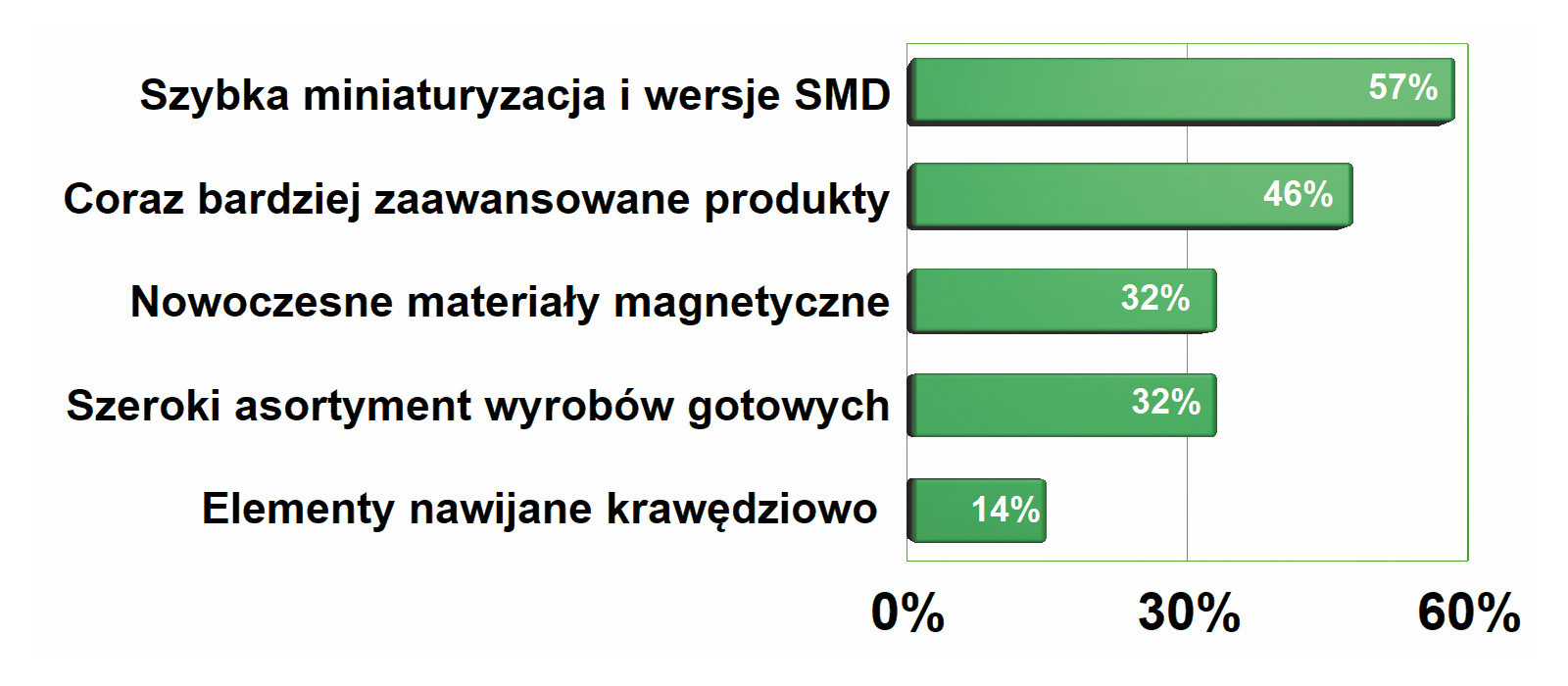

Nowości w zakresie elementów indukcyjnych

Nowości w elementach indukcyjnych są bardzo liczne, ale niestety także mało widoczne. Ogólnie są to innowacje w zakresie materiałów magnetycznych, kształtów rdzeni, a więc pośrednio sposobu wykonania uzwojenia oraz używanych materiałów nawojowych i typów kontaktów elektrycznych. W dalszej kolejności są to zaawansowane materiały izolacyjne, skomplikowane procesy impregnacji oraz montażu takich komponentów.

Nowe materiały magnetyczne zapewniają pracę przy dość dużych częstotliwościach kluczowania, mają małe straty związane z przemagnesowaniem, wysoką indukcję nasycenia i podobne właściwości. Producenci proponują w tym obszarze ferryty z różnych mieszanek tlenków metali, spiekane drobiny czystego metalu o różnym ziarnie składzie i proporcjach. Eksperymenty prowadzone są w wielu kierunkach także w stronę rozwiązań hybrydowych, a więc bazujących na ferrytach łączonych ze sproszkowanym metalem, po to, aby zapewnić dużą indukcję nasycenia, małe straty na histerezie, a także aby uzyskać łagodną charakterystykę zapobiegającą gwałtownemu spadkowi indukcyjności przy zbliżeniu się z wartością prądu do nasycenia. Można też powiedzieć, że celem zmian w nowościach są maksymalizacja energii, jaką można zgromadzić w danej objętości materiału magnetycznego lub uzyskanie najkorzystniejszego stosunku ceny do parametrów.

Kształt materiału magnetycznego, czyli kształtka, decyduje o możliwości nawinięcia uzwojenia o określonej objętości, możliwości integracji w obudowie a także o indukcyjności rozproszenia. W tym obszarze też sporo się dzieje, a liczba ofertowych wariacji na temat kształtów takich jak "R" lub "E" stale się zwiększa.

Druty nawojowe coraz częściej są wielokrotnie izolowane (nawet czterokrotnie), co ułatwia zapewnienie wysokiej jakości izolacji elektrycznej. Dzięki takim drutom większość zasilaczy powszechnego użytku jest dzisiaj wykonana w tzw. II klasie izolacji i nie wymaga uziemiania. Coraz częściej transformatory nawijane są licami oraz także taśmą miedzianą (drutem o przekroju prostokątnym), który pozwala lepiej wypełnić okno nawojowe. Jest to tzw. nawijanie krawędziowe.

Nowe materiały izolacyjne dają możliwość ciasnego upakowania uzwojenia i jednoczesnego zachowania bezpieczeństwa. Są one ważne, bo z roku na rok układy impulsowe pracują przy wyższych napięciach wejściowych.

EMC to kolejny istotny czynnik prorozwojowy dla rynku

Poza miniaturyzacją na rynek elementów indukcyjnych pozytywnie oddziałują zagadnienia związane z kompatybilnością elektromagnetyczną. Spośród wielu innych czynników na ten warto zwrócić uwagę, ponieważ wymagania w zakresie emisji zaburzeń są dzisiaj elementem zapewnienia jakości, a nie bezsensownym i niepotrzebnym wymaganiem, którego spełnienia się unika lub obchodzi. W układach impulsowych panowanie nad emisją jest ważną i niełatwą częścią pracy inżynierskiej i każde rozwiązanie układowe lub komponent, które wyraźnie w tym pomaga jest w tych działaniach cenną pomocą. Widać to między innymi po tym, że konstrukcja omawianych podzespołów staje się zwarta i zabudowana materiałem magnetycznym, a uzwojenia są ukrywane we wnętrzu, bo ogranicza to zaburzenia. Konstrukcje otwarte takie jak dławiki szpulkowe są wypierane przez rozwiązania na rdzeniach toroidalnych, można też powiedzieć, że mamy renesans rdzeni o kształtach podobnych do kubkowych.

Wymagania jakościowe staje się zwiększają

Szybki rozwój rynku elektroniki i to, że rozwiązania na niej bazujące pojawiają się w coraz to nowych obszarach techniki i branżach, prowadzą do wzrostu wymagań jakościowych stawianych przed urządzeniami elektronicznymi, a w konsekwencji przed wszystkimi wchodzącymi w ich skład elementami. Zależność ta wynika też z tego, że sprzęt elektroniczny pełni w naszym życiu coraz bardziej odpowiedzialną rolę, np. jest instalowany w energetyce, telekomunikacji, medycynie, a straty, do jakich dochodzi w przypadku niedostępności usług lub awarii sprzętu w takich obszarach, są coraz wyższe. Dotyczy to także trudnodostępnych miejsc instalacji, w jakich elektronika się pojawia i gdzie nie zawsze ma dobre warunki środowiskowe podczas działania. Przykładem może być oświetlenie ledowe, gdzie wzrost temperatury wywołany kiepską wentylacją w miejscu instalacji jest w stanie zdegradować w krótkim czasie konstrukcję.

W elementach indukcyjnych zagadnienia te są bardzo istotne z kilku powodów. Po pierwsze narażenia mechaniczne, a więc wibracje i udary wywołują naprężenia w uzwojeniach i rdzeniu i prowadzą do pękania, rozklejania rdzeni oraz rozszczelnienia zalew i uszkodzeń na izolacji. Elementy te mają nierzadko dużą masę przez co przeciążenia mechaniczne wynikające z drgań są problemem dla jakości w aspekcie długoterminowym. Podobnie negatywnie na konstrukcję oddziałują zmiany temperatury i wilgotności, które dodatkowo są w stanie pogorszyć z czasem jakość izolacji, niemniej zjawisk fizycznych, które w długiej perspektywie wpływają na jakość elementów, jest więcej. Ich wpływ na jakość zwiększa się też wraz z obciążeniem mocą, bo płynące duże prądy powodują na-grzewanie, wysokie napięcia niszczą izolację na skutek mikrowyładowań oraz wyładowań niezupełnych (koronowych), a wysokie wartości indukcji magnetycznej na skutek efektu magnetostrykcji mogą wywołać przykre dla ucha piski. Takie problemy są codziennością dla producentów podzespołów indukcyjnych, ale coraz większa świadomość projektantów elektroniki pomaga w rozwoju rynku w kierunku długoterminowej jakości, bo wiadomo, co można wymagać i za co się płaci.

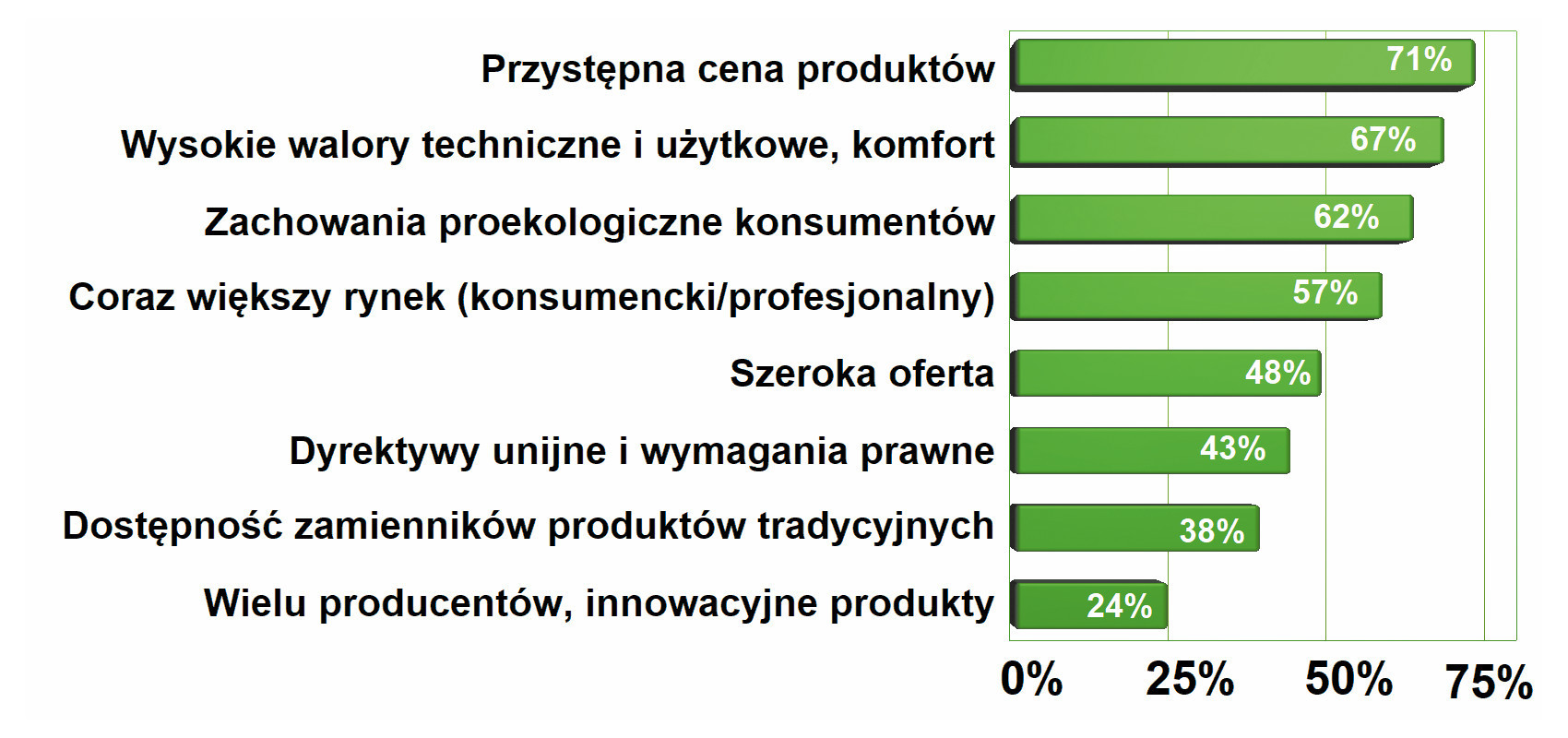

Oświetlenie LED

Jeszcze kilka lat temu rynek oświetlenia LED był w fazie eliminacji żarówek wolframowych, które zostały szybko wyrzucone na margines m.in. za pomocą zakazów sprzedaży. Potem przyszła kolej na rugowanie z użycia lamp fluorescencyjnych (świetlówek kompaktowych), a obecnie trwa proces "dobijania" nielicznych opraw sufitowych ze świetlówkami 18-watowymi. Do niedawna na rynku oświetlenie LED było dostępne głównie w formie zamienników, czyli pasujących do starych opraw żarówek z diodami i zasilaniem, obecnie coraz więcej opraw ma konstrukcję zintegrowaną, a więc zawiera niewymienne źródło światła.

Coraz więcej produktów przynosi coś więcej niż tylko światło – pozwala na programowanie czasu włączenia i wyłączenia, aktywuje się w obecności osób, pozwala na regulację jasności, barwy, współpracuje ze smartfonem itd. Ostatni trend to coraz większy udział rozwiązań specjalistycznych, a więc przeznaczonych do wybranych miejsc i aplikacji. LED-y dają o wiele większe możliwości kompozycji źródeł z oprawą i resztą otoczenia i widać, że cieszą się zainteresowaniem. Są przeznaczone do oświetlenia budynków, stanowisk pracy, ulic, obiektów publicznych. Takie cenne obszary to również np. architektoniczne, sceniczne, medyczne, motoryzacyjne.

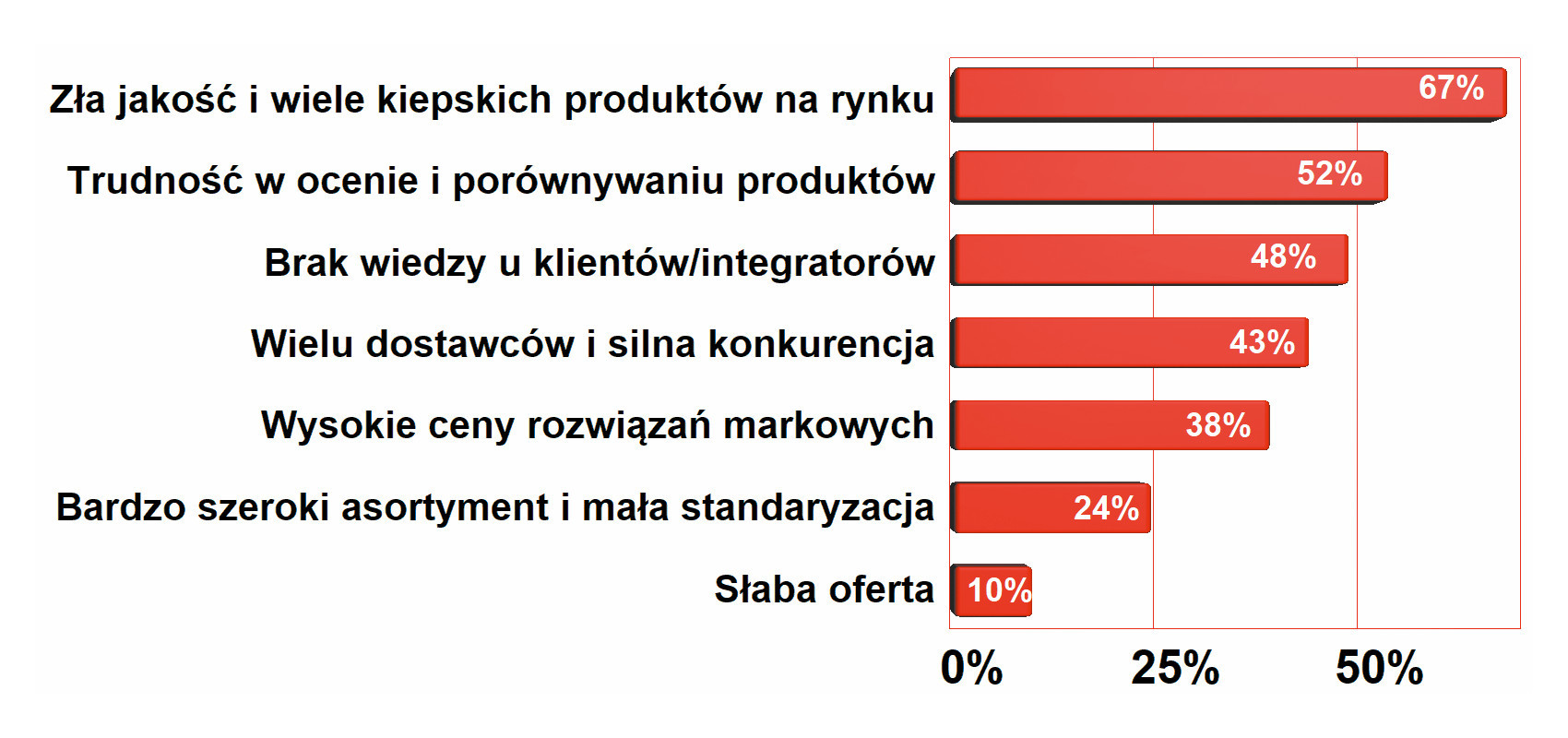

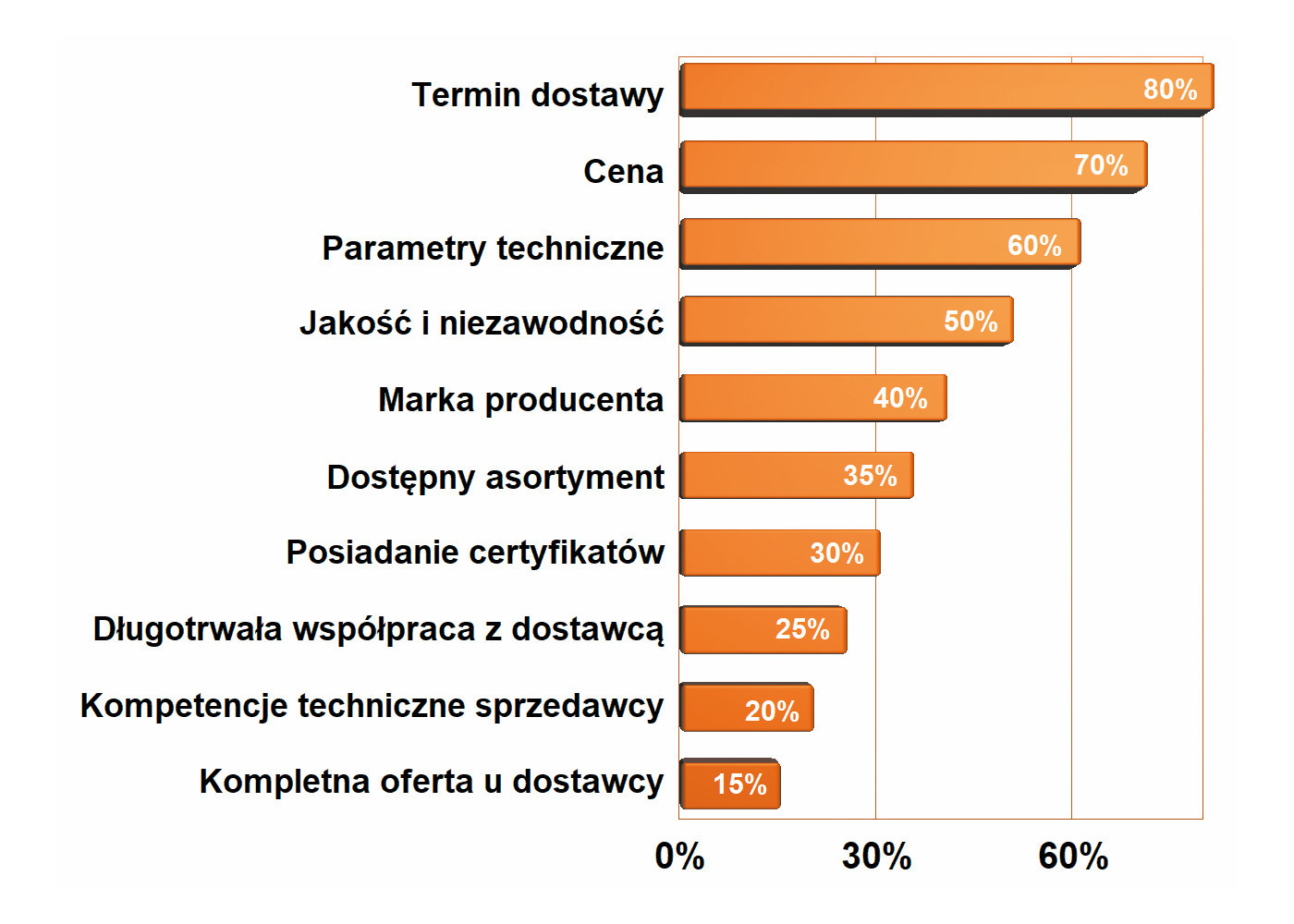

Lampy ledowe zapewniają obecnie znacznie lepszą jakość, trwałość i dobre parametry świetlne niż jeszcze dekadę temu. Wówczas wiele produktów miało problemy a ich deklarowane parametry nie pokrywały się z rzeczywistością. Zapewne dlatego dzisiaj klienci są ostrożniejsi, zwłaszcza w aplikacjach profesjonalnych, gdzie inwestycje nierzadko są realizowane w na tyle dużej skali, że dobór produktu nie może być dziełem przypadku, na przykład, gdy celem jest oszczędność energii.

Nowe etykiety energetyczne

Minął rok, od kiedy obowiązują nowe etykiety energetyczne dla oświetlenia LED określające ich wydajność świetlną, zużycie energii w ciągu 1000 godzin pracy oraz kategorię energetyczną (klasę). Produkty konsumenckie i wszystkie źródła światła wytwarzane przez markowe firmy takie etykiety mają, gorzej wygląda etykietowanie w zakresie importowanych z Azji produktów wykraczających poza termin "konsumencki". Tu nadal jeszcze bez problemu można znaleźć źródła, które etykiet nie mają lub mają starego typu. W wielu wypadkach wynika to z braku wiedzy sprzedawców, firm importowych lub hurtowych, którym brakuje jeszcze "świadomości" oraz często także zwykłej chęci.

Wprowadzający produkty oświetleniowe na rynek są zobowiązani rejestrować swoje produkty w bazie danych EPREL (European Product Registry for Energy Labelling – Europejski Rejestr Etykiet Energetycznych). Celem jest zgromadzenie w jednym miejscu wszystkich dokumentacji technicznych, dotyczących produktów elektrycznych, należących do różnych klas energetycznych. Tam ma się znaleźć szczegółowa dokumentacja techniczna danego produktu, a link prowadzący bezpośrednio do wpisu w bazie jest podawany na kodzie QR na etykiecie. Wymóg ten dla wielu firm nie jest prosty do spełnienia z przyczyn organizacyjnych oraz technicznych. Gdy oferta handlowa jest szeroka, czyli firma ma bardzo dużo źródeł światła, nakład pracy, jaki wiąże się z zarządzaniem wpisami, utrzymywaniem ich w stanie aktualnym, na pewno nie jest drobiazgiem w skali dnia pracy. Baza EPREL wymaga też wpisania parametrów technicznych oświetlenia, takich jak wydajność, kąt emisji światła, temperatura barwowa i podobnych. Firmy importowe nie zawsze dysponują szczegółowymi parametrami, a czasem nie chcą wpisywać tego, co podał im chiński kontrahent, gdyż czują, że nie pokrywa się to z rzeczywistością.

Co trzeba mieć, aby badać jakość oświetlenia LED?

Aby móc weryfikować jakość światła dostarczanego przez oświetlenie ledowe, konieczna jest odpowiednia aparatura pomiarowa. Wiele wielkości fizycznych można zmierzyć z dużą dokładnością i małym kosztem. Przykładem może być napięcie, rezystancja, temperatura. Mierniki służące do tego celu są tanie, powszechnie dostępne, bardzo precyzyjne, a wynik pokapokazywany na wyświetlaczu nie sprawia nikomu problemów z interpretacją. Gorzej jest z wielkościami fizycznymi takimi jak wilgotność, stężenie gazów, ale tutaj także oferta rynku jest bogata i nawet dysponując niewielką sumą można skompletować całkiem sensowne instrumentarium.

Jeśli chodzi o pomiary światła, to niestety sytuacja jest trudniejsza. Przyrządy pomiarowe są znacznie bardziej kosztowne, co wynika z tego, że są to urządzenia skomplikowane, precyzyjne i często o unikatowych właściwościach. Rynek aparatury do pomiarów optycznych jest drobnym ułamkiem tego, co mamy w zakresie pomiarów elektrycznych, przez co producentów jest znacznie mniej. Firmy te nie mogą też rozłożyć kosztów inżynierskich na dziesiątki tysięcy mierników, co czyni inwestycję trudniejszą finansowo. Pomiary optyczne są też trudniejsze od strony merytorycznej, bo sam wynik trzeba umieć odnieść do wymagań aplikacyjnych, porównać z innymi produktami i wiedzieć, czy różnica ma jakiekolwiek znaczenie.

Kolejny problem z pomiarami źródeł optycznych jest taki, że potrzebna jest interdyscyplinarna wiedza z zakresu elektroniki (np. zasilanie), optyki (kształtowanie wiązki światła), fizyki. Przydaje się też znajomość chemii, procesów związanych z badaniami starzeniowymi, estymacją żywotności i innymi zagadnieniami. Słowem – nie jest tak łatwo, jak z napięciem.

Podstawowym przyrządem jest spektrometr pozwalający na pomiar skorelowanej temperatury barwowej (CCT) i współczynnika reprodukcji barw (CRI). Do niego trzeba dokupić kulę całkującą wraz z osprzętem, aby badać wydajność świetlną. Ten zestaw minimum można dalej rozbudowywać o sprzęt do badań klimatycznych, starzeniowych, kamerę termowizyjną itp. Do utrzymywania aparatury w stanie jakości metrologicznej niezbędne są wzorce itd.

Migotanie jest coraz mniejszym problemem

Jeszcze kilka lat temu migotanie źródeł światła było częstą przypadłością tanich źródeł. Minimalna bezwładność diod powoduje, że tętnienia napięcia zasilającego wywołane kiepską filtracją lub złą korekcją współczynnika mocy przenoszą się na wahania strumienia świetlnego. Nie tylko chodzi o zmiany w takt częstotliwości sieci zasilającej 50/100 Hz, ale także te o wyższej częstotliwości, które jest wynikiem działania PWM.

Metodą zapewnienia małego poziomu migotania źródeł światła jest użycie zasilaczy dobrej jakości, a więc takich o stabilnym napięciu wyjściowym, które nie tylko nie mają tętnień związanych z konwersją energii i korekcją PFC, ale także charakteryzują się dobrą dynamiką tj. stabilnością napięcia wyjściowego przy dużych zmianach prądu obciążenia. Ponad rok temu weszła w życie kolejna rewizja dyrektywy Ekoprojektu, która wymusza kontrolowanie przez dostawców oświetlenia zjawiska migotania. Poprawiła się też jakość zasilaczy ledowych dostępnych na rynku oraz scalonych rozwiązań driverów wykorzystywanych w modułach i oprawach zintegrowanych. Szersza oferta i dobre parametry zasilaczy specjalizowanych powodują, że migotanie światła przestaje być problematyczne w produktach nowych.

Inteligentne oświetlenie

Inteligentne oświetlenie to termin o szerokim znaczeniu, często też określane terminem "smart" w przypadku, gdy chodzi o źródła światła do pomieszczeń wewnętrznych. Koncepcja opiera się na tym, że do źródła światła dodajemy różne czujniki, obwody sterujące (jasnością, kolorem, odcieniem), aktywację ruchem człowieka, programowanie czasu działania oraz komunikację. Jednym z najczęściej spotykanych funkcjonalności tego systemu jest możliwość dostosowywania temperatury barwowej oraz jasności świecenia ręcznie lub automatycznie w zależności od pory dnia oraz zdefiniowanego profilu.

Takie możliwości zapewniają profesjonalne oprawy przemysłowe, do budynków biurowych i stanowisk pracy, a nawet żarówki ledowe do zastosowań domowych. Rozwiązania te różnią się tylko liczbą takich funkcji i komunikacją. W systemach budynkowych sterowanie lampami realizuje się za pomocą DALI (Digital Addressable Lighting Interface) i Ethernetu lub ZigBee. W tych domowych częściej spotyka się Bluetooth i Wi-Fi umożliwiające komunikację ze smartfonem. Niestety jednym z kłopotów branży oświetleniowej pozostaje brak jednomyślności co do standardu wymiany danych, co wywołuje spore problemy z interoperacyjnością poszczególnych modułów LED. Od kilku lat trwają prace nad wprowadzeniem większej standaryzacji, ale idzie to opornie.

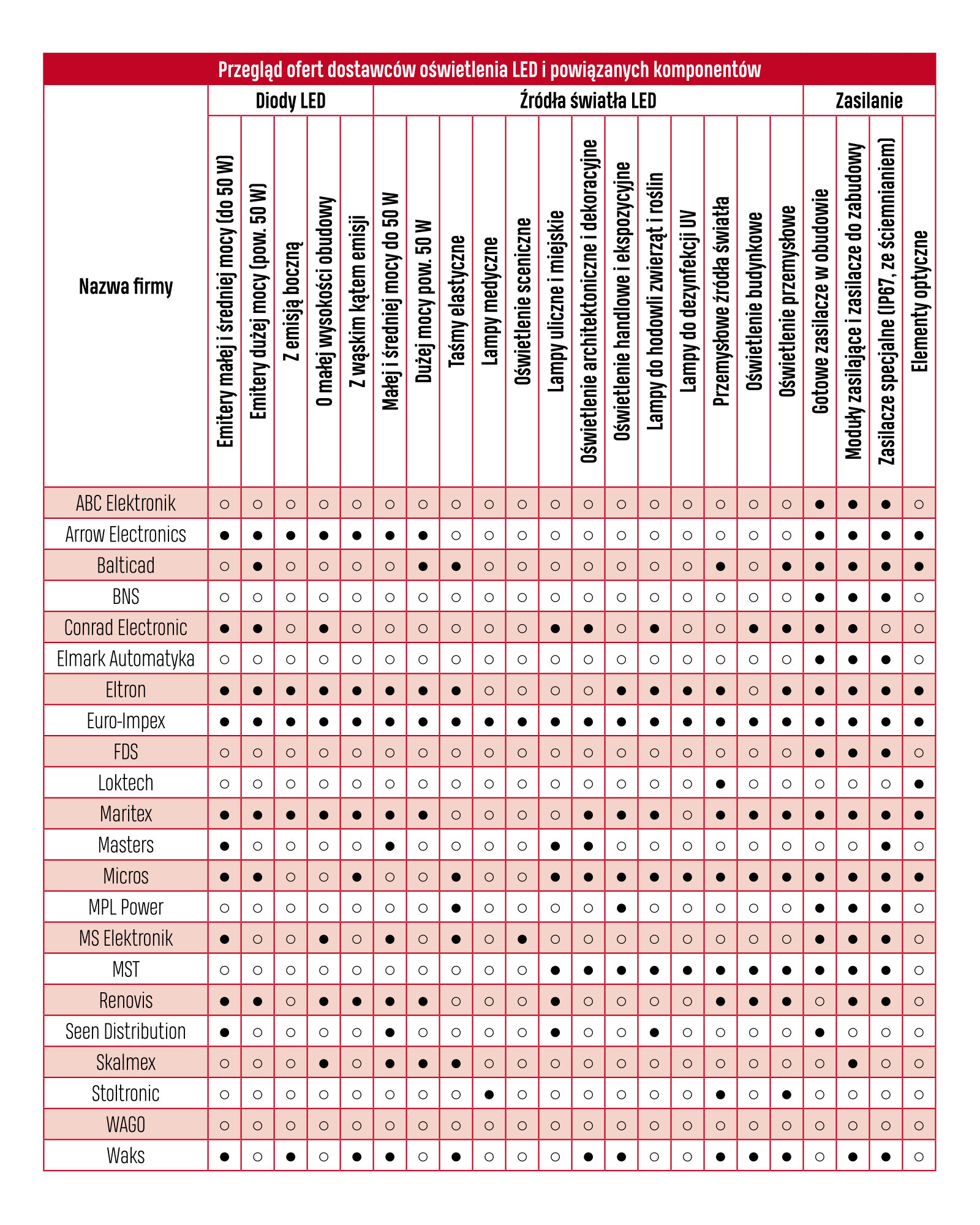

Oświetlenie specjalistyczne i przemysłowe

Silna konkurencja na rynku konsumenckim powoduje, że stale rośnie znaczenie oświetlenia specjalistycznego i profesjonalnego, w którym wartość dodana dla klienta jest większa niż w obszarze konsumenckim oraz nie ma takiej konkurencji cenowej ze strony importerów produktów azjatyckich. Renomowane firmy stawiają na nowoczesne produkty, o dużej funkcjonalności, jakości także w zakresie popularnych rozwiązań konsumenckich i nierzadko porzucają aktywność w zakresie wyrobów typowych, gdzie konkurencja ma charakter cenowy.

W tym obszarze ilościowo i asortymentowo dominują rozwiązania oświetleniowe do sklepów wielkopowierzchniowych, magazynów, hal produkcyjnych (głównie lampy high i low bay, oprawy liniowe), w dalszej kolejności są to lampy montowane w sufitach podwieszanych, systemy oświetlenia ulicznego, lampy obiektowe, wersje z certyfikatami (Atex, górniczymi, medycznymi), w obudowach odpornych na narażenia środowiskowe i podobne. Drugim obszarem specjalizacji jest atrakcyjne wzornictwo pozwalające nadać pomieszczeniom indywidualny charakter i zapewnić wysoką funkcjonalność.

Jeszcze inna droga specjalizacji to oświetlenie do zastosowań w rolnictwie, a więc wykorzystywane do uprawy roślin i hodowli zwierząt oraz UV do sterylizacji. Światło o odpowiednim widmie oraz dawce korzystnie wpływa na wzrost i poziom zawartości pożądanych substancji aktywnych w roślinach. UV pomaga z kolei w utrzymaniu dobrej kondycji plonów poprzez ograniczanie rozwoju pleśni oraz niektórych gatunków szkodników, stanowiąc alternatywę dla środków chemicznych. Do takich zastosowań pojawiły się już odpowiednie diody o specyficznej barwie światła.

LED-y z zakresów UV-B oraz UV-C wykorzystywane są również m.in. w celu dezynfekcji pożywienia, powietrza, wody oraz powierzchni. Ich zaletą jest nie tylko wysoka energooszczędność, ale również małe wymiary, pozwalające na miniaturyzację urządzeń, przez co wypierają lampy rtęciowe z wielu zastosowań. Także dzięki temu, że nie zawierają rtęci i wiążących się z nią problemów z recyklingiem. Drugą korzyścią jest duża żywotność. Lampy rtęciowe mają ją na poziomie ok. 8 tys. godzin, lampa LED UV może osiągnąć nawet 10-krotnie dłużej, nie wymagają nagrzewania, co zwiększa wydajność procesu sterylizacji i umożliwia błyskawiczne uruchomienie systemów dezynfekujących.

Zasilanie dla oświetlenia LED

Zasilacze LED to produkt o specyficznych właściwościach dostosowanych do tego typu aplikacji. Takich specjalizowanych jednostek jest na rynku wiele i bez trudu można wybierać spośród ofert wielu producentów i typów. Rośnie też stopień zaawansowania technicznego zasilaczy ledowych, co ma korzystny wpływ na parametry oświetlenia i trwałość. Poza zasilaczami do sieci energetycznej są jeszcze wersje zasilane niskim napięciem stałym (DC-DC), są moduły open frame i układy scalone specjalizowanych konwerterów impulsowych. Zasilacze dla diod LED są produkowane głównie przez firmy azjatyckie, które celują w tworzeniu szerokiego asortymentu standardowych konstrukcji o dobrym poziomie jakości.

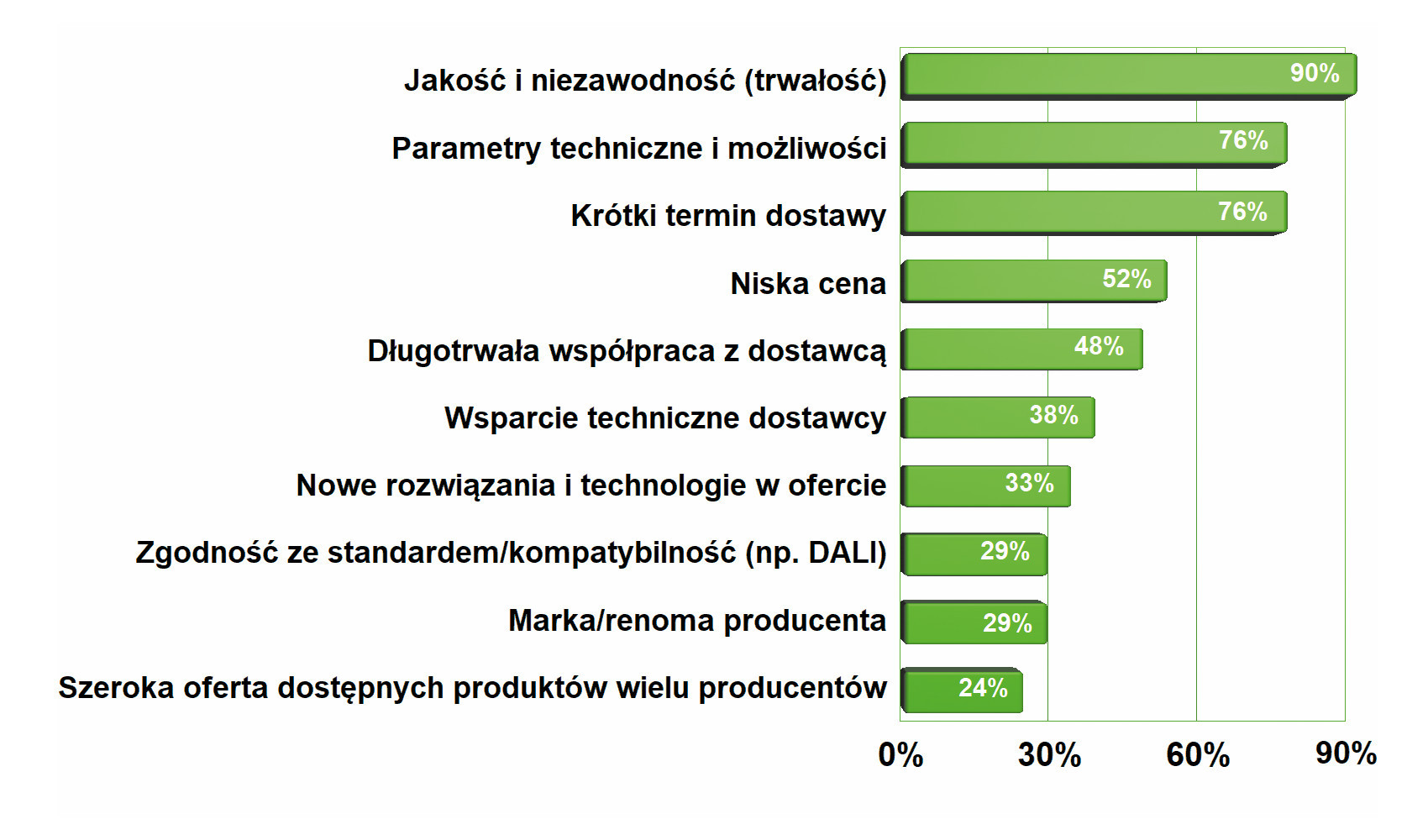

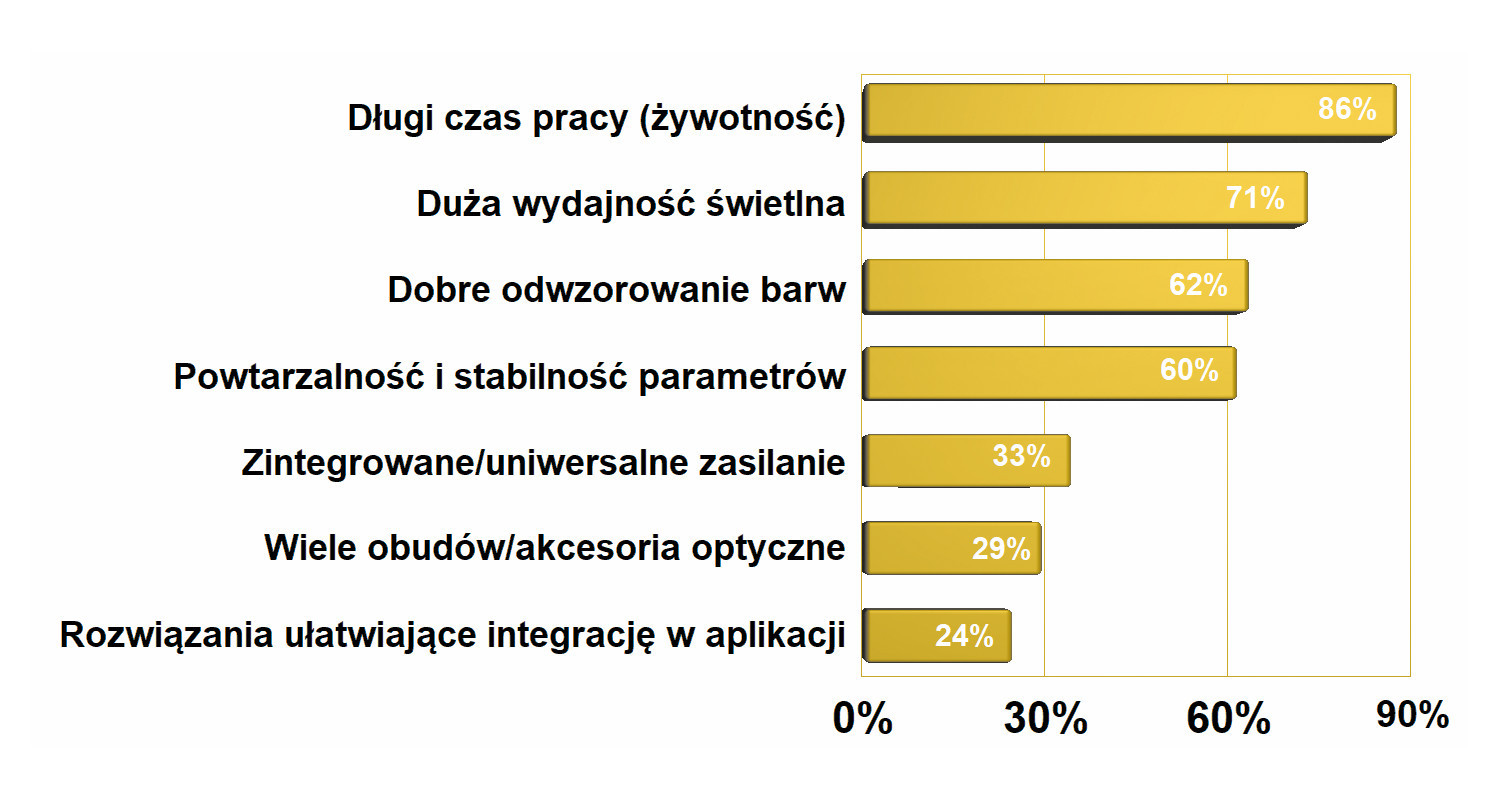

Jakość zasilania, diod, optyki i materiałów

Mówiąc o jakości oświetlenia ledowego, w największym stopniu skupiamy się na ocenie diod, a więc emiterów światła. Rozważamy zagadnienia związane z wpływem temperatury na trwałość, degradacją luminoforu itp. czynnikami. Niemniej z perspektywy lat można powiedzieć, że w wielu przypadkach diody nie są głównym sprawcą złej jakości produktów końcowych. Może kiedyś tak było, ale dzisiaj rozwój technologii pozwala zapewnić ich działanie w dziesiątkach tysięcy godzin.

Poza diodami problemy sprawia zasilanie, zwłaszcza to zintegrowane z lampą, gdyż wówczas zasilacz jest umieszczony blisko źródła światła i całość razem grzeje się znacząco. Prowadzi to do wysychania elektrolitu w kondensatorach elektrolitycznych i przedwczesnych awarii. Zasilacze są też wrażliwe na przepięcia w sieci. Dotyczy to głównie produktów konsumenckich, gdzie oszczędza się na komponentach oraz wersji profesjonalnych w przypadku, gdy warunki eksploatacji są trudne. Świadomość rynku w zakresie wpływu warunków panujących w miejscu instalacji na żywotność jest niewielka i zasilacz zabudowany szczelnie w drewnianym meblu nie jest wcale rzadkością. Ostatnim czynnikiem determinującym żywotność oświetlenia jest jakość produktów chemicznych, takich jak zalewy hermetyzujące i tworzywa elementów optycznych, które żółkną, kruszą się lub deformują. Warto więc pamiętać, że w zapewnieniu jakości liczy się połączenie wszystkich elementów w spójną całość.

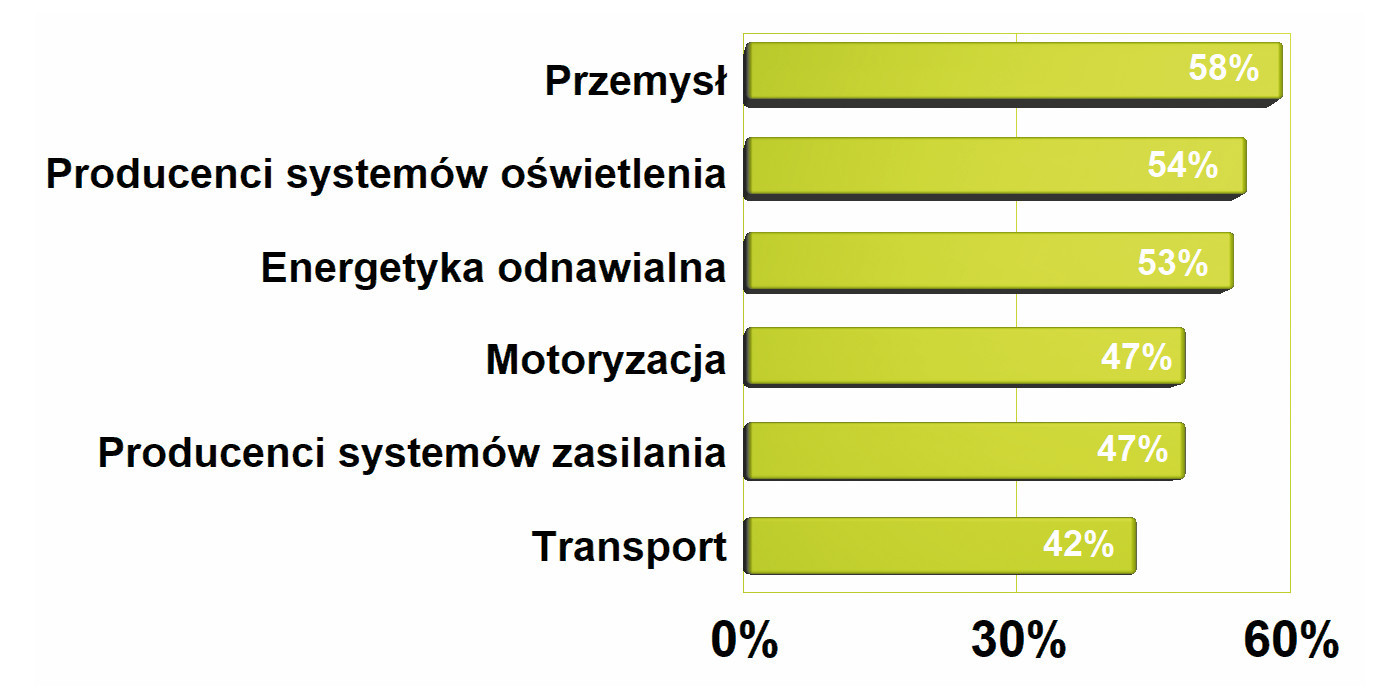

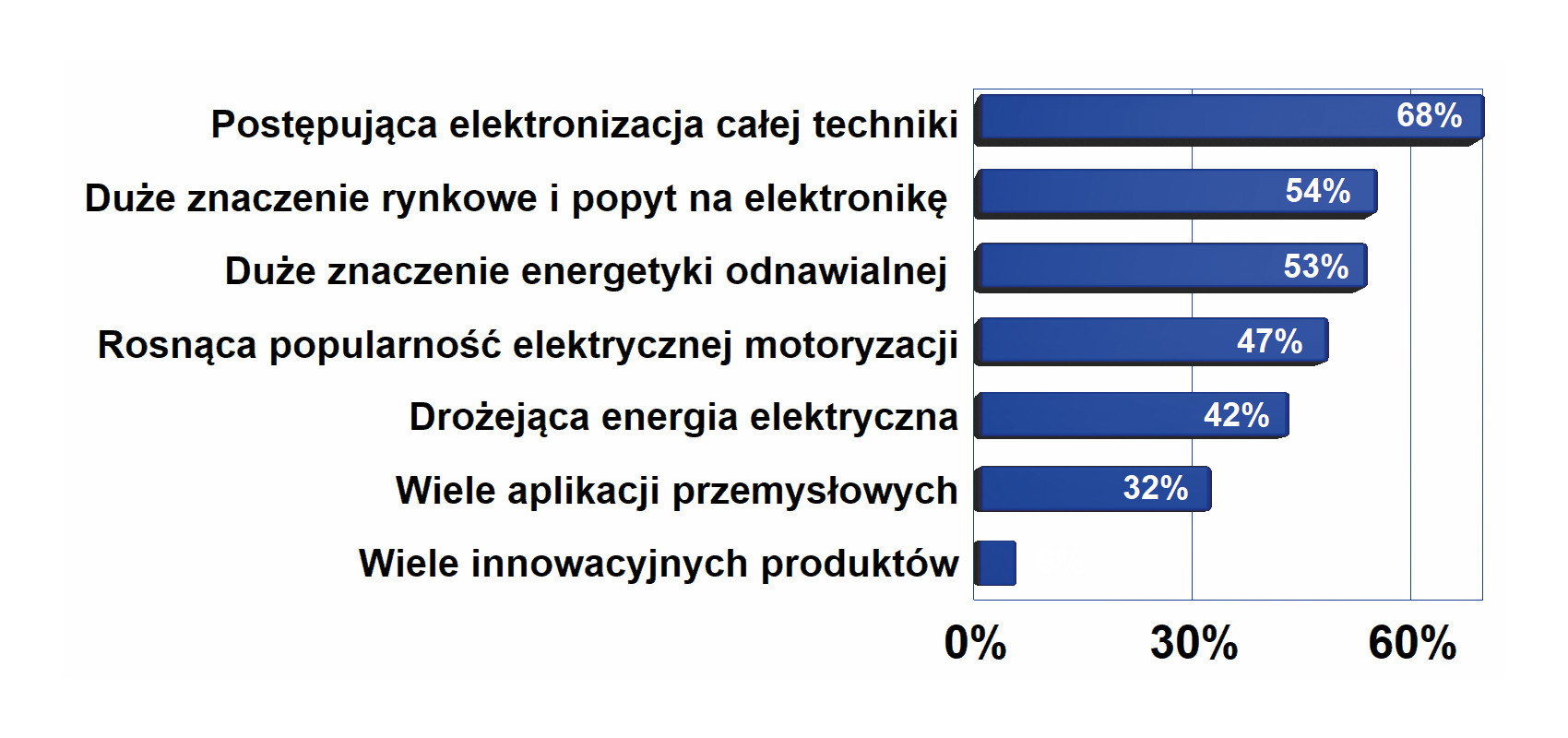

Podzespoły półprzewodnikowe dużej mocy

W podzespołach mocy aktywność producentów kieruje się w stronę poprawy parametrów maksymalnych oraz zapewnienia większego stopnia integracji, a także mniejszych obudów zapewniających skuteczne odprowadzanie ciepła. Elementy mocy są wyposażane w dodatkowe obwody sterujące i zabezpieczające, dzięki czemu ich wykorzystanie staje się łatwiejsze i poprawia się niezawodność. W wielu zastosowaniach podzespoły mocy trzeba łączyć szeregowo lub równolegle, dlatego nowe wersje o większej obciążalności i dopuszczalnych parametrach dają szansę na to, że daną funkcję w układzie będzie można zrealizować mniejszą liczbą części. Producenci przykładają też dużą wagę do redukcji strat mocy, co ogranicza gabaryty radiatorów, wielkość obudów, zwiększa stopień integracji i także zmniejsza cenę.

"Duża moc" jest coraz większa

Wartości napięcia, prądu lub mocy, od której zaczyna się "duża moc", stale się przesuwają w kierunku większych wartości. W przypadku systemów zasilanych napięciem stałym o niskiej wartości, płynące prądy sięgają kilkadziesiąt amperów nawet w niewielkich systemach cyfrowych. Podobnie jest w mniejszych urządzeniach mobilnych zasilanych z akumulatorów, w dużym przemysłowym sprzęcie mobilnym, samochodach hybrydowych, gdzie kilowatowe silniki elektryczne są zasilane napięciem ok. 200 V. W instalacjach PV, gdzie napięcia stałe są jeszcze większe, "duża moc" zaczyna się od 500‒1000 W. W przypadku sprzętu zasilanego z sieci o dużej mocy mówi się zwykle tam, gdzie w grę wchodzi zasilanie z sieci trójfazowej, a więc powyżej 2 kW. Tak postawione granice cały czas są dość płynne i trzeba mieć świadomość, że inaczej na dużą moc patrzy energetyk, a inaczej inżynier zajmujący się sprzętem konsumenckim.

Tyrystory w układach mocy

Diody i tyrystory cały czas są domeną prostowników w systemach zasilania prądem stałym w transporcie szynowym, energetyce i przemyśle przetwórczym, w urządzeniach takich jak zgrzewarki, spawarki, w układach miękkiego rozruchu silników bardzo dużej mocy, urządzeniach zabezpieczających przez przepięciami. Elementy te pracują z prądami sięgającymi kiloamperów i napięciami ponad 1 kV (dla większych napięć są łączone w stosy szeregowe) i cały czas w takich zakresach nie mają realnej konkurencji.

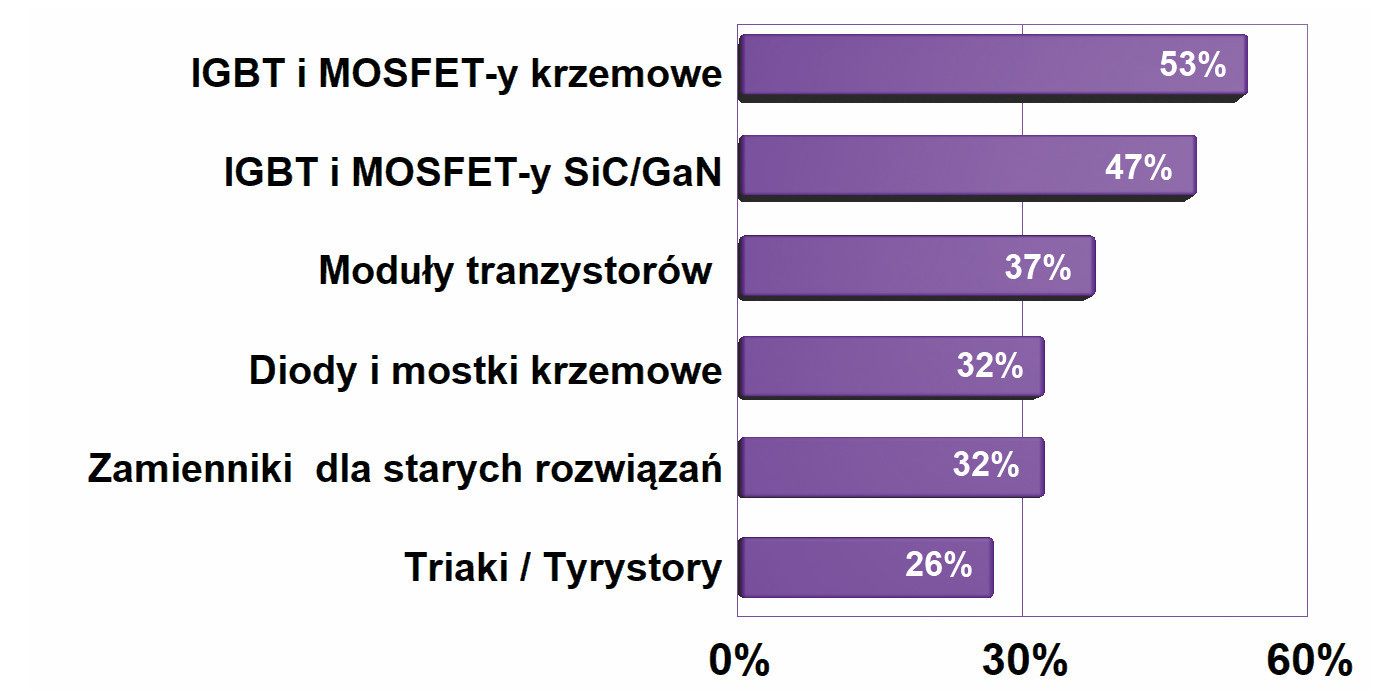

Tranzystory krzemowe

Najbardziej istotną i wartościową częścią tej grupy produktowej są półprzewodniki: tranzystory IGBT i MOSFET oraz moduły o różnym stopniu układowej złożoności. Tranzystory mocy MOSFET dostępne są w wersjach niskonapięciowych (30‒60 V), średnionapięciowych (100‒400 V) i wysokonapięciowych (600‒800 V). Mimo znakomitych parametrów nowych opracowań tranzystorów MOSFET energetyka częściej korzysta z elementów IGBT. Mają one mniejsze straty mocy przy dużych napięciach znamionowych, co powoduje, że na rynku powoli zarysowuje się podział aplikacyjny, zgodnie z którym MOSFET- y częściej pojawiają się w zastosowaniach niskonapięciowych, do około 400V, a IGBT w przypadku napięć wyższych.

Nowe materiały półprzewodnikowe

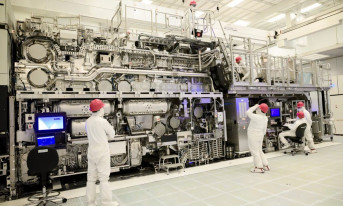

Wiele nowych rozwiązań z obszaru konwersji mocy elektrycznej wiąże się z wykorzystaniem podzespołów na bazie nowych materiałów półprzewodnikowych, takich jak azotek galu (GaN) lub węglik krzemu (SiC). Elementy takie używane są w modułach inwerterów, czyli w przetwornicy odpowiedzialnej za konwersję prądu stałego dostarczanego z akumulatora na prąd przemienny wymagany do pracy silnika elektrycznego lub przekształcenie napięcia sieci energetycznej w trójfazowe napięcie przemienne o parametrach dobranych do zasilania silnika. Sprawność i wydajność falownika mają kluczowy wpływ na istotne parametry pojazdu, jak zasięg, czas ładowania oraz żywotność baterii, a w przypadku zasilania z sieci na koszt posiadania urządzenia lub maszyny. Dlatego w takich zastosowaniach, gdzie czas eksploatacji liczy się w wielu latach, elementy te dają duże oszczędności.

IGBT oraz MOSFET-y z powodu swoich stosunkowo dużych rozmiarów struktury mają kłopoty z komutacją z wysoką częstotliwością (straty komutacyjne), które ograniczają też maksymalną dopuszczalną częstotliwość pracy inwertera. Takie limity i ograniczenia charakterystyczne dla krzemu mogą zostać ominięte poprzez wykorzystanie półprzewodników szerokopasmowych. Mogą pracować w wyższych temperaturach, przy wyższych napięciach oraz częstotliwościach, redukując straty mocy w układach konwersji zasilania. Mają też wysoką wytrzymałość elektryczną, przekładającą się na znacząco wyższą wartość napięcia przebicia niż w przypadku tranzystora krzemowego o podobnych rozmiarach. Pozwala to na tworzenie układów o mniejszych niż w przypadku krzemu wymiarach, zachowując przy tym pożądane cechy elektryczne. Mniejszy rozmiar przekłada się zaś na niższą wartość pojemności wymaganą do przeładowania w procesie przełączania, a zatem krótszy czas przełączania i wyższą maksymalną częstotliwość pracy. Tranzystory GaN mają o połowę niższą wartość rezystancji włączenia R DS(ON) niż w strukturach krzemowych, to zaś oznacza dwukrotnie mniejsze straty przewodzenia. W związku z tym zmniejsza się również ilość generowanej podczas pracy układ energii cieplnej, możliwe jest uproszczenie konstrukcji systemu chłodzenia.

GaN-y świetnie sprawdzają się w pracy z napięciami dochodzącymi do 1 kV, zaś SiC dla napięć jeszcze większych. Te zalety są oczywiście okupione wyższą ceną, niemniej całkowity koszt systemu może być utrzymany w ryzach dzięki uproszczeniu i redukcji rozmiaru pozostałych komponentów – np. radiatorów, kondensatorów czy elementów magnetycznych.

Jedyny problem to ograniczona dostępność takich elementów – rynek cały czas czeka na tanie tranzystory GaN oraz na ich dostępność.

Moduły mocy

Poza podzespołami dyskretnymi ważną częścią rynku są moduły, zawierające one typowo 4‒6 tranzystorów w układzie mostka. W modułach umieszcza się też prostownik, diody usprawniające oraz zabezpieczające, czujnik temperatury. Czasem pojawia się dodatkowy tranzystor do realizacji korekcji współczynnika mocy. Takie komponenty znajdują się w ofertach wielu producentów półprzewodników i stanowią bazę konstrukcyjną większości falowników, napędów i regulatorów. Moduły stanową zwartą konstrukcję o dobrych parametrach w zakresie odprowadzania ciepła, przy jednoczesnym zapewnieniu izolacji galwanicznej od radiatora. Gwarantują łatwy montaż i sparowane elementy, pozwalają na wygodne połączenie (śruby lub konektory) i są dużo tańsze od rozwiązania na elementach dyskretnych.

Nie tylko półprzewodniki

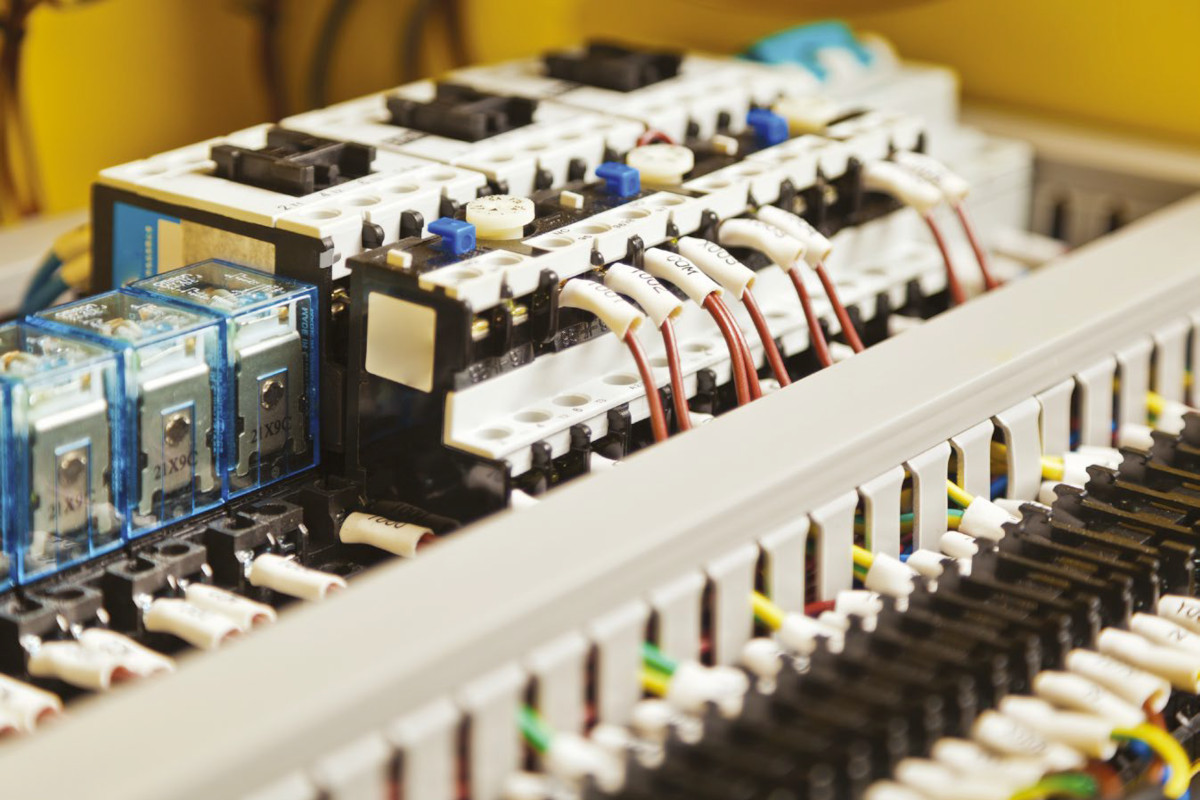

Poza półprzewodnikami elektronika dużych mocy łączy w całość wiele innych specjalizowanych produktów związanych z odprowadzaniem ciepła, jak radiatory, wentylatory, bloki chłodzące lub systemy chłodzenia wodnego. W grupie tej są także transformatory, filtry przeciwzakłóceniowe i inne części znajdujące się w takich urządzeniach. To również kable i złącza przeznaczone do prądów stałych o dużym natężeniu i pracy w trudnych warunkach środowiskowych, przekaźniki (styczniki) i urządzenia zabezpieczające umożliwiające podłączanie lub odłączanie gałęzi ogniw, liczniki energii/bezpieczniki. Cały czas na znaczeniu zyskują też superkondensatory.

Znaczenie tych komponentów uwypukla elektromobilność, bo w takich aplikacjach zwykle typowym problemem jest zapewnienie szybkiego ładowania akumulatora dużym prądem, a więc z użyciem ładowarki dużej mocy, kabli chłodzonych cieczą, złączy zdolnych do pracy przy wysokim napięciu stałym i podobnych.

Długie czasy dostaw i wzrost cen

Długie czasy dostaw, z jakimi cały czas zmaga się rynek, oznaczają coraz wyższe koszty komponentów. To oczywista zależność, która jest dzisiaj dodatkowym problemem dla rynku dystrybucji. Ceny podzespołów zwiększają się na skutek splotu wielu czynników, takich jak wzrost kosztów surowców, transportu, kosztów pracy, na skutek dużej inflacji pojawiającej się przy okazji tłumienia skutków pandemii a także tego, że duży popyt rynku pozwala na podwyżki. Ceny poszukiwanych, zaawansowanych elementów podwoiły się, a spekulanci oferują niektóre pozycje nawet 7‒8-krotnie drożej niż 2 lata temu. To oczywiście są skrajne przypadki, niemniej oddające to, czym dzisiaj żyje branża. Poza cenami, negatywnie na rynek wpływa też niestabilna sytuacja u inwestorów przejawiająca się przesunięciami terminów lub rezygnacją z inwestycji. Niestety fakty są takie, że wzrost cen materiałów, kosztów pracy i mediów zmusza do przeliczenia opłacalności wielu inwestycji i projektów.

Napędy silników i inwertery solarne

Impuls rozwojowy dla komponentów dużej mocy tworzą także napędy silników wykorzystywane w aplikacjach przemysłowych. Są to falowniki ze sterownikami umożliwiającymi płynną regulację obrotów, zmianę kierunku wirowania i z miękkim rozruchem. Falowniki takie generują na wyjściu trójfazowe napięcie, które zasila bezpośrednio uzwojenia silnika indukcyjnego (asynchronicznego i synchronicznego) i mają wysoką sprawność. Falownik może być zasilany z sieci jednofazowej lub trójfazowej (w zależności od mocy). Napięcie to jest prostowane a następnie falowane, czyli zamieniane na przemienne napięcie trójfazowe o regulowanej częstotliwości.

Podobną zasadę działania mają inwertery solarne. W tym przypadku stałe napięcie dostarczane przez panele PV jest zamieniane na przemienne napięcie (jedno- lub trójfazowe), o parametrach identycznych jak to, co jest w sieci. Zgodność częstotliwości, fazy i wartości napięcia wyjściowego inwertera solarnego umożliwia oddawanie energii do sieci energetycznej. Cechą falowników solarnych jest to, że stałe napięcie wejściowe dostarczane przez ogniwa (panele) PV może zmieniać się w szerokich granicach od kilkunastu do kilkuset woltów.

Miniaturyzacja

Wiele aplikacji elektroniki mocy pracuje dzisiaj z napięciami przekraczającymi 500 V i prądami wykraczającymi poza 100 A, czyli z mocą sięgającą 10 kW. Takie granice wyznaczają aplikacje w transporcie szynowym, motoryzacji elektrycznej oraz w sprzęcie przemysłowym. Bez względu na to, współczesne urządzenia muszą być możliwie nieduże. Wprawdzie w instalacjach dostępność miejsca nie jest zwykle problemem, miniaturyzacja jest ważnym trendem w energoelektronice, bo pozwala na większą integrację, lepszą swobodę aplikacyjną oraz otwiera nowe możliwości w zakresie zastosowań. Budowane w oparciu na podzespołach mocy falowniki, zasilacze, ładowarki mają uniwersalną konstrukcję i mogą być aplikowane w różnych systemach. Mniejszy sprzęt ma niewątpliwie szerszy zakres takich możliwości.

Wiadomo, że do miniaturyzacji konieczne jest zwiększenie sprawności konwersji energii elektrycznej, stąd w tym temacie nieustannie pojawiają się na rynku ważne innowacje. Lepsze parametry komutacyjne podzespołów dużej mocy (np. SiC i GaN) zapewniają większą sprawność, pozwalając zmniejszyć liczbę elementów wykonawczych i tym samym ograniczyć zajmowane miejsce w obudowie urządzenia. Z kolei mniejsza liczba elementów to także oszczędność pieniędzy, prostsze sterowanie i serwisowanie. Wysoka sprawność to też mniejsze koszty chłodzenia, zasilania, ale także lepszy potencjał modernizacyjny. Wiadomo, że starsze rozwiązania falowników, zasilaczy, przełączników mogą nierzadko pracować przez długie lata i charakteryzują się dużą niezawodnością. W takiej sytuacji zmianę produktu na nowy mogą zapewnić tylko znacząco lepsze parametry, na przykład sprawności, które są w stanie przekonać firmy do opłacalności inwestycji. Dlatego w temacie sprawności wiele się dzieje.

Dla miniaturyzacji istotne są też zagadnienia związane z odprowadzaniem ciepła. Sprawne chłodzenie sprzyja miniaturyzacji, dlatego wiele innowacji nie kończy się na strukturach półprzewodnikowych, ale dotyczy także obudów komponentów. Wiele nowych rozwiązań półprzewodników mocy ma specjalnie zaprojektowane obudowy pod kątem aplikacyjnym, tak aby można było osiągnąć wysoki stopień integracji i dobre odprowadzanie ciepła. Takie zjawiska są charakterystyczne głównie dla branży motoryzacyjnej oraz wybranych rynków półprofesjonalnych, np. napędów silników BLDC w sprężarkach klimatyzatorów. W takim miejscu silnik, falownik i sterownik są zintegrowane w formie jednego komponentu.

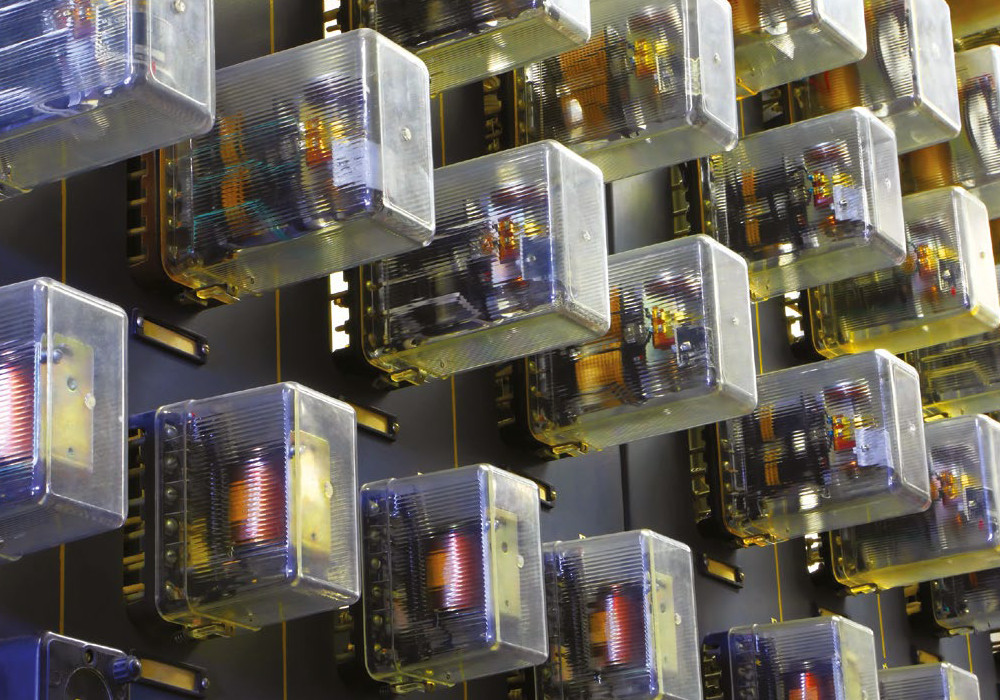

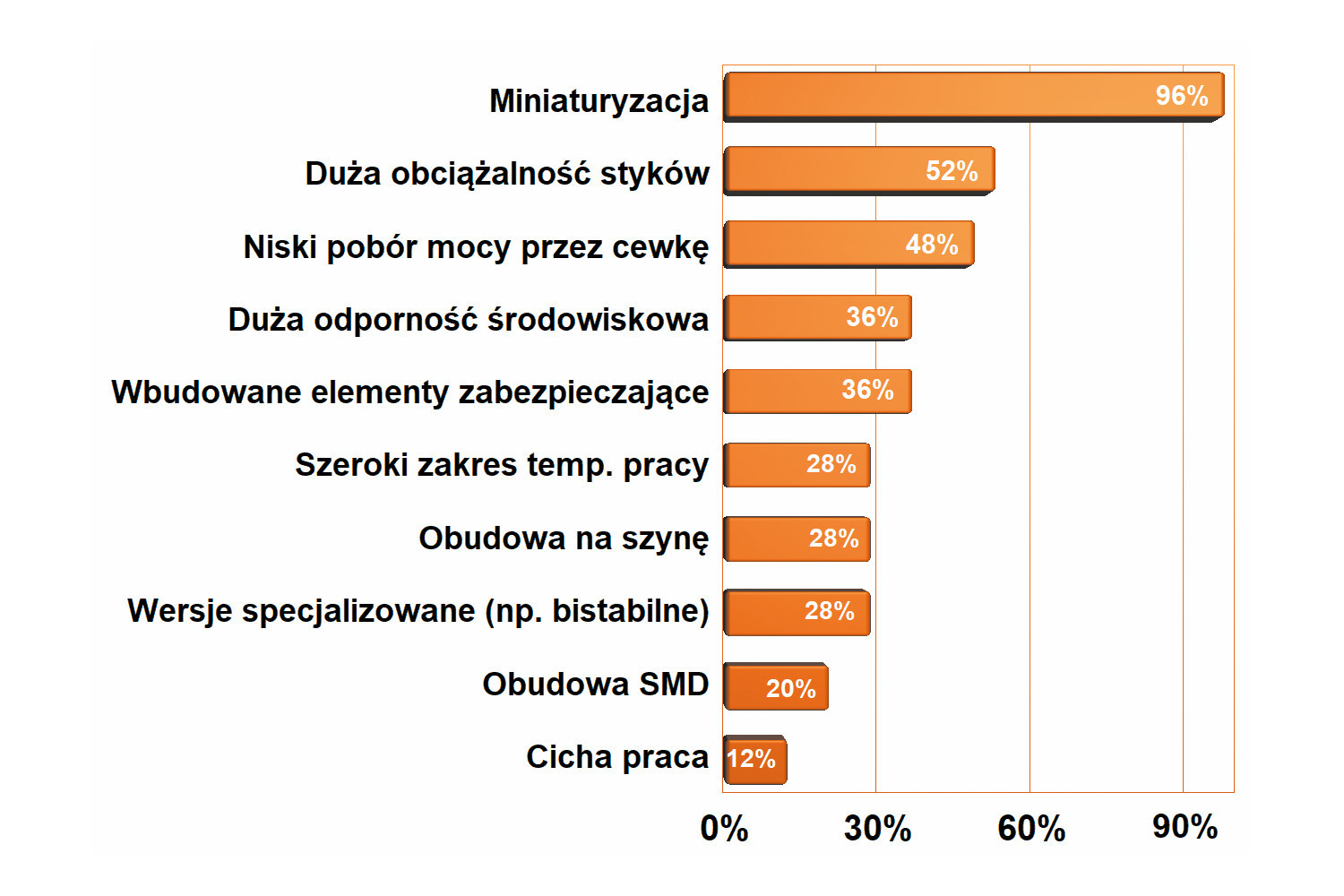

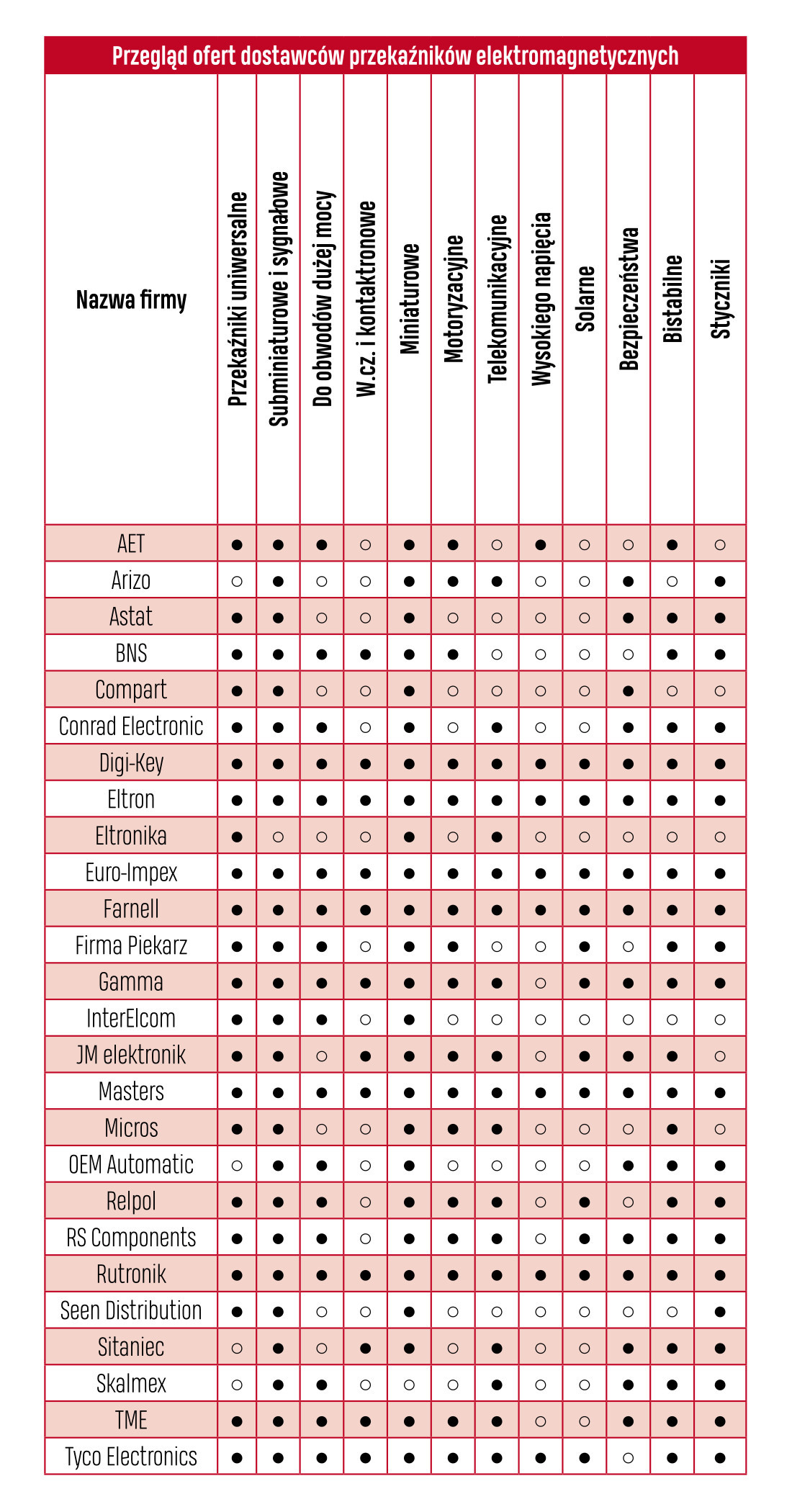

Przekaźniki elektromagnetyczne

Przekaźniki elektromagnetyczne uznawane są za produkty perspektywiczne, zawsze dobrze dopasowane do aktualnych wymagań technicznych. Zapewniają dużą odporność na chwilowe przeciążenia, przepięcia i stany nieustalone oraz możliwość komutacji sygnałów dużej mocy, zarówno przy wysokim napięciu, jak i przy dużym natężeniu prądu. Ważną cechą jest też mały opór w stanie załączenia, czego nie da się uzyskać w przekaźnikach półprzewodnikowych na wysokie napięcia i mają pomijalnie mały upływ w stanie rozwarcia styków. Mimo wielu zmian w technice i ogromnego postępu w technologii, w wielu zastosowaniach (np. bezpieczeństwo) nie mają konkurencji.

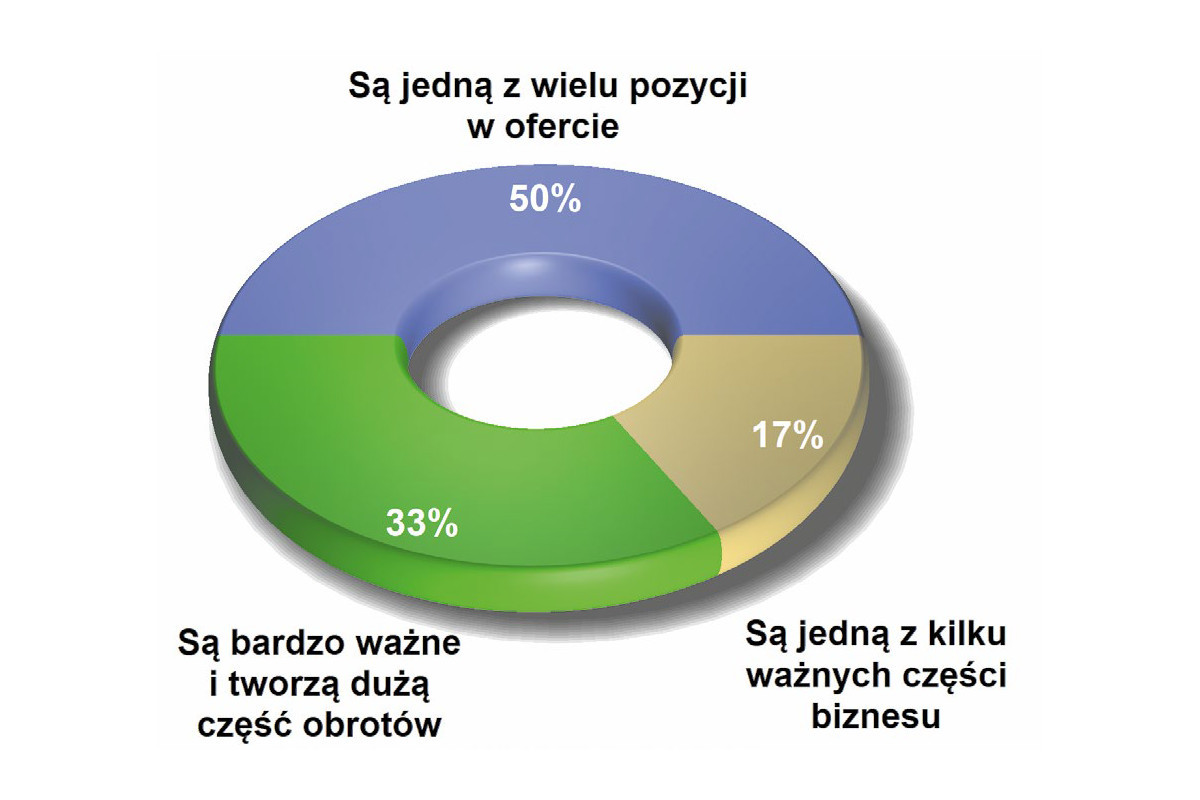

W ofertach producentów przekaźników widocznych jest coraz więcej typów o funkcjonalności i parametrach dostosowanych do wymagań aplikacji. Do niedawna przekaźnik był postrzegany jako coś bardzo uniwersalnego, który można było używać w zasadzie dowolnie, obecnie okazuje się, że czasem warto sięgnąć po rozwiązanie aplikacyjne. Przykładem mogą być wersje solarne, zdolne do komutacji obwodów mocy prądu stałego, rozwiązania odporne na uderzenia prądu udarowego, o podwyższonej odporności izolacji, bistabilne. Czasy, gdy przekaźnik dobierało się na podstawie paru parametrów, już dawno się skończyły – poza obszarem aplikacyjnym, typem trzeba też decydować o wymaganiach środowiskowych, obudowie, opcjach dodatkowych jak np. wskaźnik zadziałania, wbudowanym elemencie gaszącym przepięcia, systemie gaszenia łuku elektrycznego, przycisku testującym itp. Do tego dochodzą opcje montażu, parametry cewki przekaźnika oraz jej moc.

Jakość oczkiem w głowie

Na rynku przekaźników widoczny jest stały wzrost zainteresowania klientów w stronę produktów wysokiej jakości i tych produkowanych przez renomowanych producentów. Przyczyn tego zjawiska jest wiele, na przykład rosnące koszty pracy i tym samym drożejący serwis. To także coraz większy eksport krajowych przedsiębiorstw, coraz więcej urządzeń i aparatury w fabrykach oraz większe skomplikowanie techniczne nowych instalacji. W Polsce szybko rozwijają się rynki związane z produkcją maszyn, sektorem budowlanym i postępuje automatyzacja wielu dziedzin.

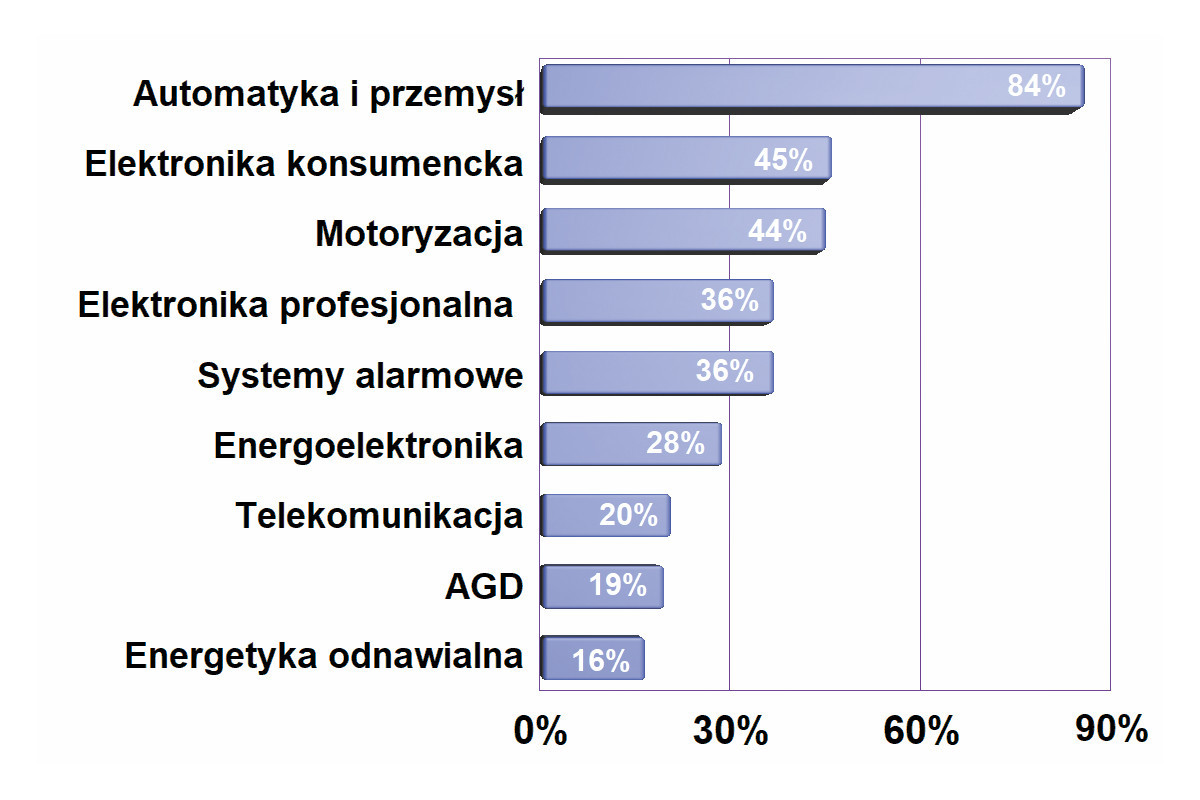

Rozwój produkcji inicjuje też popyt na systemy kontroli i sterowania, co zawsze stymuluje popyt na przekaźniki. Wiele krajowych firm produkuje i eksportuje urządzenia dla przemysłu, takie jak sterowniki, regulatory, urządzenia pomiarowe, styczniki, systemy bezpieczeństwa i nadzoru. W ramach inwestycji i modernizacji starszych zakładów i linii produkcyjnych kupowane są nowe maszyny i budowane do nich instalacje oraz systemy. Strumień sprzedaży dla przemysłu tworzą też elektronika profesjonalna, energoelektronika, motoryzacja, systemy alarmowe. Nie są to filary rynku odpowiedzialne za zbyt przekaźników, ale z pewnością mające znaczenie.

Liczne inwestycje producentów europejskich w automatyzację produkcji spowodowały, że wytwarzanie przekaźników wymaga mniej pracy ręcznej niż dawniej, więc jakość jest lepsza przy jednocześnie niższej cenie. Ceny przekaźników markowych nie są już dzisiaj w dużej dysproporcji w stosunku do tych tańszych i nierzadko różnica pomiędzy wersjami staje się niewarta starań. Co więcej, w ostatniej dekadzie w technologii przekaźników zaszło sporo korzystnych zmian poprawiających jakość i trwałość tych elementów, przez co działy utrzymania ruchu w przemyśle kupują obecnie relatywnie mniej tych elementów niż kiedyś. To też ogranicza zapędy do oszczędzania.

Przede wszystkim przemysł

Rozwój rynku przekaźników determinują głównie zastosowania przemysłowe, co wynika po prostu z tego, że niezmiennie od lat branża ta jest wiodącym odbiorcą tych komponentów, wykorzystując je w instalacjach, urządzeniach i maszynach oraz komponentach automatyki przemysłowej. Wiele krajowych firm produkuje i eksportuje urządzenia dla przemysłu, takie jak sterowniki, regulatory, urządzenia pomiarowe, styczniki, systemy bezpieczeństwa i nadzoru. Rośnie nieustannie skomplikowanie procesów wytwarzania, które wykorzystują coraz więcej urządzeń i sprzętu technicznego. W ramach inwestycji i modernizacji starszych zakładów i linii produkcyjnych kupowane są nowe maszyny i budowane do nich instalacje i systemy. Wiele dzisiaj się mówi o wdrażaniu inteligentnych rozwiązań produkcyjnych, koncepcji Przemysłu 4.0 i tym, że w warunkach krajowych firmy produkcyjne stawiają na jakość. Te procesy co do zasady wiążą się z użyciem coraz to większej liczby urządzeń elektronicznych. W wielu z nich gdzieś jest zwykle jakiś przekaźnik.

Strumień sprzedaży dla przemysłu tworzą też elektronika profesjonalna, energoelektronika, motoryzacja, systemy alarmowe. Nie są to filary rynku odpowiedzialne za zbyt, ale z pewnością mające znaczenie. Niemniej rynek AGD wyraźnie stracił na znaczeniu, co jest skutkiem ekspansji przełączników elektronicznych.

Wiele pozornie drobnych usprawnień

Przekaźnik elektromagnetyczny jest komponentem znanym od dziesiątek lat, ale sukcesywnie wprowadzane są ulepszenia, które zapewniają, że produkty te cały czas ewoluują. Takie usprawnienia to m.in. coraz więcej wersji, gdzie moc pobierana przez cewkę została wyraźnie ograniczona, wersje ciche, przekaźniki bistabilne, rozwiązania z przyciskiem testującym, kontrolką, a nawet przezroczyste obudowy pozwalające na wizualną kontrolę stanu styków. Sporo usprawnień dotyczy podłączenia przewodu w wersjach przemysłowych, w tym popularyzacji zacisku sprężynowego, większej liczby dostępnych akcesoriów, większej oferty w zakresie przekaźników w obudowach szczelnych.

E-mobilność też tworzy zapotrzebowanie na wersje specjalne, a więc zdolne do komutacji wysokich napięć stałych, czyli wyposażonych w systemy gaszenia łuku elektrycznego, wersje ze stykami odpornymi na sklejanie się od wysokich prądów udarowych.

Warto też dostrzec, że rośnie liczba przekaźników z wbudowaną elektroniką do montażu na szynie DIN. Są to wersje czasowe, nadzorcze, wykrywające brak fazy, włączające oświetlenie na noc itp. Są to takie rozwiązania klasy "małej automatyki", czyli przekaźnik z dodatkiem, użyteczne, niedrogie. Sterowanie oświetleniem w garażu, wentylacją w hali, załączanie oświetlenia przeszkodowego i podobne zadania, nie wymagają złożonych sterowników oraz programowana, ale jednocześnie czegoś więcej niż sam przekaźnik.

Poza kwestiami technicznymi przekaźniki zyskują szczelne obudowy zapewniające odporność środowiskową, mające wzmocnioną izolację między cewką i stykami, a w ich kartach katalogowych pojawiają się kolejne certyfikaty jakości potwierdzające deklaracje producenta.

Komputery jednopłytkowe

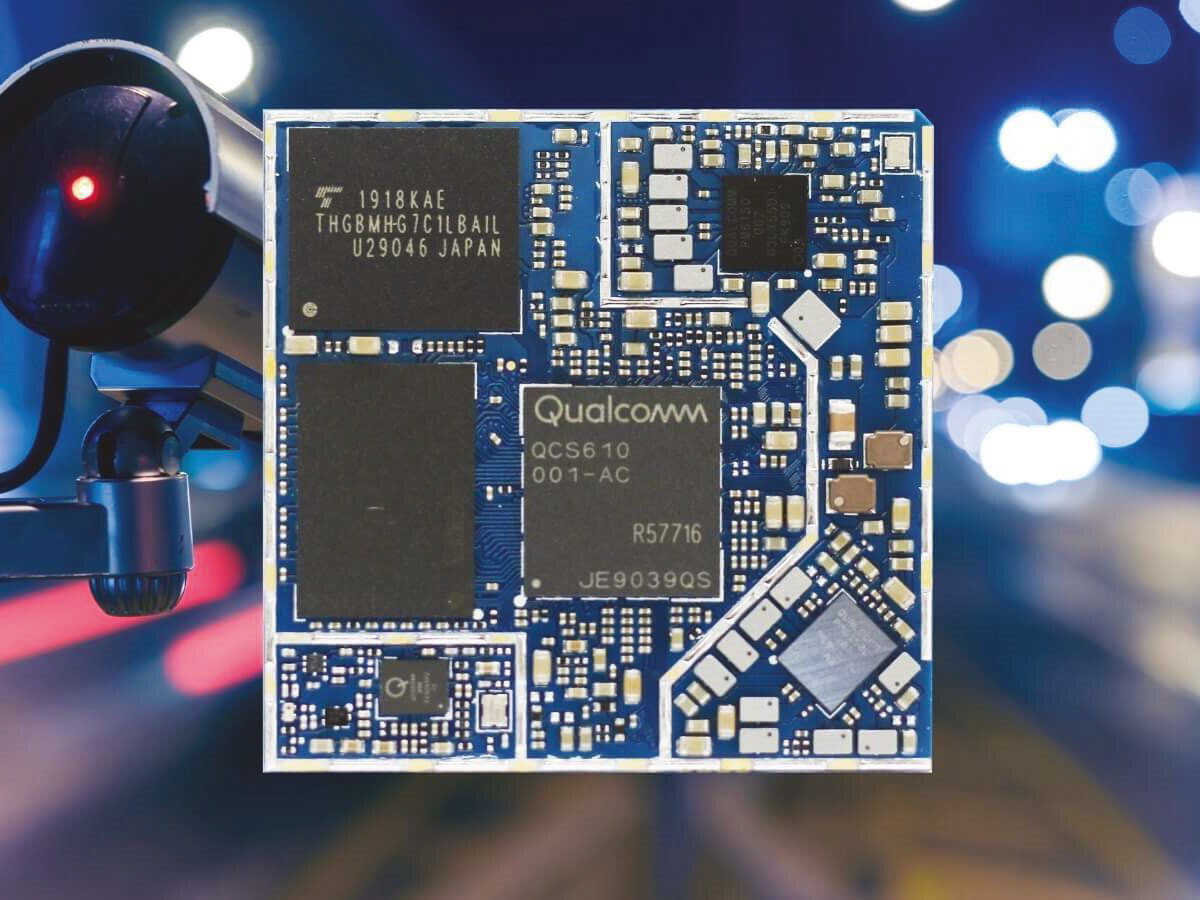

Komputery jednopłytkowe to produkty, które są dostępne w minimum kilkudziesięciu wersjach, typach, różniących się wyposażeniem, możliwościami i ceną. Celem jest to, aby zaproponować klientowi produkt jak najlepiej dopasowany do jego potrzeb, bez konieczności przepłacania za niewykorzystywane interfejsy, złącza, pamięć, komunikację itd. Nowe technologie w zakresie procesorów, zaawansowanie technologii półprzewodnikowej oraz technik pakowania w ramach układu SoC przynoszą nie tylko mniejsze wymiary płytek z komputerami, ale także coraz mniejszy pobór mocy i większe zasoby. Efekty są imponujące, bo nieźle wyposażony komputer zajmuje dzisiaj na płytce tylko 20 cm².

ile kiedyś na rynku komputerów jednopłytkowych wyścig technologiczny odnosił się głównie do rosnącej wydajności, to obecnie zdecydowana większość komputerów ma ją na tyle dużą, że wystarcza ona do ogromnej większości aplikacji, a liczy się pobór mocy, wysoka skala integracji w ramach jednego SoC, duża liczba dostępnych interfejsów oraz często także wydajna grafika, pozwalająca wyświetlać multimedia. Najlepszy z punktu widzenia rynku jest produkt o dużej mocy obliczeniowej, ale mały i energooszczędny, na dodatek niedrogi. Oczywiście wiele tych zależności jest w opozycji do innych, np. wydajność vs. pobór mocy, ale co do zasady producenci nieustanne starają się wypracować jakiś jeszcze lepszy kompromis. Efektem jest szybki postęp technologiczny oraz wiele interesujących produktów i nowości pojawiających się co roku w sprzedaży.

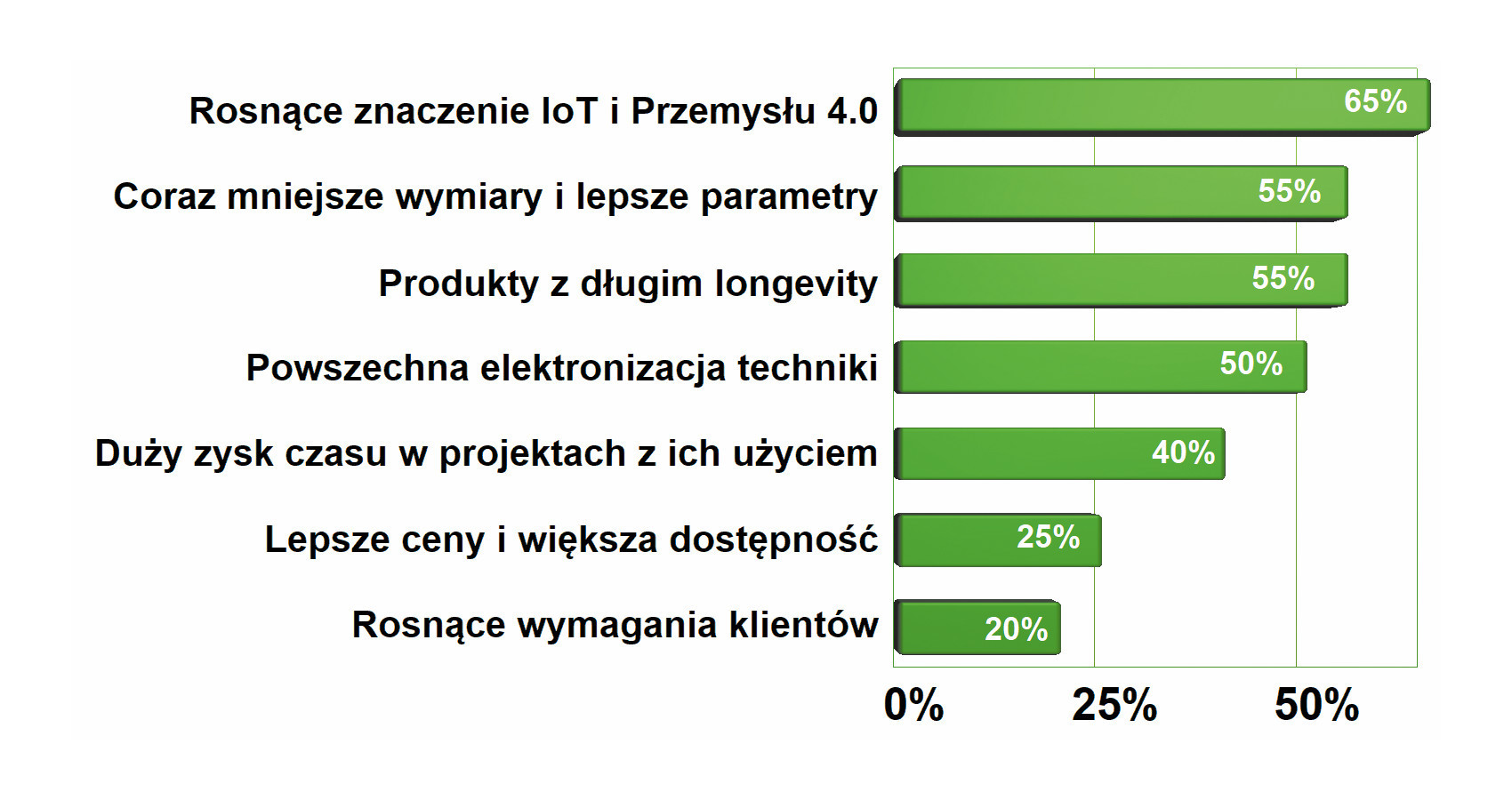

IoT i przemysŁ 4.0

Przemysłowy Internet Rzeczy oraz Przemysł 4.0 to dwa ważne trendy, które zmieniają współczesną elektronikę i często rozwiązania tego typu opierają się na użyciu komputera jednopłytkowego: standardowego, SoM/ CoM lub w postaci jakiejś popularnej platformy open source. Urządzenia tego typu wykorzystywane są w automatyce przemysłowej, sieciach komputerowych i telekomunikacyj nych, a także wszystkich aplikacjach "smart". Są bazą automatów sprzedaży, kiosków informacyjnych, stacji pomiarowych, rozrywki i reklamy. Są to przykłady takich rozwiązań, gdzie niezbędny jest jakiś komputer. Można dyskutować, czy w danym zastosowaniu wystarczy jeszcze mikrokontroler, czy już potrzebna jest większa wydajność, ale w praktyce decyzje są wielowymiarowym zagadnieniem. Coraz większa ilość zbieranych danych, przetwarzanie ich na krawędzi (wejściu) w oparciu o algorytmy AI/ML, większe wymagania co do wizualizacji, pracy w czasie rzeczywistym i podobne czynniki powodują, że trzeba sięgać po coś lepszego w zakresie funkcjonalności, czyli mikroprocesor. Komputer jednopłytkowy, duży lub mały SoM staje się w takich okolicznościach adekwatny.

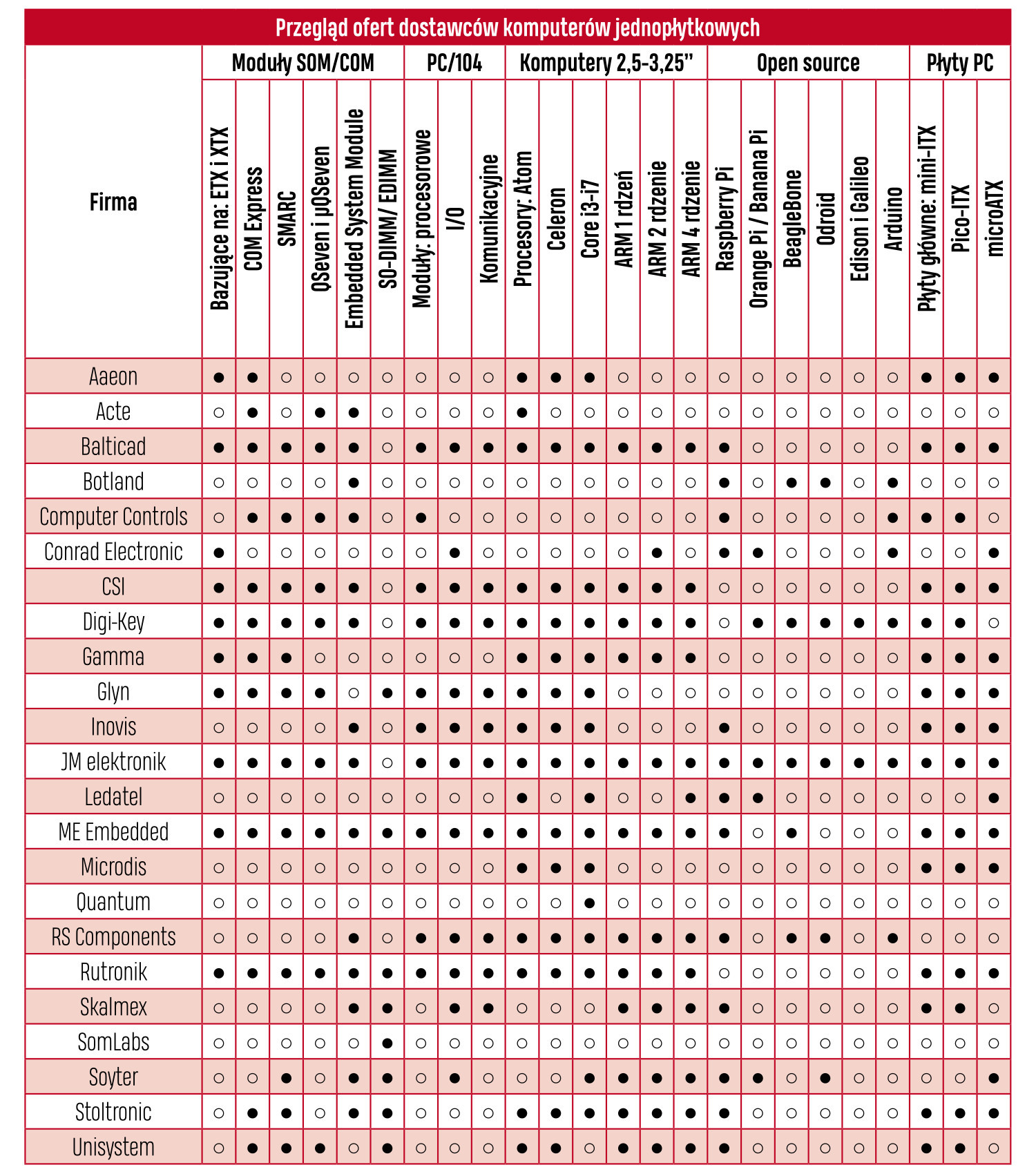

Standard mechaniczny, czyli Form Factor

W obszarze komputerów jednopłytkowych ważną rolę odgrywają standardy zapewniające możliwość korzystania z produktów wielu producentów. Chodzi o zapewnienie zgodności mechanicznej i pinowej, użycie jednakowego złącza, zasilania itd. Korzystając z rozwiązań standardowych, można zapewnić sobie większą swobodę wyboru producenta. Oparcie projektu na popularnym standardzie jest istotne, gdy trzeba zapewnić długoterminową dostępność produktów, np. rzędu 15 lat. Dostępność komputerów z wielu źródeł zaopatrzenia jest w tym bardzo pomocna, czyli standaryzacja łagodzi nieco problemy z niedostępnością elementów. Jest wiele różnych źródeł komputerów jednopłytkowych w określonych standardach rozmiarów, np. 3,5", co sprawia, że szukanie zamienników i reagowanie na problemy z dostawami jest prostsze.

Standard to z reguły tzw. form factor (kształt i wymiary produktu), który determinuje podstawowe cechy płytek zawierających komputery jednopłytkowe, w tym rozmieszczenie złączy, punkty mocowania, chłodzenie, podłączenie zasilania. Co do zasady, specyfikacje elektryczne, użyte chipy i procesory nie mieszczą się w tej definicji. Za standardem wymiarowo- pinowym zwykle kryje się jakieś stowarzyszenie czy konsorcjum, które dba o promocję, zgodność produktów pomiędzy producentami i o podobne działania.

Wspólną cechą jest to, że jest ich dużo, aby łatwo było się rozeznać, bo często w ramach danej grupy funkcjonują jeszcze podformaty. Na przykład w ITX kryją się: Mini, Nano, Pico i Femto. W innych rozwiązaniach te wariacje na temat się numeruje albo dodaje literki wskazujące na typ użytej magistrali, jak PCIe104, PCI104 Express, lub podkreśla większą funkcjonalność jak w PC104-Plus. Duże płytki, takie jak EBX, można rozbudować o moduły, w tym o warianty PC104, co sprawia, że są to rozwiązania konfigurowalne. Z kolei format EPIC charakteryzuje się tym, że płytki takie mają zwykle wiele linii I/O, zunifikowane złącza wzdłuż krawędzi płytki drukowanej i możliwość układania modułów rozszerzeń PC104- Plus.

Standardy są popularne w branżach i zastosowaniach: automatyce, branży rozrywkowej lub wojsku. Te dla hobbystów i makerów, w tym Raspberry Pi (85 × 56 mm), rzadko mają te branżowe rozmiary. Część producentów nie zaprząta sobie głowy normalizacją i tworzy własne konstrukcje – popularnym formatem jest płytka o wielkości pamięci DRAM do peceta, bo łatwo dla niej kupić złącza i wiele oprogramowania inżynierskiego ma takie komponenty w bibliotekach. W przypadku modułów COM/SOM standardów nie ma wcale, tak samo kompatybilności pinowej, za to są maleńkie wymiary, np. moduły procesorowe 40 × 40 mm lub komputerki w formacie karty PCI Express Mini 51 × 35 mm.

Kolejną cechą charakterystyczną jest to, że kolejne wersje są coraz mniejsze. Większość nieprzemysłowych i niestandardowych SBC jest również bardzo mała, dlatego form factor rozmiar nie jest w ich przypadku tak ważny. Eksperci twierdzą, że kształt płytki zbliżony do kwadratowego najlepiej zmniejsza skutki wstrząsów i wibracji, a także pomaga w uzyskaniu stabilnego mocowania, ale faktem jest, że znakomita większość omawianych produktów jest prostokątna.

Komputery jednopłytkowe SOM/COM

Są to małe modułowe rozwiązania pozwalające na zamontowanie ich na własnej płycie bazowej (aplikacyjnej) w podstawce. Długa żywotność, doskonałe parametry, możliwość wymiany na wersję o większych zasobach, przetestowana i dopracowana w szczegółach konstrukcja razem z atrakcyjną ceną są najważniejszymi atutami takich rozwiązań.

Gdy taki komputer przestanie być dostępny lub nie będzie w stanie zapewnić wystarczających zasobów, można go stosunkowo łatwo zastąpić nowszym, podczas gdy reszta systemu, w tym I/ O, zasilacz, złącza, okablowanie i wymiary fizyczne pozostają dokładnie takie same. Pozwala szybko i ekonomicznie nadążać za rozwijającą się technologią. Można też łatwo przejść do innej marki w razie problemów z jakością, dostępnością lub ceną. Ponadto klienci mogą tworzyć wiele konfiguracji swoich systemów, wybierając dla każdego inny moduł na podstawie wymaganej wydajności i przy założonej cenie.

Komputery tego typu są małe, ale z reguły bez kompromisów w zakresie zasobów. Są wyposażone w wiele interfejsów przewodowych (Ethernet, HDMI, USB, SATA, M. 2, Display Port, GPIO) i bezprzewodowych (Wi-Fi/Bluetooth). Z uwagi na małe wymiary muszą być zamontowane na płycie bazowej (carrier), która rozprowadza ich magistralę na standardowe złącza peryferyjne. Takie podejście jest ekonomiczne, bo płyta bazowa nie musi być wielowarstwowa. Oczywiście nie każdy komputer ma wszystkie interfejsy, ale właśnie o to chodzi, aby kupować rozwiązania bez przepłacania za nadmiarowość. SoM/CoM zapewnia kompletne, bezproblemowe rozwiązanie, gotowe do użycia łącznie z oprogramowaniem, gdyż producenci poza sprzętem dostarczają obrazy systemów (Linux, Android).

Podobnie jak w przypadku SBC tu także istotne są wymiary, z tym, że "form factor" nazywa się tutaj "footprint", a rozkład wyprowadzeń nazywa się "type". Jest około 8 typów, przy czym najczęściej używane rozkłady wyprowadzeń to "Type 6" i "Type 10".

Popularne formaty (footprint) to COM Express: mini (55 × 84 mm), compact (95 × 95 mm), basic (95 × 125 mm) i extended (110 × 155 mm). Oddzielną kategorią formatową jest wykonanie podobne do modułu pamięci laptopowej SODIMM (67 × 32 mm), które pozwala użyć tych samych podstawek. Jeszcze inne formaty funkcjonujące na rynku to Qseven i SMARC.

Czym się różnią SBC, SOM/COM?

SBC, to zwyczajowa nazwa małego komputera wykonanego w formie jednej płytki drukowanej, ale zawierającego złącza interfejsów i zintegrowane elementy peryferyjne (np. moduł komunikacji bezprzewodowej, dysk SSD, moduł TPM). Jest to produkt gotowy do działania, który nie wymaga żadnych prac przygotowawczych po stronie hardware.

Moduł SoM (System-on-Module) lub CoM (Computer on Module) to także komputer wykonany w formie małej płytki, integrujący zazwyczaj mikroprocesor (MPU), pamięci RAM i Flash oraz – opcjonalnie moduł radiowy Wi-Fi/BT. Na złączach SoM dostępne są konfigurowalne sygnały I/O interfejsów dostępnych w MPU, które użytkownik/ projektant samodzielnie konfiguruje, dostosowując je do potrzeb aplikacji. SoM-y wymagają zaprojektowania przez użytkownika carrier-boarda, który będzie wyposażony w peryferia wymagane przez aplikację docelową (interfejsy komunikacyjne, dysk SSD, modem LTE, specyficzne interfejsy komunikacyjne itp.).

Zwykle w tej roli jest używana płyta bazowa (carrier) dostarczana przez producenta SOM-ów razem w komplecie, ale finalnie producenci opracowują własne, specyficzne rozwiązania płyty bazowej (tzw. aplikacyjne). Zatem SBC to kompletny komputer o ustalonej przez producenta konfiguracji sprzętowej, podczas gdy system na SoM składa się z co najmniej dwóch płytek.

Czasy dostaw są dotkliwym problemem

Długie czasy dostaw negatywnie oddziaływają na całą branżę elektroniki, a na część związaną z komputerami jednopłytkowymi wpływ ten jest bardzo duży. Na skutek tego projekty ulegają raczej skróceniu i rozdrobnieniu, np. zamiast finansować rozbudowany projekt, klienci wolą mniejsze urządzenia, ale z możliwością modularnego rozbudowywania w przyszłości. Bo w ten sposób ponoszą mniejsze ryzyko. W świecie komputerów jednopłytkowych to zjawisko premiuje wersje standardowe (wymiary, rozkład wyprowadzeń), bo ułatwia zamianę w razie pojawienia się kłopotów. Mikroprocesor jest cały czas najważniejszym komponentem w omawianych produktach, ale z innymi rynek też ma kłopoty, np. modułami do komunikacji bezprzewodowej, pamięciami, a nawet podzespołami pasywnymi.

A kolejnym kłopotem są podwyżki cen

Braki oznaczają coraz wyższe koszty komponentów. Ceny poszukiwanych, zaawansowanych elementów elektronicznych zostały wywindowane przez spekulację, zdublowane zamówienia oraz przez gromadzenie zapasów. Dla większości przedsiębiorstw widmo przestojów w produkcji, opóźnień w realizacji projektu, groźba niedotrzymania warunków umowy oraz inne podobne zjawiska prowadzą do wzrostu presji na dział zakupów i niestety konieczności płacenia dużo więcej. Kiedyś ratunkiem były źródła azjatyckie, ale teraz tam też ceny wzrosły. W efekcie wzrostu cen materiałów, kosztów pracy i mediów konieczne staje się przeliczenie opłacalności wielu inwestycji i projektów.

Konkurencja ze strony platform open source będzie się zwiększać

Wykorzystanie sprzętu o gorszych właściwościach w bardziej zaawansowanych aplikacjach zawsze było widoczne na rynku elektroniki i dotyczyło wielu branż, łącznie z wojskiem, gdzie "commercial-of-the-shelf", czyli seryjny produkt komercyjny dostępny "z półki" w zastosowaniu wojskowym, jest od wielu lat uznanym podejściem projektowym. Najczęściej zjawisko to dotyczy zakresu temperaturowego i urządzeń przeznaczonych do pracy na zewnątrz budynków, także tych działających w trudnych warunkach przemysłowych, systemach monitoringu i bezpieczeństwa, automatach sprzedaży itp.

W takich aplikacjach próbuje się używać tańszych produktów konsumenckich, wszędzie tam, gdzie warunki nie są aż tak bardzo krytyczne, zastosowania nie tak odpowiedzialne jak w systemach mission critical, a rynek jest wrażliwy na cenę, jest szansa, że może się to udać, o ile aplikowanie sprzętu konsumenckiego nie będzie całkowicie bezmyślne. Wraz ze wzrostem zaawansowania technologii półprzewodnikowej nawet tanie chipy działają w relatywnie szerokim zakresie temperatur i granice między tymi do zastosowań profesjonalnych i konsumenckimi nie są tak wyraźnie rozdzielone. Tańsze procesory i pamięci produkowane są na tych samych urządzeniach i liniach technologicznych co inne i zakres temperaturowy ustalany jest za pomocą selekcji u producenta. Zwykle mają spory zapas w stosunku do specyfikacji i na tym opiera się cały koncept. Skutkiem tych procesów jest to, że tanie i popularne komputery jednopłytkowe, czego doskonałym przykładem może być Raspberry Pi, mają całkiem dobre parametry środowiskowe i są z powodzeniem aplikowane w aplikacjach komercyjnych, odbierając rynek rozwiązaniom specjalizowanym.

Platformom open source najbardziej brakuje wieloletniej dostępności, przez co ich możliwości aplikacyjne sięgają jedynie obszaru półprofesjonalnego, a więc takiego o łagodnych wymaganiach i aplikacji, które nie są wytwarzane latami. Ale cały czas jest dla nich sporo zastosowań. Oczywiście szybka ewolucja rynku produktów tej kategorii jest problemem, bo nowości pojawiają się bardzo często i równie szybko mogą zniknąć. Brakuje też stabilności oprogramowania, wersji produktu i spełnienia wielu innych kryteriów charakterystycznych dla świata profesjonalnego, niemniej część projektów jest w ten sposób realizowana.

Rola takich komputerów może w przyszłych latach jeszcze się trochę zwiększyć, gdyż oferta produktowa szybko się poszerza w kierunku bardziej wydajnych i rozbudowanych sprzętowo jednostek, bazujących na 32-bitowych rdzeniach mikrokontrolerów.

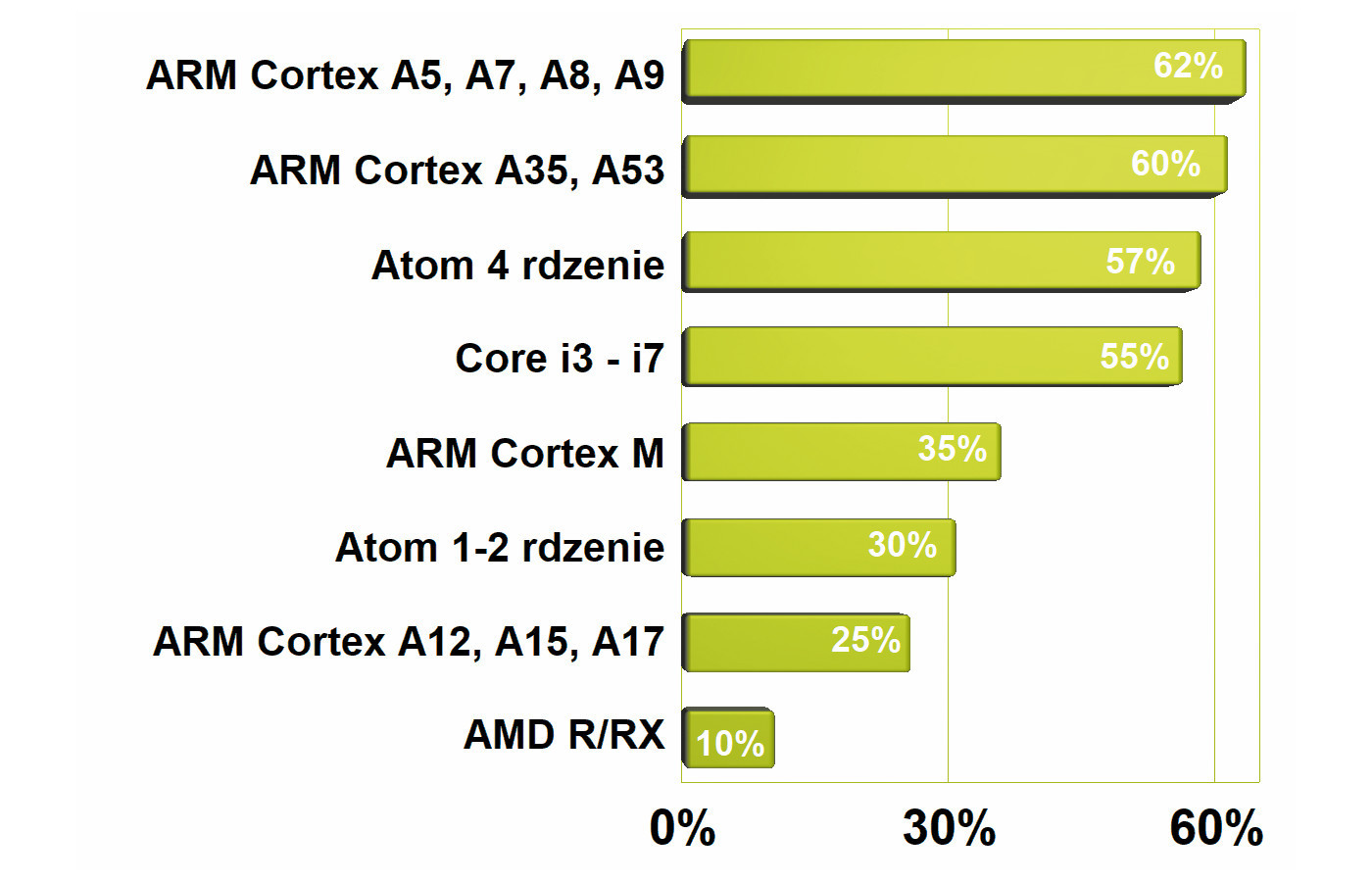

ARM-y na szczycie

Od wielu lat w obszarze komputerów jednopłytkowych procesory ARM systematycznie umacniały swoją pozycję, gdyż zapewniały małe zużycie energii przy wystarczającej wydajności. Nie wymagały do pracy wentylatorów i można było je łatwo zintegrować z innymi blokami funkcjonalnymi w ramach SoC. ARM-y w świecie SBC korzystały ponadto z pozycji jaką elementy te mają na innych rynkach, a więc dużej dostępności od wielu producentów, wielu narzędziom i oprogramowaniu projektowemu oraz także bardzo przekrojowej ofercie, w której każdy mógł znaleźć dla siebie dobrze dopasowane rozwiązanie.

Mamy układy z rodziny Cortex- M o niewielkiej mocy obliczeniowej znane ze świata mikrokontrolerów, są wydajniejsze jednostki 32-bitowe Cortex- A5-A9 i 64-bitowe takie jak Cortex- A35, A53. W sumie jest to kilkadziesiąt rdzeni, które każdy z producentów obudowuje w liczne układy peryferyjne: interfejsy, komunikację, tworząc dziesiątki, jeśli nie setki wersji.

Procesory ARM stopniowo przejmowały udziały w rynku, przede wszystkim kosztem Intela (Core i Celeron w wersjach embedded oraz Atom). 7‒8 lat temu ich udział w rynku można było szacować na 30‒40%, 3 lata temu układy Intela przeważały na wykresie popularności poszczególnych typów, a dzisiaj są na czele.

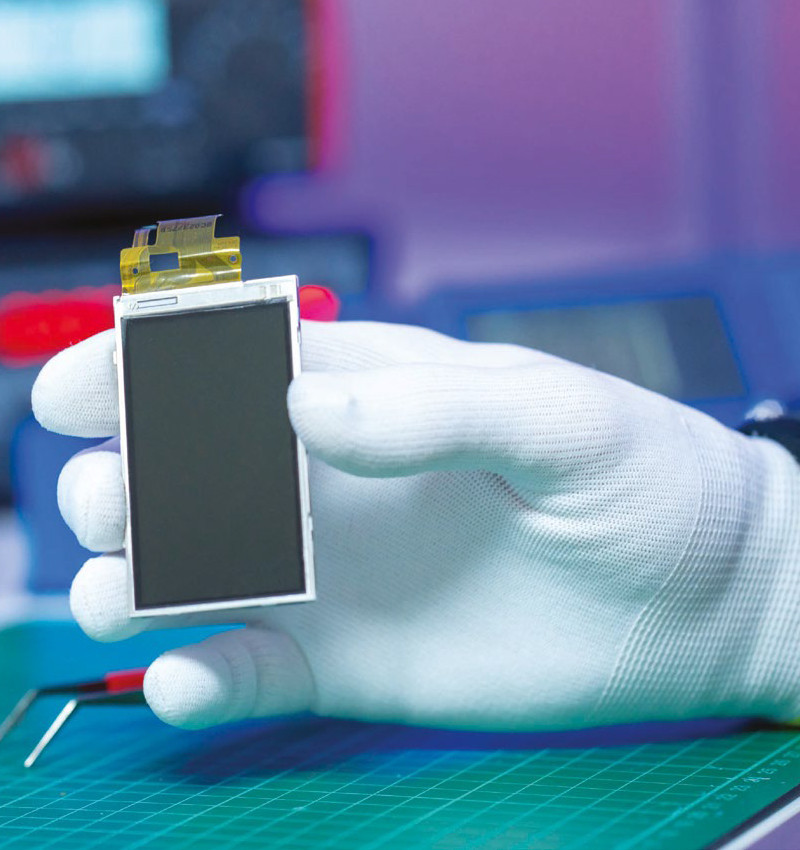

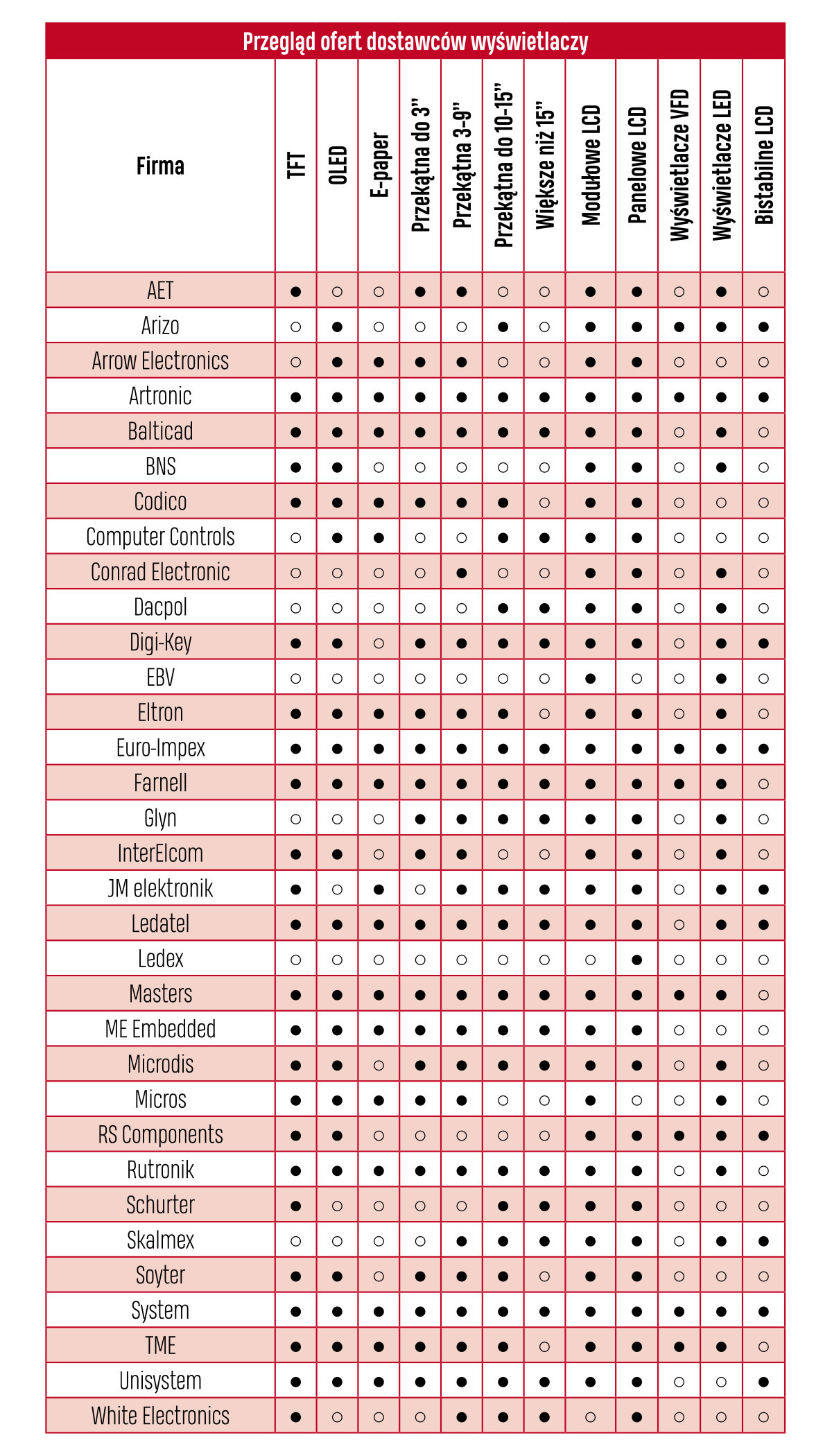

Wyświetlacze

Jasny i kontrastowy wyświetlacz o wysokiej rozdzielczości z ekranem dotykowym jest tym samym centralnym elementem wielu urządzeń elektroniki profesjonalnej i razem z mikrokontrolerem jest pierwszym komponentem, który wybiera się do nowych projektów. W konsekwencji rynek wyświetlaczy rozwija się bardzo dynamicznie, a nowości produktowe pojawiają się na nim co chwilę.

Nowości

Z racji dużego znaczenia i dużej liczby technologii funkcjonujących na rynku, nowości w zakresie wyświetlaczy też jest wiele. Nowych rozwiązań i dostępnych opcji jest na tyle dużo, że nie da się inaczej niż ogólnie ich opisać, bo niestety trzeba by się mocno zagłębić w szczegóły techniczne.

Rośnie liczba dostępnych przekątnych ekranu i rozdzielczości, jakie ma matryca, proporcji boków, dostępnych interfejsów. Pojawiają się zaawansowane kontrolery, opcje związane z szerokim zakresem temperatur pracy, dużym kątem obserwacji, czytelnością w warunkach silnego oświetlenia słonecznego. Dostawcy wyświetlaczy tworzą też grupy produktów, wokół których możliwa jest łatwa migracja, czyli zmiana wyświetlacza nie wiąże się z kłopotliwymi zmianami układu elektronicznego i dużymi modyfikacjami oprogramowania. Zwykle takie zmiany dotyczą wielkości przekątnej, rozdzielczości oraz typu panelu dotykowego, ale nierzadko sięgają też głębiej, obejmując zmiany technologii np. TFT na OLED oraz możliwość wybrania kilku opcji sterowania dotykiem (rezystancyjna, pojemnościowa, z opcją wielokrotnego dotyku).

Wersje dopasowane do aplikacji i integracja z obudową

Producenci elektroniki mają dzisiaj znacznie większe możliwości dopasowania wyświetlacza do projektowanego urządzenia, tak aby pasował idealnie pod względem elektrycznym, mechanicznym i funkcjonalnym. Potocznie nazywa się to kastomizacją (customizacją), co może brzmi okropnie, ale niestety na razie tak być musi, bo nie mamy w języku polskim jednowyrazowego terminu określającego dopasowanie produktu do specyficznych wymagań klienta.

Kiedyś kastomizacja była dostępna dla dużych firm, które były w stanie wyłożyć spore sumy pieniędzy na bezzwrotne koszty przygotowania zamówienia o indywidualnych cechach i oczywiście kupić też dużą partię. Dzisiaj próg wejścia jest znacznie niższy, a ponadto część prac biorą na siebie dystrybutorzy. Bezzwrotne koszty takich modyfikacji z roku na rok maleją i tym samym usługi stają się coraz bardziej przystępne. Polegają one na zamontowaniu wyświetlacza w obudowie w przygotowanym oknie, sklejeniu ekranu z panelem za pomocą kleju przeźroczystego w warunkach wykluczających pozostawienie brudu, przyklejenie ekranu płyty frontowej i podobnych czynnościach. Częściowe lub pełne dopasowanie do projektu klienta wyświetlaczy TFT, OLED, oraz paneli dotykowych polega dostosowaniu kształtu, rozmiaru, koloru oraz innych parametrów technicznych.

Usługi dotyczą też obudów, a więc montażu wyświetlacza w przygotowanym oknie. W przypadku wersji z dotykiem montaż ekranu jest bardzo istotny, bo musi zapewnić trwałość przy naciskaniu. Małe obudowy, trzymane w ręku, są podatne na wyginanie i montaż musi kompensować niewielkie przemieszczenia.

Nowe technologie stają się coraz bardziej dostępne

Wzrost zainteresowania e-papierem i OLED widoczny w ostatnich czasach to proces wynikający z tego, że na rynku elektroniki większe znaczenie mają aplikacje zasilane z baterii, a więc zagadnienia niskiego poboru mocy wysuwają się na pierwszy plan. Druga przyczyna to taka, że ceny tych produktów spadły i wyświetlacze te przestały być luksusem. Obie te technologie są znane od dwóch dekad, co oznacza, że właściwości, technologia, maszyny do produkcji zostały dopracowane, a wady "wieku niemowlęcego", np. związane z małą trwałością, już dzisiaj nie istnieją

.

problemu można kupić wyświetlacze tego typu o małych przekątnych, a więc takie, które najczęściej są używane w elektronice, zarówno jako elementy graficzne, jak i zamienniki alfanumeryczne dla typowych wersji modułowych. Podobne zjawiska można zaobserwować w zakresie wyświetlaczy typu e-paper, a więc w jednostkach, które wykorzystywane są w ksią żkach elektronicznych.

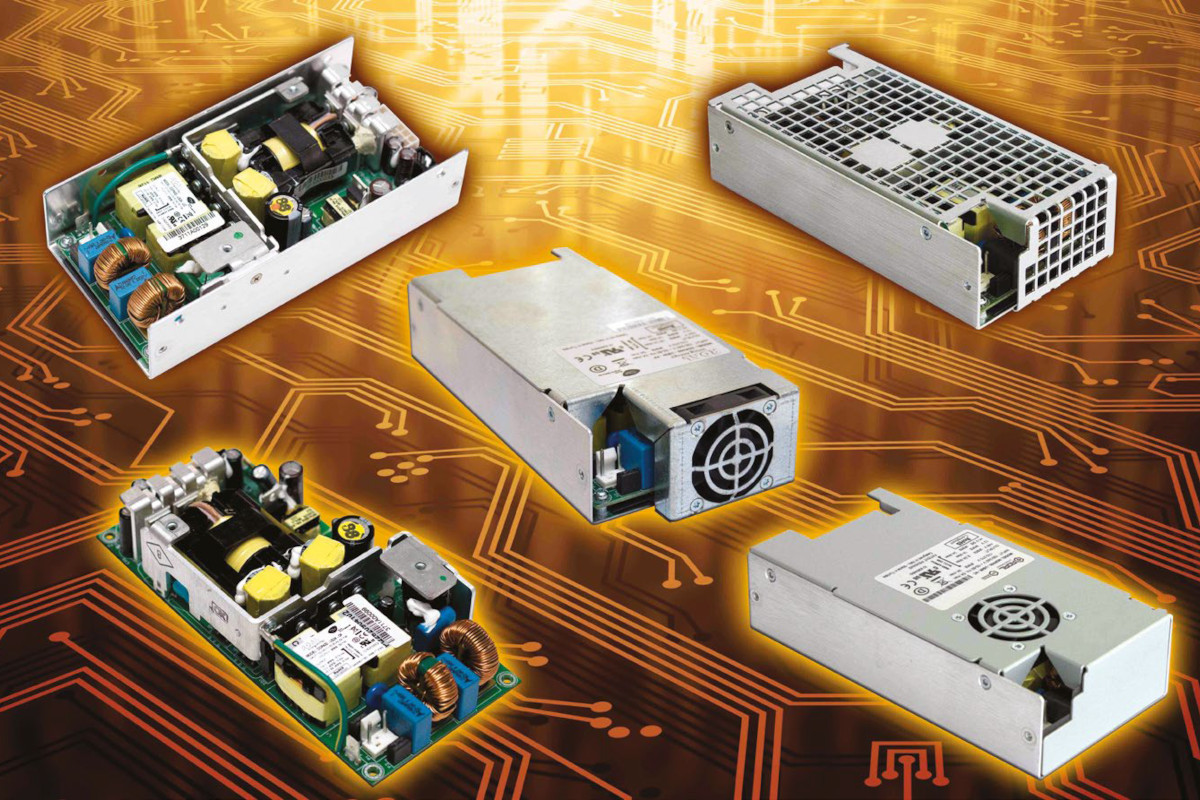

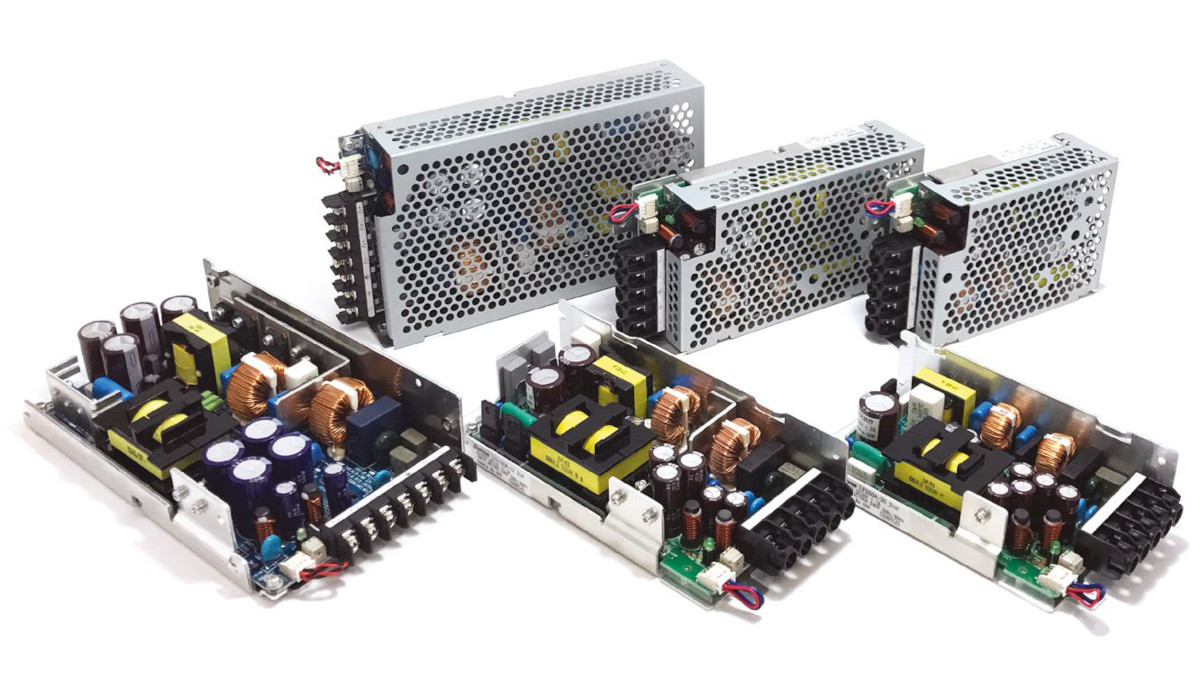

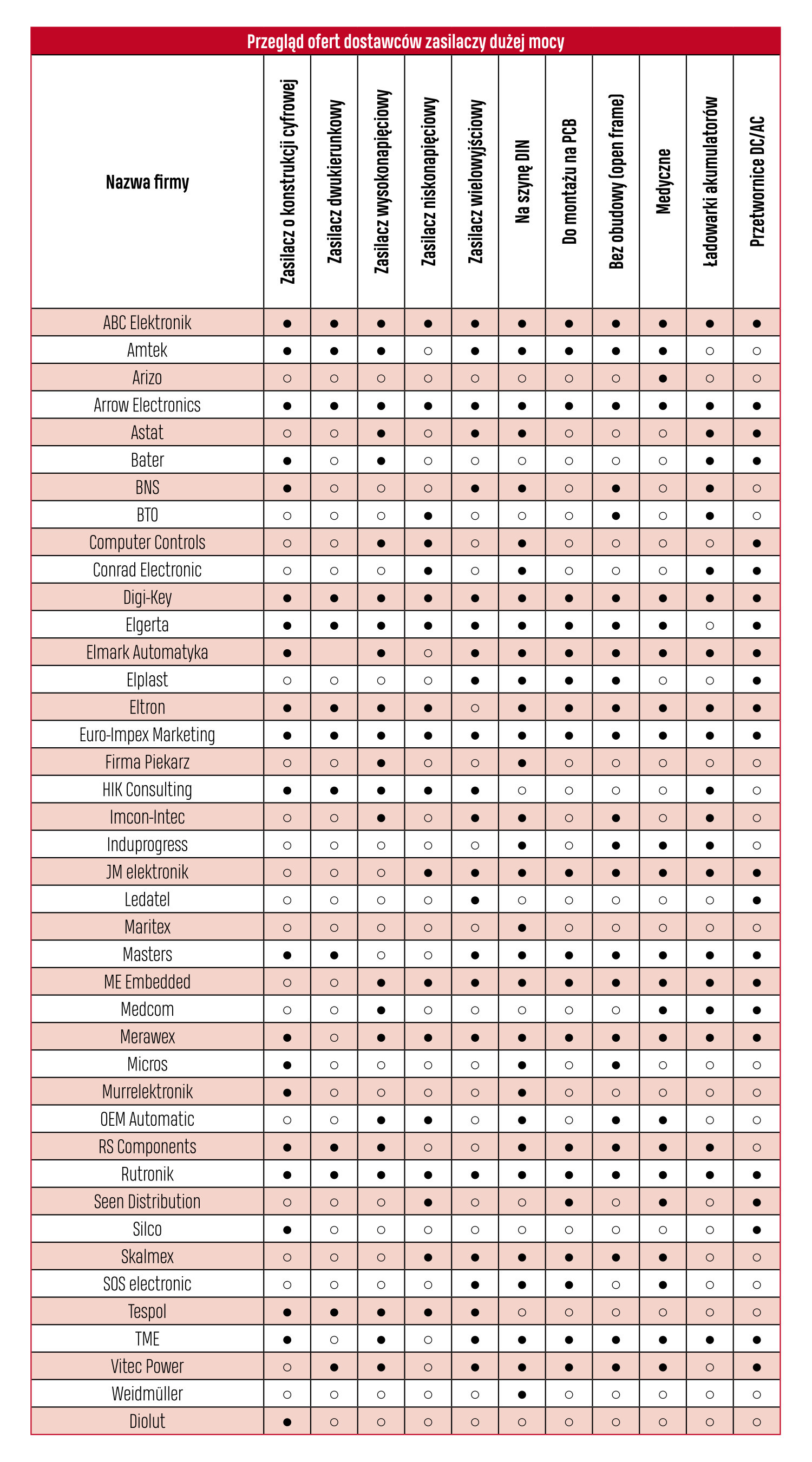

Zasilacze dużej mocy

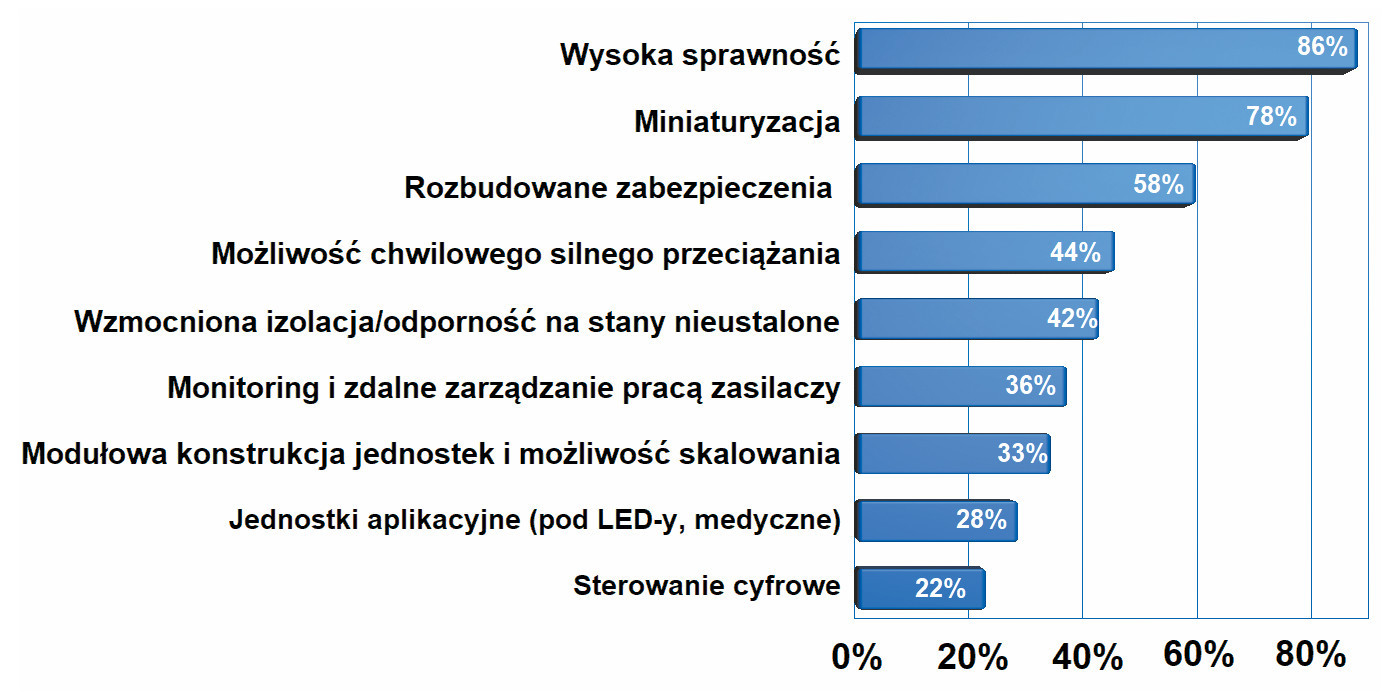

Do każdego urządzenia elektronicznego potrzebna jest energia, stąd zapotrzebowanie na zasilacze można wskazać w praktycznie każdej dziedzinie techniki, bo są to urządzenia uniwersalne i bez których nie można się obyć, dlatego wraz z inwestycjami w telekomunikacji, transporcie, w przemyśle, kolejnymi firmami, rynek zasilaczy znacząco się zwiększa i przyciąga nowych dostawców. Od zasilaczy żąda się coraz więcej, a lepsze parametry takie jak sprawność, miniaturowe wymiary lub zdolność do chwilowego przeciążania, muszą iść w parze z niską ceną, co sprawia, że tytułowy rynek jest bardzo wymagający.

Jeszcze dekadę temu miarę jakości zasilaczy tworzyła waga. Im zasilacz był cięższy, tym z reguły był lepszej jakości, bo lekki miał mniejsze radiatory, niewydajne filtry i transformator bez żadnego zapasu. Dzisiaj ta reguła niestety już tak nie działa, bo poszczególne jednostki mogą różnić się istotnie od strony technologii konwersji energii, a dodatkowo duża sprawność takich jednostek powoduje, że ogólnie zasilacze są lżejsze niż jeszcze parę lat temu.

Bez względu na to, szczęśliwie świadomość rynku co do istoty zagadnień zasilających się zwiększa tak samo jak podejście do jakości. Jest ona znacząco większa niż dla tych małych jednostek stosowanych w elektronice konsumenckiej. Klienci z branż odległych od elektroniki przemysłowej z reguły nie chcą płacić więcej za produkty renomowane i o gwarantowanej jakości, raczej kupują jednostki najtańsze i nawet jak później urządzenie nie działa prawidłowo, nie są w stanie powiązać anomalii z kiepskim zasilaniem i nietrafionym wyborem. Część z nich uczy się na błędach i takie ryzyko jest dla nich nauczką na przyszłość niemniej, ponieważ temat "psucia rynku" przez tanie zasilacze azjatyckie od lat jest dyżurnym tematem branży, zapewne takie wpadki nie są powodem do chwały i firmy skrzętnie je ukrywają. Ci związani z branżą profesjonalną działają bardziej odpowiedzialnie, stąd wybór produktu przez pryzmat niskiej ceny szczęśliwie nie jest jedynym obowiązującym.

Ogromna rola podzespołów SiC/GaN

W przypadku zasilaczy dużej mocy poprawa wielu ważnych parametrów technicznych wiąże się z użyciem nowych generacji podzespołów półprzewodnikowych. Dotyczy to wielu zagadnień, a przykładem może być mała moc pobierana z sieci bez obciążenia, która wynosi kilkadziesiąt miliwatów nawet w wydajnych, kilkusetwatowych zasilaczach przemysłowych. Aby zapewnić taki rewelacyjny wynik, konieczne jest użycie zaawansowanych kontrolerów scalonych, które potrafią dynamicznie zmieniać topologię konwersji energii w funkcji stopnia obciążenia, uruchamiają tryby oszczędnościowe, gdy zasilacz jest nieobciążony itp.

Zaawansowany kontroler zmienia też dynamicznie częstotliwość kluczowania tranzystorów po to, aby ograniczyć straty mocy wynikające z komutacji, a więc aby zapewnić większą sprawność zasilacza. Taki układ zwykle dzisiaj pracuje w topologii rezonansowej, która zapewnia małą emisję zaburzeń elektromagnetycznych i realizuje przełączanie tranzystorów w zerze napięcia lub prądu.

Kolejnym bardzo istotnym elementem są tranzystory przełączające, które powinny zapewnić małe straty na przewodzenie (jak najmniejszy spadek napięcia w czasie przewodzenia) oraz na komutację (w czasie przełączania). Dodatkowo tranzystory takie powinny mieć jak największe napięcie znamionowe. Zapewnia to oczywiście dużą odporność na przepięcia pojawiające się w sieci energetycznej, ale także ogranicza straty energii wynikające z konieczności tłumienia przepięć na transformatorze, powstających w wyniku przełączania.

Naturalnym kandydatem do nowoczesnej jednostki zasilającej są elementy wykonane z azotku galu, niemniej na razie nie widać na rynku, aby takie jednostki zasilającej się pojawiały masowo w ofertach. Rynek czeka na tanie tranzystory GaN oraz na ich dobrą dostępność. Na razie trafiają one głównie do elektrycznej motoryzacji, gdzie stanowią bazę konstrukcyjną inwerterów i konwerterów. W zasilaczach też niewątpliwie będą, ale prawdopodobnie jak rynek dystrybucji się uspokoi i ceny ustabilizują.

Zagadnienia związane z energią odnawialną i elektromobilnością

Coraz więcej systemów zasilających staje się bardziej skomplikowanych z uwagi na to, że nie bazują one już jedynie na jednym źródle energii, tj. sieci energetycznej. Popularyzacja energii odnawialnej i elektromobilności w transporcie wymusza dostosowanie zasilaczy także do takich źródeł i odbiorników. Oznacza to możliwość podłączenia akumulatora, zdolność do zasilania napięciem stałym wahającym się w szerokim zakresie, możliwość przeciążania i łączenia równoległego. To także działanie dwukierunkowe, w której kierunek energii może zostać odwrócony po to, aby doładować akumulator jako ładowarka. Taka funkcjonalność jest podstawą działania systemów odzyskiwania energii w napędach.

Sprawność jest i będzie bardzo istotnym parametrem

Duża sprawność konwersji energii zawsze jest istotnym parametrem selekcji zasilacza, bez względu na przeznaczenie i moc wyjściową. W przypadku jednostek dużej mocy przekracza ona już istotnie 90%, czasem jest to już nawet ponad 95% dla pełnego obciążenia i generalnie taki rewelacyjny wynik pozwala na wykonywanie zasilaczy mniejszych, bo w nich zagadnienia związane z odprowadzaniem ciepła nie są tak bardzo uwypuklone. Większa sprawność to mniej ciepła, a więc też mniejszy zasilacz. Ponieważ mniejszy, to też tańszy, a skoro jest on podczas pracy chłodniejszy, to zasilacz jest tym samym bardziej niezawodny. Są to proste zależności, które od lat zmieniają branżę od strony technologii. Mała, ale wydajna jednostka zasilająca ułatwia instalację, pozwala na lepszą integrację z konstrukcją urządzenia lub maszyny oraz z dużym prawdopodobieństwem jest nowocześniejsza od większych (starszych) rozwiązań.

Kolejny skok sprawności zapewnią nowe półprzewodniki, a więc GaN-y. Niemniej, aby trafiły pod strzechy, muszą być tańsze i dostępne, stąd cały czas zasilacze wykonane w tej technologii ogląda się niestety tylko na zdjęciach. Duża sprawność w kolejnych latach dalej będzie na topie, bo energia elektryczna drożeje. Wysoka sprawność to oszczędność energii zasilającej, a więc mniejsze rachunki, a także dzisiaj dłuższy czas pracy z danej pojemności akumulatora.

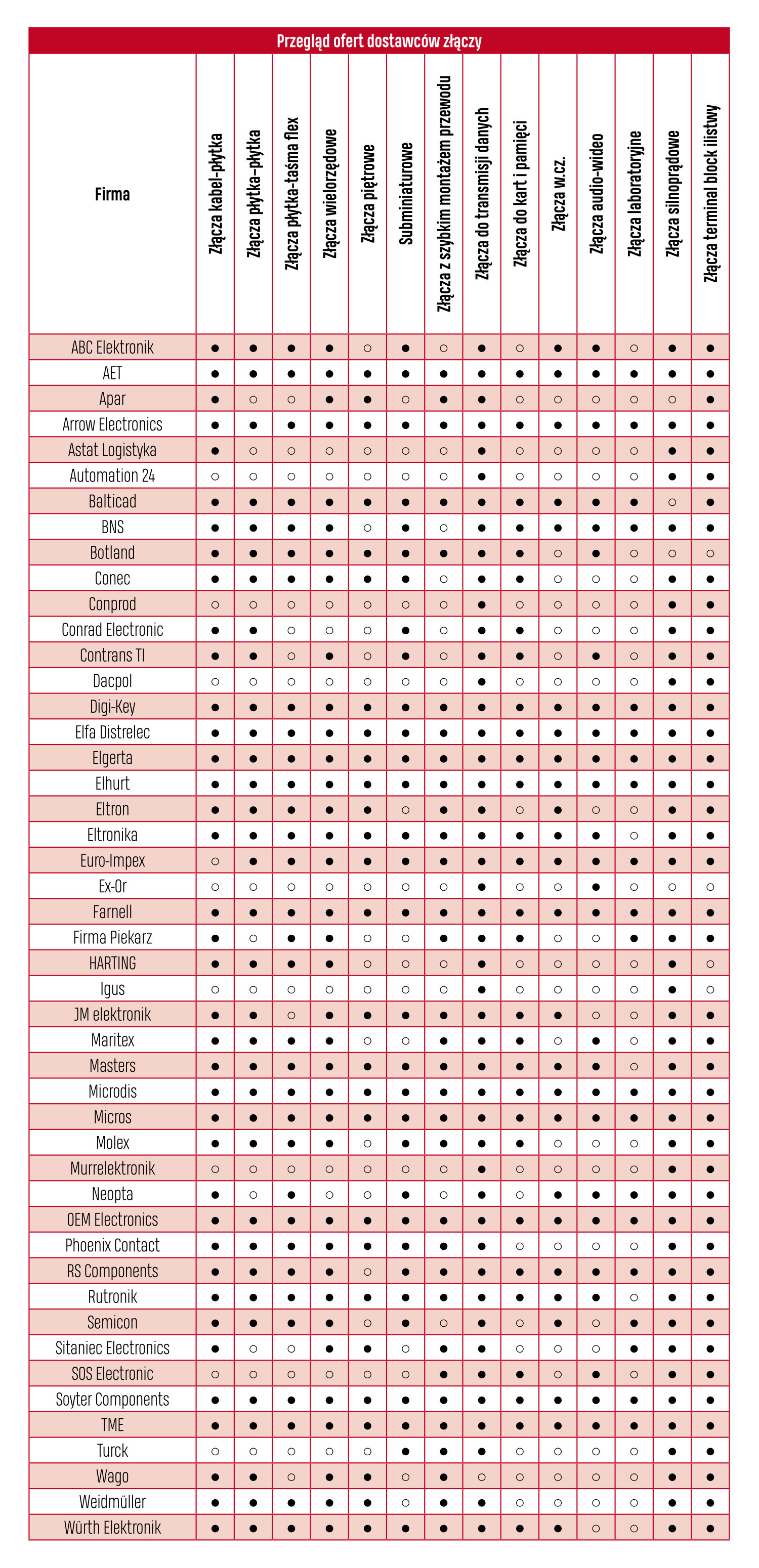

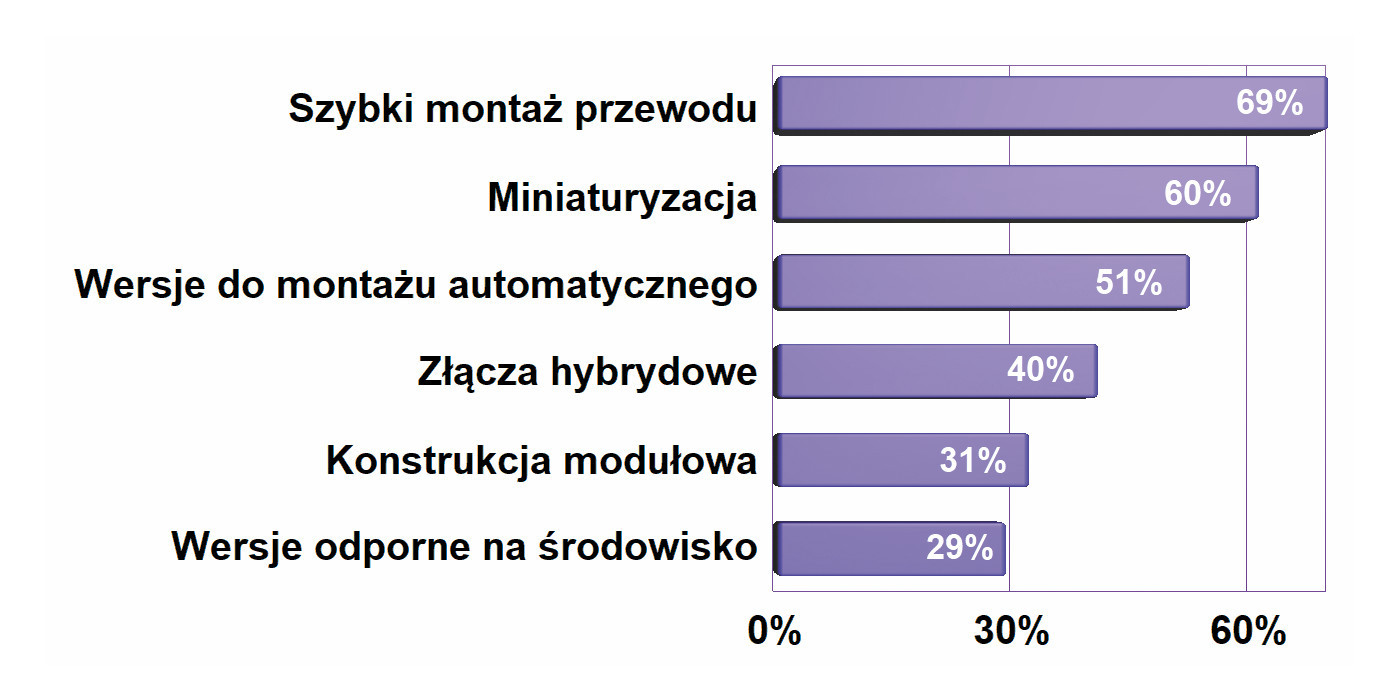

Nowoczesne złącza i innowacyjne systemy połączeniowe

Uszkodzenie pojedynczego złącza elektrycznego jest niekiedy w stanie zatrzymać pracę całego zakładu. Wybór odpowiedniego typu elementu może nie tylko zmniejszyć ryzyko wystąpienia takiego zdarzenia, ale także skrócić czas ewentualnego przestoju w przypadku awarii. Wybór właściwego złącza może mieć krytyczne znaczenie, szczególnie w aplikacjach przemysłowych, warto zatem przygotować się do tego zagadnienia starannie oraz z uwagą.

Charakterystyczną cechą rynku złączy jest bardzo mała standaryzacja tych produktów, co jest skutkiem istnienia dużej liczby producentów, ogromnego portfolio produktów i szybkiej ewolucji technologicznej (złączy i produktów je wykorzystujących). Ujednolicenie dotyczy niewielkiego obszaru produktów do zastosowań wojskowych, a w pozostałych obszarach aplikacyjnych standard to faktycznie popularne złącze mające wiele odpowiedników.

Z roku na rok na rynku funkcjonuje coraz więcej typów elementów o specjalizowanej konstrukcji pod kątem zastosowań i standardów branżowych. Rynek kieruje się ku specjalizacji, a ona wymusza tworzenie konstrukcji dopasowanych do wymagań aplikacyjnych, np. do nowej wersji interfejsu komunikacyjnego, do specyficznego czujnika itd. Poszerza to asortyment i pozwala producentom na ucieczkę technologiczną do przodu, w kierunku zaawansowania technicznego elementów połączeniowych, unikatowych rozwiązań styku, z drugiej strony niestety skraca czas życia produktów. Przykładem może być interfejs USB, gdzie nowa wersja "C" szybko wypycha obecnie na margines wersje "B".

Takie działania powodują, że liczba typów, wykonań, marek jest ogromna i sprawia klientom problemy z zaopatrzeniem. Gdy produktów jest mniej i daje się wyróżnić popularne i często używane typy, to czasy ich dostaw są krótkie, bo dystrybutorzy mają je często w lokalnych magazynach buforowych. W przeciwnej sytuacji trzeba czekać o wiele dłużej. Sytuacja ta sprzyja niestety dostawcom zamienników i wyrabia w klientach konserwatywne zachowania, bo nowe produkty kojarzą się z kłopotami.

Duży asortyment powoduje, że dokładna orientacja w ofercie ze znajomością szczegółów i niuansów staje się rzadkością, zwłaszcza w przekrojowym aspekcie obejmującym wielu producentów. Prowadzi to do wielu nietrafnych wyborów, preferowania tego, co się zna i wcześniej kupowało. Jednocześnie jest to znak, że wymagania klientów w zakresie wsparcia technicznego są duże, a firmy kompetentne mogą budować długofalowe relacje z klientami w oparciu o nie. Bo klienci zawsze wracają do tych, którzy się znają i pomagają w decyzjach i problemach.

Małe, ale bez kompromisów