Automatyka domowa i budynkowa

Główne korzyści, jakie przynosi automatyka budynkowa to przede wszystkim większy komfort osób, który w takim budynku codziennie przebywają lub nim zarządzają. Ponadto pozwala poczynić znaczne oszczędności finansowe, dzięki np. optymalizacji zużycia prądu, wyłączaniu zbędnych odbiorników oraz regulacji ogrzewania.

Teoria ta brzmi bardzo zachęcająco, ale trzeba przyznać, że opisane powyżej korzyści i realizowane funkcje nie są żadną nowością. Opis czym jest automatyka budynkowa został wypracowany wiele lat temu i cały czas jest aktualny. Zmienia się tylko rozłożenie akcentów. Dawniej wynoszony na piedestał był głównie komfort, w ramach którego pojawiało się sterowanie roletami w oknach i wyłączanie oświetlenia w nieużytkowanych pomieszczeniach. Potem doszły zagadnienia związane z komunikacją, integracją komponentów automatyki w system połączony siecią komputerową i integracja z oprogramowaniem zapewniającym dostęp z dowolnego miejsca za pomocą urządzeń mobilnych i Internetu. Gdzieś po drodze pojawiło się bezpieczeństwo (kontrola dostępu, monitoring, alarmy).

Dzisiaj nacisk kładzie się na funkcjonalność oprogramowania, w tym tworzenie scenariuszy sterowania pod kątem minimalizacji zużycia energii elektrycznej i innych mediów. Powodem jest oczywiście gwałtowny wzrost cen, który skierował uwagę firm i zarządców budynków na to, aby w jakiś sposób ograniczyć koszty. Komfort zdecydowanie ustąpił miejsca ekonomii i paradoksalnie jest to dobra wiadomość dla rynku, gdyż nic tak dobrze nie przemawia do wyobraźni jak mniejszy rachunek.

Kolejnym czynnikiem jest powiązanie automatyki budynkowej z instalacjami PV, magazynami energii, po to, aby lepiej zarządzać przepływami w takt zmiennych cen energii, taryf i warunków w zakresie nasłonecznienia.

Trendy techniczne rynku automatyki budynkowej

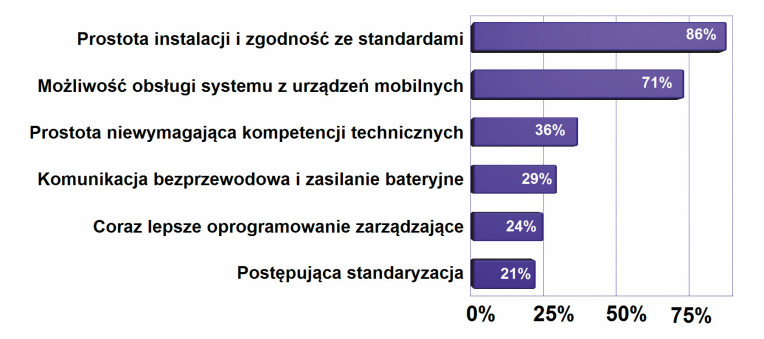

W zestawieniu najbardziej istotnych trendów zmieniających rynek automatyki budynkowej dwa kryteria wybijają się wyraźnie ponad resztę: prostota instalacji i zgodność ze standardami oraz możliwość obsługi z użyciem urządzeń mobilnych, czyli w praktyce ze smartfona. Inaczej mówiąc, liczy się funkcjonalność i łatwość użycia z wykorzystaniem aplikacji. Rola smartfonów w systemach automatyki jest duża i z pewnością będzie jeszcze się zwiększać, bo mają one duże możliwości (obliczeniowe, komunikacyjne) i zawsze mamy je przy sobie.

Podstawowe elementy systemu automatyki domowej

Typowy system automatyki domowej składa się z kilku grup różnych typów elementów. W zależności od rozmiaru i stopnia zaawansowania systemu dana grupa może być reprezentowana przez jeden lub więcej modułów.

Sterownik systemu (BMS) – jest zazwyczaj centralnym elementem, który pośrednio lub bezpośrednio zarządza pracą wszystkich podzespołów, obsługuje również komunikację z użytkownikiem. Może być zrealizowany m.in. w postaci systemu wbudowanego opartego na mikroprocesorze lub jako aplikacja uruchomiona na komputerze wyposażonym w system operacyjny.

Łącze komunikacyjne – zapewnia wymianę danych między poszczególnymi elementami systemu. Połączenie takie może zostać zrealizowane jako przewodowe lub bezprzewodowe.

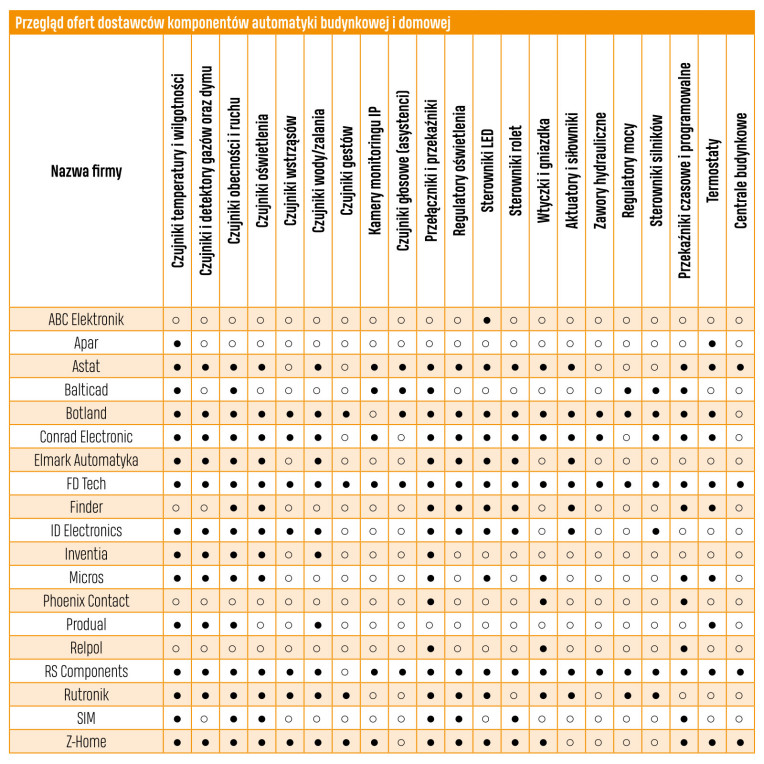

Czujniki oraz urządzenia wejściowe – za pośrednictwem modułów umieszczonych w różnych miejscach budynku system otrzymuje informacje nt. stanu otoczenia (czujniki) oraz polecenia od użytkownika (interfejsy wejściowe). Podstawowe typy obejmują sensory klimatu tj. temperatury, wilgotności, potem wersje alarmowe (obecności i ruchu, wstrząsów, pozycji drzwi i okien) oraz bezpieczeństwa jak detektory gazów. Elementami wejściowymi systemów są też kamery monitoringu, czujniki głosowe, czytniki RFID/ NFC. Na podstawie wskazań czujników oraz otrzymanych danych wejściowych system zarządza pracą elementów wykonawczych, takich jak np. ogrzewanie czy oświetlenie.

Urządzenia wykonawcze – a więc przełączniki i przekaźniki, sterowniki rolet, oświetlenia LED (do załączania, regulacji jasności i barwy światła). Są też zdalnie sterowane gniazdka, siłowniki, zawory do sterowania instalacją podlewania. To również termostaty i regulatory do kontroli klimatu.

Czynniki sprzyjające rozwojowi rynku automatyki budynkowej i domowej

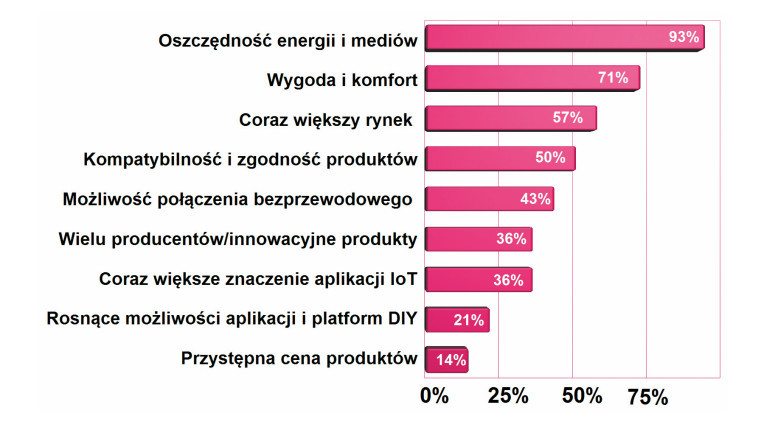

Aktualnie głównym i najważniejszym czynnikiem sprzyjającym rozwojowi rynku komponentów automatyki budynkowej są koszty związane z energią elektryczną i ogrzewaniem. Komfort i wygoda życia spadły na drugą pozycję i tym samym z systemów takich została zdjęta etykieta ekstrawagancji. Za istotne czynniki uznano ponadto coraz większą kompatybilność i interoperacyjność produktów pozwalających na mieszanie w instalacji różnych rozwiązań i marek, a także coraz większy rynek, który zaczyna osiągać potencjał przyspieszający rozwój przez analogię do kuli śnieżnej toczącej się z góry.

Przechowywanie danych – jak np. historii wskazań czujników czy zapisu z kamer wymaga pamięci masowej. Do tego wykorzystuje się głównie rozwiązania serwerowe (np. NAS). Wykorzystanie tego typu układów zwiększa jednak koszt uruchomienia oraz utrzymania systemu, projektanci muszą zatem często szukać kompromisu pomiędzy dostępną pojemnością pamięci a ceną systemu.

Układy zasilania – w systemach automatyki domowej wykorzystuje się różne rodzaje zasilania – od instalacji elektrycznej do zasilania bateryjnego lub akumulatorowego. Niektóre nowoczesne moduły są w stanie częściowo lub całkowicie pozyskiwać energię z otoczenia, wykorzystując np. energię świetlną czy fal radiowych. Podsystemy zasilania większości systemów mają kilka trybów pracy o różnym poziomie zużycia energii elektrycznej, jak np. czuwanie, uśpienie czy wysoka aktywność. Przełączanie pomiędzy tymi trybami może odbywać się automatycznie lub poprzez decyzję użytkownika.

Wiele standardów branżowych

Standardów branżowych, które są wykorzystywane w systemach automatyki budynkowej, jest wiele, a poza nimi spora część rynku obsługiwana jest z użyciem rozwiązań specyficznych dla producenta. Jak można wyczytać z przedstawionych w tym opracowaniu wykresów i z innych publikacji, funkcjonujących rozwiązań jest wiele, przez co kompatybilność produktów jest niewielka lub żadna.

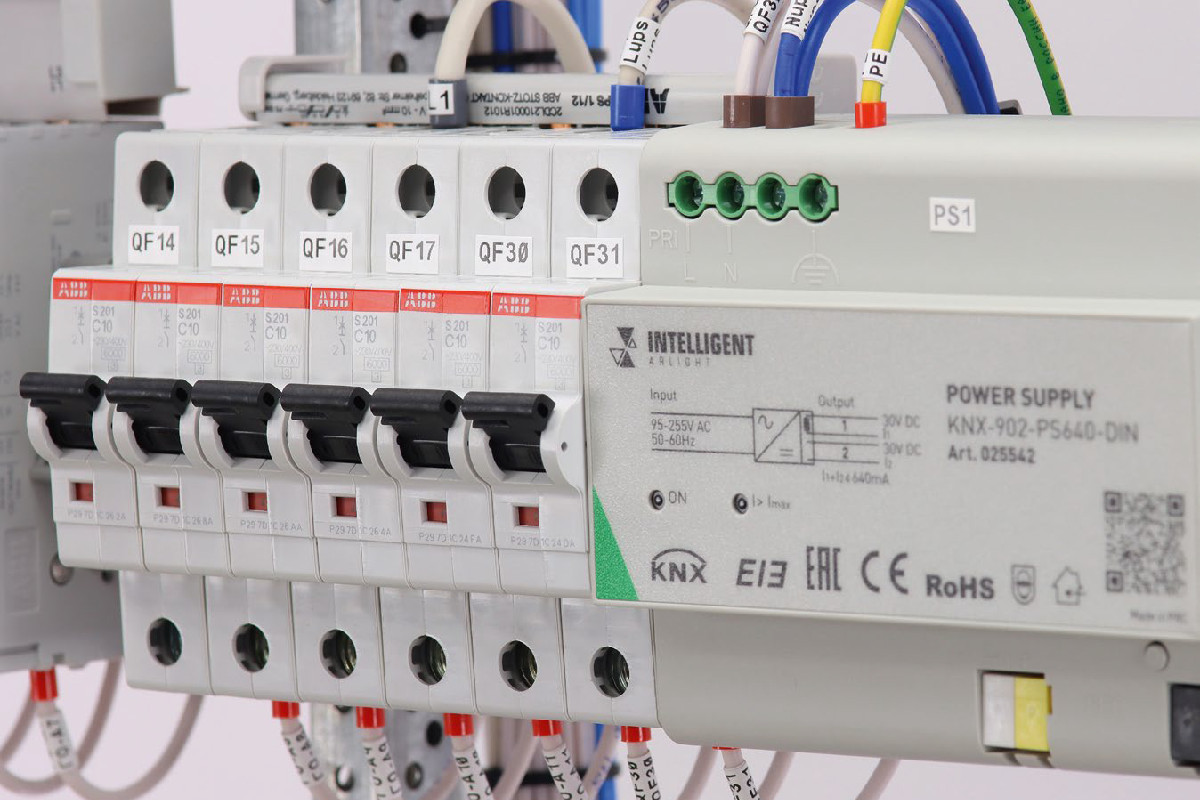

W zakresie rozwiązań przewodowych największą popularność ma KNX (dawniej EIB). Jest to otwarty standard powstały jako połączenie kilku protokołów i koncepcji rozwijających je organizacji: jak EIBA – European Installation Bus Association, European Home Systems Association oraz BatiBUS – BCI, Batibus Club International. KNX jest w stanie obsłużyć instalacje elektryczne, teletechniczne, HVAC, alarmowe, nagłośnienia, monitoring, zabezpieczenia budynków, opomiarowanie i wszystkie inne działające w budynku. Ma zatem duży potencjał i możliwości. Jednocześnie zapewnia energooszczędność, multimedialność i ogromną funkcjonalność. Na jego podstawie powstała europejska norma EN50090, a w kolejności protokół ten stał się standardem międzynarodowym (ISO) w zakresie automatyzacji budynków i urządzeń – ISO/ IEC 14543-3. Europejska organizacja normalizacyj na także uznała KNX za standard dla systemów automatycznego sterowania budynkami, publikując specyfikację KNX jako normy EN 13321-1 i EN 13321-2. Również Chiny uznały standard KNX, publikując w 2007 roku normę GB/Z 20965. Efekt tych działań jest taki, że KNX jest standardem wspieranym przez ponad 400 producentów sprzętu i w zakresie automatyzacji przewodowej dużych budynków może być postrzegany jako numer 1.

KNX jest systemem opartym na konwencji rozproszonej, dzięki czemu nie jest wymagana jednostka centralna. Każdy element magistralny podłączony do instalacji wyposażony jest w procesor i elementy niezbędne do samodzielnej pracy. Dzięki takiemu rozwiązaniu w przypadku awarii system – z wyjątkiem uszkodzonego elementu magistralnego – działa poprawnie, w przeciwieństwie do systemów scentralizowanych, w których podczas awarii cały system przestaje działać. Ale minusem jest to, że komponenty systemowe są bardziej rozbudowane od strony hardware.

Nie wiadomo, czy w przyszłości pozycja KNX się nie zmieni, bo szybko upowszechnia się SPE, czyli Ethernet działający na pojedynczej skrętce przewodów (KNX też jest 2-przewodowy). W zastosowaniach przemysłowych jest to już rozwiązanie popularne i doceniane, jeśli chodzi o możliwość tworzenia instalacji rozporoszonych. Ekspansja SPE w systemach automatyki budynkowej już się zaczyna i być może spowoduje to, że gwiazda KNX nieco przygaśnie, bo rozproszone systemy sterowania w przemyśle i automatyki budynkowej mają bardzo dużo wspólnych cech i transfer technologii jest nieunikniony.

Popularne rozwiązania bezprzewodowe to z kolei ZigBee i Z-Wave, doskonale znane od lat, pod kątem właśnie takich zastosowań opracowane i wreszcie zdobywające rynek. Niemniej rosnąca popularność rozwiązań IoT promuje też w omawianym obszarze Bluetooth LE, bo interfejs ten jest sprzętowo zaszyty w większości platform sprzętowych do takich zastosowań i dostaje się go praktycznie gratis. W zakresie domu istotny jest jeszcze PLC, czyli komunikacja po przewodach energetycznych.

Rozwiązania półamatorskie i hobbystyczne

Mówiąc o automatyce domowej, nie sposób pominąć konstrukcji hobbystycznych i półprofesjonalnych bazujących na gotowych platformach z mikrokontrolerami, głównie takich, dla których jest tworzone oprogramowanie w Arduino IDE. Popularność takich rozwiązań jest największa w systemach o niewielkiej skali działania, stąd raczej ograniczonych do domu niż budynku.

W oparciu o gotowe moduły nietrudno wykonać czujniki i elementy wykonawcze komunikujące się przez Bluetooth lub Wi- Fi (ESP 32), zasilane z baterii i co najważniejsze, bardzo tanie. Oprogramowanie dla typowych zadań jest praktycznie dostępne gotowe i za darmo, bo są to rozwiązania open source. Dzięki temu nakład pracy i potrzebne umiejętności nie są wcale duże. W ramach systemów open source są też dostępne darmowe aplikacje i duże systemy kontrolne pełniące funkcję BMS. Przykładem może być Domoticz, który uruchamia się na różnych systemach operacyjnych, w tym serwerach NAS Synology wykorzystywanych do obsługi kamer monitoringu oraz Pi Home Assistant dla komputera Raspberry Pi.

Zwiększająca się rola oprogramowania

Oprogramowanie systemów automatyki budynkowej pełni ogromnie ważną funkcję w definiowaniu ich możliwości i funkcjonalności. Można pokusić się o stwierdzenie, że jest ono dzisiaj bardziej istotną częścią systemu automatyki niż warstwa hardware, gdyż decyduje o wartości dodanej tj. korzyści z posiadania.

Wiele rozwiązań sprzętowych czujników, przekaźników, siłowników i układów pomiarowych wchodzących w skład instalacji opiera się na relatywnie prostej realizacji układowej, nierzadko bazującej na jednym chipie SoC, mikrokontrolerze z dodatkami itp. Funkcjonalność elementu, komunikację (protokół i bezpieczeństwo) definiuje oprogramowanie firmware. Podobnie jest w warstwie wyższej instalacji, a więc w obszarze kontrolera zarządzającego pracą budynku – BMS (Building Management System), który monitoruje parametry pracy poszczególnych urządzeń, informuje o problemach i awariach. System taki udostępnia zazwyczaj interfejs graficzny, który w czytelny sposób pozwala na podgląd parametrów pracy oraz zmianę wartości nastawionych. Możliwości takiego rozwiązania też w znacznej części określa software.

Kolejne istotne części to dostęp zdalny z poziomu aplikacji na smartfonie lub z użyciem strony Web urządzenia, a więc responsywny interfejs webowy, aplikacja na Androida i iOS. Pozwala to na kontrolowanie instalacji z dowolnego miejsca i na pewno ułatwia znacząco korzystanie i ustawianie dzięki możliwości zapamiętywania konfiguracji, ale nie wyczerpuje potrzeb klientów. W kolejnym kroku niezbędne jest więc zapisywanie danych o stanie obiektu w bazie danych (najlepiej umieszczonej w chmurze obliczeniowej). Ułatwia to wizualizację (np. zużycia energii, alarmów, powiadomień), przeglądanie aktywności różnych procesów, takich jak ogrzewanie wody za pomocą energii słonecznej oraz oczywiście oszczędności.

Inne funkcje na tym poziomie to tworzenie raportów i wykresów, dostęp do danych historycznych pozwalający na porównywanie odczytów bieżących z poprzednimi oczywiście z poziomem szczegółowości dopasowanym do kategorii użytkowników. Oprogramowanie analityczne nie jest potrzebne cały czas, stąd funkcje mogą być oddzielone od systemu. Analityka może być na żądanie, kupowana jako usługa itd.

Oddzielenie bazy danych z zapisem chwilowego staniu obiektu oraz funkcji analityczno-raportujących ułatwia wykonywanie kopii zapasowych, aktualizowanie i rozbudowę funkcjonalności takiego oprogramowania oraz możliwość użycia narzędzi od innego producenta/dostawcy itd. Jest to cenna możliwość, gdyż zapewnia większą elastyczność.

Analityka danych, a więc analiza chwilowego stanu obiektu po to, aby tworzyć i dopasowywać scenariusze użycia poszczególnych urządzeń a następnie planować ich użycie/dezaktywację, jest zapewne najtrudniejszym zadaniem, które stoi przed inwestorem. Wykresy zużycia energii, plany zajętości pomieszczeń i inne informacje o stanie obiektu trzeba powiązać z taryfami za prąd, a dalej opracować schematy regulacji, co nie jest proste.

Niemniej jest to idealne zadanie dla systemów uczenia maszynowego i sztucznej inteligencji (AI). Pojawienie się oprogramowania tego typu przeznaczonego do systemów automatyki budynkowej jest tylko kwestią czasu.

Czego najbardziej brakuje na rynku automatyki budynkowej?

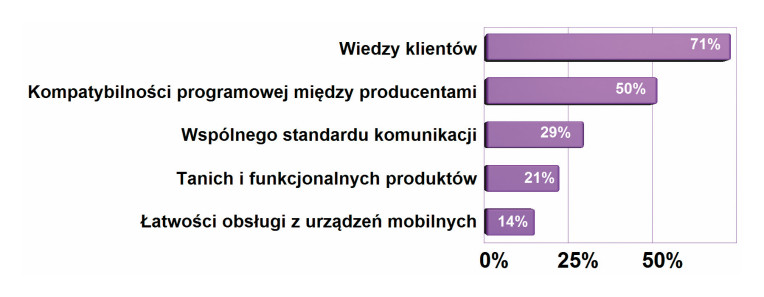

Zestawienie opinii wyrażonych w naszych ankietach jednoznacznie przekonuje, że na rynku automatyki budynkowej najwięcej problemów jest z brakiem wiedzy klientów na temat możliwości/ograniczeń technicznych produktów oraz tego, co można osiągnąć z ich wykorzystaniem. Drugim problemem jest kompatybilność programowa i razem te czynniki mogą być zniechęcające. Systemy automatyki budynkowej trafiają i są wybierane nie tylko przez ludzi ze świata techniki. Często mają duże możliwości w zakresie platformy sprzętowej i systemowej, ale wykorzystanie ogranicza słabe oprogramowanie. Efektem bywa rozczarowanie kupujących.

Rozwój i przyszłość

odstawowymi wymogami stawianymi obecnie systemom automatyki budynkowej są skalowalność i kompleksowość. Zastosowany system powinien obejmować wszystkie występujące w budynku podsystemy monitorujące i nadzorujące prace poszczególnych elementów. Chodzi o rozwiązania obejmujące: systemy przeciwpożarowe, kontroli dostępu, klimatyzacji, telewizji dozorowej i sieci komputerowej. Alians możliwości nowoczesnej automatyki z IT daje możliwości stworzenia zaawansowanej struktury o dużej autonomii.

Obserwując rynek, można stwierdzić, że systemy automatyki budynkowej rozwijane są i będą głównie w kierunku możliwości integracji niezależnych systemów takich jak systemy sygnalizacji pożaru, dźwiękowego systemu ostrzegania, itp. Ważnym elementem jest również możliwość wykorzystywania przez systemy automatyki budynkowej wspólnej platformy okablowania strukturalnego i komunikacji poprzez Ethernet, w tym jednoparowy SPE.

Potrzeba chwili związana ze stale drożejącą energią powoduje, że coraz większe znaczenie ma oprogramowanie wysokiego poziomu, a więc to realizujące funkcje analityki danych oraz optymalizujące koszty. Do niedawna użytkownicy zadowalali się tym, że mogli zdalnie wyłączyć odbiornik, taki jak na przykład drukarka lub oświetlenie w korytarzu. Dzisiaj chcą mniej więcej tego samego, tylko w odwróconej kolejności – a więc włączyć oświetlenie jedynie wówczas, gdy ktoś będzie go potrzebował. Ta zmiana akcentów może wydawać się drobna, niemniej definiuje na nowo systemy automatyki.

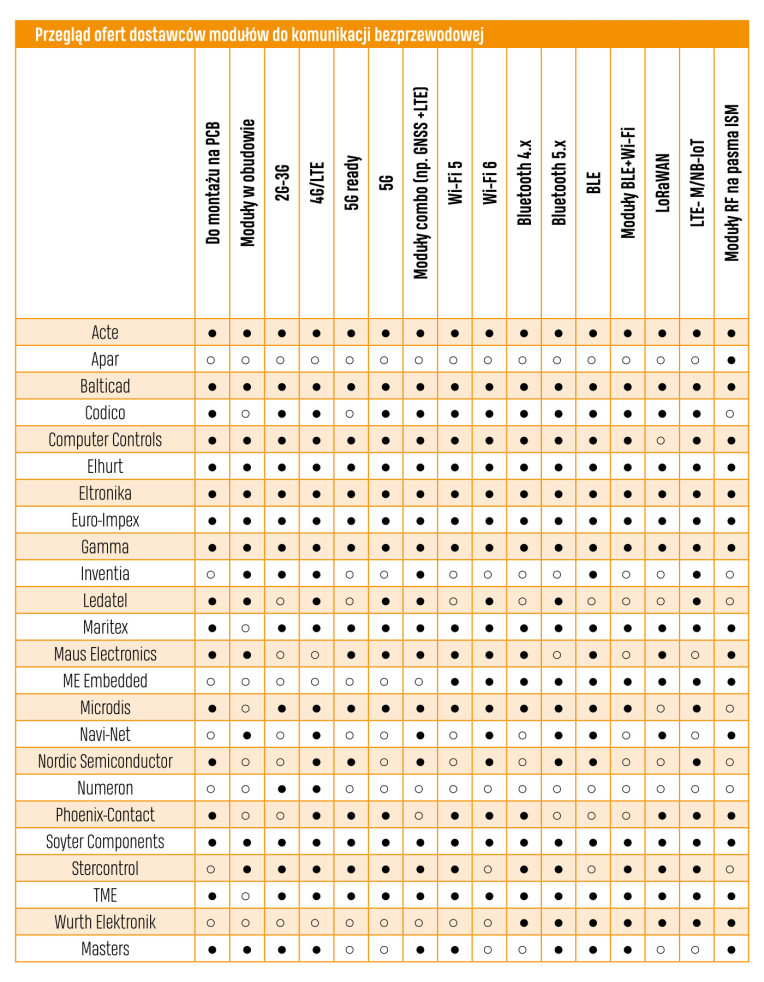

Moduły do komunikacji bezprzewodowej

Cechą rynku modułów komunikacji bezprzewodowej jest ogromna różnorodność urządzeń, standardów, protokołów, wersji i wykonań. Co chwila pojawiają się nowe standardy i wersje, które rozwiązują problemy jakie jeszcze chwilę wcześniej były dużym kłopotem (np. pobór mocy), dają lepsze parametry lub są lepiej powiązane z resztą infrastruktury w cały system. Rosnący stopień skomplikowania i zależności technologii oraz wspomniana szybka ewolucja niestety nie sprzyjają dobrej orientacji klientów i utrudniają dokonywanie optymalnych wyborów.

Mamy Wi-Fi, Bluetooth, moduły do sieci komórkowych, wersje RF na pasma ISM w dziesiątkach odmian i moduły do sieci LPWAN. Konstruktor ma do wyboru nie tylko kilka generacji sieci Wi-Fi i komórkowych oraz Bluetooth różniących się nie tylko przepustowością, ale i poborem mocy, z których nie wszystkie są ze sobą kompatybilne. Do dyspozycji są też inne rozwiązania otwarte i protokoły własnościowe. Dużo modułów komórkowych to wielosystemowe platformy z procesorem aplikacyjnym, pamięcią oraz wersje z wbudowanym odbiornikiem lokalizacyjnym lub Bluetooth albo Wi- Fi. Razem tworzy to ogromne możliwości i wybrać optymalne rozwiązanie do projektu staje się coraz bardziej skomplikowane.

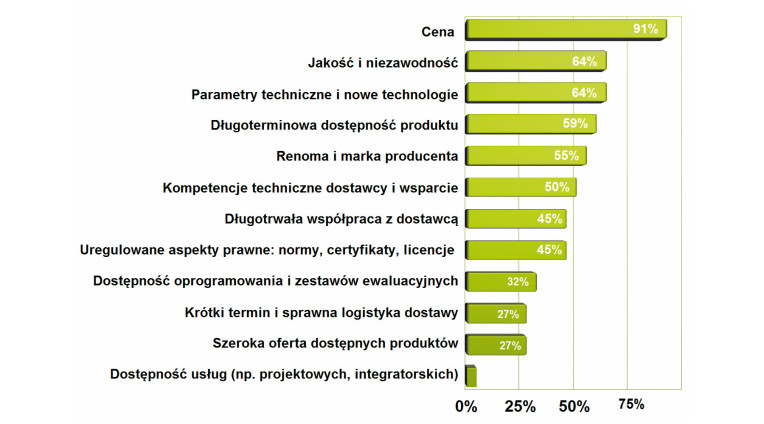

Najważniejsze dla klientów cechy ofert brane pod uwagę przy kupowaniu modułów do komunikacji bezprzewodowej

Na liście najważniejszych czynników branych pod uwagę przez klientów poszukujących rozwiązań bezprzewodowych są cena oraz jakość, co sygnalizuje, że rynek jest dzisiaj znacznie bardziej dojrzały niż jeszcze kilka lat temu. Zapewne z uwagi na istotność niskiej ceny na rynku przez długie lata funkcjonują starsze technologie komunikacji i nadal są wybierane przez klientów. Na kolejnych dwóch miejscach uplasowały się jakość i niezawodność oraz parametry techniczne, czyli te czynniki, które decydują o przewadze technologicznej. Dalej mamy wsparcie techniczne, czyli pomoc techniczną ze strony dostawcy, która jest istotna przede wszystkim w produktach nowych i złożonych. Taki rezultat to splot wielu czynników, m.in. lepszej świadomości rynkowej, lepszej dostępności rozwiązań bezprzewodowych, malejących cen modułów, doskonalszych technologii, w tym parametrów oraz standardów. Warto zwrócić uwagę na duże znaczenie długoterminowej dostępności, uregulowanych aspektów prawnych (w tym opłaconych przez producenta licencji na oprogramowanie firmware/za obsługę standardu). Długi termin dostawy przestał być istotny.

5G już jest

Dostępność sieci komórkowej w technologii 5G w Polsce stała się faktem w ostatnich dwóch latach, gdyż po wielu problemach natury politycznej zakończyły się wielokrotnie zapowiadane i przekładane aukcje częstotliwości dla operatorów. Zmiana ta widoczna jest już w dostępnych usługach świadczonych przez operatorów, a abonamenty z opcją "5G" są codziennością. Faktem jest, że 5G w naszym kraju pojawia się stosunkowo późno, odnosząc to do innych krajów Unii Europejskiej, co ma wpływ na potencjał i tempo rozwoju rynku modułów komunikacyjnych w tym standardzie, gdyż aby rynek się rozwijał, a sprzedaż była możliwa, operatorzy muszą mieć gotową infrastrukturę. W tym kontekście należy pamiętać, że "5G" jest terminem bardzo pojemnym, jeśli chodzi o zakres dostępnych usług jak też o wykorzystywane pasma częstotliwości. Nie zawsze dostępność "5G" oznacza pełny zakres możliwości. Raczej, na etapie początkowym, jest to "fragment". Podobnie jest z zasięgiem, który na początku pojawia się w centrach dużych miast, potem dopiero jest rozszerzany na ich peryferia. Operatorzy podają, że docierają z usługami 5G "do połowy mieszkańców Polski" i że czekają ich dwa lata intensywnych inwestycji.

Operatorzy komórkowi w Polsce oferują usługi w sieci 5G od 2022 roku. Państwo nie udostępniło im jeszcze wtedy częstotliwości, które w Europie do tego celu wskazano (700 MHz, 3,6 GHz oraz 26 GHz), zatem w większości radzili sobie, dzieląc już posiadane zasoby od usług starszego typu np. Internetu LTE. Wyjątkiem był Polkomtel, który na 5G przeznaczył konkretne pasmo (2,6 GHz). Pasmo 3,6 GHz to tzw. pasmo pojemnościowe, co oznacza, że więcej urządzeń czy aplikacji może korzystać z nadajnika w tym samym czasie. Dopiero niedawno rozdysponowano pasmo 700 MHz między operatorów sieci komórkowych, operatora systemu łączności dla służb (PPDR, Public Protection and Disaster Relief) oraz organizatorów specjalnych wydarzeń masowych (PMSE). Pasmo 700 MHz ma inne właściwości: zapewnia zasięg sygnału na większym obszarze i potencjalnie do większej liczby domów i firm, stąd określane jest mianem "pokryciowego". Z punktu widzenia sprzedaży modułów 5G dostępność 700 MHz jest istotna, bo poszerza możliwości użycia. Sytuacja będzie jeszcze lepsza, gdy UKE rozdysponuje pasmo 800 MHz.

2G/3G będzie wygaszane

Świat telekomunikacji szybko się zmienia, stąd wielu operatorów sieci całkowicie wycofuje wsparcie dla technologii 2G. Nie jest ono używane przez zdecydowaną większość mobilnych urządzeń używanych obecnie, a zapotrzebowanie klientów praktycznie nie istnieje poza obszarami wiejskimi. 3G szybko odchodzi do lamusa z bardzo podobnych powodów. Nowoczesne urządzenia wymagają wyższej przepustowości niż może zapewnić 3G, a wspieranie tej technologii ma mało sensu dla nowoczesnego operatora. Chociaż wsparcie dla 3G na świecie jest znacznie większe niż dla 2G, dni tego standardu też są policzone.

Można przyjąć, że minimalny poziom możliwości komórkowych zapewniają sieci LTE, a w kolejnych latach będzie to sieć 5G. 5G zapewnia nie tylko większą wydajność, ale także pozwala na niezawodną komunikację dla wielu działających jednocześnie urządzeń, małe opóźnienia, sieci prywatne i sieci typu NTN (z komunikacją satelitarną, niekorzystające z nadajników naziemnych). 5G idzie więc wyżej, szerzej, a także ma mniejsze potrzeby energetyczne poprzez rozszerzone wsparcie dla urządzeń o ultraniskim zużyciu energii i uproszczone implementacje protokołu (takie jak w LTE "niskie kategorie", NB, M).

Wiele z funkcji 5G będzie prawdopodobnie bezużytecznych do zastosowań M2M/ IoT/Embedded. Ogromna przepustowość może stanowić wyzwanie dla mikroprocesora, a pasma mikrofalowe niekoniecznie muszą zapewnić efektywność energetyczną. Prawdopodobnie minie jeszcze kilka lat, zanim na rynku pojawi się masowo produkowany, tani modem 5G o praktycznym zastosowaniu dla większości urządzeń IoT/M2M. Na razie ceny jednostek "5G" są wysokie.

Ważne i poszukiwane wersje modułów do komunikacji bezprzewodowej

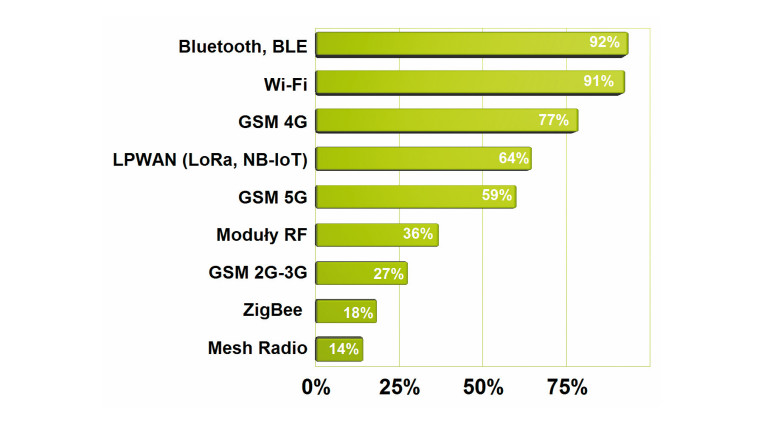

Lista ważnych i poszukiwanych wersji modułów do komunikacji bezprzewodowej obejmuje wszystkie główne standardy, jak Wi-Fi, Bluetooth BLE, wersje do sieci komórkowych w standardzie 4G (LTE). Bardzo wysoką notę można przypisać także rozwiązaniom dla sieci LPWAN (LoRA WAN, NB-IoT itp.), które się spopularyzowały i wypracowały własne miejsce na rynku. Z każdą kolejną edycją naszego badania ankietowego zajmują one coraz wyższe miejsce na wykresie. Z wykresu widać ponadto, że moduły do sieci komórkowych działające w starszych technologiach (2G i 3G) są już marginesem. Niezmiennie od lat pozycja rynkowa ZigBee jest bardzo słaba.

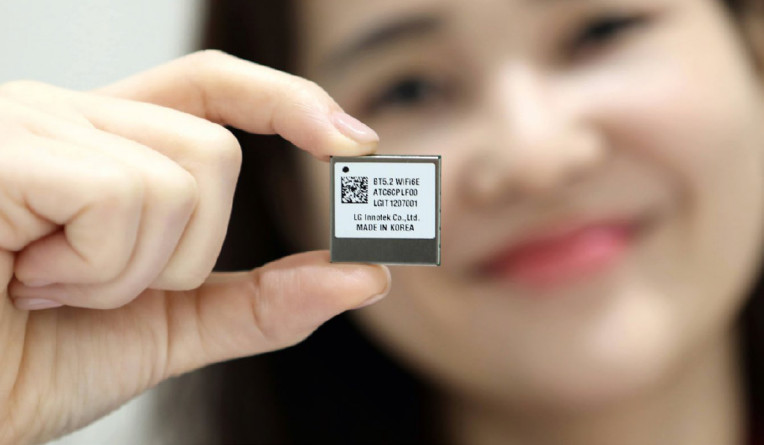

eSIM stało się standardem

W przypadku modułów do sieci komórkowych, tak samo jak w telefonach komórkowych, konieczne jest wykupienie usługi u operatora. Identyfikacja urządzenia następuje z użyciem karty SIM, która zawiera unikalny numer identyfikujący każde urządzenie w sieci komórkowej IMSI, który jest już zarejestrowany w bazach danych sieci komórkowej oraz pozwala na bezpieczne dołączenie do sieci. Karta SIM dzisiaj ma formę elektroniczną, tj. są to zapisane w pamięci urządzenia dane stanowiące tzw. embedded SIM (eSIM). Zapewnienie obejmuje aktywację profili sieci łączności zapisanych na karcie SIM, w tym wszystkich partnerów roamingowych. Karta SIM może również zawierać informacje o abonencie, konfigurację sieci i zasady korzystania, takie jak całkowite limity zużycia danych i wymagania dotyczące jakości usług, które są wykorzystywane do prawidłowego wystawiania rachunków klientowi zgodnie z umową. Elektroniczny SIM znacząco uprościł zarządzanie urządzeniami, gdyż nie trzeba nic montować w gnieździe, nie ma problemu z niezawodnością, zakresem temperatur, bezpieczeństwo jest większe, gdyż karty eSIM nie da się wyjąć. Zmiana operatora też stała się łatwiejsza. Bezsprzecznie eSIM stał się dużym ułatwieniem w rozwoju komunikacji M2M i IoT.

eSIM pozwala też łatwo skorzystać z usług globalnych operatorów specjalizujących się w obsłudze aplikacji IoT. Firmy takie zapewniają centralne zarządzanie wieloma kartami SIM za pomocą własnego oprogramowania, w tym powiadomienia, dają przydział danych na konto zamiast na urządzenie, co może dodatkowo obniżyć koszty i ułatwia pracę.

Istotne nowości w obszarze komunikacji bezprzewodowej

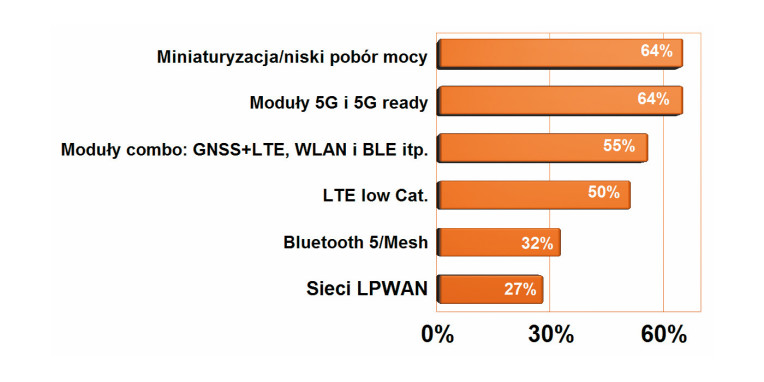

Zestawienie najbardziej istotnych trendów, produktów i technologii w zakresie komunikacji bezprzewodowej otwierają miniaturyzacja i mały pobór mocy, który jest wspólnym mianownikiem wielu nowych rozwiązań kierowanych do świata IoT, AMR i urządzeń mobilnych. Podobne wskazanie uzyskały nowe moduły do sieci 5G. Kolejne trzy pozycje o mniej więcej tym samym udziale procentowym to moduły dwa-w-jednym (combo), moduły LTE niskich kategorii (a więc zapewniające mały pobór mocy kosztem wydajności) oraz nowe wersje Bluetooth. Popularność i duże znaczenie rynkowe modułów combo wynika z tego, że wiele aplikacji ma takie właściwości, że są one korzystniejszą alternatywą. Przykładem może być rejestrator transportowy, który odczytuje położenie pojazdu i wysyła go do bazy za pośrednictwem sieci komórkowej.

Znaczenie certyfikacji

Moduły komunikacyjne znacząco upraszczają konstrukcję urządzeń elektronicznych, gdyż dzięki nim konstruktor skupia się na zagadnieniach aplikacyjnych i użytkowych zamiast na realizacji toru radiowego, budowie protokołu, modulacjach itp. Poza wymienionymi aspektami dużą wartością dodaną jest certyfikacja, a więc zgodność modułów z wymaganiami dyrektywy RED i innych podobnych regulacji obowiązujących w pozostałych regionach świata jak FCC. Moduły muszą być też certyfikowane na zgodność ze standardem protokołu, wymaganiami sieci komórkowych, po to, aby potrafiły działać z innym zgodnym sprzętem tworzącym infrastrukturę dostępową.

certyfikacją wiążą się opłaty, gdyż nierzadko rozwiązania związane z komunikacją są chronione patentami, których właścicielami są organizacje i firmy odpowiedzialne za rozwój standardu. Niewiele firm ma świadomość, że wprowadzając produkt na rynek, bierze odpowiedzialność za regulowanie opłat patentowych. Ze wzglądu na tysiące zarejestrowanych patentów jest to szczególnie ważne w przypadku łączności komórkowej. Producenci modułów najczęściej lakonicznie odpowiadają na pytanie, czy prawa patentowe są przez nich opłacane (nie muszą ich opłacać, ale wtedy negocjacje z właścicielami patentów musiałby prowadzić klient końcowy, bo to on jest odpowiedzialny), najczęściej są opłacane, ale tylko ich niewielka część, o czym klient końcowy nie ma świadomości, a można zawsze ogólnie powiedzieć "tak, opłacamy".

Stan uregulowanych opłat patentowych jest zatem niełatwy do ustalenia i powinien być przedmiotem pytań do sprzedawcy oraz zawarty w treści zamówień, po to, aby w razie problemów można było ustalić odpowiedzialność.

Główne trendy techniczne

Za najważniejsze trendy techniczne zmieniające rynek komunikacji bezprzewodowej uznano możliwość zdalnego zarządzania urządzeniami oraz dokonywania aktualizacji oprogramowania drogą radiową (FOTA), dzięki którym projektowanie rozproszonych sieci czujnikowych, IoT i podobnych rozwiązań staje się łatwiejsze, a eksploatacja tańsza. Na drugim miejscu znalazł się mały pobór mocy, co jest uniwersalną wartością zmieniającą cały rynek elektroniki, a zwłaszcza technologie mobilne. Za znaczącą nowość uznano moduły SoM pozwalające na stworzenie aplikacji bez konieczności dodawania zewnętrznego hardware (MCU, pamięć), jak również coraz doskonalsze oprogramowanie projektowe przyspieszające i ułatwiające tworzenie aplikacji.

Istotna nowość LTE Cat 1 bis

LTE Cat 1 bis to wersja standardu LTE, która została opracowana specjalnie do obsługi aplikacji IoT. Cat 1 bis wykorzystuje istniejące sieci LTE, ale co najważniejsze, działa z jedną anteną, w przeciwieństwie do LTE Cat 1, które wymaga, aby urządzenia IoT miały dwie anteny (MIMO). Ma to oczywiste zalety pod względem zapewnienia bardziej kompaktowych wymiarów aplikacji IoT i większej prostoty w projektowaniu niż dla sprzętu LTE Cat 1.

Inną ważną zaletą jest to, że Cat 1 bis może oferować taką samą szybkość transmisji danych, opóźnienie, możliwości roamingu jak LTE Cat 1, mimo korzystania z jednej anteny. Wykorzystuje też tę samą infrastrukturę i standardy co LTE Cat 1, więc nie ma potrzeby przerabiania i dostosowywania projektów pod tym kątem.

Podobnie jak LTE Cat 1, bis zapewnia 10 Mb/s w dół i 5 Mb/s w górę, wykorzystuje pasmo o szerokości 20 MHz i daje opóźnienie mniejsze niż 100 ms. Te kryteria wydajności odróżniają Cat 1 bis od innych wariantów LTE, które obsługują komunikację z jedną anteną, w tym LTE Cat 0, LTE Cat M1 i LTE Cat NB1 (NB-IoT), które oferują przepustowość poniżej 1 Mb/s.

LTE Cat 1 bis jest zatem atrakcyjną propozycją do aplikacji IoT o optymalnej wydajności. Jednak moduły Cat 1 bis mogą być droższe niż LTE-M i NB-IoT, więc pojawiają się głównie tam, gdzie można wykorzystać wyższą szybkość transmisji danych. Oczywiście cały czas dostępne są funkcje takie jak tryb oszczędzania energii (PSM) i rozszerzony nieciągły odbiór (eDRX), które minimalizują pobór mocy.

Typowe zastosowania Cat 1 bis obejmują aplikacje związane ze śledzeniem zasobów, logistyką, transportem towarów, telematyką, sieciami czujników i aplikacjami mikromobilności. W miarę dojrzewania rynku przewiduje się, że ceny modemów Cat 1 bis zbliżą się do kosztów modemów LTE-M i NB-IoT, co dodatkowo napędzi sprzedaż.

Najważniejsze zjawiska pozytywne dla rozwoju rynku modułów do komunikacji bezprzewodowej

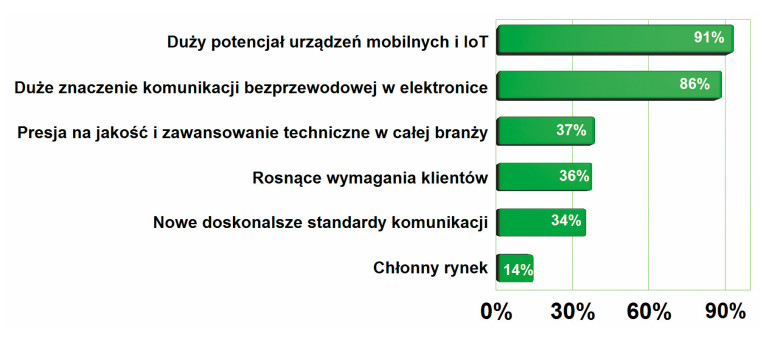

W zestawieniu głównych czynników pozytywnie wpływających na rozwój rynku komunikacji bezprzewodowej za najważniejsze postrzegane jest to, że liczba produktów z komunikacją szybko się zwiększa, a w tym tych z obszaru Internetu Rzeczy. Rozwój determinują rosnące wymagania klientów, którzy przeszli do porządku dziennego nad tym, że komunikację radiową już mają i teraz sięgają po więcej, a więc, aby była ona wydajna, oszczędna energetycznie, niezawodna itd. Pozytywnie wspierają rozwój także nowe standardy. Mimo że jest ich coraz więcej, często się zmieniają i kolejne wersje nierzadko mają czas życia rzędu kilku lat, przełamują one wiele barier za pomocą wymyślnych modulacji, protokołu lub też dopasowania do specyficznych wymagań.

Redcap – czyli wejście w 5G

5G Reduced Capability (RedCap), to z kolei nowy wariant sieci 5G zaprojektowany do obsługi aplikacji o średnich wymaganiach w zakresie przepustowości, żywotności baterii i złożoności. RedCap kierowany jest jako tańsza alternatywa tam, gdzie nie jest wymagana duża wydajność standardowej technologii 5G.

RedCap (Reduced Capability) ma na celu bycie zamiennikiem dla rozwiązań LTE, na których często polegają producenci urządzeń IoT klasy średniej. 5G RedCap oferuje porównywalną wydajność przepustowości do LTE Cat-4 i LTE Cat-6. Moduły tego typu obsługują transmisję 150 Mb/s DL i 50 Mb/s UL, korzystają z jednej anteny i mniejszej mocy nadawania, używają prostszego wariantu modulacji QAM (np. 64QAM zamiast 256QAM) i węższego pasma częstotliwości, na przykład 20 MHz dla sub-7 GHz lub 100 MHz dla mmWave. Jest to znacząco mniej niż dla zwykłego NR, gdzie pasma te wynoszą odpowiednio 100 i 200 MHz.

Kolejny aspekt to redukcja kanałów MIMO, w tym umożliwienie operacji półdupleksowych (HD), a więc działanie na jednej antenie i tym samym kanale. Zasada jest taka, że w pasmach, w których moduł bazowy NR musi być wyposażony, w co najmniej dwie gałęzie odbiorcze, urządzenie RedCap musi mieć tylko jedną.

Podobnie moduł NR obsługuje pełny dupleks (FD) w paśmie FDD, tj. ma możliwość nadawania i odbierania na różnych częstotliwościach w tym samym czasie. Do tego celu wymagany jest specjalny filtr wąskopasmowy tzw. duplekser, pozwalający pracować odbiornikowi i nadajnikowi z jedną anteną w tym samym czasie. Często wymagana jest obsługa wielu pasm FDD i w module może być potrzebnych wiele drogich duplekserów.

W przypadku urządzenia RedCap obsługa FD-FDD jest opcjonalna, tzn. nie jest wymagane odbieranie i nadawanie na tej samej częstotliwości w tym samym czasie, tylko na przemian. Taka operacja to półdupleks FDD (HD-FDD). HD-FDD eliminuje potrzebę stosowania filtrów. Zamiast tego używa się przełącznika nadawanie- odbiór, który jest znacznie tańszy.

Kolejne uproszczenie to rezygnacja z agregacji nośnych, czyli tego, aby działać jednocześnie w różnych pasmach częstotliwości, co wymaga użycia min. dwóch niezależnych transceiverów radiowych.

Przykładowe aplikacje dla RedCap to elektronika noszona (zegarki, aplikacje medyczne, gogle AR/ VR), przemysłowe czujniki bezprzewodowe i kamery nadzoru wideo. Uznano, że mają one mniej rygorystyczne wymagania dotyczące szybkości transmisji danych niż daje szerokopasmowy eMBB i nie wymagają deterministycznego małego opóźnienia (URLLC). Takie zastosowania mają zupełnie inne wymagania niż aplikacje niskiej mocy z obszaru LPWA, którymi obecnie są rozwiązania LTE-M i NB-IoT. Na przykład, szybkości transmisji danych muszą być wyższe niż w przypadku LPWA. Innymi słowy RedCap jest pozycjonowany jako segment niższy niż eMBB, ale wyższy niż LPWA.

Najważniejsze czynniki negatywne dla rynku

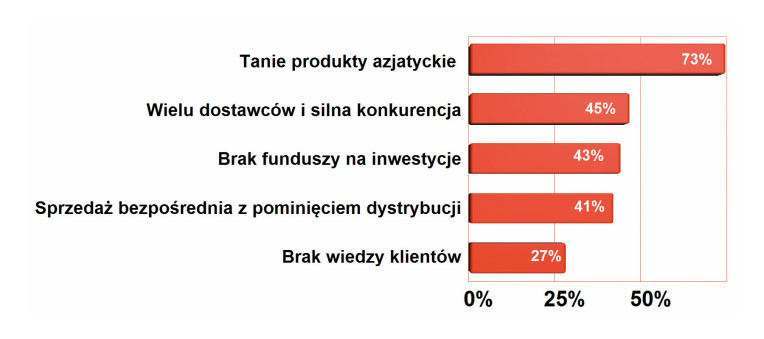

Czynniki negatywnie oddziałujące na rynek to tanie produkty azjatyckie, które są ogólnie łatwo dostępne, bo producentów jest wielu, a rynek jest szeroki i chłonny. Tamtejsze firmy mają często swobodne podejście do rynku dystrybucji i sprzedają towar każdemu, kto się zgłosi, także w kanałach B2C za pośrednictwem platform internetowych. Efektem jest zaostrzenie konkurencji, które znalazło się na pozycji drugiej na wykresie. Trzeci czynnik negatywnie oddziałujący na rynek to brak funduszy na inwestycje i ogólnie nie najlepsza sytuacja w wielu sektorach gospodarki. Nadzieję pokładamy w funduszach KPO, które zaczynają do nas docierać, ale musi minąć czas, zanim środki te przełożą się na zamówienia.

Potencjał sieci LPWAN

Sieci LPWAN (Low-Power Wide- Area Network), to rozwiązania, gdzie przy małej przepustowości zapewniony został znacznie większy w porównaniu do innych standardów zasięg komunikacji. W warunkach krajowych oznacza to sieci LoRaWAN oraz LTE Cat. M / NB-IoT (Narrow-Band IoT) oraz opisane wyżej wersje 5G RedCap i LTE cat 1 bis, które służą głównie do zbierania danych z rozległych aplikacji telemetrycznych. Typowe aplikacje, jak liczniki wody, gazu czy ciepła, systemy alarmowe, czujniki zadymienia, śledzenie ludzi i zwierząt, produkty AGD, kontrola dostępu do budynku, sterowanie oświetleniem, różnego rodzaju czujniki, np. stacje meteorologiczne itp., nie potrzebują większych wydajności, stąd LTE niskiej kategorii może być dobrym pomysłem.

Zasilacze dużej mocy

Każda kolejna generacja zasilaczy wchodzących na rynek ma coraz większą sprawność i najbardziej zmiany te widać właśnie w zasilaczach dużej mocy, gdzie sięga ona 95–96%. Wysoka sprawność to oszczędność energii zasilającej, a więc mniejsze rachunki, ale także mniejsze gabaryty oraz słabsze nagrzewanie oraz zdolność do pracy w szerokim zakresie temperatur. Duża sprawność w warunkach przemysłowych to synonim niezawodności, na którą rynek zwraca coraz więcej uwagi. Od strony układowej zasilacze wyposaża się dzisiaj we wszechstronne układy zabezpieczające, rozbudowane filtry wejściowe, sterowniki zapewniające sygnalizację stanu zasilacza i podobne obwody ochronne na tyle skuteczne, że awaria na skutek przeciążenia, stanu nieustalonego lub zwykłego błędu podczas montażu instalacji staje się praktycznie niemożliwa.

Ogromna część zasilaczy dostępnych na rynku krajowym produkowana jest w Chinach. Jak bardzo ogromna jest ta część? W przypadku zasilaczy katalogowych o typowej funkcjonalności, a więc bez pełnej cyfryzacji, interfejsów komunikacyjnych do dzielenia mocy podczas pracy równoległej lub też przy braku konieczności spełniania wymagań norm branżowych, praktycznie wszystkie zasilacze pochodzą z Azji.

Główne problemy rynku zasilania

Głównym problemem rynku jest nie najlepsza sytuacja w gospodarce krajowej, ale wpływ wojny na Ukrainie, tego, co dzieje się w całej gospodarce europejskiej też uznano za istotny czynnik determinujący obecne warunki biznesowe. Podobne komentarze bez problemu można znaleźć w wielu innych raportach analitycznych i statystykach opisujących stan gospodarki, co razem daje spójny obraz tego, że rynek cierpi na brak popytu, wyhamowanie lub przesuwanie w czasie projektów i inwestycji. Szczęśliwie, zatwierdzono nam wreszcie środki z KPO, więc w perspektywie kolejnych miesięcy można oczekiwać zmiany na lepsze.

Nawet jeśli na tabliczce znamionowej widnieje logotyp znanego producenta, zachodniej marki, renomowanej i kojarzonej z Europą lub Ameryką, też z dużym prawdopodobieństwem zasilacz został wyprodukowany w Chinach, przez tamtejszego producenta wyspecjalizowanego w takich produktach, jako produkt kastomizowany – na zamówienie klienta pod jego wymagania. Praktycznie każdy tamtejszy producent zasilaczy podejmuje się takich zleceń, są też firmy, które wyłącznie zajmują się taką działalnością. Takie są realia rynku dyktowane przez ekonomię, bowiem "u nas" komponenty do produkcji kosztują znacznie więcej niż "tam" cały zasilacz, w obudowie, z transportem i badaniami.

Wyjątki się oczywiście zdarzają, na przykład dotyczą jednostek specjalizowanych, takich, które nie mają uniwersalnego charakteru i są ściśle dopasowane do wymagań aplikacyjnych lub też spełniają wymagania specyficznych norm. Niemniej są to produkty niszowe, a jak wiadomo, nisze nie tworzą rynku, tylko wskazują na istniejące luki.

Zasilacze impulsowe bazują na typowych podzespołach elektronicznych, do produkcji których nie jest wymagana bardzo zaawansowana technologia. Stąd we wnętrzu obudowy nie znajdziemy (pomijając rzadkie wyjątki) podzespołów czołowych marek, nawet jeśli dotyczy to półprzewodników. Tanie, własne, standardowe, elementy zapewniają niskie koszty produkcji i sprawiają, że zasilacze, bardzo dobre, dobre i kiepskie, produkowane są w Chinach. Jednostki te są importowane przez dziesiątki firm handlowych, które znakują takie zasilacze własnymi znakami towarowymi i markami, tworząc marki handlowe. Tak wygląda rynek.

Sprawność zasilacza oznacza zaawansowanie techniczne

Sprawność zasilaczy jest bardzo istotnym parametrem urządzeń z kilku powodów. Po pierwsze, im jest ona większa, tym zasilacz może dostarczać więcej mocy przy tych samych wymiarach (większa gęstość mocy). Czyli duża sprawność jest przepustką do miniaturyzacji. Bezsprzecznie wysokosprawny zasilacz kojarzy się również z produktem nowoczesnym i zaawansowanym technicznie.

Duża sprawność oznacza niższe koszty eksploatacji urządzeń. Ponieważ energia elektryczna stale drożeje, w rozwiązaniach przemysłowych lub teleinformatycznych, gdzie sprzęt pracuje non stop, koszt energii jest bardzo ważny. W serwerowniach do kosztu prądu zużywanego przez urządzenia trzeba doliczyć koszt usunięcia ciepła z obiektu za pomocą systemu klimatyzacji – sprawność w takim przypadku liczy się podwójnie.

Wysokosprawny zasilacz oznacza często też małą awaryjność, a więc pośrednio jakość. Takie jednostki mało się grzeją i ich podzespoły nie są tak obciążone cieplnie. Są mniejsze, a więc też mogą być tańsze w produkcji, bo nie potrzeba do nich dużych radiatorów. Mogą też działać w szerszym zakresie temperatur, nie wymagają chłodzenia wymuszonego. Także ograniczenia na moc wyjściową przy skrajnych temperaturach otoczenia stają się łagodniejsze. Na koniec warto zauważyć, że duża sprawność zasilaczy, mała moc pobierana bez obciążenia lub konieczność korekcji współczynnika mocy jest dla niektórych zastosowań i typów wymagana przez regulacje Ekoprojektu i normy emisji EMC. Sprawność zasilaczy konsumenckich jest dzisiaj zbliżona do 90%, a 95% w przypadku zasilaczy dużej mocy nie jest zaskoczeniem.

Zjawiska techniczne w zasilaczach

Od wielu lat duża sprawność jest postrzegana jako najważniejszy trend technologiczny wyznaczający kierunek rozwoju branży zasilania. Duża sprawność determinuje wiele ważnych parametrów zasilaczy, w tym rozmiary, wielkość wymaganego systemu chłodzenia oraz koszty energii. Od wielu lat lokuje się ona na szczycie takich zestawień i tak też jest obecnie. Na drugiej pozycji znalazły się rozbudowane zabezpieczenia, co należy odczytywać jako istotę zagadnień związanych z jakością i trwałością systemu zasilania. Z kolei jednostki specjalizowane na trzeciej pozycji od góry wykresu sygnalizują, że zasilacze stają się coraz bardziej dopasowane do wymagań aplikacyjnych, tj. mniej uniwersalne.

Interfejs komunikacyjny

Interfejs cyfrowy daje możliwość odczytu stanu zasilacza, a więc napięcia wyjściowego i prądu, temperatury, parametrów napięcia sieci energetycznej oraz informacji nt. liczby przepracowanych godzin lub wcześniejszych zdarzeń, takich jak zaniki napięcia lub przeciążenia. Takie informacje mogą być wykorzystane do zarządzania działaniem systemu, planowania obsługi technicznej lub prognozowania awarii. W kontekście Przemysłu 4.0 takie możliwości stają się coraz bardziej potrzebne.

Interfejs pozwala na ustawianie parametrów jak wartości napięć i prądów oraz progów zadziałania zabezpieczeń. Jest też niezbędnym elementem przy łączeniu wielu jednostek w systemy pracujące równolegle lub typu N+ 1, a więc z redundancją i z możliwością wymiany pojedynczych modułów podczas pracy (bez wyłączania zasilania). Systemy zasilania stają się coraz bardziej złożone i możliwość programowania zasilaczy to w pewnej mierze skutek tych procesów.

Warto zwrócić uwagę jeszcze na ekonomiczne aspekty możliwości programowania parametrów zasilania. Im w szerszym zakresie jest ono możliwe, tym mniej jednostek może mieć producent w ofercie. Mniej typów to niższe koszty magazynowania i większa skala produkcji dla danej jednostki. Nawet, jeśli dodanie programowania odbywa się kosztem wzrostu komplikacji układowej, po uwzględnieniu wszystkich korzyści jest to opłacalne dla producentów i klientów. Dlatego rynek zasilania profesjonalnego zmierza w tym kierunku.

Zasilacze dużej mocy są kosztowne i z reguły dystrybutorzy nie mają lokalnych magazynów wypełnionych zasilaczami, bo jest to nieekonomiczne. Poza tym, takie jednostki kupuje się z wyprzedzeniem do realizowanych projektów i nie muszą one być dostępne od ręki. Zatem praktyką jest centralny magazyn produktów dla wielu krajów w skali kontynentu a nawet świata. Im mniej w nim jest typów, im większa możliwość programowania i ustalania specyfikacji, tym większa jest elastyczność logistyki towarów.

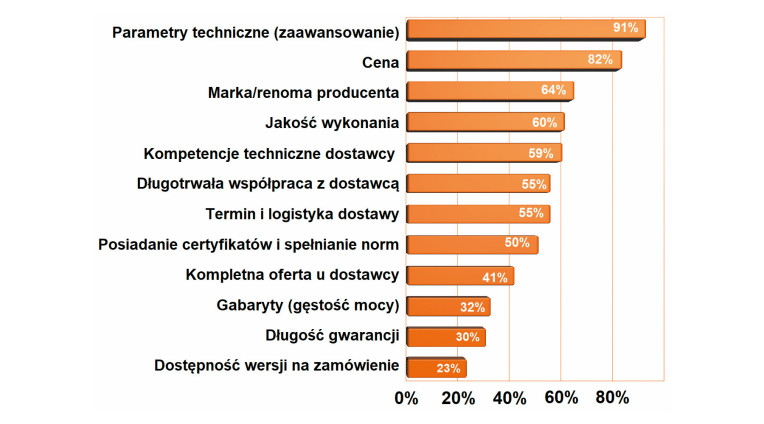

Najważniejsze cechy brane pod uwagę przy kupnie zasilaczy

W zestawieniu najważniejszych kryteriów branych pod uwagę przez klientów przy selekcji zasilacza i dostawcy na szczycie uplasowały się parametry techniczne i cena. Tym samym rynek wrócił do "standardu" obowiązującego przez lata, który można podsumować jako "najlepszy zasilacz za najmniejszą cenę". Wyjątkiem w tej regule były dwa ostatnie lata, kiedy na drugim miejscu był termin dostawy. Za ważne czynniki uznano markę producenta i jakość wykonania a także kompetencje techniczne dostawcy. Ta trójka kryteriów dobitnie pokazuje, że trudne czasy po pandemii się skończyły i wchodzimy w okres normalności, w której klienci przestają się martwić, czy kupią i swoje potrzeby kierują do tych, którzy są w stanie pomóc im rozwiązać problem.

Korekcja współczynnika mocy

Korektor współczynnika mocy jest dzisiaj częścią większości zasilaczy o mocy powyżej 100 watów, zasilaczy teleinformatycznych oraz wybranych jednostek napięciowych średniej i dużej mocy do zastosowań profesjonalnych. O konieczności korekcji kształtu prądu pobieranego z sieci decydują wymagania prawne, nakładające obowiązek minimalizacji poziomu zaburzeń (harmonicznych) wprowadzanych do sieci energetycznej oraz potrzeba minimalizacji mocy biernej, za którą się płaci dodatkowo. Wprawdzie użytkownicy prywatni nie płacą za moc bierną, więc to ich nie dotyczy, ale w przypadku fabryk, biur, dużych obiektów, w których jest wiele sprzętu zasilanego z zasilaczy bez PFC, na rachunku pojawia się opłata. Często nie są to małe sumy. Korekcja jest realizowana metodą impulsową na wejściu zasilacza, co do zasady takie zasilacze mają filtr wejściowy bardziej rozbudowany od analogicznych jednostek bez PFC.

Zasilacze dla systemów pomiarowych, badań i miernictwa

Zasilacze dużej mocy to również jednostki laboratoryjne wykorzystywane przy pomiarach do zasilania sprzętu i zadawania sygnałów wymuszeń. Są wykorzystywane także w sferze produkcji, podczas testowania jakości i badań automatycznych, gdzie pełnią funkcję wymuszeń zaburzeń w sieci zasilania oraz części testerów odpowiedzialnej za badania wytwarzanych urządzeń pod kątem współpracy ze źródłem zasilania. Zasilacze takie pozwalają na swobodne programowanie parametrów wyjściowego przebiegu "w locie" i tym samym są wygodnym elementem systemów pomiarowych i testerów ATE. Jednostki te różnią się głównie tym, że pozwalają na regulację napięć i prądów wyjściowych w szerokim zakresie (np. czterech ćwiartkach), mają bardzo dobre parametry stabilizacji i czystości napięcia wyjściowego, zawierają często kilka niezależnych kanałów wyjściowych i mogą być sterowane z komputera, pełniąc funkcję elementu systemu pomiarowego.

"Cztery ćwiartki" oznaczają, że zasilacz może płynnie zmieniać polaryzację napięcia na odwrotną, przechodząc z napięciem przez zero bez konieczności przepinania kabli, a także, że nie tylko jest w stanie dostarczać energię, ale również ją pobierać. W tym przypadku prąd może płynąć także "do zasilacza".

Zjawiska pozytywne dla rynku zasilaczy

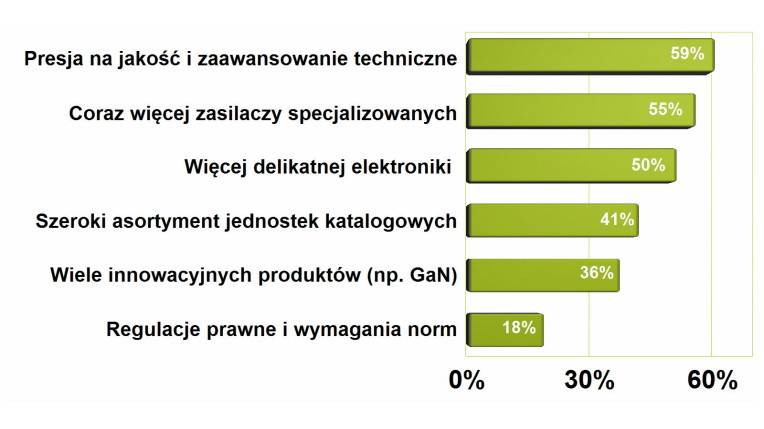

Czynniki pozytywnie wpływające na rynek to stale zwiększająca się presja na jakość i wzrost zaawansowania technicznego urządzeń elektronicznych. Kiepski zasilacz jest w stanie przekreślić wszystkie korzyści techniczne i cenowe z instalacji nowego urządzenia lub systemu, a także wymusić kosztowne akcje serwisowe. Taką świadomość ma coraz więcej osób i wymagania klientów do wybierania jednostek zasilających, które nie będą sprawiały problemów pozytywnie zmieniają rynek. Drugie miejsce odzwierciedla to, że rynek zasilania szybko się zmienia, co chwila powstają nowe konstrukcje o wysokiej funkcjonalności, dzięki czemu wybór dobrze dopasowanego do wymagań aplikacyjnych zasilacza staje się coraz prostszy. Istotne jest też to, że zasilanie jest zawsze potrzebne, dlatego rosnący rynek bezpośrednio przekłada się na większe zapotrzebowanie na zasilacze, a także to, że asortyment jednostek katalogowych będących w sprzedaży cały czas się poszerza. Coraz więcej zasilaczy można po prostu kupić "z półki", dzięki czemu zapewnienie zasilania przestaje być problemem.

Z wiedzą jest coraz gorzej

Aby dobrze wybrać zasilacz do danej aplikacji i docenić walory techniczne kryjące się w zaawansowanych jednostkach zasilających, trzeba mieć wiedzę na temat ich funkcjonalności i parametrów. Wiedza ta pozwala na formułowanie pytań kierowanych potem do dostawców, a także na poszerzenie horyzontów na temat tego, co można osiągnąć w tworzonej aplikacji. Inaczej dyskusja sprowadzana jest do podstawowych danych, takich jak napięcie wyjściowe, moc, obudowa, złącze DC i cena, co nikomu nie daje wiele przestrzeni do manewru.

Kupujący zasilacze coraz częściej nie mają wystarczających kompetencji i doświadczenia, aby umieć ocenić produkt, więc nietrudno o nadużycia. Nie każdy zna się na zasilaczach, a im aplikacja lub wytwarzane urządzenie bardziej odbiega od elektroniki, tym tej wiedzy jest w naturalny sposób mniej. Klienci z branż odległych od elektroniki z reguły nie chcą płacić więcej za produkty renomowane i o gwarantowanej jakości, raczej kupują jednostki najtańsze i nawet jak później urządzenie nie działa prawidłowo, nie są w stanie powiązać anomalii z kiepskim zasilaniem i nietrafionym wyborem, gdyż nie mają wiedzy.

Jak sygnalizowano nam w ankietach "poziom wiedzy klientów na tematy związane z zasilaniem obniża się z roku na rok". Być może dlatego, że jest to coraz bardziej skomplikowane zagadnienie i dotykające wielu branż, sektorów i aplikacji, nawet znacznie odległych tematycznie od techniki. Innym powodem może być to, że zasilacze sprzedają nie tylko specjalistyczni dystrybutorzy, ale też firmy handlowe bez kompetencji kadrowych w tym zakresie, dla których zasilacz jest tylko indeksem (oznaczeniem produktu). To zapewne jest konsekwencja szerokiego rynku.

Jednostki o specjalnym przeznaczeniu

Zasilacze to produkty z zasady uniwersalne, ale producenci coraz częściej tworzą wersje specjalizowane – ukierunkowane na specyficzne zastosowania (obsługujących redundancję, sygnalizację, z dodatkowymi wyjściami). Uwalniają one projektantów od konieczności dodawania dodatkowych układów pomocniczych, realizujących specyfikę aplikacyjną, które zostają zaszyte wewnątrz obudowy. Takie specjalizowane wersje spełniają wymagania branżowe od strony elektrycznej i mechanicznej.

Asortyment dostępnych na rynku zasilaczy poszerza się także o wersje wyposażone we wzmocnioną izolację o niskiej upływności. Do niedawna były one rzadkością i wykorzystywane tylko w aplikacjach medycznych, niemniej poszerzająca się oferta wskazuje, że takie jednostki trafiają także do aplikacji przemysłowych, precyzyjnej aparatury pomiarowej oraz rozbudowanych systemów, gdzie łączone są obwody na różnych potencjałach. W takich przypadkach zasilacz o wzmocnionej izolacji jest w stanie zapewnić stabilność i jakość działania układów pomiarowych. Problemy są coraz częstsze, bo nie zawsze zasilacz pracuje ze stabilnym obciążeniem, stabilną siecią energetyczną i uziemioną obudową. Duży prąd upływu może wywołać wzrost potencjału na wyjściu w stosunku do ziemi przy połączeniu do sieci dwoma przewodami i przy niewielkim obciążeniu, co może zakłócać działanie obwodów kondycjonujących, wejściowych przetworników itp.

Konkurencja na rynku zasilaczy wg typów

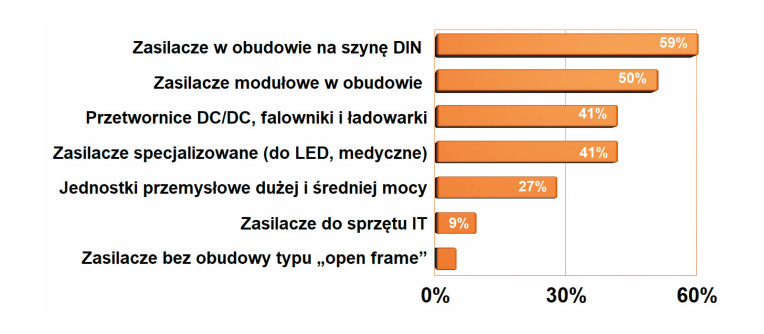

Największa konkurencja na rynku jest w zakresie zasilaczy do montażu na szynę DIN. W takiej wersji dostępnych jest wiele typów aparatury i urządzeń, Kolejna grupa pod względem ważności to modułowe zasilacze w obudowie przeznaczone do montażu w skrzynce lub szafie instalacyjnej, przetwornice i ładowarki, a więc rozwiązania powiązane tematycznie z szybko zyskującą na znaczeniu elektromobilnością. To także specjalizowane rozwiązania do oświetlenia LED. Znaczenie tych pierwszych determinuje uniwersalność i szeroki obszar aplikacyjny, tych drugich dokładnie coś przeciwnego, a więc wąska specjalizacja.

Na razie GaN to tylko marketingowy fetysz

W przypadku zasilaczy dużej mocy poprawa wielu ważnych parametrów technicznych wiąże się z użyciem nowych generacji podzespołów półprzewodnikowych. Dotyczy to wielu zagadnień, a przykładem może być mała moc pobierana z sieci bez obciążenia, która wynosi kilkadziesiąt miliwatów nawet w wydajnych, kilkusetwatowych zasilaczach przemysłowych. Aby zapewnić taki rewelacyjny wynik, konieczne jest użycie zaawansowanych kontrolerów scalonych, które potrafią dynamicznie zmieniać topologię konwersji energii w funkcji stopnia obciążenia, uruchamiają tryby oszczędnościowe, gdy zasilacz jest nieobciążony itp.

Zaawansowany kontroler zmienia też dynamicznie częstotliwość kluczowania tranzystorów po to, aby ograniczyć straty mocy wynikające z komutacji, a więc aby zapewnić większą sprawność zasilacza. Taki układ zwykle dzisiaj pracuje w topologii rezonansowej, która zapewnia małą emisję zaburzeń elektromagnetycznych i realizuje przełączanie tranzystorów w zerze napięcia lub prądu (ZVS, ZCS).

Kolejnym bardzo istotnym elementem są tranzystory przełączające, które powinny zapewnić małe straty na przewodzenie (jak najmniejszy spadek napięcia) oraz na komutację (w czasie przełączania). Dodatkowo tranzystory takie powinny mieć jak największe napięcie znamionowe. Zapewnia to oczywiście dużą odporność na przepięcia pojawiające się w sieci energetycznej, ale także ogranicza straty energii wynikające z konieczności tłumienia przepięć na transformatorze powstających w wyniku przełączania.

Naturalnym kandydatem do nowoczesnej jednostki zasilającej są elementy wykonane z azotku galu, niemniej na razie nie widać na rynku, aby takie jednostki pojawiały się masowo w ofertach.

Powodem są wyższe ceny i gorsza dostępność tych elementów. Na razie trafiają one głównie do elektrycznej motoryzacji, gdzie stanowią bazę konstrukcyjną inwerterów i konwerterów. Do zasilaczy o uniwersalnym przeznaczeniu i mocy do ok. 1 kW raczej nie, bo zysk z ich użycia jest minimalny.

Straty mocy podczas konwersji pojawiają się w elementach indukcyjnych (transformator, dławik PFC), tranzystorach kluczujących, prostowniku wejściowym i wyjściowym, kondensatorach. Moc tracimy też w układach gasikowych chroniących półprzewodniki przed uszkodzeniem. GaN-y poprawiają sprawność stopnia mocy, ale całej reszty nie, stąd procentów sprawności nie przybywa wiele. Czasem różnicy nie ma wcale.

Mariusz Cisek

kierownik działu rozwoju produktów w firmie Relpol

Czego oczekują dzisiaj klienci od dostawców zasilaczy?

Klienci z sektora przemysłowego mają zazwyczaj konkretne oczekiwania, jeśli chodzi o dostawców zasilaczy przemysłowych. Oczekiwania te dotyczą kilku kluczowych czynników, takich jak niezawodność i trwałość, gdyż zastosowania przemysłowe często wymagają ciągłego i niezawodnego zasilania. Klienci oczekują zasilaczy, które są trwałe i odporne na trudne warunki środowiskowe. Zasilacze powinny mieć długą żywotność i być odporne na czynniki takie jak zmiany temperatury, wilgotność i wibracje. Drugi istotny czynnik to kompaktowy rozmiar i forma, w wielu zastosowaniach przemysłowych przestrzeń jest ograniczona. Klienci poszukują kompaktowych i zajmujących niewiele miejsca rozwiązań zasilających, które można łatwo zintegrować z ich systemami. Ostatni to wydajność i efektywność energetyczna są istotną kwestią w środowiskach przemysłowych. Klienci oczekują zasilaczy, które działają wydajnie, aby zminimalizować zużycie energii i obniżyć koszty. Liczą się ponadto funkcje ochronne, ponieważ środowiska przemysłowe mogą stwarzać zagrożenia, takie jak przepięcia, przetężenia i zwarcia. Klienci oczekują zasilaczy z wbudowanymi funkcjami zabezpieczającymi, aby chronić swój sprzęt i zapewnić niezawodność systemu.

Gdzie kieruje się rozwój tego biznesu?

W branży zasilaczy przemysłowych kluczowe są cztery podstawowe czynniki, które wpływają na specyfikę handlu: cena, dostępność, jakość i niezawodność. To są kluczowe elementy w handlu zasilaczami przemysłowymi. Firmy muszą znaleźć równowagę między konkurencyjnymi cenami a oferowaną jakością, jednocześnie zapewniając dostępność produktów. Krótkie czasy dostawy stają się standardem, a szybkość realizacji zamówień ma kluczowe znaczenie. Wprowadzenie szybkich dostaw może być istotnym czynnikiem różnicującym na rynku. Ciągłe dostosowywanie się do zmieniających się potrzeb rynku jest niezbędne dla utrzymania konkurencyjności w branży zasilaczy przemysłowych.

Więcej funkcjonalności

Użyteczna funkcjonalność, jaka pojawia się dzisiaj często w zaawansowanych jednostkach zasilających, obejmuje obecnie takie dodatki, jak np. możliwość regulacji wyjściowego napięcia w niewielkim zakresie trymerem, po to, aby skompensować spadek napięcia na przewodach wyjściowych. Do tego samego celu służą zwielokrotnione zaciski wyjściowe lub też możliwość podłączenia dwóch dodatkowych przewodów pomiarowych bezpośrednio do zacisków obciążenia (tzw. czteroprzewodowe połączenie kelwinowskie). Taki sposób zapewnia znakomite parametry napięcia wyjściowego (statyczne i dynamiczne) w zasilaczach dużej mocy i o niskim napięciu wyjściowym.

Od strony układowej zasilacze wyposaża się dzisiaj we wszechstronne układy zabezpieczające, rozbudowane filtry wejściowe, sterowniki zapewniające sygnalizację stanu zasilacza i podobne obwody ochronne na tyle skuteczne, że awaria na skutek przeciążenia, stanu nieustalonego lub zwykłego błędu podczas montażu instalacji staje się praktycznie niemożliwa.

Szeroki zakres napięcia wejściowego to kolejny parametr, który wiele mówi o nowoczesności. Standard tanich jednostek to 100‒240 V AC, lepsze działają w zakresie 85‒265 V AC, najlepsze w jeszcze szerszych widełkach, np. 90‒450VAC, a więc mogą być zasilane napięciem międzyfazowym. Nawet jeśli nie korzystamy z sieci innej niż 1-fazowa 230VAC, to gdy zakres dopuszczalnych napięć jest szeroki, korzystnie przekłada się to na odporność zasilacza na krótkotrwałe zaniki napięcia i przepięcia o dużej wartości.

Asortyment dostępnych na rynku zasilaczy poszerza się także o wersje wyposażone w wzmocnioną izolację oraz o małej upływności. Do niedawna były one rzadkością i wykorzystywane tylko w aplikacjach medycznych, niemniej poszerzająca się oferta wskazuje, że takie jednostki trafiają także do urządzeń przemysłowych, do precyzyjnej aparatury pomiarowej oraz rozbudowanych systemów, gdzie łączone są obwody na różnych potencjałach. W takich przypadkach zasilacz o wzmocnionej izolacji jest w stanie zapewnić stabilność i jakość działania układów pomiarowych.

Jakub Motyka

Elmark Automatyka Jakub Motyka, Elmark Automatyka

Na jakie cechy produktu zwracają uwagę kupujący zasilacze medyczne: markę, dokumentację (wyniki badań, certyfikaty), cenę a może na coś innego?

Kupujący zasilacze medyczne zwykle zwracają uwagę między innymi na certyfikaty i zgodność z normami. Oczekują, że zasilacze medyczne spełnią normy bezpieczeństwa, takie jak normy ISO 13485, IEC 60601 i MOPP. Certyfikaty potwierdzające zgodność z tymi normami są kluczowym elementem. Ponadto istotna jest również pełna i precyzyjna dokumentacja techniczna, obejmująca wyniki badań, specyfikacje techniczne oraz instrukcje obsługi. Umożliwia to dokładne zrozumienie parametrów technicznych oraz poprawne korzystanie z urządzenia. Dla wielu kupujących istotne jest też wsparcie techniczne. Kupujący zasilacze medyczne doceniają dostępność i jakość wsparcia technicznego ze strony producenta. W razie problemów czy pytań szybka pomoc może być kluczowa. W obszarze medycznym, gdzie czas jest często kluczowy, dostępność zasilaczy oraz terminowość dostaw również są bardzo istotnymi czynnikami. Oczywiście również cena jest ważnym czynnikiem. Kupujący medyczne zasilacze zwykle szukają rozsądnej równowagi między jakością a kosztem

Jaki jest stan wiedzy rynku na temat tego, czym są zasilacze medyczne, jakie wymagania muszą spełniać i w czym różnią się od innych?

Zwykle klienci zainteresowani zasilaczami medycznymi są świadomi tego, jakiego sprzętu szukają i jakie są główne różnice między zasilaczami medycznymi a regularnymi. Zwracają głównie uwagę na spełnienie normy 60601-1 oraz 2×MOPP. Dla wielu klientów istotna jest też klasa ochronności zasilacza.

Zasilacze dla urządzeń medycznych

Urządzenia medyczne stanowią szczególną kategorię produktów. Ze względu na ich zastosowania, związane z ratowaniem życia oraz zdrowia pacjentów, podlegają szczegółowym regulacjom w zakresie bezpieczeństwa oraz niezawodności. Dotyczy to również układów zasilaczy przeznaczonych do tego typu urządzeń. Jednym z najważniejszych priorytetów jest tutaj zapewnienie ich użytkownikom maksymalnego poziomu bezpieczeństwa. Głównym standardem normatywnym jest tutaj EN60601, który wprowadza pojęcie otoczenia ("patient vicinity"), które zdefiniowane jest jako obszar o promieniu 1,83 m od ciała pacjenta. Co do zasady zapisy i wymagania zawarte w standardzie dotyczyć powinny wszystkich urządzeń elektrycznych pracujących w tym obszarze. Urządzenia te podlegają dalszej klasyfikacji, z uwagi na sposób ich rozmieszczenia względem pacjenta – wyróżnia się grupy układów typu B, BF oraz CF. Każda z tych grup ma oddzielne wymagania, które wpływają na parametry przeznaczonych dla nich zasilaczy.

− Sprzęt typu B( Body) przeznaczony jest do pracy w otoczeniu pacjenta, jednak bez bezpośredniego kontaktu z jego ciałem. Zasilacze dla urządzeń z tej kategorii powinny charakteryzować się napięciem przebicia nie mniejszym niż 1500 V AC, separacją (creepage, najkrótsza odległość wzdłuż powierzchni materiału izolacyjnego pomiędzy dwoma częściami przewodzącymi) o wartości co najmniej 2,5 mm oraz zastosowaniem podstawowej izolacji.

- Sprzęt typu BF (Body Floating) pracuje w bezpośrednim kontakcie z ciałem pacjenta. Wymagania odnośnie do zasilania to 3000 V AC napięcia przebicia, 5 mm separacji oraz podwójna warstwa izolacji.

- Sprzęt typu CF (Cardiac Floating) przeznaczony jest do pracy w bezpośrednim kontakcie z sercem pacjenta. Wymagania odnośnie do zasilania to 4000 V AC napięcia przebicia, 8 mm separacji oraz podwójna warstwa izolacji.

Standard IEC/PN/EN 60601 operuje również pojęciem środków ochrony (Means of Protection, MOP). Operatorzy sprzętu oraz pacjenci traktowani są przez standard odmiennie, a środki ich ochrony rozróżnianie są za pomocą następującej klasyfikacji:

- MOOP (Means of Operator Protection) – środki ochrony operatora,

- MOPP (Means of Patient Protection) – środki ochrony pacjenta.

Kategorie środków ochrony ściśle powiązane są z opisanymi powyżej grupami urządzeń medycznych. Przykładowo, urządzenie z grupy B wymagało 1500 V AC napięcia przebicia, 2,5 mm separacji oraz pojedynczej warstwy izolacji. Pozwoli to jednak na uzyskanie ochrony jedynie na poziomie 1× MOOP. Jeśli koniecznie jest zapewnienie poziomu 1× MOPP, konieczne będzie zwiększenie separacji do wartości 4 mm.