Komponenty indukcyjne

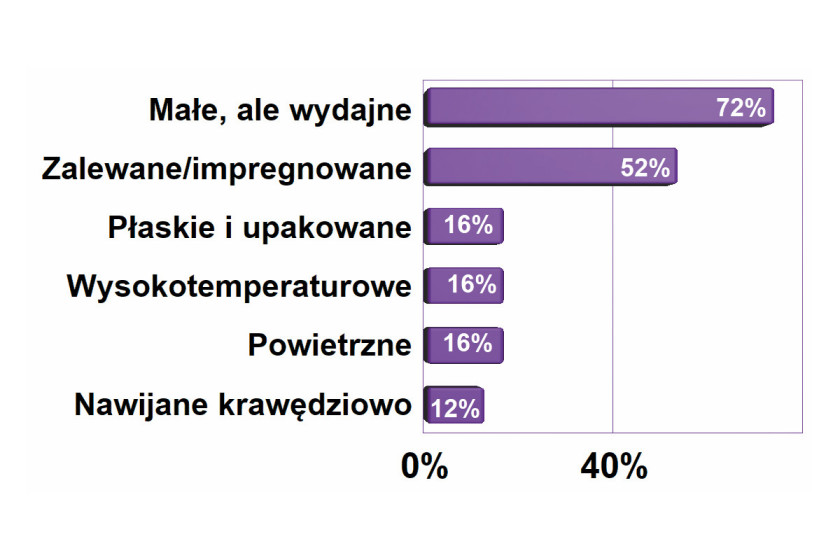

W obszarze elementów indukcyjnych pojawia się dużo nowości produktowych i innowacji technologicznych w materiałach, a rekordy sprawności czy gęstości mocy z jednostki objętości nie byłyby możliwe bez ich wykorzystania. Rozwój elektromobilności, aplikacji zielonej energii nie byłby tak spektakularny, gdyby nie małe i wydajne elementy indukcyjne, które są potrzebne praktycznie w każdym projekcie.

Co słychać na rynku?

Aktualnie sytuacja w biznesie nie jest najlepsza, bo po pandemii na całym świecie popyt na elektronikę użytkową zmalał, w krajowej gospodarce mamy spowolnienie, a sytuacja u naszych sąsiadów wcale nie jest do pozazdroszczenia. Do tej pory nawet jak w kraju był dołek, firmy mogły się ratować eksportem, a teraz niestety sposób ten nie działa i mamy kumulację czynników negatywnych.

Zjawisk negatywnie oddziałujących na krajowe firmy produkcyjne tego typu jest sporo, m.in. zwiększone koszty działalności, koszty zatrudnienia i materiałów. Przy braku popytu i spadku konsumpcji warunki do działania nie są idealne. Firmy sygnalizują, klienci zamawiają mniejsze ilości, zamówień jest mniej, często też terminy dostaw przesuwane są na przyszły rok.

Istniejący dołek na rynku widać też w malejących cenach frachtu towarów z Chin, zarówno drogą morską, jak i kolejową oraz skróceniu czasu tego transportu o mniej więcej jedną trzecią w stosunku do tego, co było rok wcześniej. Towarów transportowanych jest wyraźnie mniej i dane statystyczne to doskonale pokazują.

Nagromadzone zapasy z pewnością w niedalekiej perspektywie zostaną zużyte, co otworzy drogę do kolejnych zamówień, ale w przyszłym roku koszty działalności mogą znowu wzrosnąć. W zakresie przyszłości niewiadomych jest więcej, bo niełatwo ocenić perspektywy na rynkach zagranicznych lub warunki w Chinach, gdzie kupujemy wiele materiałów i komponentów.

Miniaturyzacja zawsze się liczy

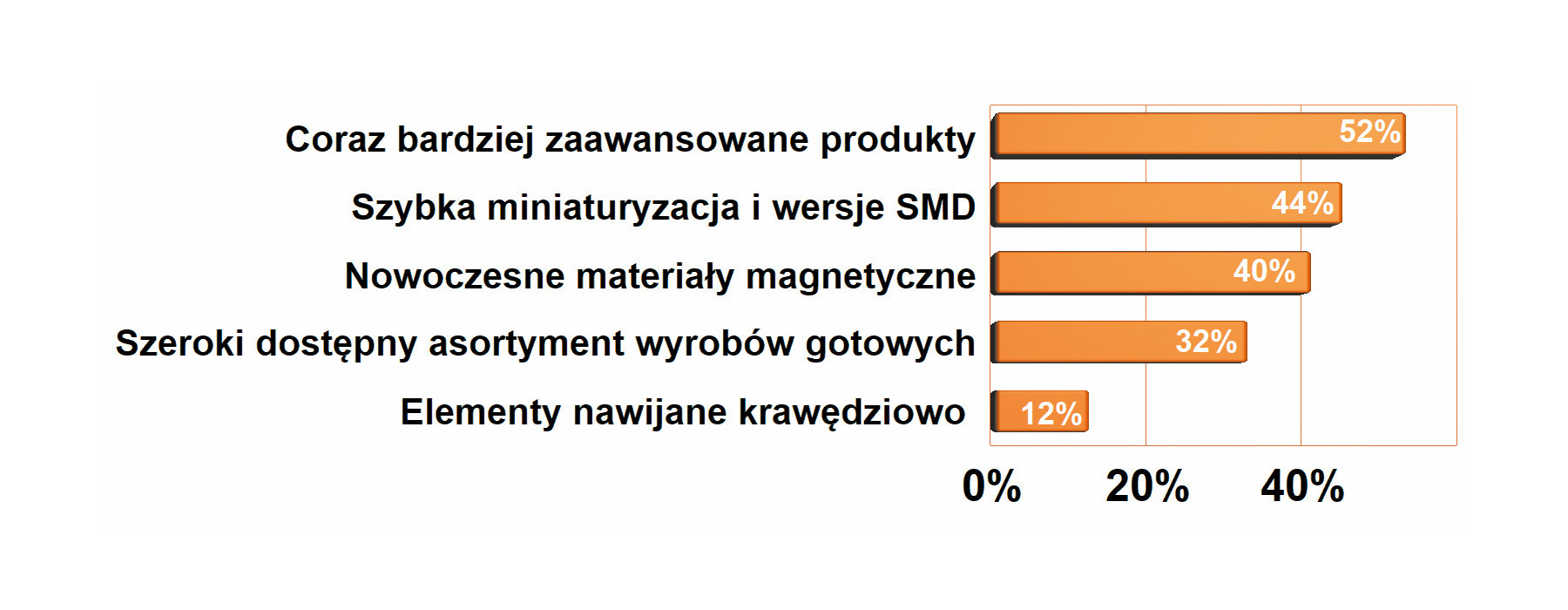

Wszystkie współczesne urządzenia elektroniczne są z generacji na generację coraz mniejsze, a znaczenie elektroniki mobilnej na rynku stale się pogłębia. Trend miniaturyzacji dotyczy też systemów zasilania, elektromobilności i przemysłowych urządzeń energoelektronicznych, których gęstość mocy sukcesywnie z każdą kolejną generacją rośnie. Nowoczesne półprzewodniki i elementy indukcyjne są niezbędne do takich zmian, bo za postępem technicznym kryją się bardzo często znaczące innowacje w zakresie impulsowej konwersji mocy. Osiągnięcie wysokiej sprawności jest możliwe m.in. dzięki dostępności miniaturowych dławików i transformatorów bazujących na niskostratnych materiałach magnetycznych o zwartej konstrukcji mechanicznej, zapewniającej małe reaktancje pasożytnicze, emisję zaburzeń i takich, które mają gabaryty pozwalające na łatwą integrację w urządzeniu. Mały i płaski transformator z uzwojeniami nawiniętymi licą lub płaskownikiem miedzianym (drutem krawędziowym) z rdzeniem otaczającym praktycznie całe uzwojenie jest rozwiązaniem, do którego się dąży we współczesnych rozwiązaniach systemów zasilania. Poza układami konwersji energii cała reszta elementów indukcyjnych też jest coraz mniejsza. Dotyczy to filtrów, cewek w.cz., dławików lub też transformatorów sygnałowych, które nie mogą górować gabarytami nad resztą elektroniki.

Katalogowy czy na zamówienie?

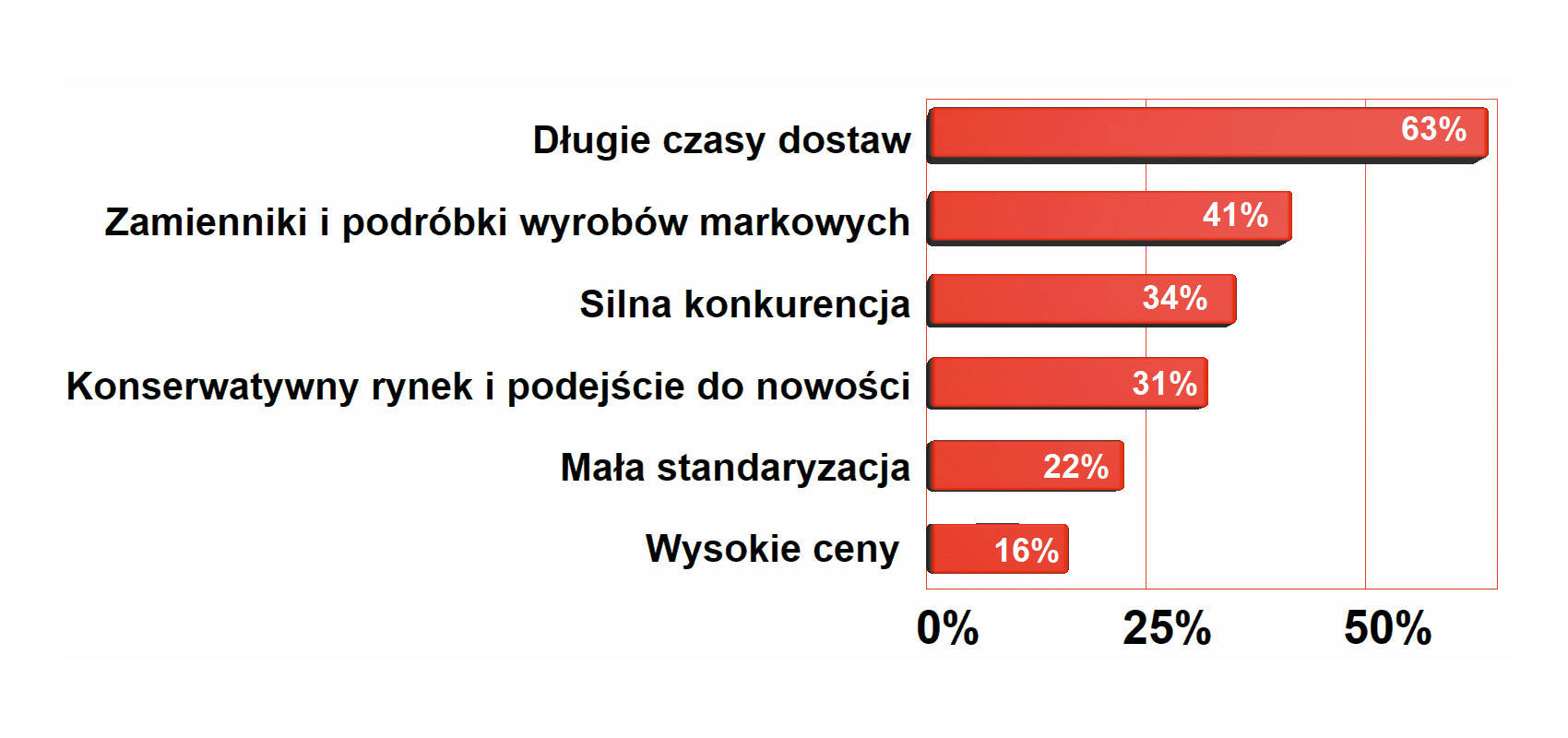

Cechą rynku elementów indukcyjnych jest bardzo szeroki asortyment produktów katalogowych. Z jednej strony jest to zjawisko pozytywne, bo pozwala dobrać do aplikacji najlepiej pasujący element przy minimalnym kompromisie w parametrach. Z drugiej strony na te mniej popularne typy cewek i dławików trzeba często długo czekać, bo możliwości ich magazynowania u dystrybutorów są niestety ograniczone. Widać to doskonale w obecnych czasach, gdy rynek powoli dochodzi do równowagi po wielkim rozchwianiu łańcuchów dostaw po pandemii. Na skutek ogromnego asortymentu wybór produktu jest wielki tylko teoretycznie, bo ogranicza się do tego, co jest w magazynach, a nie w katalogu.

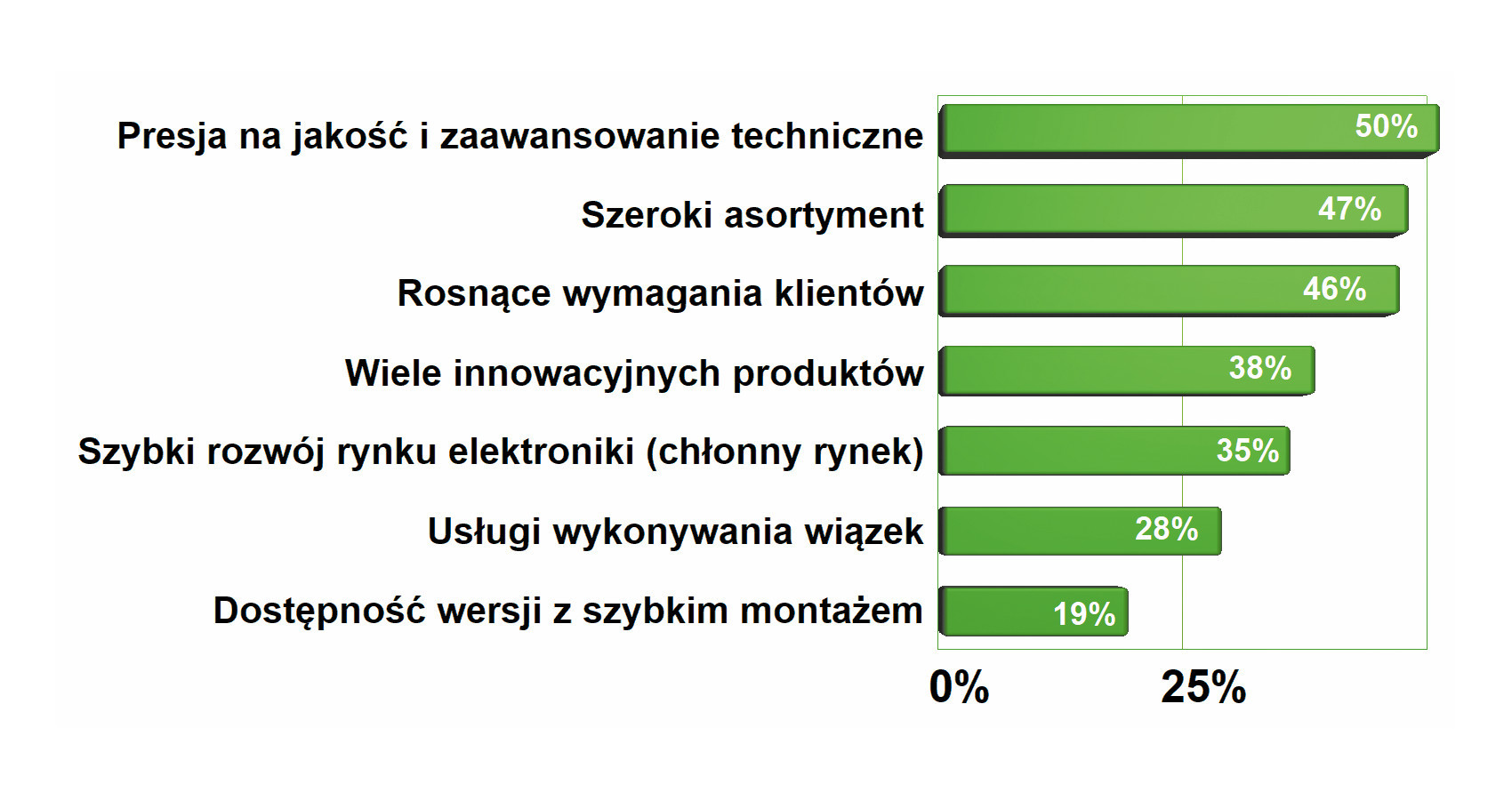

Im bardziej wymagająca aplikacja, im większa gęstość mocy, wyższe poziomy napięć i prądów, tym większe znaczenie dla zapewnienia dużej funkcjonalności mają elementy indukcyjne produkowane według indywidualnej specyfikacji (kastomizowane). Zapewniają one najlepsze parametry użytkowe, dobre dopasowanie do montażu w obudowie lub też do wymagań elektrycznych oraz są w najmniejszym stopniu kompromisem. Z takich przyczyn udział produkcji na zamówienie w krajowej branży podzespołów indukcyjnych jest i zawsze był bardzo duży. Dla większości krajowych firm produkcyjnych jest to wręcz podstawa aktywności biznesowej. To się nie zmienia od lat.

Produkowanie elementów indukcyjnych na zamówienie klientów, a więc wg indywidualnie przygotowanej specyfikacji, ułatwia też utrzymanie niezbędnych inwestycji w park maszynowy. Standardowe elementy takie jak dławiki do montażu na płytkach drukowanych są produkowane na wydajnych i zaawansowanych automatach, które pracują całkowicie autonomicznie. Takie urządzenia są drogie i z punktu widzenia krajowych przedsiębiorstw za bardzo wydajne, a na skutek dużej konkurencji marże przy sprzedaży są małe. Produkcja na zamówienie opiera się na znacznie mniejszych seriach, wyrobach niestandardowych, czyli wymaga maszyn o mniejszym stopniu autonomiczności, takich, które wspierają działanie ludzi. Od strony inwestycyjnej jest to rozwiązanie tańsze, a więc znajduje się w zasięgu inwestycyjnym także mniejszych firm, bo jak wiadomo, ceny wszystkich urządzeń produkcyjnych są bardzo wysokie i liczy się je w milionach euro.

Najważniejsze dla branży są aplikacje zasilające

Szacuje się, że elementy indukcyjne i magnetyczne mogą stanowić około połowy całkowitej masy współczesnego układu konwersji energii pracującego na wysokiej częstotliwości. Zasada działania tego typu komponentów wymaga zapewnienia bardzo wysokiego poziomu precyzji podczas całego procesu produkcyjnego, ponieważ ich właściwości ściśle zależą od posiadanych wymiarów geometrycznych. Nawet niewielkie niedokładności w procesie formowania rdzenia lub uzwojenia mogą prowadzić do znaczących różnic w rozkładzie strumienia pola magnetycznego podczas pracy układu. Na przestrzeni lat poczyniono ogromne postępy w projektowaniu i konstrukcji elementów aktywnych i półprzewodnikowych, jednocześnie zaś sposób wytwarzania elementów pasywnych takich jak cewki pozostał niemal niezmieniony. Parametry tego typu elementów są często czynnikiem ograniczającym rozwój oraz poprawę efektywności układów konwersji mocy. Wskutek intensywnie prowadzonych prac i projektów badawczych na rynku pojawiło się na przestrzeni ostatnich lat wiele nowych typów materiałów magnetycznych, wykorzystywanych do konstrukcji komponentów indukcyjnych. Materiały te pozwalają na poprawę właściwości elementów indukcyjnych, pozwalając na uzyskanie mniejszej masy układu, wyższej częstotliwości pracy czy też niższego poziomu strat.

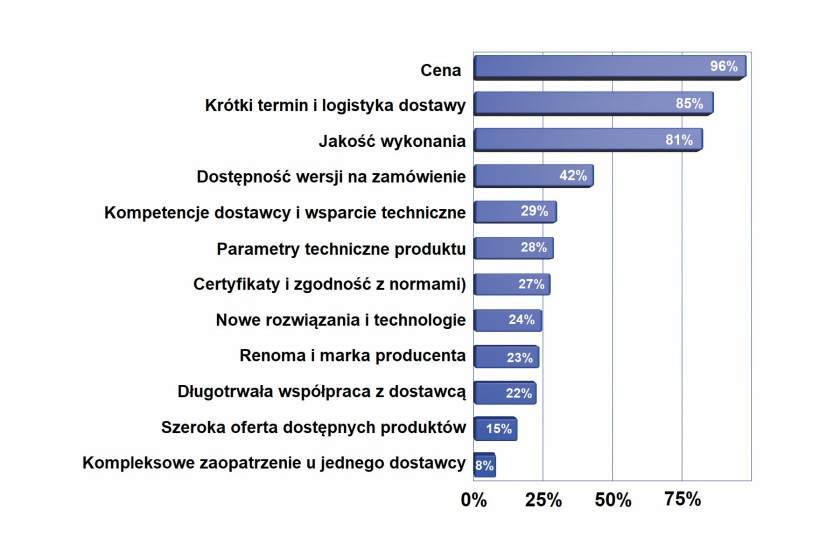

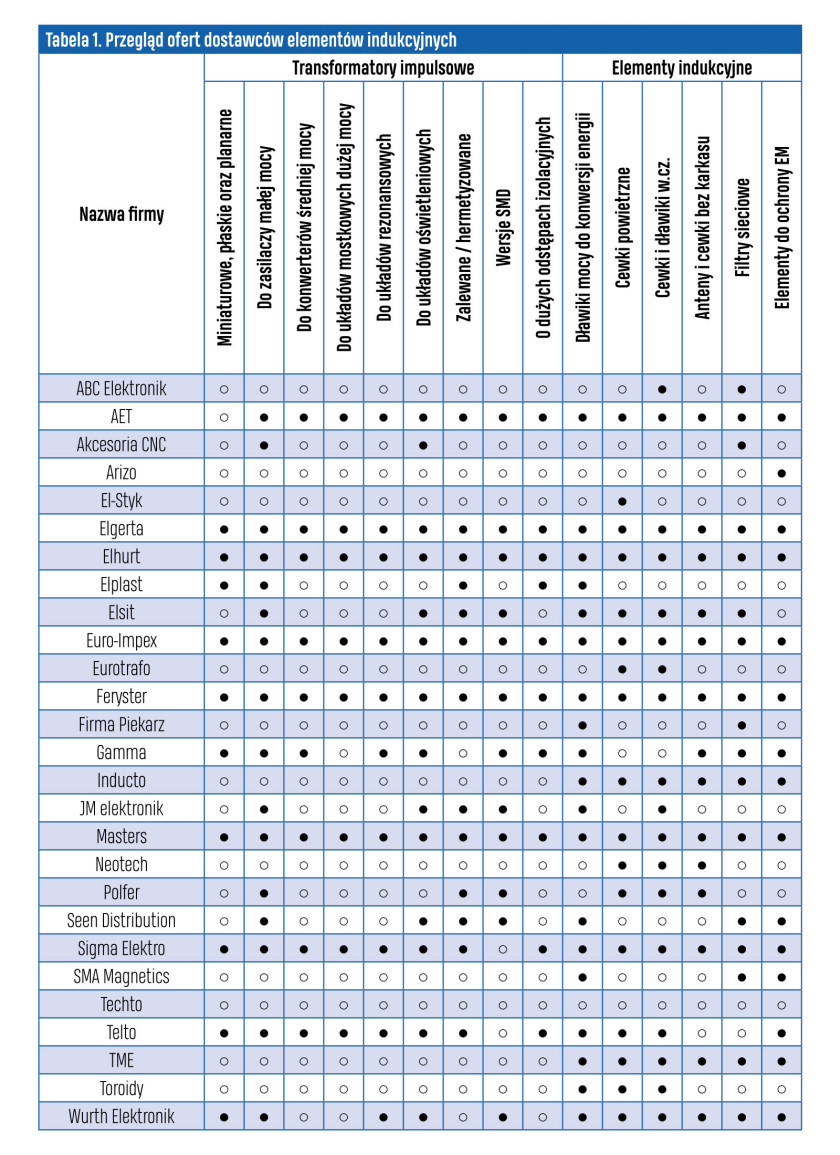

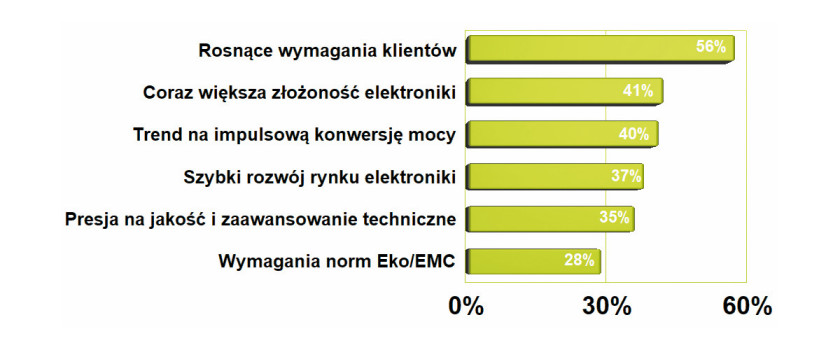

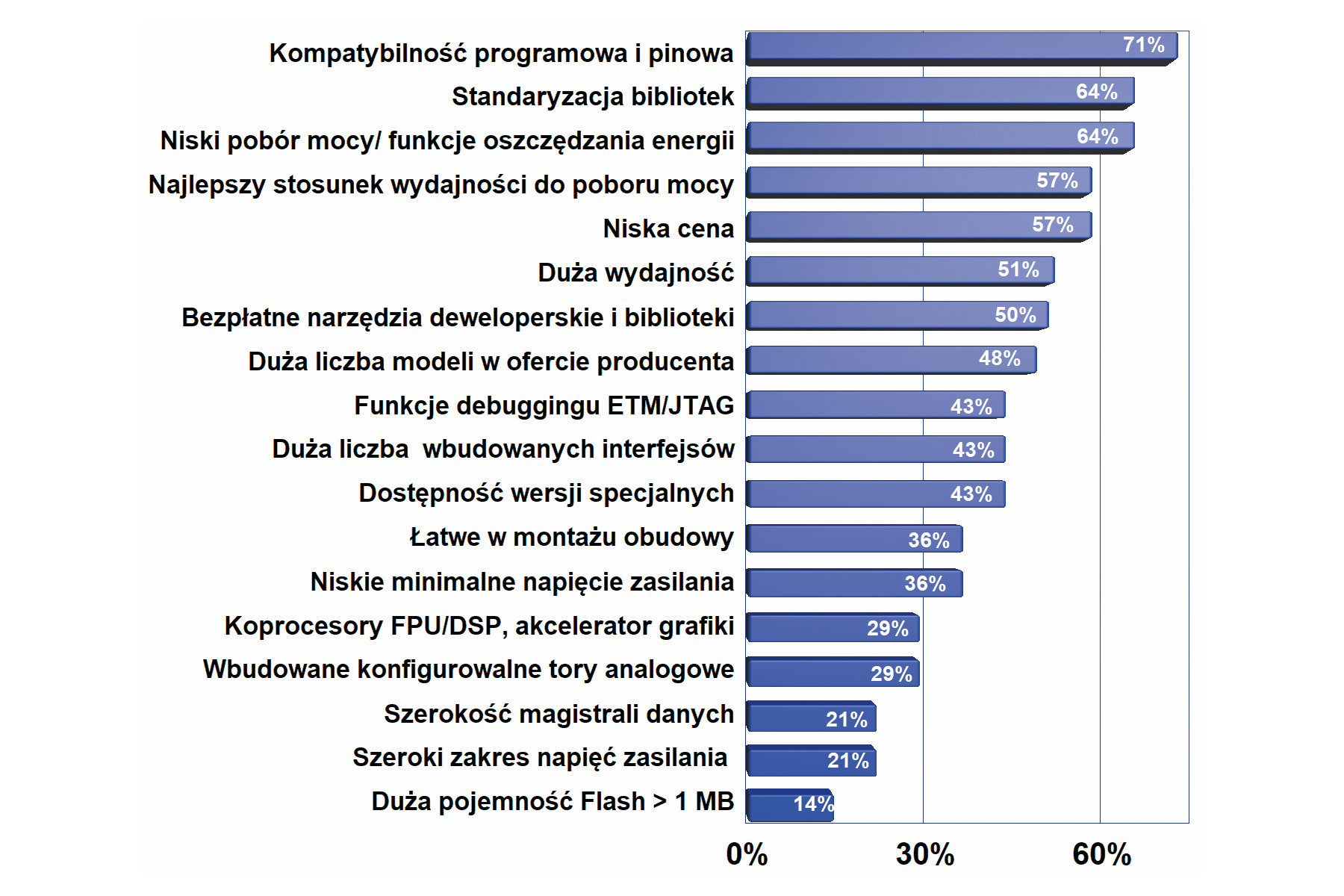

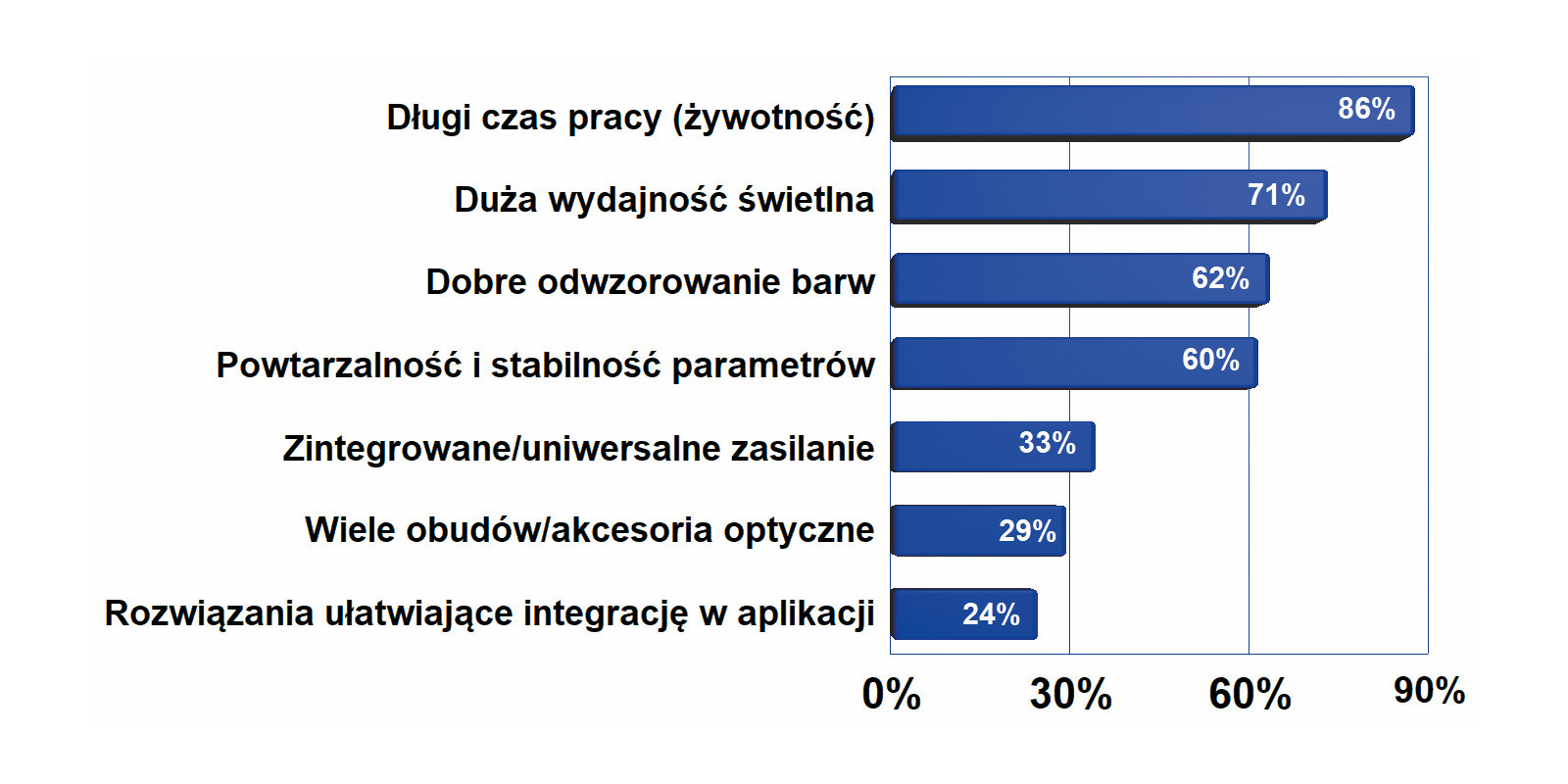

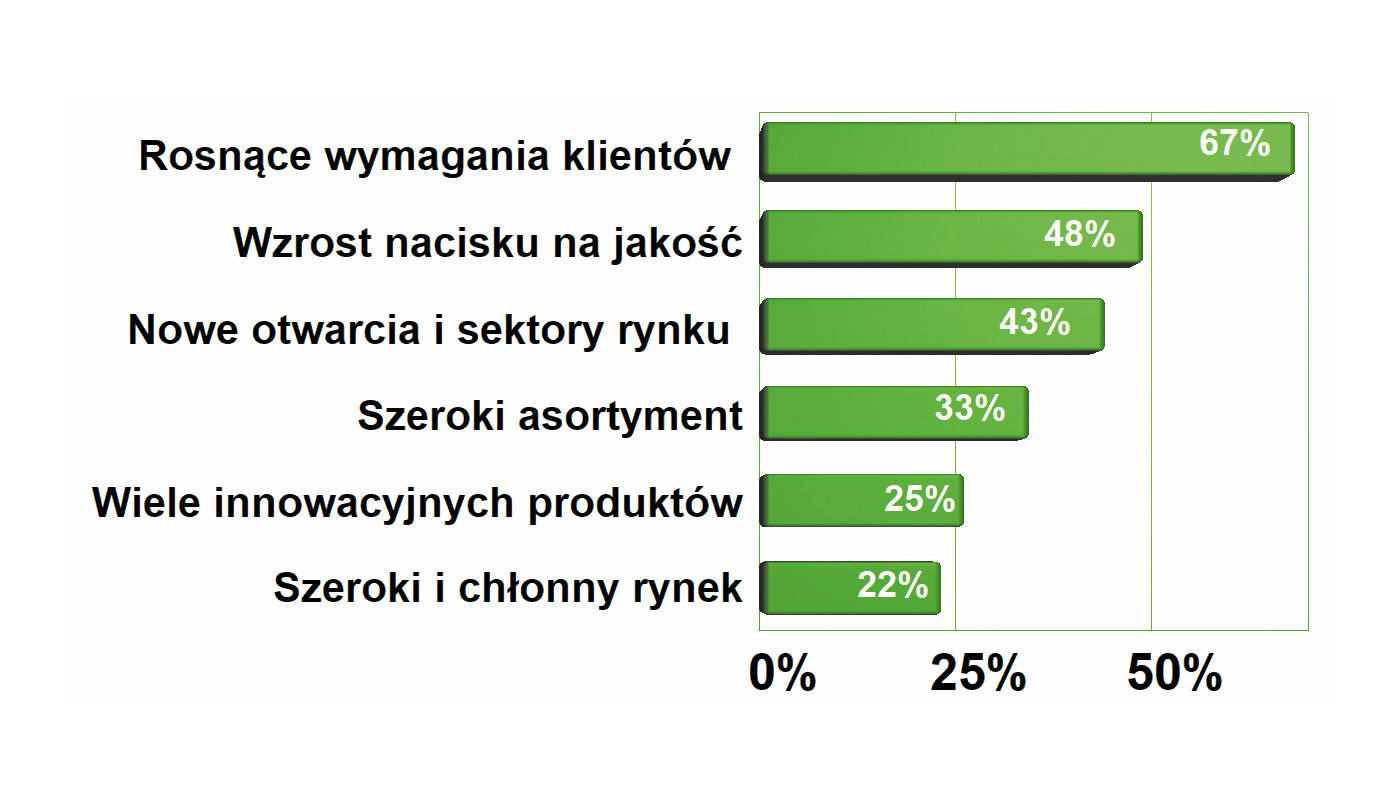

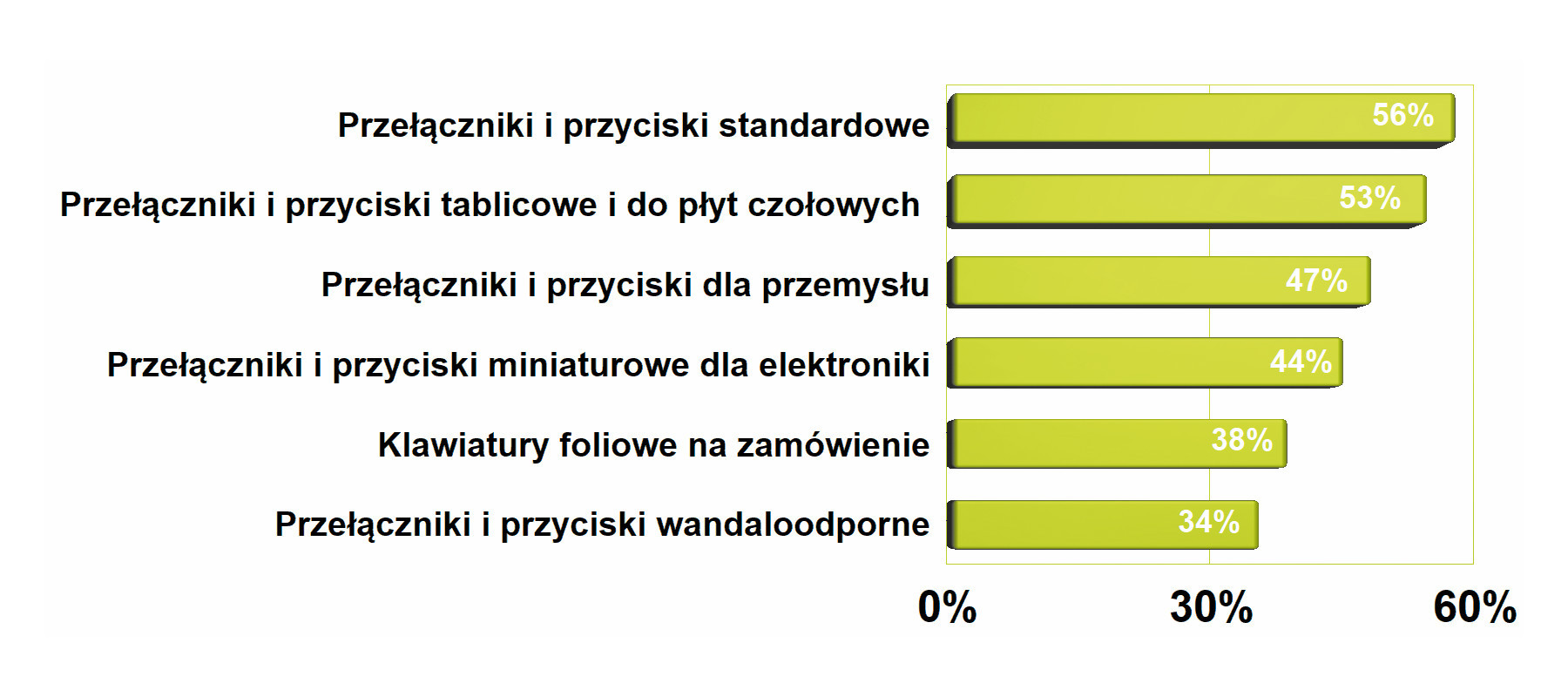

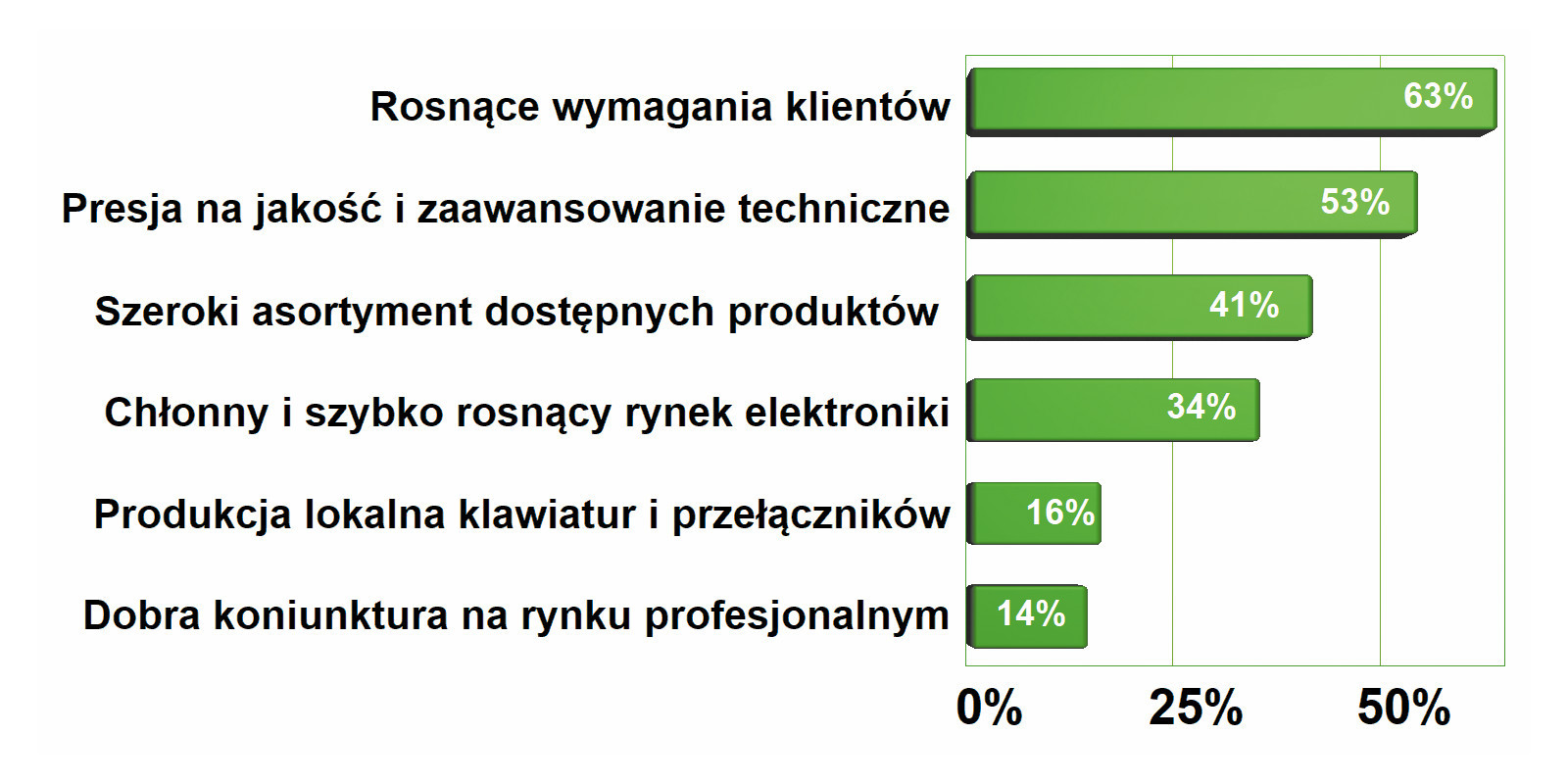

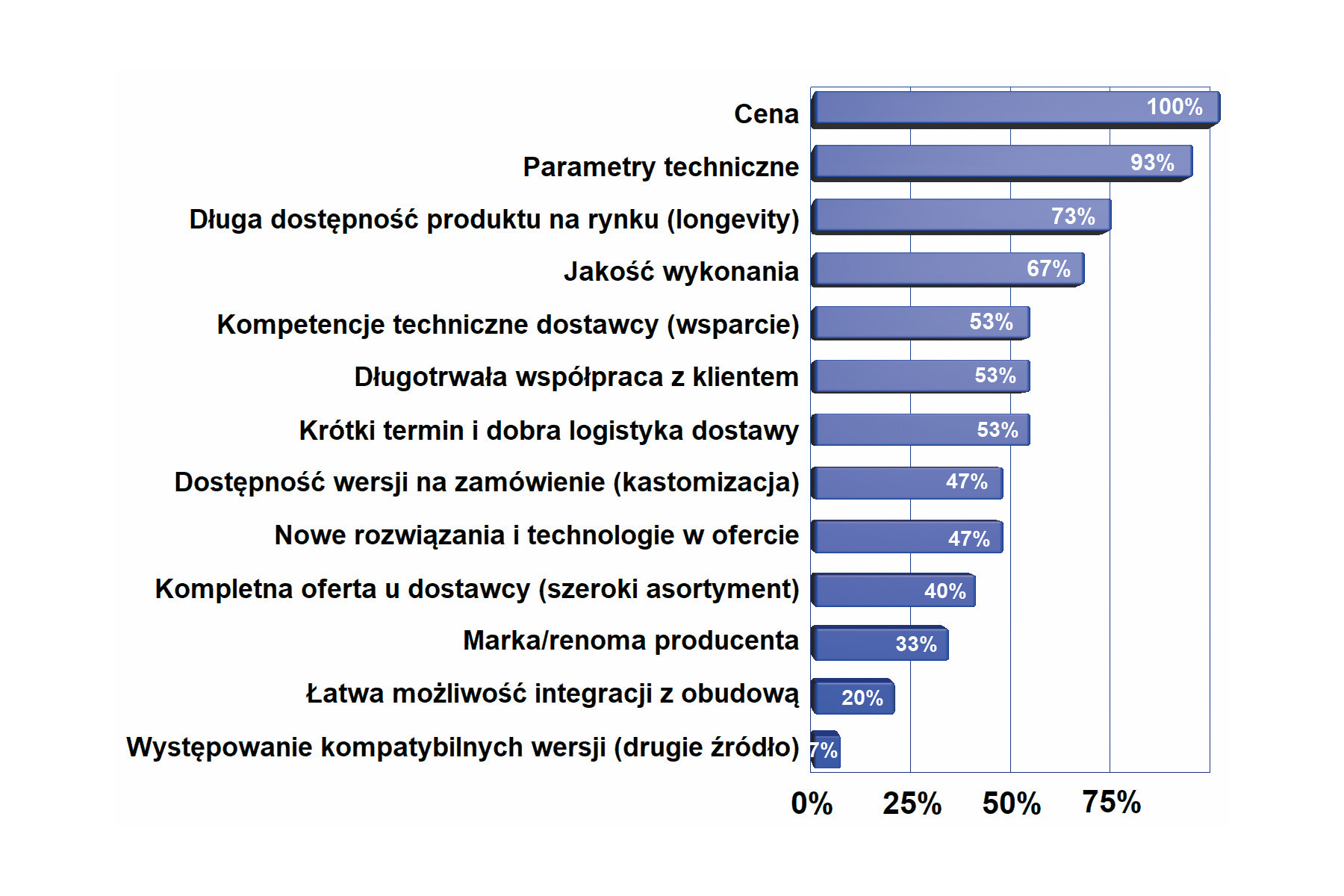

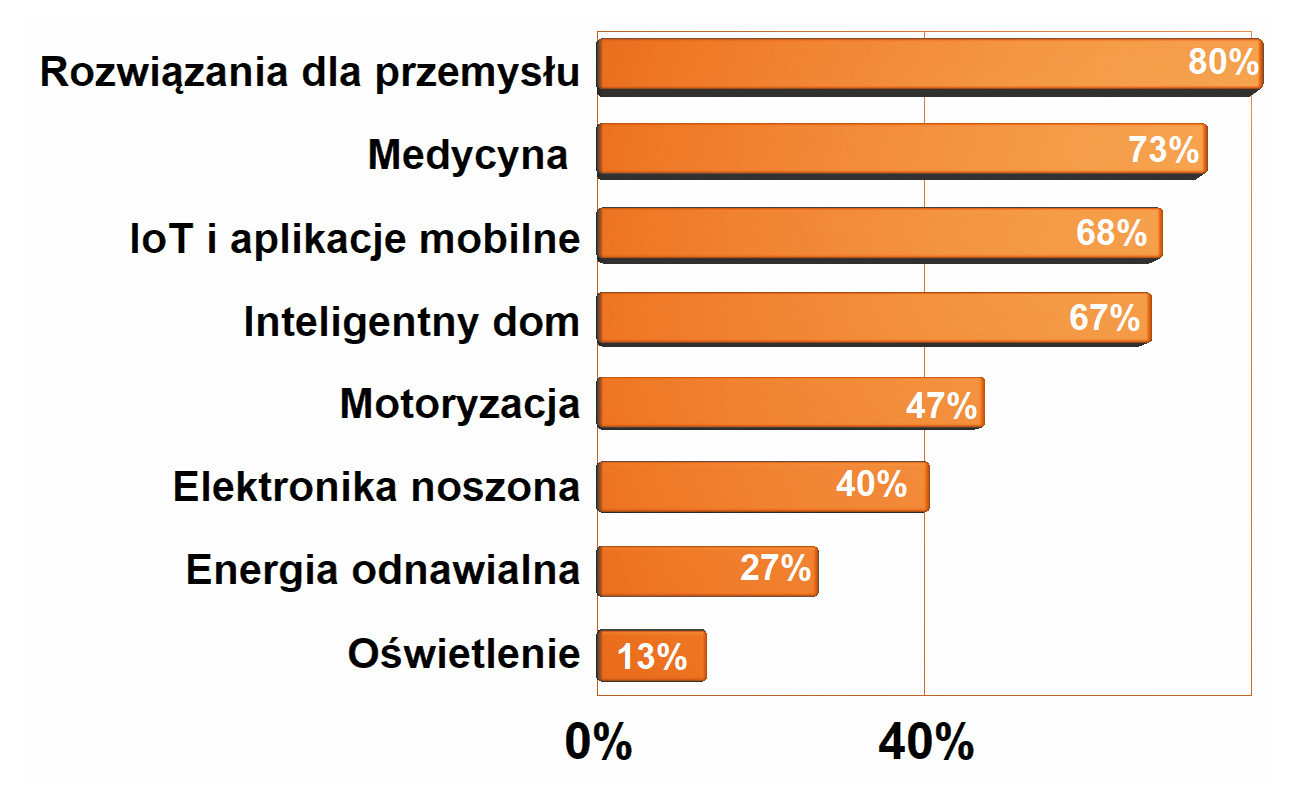

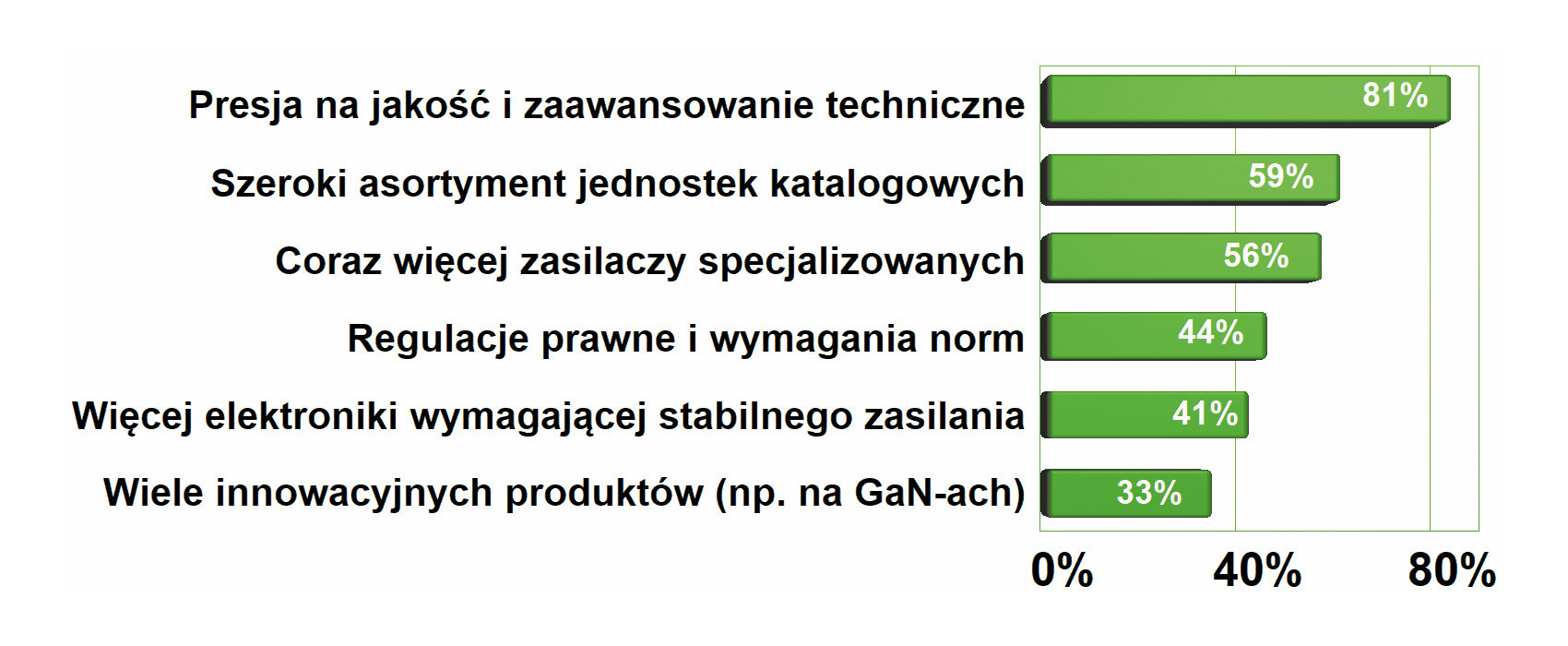

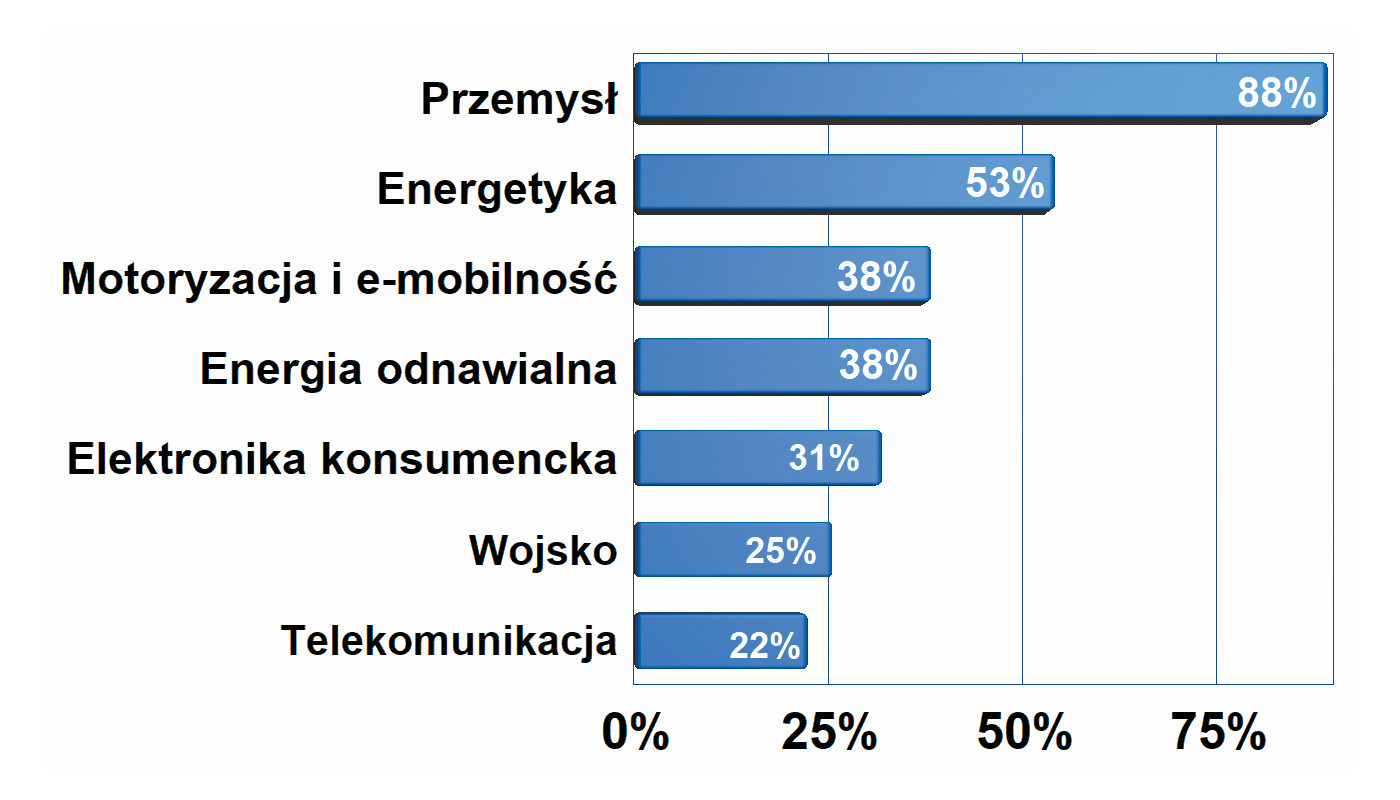

Z wykresu wynika, że dla omawianego rynku w zasadzie wszystko się liczy, bo pola na wykresie mają podobne wskazania procentowe, zaś pierwsze jest na tyle uniwersalne, że da się przypisać do wielu różnych produktów. Wspólnym mianownikiem dla nich jest szybko zwiększające się nasycenie elektroniką każdej dziedziny techniki, która zapewnia szybkie tempo wzrostu rynku.

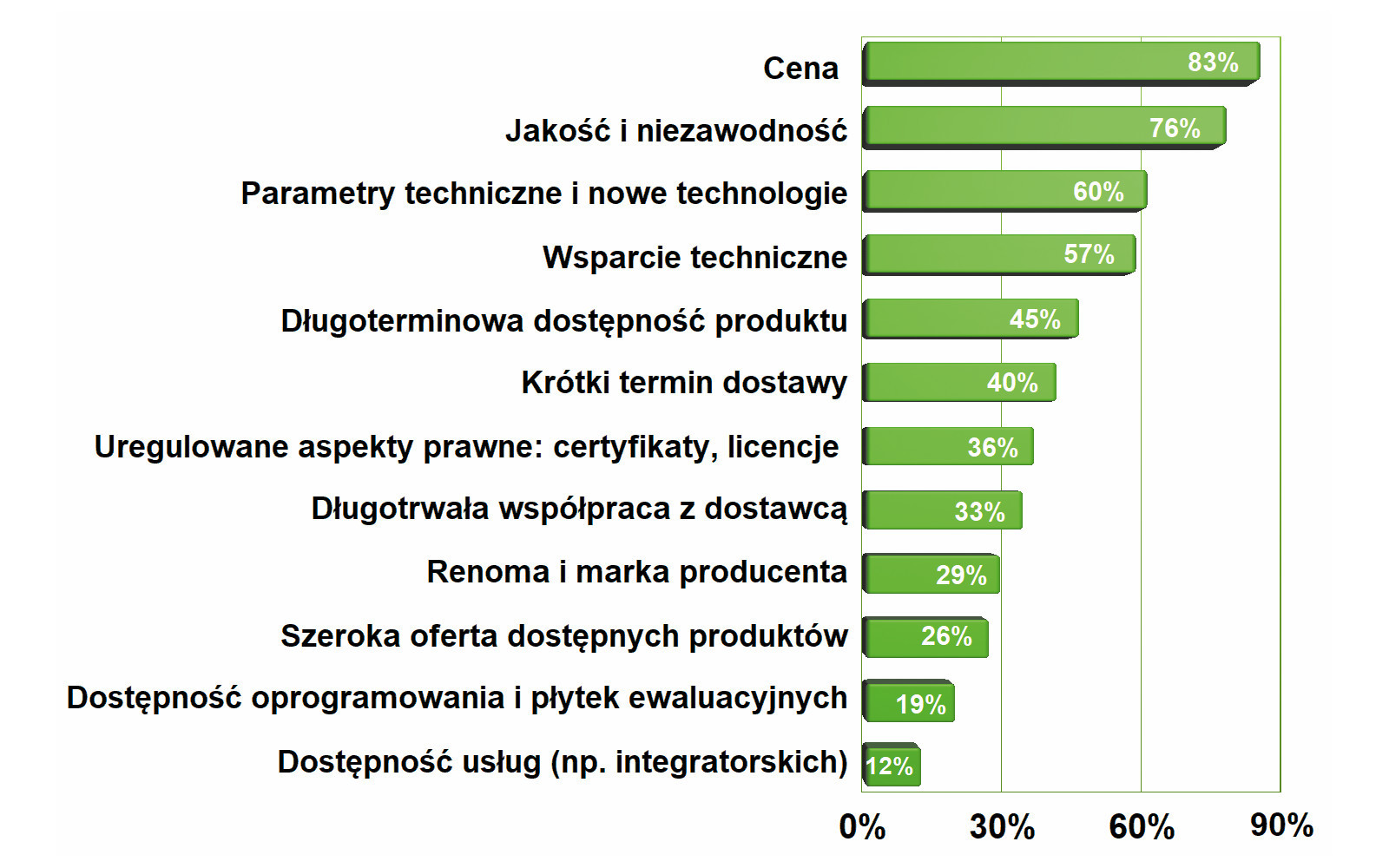

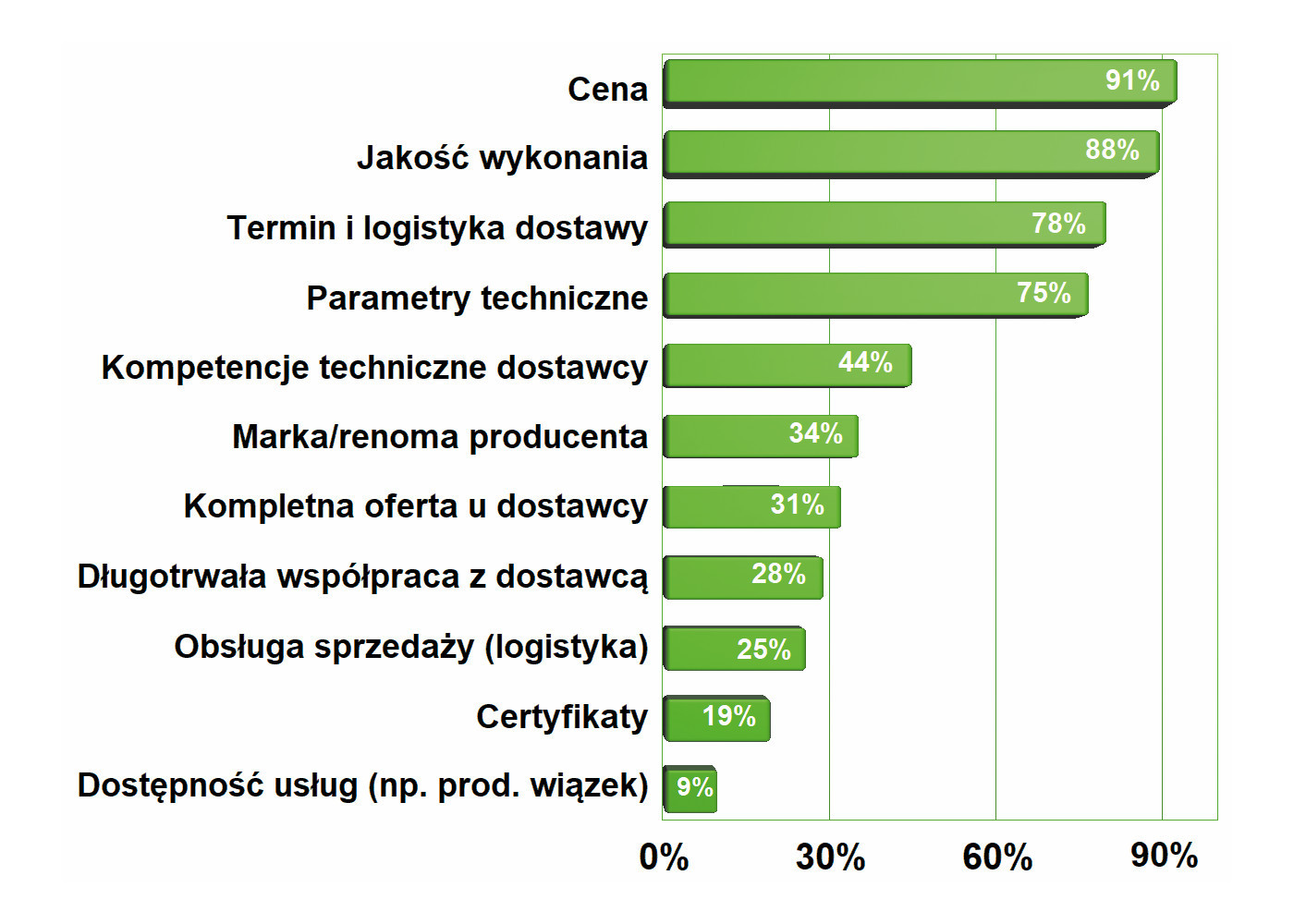

Wsparcie techniczne oraz wysoka jakość to kamienie milowe definiujące współpracę.

Mimo że co do zasady działania elementy indukcyjne są proste, liczba szczegółów technicznych, zjawisk fizycznych, które trzeba brać pod uwagę przy ich aplikowaniu i projektowaniu, jest ogromna. Widać to najbardziej w transformatorach, gdzie dla zapewnienia optymalnych parametrów konieczne jest posiadanie wiedzy z fizyki (zjawiska w magnetykach), elektryki (izolacja, bezpieczeństwo funkcjonalne), kompetencji układowych w zakresie elektroniki (metody impulsowej konwersji mocy), przynajmniej podstawowej wiedzy z obszaru EMC, a w końcu szczegółów technologicznych związanych z produkcją takich elementów i testowaniem ich właściwości.

Na koniec warto dostrzec, że przy ogromnej ofercie rynku w zakresie materiałów magnetycznych, licznych wersji wykonania, różnych obudów i kształtów rdzeni, nawet pobieżna orientacja w tym, co jest nowe, a co już wychodzi z użycia, czym warto się zainteresować i będzie się najlepiej nadawać do projektu, a co jest kompletnie nietrafionym pomysłem, nastręcza sporo trudności. Zatem nawet jeśli wiele osób rozumie, co do zasady, o co chodzi w nawijaniu, tylko ułamek z nich zna się dobrze na takich niuansach. Prawdopodobnie dlatego producenci elementów indukcyjnych tak dużą wagę przykładają do wsparcia technicznego, pomocy projektowej dla klientów i wkładają wiele wysiłku w to, aby pomysły klientów przekuć na działające elementy. Klienci oczekują dzisiaj od transformatorów sieciowych i elementów indukcyjnych do układów impulsowych niezawodnego działania, wysokiej odporności na narażenia środowiskowe, przeciążenia, podwyższoną temperaturę i stany nieustalone.

W ostatnich latach znacznie wzrosła ponadto świadomość klientów na temat wykonania elementów indukcyjnych zgodnie z wymaganiami norm bezpieczeństwa, certyfikacji niepalności UL i takich samych wymagań w stosunku do używanych materiałów konstrukcyjnych. W ramach poprawiającej się dbałości firm o warunki pracy personelu rośnie zapotrzebowanie na transformatory separacyjne, automatykę przeciążeniową i podobne elementy ochronne. Wzrost zainteresowania jakością produkowanych transformatorów i elementów indukcyjnych jest zdaniem niektórych producentów tak wyraźnie widoczny, że cena tych elementów nierzadko schodzi na drugi plan. Innymi słowy, rynek szybko dojrzewa, jeśli chodzi o relacje.

Mocny potencjał krajowych producentów

Produkcja transformatorów oraz dławików bazuje na stosunkowo prostej technologii, dostępnych powszechnie materiałach, jak druty, lice, karkasy, rdzenie, i maszynach do nawijania. W efekcie w kraju funkcjonuje kilkunastu producentów. W ogromnej większości są to firmy z dużym doświadczeniem i kadrą inżynierską, zajmujące się tą działalnością od lat. Na przestrzeli dwóch dekad polscy producenci stali się dobrymi partnerami do interesów z firmami skandynawskimi lub niemieckimi, gdyż zaoferowali konkurencyjnie niższe ceny, wysoką jakość wykonania, przy ważnej z punktu widzenia prowadzonego biznesu bliskości geograficznej. Co więcej, wiele projektów urządzeń specjalistycznych, jakie są cechą szczególną naszego rynku, wymaga takich elementów wykonanych na zamówienie, zwłaszcza transformatorów impulsowych. Wprawdzie wszyscy wytwórcy dostarczają takie indywidualnie dopasowane komponenty, niemniej krajowi wytwórcy mają tu przewagę w postaci szybkości, możliwości zamówienia niewielkich partii i świadczą wysokiej jakości wsparcie techniczne (projekt), co w przypadku tematyki zasilania impulsowego ma spore znaczenie. Stabilna cena i dostępność są podstawą dla tej branży tak samo jak pewność, że zamawiane produkty spełniają wymogi norm obowiązujących w Europie oraz na świecie.

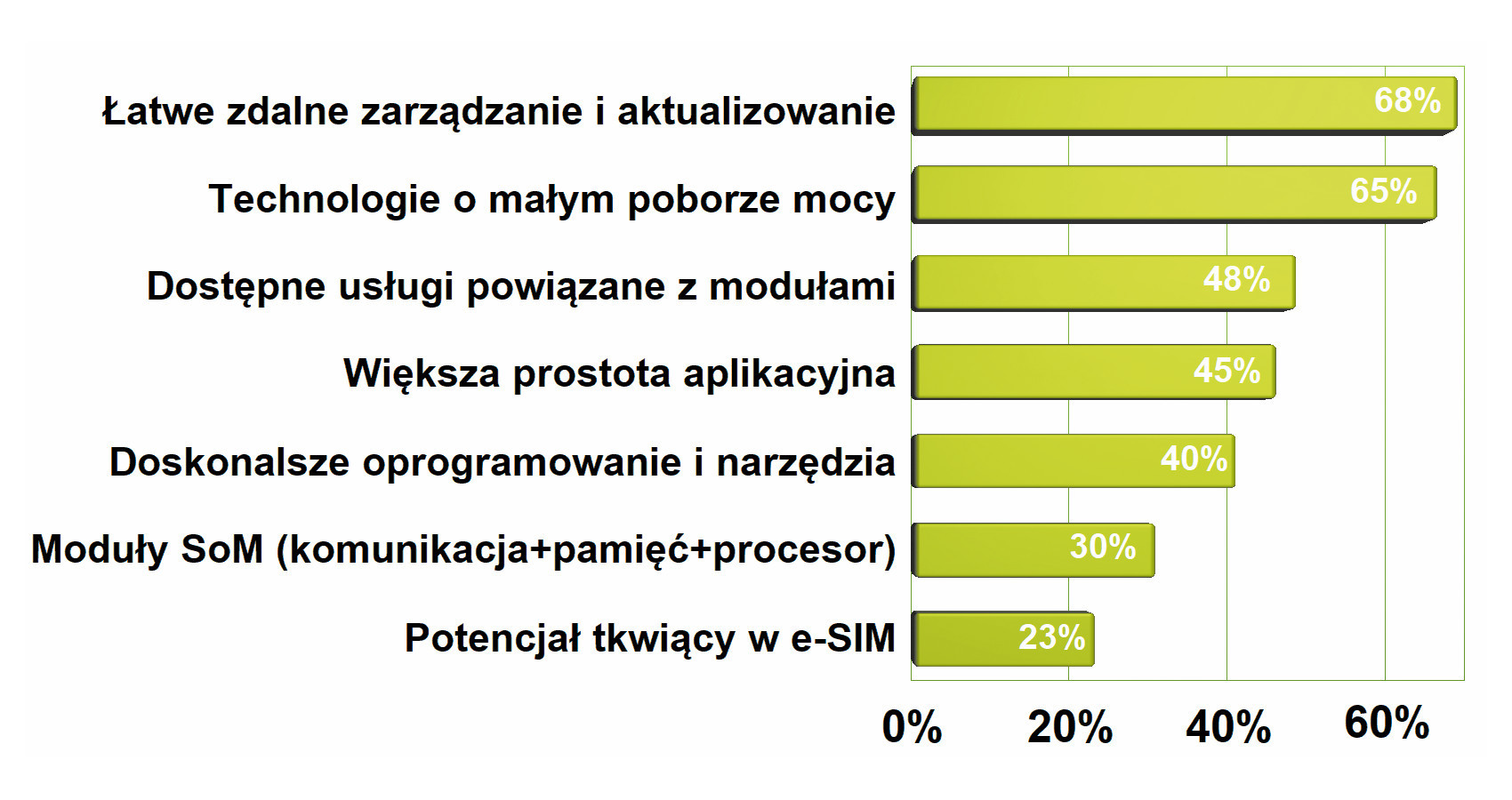

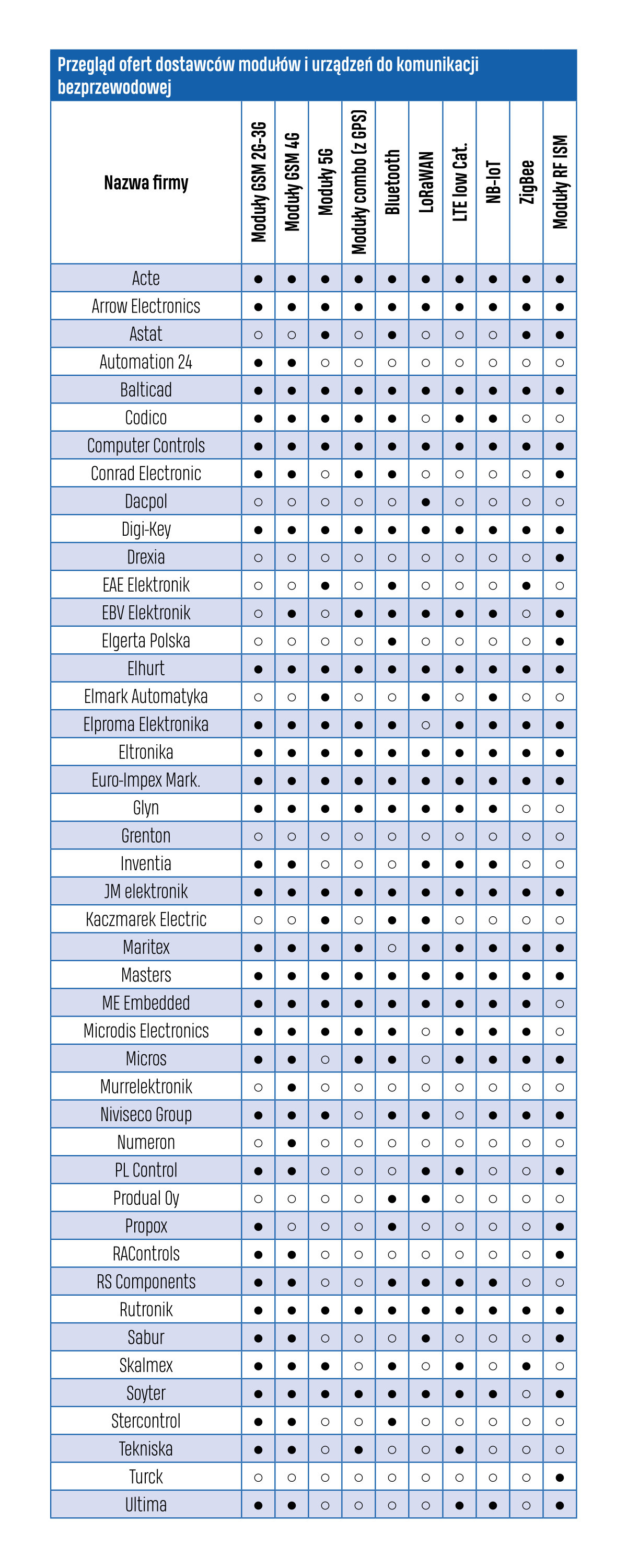

Urządzenia i moduły do komunikacji bezprzewodowej

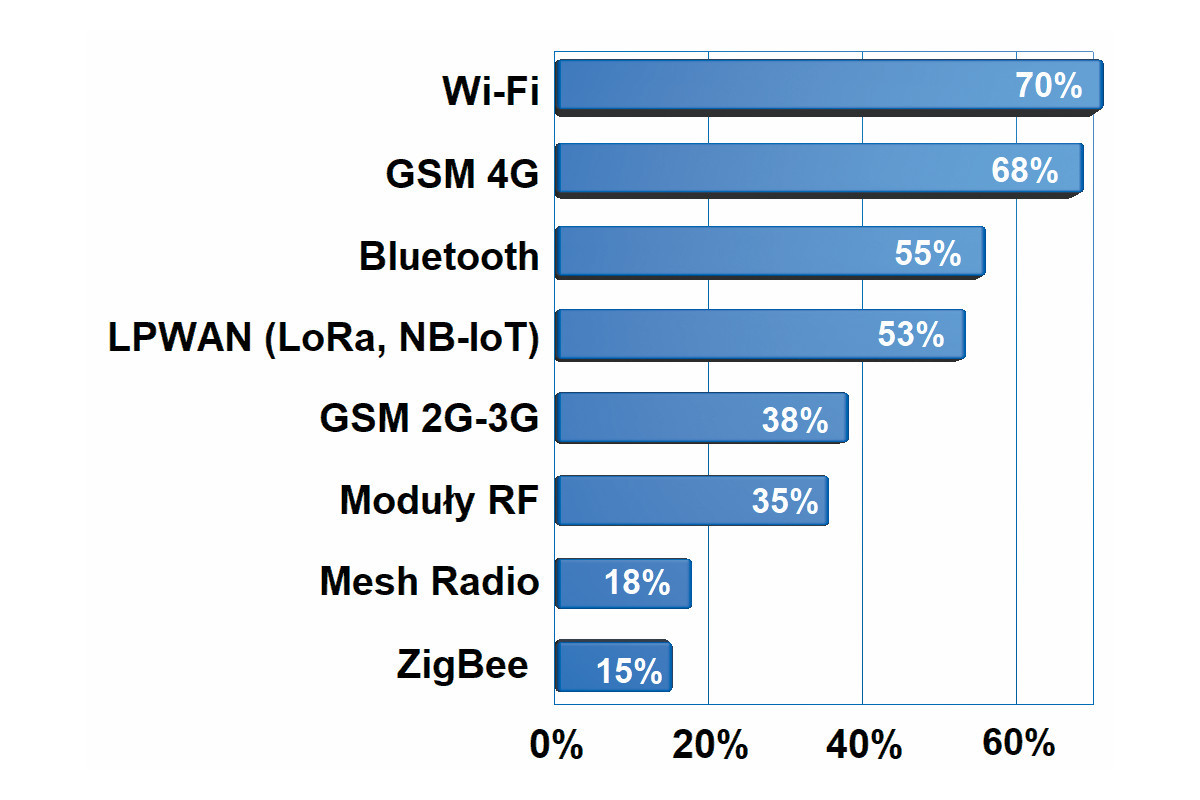

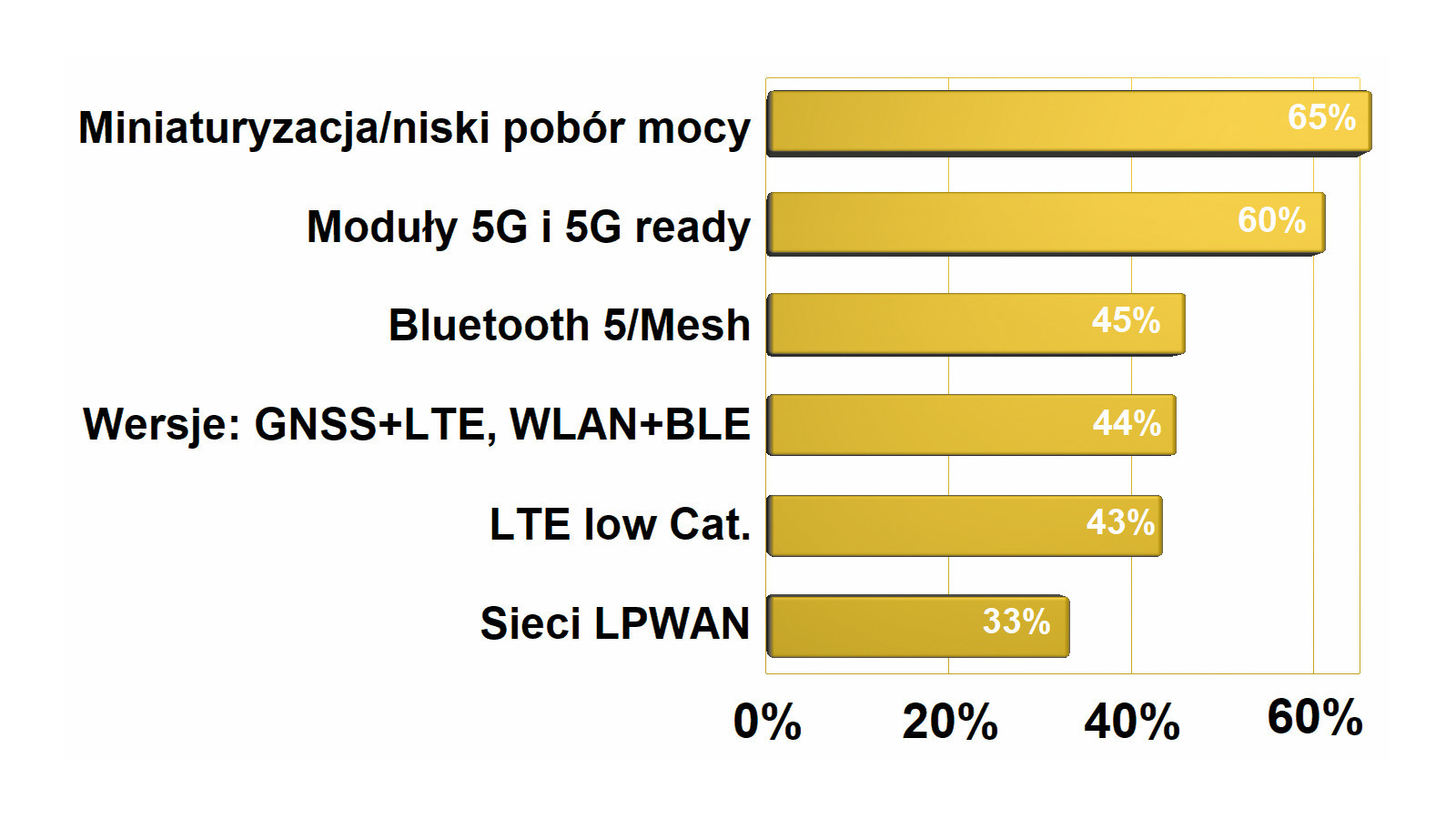

Jeszcze kilka lat temu dużą wartością aplikacyjną było to, że istniała możliwość radiowej wymiany danych, dzisiaj projektanci traktują ją jako oczywistość i wartość dawno zdobytą. Obecnie więcej uwagi kierowane jest na jakość komunikacji, czyli pewność tego, że kanał komunikacji zapewni deklarowaną przepustowość, że nie będzie opóźnień, zacięć, rozłączeń, konieczności resetowania ustawień protokołu i podobnych problemów. Najlepsze rozwiązanie modułu i urządzenia do komunikacji bezprzewodowej jest takie, że działa od momentu załączenia zasilania, a całą obsługę techniczną, w tym modyfikację ustawień, aktualizację oprogramowania, podglądanie stanu z raportowaniem, realizuje się zdalnie (drogą radiową).

Rynek telefonii komórkowej jest w trakcie wielkiej zmiany, jaką niesie ze sobą sieć piątej generacji. Operatorzy komórkowi zapewniają już klientom takie możliwości, ale na razie usługi są niejako pilotażowe, bo są realizowane w oparciu o posiadane już przez operatorów częstotliwości, jak 2,1 GHz dla Play i T-Mobile oraz 2,6 GHz dla Polkomtela. Aby możliwa była pełna ocena zalet sieci 5G, operatorzy muszą dostać dostęp do pasm 3,4‒3,8 GHz, 26 GHz (na pikokomórki) i 700 MHz (na usługi o dużym zasięgu). Aukcje tych częstotliwości miały już dawno się zakończyć, ale z uwagi na politykę, jeszcze trwają.

Razem ze zbliżającą się rewolucją w telekomunikacji następuje też przebudowa infrastruktury komunikacyjnej przez operatorów, którzy stopniowo zamykają BTS-y 2G. Na rynku jest coraz mniej telefonów komórkowych starszej generacji, a utrzymanie infrastruktury kosztuje. W obszarze konsumenckim migracja do sieci 4G jest niejako wymuszona przez kolejne umowy, nowe smartfony, dla modułów tempo migracji jest mniejsze, bo często urządzenia takie pracują długie lata. Niemniej powoli nie oznacza wcale i zmiany technologii z 2G do LTE Cat. 1 lub CAT-M względnie NB-IoT są widoczne.

Na rynku są już też dostępne rozwiązania modułów komunikacyjnych dla sieci 5G i w większości ich możliwości determinowane są przez oprogramowanie firmware. Zatem jeśli nawet obecnie nie obsługują one jakiejś funkcjonalności, z pewnością z czasem będzie można ją dodać z kolejną aktualizacją.

Jak prosto skorzystać ze skomplikowanej technologii

Rosnący stopień skomplikowania i zależności technologii oraz wspomniana szybka ewolucja niestety nie sprzyjają dobrej orientacji klientów i utrudniają optymalne wybory. Klienci bardzo często nie mają świadomości technicznej i ograniczeń związanych z modułami, słabo orientują się w dostępnych nowościach i stąd wymagają wsparcia ze strony sprzedawcy. Wielu traktuje komunikację radiową tak, jak gdyby to odpowiednik kabla, inni zatrzymali się z wiedzą i przykładają stare schematy do nowych wersji. Przy takim podejściu łatwo o rozczarowanie.

Ponieważ moduł komunikacyjny, nawet najlepiej wybrany, nie tworzy aplikacji ani usługi, którą można sprzedać, nierzadko wsparcie dostawców dotyczy też sfery oprogramowania. Ubocznym efektem jest to, że początkowe etapy zarówno sprzedaży, jak i części projektowych wydłużają się zatem i muszą być prowadzone ze szczególną starannością, aby zapewnić klientowi satysfakcję z usługi.

O aplikacji z komunikacją bezprzewodową trzeba dzisiaj w czasie projektowania analizując zagadnienie w sposób kompleksowy, tj. rozpatrując je jako całą sieć powiązanych i zależnych od siebie działań. Gdzieś w takim projekcie jest oczywiście moduł komunikacyjny, ale jest on tylko niewielką częścią całości, zarówno ekonomicznie, jak i technicznie.

Bogata funkcjonalność oprogramowania, usług związanych z akwizycją danych, komunikacją, sprawia, że czołowi producenci rozwiązań komunikacyjnych mogą się w ten sposób wybić ponad przeciętną. Inni, jak duże firmy znane ze świata IT, także poszerzają możliwości swoich rozwiązań o obsługę takich platform. Czasem oznacza to dla nich otwarcie biznesu na nową działalność, ale IoT niczym magnes przyciąga wielu graczy.

Patrząc z perspektywy, można powiedzieć, że zmiany idą w takim kierunku, aby najważniejszym problemem do rozwiązania był pomysł na rozwiązanie problemu lub zyskania korzyści wynikającej z technologii, a nie budowa układu elektronicznego lub pisanie kodu. To zadanie ma się sprowadzać do wyboru rozwiązania spośród wielu dostępnych, niekoniecznie tworzenia własnego, a także kupna usługi (konta) w powiązanej z taką platformą chmurze obliczeniowej zamiast tworzenia i konfigurowania własnej.

Sieci LPWAN

Sieci LPWAN (Low-Power Wide-Area Network) to rozwiązania działające w pasmach ISM, gdzie przy małej przepustowości zapewniony został znacznie większy w porównaniu do innych standardów zasięg komunikacji. W warunkach krajowych oznacza to sieci LoRaWAN oraz LTE Cat. M /NB-IoT (Narrow-Band IoT), które służą głównie do zbierania danych z rozległych aplikacji telemetrycznych. Typowe aplikacje, jak liczniki wody, gazu czy ciepła, systemy alarmowe, czujniki zadymienia, śledzenie ludzi i zwierząt, produkty AGD, kontrola dostępu do budynku, sterowanie oświetleniem, różnego rodzaju czujniki, np. stacje meteorologiczne itp., nie potrzebują większych wydajności, stąd LTE niskiej kategorii może być dobrym pomysłem.

NB-IoT oraz LTE kategorii M to rozwiązania wykorzystujące infrastrukturę sieci komórkowych przeznaczone do aplikacji transmitujących niewiele danych (głównie klasy IoT), niewymagających dużej szybkości, za to efektywnych energetycznie. Działają one w małym paśmie, mają ograniczoną konieczność zgłaszania obecności w sieci i pobierają wielokrotnie mniej energii od zwykłych modułów LTE. Moduły NB-IoT w zamyśle producentów nie mają konkurować z rozwiązaniami 2G/3G/4G, ponieważ nie nadają się do aplikacji z regularnym, dużym/średnim transferem danych. Otwierają jednak nowe możliwości wykorzystania infrastruktury sieci 4G w aplikacjach zasilanych z baterii przy niskiej cenie i dobrym zasięgu wewnątrz budynków. Uwalniają też od ryzyka związanego z perspektywą pogorszenia się zasięgu sieci 2G, a przecież wiele urządzeń ma takie moduły cały czas działające, bo są one bardzo tanie.

Moduły do sieci komórkowych

Moduły przeznaczone do pracy w sieciach komórkowych cały czas stanowią główny nurt sprzedaży, a dodatkowym czynnikiem poprawiającym tempo rozwoju rynku jest ciągły spadek ich cen lub wzrost funkcjonalności i zasobów, które się dostaje za daną sumę. Upraszcza to implementację i obniża koszty docelowej aplikacji, gdyż na przykład zewnętrzny mikrokontroler lub dodatkowe układy stają się zbędne. Często więc sam moduł wystarcza do realizacji aplikacji, bo ma dostępne nie tylko zasoby obliczeniowe i pamięć, ale też układy peryferyjne. Umożliwia to znaczne skrócenie czasu potrzebnego na wdrożenie aplikacji, uproszczenie płytki PCB oraz zmniejszenie rozmiarów finalnego urządzenia, co ma szczególne znaczenie w dobie IoT.

Jeszcze do niedawna zdecydowana większość sprzedawanych modułów to były głównie jednostki GSM/ GPRS, przeznaczone do aplikacji niewymagających przesyłania dużej ilości danych. Obecnie widać wyraźny wzrost sprzedaży modułów o większej szybkości zdolnych do pracy w sieciach LTE. Moduły do sieci komórkowych zwykle pozwalają na migrację od rozwiązań najprostszych do najbardziej wydajnych bez konieczności przeprojektowania płytki lub też na stworzenie jednej mozaiki do produktu na różne rynki i standardy (Europa, USA). Dostępne są też wielosystemowe "kombajny" oraz wersje z wbudowanym odbiornikiem lokalizacyjnym GPS+Glonass+Beidou lub Bluetooth albo Wi-Fi.

W zależności od obsługiwanej kategorii sieć w standardzie LTE zapewnia transmisję danych z prędkością do 150 Mbps (dla kat. 4) dzięki możliwości pracy wieloantenowej (MIMO), pozwalającej na jednoczesny odbiór i nadawanie danych w wielu kanałach jednocześnie. Niemniej takie rozwiązania o dużej wydajności są oczywiście kosztowne, stąd dla aplikacji IoT i podobnych rozwiązań producenci przygotowali produkty bazujące na LTE niższych kategorii, 0, 1 (o przepustowości do 10 Mbps) lub M1. Działają one w sieci LTE, a więc nie niosą ze sobą ryzyka projektowego, że z czasem stracą zasięg, ale też nie są przewymiarowane w stosunku do potrzeb aplikacji. Typowe aplikacje, jak liczniki wody, gazu czy ciepła, systemy alarmowe, czujniki zadymienia, śledzenie ludzi i zwierząt, produkty AGD, kontrola dostępu do budynku, sterowanie oświetleniem, różnego rodzaju czujniki, np. stacje meteorologiczne itp., nie potrzebują większych wydajności stąd LTE niskiej kategorii może być dobrym pomysłem.

Bluetooth low energy

Najnowszy Bluetooth Low Energy (BLE) w wersji 5 to kolejna usprawniona wersja doskonale znanego standardu komunikacyjnego, która dobrze wpasowuje się w potrzeby aplikacji IoT, elektroniki noszonej i innych urządzeń zasilanych z baterii. BLE jest efektywny energetycznie (stąd nazwa) i zapewnia większą efektywność komunikacji, lepszą elastyczność pracy i konfiguracji dołączonych urządzeń, w tym możliwość jednoczesnej pracy w trybie nadawania i odbioru danych. Niższe są też koszty implementacji. Rosnąca popularność BLE w urządzeniach mobilnych powodują, że Bluetooth Low Energy jest najpopularniejszą metodą komunikacji urządzeń typu wearables.

Bluetooth jest przydatny wszędzie tam, gdzie konieczne jest nie tyle stworzenie całej sieci, co jedynie przesłanie, od czasu do czasu, niewielkiej ilości danych na niedużą odległość. Wersje BLE pozwalają tworzyć energooszczędne urządzenia pracujące na zasilaniu bateryjnym przez wiele lat i np. przesyłające od czasu do czasu zgromadzone dane.

Wi-Fi

W dziedzinie komunikacji bezprzewodowej Wi-Fi jest jednym z najbardziej powszechnych sposobów łączności zapewniającej bezpieczne, niezawodne i szybkie połączenia bezprzewodowe IP. Takie moduły wybierane są zwykle, gdy pobór energii jest drugoplanowy, a liczy się łatwość rozszerzenia urządzenia o komunikację opartą na protokole IP bez wprowadzania większych modyfikacji w działających urządzeniach lub rozszerzenie dowolnych urządzeń wyposażonych w interfejsy UART, SPI, RMII, USB lub LAN o bezprzewodowość. Moduły Wi-Fi to rozwiązania niedrogie, często wykorzystywane jako mosty zapewniające "przezroczystą" transmisję sygnałów. Są one podstawą aplikacji przemysłowych, medycznych, a koncepcyjnie moduły te są zbliżone do całej reszty już omówionych rozwiązań. Komunikację Wi-Fi mają wbudowane licznie dostępne na rynku płytki rozwojowe i większość platform do IoT. Dużą popularność W-Fi (i Bluetooth) w zakresie IoT zapewniają mikrokontrolery z wbudowaną komunikacją, np. Espressif ESP8266.

RF – ciągle się rozwija, bo są niedrogie mcu z RF

Komunikacja bezprzewodowa to także rozwiązania, gdzie nie są potrzebne standardy, duży zasięg lub przepustowość. Aplikacje, gdzie dochodzi do podłączenia jednego urządzenia do sterownika, takie, gdzie nie ma wymagań co do interoperacyjności na poziomie protokołu i podobnych, a więc ogólnie klasa zagadnień o mniejszej złożoności, są z powodzeniem obsługiwane za pomocą modułów radiowych, wbudowanych do wnętrza MCU, dostępnych w formie specjalizowanego chipa. Są to też moduły hybrydowych transceiverów radiowych przeznaczone do wlutowania w PCB, które na wejściu i wyjściu dostarczają/przyjmują zwykły sygnał cyfrowy, realizując modulację/demodulację oraz obsługę toru w.cz.

Takie produkty zawsze będą, bo nikt rozsądny nie będzie robił bezprzewodowego dzwonka do bramy na czymś bardziej skomplikowanym. Taki moduł pozwala też zrobić rozwiązanie o charakterze własnościowym (np. w alarmie) z użyciem specyficznego kodowania lub szyfrowania, bo nie zawsze korzystanie z czegoś znanego jest rozsądne. Jak wiadomo w przypadku sieci bezprzewodowych zagadnienia bezpieczeństwa stają się coraz bardziej istotne, a w przypadku aplikacji IoT nawet są postrzeganie jako kluczowe czynniki dla rozwoju. Stąd tor radiowy z własną obsługą transmisji bywa interesującym pomysłem w pewnej klasie aplikacji, np. w systemie alarmowym.

Moduły wielosystemowe

Coraz więcej modułów do komunikacji bezprzewodowej to wersje wielostandardowe lub wielofunkcyjne. Najczęściej Wi-Fi łączy się w jednym komponencie z Bluetooth, a moduły komunikacyjne z nawigacją, np. LTE- +GNSS. Takie połączenie jest wygodne, tańsze, zajmujące mniej miejsca i tym samym lepiej dopasowane do wymagań aplikacyjnych. Przykładem może być lokalizator wysyłający pozycję obiektu za pomocą sieci komórkowej lub automat podłączony na stałe do sieci przez Wi-Fi, ale także umożliwiający podłączenie się przez Bluetooth użytkownikom/pracownikowi serwisu. Sytuacji, gdzie dodatkowy interfejs jest potrzebny lub przynajmniej mile widziany, jest coraz więcej i stąd produkty takie zyskują na popularności.

Takie komponenty wspierają projektanta w zakresie oprogramowania, czyli wymagają mniej zabiegów programistycznych nad przekodowaniem, przesłaniem i obróbką danych. Domyślne zadania, jak wysyłanie pozycji przez modem komórkowy, są już wstępnie przygotowane przez producenta. Moduły wielosystemowe są też mniejsze od każdego alternatywnego rozwiązania, a to w obszarze elektroniki mobilnej oraz aplikacji IoT jest bardzo istotne. To samo dotyczy mniejszego poboru mocy, liczby wymaganych elementów zewnętrznych.

Usługi

Im bardziej aplikacje komunikacji bezprzewodowej są powszechnie wykorzystywane, rozproszone po obiektach, w przestrzeni jako elementy systemów pomiarowych, sieci sensorycznych, tym bardziej rośnie znaczenie dostępności usług związanych z obsługą zdalną takich aplikacji. Aby możliwe było zainstalowanie czujnika w niedostępnym miejscu, konieczne jest zapewnienie bezobsługowości, czyli możliwości aktualizacji oprogramowania drogą radiową, monitorowania stanu, diagnozowania działania i podobnych. Dla wielu takich zastosowań jedną z najważniejszych funkcjonalności jest też możliwość wysyłania danych do chmury, po to, aby dane były gromadzone w sposób automatyczny i dalej przetwarzane.

Z czasem znaczenie tej sfery działania aplikacji staje się coraz bardziej istotne, a usługi towarzyszące takiej komunikacji, związane z obróbką danych, stają się coraz istotniejsze. Nietrudno dostrzec, że w obszarze IoT mamy do dyspozycji coraz bardziej uniwersalne, zaawansowane platformy sprzętowe. Coraz łatwiej kupić rozwiązania prawie gotowe, takie które wymagają jedynie konfiguracji, niewielkiej integracji (obudowa, zasilanie, podłączenie czujnika) i tym samym wysiłek projektanta kieruje się w stronę aplikacyjną, integracyjną oraz właśnie związaną z analityką danych. Jest to słuszny kierunek, bo przecież nie ma sensu, aby każdy inżynier zajmujący się IoT i komunikacją bezprzewodową rozwiązywał podstawowe problemy z tworzeniem hardware, firmware, bo część ta jest w sumie zawsze podobna, a poza tym coraz bardziej zaawansowana technologia półprzewodnikowa pozwala zamknąć ją do jednego chipa.

Mikrokontrolery i platformy IoT

O mikrokontrolerach w mediach było głośno dwa lata temu, kiedy w pandemii zaczęły się kłopoty z ich dostępnością, a czasy realizacji zamówień pobiły rekordy, często przekraczając znacznie cały rok. Wówczas okazało się, jak bardzo jesteśmy zależni od tych jednostek i jak mało poświęcaliśmy uwagi w projektach na minimalizację ryzyka związanego z jednym źródłem zaopatrzenia, typem układu, a nawet używaną obudową.

Problemy z kupnem układów dla większości firm okazały się dużym kłopotem: organizacyjnym, technicznym i finansowym. Zmusiły do zmiany wypracowanych mechanizmów działania, źródeł zaopatrzenia, a niejeden projekt musiał zostać przeprojektowany pod to, co akurat udało się kupić. Problemy z zaopatrzeniem doprowadziły ponadto do sytuacji, że producenci elektroniki zmuszeni byli akceptować każde warunki dostaw i ceny, zaczęli się interesować odpowiednikami funkcjonalnymi (klonami) poszukiwanych chipów, co wcześniej było prawie nie do pomyślenia. Problemy z zaopatrzeniem zwiększyły także świadomość klientów, którzy odchodzą dzisiaj od zamkniętych systemów i architektur własnościowych i stawiają coraz częściej na systemy elastyczne, otwarte, możliwe do rozbudowania o urządzenia pochodzące od różnych producentów. Wypracowywana w ostatnich latach koncepcja utrzymywania małych zapasów magazynowych i kupowania potrzebnych ilości na bieżąco z dnia na dzień też odeszła w przeszłość i nie wiadomo, czy kiedyś wróci.

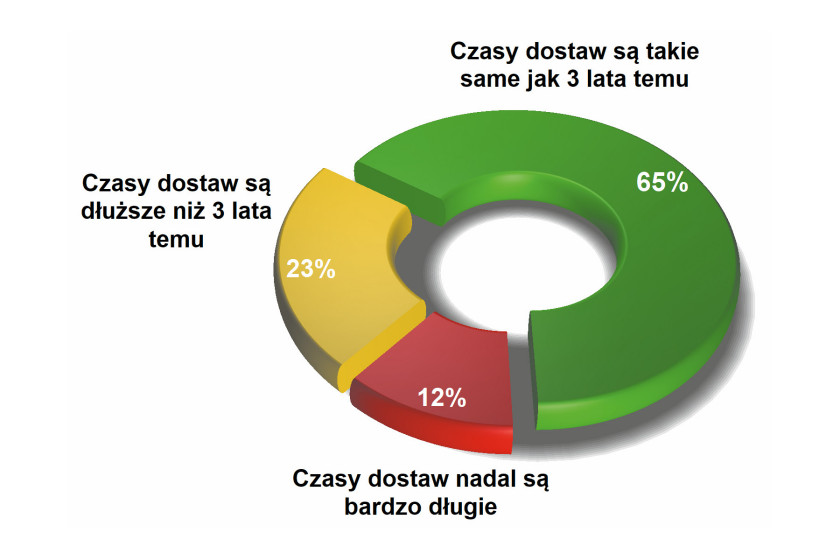

Wiele z opisanych wyżej problemów rynkowych zalicza się już do przeszłości, mimo że czasy dostaw jeszcze nie wróciły całkowicie do normy. Niestety, wojna ciągle wpływa na dostępność, czasy dostaw i ceny. Zresztą nie wiadomo, czy kiedykolwiek łańcuchy wrócą do tego, co było. Nie wiadomo też, czy to, co było dwa lata temu normą, dalej obowiązuje jako wyznacznik stabilności. Dostępność z pewnością się poprawia, bo linie produkcyjne cały czas pracują, a jednocześnie popyt rynku zmalał, dzięki czemu luki w magazynach łatwiej zapełnić. Producenci nagromadzili też zapasy, bojąc się niepewności i na razie ograniczają zakupy w oczekiwaniu na ożywienie rynku.

Niestety mikrokontrolery znacząco podrożały, tak mniej więcej dwukrotnie i realizacja projektów wrażliwych na cenę jest znacznie trudniejsza. Przykładem mogą być rozproszone sieci sensoryczne w IoT, składające się z wielu węzłów, z których każdy zawiera mikrokontroler. Przed nami zapewne są kolejne podwyżki wywołane inflacją oraz wzrostem cen u producentów półprzewodników. Największe na świecie fabryki chipów, w tym TSMC, Samsung i Intel, rozważają podwyżki cen z powodu inflacji oraz rosnących kosztów. W efekcie wzrostu cen materiałów, kosztów pracy i mediów konieczne staje się ciągłe przeliczanie opłacalności wielu inwestycji i realizowanych projektów.

Na dodatek sytuacja w ostatnich miesiącach w gospodarce nie jest najlepsza. Dużym problemem na rynku jest wstrzymanie finansowania z funduszy unijnych (środki z KPO), przez co wiele projektów rozwojowych, infrastrukturalnych jest zawieszonych. Gospodarka krajowa, a także europejska, przechodzi okres spowolnienia i ma to wpływ na rynek i sprzedaż. Mniej mówi się o cyfryzacji przemysłu i usług, mimo że trend ten cały czas jest postrzegany jako ważny i przyszłościowy, więcej o technologiach AI/ML, edge computing, które nie tylko są domeną mikroprocesorów, ale też "słabszych" jednostek. W największym stopniu dotyczy to oczywiście uczenia maszynowego, z uwagi na ograniczoną moc przetwarzania danych w MCU.

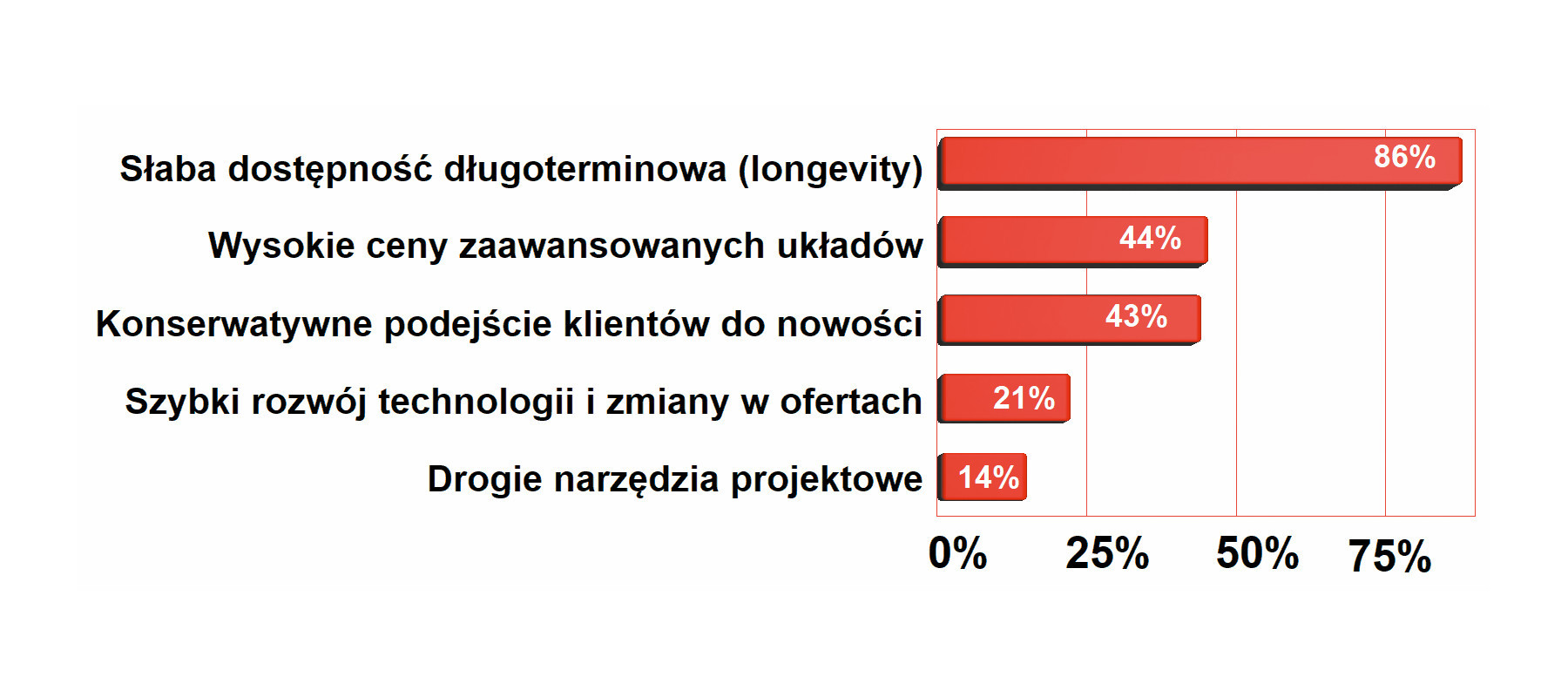

Poza nie najlepszym otoczeniem gospodarczym firmy sygnalizują, że czas funkcjonowania układów na rynku się skrócił (tzw. okres longevity). Gorzej sprzedające się układy, te mniej popularne, są wycofywane z ofert i na ich miejsce wprowadzane są inne. Powodem jest chęć optymalizacji mocy wytwórczych i sprostanie potrzebom zakupowym jak największej części klientów. To słuszne cele, niemniej sprawiają one problemy w przypadku elektroniki profesjonalnej, która jest długo produkowana i serwisowana.

To samo dotyczy obudów układów scalonych, których różnorodność jest dzisiaj znacznie mniejsza niż dawniej. Zmiana obudowy nie jest wprawdzie tak trudna jak przesiadka na inny procesor, ale też wymaga poświęcenia czasu na zmiany mozaiki PCB. Nowe obudowy to często wersje bezwyprowadzeniowe o małych rastrach. Ich montaż i serwis mogą wymagać lepszego sprzętu w sensie zaawansowania technologicznego.

Do negatywnych zjawisk można też zaliczyć rozbieżność oczekiwań programistów i architektów infrastruktury a możliwościami technicznymi urządzeń, takimi jak moc obliczeniowa, wielkość pamięci, duży pobór mocy, brak kompatybilności urządzeń w systemie. Można też zwrócić uwagę na jeszcze jeden aspekt – cyberbezpieczeństwo, które niedostatecznie poważnie traktowane może prowadzić do wycieku danych, produkcyjnych czy klientów. O tym się mówi coraz częściej, niemniej praktyka bywa niestety bardzo beztroska.

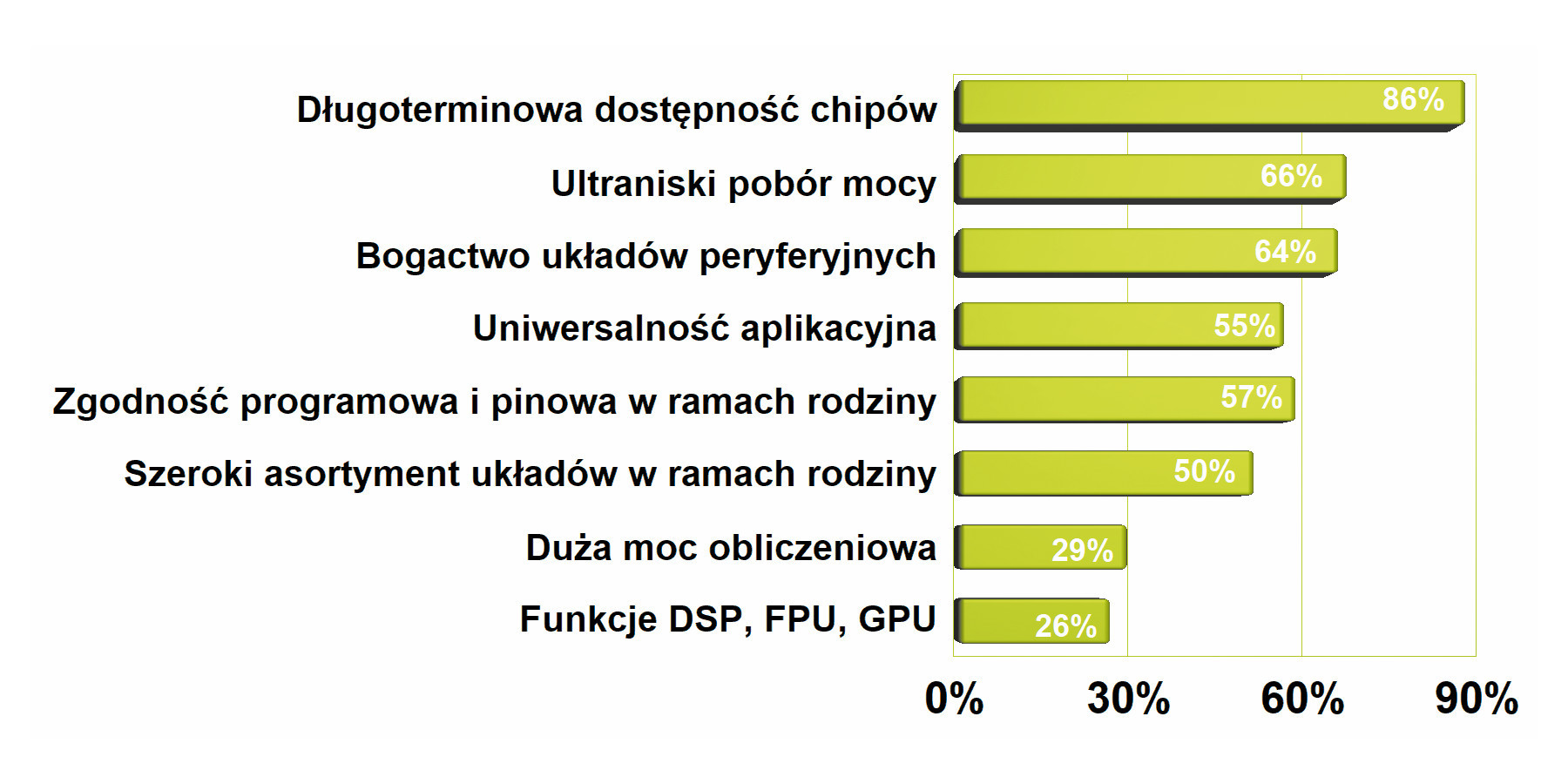

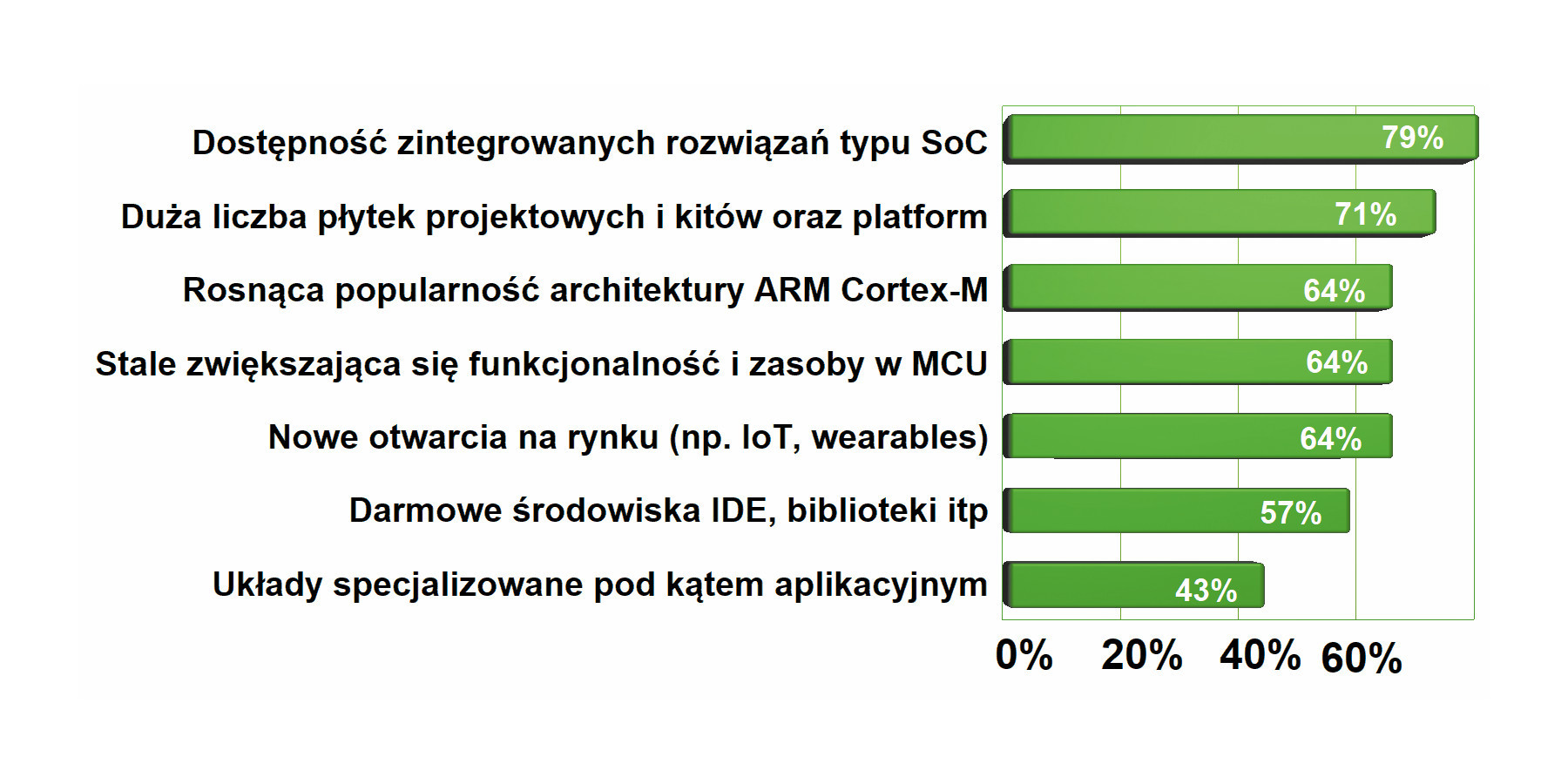

Na trzecim miejscu zestawienia mamy bogactwo układów peryferyjnych, a więc dodatków wbudowanych w strukturę mikrokontrolera. Peryferia są istotne, gdyż w wielu przypadkach zasoby MCU tworzą całość warstwy sprzętowej aplikacji, takiej jak IoT.

Mikrokontrolery mogą być postrzegane jako prawdopodobnie najpopularniejszy typ układów scalonych i funkcjonalnych na rynku elektroniki, najbardziej uniwersalny i wykorzystywany praktycznie w każdej aplikacji. Z tego powodu rozwój technologiczny w tym obszarze jest dynamiczny, a kolejne jednostki wchodzące na rynek charakteryzują się większą wydajnością, mniejszym poborem mocy, większą liczbą zaawansowanych układów peryferyjnych. Rozwój rynku wspierają też liczne narzędzia programistyczne, zintegrowane środowiska programistyczne i biblioteki pozwalające niewielkim wysiłkiem zyskać cenną funkcjonalność, taką jak na przykład uczenie maszynowe. Wiele innych typów układów scalonych projektuje się pod kątem współpracy z mikrokontrolerami, stąd to co dzieje się w omawianym obszarze, wpływa istotnie na biznes.

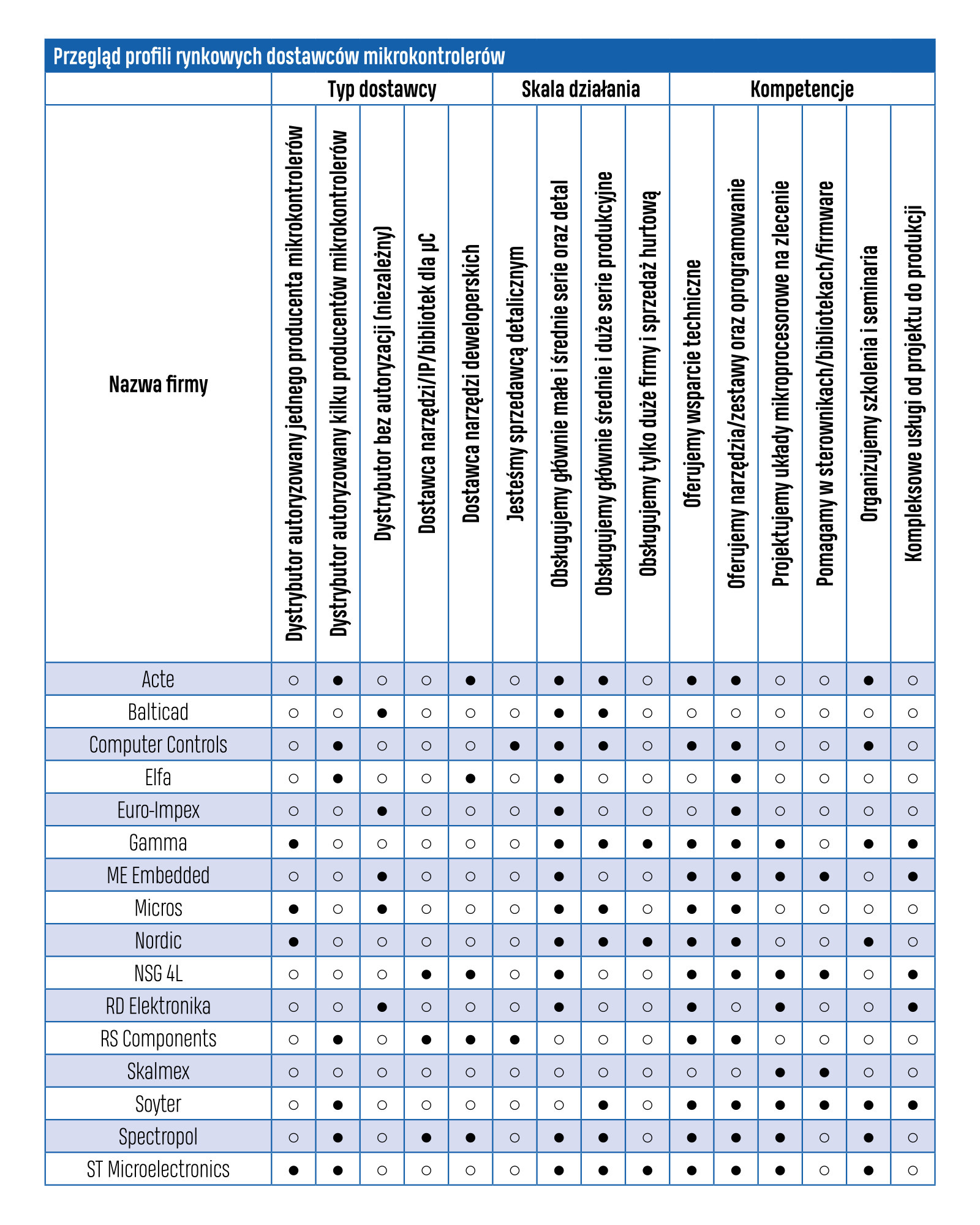

Wsparcie techniczne

Z uwagi na coraz większą złożoność, krótszy czas funkcjonowania chipów w branży, dla każdego klienta odpowiednie wsparcie techniczne świadczone przez dystrybutora z roku na rok staje się coraz bardziej istotne. Obecnie na rynku jest bardzo dużo podobnych funkcjonalnie produktów i wiele z nich jest do siebie podobnych. Wybór optymalnego rozwiązania staje się niełatwy i czasochłonny, a przecież codziennym kłopotem współczesnego projektanta jest chroniczny brak czasu. Stale zwiększa się liczba zagadnień technicznych i wymagań, o których trzeba pamiętać oraz je uwzględnić. W wyżyłowanych do granic projektach o powodzeniu decydują drobne szczegóły, a często wybiera się nie tyle komponent, co całe środowisko i architekturę, łącznie z oprogramowaniem narzędziowym, zestawami ewaluacyjnymi, a nawet próbkami.

Płytki startowe razem ze społecznością inżynierską na forach dyskusyjnych ograniczają zapotrzebowanie na wsparcie techniczne, dlatego producenci i dystrybutorzy wspierają takie działania i bardzo często prowadzą je dla społeczności, a ich specjaliści aktywnie odpowiadają na podające tam pytania. Wiele problemów aplikacyjnych jest wspólnych dla danego zastosowania, stąd duża szansa, że temat omówiony na forum okaże się przydatny dla kolejnego użytkownika i nie będzie wymagać kontaktu z inżynierami pomocy technicznej. Gotowa płytka eliminuje ponadto wiele trywialnych błędów projektowych niepowiązanych z tworzoną aplikacją lub też zwykłych pomyłek, które paradoksalnie potrafią być trudne do zauważenia.

Wsparcie techniczne dystrybutorów jest też przeciwwagą dla sprzedaży typu direct, a więc kupowania przez Internet bezpośrednio od producenta. Taki model producenci próbują upowszechniać od lat, z różnym skutkiem.

Oprogramowanie równie istotne jak hardware

Na szybkość projektowania ma też wpływ czas przygotowania oprogramowania i z reguły jest to zagadnienie bardziej istotne od warstwy sprzętowej. To dlatego, że wiele aplikacji składa się z mikrokontrolera razem z niewielkim otoczeniem układów pomocniczych i peryferyjnych i od strony układowej są one stosunkowo proste. To jest normalne działanie, bo konieczność minimalizacji kosztów prowadzi do tego, aby koszt materiałowy zdefiniowany przez listę BOM był jak najniższy. Z uwagi na to korzystniej jest implementować więcej funkcji użytkowych w oprogramowaniu, bo związane z nim wydatki nie dotyczą każdej wytworzonej sztuki.

Te procesy sprawiają, że rola oprogramowania firmware cały czas się zwiększa. Staje się ono bardziej rozbudowane i złożone, a czas jego przygotowania (napisania) jest coraz dłuższy.

Na drugim miejscu pod względem ważności oddziaływania regresywnego wskazano wysokie ceny. W czasie rynkowych niedoborów wzrost cen jest naturalną konsekwencją, niemniej w przypadku MCU wykracza on poza wszelkie wskaźniki inflacyjne i to zapewne było powodem tak wysokiej pozycji w ankietach.

W ankietach blisko 50% trafień padło też na "konserwatywne podejście klientów do nowości", a więc przywiązania klientów do wypróbowanych i znanych architektur MCU i istniejących w ich obrębie typów i niechęci do wyjścia poza znany schemat. Inercja z pewnością od wielu lat przeszkadza w dynamice rozwoju rynku, nie tylko mikrokontrolerów, ale także wielu innych grup produktów, ale z drugiej strony, są to skomplikowane produkty, do których wiedzę, narzędzia sprzętowe, oprogramowanie gromadzi się przez długi czas. Zgromadzenie tego zabiera mnóstwo czasu, więc naturalne jest, że firmy chcą jak najdłużej korzystać z dorobku. Poza tym inercję inżynierską można też traktować jako właśnie efekt krótkiej żywotności rynkowej układów.

Podobnie jak zestawy startowe, projekty aplikacyjne lub gotowe rozwiązania dostarczane przez działy wsparcia technicznego producenta i dystrybutora ułatwiają budowę części sprzętowej, takie same zjawiska można dostrzec w zakresie oprogramowania. Podstawą są zintegrowane środowiska typu IDE, ale największą pomoc zapewniają gotowe kawałki kodu, biblioteki procedur lub nawet gotowe rozwiązania z otwartą licencją, które wystarczy przerobić pod swoje potrzeby. Takie zasoby też się bardzo szybko zwiększają i mają duży wpływ na tempo rozwoju rynku i na akceptację nowych rozwiązań. Poza oprogramowaniem darmowym na rynku jest jeszcze wiele narzędzi płatnych związanych np. z grafiką, interfejsem użytkownika. Konieczność pracy od zera jest chyba bardzo rzadkim przypadkiem.

Coraz większe znaczenie w tworzeniu oprogramowania mają języki wysokiego poziomu, także wersje skryptowe, specjalizowane narzędzia zdolne do wygenerowania kodu na podstawie zapisanego graficznie algorytmu. Takie narzędzia najczęściej kierowane są do tworzenia aplikacji IoT i jeśli nie ma wymagań co do szybkości, a stopień komplikacji nie jest duży, to można z ich użyciem zaoszczędzić sobie sporo wysiłku.

W powstanie takich narzędzi zaangażowały się duże koncerny, np. Renesas i Microsoft, który stworzył narzędzia pozwalające prosto stworzyć oprogramowanie dla projektu IoT z wykorzystaniem chmury. Wraz z kolejnymi układami SoC zawierającymi kompletne platformy sprzętowe do takich zastosowań tego typu narzędzia będą zyskiwać na znaczeniu i zapewne będą coraz doskonalsze. Hipotetyczny koniec tych procesów można upatrywać w tym, że w obszarze IoT najbardziej liczyć się będzie pomysł na aplikację, to, jaką korzyść (wartość) będzie można osiągnąć, a nie sprzęt i oprogramowanie.

Peryferia, bezprzewodowość

Wraz z każdą kolejną generacją i nową architekturą mikrokontrolery zawierają coraz więcej zaawansowanych obwodów peryferyjnych przeznaczonych do realizacji typowych zadań, jak współpraca z czujnikami (wzmacniacz operacyjny), do komunikacji bezprzewodowej, ze sterownikiem przycisków dotykowych, z wysokorozdzielczym przetwornikiem A/C, blokiem kryptograficznym, kontrolerem wyświetlacza i tak dalej. Ważne są interfejsy jak SPI, I²C, I²S, UART, PDM i PWM i przetworniki ADC o rozdzielczości min. 12 bitów. Wymagania rynku są takie, że z czasem bloków peryferyjnych będzie jeszcze więcej, bo zawsze rozwiązanie maksymalnie zintegrowane będzie w centrum uwagi, nie tylko z uwagi na cenę.

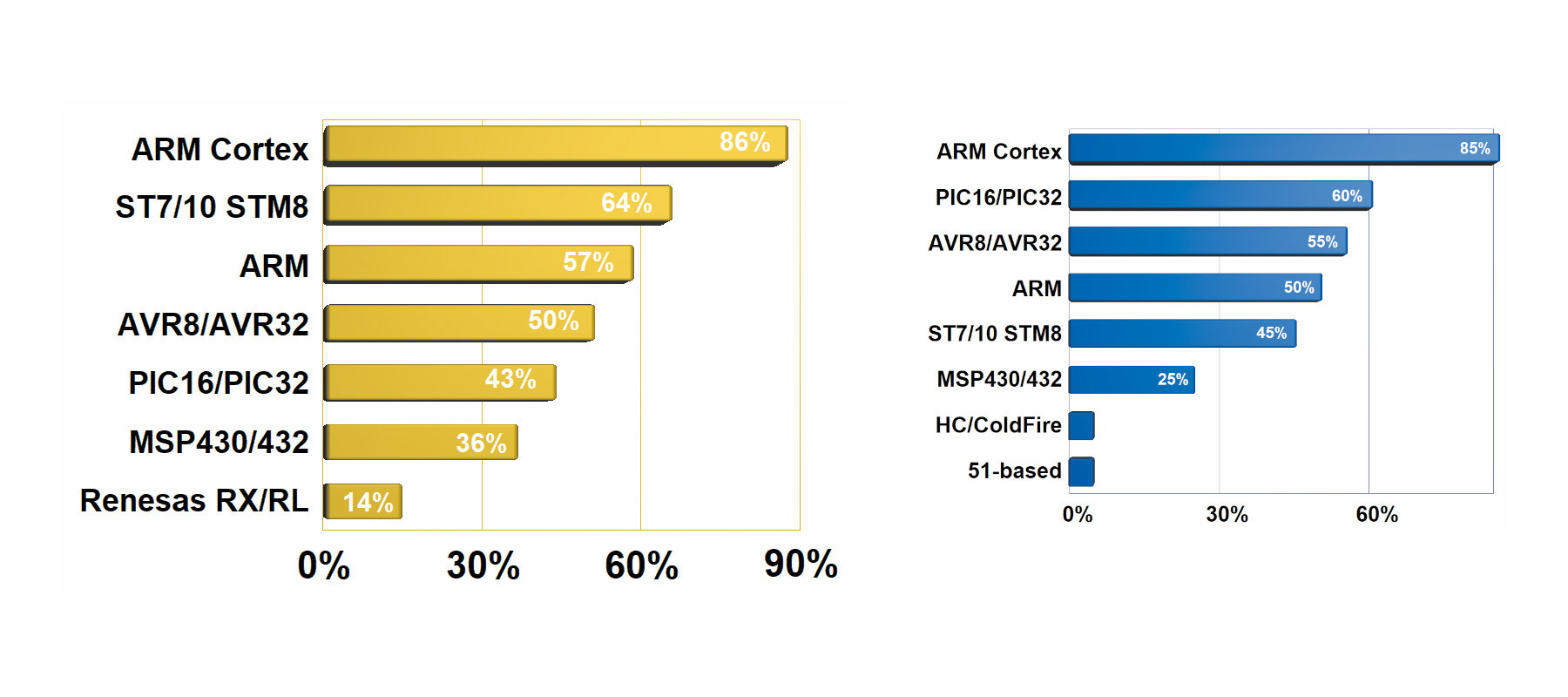

Silnie połączona z tematyką mikrokontrolerów jest komunikacja bezprzewodowa, co wynika z ekspansji aplikacji IoT oraz popularności połączeń tego typu w każdej dziedzinie techniki. Mikrokontrolery w postaci SoC z transceiverem RF, Bluetooth, Wi-Fi, ZigBee, LoRa, LTE przebijają się coraz częściej w aplikacjach, pozwalają łatwo zrealizować wiele typowych aplikacji. Przy wykorzystaniu projektów referencyjnych, narzędzi i oprogramowania dostarczanego przez producentów można to zrobić szybko i bez ryzyka niepowodzenia badań EMC, badania zgodności z przepisami itd. Na rynku komunikacji bezprzewodowej jest zbyt wiele standardów i ciągle pojawiają się nowe. Inwestycja w konkretne rozwiązanie standardowe oznacza niestety większą komplikację i koszty, a wiele z projektów i aplikacji nie musi mieć takiej zgodności, bo stanowi system zamknięty lub własnościowy. Moduły radiowe wbudowane w mikrokontrolery działają w bezpłatnych pasmach ISM i mają znakomite parametry. Pozwalają na pracę w różnych pasmach częstotliwości od 433 MHz do 2,4 GHz, mają możliwość pracy w systemie punkt-wielopunkt, umożliwiają ustawianie parametrów, oferują tryby oszczędzania energii. Wartość dodana do aplikacji związana z ich wykorzystaniem jest z pewnością istotna, zwłaszcza w komplecie z mikrokontrolerem. Przykładem takiego rozwiązania jest m.in. mikrokontroler ESP32 od firmy Espressif, który zdobył ogromną popularność i doczekał się nowych wersji.

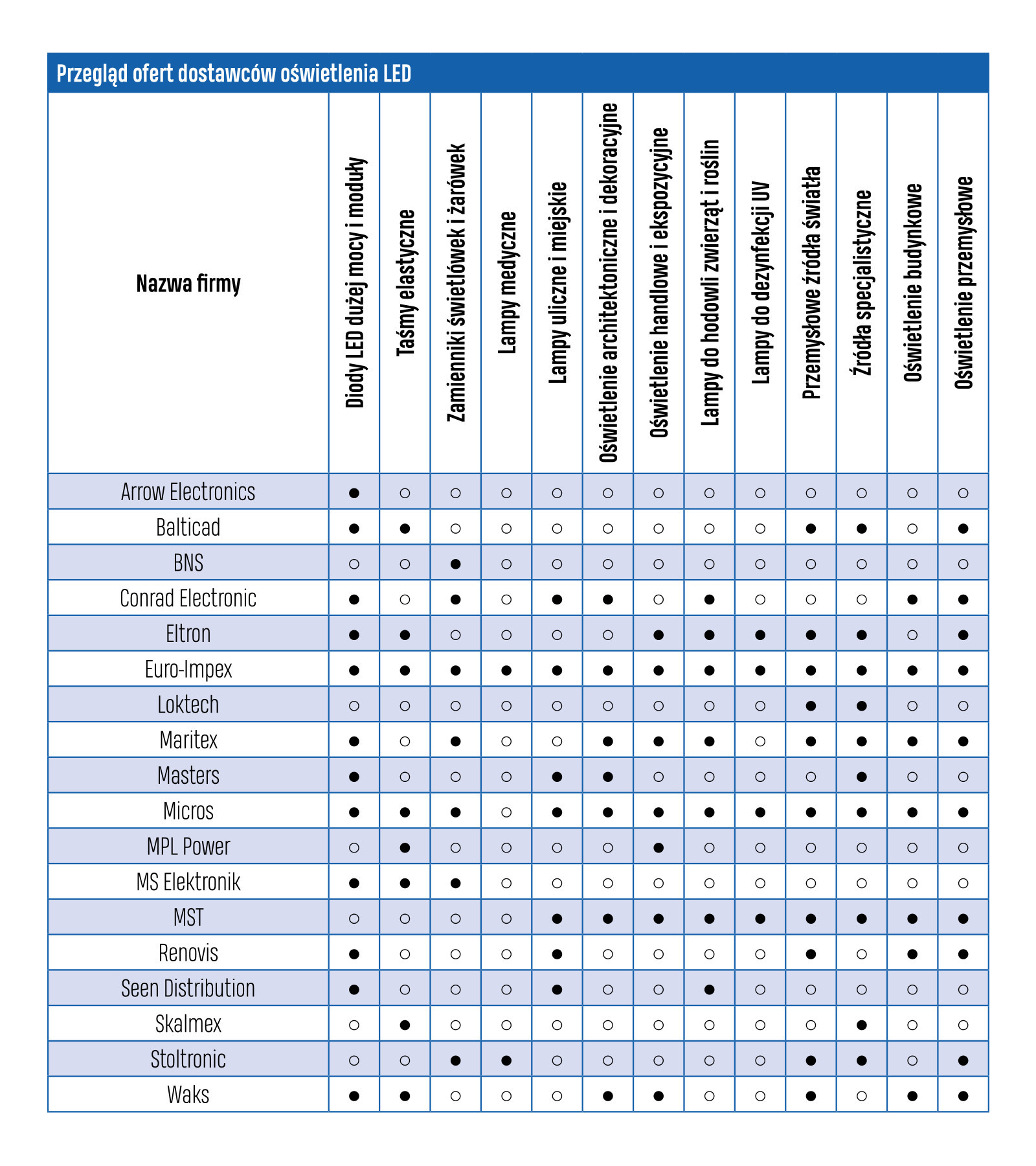

Oświetlenie LED

Jeszcze kilka lat temu rynek oświetlenia LED był w fazie eliminacji żarówek wolframowych, które zostały szybko wyrzucone na margines m.in. za pomocą zakazów sprzedaży. Potem przyszła kolej na rugowanie z użycia lamp fluorescencyjnych (świetlówek kompaktowych), a obecnie trwa proces "dobijania" nielicznych opraw sufitowych ze świetlówkami 18-watowymi. Do niedawna na rynku oświetlenie LED było dostępne głównie w formie zamienników, czyli pasujących do starych opraw żarówek z diodami i zasilaniem, obecnie coraz więcej opraw ma konstrukcję zintegrowaną, a więc zawiera niewymienne źródło światła. Obecnie też mamy zamienniki, ale większego kalibru w postaci opraw oświetleniowych równoważnych funkcjonalnie. Mają one podobne wymiary, system mocowania, przyłącze elektryczne oraz parametry świetlne, ale wykonane są jako konstrukcja zintegrowana, niebazująca na wymiennym emiterze. Takie oprawy oświetleniowe mogą być używane równolegle z tradycyjnymi, nie wymagają kompletnych przeróbek instalacji i są produktem znanym specjalistom.

Coraz więcej produktów przynosi coś więcej niż tylko światło – pozwala na programowanie czasu włączenia i wyłączenia, aktywuje się w obecności osób, pozwala na regulację jasności, barwy, współpracuje ze smartfonem itd. Ostatni trend to coraz większy udział rozwiązań specjalistycznych, a więc przeznaczonych do wybranych miejsc i aplikacji. LED-y dają o wiele większe możliwości kompozycji źródeł z oprawą i resztą otoczenia i widać, że cieszą się zainteresowaniem. Są przeznaczone do oświetlenia budynków, stanowisk pracy, ulic, obiektów publicznych. Takie cenne obszary to również np. architektoniczne, sceniczne, medyczne, motoryzacyjne.

Inteligentne oświetlenie, czyli smart

Inteligentne oświetlenie to termin o szerokim znaczeniu, często też określane terminem "smart" w przypadku, gdy chodzi o źródła światła do pomieszczeń wewnętrznych. Koncepcja opiera się na tym, że do źródła światła dodajemy różne czujniki, obwody sterujące (jasnością, kolorem, odcieniem), aktywację ruchem człowieka, programowanie czasu działania oraz komunikację. Jednym z najczęściej spotykanych funkcjonalności tego systemu jest możliwość dostosowywania temperatury barwowej oraz jasności świecenia ręcznie lub automatyczne w zależności od pory dnia oraz zdefiniowanego profilu.

Takie możliwości zapewniają profesjonalne oprawy przemysłowe, do budynków biurowych i stanowisk pracy, a nawet żarówki ledowe do zastosowań domowych. Rozwiązania te różnią się tylko liczbą takich funkcji i komunikacją. W systemach budynkowych sterowanie lampami realizuje się za pomocą DALI (Digital Addressable Lighting Interface) i Ethernetu lub ZigBee. W tych domowych częściej spotyka się Bluetooth i Wi-Fi umożliwiające komunikację ze smartfonem. Niestety jednym z kłopotów branży oświetleniowej pozostaje brak jednomyślności co do standardu wymiany danych, co wywołuje spore problemy z interoperacyjnością poszczególnych modułów LED. Od kilku lat trwają prace nad wprowadzeniem większej standaryzacji, ale idzie to opornie. W wielu przypadkach każda marka ma swoją aplikację i koncepcję sterowania. Kupuje się jego wizję, a nie interoperacyjność.

Oświetlenie specjalistyczne i przemysłowe

Silna konkurencja na rynku konsumenckim powoduje, że stale rośnie znaczenie oświetlenia specjalistycznego i profesjonalnego, w którym wartość dodana dla klienta jest większa niż w obszarze konsumenckim oraz nie ma takiej konkurencji cenowej ze strony importerów produktów azjatyckich. Renomowane firmy stawiają na nowoczesne produkty, o dużej funkcjonalności, jakości, także w zakresie popularnych rozwiązań konsumenckich i nierzadko porzucają aktywność w zakresie wyrobów typowych, gdzie konkurencja ma charakter cenowy.

W tym obszarze ilościowo i asortymentowo dominują rozwiązania oświetleniowe do sklepów wielkopowierzchniowych, magazynów, hal produkcyjnych (głównie lampy highi low bay, oprawy liniowe), w dalszej kolejności są to lampy montowane w sufitach podwieszanych, systemy oświetlenia ulicznego, lampy obiektowe, wersje z certyfikatami (Atex, górniczymi, medycznymi), w obudowach odpornych na narażenia środowiskowe i podobne. Drugim obszarem specjalizacji jest atrakcyjne wzornictwo pozwalające nadać pomieszczeniom indywidualny charakter i zapewnić wysoką funkcjonalność.

Jeszcze inna droga specjalizacji to oświetlenie do zastosowań w rolnictwie, a więc wykorzystywane do uprawy roślin i hodowli zwierząt oraz UV do sterylizacji. Światło o odpowiednim widmie oraz dawce korzystnie wpływa na wzrost i poziom zawartości pożądanych substancji aktywnych w roślinach. UV pomaga z kolei w utrzymaniu dobrej kondycji plonów poprzez ograniczanie rozwoju pleśni oraz niektórych gatunków szkodników, stanowiąc alternatywę dla środków chemicznych. Do takich zastosowań pojawiły się już odpowiednie diody o specyficznej barwie światła.

LED-y z zakresów UV-B oraz UV-C wykorzystywane są również m.in. w celu dezynfekcji pożywienia, powietrza, wody oraz powierzchni. Ich zaletą jest nie tylko wysoka energooszczędność, ale również małe wymiary, pozwalające na miniaturyzację urządzeń, przez co wypierają lampy rtęciowe z wielu zastosowań. Także dzięki temu, że nie zawierają rtęci i wiążących się z nią problemów z recyklingiem. Drugą korzyścią jest duża żywotność. Lampy rtęciowe mają ją na poziomie ok. 8 tys. godzin, lampa LED UV może osiągnąć nawet 10-krotnie więcej, nie wymagają nagrzewania, co zwiększa wydajność procesu sterylizacji i umożliwia błyskawiczne uruchomienie systemów Przegląd ofert dostawców oświetlenia LED dezynfekujących.

Jakość zasilania, diod, optyki i materiałów

Mówiąc o jakości oświetlenia ledowego, w największym stopniu skupiamy się na ocenie diod, a więc emiterów światła. Rozważamy zagadnienia związane z wpływem temperatury na trwałość, degradacją luminoforu itp. czynnikami. Niemniej z perspektywy lat można powiedzieć, że w wielu przypadkach diody nie są głównym sprawcą złej jakości produktów końcowych. Może kiedyś tak było, ale dzisiaj rozwój technologii pozwala zapewnić ich działanie w dziesiątkach tysięcy godzin.

Poza diodami problemy sprawia zasilanie, zwłaszcza to zintegrowane z lampą, gdyż wówczas zasilacz jest umieszczony blisko źródła światła i całość razem grzeje się znacząco. Prowadzi to do wysychania elektrolitu w kondensatorach elektrolitycznych i przedwczesnych awarii. Zasilacze są też wrażliwe na przepięcia w sieci. Dotyczy to głównie produktów konsumenckich, gdzie oszczędza się na komponentach oraz wersji profesjonalnych w przypadku, gdy warunki eksploatacji są trudne. Świadomość rynku w zakresie wpływu warunków panujących w miejscu instalacji na żywotność jest niewielka i zasilacz szczelnie zabudowany w drewnianym meblu nie jest wcale rzadkością. Ostatnim czynnikiem determinującym jakość i żywotność oświetlenia jest jakość produktów chemicznych, takich jak zalewy hermetyzujące i tworzywa elementów optycznych, które żółkną, kruszą się lub deformują. Warto więc pamiętać, że w zapewnieniu jakości liczy się połączenie wszystkich elementów w spójną całość.

Przekaźniki elektromagnetyczne

Niezmiennie od dziesiątków lat przekaźniki elektromagnetyczne łączą obwody w urządzeniach elektronicznych i elektrycznych, zapewniając wysokie parametry użytkowe za niewielką cenę. Ich trwałość i duża odporność na przeciążenia okazują się na tyle ważne dla inżynierów, że nie tylko nie zastępują ich w wielu obwodach przez wersje półprzewodnikowe, ale z powodzeniem aplikują je w nowych obszarach. Przekaźniki elektromagnetyczne są fenomenem techniki, bo mimo przeszło 150-letniej historii cały czas uznawane są za produkty perspektywiczne, zawsze obecne i istotne, a nowe pomysły w zakresie miniaturyzacji, wysokiej jakości wykonania, niskiego poboru mocy przez cewkę elektromagnesu w tych elementach ciągle budzą zainteresowanie.

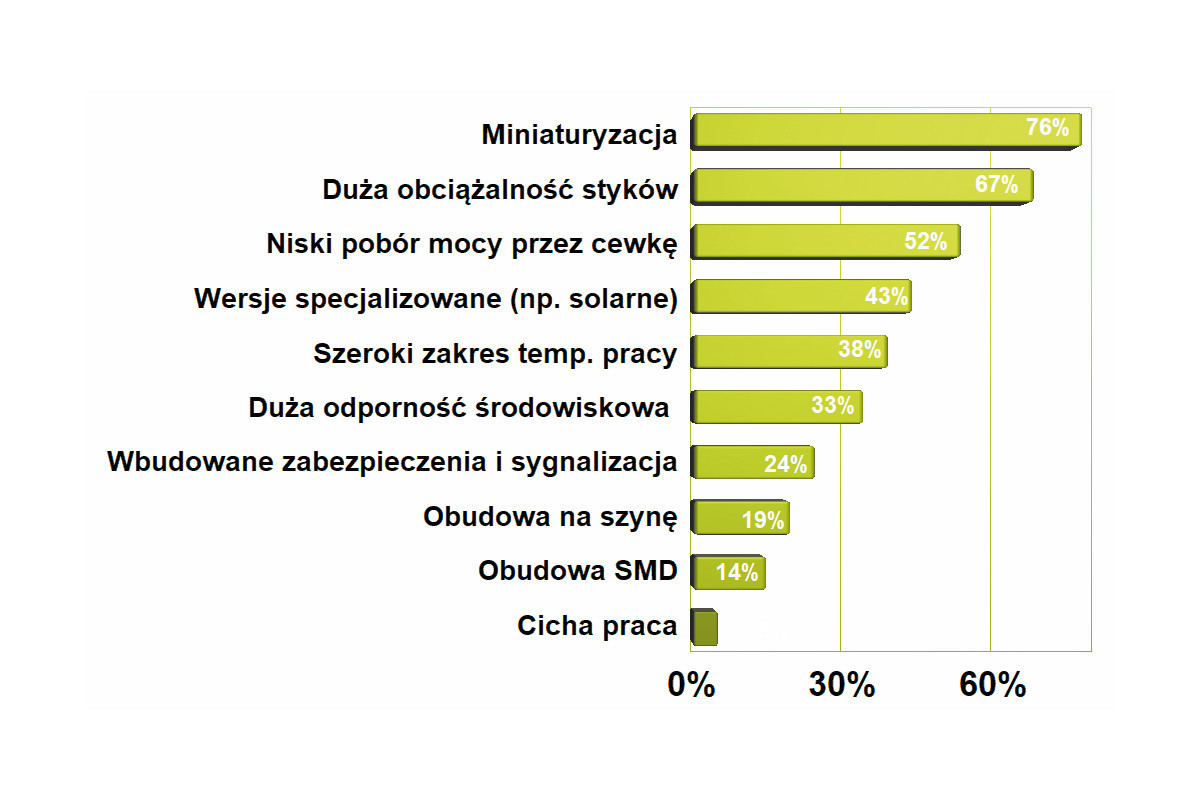

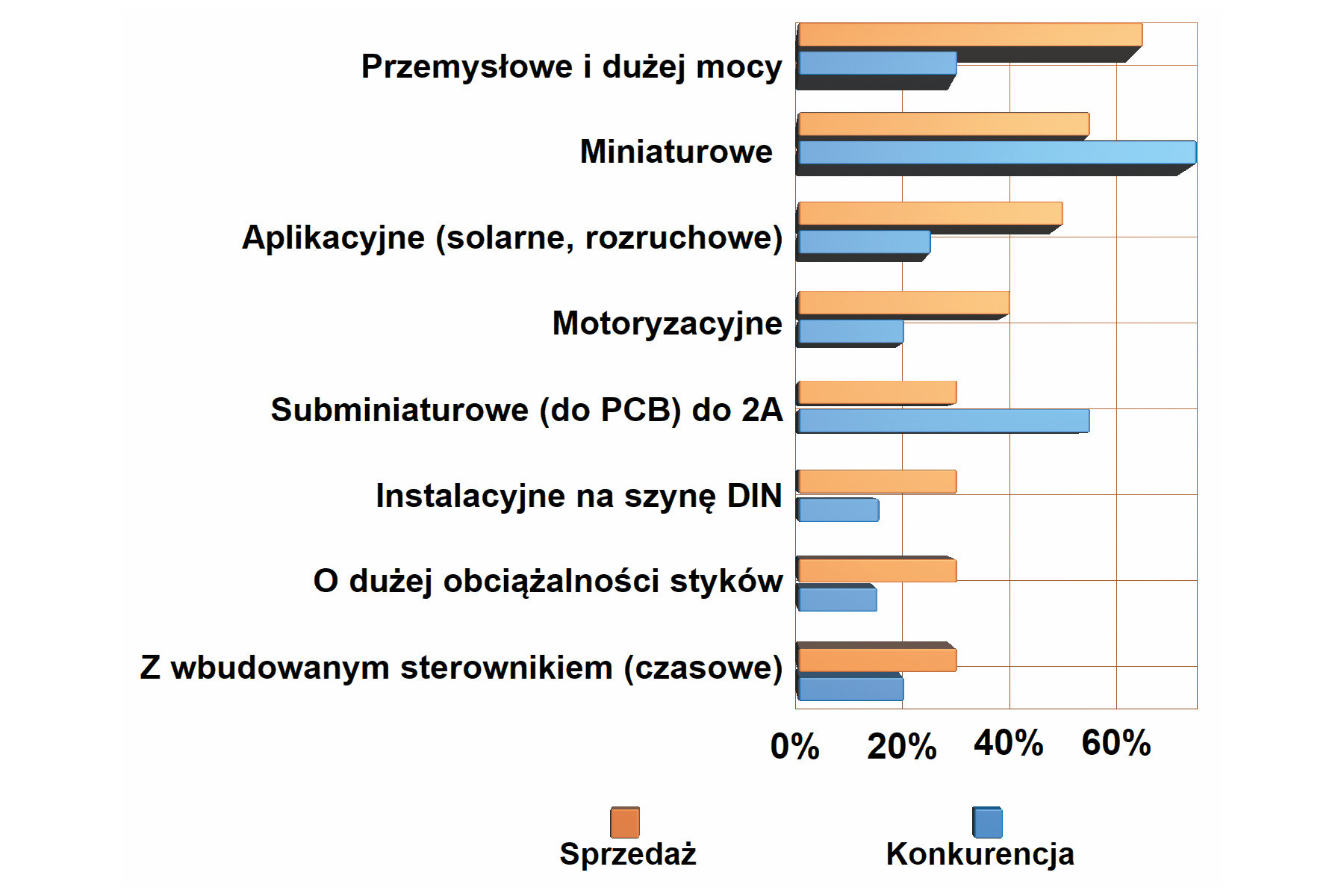

Od wielu lat jednym z najważniejszych trendów rozwojowych rynku przekaźników elektromagnetycznych jest miniaturyzacja. Nowe wykonania wchodzące na rynek nie tylko mają mniejsze wymiary, ale także nierzadko jednocześnie zwiększoną obciążalność styków, przez co moc łączeniowa przypadająca na jednostkę objętości (gęstość mocy) tego elementu z każdą generacją się zwiększa.

Miniaturyzacja w przekaźnikach wiąże się ponadto z pogłębiającą się specjalizacją tych elementów. Im mniejszy komponent, tym parametry maksymalne są ściślej określone. Miejsce wersji zdolnych do przełączania zarówno napięć stałych, jak i przemiennych, niskich i wysokich wartości jednocześnie zajmują konstrukcje specjalizowane, ukierunkowane np. na małe napięcia, sterowanie obciążeniem indukcyjnym o dużej zdolności do chwilowego przeciążania i podobne. To samo dotyczy liczby styków, które coraz rzadziej występują w dwóch parach przełączających – nierzadko jest to tylko jeden styk zwierny. Wersje specjalizowane są przeznaczone do odpowiednich zastosowań: instalacji fotowoltaicznych, załączania silników, gdzie prąd rozruchowy ma dużą wartość, są wersje bistabilne, bezpieczeństwa i podobne.

Wysokiej jakości materiały, duża dokładność wykonania odpowiadająca możliwościom mechaniki precyzyjnej niczym z zegarków i pełna automatyzacja produkcji eliminująca wiele błędów produkcyjnych pozwalają sprowadzić przekaźnik do wielkości, w której nie dominuje on w systemie nad innymi komponentami, a więc nie jest problemem integracyjnym. Nowe wykonania mechaniczne to także wersje w obudowach do montażu SMT, które są dostępne nawet wówczas, gdy moc komutowana jest duża. To także konstrukcje ciche, takie, które nie zwracają uwagi użytkownika głośnym stukaniem.

Współczesny przekaźnik elektromagnetyczny jest też konstrukcją znacznie bardziej odporną na wpływ środowiska i warunki występujące podczas produkcji (takie jak automatyczny montaż, mycie płytek i zalewanie obudowy), a także na narażenia mechaniczne. Przekaźniki dostępne w handlu występują obecnie praktycznie wyłącznie w wersji obudowanej, standardem staje się też dodatkowa hermetyzacja krawędzi obudów za pomocą żywicy. Poprawia to z pewnością trwałość i jakość tych elementów i eliminuje całkowicie dawne problemy, takie jak pokrywanie się styków tlenkami od znajdujących się w powietrzu atmosferycznym związków (siarka, kwasy).

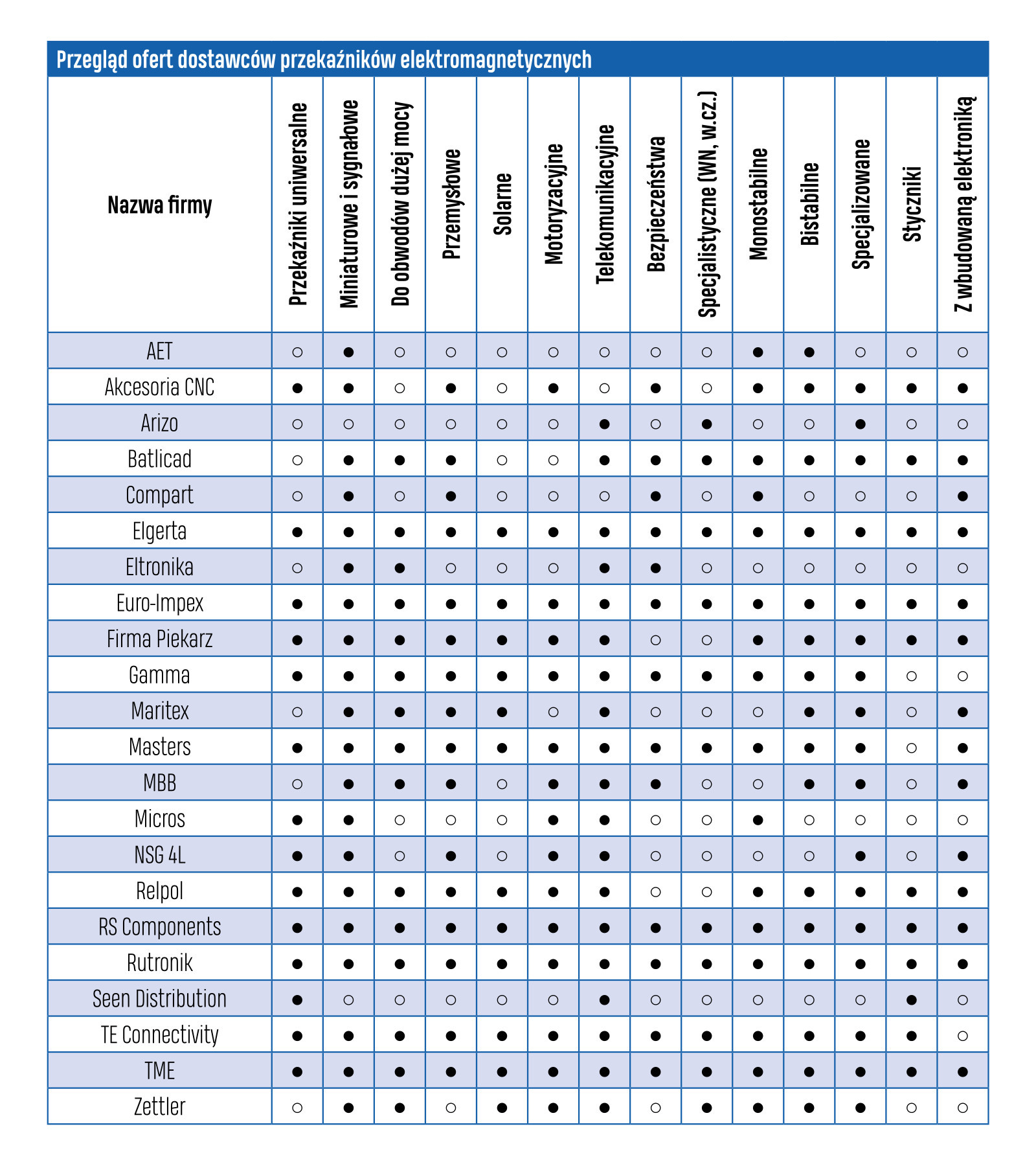

Efektem ubocznym tych procesów jest to, że oferta rynku w zakresie typów i wykonań jest imponująca, a portfolio produktów czołowych producentów liczy mnóstwo pozycji, co nie tylko utrudnia inżynierom selekcję produktu, a działom marketingu promocję konkretnych pozycji, ale także negatywnie wpływa na czasy dostaw. Wersje mało popularne nie są magazynowane przez dystrybutorów, co powoduje, że czasy dostaw potrafią się znacznie wydłużać.

Mała moc cewki, czyli niewielkie nagrzewanie

Poza zmianami w konstrukcji mechanicznej producenci kładą dzisiaj nacisk na obniżenie poboru mocy przez elektromagnes. Dla typowych wersji o obciążalności styków na poziomie 8 A waha się ono w zależności od liczby styków od 200 do 400 mW. Jest to spora redukcja ważna nie tylko w elektronice, bo wiele układów sterujących nierzadko pobiera mniej mocy niż ten jeden element, ale także w aplikacjach przemysłowych. Tam, gdzie przekaźników pracuje dużo, wydzielające się z cewek ciepło negatywnie wpływa na trwałość a pozytywnie na możliwość pracy w szerszym zakresie temperatur. Nie jest to może tak bardzo istotne w przypadku przekaźników umieszczonych w dużych obudowach, a więc takich, które mają możliwość rozproszenia ciepła, niemniej wersje miniaturowe zyskują wiele na jakości właśnie dzięki obniżaniu mocy pobieranej przez cewkę. Dwie dekady temu przekaźnik z cewką zasilaną z sieci 230 V AC pobierał 1–1,5 wata, dzisiaj jest to ok. 0,5 W, czyli znacznie mniej. Wystarczy dotknąć ręką obu tych wersji podczas pracy, aby przekonać się, jak dużą różnicę w temperaturze obudowy zapewnia ta zmiana.

Wymagania jakościowe stale się zwiększają

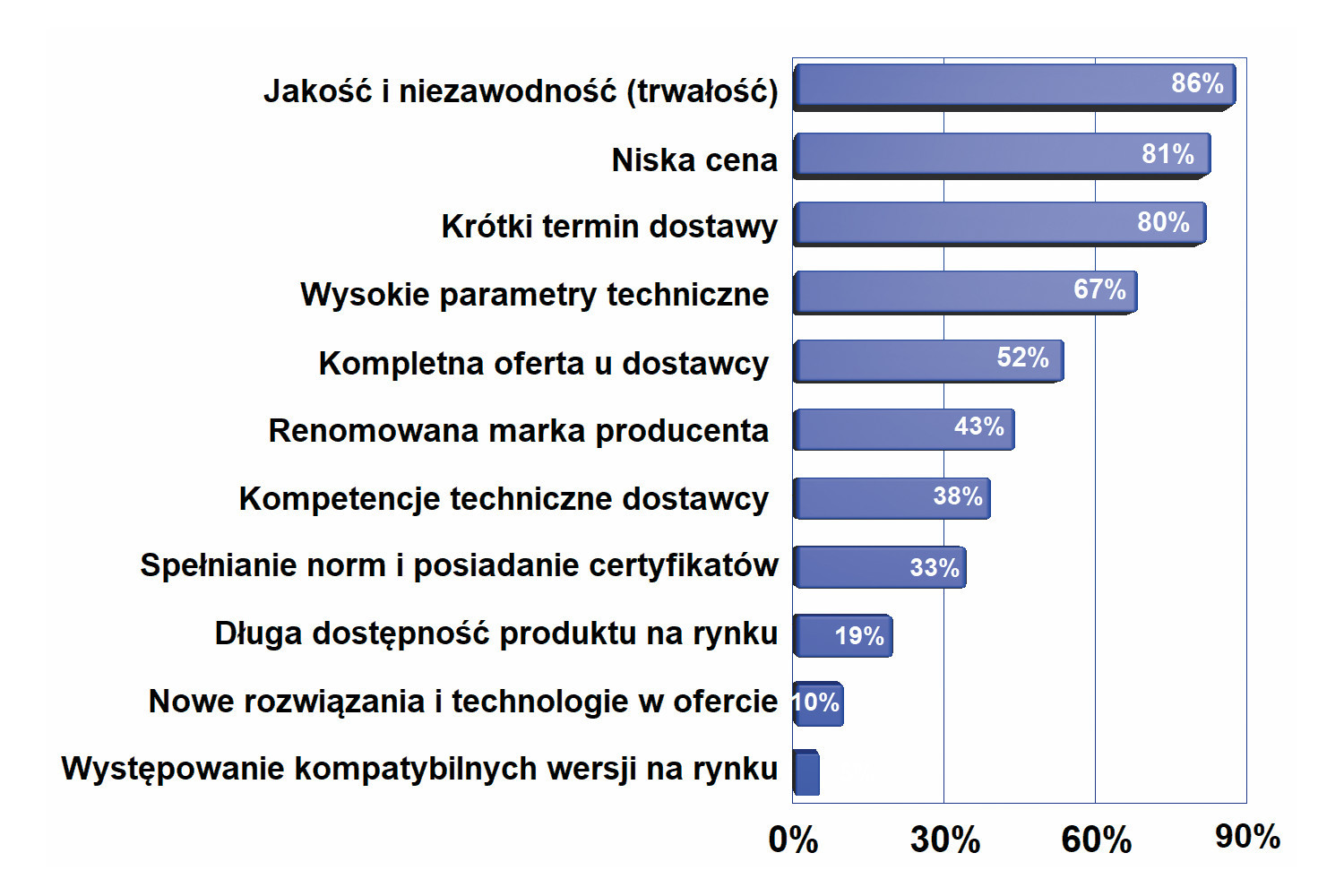

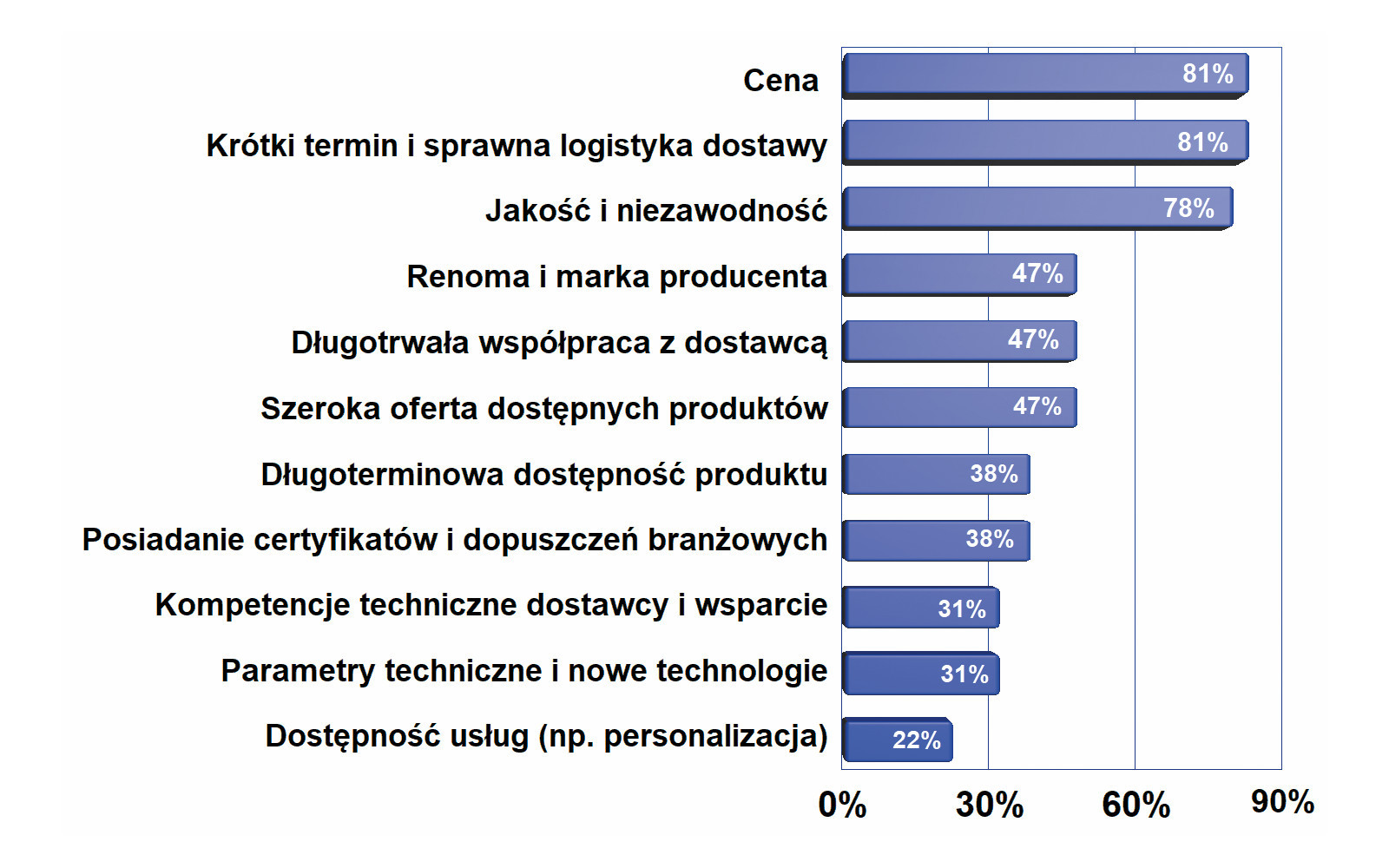

Od przeszło dekady na rynku przekaźników widoczny jest zwrot zainteresowania klientów w stronę produktów wysokiej jakości i tych produkowanych przez renomowanych producentów. Proces ten dzieje się, mimo że cały czas są dostępne przekaźniki klasyfikowane jako tanie marki, a silna konkurencja zapewnia wiele rozwiązań o zbliżonych parametrach.

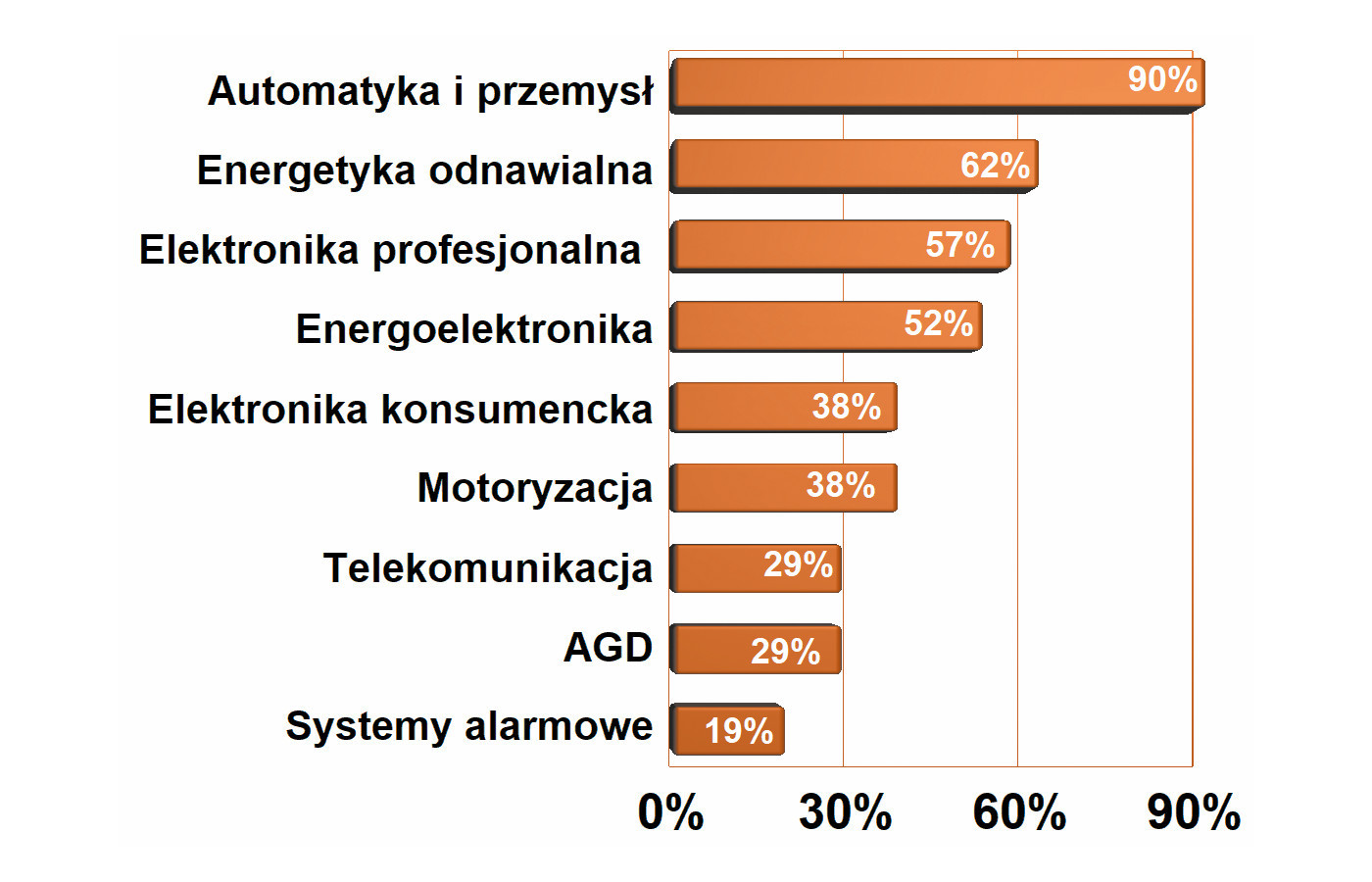

Przyczyn tego zjawiska jest wiele, w tym rosnące koszty działalności firm i tym samym drożejący serwis oraz obsługa techniczna urządzeń. To także coraz większy eksport krajowych przedsiębiorstw, coraz więcej urządzeń i aparatury w fabrykach oraz większe skomplikowanie techniczne nowych instalacji. W Polsce szybko rozwijają się rynki związane z produkcją maszyn, sektorem budowlanym i postępuje automatyzacja wielu dziedzin gospodarki. Rozwój produkcji jest też źródłem popytu na systemy kontroli i sterowania, co zawsze stymuluje zapotrzebowanie na przekaźniki. Wiele krajowych firm produkuje i eksportuje urządzenia dla przemysłu, takie jak sterowniki, regulatory, urządzenia pomiarowe, styczniki, systemy nadzoru. W ramach inwestycji kupowane są nowe maszyny i budowane do nich instalacje oraz systemy. Strumień sprzedaży dla przemysłu tworzy też elektronika profesjonalna, energoelektronika, elektromobilność i sektor energii odnawialnej.

Zainteresowanie jakością w branży bierze się też z tego, że krajowych przedsiębiorców obecnie stać na lepsze produkty, bo sytuacja w gospodarce ogólnie jest dobra. Inwestycje producentów w automatyzację produkcji spowodowały, że wytwarzanie przekaźników wymaga minimalnych nakładów pracy ręcznej, więc jakość jest lepsza przy jednocześnie mniejszych kosztach. Ceny przekaźników markowych nie są już dzisiaj w dużej dysproporcji w stosunku do tych tańszych i nierzadko różnica pomiędzy wersjami markowymi i resztą staje się niewarta starań. Co więcej, w ostatniej dekadzie w technologii przekaźników zaszło sporo korzystnych zmian poprawiających jakość i trwałość tych elementów, przez co działy utrzymania ruchu w przemyśle kupują obecnie relatywnie mniej tych elementów niż kiedyś. To też ogranicza zapędy do oszczędności. Paradoksalnie rynek dzisiaj ma znacznie większą świadomość w zakresie podejścia do jakości właśnie dzięki temu, że kiedyś była ona mniej istotna, a liczyła się cena. Nic tak nie edukuje klientów i nie zmienia kierunku myślenia firm, jak pojawiające się problemy z urządzeniami w okresie gwarancyjnym i ponoszone koszty serwisu z powodu elementu, na którym oszczędzono złotówkę.

Elektronika wkracza do przekaźnika

Szybki rozwój automatyki budynkowej oraz aplikacji przemysłowych w zakresie tzw. małej automatyki tworzy zapotrzebowanie na przekaźniki z wbudowaną elektroniką, np. czasowe, programowalne. Są to ministerowniki do oświetlenia w garażu, sterowania wentylacją w hali, załączania oświetlenia przeszkodowego i podobnych zadań. Takie aplikacje wymagają czegoś więcej niż zwykły przekaźnik, ale jeszcze nie jest to sterownik PLC. Wbudowana elektronika realizuje sterowanie czasowe, współpracuje z czujnikami itp. Elementy takie są zazwyczaj umieszczane w obudowie do montażu na szynie DIN i pracują w skrzynkach elektroinstalacyjnych. Z roku na rok jest takich wersji więcej.

Wersje pod aplikacje

Nietrudno zauważyć, że rośnie liczba przekaźników specjalizowanych, takich, których parametry i funkcjonalność zostały ściśle dopasowane do wymagań aplikacyjnych: do załączania obciążeń indukcyjnych i oświetlenia żarowego, aplikacji fotowoltaicznych, wersji bistabilnych, bezpieczeństwa itp. Do niedawna przekaźnik był postrzegany jako coś bardzo uniwersalnego, którego można było używać w zasadzie dowolnie, obecnie okazuje się, że czasem warto sięgnąć po rozwiązanie aplikacyjne. Tego typu przekaźniki coraz liczniej pojawiają się w ofertach dostawców i ich potencjał rynkowy się zwiększa razem z potencjałem sektorów, do których trafiają.

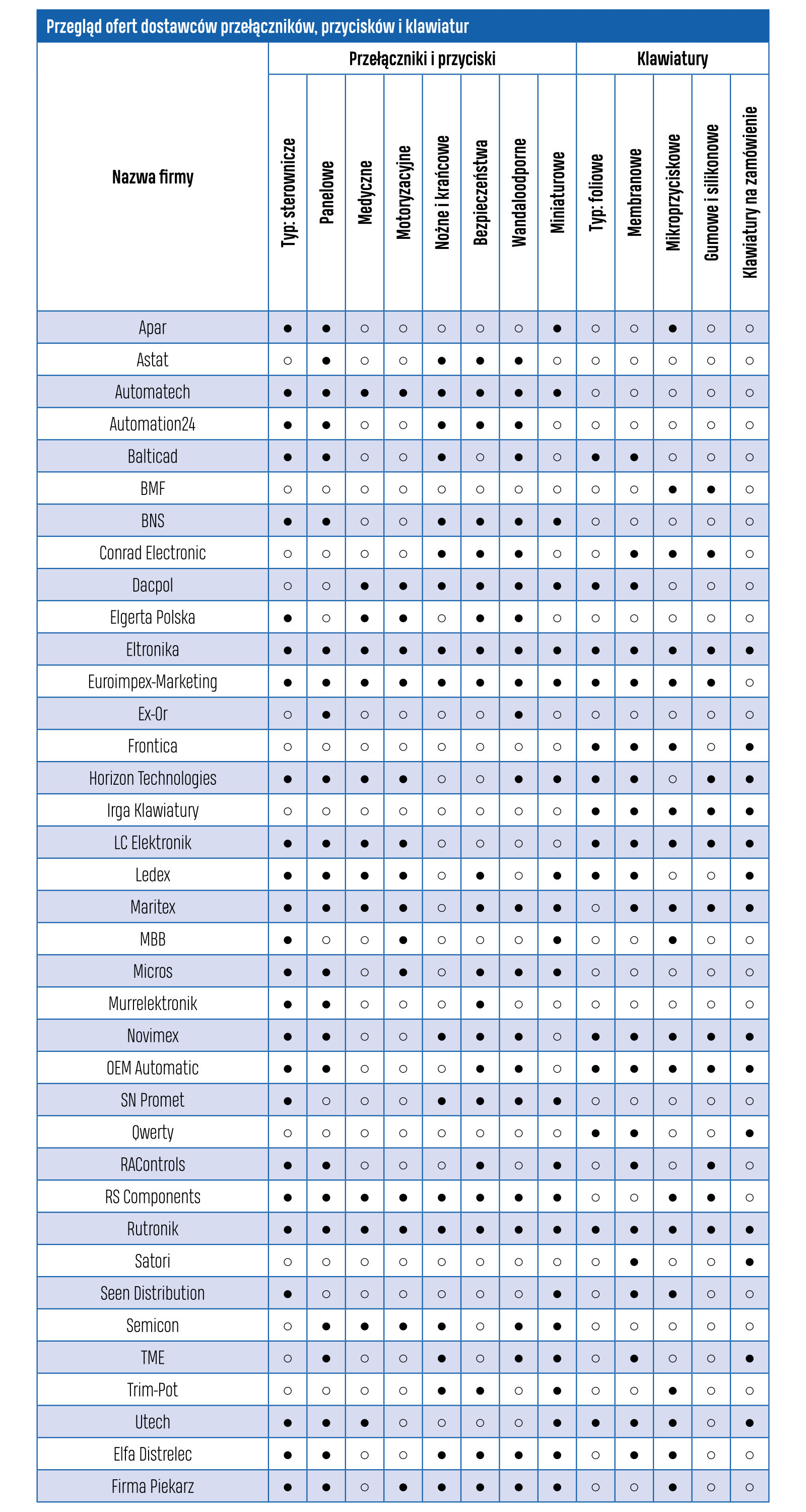

Przełączniki, przyciski i klawiatury

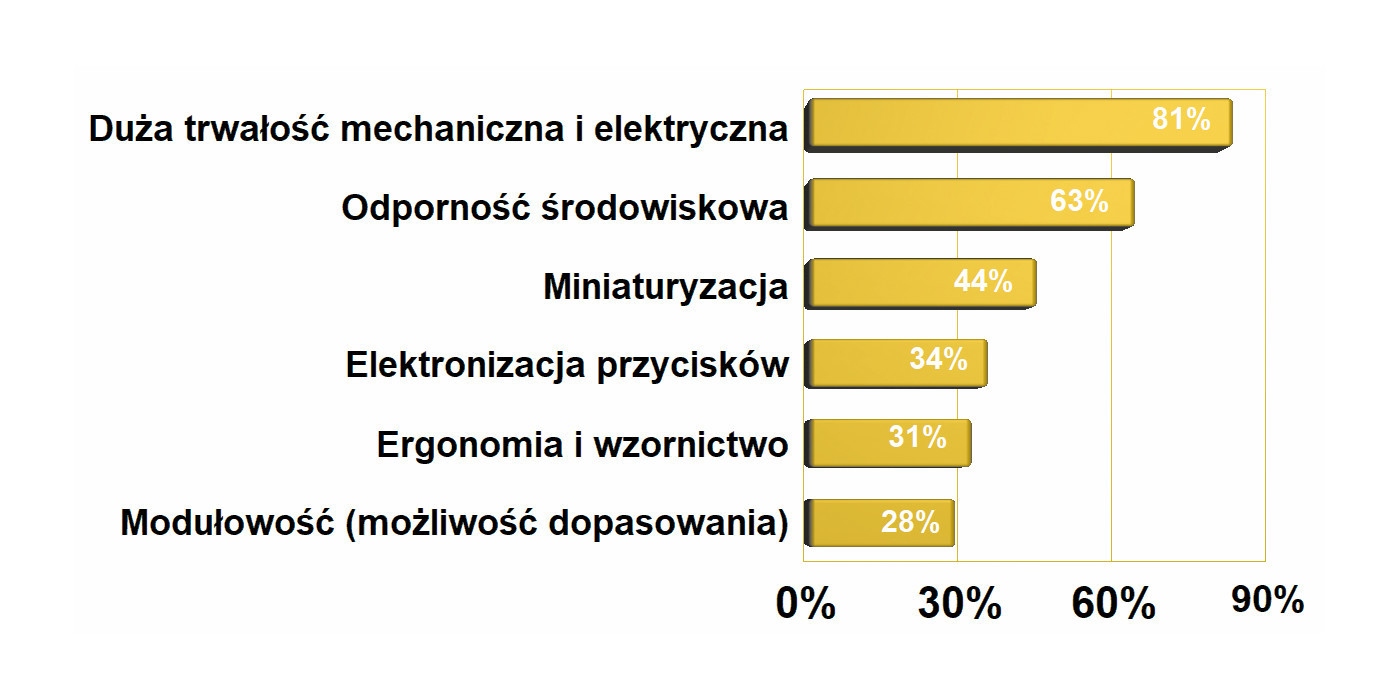

Podobnie jak dla wielu innych elementów elektronicznych, tematem dyżurnym w branży przełączników i klawiatur jest jakość rozumiana w największym stopniu przez pryzmat trwałości mechanicznej i elektrycznej. Zainteresowanie jakością to splot wielu czynników, jak zwiększająca się wymiana handlowa z zagranicą, usługi projektowe realizowane na zlecenie partnerów zagranicznych, duże znaczenie branży przemysłowej. Jakość to też sposób producentów klawiatur na konkurencję dalekowschodnią.

W przypadku omawianych produktów jakość jest szczególnie istotna, bo często wyrabia opinię klientowi końcowemu o marce i producencie. Przez wiele lat napływ niskiej jakości azjatyckiej produkcji spędzał dystrybutorom renomowanych produktów sen z powiek i wymuszał nacisk działań na edukację klientów. Póki na rynku były ciężkie czasy, nie było to łatwe zadanie, ale w ostatnich latach świadomość klientów wyraźnie się poprawiła. Być może powodem jest też wzrost zamożności i potencjału firm, które nie muszą oszczędzać na wszystkim. Ponadto pierwotny dystans między dużymi cenami produktów kwalifikowanych jako czołowe marki a tanimi wyrobami chińskimi znacząco się zmniejszył i nie tworzy przepaści niedostępności.

Ogromny asortyment

Przełączników i przycisków na rynku jest mnóstwo, tak samo jak producentów i firm, które mają je w ofertach. Czołowi producenci mają licznych naśladowców, wiele innych firm korzysta z tego, że rynek jest chłonny i proponuje wielowariantowe rozwiązania, które w zamyśle mają pokryć większość potrzeb klientów. Brakuje standaryzacji, bo w praktyce dotyczy ona tylko tych najpopularniejszych produktów, które mają wielu producentów i tym samym standardem staje się to, co jest popularne.

W przełącznikach i przyciskach nie funkcjonuje system modułowy, który pozwala na ograniczenie liczby części składowych taki, jakie spotyka się w złączach. Przeciwnie, wiele produktów daje możliwość kompozycji spośród wielu typów. Za jedną pozycją kryją się dziesiątki wersji różniących się kształtem dźwigni, kapturkiem, stopniem ochrony, końcówkami łączeniowymi, kolorem podświetlenia. Utrudnia to dokonywanie wyborów, także zmianę produktu na inny, pochodzący od innego producenta, a także utrudnia promocję nowych rozwiązań.

Klawiatury

Klawiatury membranowe (foliowe) znajdują szerokie zastosowanie w sprzęcie kontrolno-pomiarowym, systemach przemysłowych, maszynach, w motoryzacji, sprzęcie medycznym i wielu innych obszarach spoza konsumenckiego. Ich duża popularność wynika z dobrej dostępności i niewielkiego skomplikowania technologii wytwarzania, co przekłada się na niskie koszty uruchomienia produkcji i jednostkowe oraz dobre własności użytkowe i jakości. Kolejny atut to taki, że jest to produkt elastyczny, taki, który można dopasować do wielu specyficznych wymagań aplikacyjnych. Klawiatury mogą być z klikiem klawiszy, podświetleniem, z frontem silikonowym lub foliowym, z polami przezroczystymi lub kolorowym filtrem pod wyświetlacz itd. Wraz z warstwami realizującymi ekranowanie elektromagnetyczne, konstrukcja jest zabezpieczana przed wpływem czynników środowiskowych lakierami i warstwami ochronnymi. Możliwości jest wiele, a rynek szeroki i chłonny. Klawiatury integruje się też z wyświetlaczami, sklejając je w całość tworzącą interfejs HMI.

Produkcja indywidualnie dopasowanych do aplikacji klawiatur, w pełni zintegrowanych z obudową także w małych seriach, tworzonych za pomocą druku cyfrowego, od wielu lat jest podstawą biznesu krajowych wytwórców. Firmy te inwestują w rozwój technologii, w nowe trwałe materiały, zapewniające odporność środowiskową i długotrwałe działanie, wykorzystują druk cyfrowy po to, aby dać możliwość pełnej indywidualizacji projektów, także tych określanych jako małe serie oraz łączą w ramach jednej oferty wiele rozwiązań przełączających, podświetleń i całego know-how, aby mieć ofertę dla każdego klienta.

Duży postęp we wzornictwie

Ciągłym trendem w branży jest poprawiający się wygląd elementów przełączających, czyli wzornictwo. Żywe kolory tworzyw sztucznych, ergonomiczne kształty, zintegrowane podświetlenia ledowe (również wielokolorowe) są z pewnością przykładem zachodzących zmian w omawianym sektorze. To samo można powiedzieć o ikonach, konstrukcji mechanicznej zapewniającej precyzję działania, responsywność, słyszalny "klik" wskazujący na zadziałanie. Wzornictwo to także odpowiednia faktura powierzchni tworzyw zapobiegająca poślizgowi i dająca pozytywne wrażenia podczas dotykania.

Jest to z pewnością wynik tego, że producenci mają dzisiaj do dyspozycji znacznie lepsze materiały i urządzenia produkcyjne o większej dokładności. Zaawansowane technologie produkcyjne są coraz bardziej przystępne. Druk cyfrowy o wysokiej rozdzielczości znakowarki i obrabiarki laserowe nie są już dzisiaj luksusem dostępnym dla największych firm i coraz częściej są wykorzystywane do personalizacji produktów, wykonywania produkcji małoseryjnej i innych operacji. Obrabiarki laserowe zapewniają wszystko, co jest dzisiaj potrzebne do zapewnienia jakości, a więc wysoką precyzję wykonywania oznaczeń, trwałość oraz szybkość. Mamy też w zasięgu obrabiarki CNC, drukarki 3D do prototypowania oraz zaawansowane oprogramowanie CAD do tego, aby stworzyć projekt. To wszystko przynosi efekty.

Elektronizacja idzie wolno

Elektronizacja przycisków to proces polegający na tym, aby poprawić trwałość mechaniczną tego elementu poprzez integrację technologii dotykowych, np. piezoelektrycznych, pojemnościowych lub indukcyjnych. Tego typu elementy stanowią wydzielony, pojedynczy komponent stanowiący odrębną całość, której można użyć praktycznie tak samo, jak tradycyjnych. Takie technologie są najczęściej wykorzystywane w aplikacjach narażonych na wandalizm, np. windy, automaty sprzedaży. Elektronizacja przycisków umożliwia też uszczelnienie konstrukcji frontu. Wadą jest brak skoku klawisza, trudność obsługi w rękawiczkach, przez co są to produkty niszowe.

Haptyka, ToF, gesty

Nadchodzącą nowością technologiczną w zakresie przełączników i klawiatur są elementy haptyczne. Mogą one dostarczać informacji zwrotnych w aplikacjach medycznych i przemysłowych a także realizować system ostrzeżeń, aby poinformować o potencjalnie niebezpiecznych warunkach. Przydają się w otoczeniu, gdzie jest duży poziom hałasu, użytkownik nosi grube rękawice, pod wodą itd.

Obecnie funkcjonalności haptyczne, takie jak drgania oraz wibracje, znajdują szerokie zastosowanie w smartfonach (wibracja informuje np. o nadchodzącym połączeniu lub wiadomości), kontrolerach gier, urządzeniach medycznych, lotnictwie, robotyce, zabawkach, symulatorach i urządzeniach treningowych, ale można oczekiwać, że miniaturowe siłowniki wibracyjne (bazujące na silniku i wirującym ciężarku lub aktuatorze piezoelektrycznym) będą coraz częściej wspierać działanie przełączników i ekranów dotykowych.

Z kolei czujniki ToF (Time of Flight) pozwalają ocenić odległość palca od ekranu dotykowego. Z ich użyciem można ekran podświetlić, zanim zostanie dotknięty, wybudzić aplikację z uśpienia i poprawić możliwość obsługi w rękawicy. W wersji z laserem czujniki ToF mogą dokonywać wielu pomiarów odległości jednocześnie, tworząc mapę trójwymiarową zbliżającego się obiektu i w ten sposób zapewniając niewrażliwość na zakłócenia.

Na koniec warto wspomnieć, że pozwalają one na rozpoznawanie gestów, tworząc trójwymiarowy model obiektu, dostarczą danych dla komputera, który na podstawie serii pomiarów wykryje gest, czyli w praktyce ruchy dłoni. Takie nowe pomysły przede wszystkim niwelują wady rozwiązań dotykowych (rękawica, opóźnienia, niepewność zadziałania w skrajnych warunkach środowiskowych).

Wyświetlacze i elektroniczny papier

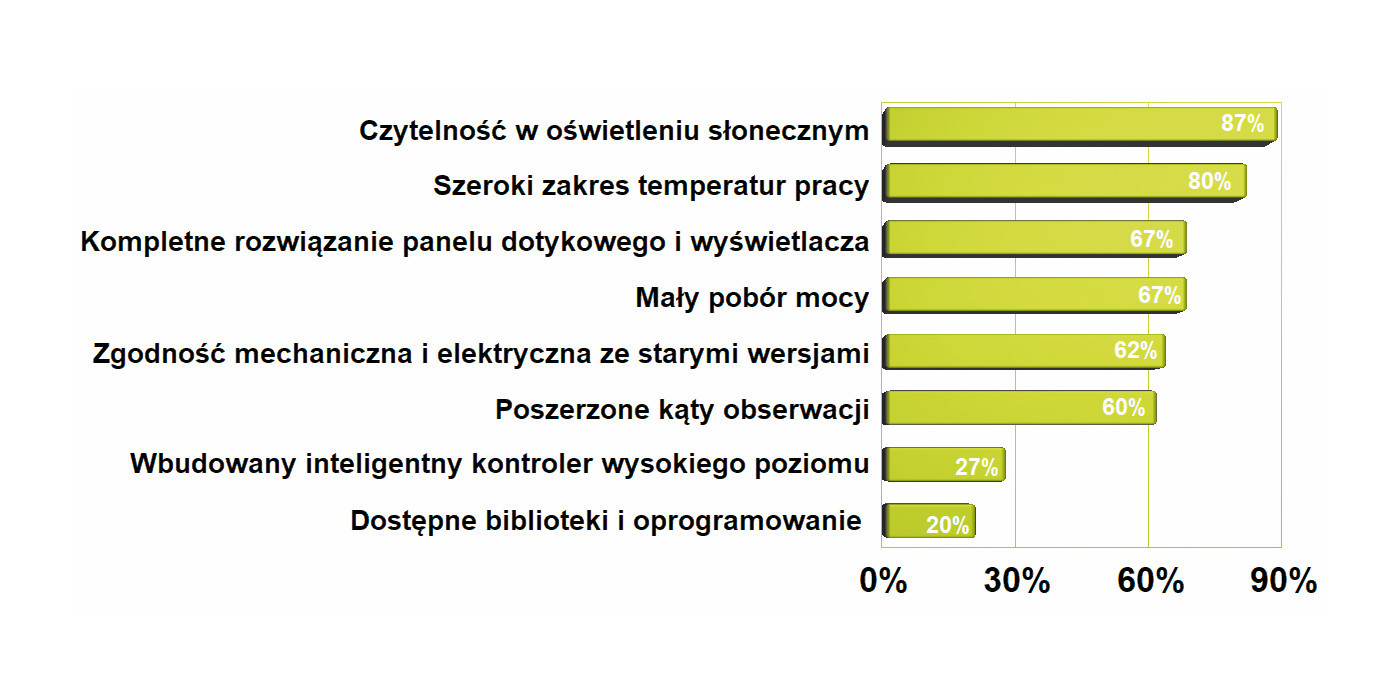

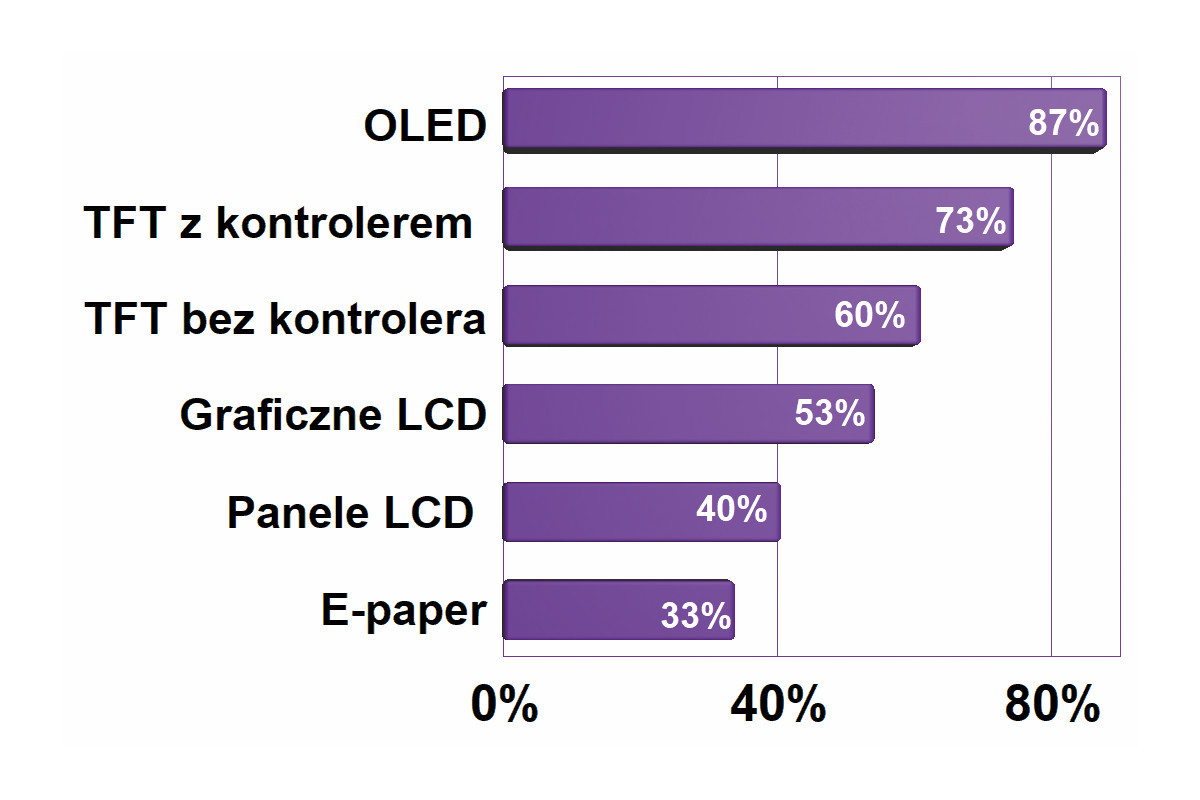

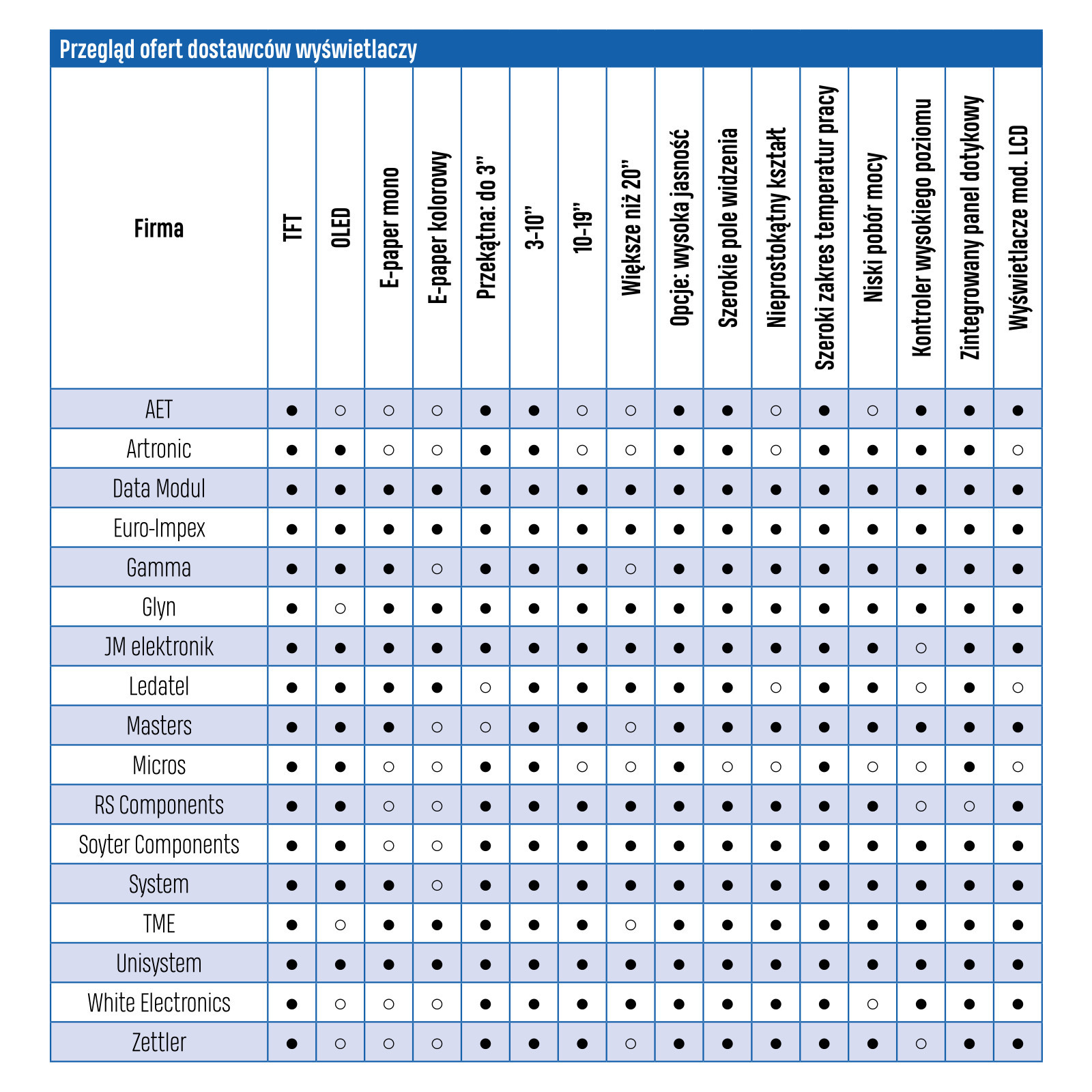

Na rynku mamy coraz większy asortyment jednostek wyświetlaczy, są one coraz tańsze, a więc dostępniejsze, mają coraz lepsze parametry w zakresie wizualizacji danych oraz odporności mechanicznej i środowiskowej. Rośnie liczba dostępnych przekątnych ekranu i rozdzielczości, proporcji boków i interfejsów. Pojawiają się zaawansowane kontrolery, opcje związane z szerokim zakresem temperatur pracy, dużym kątem obserwacji, czytelnością w warunkach silnego oświetlenia słonecznego. Dostawcy wyświetlaczy tworzą też grupy produktów, wokół których możliwa jest łatwa migracja, czyli zmiana wyświetlacza nie wiąże się z kłopotliwymi zmianami układu elektronicznego i dużymi modyfikacjami oprogramowania.

Wśród pozytywnych zmian na rynku w ostatnich dwóch latach zauważalne jest dążenie klientów do zapewniania jak najlepszych parametrów optycznych wyświetlaczy stosowanych w ich produktach. Dlatego widać wyraźny trend zastępowania starych typów jednostek graficznych, znakowych oraz TFT-TN wykonaniami w nowszych technologiach jak TFT IPS, OLED oraz e-papier. Poprawia się dostępność wyświetlaczy i nie ma już dzisiaj większych problemów z dostawami, z wyjątkiem mniej typowych rozwiązań lub wyświetlaczy inteligentnych z wbudowanymi kontrolerami wysokiego poziomu, na które nadal przy większych zamówieniach są trudności z dostępnością.

Do pozytywnych zjawisk zapisać można też ciągłą popularyzację graficznych interfejsów użytkownika.

Obecnie sektor wizualizacji informacji dynamicznie się rozwija ze względu na wszechobecną cyfryzację i konieczność prezentacji coraz większej ilości danych. Coraz częściej korzysta się z urządzeń poprzez bezpośrednie interakcje użytkownika z wyświetlaczem. Dlatego funkcja sterowania dotykowego jest już praktycznie koniecznością w nowych projektach. Jest teraz standardem i panele dotykowe aplikowane są nawet w przypadkach, gdzie spokojnie bez nich można by się obyć. Niemniej decydujące są przyzwyczajenia klientów, którzy oswoili się ze sprzętem mobilnym na tyle, że oczekują zawsze podobnej funkcjonalności. Działanie wyświetlaczy wspomagają też czujniki obecności i kamery do rozpoznawania gestów.

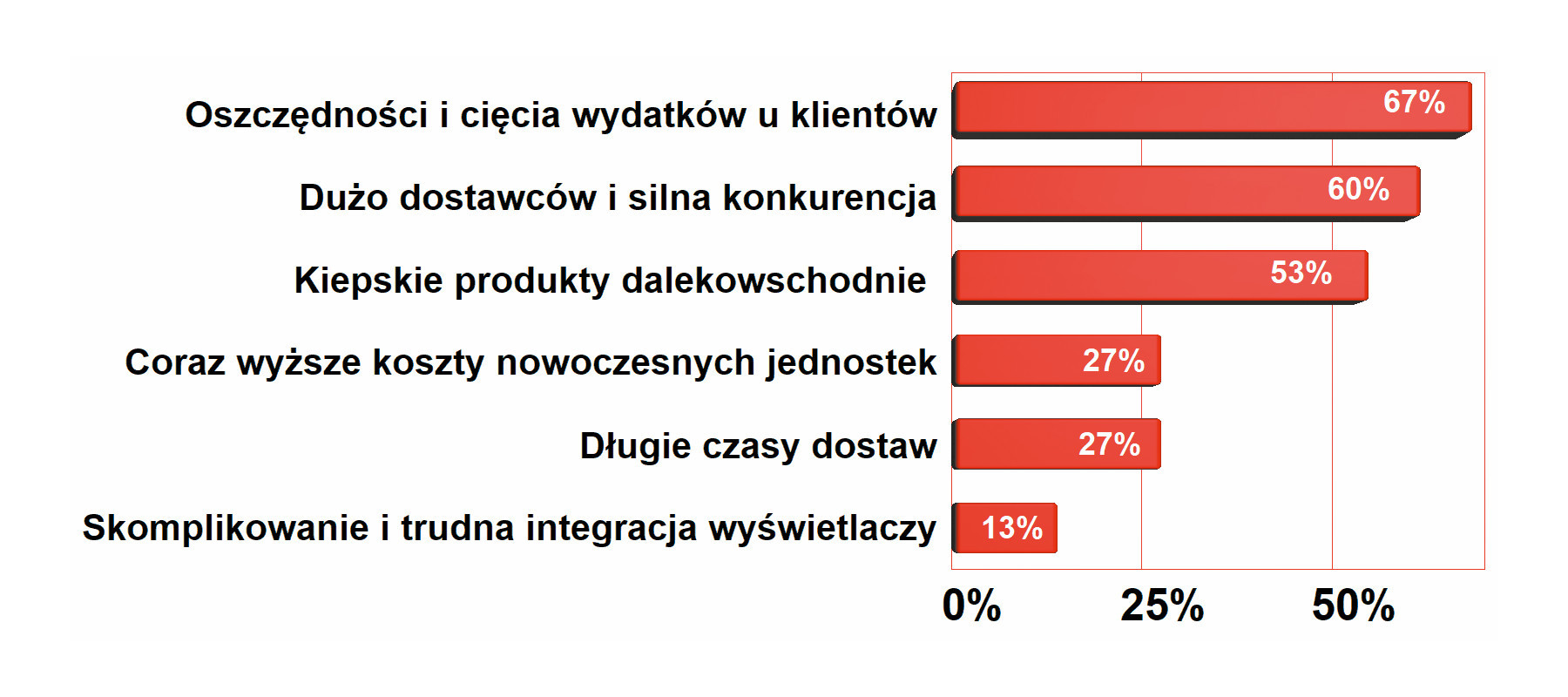

Wśród negatywnych zjawisk należy odnotować poszukiwania przez klientów najtańszej opcji, a w efekcie zamawianie wyświetlaczy mało znanych chińskich producentów, których jakość i trwałość często znacząco odbiegają od rozwiązań znanych producentów, o ugruntowanej pozycji na rynku europejskim, kładących duży nacisk na wysoką jakość produktu, co niestety skorelowane jest z trochę wyższą ceną.

Coraz większe znaczenie ma specjalistyczna funkcjonalność wyświetlaczy, taka jak szerokie kąty widzenia obserwacja w warunkach silnego oświetlenia, praca w szerokim zakresie temperatur. Znaczenie produktu kompleksowego stale się zwiększa. Wyświetlacz z panelem dotykowym oraz kontrolerem do obsługi całości jest często obiektem zainteresowania inżynierów, ponieważ zapewnia wygodę i oszczędność czasu oraz daje małe ryzyko projektowe. Taki moduł jest zwykle zbalansowany pod względem ceny i wydajności, nierzadko wspierany przez biblioteki oprogramowania i zestawy startowe, dzięki czemu można o wiele szybciej przygotować aplikację niż w wariancie, kiedy każdy aspekt interfejsu użytkownika opracowuje się oddzielnie.

Elektroniczny papier to nie tylko e-booki

Elektroniczny papier to cały czas nowa i rozwijająca się technologia pozwalająca na tworzenie innowacyjnych produktów. Energooszczędne lekkie ekrany niewymagające podświetlania treści są przyjazne dla oczu, dobrze sprawdzają się w warunkach silnego nasłonecznienia oraz świetnie nadają się do urządzeń zasilanych bateryjnie. Wraz z kolejnymi generacjami mamy lepszą jakość wyświetlanego obrazu (kontrast, rozdzielczość) oraz odwzorowanie barw. Gorzej wygląda reprodukcja treści kolorowych, stąd na rynku wciąż dominują modele jedno- oraz dwukolorowe. Jakość oferowanych kolorów wciąż pozostawia jednak sporo do życzenia.

Poza jednym z najpopularniejszych i najbardziej znanych zastosowań wyświetlaczy e-papierowych w czytnikach e-booków, takie ekrany pojawiają się w supermarketach, gdzie zastępują tradycyjne papierowe etykiety produktów, co pozwala m.in. na bieżąco i zdalnie aktualizować informacje o cenach. Do ciekawych zastosowań należą też tablice informacyjne, rozkłady jazdy, stacje pogody czy znaki drogowe. Z e-papierowymi wyświetlaczami dość często spotkać się można również w zastosowaniach przemysłowych oraz logistycznych.

Kastomizacja i integracja

Elektronika mobilna, noszona, aplikacje IoT, sprzęt medyczny to przykłady urządzeń, w których konstrukcja wyświetlacza jest zintegrowana z obudową, często w nierozdzielną całość, tj. przyklejona do szyby lub przezroczystej części obudowy, tak aby połączenie było odporne na wpływ środowiska, narażenia mechaniczne wynikające z użytkowania oraz aby było estetyczne. Częściowe lub pełne dopasowanie do projektu klienta wyświetlaczy TFT, OLED, oraz paneli dotykowych polega na dostosowaniu kształtu, rozmiaru, koloru oraz innych parametrów technicznych. Takie wersje dostarczają specjalizowani dostawcy wyświetlaczy w połączeniu z możliwościami, jakie zapewniają im producenci. Koszty takich modyfikacji z roku na rok maleją, dostępność i oferta stale się poszerzają i tym samym takie usługi stają się bardziej przystępne.

Pobór mocy

Mały pobór mocy jest jednym z najbardziej istotnych trendów zmieniających całą współczesną elektronikę, a w aplikacjach mobilnych można go postrzegać jako zagadnienie kluczowe dla funkcjonalności i powodzenia rynkowego produktu. Dla rynku wyświetlaczy ograniczanie poboru mocy także jest zagadnieniem bardzo ważnym, bo w znakomitej większości urządzeń wyświetlacz jest obowiązkowy i bardzo obciążający dla bilansu energetycznego. Ponieważ z wyświetlacza nie da się zrezygnować, nie ma wyjścia – wyświetlacz też musi pobierać małą moc i wiele zmian technologicznych, które można obserwować w ostatnich latach, jest temu podporządkowanych.

Chęć zapewnienia niskiego poboru mocy kieruje uwagę konstruktorów na OLED-y i e-papier, gdzie nie ma konieczności podświetlania treści, a więc tego najbardziej energochłonnego czynnika. W przypadku e-papieru bilans energetyczny jest jeszcze bardziej korzystny, bo statyczny obraz nie wymaga zasilania, odświeżania ani nawet nadzoru ze strony mikrokontrolera. Na rynku są też rozwiązania wyświetlaczy bistabilnych, które można postrzegać jako produkt o funkcjonalności podobnej do e-papierowych. Przykładem może być ECB RLCD (Electrochromic Bistable Reflective Cholesteric Liquid Crystal Display), bistabilna technologia o małym poborze mocy i dobrej reprodukcji kolorów. Podobnie jak w e-papierze, tutaj też energia jest zużywana tylko przy zmianie treści. Wersje bistabilne uzupełniają elektroniczny papier tam, gdzie ma on jeszcze jakieś niedoskonałości.

Trzeba też dostrzec, że chęć zapewnienia dobrego bilansu energetycznego cały czas utrzymuje spore zapotrzebowanie na znakowe wyświetlacze panelowe LCD. Są to płytki szklane z ciekłym kryształem, bez kontrolera i wyświetlające z góry ustalone znaki, takie jak cyfry lub symbole. Panelowe wyświetlacze segmentowe LCD pobierają znikomą moc, zapewniają dobry kontrast i czytelność w oświetleniu słonecznym, przez co mogą być aplikowane w pewnej części urządzeń, gdzie trzeba przekazać mało informacji, np. w licznikach mediów, aparaturze pomiarowej, komponentach automatyki budynkowej itp.

Wzrost zainteresowania e-paperem i OLED

OLED-y i e-papery szybko się popularyzują na bazie trendów związanych z energooszczędnością, rosnącą liczbą aplikacji mobilnych, rozwojem obszaru IoT i elektroniki noszonej. Technologie takie jak OLED, e-paper szybko zyskują popularność na skutek potrzeby minimalizacji poboru mocy, a dzięki większemu popytowi ich ceny się obniżają. Podstawowe wersje takich wyświetlaczy na tyle potaniały, że wybór OLED-a przestał mieć znamiona jakiegokolwiek luksusu. Skoro opłacalne jest produkowanie elektronicznych metek wyświetlających ceny w supermarketach, bazujących na wyświetlaczach e-papierowych, to znaczy, że bariera cenowa przestała istnieć.

Na pytanie, jaka jest różnica w cenie między graficznymi TFT-LCD a OLED, trudno jest odpowiedzieć, mimo że przeszukanie ofert handlowych dostawców katalogowych nie stanowi problemu. Trudno znaleźć bezpośrednie odpowiedniki pod względem przekątnej, rozdzielczości, kontrolera, montażu itp. Ceny sporo się różnią w zależności od kategorii produktu, np. te z typową i popularną przekątną oraz proporcją boków są wyraźnie tańsze od reszty jednostek TFT, a OLED-y często są produkowane w innych wymiarach i proporcjach. Nawet jeśli się uda znaleźć jakąś parę, to będzie ona niereprezentatywna dla takiego porównania i podanie jakichkolwiek liczb przyniosłoby więcej zamieszania niż pożytku.

Bezsprzecznie na rynku można kupić wiele niedrogich monochromatycznych OLED-ów o małych przekątnych i niedużej rozdzielczości. Za taką samą sumę można nabyć znacznie większy wyświetlacz LCD-TFT i jedyne, z czym trzeba się zmierzyć dzisiaj, to nie, czy z sumą zaplanowaną w budżecie uda się coś nabyć, ale z tym, co wybrać. W przypadku urządzeń profesjonalnych i przemysłowych, takich o dużej wartości dodanej, aktualny poziom cen wydaje się do przyjęcia. Nawet dwukrotna różnica w cenie jest akceptowana, a dodatkowo, jeśli producent elektroniki rozpoczyna obecnie projekt, to wyświetlacz OLED-owy w ilościach wolumenowych będzie kupował do produkcji za minimum rok, a nierzadko nawet za dwa lata. Zatem różnica w cenie będzie jeszcze mniejsza, niż jest dzisiaj.

Wsparcie techniczne jest bardzo istotne

Na rynku jest dostępnych wiele wyświetlaczy, w tym technologii wyświetlania, typów i funkcjonalności. Po dodaniu do tego kontrolera, panelu dotykowego, interfejsu, narzędzi projektowych, zasobów oprogramowania, liczba kryteriów wyboru dodatkowo się zwiększa i decyzja, co wybrać, staje się jeszcze bardziej złożona. W takich okolicznościach znaczenie bliskiej współpracy z dostawcą wyświetlaczy staje się bardzo ważne. Nie chodzi nawet o jakąś ogólną orientację, ale o dokładne rozeznanie w szczegółach, w tym takich niedostępnych w kartach katalogowych. Znaczenie kompetentnego wsparcia technicznego jest pośrednio efektem szerokiej oferty rynku i krótkiego czasu życia wielu technologii. Najwięcej do powiedzenia w zakresie wsparcia mają specjalizowani dostawcy wyświetlaczy i bezsprzecznie firmy te mają znaczną przewagę nad handlowymi po stronie kompetencji.

Dawniej nowe jednostki wyświetlające nie pojawiały się co chwila, były prostsze, dzięki czemu możliwość opanowania szczegółów wyświetlacza i kontrolera była łatwiejsza. Dzisiaj inżynier, który godzinami ślęczy nad projektem, zazwyczaj nie jest dogłębnie zorientowany w szczegółach i ryzyko, jakie kryje się za decyzją, jest duże. O udanej implementacji decyduje nie tylko ekran, ale także sterowanie, komunikacja, połączenie z panelem dotykowym, zarządzanie poborem mocy itd. oraz oprogramowanie. Wsparcie techniczne związane z wyświetlaczami przesuwa się też w stronę aplikacyjną, czyli doboru optymalnej jednostki z punktu widzenia aplikacji, integracji wyświetlacza z obudową lub połączenia w całość elementów, takich jak złącze, interfejs, wyświetlacz, kontroler oraz panel.

Wsparcie aplikacyjne obejmuje też coraz bardziej popularne gotowe do użycia płytki zawierające projekty referencyjne. Stanowią one przykłady do naśladowania, są demonstracją dobrych praktyk projektowych i dają szansę tego, aby na początku pracy nie popełnić drobnej, ale trudnej do znalezienia pomyłki. Liczne zestawy startowe, będące nierzadko kompletną platformą sprzętową dla aplikacji, plus dostępne oprogramowanie i biblioteki procedur w wielu przypadkach sprawiają, że nakład pracy wymaganej do obsługi wybranych popularnych modeli wyświetlaczy graficznych z panelem dotykowym jest porównywalny z tym, który kiedyś trzeba było poświęcić na obsługę prostych modułów znakowych z wbudowanym kontrolerem.

Zasilacze dużej mocy i ładowarki akumulatorów

Zasilacze impulsowe to jedne z najpopularniejszych na rynku komponentów standardowych przeznaczonych do realizacji systemów elektronicznych. Każdy sprzęt wymaga zapewnienia zasilania, najczęściej z sieci energetycznej, stąd dzisiaj zasilacze są wykorzystywane praktycznie we wszystkich gałęziach współczesnej techniki, bez względu na branżę, typ urządzenia i aplikację. W obszarze techniki dla jednostek dużej mocy wyścig technologiczny koncentruje się na sprawności, małych wymiarach przy dużej mocy wyjściowej oraz niezawodności.

Najważniejszym zagadnieniem technicznym w zasilaczach dużej mocy jest miniaturyzacja, gdyż umożliwia ona wytwarzanie urządzeń wydajnych, ale niewielkich. Mniejsze zasilacze mogą też być tańsze w produkcji, bo nie potrzeba do nich dużych radiatorów. Kluczem do miniaturyzacji jest duża sprawność zapewniająca oszczędność energii zasilającej, a więc dająca mniejsze rachunki oraz dłuższy czas pracy z akumulatora. Wysoko sprawny zasilacz niewiele się grzeje, a więc może też pracować w szerszym zakresie temperatur, a cała konstrukcja może być bardziej zminiaturyzowana, bo nie ma potrzeby rozpraszania tak dużej mocy cieplnej, użycia wentylowanej obudowy itd.

Wysoka sprawność oznacza często też małą awaryjność zasilaczy, a więc pośrednio dobrą jakość. Takie zasilacze się nie grzeją, więc ich podzespoły nie są tak obciążone cieplnie. Także ograniczenia na moc wyjściową przy dużych temperaturach otoczenia stają się łagodniejsze. Wysoka sprawność zasilaczy lub konieczność korekcji współczynnika mocy przy dużej mocy wyjściowej jest ponadto dla coraz większej grupy produktów wymogiem prawnym. Dotyczy to najbardziej wersji konsumenckich, ale większe jednostki też wpisują się w ten trend.

W efekcie każda kolejna generacja zasilaczy wchodzących na rynek ma coraz większą sprawność, a w najlepszych produktach sięga ona 95– 96%, czyli o około 10% więcej, niż było dekadę temu. Upowszechnienie się podzespołów mocy z azotku galu powinno jeszcze bardziej pozwolić na większe zminiaturyzowanie zasilaczy.

Jakość zasilaczy to temat zawsze aktualny

Jakościowo dobry zasilacz to taki, który się nie grzeje, jest zabezpieczony skutecznie przed przepięciami i ma dobrze działające filtry zakłóceń, dobre kondensatory i adekwatne do prądu wyjściowego przekroje przewodów nawojowych oraz kabli wyjściowych. Dobry zasilacz ma zabezpieczenia wyjścia przed odwrotną polaryzacją, blokadę możliwości niekontrolowanego wzrostu napięcia w czasie uszkodzenia, dodatkowe kondensatory blokujące wyjście, które obniżają poziom szumów i zakłóceń. Dobry zasilacz ma też zabezpieczenie termiczne, które chroni jego działanie przed uszkodzeniem bądź przez czasowe wyłączenie lub przez derating, czyli obniżenie prądu wyjściowego do poziomu bezpiecznego w wyższej temperaturze.

Użyteczna funkcjonalność, jaka pojawia się dzisiaj często w zaawansowanych jednostkach zasilających, obejmuje ponadto takie dodatki, jak np. możliwość regulacji wyjściowego napięcia w niewielkim zakresie trymerem, po to, aby skompensować spadek napięcia na przewodach wyjściowych. Do tego samego celu służą zwielokrotnione zaciski wyjściowe lub też możliwość podłączenia dwóch dodatkowych przewodów pomiarowych bezpośrednio do zacisków obciążenia (tzw. czteroprzewodowe połączenie kelwinowskie). Od strony układowej dobre zasilacze wyposaża się dzisiaj we wszechstronne układy zabezpieczające, rozbudowane filtry wejściowe, sterowniki zapewniające sygnalizację stanu zasilacza i podobne obwody ochronne na tyle skuteczne, że awaria na skutek przeciążenia, stanu nieustalonego lub zwykłego błędu podczas montażu instalacji staje się praktycznie niemożliwa.

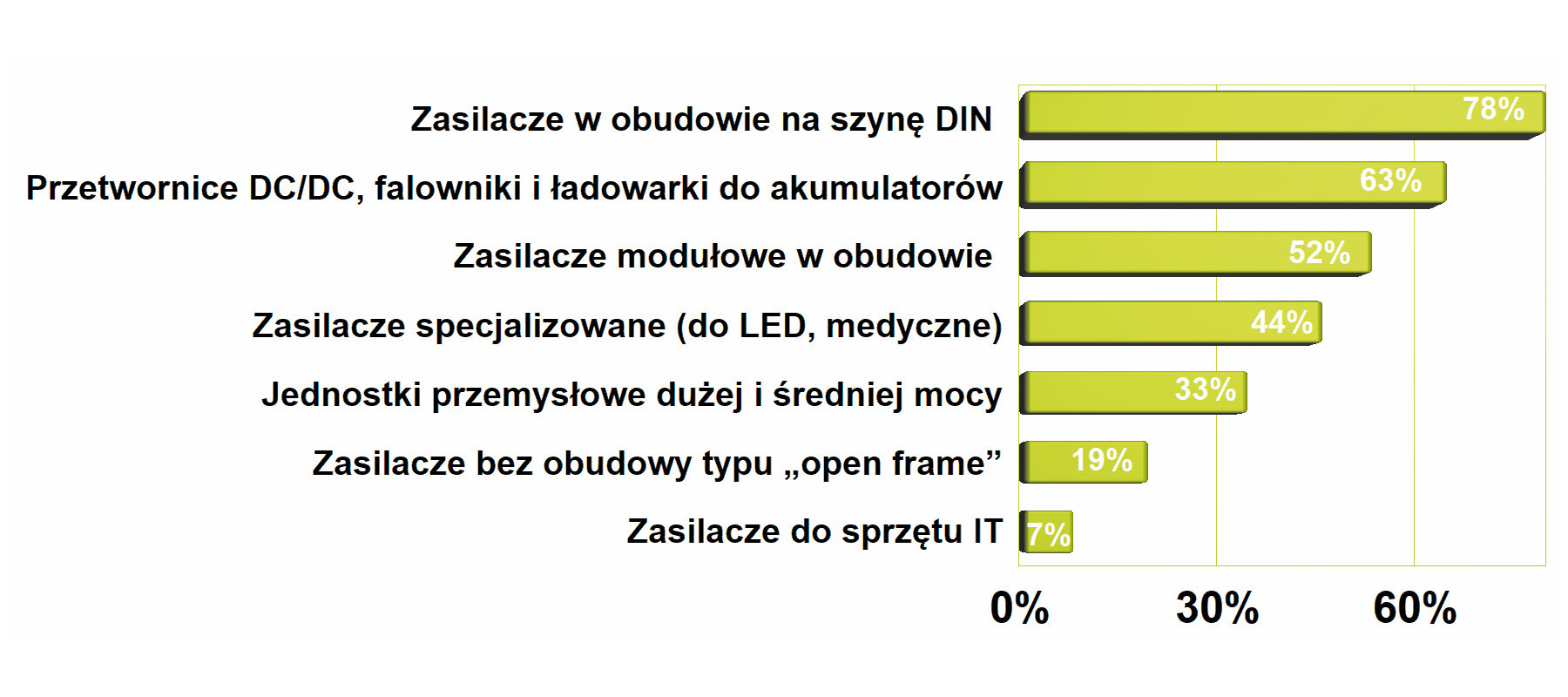

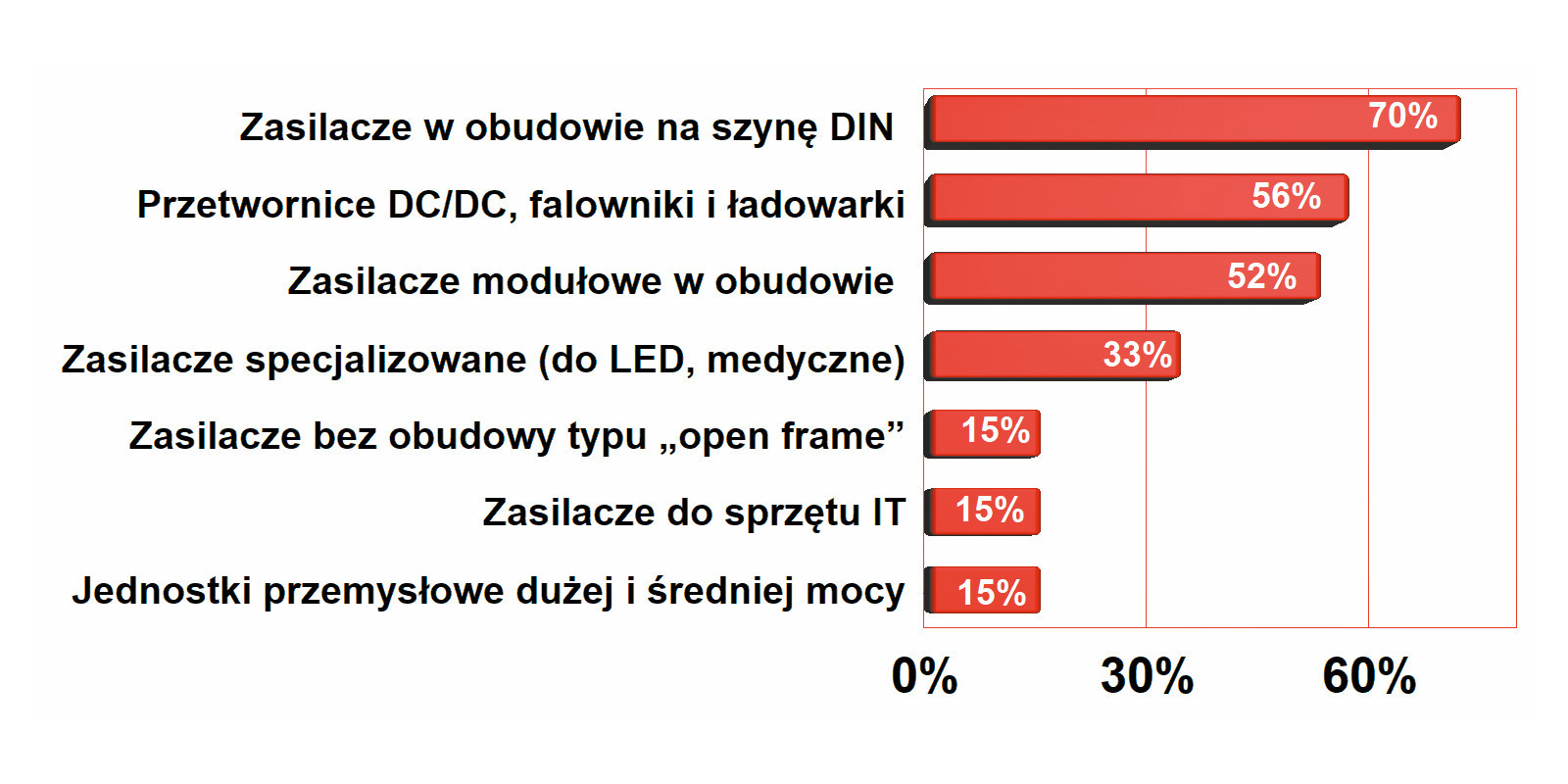

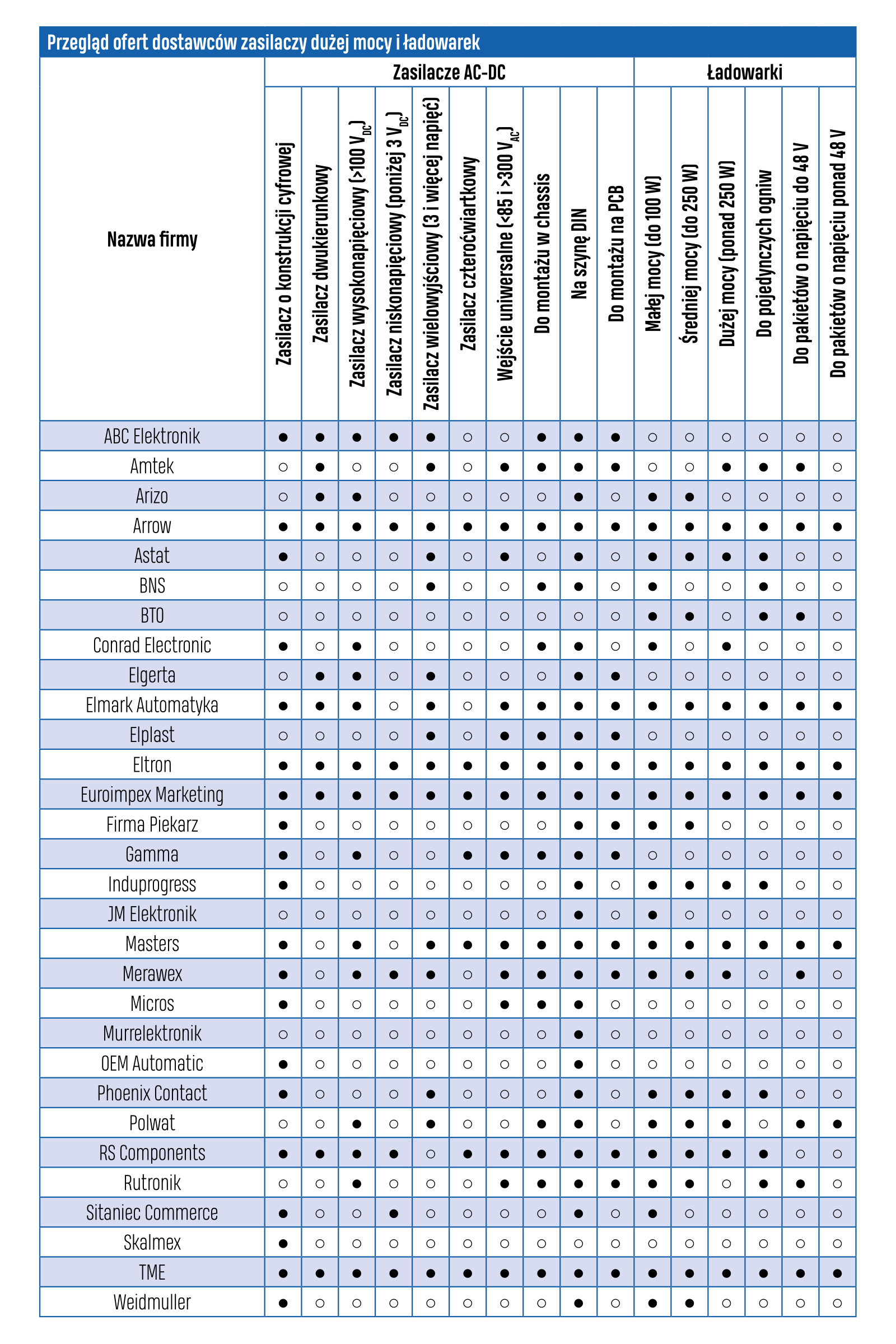

Najbardziej zaawansowane jednostki, wyposażone w interfejsy cyfrowe, pozwalają nie tylko na wszechstronne monitorowanie aktualnego stanu czy sterowanie włączaniem/wyłączaniem, ale również ustawienie i odczyt wielu parametrów pracy, takich jak napięcie, prąd wyjściowy czy progi zadziałania zabezpieczeń. Niektóre umożliwiają rejestrację stanów awaryjnych i rzeczywistego czasu pracy, a nawet predykcję pozostałego czasu życia. Na koniec warto wyróżnić cechy wymuszane nowymi aplikacjami i nowymi wymaganiami obowiązujących norm. Należą do nich coraz bardziej wyrafinowane układy korekcji współczynnika mocy, dzięki któremu nie trzeba płacić ekstra rachunku za moc bierną. Inne to zdolność do krótkotrwałego dostarczenia dużego prądu potrzebnego do rozruchu coraz powszechniejszych obciążeń indukcyjnych, takich jak silniki, czy do absorbcji prądu wspomagającej ich hamowanie, łącznie ze zwrotem odbieranej energii do sieci. Są to również rozwiązania coraz większych zasilaczy z cichym i bezawaryjnym chłodzeniem pasywnym oraz małe zakłócenia, prądy upływu i wzmocniona izolacja galwaniczna, wymagane przez aplikacje medyczne.