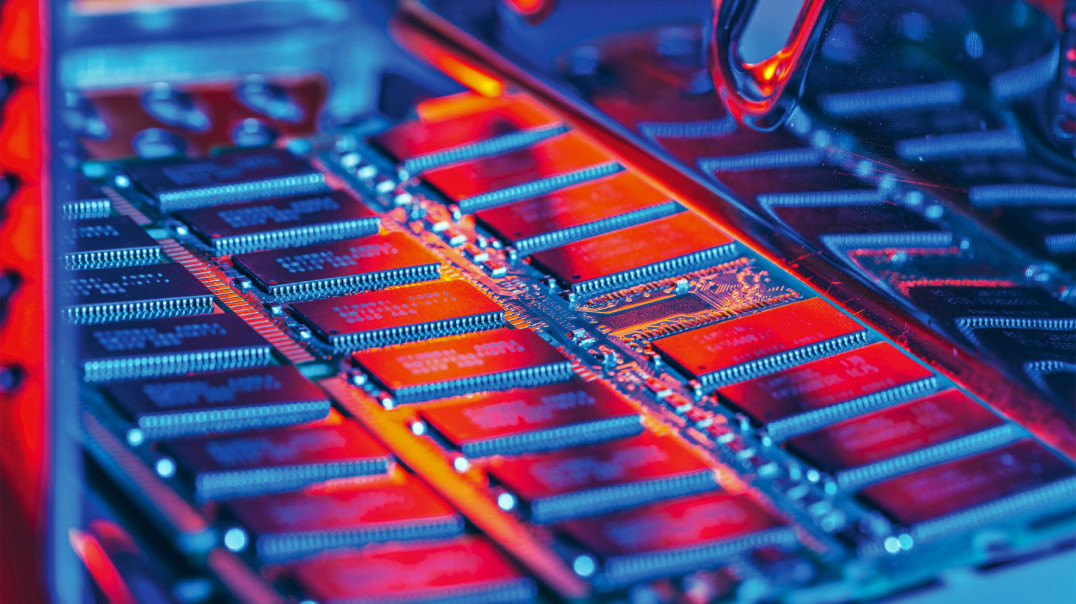

Najwięksi producenci pamięci, czyli SK Hynix, Samsung Electronics oraz Micron Technology, weszli w fazę wyjątkowo rentownego cyklu koniunkturalnego, w którym kluczowa stała się marża, a nie wolumen sprzedaży. Po nadwyżkach magazynowych w 2023 roku firmy te przestawiły linie produkcyjne na moduły DDR5 HBM (High Bandwidth Memory) oraz serwerowe, niezbędne do trenowania modeli generatywnej AI. Motywacja finansowa jest oczywista: standardowe moduły do komputerów osobistych generują minimalne zyski, podczas gdy zaawansowane pamięci dla centrów danych potrafią osiągać marże rzędu nawet 75%, często wyższe niż same akceleratory AI.

W efekcie moce produkcyjne zostały praktycznie wyprzedane na cały rok, a Micron prognozuje marżę brutto na poziomie 68% w drugim kwartale 2026 roku. To coś nieosiągalnego w segmencie konsumenckim.

Problem nie kryje się tylko w zapotrzebowaniu rynku

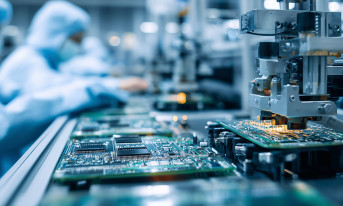

Problem nie sprowadza się jednak tylko i wyłącznie do popytu. Istotne są także ograniczenia technologiczne. Wersje HBM3E zajmują około trzykrotnie więcej powierzchni krążków krzemu niż standardowe DDR5, co wynika z większych rozmiarów układów i niższej wydajności procesu przy pionowym układaniu warstw półprzewodnika. Ponieważ globalne zdolności produkcyjne podłoży krzemowych są ograniczone, a budowa nowych fabryk trwa latami, każdy krążek przeznaczony na pamięć dla AI oznacza mniej chipów dla rynku masowego. Nie istnieje tutaj inna opcja. W świecie produkcji pamięci obowiązuje coś za coś. To prowadzi do niedoborów, z którymi muszą mierzyć się producenci komputerów i sprzętu konsumenckiego.

Sztuczna inteligencja wywróciła więc rynek pamięci do góry nogami zarówno w segmencie DRAM, jak i NAND. Z czasem okazało się bowiem, że pamięci Flash wcale nie straciły strategicznego znaczenia w erze AI. Przesunięcie akcentu z trenowania modeli na ich wdrażanie wygenerowało stabilny i rosnący popyt na szybkie nośniki SSD wykorzystywane w centrach danych. NAND stał się fundamentem infrastruktury obsługującej zapytania do modeli AI. Wiele wskazuje na to, że strukturalna nierównowaga podaży i popytu – obejmująca zarówno DRAM, jak i pamięci Flash – utrzyma się przez rok 2026, a być może i dłużej.

Ceny cały czas rosną

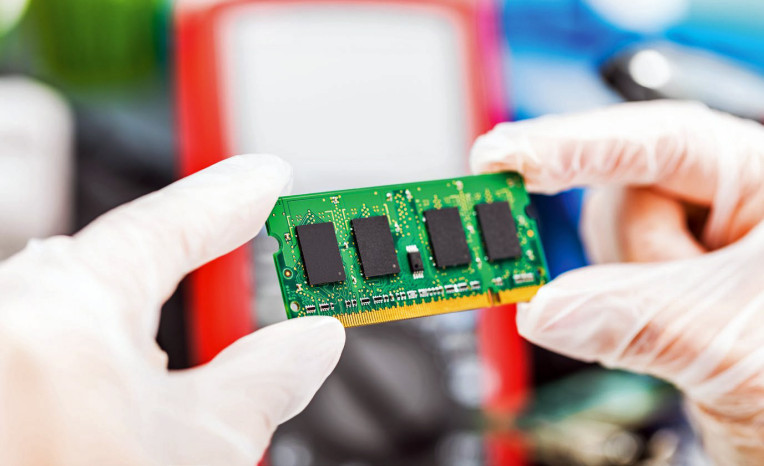

Konsekwencje są niestety mocno odczuwalne. Znacznie mocniej, niż wydaje się na pierwszy rzut oka. Naturalne jest myślenie, że drożejąca pamięć to proporcjonalnie drożejące urządzenia. Skala jest jednak o wiele poważniejsza. Przez ponad dekadę producenci elektroniki korzystali z taniejącej pamięci, by zwiększać wydajność bez podnoszenia cen końcowych. Teraz pamięć drożeje zamiast tanieć. Analitycy przewidują, że ceny DRAM mogą wzrosnąć o 50‒55% na początku 2026 roku, a ceny elektroniki konsumenckiej nawet o 20%, gdy producenci przeniosą koszty na klientów.

Sytuację komplikuje tak zwany paradoks AI PC. Branża chce pobudzić sprzedaż komputerów zdolnych do lokalnego uruchamiania modeli sztucznej inteligencji, co wymaga 16 lub nawet 32 GB pamięci RAM. Jednocześnie to właśnie rozwój AI sprawia, że pamięć staje się droższa i trudniej dostępna. Gdy koszt pamięci stanowi już blisko jedną piątą kosztu produkcji komputera, część firm ogranicza sprzedaż komponentów, aby zapobiec spekulacyjnemu wykupowi. Prognozy wskazują na możliwy spadek dostaw komputerów w 2026 roku, ponieważ AI PC mogą okazać się zbyt drogie dla wielu użytkowników. Szybko może się więc okazać, że AI PC nie zawładną rynkiem.

Na koniec na rynek wkracza geopolityka

W tle trwają również przetasowania geopolityczne. Firmy desperacko poszukują dodatkowych mocy produkcyjnych, zawierając nieoczywiste partnerstwa. Jednocześnie Chiny próbują wykorzystać sytuację, zwiększając inwestycje w krajową produkcję pamięci. Tamtejsze przedsiębiorstwa technologiczne również gromadzą zapasy układów, obawiając się przyszłych regulacji, co dodatkowo ogranicza globalną podaż. Wszystko to sprawia, że 2026 rok może stać się punktem zwrotnym dla całego łańcucha dostaw półprzewodników. Era taniej i powszechnie dostępnej pamięci dobiega końca. Wartość pojedynczego wafla krzemowego coraz częściej mierzy się tym, jak bardzo wspiera rozwój centrów danych i trenowanie modeli AI, a nie tym, ile smartfonów czy laptopów można z niego wyprodukować.