Zasilacze impulsowe – niezawodne i bezpieczne

Zasilacz to pojemny termin, za którym kryją się tysiące rozwiązań różniących się parametrami, budową, przeznaczeniem i wykonaniem. Dwa takie same zasilacze w tym ujęciu mogą być inne, jeśli chodzi o konstrukcję wewnętrzną, jakość i funkcjonalność. Mało widoczną dla użytkownika cechą jest też nowoczesność konstrukcyjna tych jednostek.

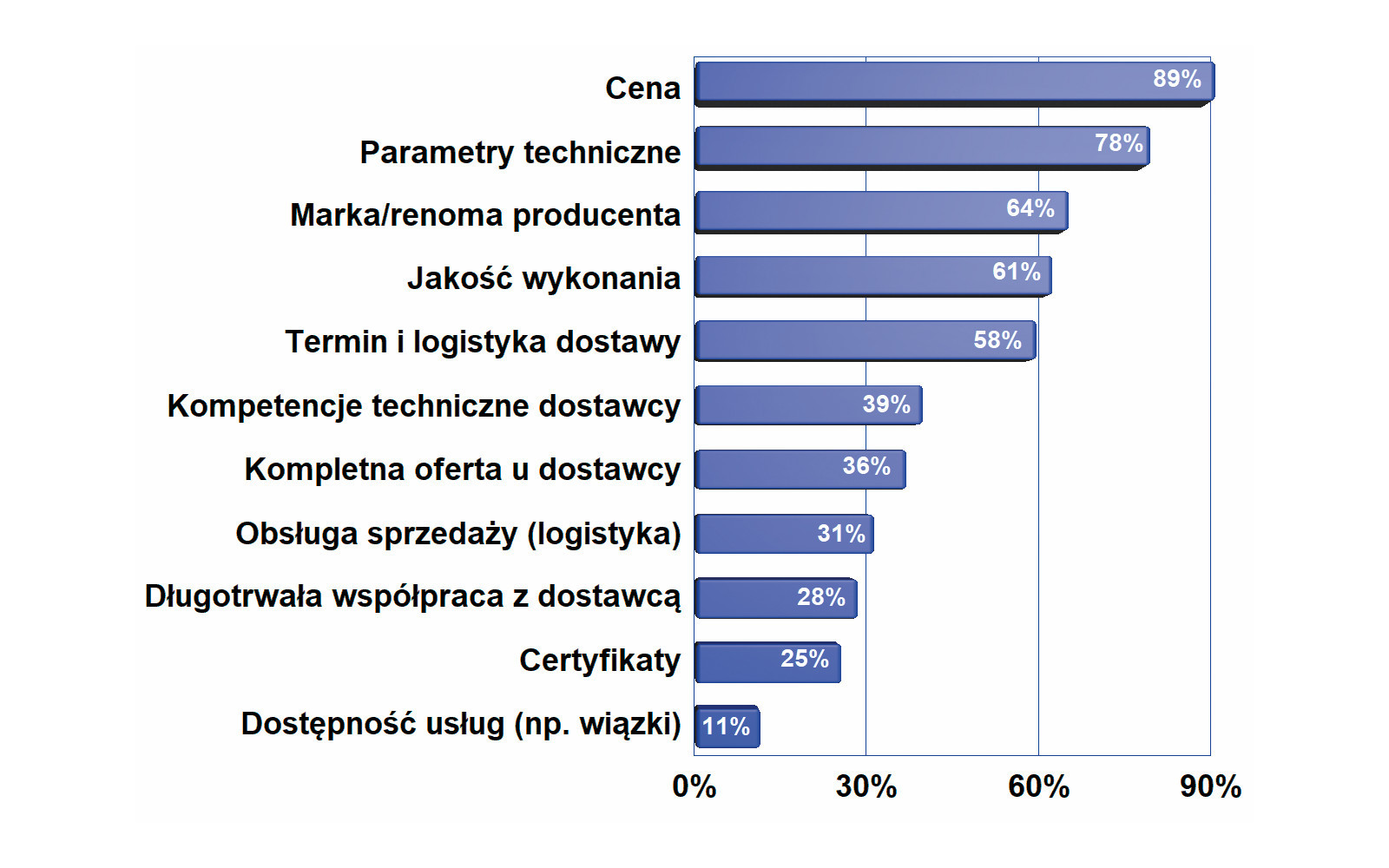

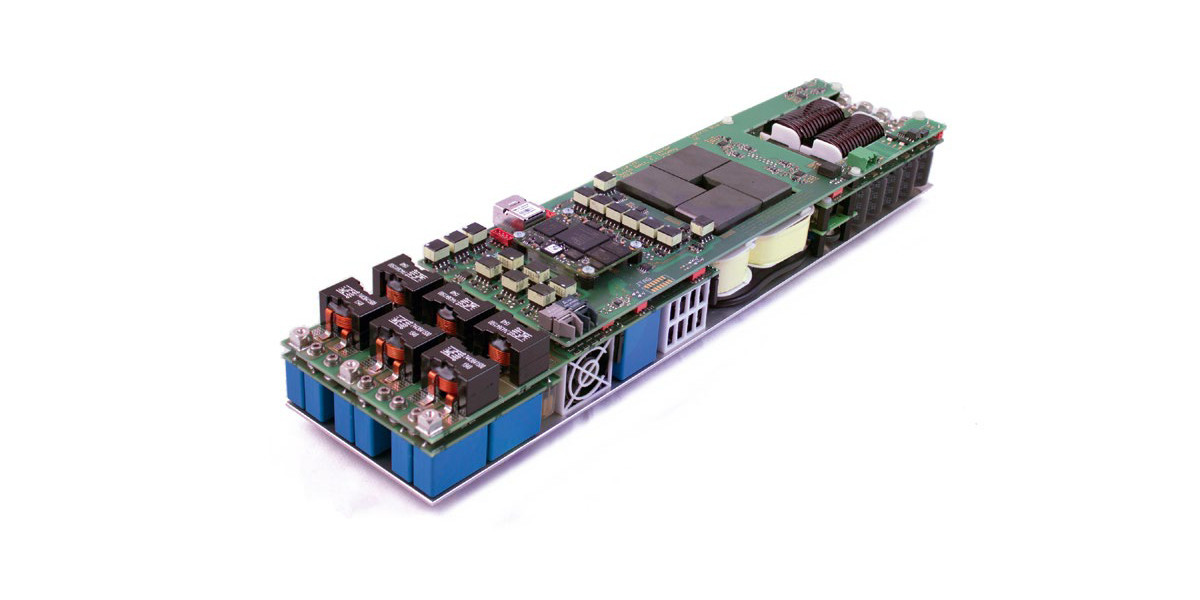

Nowoczesny zasilacz to taki, którego budowa opiera się na najnowszych dostępnych na rynku technologiach konwersji mocy, materiałach i komponentach. Z tym bywa różnie – wystarczy otworzyć obudowę, aby przekonać się, że wiele jednostek dostępnych na rynku to konstrukcje, w których takich nowinek się nie znajdzie. Powodów tego jest wiele. Przede wszystkim chodzi o cenę, która jest ważnym kryterium wyboru produktu przez klienta. Nowe komponenty i materiały zwykle są droższe od tych popularnych, dlatego musi minąć sporo czasu, zanim nowości trafią do wnętrza zasilaczy dostępnych w handlu. Można nawet pokusić się o stwierdzenie, że im zasilacz popularniejszy, tańszy i bardziej standardowy, tym jego wewnętrzna konstrukcja opiera się na rozwiązaniach znanych od lat. Inercja w adaptacji nowych technologii daje się zauważyć na wielu rynkach, ale w przypadku zasilaczy ma ona bardzo realny wymiar ekonomiczny. Z tych przyczyn w zasilaczach małej mocy jest ona najsłabiej zarysowana i dotyczy najczęściej sterownika scalonego, a najrzadziej elementów magnetycznych i podzespołów pasywnych. W jednostkach dużej mocy, rozwiązaniach specjalizowanych i niszowych bywa znacznie większa, bo cena tych rozwiązań ma mniejsze znaczenie, a funkcjonalność i parametry techniczne są bardziej brane pod uwagę.

SPRAWNOŚĆ JEST BARDZO ISTOTNA

Sprawność zasilaczy staje się ważna z kilku powodów. Po pierwsze, im jest ona większa, tym zasilacz może dostarczać więcej mocy przy tych samych wymiarach. Czyli wysoka sprawność jest przepustką do miniaturyzacji. Bezsprzecznie wysoko sprawny zasilacz kojarzy się również z produktem nowoczesnym i zaawansowanym technicznie.

Po drugie, wysoka sprawność oznacza niższe koszty eksploatacji urządzeń. Ponieważ energia elektryczna stale drożeje, w rozwiązaniach przemysłowych, teleinformatycznych oraz innych obszarach, gdzie urządzenia pracują non stop przez długie lata, koszt energii się liczy. W wielu przypadkach do kosztu pobieranej z sieci energii elektrycznej trzeba doliczyć koszt usunięcia ciepła z obiektu za pomocą systemu klimatyzacji (np. w serwerowniach, stacjach telekomunikacyjnych).

Po trzecie, wysoka sprawność oznacza też często małą awaryjność zasilaczy, a więc pośrednio dużą jakość. Bo wysoko sprawne jednostki mało się grzeją i ich podzespoły nie są tak obciążone cieplnie. Są mniejsze, a więc też mogą być tańsze w produkcji, bo nie potrzeba do nich dużych radiatorów. Dzięki wysokiej sprawności zasilacze mogą działać w szerszym zakresie temperatur, nie wymagają chłodzenia wymuszonego. Także ograniczenia na moc wyjściową przy dużych temperaturach otoczenia stają się łagodniejsze. To zagadnienie określa się terminem derating, co oznacza, że z uwagi na ograniczenia cieplne, przy wysokich temperaturach otoczenia, moc maksymalna dostarczana przez zasilacz maleje.

Po czwarte, wysoka sprawność zasilaczy, mała moc standby lub konieczność korekcji współczynnika mocy jest coraz częściej wymogiem prawnym.

Sprawność najbardziej zaawansowanych jednostek dawno już przekroczyła 90%, a wartości rzędu 95% wcale nie są jakimś wyjątkiem. Z reguły im zasilacz mniejszej mocy, tym sprawność średnia jest mniejsza, ale mimo to bez problemu można kupić dzisiaj zasilacze wtyczkowe lub biurkowe do sprzętu konsumenckiego osiągające średnią sprawność 88‒90%.

Warto dodać, że w produktach konsumenckich wysoka sprawność idzie w parze z małym poborem mocy bez obciążenia. Ograniczenie wielkości energii pobieranej przez zasilacz na własne potrzeby to także wymogi narzucane przez regulacje unijne, gdyż nawet jeśli pobierana przez pojedynczy zasilacz moc standby nie wydaje się duża to jednak takich zasilaczy jest bardzo dużo i sumarycznie stanowią one już poważne obciążenie dla sieci. Bezsprzecznie w temacie mocy standby sporo się ostatnio dzieje, a producenci półprzewodników, czyli układów sterujących i zasilaczy, wkładają wiele wysiłku w to zagadnienie, co chwila bijąc rekordy oszczędności i ekologiczności. Zapewnienie niskiego poboru mocy bez obciążenia jest łatwiejsze w przypadku sterowania cyfrowego, bo implementacja technik sterowania z gubieniem impulsów, zmianą topologii konwersji w takim stanie w ten sposób jest łatwiejsza do osiągnięcia. Jednostki zgodne z Energy Efficiency Level VI lub CoC 5 pobierają z sieci w tym stanie poniżej 0,1 W.

CYFRYZACJA ZASILACZY

Cyfryzacja zasilaczy jest bezdyskusyjnym faktem, niemniej jest to proces pod każdym względem ewolucyjny i niekoniecznie dotyczący dzisiaj obwodów konwersji mocy. Cyfrowa jednostka może mieć cyfrowy sterownik bazujący na procesorze DSP lub wydajnym mikrokontrolerze lub też być zrealizowana w wersji klasycznej z procesorem zarządzającym działaniem sterownika.

Najczęściej cyfryzacja zasilaczy dotyczy tego drugiego przypadku. Procesor realizuje wówczas komunikację cyfrową, nadzoruje działanie sterownika, pozwala na ustawienie progów zabezpieczeń, poziomów napięć, zarządza równomiernym podziałem mocy przy połączeniu równoległym, dokonuje kompensacji spadku napięcia na przewodach zasilających itd. Pełna cyfryzacja zapewnia jeszcze możliwość programowania topologii konwersji mocy, a więc większą elastyczność działania. W zasilaczu całkowicie cyfrowym topologia konwersji energii może się zmieniać płynnie w zależności od obciążenia lub napięcia wejściowego, po to, aby zmaksymalizować sprawność przetwarzania lub ograniczyć straty mocy, gdy zasilacz jest nieobciążony. Rozwiązania cyfrowe pomagają też w realizacji złożonych systemów zasilających, na przykład tzw. dwukierunkowych, czyli takich, które mogą dostarczać energię do obciążenia lub ją pobierać, przesyłając z powrotem do sieci. W takich przypadkach zmiana topologii konwersji energii w locie jest niezbędna.

W obszarze przemysłu, elektroniki konsumenckiej cyfryzacja zasilaczy to cały czas przyszłość, niemniej patrząc na tempo zmian w przemyśle elektronicznym, nie wydaje się, aby była ona tak bardzo odległa.

INTERFEJS KOMUNIKACYJNY

Coraz więcej jednostek zasilających ma możliwość komunikacji za pomocą interfejsu cyfrowego. Jest to także wymowny znak postępującej cyfryzacji, ale i obraz zmieniających się wymagań klientów.

Interfejs cyfrowy daje możliwość odczytu stanu zasilacza, a więc napięcia wyjściowego i prądu, temperatury, parametrów napięcia sieci energetycznej oraz informacji nt. liczby przepracowanych godzin lub wcześniejszych zdarzeń, takich jak zaniki napięcia lub przeciążenia. Takie informacje mogą być wykorzystane do zarządzania działaniem systemu, planowania obsługi technicznej lub prognozowania awarii.

W drugą stronę interfejs pozwala na ustawianie parametrów takich jak wartości napięć i prądów oraz progów zadziałania zabezpieczeń. Programować można też działanie korektora spadku napięcia na długich przewodach, który podbija lekko napięcie przy wzroście prądu obciążenia. Interfejs jest też niezbędnym elementem przy łączeniu wielu jednostek w systemy pracujące równolegle lub typu N+1, a więc z redundancją i hot swapem.

Zasilacz z interfejsem cyfrowym staje się obecnie komponentem komunikacyjnym i takim samym elementem jak np. switch sieciowy, bo łącze cyfrowe nierzadko obsługuje standardowy protokół sieciowy jak Modbus, a konstrukcja oprogramowania pozwala na zdalne zarządzanie. Nie tylko chodzi tu o wygodę, ale także o możliwość zapanowania nad złożonymi systemami zasilającymi, gdzie poza siecią energetyczną jest też akumulator lub agregat prądotwórczy, panel fotowoltaiczny itd. Systemy zasilania stają się coraz bardziej złożone i możliwość programowania zasilaczy to w pewnej mierze skutek tych procesów.

Warto zwrócić uwagę jeszcze na ekonomiczne aspekty możliwości programowania parametrów zasilania. Im w szerszym zakresie jest ono możliwe, tym mniej jednostek może mieć producent w ofercie. Mniej typów to niższe koszty magazynowania i większa skala produkcji dla danej jednostki. Nawet jeśli dodanie programowania odbywa się kosztem wzrostu komplikacji układowej, po uwzględnieniu wszystkich korzyści jest to opłacalne dla producentów i klientów. I dlatego rynek zasilania profesjonalnego zmierza w tym kierunku.

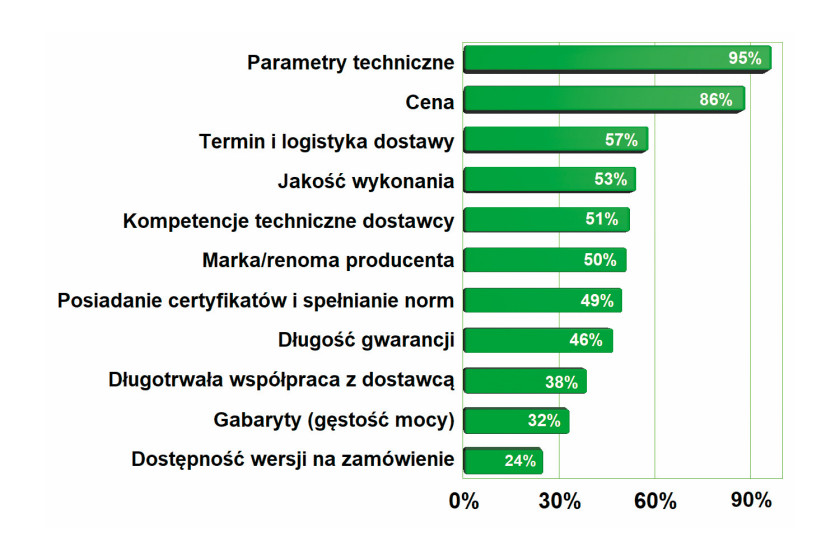

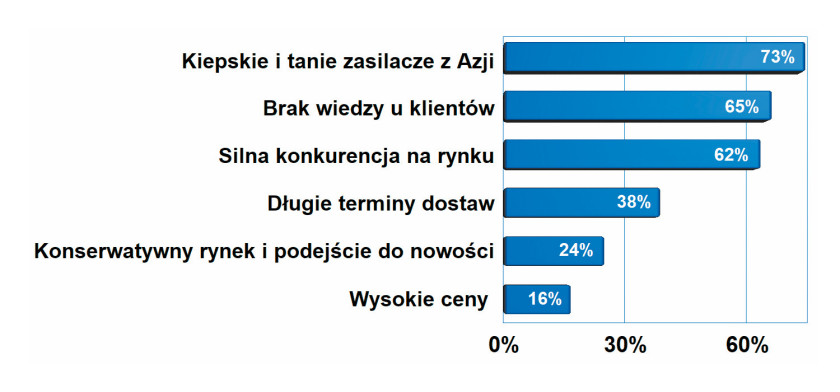

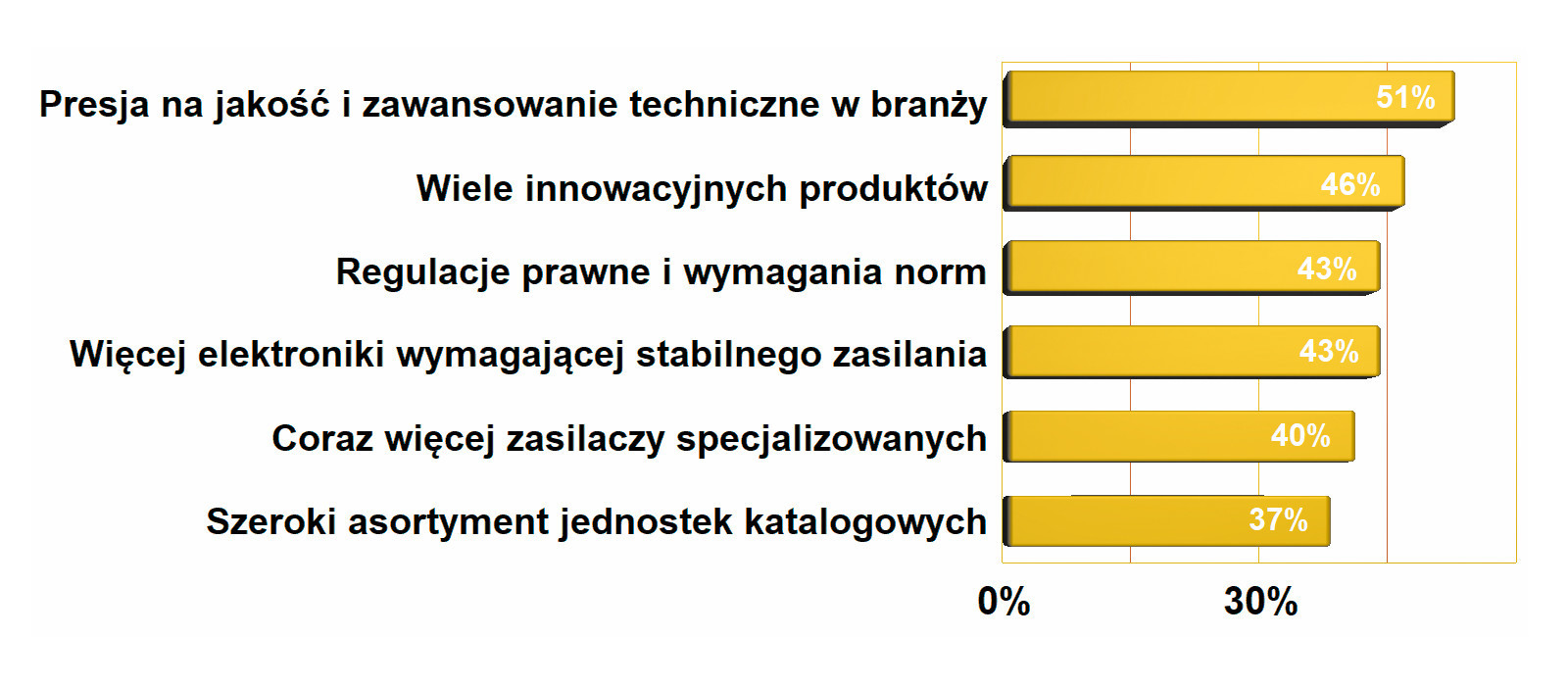

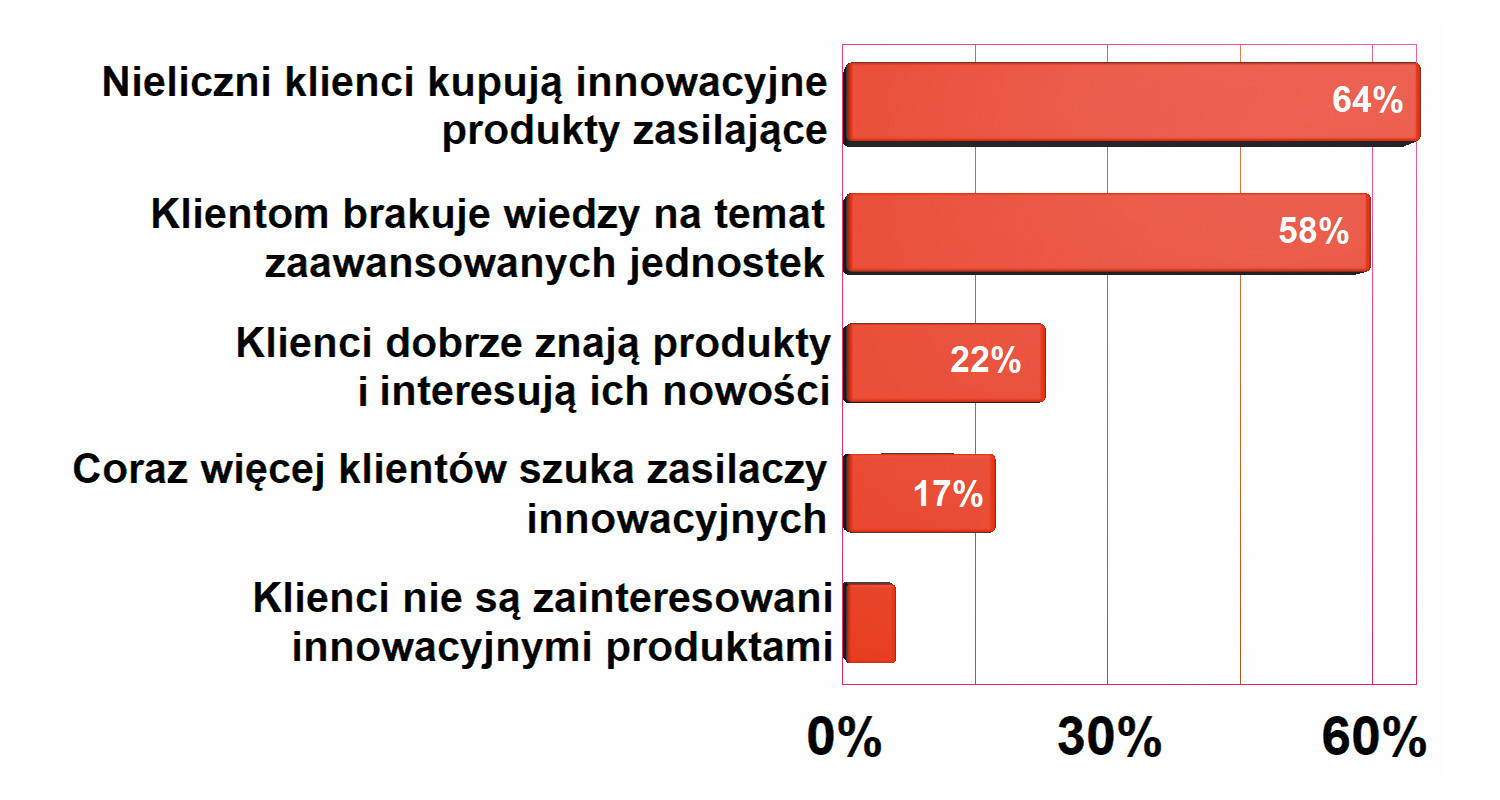

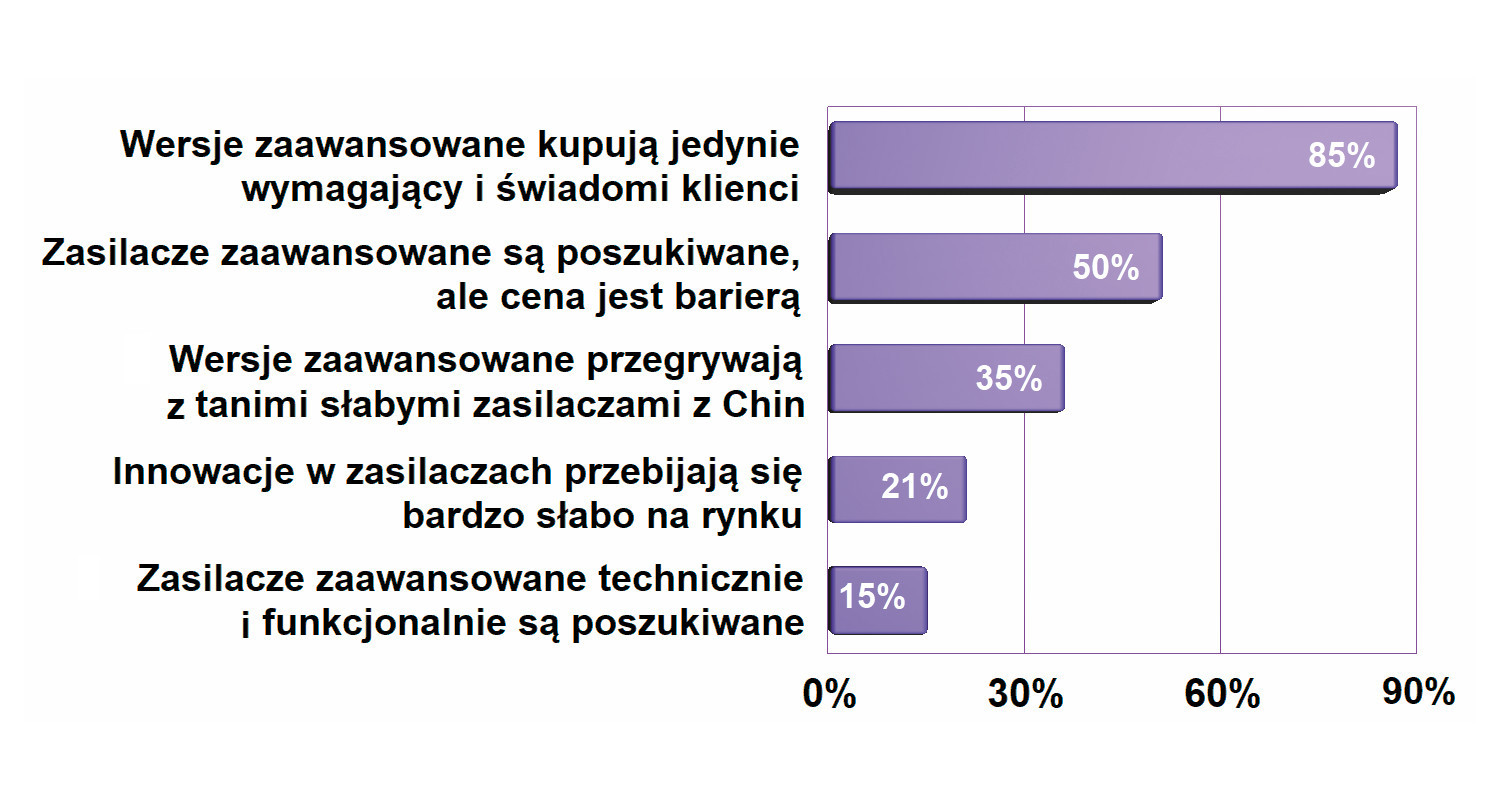

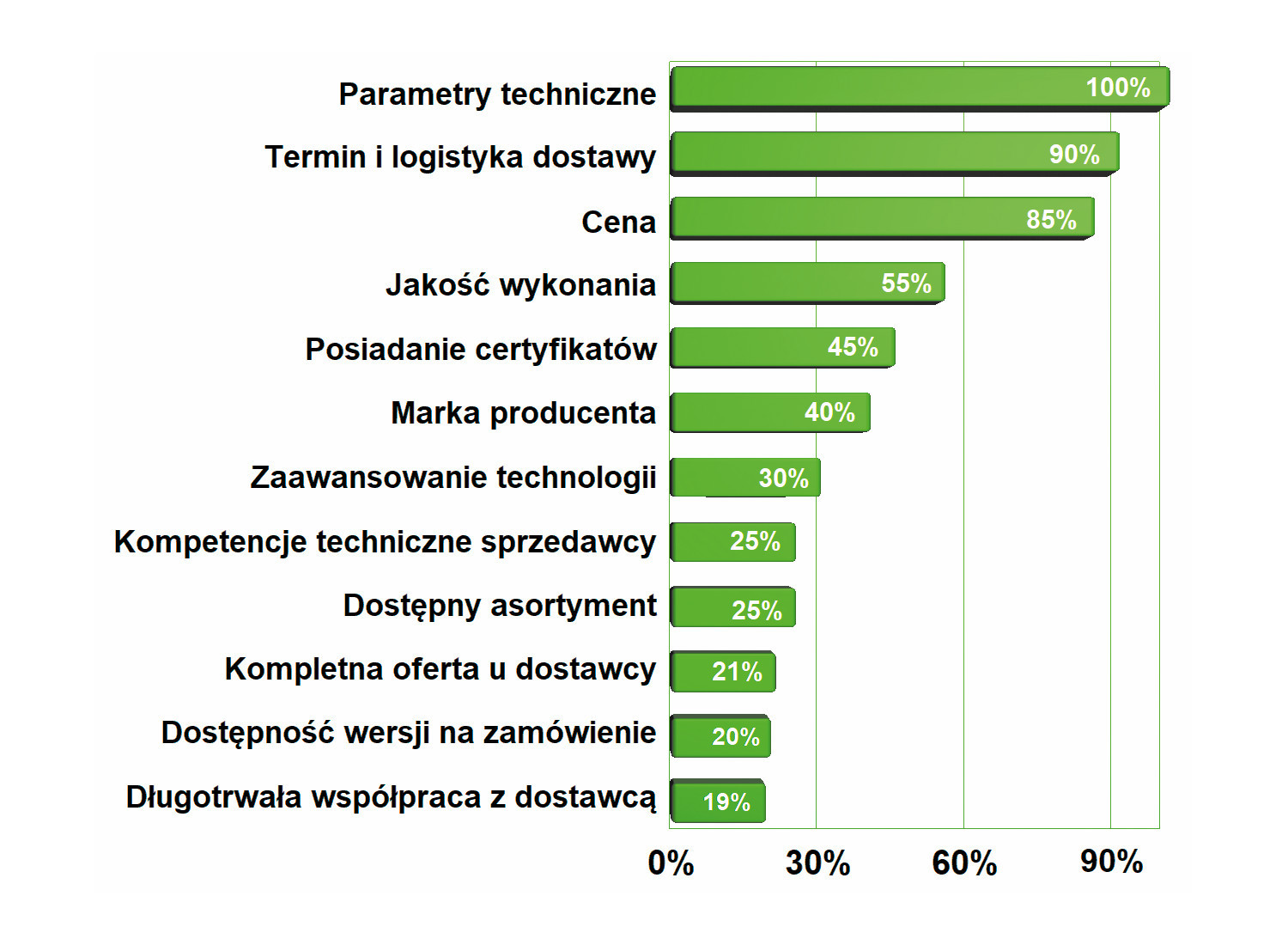

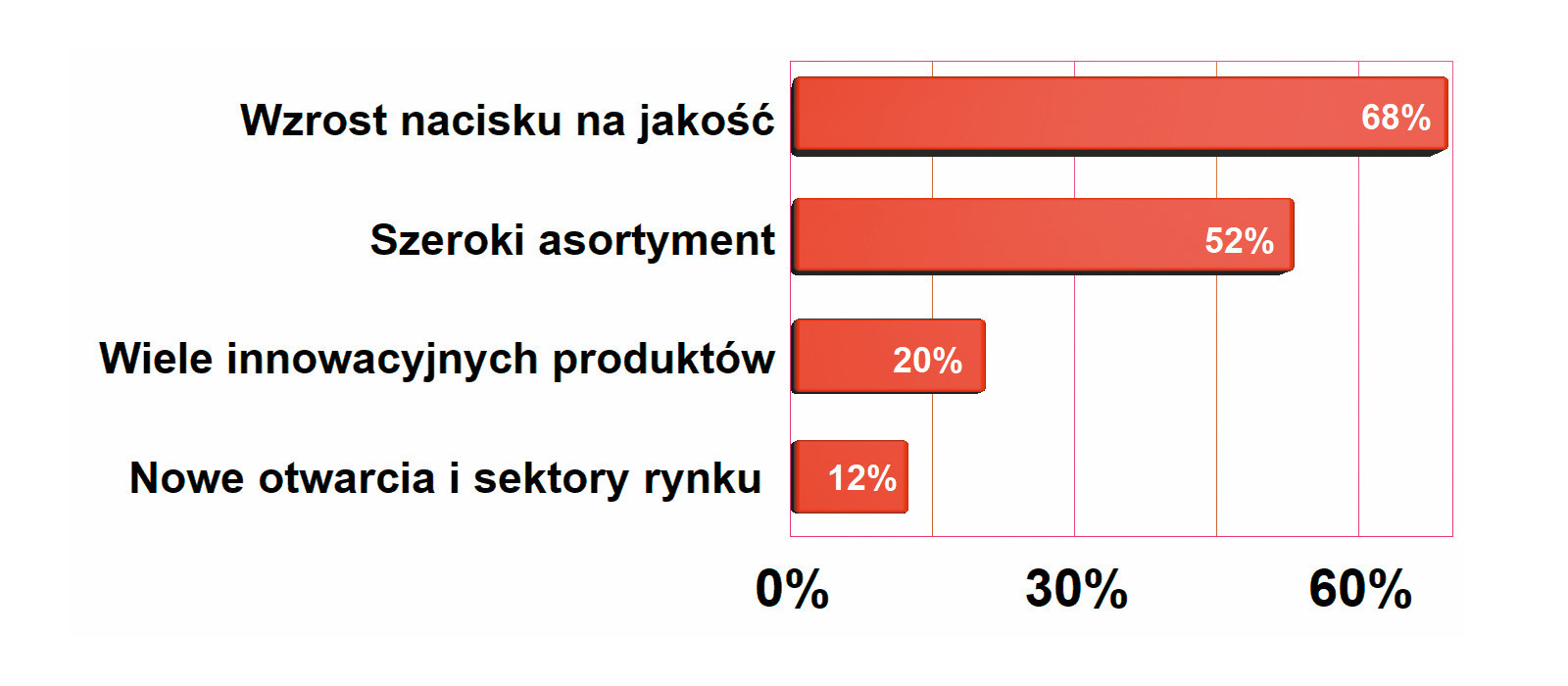

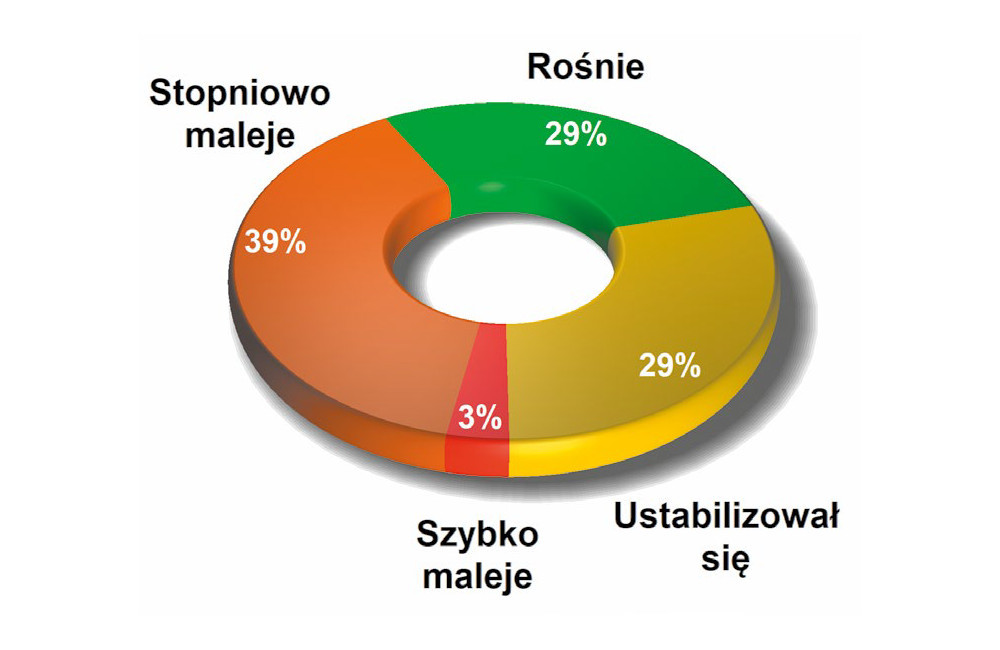

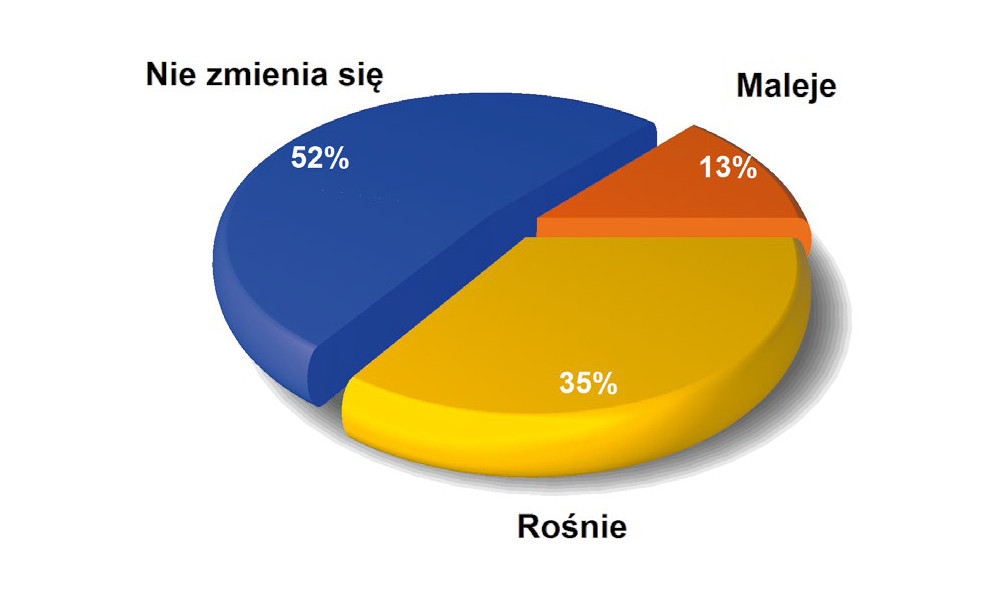

Zainteresowanie innowacjami w zasilaczach na rynku polski |

|---|

ZASILANIE GWARANTOWANE W WERSJI "MNIEJSZEJ"

Pojęcie "zasilanie gwarantowane" odnosi się w uproszczeniu do systemów, w których zanik głównego napięcia sieci energetycznej nie prowadzi do wyłączenia systemu. Zwykle takie zasilanie jest realizowane za pomocą zasilacza UPS, który jest specjalizowaną przetwornicą z akumulatorem, zdolną do podtrzymania napięcia sieci. Drugi popularne rozwiązanie to zasilacz napięcia stałego, który ma na wyjściu dodany akumulator podtrzymujący stałe napięcie wyjściowe. Jest to zasilacz buforowy, który typowo dostarcza 12 V napięcia stałego i współpracuje z kwasowo-ołowiowym akumulatorem żelowym.

W ostatnim okresie na rynku pojawiają się zasilacze, których funkcjonalność znajduje się pomiędzy tymi UPS-ami i zasilaczami buforowymi. Pozwalają one dołączyć akumulator i stworzyć w razie potrzeby podtrzymanie napięcia wyjściowego. Inne rozwiązania zasilaczy tego typu zawierają superkondensatory zapewniające podtrzymanie zasilania, dzięki czemu mają dużą trwałość i pracują w szerszym zakresie temperatur. Takie specjalistyczne zasilanie gwarantowane zyskuje na popularności, bo z jednej strony rośnie liczba urządzeń wymagających podtrzymania zasilania (np. elementy infrastruktury teleinformatycznej, takie jak switche lub modemy), a z drugiej strony moc pobierana przez takie urządzenia jest coraz mniejsza. Nierzadko też wymagany czas podtrzymania zasilania nie musi być długi. Klasyczne UPS- y stają się tym samym dla nich "za duże". W takich sytuacjach akumulatory w zasilaczu buforowym zastępuje się dzisiaj superkondensatorami i to wystarcza. Czas podtrzymania jest zwykle znacznie mniejszy, ale tę niedogodność rekompensuje szeroki zakres temperatur pracy, niewielki ciężar, brak konieczności wymiany okresowej akumulatorów (a więc jest pełna bezobsługowość). Cena takich rozwiązań jest wyższa, ale w aspekcie długoterminowym inwestycja w takie rozwiązanie ma sens, tym bardziej, że akumulator zdolny do pracy w szerokim zakresie temperatur też wcale nie jest tani. Zasilacze z superkondensatorami to propozycja głównie do zastosowań w przemyśle i aplikacji instalowanych na zewnątrz budynków.

JEDNOSTKI O SPECJALNYM PRZEZNACZENIU

Zasilacz to produkt uniwersalny, ale na rynku coraz częściej producenci tworzą wersje specjalizowane – ukierunkowane na specyficzne zastosowania. Uwalniają one projektantów od konieczności dodawania dodatkowych układów pomocniczych, płytek realizujących specyfikę aplikacyjną, które zostają zaszyte wewnątrz obudowy. Takie specjalizowane wersje spełniają wymagania branżowe od strony elektrycznej i mechanicznej.

Są to wykonania aplikacyjne: do oświetlenia LED, do ładowania akumulatorów o stałym prądzie wyjściowym, wersje medyczne o wzmocnionej izolacji i małym prądzie upływu izolacji, wysokonapięciowe itd. W przypadku zasilaczy do LED stosowane są inne obudowy i złącza, takie, które są dopasowane do specyfiki montażu w oprawie oświetleniowej lub puszkach elektroinstalacyjnych. Obudowy takie są najczęściej hermetyczne.

Asortyment dostępnych na rynku zasilaczy poszerza się także o wersje wyposażone we wzmocnioną izolację o niskiej upływności. Do niedawna były one rzadkością i wykorzystywane tylko w aplikacjach medycznych, niemniej poszerzająca się oferta wskazuje, że takie jednostki trafiają także do aplikacji przemysłowych, precyzyjnej aparatury pomiarowej oraz rozbudowanych systemów, gdzie łączone są obwody na różnych potencjałach. W takich przypadkach zasilacz o wzmocnionej izolacji jest w stanie zapewnić stabilność i jakość działania układów pomiarowych. Problemy są coraz częstsze, bo nie zawsze zasilacz pracuje ze stabilnym obciążeniem, stabilną siecią energetyczną i uziemioną obudową. Duży prąd upływu może wywołać wzrost potencjału na wyjściu w stosunku do ziemi przy połączeniu do sieci dwoma przewodami i przy niewielkim obciążeniu, co może zakłócać działanie obwodów kondycjonujących, wejściowych przetworników itp.

Są też zasilacze dwukierunkowe, a więc takie, które są w stanie odwrócić kierunek konwersji energii i dostarczać zasilanie do wejścia z wyjścia. Inne rozwiązania to zasilacze czteroćwiartkowe, czyli takie, które mogą płynnie zmieniać funkcję z dostarczania energii do obciążenia na jej odbieranie (jak obciążenie elektroniczne). Takich rozwiązań pojawia się coraz więcej.

ELEKTROMOBILNOŚĆ

Bez względu na to, ile samochodów elektrycznych jest już w użyciu, ile ich będzie w najbliższych trzech latach i czy będą one produkowane w Polsce zgodnie z wolą polityków, elektromobilność jest ważnym trendem zmieniającym rynek zasilania już dzisiaj. To dlatego, że na samochodach elektrycznych świat się nie kończy i poza nimi jest wiele sprzętu o napędzie elektrycznym. Po stronie profesjonalnej wystarczy wymienić wózki magazynowe, w tym rozwiązania działające autonomiczne, roboty oraz rozwiązania transportowe mniejszego kalibru, takie jak skutery, hulajnogi, rowery. Te wszystkie urządzenia są zasilane z akumulatorów i muszą mieć ładowarki, czyli specjalne zasilacze.

Szczegóły realizacji procesu ładowania zależą od konkretnego rozwiązania, ale zawsze podstawowym komponentem ładowarki jest zasilacz. Ładowarka powinna być mała i szybka, bo wszystkim użytkownikom zależy na szybkim ładowaniu, a wiele aspektów aplikacyjnych i ekonomicznych jest wprost powiązane z tym, czy sprzęt będzie można szybko naładować.

Wysoko sprawny zasilacz pozwala zapewnić dużą moc wyjściową przy niewielkich wymiarach i dlatego trend elektromobilności będzie pozytywnie oddziaływał na rynek zasilania w kolejnych latach. Co więcej, wydaje się, że ładowarki takie będą budowane w oparciu o najnowsze rozwiązania technologiczne, a więc materiały magnetycznie i podzespoły indukcyjne oraz półprzewodniki z GaN. Wskazują na to konstrukcje, które się pojawiają na rynku. Ładowarki bazujące na tranzystorach z GaN zapewniają wyraźnie widoczną dla użytkownika większą gęstość mocy. Małe rozwiązania, wielkości pudełka zapałek do telefonów, osiągają 25 W, odrobinę większe do laptopów ok. 60‒80 W, zasilacze o mocy jednego kilowata są dzisiaj wielkości szkolnego piórnika.

ZASILACZE DO SYSTEMÓW POMIAROWYCH, BADAŃ I MIERNICTWA

Zasilacze to też jednostki laboratoryjne wykorzystywane przy pomiarach do zasilania sprzętu i zadawania sygnałów wymuszeń. Są wykorzystywane także w sferze produkcji, podczas testowania jakości i badań automatycznych, gdzie pełnią funkcję podobną do generatorów arbitralnych dużej mocy, generatorów zaburzeń w sieci zasilania oraz części testerów odpowiedzialnej za badania wytwarzanych urządzeń pod kątem współpracy ze źródłem zasilania. Zasilacze takie pozwalają na swobodne programowanie parametrów wyjściowego przebiegu "w locie" i tym samym są wygodnym elementem systemów pomiarowych i testerów ATE. Jednostki te różnią się głównie tym, że pozwalają na regulację napięć i prądów wyjściowych w szerokim zakresie (np. czterech ćwiartkach układu współrzędnych z płynnym przejściem przez zero w każdym kierunku), mają bardzo dobre parametry stabilizacji i czystości napięcia wyjściowego, zawierają często kilka niezależnych kanałów wyjściowych i mogą być sterowane z komputera, pełniąc funkcję elementu systemu pomiarowego.

LICZNE UŻYTECZNE DODATKI

Użyteczna funkcjonalność, jaka pojawia się dzisiaj często w zaawansowanych jednostkach zasilających, obejmuje takie dodatki, jak np. możliwość regulacji wyjściowego napięcia w niewielkim zakresie trymerem, po to, aby skompensować spadek napięcia na przewodach wyjściowych. Do tego samego celu służą zwielokrotnione zaciski wyjściowe lub też możliwość podłączenia dwóch dodatkowych przewodów pomiarowych bezpośrednio do zacisków obciążenia (tzw. połączenie kelwinowskie czteroprzewodowe). Taki sposób zapewnia znakomite parametry napięcia wyjściowego (statyczne i dynamiczne) w zasilaczach dużej mocy i o niskim napięciu wyjściowym, np. 5 V/100 A.

Kolejne przydatne funkcje to wyjście sygnalizacji zaniku zasilania, gotowości zasilacza, możliwość chwilowego przeciążania, która przydaje się przy zasilaniu odbiorników takich jak silniki indukcyjne lub promienniki halogenowe. Pozwala to uniknąć przewymiarowana konstrukcji i kupowania zasilacza ze sporym zapasem mocy. Wiele aplikacji potrzebuje jej przez krótki czas, a przykładem mogą być zawory, rygle oraz siłowniki i w takiej sytuacji niewielka jednostka zasilająca z możliwością przeciążania jest w rozrachunku znacznie tańsza. Przeciążanie najczęściej bazuje na wbudowanych superkondensatorach.

Od strony układowej zasilacze wyposaża się dzisiaj we wszechstronne układy zabezpieczające, rozbudowane filtry wejściowe, sterowniki zapewniające sygnalizację stanu zasilacza i podobne obwody ochronne na tyle skuteczne, że awaria na skutek przeciążenia, stanu nieustalonego lub zwykłego błędu podczas montażu instalacji staje się praktycznie niemożliwa.

SZEROKI ZAKRES NAPIĘCIA WEJŚCIOWEGO

Pięć lat temu nowością na rynku zasilania impulsowego były wersje pozwalające na zasilanie dowolną wartością napięcia sieciowego występującą na całym świecie, a więc od ok. 86 do 240 VAC, w tym także odpowiadającą jej wartością napięcia stałego. Nietrudno zauważyć, że szybko stało się to standardem i dzisiaj w zasadzie ogromna większość zasilaczy małej i średniej mocy nie wymaga przełączania zakresu zasilania. Wyjątkiem są wersje zdolne do pracy jeszcze w szerszym zakresie, a więc także z zasilaniem napięciem międzyfazowym (ok. 400 VAC), niemniej ich obszar aplikacyjny jest znacznie ograniczony.

Złącza silnoprądowe – awangarda techniki łączeniowej

Złącza silnoprądowe to jedna z najważniejszych grup asortymentowych wśród komponentów elektromechanicznych. Elementy te zajmują także wysoką pozycję w całej ofercie szeroko pojętej techniki łączenia, z uwagi na wysoką przenoszoną moc i wiążące się z nią problemy, z którymi mierzą się ich wytwórcy. W miarę jak skala produkcji przemysłowej w Polsce rośnie, sprzętu i urządzeń technicznych potrzeba coraz więcej, przez co rośnie też zapotrzebowanie na elementy połączeniowe.

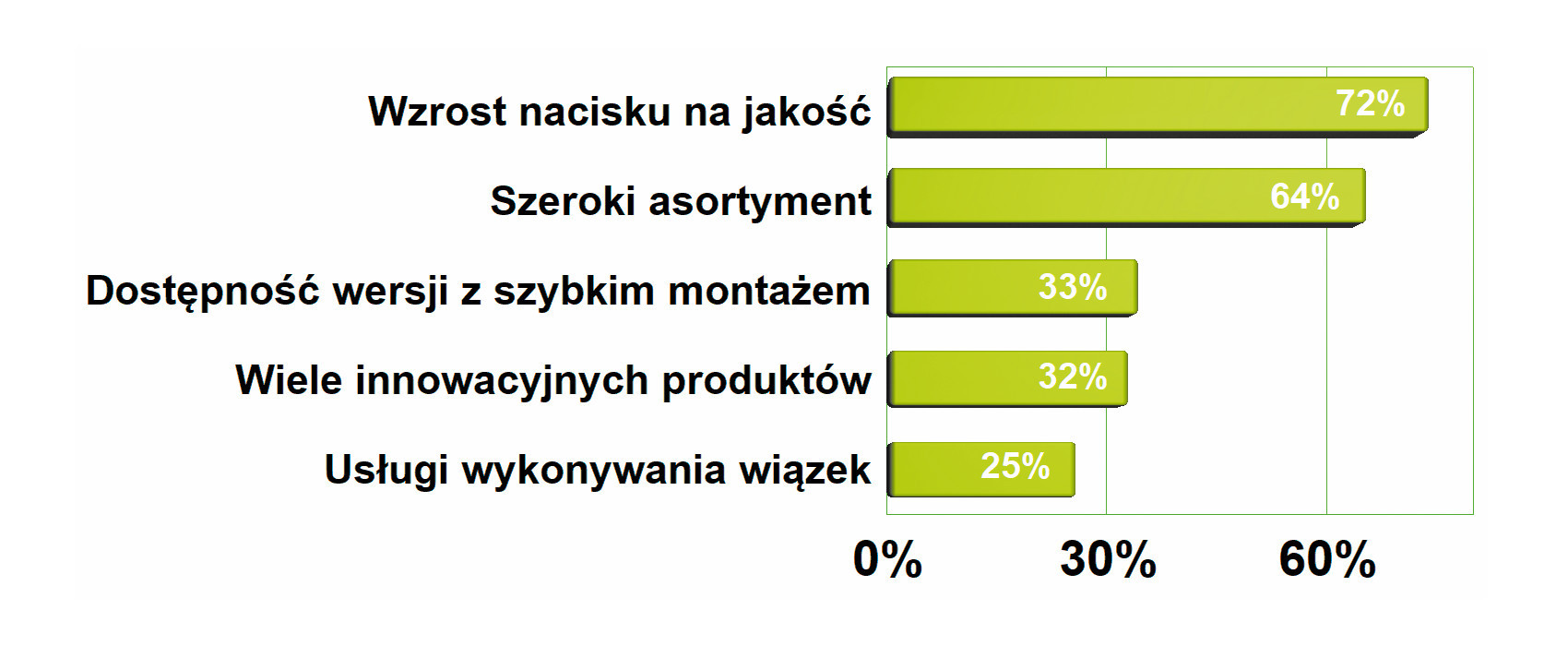

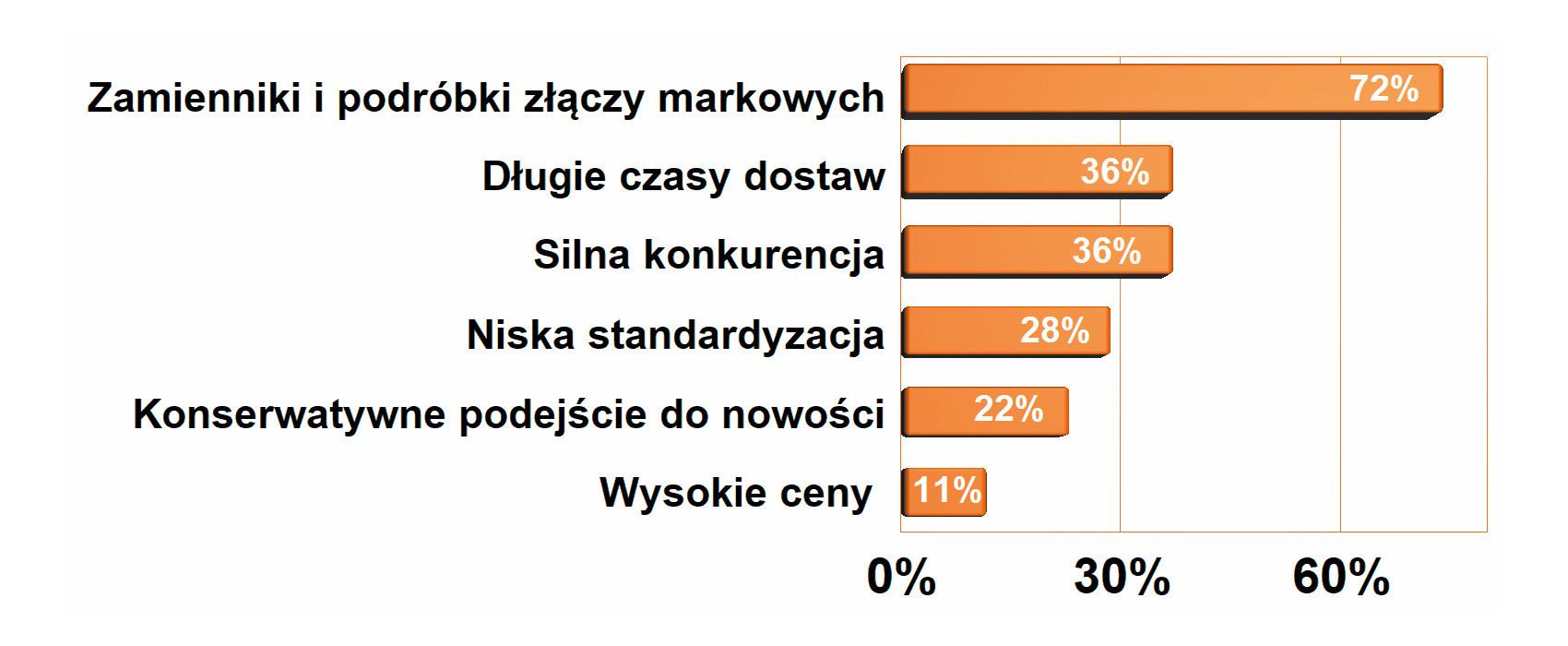

Nie bez znaczenia jest też to, że elektronika odgrywa coraz większe znaczenie w postępie technicznym, a jej istotność w aplikacjach dużej mocy szybko się zwiększa. W konsekwencji rozwijającego się rynku krajowego poprawia się też oferta złączy pod kątem szerokości asortymentu, dostępności elementów wysokiej jakości od czołowych firm europejskich i złączy produkowanych w krajach azjatyckich. Wydaje się, że główna oś rywalizacji o klienta w tym obszarze jest między renomowanymi markowymi firmami zlokalizowanymi w Europie i producentami mniej znanymi spoza jej obszaru.

Coraz wyższe wymagania klientów spychają na margines kiepskie jakościowo elementy, rynek powoli oczyszcza się też z niskiej jakości zamienników, bo koszty napraw przekraczają uzyskane korzyści ich przy zakupie. W ten sposób jeden z najważniejszych problemów rynku, związany z tanimi złączami o kiepskiej jakości, staje się mniej dokuczliwy i oddziałujący na relacje z klientami, z czym jeszcze parę lat temu był widoczny problem. Dzisiaj renomowani producenci i dystrybutorzy skupiają się raczej na zapewnieniu dostępności elementów i wsparcia technicznego, bo są to obszary, gdzie wysiłek może przynieść długofalowe korzyści biznesowe.

ZJAWISKA TECHNICZNE W ZŁĄCZACH SILNOPRĄDOWYCH

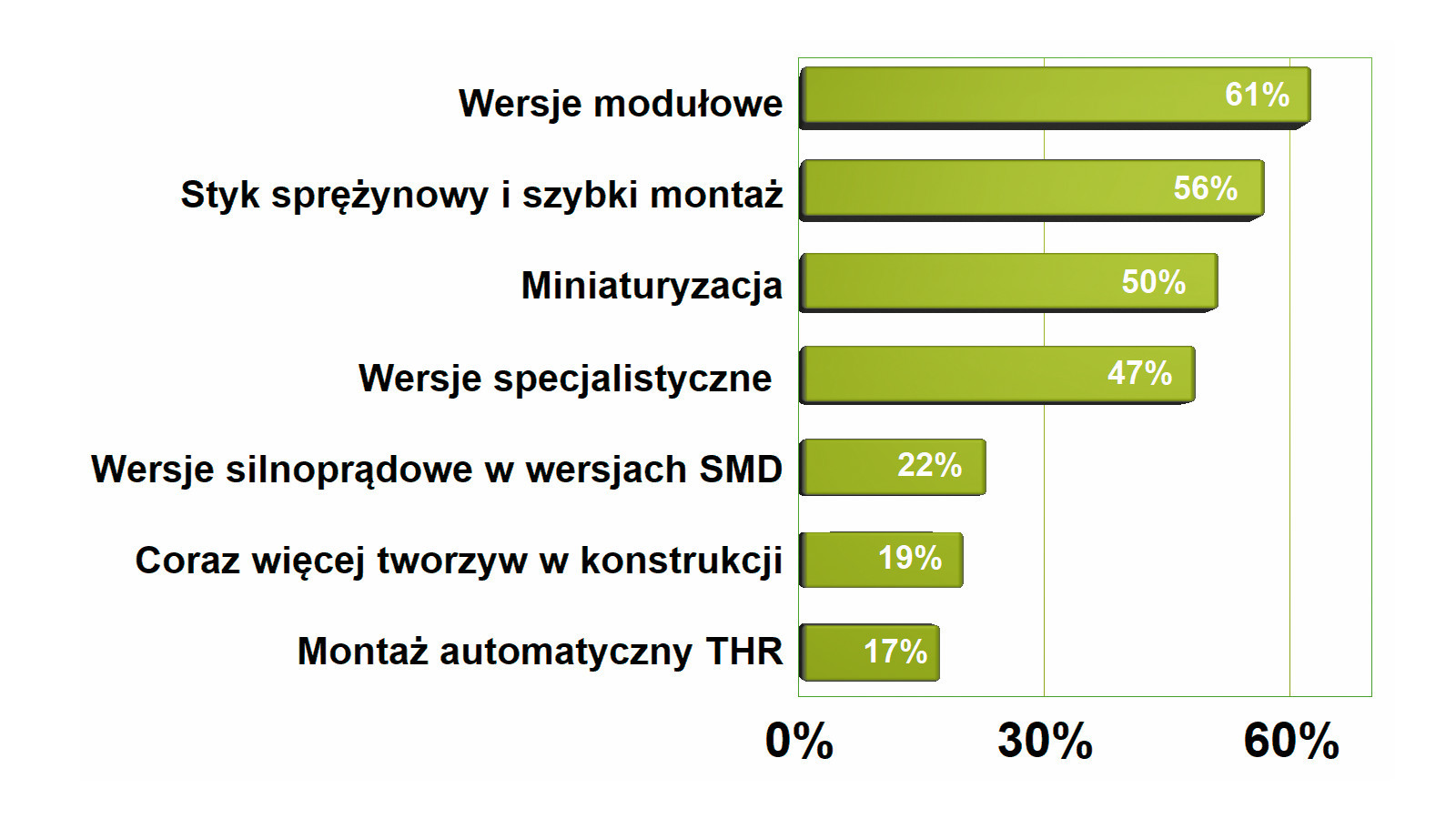

Rozwój techniczny w złączach silnoprądowych przebiega w tym obszarze podobnymi ścieżkami, jak w przypadku innych elementów. Bezsprzecznie zmiany kierują się ku kompaktowości i miniaturyzacji, czego skutkiem są też wersje kabel-płytka dostępne do montażu powierzchniowego oraz THR (Through Hole Reflow), jak również elementy do montażu kabla o niewielkich wymiarach i gęstych rastrach pinów. Obciążalność złączy w przeliczeniu na objętość powiększa się głównie na skutek stosowania lepszych materiałów na styki i tworzyw konstrukcyjnych obudowy złącza. Coraz szerzej wykorzystywane są tworzywa kompozytowe, bo zapewniają wysoką stabilność mechaniczną obudowy w szerokim zakresie temperatur. Dzięki temu nawet zwiększone nagrzewanie styków nie powoduje deformacji.

Drugim obszarem pozwalającym na miniaturyzację jest konstrukcja styków. Producenci sporo eksperymentują tutaj z materiałami i pokryciami takimi, aby niewielki pin był jednocześnie wytrzymały mechanicznie oraz elastyczny. Zwiększane jest pole styku na wszystkie płaszczyzny i na całą długość pinu, stosowane są wielosprężynowe systemy docisku części męskiej i żeńskiej, po to, aby zapewnić pewny kontakt na dużej powierzchni.

Ostatnim ważnym zagadnieniem związanym z miniaturyzacją są pokrycia styków. Z reguły piny, a więc konstrukcyjne elementy styku złącza, wykonuje się z materiałów zapewniających wysoką odporność mechaniczną, natomiast za kontakt elektryczny odpowiada materiał pokrycia. Celem jest zapewnienie niskiej rezystancji przy dużej odporności na ścieranie, utlenianie i wypalanie materiału na skutek iskrzenia.

Liczba problemów, z jakimi mierzą się producenci złączy jest naprawdę duża, gdyż nie chodzi o to, aby uzyskać jednorazowo dobry wynik, ale o stabilne parametry połączenia w czasie i różnych warunkach środowiskowych. W tym obszarze kryją się też największe różnice między tanimi złączami słabej jakości a rozwiązaniami z górnej półki.

MODUŁOWOŚĆ W ZŁĄCZACH

Coraz więcej urządzeń technicznych ma konstrukcję modułową i zawiera bloki funkcjonalne, które są łączone w jednej obudowie za pomocą dobranych komponentów połączeniowych. Łatwiejszy montaż i demontaż zapewniane są przez logiczny podział aplikacji na części, systemy szybkich połączeń (niewymagających stosowania narzędzi). Przynosi to oszczędności w serwisie, utrzymaniu ruchu, instalacji, modernizacji.

Podobne procesy są widoczne po stronie złączy, w których asortymencie modułowość jest coraz bardziej widoczna. Polega ona na podziale konstrukcji na elementy składowe i zapewnieniu możliwości komponowania finalnego wyrobu z zestawu części składowych, do których zalicza się w minimalnym zakresie obudowa i wkładka z pinami. W szerszym zakresie dochodzą jeszcze możliwości kompozycji wkładki z pinami tak, że można dobierać liczbę i typy znajdujących się w niej styków, elementy wyprowadzenia kabla, ekrany i uszczelnienia, akcesoria itd.

Złącza modułowe to dobre rozwiązanie zarówno dla klientów, jak i producentów, bo pozwala ominąć problemy wynikające z bardzo małej standaryzacji tych produktów. Dla producentów oznacza to mniejszą liczbę pozycji w ofercie, dla klienta lepsze ceny i lepszą dostępność wynikające ze skali produkcji oraz kosztów logistyki. Nic dziwnego, że z roku na rok wersji modułowych na rynku przybywa.

SZYBKI MONTAŻ

Wiele instalacji realizowanych jest w niekorzystnych warunkach: na zewnątrz budynków, przy słabym oświetleniu, w niewygodnej pozycji, przez co ryzyko błędu jest spore. Oczywiście wiele złączy z tego obszaru pozwala na zakodowanie połączenia, czyli na zamontowanie zabezpieczenia mechanicznego uniemożliwiającego włożenie złej wtyczki w gniazdo, niemniej kodowanie nie zapobiega możliwości uszkodzenia elementów złącza i nie zawsze jest możliwe.

Kolejny obszar ryzyka to konieczność montażu przewodu w złączu w trudnych warunkach, np. podczas pracy na wysokości. Brak konieczności korzystania z narzędzi, proste czynności sprowadzające się do wsunięcia końcówki przewodu w otwór szybko zyskują tutaj uznanie.

Zacisk sprężynowy będący podstawą takiego montażu nie jest na rynku nowością, bo bazujące na nim złącza są już dostępne mniej więcej od dekady, ale w zakresie rozwiązań silnoprądowych dopiero od niedawna, bo konieczne było dopracowanie szczegółów rozwiązań, aby gwarantowały one wysokiej jakości połączenie. W obwodach zasilanych z sieci było to łatwiejsze do zapewnienia, bo gdy styk się pogarszał, powstawał łuk, który czyścił połączenie, wypalając tlenki. W obwodach niskonapięciowych producenci złączy proponują inne rozwiązania szybkiego montażu, jak na przykład takie bazujące na dźwigni. Cały czas popularne są również złącza zaciskane. Ich potencjał jest najbardziej widoczny w aplikacjach niskonapięciowych, np. motoryzacji, gdzie połączenie zaciskane uważane jest za bardzo odporne na narażenia mechaniczne oraz środowiskowe i przy tym tanie.

Złącza silnoprądowe – definicjaMimo że złącza silnoprądowe stanowią wyraźnie wydzieloną grupę produktową, nie ma ścisłej definicji pozwalającej na jednoznaczną ich kategoryzację i przyporządkowanie do takiego obszaru aplikacyjnego. Nie da się arbitralnie ustalić jakie prądy i napięcia są już silne, a jakie nie, bo za każdym razem odpowiedź trzeba rozbudować o dalsze właściwości: rozmiar, raster, liczbę pinów, odporność środowiskową i podobne kryteria. Dlatego w niniejszym opracowaniu przyjmowana jest elastyczne podejście, w ramach której do grupy tej kwalifikowane są elementy, w których parametry charakteryzujące obciążalność (maksymalny prąd przewodzenia, dopuszczalne napięcie znamionowe, moc) są ważne, wymieniane na początku oraz traktowane jako istotna część ich charakterystyki. To także takie elementy, które zdaniem producenta przeznaczone są do łączenia obwodów mocy. Nie zagłębiamy się w to, czy np. 5 A to już "silny" prąd, bo jak doskonale inżynierowie wiedzą, "to zależy". |

ZŁĄCZA KABLOWE I DO PCB

Złącza silnoprądowe najczęściej występują w wersji kabel-kabel lub kabel-panel, gdzie jedna część jest mocowana do obudowy. Elementy te mogą być okrągłe lub prostokątne, zawierać różną liczbę pinów i mieć różną obciążalność oraz sposób montażu przewodu. Dostępne są w wersji prostej i kątowej, z metalu oraz tworzywa. Można śmiało powiedzieć, że na rynku da się kupić praktycznie każdą kombinację wielkości i rodzaju tych elementów. Drugą część asortymentu tworzą złącza do montażu na płytce drukowanej, a więc takie, gdzie jedna z części jest przylutowana (w procesie SMT/ THT/THR), a druga służy do montażu kabla. Wlutowane w płytkę złącze w takim przypadku jest jeszcze zwykle mocowane do obudowy urządzenia, co zapewnia stabilność mechaniczną połączenia istotną zwłaszcza przy elementach do montażu powierzchniowego.

Niemniej warto zauważyć, że w warunkach krajowych znaczenie złączy silnoprądowych montowanych automatycznie jest niewielkie, gdyż są one kierowane do aplikacji masowych. W produkcji prowadzonej w średniej skali lub jednostkowej, złącze z końcówkami do SMD lub THR nie ma uzasadnienia, bo nie przynosi obniżki kosztów, a wymaga spełnienia wielu wymagań podczas montażu.

TERMINAL BLOKI

Kolejną dużą grupą złączy, zwłaszcza w aplikacjach elektronicznych, są terminal bloki. Są to modułowe złącza kabel-PCB z zaciskiem śrubowym lub sprężynowym. Terminal bloki występują w wersjach kątowych i prostych, dwuczęściowych rozłączalnych, rozwiązaniach pozwalających zamontować więcej niż jeden przewód w styku. Są wersje do SMT, uszczelnione lub z ekranem elektromagnetycznym.

Terminal bloki znaleźć można w ofertach wielu producentów, zarówno u tanich chińskich dostawców, jak u wiodących światowych producentów, gdyż są to produkty o dużej uniwersalności. Można powiedzieć, że elementy te stanowią większą część funkcjonujących na rynku rozwiązań, gdzie do płytki drukowanej trzeba dołączyć przewody. Wykorzystuje je branża oświetleniowa, producenci zasilaczy, sterowników i regulatorów, automatyka budynkowa, producenci systemów alarmowych, domofonowych, urządzeń kontrolnych, AGD i wielu innych. Obszar aplikacyjny jest bardzo szeroki i widać, że z czasem znaczenie wersji zapewniających szybki montaż przewodów, a także wersji rozłączalnych, takich, w których można rozpiąć złącze jednym ruchem, bez mozolnego rozpinania pojedynczych kabli jest coraz większe. Innymi słowy, terminal bloki dzisiaj to już zaawansowane systemy połączeniowe i produkty dopracowane w szczegółach. Ich obciążalność prądowa sięga kilkudziesięciu amperów na końcówkę, co pokazuje, że mogą być stosowane w wielu różnych aplikacjach.

ZŁĄCZA NA SZYNĘ DIN I DO OBUDOWY

Poza wymienionymi typami w zakresie złączy silnoprądowych na rynku mamy jeszcze komponenty przeznaczone do montażu na szynie DIN, które wykorzystuje się do tworzenia instalacji przemysłowych, np. okablowania systemów montowanych w skrzynkach instalacyjnych, obudowach, szafach technicznych, rozdzielniach itp. W takich systemach konieczne jest połączenie ze sobą w działający system komponentów takich jak zasilacze, przekaźniki, sterowniki, zabezpieczenia, wyłączniki, sygnalizatory i podobne. Wiele sygnałów musi zostać rozgałęzionych, bo połączenia punkt-punkt stanowią jedynie ułamek całości instalacji. Złącza na szynę pozwalają na wygodne okablowanie i mają postać wąskich płaskich elementów, które można składać w większe zespoły, podobnie jak spaja się terminal bloki. Mają też możliwość wewnętrznego połączenia biegunów, co ułatwia tworzenie dystrybucji zasilania. Szyna DIN stanowi podstawę mechaniczną takiej całości.

W aplikacjach przemysłowych produkty na szynę są na rynku cenione, bo pozwalają szybko i bez konieczności korzystania ze specjalistycznych narzędzi stworzyć system, instalację lub nawet całą aplikację. Zapewniają niezbędną indywidualność, bo każdy projekt może być inny, możliwość modernizacji i zmian w dowolnym momencie. Nie ma też konieczności tworzenia specjalnego chassis, montowania i przykręcania do niego elementów. Szyna pozwala ponadto na utrzymanie porządku i czytelności instalacji, co ma ogromne znaczenie dla utrzymania ruchu i serwisu.

Mimo unifikacji wymiarów i konstrukcji wymuszanej przez montaż na szynie złącza tego typu dostępne są w różnych wersjach pod względem obciążalności, obsługiwanych średnic przewodów, typu zacisku itp. Warto zauważyć, że w tym obszarze kładzie się spory nacisk nie tylko na łatwość tworzenia instalacji, ale także na prostotę i czytelność obsługi technicznej. Oznaczniki tekstowe i symboliczne, kolorowe obudowy, przyciski ułatwiające demontaż, punkty pomiarowe pozwalające na wsunięcie kabla pomiarowego, obudowy, mostki, kontrolki – razem tworzą bardzo często spójny system połączeń charakterystyczny dla danego producenta.

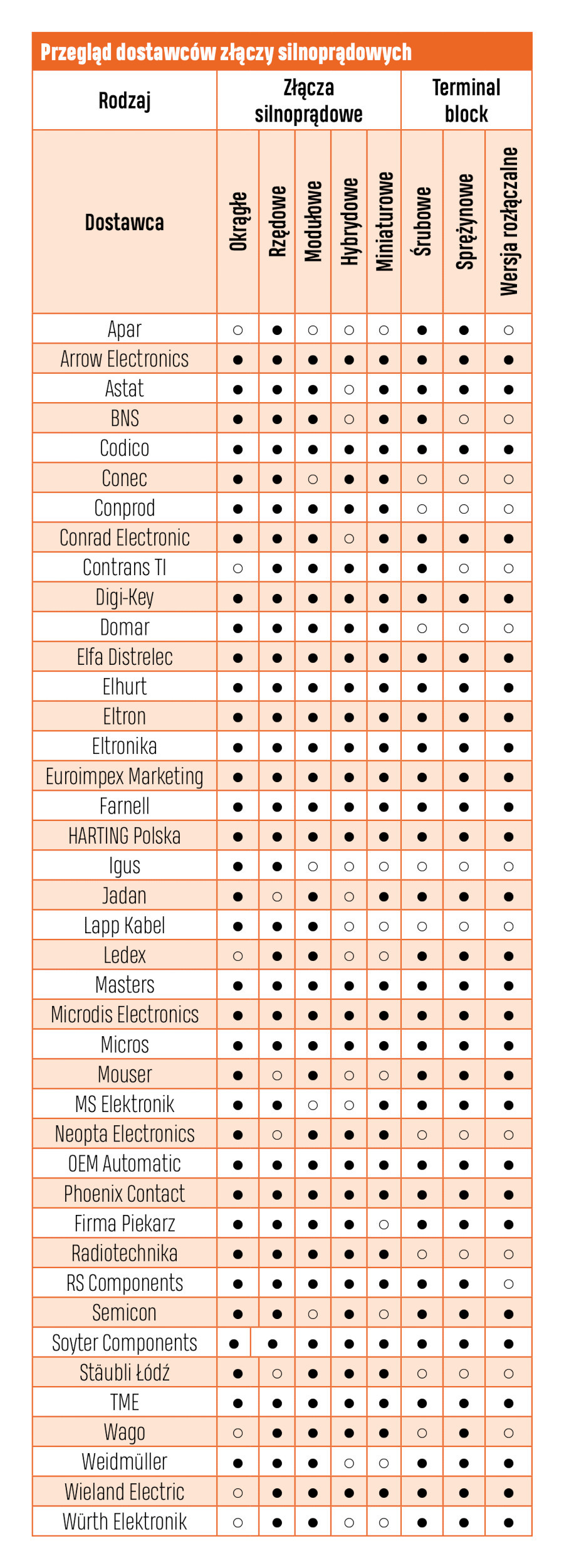

DOSTAWCY ZŁĄCZY SILNOPRĄDOWYCH

Dostawców oferujących złącza silnoprądowe można podzielić na kilka wydzielonych grup, wśród których wyraźnie widać krajowe przedstawicielstwa i oddziały firm zagranicznych. W ogromnej większości są to firmy ukierunkowane na branżę przemysłową i zajmują się one nie tylko wytwarzaniem złączy, ale szerokiego spektrum urządzeń i komponentów. Większość z nich to przedsiębiorstwa działające w skali globalnej, o szerokich i przekrojowych ofertach, w których można znaleźć wszystkie typy omawianych złączy. Krajowe oddziały obsługują międzynarodowy biznes zlokalizowany w Polsce, np. producentów EMS, firmy motoryzacyjne, producentów wiązek kablowych oraz nadzorują i rozwijają rynek dystrybucji (hurtownie, firmy handlowe). W naszym zestawieniu są to HARTING, Phoenix Contact, Wago Elwag, Conec, igus, Stäubli, Weidmüller, a także Wieland Electric, LappKabel. Jak widać, jest to całkiem duże grono, które z pewnością ma potencjał do tego, aby dyktować warunki.

Drugą wyraźnie zarysowaną grupę tworzą dystrybutorzy o szerokim profilu, a więc firmy katalogowe, jak TME, Elfa Distrelec, Farnell, Conrad Electronic, RS Components, Mouser. To także duże firmy hurtowe jak Micros, Elhurt, Masters, Arrow Electronics, Firma Piekarz, Soyter Components, w ofertach których złącza stanowią istotną część ofert.

W dalszej kolejności na rynku wyróżnić można dystrybutorów specjalizowanych, których aktywność koncentruje się na wybranych tematach technicznych i liniach produktów z obszaru elektroniki, jak na przykład Eltronika, Microdis Electronics, Contrans TI, Payda Electronics, Neopta Electronics oraz Radiotechnika Marketing. W obszarze automatyki lub firm działających na styku branż elektroniki i automatyki dostawcami złączy są firmy takie jak Apar, OEM Automatic, Eltron.

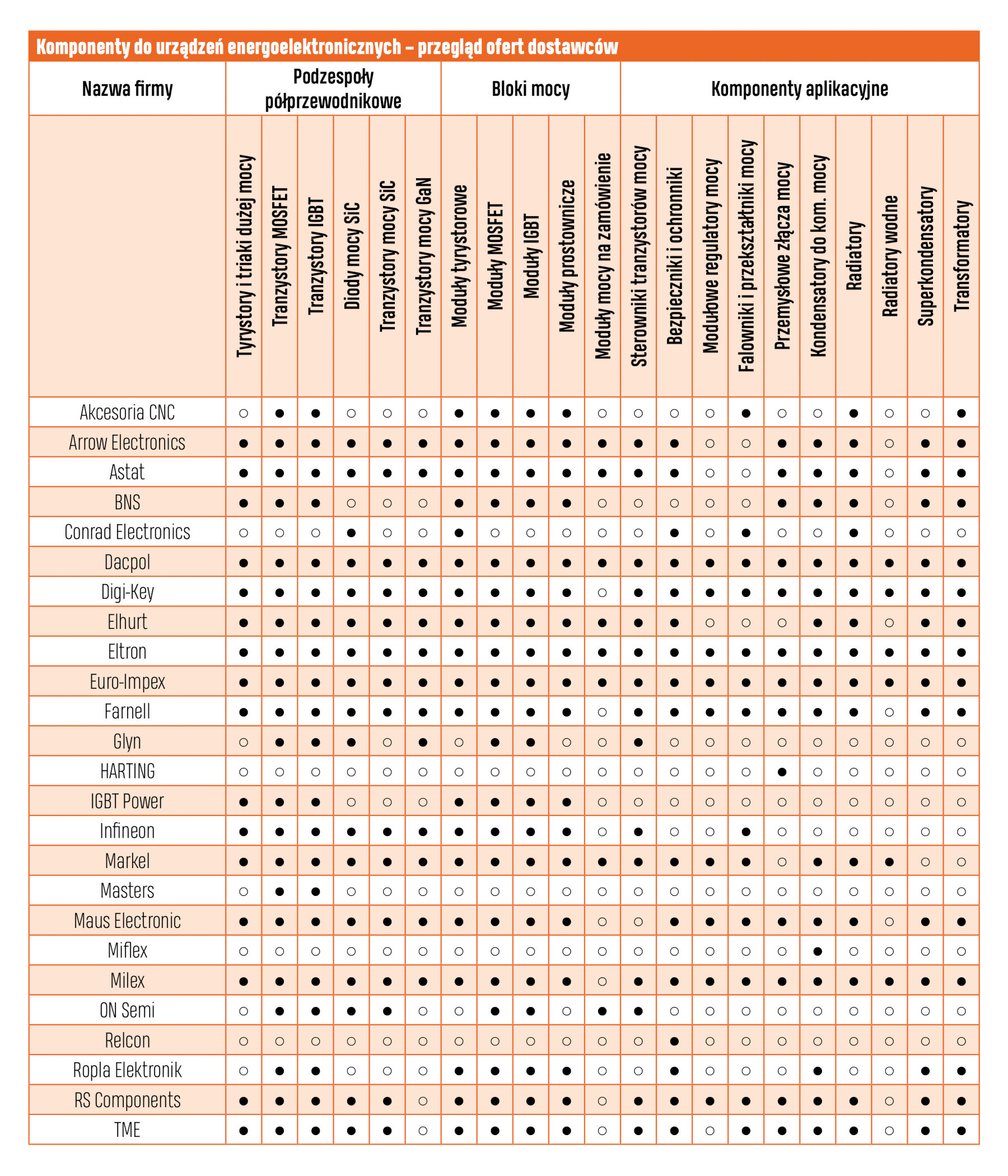

Podzespoły dla energoelektroniki – SiC i GaN zmieniają status quo

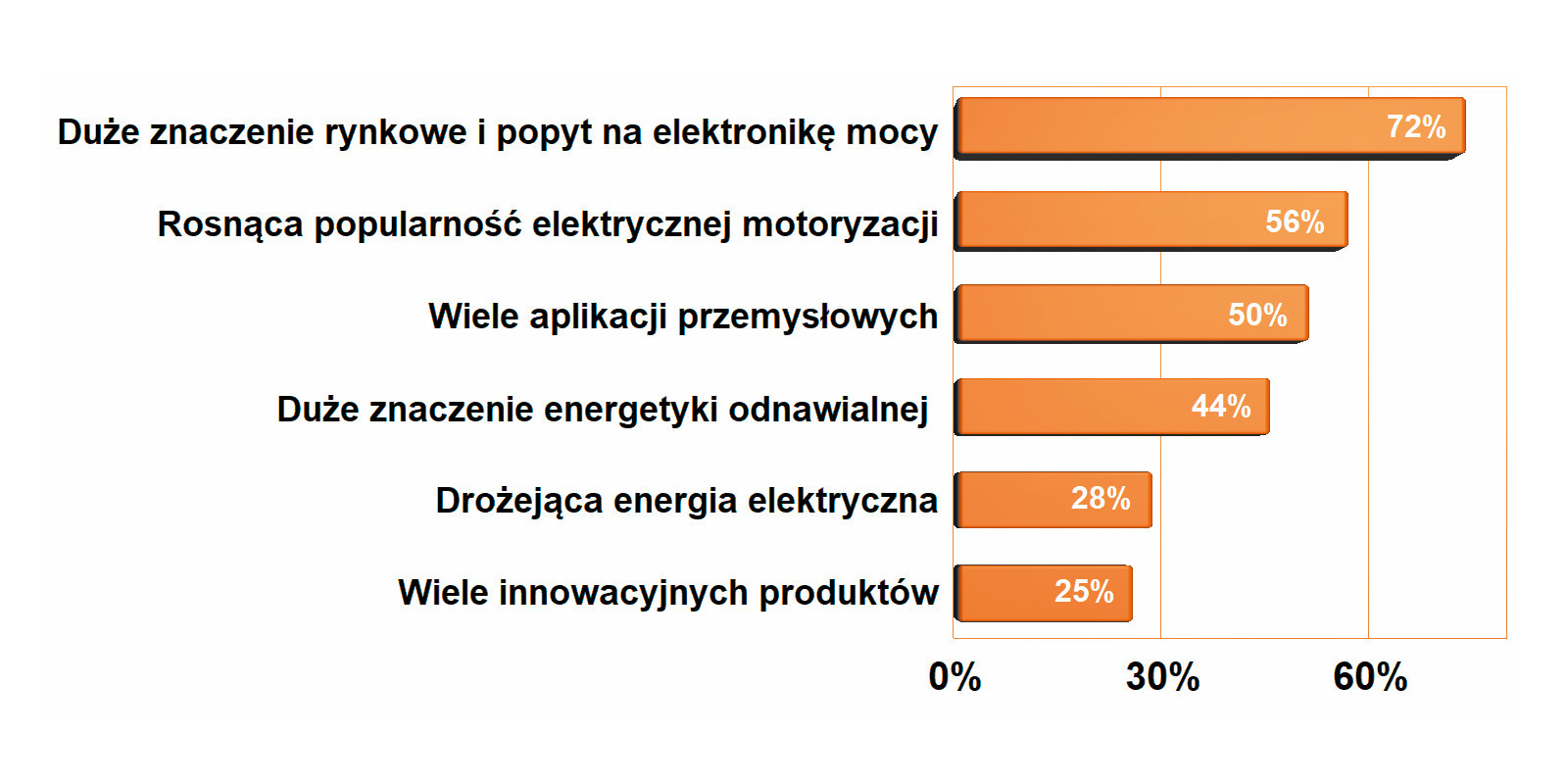

Elektronika dużych mocy, czyli energoelektronika, to sektor, który w ostatnich latach bardzo szybko się rozwija. Powodów jest co najmniej kilka, a za najważniejszy można zapewne uznać dużą liczbę nowych aplikacji, które na niej bazują, jak elektryczna motoryzacja, transport szynowy, aplikacje energii odnawialnej lub indukcyjne systemy grzewcze. Elektronizacji podlega też wytwarzanie i dystrybucja energii elektrycznej, napędy silników dużej mocy w maszynach przemysłowych i wiele innych podobnych obszarów.

W takich zastosowaniach elektronika mocy jest w stanie zapewnić wysoką sprawność regulacji i konwersji energii, wysoką niezawodność działania i dużą odporność na przeciążenia. Nowoczesne rozwiązania zasilające i sterujące, bazujące na podzespołach półprzewodnikowych dużej mocy, jak na przykład falowniki, konwertery i przetwornice, mają też niewielkie rozmiary, dzięki czemu dają się łatwo integrować w maszynach i urządzeniach. W energoelektronice liczy się ponadto wysoka funkcjonalność, która na przykład w napędach silników jest równoważna zapewnieniu płynności działania, możliwości zdalnej kontroli i sterowania. Jest to po prostu nowoczesność.

W Polsce rynek podzespołów dużej mocy rozwija się w takt dużych inwestycji przemysłu energetycznego, transportu kolejowego, w rytm kolejnych modernizacji fabryk, czyli innymi słowy, wraz z dużymi projektami, realizowanymi nierzadko jako wieloletnie plany finansowane z funduszy strukturalnych. Dostawcą dla przemysłu, automatyki i energetyki jest lub chce być duża część krajowych firm handlowych. W kolejnych latach drożejąca energia elektryczna, wymagania jakościowe, jakie stawia się przed współczesnymi aplikacjami, zapewnią też niezłe perspektywy rozwojowe na przyszłość, bo zainteresowanie nowymi, energooszczędnymi technologami będzie się zwiększać.

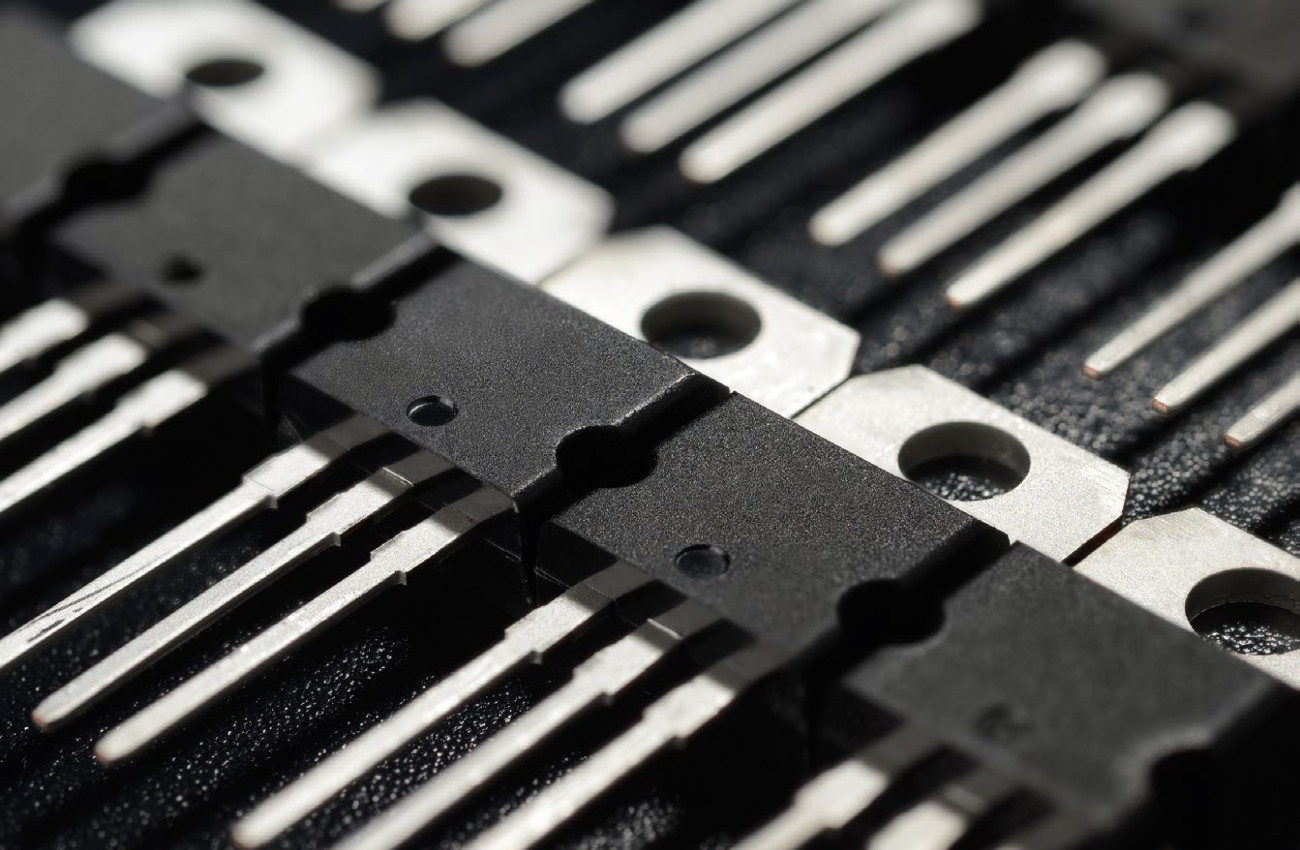

PÓŁPRZEWODNIKI, CZYLI GŁÓWNIE TRANZYSTORY

Kluczowymi podzespołami elektroniki dużej mocy są półprzewodniki, a więc głównie diody i tranzystory. Znaczenie tyrystorów wyraźnie maleje, bo postęp technologiczny w zakresie tranzystorów mocy jest tak imponująco szybki, że do nowych projektów tyrystorów się już praktycznie nie wykorzystuje. Mają one zbyt duże straty mocy i nie dają takiej swobody komutacji prądu jak tranzystor.

Jeszcze dekadę temu regulatory, softstarty i przełączniki dużej mocy, które uruchamiały na przykład proces zgrzewania, budowane były z reguły za pomocą tyrystorów i przez to z konieczności opierały się na fazowej regulacji mocy. Dzisiaj tam, gdzie się tylko da, wykorzystuje się tranzystory IGBT lub MOSFET, które dają większe możliwości scalania i tym samym zapewniają równoległe łączenie bloków mocy. W stosunku do tyrystorów ich sterowanie jest prostsze i wymaga mniejszej energii. Niemniej najważniejsze, że są to elementy znacznie szybsze, a więc pozwalające załączać napięcie do obciążenia z kilohercową szybkością. Oprócz wielu możliwości w zakresie sterowania pozwala to na redukcję wielkości filtrów przeciwzakłóceniowych i pozwala lepiej kontrolować stany nieustalone. Oczywiście parametry najsilniejszych tyrystorów nadal znacznie przekraczają to, co oferują IGBT, ale gdy się policzy cały koszt urządzenia, te różnice są już zwykle niewielkie.

MOSFET I IGBT

W wymienionych powodów we współczesnej elektronice mocy wykorzystuje się praktycznie tylko tranzystory MOSFET i IGBT. Tranzystory bipolarne przegrywają z nimi w zakresie wymaganej mocy sterującej, która jest za duża, bo ich wzmocnienie prądowe przy dużym obciążeniu jest niewielkie.

MOSFET-y mają bardzo małe straty związanie z przewodzeniem, a więc niską rezystancję kanału w stanie włączenia dla wersji o małym napięciu znamionowym (do ok. 50 V). W elementach na wyższe napięcia, do 800 V, rezystancja kanału w stanie przewodzenia jest już niestety znacząco większa. Stąd najczęściej MOSFET-y są stosowane w obwodach niskonapięciowych, a w aplikacjach zasilanych z wyprostowanego napięcia sieci używane są jedynie dla małej i średniej mocy wyjściowej.

Z kolei tranzystory IGBT są domeną aplikacji o wyższym napięciu zasilania, gdyż zawarty w ich strukturze tranzystor bipolarny jako element wyjściowy ma przy dużych prądach obciążenia i wysokich napięciach znamionowych lepsze parametry związane ze stratami na przewodzenie (niewielkie napięcie nasycenia).

W takim zakresie MOSFET-y mają już wyraźnie gorsze parametry, np. RDS(ON) rzędu pojedynczych omów. Dla układów dużej mocy bywa to dyskwalifikujące, natomiast bez problemu udaje się nabyć znakomite IGBT na napięcie 1‒1,5 kV. Innymi słowy w zakresie półprzewodników mocy istnieje coraz wyraźniejszy podział aplikacyjny rynku wyznaczany przez najlepsze zakresy parametrów elementów mocy.

KOMPONENTY SIC I GAN

Z pewnością półprzewodniki, węglika krzemu nie są już na rynku nowością, ale faktem jest, że w ostatnich pięciu latach ich popularność bardzo się zwiększyła. Przed 2010 rokiem tylko firma Cree dostarczała na rynek materiały podłożowe z SiC. Obecnie, głównie za sprawą znacznych inwestycji producentów półprzewodników, takich jak m.in. Cree, Infineona, Rohm, ON Semi, Littelfuse oraz ST Micro, dostępność się znacznie poprawiła. W efekcie od paru lat w wielu zastosowaniach SiC stanowią już rzeczywistą alternatywę dla elementów krzemowych i to mimo, że nadal są droższe. Można też liczyć, że ceny takich tranzystorów niedługo spadną, bo rynek materiałów podłożowych z węglika krzemu jest aktualnie w fazie transformacji z krążków 4-calowych na 6-calowe i jest na nim aktywnych coraz więcej producentów. Większa powierzchnia płytek poprawi też wydajność produkcji takich podzespołów, bo na razie przy użyciu krążków 4-calowych producenci mają za małe moce wytwórcze i nie nadążają z produkcją w stosunku do zapotrzebowania, np. ze strony rynku energii odnawialnej.

Dobre parametry elektryczne tranzystorów z SiC zapewnione są nawet w wysokich temperaturach, co ułatwia budowę konwerterów i ogranicza nakłady wymagane do zapewnienia chłodzenia. Wysoka temperatura dopuszczalna złącza jest tutaj o 25–30º większa niż dla półprzewodników krzemowych. Pozwala to na zmniejszenie powierzchni wymaganych radiatorów lub wydajności systemu chłodzenia. Nierzadko też przejście na elementy SiC umożliwia rezygnację z chłodzenia wymuszonego i zastąpienie go konwekcyjnym. Co więcej, tranzystory te są w stanie pracować przy 2‒5 razy wyższych częstotliwościach kluczowania, co pozwala na redukcję wymiarów elementów magnetycznych i pojemności. Niewielkie prądy zerowe nawet w wysokich temperaturach zapewniają stabilne działanie i dużą niezawodność, co widać właśnie najbardziej w tych ekstremalnie trudnych warunkach otoczenia i zasilania.

Typowy MOSFET SiC pozwala utrzymać w ryzach straty mocy przy częstotliwościach rzędu 300 kHz, prądach 100 A, a więc tam, gdzie krzem się już "nie wyrabia". SiC pozwala też na działanie z wysokim napięciem przewyższającym 1 kV przy niskiej RDS( ON) poniżej 100 mΩ dla 1,2 kV. Jeśli chodzi o tranzystory z azotku galu GaN to oferują one jeszcze lepsze parametry w zakresie przełączania z dużą częstotliwością, nawet 1 MHz przy dużym poziomie mocy.

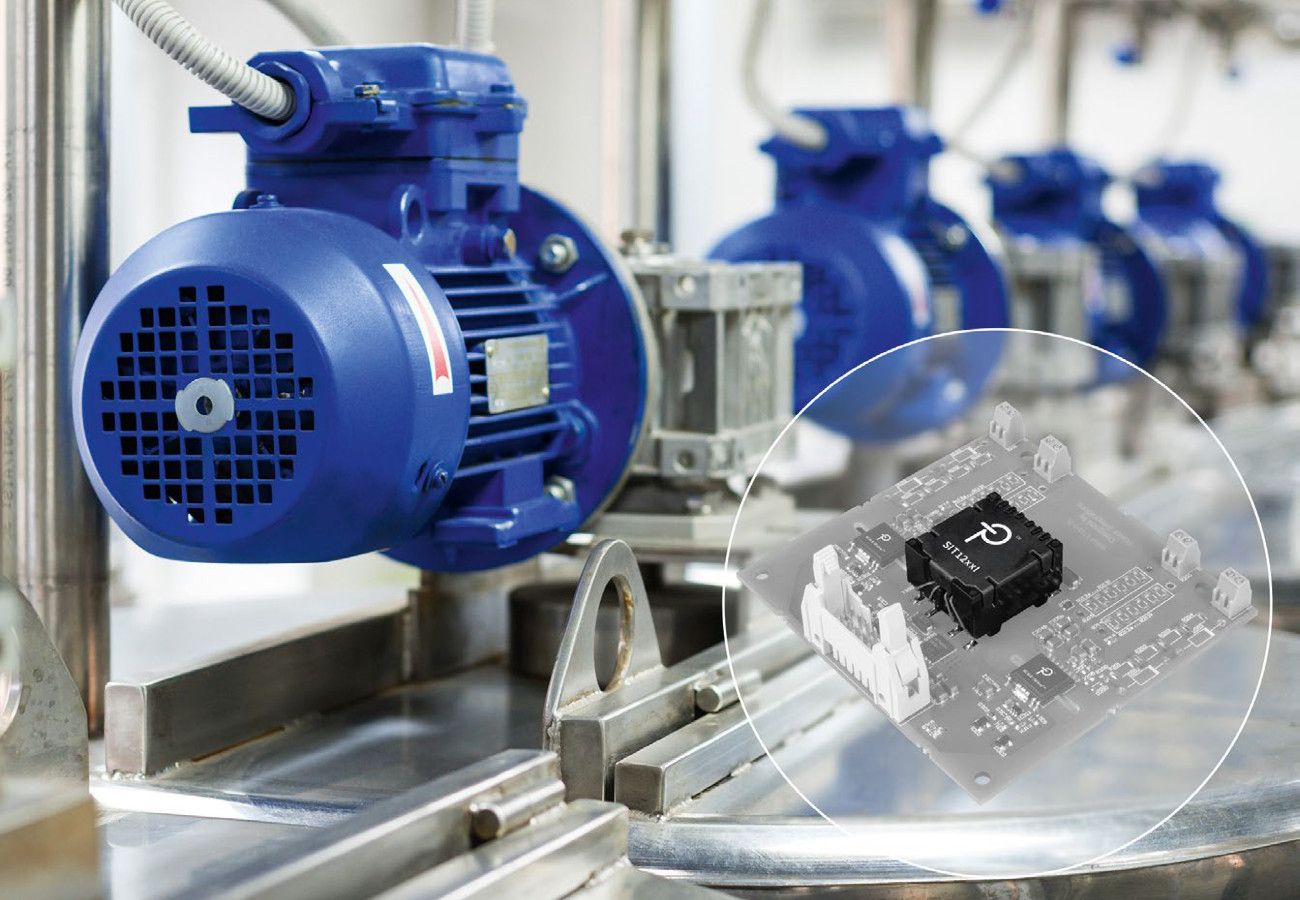

NAPĘDY SILNIKÓW, CZYLI FALOWNIKI

Silny impuls rozwojowy dla półprzewodników mocy tworzą także napędy silników. Od kilku lat w maszynach przemysłowych, na kolei, w sprzęcie AGD, systemach klimatyzacji, w motoryzacji i podobnych obszarach wykorzystuje się elektroniczne sterowniki umożliwiające płynną regulację obrotów, zmianę kierunku wirowania i zapewniające miękki rozruch. Oprócz takich funkcji użytkowych falowniki umożliwiają osiągnięcie wysokiej sprawności energetycznej, która jest wymagana obecnie przez przepisy unijne. Urządzenia te współpracują z silnikami indukcyjnymi, a więc tymi, które są powszechnie stosowane w maszynach i urządzeniach przemysłowych, dla których do niedawna nie było dobrych pod względem sprawności pracy i skuteczności działania regulatorów obrotów. Duże jednostki musiały mieć w tym celu przełączane uzwojenia, co było niewygodne i ograniczało liczbę biegów silnika do co najwyżej kilku. Obie te metody obarczone są poważnymi wadami, dlatego rynek napędów, które elektronicznie kształtują moc i szybkość wirowania pola magnetycznego w silniku, rozwija się dzisiaj bardzo dynamicznie.

ENERGIA ODNAWIALNA

Energia elektryczna jest coraz droższa, co sprzyja inwestycjom w technologie energooszczędne. Częścią tego procesu są technologie energii odnawialnej. Napięcie generowane przez źródła nie nadaje się w 99% przypadków do bezpośredniego wykorzystania praktycznego, bo waha się w dużym zakresie oraz nieliniowo zmienia się wraz z oświetleniem i siłą wiatru i obciążeniem. Z uwagi na powyższe większość takich inwestycji wykorzystuje złożone systemy konwersji mocy bazujące na złożonych sterownikach i wydajnych stopniach mocy zbudowanych właśnie z półprzewodników. W mniejszej skali, ale w podobny sposób, oddziaływają na rynek komponentów mocy instalacje fotowoltaiczne, które zawsze wykorzystują jakiś inwerter dostarczający energię elektryczną o stałych parametrach, co pozwala na dołączenie instalacji do sieci. Do tego są potrzebne elementy dużej mocy.

Poza tym w tym obszarze funkcjonują magazyny energii, takie jak akumulatory i superkondensatory, pozwalające przechwycić nadwyżkę mocy wytwarzanej nad zużywaną, wspomagające chwile szczytowych poborów mocy. Gdy instalacja nie jest połączona z siecią energetyczną, akumulator jest praktycznie niezbędny i od jego pojemności i niezawodności zależy w dużym stopniu dostępność energii zasilającej. Obsługa takich zadań wymaga dwukierunkowego (złożonego) falownika.

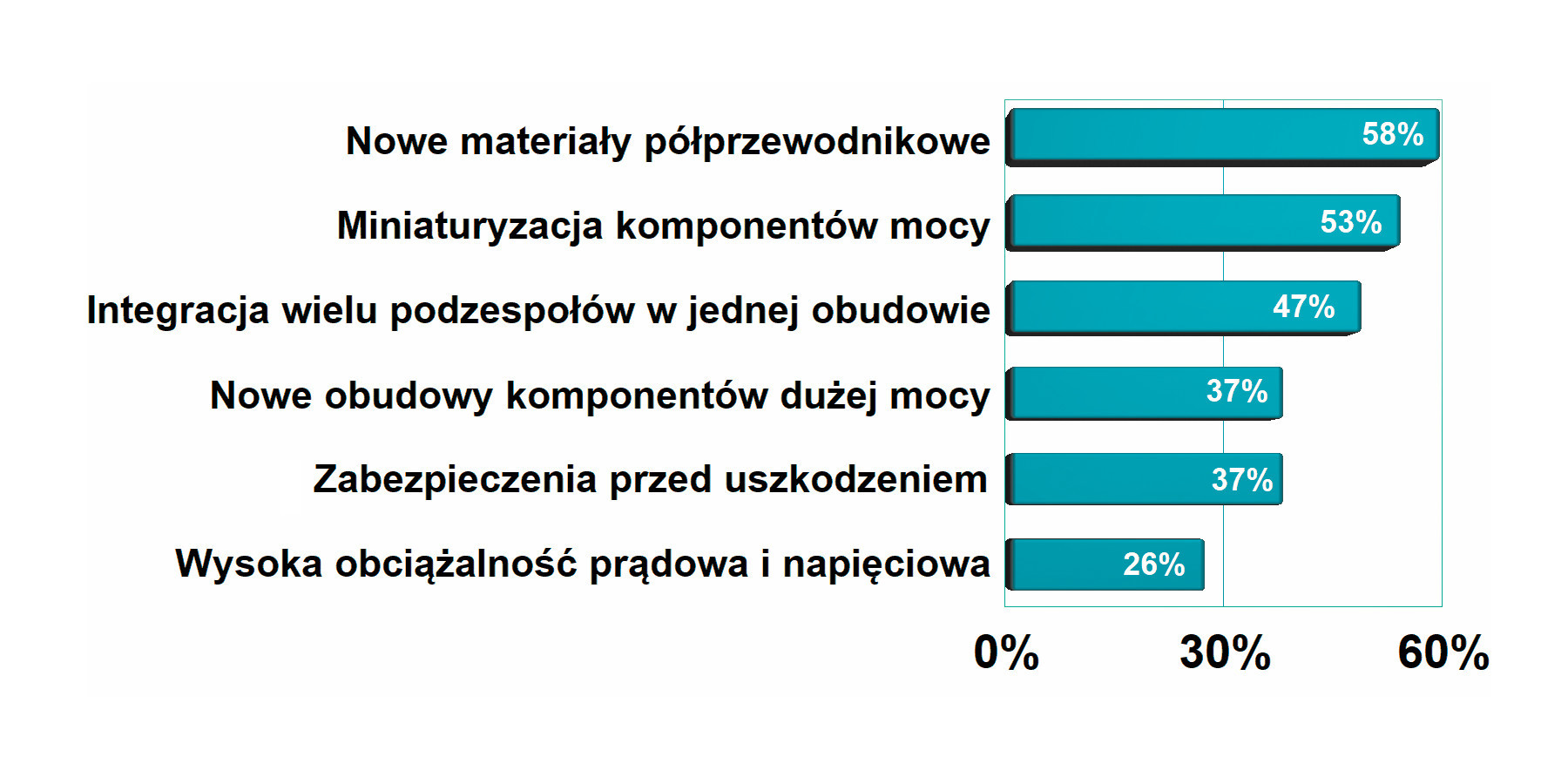

MINIATURYZACJA, SPRAWNOŚĆ I ODPROWADZANIE CIEPŁA

Wiele aplikacji elektroniki mocy pracuje dzisiaj z napięciami przekraczającymi 500 V i prądami wykraczającymi poza 100 A. Takie granice wyznaczają aplikacje w transporcie szynowym, motoryzacji elektrycznej oraz w sprzęcie przemysłowym. Energetyka podane wartości mnoży jeszcze nawet kilkukrotnie, a maksymalną obciążalność komponentów zwiększa, łącząc je szeregowo i równolegle w stosy. Niemniej bez względu na to, urządzenia muszą być możliwie niewielkie. Mimo że w wielu instalacjach miejsce nie jest problemem, miniaturyzacja jest ważnym trendem w energoelektronice, bo pozwala na większą integrację, lepszą swobodę aplikacyjną oraz otwiera nowe możliwości w zakresie zastosowań.

Wiadomo, że do miniaturyzacji konieczne jest zwiększenie sprawności konwersji energii elektrycznej, stąd w tym temacie nieustannie pojawiają się na rynku ważne innowacje. Lepsze parametry komutacyjne podzespołów dużej mocy zapewniają większą sprawność, pozwalając zmniejszyć liczbę elementów wykonawczych i tym samym ograniczyć zajmowane miejsce w obudowie urządzenia. Z kolei mniejsza liczba elementów to także oszczędność pieniędzy, prostsze sterowanie i serwisowanie. Wysoka sprawność to też mniejsze koszty chłodzenia, zasilania, ale także lepszy potencjał modernizacyjny. Wiadomo, że starsze rozwiązania falowników, zasilaczy, przełączników mogą nierzadko pracować przez długie lata i charakteryzują się dużą niezawodnością. W takiej sytuacji zmianę produktu na nowy mogą zapewnić tylko znacząco lepsze parametry, na przykład sprawności, które są w stanie przekonać firmy do opłacalności inwestycji. Dlatego w temacie sprawności wiele się dzieje.

Równolegle do pojawiających się na rynku nowych podzespołów półprzewodnikowych o coraz mniejszych stratach komutacyjnych, warto dostrzec trend związany z zarządzaniem ciepłem. Sprawnie działający mechanizm jego odprowadzania sprzyja miniaturyzacji, dlatego wiele innowacji nie kończy się na strukturach półprzewodnikowych i dotyczy także obudów komponentów. Najwięcej zmian w obszarze obudów jest w motoryzacji, ale jak to zwykle bywa, z czasem dobre pomysły przebijają się do innych branż i zastosowań.

MODUŁY MOCY

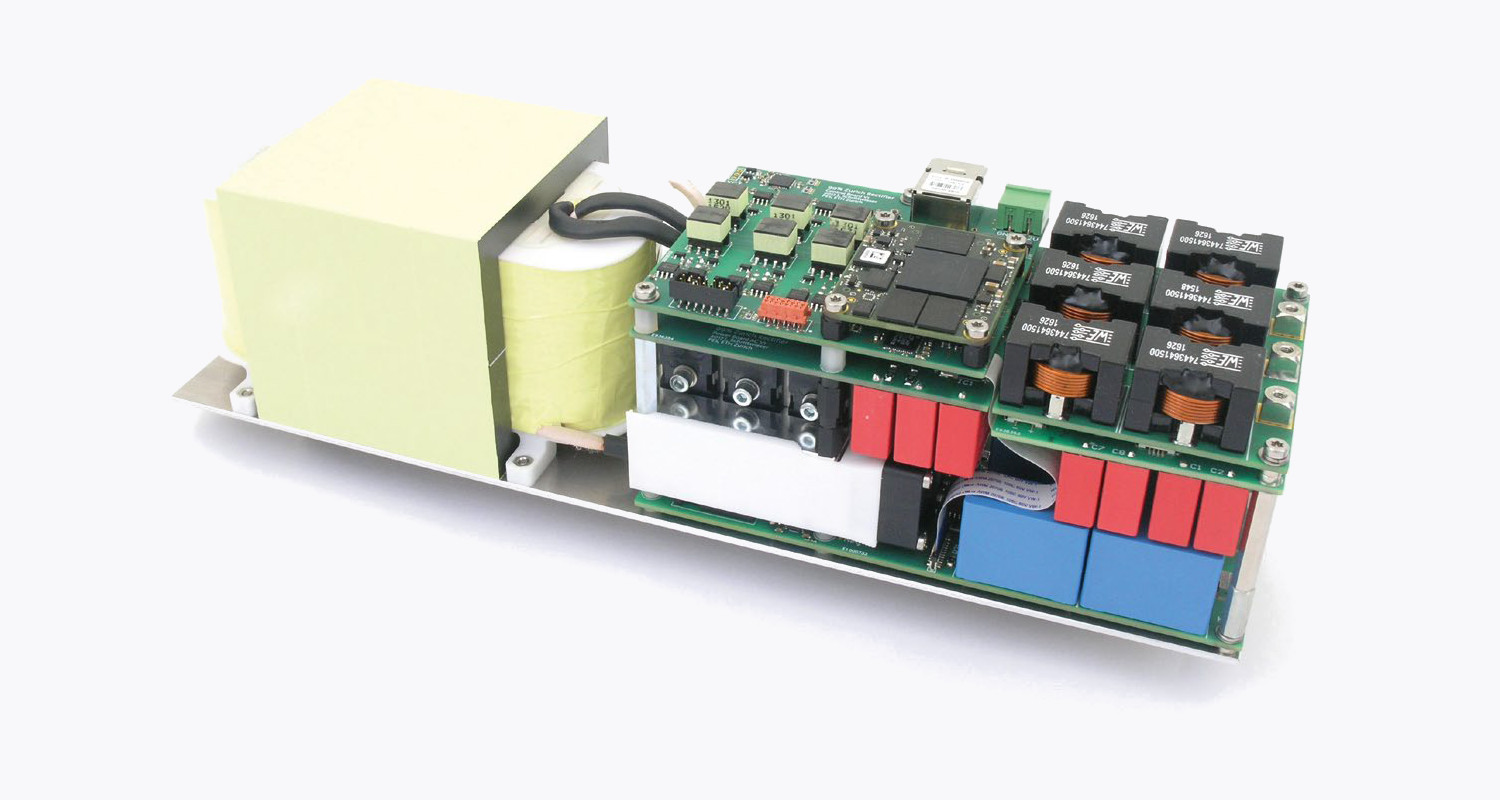

Podzespoły półprzewodnikowe dużej mocy obejmują zarówno szereg elementów dyskretnych, jak również funkcjonalne moduły o różnym stopniu złożoności, jeśli chodzi o strukturę wewnętrzną. Są one przeznaczone do układów półmostkowych lub pełnomostkowych, w wersji jednofazowej i trójfazowej. Najczęściej moduły zawierają 6 tranzystorów mocy, ale często umieszcza się w nich też prostownik, diody usprawniające oraz zabezpieczające. Takie komponenty znajdują się w ofertach wielu producentów półprzewodników i stanowią bazę konstrukcyjną większości napędów, regulatorów i zasilaczy. Występują one w wielu wersjach o różnej topologii, pozwalając zrealizować w prosty sposób stopień mocy. Modułowe półprzewodniki mocy zdobyły rynek również tym, że stanową one zwartą konstrukcję o dobrych parametrach w zakresie odprowadzania ciepła, przy jednoczesnym zapewnieniu izolacji galwanicznej od radiatora.

Półprzewodniki mocy to ponadto elementy, które zawsze współpracują z radiatorem lub innym systemem odprowadzania ciepła oraz w ogromnej większości zasilane są wysokimi napięciami, przekraczającymi 350 V. Dlatego ułatwienia związane z izolacją galwaniczną poszczególnych elementów, zapewniające bezproblemowy montaż na metalowym radiatorze, są jednym z najważniejszych źródeł przewagi rynkowej modułów nad elementami dyskretnymi.

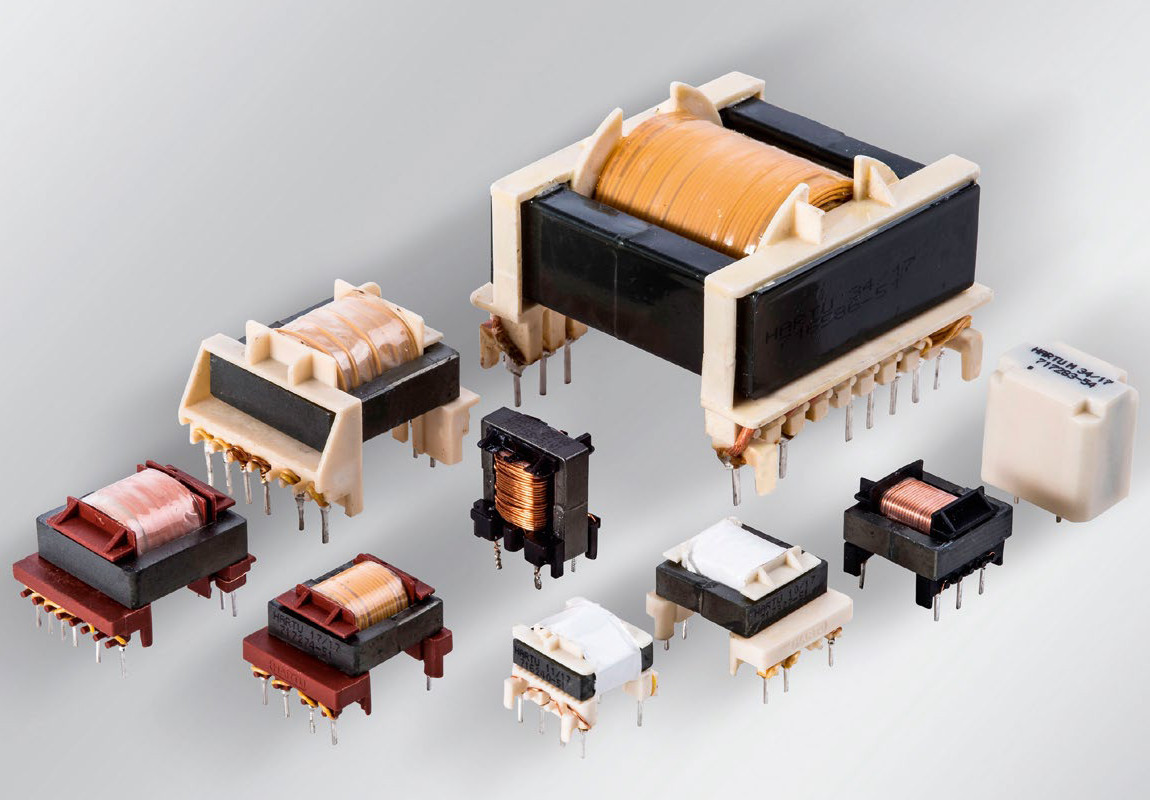

NIE TYLKO PÓŁPRZEWODNIKI

Poza półprzewodnikami energoelektronika łączy w całość wiele innych specjalizowanych produktów związanych z odprowadzaniem ciepła, jak radiatory, wentylatory, bloki chłodzące lub systemy chłodzenia wodnego. W grupie tej są także transformatory, filtry i inne części znajdujące się w torze dużej mocy. To również kable i złącza przeznaczone do prądów stałych o dużym natężeniu i pracy w trudnych warunkach środowiskowych, przekaźniki (styczniki) i urządzenia zabezpieczające umożliwiające podłączanie lub odłączanie gałęzi ogniw, liczniki energii/bezpieczniki.

Ważnym produktem są też specjalizowane sterowniki tranzystorów zapewniające izolację galwaniczną, poziomy napięć wymagane do sterowania bramką i dużą wydajność prądową umożliwiającą sprawną komutację. Są one pomostem między warstwą sygnałową aplikacji (np. mikrokontrolerem) oraz blokiem mocy.

KŁOPOTY Z DOSTĘPNOŚCIĄ PODZESPOŁÓW

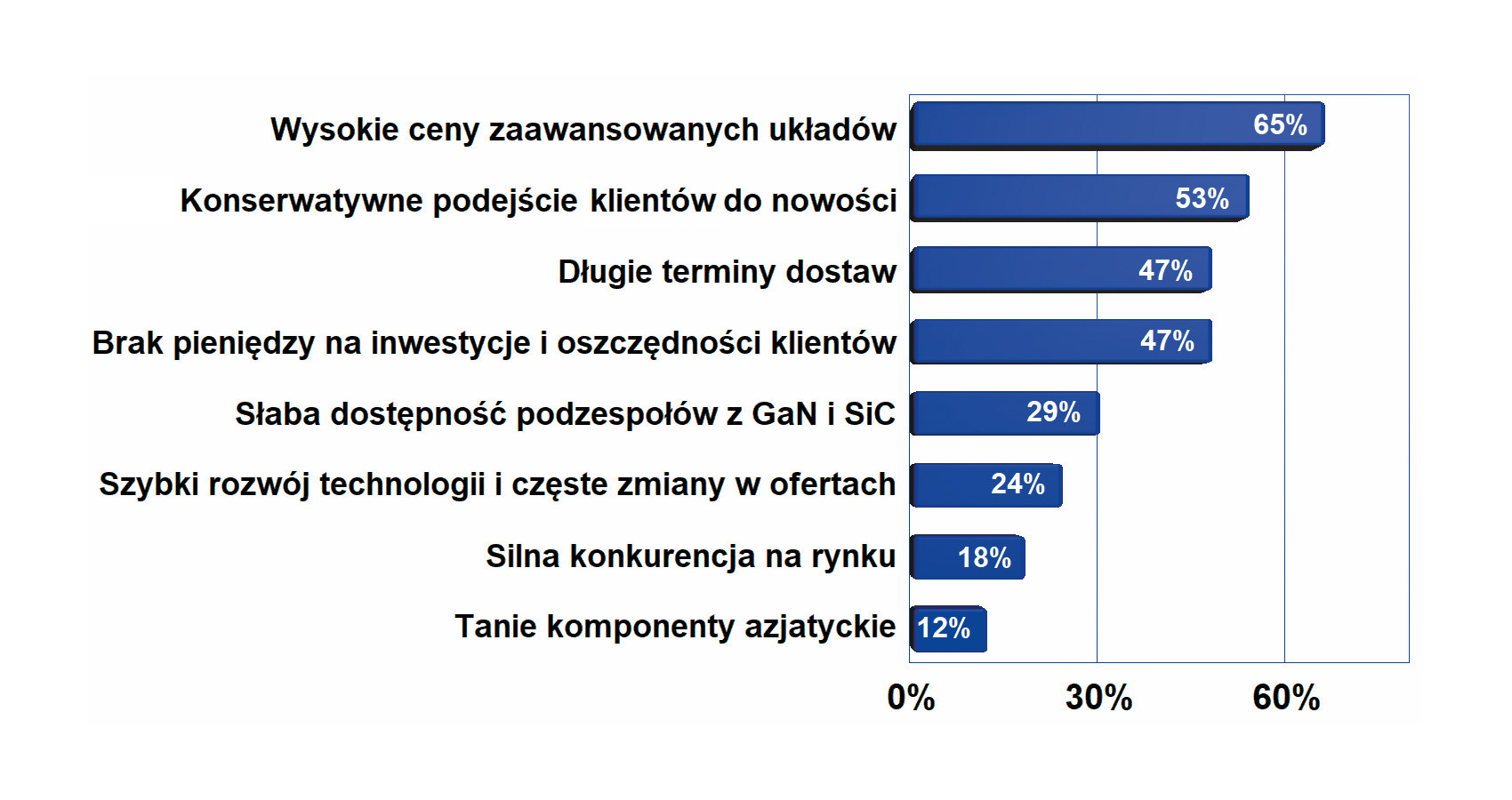

Gwałtowny rozwój elektrycznej motoryzacji oraz aplikacji związanych z energią odnawialną powoduje, że popyt na nowoczesne półprzewodniki mocy jest bardzo duży. Przy ograniczonej podaży na rynku pojawiają się kolejki i czasy dostaw się zwiększają.

Zjawisko to ogranicza trochę tempo rozwoju rynku, bo projektanci muszą brać pod uwagę dostępność tranzystorów mocy. Zapewne kolejki są największym problemem dla tych, którzy tworzą aplikacje wytwarzane w średnich seriach, a więc za małych, aby negocjować dostawy na najwyższym szczeblu oraz za dużych, aby po prostu kupić potrzebną ilość u detalisty. Takie potrzeby ma właśnie wielu krajowych producentów.

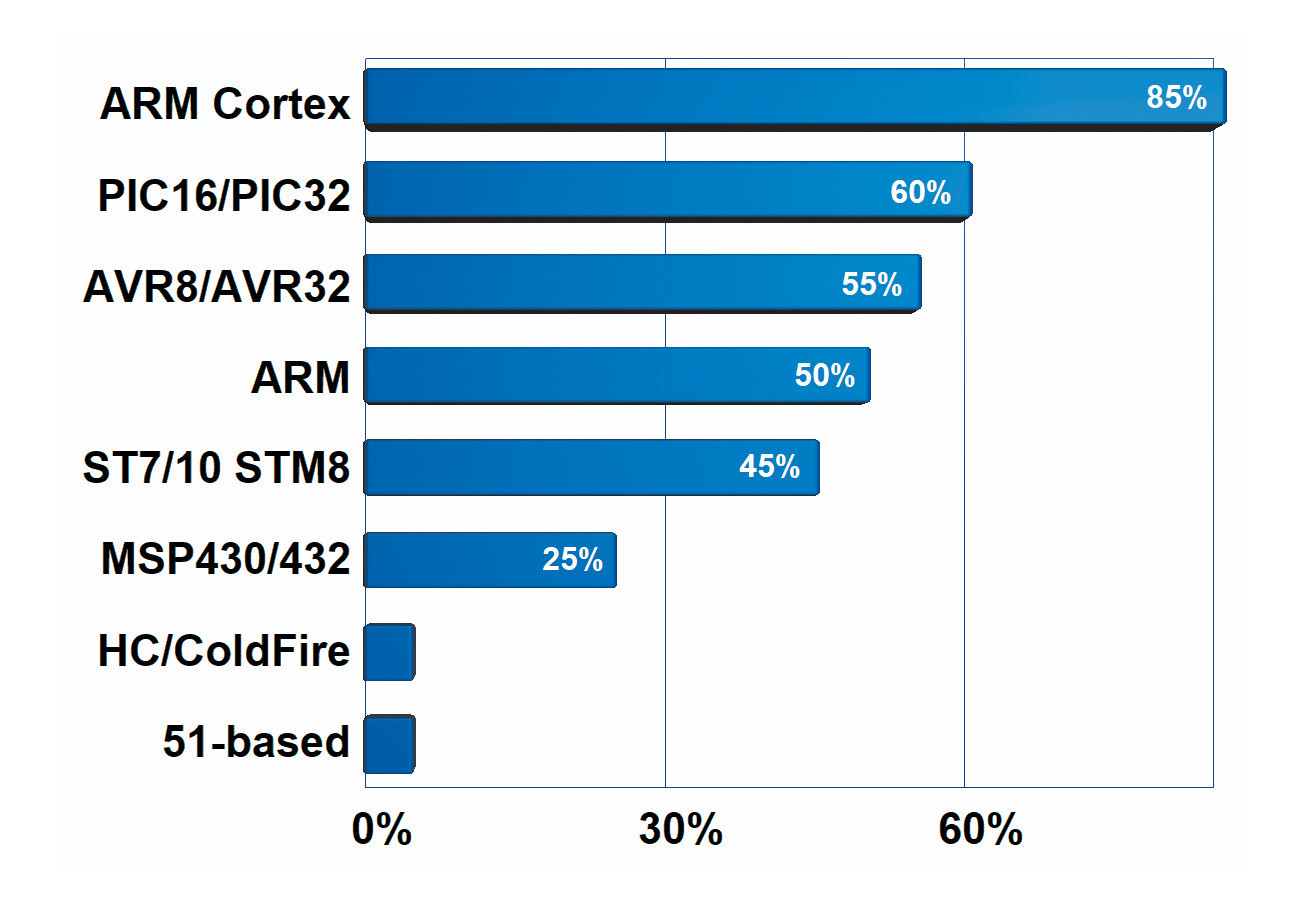

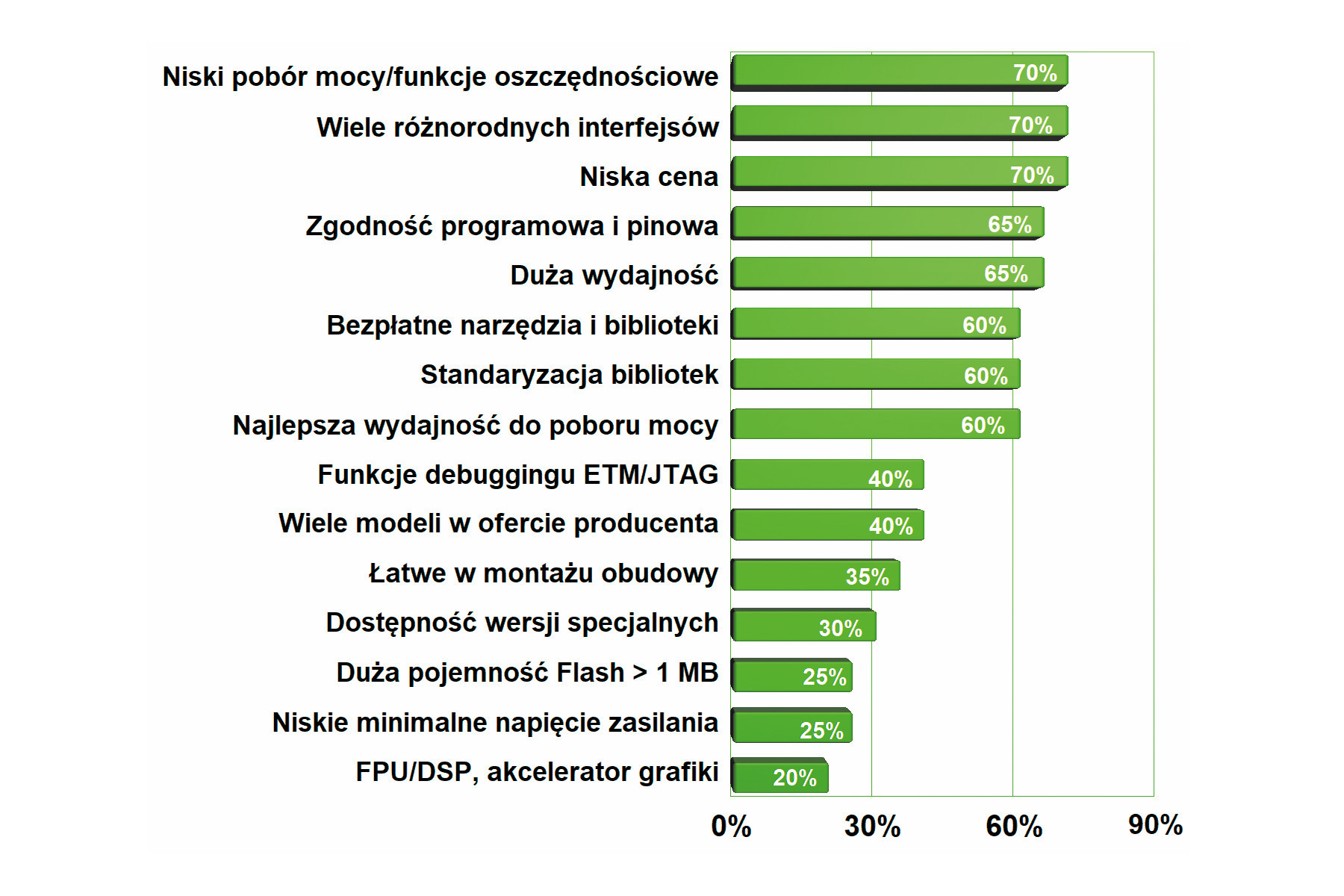

Mikrokontrolery i rozwiązania dla IoT – definiują nowoczesną elektronikę

Jesteśmy już bardzo blisko takiego stanu w rozwoju technologii, że każde urządzenie elektroniczne wymagające zasilania będzie miało przynajmniej jeden mikrokontroler. Liczba tych chipów w układach elektronicznych nieustannie rośnie, bo są one w stanie zapewnić bardzo dużą funkcjonalność za niską cenę, a dla wielu aplikacji tworzą praktycznie całą platformę sprzętową. Duża liczba producentów, wersji, różne architektury, rdzenie, szerokości szyny danych, wyposażenie w układy peryferyjne, a także przeznaczenie aplikacyjne powodują, że dobór optymalnej jednostki do realizowanego projektu staje się trudny i czasochłonny. Poza aspektami technicznymi optymalny wybór MCU wymaga też rozeznania biznesowego w cenach, dostępności, wymaganej wielkości zakupu i podobnych. W takich okolicznościach uwaga kierowana jest na dystrybutorów mikrokontrolerów oraz narzędzi, którzy są w stanie pomóc przebrnąć przez wiele trudnych decyzji.

Postęp techniczny i technologiczny w obszarze mikrokontrolerów jest bardzo szybki, przez co trzeba bardzo uważać, głosząc twierdzenia na temat tego, co się da, czego się nie da, co można, a czego nie. Bo zawsze może się okazać, że pojawiło się rozwiązanie, które tworzy wyjątek. A jak się ten wyjątek przyjmie (czyli okaże się dobrym pomysłem), to trwale zmienia paradygmat w danym obszarze.

Stałym trendem od lat jest to, że funkcjonalność mikrokontrolerów cały czas rośnie. Nowe mają więcej układów peryferyjnych, większą pamięć, lepsze rdzenie zapewniające wydajność i energooszczędność.

Rozwój rynku mikrokontrolerów nie jest też jednokierunkowy. Z uwagi na liczne obszary aplikacyjne rodziny produktów rozwijają się w kierunku dużej wydajności, małej mocy, w obrębie wersji specjalizowanych, np. komunikacyjnych, do przetwarzania sygnałów i sterowania silnikami itd.

Wiele jednostek jest ukierunkowanych do pracy w określonych aplikacjach i zawiera zestaw obwodów peryferyjnych kompletny z punktu widzenia zastosowań aplikacyjnych. Przykładem mogą być układy z obwodami analogowymi przeznaczone do pracy w zasilaczach cyfrowych, jednostki z wbudowanym transceiverem do komunikacji bezprzewodowej lub też mikrokontrolery o bardzo małym poborze mocy i z wysokorozdzielczym przetwornikiem A/C, a także blokiem obliczeniowym do kalkulacji zużycia mediów.

OPTYMALNY WYBÓR UKŁADU TO SPORE WYZWANIE

Ponieważ nie ma jednego układu pasującego do każdego zastosowania, oferty producentów szybko się rozszerzają, tworząc rodziny zawierające dziesiątki zgodnych pinowo i programowo wersji. Niekiedy jest ich tak wiele, że wybór wariantu w zakresie interfejsów, pamięci, obudowy a także ważnych szczegółów, jak zakres temperatur pracy itd., wymaga posłużenia się arkuszem kalkulacyjnym lub specjalizowanym narzędziem online. Niemniej wiele wersji i wariantów obudów pozwala dobrze dobrać układ do wymagań aplikacyjnych.

Specjalizacja jeszcze bardziej zwiększa asortyment i przekłada się na setki chipów w każdej z rodzin. To dobrze i źle. Dobrze, bo jest z czego wybierać, nie trzeba iść na kompromisy lub przepłacać, kupując chip, którego możliwości wykorzystamy jedynie w części. Wiele komponentów w ramach oferty producenta i rodziny zapewnia też łatwość migracji. Czyli użycia innego, lepszego chipu, zamiast dotychczasowego, bez konieczności przerabiania mozaiki obwodu drukowanego lub zmiany oprogramowania. Do minusów zaliczyć można to, że wybór jednostki najlepszej do danej aplikacji przestaje być łatwy. Póki wybór układu dotyczy danej rodziny, zestawienie parametrów ma formę jednej strony w arkuszu i daje się jakoś objąć. Wybór się komplikuje, gdy trzeba dobrać układ w ramach jednego producenta, a więc zwykle spośród wielu rodzin. Jeszcze gorzej jest, gdy nawet wybór producenta jest sprawą otwartą. Wówczas jest to prawdziwa loteria.

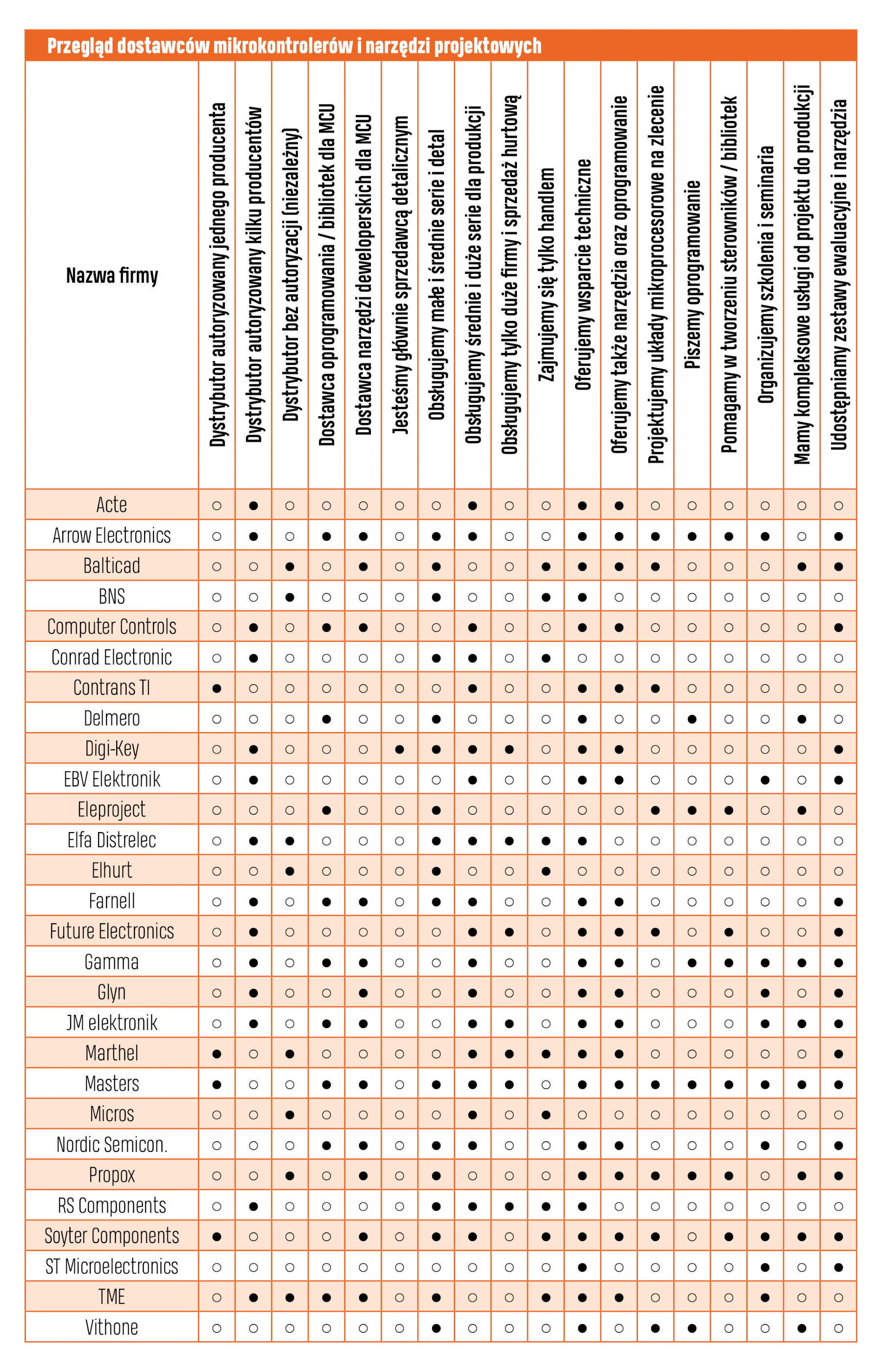

W ramach jednego producenta selekcję mikrokontrolera zwykle ułatwiają narzędzia online, konfiguratory i selektory. W jeszcze większej perspektywie układy pomagają wybrać dystrybutorzy. Pracownicy działów wsparcia technicznego mają nie tylko wiedzę techniczną, ale także informacje na temat dostępności poszczególnych wersji, planowanego wycofania z oferty i podobnych aspektów biznesowych.

SZEROKA OFERTA SPRZYJA INERCJI

Negatywnym czynnikiem dla szybko rozwijającego się rynku jest to, że produkty mało popularne wypadają z produkcji. Koniec wytwarzania pojawia się też szybciej, gdy w ofercie pojawi się podobna, ale lepsza jednostka.

W rzeczywistości takich problemów jest znacznie więcej, stąd wiele firm wiąże się z danym producentem mikrokontrolerów i konkretną architekturą na długo.

Inżynierska inercja tym samym negatywnie wpływa na tempo rozwoju rynku, ale nie należy postrzegać tego zjawiska pejoratywnie. Wyszukiwanie nowych rozwiązań, testy, tworzenie środowiska pracy z nowymi rozwiązaniami, narzędzia, oprogramowanie i co chyba jest najważniejsze – wiedza i znajomość danego rozwiązania mają wartość materialną. Poszukiwanie nowych rozwiązań w zakresie mikrokontrolerów musi być podbudowane solidną argumentacją, np. tym, że to z czego firma korzysta aktualnie, nie jest wystarczające lub że korzyści z nowej platformy będą wymiernie duże.

Skutek jest taki, że firmy zazwyczaj w nowych projektach zostają ze znaną sobie rodziną mikrokontrolerów danego producenta – starają się modernizować produkty w znanej sobie architekturze i zestawie oprogramowania.

WSPARCIE TECHNICZNE ZAWSZE JEST POTRZEBNE

Producenci i dystrybutorzy rozumieją rozterki producentów elektroniki oraz ich ciągłe problemy z brakiem czasu i starają się wspierać każde działanie, za którym kryje się realna chęć rozwoju. Darmowe próbki chipów to standardowe minimum, ale miniaturowe obudowy chipów (zwłaszcza te bezwyprowadzeniowe) oraz konieczność posłużenia się procesem SMT w montażu nawet jednej sztuki powodują, że najlepszą platformą do testów nowych rozwiązań są płytki startowe. W ostatnich pięciu latach w tym obszarze zaszły ogromne zmiany, a liczba zestawów dostępnych na rynku jest liczona w tysiącach. W praktyce każdy nowy chip o charakterze systemowym (a więc bardziej złożony) oraz inne układy w małych obudowach, np. bezwyprowadzeniowych, są wprowadzane na rynek razem z zestawem projektowym. Płytki startowe są często traktowane tak samo jak próbki, a więc rozdawane na seminariach, przekazywane klientom w ramach wsparcia technicznego. Ogólnie ma to sens, bo w dzisiejszej sytuacji, gdy czas staje się największym dobrem w pracy inżynierskiej, każde działanie, które go oszczędza i sprawia, że nie trzeba zaczynać od zera, jest doceniane.

Interesujący, pomysłowy i bogato wyposażony zestaw, zawierający mikrokontroler, układ komunikacyjny, czujniki, wyświetlacz, jest niczym magnes przyciągający uwagę. Otrzymana za darmo płytka startowa nierzadko jest przyczyną zainteresowania daną architekturą studentów i pracowników biur projektowych, którzy później mogą podjąć decyzję o większym zaangażowaniu właśnie w tym, znanym już kierunku.

Warto zauważyć, że zestawy projektowe, nawet te darmowe lub oferowane za symboliczne sumy, mają całkiem spore możliwości. Producenci dotują takie konstrukcje, instalując tam kosztowne elementy, takie jak FPGA lub nowoczesne czujniki MEMS itp. Przy wykorzystaniu projektów referencyjnych, narzędzi i oprogramowania dostarczanego przez producentów ryzyko niepowodzenia jest minimalne.

Dostępność narzędzi projektowych oraz nowości ze świata mikrokontrolerów dostrzegli dystrybutorzy katalogowi. W ostatnich trzech latach wszystkie firmy tego typu znacznie rozbudowały swoje oferty, nawiązały współpracę z producentami narzędzi i zaczęły je intensywnie promować. To znak, że na mikrokontrolery patrzy się przez pryzmat narzędzi, a nie chipów.

OPROGRAMOWANIE RÓWNIE ISTOTNE JAK HARDWARE

Na szybkość projektowania ma też wpływ czas przygotowania oprogramowania i z reguły jest to zagadnienie bardziej istotne od warstwy sprzętowej. To dlatego, że wiele aplikacji składa się z mikrokontrolera razem z niewielkim otoczeniem układów pomocniczych i peryferyjnych i od strony układowej są one stosunkowo proste. To jest normalne działanie, bo konieczność minimalizacji kosztów prowadzi do tego, aby koszt materiałowy zdefiniowany przez listę BOM był jak najniższy. Z uwagi na to korzystniej jest implementować więcej funkcji użytkowych w oprogramowaniu, bo związane z nim wydatki nie dotyczą każdej wytworzonej sztuki.

Te procesy sprawiają, że rola oprogramowania firmware cały czas się zwiększa. Staje się ono bardziej rozbudowane i złożone, a czas jego przygotowania (napisania) jest coraz dłuższy.

Podobnie jak zestawy startowe, projekty aplikacyjne lub gotowe rozwiązania dostarczane przez działy wsparcia technicznego producenta i dystrybutora ułatwiają budowę części sprzętowej, takie same zjawiska można dostrzec w zakresie oprogramowania. Podstawą są zintegrowane środowiska typu IDE, ale największą pomoc zapewniają gotowe kawałki kodu, biblioteki procedur lub nawet gotowe rozwiązania z otwartą licencją, które wystarczy przerobić pod swoje potrzeby. Takie zasoby też się bardzo szybko zwiększają i mają duży wpływ na tempo rozwoju rynku i akceptację nowych rozwiązań. Poza oprogramowaniem darmowym na rynku jest jeszcze wiele narzędzi płatnych związanych np. z grafiką, interfejsem użytkownika. Konieczność pracy od zera jest chyba bardzo rzadkim przypadkiem.

Coraz większe znaczenie w tworzeniu oprogramowania mają języki wysokiego poziomu, także wersje skryptowe, specjalizowane narzędzia zdolne do wygenerowania kodu na podstawie zapisanego graficznie algorytmu. Takie narzędzia najczęściej kierowane są do tworzenia aplikacji IoT i jeśli nie ma wymagań co do szybkości, a stopień komplikacji nie jest duży to można sobie z ich użyciem zaoszczędzić sporo wysiłku.

W powstanie takich narzędzi zaangażowały się duże koncerny, a przykładem może być Microsoft, który stworzył narzędzia pozwalające prosto stworzyć oprogramowanie dla projektu IoT z wykorzystaniem chmury Azure Sphere. Wraz z kolejnymi układami SoC zawierającymi kompletne platformy sprzętowe do takich zastosowań takie narzędzia będą zyskiwać na znaczeniu i zapewne będą coraz doskonalsze. Hipotetyczny koniec takich procesów można upatrywać w tym, że w obszarze IoT najbardziej liczyć się będzie pomysł na aplikację, to jaką korzyść (wartość) będzie można osiągnąć, a nie sprzęt i oprogramowanie.

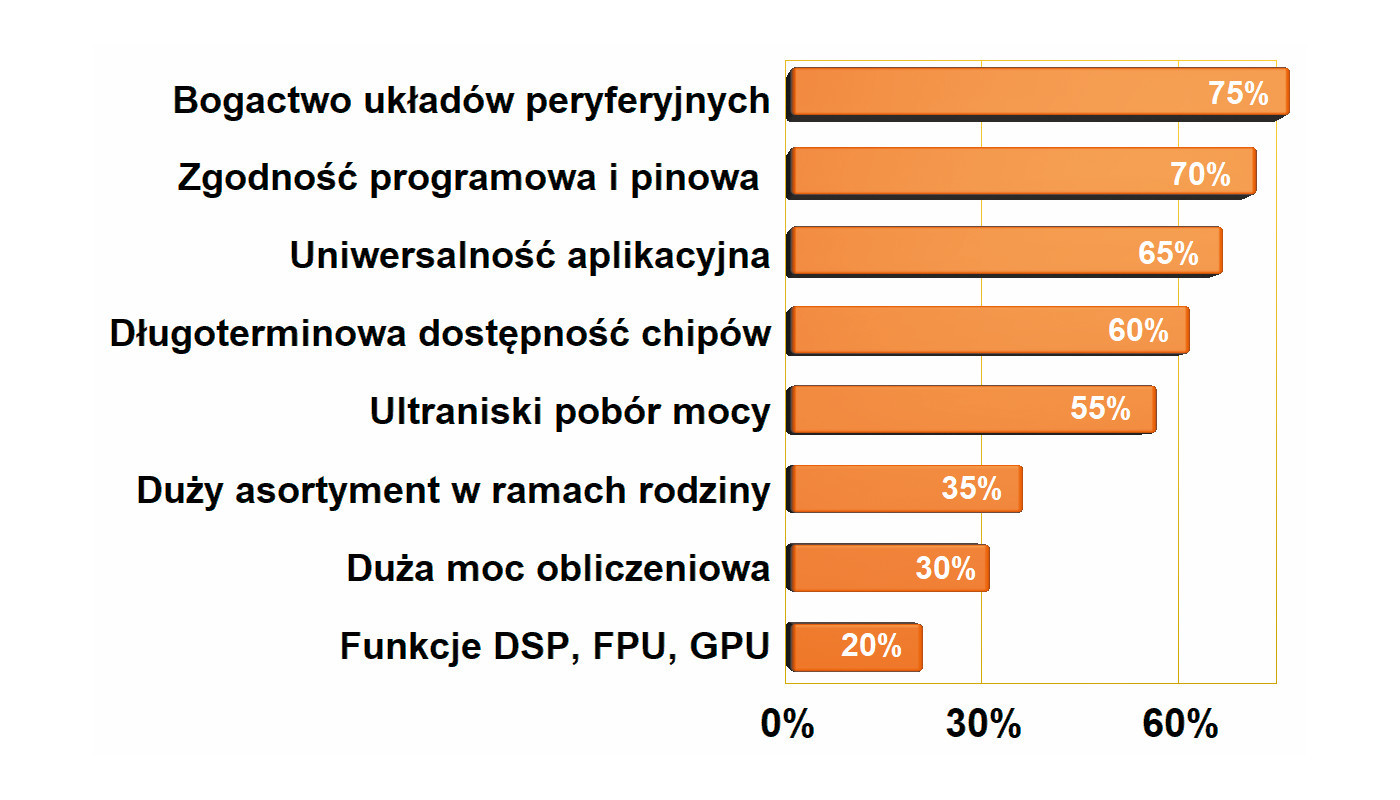

Duża moc obliczeniowa, koprocesory graficzne i jednostki DSP w hierarchii potrzeb krajowych klientów znalazły się na samym dole zestawienia. To zapewne dlatego, że aplikacje w których liczy się wydajność przetwarzania danych łatwiej stworzyć w oparciu na komputerach SOM/COM.

PHYTON ATAKUJE DOMINUJĄCĄ POZYCJĘ C++

Z opisanych wyżej powodów coraz częściej programiści sięgają w pracy po języki wysokiego poziomu takie jak Phyton. Powodem jest to, że z ich użyciem łatwo i szybko można napisać nawet skomplikowany program, taki którego implementacja w C++ wymagałaby znacznie więcej wysiłku. Dawniej, gdy zasoby pamięciowe mikrokontrolerów były niewielkie, tak samo wydajność przetwarzania, koniecznie było pisanie oprogramowania w językach niskiego poziomu, w asemblerze, potem przez długie lata w C/C++. Dzisiaj wydajność przetwarzania nie jest barierą, bez problemu można kupić chipy z pojemną pamięcią Flash, a wiele aplikacji nie musi działać w czasie rzeczywistym. Badania ankietowe, zarówno nasze własne wykonywane na potrzeby tego zestawienia, jak i zagraniczne stowarzyszenia branżowe wykazują niezbicie, że Phyton w systemach embedded jest wybierany równie często jak język C.

KOMUNIKACJA I NIEWIELKIE POTRZEBY ENERGETYCZNE

W ostatnich latach rynek elektroniki szybko się zmienia i znaczenia nabierają aplikacje przenośne, rozwiązania IoT oraz systemy rozproszone, np. telemetryczne sieci pomiarowe. Wiele takich rozwiązań zasilanych jest z akumulatorów i baterii jednorazowych, stąd potrzeby związane z zapewnieniem jak najmniejszego poboru mocy stają się bardzo istotne.

Drugim istotnym trendem jest komunikacja bezprzewodowa. Elektronika mobilna, urządzenia klasyfikowane jako IoT muszą mieć możliwość wymiany danych, dostępu do Internetu lub możliwość gromadzenia danych w chmurze obliczeniowej. Stąd komunikacja jest i będzie w przyszłości ważnym obszarem determinującym możliwości mikrokontrolerów. Na rynku są układy SoC, gdzie moduł komunikacyjny został zintegrowany w całość aplikacyjną z mikrokontrolerem tak, że całość realizuje wygodną platformę aplikacyjną, np. Espressif. Sukces tego rozwiązania wskazuje po raz kolejny wyraźnie rysujący się kierunek rozwoju, a więc uniwersalną platformę sprzętową o szerokich możliwościach konfiguracji.

WYDAJNOŚĆ CZY NISKI POBÓR MOCY

Mówiąc ogólnie, duża wydajność mikrokontrolerów jest w sprzeczności z niskim poborem mocy. Ale ostatnio na rynku pojawiły się mikrokontrolery, które mają dwa rdzenie – jeden wydajny a drugi energooszczędny, co pozwala programiście używać ich w zależności od tego, co jest potrzebne w danej chwili. To przykład wyłomu w tej ogólnej regule.

Nowe technologie pozwalają na usypianie działania procesora i szybkie wybudzanie, automatyczne dopasowanie wydajności do realizowanych zadań, skalowanie napięcia zasilania i inne podobne techniki. Są układy z autonomicznie działającymi układami peryferyjnymi, które mogą samodzielnie wymieniać dane bez udziału procesora. W zakresie niskiego poboru mocy producenci z pewnością nie powiedzieli jeszcze ostatniego słowa, wraz z kolejnymi rekordami można liczyć na wzrost popularności zasilania energią wolnodostępną (energy harvesting), przed którą widać wielki potencjał i która powinna być głównym źródłem zasilającym dla aplikacji elektroniki noszonej (wearables).

Na razie producenci mikrokontrolerów starają się łagodzić niedogodności związane z zawieraniem kompromisu między dużą wydajnością a małym poborem mocy poprzez rozbudowę chipów. Dwa mikrokontrolery w jednej strukturze są pomysłową koncepcją, która pojawiła się w rodzinie STM32, ale można ją dostrzec też w wielu układach SoC, gdzie z reguły jest kilka rdzeni: aplikacyjny, komunikacyjny itd.

OGROMNA FUNKCJONALNOŚĆ ZA GROSZE

Mikrokontrolery są coraz tańsze, co może niekoniecznie widać w cenach bezwzględnych, ale z pewnością daje się dostrzec pod względem stosunku ceny do możliwości (wydajność, pamięć, układy peryferyjne).

Projektanci przez cały czas szukają też oszczędności na najdroższych układach stosowanych w modułach elektronicznych, stąd wynika prawdopodobnie zapotrzebowanie na tanie mikrokontrolery, które nie muszą być uniwersalne. To zapewne też przyczyna, dla której jednostki 8-bitowe cały czas znajdują chętnych, bo takiego mikrokontrolera opłaca się użyć nawet do prostych funkcji logicznych. Kolejną odsłonę możliwości integracji i obniżki cen przynoszą układy SoC (system na krzemie) zawierające w jednym chipie praktycznie całą aplikację (procesor, pamięć, komunikację). Funkcjonalność, jaką dostaje się za symbolicznego dolara, jest bardzo duża i niemożliwa do osiągnięcia w jakimkolwiek innym rozwiązaniu bazującym na elementach dyskretnych. Dlatego perspektywy dla tego obszaru rynku są znakomite.

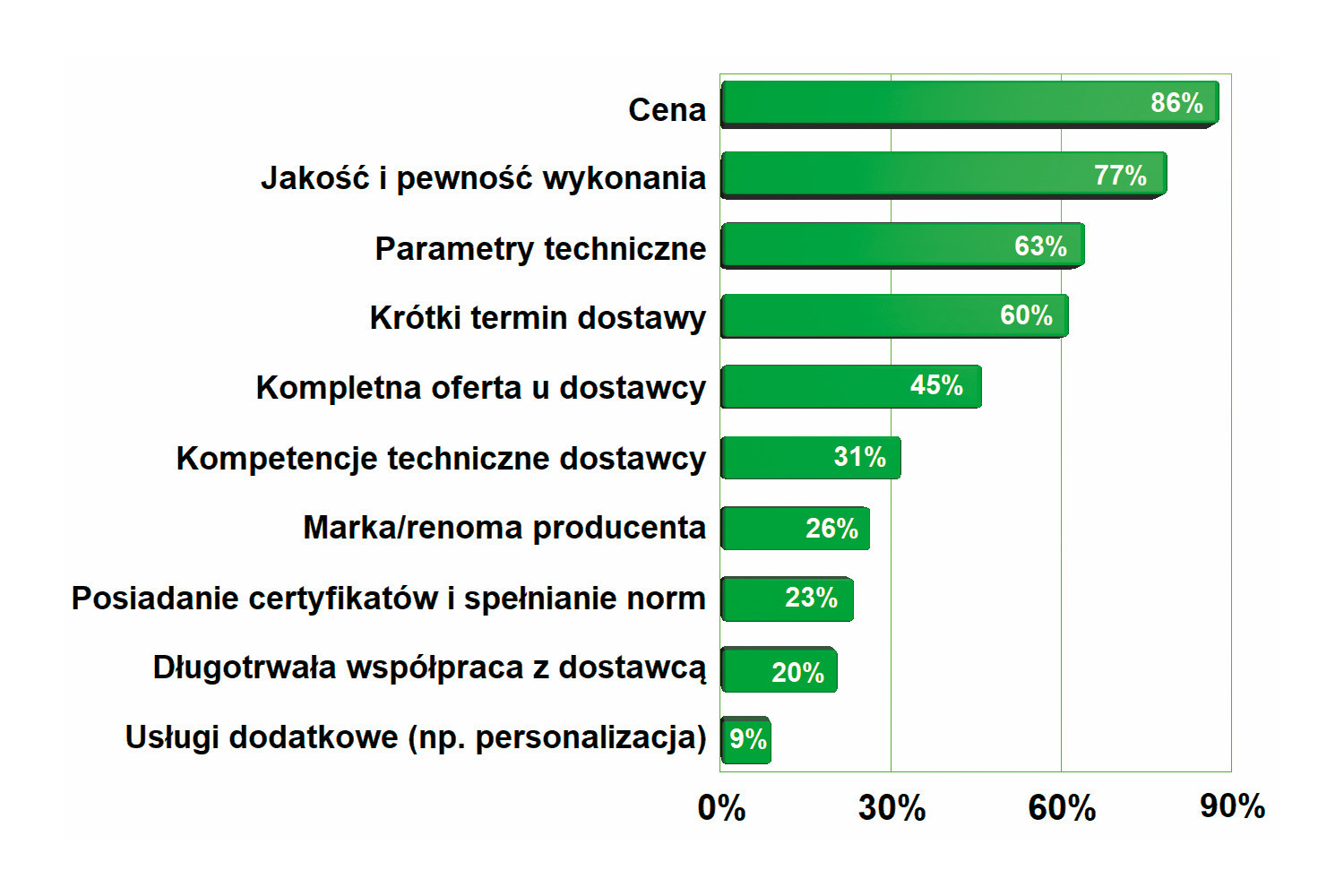

Przekaźniki elektromagnetyczne – zawsze są atrakcyjnym wyborem w układach automatyki

Współczesny przekaźnik elektromagnetyczny to miniaturowy element przełączający o dużej odporności elektrycznej i środowiskowej oraz o szerokim spektrum aplikacyjnym. Zapewnia wysoką funkcjonalność za niewielką cenę, przez co niezmiennie jest uznawany za produkt perspektywiczny, użyteczny, a nowe rozwiązania producentów w zakresie miniaturyzacji, wysokiej jakości wykonania, niskiego poboru mocy przez cewkę elektromagnesu sprawiają, że zawsze jest też dla projektantów atrakcyjnym wyborem. Z każdą kolejną wersją elementy te ulegają licznym zmianom, gdyż na rynku jest wielu producentów zabiegających o klientów i proponujących coraz lepsze wykonania.

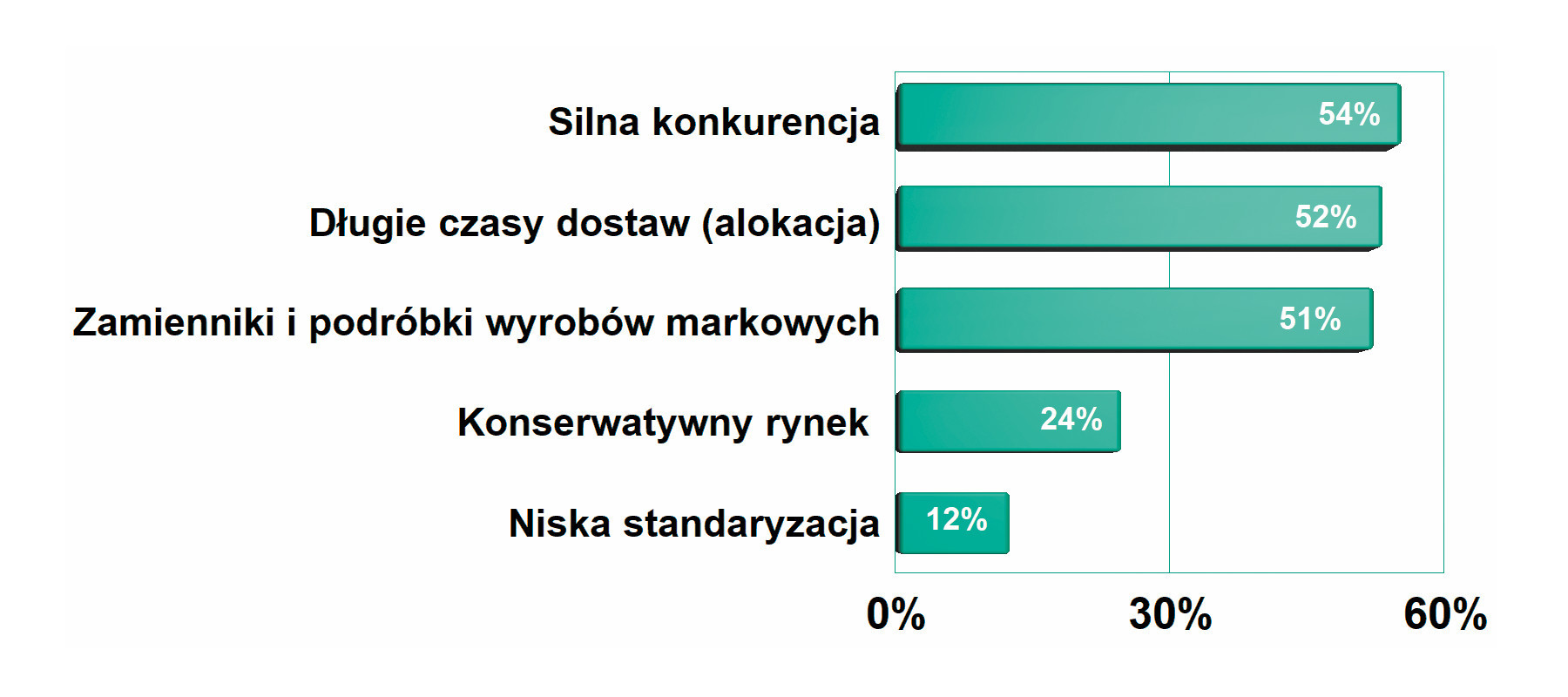

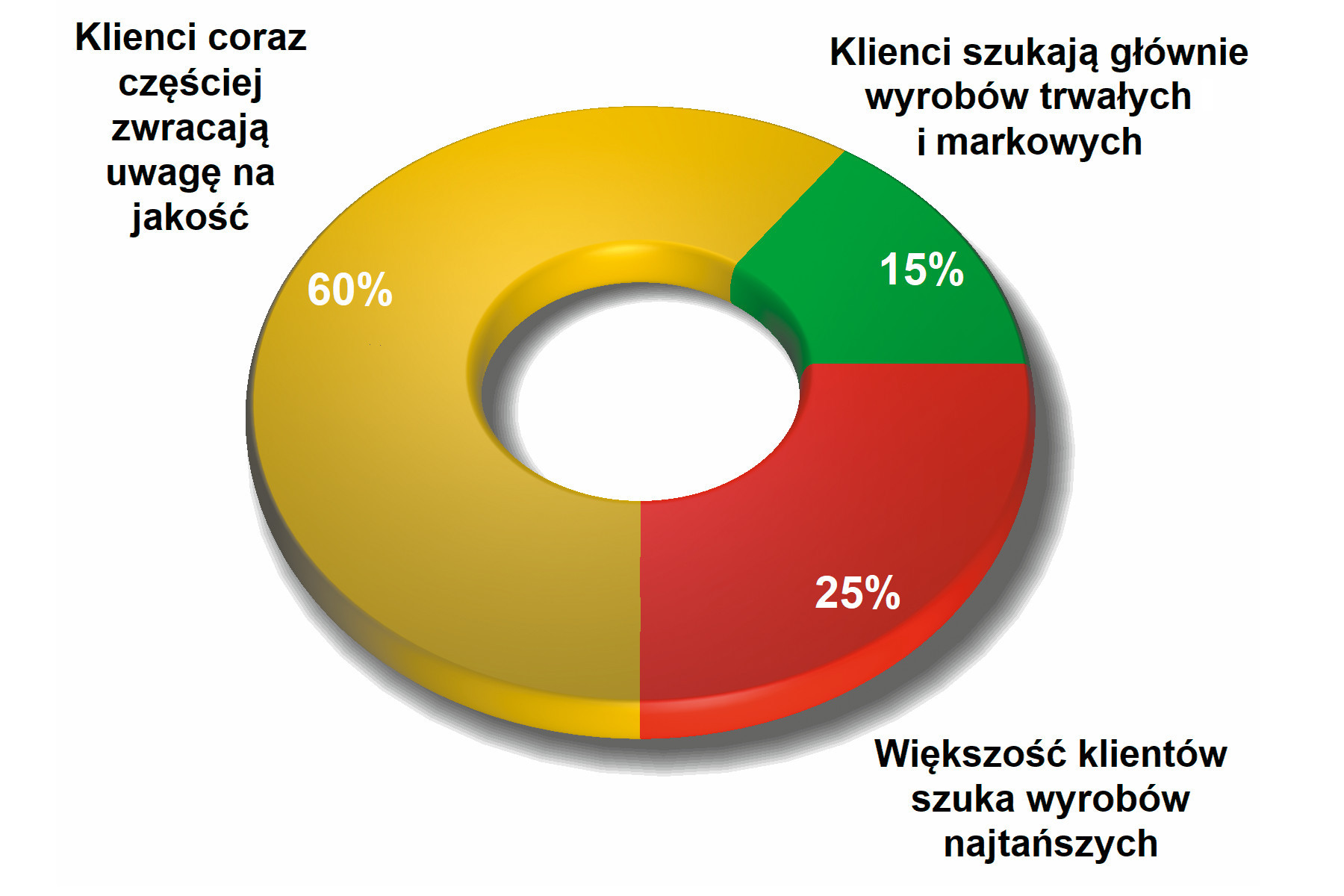

Na rynku przekaźników widoczny jest zwrot zainteresowania klientów w stronę produktów o wysokiej jakości i tych produkowanych przez renomowanych producentów. Proces ten zachodzi, mimo że cały czas są dostępne przekaźniki klasyfikowane jako podróbki oraz tanie chińskie marki, a silna konkurencja zapewnia wiele rozwiązań o zbliżonych parametrach.

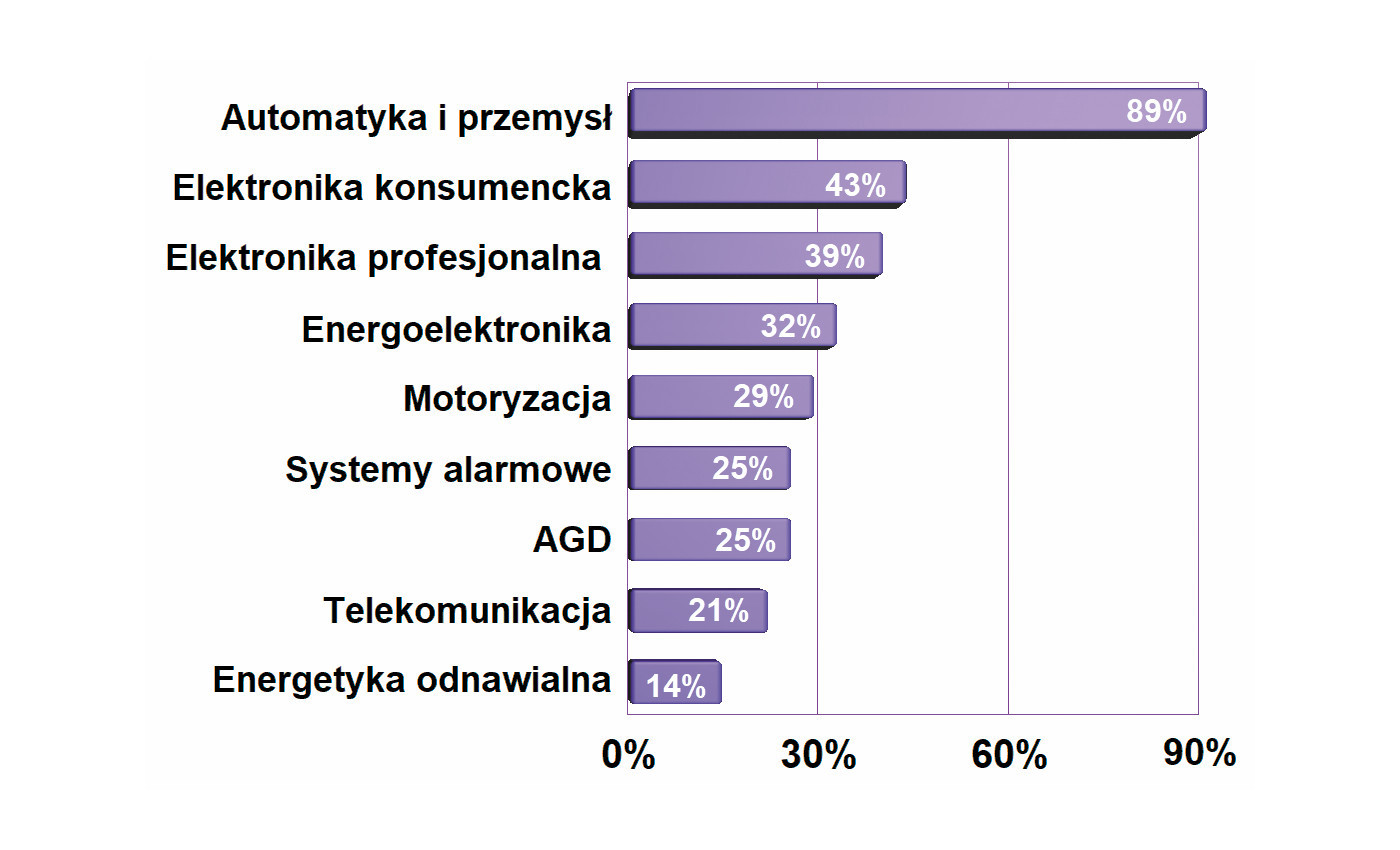

Przyczyn tego zjawiska jest wiele, na przykład rosnące koszty pracy i tym samym drożejący serwis i obsługa techniczna urządzeń. To także coraz większy eksport krajowych przedsiębiorstw, coraz więcej urządzeń i aparatury w fabrykach oraz większe skomplikowanie techniczne nowych instalacji. W Polsce szybko rozwijają się rynki związane z produkcją maszyn, sektorem budowlanym i postępuje automatyzacja wielu dziedzin. Rozwój produkcji inicjuje też popyt na systemy kontroli i sterowania, co zawsze stymuluje popyt na przekaźniki. Wiele krajowych firm produkuje i eksportuje urządzenia dla przemysłu, takie jak sterowniki, regulatory, urządzenia pomiarowe, styczniki, systemy bezpieczeństwa i nadzoru. W ramach inwestycji i modernizacji starszych zakładów i linii produkcyjnych kupowane są nowe maszyny i budowane do nich instalacje oraz systemy. Strumień sprzedaży dla przemysłu tworzą też elektronika profesjonalna, energoelektronika, motoryzacja, systemy alarmowe. Nie są to filary rynku odpowiedzialne za zbyt przekaźników, ale z pewnością mające znaczenie.

Zainteresowanie jakością w branży bierze się też z tego, że krajowych przedsiębiorców obecnie stać na lepsze produkty, bo sytuacja w gospodarce jest dobra, a rynek się rozwija, zapewniając im niezłe dochody. Innymi słowy, nie muszą oni oszczędzać na wszystkim i na te lepsze produkty ich stać. Liczne inwestycje producentów europejskich w automatyzację produkcji spowodowały, że wytwarzanie przekaźników wymaga mniej pracy ręcznej niż dawniej, więc jakość jest lepsza przy jednocześnie niższej cenie. Ceny przekaźników markowych nie są już dzisiaj w dużej dysproporcji w stosunku do tych tańszych i nierzadko różnica pomiędzy wersjami staje się niewarta starań. Co więcej, w ostatniej dekadzie w technologii przekaźników zaszło sporo korzystnych zmian poprawiających jakość i trwałość tych elementów, przez co działy utrzymania ruchu w przemyśle kupują obecnie relatywnie mniej tych elementów niż kiedyś. To też ogranicza zapędy do oszczędzania.

Paradoksalnie rynek jest też dzisiaj znacznie bardziej wyedukowany w zakresie podejścia do jakości właśnie dzięki temu, że kiedyś była ona drugorzędna w stosunku do niskiej ceny. Nic tak nie edukuje klientów i nie zmienia kierunku myślenia firm, jak pojawiające się problemy z urządzeniami w okresie gwarancyjnym i ponoszone koszty serwisu z powodu elementu, na którym oszczędzono ułamek złotówki.

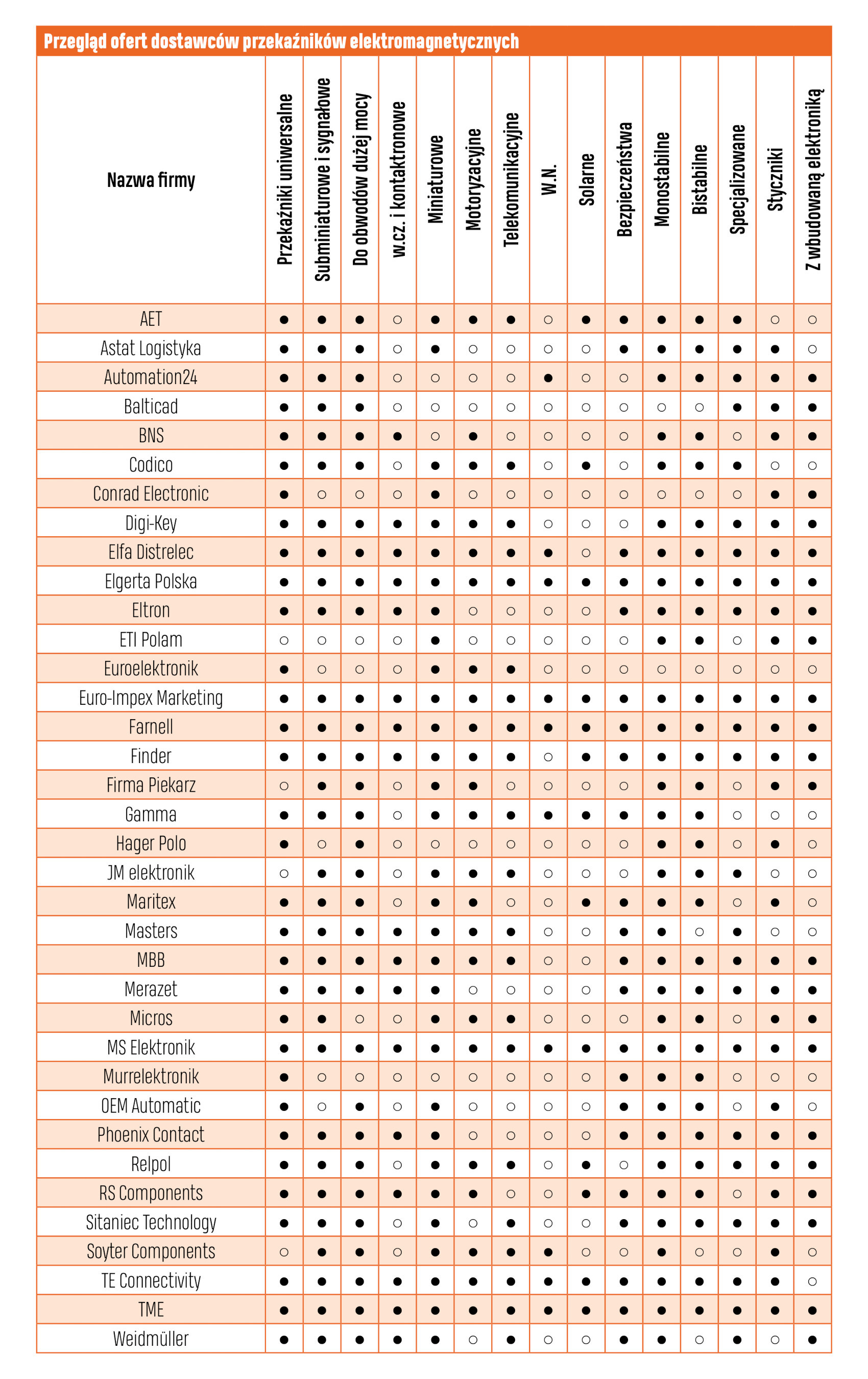

SZEROKI ASORTYMENT

Wiele zmian na rynku, jakie zaszły w ostatnich latach, też można uznać za czynniki sprzyjające dla przekaźników i także pośrednio dla jakości. Przykładem może być wzrost znaczenia specjalizacji, odchodzenie od wytwarzania długich serii na rzecz produkcji elastycznie dopasowującej się do chwilowych potrzeb rynku bądź wręcz realizowanej na zlecenie. Sprawne realizowanie projektów, zleceń integracji i usług produkcyjnych preferuje firmy lokalne, a więc zdolne do zapewnienia szybkich dostaw komponentów. Im szerszy asortyment, im więcej typów wykonań i możliwości w zakresie przekaźników mamy na rynku, tym pozycja rynkowa dużych lokalnych graczy jest lepsza, bo oni mają magazyny fabryczne blisko klienta.

ROSNĄCY ASORTYMENT WERSJI SPECJALISTYCZNYCH

W ofertach producentów przekaźników widocznych jest coraz więcej typów o funkcjonalności i parametrach dostosowanych do wymagań aplikacji. Do niedawna przekaźnik był postrzegany jako coś bardzo uniwersalnego, co można było używać w zasadzie dowolnie, obecnie okazuje się, że czasem warto sięgnąć po rozwiązanie aplikacyjne. Przykładem mogą być wersje solarne, zdolne do komutacji obwodów mocy prądu stałego, rozwiązania odporne na uderzenia prądu udarowego, o podwyższonej odporności izolacji, bistabilne i podobne. Czasy, gdy przekaźnik dobierało się na podstawie paru parametrów, już dawno się skończyły – poza obszarem aplikacyjnym, typem, trzeba też zająć się wymaganiami środowiskowymi, obudowie, opcjach dodatkowych jak np. wskaźnik zadziałania, wbudowanym elemencie gaszącym przepięcia, systemie gaszenia łuku elektrycznego, przycisku testującym itp. Do tego dochodzą opcje montażu, parametry cewki przekaźnika oraz jej moc (nominalna i obniżona). Kryteriów selekcji jest mnóstwo.

Warto dostrzec, że liczba wersji przekaźników z obniżonym poborem mocy przez cewkę także systematycznie się powiększa. Doszliśmy do momentu, że większość popularnych typów jest już dostępnych w wersji oszczędnej, a redukcja poboru mocy sięga 30‒50%. Poza redukcją energii elektrycznej niski pobór mocy przez cewkę przekłada się na mniejsze nagrzewanie i możliwość pracy w szerszym zakresie temperatur. To kolejny czynnik sprzyjający jakości.

STYK CZY ZESTYK?

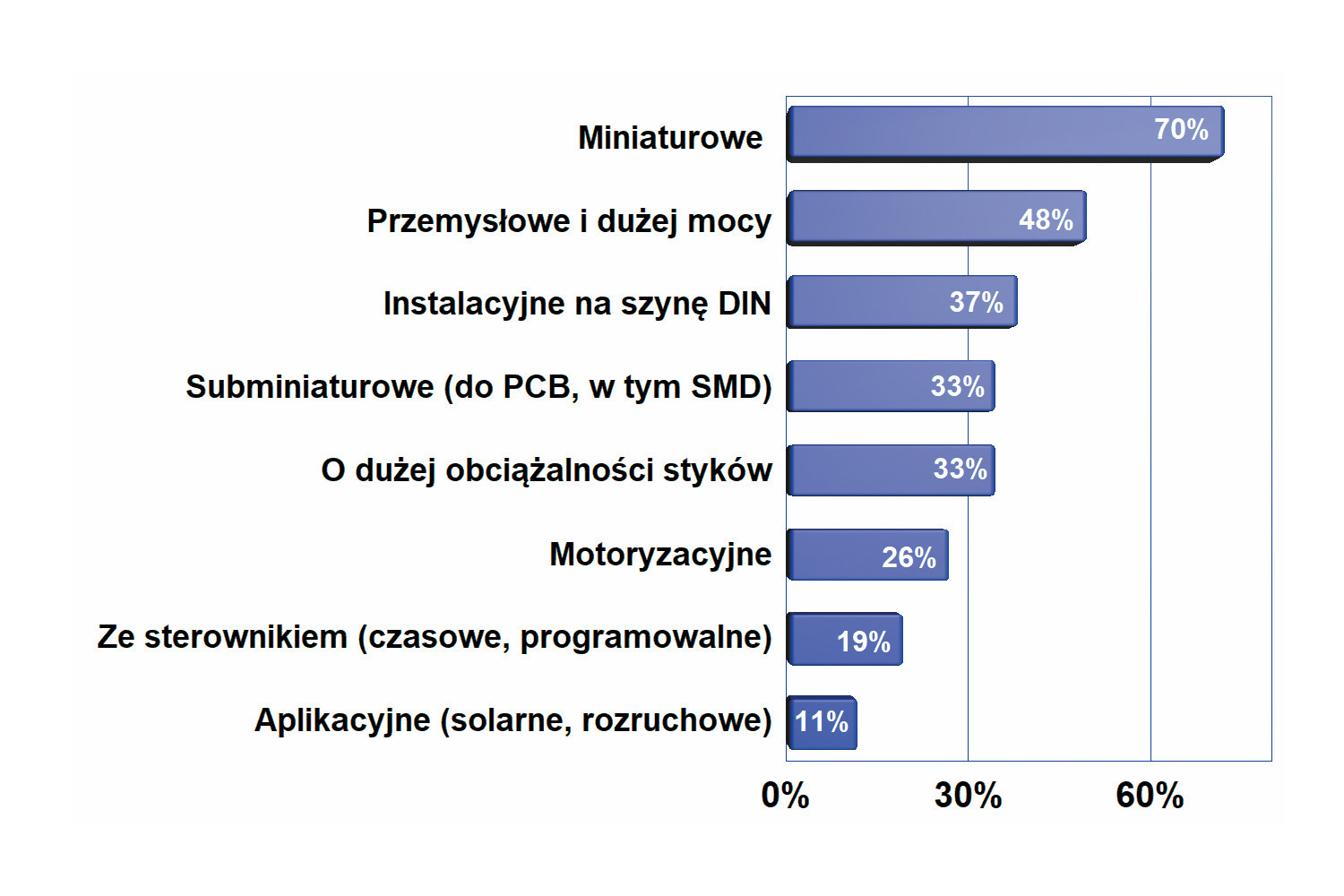

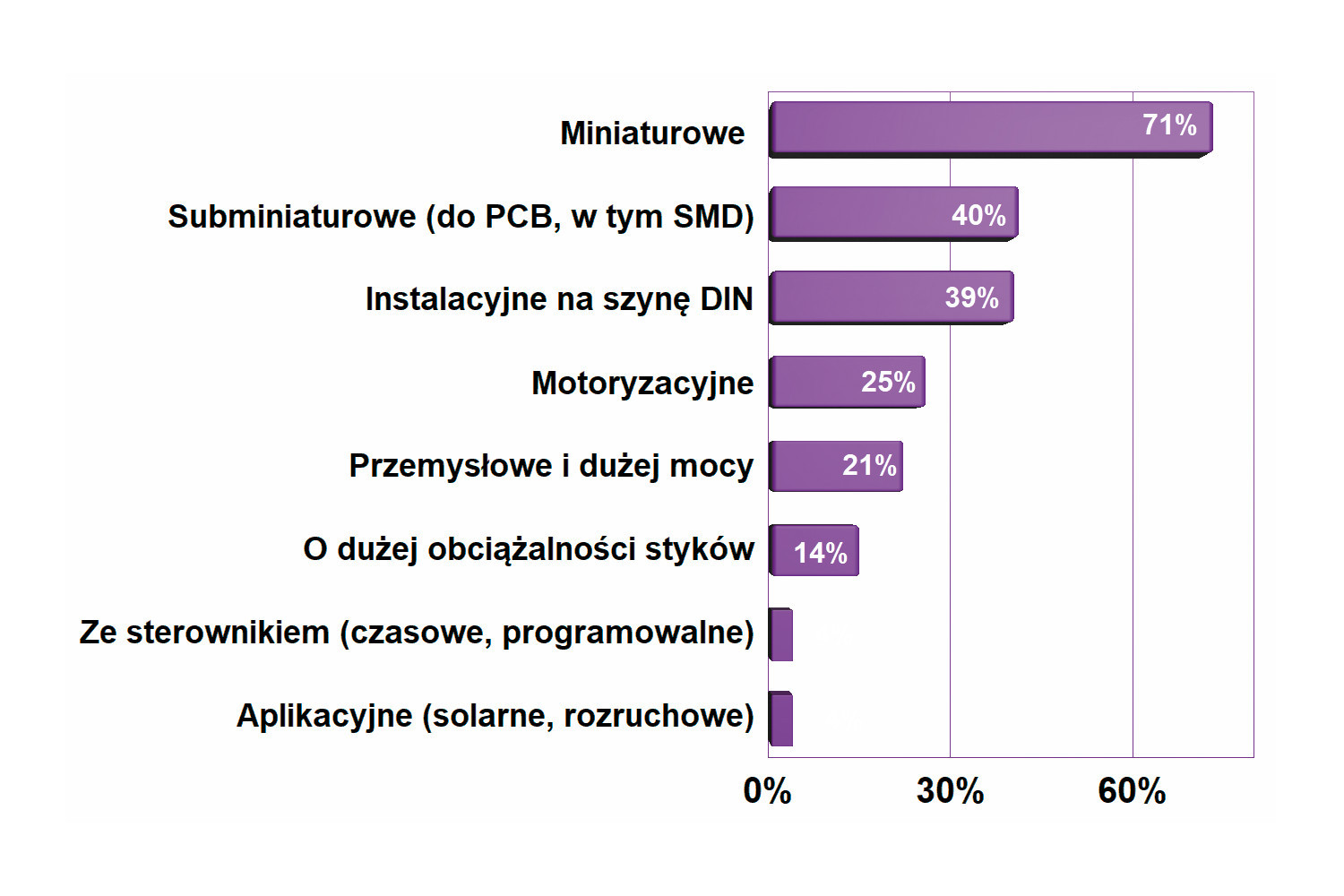

Warto zauważyć, że poszczególne typy przekaźników opisywane są terminami, których znaczenie zmienia się w zależności od docelowej branży, a na dodatek funkcjonujące określenia nie są ścisłe. Poszukiwanie przekaźnika oraz sprawne poruszanie się po katalogach producentów wymaga przez to nieco uwagi. I tak termin przekaźnik miniaturowy oznacza zwykle element o średniej wielkości i obciążalności z punktu widzenia elektroników, przeznaczony do montażu na płytce drukowanej. Elementy takie przeznaczone są do załączania obciążeń od 5 do 10 A przy napięciu sieci 230 VAC i zawierają jedną lub maksymalnie dwie pary styków.

Druga grupa kierowana do elektroniki to przekaźniki subminiaturowe. Są to elementy o małych wymiarach i obciążalności przeznaczone do montażu na płytkach drukowanych w wersjach THT i SMD. Ich prąd przewodzenia styków zawiera się typowo w zakresie 0,5‒2 A, napięcia pracy sięgają 120 V, a więc nie są to elementy przeznaczone do pracy z napięciem sieci energetycznej. To takie typowe przekaźniki do aplikacji w elektronice, do pracy z małymi sygnałami o wielkości kondensatora elektrolitycznego.

Ciekawostką jest też to, że to, co elektronicy nazywają stykami, formalnie producenci nazywają zestykami. Racja jest po ich stronie, bo styk to element z materiału kontaktowego, który realizuje połączenie obwodu elektrycznego. Razem z dźwignią i mechanizmem ruchu ten kontakt tworzy zestyk, a więc coś więcej niż tylko główkę ze stopu metalu. Zestyk zatem to element przełączający zawierający styki. Wystarczy przejrzeć katalogi firm elektronicznych, aby zauważyć, że w świecie elektroniki "zestyk" nie istnieje i obojętnie o czym mówimy, jest to styk. Tworząc zapytania ofertowe warto pamiętać o tej ułomności, aby uniknąć nieporozumień. Podobnie zresztą jest z "przyłączem", które elektronicy nazywają złączem zasilającym, wtyczką, gniazdem itp.

Kolejna ważna grupa to przekaźniki przemysłowe. Są to elementy o jeszcze większych wymiarach niż miniaturowe, zwykle są one przeznaczone do montażu w podstawce lub z końcówkami do lutowania lub mają końcówki pod konektory. Zawierają kilka par styków o dużej obciążalności, z reguły trzy do każdej fazy po jednym, mogą one włączać obciążenia indukcyjne, pracują przy napięciu do 400 V itp. Wyróżniają się odpornością, trwałością, dodatkami takimi jak przycisk testowy lub kontrolka oraz wzmocniona izolacja. Przekaźniki przemysłowe montuje się w przezroczystych obudowach po to, aby można było łatwo ocenić ich stan techniczny.

Poza wymienionymi typami kolejne grupy produktowe w zakresie przekaźników są już dostępne w obudowach instalacyjnych. Są to wersje do montażu na szynie DIN lub przykręcane do płaskiej powierzchni w skrzynce instalacyjnej. To samo dotyczy wersji specjalizowanych, nadzorczych, czasowych. Są to konstrukcje, w których oprócz przekaźnika elektromagnetycznego jest coś jeszcze: logika sterująca lub układy interfejsu.

WERSJE Z WBUDOWANĄ ELEKTRONIKĄ

Inną rozwijającą się grupą przekaźników aplikacyjnych są wykonania z wbudowaną elektroniką, czyli wersje czasowe oraz nadzorcze. Terminy te kryją tak naprawdę sterowniki elektroniczne o niewielkiej funkcjonalności z możliwością ustawienia pokrętłami czasów, progów i histerezy reakcji na zdarzenia, takie jak przekroczenie ustalonego poziomu. W sumie już nie są to przekaźniki elektromagnetyczne, tylko ogólnie "przekaźniki". Takie wersje to użyteczne komponenty dla automatyki, pozwalające na modernizację i budowę instalacji oraz urządzeń. Zapewniają sterowanie oświetleniem w garażu, wentylacją w hali, załączanie oświetlenia przeszkodowego i podobne zadania, nie wymagają programowana, ale jednocześnie są więcej, niż samym przekaźnikiem.

W największej części elementy te pełnią zadania ochronne, a więc wyłączają zasilanie przy przekroczeniu temperatury, napięcia, prądu w obwodzie i przeznaczone są do pracy w instalacjach 1-fazowych prądu przemiennego, ale spotyka się też wersje dla sieci trójfazowej. Z kolei wersje czasowe to elementy, które załączają lub odłączają obwód po zadanym czasie, realizują opóźnienie załączenia lub wyłączenia. Liczba kombinacji i wersji oraz możliwości tych komponentów są imponujące, co zapewne jest podstawą ich użyteczności. Elektronizacja przekaźników daje też możliwości poprawy parametrów oraz jest sposobem na zwiększenie zainteresowania danym typem, np. bistabilnym.

Mimo wielu innowacyjnych produktów, które zaprezentowano w ostatnich latach, znaczenie rynkowe przekaźników z wbudowaną elektroniką, co pokazało nasze badanie ankietowe, jest ułamkiem tego, co zapewniają wersje elektromagnetyczne. Ale na pewno jest to dla producentów przekaźników istotny kierunek rozwoju, poszerzający rynek. To zapewne wynika ze specyfiki omawianej branży, gdzie ewolucja produktów przebiega dość wolno i na ich przyjęcie przez rynek trzeba zapewne sporo poczekać.

STYCZNIK KONTRA PRZEKAŹNIK

Poza przekaźnikami na rynku funkcjonują tzw. styczniki. Nazwa ta określa specjalizowany przekaźnik dużej mocy przeznaczony do pracy w aplikacjach przemysłowych i energoelektronicznych. Styczniki są komponentami do montażu w obudowie lub na szynie DIN i mają obudowę, która pozwala na zamocowanie w chassis. Są przeznaczone do łączenia dużych obciążeń, o mocy nawet wielu kilowatów, trójfazowych silników, dużych grzejników oraz całych systemów oświetlenia przemysłowego i obiektowego. Styczniki są łączone przewodami o dużym przekroju i mają wyprowadzenia przystosowane do montażu grubych kabli. Ich cewka z reguły jest zasilana napięciem 24 VDC lub napięciem przemiennym 230 VAC. Zawierają kilka styków, typowo trzy duże pary styków dla trzech obwodów fazowych, ale czasem też i jedną małą parę do sygnalizacji.

SSR I IPS

W ofertach producentów przekaźników elektromagnetycznych pojawiają się też wersje półprzewodnikowe, niemniej nie znaczy to, że firmy te poszerzają w tym kierunku profil produkcji. Regułą jest to, że producent ma szeroką ofertę, ale produkuje samodzielnie tylko jej część, tę, w której ma największe kompetencje, maszyny i takie przekaźniki, które uznaje za strategiczne dla biznesu. Mniej strategiczne pozycje kupuje się jako elementy gotowe u innych wytwórców. To samo dotyczy elementów przekaźników, np. cewek, które też można kupić u specjalizowanych producentów. W tym wszystkim chodzi o koszty i specjalizację w biznesie. Najpopularniejsze przekaźniki miniaturowe wytwarzane są na liniach automatycznych, które są drogie, ale bardzo wydajne. Jednocześnie zapewniają one wysoką jakość, stąd bez sensu byłoby nie skorzystać z ich potencjału. Podobnie jest z popularnymi przekaźnikami SSR o niewielkiej obciążalności, które wyglądają identycznie, mają takie same parametry oraz różnią się jedynie oznaczeniem. To zjawisko jest pozytywne, gdyż pośrednio oznacza, że takie wspólne produkty są znakomitym komponentem o bezdyskusyjnej jakości, spełniającym wymagania wielu czołowych producentów. Z takich samych powodów kooperacja w produkcji ma znaczenie pozytywne dla branży, bo wzrost specjalizacji i automatyzacji prowadzi do lepszej jakości oraz jednocześnie zapewnia możliwie najniższe ceny wynikające z działania w dużej skali.

Przekaźniki półprzewodnikowe są produktem, który jest stosowany w aplikacjach automatyki budynkowej, osprzęcie instalacyjnym (termostaty, regulatory) i podobnych rozwiązaniach, gdzie elementy te załączają grzałki, oświetlenie. Rozwiązania o dużej mocy przeznaczone dla energoelektroniki to już inna klasa rozwiązań, co widać nawet na oko po obudowie, zaś w elektronice konsumenckiej, motoryzacji i innych urządzeniach o dużej skali złożoności raczej korzysta się z IPS-ów, a więc elektronicznych przełączników półprzewodnikowych zawierających poza samymi elementami mocy także logikę sterującą i zabezpieczenia.

WIELE NOWOŚCI I DROBNYCH INNOWACJI

Cały czas na rynku pojawiają się nowe rozwiązania, niemniej rozwój ma ewolucyjny charakter bez przełomowych premier i kamieni milowych w rozwoju. Dominują systematyczne usprawnienia – pojawiają się mniejsze wersje albo o większej obciążalności. Coraz więcej istniejących typów przekaźników można kupić w wersji energooszczędnej z czułą cewką, pojawiają się też wykonania ciche. Konstruktor ma coraz większy wybór wersji specjalistycznych, np. nadających się do przełączania wysokich napięć stałych, ze stykami odpornymi na sklejanie się od wysokich prądów udarowych lub też rozwiązań skutecznie komutujące małe prądy.

Poza kwestiami technicznymi przekaźniki zyskują szczelne obudowy zapewniające odporność środowiskową, mające wzmocnioną izolację między cewką i stykami, a w ich kartach katalogowych pojawiają się kolejne certyfikaty jakości potwierdzające deklaracje producenta.

Przełączniki, przyciski i klawiatury – użyteczne i niezbędne

Kiepskiej jakości przełącznik lub klawiatura są w stanie skutecznie popsuć opinię o producencie urządzenia wśród wielu klientów, a firmę wpędzić w kosztowny serwis. W miarę upływu lat coraz więcej osób jest świadomych takiego ryzyka i co jest również, ważne, ma obecnie fundusze na to, aby go minimalizować. Temat jakości elementów elektromechanicznych zawsze w omawianym sektorze był istotny i dyskutowany.

Dystrybutorzy i producenci wkładają od lat wiele wysiłku w promocję elementów markowych wśród firm elektronicznych, cierpliwie pracując nad zmianą podejścia klientów do zakupów. Te ich działania przynoszą na szczęście efekty. W ostatnich latach jakość przełączników i przycisków znacznie się poprawiła, a udział tandety jest wyraźnie mniejszy. Wytwórcy udoskonalili technologię, poprawili precyzję działania tych elementów i sięgnęli po nowe, lepsze materiały, aby zdjąć z elementów elektromechanicznych piętno najsłabszego ogniwa.

DOTYK KONTRA NACISK

Obszar określany terminem interfejs człowiek-maszyna (Human Machine Interface, HMI) to sfera zagadnień związanych z dwukierunkową komunikacją z urządzeniami. Są to nie tylko aspekty techniczne, gdyż wiele uwagi poświęca się zagadnieniom takim, jak percepcja przez człowieka komunikatów płynących od urządzeń, wygoda i intuicyjność sterowania nimi, a także temu, aby mechanizmy wymiany informacji były jednoznaczne i spójne.

Przełączniki i klawiatury są bardzo istotną częścią HMI, ale w kontekście rozwoju rynku przy ich omawianiu zawsze pojawia się temat technologii dotykowych, a więc rozwiązań pozbawionych elementów mechanicznych. Są one dostępne w postaci pojedynczych elementów, czasem nawet w wersjach identycznych jak rozwiązania mechaniczne (tzw. zamienniki) oraz wykonywane na bazie wyświetlaczy z ekranem dotykowym.

Ta nowa technologia zdobyła uznanie w wielu aplikacjach mobilnych oraz grupie specyficznych rozwiązań takich jak automaty sprzedaży, punkty informacyjne. Ale mimo sporego potencjału technicznego nie widać, aby po początkowej fazie szybkiej ekspansji technologii zdobywała dalej szybko rynek i pojawiała się w kolejnych grupach aplikacji.

Powodów jest co najmniej kilka. Przełączniki mechaniczne i klawiatury zapewniają dzisiaj dużą trwałość mechaniczną i elektryczną oraz mają interesujące wzornictwo, a także dużą funkcjonalność. Ich zastąpienie przez elementy dotykowe, nawet gdy są to zamienniki 1:1, nie przynosi wielkiego skoku jakościowego.