Komponenty indukcyjne, transformatory i filtry

SZEROKI ASORTYMENT

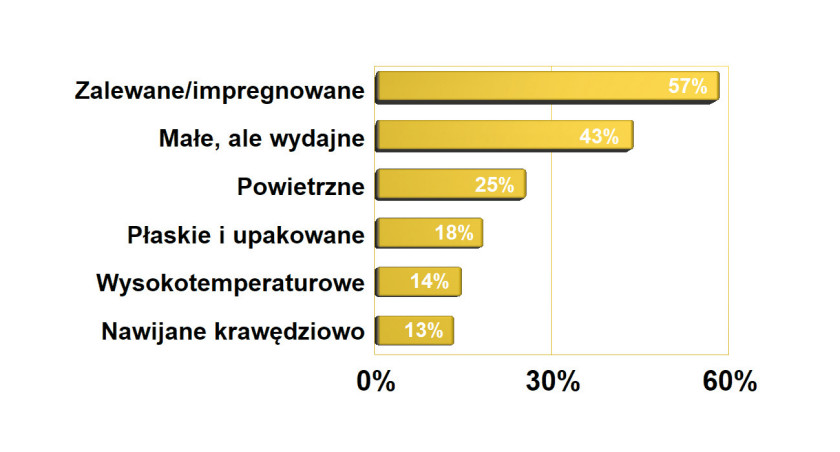

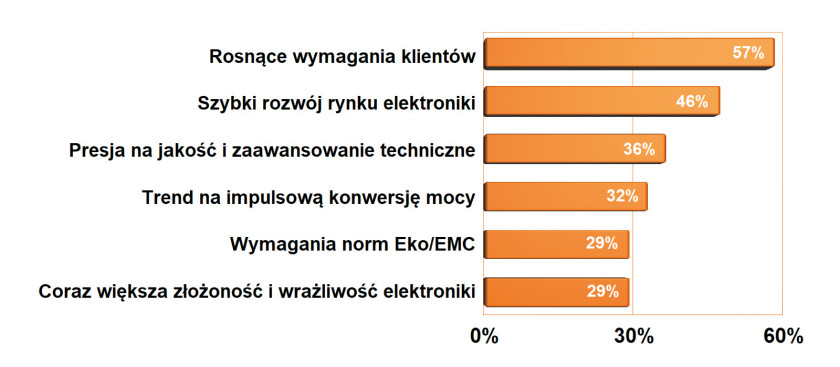

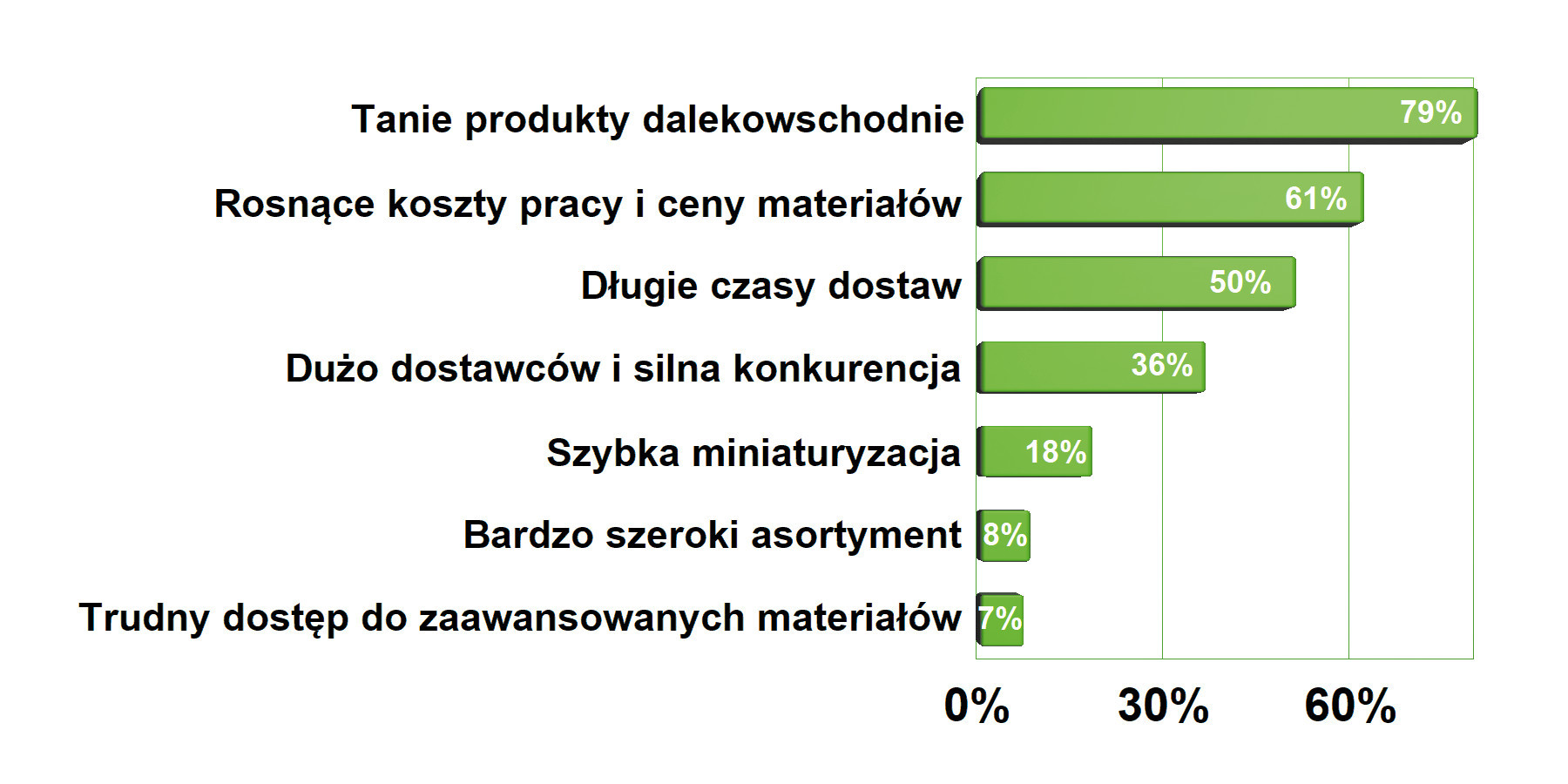

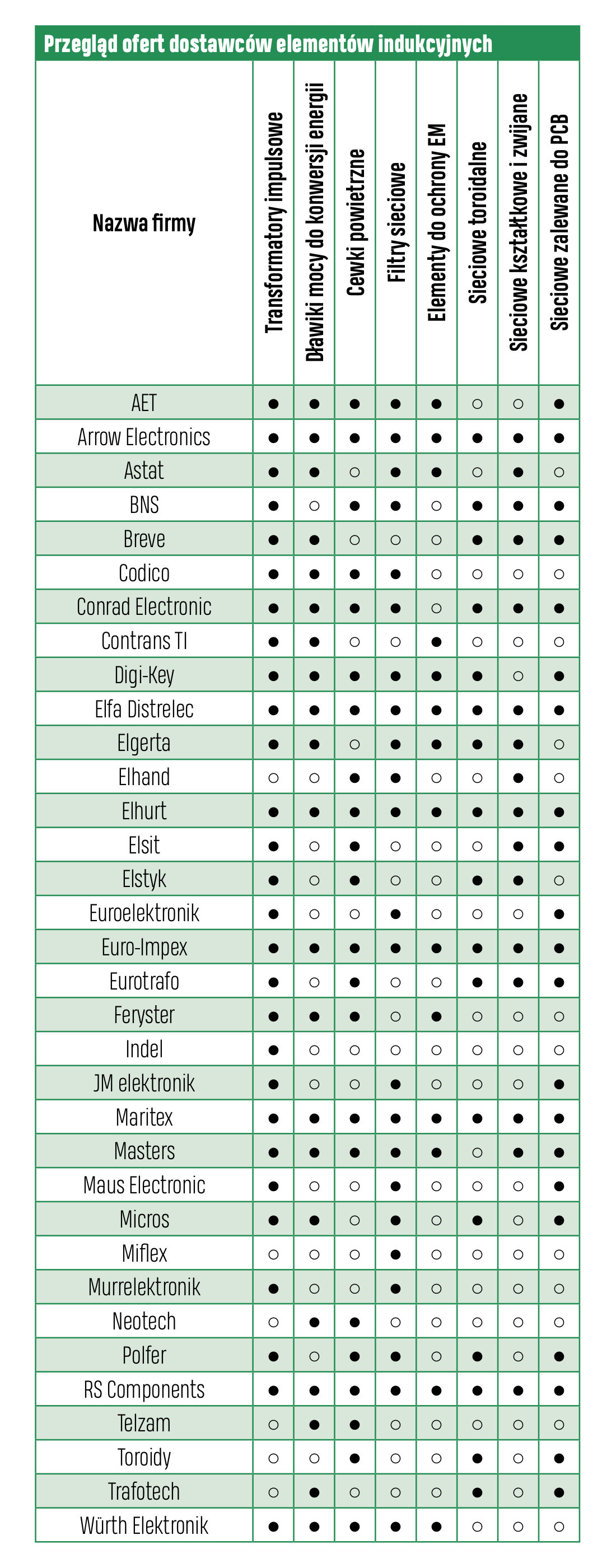

Cechą rynku elementów indukcyjnych jest bardzo szeroki asortyment produktów katalogowych. Z jednej strony jest to zjawisko pozytywne, bo pozwala dobrać do aplikacji najlepiej pasujący element przy minimalnym kompromisie w parametrach. Z drugiej strony na te mniej popularne typy cewek i dławików trzeba często długo czekać, bo możliwości ich magazynowania u dystrybutorów są niestety ograniczone. Dlatego w praktyce wybór produktu jest wielki tylko, teoretycznie, bo ogranicza się do tego co jest w magazynach, a nie w katalogu. Szczęśliwie ten problem dotyczy głównie małych elementów, tych do montażu na PCB, które potrzebne są w dużych ilościach. Wersje do układów dużej mocy z reguły produkowane są na zamówienie, ale granice między produkcją katalogową wydają się płynne i wszystko zależy od konkretnego przypadku.

ELEMENTY NA ZAMÓWIENIE

Można powiedzieć, że im bardziej wymagająca aplikacja, im większa moc, poziomy napięć i prądów, tym większe znaczenie dla zapewnienia jej dużej funkcjonalności mają elementy indukcyjne produkowane według indywidualnej specyfikacji. Zapewniają one najlepsze parametry użytkowe, dobre dopasowanie do warunków montażu w obudowie lub też do wymagań elektrycznych oraz są w najmniejszym stopniu jakimś kompromisem. Z takich przyczyn udział produkcji na zamówienie w krajowej branży podzespołów indukcyjnych jest i zawsze był bardzo duży. Dla większości krajowych firm produkcyjnych jest to wręcz podstawa aktywności biznesowej.

Produkowanie elementów indukcyjnych na zamówienie klientów, a więc wg indywidualnie przygotowanej specyfikacji, ułatwia też utrzymanie niezbędnych inwestycji w park maszynowy. Standardowe elementy takie jak dławiki do montażu na płytkach drukowanych są produkowane na wydajnych i zaawansowanych automatach. Takie urządzenia są drogie i z punktu widzenia krajowych przedsiębiorstw za bardzo wydajne, a na skutek dużej konkurencji marże przy sprzedaży są małe. Produkcja na zamówienie opiera się na znacznie mniejszych seriach, wyrobach niestandardowych, a więc wymaga maszyn o mniejszym stopniu autonomiczności, takich, które wspierają działanie ludzi. Od strony inwestycyjnej jest to rozwiązanie tańsze, a więc znajduje się w zasięgu inwestycyjnym także mniejszych firm, bo jak wiadomo, ceny wszystkich urządzeń produkcyjnych są bardzo wysokie.

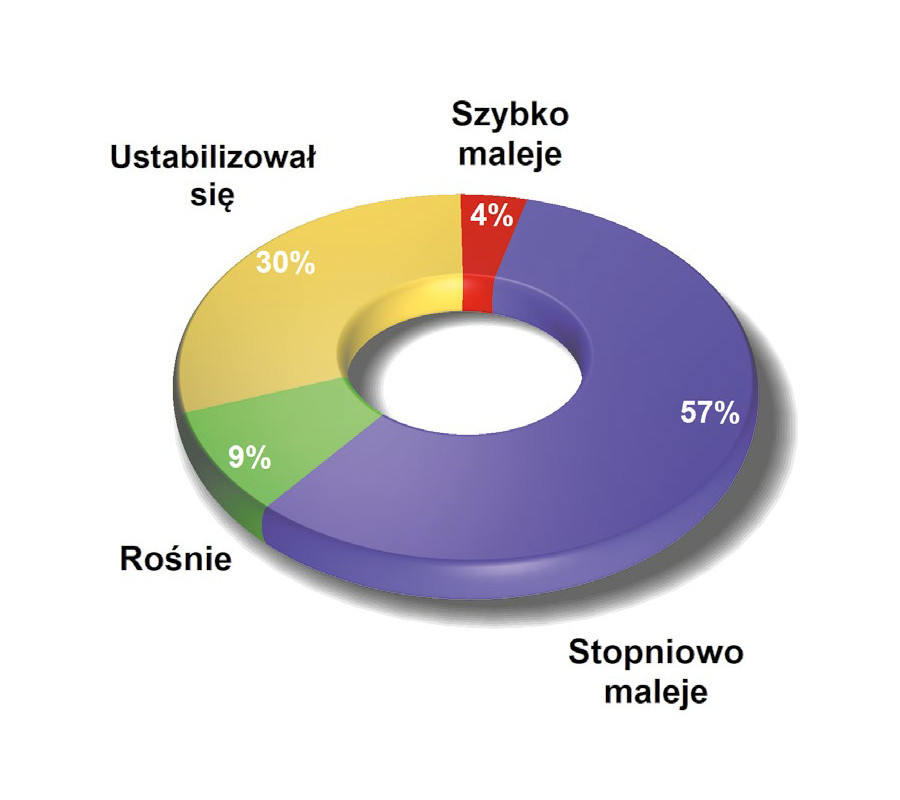

Przez lata taki pomysł na biznes dobrze się sprawdzał i zapewniał szybki rozwój. Dopiero w ostatnich dwóch latach, na skutek rosnących kosztów pracy, ograniczonej dostępności do kadry i dużej konkurencji na rynku, ta koncepcja działalności daje nieco gorsze wyniki. Ale nie jest to wynik specyfiki branży, tylko raczej wpływu polityki na całą sferę przemysłową w Polsce.

MINIATURYZACJA

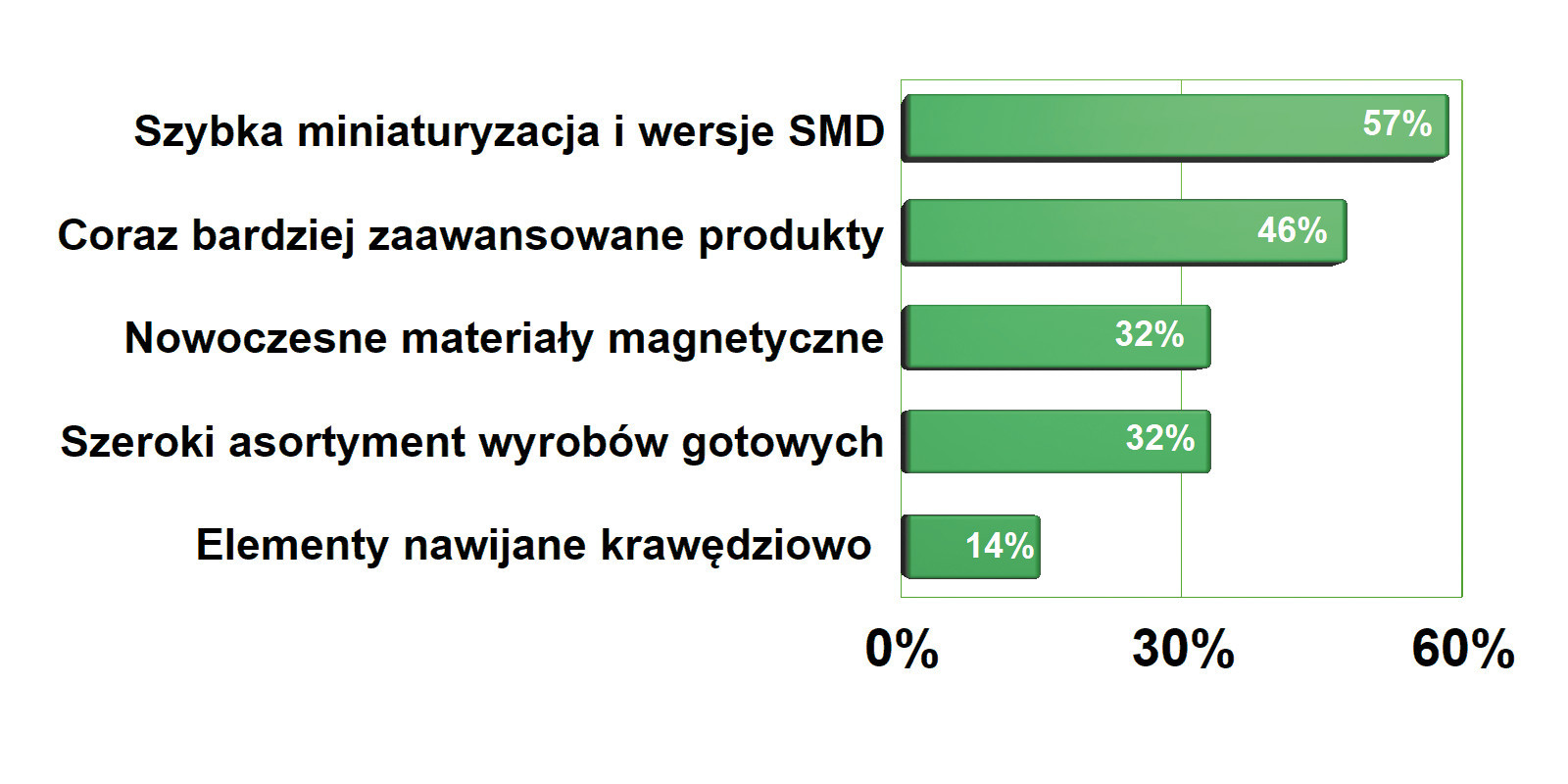

Miniaturyzacja jest jednym z najważniejszych trendów zmieniających rynek podzespołów indukcyjnych, bo z każdą kolejną generacją urządzenia elektroniczne są mniejsze, kompaktowe i przenośne. Rynek oczekuje, że zasilacze, ładowarki, falowniki nawet o dużych mocach będą miały małe rozmiary i z pewnością takie oczekiwania są miarą nowoczesności tych urządzeń. Skoro sprawność systemów zasilania przekracza bez problemu 95%, a nowoczesne półprzewodniki z SiC i GaN dają możliwość komutowania prądu z dużą częstotliwością, przy wysokim napięciu i ogromnych wartościach prądu, to elementy indukcyjne, takie jak transformatory i dławiki, muszą te globalne trendy wspierać.

Poza układami konwersji energii cała reszta elementów indukcyjnych też musi być coraz mniejsza. Dotyczy to filtrów, cewek w.cz., dławików lub też transformatorów sygnałowych, które nie mogą górować gabarytami nad resztą elektroniki. Miniaturyzacja ma nawet wpływ na transformatory sieciowe, tyle że niewielki i daleki od spektakularnych osiągnięć widocznych w rozwiązaniach do aplikacji impulsowych. Dla komponentów małej mocy standardem jest obecnie dopasowanie do montażu SMT i obudowa o bardzo zwartej konstrukcji.

Miniaturyzacji sprzyja ponadto konieczność ograniczania emisji zaburzeń elektromagnetycznych. Z reguły małe dławiki i transformatory są z zewnątrz zabudowane materiałem magnetycznym, a uzwojenie mają ukryte w środku. Dzięki temu zakłócenia są minimalne. Te na większy zakres mocy też są stosunkowo mocno zabudowane, a dodatkowo do ich nawijania używa się specjalnych drutów: licy, taśmy miedzianej i podobnych, dzięki czemu mają zwartą konstrukcję mechaniczną.

NOWOŚCI W ZAKRESIE ELEMENTÓW INDUKCYJNYCH

Nowości w elementach indukcyjnych są bardzo liczne, ale niestety także mało widoczne. Ogólnie są to innowacje w zakresie materiałów magnetycznych, kształtów rdzeni, a więc pośrednio sposobu wykonania uzwojenia oraz używanych materiałów nawojowych i typów kontaktów elektrycznych. W dalszej kolejności są to zaawansowane materiały izolacyjne, skomplikowane procesy impregnacji oraz montażu takich komponentów.

Nowe materiały magnetyczne zapewniają pracę przy dość dużych częstotliwościach kluczowania, mają małe straty związane z przemagnesowaniem, wysoką indukcję nasycenia i podobne właściwości. Producenci proponują w tym obszarze ferryty z różnych mieszanek tlenków metali, spiekane drobiny czystego metalu o różnym ziarnie, składzie i proporcjach. Eksperymenty prowadzone są w wielu kierunkach także w stronę rozwiązań hybrydowych, a więc bazujących na ferrytach łączonych ze sproszkowanym metalem, po to, aby zapewnić dużą indukcję nasycenia, małe straty na histerezie, a także aby uzyskać łagodną charakterystykę zapobiegającą gwałtownemu spadkowi indukcyjności przy zbliżeniu się z wartością prądu do nasycenia. Można też powiedzieć, że celem zmian w nowościach jest maksymalizacja energii, jaką można zgromadzić w danej objętości materiału magnetycznego lub uzyskanie najkorzystniejszego stosunku ceny do parametrów.

Kształt materiału magnetycznego, czyli kształtka, decyduje o możliwości nawinięcia uzwojenia o określonej objętości, możliwości integracji w obudowie a także o indukcyjności rozproszenia. W tym obszarze też sporo się dzieje, a liczba ofertowych wariacji na temat kształtów takich jak "R" lub "E" stale się zwiększa.

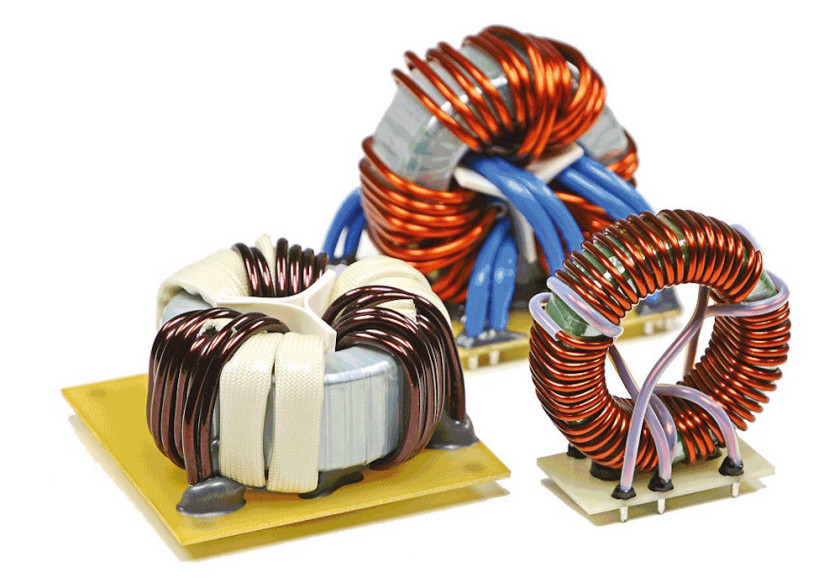

Druty nawojowe coraz częściej są wielokrotnie izolowane (nawet czterokrotnie), co ułatwia zapewnienie wysokiej jakości izolacji elektrycznej. Dzięki takim drutom większość zasilaczy powszechnego użytku jest dzisiaj wykonana w tzw. II klasie izolacji i nie wymaga uziemiania. Coraz częściej transformatory nawijane są licami oraz także taśmą miedzianą (drutem o przekroju prostokątnym), który pozwala lepiej wypełnić okno nawojowe. Jest to tzw. nawijanie krawędziowe.

Nowe materiały izolacyjne dają możliwość ciasnego upakowania uzwojenia i jednoczesnego zachowania bezpieczeństwa. Są one ważne, bo z roku na rok układy impulsowe pracują przy wyższych napięciach wejściowych.

TRANSFORMATORY SIECIOWE

Transformatory sieciowe są doskonałym przykładem na to, że procesy dziejące się we współczesnej technice, o ile nie dotyczą obszaru konsumenckiego, rozciągają się na lata, a nierzadko nawet na dekady. Dlatego zasilanie impulsowe nie wyrzuciło transformatorów sieciowych na margines i dalej znajdują one zastosowanie w kilku ważnych niszach techniki.

Pierwszą są urządzenia, w których trzeba zapewnić dużą odporność na przepięcia i stany nieustalone pojawiające się w sieci energetycznej, które zwykłym transformatorom nie szkodzą, a dla zasilaczy impulsowych potrafią być zabójcze. W aplikacjach przemysłowych, instalacjach w terenie, miejscach, gdzie zasilanie jest dalekie od stabilności, bo np. jest dostarczane linią napowietrzną, dalej zwykłe transformatory są stosowane z tego powodu.

Zasilacze z transformatorami sieciowymi są też elementami precyzyjnej aparatury, sprzętu medycznego i innych rozwiązań, gdzie istotne jest uzyskanie dużej czułości – np. w układach radiowych. Przy transformatorach sieciowych nie ma problemu z zakłóceniami wywołanymi przełączaniem prądu z wysoką częstotliwością.

Po trzecie, wersje sieciowe potrafią działać bezawaryjnie przez długie lata, czego niestety nie da się powiedzieć o jednostkach impulsowych za podobne pieniądze. Gdy konieczne jest zapewnienie pewnej pracy urządzenia w warunkach podwyższonej temperatury i przez długi czas, np. powyżej 5 lat, rozwiązanie takie wydaje się pewniejsze. Instalacja przemysłowa w terenie, rozproszone systemy instalowane na obiektach również wykorzystują zasilacze tego typu także z opisanych względów.

Na koniec warto przypomnieć o rozwiązaniach niszowych, np. sprzęt audio wysokiej klasy, sprzęt estradowy, w których konserwatywne podejście do projektu jest czymś oczekiwanym przez rynek.

ELEKTROMOBILNOŚĆ

Elektromobilność ma znaczący i pozytywny wpływ na rozwój sektora komponentów indukcyjnych, gdyż w tym obszarze zagadnienia związane z konwersją mocy stają się pierwszoplanowe. To, że w naszym kraju termin ten niekoniecznie wiąże się z masową motoryzacją i transportem osobistym, nie ma tutaj akurat żadnego znaczenia, bo w zasięgu aktywności firm krajowych znajdują się głównie zastosowania profesjonalne związane z transportem w zakładach przemysłowych, magazynach itp. W tym wycinku elektromobilności koncentruje się aktywność i dla takich pojazdów konstruowane są konwertery zasilające, ładowarki, napędy silników, których wspólnym mianownikiem jest to, że opierają się one na impulsowej konwersji mocy. Zaawansowane podzespoły indukcyjne determinują w nich moc maksymalną, objętość i ciężar.

Znaczącym klientem na podzespoły indukcyjne staje się też tradycyjna motoryzacja, bo udział elektroniki w pojazdach stale rośnie. Niemniej w warunkach krajowych obszar ten jest obsługiwany przez krajowe firmy tylko w niewielkim zakresie, głównie na rzecz firm usługowych pracujących na jej zlecenie lub tworzących dodatki, takie jak oświetlenie, nagłośnienie, instalacje specjalne.

BEZPIECZEŃSTWO SYSTEMÓW ZASILAJĄCYCH

Mówiąc o elementach indukcyjnych najczęściej myśli się o transformatorach (impulsowych lub sieciowych), bo są one głównym elementem zasilaczy, ładowarek i przetwornic. Poza obniżaniem napięcia elementy te zapewniają także wymagane normami bezpieczeństwo użytkowania urządzeń i zagadnienie to w ostatnich latach staje się coraz istotniejsze i dostrzegalnie wpływa na rozwój branży. Świadomość klientów na temat wykonania elementów indukcyjnych zgodnie z wymaganiami norm bezpieczeństwa, certyfikacji niepalności UL i takich samych wymagań w stosunku do używanych materiałów konstrukcyjnych znacznie się zwiększyła w ostatnich latach. W ramach poprawiającej się dbałości firm o warunki pracy personelu rośnie także zapotrzebowanie na transformatory separacyjne, automatykę przeciążeniową i podobne elementy ochronne.

Transformatory są głównym elementem zapewniającym izolację galwaniczną między stroną pierwotną dołączoną do sieci a wtórną, czyli chronią użytkowników od niebezpiecznych potencjałów w sieci i eliminują możliwość porażenia prądem. Jakość takiej ochrony stale się poprawia, także w aspekcie długoterminowej eksploatacji urządzeń. Aby ją zapewnić na wysokim poziomie, nierzadko przewyższającym to, co wymaga norma, producenci stosują wielokrotnie izolowane druty nawojowe, podwójne warstwy taśm między uzwojeniami, karkasy wielosekcyjne oraz także impregnują uzwojenia. Zapewnienie skutecznej ochrony pozwala na konstrukcję zasilaczy niewymagającą uziemiania i widać, że rynek zmienia się w tym kierunku, czyli że większość rozwiązań konsumenckich to zasilacze z drugą klasą ochronności. Oczywiście zagadnienia bezpieczeństwa dotyczą także oświetlenia LED- owego, co dodatkowo uwypukla znaczenie tych zagadnień.

CORAZ WIĘKSZE OCZEKIWANIA KLIENTÓW

Klienci oczekują dzisiaj od transformatorów sieciowych i elementów indukcyjnych do układów impulsowych niezawodnego działania, wysokiej odporności na narażenia środowiskowe, przeciążenia, podwyższoną temperaturę i stany nieustalone. W elementach indukcyjnych zagadnienia te są bardzo istotne z kilku powodów. Po pierwsze narażenia mechaniczne, a więc wibracje i udary wywołują naprężenia w uzwojeniach i rdzeniu, i prowadzą do pękania, rozklejania rdzeni oraz rozszczelnienia zalew i uszkodzeń izolacji. Elementy te mają nierzadko dużą masę, przez co przeciążenia mechaniczne wynikające z drgań są problemem dla jakości w aspekcie długoterminowym. Podobnie negatywnie na konstrukcję oddziałują zmiany temperatury i wilgotności, które dodatkowo są w stanie pogorszyć z czasem jakość izolacji, niemniej zjawisk fizycznych, które w długiej perspektywie wpływają na jakość elementów, jest więcej. Ich wpływ na jakość zwiększa się też wraz z obciążeniem mocą, bo płynące duże prądy powodują nagrzewanie, wysokie napięcia niszczą izolację na skutek mikrowyładowań, a wysokie wartości indukcji magnetycznej na skutek efektu magnetostrykcji mogą wywołać przykre dla ucha piski. Takie problemy są codziennością dla producentów podzespołów indukcyjnych, ale coraz większa świadomość projektantów elektroniki pomaga w rozwoju rynku w kierunku długoterminowej jakości.

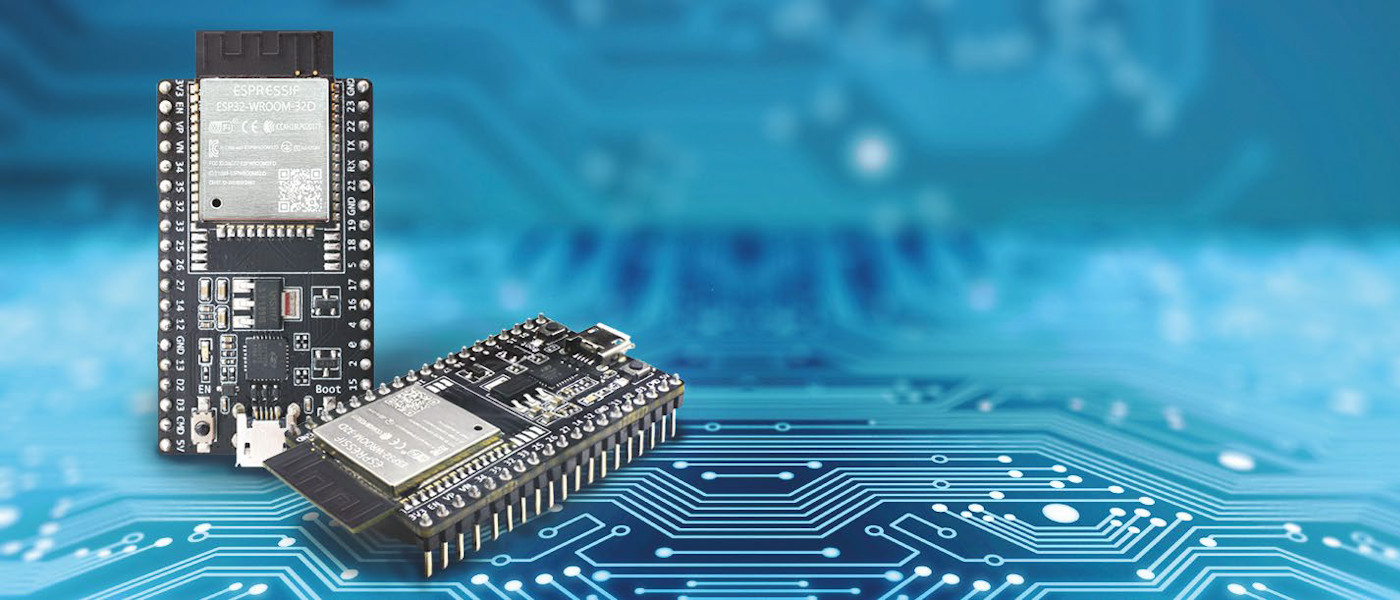

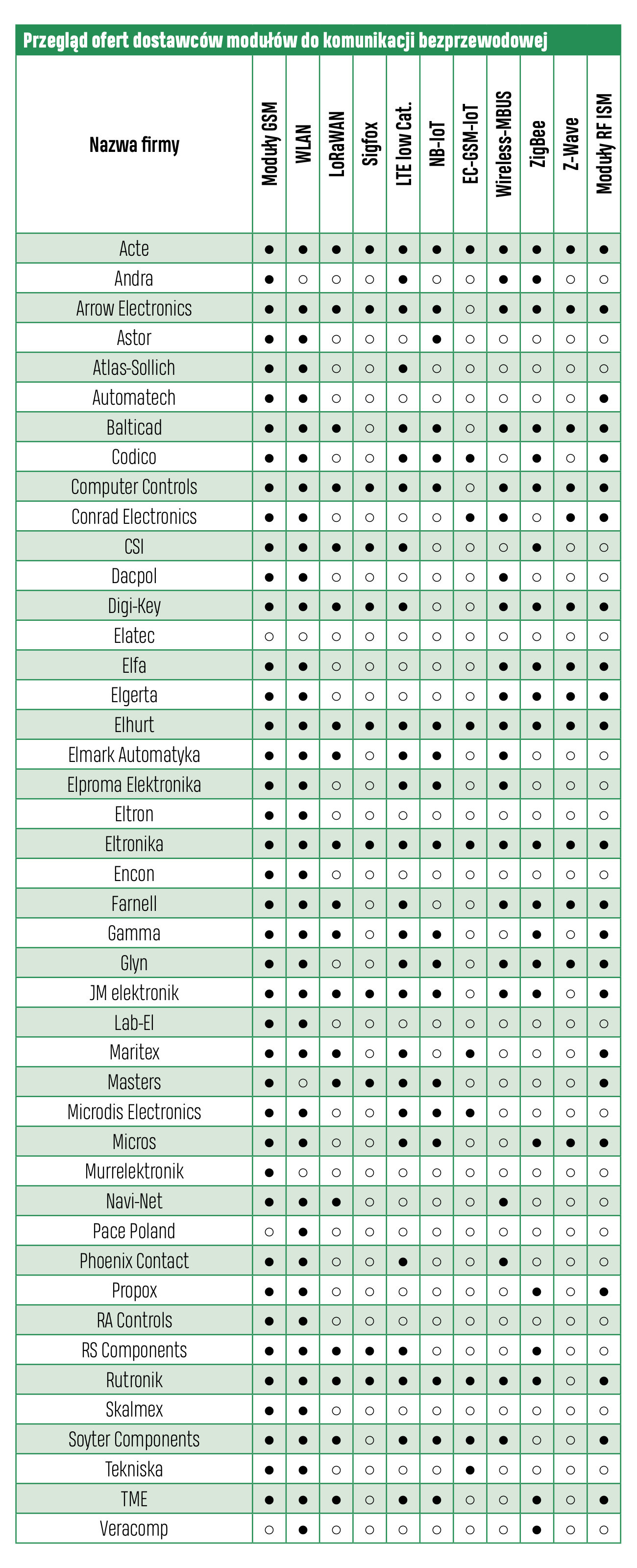

Urządzenia i moduły do komunikacji bezprzewodowej

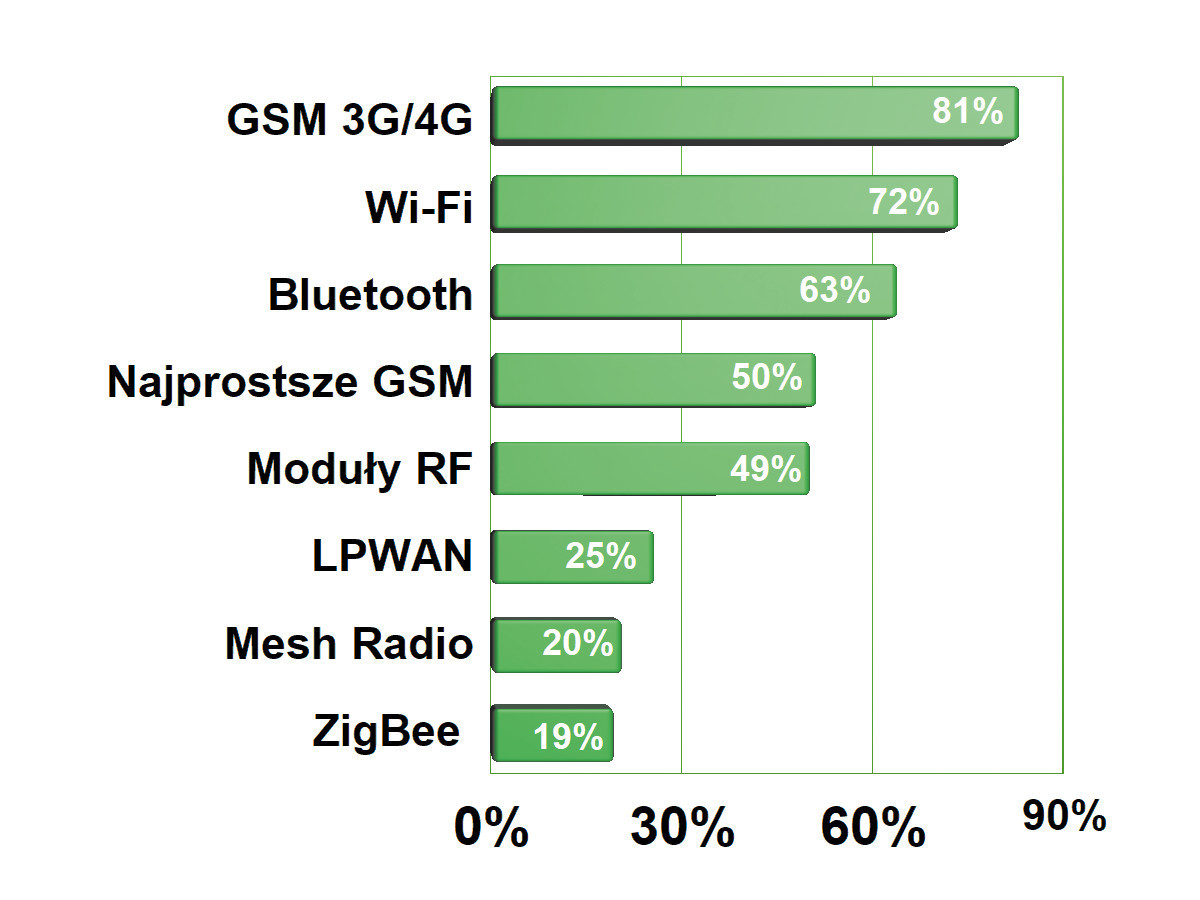

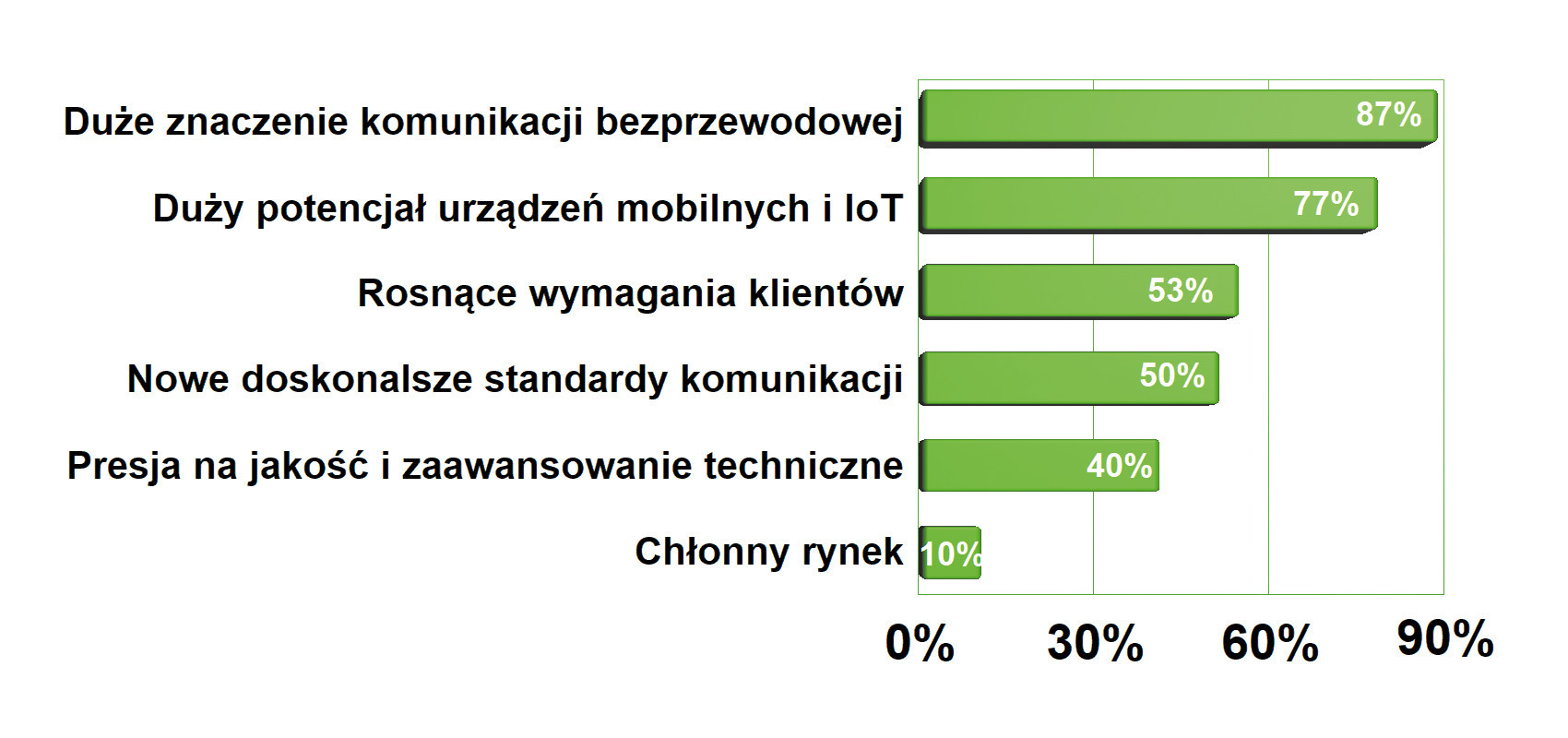

Jeszcze kilka lat temu, chcąc zaimplementować obsługę sieci bezprzewodowej w urządzeniu elektronicznym, konstruktor miał dosyć łatwy wybór. Do komunikacji na duże odległości wybierał modem sieci komórkowej, do łączenia się z siecią lokalną sięgał po Wi- Fi, a na potrzeby sieci osobistej stosował Bluetooth. Oczywiście zawsze istniała możliwość realizacji jakiejś indywidualnej metody bezprzewodowego transferu danych – jak np. w modułach radiowych, ale mimo to była to decyzja względnie prosta.

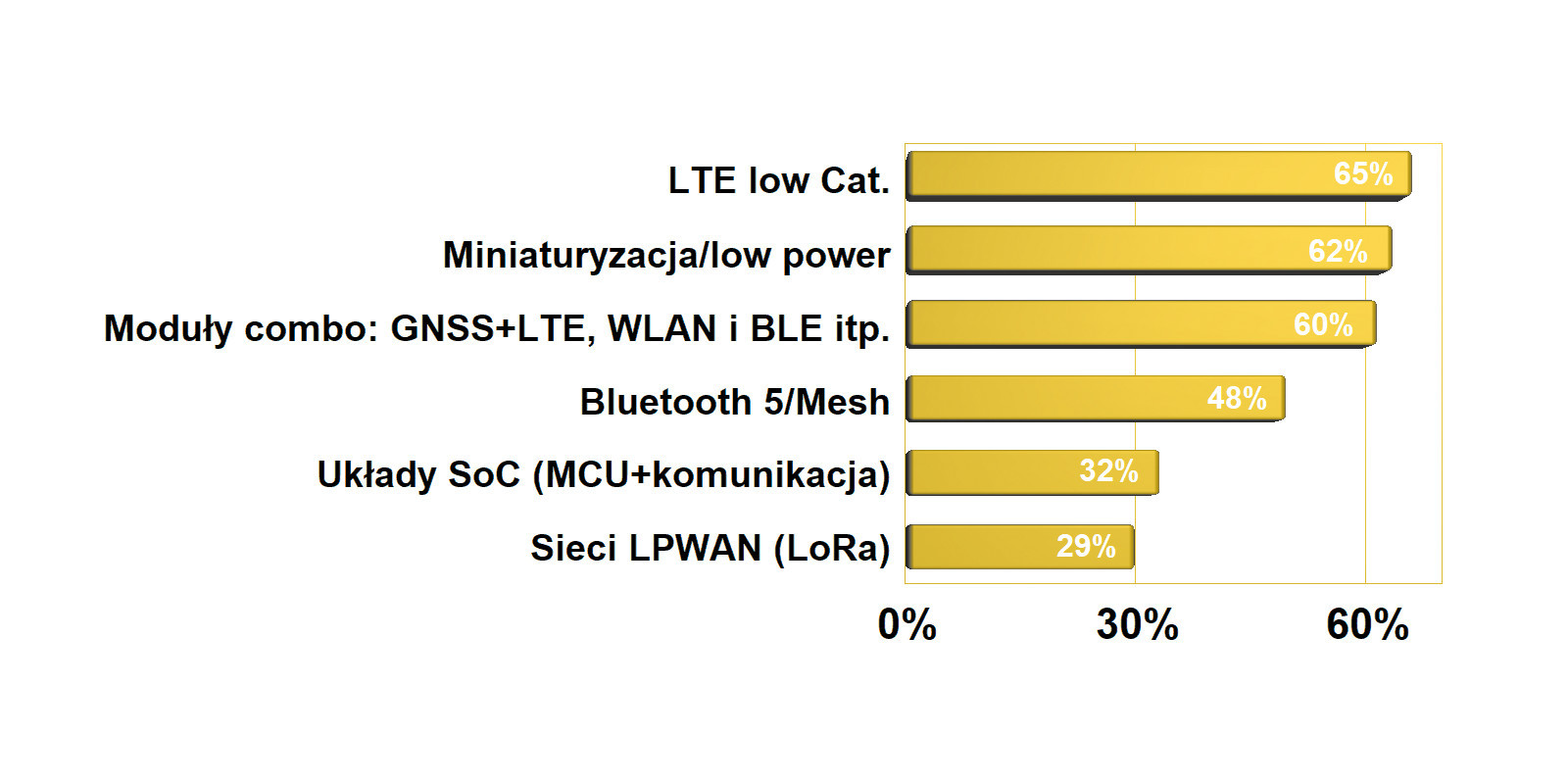

Czasy się jednak zmieniły, a oczekiwania klientów w zakresie bezprzewodowości i nowe koncepcje jak IoT lub Przemysł 4.0 sprawiły, że powstały nowe standardy oraz zupełnie nowe wersje już istniejących. Obecnie konstruktor ma do wyboru nie tylko kilka generacji sieci Wi-Fi i komórkokomórkowych oraz Bluetooth różniących się nie tylko przepustowością, ale i poborem mocy, z których nie wszystkie są ze sobą kompatybilne. Do dyspozycji są też inne rozwiązania otwarte, takie jak 6LoWPAN oraz własnościowe protokoły, takie jak MiWi, LoRa, przemysłowe np. Wireless Mbus. Do tego RFID coraz częściej zastępowane jest implementacjami NFC, które także umożliwia dwukierunkową komunikację bezprzewodową. Razem tworzy to ogromne możliwości i wybrania optymalnego rozwiązania do projektu staje się coraz bardziej skomplikowane.

BLUETOOTH – SZYBKA EWOLUCJA NAKRĘCANA SMARTFONAMI

W zakresie komunikacji Bluetooth rozwój produktów oraz samego standardu w ostatnich latach bardzo przyspieszył. Aktualnie mamy już 5. wersję, która zapewnia daleko lepsze parametry w porównaniu do poprzedników, zwłaszcza tych sprzed wersji BLE. Bluetooth jest najważniejszą opcją w zakresie komunikacji do aplikacji IoT, bo zapewnia dobre własności energetyczne, wystarczający zasięg i jest dostępny w szerokiej gamie rozwiązań układowych w postaci modułów, samych chipów, mikrokontrolerów z wbudowanym układem tego typu. Do popularności przyczynia się też to, że część aplikacji IoT jest obsługiwana za pomocą smartfonów, właśnie z użyciem Bluetooth.

Bluetooth jest przydatny wszędzie tam, gdzie konieczne jest nie tyle stworzenie całej sieci, ale jedynie przesłanie, od czasu do czasu, niewielkich ilości informacji na niedużą odległość. Wersje BLE (4 i wyżej) pozwalają tworzyć energooszczędne urządzenia pracujące na zasilaniu bateryjnym przez wiele lat i np. przesyłające od czasu do czasu zgromadzone dane. Jeśli natomiast projektowane urządzenie będzie obsługiwało zarówno Wi- Fi, jak i Bluetooth, warto sięgnąć po zintegrowane układy, które pozwalają na użycie obu tych standardów, bez potrzeby stosowania dodatkowych chipów.

RF – CIĄGLE SIĘ ROZWIJA, BO SĄ NIEDROGIE MCU Z RF

Komunikacja bezprzewodowa to także rozwiązania, gdzie nie są potrzebne standardy, duży zasięg lub przepustowość. To np. aplikacje, gdzie dochodzi do podłączenia jednego urządzenia do sterownika, takie, gdzie nie ma wymagań co do interoperacyjności na poziomie protokołu i podobne, a więc ogólnie klasa zagadnień o mniejszej złożoności, są z powodzeniem obsługiwane za pomocą modułów radiowych, wbudowanych do wnętrza MCU, dostępnych w formie specjalizowanego chipa. Są to też moduły hybrydowych transceiverów radiowych przeznaczone do wlutowania w PCB, które na wejściu i wyjściu dostarczają/przyjmują zwykły sygnał cyfrowy, realizując modulację/demodulację oraz obsługę toru w.cz.

Takie produkty zawsze będą, bo nikt rozsądny nie będzie robił bezprzewodowego dzwonka do bramy na czymś bardziej skomplikowanym. Taki moduł pozwala też zrobić rozwiązanie o charakterze własnościowym (np. w alarmie) z użyciem specyficznego kodowania lub szyfrowania, bo nie zawsze korzystanie z czegoś znanego jest rozsądne. Jak wiadomo, w przypadku sieci bezprzewodowych zagadnienia bezpieczeństwa stają się coraz istotniejsze, a w przypadku aplikacji IoT nawet są postrzeganie jako kluczowe czynniki dla rozwoju. Stąd tor radiowy z własną obsługą transmisji bywa interesującym pomysłem w pewnej klasie aplikacji. Najlepszym przykładem mogą tu być właśnie bezprzewodowe systemy alarmowe.

ZIGBEE

Standard ZigBee nigdy nie odniósł takiego sukcesu, jak Wi- Fi czy Bluetooth, mimo że z założenia miał być bardziej niezawodny i energooszczędny. Może obsługiwać różne topologie sieciowe, w tym kratę (mesh). Urządzenia połączone w ten sposób retransmitują otrzymane dane, dzięki czemu nie ma potrzeby stosowania pojedynczych, centralnych węzłów, które pośredniczyłyby w komunikacji i od których działania zależałaby sprawność całej sieci. Co więcej, komunikacja ZigBee jest szyfrowana z użyciem 128-bitowego klucza i pomyślana z założeniem, że stosujące ją urządzenia będą wzbudzały się niemal tylko na czas transmisji. W efekcie stworzono standard, który pozwala na tworzenie bardzo energooszczędnej instalacji, stosowanej np. w rozległych sieciach czujnikowych. Z czasem powstały nowsze wersje standardu, ale w ich upowszechnieniu stała się problemem licencja, na której oferowana jest specyfikacja ZigBee. Pomimo że dla celów niekomercyjnych specyfikacja jest dostępna bezpłatnie, w przypadku zastosowań komercyjnych konieczna jest przynależność do organizacji ZigBee Alliance, która wiąże się z opłatami. To natomiast sprzeczne jest z założeniami licencji GPL, w związku z czym włączanie obsługi ZigBee do bibliotek oferowanych bezpłatnie w ramach licencji GPL stało się niemożliwe. Wydaje się, że powyższe ograniczenie sprawiło, że ZigBee nie przyjęło się w urządzeniach konsumenckich, a przyszłość w automatyce budynkowej jest mocno niepewna, gdyż najnowsza wersja standardu Bluetooth zapewnia podobną funkcjonalność, a jednocześnie jest znacznie bardziej rozpowszechniona.

USŁUGI

Im bardziej aplikacje komunikacji bezprzewodowej są powszechnie wykorzystywane, rozproszone po obiektach, w przestrzeni jako elementy systemów pomiarowych, sieci sensorycznych, tym bardziej rośnie znaczenie dostępności usług związanych z obsługą zdalną takich aplikacji. Aby możliwe było zainstalowanie czujnika w niedostępnym miejscu, konieczne jest zapewnienie bezobsługowości, czyli możliwości aktualizacji oprogramowania drogą radiową, monitorowania stanu, diagnozowania działania i podobnych. Dla wielu takich zastosowań jedną z najważniejszych funkcjonalności jest też możliwość automatycznego wysyłania danych do chmury, po to, aby dane były gromadzone w sposób automatyczny i dalej przetwarzane.

Z czasem znaczenie tej sfery działania aplikacji staje się coraz istotniejsze, a usługi towarzyszące takiej komunikacji, związane z obróbką danych stają się ważne. Nietrudno dostrzec, że w obszarze IoT mamy do dyspozycji coraz bardziej uniwersalne, zaawansowane platformy sprzętowe. Łatwiej kupić rozwiązania prawie gotowe, takie, które wymagają jedynie konfiguracji, niewielkiej integracji (obudowa, zasilanie, podłączenie czujnika) i tym samym wysiłek projektanta kieruje się w stronę aplikacyjną, integracyjną oraz właśnie związaną z analityką danych. Jest to słuszny kierunek, bo przecież nie ma sensu, aby każdy inżynier zajmujących się IoT i komunikacją bezprzewodową rozwiązywał podstawowe problemy z tworzeniem hardware, firmware, bo część ta jest w sumie zawsze podobna, a poza tym coraz bardziej zaawansowana technologia półprzewodnikowa pozwala zamknąć ją do jednego chipa.

Bogata funkcjonalność oprogramowania, usług związanych z akwizycją danych, komunikacją, sprawia, że czołowi producenci rozwiązań komunikacyjnych mogą się w ten sposób wybić ponad przeciętną. Inni, jak duże firmy znane ze świata IT, także poszerzają możliwości swoich rozwiązań o obsługę takich platform. Czasem oznacza to dla nich otwarcie biznesu na nową działalność, ale IoT niczym magnes przyciąga wielu graczy.

Patrząc z perspektywy, można powiedzieć, że zmiany idą w takim kierunku, aby najważniejszym problemem do rozwiązania był pomysł na aplikację lub zyskania korzyści wynikającej z technologii, a nie budowa układu elektronicznego lub pisanie kodu. To zadanie ma się sprowadzać do wyboru rozwiązania spośród wielu dostępnych, niekoniecznie tworzenia własnego, a także kupna usługi (konta) w powiązanej w taką platformą chmurze obliczeniowej zamiast tworzenia i konfigurowania własnej.

ROLA TANICH MODUŁÓW GSM STARSZEJ GENERACJI

Rynek komunikacji bezprzewodowej łączy w całość wielu producentów oraz także bardzo szeroki asortyment produktów. W zakresie komunikacji technologie zmieniają się bardzo szybko i to, co dzisiaj wydaje się znakomite pod względem parametrów, wydajności i możliwości, za rok–dwa zostanie zastąpione czymś nowszym. W dużej części rozwój oznacza też zachowanie kompatybilności wstecznej, przez co starsze rozwiązania dalej można używać. W przypadku sieci komórkowych lada moment będziemy korzystać z technologii 5G, aktualnie mamy produkty 4G (LTE), ale cały czas dostępne są wersje 3G, a nawet 2G (GPRS).

Takie rozwiązania mają niewyszukane możliwości, ale dla części użytkowników nadal są wystarczające i relatywnie tanie. Poza tym liczy się ich dostępność, w miarę standardowa konstrukcja, bo są one nierzadko jak spod tego samego stempla, dzięki czemu można łatwo zmienić dostawcę.

Niskie ceny konserwują rynek, bo tym bardziej zaawansowanym trudniej się jest przebić. Teza ta jest najbardziej prawdopodobna w przypadku uniwersalnych technologii komunikacji, czyli dla sieci telefonii komórkowej. Im rozwiązania są bardziej specjalistyczne, tym zjawisko to jest słabiej zarysowane, bo wartość dodana nowych rozwiązań, np. energooszczędność, jest większa i tym samym decydująca o potencjale aplikacyjnym.

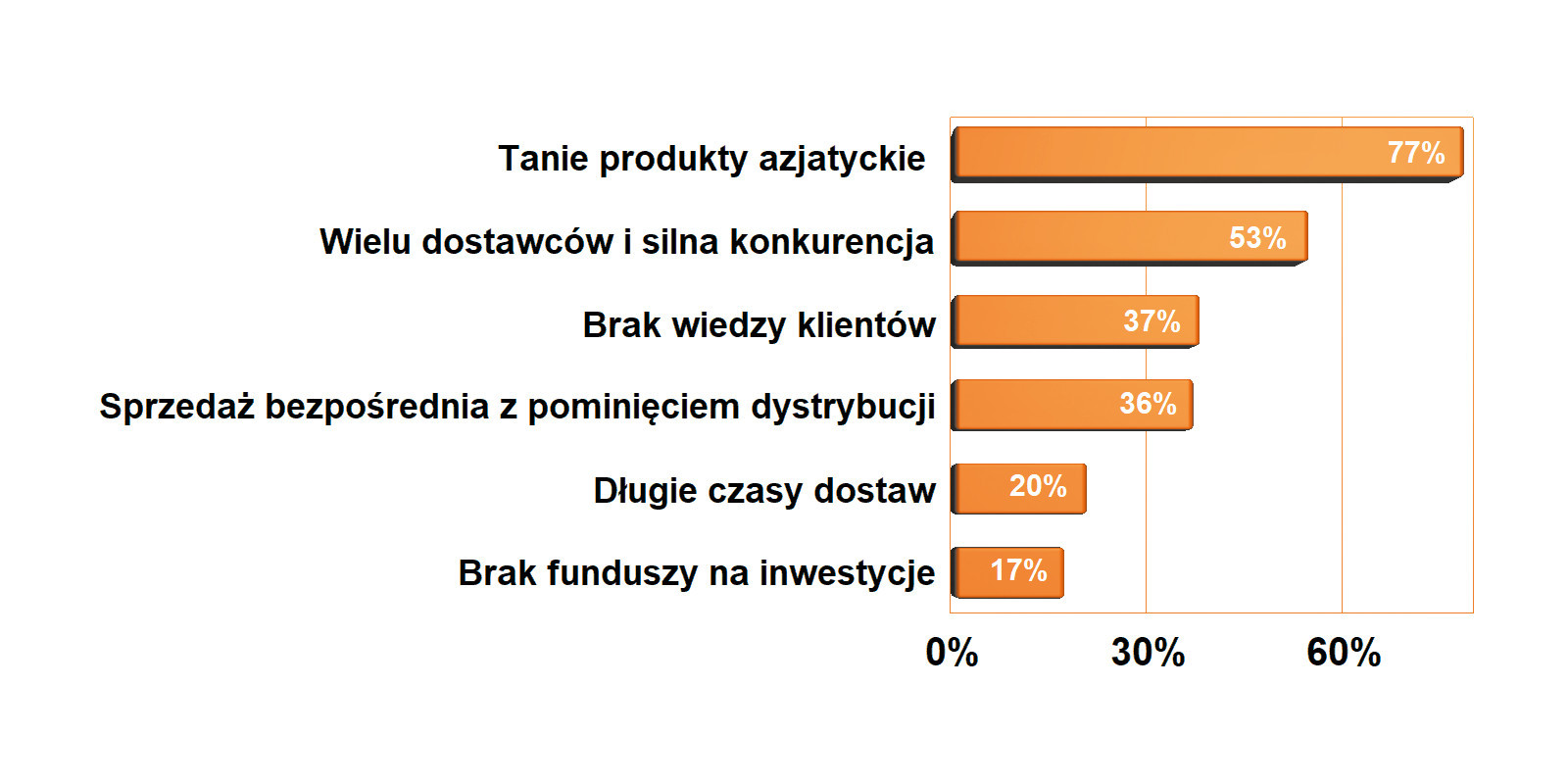

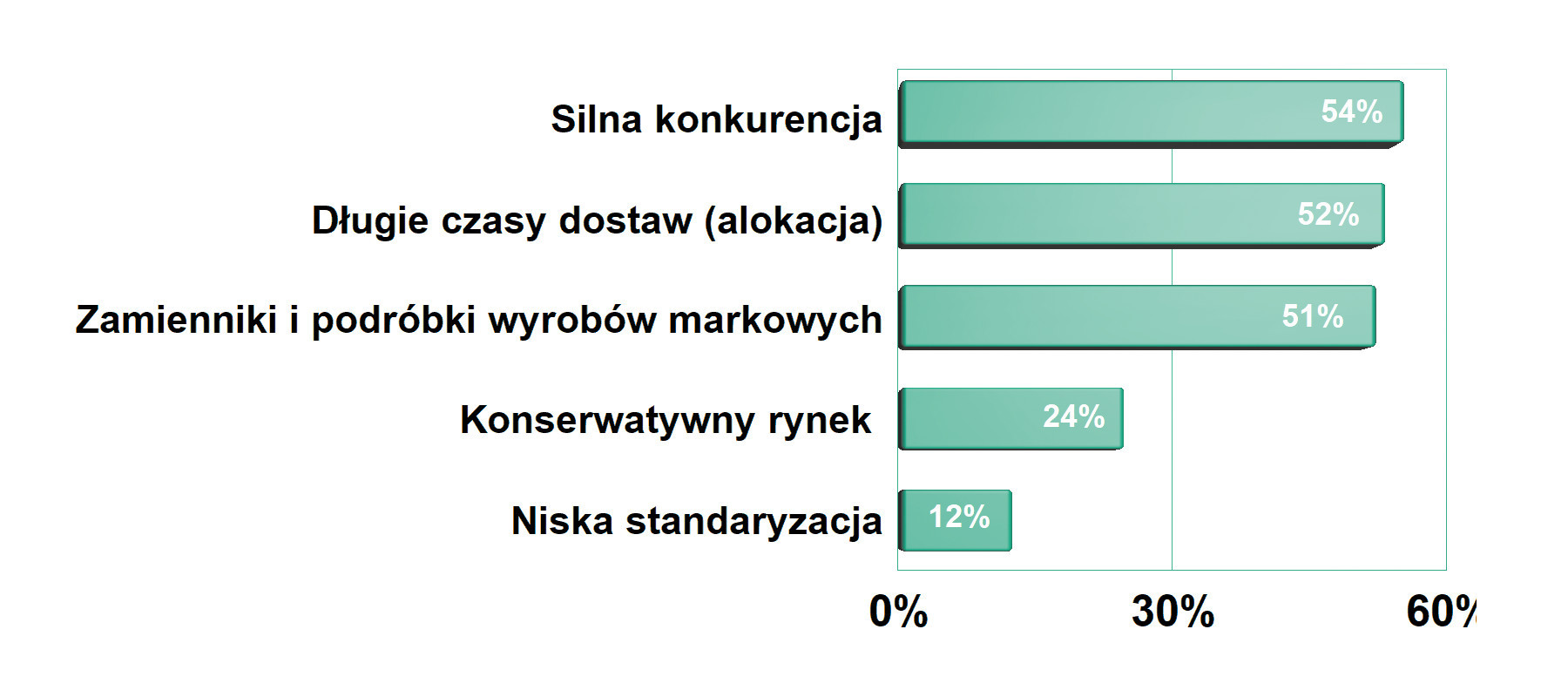

ŹRÓDŁA AZJATYCKIE TYPU DIRECT

Rynek dystrybucji i łańcuch dostaw, jaki na nim funkcjonuje, szybko się zmienia i z pewnością można nazwać skomplikowanym. Komponenty można kupować z różnych źródeł: od dystrybutora autoryzowanego, firmy dystrybucyjnej bez autoryzacji, brokera, a także od producenta, na rynku lokalnym i za granicą przez Internet. Z pewnością nie wyczerpuje to dostępnych opcji, ale w miarę upływu lat zakupy stają się coraz prostsze, a możliwości zaopatrzenia w ten sam produkt jest coraz więcej. Powiązania między firmami robią się też coraz mniej formalne. Dawniej dystrybutor autoryzowany odpowiadał za przydzielony mu obszar rynku i sprzedaż była ukierunkowana formalnie w jego stronę. Niemniej wraz z pojawieniem się globalnych firm katalogowych pojawiły się w tej zasadzie wyłomy, bo firmy działające w skali światowej wywalczyły sobie możliwość sprzedaży wszędzie i mają atrakcyjne ceny wynikające z dużej skali prowadzonego biznesu. Do tego doszły wielkie platformy internetowe w Azji, wysyłające towar na cały świat oraz sklepy producentów, umożliwiające kupowanie klientom końcowym bezpośrednio z magazynów wytwórcy.

Efektów tych procesów jest wiele, ale najbardziej widoczne to zaostrzenie konkurencji wynikające z rosnącej liczby miejsc, gdzie można dany towar kupić, większego znaczenia kryterium niskiej ceny oraz polaryzacji rynku na firmy o profilu handlowym oraz dostawców z wartością dodaną w postaci wsparcia technicznego, usług, oprogramowaniem i ogólnie postrzeganą wiedzą wykraczającą daleko poza to, co jest napisane w specyfikacji produktu.

Podobny proces, ale niejako z drugiej strony, widać u producentów mikrokontrolerów, który do wybranych jednostek wbudowują transceivery komunikacyjne. Dawniej był to zwykle prosty moduł radiowy na pasma ISM z niewyszukaną modulacją i parametrami, obecnie nie tylko część komunikacyjna może być na wysokim poziomie (np. Bluetooth, LoRA), a na dodatek są też rozwiązania wielosystemowe, gdzie obsługę stosu protokołu można wgrać.

SOM Z PROCESOREM APLIKACYJNYM PAMIĘCIĄ I MCU

Moduły komunikacyjne w coraz większym stopniu stają się małymi komputerkami z procesorem o relatywnie sporej mocy obliczeniowej, niezłych zasobach pamięci Flash i SRAM, interfejsie komunikacyjnym, a nawet z dostępnymi liniami GPIO, przetwornikami ADC i DAC. W takim urządzeniu można uruchomić aplikację napisaną w języku wysokiego poziomu (jak przykładowo Phyton), aby zrealizować całość prostej platformy czujnikowej, wykonawczej lub pomiarowej. Jest to bardzo wygodne zwłaszcza w tzw. projektach, a więc tam, gdzie tworzy się jednostkowe rozwiązania i urządzenia pod specyfikację klienta i o produkcji w wielkiej skali nie ma mowy.

Łukasz ChojnowskiProduct Manager Wireless & Semiconductors w JM elektronik

LoRaWAN jest jedną z najbardziej popularnych technologii komunikacji w nielicencjonowanym paśmie ISM. Jest jedną z najbardziej uniwersalnych oraz dostępnych dla każdego technologii LPWAN zarówno z punktu widzenia tworzenia sieci jak i integracji urządzeń końcowych i realizacji określonego projektu. Z tego względu zainteresowania LoRaWAN doświadczamy z każdej strony – od małych podmiotów realizujących pojedyncze, lokalne systemu odczytu zdalnego (np. odczyt temperatury i sterowanie w budynkowych systemach klimatyzacji), po podmioty wdrażające dostęp do sieci w całych miejscowościach. LoRaWAN kwitnie przede wszystkim w szeroko rozumianym smart city – systemy odczytu zdalnego mediów (głównie zużycie wody w systemach wodociągowych), pomiar parametrów powietrza w różnych lokalizacjach (czujniki jakości powietrza, temperatury, wilgotności, itp.), systemy parkingowe. Główną motywacją do wdrażania tego typu systemów jest uniwersalność platformy – raz uruchomiona sieć, czyli mówiąc wprost zakup stacji bazowych i uruchomienie serwera, może być wykorzystywana w dowolnych aplikacjach. Dzięki temu koszt infrastruktury amortyzowany jest relatywnie szybko i klienci mają możliwość stopniowego rozwijania jej funkcjonalności. Kolejnym czynnikiem jest popularność – na rynku znajdziemy szeroką gamę gotowych urządzeń dedykowanych LoRaWAN, co pozwala na szybką integrację i rozwiązanie problemów klienta.

Trudno jest jednoznacznie na to pytanie odpowiedzieć. Fakty są takie, że wciąż w Polsce nie mamy globalnego (ogólnokrajowego) operatora sieci LoRaWAN. Jest natomiast bardzo duża liczba wdrożeń lokalnych, gdzie zasięgiem obejmowane są całe miasta. Wynika to bezpośrednio z niskich kosztów uruchomienia takiej sieci i bardzo szybkim jej uruchomieniem – z naszymi klientami uruchamiamy sieci testowe LoRaWAN w przeciągu kilku dni, wliczając przeszkolenie z podstaw działania sieci, konfiguracji sprzętu, serwerów i aplikacji. Może się pojawić również pytanie dodatkowe – czy w Polsce taki globalny operator jest potrzebny? Gdyby był, dostęp wiązałby się pewnie z dodatkowymi opłatami w formie abonamentu. Klienci szukają najbardziej odpowiedniego rozwiązania dla siebie. Bardzo często wolą przeznaczyć budżet na infrastrukturę własną niż podpisywać wieloletnie kontrakty z operatorami. Z drugiej strony są również klienci, którzy nie chcą inwestować w infrastrukturę i wolą znaleźć partnera, który zapewni im dostęp do sieci LoRaWAN. Wybór scenariusza zawsze jest uwarunkowany indywidulanym planem biznesowym projektu. |

MODUŁY COMBO

Coraz więcej modułów do komunikacji bezprzewodowej to wersje wielostandardowe lub wielofunkcyjne. Najczęściej Wi-Fi łączy się w jednym komponencie z Bluetooth, a moduły komunikacyjne z nawigacją, np. LTE+GNSS. Takie połączenie jest wygodne, tańsze, zajmujące mniej miejsca i tym samym lepiej dopasowane do wymagań aplikacyjnych. Przykładem może być lokalizator wysyłający pozycję obiektu za pomocą sieci komórkowej lub automat podłączony na stałe do sieci przez Wi-Fi, ale także umożliwiający podłączenie się przez Bluetooth użytkownikom/pracownikowi serwisu. Sytuacji, gdzie dodatkowy interfejs jest potrzebny lub przynajmniej mile widziany, jest coraz więcej i stąd produkty takie zyskują na popularności.

Poza rozbudowaniem warstwy sprzętowej, komponenty combo wspierają projektanta w zakresie oprogramowania, czyli że wymagają mniej zabiegów programistycznych nad przekodowaniem, przesłaniem i obróbką danych. Domyślne zadania, jak wspomniane wysyłanie pozycji przez modem komórkowy, są już wstępnie przygotowane przez producenta. Moduły combo są też mniejsze od każdego alternatywnego rozwiązania, a to w obszarze elektroniki mobilnej oraz aplikacji IoT jest bardzo istotne. To samo dotyczy mniejszego poboru mocy, liczby wymaganych elementów zewnętrznych itd.

Mikrokontrolery i IoT

Mikrokontrolery są coraz tańsze, co może niekoniecznie widać w cenach bezwzględnych, ale z pewnością daje się dostrzec pod względem stosunku ceny do możliwości. Projektanci przez cały czas szukają też oszczędności na najdroższych układach stosowanych w modułach elektronicznych, stąd wynika prawdopodobnie zapotrzebowanie na tanie mikrokontrolery, które nie muszą być uniwersalne. To zapewne też przyczyna, dla której jednostki 8-bitowe cały czas znajdują chętnych, bo takiego mikrokontrolera opłaca się użyć nawet do prostych funkcji logicznych. Kolejną odsłonę możliwości integracji i obniżki cen przynoszą układy SoC (system na krzemie) zawierające w jednym chipie praktycznie całą aplikację (procesor, pamięć, komunikację). Funkcjonalność, jaką dostaje się za symbolicznego dolara, jest bardzo duża i niemożliwa do osiągnięcia w jakimkolwiek innym rozwiązaniu bazującym na elementach dyskretnych. Dlatego perspektywy dla tego obszaru rynku są znakomite.

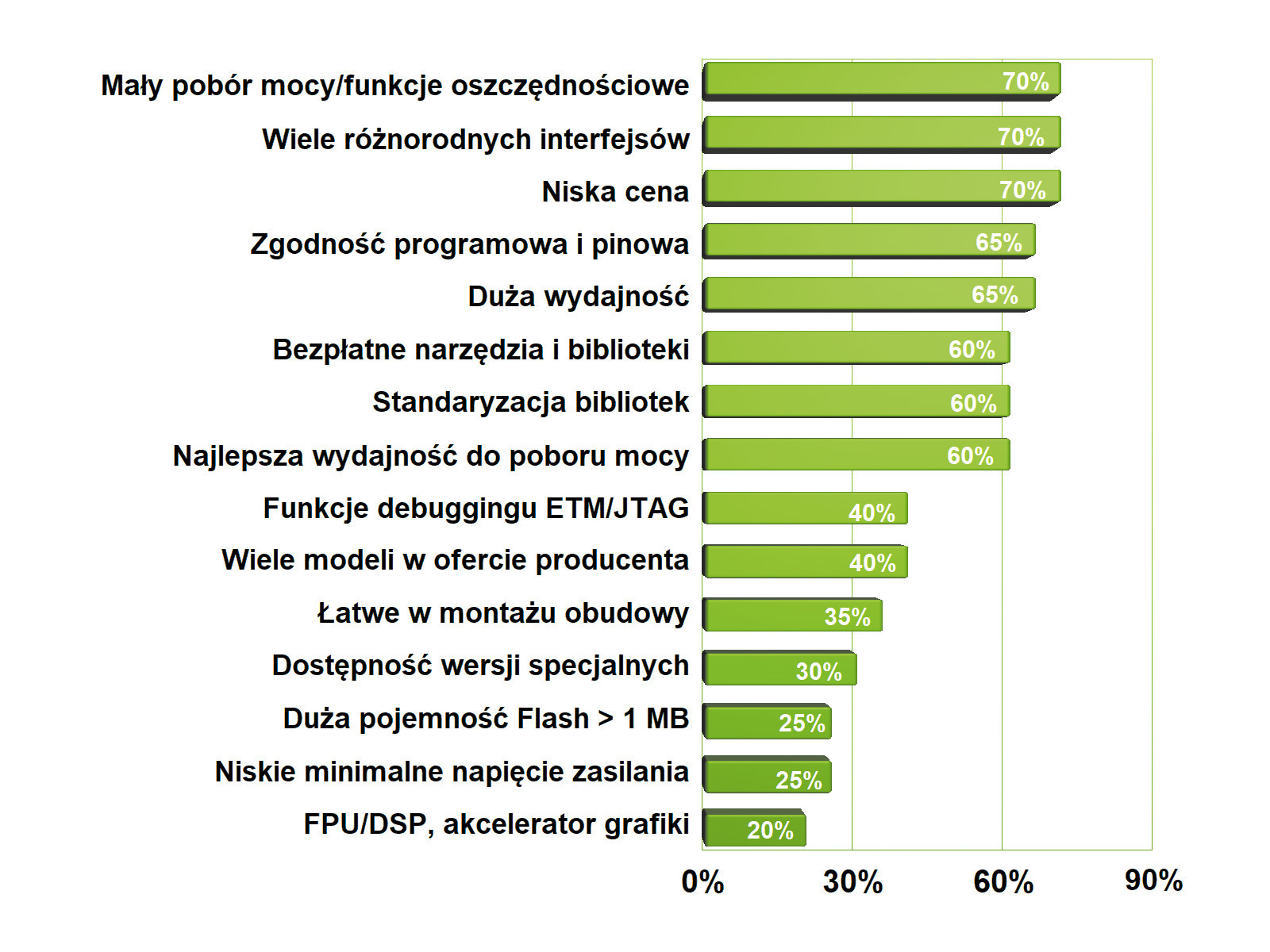

Stałym trendem od lat jest to, że funkcjonalność mikrokontrolerów cały czas rośnie. Nowe mają więcej układów peryferyjnych, większą pamięć, lepsze rdzenie zapewniające wydajność i energooszczędność.

Rozwój rynku mikrokontrolerów nie jest też jednokierunkowy. Z uwagi na liczne obszary aplikacyjne rodziny produktów rozwijają się w kierunku dużej wydajności, małej mocy, w obrębie wersji specjalizowanych, np. komunikacyjnych, do przetwarzania sygnałów i sterowania silnikami itd.

Wiele jednostek jest ukierunkowanych do pracy w określonych aplikacjach i zawiera zestaw obwodów peryferyjnych kompletny z punktu widzenia zastosowań aplikacyjnych. Przykładem mogą być układy z obwodami analogowymi przeznaczone do pracy w zasilaczach cyfrowych, jednostki z wbudowanym transceiverem do komunikacji bezprzewodowej lub też mikrokontrolery o bardzo małym poborze mocy i z wysokorozdzielczym przetwornikiem A/ C, a także blokiem obliczeniowym do kalkulacji zużycia mediów.

Ponieważ nie ma jednego układu pasującego do każdego zastosowania, oferty producentów szybko się rozszerzają, tworząc rodziny zawierające dziesiątki zgodnych pinowo i programowo wersji. Niekiedy jest ich tak wiele, że wybór wariantu w zakresie interfejsów, pamięci, obudowy a także ważnych szczegółów, jak zakres temperatur pracy itd., wymaga posłużenia się arkuszem kalkulacyjnym lub specjalizowanym narzędziem online.

Wiele komponentów w ramach oferty producenta i rodziny zapewnia też łatwość migracji. Czyli użycia innego, lepszego chipu, zamiast dotychczasowego, bez konieczności przerabiania mozaiki obwodu drukowanego lub zmiany oprogramowania. Do minusów zaliczyć można to, że wybór jednostki najlepszej do danej aplikacji przestaje być łatwy. Póki wybór układu dotyczy danej rodziny, zestawienie parametrów ma formę jednej strony w arkuszu i daje się jakoś objąć. Wybór się komplikuje, gdy trzeba dobrać układ w ramach jednego producenta, a więc zwykle spośród wielu rodzin. Jeszcze gorzej jest, gdy nawet wybór producenta jest sprawą otwartą. Wówczas wybór to prawdziwa loteria.

SZEROKA OFERTA SPRZYJA INERCJI

Negatywnym czynnikiem dla szybko rozwijającego się rynku jest to, że produkty mało popularne wypadają z produkcji. Koniec wytwarzania pojawia się też szybciej, gdy w ofercie pojawi się podobna, ale lepsza jednostka.

W rzeczywistości takich problemów jest znacznie więcej, stąd wiele firm wiąże się z danym producentem mikrokontrolerów i konkretną architekturą na długo.

Inżynierska inercja negatywnie tym samym wpływa na tempo rozwoju rynku, ale nie należy postrzegać tego zjawiska pejoratywnie. Wyszukiwanie nowych rozwiązań, testy, tworzenie środowiska pracy z nowymi rozwiązaniami, narzędzia, oprogramowanie i co chyba jest najważniejsze – wiedza i znajomość danego rozwiązania mają wartość materialną. Poszukiwanie nowych rozwiązań w zakresie mikrokontrolerów musi być podbudowane solidną argumentacją, np. tym, że to, z czego firma korzysta aktualnie, nie jest wystarczające lub korzyści z nowej platformy będą wymiernie duże.

Skutek jest taki, że firmy zazwyczaj w nowych projektach zostają ze znaną sobie rodziną mikrokontrolerów danego producenta – starają się modernizować produkty w znanej sobie architekturze i zestawie oprogramowania.

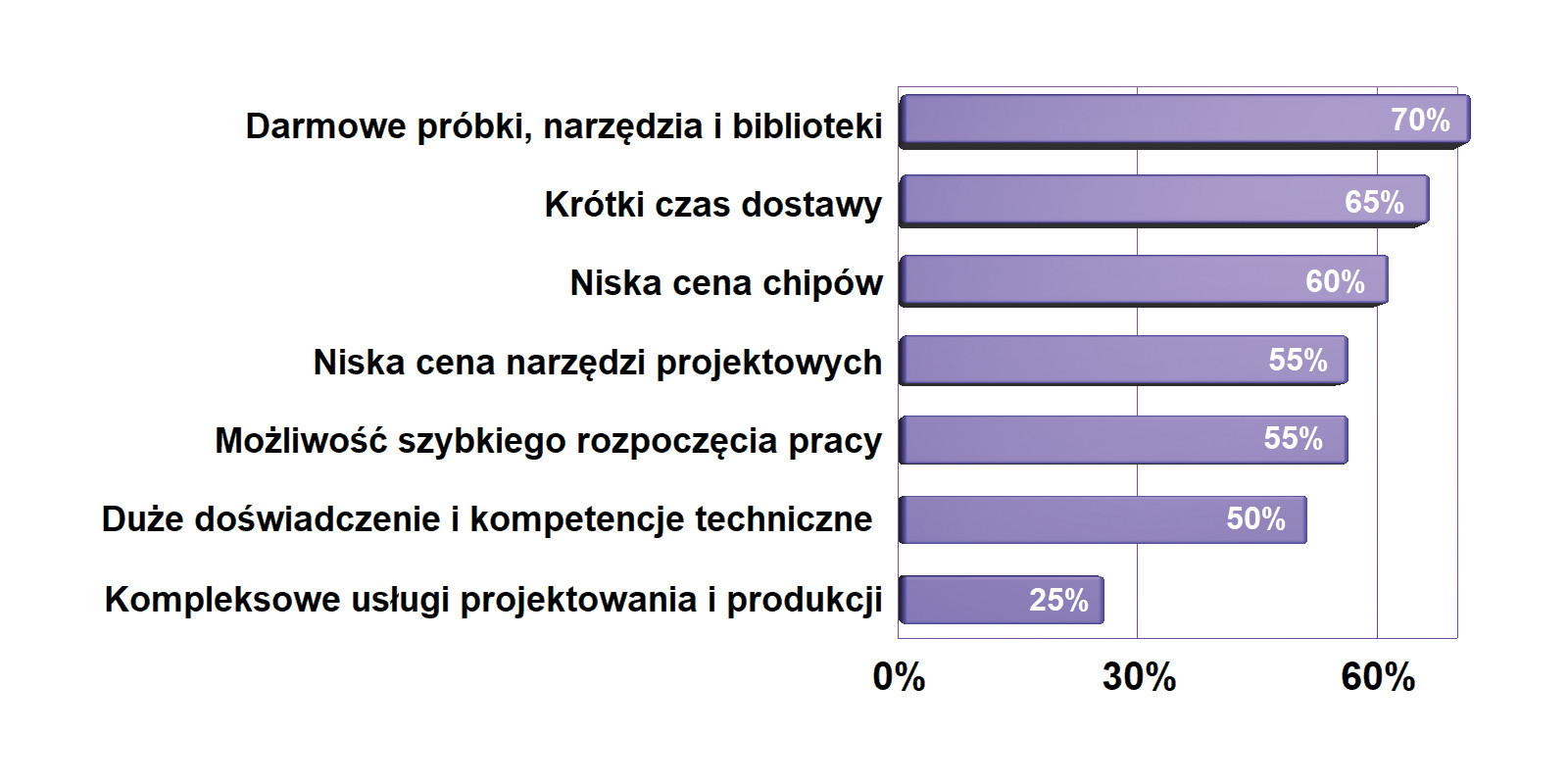

WSPARCIE TECHNICZNE ZAWSZE JEST POTRZEBNE

Producenci i dystrybutorzy rozumieją rozterki producentów elektroniki oraz ich ciągłe problemy z brakiem czasu i starają się wspierać każde działanie, za którym kryje się realna chęć rozwoju. Darmowe próbki chipów to standardowe minimum, ale miniaturowe obudowy chipów (zwłaszcza te bezwyprowadzeniowe) oraz konieczność posłużenia się procesem SMT w montażu nawet jednej sztuki powodują, że najlepszą platformą do testów nowych rozwiązań są płytki startowe. W ostatnich pięciu latach w tym obszarze zaszły ogromne zmiany, a liczba zestawów dostępnych na rynku jest liczona w tysiącach. W praktyce każdy nowy chip o charakterze systemowym (a więc bardziej złożony) oraz inne układy w małych obudowach, np. bezwyprowadzeniowych, są wprowadzane na rynek razem z zestawem projektowym. Płytki startowe są często traktowane tak samo jak próbki, a więc rozdawane na seminariach, przekazywane klientom w ramach wsparcia technicznego. Ogólnie ma to sens, bo w dzisiejszej sytuacji, gdy czas staje się największym dobrem w pracy inżynierskiej, każde działanie, które go oszczędza i sprawia, że nie trzeba zaczynać od zera, jest doceniane.

Interesujący, pomysłowy i bogato wyposażony zestaw zawierający mikrokontroler, układ komunikacyjny, czujniki, wyświetlacz, jest niczym magnes przyciągający uwagę. Otrzymana za darmo płytka startowa nierzadko jest przyczyną zainteresowania daną architekturą studentów i pracowników biur projektowych, którzy później mogą podjąć decyzję o większym zaangażowaniu właśnie w tym, znanym już kierunku.

OPROGRAMOWANIE RÓWNIE ISTOTNE JAK HARDWARE

Na szybkość projektowania ma też wpływ czas przygotowania oprogramowania i z reguły jest to zagadnienie bardziej istotne od warstwy sprzętowej. To dlatego, że wiele aplikacji składa się z mikrokontrolera razem z niewielkim otoczeniem układów pomocniczych i peryferyjnych i od strony układowej są one stosunkowo proste. To jest normalne działanie, bo konieczność minimalizacji kosztów prowadzi do tego, aby koszt materiałowy zdefiniowany przez listę BOM był jak najniższy. Z uwagi na to korzystniej jest implementować więcej funkcji użytkowych w oprogramowaniu, bo związane z nim wydatki nie dotyczą każdej wytworzonej sztuki.

Te procesy sprawiają, że rola oprogramowania firmware cały czas się zwiększa. Staje się ono bardziej rozbudowane i złożone, a czas jego przygotowania (napisania) jest coraz dłuższy.

Podobnie jak zestawy startowe, projekty aplikacyjne lub gotowe rozwiązania dostarczane przez działy wsparcia technicznego producenta i dystrybutora ułatwiają budowę części sprzętowej, takie same zjawiska można dostrzec w zakresie oprogramowania. Podstawą są zintegrowane środowiska typu IDE, ale największą pomoc zapewniają gotowe kawałki kodu, biblioteki procedur lub nawet gotowe rozwiązania z otwartą licencją, które wystarczy przerobić pod swoje potrzeby. Takie zasoby też się bardzo szybko zwiększają i mają duży wpływ na tempo rozwoju rynku i na akceptację nowych rozwiązań. Poza oprogramowaniem darmowym na rynku jest jeszcze wiele narzędzi płatnych związanych np. z grafiką, interfejsem użytkownika. Konieczność pracy od zera jest chyba bardzo rzadkim przypadkiem.

KOMUNIKACJA I NIEWIELKIE POTRZEBY ENERGETYCZNE

W ostatnich latach rynek elektroniki szybko się zmienia i znaczenia nabierają aplikacje przenośne, rozwiązania IoT oraz systemy rozproszone, np. telemetryczne sieci pomiarowe. Wiele takich rozwiązań zasilanych jest z akumulatorów i baterii jednorazowych, stąd potrzeby związanie z zapewnieniem jak najmniejszego poboru mocy stają się bardzo istotne.

Drugim istotnym trendem jest komunikacja bezprzewodowa. Elektronika mobilna, urządzenia klasyfikowane jako IoT muszą mieć możliwość wywymiany danych, dostępu do Internetu lub możliwość gromadzenia danych w chmurze obliczeniowej. Stąd komunikacja jest i będzie w przyszłości ważnym obszarem determinującym możliwości mikrokontrolerów.

Mówiąc ogólnie, duża wydajność mikrokontrolerów jest w sprzeczności z niskim poborem mocy. Ale ostatnio na rynku pojawiły się mikrokontrolery, które mają dwa rdzenie – jeden wydajny, a drugi energooszczędny, co pozwala programiście używać ich w zależności od tego, co jest potrzebne w danej chwili. To przykład wyłomu w tej ogólnej regule.

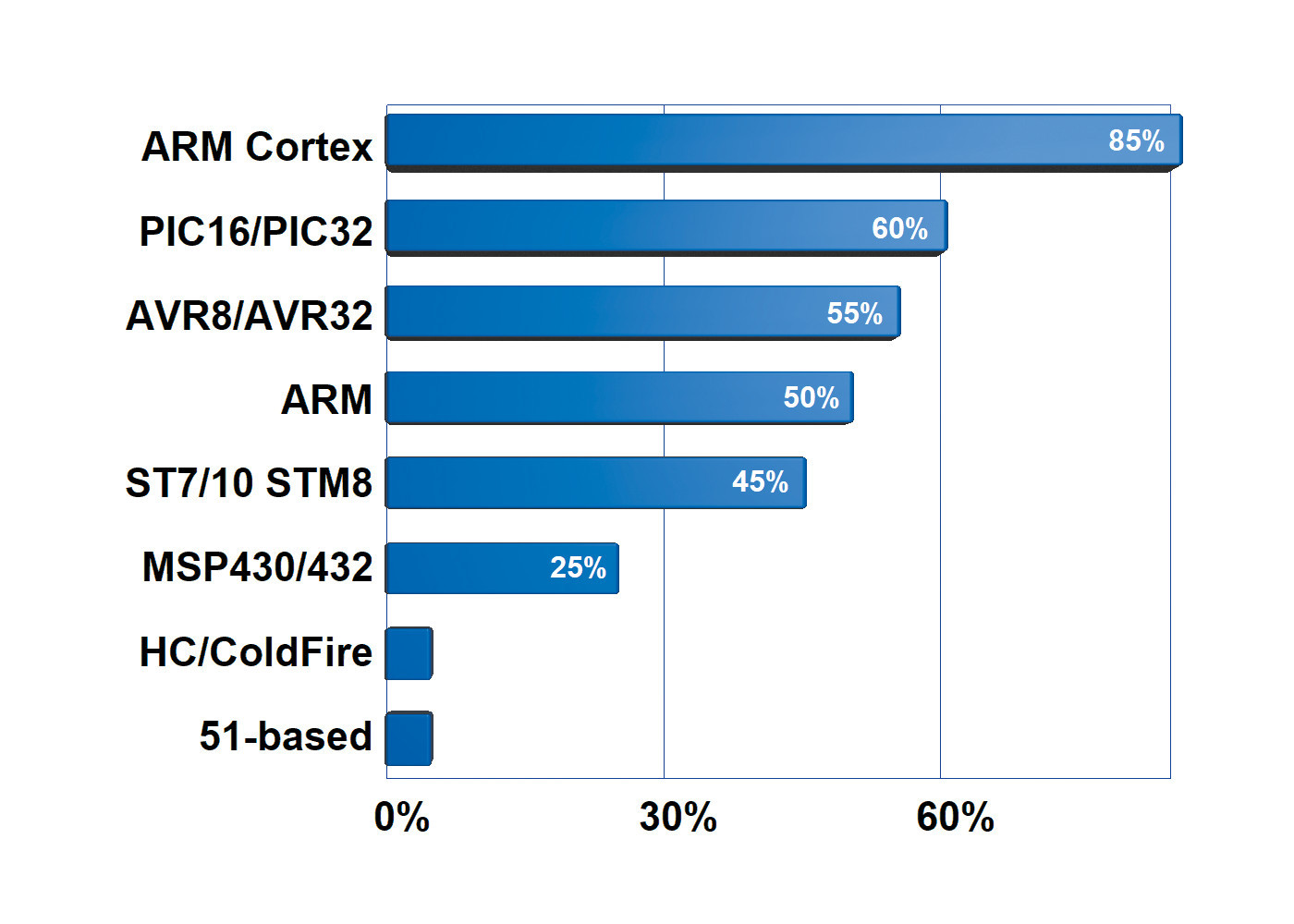

EWOLUCJA, A NIE REWOLUCJA

W zakresie popularnych mikrokontrolerów, technologii i rozwiązań w ostatnich latach nie pojawiły się jakieś przełomowe koncepcje. Rynek jest zdominowany przez architekturę ARM Cortex-M, która stale wzbogaca się o nowe wersje, zarówno takie, gdzie nacisk położono na wydajność, jak i te koncentrujące się na zagadnieniach energooszczędności.

Na rynku pojawiają się też często jednostki specjalizowane jako systemy na krzemie (SoC). Najczęściej dotyczy to integracji mikrokontrolera i układu radiowego, rzadziej z FPGA lub obwodami audio. SoC-e to korzystne rozwiązania które są implementowane m.in. w urządzeniach medycznych, systemach oświetleniowych, grach elektronicznych oraz IoT. Za ich pomocą można zamknąć całą warstwę sprzętową aplikacji w jednym układzie, stąd tam, gdzie liczy się cena, miniaturyzacja, jest to korzystny wybór.

Oprócz nowoczesnych, bogato wyposażonych i wydajnych mikrokontrolerów 32-bitowych na rynku cały czas zgodnie egzystuje grupa procesoprocesorów 8-bitowych, o nieporównywalnie mniejszych zasobach, funkcjonalności i liczbie układów peryferyjnych, ale za to bardzo tanich i znakomicie nadających się do realizacji prostych układów sterowania. Do wielu zastosowań i aplikacji 8 bitów całkowicie wystarcza, a przy niskich cenach takich jednostek, zaczynających się od ułamka dolara za sztukę, wykorzystuje się je jako proste układy czasowo-logiczne.

Przekaźniki elektromagnetyczne

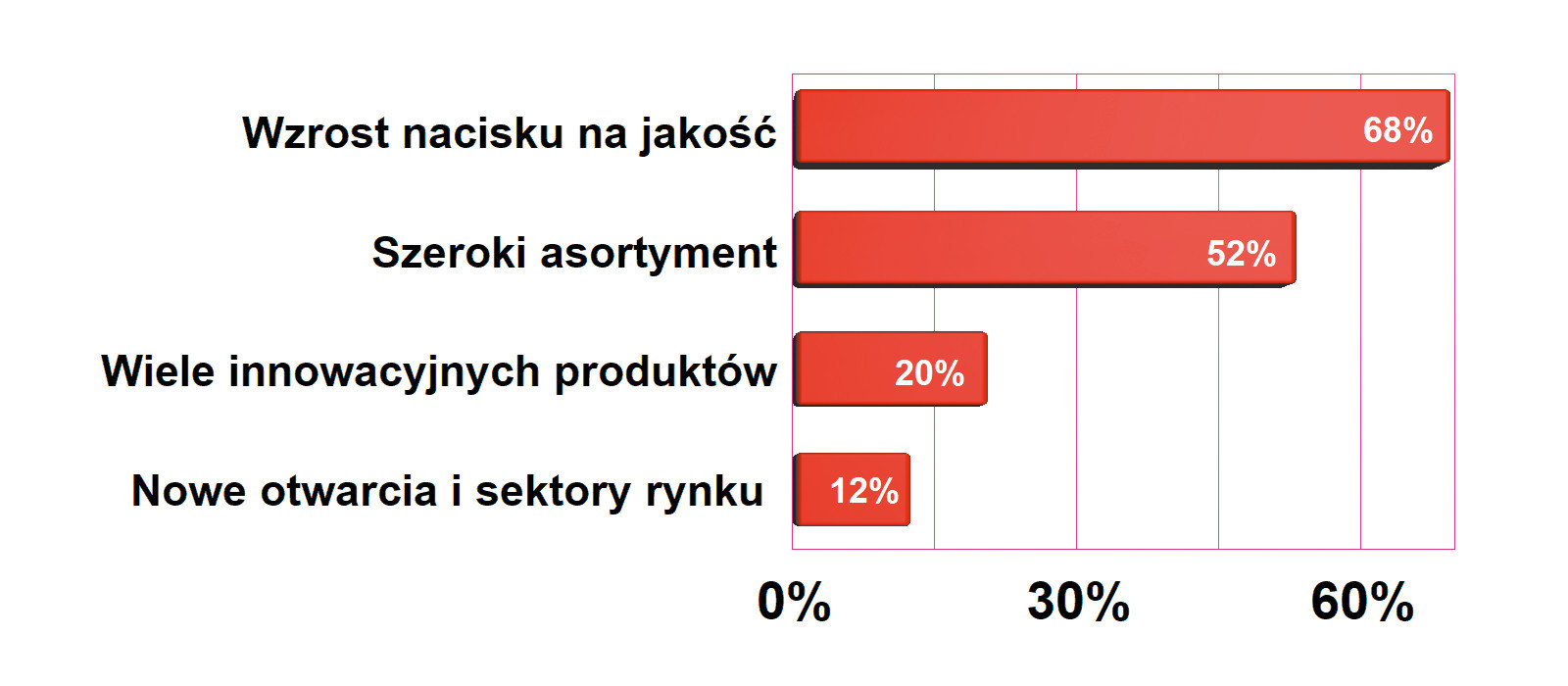

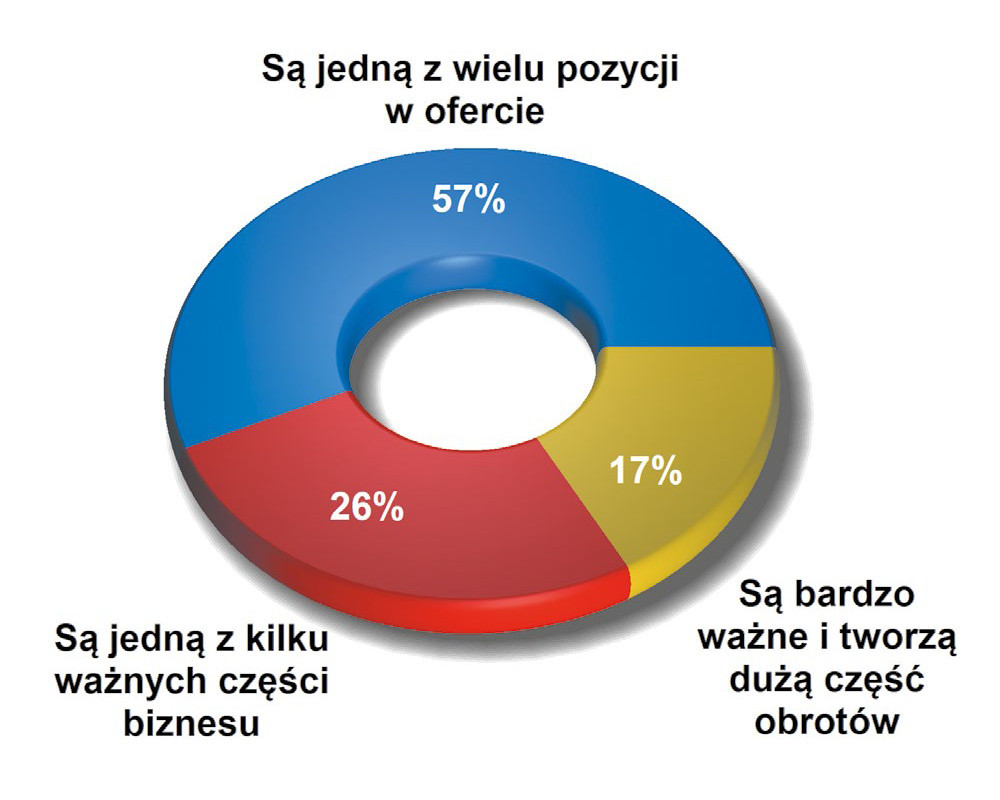

Na rynku przekaźników widoczny jest zwrot zainteresowania klientów w stronę produktów wysokiej jakości i tych produkowanych przez renomowanych producentów. Proces ten dzieje się, mimo że cały czas są dostępne przekaźniki klasyfikowane jako podróbki oraz tanie chińskie marki, a silna konkurencja zapewnia wiele rozwiązań o zbliżonych parametrach.

Przyczyn tego zjawiska jest wiele, na przykład rosnące koszty pracy i tym samym drożejący serwis i obsługa techniczna urządzeń. To także coraz większy eksport krajowych przedsiębiorstw, coraz więcej urządzeń i aparatury w fabrykach oraz większe skomplikowanie techniczne nowych instalacji. W Polsce szybko rozwijają się rynki związane z produkcją maszyn, sektorem budowlanym i postępuje automatyzacja wielu dziedzin. Rozwój produkcji inicjuje też popyt na systemy kontroli i sterowania, co zawsze stymuluje popyt na przekaźniki. Wiele krajowych firm produkuje i eksportuje urządzenia dla przemysłu, takie jak sterowniki, regulatory, urządzenia pomiarowe, styczniki, systemy bezpieczeństwa i nadzoru. W ramach inwestycji i modernizacji starszych zakładów i linii produkcyjnych kupowane są nowe maszyny i budowane do nich instalacje oraz systemy. Strumień sprzedaży dla przemysłu tworzą też elektronika profesjonalna, energoelektronika, motoryzacja, systemy alarmowe. Nie są to filary rynku odpowiedzialne za zbyt przekaźników, ale z pewnością mające znaczenie.

Zainteresowanie jakością w branży bierze się też z tego, że krajowych przedsiębiorców obecnie stać na lepsze produkty. Liczne inwestycje producentów europejskich w automatyzację produkcji spowodowały, że wytwarzanie przekaźników wymaga mniej pracy ręcznej niż dawniej, więc jakość jest lepsza przy jednocześnie niższej cenie. Ceny przekaźników markowych nie są już dzisiaj w dużej dysproporcji w stosunku do tych tańszych i nierzadko różnica pomiędzy wersjami staje się niewarta starań. Co więcej, w ostatniej dekadzie w technologii przekaźników zaszło sporo korzystnych zmian poprawiających jakość i trwałoś ć tych elementów, przez co działy utrzymania ruchu w przemyśle kupują obecnie relatywnie mniej tych elementów niż kiedyś. To też ogranicza zapędy do oszczędzania.

Paradoksalnie rynek jest też dzisiaj znacznie bardziej wyedukowany w zakresie podejścia do jakości właśnie dzięki temu, że kiedyś była ona drugorzędna w stosunku do niskiej ceny. Nic tak nie edukuje klientów i nie zmienia kierunku myślenia firm jak pojawiające się problemy z urządzeniami w okresie gwarancyjnym i ponoszone koszty serwisu z powodu elementu, na którym oszczędzono ułamek złotówki.

SZEROKI ASORTYMENT

Wiele zmian na rynku, jakie zaszły w ostatnich latach, też można uznać za czynniki sprzyjające dla przekaźników i także pośrednio dla jakości. Przykładem może być wzrost znaczenia specjalizacji, odchodzenie od wytwarzania długich serii na rzecz produkcji elastycznie dopasowującej się do chwilowych potrzeb rynku bądź wręcz realizowanej na zlecenie. Sprawne realizowanie projektów, zleceń integracji i usług produkcyjnych preferuje firmy lokalne, a więc zdolne do zapewnienia szybkich dostaw komponentów. Im szerszy asortyment, im więcej typów wykonań i możliwości w zakresie przekaźników mamy na rynku, tym pozycja rynkowa dużych lokalnych graczy jest lepsza, bo oni mają magazyny fabryczne blisko klienta.

ROSNĄCY ASORTYMENT WERSJI SPECJALISTYCZNYCH

W ofertach producentów przekaźników widocznych jest coraz więcej typów o funkcjonalności i parametrach dostosowanych do wymagań aplikacji. Do niedawna przekaźnik był postrzegany jako coś bardzo uniwersalnego, który można było stosować w zasadzie dowolnie, obecnie okazuje się, że czasem warto sięgnąć po rozwiązanie aplikacyjne. Przykładem mogą być wersje solarne, zdolne do komutacji obwodów mocy prądu stałego, rozwiązania odporne na uderzenia prądu udarowego, o podwyższonej odporności izolacji, bistabilne i podobne. Czasy, gdy przekaźnik dobierało się na podstawie paru parametrów, już dawno się skończyły – poza obszarem aplikacyjnym, typem trzeba też decydować o wymaganiach środowiskowych, obudowie, opcjach dodatkowych, jak np. wskaźnik zadziałania, wbudowanym elemencie gaszącym przepięcia, systemie gaszenia łuku elektrycznego, przycisku testującym itp. Do tego dochodzą opcje montażu, parametry cewki przekaźnika oraz jej moc (nominalna i obniżona). Kryteriów selekcji jest mnóstwo.

Warto dostrzec, że liczba wersji przekaźników z obniżonym poborem mocy przez cewkę także systematycznie się powiększa. Doszliśmy do momentu, że większość popularnych typów jest już dostępnych w wersji oszczędnej, a redukcja poboru mocy sięga 30‒50%. Poza redukcją energii elektrycznej niski pobór mocy przez cewkę przekłada się na mniejsze nagrzewanie i możliwość pracy w szerszym zakresie temperatur. To kolejny czynnik sprzyjający jakości.

MINIATUROWE I SUBMINIATUROWE

Poszukiwanie przekaźnika oraz sprawne poruszanie się po katalogach producentów wymaga nieco uwagi co do terminologii. I tak termin przekaźnik miniaturowy, oznacza zwykle element o średniej wielkości i obciążalności z punktu widzenia elektroników, przeznaczony do montażu na płytce drukowanej. Elementy takie przeznaczone są do załączania obciążeń od 5 do 10 A przy napięciu sieci 230 V AC i zawierają jedną lub maksymalnie dwie pary styków.

Druga grupa kierowana do elektroniki to przekaźniki subminiaturowe. Są to elementy o małych wymiarach i obciążalności przeznaczone do montażu na płytkach drukowanych w wersjach THT i SMD. Ich prąd przewodzenia styków zawiera się typowo w zakresie 0,5‒2 A, napięcia pracy sięgają 120 V, a więc nie są to elementy przeznaczone do pracy z napięciem sieci energetycznej. To takie typowe przekaźniki do aplikacji w elektronice, do pracy z małymi sygnałami o wielkości kondensatora elektrolitycznego.

Kolejna ważna grupa to przekaźniki przemysłowe. Są to elementy o jeszcze większych wymiarach niż miniaturowe, zwykle są one przeznaczone do montażu w podstawce lub z końcówkami do lutowania lub mają końcówki pod konektory. Zawierają kilka par styków o dużej obciążalności, z reguły trzy do każdej fazy po jednym, mogą one włączać obciążenia indukcyjne, pracują przy napięciu do 400 V itp. Wyróżniają się odpornością, trwałością, dodatkami takimi jak przycisk testowy lub kontrolka oraz wzmocniona izolacja. Przekaźniki przemysłowe montuje się w przezroczystych obudowach po to, aby można było łatwo ocenić ich stan techniczny.

Poza wymienionymi typami kolejne grupy produktowe w zakresie przekaźników są już dostępne w obudowach instalacyjnych. Są to wersje do montażu na szynie DIN lub przykręcane do płaskiej powierzchni w skrzynce instalacyjnej. To samo dotyczy wersji specjalizowanych, nadzorczych, czasowych. Są to konstrukcje, w których oprócz przekaźnika elektromagnetycznego jest coś jeszcze: logika sterująca lub układy interfejsu.

WERSJE Z WBUDOWANĄ ELEKTRONIKĄ

Inną rozwijającą się grupą przekaźników aplikacyjnych są wykonania z wbudowaną elektroniką, czyli wersje czasowe oraz nadzorcze. Terminy te kryją tak naprawdę sterowniki elektroniczne o niewielkiej funkcjonalności z możliwością ustawienia pokrętłami czasów i progów oraz histerezy reakcji na zdarzenia, takie jak przekroczenie ustalonego poziomu. W sumie już nie są to przekaźniki elektromagnetyczne, tylko ogólnie "przekaźniki".

Takie wersje to użyteczne komponenty dla automatyki, pozwalające na modernizację i budowę instalacji i urządzeń. Zapewniają sterowanie oświetleniem w garażu, wentylacją w hali, załączanie oświetlenia przeszkodowego i podobne zadania, nie wymagają złożonych sterowników wymagających programowana, ale jednocześnie użycia czegoś więcej niż sam przekaźnik.

W największej części elementy te pełnią zadania ochronne, a więc wyłączają zasilanie przy przekroczeniu temperatury, napięcia, prądu w obwodzie i przeznaczone są do pracy w instalacjach 1-fazowych prądu przemiennego, ale spotyka się też wersje dla sieci trójfazowej. Z kolei wersje czasowe to elementy, które załączają lub odłączają obwód po zadanym czasie, realizują opóźnienie załączenia lub wyłączenia. Liczba kombinacji i wersji oraz możliwości tych komponentów są imponujące, co zapewne jest podstawą ich użyteczności. Elektronizacja przekaźników daje też możliwości poprawy parametrów oraz jest sposobem na zwiększenie zainteresowania danym typem, np. bistabilnym.

STYCZNIK CZY PRZEKAŹNIK?

Poza przekaźnikami na rynku funkcjonują tzw. styczniki. Nazwa ta określa specjalizowany przekaźnik dużej mocy przeznaczony do pracy w aplikacjach przemysłowych i energoelektronicznych. Styczniki są komponentami przeznaczonymi do montażu w obudowie lub na szynie DIN i mają obudowę, która pozwala na zamocowanie w chassis. Są przeznaczone do łączenia dużych obciążeń, o mocy nawet wielu kilowatów, trójfazowych silników, dużych grzejników oraz całych systemów oświetlenia przemysłowego i obiektowego. Styczniki są łączone przewodami o dużym przekroju i mają wyprowadzenia przystosowane do montażu grubych kabli. Ich cewka z reguły jest zasilana napięciem 24 V DC lub napięciem przemiennym 230 V AC. Zawierają kilka styków, typowo trzy duże pary styków dla trzech obwodów fazowych, ale czasem też i jedną małą parę do sygnalizacji.

WIELE NOWOŚCI I DROBNYCH INNOWACJI

Cały czas na rynku pojawiają się nowe rozwiązania, niemniej rozwój ma ewolucyjny charakter bez przełomowych premier i kamieni milowych w rozwoju. Dominują systematyczne usprawnienia – pojawiają się mniejsze wersje albo o większej obciążalności. Coraz więcej istniejących typów przekaźników można kupić w wersji energooszczędnej z czułą cewką, pojawiają się też wykonania ciche. Konstruktor ma coraz większy wybór wersji specjalistycznych, np. nadających się do przełączania wysokich napięć stałych, wersje ze stykami odpornymi na sklejanie się od wysokich prądów udarowych lub też rozwiązania skutecznie komutujące małe prądy.

Poza kwestiami technicznymi przekaźniki zyskują szczelne obudowy zapewniające odporność środowiskową, mające wzmocnioną izolację między cewką i stykami, a w ich kartach katalogowych pojawiają się kolejne certyfikaty jakości potwierdzające deklaracje producenta.

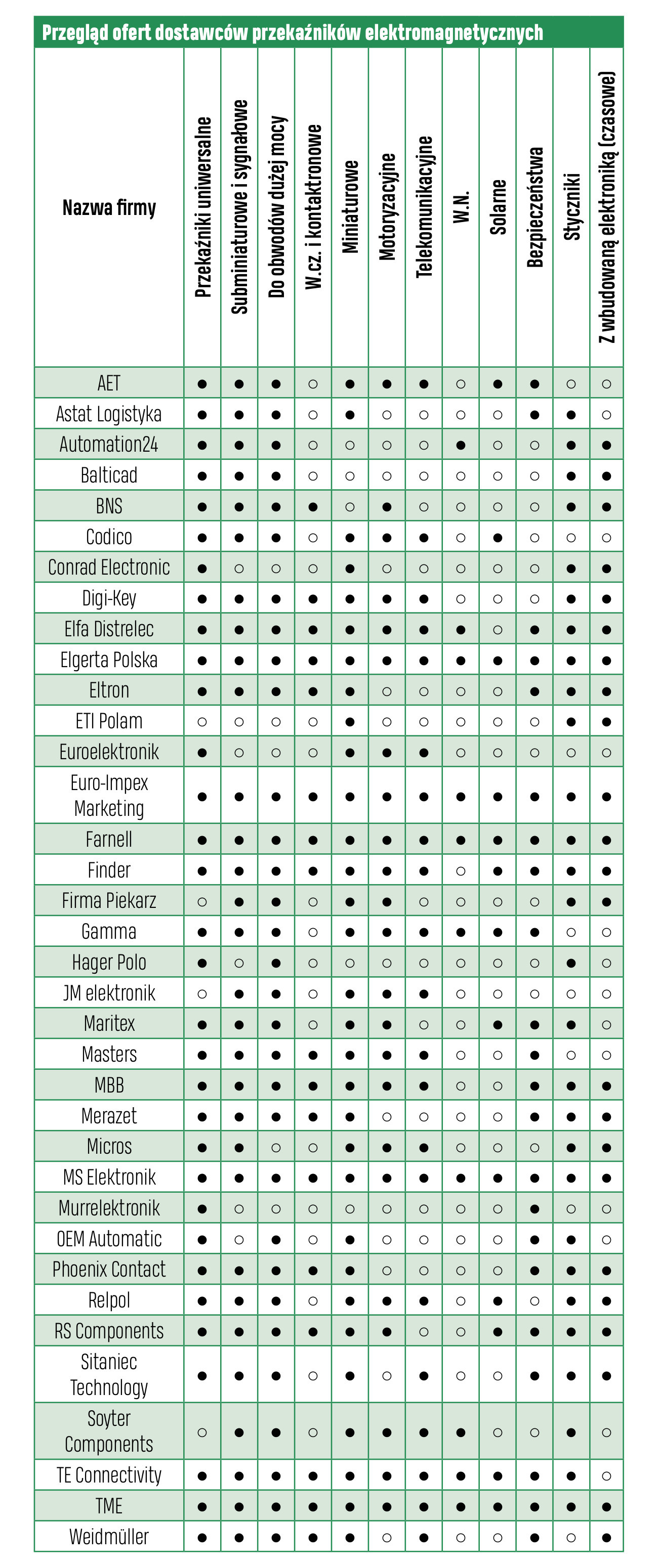

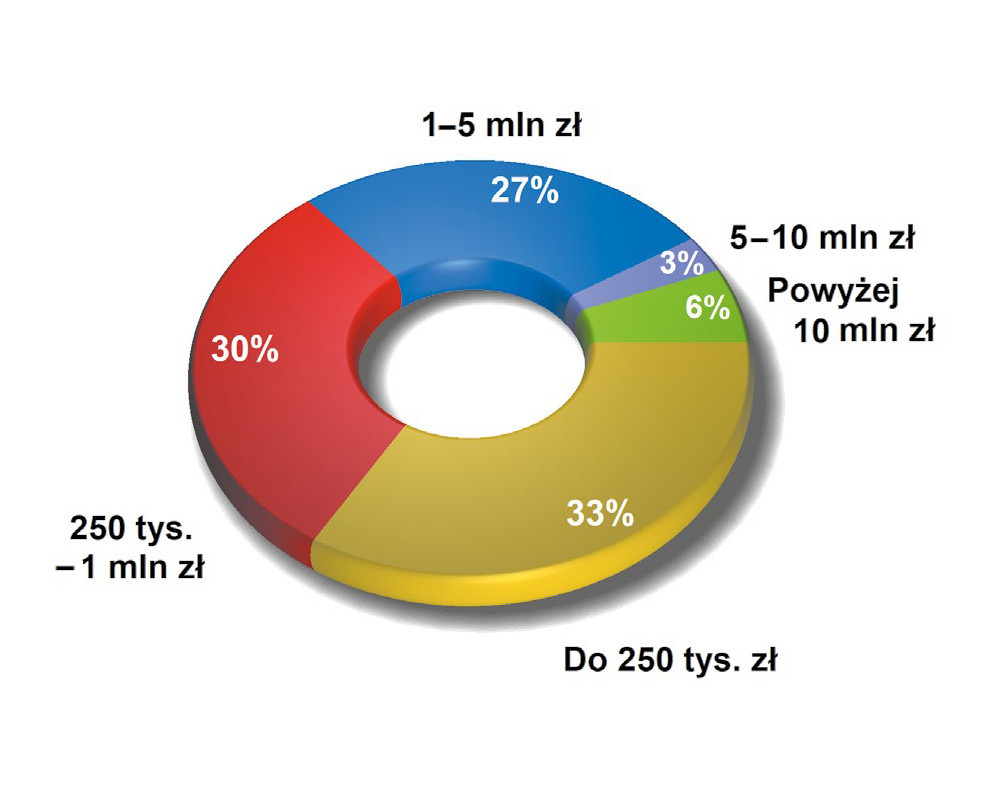

DOSTAWCY PRZEKAŹNIKÓW

W zakresie czołowych na rynku dostawców przekaźników widać stabilność i uporządkowanie relacji. Zmiany w sieci dystrybucji pojawiają się rzadko i tylko w zasadzie w zakresie dystrybuowanych marek. W miarę upływu lat dystrybutorzy często poszerzają asortyment i oferują równolegle produkty kilku producentów, tak aby mieć i te lepsze, i te tańsze.

Przekaźniki sprzedaje wiele firm działających na rynku elektroniki i automatyki, w tym wszyscy dostawcy katalogowi, jak TME, Farnell, Conrad Electronic, Digi-Key, RS i Elfa Distrelec. Produkty te mają oczywiście duże hurtownie, jak Masters, Maritex, Micros oraz dostawcy specjalizowani, np. Codico, Piekarz, Soyter. Są też oczywiście dostawcy komponentów automatyki: Eltron, Astat, Weidmüller lub Phoenix Contact. Lista ta nie zmienia się od lat, ale w sumie to chyba dobrze, bo nic tak nie cieszy dzisiaj w biznesie jak stabilność. Czołową firmą w skali kraju jest oczywiście Relpol – nasz krajowy producent przekaźników.

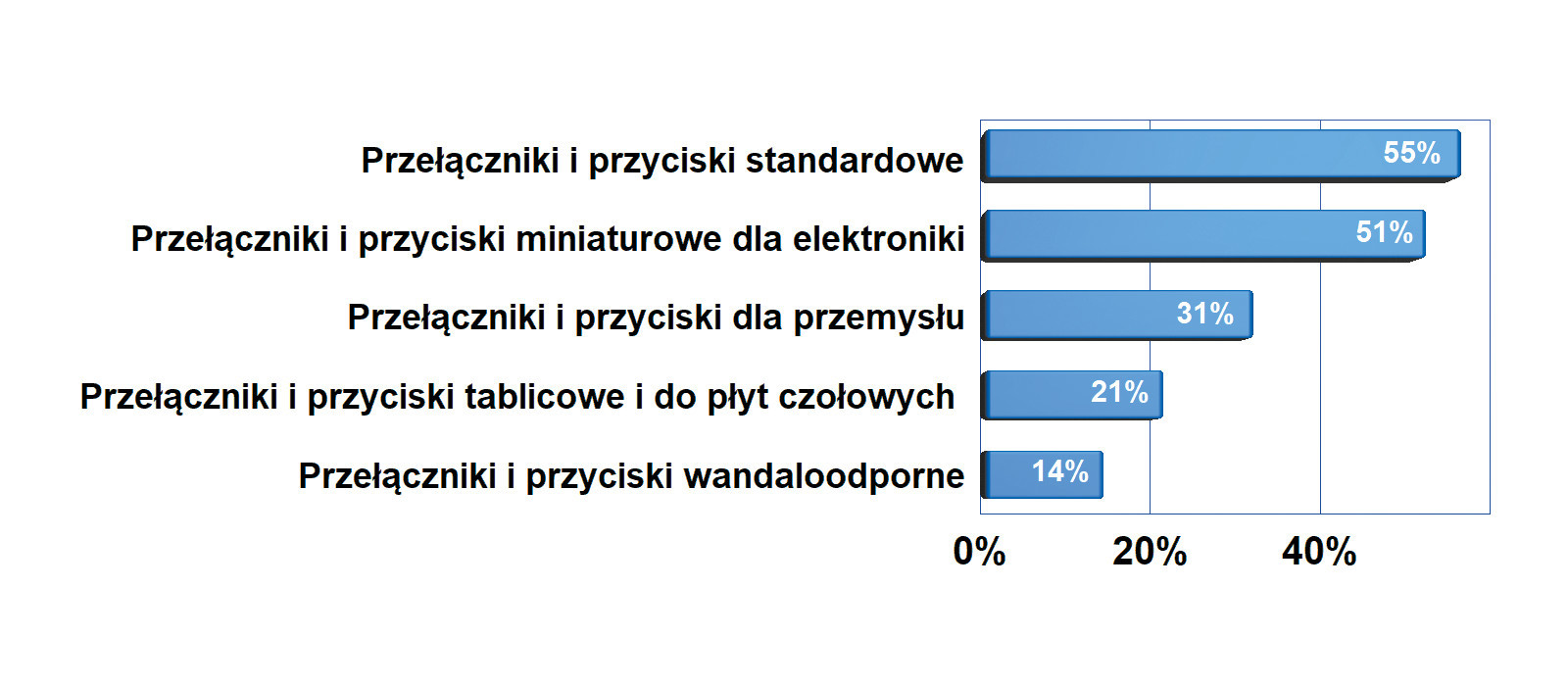

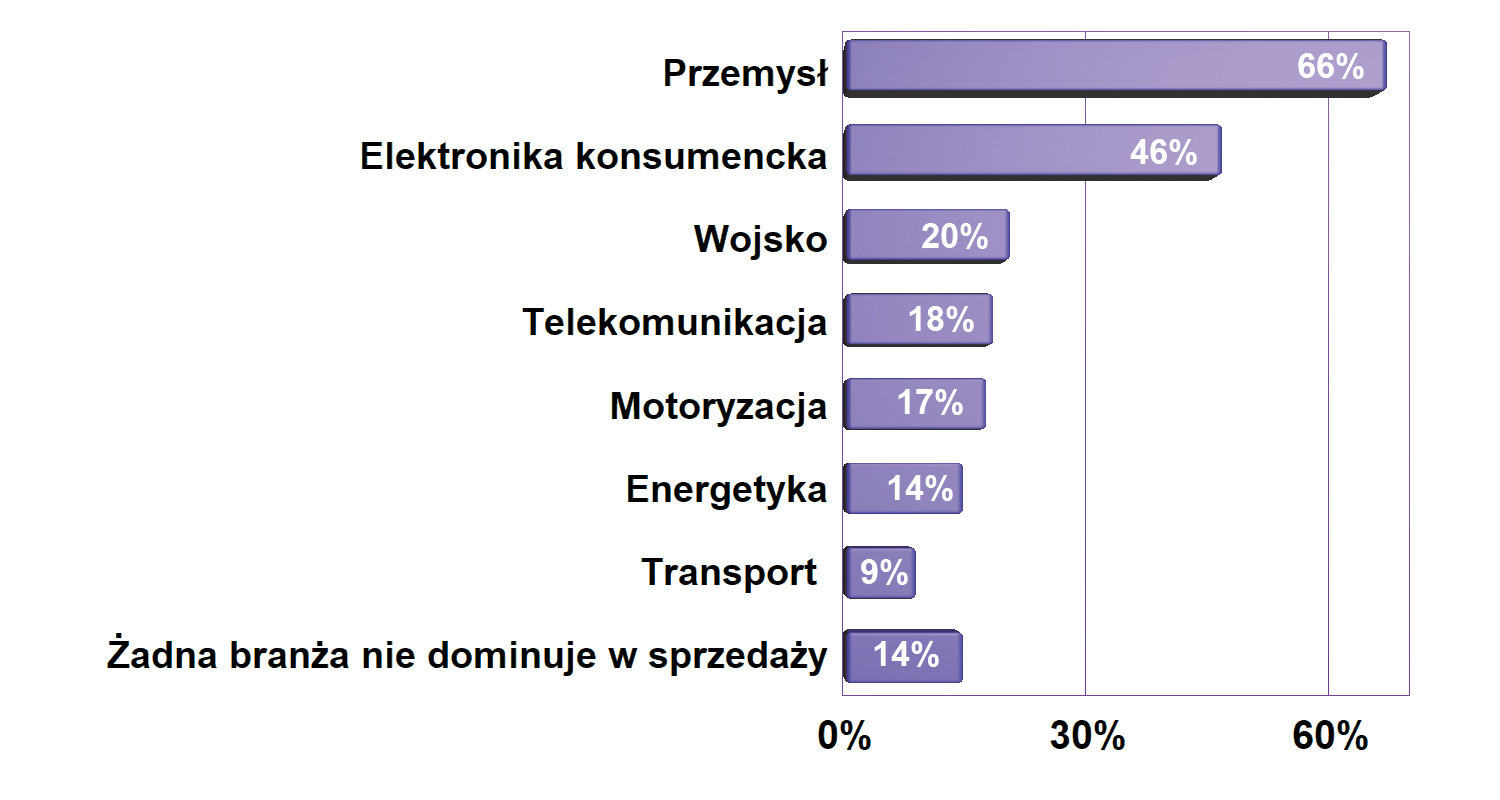

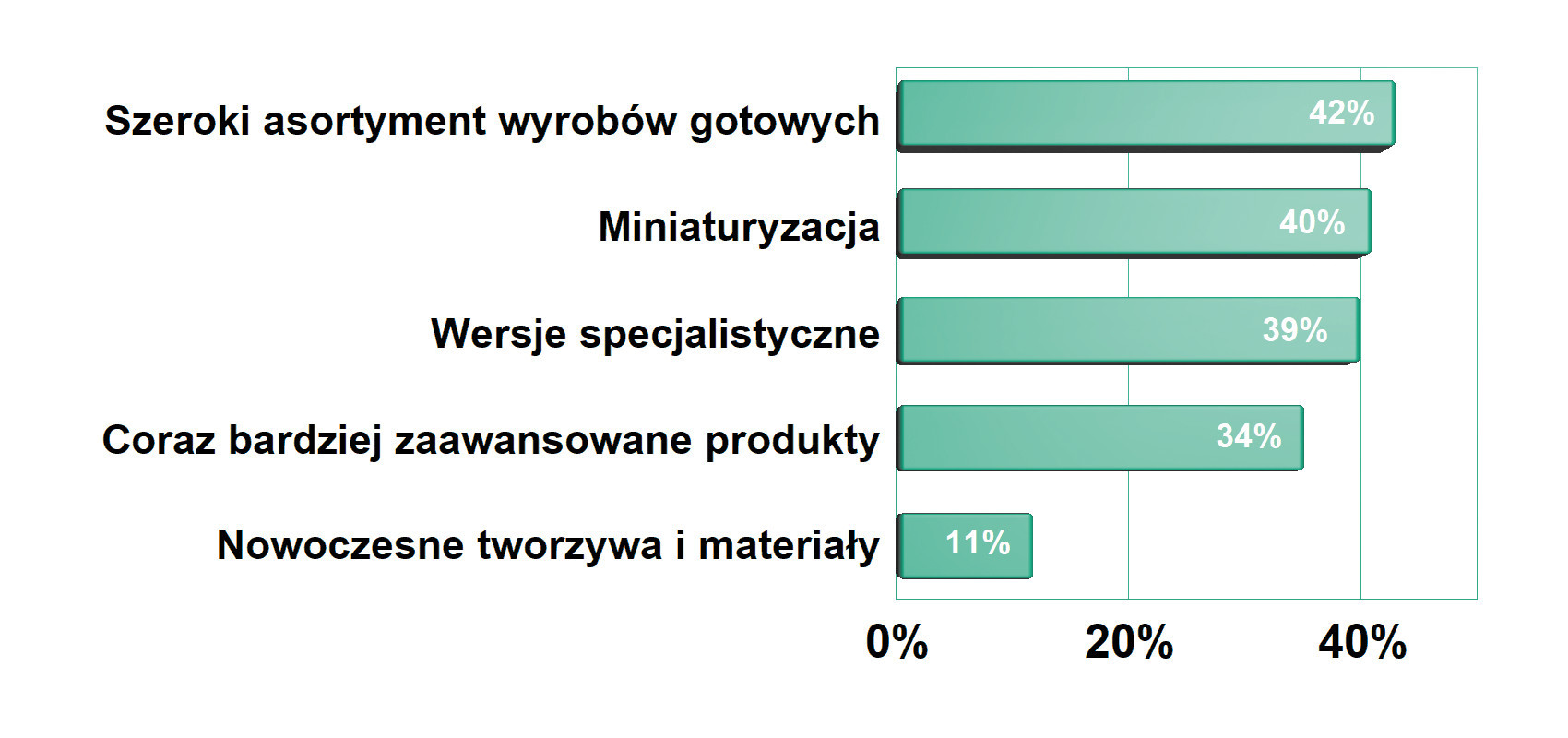

Przełączniki, przyciski i klawiatury

Kiepskiej jakości przełącznik lub klawiatura są w stanie skutecznie popsuć opinię o producencie urządzenia wśród wielu klientów, a firmę wpędzić w kosztowny serwis. W miarę upływu lat coraz więcej osób jest świadomych takiego ryzyka i co jest również ważne, ma obecnie fundusze na to, aby go minimalizować. Temat jakości elementów elektromechanicznych zawsze w omawianym sektorze był istotny i dyskutowany. Dystrybutorzy i producenci wkładają od lat wiele wysiłku w promocję elementów markowych wśród firm elektronicznych, cierpliwie pracując nad zmianą podejścia klientów do zakupów. Te ich działania przynoszą na szczęście efekty.

W ostatnich latach jakość przełączników i przycisków znacznie się poprawiła, a udział tandety jest wyraźnie mniejszy. Wytwórcy udoskonalili technologię, poprawili precyzję działania tych elementów i sięgnęli po nowe, lepsze materiały, aby zdjąć z elementów elektromechanicznych piętno najsłabszego ogniwa.

Przełączników i przycisków na rynku jest mnóstwo, tak samo jak producentów i firm, które mają je w ofertach. Czołowi producenci mają licznych naśladowców, wiele innych firm korzysta z tego, że rynek jest chłonny i proponuje wielowariantowe rozwiązania, które w zamyśle mają pokryć większość potrzeb klientów. Brakuje standaryzacji, bo w praktyce dotyczy ona tylko tych najpopularniejszych produktów, które mają wielu producentów i tym samym standardem staje się to, co jest popularne. Doskonałym przykładem są przyciski membranowe do PCB.

W przełącznikach i przyciskach nie funkcjonuje system modułowy, który pozwala na ograniczenie liczby części składowych, taki, jaki spotyka się w złączach. Przeciwnie, wiele produktów daje możliwość kompozycji spośród wielu typów. Za jedną pozycją kryją się dziesiątki wersji różniących się kształtem dźwigni, kapturkiem, stopniem ochrony, końcówkami łączeniowymi, kolorem podświetlenia. Utrudnia to dokonywanie wyborów, także zmianę produktu na inny pochodzący od innego producenta, a także utrudnia promocję nowych rozwiązań.

JAKOŚĆ I WZORNICTWO

Ciągłym trendem w branży jest poprawiająca się jakość rozwiązań elektromechanicznych i ich wygląd, czyli wzornictwo. Żywe kolory tworzyw sztucznych, kształty wykraczające daleko poza nudne prostopadłościany lub podświetlenia ledowe są z pewnością przykładem zachodzących zmian w omawianym sektorze. Jest to z pewnością wynik tego, że producenci mają dzisiaj do dyspozycji lepsze materiały i urządzenia produkcyjne zapewniające większą dokładność, ale także z tego, że zaawansowane technologie produkcyjne są coraz bardziej przystępne. Druk cyfrowy o wysokiej rozdzielczości znakowarki i obrabiarki laserowe nie są już dzisiaj luksusem dostępnym dla największych firm i coraz częściej są wykorzystywane do personalizacji produktów, wykonywania produkcji małoseryjnej i innych operacji. Obrabiarki laserowe zapewniają wszystko, co jest dzisiaj potrzebne do zapewnienia jakości, a więc wysoką precyzję wykonywania oznaczeń, trwałość oraz szybkość. Patrząc na całkowite koszty posiadania, widzi się, że stają się także kosztowo efektywne, gdyż nawet jak inwestycja wymaga większych nakładów na początku, to potem jest to równoważone małymi kosztami użytkowania.

Takie urządzenia pozwalają zapewnić możliwość wytwarzania produktów o wysokiej jakości technicznej i wizualnej w małej skali, bez konieczności sięgania po kompromisy. W warunkach krajowych jest to bardzo cenne.

KLAWIATURY

Klawiatury membranowe lub inaczej foliowe znajdują szerokie zastosowanie w urządzeniach powszechnego użytku, sprzęcie kontrolno-pomiarowym, rozwiązaniach przemysłowych, motoryzacji, urządzeniach medycznych oraz sprzęcie AGD. Ich duża popularność wynika z dobrej dostępności i niewielkiego skomplikowania technologii produkcji, co przekłada się na niskie ceny uruchomienia produkcji i koszty jednostkowe oraz dobre własności użytkowe i jakość. Kolejny atut to taki, że jest to produkt elastyczny, taki który można dopasować do wielu specyficznych wymagań aplikacyjnych. Klawiatury mogą być z klikiem klawiszy, podświetleniem, z frontem silikonowym lub foliowym, z polami przezroczystymi lub kolorowym filtrem pod wyświetlacz itd. Wraz z warstwami realizującymi ekranowanie elektromagnetyczne konstrukcja jest zabezpieczana przed wpływem czynników środowiskowych lakierami i warstwami ochronnymi. Możliwości jest wiele, a rynek szeroki i chłonny.

O atrakcyjności klawiatur przekonuje to, że w miarę upływu lat liczba firm zajmujących się ich wytwarzaniem (we własnym zakresie lub w kooperacji) rośnie.uje to, że w miarę upływu lat liczba firm zajmujących się ich wytwarzaniem (we własnym zakresie lub w kooperacji) rośnie. Nie jest to dynamiczny przyrost, ale dostrzegalny, najbardziej u producentów obudów, którzy rozszerzają ofertę o klawiatury.

Producenci klawiatur cały czas inwestują w rozwój technologii, w nowe trwałe materiały, zapewniające odporność środowiskową i długotrwałe działanie, wykorzystują druk cyfrowy po to, aby dać możliwość pełnej indywidualizacji projektów, także tych określanych jako małe serie oraz łączą w ramach jednej oferty wiele rozwiązań przełączających, podświetleń i całego know-how, aby mieć ofertę dla każdego klienta.

DOTYK KONTRA NACISK

Obszar określany terminem interfejs człowiek-maszyna (Human Machine Interface, HMI) to sfera zagadnień związanych z dwukierunkową komunikacją z urządzeniami. Są to nie tylko aspekty techniczne, gdyż wiele uwagi poświęca się zagadnieniom takim, jak percepcja przez człowieka komunikatów płynących od urządzeń, wygoda i intuicyjność sterowania nimi, a także temu, aby mechanizmy wymiany informacji były jednoznaczne i spójne.

W zakresie interfejsu HMI sporo się dzieje i istnieje spora szansa na to, że w kolejnych latach równowaga ta może zostać naruszona. Rozwiązania dotykowe stają się coraz lepsze i wiele z nowych kontrolerów pozwala na obsługę w rękawiczce, bez problemów z szybkością detekcji i pewnością wykrywania dotyku. Są też takie, gdzie istnieje możliwość wykrycia siły nacisku palca na przycisk (poprzez ocenę wielkości dotkniętego pola), co daje możliwość zapewnienia lepszej responsywności interfejsu.

Widoczny jest też rozwój technologii haptycznych, a więc takich, w których urządzenie komunikuje się z operatorem za pomocą dotyku. Na razie sprowadza się to do potwierdzenia stanu za pomocą wibracji, co już w przypadku przycisków dotykowych i klawiatur ekranowych jest wykorzystywane do zapewnienia wspomnianego potwierdzenia zadziałania, ale zapewne niedługo aktuatory haptyczne zostaną też wbudowane do przycisków.

Kolejna innowacja, jaka czeka w kolejce, to optyczne czujniki zbliżeniowe, które wykorzystują do wykrywania obiektu (palca) impuls światła generowany przez laser lub LED i mierzą czas, po jakim wróci sygnał odbity od przedmiotu (jest to metoda o nazwie Time of Flight, ToF). Elementy dotykowe z czujnikiem ToF rozwiązują całkowicie problem rękawiczki, pozwalają na aktywację (wybudzenie urządzenia) przy zbliżeniu się osoby do czujnika. W wersji z laserem czujniki ToF mogą dokonywać wielu pomiarów odległości jednocześnie, tworząc mapę trójwymiarową zbliżającego się obiektu i w ten sposób zapewniają niewrażliwość na zakłócenia.

Na koniec warto wspomnieć, że do interfejsu HMI dodawane będzie rozpoznawanie gestów. Umożliwią to właśnie wielopunktowe czujniki ToF, które tworząc trójwymiarowy model obiektu, dostarczą danych dla komputera, który na podstawie serii pomiarów wykryje gest, czyli w praktyce ruchy dłoni.

Czy te wszystkie nowe pomysły wypchną z rynku rozwiązania mechaniczne? Z pewnością nie, ale mogą doprowadzić do przetasowań i zapewnią, że w branży zawsze będzie coś nowego.

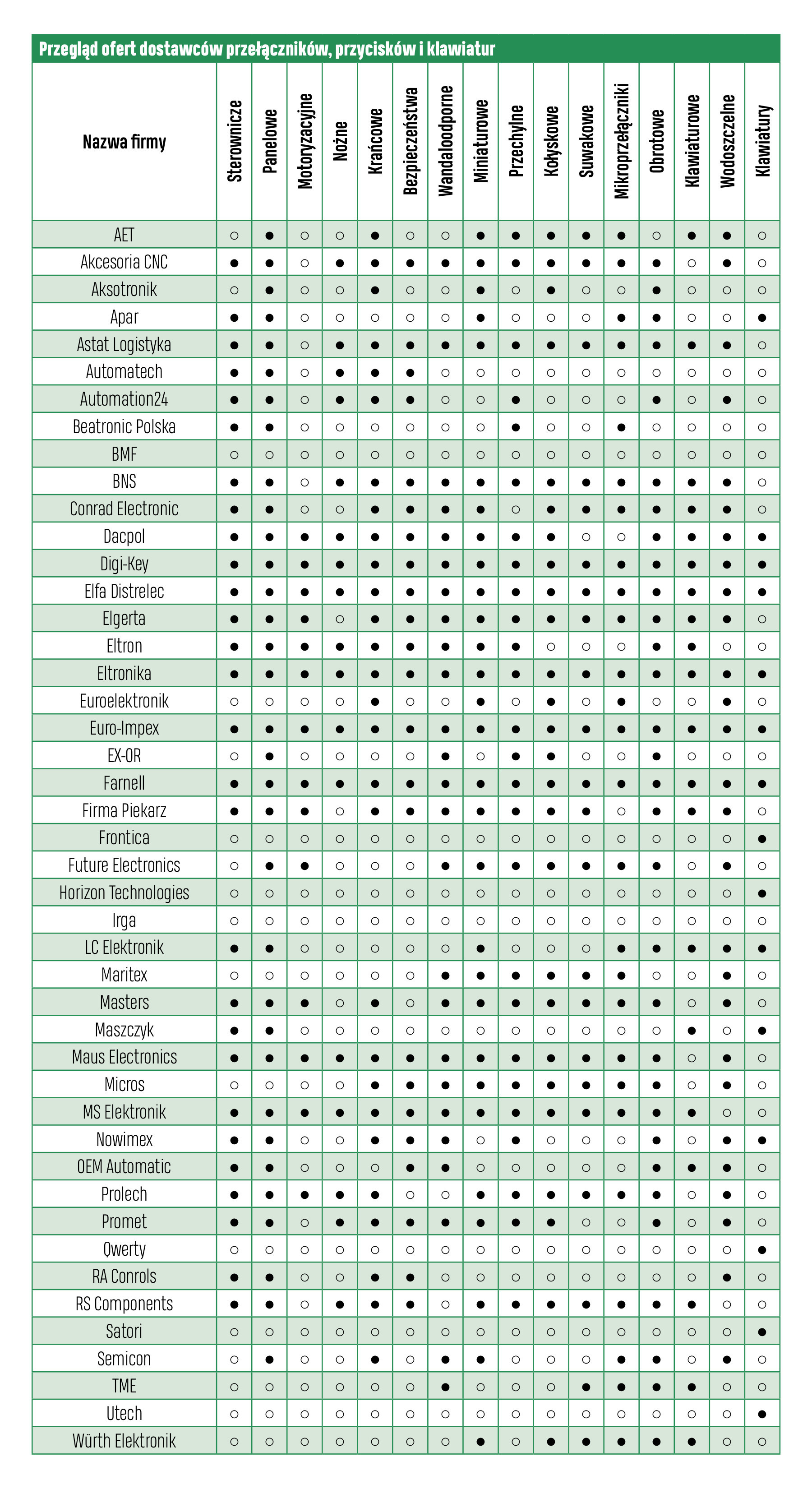

CZOŁOWI DOSTAWCY I PRODUCENCI

Pierwszą i wyraźnie odrębną grupę firm stanowią firmy, których biznes związany jest głównie z klawiaturami, czyli Qwerty, Frontica, Irga, Horizon Technologies, Satori, Utech, Maszczyk, LC Elektronik. Oferta wymienionych firm prawie wyłącznie obejmuje wersje nastawione na indywidualne wzornictwo. Taki profil rynkowy ma także firma dystrybucyjna Beatronic Polska, która proponuje klientom klawiatury do aplikacji przemysłowych.

Kolejny obszar aktywności tworzą katalogowe firmy dystrybucyjne o szerokim profilu, dla których przełączniki i przyciski to jedna z wielu pozycji w katalogu: TME, RS Components, Digi-Key, Maus Electronics (Mouser Electronics), Farnell, Conrad Electronic, Elfa Distrelec. W dalszej kolejności są to dostawcy specjalizowani obsługujący głównie sektor elektroniki, jak Semicon, Maritex, Micros, Future Electronics, Masters AET, Firma Piekarz, Euro-Impex Marketing, Würth Elektronik, Eltronika, Aksotronik.

Jeszcze inną grupę dostawców tworzą dystrybutorzy przycisków i przełączników dla systemów przemysłowych, energoelektroniki i zastosowań profesjonalnych. Takimi firmami są na przykład RA Controls, Dacpol, Eltron, Apar oraz krajowy producent – spółdzielnia Promet.

Wyświetlacze do urządzeń elektronicznych

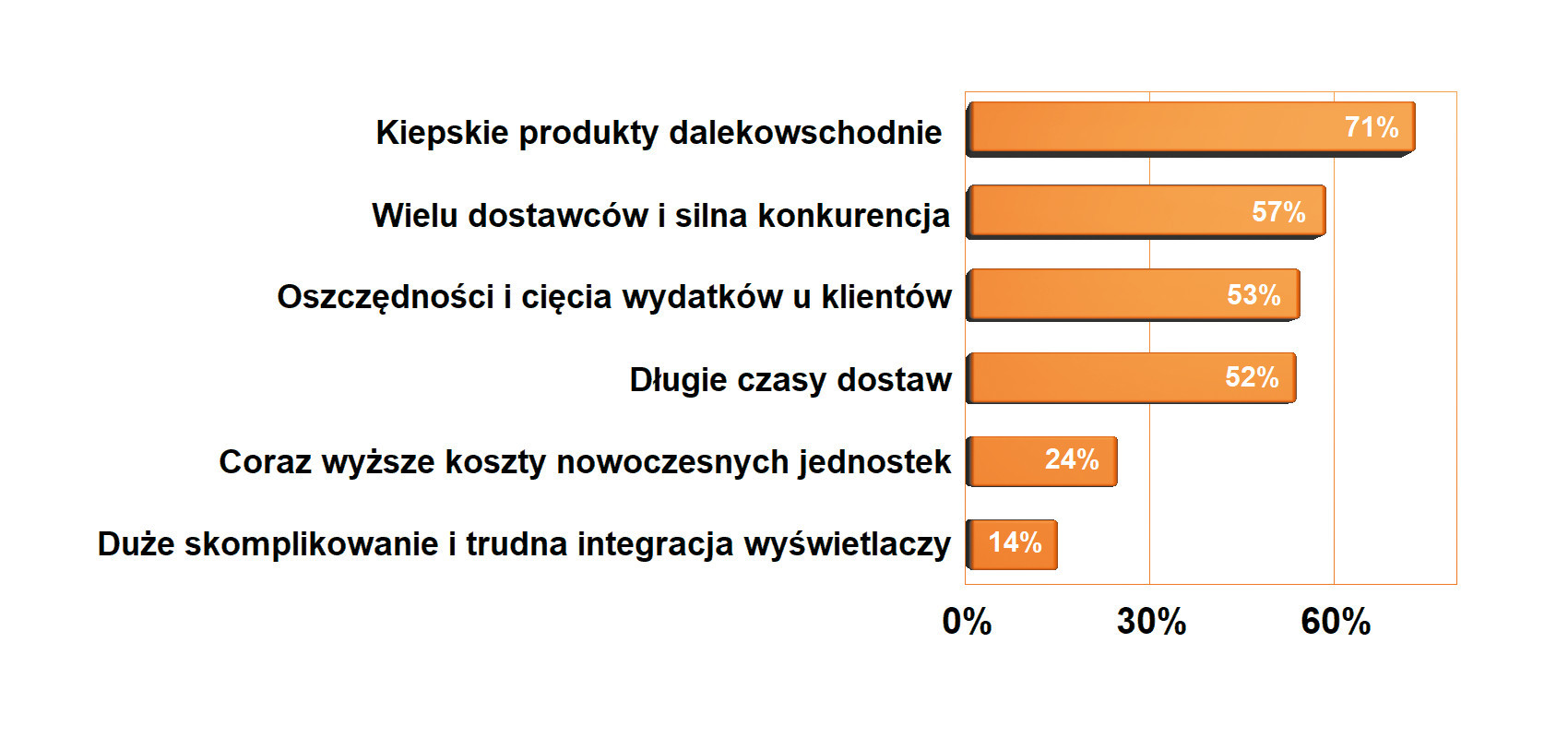

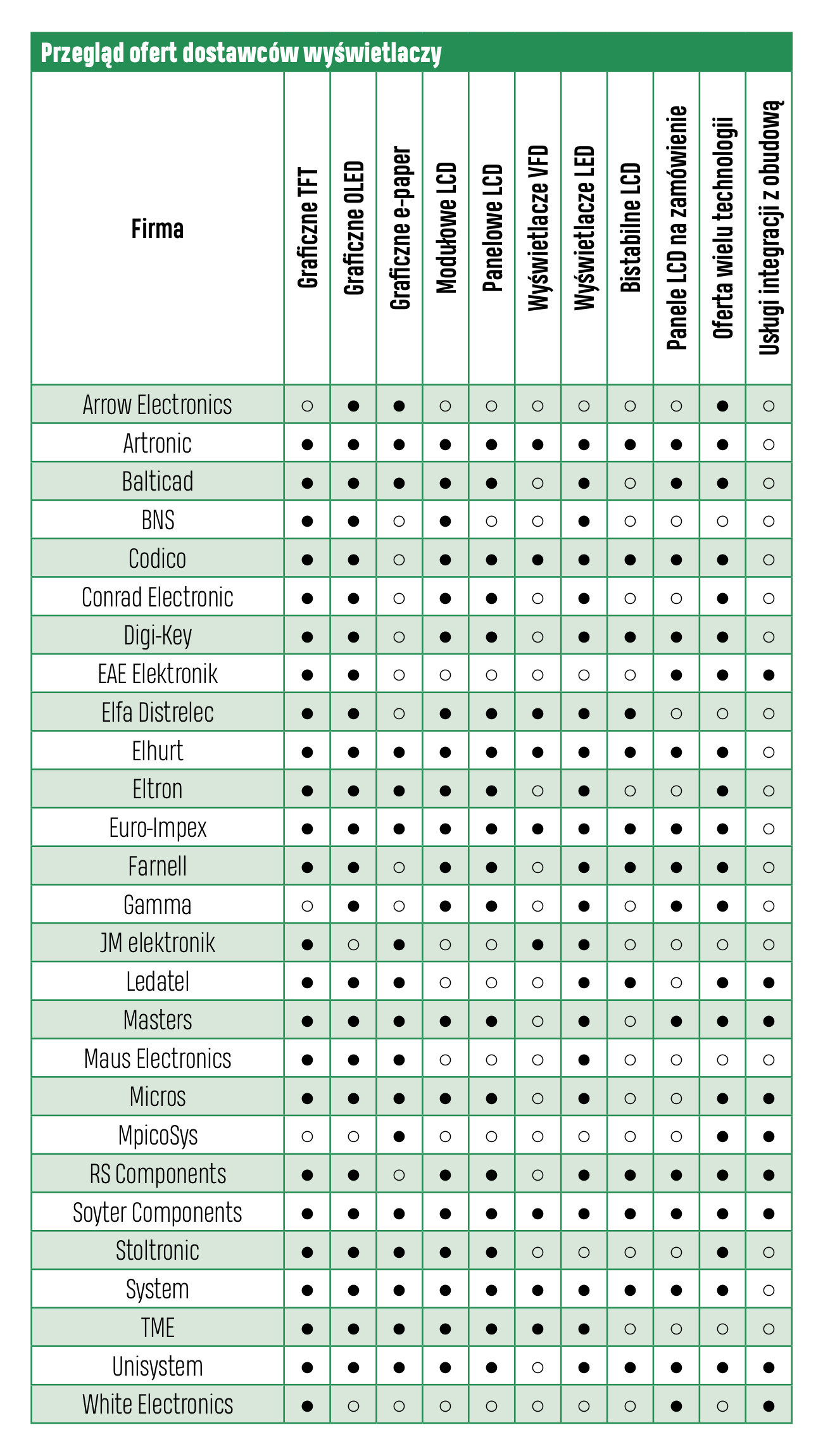

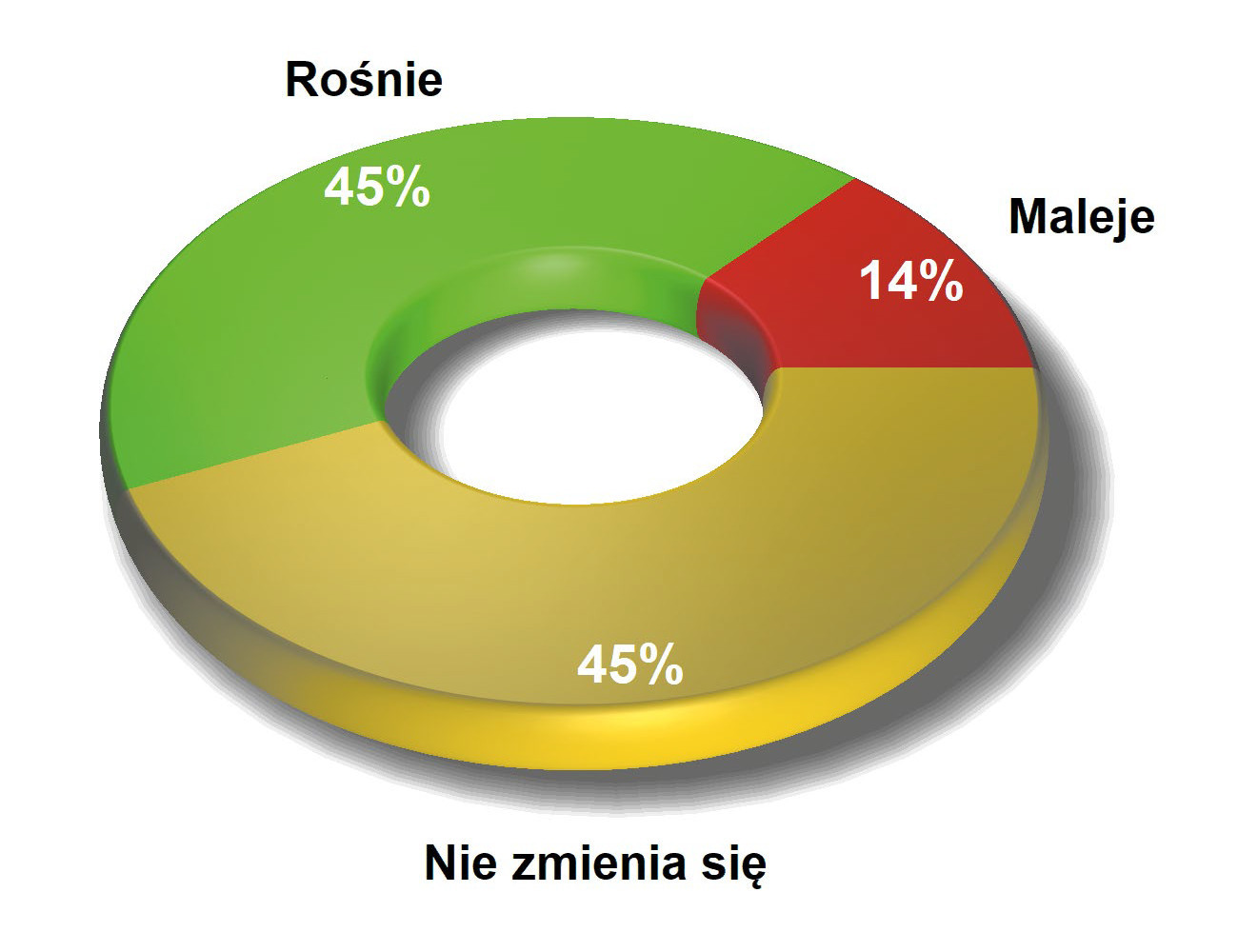

Wyświetlacz to jeden z najważniejszych komponentów elektronicznych, a duża popularność i wiele obszarów zainteresowań sprawiają, że jednostki te są atrakcyjnym produktem dla sieci dystrybucji. W ich sprzedaży liczy się to, że ich ceny jednostkowe są w porównaniu do innych elementów stosunkowo wysokie, a ponadto wyświetlacz często jest komponentem kupowanym w pierwszej kolejności. Skoro wyświetlacz w praktycznie każdym większym urządzeniu stał się niezbędny, to w konsekwencji rynek tych produktów, zarówno od strony obrotów, jak i asortymentu jest duży i szybko się rozwija w kilku kierunkach wyznaczanych przez technologie wyświetlania.

Charakterystyczną cechą rynku wyświetlaczy jest to, że czas życia poszczególnych technologii jest stosunkowo długi i nawet po okresie maksymalnej popularności poszczególne typy nie wypadają całkowicie na margines, dalej funkcjonując w niszach. Przykładem mogą być wyświetlacze segmentowe LED lub moduły znakowe LCD, które cały czas sprawdzają się w określonych aplikacjach, są modernizowane i ulepszane i nie widać, aby miały wypaść z rynku. Skutkiem jest to, że asortyment w obiegu jest bardzo szeroki. Nowe jednostki o coraz lepszych parametrach pojawiają się co chwila, a duża liczba producentów i dystrybutorów tworzy niezwykle konkurencyjny i zróżnicowany rynek. Dostęp do nowych technologii staje się coraz łatwiejszy, a ceny omawianych produktów stale się zmniejszają.

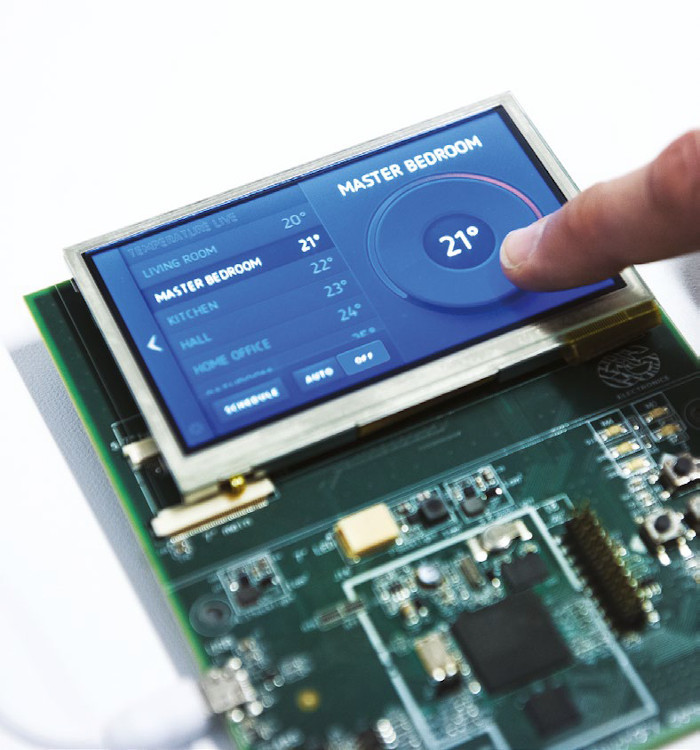

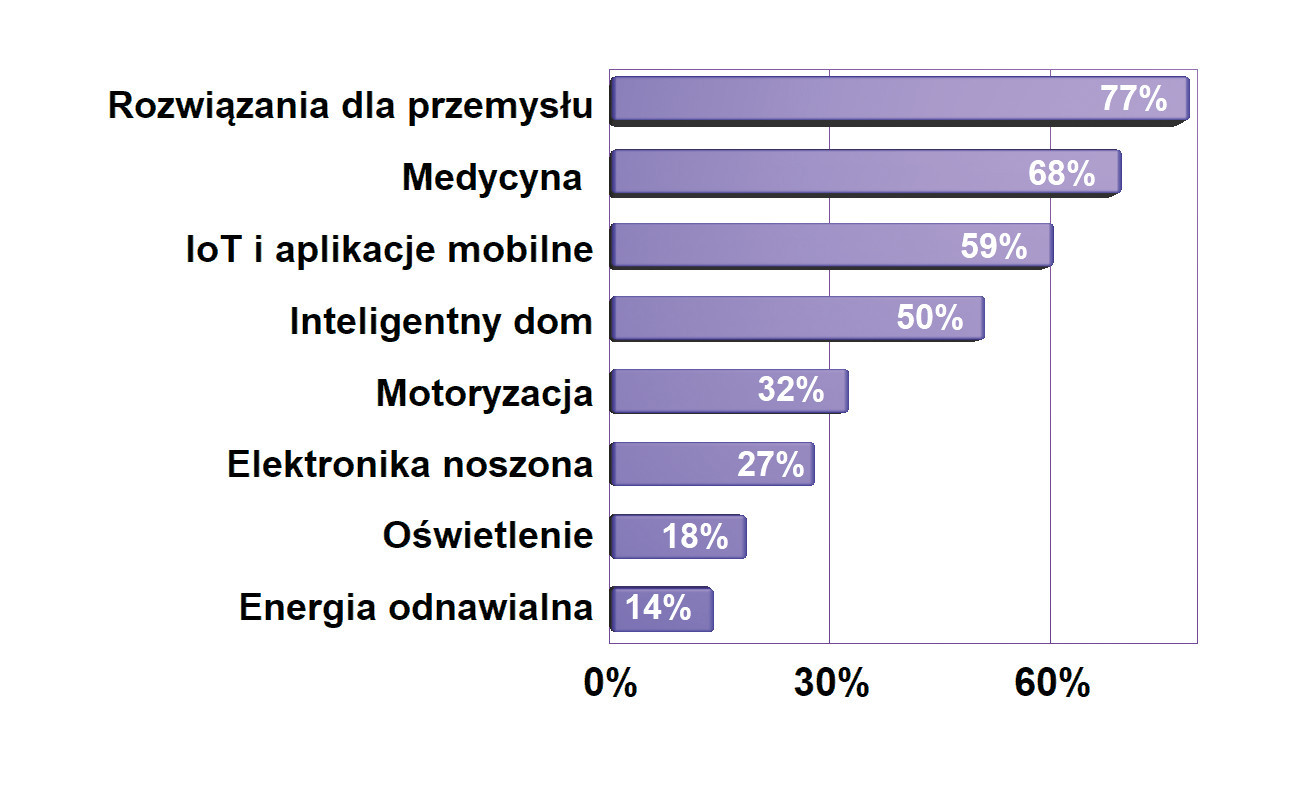

Trudno odpowiedzieć, czy i w jakim stopniu szeroki dostępny asortyment wyświetlaczy kreuje nowe aplikacje, czy też ważniejszy jest proces odwrotny, w którym rozwój elektroniki i ekspansja na nowe rynki powoduje, że potrzeba coraz więcej tych jednostek. W sumie sprowadza się to do tego samego: mamy coraz większy asortyment jednostek wyświetlaczy, są one coraz tańsze, a więc dostępniejsze, mają coraz lepsze parametry w zakresie wizualizacji danych oraz odporności mechanicznej i środowiskowej. Graficzny interfejs użytkownika z ekranem dotykowym, znany z telefonów komórkowych i innych aplikacji konsumenckich, jest też wytrychem otwierającym drzwi do wielu nowych branż, np. inteligentnego budynku, systemów bezpieczeństwa i ochrony mienia, branży reklamy i oczywiście do przemysłu, czyli sektora w Polsce najbardziej wartościowego.

Nawet w obrębie jednej grupy projektowej wyświetlacze nie są takie same, bo te przeznaczone do aplikacji konsumenckich mają inne parametry od wersji przemysłowych. Te pierwsze są zoptymalizowane kosztowo, te drugie mają lepsze parametry środowiskowe itd.

CUSTOMIZACJA I INTEGRACJA

Elektronika mobilna, noszona, aplikacje IoT, sprzęt medyczny to przykłady rozwiązań urządzeń, w których konstrukcja wyświetlacza jest silnie zintegrowana z obudową oraz całą resztą produktu. W takich przypadkach jednostka wyświetlająca jest spasowana z resztą, przyklejona do szyby lub przezroczystej części obudowy, tak aby połączenie było odporne na wpływ środowiska, narażenia mechaniczne wynikające z użytkowania oraz oczywiście estetyczne. Integracja wymaga posiadania maszyn i umiejętności, które są oferowane jako usługi przez dostawców obudów w przypadku małych serii. W przypadku większych serii dostępne są rozwiązania tworzone na zamówienie (customizowane). Częściowe lub pełne dopasowanie do projektu klienta wyświetlaczy TFT, OLED oraz paneli dotykowych polega na dostosowaniu kształtu, rozmiaru, koloru oraz innych parametrów technicznych. Takie wersje dostarczają specjalizowani dostawcy zasilaczy w połączeniu z możliwościami, jakie zapewniają im producenci. Bezzwrotne koszty takich modyfikacji z roku na rok maleją i tym samym usługi stają się coraz bardziej przystępne.

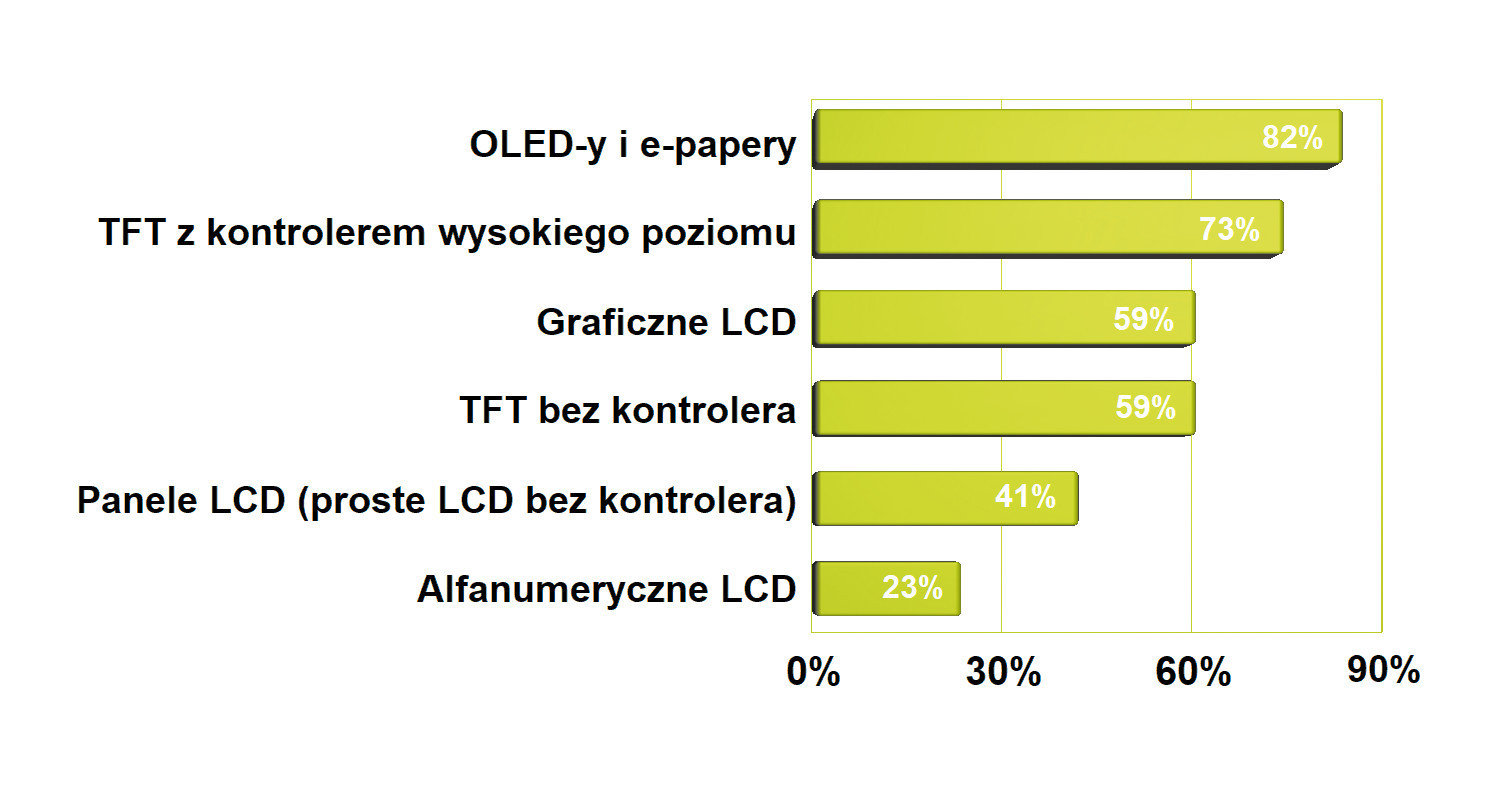

WZROST ZAINTERESOWANIA E-PAPIEREM I OLED

OLED-y i e-papiery szybko się popularyzują na bazie trendów związanych z energooszczędnością, rosnącą liczbą aplikacji mobilnych, rozwojem obszaru IoT i elektroniki noszonej. Ceny tych rozwiązań w ostatnich latach znacznie spadły, a oferta rynku się poszerzyła. Zmniejszająca się dostępność do produktów wcześniejszych generacji wymusza zainteresowanie takimi nowszymi rozwiązaniami. OLED-y zawsze kojarzyły się z wieloma walorami technicznymi, takimi jak niski pobór mocy, wysoki kontrast i duża jasność, jednak te zalety były okupione dość dużą ich ceną i niekoniecznie wielką trwałością. To oczywiście jest odległa przeszłość, bo technologia produkcji została udoskonalona i obecnie nie ma problemu, ani z jakością, ani trwałością tych jednostek.

Dzisiaj bez problemu można kupić wyświetlacze tego typu o małych przekątnych, a więc takie, które najczęściej są używane w elektronice, zarówno jako elementy graficzne, jak i zamienniki alfanumeryczne dla typowych wersji modułowych.

Podobne zjawiska można zaobserwować w zakresie wyświetlaczy typu e-paper, a więc w jednostkach, które wykorzystywane są w książkach elektronicznych. One także stają się dostępne dla systemów elektroniki profesjonalnej i przestały być domeną e-booków. Wyświetlacze takie pojawiają się w ofertach coraz częściej i jest to wyraźny znak, że w krajowych OEM-ach są one rozważane i analizowane pod kątem aplikacyjnym.

PANELE LCD ZNAKOWE

Panelowe wyświetlacze znakowe (segmentowe) LCD, które składają się z płytek szklanych z ciekłym kryształem, cały czas się świetnie trzymają na rynku i tworzą drugi biegun technologiczny będący w opozycji do złożonych i nowoczesnych jednostek graficznych. Znakowe panele LCD pobierają znikomą moc, stąd nadają się do pracy w aplikacjach mobilnych, IoT i podobnych. Nie odstają zatem od bardzo ważnego trendu energooszczędności, który jest jednym z istotnych zjawisk wypychających na margines techniki jednostki takie jak VFD. Znakomicie sprawdziły się one w kasach, a wcześniej w rozwiązaniach konsumenckich, ale duży pobór mocy przekreśla ich przyszłość.

Panelowe LCD nie wymagają też złożonego kontrolera i do ich sterowania wystarcza kontroler znajdujący się w wielu mikrokontrolerach. Implementacja jest prosta, a sam wyświetlacz tani, stąd w zastosowaniach, gdzie ilość informacji do przekazania nie jest duża, cały czas są korzystnym wyborem.

Panelowe LCD można zamówić z własnymi symbolami i w specyficznym układzie segmentów. Dawniej było to dość kosztowne i wymagało zamówienia bardzo dużej serii. Ale z czasem ceny indywidualizacji spadły, a minima zakupowe zmalały, przez co takie wyświetlacze stale są interesujące.

MODUŁY ZNAKOWE LCD

Znakowe moduły wyświetlaczy LCD z kontrolerem zawierające kilka linii zapisały się pozytywnie w ostatnich kilkunastu latach w rozwoju branży elektronicznej, zapewniając prostotę obsługi i niezłe parametry, ale coraz trudniej sprostać im wymaganiom współczesnej elektroniki. Wyświetlacze tego typu są tanie, produkowane przez wiele firm i dostępne w szerokim asortymencie kolorów, typów i rozmiarów. Ich parametry są często poprawiane przez wytwórców, dzięki czemu nie są to produkty o konstrukcji zamkniętej. Nowe opracowania dają minimalną szansę na odmłodzenie starszych urządzeń, ale fakty są nieubłagane – rynek rozwija się w innym kierunku i elementy te są powoli wypierane z rynku przez nowsze technologie.

WSPARCIE TECHNICZNE JEST BARDZO ISTOTNE

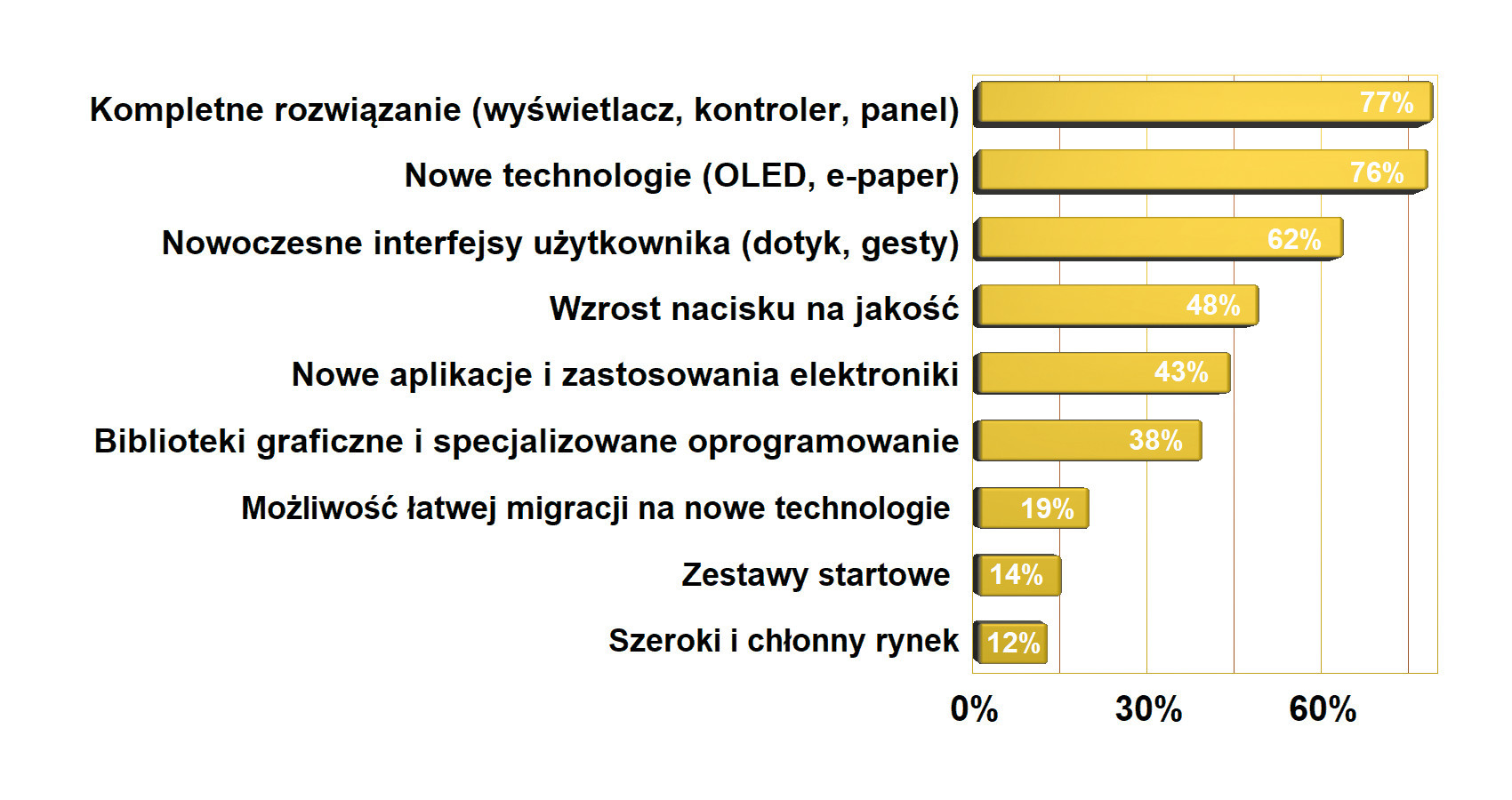

Rośnie też znaczenie bliskiej współpracy z dostawcą wyświetlaczy, bo jednostek tych jest na tyle dużo, że niełatwo o przekonanie na co postawić w projekcie. Nie chodzi nawet o jakąś ogólną orientację, ale o dokładne rozeznanie w szczegółach, które niekoniecznie można wyczytać z kart katalogowych. Unikanie pułapek wymaga posiadania doświadczenia, spojrzenia z szerszej perspektywy lub po prostu podzielenia się problemem z innymi specjalistami. Wzrost znaczenia wsparcia technicznego jest więc skutkiem ubocznym szerokiej oferty rynku i krótkiego czasu życia wielu technologii. Najwięcej do powiedzenia w zakresie wsparcia mają specjalizowani dostawcy wyświetlaczy i bezsprzecznie firmy te mają znaczną przewagę nad handlowymi.

Dawniej, gdy rynek nie rozwijał się tak szybko i nowe jednostki wyświetlające nie pojawiały się co chwila, możliwość opanowania szczegółów wyświetlacza, poznania niuansów kontrolera, była lepsza. Inżynierowie ogólnie mieli więcej czasu, a same wyświetlacze były także prostsze od strony technicznej. Inżynier, który godzinami ślęczy nad projektem, zazwyczaj nie jest dogłębnie zorientowany w szczegółach, a więc w tym, co jest dostępne na rynku, które rozwiązania mają przyszłość, a nie są kolejnym przystankiem w rozwoju technologii i wynikiem eksperymentów producentów. Na dodatek wraz z każdą nową generacją wyświetlaczy ich skomplikowanie rośnie. Nie chodzi o to, że jest coraz więcej pikseli do obsłużenia, ale o cały proces sterowania, który obejmuje coraz więcej zagadnień, w tym komunikację z kontrolerem, połączenie z panelem dotykowym, zarządzanie poborem mocy itd. Teraz, gdy czasu jest coraz mniej, potrzeba korzystania z gotowych rozwiązań sprzętowych, fragmentów kodu, bibliotek jest coraz bardziej zarysowana.

Wsparcie techniczne związane z wyświetlaczami przesuwa się też w stronę aplikacyjną, czyli doboru optymalnej jednostki z punktu widzenia aplikacji, integracji wyświetlacza z obudową lub połączenia w całość elementów takich jak złącze, interfejs, wyświetlacz, kontroler oraz panel. Elementów składających się na kompletne rozwiązanie jest coraz więcej, stąd ryzyko złego wyboru też niestety rośnie.

Wsparcie aplikacyjne obejmuje także coraz bardziej popularne gotowe do użycia płytki zawierające projekty referencyjne. Stanowią one przykłady do naśladowania, są demonstracją dobrych praktyk projektowych i dają szansę tego, aby na początku pracy nie popełnić drobnej, ale trudnej do znalezienia pomyłki. Liczne zestawy startowe, będące nierzadko kompletną platformą sprzętową dla aplikacji, plus dostępne oprogramowanie i biblioteki procedur w wielu przypadkach sprawiają, że nakład pracy wymaganej do obsługi wybranych popularnych modeli wyświetlaczy graficznych z panelem dotykowym jest porównywalny z tym, jaki kiedyś trzeba było poświęcić na obsługę prostych modułów znakowych z wbudowanym kontrolerem.

POPULARYZACJA GRAFICZNYCH INTERFEJSÓW UŻYTKOWNIKA

Graficzny interfejs użytkownika staje się coraz dostępniejszy nawet w aplikacjach, gdzie dostępne zasoby sprzętowe są niewielkie. Pomocą są tutaj biblioteki oprogramowania lub wyświetlacze ze specjalizowanym kontrolerem i rozbudowaną pamięcią. Znosi to wiele problemów takich, że aplikacje proste zwykle miały siermiężny GUI. Dawniej problemy te omijano, wykorzystując wyświetlacze modułowe znakowe, których jedną z zalet było to, że wyświetlanie było banalnie proste. Teraz to samo można mieć w graficznych kolorowych TFT, a więc ze znacznie lepszą jakością zobrazowania.

ELEKTRONIKA KONSUMENCKA ŹRÓDŁEM INNOWACJI

Wydaje się, że źródłem innowacji i nowych technologii jest dzisiaj elektronika konsumencka, a w dużej mierze smartfony. Tam trafiają innowacje związane z wyświetlaczami, panelami dotykowymi, a w ostatnich latach także czujniki linii papilarnych, kamery do rozpoznawania twarzy lub sensory typu ToF do wykrywania gestów. Mimo że nie wszystkie te produkty wiążą się bezpośrednio z tematyką wyświetlaczy, z uwagi na zagadnienia związane z ich integracją w kompletną jednostkę, jest to w pewnym stopniu ich funkcjonalna część. Takie "dodatki" są montowane pod szkłem panelu dotykowego, dlatego należy oczekiwać, że z czasem takie podejście będzie standardem dla rynku i tak jak dzisiaj mamy wyświetlacz z panelem, tak będzie niedługo z tymi czujnikami. Aktualnie słychać zapowiedzi o integracji pod szkłem panelu kamery w smartfonach, co przekonująco wyznacza kierunek, w którym będzie w kolejnych latach szedł rozwój rynku.

Dominacja elektroniki konsumenckiej w innowacjach niesie też negatywne zjawiska. Tempo rozwoju technologii jest szybkie i wiele rozwiązań po krótkim czasie wypada z ofert. Oznacza to, że rynek przemysłowy ma kłopoty z szeroką adaptacją rozwiązań konsumenckich, gdyż nie jest w stanie zagwarantować wieloletniej dostępności i niezmienności wyświetlaczy. Klienci oczekują często, by wyświetlacze przemysłowe miały porównywalne parametry optyczne oraz technologiczne, a co więcej także cenowe. Nie jest to możliwe, ponieważ wyświetlacze przemysłowe mają dłuższy czas pracy, tzn. wykonane są z komponentów o wyższej jakości i tym samym droższych. Są też produkowane przez wiele lat, więc muszą wykorzystywać starsze linie i technologie, ponadto często wytwarzane są w mniejszych partiach i utrzymywane w magazynach producentów i dystrybutorów, co również prowadzi do wyższej ceny.

Nierzadko kolejne generacje rozwiązań konsumenckich nie są kompatybilne z poprzednikami. Do różnic mechanicznych i w rozkładzie wyprowadzeń dochodzą tu jeszcze inne kontrolery, interfejsy, co niestety dla wielu nabywców okazuje się już bagażem pod ich siły. Do tego na nowe wersje trzeba długo czekać, spełnić minima zakupowe, a te o bardziej unikalnych właściwościach potrafią szybko wypaść z produkcji. Są to te minusy, jakie niesie dominacja elektroniki konsumenckiej.

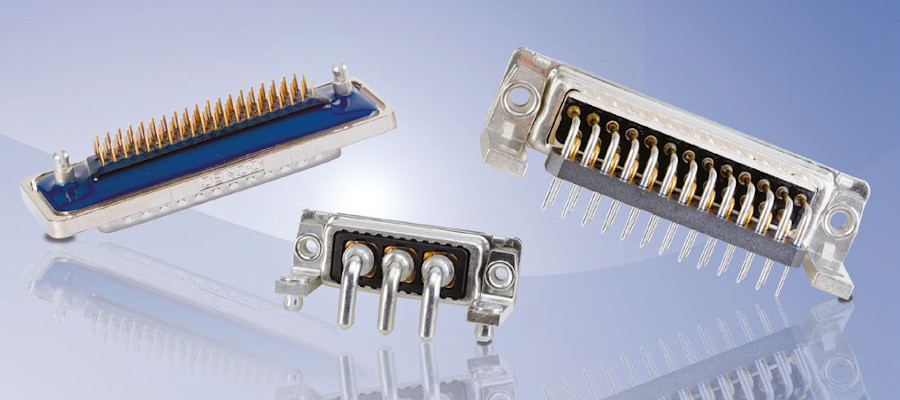

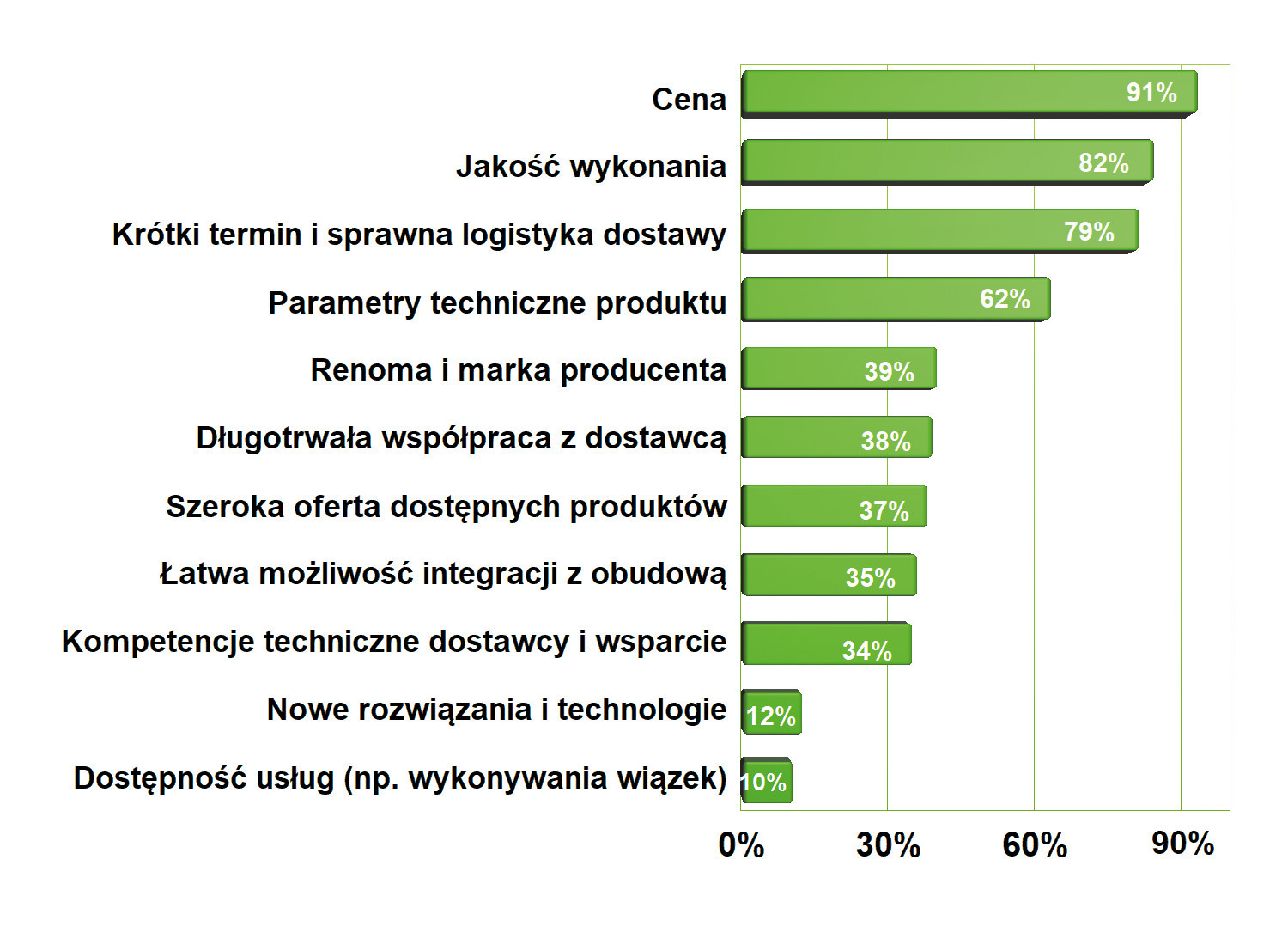

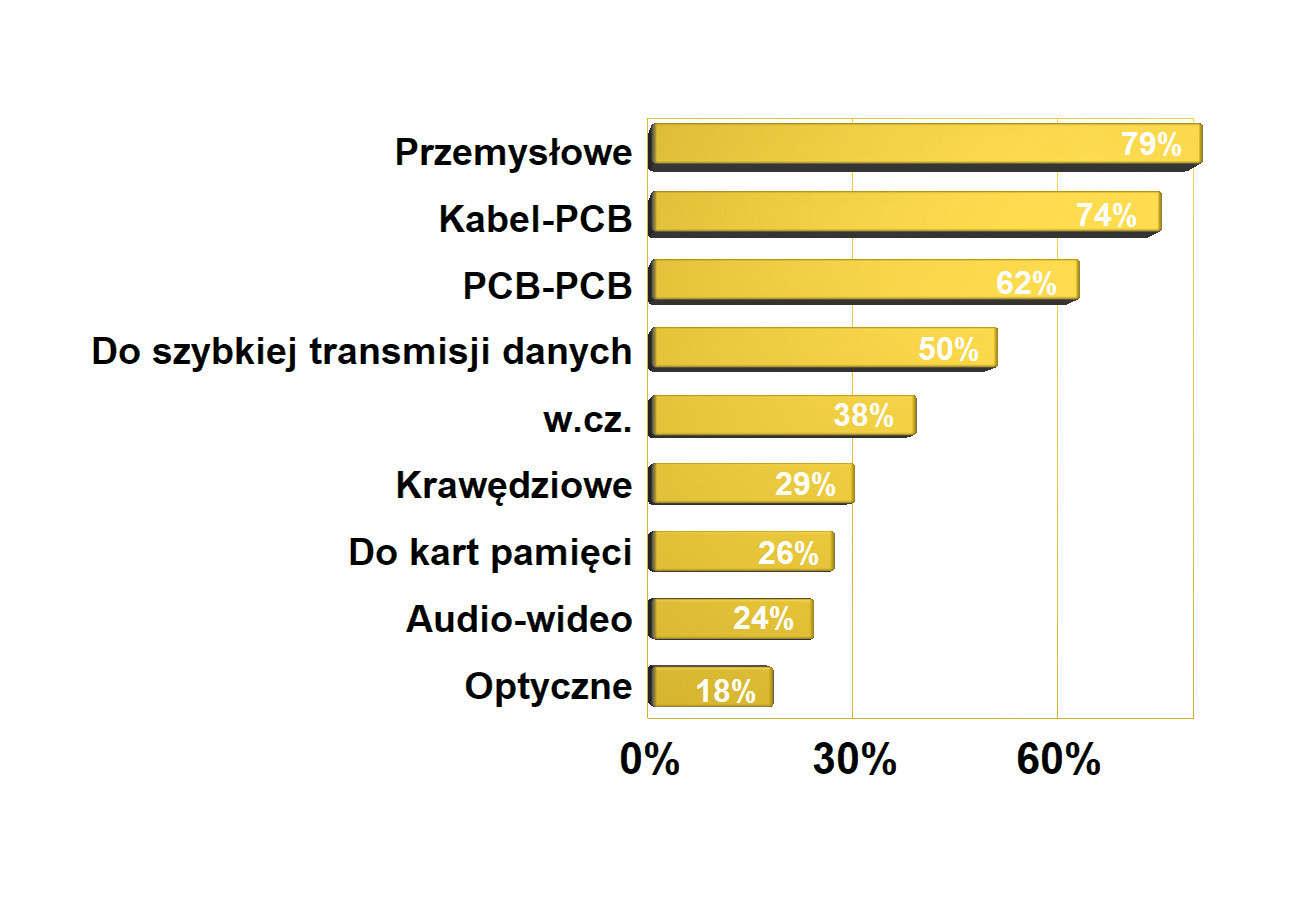

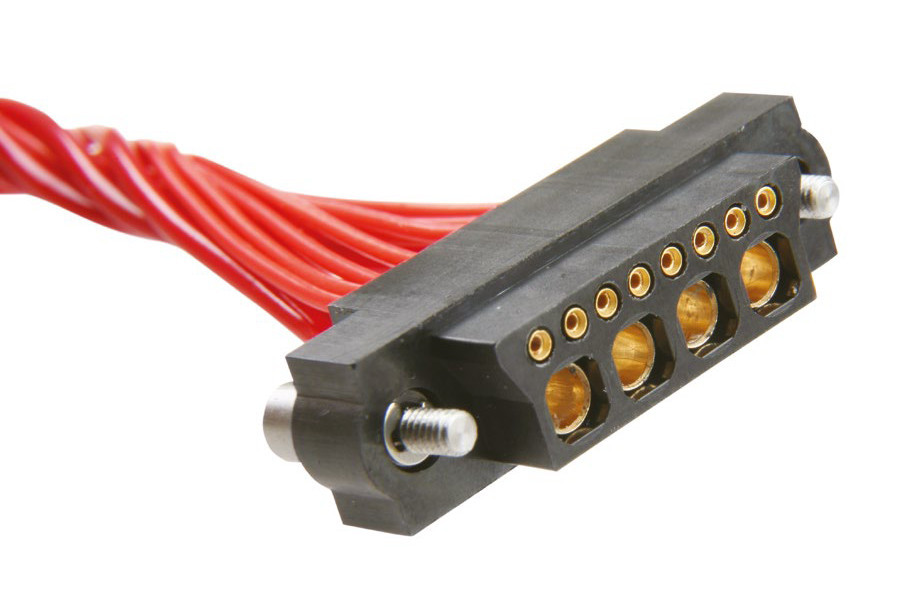

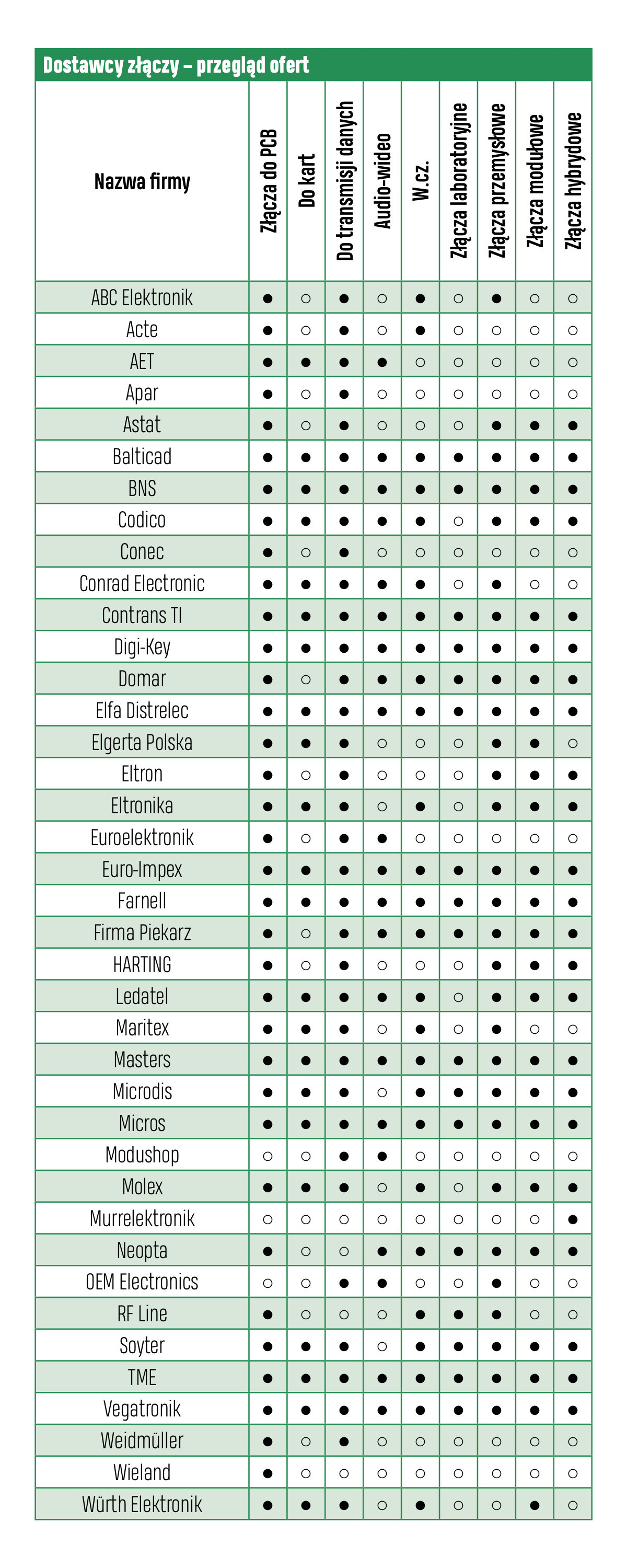

Złącza sygnałowe do urządzeń elektronicznych

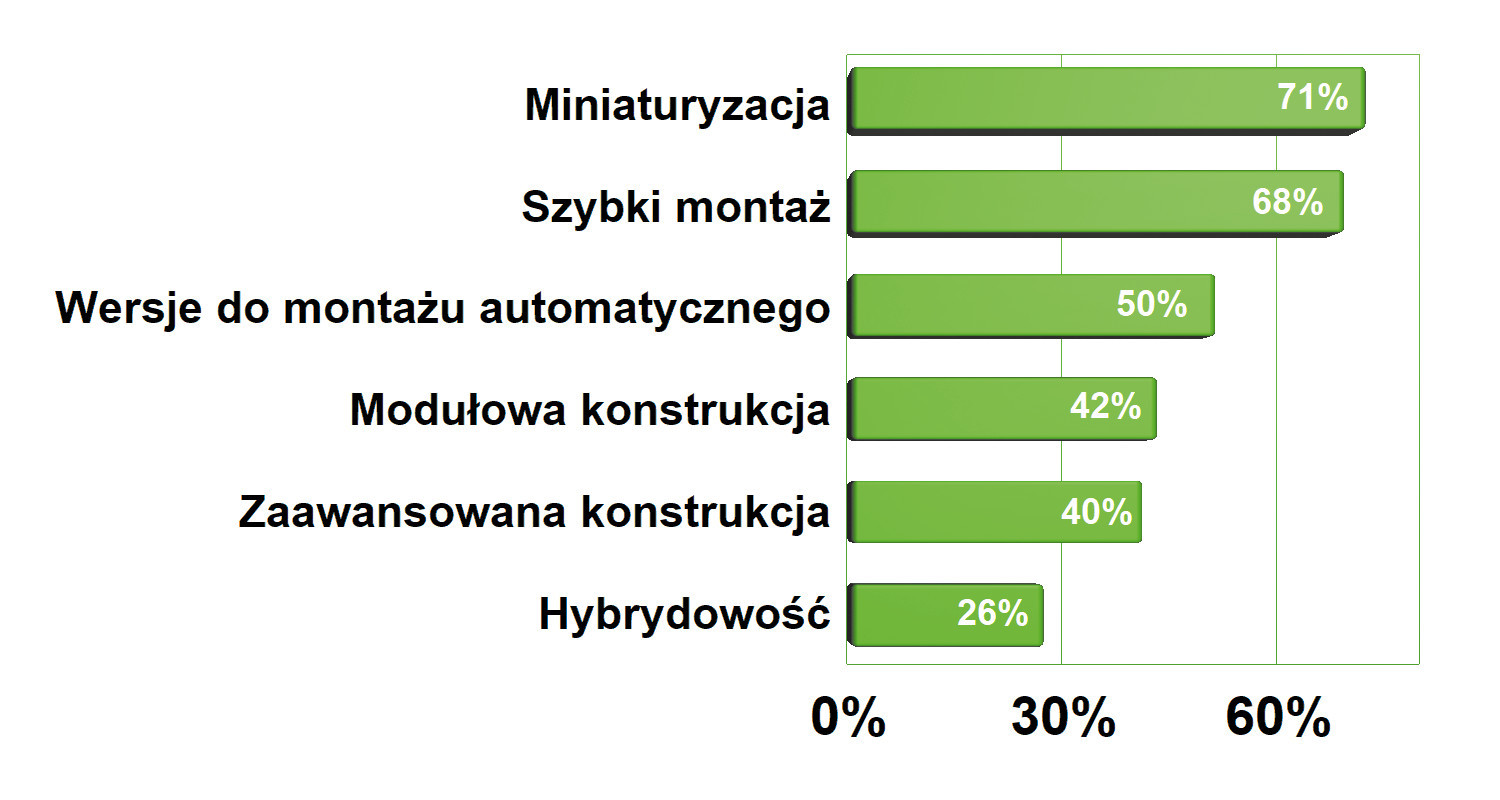

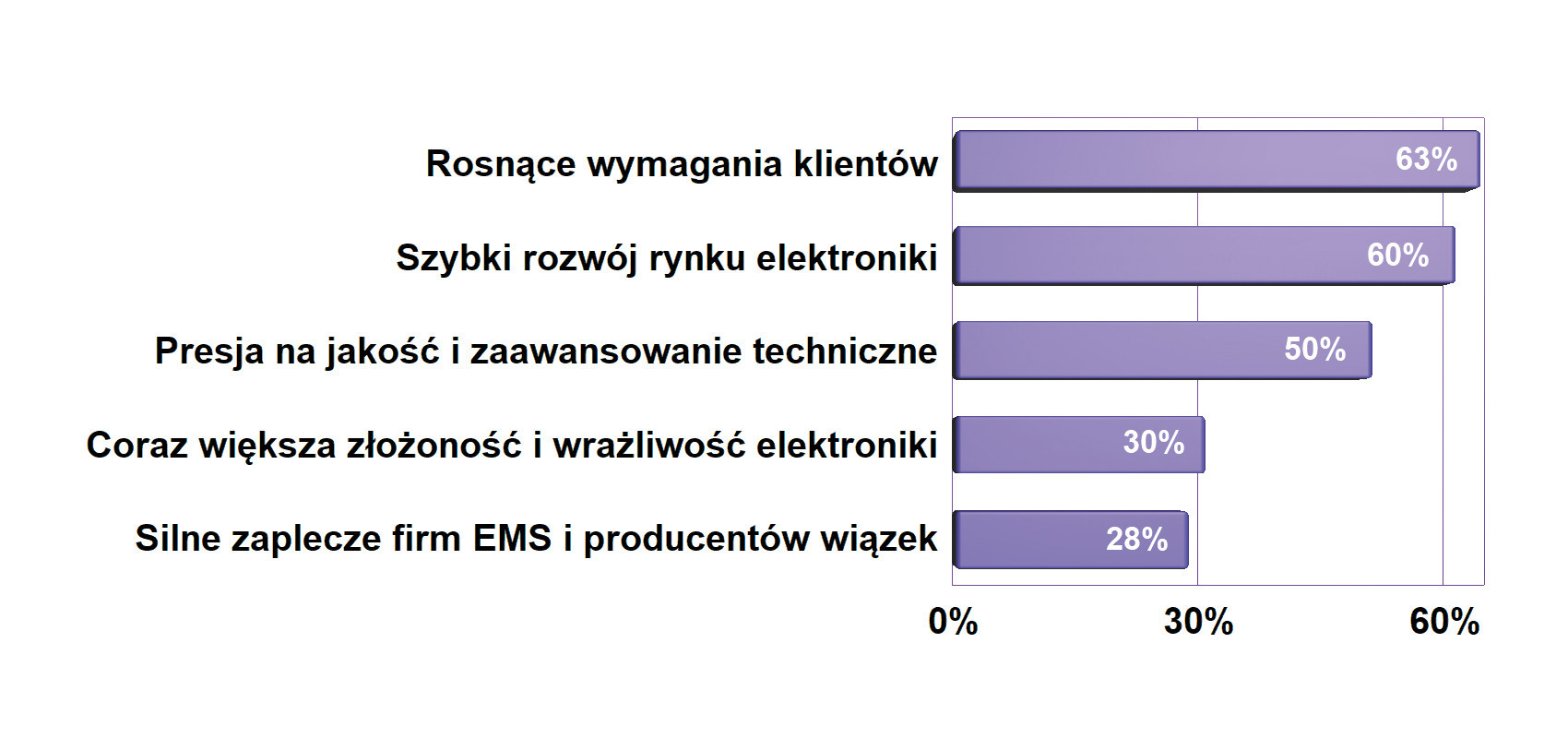

Popyt na złącza i ciągle rosnący rynek kształtują w największej części zmiany w elektronice, jak rosnąca złożoność układowa, coraz większa penetracja rozwiązań mechatronicznych i robotyzacja w przemyśle, miniaturyzacja i modułowość konstrukcyjna oraz podobne. Postępujące skomplikowanie przekłada się na wzrost zapotrzebowania na złącza i zjawisko to nie zmienia się od lat. Sam rynek produktów OEM też rośnie w dobrym tempie, przewyższającym zwykle istotnie średnioroczny wzrost gospodarczy, a spory potencjał Polski w zakresie produkcji EMS oraz usług outsourcingowych w zakresie produkcji wiązek kablowych też jest wsparciem dla rozwoju. Rynek od strony produktów też wydaje się skomplikowany, bo brak standardów przy ogromnej liczbie dostępnych elementów, a nawet przy braku wspólnego systemu oznaczeń powoduje, że niewielu inżynierów dobrze się orientuje w tej tematyce. Wiedza o produktach zwykle ogranicza się do podstawowych i używanych od dawna wersji.

MINIATURYZACJA W ZŁĄCZACH SYGNAŁOWYCH

Współczesna elektronika jest coraz bardziej złożona, a jednocześnie mniejsza, lżejsza, bardziej mobilna. W obudowach jest coraz mniej miejsca, bo trzeba zmieścić ogromną liczbę podzespołów, pojemny akumulator, system chłodzenia, dodatkowy filtr lub ekran i oczywiście duży wyświetlacz. Złącze, podobnie jak przekaźnik, to element, który pod względem wymiarów jest relatywnie duży w porównaniu do reszty elektroniki i jak nietrudno dostrzec, zaczyna też wielkością przewyższać zaawansowane półprzewodniki mocy.

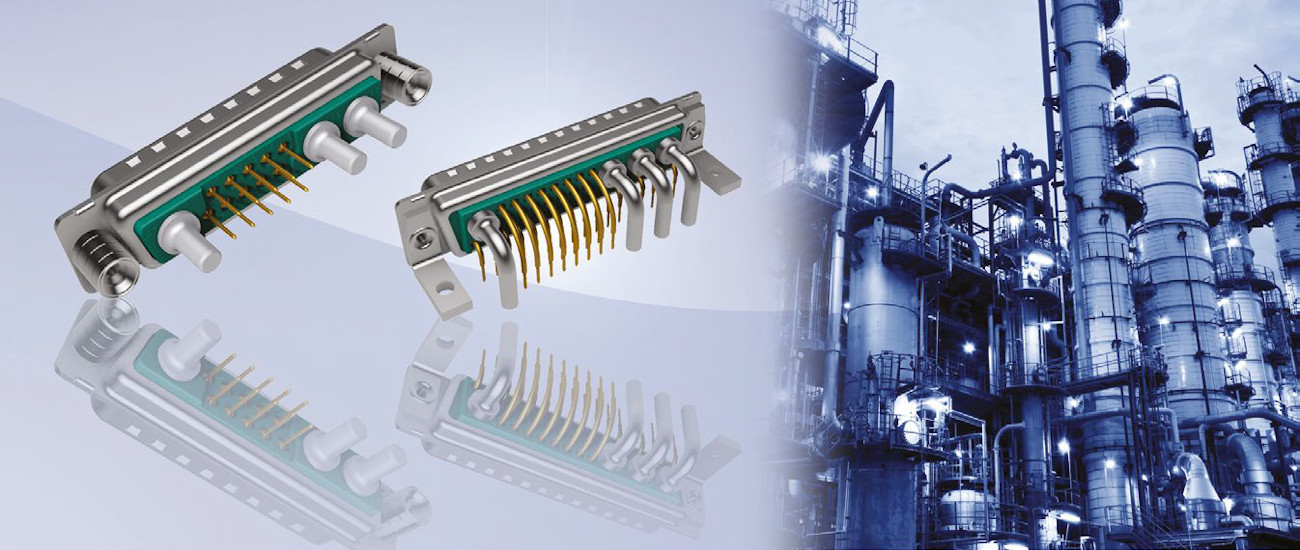

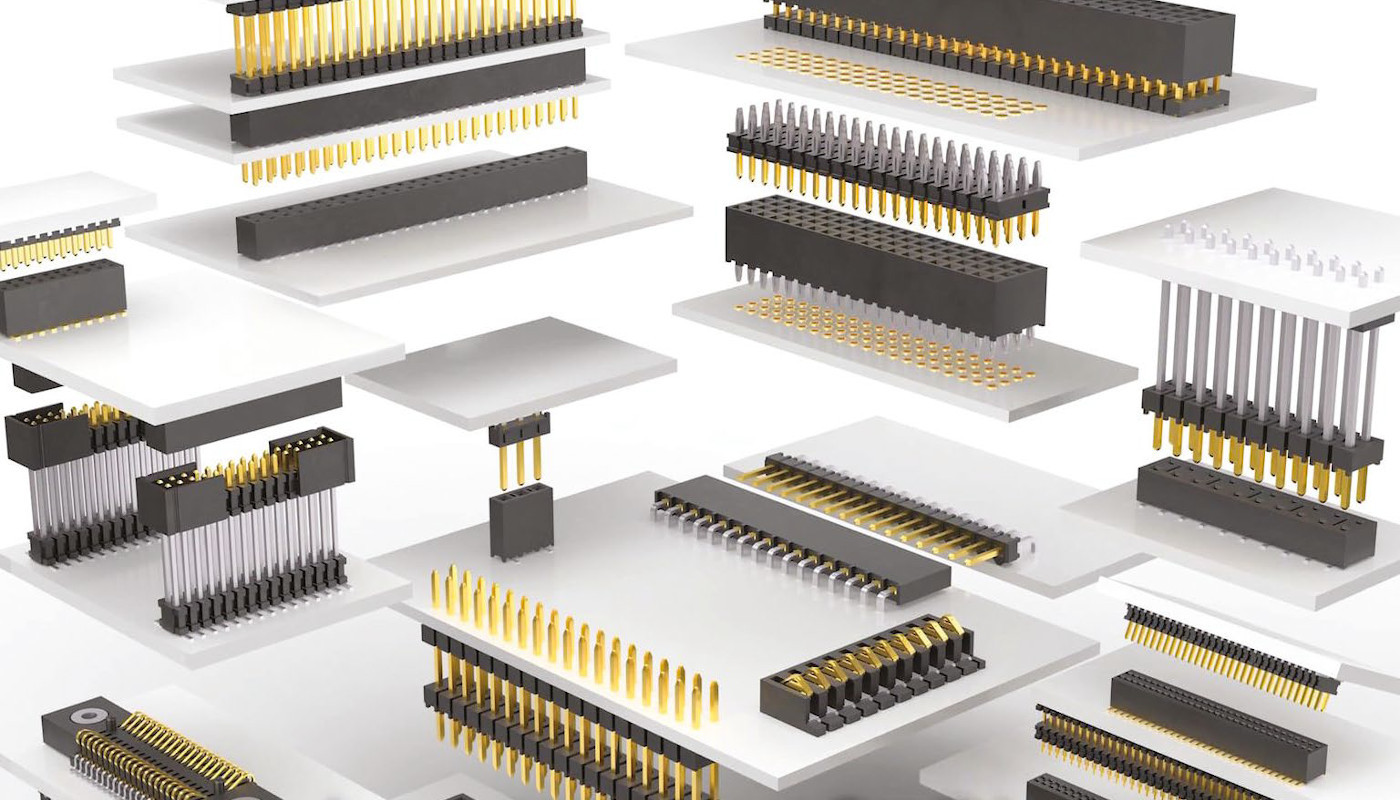

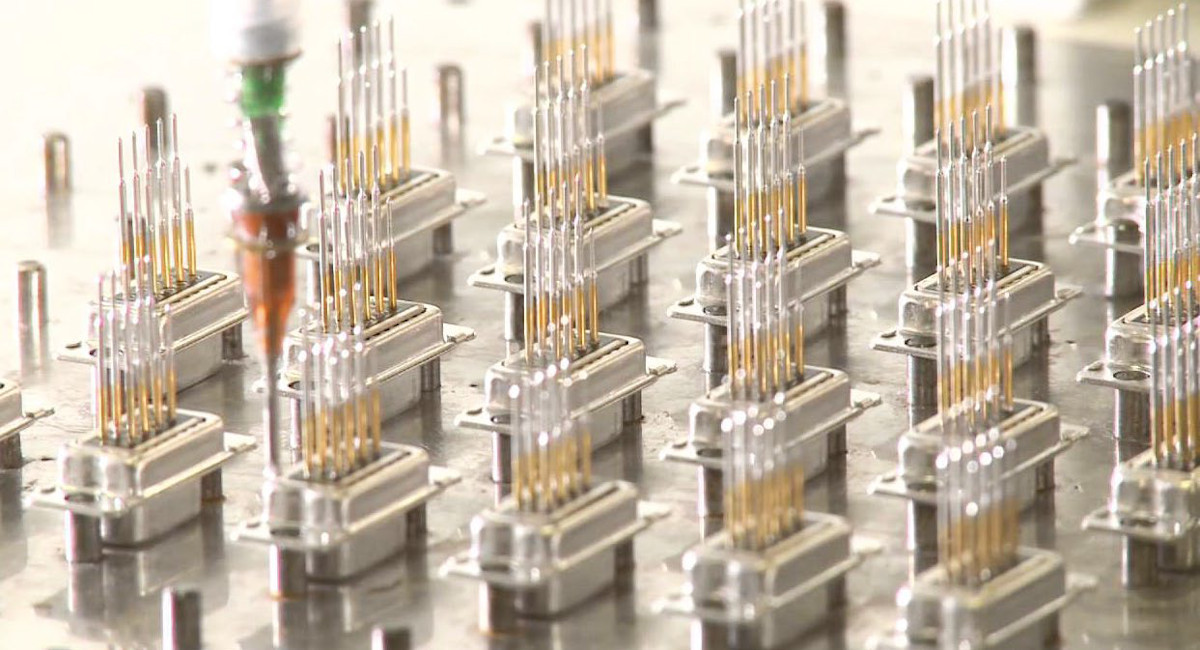

Nowoczesne złącza muszą być więc coraz mniejsze, a w przypadku elementów sygnałowych, gdzie wyprowadzenia nie przenoszą dużych mocy, oczekiwań rynku nie ma co hamować. W efekcie wiele nowych konstrukcji pod względem precyzji wykonania, upakowania i rozwiązań konstrukcyjnych detali mechanicznych przypomina pod kątem precyzji i zaawansowania szwajcarskie zegarki. Trend na upakowanie pinów i mniejsze rastry jest bardzo silny. Szczególnie imponujący postęp nastąpił w ostatnich latach w złączach międzypłytkowych (mezzanine connectors), elementów łączących PCB z taśmą elastyczną i rozwiązań dla szybkich interfejsów cyfrowych, np. USB typu C lub LVDS. W nich piny mają grubość włosa, a raster nie wykracza poza 0,5 mm. Obudowy nowoczesnych konstrukcji omawianych elementów są mniejsze dzięki większej precyzji wykonania detali, lepszym tworzywom sztucznym oraz wyrafinowanej konstrukcji mechanicznej, np. zapewniającej możliwość korekcji położenia wtyku w stosunku do gniazda i ograniczenie naprężeń mechanicznych.

ZAMIENNIKI – PROBLEM CIĄGLE ISTOTNY

Zamienniki złączy to temat aktualny od lat. Im dany typ komponentu jest bardziej popularny, tym więcej na rynku jest dostępnych jego zamienników. Pod tą nazwą kryją się produkty innych producentów, które są zgodne mechanicznie i elektrycznie i mogą być wymiennie używane zamiast pierwotnego typu. Przykładem mogą być złącza w standardzie popularnych interfejsów cyfrowych (USB, HDMI, Ethernet), które są produkowane przez wiele firm, w tym tanich producentów azjatyckich. Wiele zamienników kryje też obszar kart i modułów pamięci, kart mikroprocesorowych, złączy do płytek drukowanych współpracujących z goldpinami, elementów do łączenia płytek drukowanych w moduły i podobne. Efektem jest koncentracja kupujących na cenie, a nie na tym, co te zamienniki reprezentują pod względem jakości i parametrów technicznych.

Zamienniki nie byłyby dużym problemem dla rynku, gdyby zawsze reprezentowały wysoki poziom jakościowy. Prawdą jest, że część z takich produktów ma niezłe właściwości i nie sprawia kłopotów w mniej odpowiedzialnych aplikacjach lub tam, gdzie złącza są rzadko używane. Ale wiele z takich elementów to po prostu tandeta, co tworzy chaos informacyjny, utrudnia wybór produktu i sprawia, że nierzadko staje się on loterią.

Zamienniki mają też kłopoty z powtarzalnością parametrów mechanicznych i elektrycznych w obrębie większych serii, stabilnością parametrów elektrycznych w czasie i w funkcji kolejnych cykli łączenia i rozłączania. Nie jest to wielki problem, gdy dotyczy typowych rozwiązań o dużych rastrach i wymiarach, ale w takich miniaturowych rozwiązaniach, gdzie odstęp pomiędzy pinami jest poniżej milimetra, nawet drobne wahania skutkują niepewnością kontaktu. Jest to problem dla producentów, którzy z sukcesem zakończyli fazę prototypowania i wypuścili pierwszą próbną serię, a potem w produkcji masowej napotykają to, że działanie złączy staje się przypadkowe.

Zamienniki są chętnie wybierane do aplikacji, gdzie złącze jest używane sporadycznie, np. służy do aktualizacji firmware raz na rok, pełni funkcję portu serwisowego itp. W miejscach niekrytycznych, czyli rzadko używanych, niedostępnych dla użytkownika, bez wpływu na poprawne działanie urządzenia, zamienniki postrzegane są jako dobry wybór.

STANDARDY BRANŻOWE WPŁYWAJĄ NA RYNEK ZŁĄCZY

zakresie złączy sygnałowych widać, że z roku na rok na rynku funkcjonuje coraz więcej typów elementów o specjalizowanej konstrukcji pod kątem zastosowań i standardów branżowych. Rynek kieruje się ku specjalizacji, a ona wymusza tworzenie konstrukcji dopasowanych do wymagań aplikacyjnych, np. do nowej wersji interfejsu komunikacyjnego, do specyficznego czujnika itd. Poszerza to asortyment i pozwala producentom na ucieczkę technologiczną do przodu, w kierunki zaawansowania technicznego elementów połączeniowych, unikatowych rozwiązań styku, z drugiej strony niestety skraca czas życia produktów. Przykładem może być interfejs USB, gdzie nowa wersja "C" szybko wypycha obecnie na margines wersje "B". A niedługo przecież pojawi się na rynku "typ D", nad którym już trwają prace.

Podobnie jest z aplikacjami IoT, gdzie niezbędne są subminiaturowe złącza koncentryczne do podłączania anteny, elementy typu PCB- flex łączące części składowe wewnątrz obudowy, tak samo jak wyprowadzenia interfejsów, gniazda kart pamięci i inne. Wszystko to oczywiście musi być tak małe, jak tylko się da, a więc inne od typowych wersji.

LATA LECĄ, A NOWOŚCI TE SAME

Nowości w złączach to także szybki montaż: przewodu i elementu na płytce. Szybkie techniki montażu dotyczą też wersji optycznych (do światłowodów). Są to trendy widoczne od dekady, ale ponieważ cały czas zmieniają one branżę i są inspiracją dla producentów do rozwoju, nieustannie postrzega się je jako nowość. W branży złączy procesy upowszechniania się nowości technologicznych trwają dość długo. Być może jest to wynik tego, że w omawianych elementach przełomy zdarzają się mniej więcej raz na wiele lat, poza nimi trwa mozolna ewolucja polegająca na doskonaleniu poszczególnych produktów, modernizacjach istniejących wersji.

Podobnie coraz więcej typów jest dostosowywanych do montażu automatycznego. Powodem są oczywiście duże koszty pracy ręcznej i problemy z utrzymaniem jakości montażu ręcznego. Duże elementy, jak złącza, przekaźniki, elementy indukcyjne, zalicza się do tych, które cały czas opierają się automatyzacji. Oczywiście na rynku są wersje SMD, niemniej nie zawsze można ich użyć bez analizy długoterminowej jakości mechanicznej połączenia.