Zagadnienia dotyczące autonomii działania maszyn i urządzeń koncentrują się na wykorzystaniu skanerów optycznych lidar i mimo że zapewniają dobre parametry, nadal nie rozwiązują wszystkich problemów. Motoryzacja do celów związanych z jazdą autonomiczną wykorzystuje lidary o zasięgu większym niż 100 m i rozdzielczości kątowej 0,1°. Jednak nie wszystkie aplikacje autonomiczne wymagają takich dobrych parametrów. Tam, gdzie trzeba zapewnić pomoc w parkowaniu lub wykrywać przeszkody podczas zamiatania ulic, wystarczą prostsze i tańsze detektory. Istnieje wiele technologii wykrywania głębi, jak czujniki radarowe działające w zakresie mikrofal, stereoskopowe systemy optyczne, akustyczne detektory ultradźwiękowe oraz lidary. Każdy z tych czujników jest w pewnym sensie kompromisem między wydajnością, wielkością i ceną rozwiązania detektora. Sensory ultradźwiękowe są najtańsze, ale mają ograniczony zasięg, rozdzielczość i pewność detekcji. Radar ma znacznie lepszy zasięg i niezawodność wykrywania obiektów, ale ma również ograniczenia rozdzielczości kątowej. Natomiast stereoskopia w oparciu o 2 kamery może wymagać zapewnienia dużej mocy obliczeniowej i ma ograniczenia dokładności, jeśli system nie jest odpowiednio skalibrowany. Lidar pomaga wypełnić te luki dzięki precyzji pomiaru głębokości, małej rozdzielczości kątowej i niewielkim wymaganiom w zakresie zasobów komputerowych niezbędnych do przetwarzania danych, nawet przy dużych odległościach. Jednak mimo to lidary są zwykle postrzegane jako nieporęczne i kosztowne, co nie musi zawsze być prawdą.

Projektowanie systemu autonomicznego z lidarem rozpoczyna się od ustalenia najmniejszego obiektu, który system musi wykryć, określenia jego współczynnika odbicia światła oraz odległości, w jakiej się on znajduje. To zdefiniuje wymaganą rozdzielczość kątową detektora. Na tej podstawie można dalej obliczyć minimalną wartość stosunku sygnału do szumu (SNR), która jest niezbędna do zapewnienia pewności wykrywania.

Zrozumienie sposobu działania lidaru jest niezbędne do dokonania odpowiednich kompromisów projektowych i umożliwia opracowanie optymalnego rozwiązania zarówno pod względem kosztów, jak i wydajności. Rozważmy na przykład autonomiczny samochód poruszający się po drodze z prędkością 100 km/h oraz autonomicznego robota poruszającego się po strefie dla pieszych lub magazynie z prędkością 6 km/h. W przypadku dużej prędkości może być istotne rozważenie nie tylko pojazdu poruszającego się z prędkością 100 km/h, ale także innego pojazdu jadącego z tą samą prędkością w przeciwnym kierunku. Dla systemu percepcji otoczenia jest to równoznaczne z obiektem zbliżającym się ze względną prędkością 200 km/h. W przypadku czujnika lidarowego, który wykrywa obiekty w maksymalnej odległości 200 m, pojazdy zmniejszyłyby wzajemną odległość o 25% w ciągu sekundy. Należy podkreślić, że prędkość pojazdu (lub prędkość zbliżania się do obiektu), droga hamowania oraz dynamika związana z wykonywaniem manewrów unikowych to problemy charakterystyczne dla każdej sytuacji. Ogólnie można stwierdzić, że do zastosowań w detekcji obiektów o dużej prędkości potrzebne są lidary o większym zasięgu.

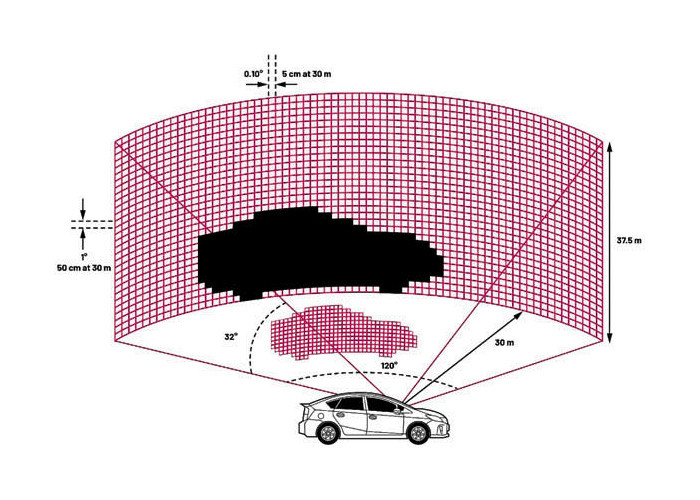

Rozdzielczość to kolejna ważna cecha charakterystyczna. Duża rozdzielczość kątowa umożliwia odbieranie sygnałów odbitych na wielu pikselach z pojedynczego obiektu. Jak pokazano na rysunku 1, rozdzielczość kątowa 1° przekłada się na piksele obrazowe odpowiadające kwadratom 3,5-metrowym na 200-metrowym dystansie. Piksele obrazu tej wielkości są większe niż wiele obiektów, które muszą zostać wykryte, co jest problemem. Stąd do poprawy współczynnika SNR i tym samym wykrywalności używa się często uśredniania przestrzennego, ale przy tylko jednym pikselu na obiekt, nie jest to możliwe, bo nie ma co uśredniać. Co więcej, nawet jeśli obiekt zostanie wykryty, niemożliwe staje się określenie jego rozmiaru. Kawałek gruzu lub część, która odpadła z samochodu, zwierzę, znak drogowy i motocykl są zazwyczaj mniejsze niż 3,5 m. Tutaj może pomóc system o rozdzielczości kątowej 0,1°, który ma piksele 10 razy mniejsze i powinien wykryć dokonując około pięć razy detekcji samochód o średniej szerokości w odległości 200 m. Większość samochodów jest zazwyczaj szersza niż wyższa i w ten sposób prawdopodobnie można odróżnić samochód od motocykla.

Wykrywanie, czy obok obiektu można bezpiecznie przejechać, wymaga znacznie dokładniejszej rozdzielczości detektora w elewacji (w pionie) w porównaniu z azymutem. Są one ważne w przypadku na przykład autonomicznego robota odkurzającego, który porusza się powoli i musi wykrywać wąskie, ale wysokie obiekty, takie jak nogi stołu.

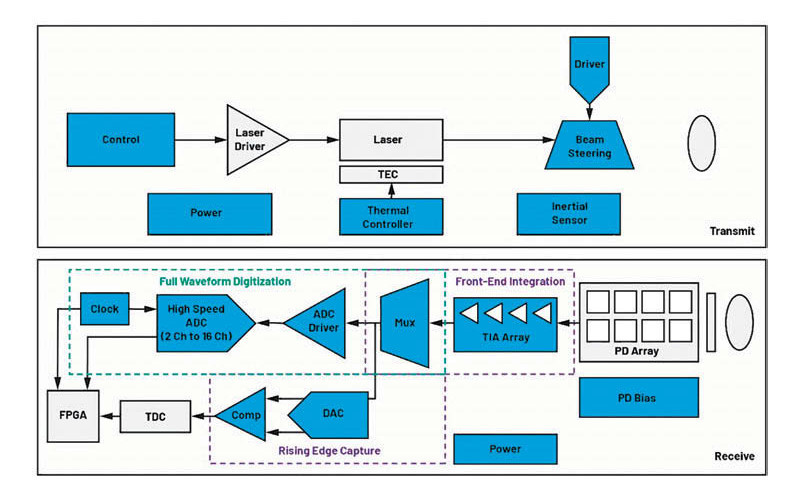

Mając zdefiniowaną odległość i prędkość obiektu, który trzeba wykryć, a także późniejsze wymagania dotyczące wydajności, można określić architekturę (sposób detekcji) systemu z lidarem, jak pomiar czasu przelotu (ToF) i system z oświetlaniem światłem błyskowym lub radar skanujący. Bez względu na typ Analog Devices zapewnia wiele niezbędnych komponentów do budowy takiego systemu (patrz rys. 2).

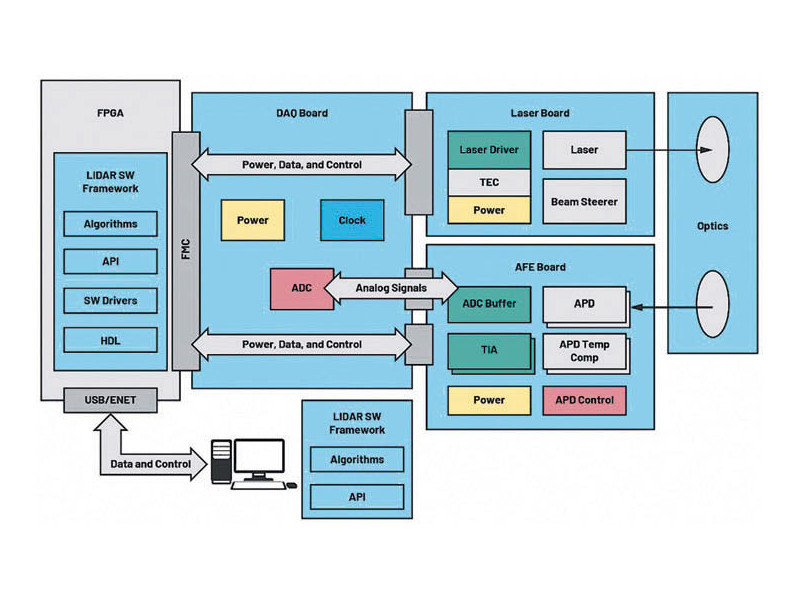

AD-FMCLIDAR1-EBZ to wydajna platforma prototypowa czujnika lidarowego bazującego na ToF z laserem podczerwonym 905 nm. Umożliwia on szybkie prototypowanie systemów robotyki, dronów oraz sprzętu rolniczego i budowlanego, a także rozwiązań klasy ADAS/AV. Jest to projekt referencyjny przeznaczony do tworzenia aplikacji o dużym zasięgu detekcji. Źródło światła sterowane jest za pomocą drivera scalonego ADP3634 współpracującego z podwójnym 4-amperowym MOSFET-em. Detektor stanowi matryca 16 fotodiod z powielaniem lawinowym (APD) firmy First Sensor. Są one zasilane z użyciem programowalnego zasilacza LT8331, który generuje wysokie napięcie niezbędne do ich pracy. Dalej znajduje się 4-kanałowy wzmacniacz transimpedancyjny (TIA) LTC6561, który wybrano ze względu na mały poziom szumów i dużą przepustowość, a także 8-bitowy przetwornik ADC AD9094 o szybkości 1 GSps, który ma w tej klasie najniższy pobór mocy na kanał (435 mW).

Minimalizacja poboru mocy przez czujnik jest ważna, ponieważ mniejsza ilość rozpraszanego ciepła, upraszcza konstrukcję mechaniczną i pozwala na zmniejszenie wielkości czujnika.

Jest to lidar typu flash, a więc bez systemu skanującego przestrzeń za pomocą wąskiej wiązki światła. Tutaj całe pole widzenia jest oświetlane szeroką, rozbieżną wiązką laserową w jednym krótkim błysku. Wykrywanie bazuje na pomiarze czasu przelotu światła od źródła do obiektu i z powrotem (ToF, Time of Flight) i czujniku matrycowym (tzw. kamera 2D), z których każdy piksel zbiera informacje o lokalizacji i intensywności sygnału odbitego. Informacja o głębokości jest zbierana z wykorzystaniem czasu przelotu impulsu laserowego do obiektu i z powrotem.

Zasięg działania jest związany z częstotliwością próbkowania przetwornika ADC. Odpowiada on też za precyzję wyznaczenia zasięgu, bo pozwala to systemowi dokładnie wiedzieć, jak daleko znajduje się obiekt, co może mieć krytyczne znaczenie w przypadkach, które wymagają bezpiecznego poruszania się na bliskim dystansie, takich jak parkowanie lub logistyka magazynowa.

Dodatkowo kolejne odczyty odległości można wykorzystać do obliczenia prędkości, niemniej precyzja układu pomiarowego jest tutaj kluczowa do osiągnięcia rzetelnych wyników. Przy wykorzystaniu prostego algorytmu z wartością progową, takiego jak bezpośredni ToF, osiągalna precyzja w pomiarze dystansu wynosi 15 cm dla szybkości próbkowania 1 ns, to znaczy z użyciem przetwornika 1 GSps. Wykorzystując interpolację danych z kilku kolejnych pomiarów, pomiar odległości może być jeszcze poprawiony za pomocą statystycznej obróbki danych zapewniającej eliminację szumu. Szacunkowo można przyjąć, że dokładność zasięgu można poprawić o pierwiastek kwadratowy z SNR.

Inny zestaw o oznaczeniu EVAL-ADAL6110- 16 to z kolei konfigurowalny lidar 2D typu flash do zastosowań wymagających wykrywania/śledzenia obiektów w czasie rzeczywistym (65 Hz), takich jak unikanie kolizji, monitorowanie wysokości i systemy miękkiego lądowania.

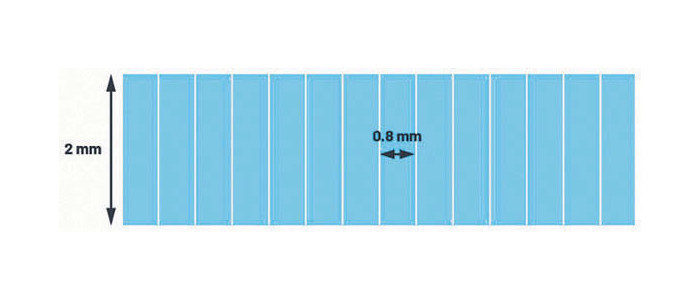

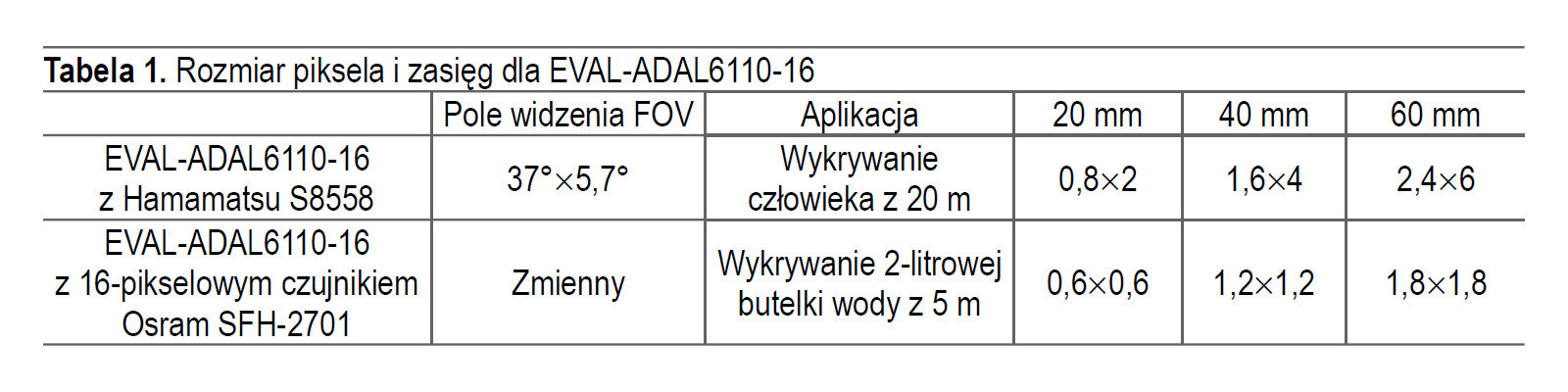

Optyka zastosowana w tym projekcie referencyjnym zapewnia pole widzenia (FOV) 37° (azymut) na 5,7° (wysokość). Z użyciem liniowej matrycy 16-elementowej zorientowanej poziomo rozmiar piksela przy 20 m odległości jest porównywalny z wielkością człowieka (0,8×2 m). Jeśli taka optyka nie spełnia wymagań aplikacji, płytkę drukowaną można łatwo wyjąć z obudowy i użyć gdzie indziej.

Przetwarzanie sygnału opiera się na układzie ADAL6110-16 firmy ADI, który jest 16-kanałowym procesorem sygnałowym lidaru (LSP, Lidar Signal Processor) o małym poborze mocy. Zapewnia on sterowanie czasem oświetlania obiektu i sterowanie próbkowaniem odebranej fali. Integracja w jednym chipie kluczowych bloków zmniejsza szumy, pozwala na zmniejszenie rozmiaru i wagi czujnika oraz zużycia energii. Moduł jest zasilany napięciem 5 V z gniazda USB i może być zintegrowany z aplikacją za pomocą jednego z czterech dostępnych protokołów komunikacyjnych: SPI, USB, CAN lub RS-232.

To rozwiązanie referencyjne może być modyfikowane w celu tworzenia dopasowanych do aplikacji konfiguracji, jak pokazano na rysunkach 5–7. Jest dostarczany z 16-elementową linijką fotodiod Hamamatsu S8558. Rozmiar piksela dla obiektywu o ogniskowej 20 mm wynosi 0,8×2 mm, a przeliczenie wielkości dla różnych odległości obiektu pokazane zostało w tabeli 1.

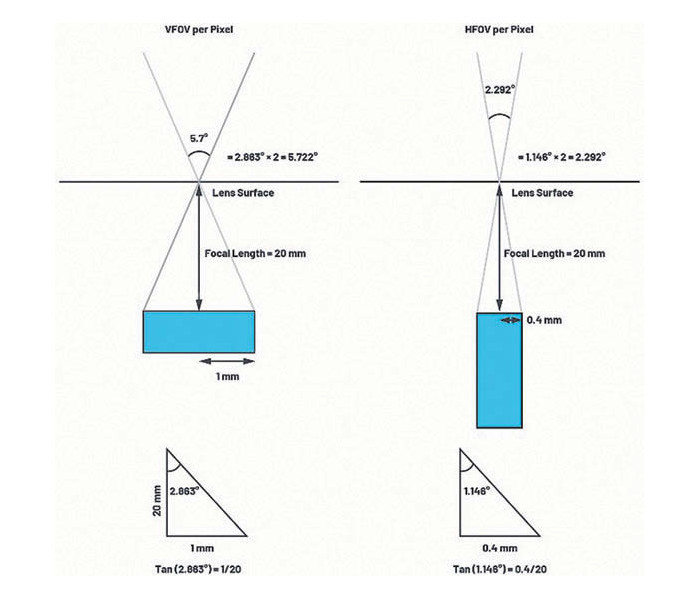

Dla obiektywu o ogniskowej 20 mm pionowe i poziome pole widzenia (FOV) na piksel można obliczyć za pomocą trygonometrii, jak pokazano na rysunku 6. Linijka 16-pikselowa nadaje się do aplikacji takich jak systemy zapobiegania kolizji w pojazdach autonomicznych i robotach. W opracowaniu jest wersja z detektorem matrycowym 4×4 pozwalającym na wykrywania obiektów obok określonego punktu i wykrywania kierunku poruszania. Przeznaczeniem będą systemy ostrzegania kierowcy o potencjalnej kolizji z samochodem, rowerem bądź pieszym, jak pokazano na rysunku 7.

Sarven Ipek, Ron Kapusta

Analog Devices

Arrow Electronics Poland

tel. 22 558 82 66

www.arrow.com