Komputery jednopłytkowe

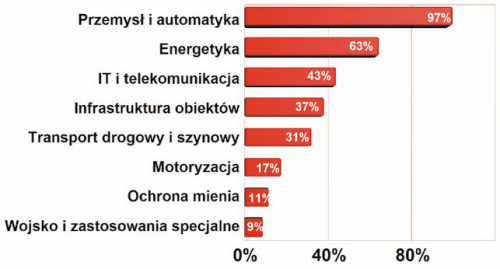

Zainteresowanie komputerami jednopłytkowymi w najbliższej przyszłości będą ciągnąć w górę aplikacje związane przemysłowym Internetem Rzeczy, koncepcją Przemysłu 4.0, a także idee takie jak smart cities. Maleńkie komputerki nie większe niż karta kredytowa są obecnie podstawą wielu aplikacji z tego obszaru, gdyż pobierają niewiele mocy zasilającej, mają małe wymiary i dają się bezproblemowo integrować w większe systemy, np. sieci rozproszonych czujników z komunikacją bezprzewodową.

Zainteresowanie komputerami jednopłytkowymi w najbliższej przyszłości będą ciągnąć w górę aplikacje związane przemysłowym Internetem Rzeczy, koncepcją Przemysłu 4.0, a także idee takie jak smart cities. Maleńkie komputerki nie większe niż karta kredytowa są obecnie podstawą wielu aplikacji z tego obszaru, gdyż pobierają niewiele mocy zasilającej, mają małe wymiary i dają się bezproblemowo integrować w większe systemy, np. sieci rozproszonych czujników z komunikacją bezprzewodową.

Zapewniają one bardzo dużą szybkość realizacji projektu, bo konstruktor musi w tym przypadku zapewnić jedynie płytę bazową ze złączem, zasilaniem i niezbędnymi układami pośredniczącymi. Tworzeniu takich aplikacji sprzyjają zmiany w technologii półprzewodnikowej pozwalające zintegrować kompletny komputer na płytce o wielkości kilku centymetrów kwadratowych o wydajności i zasobach pamięci wystarczających do uruchomienia poważnego systemu operacyjnego takiego jak na przykład Windows 10 IoT Core, Linux, Android.

Szeroka oferta, wielu producentów zajmujących się tytułową tematyką oraz nowe technologie integracji całego komputera do jednego typu SoC pozwalają producentom tworzyć wielowariantowe rozwiązania dostępne z półki w niewielkich cenach. Jeśli to nie wystarcza, dostępna jest personalizacja lub produkty tworzone na zamówienie. Coraz więcej firm proponuje wersje indywidualne, a więc takie, gdzie złącza, wymiary i kształt płytki drukowanej, pamięć i procesor dopasowane są do wymagań realizowanego projektu.

Rynek SBC przenika się ponadto ze światem tradycyjnych pecetów, z których rozwiązania w postaci nowych wersji miniaturowych płyt głównych stają się bazą dla komputerów przemysłowych jak na przykład Pico-ITX (100 × 72 mm). Trend indywidualizacji i personalizacji wymusza też rosnąca konkurencja na rynku - w walce o klienta i udziały konieczne jest wyróżnienie się oprócz wspomnianej personalizacji także wsparciem w zakresie integracji komputera z aplikacją.

ARM-Y RZĄDZĄ

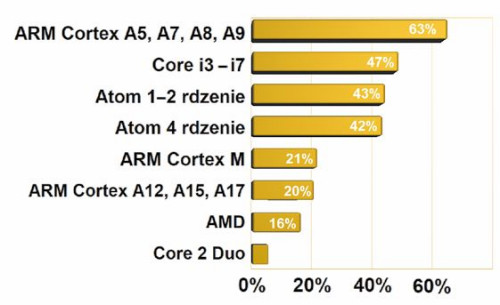

Na rynek SBC przebojem weszły w ostatnich 5 latach procesory ARM, które do takich zastosowań nadają się doskonale pod względem poboru mocy, możliwości integracji oraz dużej wydajności. Nie oznacza to oczywiście, że architektura x86 Intela jest w odwrocie. Procesory tego producenta są wybierane chętniej, gdy konieczne jest zapewnienie wysokiej mocy obliczeniowej, dobrych możliwości multimedialnych i graficznych. Z kolei układy ARM producenci mogą scalać samodzielnie w ramach SoC i tworzyć rozwiązania skrojone na miarę pod kątem wydajności zasobów i pobieranej mocy.

Ponieważ licencjobiorców ARM jest wielu, także oferta rynku w zakresie SBC wydaje się szeroka, a ceny bardzo konkurencyjne. W 2015 roku do ARM-ów należało 40% rynku, co przekonuje, że klienci cenią te układy i chętnie je stosują w swoich projektach, tym bardziej że jest w czym wybierać - mamy układy z rodziny Cortex-M o niewielkiej mocy obliczeniowej znane ze świata mikrokontrolerów, są wydajniejsze jednostki 32-bitowe Cortex-A5-A9 i 64-bitowe takie jak Cortex-A35, A53. W sumie jest to kilkadziesiąt rdzeni, które każdy z producentów obudowuje w liczne układy peryferyjne: interfejsy, komunikację, tworząc dziesiątki, jeśli nie setki wersji. Widać to zwłaszcza w przypadku modułów SOM/COM, których jest mnóstwo.

Kamil PrusFAE w Computer Controls

W kwestii nowości w zakresie systemów SBC warto wymienić rozwiązania oparte o układy procesorów mobilnych (Qualcomm), FPGA lub rozwiązania łączące standardową architekturę ARM/x86 z układami FPGA. Należy również wspomnieć o zróżnicowaniu rozwiązań w zakresie samego hardware’u, obecny rynek pozwala na znalezienie rozwiązania dosłownie "szytego na miarę".

Specyfikacja produktu jest zazwyczaj pierwszym kryterium branym przy doborze systemów SBC. W zależności od rynku oraz aplikacji strategicznymi czynnikami stają się różne kwestie np. spełniane standardy, architektura procesora czy liczba oraz rodzaje interfejsów. Bardzo ważnymi czynnikami są również: dostępność produktu, jakość oraz dostępność dokumentacji, rodzaje systemów operacyjnych, cena oraz niekiedy wsparcie producenta. Klienci opierający swoje rozwiązania o systemy SBC oczekują prostego oraz szybkiego wykonania projektu produktu/usługi. Wiąże się to z takimi kwestiami jak znajomość rozwiązania lub producenta, dostępność dokumentacji oraz sterowników, a także wsparcie oraz wiedza po stronie producenta lub dystrybutora.

Klienci zazwyczaj korzystają ze znanych im rozwiązań oraz technologii, które są sprawdzone i przetestowane, co sprawia, że poszukiwania rozwiązań zawężają się do tego, co sprawdzone i znane. Rynek dostawców oraz systemów SBC jest duży i zdywersyfikowany, liczba producentów oraz produktów sprawia, że nie sposób wszystko śledzić w momencie, gdy głównym celem jest rozwój projektu. |

FORM FACTOR

Większość SBC to prostokątna płytka z chipami oraz wielopinowym złączem lub gniazdami interfejsów umieszczonymi na jej obrzeżu, przez co można by oczekiwać, że po latach producentom uda się wypracować jakiś standard co do rozmieszczenia i wymiarów. Takie próby były i są podejmowane, a branża co jakiś czas ekscytuje się nowym wypracowanym standardem (form factor), który za każdym razem jest określany jako przełomowy. Niemniej po chwili okazuje się, że pojawia się nowy pomysł na jeszcze coś mniejszego.

W takiej rzeczywistości część producentów nie zaprząta sobie głowy normalizacją i tworzy własne konstrukcje. W efekcie na rynku funkcjonuje kilkadziesiąt rozwiązań, w tym także mniej lub bardziej otwarte (open source), rozwijane przez stowarzyszenia i fundacje (jak Raspberry Pi). W przypadku modułów COM/SOM standardów nie ma wcale, tak samo kompatybilności pinowej, za to są maleńkie wymiary, np. moduły procesorowe 40 × 40 mm lub komputerki w formacie karty PCI Express Mini 51 × 35 mm.

WŁASNY KOMPUTER?

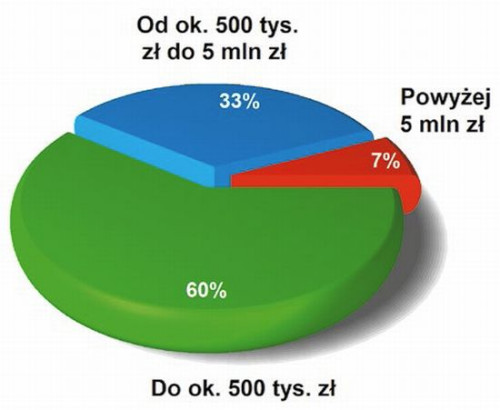

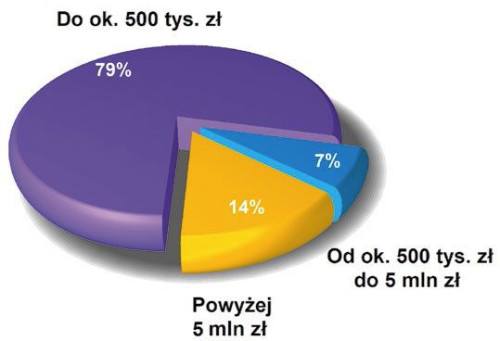

W warunkach krajowych SBC są istotnym produktem, bo wytwarzamy krótkie serie specjalistycznych urządzeń, do których nie opłaca się tworzyć własnego sterownika komputerowego.

W warunkach krajowych SBC są istotnym produktem, bo wytwarzamy krótkie serie specjalistycznych urządzeń, do których nie opłaca się tworzyć własnego sterownika komputerowego.

Próg opłacalności określający minimalną skalę realizowanej produkcji własnej, która jest niezbędna do tego, aby własna konstrukcja miała sens ekonomiczny, określa się na około 5000 szt. rocznie. Nawet zakładając, że są to dane dla Europy Zachodniej i u nas ceny pracy inżynierskiej są trochę niższe, ten próg nadal będzie wysoki i to, czy jest to 5000, czy 4500 urządzeń rocznie, w praktyce nic nie zmienia.

Po prostu w realiach krajowych to dość dużo, zwłaszcza w dzisiejszych czasach, gdy wiele kontraktów powiązanych jest z realizacją projektów i systemów tworzonych na miarę. W takiej rzeczywistości trzeba mieć naprawdę silne argumenty, aby brać się za tworzenie jeszcze jednej, własnej wersji. Świat komputerów jednopłytkowych zmienia się niezwykle dynamicznie, nowe produkty o lepszych parametrach pojawiają się co kilkanaście miesięcy i tym samym wymuszają na producentach specjalizację.

Argumentem, jaki wysuwa się przeciwko gotowym komputerom, jest ograniczona żywotność tego produktu na rynku, bo skoro technologia szybko się zmienia, to także produkty na niej bazujące stają się dostępne przez niedługi czas. Popularne modele mogą być utrzymywane w produkcji nieco dłużej, niemniej z punktu widzenia elektroniki profesjonalnej, na przykład medycznej, ograniczona czasowo dostępność jest postrzegana w tym sektorze rynku jako problem.

Niemniej warto odnotować, że co roku oferta produktów, które mają gwarantowaną długą dostępność, 5-7-letnią, się zwiększa. Okres ten też nie jest jakimś rekordem, bo wystarczy poszperać chwilę, aby znaleźć na przykład wersje z gwarantowaną 15-letnią dostępnością. To na tym rynku bardzo długo. A skoro producenci wkładają wiele wysiłku, aby komputer miał jak najdłuższy czas życia, to znaczy, że opłacalność tworzenia czegoś własnego w Polsce dotyczy raczej sterowników bazujących na mikrokontrolerach niż silniejszych jednostek przeznaczonych do pracy pod systemem operacyjnym.

POBÓR MOCY CIĄGLE MALEJE

Nowe technologie w zakresie procesorów, zaawansowanie technologii półprzewodnikowej, coraz większe upakowanie bloków funkcjonalnych w ramach układu SoC przynoszą nie tylko mniejsze wymiary płytek z komputerami, ale także coraz mniejszy pobór mocy. W przypadku μQSeven o wymiarach 4 × 7 cm jest to maksymalnie 10 W, ale nie znaczy, że ten komputer właśnie tyle pobiera.

Nowe technologie w zakresie procesorów, zaawansowanie technologii półprzewodnikowej, coraz większe upakowanie bloków funkcjonalnych w ramach układu SoC przynoszą nie tylko mniejsze wymiary płytek z komputerami, ale także coraz mniejszy pobór mocy. W przypadku μQSeven o wymiarach 4 × 7 cm jest to maksymalnie 10 W, ale nie znaczy, że ten komputer właśnie tyle pobiera.

Generalnie podawanie mocy zasilającej w przypadku omawianych produktów zawsze dotyczy wartości maksymalnej, gdyż wykorzystywane techniki oszczędzania energii, np. poprzez wyłączanie bloków nieużywanych lub ograniczanie taktowania, powodują, że podczas realizacji typowych zadań pobór mocy jest ułamkiem wartości maksymalnej.

CORAZ WIĘKSZA INTEGRACJA

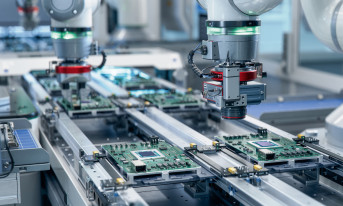

Z roku na rok komputery jednopłytkowe mają coraz mniejsze wymiary, ale też większe zasoby oraz moc obliczeniową. Jest to bezsprzecznie zasługa nowych technologii półprzewodnikowych, a więc procesów o coraz mniejszym wymiarze charakterystycznym lub metod układania jednego układu na drugim (PoP - Package over Package), po to aby zajmowały coraz mniej miejsca na płytce drukowanej.

Przełomem stało się to, że procesory i inne układy (interfejsy) są dostępne jako bloki IP (a więc jako oprogramowanie) i mogą być łatwo integrowane w jednej strukturze jako układ SoC (System on Chip). Efekty są imponujące, bo nieźle wyposażony komputer zajmuje na płytce powierzchnię nieznacznie przekraczającą 20 cm2. Znakiem możliwości, jakie kryją się we współczesnej technologii półprzewodnikowej, jest także dostępność matryc FPGA, które też są przez producentów integrowane w wielu rozwiązaniach SBC.

Warto zauważyć, że w przypadku komputerów jednopłytkowych duża wydajność przestaje być priorytetem. Ona jest ważna w pełnowymiarowych komputerach przemysłowych (IPC). W omawianym obszarze ważniejsze są właśnie małe wymiary, niski pobór mocy oraz niewielki koszt, gdyż w ogromnej części zadania, jakie wykonują te jednostki, nie są bardzo złożone.

Dowodem potwierdzającym taką tezę jest to, że w ostatnich latach rynek SBC został zawojowany przez układy ARM Cortex i zapewne jest to też sygnał, że rynek komputerów SBC ewoluuje raczej w stronę wymagań aplikacji IoT niż przemysłowych rozwiązań procesowych. Bezsprzecznie sektor komputerów przemysłowych staje się coraz bardziej otwarty dla "przeciętnego" konstruktora, a coraz niższe ceny i większa dostępność sprawiają, że dostęp do tych rozwiązań jest praktycznie nieograniczony.

KOMPUTERY OPEN SOURCE

Przełomowym momentem dla rynku komputerów jednopłytkowych było pojawienie się platform open source, a dokładnie komputerka Raspberry Pi. Był on bardzo tani, nieźle wyposażony, dostępny dla każdego oraz dobrze udokumentowany. RPI wszedł przebojem na rynek, bo miał rewelacyjny stosunek ceny do możliwości.

Sukces RPI wywołał na rynku prawdziwą gorączkę złota, a kolejne platformy zaczęły wyrastać jak grzyby po deszczu. Aktualnie grupa najpopularniejszych liczy minimum kilkanaście pozycji, a całość nawet kilkadziesiąt. Najtańsze komputerki kosztują poniżej 10 dolarów! W tworzenie i promocję takich rozwiązań zaangażowały się największe światowe firmy dystrybucyjne, dzięki czemu całość nie była jedynie chwilowym zainteresowaniem grup społeczności lub fundacji.

Do wymienionego Raspberry Pi należy dodać BeagleBone, BananaPi, OrangePi, HummingBoard, Gizmo lub Odroid. Do tej grupy można też dopisać wiele platform mniej otwartych, ale o podobnym charakterze i przeznaczeniu jak Galileo, Wandboard, UP Board i inne. Efekt jest taki, że komputery tego typu trwale zmieniły rynek i stworzyły nową kategorię użytkowników, makerów, czyli takich hobbystów nowej generacji.

Platformom open source brakuje wielu cech niezbędnych w aplikacjach przemysłowych, a więc szerokiego zakresu temperatur pracy, jakości, stabilności działania i wieloletniej dostępności, przez co ich możliwości aplikacyjne sięgają jedynie obszaru półprofesjonalnego, a więc takiego o łagodnych wymaganiach.

W praktyce wiele zastosowań "z pogranicza" da się za ich pomocą obsłużyć.

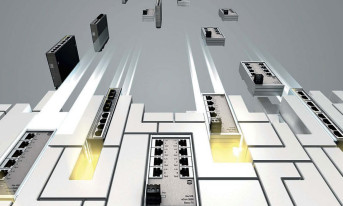

Komponenty sieci przemysłowych

Ethernet jest obecnie siecią, która znacznie wykroczyła od strony aplikacyjnej poza wąsko sprecyzowany obszar przemysłu, pojawiając się w elektronice konsumenckiej i aplikacjach domowych, systemach kontroli dostępu oraz monitoringu obiektów, w urządzeniach pomiarowych, transporcie szynowym i wielu innych obszarach techniki.

Ethernet jest obecnie siecią, która znacznie wykroczyła od strony aplikacyjnej poza wąsko sprecyzowany obszar przemysłu, pojawiając się w elektronice konsumenckiej i aplikacjach domowych, systemach kontroli dostępu oraz monitoringu obiektów, w urządzeniach pomiarowych, transporcie szynowym i wielu innych obszarach techniki.

Standard ten cały czas wkracza też na nowe rynki współczesnej techniki i szybko staje się na nich standardem dominującym. Wyraźnie widać, że w ciągu ostatnich pięciu lat jego znaczenie znacznie się zwiększyło i jest to rozwiązanie wykorzystywane przez małe i duże firmy. Popularyzacji sprzyja uniwersalność i dobrze umocowany w normach standard zarówno dla komunikacji przewodowej, jak i bezprzewodowej.

Pozycja rynkowa Ethernetu jest też dowodem, jak bardzo pomaga w rozwoju rynku wspólne rozwiązanie techniczne. Takich standardów sięgających całej techniki jest w sumie niewiele, bo z reguły duże firmy starają się narzucić całej reszcie własne technologie i czerpać z tego zyski (rozwiązania własnościowe). Otwarte rozwiązania zwykle oznaczają dużą konkurencję, obecność wielu producentów i znacznie mniejsze marże handlowe na produktach. Z punktu widzenia dużych korporacji są one mniej atrakcyjne, dlatego Ethernet można postrzegać za taki sam fenomen współczesnej techniki jak peceta.

Zapotrzebowanie na produkty komunikujące się za pomocą Ethernetu to również efekt powiększającego się zapotrzebowania rynku na sieci przemysłowe. Coraz więcej rozwiązań komunikacyjnych w tym obszarze ma charakter rozproszony, a więc taki, gdzie poszczególne elementy pomiarowe, kontrolne i sterujące są rozmieszczone w wielu miejscach obiektów i spięte kablem (miedzianym lub optycznym) w spójną całość.

Sieć sięga też obiektów energetycznych, telekomunikacyjnych, kolejowych, gdzie łączy części rozległych systemów, pozwalając na monitoring i zdalne sterowanie działaniem. W ten sposób zapewnia się lepszą dostępność usług, skraca czas reakcji na zdarzenia i likwiduje konieczność wykorzystania pracy ludzkiej w obszarach i sytuacjach niekorzystnych (trudny dostęp, niebezpieczne warunki).

Kolejnym aspektem pozytywnym dla rozwoju związanym z Ethernetem jest łatwość zmiany fizycznego medium komunikacyjnego. Oprócz standardowego kabla UTP może to być kabel światłowodowy lub połączenie bezprzewodowe po Wi- Fi. Ta właściwość sprzyja tworzeniu sieci rozległych, a okablowanie optyczne nierzadko staje się bazą infrastrukturalną dla całego zakładu, od której odchodzą miedziane rozgałęzienia lub tworzone są bezprzewodowe lokalne komórki.

DUŻA PODAŻ I ASORTYMENT

Duża popularność Ethernetu przekłada się oczywiście na relacje rynkowe - przybywa na rynku producentów takich urządzeń, poszerza się portfolio produktów i rozszerza siatka dystrybucyjna. Urządzenia takie jak switche, punkty dostępowe lub serwery portów od strony koncepcyjnej wydają się dobrze zdefiniowane i nierzadko proste, ale po dodaniu do produktu określenia "przemysłowy" pojawiają się w nich też specyficzne parametry i funkcje związane z odpornością środowiskową, złączami, rozbudowanym oprogramowaniem, zasilaniem za pomocą PoE, opcjami montażu w stojaku, odporną obudową z metalu i podobnymi cechami.

Duża popularność Ethernetu przekłada się oczywiście na relacje rynkowe - przybywa na rynku producentów takich urządzeń, poszerza się portfolio produktów i rozszerza siatka dystrybucyjna. Urządzenia takie jak switche, punkty dostępowe lub serwery portów od strony koncepcyjnej wydają się dobrze zdefiniowane i nierzadko proste, ale po dodaniu do produktu określenia "przemysłowy" pojawiają się w nich też specyficzne parametry i funkcje związane z odpornością środowiskową, złączami, rozbudowanym oprogramowaniem, zasilaniem za pomocą PoE, opcjami montażu w stojaku, odporną obudową z metalu i podobnymi cechami.

Coraz większe znaczenie mają też certyfikaty, za pomocą których duże firmy bronią się przed agresywną konkurencją cenową. Potwierdzają one zgodność z popularnymi protokołami bazującymi na Ethernecie jak Modbus lub Profibus, są gwarancją bezpieczeństwa użytkowania (np. zgodność z UL) i korzystania z sieci związanego z szyfrowaniem transmisji. Istotna jest też zgodność z normami branżowymi określającymi wymagania stawiane urządzeniom stosowanym w systemach stacji energetycznych, systemach transportowych i kontroli ruchu, i innymi regulacjami.

Popularnym hasłem w zakresie markowych rozwiązań przemysłowych jest ponadto redundancja po stronie zasilania i komunikacji w sieci, funkcje ochrony jakości i kontroli przepływu danych (QoS), szeroki zakres temperatur pracy w zakresie -40…75°C (albo jeszcze szerszym), funkcje zarządzania siecią i diagnostyki, sygnalizacja alarmowa, modułowa konstrukcja i wiele innych podobnych aspektów. Bezsprzecznie najwięcej nowinek i funkcji pojawia się w switchach, bowiem to one stanowią ten najważniejszy i centralny punkt wielu instalacji, od którego sieci się rozwijają.

Poza uniwersalnością i możliwościami komunikacyjnymi ethernetowe urządzenia infrastrukturalne, za pomocą których buduje się sieci, dają wiele różnych mechanizmów zwiększających wydajność transmisji sieciowej, pozwalających na zarządzanie urządzeniami i samą komunikacją, jak filtrowanie pakietów, kontrolę dostępu, ograniczenia maksymalne na szybkość transmisji, stworzenie logicznej wydzielonej sieci prywatnej oraz na implementację usług komunikacji głosowej i wideo.

Możliwość zarządzania urządzeniami w sieci przemysłowej ma zasadnicze znaczenie w rozwiązywaniu potencjalnych problemów i jest kluczowa w tym, aby Ethernet był szeroko akceptowany w dużych i odpowiedzialnych systemach sięgających skalą całego przedsiębiorstwa.

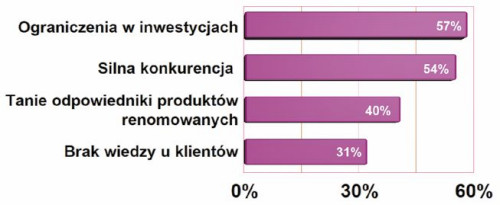

BRAK WIEDZY NA TEMAT ZAGADNIEŃ SIECIOWYCH

Negatywnym zjawiskiem wynikającym z dużej konkurencji i podaży jest to, że wielu klientów poszukuje rozwiązań najtańszych. Takich, którzy patrzą na całość zagadnienia, rozumieją, co to jest TCO, czym są problemy serwisowe, z pewnością przybywa, ale ta zwiększająca się świadomość użytkowników i klientów nie przekłada się jakoś wyraźnie na sprzedaż.

Być może dlatego, że edukacja użytkowników jest zbyt wolna w porównaniu do tempa rozwoju rynku i szybkości ewolucji technicznej poszczególnych rozwiązań. Są to też zagadnienia niełatwe i nierzadko zanim pozna się dobrze jedno urządzenie, producent wypuści już na rynek kolejne.

O ile wiele podstawowych urządzeń sieciowych działa praktycznie od włączenia zasilania, o tyle wykorzystanie możliwości bardziej zaawansowanego sprzętu wymaga od użytkowników wiedzy na tematy sieciowe, z czym często nie jest najlepiej. Szczegóły i niuanse na temat funkcjonalności to nierzadko tematy znane wyłącznie garstce specjalistów. Na dodatek dystrybutorom trudno promować nowe technologie, bo duża konkurencja ogranicza czas i możliwości finansowe w zakresie marketingu technicznego.

BEZPIECZEŃSTWO SPRZYJA PRODUKTOM MARKOWYM

Nadeszły takie czasy, że dzisiaj wszystko jest połączone, skomunikowane i obecne w sieci. A jeśli nie jest, to wkrótce będzie, bowiem na taki obrót wydarzeń wskazują wszystkie główne trendy rozwojowe na rynku związane z IoT i innymi obszarami z przedrostkiem "smart". Nietrudno dostrzec, że Ethernet w wykonaniu przewodowym lub bezprzewodowym jest jednym z głównych mediów transmisyjnych dla danych, a rozwiązania na nim się opierające cały czas zwiększają swoje udziały w rynku, niemniej ciemną stroną tej ekspansji jest wzrost zagrożeń związanych z bezpieczeństwem, cyberataków, przejęć, utraty danych i podobnych nadużyć.

Świadomość konieczności zapewnienia bezpieczeństwa jest coraz większa, bo każdy spektakularny atak daje do myślenia, zwłaszcza gdy jego wynikiem są straty finansowe dla przedsiębiorstw. Bezpieczeństwo sieci to nie tylko wysokiej jakości oprogramowanie w dołączanych urządzeniach, takie, które jest odporne na ataki, ale także solidny sprzęt sieciowy, z wbudowanymi mechanizmami ochronnymi, po to, aby chronić dane wrażliwe i przedsiębiorstwo przed szantażem.

W zakresie bezpieczeństwa liczy się kompleksowe podejście, bo wiadomo, że finalnie o jakości sieci decyduje najsłabszy komponent. Świadomość tych oczywistych zagadnień dociera do coraz większej liczby przedsiębiorców, którzy inwestują powoli w bezpieczeństwo posiadanych systemów. Na omawianym rynku oznacza to większe zapotrzebowanie na sprzęt markowy z rozbudowaną funkcjonalnością oraz, co jest także istotne, certyfikowany pod kątem bezpieczeństwa. Aspekty związane z bezpieczeństwem dodatkowo powiększają znaczenie certyfikatów, bo są one dokumentem potwierdzającym zapewnienia sprzedawcy przez trzecią stronę i specjalistów znających się na tej tematyce.

Andrzej KałowyElhurt

Coraz większą popularnością cieszą się produkty o wysokiej jakości i niezawodności. Dzięki bardzo szerokiemu zastosowaniu, od automatyki przemysłowej, po miernictwo, aż do cyfrowej reklamy. W dzisiejszych czasach większość systemów ma zdalny dostęp, dlatego największym zainteresowaniem cieszą się komórkowe routery w przemysłowym wykonaniu ze złączem szeregowym. W aplikacjach, gdzie mogą pojawić się problemy z zasięgiem, odbiorcy wymagają funkcji dual SIM. Ważnym czynnikiem jest również odporność na kurz i wodę, ponieważ ze względu na specyfikę routery i modemy pracują w ciężkich warunkach.

Bardzo ważnym czynnikiem przy handlu takimi produktami jest odpowiednia wiedza. Klienci oczekują profesjonalizmu oraz wsparcia, od momentu znalezienia urządzenia spełniającego ich wymagania, do pełnego wsparcia posprzedażowego, we wdrażaniu sprzętu i pomocy w rozwiązaniu ewentualnych trudności pojawiających się w trakcie użytkowania. |

URZĄDZENIA PRZEWODOWE

Podstawowym elementem infrastruktury komunikacyjnej dla Ethernetu jest switch. Może on być prosty (niezarządzalny) lub złożony (zarządzalny) i o różnym wyposażeniu. Typowy switch ma od kilku do kilkunastu portów do podłączenia kabla miedzianego UTP, wersje złożone mogą mieć też port światłowodowy lub są zintegrowane z bezprzewodowym punktem dostępowym tak, że można do urządzania podłączyć się na różne sposoby. Obecnie sieci przemysłowe i te pracujące w mniej odpowiedzialnych zastosowaniach mają zwykle charakter mieszany i są uzupełniane komunikacją bezprzewodową, bo jedno urządzenie zapewniające oba typy połączeń jest wygodniejsze.

Podstawowym elementem infrastruktury komunikacyjnej dla Ethernetu jest switch. Może on być prosty (niezarządzalny) lub złożony (zarządzalny) i o różnym wyposażeniu. Typowy switch ma od kilku do kilkunastu portów do podłączenia kabla miedzianego UTP, wersje złożone mogą mieć też port światłowodowy lub są zintegrowane z bezprzewodowym punktem dostępowym tak, że można do urządzania podłączyć się na różne sposoby. Obecnie sieci przemysłowe i te pracujące w mniej odpowiedzialnych zastosowaniach mają zwykle charakter mieszany i są uzupełniane komunikacją bezprzewodową, bo jedno urządzenie zapewniające oba typy połączeń jest wygodniejsze.

Funkcjonalność switcha obejmuje ponadto wiele funkcji związanych z transmisją danych, zarządzaniem dołączonymi urządzeniami, nakładaniem limitów, tworzeniem rozwiązań z redundancją, obsługą alarmów, szyfrowaniem transmisji oraz wsparciem dla protokołów przemysłowych opartych na Ethernecie. Switch jest też źródłem energii zasilającej w aplikacjach PoE, a niektóre wersje mają konstrukcję modułową pozwalającą na rozbudowę zasobów.

Trendem rozwojowym jest w przypadku omawianych urządzeń rosnące obecnie wykorzystanie sieci gigabitowych, a w przyszłości - spodziewana popularyzacja rozwiązań 10 Gb/s.

Do produktów zawierających się w omawianym obszarze należą też serwery portów szeregowych, mediakonwertery oraz karty sieciowe. Te pierwsze umożliwiają dostęp do portów szeregowych RS232/ 422/485 z poziomu Ethernetu (serial-to-Ethernet i na odwrót). Są one potrzebne do sterowania i zarządzania urządzeniem poprzez sieć oraz wydłużenia niewielkiego zasięgu RS-a. Dzięki odpowiednim sterownikom, z punktu widzenia oprogramowania, takie przedłużenie może być przezroczyste dla danych i aplikacji.

Te drugie to moduły służące do zmiany medium transmisyjnego - w szczególności Ethernetu miedzianego na światłowodowy oraz moduły wykorzystujące transmisję bezprzewodową. Natomiast karty komunikacyjne to fizyczna realizacja interfejsu w komputerach. Niemniej od kiedy port sieciowy stał się standardowym elementem płyt głównych, karty wypadły na specjalistyczny margines (głównie w systemach pomiarowych).

Moduły IO to z kolei urządzenia zapewniające możliwość podłączenia fizycznych czujników, elementów wykonawczych, liczników, napędów do sieci. Dzięki nim za pomocą jednego połączenia ethernetowego można obsłużyć wiele takich komponentów, gdyż moduły IO dostępne są w bardzo szerokim asortymencie - zarówno z wejściami i wyjściami cyfrowymi, jak też analogowymi i zawierają od kilku do ok. 16 linii w różnych kombinacjach.

Są też wersje modułowe pozwalające na rozbudowę, dzięki czemu jeden moduł może obsłużyć wszystkie sygnały dostępne w maszynie, bez konieczności rozbudowy okablowania z przekaźnikami na wyjściu, optoizolacją oraz oczywiście wersje z komunikacją bezprzewodową i dostosowane do polowych standardów przemysłowych bazujących na Ethernecie (Profibus, Modbus, Profinet).

SPRZĘT BEZPRZEWODOWY

W zastosowaniach przemysłowych komunikacja bezprzewodowa to głównie Wi-Fi, pozwalająca na proste przedłużenie Ethernetu przez kanały radiowe. Obecnie produkty w tym standardzie w zasadzie zdominowały rynek konsumencki i profesjonalny, jeżeli chodzi o bezprzewodową transmisję danych w lokalnych sieciach informatycznych. Poza Wi-Fi komunikacja przemysłowa korzysta jeszcze z łączy komórkowych i radiomodemów do tworzenia zapasowych traktów komunikacyjnych. Bluetooth to w omawianym obszarze rzadkość, a ZigBee to już technologia wręcz egzotyczna.

W zastosowaniach przemysłowych komunikacja bezprzewodowa to głównie Wi-Fi, pozwalająca na proste przedłużenie Ethernetu przez kanały radiowe. Obecnie produkty w tym standardzie w zasadzie zdominowały rynek konsumencki i profesjonalny, jeżeli chodzi o bezprzewodową transmisję danych w lokalnych sieciach informatycznych. Poza Wi-Fi komunikacja przemysłowa korzysta jeszcze z łączy komórkowych i radiomodemów do tworzenia zapasowych traktów komunikacyjnych. Bluetooth to w omawianym obszarze rzadkość, a ZigBee to już technologia wręcz egzotyczna.

Główną zaletą Wi-Fi jest duża przepustowość zwłaszcza w sprzęcie pracującym na 5 GHz, dobra stabilność połączenia i niezły zasięg. To wszystko otrzymuje się za niewielką sumę i w szerokim asortymencie, przez co rozwiązania bezprzewodowe szybko się popularyzują w przemyśle. Warto zauważyć, że funkcjonalność wielu urządzeń komunikacyjnych przenika się i wszystkie podziały stają się nieostre.

Switche przewodowe są integrowane z bezprzewodowym punktem dostępowym, porty przeznaczone do podłączenia kabla miedzianego uzupełnia się łączem optycznym. Bezprzewodowe są też serwery portów i moduły IO. Można też zauważyć, że wiele z omawianych produktów ma charakter komponentów standardowych, gdzie oferta rynku jest bardzo szeroka i praktycznie udaje się dobrać każdą kombinację.

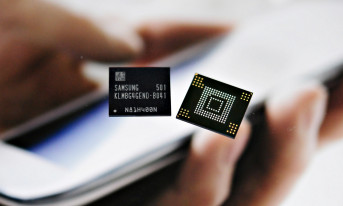

Pamięci przemysłowe Flash

Tak jak z małych komputerów przemysłowych zniknęły wentylatory, tak samo dzisiaj widać odwrót od klasycznych nośników danych, czyli napędów HDD, które zastąpiły pamięci Flash, a więc karty i dyski. W ostatnich latach dostępne pojemności nośników wzrosły na tyle, że nie ma problemu, nawet gdy trzeba przechować terabajty danych.

Tak jak z małych komputerów przemysłowych zniknęły wentylatory, tak samo dzisiaj widać odwrót od klasycznych nośników danych, czyli napędów HDD, które zastąpiły pamięci Flash, a więc karty i dyski. W ostatnich latach dostępne pojemności nośników wzrosły na tyle, że nie ma problemu, nawet gdy trzeba przechować terabajty danych.

Dyżurnym tematem w tym sektorze rynku jest trwałość i niezawodność zapisu, a także zakres temperatur pracy. No i oczywiście cena, bo ona zawsze się liczy. Przemysłowe karty i dyski są sporo droższe od konsumenckich i nie jest to różnica mała. Powodem jest to, że opierają się one na pamięciach SLC, w których jedna komórka przechowuje jeden bit danych, a nie kilka, mają bardziej zaawansowane kontrolery i bazują na chipach, które przeszły testy poprawności pracy w szerokim zakresie temperatur.

Sterowniki do takich zastosowań mają rozbudowane algorytmy detekcji i korekcji błędów, mechanizmy zarządzania uszkodzonymi blokami pamięci i monitorowania parametrów karty, które umożliwiają m.in. określenie stopnia jej zużycia. Niektóre rozwiązania mają też funkcje odzyskiwania danych oraz detekcji przerwy w zasilaniu lub podtrzymania zasilania.

|

|

Bardzo duży globalny wzrost popytu na pamięci półprzewodnikowe spowodowany zwiększeniem sprzedaży w parze z potężną ilością pamięci wbudowanej w smartfonach i wzrostem sprzedaży konsumenckich SSD spowodował w ostatnich latach duży wzrost cen pamięci, a także wydłużenie czasów dostaw. Oznacza to, że ograniczenia zjawiska wykorzystywania pamięci komercyjnych w zastosowaniach przemysłowych jeszcze potrwa.

Kamil ĆwiertniaProduct manager przemysłowych pamięci Flash w firmie CSI

W przemyśle najczęściej wykorzystywane są pamięci NAND Flash SLC, ponieważ charakteryzują się one niską awaryjnością i bardzo dużą liczbą cykli zapisu. Są też odporne na różnego rodzaju zakłócenia. Produkty oparte na pamięciach MLC stosowane są natomiast w aplikacjach budżetowych, gdzie pewność zapisu danych ma mniejsze znaczenie, natomiast wymagana jest duża pojemność. Ważne jest, aby określić, w jakim środowisku zostanie zastosowany dany nośnik oraz w jakim zakresie temperatur będzie pracował. Większość producentów podaje także wartość współczynnika TBW, który określa limit zapisywanych danych pozwalający sprawdzić, jaka pojemność dysku jest potrzebna i jaki będzie czas jego pracy. Aby uniknąć nieprzewidzianych awarii, w przypadku niestabilnego zasilania, warto rozważyć zastosowanie dysków z wbudowanymi kondensatorami, dzięki którym w każdych warunkach może zostać dokończony proces zapisu i nie dojdzie do naruszenia integralności danych lub kontrolera dysku.

Ze względu na niską cenę zakupu pamięci konsumenckich, część klientów używa ich w aplikacjach przemysłowych. W pierwszym okresie użytkowania nie widać między nimi znacznej różnicy. Niestety charakteryzują się one większą awaryjnością i nie zawsze prawidłowo pracują w trudnych warunkach środowiskowych. W takiej sytuacji okazuje się, że mogą wystąpić przestoje w produkcji, co powoduje kilkukrotnie większe koszty dla klienta niż sam zakup nośnika przemysłowego. Nie zawsze występuje też możliwość zgłoszenia reklamacji produktów z pamięciami konsumenckimi, które były wykorzystane w warunkach przemysłowych, ponieważ część producentów stosuje zapisy o ograniczonej gwarancji.

Na uwagę z pewnością zasługuje miniaturyzacja układów elektronicznych, w tym pamięci NAND Flash. W ciągu ostatnich kilku miesięcy następuje migracja technologii NAND z 2D do 3D. Ten trend dotyczy głównie rynku konsumenckiego, jednak ma on duży wpływ również na aplikacje przemysłowe. Niektórzy producenci pamięci profesjonalnych już wprowadzili produkty oparte na technologii 3D. Zmiana dotyczy zwiększenia gęstości zapisu danych poprzez warstwowe ułożenie komórek pamięci. Stosuje się, nie jak do tej pory, poziome gromadzenie danych (2D), a pionowe (3D). Takie rozwiązanie pozwala na zwiększenie pojemności i wydajności przy jednoczesnym zmniejszeniu poboru energii. Do budowy tych kości stosuje się przede wszystkim pamięci 3D MLC oraz 3D TLC. Docelowo kości 3D mają być tańsze niż 2D. |

KARTY PAMIĘCI I DYSKI FLASH

Nośniki danych z pamięciami Flash to dyski SSD (2,5", mSATA i DOM) oraz karty pamięci takie jak CF - CompactFlash oraz nowszy CFast, SD Secure Digital. W zastosowaniach profesjonalnych używane są nośniki w specjalnym wykonaniu, które charakteryzuje szeroki zakres temperatur pracy np. od -40 do +85°C i wilgotność do 95%.

Oprócz wzmocnienia konstrukcji mechanicznej stosuje się też kontrolery z algorytmami detekcji i korekcji błędów, mechanizmami zarządzania uszkodzonymi blokami pamięci i monitorowania parametrów karty, które umożliwiają m.in. określenie stopnia jej zużycia. Niektóre rozwiązania mają też funkcje odzyskiwania danych oraz detekcji przerwy w zasilaniu. Generalnie pamięci Flash dla przemysłu mają też znacznie bardziej złożone kontrolery zarządzające zapisem i zarządzaniem danych po to, aby jak najlepiej wykorzystać ograniczoną trwałość tych komórek pamięci i zapewnić najwyższą wydajność.

Oczywiście takie przemysłowe karty i dyski są droższe od konsumenckich (m.in. z uwagi na pamięci SLC) i tym samym, podobnie jak jest to z komputerami, wiele firm próbuje te drugie wykorzystywać w poważnych zadaniach. Pozytywne jest to, że pamięci Flash szybko tanieją i rynek produktów profesjonalnych szybko się rozwija. Proces ten prowadzi w naturalny sposób do ograniczenia zjawiska wykorzystywania pamięci komercyjnych w zastosowaniach przemysłowych, ale bezsprzecznie on nadal istnieje.

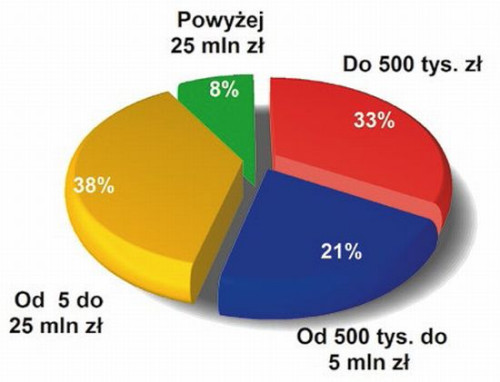

Systemy zasilania gwarantowanego

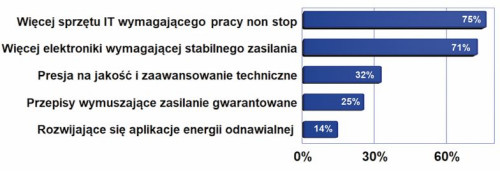

Elektroniki w naszym środowisku jest coraz więcej i pełni ona coraz bardziej odpowiedzialne zadania, przez co nieprzerwane zasilanie staje się jednym z ważniejszych zagadnień, jakie muszą rozwiązywać projektanci i integratorzy systemów w technice. W przemyśle utrata zasilania, a nawet chwilowa niestabilność, to wymierne straty wywołane niekontrolowanym przestojem, dlatego gwarancja tego, że będzie ono dostępne, jest warunkiem koniecznym do zapewnienia jakości i potencjału przedsiębiorstwa. Niewątpliwie awarii sieci energetycznych jest dzisiaj mniej niż dekadę temu, ale ponieważ nieustannie przybywa sprzętu wymagającego podtrzymania lub stałego zasilania, całość branży jest rozwojowa.

Elektroniki w naszym środowisku jest coraz więcej i pełni ona coraz bardziej odpowiedzialne zadania, przez co nieprzerwane zasilanie staje się jednym z ważniejszych zagadnień, jakie muszą rozwiązywać projektanci i integratorzy systemów w technice. W przemyśle utrata zasilania, a nawet chwilowa niestabilność, to wymierne straty wywołane niekontrolowanym przestojem, dlatego gwarancja tego, że będzie ono dostępne, jest warunkiem koniecznym do zapewnienia jakości i potencjału przedsiębiorstwa. Niewątpliwie awarii sieci energetycznych jest dzisiaj mniej niż dekadę temu, ale ponieważ nieustannie przybywa sprzętu wymagającego podtrzymania lub stałego zasilania, całość branży jest rozwojowa.

Im większa moc, dłuższy wymagany czas podtrzymania i większa dostępność energii elektrycznej, tym zapewnienie gwarancji zasilania staje się coraz bardziej złożone i kosztowne. Dlatego wyboru odpowiedniego wariantu powinno się dokonać na podstawie kilku czynników, np. oczekiwanej niezawodności, kryteriów ekonomicznych, możliwości przystosowania instalacji elektrycznej czy możliwości zapewnienia właściwych warunków montażu, pamiętając, że ciągłość zasilania jest podstawowym warunkiem bezpieczeństwa klientów, pracowników oraz mienia.

W obszarze zasilania gwarantowanego liczy się dzisiaj ogólny wzrost wymagań i jakości, a świadomość użytkowników związana ze stratami w przypadku przerwy w dostawie energii też jest większa. Mówi się także, że nic nie działa tak dobrze na rozwój rynku, jak spektakularna wpadka oraz problemy powstałe na skutek zaniedbań, bo one mają wyjątkowo przemawiający do wyobraźni aspekt edukacyjny. Warto też odnotować, że rośnie liczba ekstremalnych zjawisk pogodowych, wywołujących awarie. Stają się one istotnym czynnikiem ryzyka, tym bardziej że przerwy w dostawach są tutaj bardzo długie.

Po stronie czynników prorozwojowych dla rynku warto jeszcze wymienić popularyzację usług dostępnych w chmurze, szybki rozwój Internetu i wzrost szybkości łączy telekomunikacyjnych, które przekładają się na coraz większą liczbę obiektów infrastrukturalnych pracujących non stop. To wszystko powoduje, że znaczenie omawianego sektora rynku we współczesnej technice nieustannie się zwiększa.

PRODUKTY DO ZASILANIA GWARANTOWANEGO

Do podstawowych urządzeń zasilania gwarantowanego zalicza się zasilacze buforowe wyposażone w akumulatory i zasilacze UPS, które są w stanie zapewnić niezbędne zasilanie energią, wymagające przemiennego napięcia o parametrach takich jak sieć energetyczna. Dla większości urządzeń i systemów magazynem energii na czas awarii są akumulatory.

W dużych systemach urządzenia te są wspomagane przez agregaty prądotwórcze, natomiast rozwiązania zasilaczy bezprzerwowych małej mocy oraz wersje zapewniające krótkie czasy podtrzymania korzystają z superkondensatorów. Ogniwa paliwowe oraz inne rozwiązania takie jak generatory termoelektryczne to domena zastosowań specjalnych.

Największym problemem technicznym rynku zasilania gwarantowanego są oczywiście akumulatory, a dokładnie ich ograniczona pojemność i żywotność, a także zjawiska takie jak np. przedwczesna utrata pojemności. Szybki postęp technologiczny w zakresie efektywnej konwersji energii elektrycznej równoważy trochę umiarkowane lub nawet słabe tempo rozwoju rynku chemicznych źródeł prądu. Niemniej lata lecą, a podstawowym typem ogniw na rynku cały czas są wersje kwasowo-ołowiowe. Specjaliści mówią wprawdzie, że technologia litowo-jonowa się popularyzuje, ale w praktyce zmiany daje się dostrzec jedynie w zasilaczach buforowych.

ZASILACZE BEZPRZERWOWE UPS

Zasilacze bezprzerwowe UPS są stosowane przede wszystkim w centrach danych, systemach komunikacyjnych, w energetyce i przemyśle. Na rynku dostępne są urządzenia różnych typów. Gdy bezprzerwowa dostawa energii o odpowiednich parametrach staje się wymaganiem podstawowym, naturalnym wyborem jest UPS online.

Zasilacze bezprzerwowe UPS są stosowane przede wszystkim w centrach danych, systemach komunikacyjnych, w energetyce i przemyśle. Na rynku dostępne są urządzenia różnych typów. Gdy bezprzerwowa dostawa energii o odpowiednich parametrach staje się wymaganiem podstawowym, naturalnym wyborem jest UPS online.

Niezależnie od pracy sieci zasilającej, dostarcza on energię o wysokiej jakości (pozbawioną zaburzeń EM i harmonicznych), a w razie awarii bezprzerwowo przełącza się na pracę z baterii. Aplikacje o mniej krytycznych wymaganiach mogą z kolei korzystać z tańszych rozwiązań typu offline lub pośredniej wersji tego urządzenia z tzw. interaktywną linią sieciową.

W skład większości UPS-ów, niezależnie od ich wielkości i topologii, wchodzą akumulatory, ładowarka i przetwornica (inwerter) zamieniająca niskie napięcie stałe w przemienne. Różnice między topologiami dotyczą tego, czy przetwornica pracuje cały czas, czy jest załączana dopiero podczas awarii. Cechą UPS-a online jest podwójna konwersja energii, z sieci do napięcia akumulatora i dalej z powrotem na sieć.

Dzięki temu przetwornica zasila obciążenie czystym i dokładnie stabilizowanym przez UPS napięciem przemiennym. Oprócz tego prostownik zasilający falownik z sieci zapewnia korekcję współczynnika mocy, przez co UPS online jest w istocie też filtrem, który chroni urządzenia przed zakłócającymi wpływami sieci energetycznej, optymalizując równocześnie obciążenie w stosunku do sieci.

W UPS-ie offline w trakcie normalnej pracy obciążenie jest zasilane bezpośrednio z sieci energetycznej, przez co napięcie na obciążeniu nie jest stabilizowane ani filtrowane. Gdy napięcie zasilania spadnie poza ustaloną granicę, zasilanie obciążenia jest przełączane przekaźnikiem na przetwornicę i akumulator. Spowodowana tym przerwa może trwać typowo kilka milisekund. Zaletą UPS-a offline jest to, że gdy zasilanie z sieci jest, falownik nie pracuje, a więc nie pobiera energii.

ZASILACZE BUFOROWE

Zasilacze buforowe zyskują w ostatnich latach na znaczeniu, gdyż mamy coraz więcej urządzeń elektronicznych małej mocy, dla których wymagane jest zasilanie gwarantowane. Urządzenia automatyki budynkowej, układy komunikacyjne i telemetryczne, rozproszone systemy pomiarowe, elementy systemów alarmowych, monitoringu i kontroli dostępu, oświetlenie, komponenty infrastruktury telekomunikacyjnej to przykłady aplikacji, które wymagają obecnie zasilania bezprzerwowego ze specjalnego zasilacza wspomaganego akumulatorem. Cechą wspólną tych aplikacji jest to, że są zasilane niskim napięciem stałym, mają niewielki pobór mocy oraz to, że zwykle są one zainstalowane w miejscach, gdzie nie ma problemu z dostępnością. W takich przypadkach zasilacz buforowy sprawdza się doskonale i jest w stanie zapewnić podtrzymanie zasilania przez długi czas.

Popularności zasilaczy buforowych sprzyja ponadto to, że od strony technicznej są to urządzenia stosunkowo proste. Wiele takich urządzeń składa się z najprostszego zasilacza sieciowego, do którego dodany został akumulator na wejściu, a także układ ładowania. Przy obecności zasilania sieciowego jest on ładowany i utrzymywany w stanie gotowości, po zaniku energia zgromadzona w ogniwach kierowana jest na wyjście.

Bardziej złożone jednostki opierają się na przetwornicy impulsowej o dużej sprawności, mają dodane obwody sygnalizacyjno-kontrolne i zabezpieczające. Czasem dostępny jest też interfejs komunikacyjny (np. USB) dający możliwość zarządzania taką jednostką. Dzięki niemu urządzenie zasilane może np. w kontrolowany sposób wyłączyć się na chwilę przed wyczerpaniem energii akumulatora.

Na rynku jest wiele dostępnych typów takich urządzeń także pod kątem wykonania mechanicznego. Obudowy zasilaczy buforowych przeznaczone są do montażu na szynie, w skrzynce instalacyjnej. Są też wersje całkowicie jej pozbawione. Zasilacze tego typu mają nierzadko wydzielone specjalne zatoki pozwalające na montaż 1-2 akumulatorów, przez co całość tworzy gotową jednostkę zasilającą skalowalną i z możliwością serwisowania podczas pracy. Liczba wariantów funkcjonujących na rynku jest spora, dzięki czemu bez problemu daje się dobrać najbardziej pasujące rozwiązanie do każdych zastosowań.

Typowy zasilacz buforowy ma jedno napięcie wyjściowe o wartości powiązanej z napięciem znamionowym akumulatora, a więc z reguły 12/24 V. Na dodatek nierzadko jest to napięcie niestabilizowane, bowiem akumulator dołącza się wprost do zacisków wyjściowych.

Michał Brennenstuhlinżynier aplikacyjny w firmie Elhurt

Utrata strategicznych danych przedsiębiorstwa, a także zabezpieczenie najważniejszego filaru każdej firmy - serwerów baz danych, to główne aspekty, o których rozmawiamy podczas pierwszego kontaktu z klientem. W ostatnich latach zauważalnie wzrosła świadomość przedsiębiorców. Obawa przed utratą tego co kluczowe dla każdego przedsiębiorstwa przemawia w największym stopniu. Duży wpływ na rozwój rynku mają nowe usługi, takie jak monitorowanie na odległość czy przetrzymywanie zebranych danych w chmurze. Dla tego typu usług/aplikacji wymagana jest ciągłość pracy - 24/7. Zauważamy, że duży wpływ mają także ostatnie wydarzenia związane z unieruchomieniem wielkich korporacji przez oprogramowanie typu ransomware. Poza aspektami zabezpieczenia sieci IT klienci jednocześnie poszukują wysokiej jakości systemów zasilania awaryjnego.

Spośród wszystkich naszych klientów możemy wyróżnić dwie grupy: takich, którzy zazwyczaj nie mają świadomości i wiedzy na temat produktów i głównie kierują się podstawowymi charakterystykami i przede wszystkim ceną. Druga grupa odbiorców to osoby, które zwracają uwagę na wszystkie aspekty techniczne. Skrupulatnie sprawdzają każdy oferowany zasilacz pod kątem każdego kluczowego komponentu, a także wymagają udokumentowania kluczowych parametrów podanych w ogólnie dostępnych kartach katalogowych. W tym drugim przypadku często kwestia ceny jest drugorzędna. Ogromną wartością dodaną dla klienta jest wsparcie techniczne, takie jak dobór odpowiedniego systemu, rozwiązanie istniejącego problemu, a także serwis i montaż na miejscu przez wykwalifikowanego pracownika. |

ZASILACZE BUFOROWE Z SUPERKONDENSATORAMI

Jak wspomniano, moc pobierana przez wiele układów elektronicznych z każdą kolejną generacją urządzeń jest coraz mniejsza. Nierzadko też wymagany czas podtrzymania zasilania nie musi być długi. W takich sytuacjach akumulatory w zasilaczu buforowym zastępuje się dzisiaj superkondensatorami. Konstrukcyjnie niewiele się zmienia, bo 10-12 superkondensatorów o pojemności mniej więcej 400 F zajmuje mniej więcej tyle miejsca co akumulator 12 V o pojemności 5 Ah.

Czas podtrzymania jest zwykle znacznie krótszy, ale tę niedogodność rekompensuje szeroki zakres temperatur pracy, niewielki ciężar, brak konieczności wymiany okresowej akumulatorów (pełna bezobsługowość). Oczywiście cena takich rozwiązań jest wyższa, zwłaszcza gdy czas podtrzymania ma być długi, ale w aspekcie długoterminowym inwestycja w takie rozwiązanie ma sens, tym bardziej że akumulator zdolny do pracy w szerokim zakresie temperatur też wcale nie jest tani. Reasumując, zasilacze z superkondensatorami to propozycja głównie do zastosowań w przemyśle i aplikacjach instalowanych na zewnątrz budynków.

UPS-Y O STAŁYM NAPIĘCIU WYJŚCIOWYM

Bardzo duża część urządzeń elektronicznych opiera się na dołączonym do sieci zasilaczu impulsowym, który stanowi źródło zasilania dla poszczególnych bloków i systemów. Klasyczne transformatory sieciowe w nowym sprzęcie elektronicznym to już rzadkość, bo są to elementy kosztowne, duże, ciężkie i niestety niepozwalające w wielu przypadkach osiągnąć wysokiej sprawności konwersji energii elektrycznej.

Typowy zasilacz impulsowy przetwarza wyprostowane i odfiltrowane napięcie sieci, a więc o wartości ok. 310 V dla sieci jednofazowej. Oznacza to, że w wielu przypadkach nie ma sensu przetwarzać napięcia stałego akumulatora na przemienne napięcie sieci 50 Hz po to, aby zaraz je wyprostować i odfiltrować. Ponieważ wiele sprzętu tego typu można po prostu zasilić napięciem stałym, oznacza to, że zasilacze buforowe o wysokim napięciu stałym mogą być interesującą alternatywą dla klasycznych UPS-ów.

UPS-DC to obiegowa nazwa zasilacza buforowego dostarczającego stabilizowanego napięcia wyjściowego o mocy dochodzącej do ok. 500 W. Jednostki te mają znacznie rozbudowaną część odpowiadającą za współpracę z akumulatorem. Ich ładowarka pozwala na ładowanie szybkie ogniw i nierzadko obsługuje różne typy akumulatorów. Dodatkowo testowany jest stan baterii, także w zakresie dostępnej pojemności, gdyż wraz z kolejnymi cyklami ładowania i rozładowywania i latami pracy stale się zmienia.

W zasilaczach UPS-DC napięcie wyjściowe jest stabilizowane za pomocą wysoko sprawnej przetwornicy, co rozszerza obszar ich zastosowań. Mają one z reguły znacznie większą moc od opisanych wcześniej jednostek buforowych i pozwalają na współpracę z akumulatorami o znacznej pojemności. Pozwala to dobierać czas podtrzymania zasilania poprzez wybór odpowiedniego akumulatora.

Robert SiroicInżynier sprzedaży w Delta Energy Solutions

Popyt na niezawodne zasilanie idzie w parze z powstającymi centrami danych oraz z nieustannie postępującą cyfryzacją techniki. Warto podkreślić, że ze względu na coraz wyższe oczekiwania rynku w zakresie niezawodności poszukuje się nowych rozwiązań, które zapewniają wysoką dostępność, pozwalając przy tym na rozwój infrastruktury zasilania wraz ze wzrostem potrzeb. Kolejnym czynnikiem sprzyjającym rozwojowi rynku wysokowydajnych zasilaczy UPS są oczekiwania klienta związane z uzyskaniem wysokiej sprawność systemów, dzięki której możliwe jest oszczędzanie energii elektrycznej.

Od kilku lat można zaobserwować trend rozwoju systemów zasilania UPS idący w kierunku rozwiązań modułowych. Dzięki tej funkcjonalności możliwa jest rozbudowa zasilacza UPS, łatwość serwisu oraz wydajność ze względu na skalowalność systemu. Przykładem jest w pełni modułowy zasilacz UPS z serii Modulon DPH z możliwością pionowej rozbudowy co 25 kW do 75 kW, 150 kW i 200 kW do 4 jednostek (800 kW). |

AKUMULATORY

Integralną częścią wszystkich systemów zasilania gwarantowanego są akumulatory, zapewniające magazynowanie energii elektrycznej. Dla systemów przemysłowych znakomita część rozwiązań zasilania bazuje na ogniwach kwasowo-ołowiowych. Systemy małej mocy oraz rozwiązania specjalistyczne wykorzystują też akumulatory litowo-jonowe, a w elektronice konsumenckiej także wersje niklowo-wodorkowe. Niemniej ilościowo i wartościowo rynek jest zdominowany przez akumulatory ołowiowo-kwasowe, bo są one relatywnie tanie, wystarczająco dobre i powszechnie dostępne.

Obserwując zmiany na rynku związane z samochodami elektrycznymi lub aplikacjami energii odnawialnej, gdzie z powodzeniem aplikuje się akumulatory litowo-jonowe, można zaryzykować twierdzenie, że w przyszłości zyskają one większe znaczenie także w systemach zasilania gwarantowanego. Masowe zastosowania w motoryzacji i dobre perspektywy rynku powodują, że aktualnie trwa budowa wielu dużych fabryk takich ogniw.

Oznacza to, że podaż w kolejnych latach będzie się zwiększać i zapewne w konsekwencji ceny akumulatorów litowo-jonowych spadną. W zasilaczu buforowym takie ogniwa będą bardzo przydatne, gdyż w porównaniu do wersji kwasowo-ołowiowych są lekkie, mają minimalne samorozładowanie i zapewniają dużą gęstość mocy. Nie bez znaczenia jest to, że napięcie nominalne wynosi w tym przypadku 3,7 V, a więc dla równoważnego napięcia potrzeba mniej ogniw.

AGREGATY

Wiele systemów zasilania gwarantowanego ma strukturę hybrydową, a więc podstawowa jednostka, taka jak UPS, jest dodatkowo wspierana pomocniczym źródłem zasilania zapewniającym długi czas podtrzymania. Z reguły takie systemy są instalowane w przemyśle, gdzie utrata zasilania w trakcie procesów ciągłych jest niedopuszczalna.

W takiej sytuacji instalowany jest UPS dużej mocy wspomagany agregatem prądotwórczym, dzięki czemu nie ma konieczności instalacji akumulatorów o dużej pojemności i daje się zapewnić długi czas pracy autonomicznej. Agregaty prądotwórcze są stosowane jako rezerwowe źródło zasilania wszędzie tam, gdzie wymagany czas podtrzymania przekracza 40 min.

Wiele jednostek uruchamia się w czasie ok. 20 sekund od momentu zaniku prądu w sieci. Co istotne, nowoczesne agregaty mogą działać autonomicznie - zawierają sterownik zapewniający zdalne sterowanie i kontrolę pracy silnika z opcją powiadamiania alarmowego (uruchomienie, nadzór nad obciążeniem, blokada pracy w przypadku, gdy napięcie sieciowe pojawi się ponownie, czasy reakcji itp.).

UPS-Y W APLIKACJACH MAŁEJ I ŚREDNIEJ MOCY

W aplikacjach małej i średniej mocy chętnie korzysta się z zasilaczy UPS przeznaczonych do zasilania sprzętu komputerowego, bo są one tanie, łatwo dostępne i mają niezłe parametry. W wielu wypadkach zastosowanie UPS-a o większej mocy (przewymiarowanie systemu) uwalnia od problemów z rozruchem urządzeń lub też pewnością zasilania i stąd takie rozwiązania są stosowane.

UPS tego typu pracuje zwykle w technologii line interactive, co oznacza, że przy obecności sieci falownik nie pracuje a napięcie przekazywane jest bezpośrednio z wejścia na wyjście przez styki przekaźnika. Zanik sieci powoduje włączenie falownika i podłączenie do niego zasilanego urządzenia. Czas przełączenia wynosi kilka milisekund.

Zasilacze takie mają napięcie wyjściowe, które jest kształtem zbliżone do sinusa, pozwalają na zarządzanie i nadzór przez sieć lub USB i zwykle są dostępne w małych obudowach mieszczących też akumulator (jeden lub kilka w zależności od mocy wyjściowej).

UPS-y tego typu nie są remedium na problemy z jakością sieci zasilającej, np. spadkami napięcia. Można powiedzieć też, że gdy jakość energii jest nie najlepsza, rozwiązania te mogą sprawiać dodatkowe problemy, np. związane z częstym przełączaniem się w tryb awaryjny. Te problemy producenci starają się ograniczać, wyposażając jednostki w system stabilizacji napięcia zmiennego bazujący na transformatorach obniżająco-podwyższających lub ferrorezonansowych.

Utrzymują one napięcie wyjściowe nawet z dokładnością do ±3% przy zmianach wejściowego od -40% do +20%, ograniczają też zaburzenia nadchodzące z sieci. Ale ich główną zaletą jest łagodzenie przełączeń zasilania dzięki zgromadzonej energii magnetycznej, co częściowo upodabnia skutki ich działanie do działania UPS-ów online.

UPS-Y W ZASTOSOWANIACH PRZEMYSŁOWYCH

Zasilacze UPS przeznaczone do aplikacji przemysłowych i do zasilania obiektów z infrastrukturą IT z reguły są rozwiązaniami o dużej mocy sięgającej kilkaset kVA. Z uwagi na to system akumulatorowy będący magazynem energii jest w tym przypadku baterią ogniw o dużym napięciu znamionowym (100-220-540 VDC), gdyż zmniejsza to straty powstające w falowniku podczas konwersji energii.

Zasilacze UPS przeznaczone do aplikacji przemysłowych i do zasilania obiektów z infrastrukturą IT z reguły są rozwiązaniami o dużej mocy sięgającej kilkaset kVA. Z uwagi na to system akumulatorowy będący magazynem energii jest w tym przypadku baterią ogniw o dużym napięciu znamionowym (100-220-540 VDC), gdyż zmniejsza to straty powstające w falowniku podczas konwersji energii.

UPS-y przemysłowe mają falownik zaprojektowany do pracy z obciążeniem indukcyjnym (silniki) i takim, który w chwili rozruchu pobiera duży prąd. Jednostki te są w stanie zapewnić wysoką wartość prądu zwarciowego. Chodzi o to, aby UPS podłączony do instalacji w zakładzie był w stanie zapewnić warunki jej pracy zbliżone do tego, jakie są przy dostępności sieci, gdzie powstanie zwarcia musi doprowadzić do zadziałania bezpieczników z ustaloną selektywnością, a nie do zadziałania ograniczenia w falowniku.

Jednostki przemysłowe bazują na podwójnej konwersji energii elektrycznej (z napięcia przemiennego do stałego i znowu do przemiennego). Pozwala to na ich pracę z bardzo małym lub zerowym czasem przełączania (true-on-line), jak też na uzyskanie wysokiego współczynnika mocy.

Takie zasilacze mają często konstrukcję modułową zapewniającą skalowanie systemu zasilającego (rozbudowywanie w miarę zwiększających się potrzeb) i większą dostępność zasilania, a akumulatory są w takich rozwiązaniach umieszczane w osobnych obudowach, co ułatwia ich serwis. Bardzo często dostępna jest w tym przypadku opcja hot-swap umożliwiająca wymianę ogniw podczas pracy. Część UPS-ów pozwala także na pracę równoległą, co umożliwia uzyskanie redundancji zasilania lub zwiększenie mocy wyjściowej.

Cechą UPS-ów przemysłowych jest też rozbudowany system sterowania zapewniający wiele funkcji związanych z optymalizacją ładowania i zarządzania akumulatorami, nadzorem nad działaniem jednostki przez sieć, programowaniem czasów reakcji oraz zarządzaniem stopniowym uruchamianiem systemów zasilających w przypadku pracy równoległej wielu urządzeń. Standardem w nowoczesnych UPS-ach jest również możliwość komunikacji z wykorzystaniem sieci komputerowych lub sieci komórkowych i bieżącego, zdalnego monitorowania ich pracy.

Zmiany w technologii UPS-ów przemysłowych zmierzają w kierunku zwiększania ich sprawności, poprawy jakości napięcia wyjściowego (mały poziom harmonicznych, a więc czystość sinusoidy), współczynnika mocy wejściowej jak najbliższego 1. Innymi słowy, zasilacz taki to nie tylko awaryjne źródło energii, ale także sposób na zapewnienie jej wysokiej jakości, co w wielu przypadkach ma pierwszorzędne znaczenie.

Z takimi problemami boryka się głównie przemysł spożywczy i farmaceutyczny, dla których przerwanie procesu produkcyjnego to ogromny koszt. Stosowane może być wówczas zasilanie całej linii produkcyjnej łącznie z pompami i zaworami, ponieważ nawet krótkotrwałe zniekształcenie lub zanik napięcia może spowodować zatrzymanie przepływu substancji spożywczych lub farmaceutycznych.