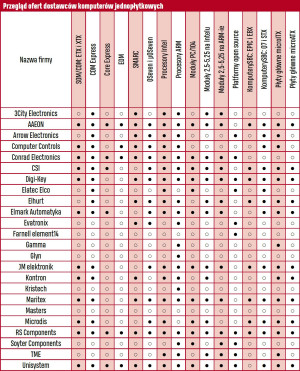

Komputery jednopłytkowe do systemów embedded - zapewniają wydajność i elastyczność

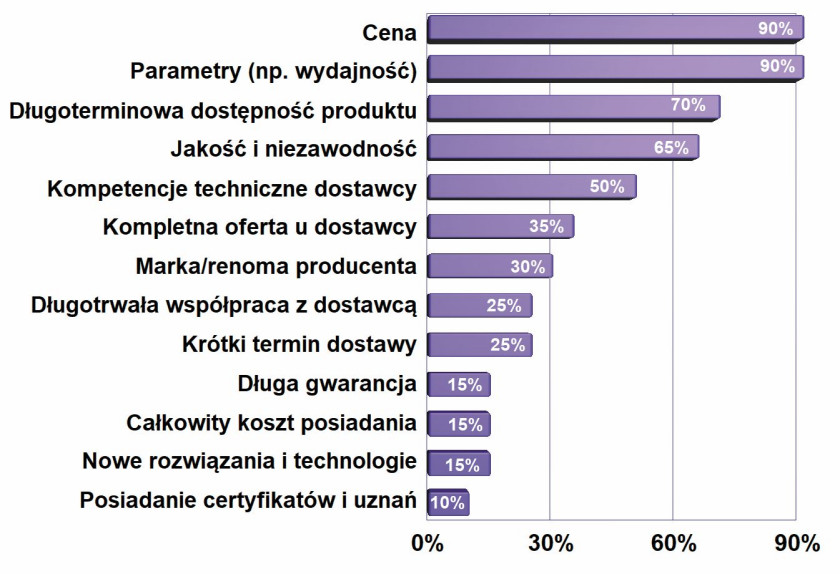

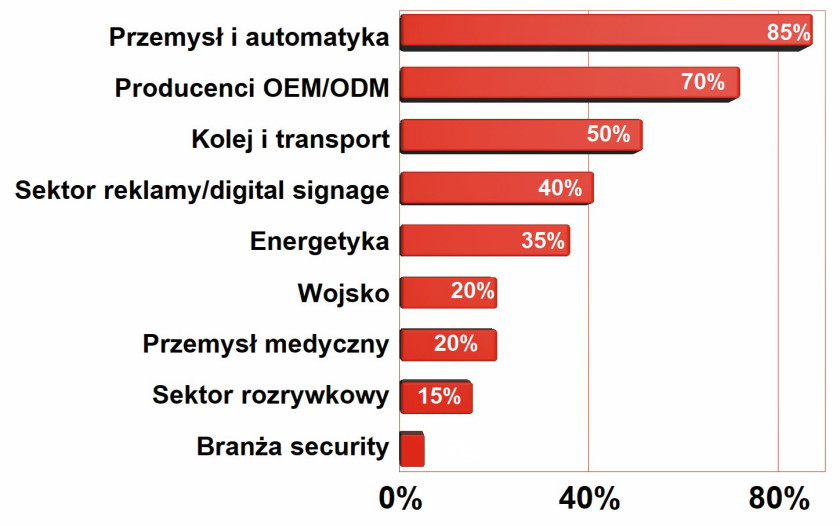

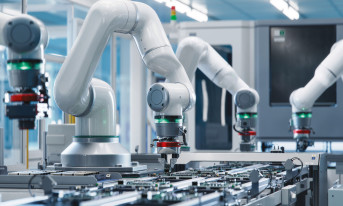

Rosnącemu popytowi na komputery jednopłytkowe sprzyja głównie postępująca komputeryzacja w przemyśle, aplikacje w transporcie, budownictwie, a nawet w rozrywce. Powszechna automatyzacja i walka o klienta, wysokie wymagania klientów specjalistycznych odnośnie certyfikatów i warunków pracy oraz wzrost liczby aplikacji embedded stanowią główne czynniki napędowe dla rynku.

Rosnącemu popytowi na komputery jednopłytkowe sprzyja głównie postępująca komputeryzacja w przemyśle, aplikacje w transporcie, budownictwie, a nawet w rozrywce. Powszechna automatyzacja i walka o klienta, wysokie wymagania klientów specjalistycznych odnośnie certyfikatów i warunków pracy oraz wzrost liczby aplikacji embedded stanowią główne czynniki napędowe dla rynku.

Krótkie serie lub wyroby wykonywane na zamówienie, rosnąca bardzo szybko komplikacja zagadnień i coraz droższa praca ludzka to naturalne czynniki rozwojowe dla komputerów jednopłytkowych. Niemniej ostatnio na skutek spadku cen, wielu nowych procesorów o znakomitych parametrach i większej świadomości klientów, można zauważyć, że komputery SBC, pamięci Flash stają się po prostu łatwo dostępne. W naszym otoczeniu jest coraz więcej urządzeń i sprzętu bazującego na komputerowym sterowaniu.

ARM-y RZĄDZĄ

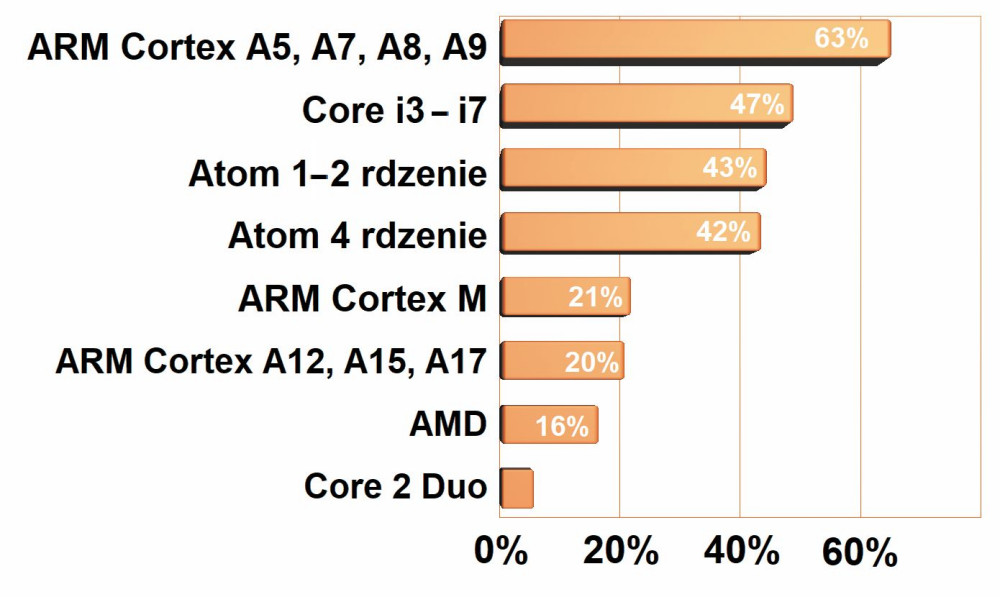

Na rynek SBC przebojem weszły w ostatnich latach procesory ARM, które do takich zastosowań nadają się doskonale pod względem poboru mocy, możliwości integracji oraz dużej wydajności. Nie oznacza to oczywiście, że architektura x86 Intela jest w odwrocie. Procesory tego producenta są wybierane chętniej, gdy konieczne jest zapewnienie wysokiej mocy obliczeniowej, dobrych możliwości multimedialnych i graficznych.

Z kolei układy ARM producenci mogą scalać samodzielnie w ramach SoC i tworzyć rozwiązania skrojone na miarę pod kątem wydajności zasobów i pobieranej mocy. Ponieważ licencjobiorców ARM jest wielu, także oferta rynku w zakresie SBC wydaje się bardzo szeroka, a ceny bardzo konkurencyjne.

Klienci cenią te układy i chętnie je stosują w swoich projektach, tym bardziej że jest w czym wybierać - mamy układy z rodziny Cortex-M o niewielkiej mocy obliczeniowej znane ze świata mikrokontrolerów, są wydajniejsze jednostki 32-bitowe Cortex-A5-A9 i 64-bitowe takie jak Cortex-A35, A53.

W sumie jest to kilkadziesiąt rdzeni, które każdy z producentów obudowuje w liczne układy peryferyjne: interfejsy, komunikację, tworząc dziesiątki, jeśli nie setki wersji. Widać to zwłaszcza w przypadku modułów SOM/COM, których jest mnóstwo.

FORM FACTOR

Większość komputerów SBC to prostokątna płytka z chipami oraz wielopinowym złączem lub gniazdami interfejsów umieszczonymi na jej obrzeżu, przez co można by oczekiwać, że po latach producentom uda się wypracować jakiś standard co do rozmieszczenia i wymiarów.

Takie próby były i są podejmowane, a branża co jakiś czas ekscytuje się nowym wypracowanym standardem (form factor), który za każdym razem jest określany jako przełomowy. Niemniej po chwili okazuje się, że pojawia się nowy pomysł na jeszcze mniejszy format.

W takiej rzeczywistości część producentów nie zaprząta sobie głowy normalizacją i tworzy własne konstrukcje. W efekcie na rynku funkcjonuje kilkadziesiąt rozwiązań, w tym także mniej lub bardziej otwarte (open source), rozwijane przez stowarzyszenia i fundacje (jak Raspberry Pi). W przypadku modułów COM/SOM standardów nie ma wcale, tak samo kompatybilności pinowej, za to są maleńkie wymiary, np. moduły procesorowe 40 × 40 mm lub komputerki w formacie karty PCI Express Mini 51 × 35 mm.

Poza nimi są tradycyjne płyty główne w wykonaniu przemysłowym w formatach Mini-ITX, MicroATX, ATX i EATX. Do tego dostępne są komputery jednopłytkowe (a więc z zamontowanym procesorem i pamięcią) o rozmiarach 5,25, 4, 3,5", a nawet o wielkości karty PICMG 1.3 jako System Host Board (SHB).

Są też moduły PC/104, PC/104-Plus, PCI-104, EPIC oraz EBX, a kolejne możliwości dają moduły płytek procesorowych SOM/COM, które są też dostępne w kilku formatach: ETX/XTX, COM Express w trzech odmianach Basic i Compact i Mini, SMARC, QSeven i uQSeven. Jak widać, wersji i pomysłów na "form factor" jest bez liku.

CORAZ WIĘKSZA INTEGRACJA

Z roku na rok komputery jednopłytkowe mają coraz mniejsze wymiary, ale też większe zasoby oraz moc obliczeniową. Jest to bezsprzecznie zasługa nowych technologii półprzewodnikowych, a więc procesów o coraz mniejszym wymiarze charakterystycznym lub metod układania jednego układu na drugim (PoP - Package over Package), po to aby zajmowały na płytce drukowanej jak najmniej miejsca.

Przełomem stało się to, że procesory i inne układy (interfejsy) są dostępne jako bloki IP (a więc jako oprogramowanie) i mogą być łatwo integrowane w jednej strukturze jako układ SoC (System on Chip). Efekty są imponujące, bo nieźle wyposażony komputer zajmuje na płytce powierzchnię nieznacznie przekraczającą 20 cm².

Znakiem możliwości, jakie kryją się we współczesnej technologii półprzewodnikowej, jest także dostępność matryc FPGA, które też są przez producentów integrowane wielu rozwiązaniach SBC.

Warto zauważyć, że w przypadku komputerów jednopłytkowych duża wydajność przestaje być priorytetem. Ona jest ważna w pełnowymiarowych komputerach przemysłowych (IPC). W omawianym obszarze ważniejsze są właśnie małe wymiary, niski pobór mocy oraz niewielki koszt, gdyż w ogromnej części zadania, jakie wykonują te jednostki, nie są bardzo złożone.

Dowodem potwierdzającym taką tezę jest to, że w ostatnich latach rynek SBC został zawojowany przez układy ARM Cortex i zapewne jest to też sygnał, że rynek komputerów SBC ewoluuje raczej w stronę wymagań aplikacji IoT niż przemysłowych rozwiązań procesowych. Bezsprzecznie sektor komputerów przemysłowych staje się coraz bardziej otwarty dla "przeciętnego" konstruktora, a coraz niższe ceny i większa dostępność sprawiają, że dostęp do tych rozwiązań jest praktycznie nieograniczony.

PLATFORMY OPEN SOURCE

Przełomowym momentem dla rynku komputerów jednopłytkowych było pojawienie się platform open source, a dokładnie komputerka Raspberry Pi. Był on bardzo tani, nieźle wyposażony, dostępny dla każdego oraz dobrze udokumentowany. RPI wszedł przebojem na rynek, bo miał rewelacyjny stosunek ceny do możliwości.

Sukces RPI wywołał na rynku prawdziwą gorączkę złota, a kolejne platformy zaczęły wyrastać jak grzyby po deszczu. Aktualnie grupa najpopularniejszych liczy minimum kilkanaście pozycji, a całość nawet kilkadziesiąt. Najtańsze komputerki kosztują poniżej 10 dolarów!

W tworzenie i promocję takich rozwiązań zaangażowały się największe światowe firmy dystrybucyjne, dzięki czemu całość nie była jedynie chwilowym zainteresowaniem grup społeczności lub fundacji. Do wymienionego Raspberry Pi należy dodać BeagleBone, BananaPi, OrangePi, HummingBoard, Gizmo lub Odroid.

Do tej grupy można też dopisać wiele platform mniej otwartych, ale o podobnym charakterze i przeznaczeniu, jak Galileo, Wandboard, UP Board i inne. Efekt jest taki, że komputery tego typu trwale zmieniły rynek i stworzyły nową kategorię użytkowników, makerów, czyli takich hobbystów nowej generacji.

Platformom open-source brakuje wielu cech niezbędnych w aplikacjach przemysłowych, czyli szerokiego zakresu temperatur pracy, jakości, stabilności działania i wieloletniej dostępności, przez co ich możliwości aplikacyjne sięgają jedynie obszaru półprofesjonalnego, a więc takiego o łagodnych wymaganiach.

W praktyce wiele zastosowań z pogranicza da się za ich pomocą obsłużyć i tym samym stają się one znaczącą częścią rynku, z którą trzeba się liczyć.

Prezentacje przykładowych firm powiązanych z tematyką tej analizy znajdują się na stronie: |

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Komunikacja bezprzewodowa - bez niej IoT nie ma racji bytu

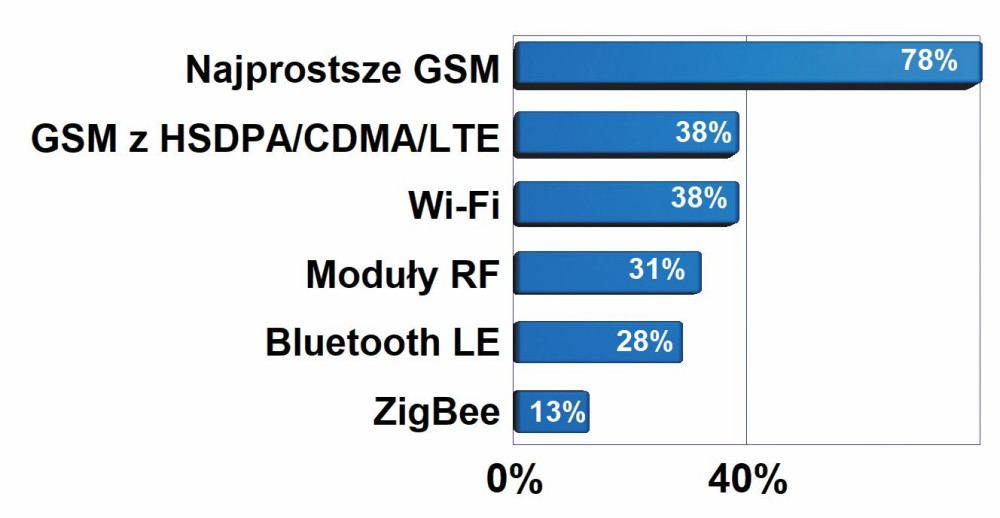

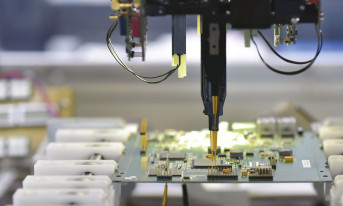

Komunikacja bezprzewodowa jest dzisiaj niezwykle popularna i dla wielu aplikacji takich jak IoT warunkuje sens istnienia produktu oraz rynkową wartość dodaną. Rozwój Internetu Rzeczy (IoT) powoduje, że coraz więcej różnego typu urządzeń korzysta z bezprzewodowej łączności z Internetem, począwszy od elektroniki osobistej, przez rozmaite czujniki aż do układów przemysłowych.

Komunikacja bezprzewodowa jest dzisiaj niezwykle popularna i dla wielu aplikacji takich jak IoT warunkuje sens istnienia produktu oraz rynkową wartość dodaną. Rozwój Internetu Rzeczy (IoT) powoduje, że coraz więcej różnego typu urządzeń korzysta z bezprzewodowej łączności z Internetem, począwszy od elektroniki osobistej, przez rozmaite czujniki aż do układów przemysłowych.

Zróżnicowanie urządzeń, ich przeznaczenia, sposobu konstrukcji oraz warunków pracy wymusza stosowanie różnych standardów komunikacji, najlepiej dopasowanych do rzeczywistych potrzeb. Za tę różnorodność odpowiadają dziesiątki różnych rozwiązań komunikacyjnych, które dostępne są w ramach modułów, o różnym przeznaczeniu, możliwościach i funkcjonalności, a także gotowych urządzeń. Warto zapoznać się z najbardziej popularnymi rozwiązaniami, aby w konkretnej sytuacji móc świadomie dokonać wyboru najodpowiedniejszego z nich.

Ceny modułów i urządzeń komunikacyjnych stale maleją i za tę samą kwotę co kiedyś można dzisiaj kupić znacznie doskonalsze urządzenia. Spadek cen to też efekt silnej konkurencji na rynku, bo duża liczba dostawców wymusza walkę o klienta, zwłaszcza w zakresie tych najpopularniejszych rozwiązań, jak moduły komórkowe.

Konkurencja cenowa jest bardzo podsycana przez firmy chińskie, polaryzuje też rynek i sprawia, że technologie wyceniane drożej, jak np. ZigBee, nie są w stanie się przebić. Problemem jest też psucie rynku przez podróbki rozwiązań markowych. Moduły komunikacyjne są coraz prostsze w aplikacji, poprawia się dostępność oprogramowania, narzędzi projektowych i projektów referencyjnych.

Konkurencja cenowa jest bardzo podsycana przez firmy chińskie, polaryzuje też rynek i sprawia, że technologie wyceniane drożej, jak np. ZigBee, nie są w stanie się przebić. Problemem jest też psucie rynku przez podróbki rozwiązań markowych. Moduły komunikacyjne są coraz prostsze w aplikacji, poprawia się dostępność oprogramowania, narzędzi projektowych i projektów referencyjnych.

Producenci wkładają dużo wysiłku, aby aplikowanie komunikacji bezprzewodowej było nieskomplikowane: wiele modułów ma zasoby sprzętowe pozwalające za ich pomocą wykonać kompletną aplikację (bez zewnętrznego mikrokontrolera), a programowanie realizowane jest w łatwych do opanowania językach jak Phyton.

Po stronie czynników negatywnych należy zapisać trend do upraszczania chipsetów rozwiązań modułowych w kierunku "all in one" oraz dominację na rynku technologii wspieranych przez producentów telefonów komórkowych. To uboczne efekty znaczenia ceny w omawianym sektorze oraz znaczenia komunikacji przez sieć komórkową.

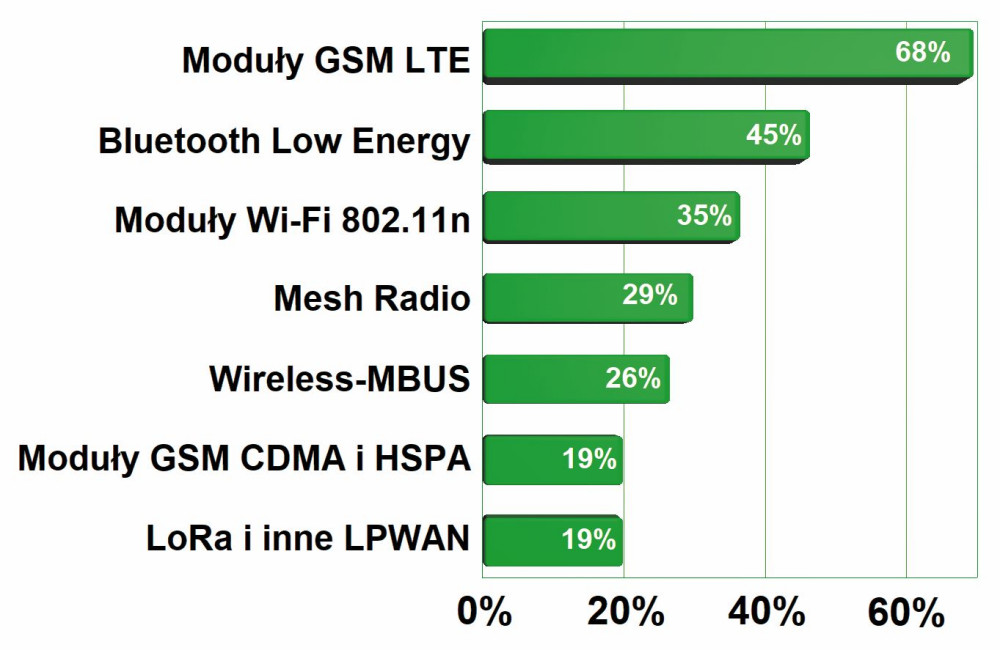

MODUŁY DO SIECI KOMÓRKOWYCH

Moduły przeznaczone do pracy w sieciach komórkowych ciągle stanowią główny nurt sprzedaży, a dodatkowym czynnikiem poprawiającym tempo rozwoju rynku jest ciągły spadek ich cen. Producenci modułów stale rozszerzają ich funkcjonalność, dzięki czemu klient dostaje coraz bardziej zaawansowany moduł w cenie często niższej niż model poprzedni.

Upraszcza to implementację i obniża koszty docelowej aplikacji, gdyż spada zapotrzebowanie na zasoby. Na przykład zewnętrzny mikrokontroler lub dodatkowe układy stają się zbędne. Często więc sam moduł wystarcza do realizacji aplikacji, bo ma dostępne nie tylko zasoby obliczeniowe i pamięć, ale też układy peryferyjne, jak przetwornik ADC, porty I/O.

Oparcie sterownika aplikacji na zasobach modułu komunikacyjnego pozwala też na znaczne skrócenie czasu potrzebnego na wdrożenie aplikacji, uproszczenie płytki PCB oraz zmniejszenie rozmiarów finalnego urządzenia, co ma szczególne znaczenie w dobie IoT.

Jeszcze do niedawna zdecydowana większość sprzedawanych modułów to były głównie jednostki GSM/GPRS, przeznaczone do aplikacji niewymagających przesyłania dużej ilości danych. Obecnie nowością są moduły z LTE, czyli działające w sieci 4G.

Moduły do sieci komórkowych zwykle pozwalają na migrację od rozwiązań najprostszych do najbardziej wydajnych bez konieczności przeprojektowania płytki lub też na stworzenie jednej mozaiki do produktu na różne rynki i standardy (Europa, USA). Dostępne są też wielosystemowe "kombajny" oraz wersje z wbudowanym odbiornikiem lokalizacyjnym GNSS lub Bluetooth albo Wi- Fi.

W zależności od obsługiwanej kategorii sieć w standardzie LTE zapewnia transmisję danych z prędkością do 150 Mbps (dla kat. 4) dzięki możliwości pracy wieloantenowej (MIMO), pozwalającej na jednoczesny odbiór i nadawanie danych w wielu kanałach jednocześnie. Niemniej takie rozwiązania o dużej wydajności są oczywiście kosztowne, stąd dla aplikacji IoT i podobnych rozwiązań producenci przygotowali rozwiązania bazujące na LTE niższych kategorii, 0, 1 (o przepustowości do 10 Mbps) lub M1.

W zależności od obsługiwanej kategorii sieć w standardzie LTE zapewnia transmisję danych z prędkością do 150 Mbps (dla kat. 4) dzięki możliwości pracy wieloantenowej (MIMO), pozwalającej na jednoczesny odbiór i nadawanie danych w wielu kanałach jednocześnie. Niemniej takie rozwiązania o dużej wydajności są oczywiście kosztowne, stąd dla aplikacji IoT i podobnych rozwiązań producenci przygotowali rozwiązania bazujące na LTE niższych kategorii, 0, 1 (o przepustowości do 10 Mbps) lub M1.

Działają one w sieci LTE, a więc nie niosą ze sobą ryzyka projektowego, że z czasem stracą zasięg, ale też nie są przewymiarowane w stosunku do potrzeb aplikacji. Typowe aplikacje, jak liczniki wody, gazu czy ciepła, systemy alarmowe, czujniki zadymienia, śledzenie ludzi i zwierząt, produkty AGD, kontrola dostępu do budynku, sterowanie oświetleniem, różnego rodzaju czujniki, np. stacje meteorologiczne itp., nie potrzebują większych wydajności, stąd LTE niskiej kategorii jest dobrym pomysłem.

BLUETOOTH LOW ENERGY

Bluetooth Low Energy (BLE), usprawniona wersja doskonale znanego standardu komunikacyjnego, jaka pojawiła się na rynku w 2010 roku (4.0), okazała się strzałem w dziesiątkę, bo jego funkcjonalność dobrze wpasowuje się w potrzeby aplikacji IoT, elektroniki noszonej i innych urządzeń zasilanych z baterii.

Bluetooth Low Energy (BLE), usprawniona wersja doskonale znanego standardu komunikacyjnego, jaka pojawiła się na rynku w 2010 roku (4.0), okazała się strzałem w dziesiątkę, bo jego funkcjonalność dobrze wpasowuje się w potrzeby aplikacji IoT, elektroniki noszonej i innych urządzeń zasilanych z baterii.

BLE jest efektywny energetycznie (stąd nazwa) i zapewnia większą sprawność komunikacji, lepszą elastyczność pracy i konfiguracji dołączonych urządzeń, w tym możliwość jednoczesnej pracy w trybie nadawania i odbioru danych. Aktualnie na rynek wchodzą produkty obsługujące wersję 5.0, jeszcze szybszą i efektywniejszą energetycznie niż 4.2.

Rosnąca popularność BLE w urządzeniach mobilnych (BLE jest obsługiwany przez około 90% tabletów i smartfonów będących w użyciu) powodują, że Bluetooth Low Energy jest dzisiaj prawdopodobnie najpopularniejszą metodą komunikacji urządzeń typu wearable.

WI-FI

Wi-Fi jest jednym z najbardziej powszechnych sposobów łączności zapewniającej bezpieczne, niezawodne i szybkie połączenia bezprzewodowe. Takie moduły wybierane są zwykle, gdy pobór energii jest drugoplanowy, a liczy się łatwość rozszerzenia urządzenia o komunikację opartą na protokole IP bez wprowadzania większych modyfikacji w działających urządzeniach lub rozszerzenie dowolnych urządzeń wyposażonych w interfejsy UART, SPI, USB lub LAN o bezprzewodowość.

Moduły Wi-Fi to rozwiązania niedrogie, często wykorzystywane jako mosty zapewniające przezroczystą transmisję sygnałów. Są one podstawą aplikacji przemysłowych, medycznych, a koncepcyjnie moduły te są zbliżone do całej reszty już omówionych rozwiązań.

SIECI LPWAN

LoRa, Sigfox to nazwy technologii, które pojawiają się coraz częściej w obszarze nowości produktowych.

Zaliczane są do rodziny sieci LPWAN (Low Power Wide Area Networks), a więc takich rozwiązań komunikacji, gdzie kosztem maksymalnej szybkości transmisji danych powiększono zasięg i sprawność energetyczną łącza. Domyślnym obszarem aplikacyjnym jest tutaj oczywiście IoT.

Koncepcyjnie obie sieci są podobne do telefonii komórkowej: mają topologię gwiazdy, w której terminale łączą się z siecią i między sobą za pomocą stacji bazowych BTS (Base Transceiver Station). Innymi słowy, do ich działania konieczna jest infrastruktura techniczna.

Niemniej BTS-y pracują w pasmach ISM, co nie wymaga płacenia za częstotliwości. W przypadku tych sieci komunikacja jest wolna po to, aby ograniczyć podatność na zakłócenia i wykorzystuje wąskie pasmo po to, aby poprawić warunki odbioru sygnału (lepszy stosunek sygnału do szumu) i zasięg.

Sieć Sigfox pokrywa swoim zasięgiem aktualnie Francję, Hiszpanię, Włochy, Wielką Brytanię, Belgię i Holandię, a także część Czech i Węgier plus kilka aglomeracji w USA. We Francji sieć ta tworzy lokalny własny system, w którym można wykupić abonament, w innych działa poprzez partnerów, którym też trzeba płacić za korzystanie.

LoRa jest bardziej otwarta w tym zakresie i nie ma tutaj z góry założenia, że dostęp będzie płatny. Może właśnie dlatego na mapie zasięgu Sigfox Polska jest cały czas białą plamą, a dla LoRa mamy aktywnych coraz więcej stacji bazowych, które pojawiają się w większych miastach.

Obie sieci są wspierane przez licznych partnerów tworzących stowarzyszenia LoRa Alliance i Sigfox Alliance. Sigfox nie wykorzystuje własnościowego protokołu, dzięki czemu układy mogą produkować różne firmy bez umów i formalności, wystarczy, że spełnią specyfikację techniczną Sigfox.

Takie układy ma na przykład Atmel/Microchip, TI, On Semi, ST Micro oraz Radiocrafts, Telit. Dla LoRa dostawcami chipów i rozwiązań komunikacyjnych są Semtech, Microchip, HopeRF i wielu innych.

NB-IOT

Przez wiele lat moduły komunikacyjne pracujące w technologii GPRS (2G) i komunikujące się poprzez sieć komórkową były podstawą komunikacji bezprzewodowej. Wraz z popularyzacją sieci 4G i rosnącym znaczeniem aplikacji IoT wiele nowoczesnych rozwiązań staje się zbyt skomplikowanych i tym samym zbyt drogich z punktu widzenia potrzeb IoT.

Przez wiele lat moduły komunikacyjne pracujące w technologii GPRS (2G) i komunikujące się poprzez sieć komórkową były podstawą komunikacji bezprzewodowej. Wraz z popularyzacją sieci 4G i rosnącym znaczeniem aplikacji IoT wiele nowoczesnych rozwiązań staje się zbyt skomplikowanych i tym samym zbyt drogich z punktu widzenia potrzeb IoT.

Szybkość komunikacji jest tutaj praktycznie bez znaczenia, bo liczy się czas pracy na bateriach. W rezultacie umieszczenie w sprzęcie IoT modemu komórkowego 4G nie ma sensu od strony technicznej i ekonomicznej. Te dylematy rozwiązuje standard NB-IoT (Narrow Band IoT), który wykorzystuje sieć komórkową 4G, ale nie ma wymienionych wad.

Maksymalna szybkość komunikacji możliwa do uzyskania w tym rozwiązaniu to 200 kbps DL. Uzyskuje się ją przy zajęciu pasma o szerokości jedynie 200 kHz (przy LTE kat. 4 jest to aż 20 MHz). Wąskopasmowa praca pozwala na zdecydowanie większe skupienie urządzeń na małym obszarze, co w przypadku IoT jest kluczowym czynnikiem i zapewnia wysoką sprawność energetyczną.

Moduły NB-IoT otwierają nowe możliwości wykorzystania infrastruktury sieci 4G w aplikacjach zasilanych z baterii przy niskiej cenie i dobrym zasięgu wewnątrz budynków. Uwalniają też od ryzyka związanego z perspektywą pogorszenia się zasięgu sieci 2G na skutek wycofywania takich nadajników z eksploatacji.

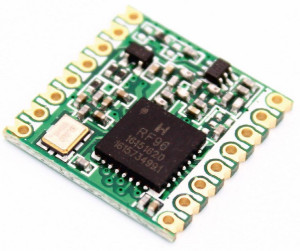

MODUŁY RF

Komunikacja bezprzewodowa nie zawsze bazuje na standardach i znanych protokołach. Moduły takie kierowane są do prostych aplikacji włącz/wyłącz lub rozwiązań własnościowych, które nie muszą mieć zdolności do komunikacji z innym sprzętem. Czasem też aplikacje są zbyt proste, aby aplikować do nich złożoną i wydajną komunikację. W takim wypadku są one też tańsze w realizacji.

Komunikacja bezprzewodowa nie zawsze bazuje na standardach i znanych protokołach. Moduły takie kierowane są do prostych aplikacji włącz/wyłącz lub rozwiązań własnościowych, które nie muszą mieć zdolności do komunikacji z innym sprzętem. Czasem też aplikacje są zbyt proste, aby aplikować do nich złożoną i wydajną komunikację. W takim wypadku są one też tańsze w realizacji.

Wiele z nich pozwala na programowanie parametrów za pomocą interfejsu cyfrowego, budowę sieci typu mesh lub wykorzystanie zamiast pojedynczego kanału pasma ISM (433/868/2,4 GHz) transmisji z rozpraszaniem widma lub skakaniem po kanałach.

Innymi słowy, prostota funkcjonalna tych modułów nie oznacza ubogiej funkcjonalności. Występują one w bardzo wielu odmianach: od najprostszych par nadajnik-odbiornik do otwierania bramy, po rozwiązania z procesorem aplikacyjnym, wejściami analogowymi i cyfrowymi, obsługą sieci o różnej topologii, szyfrowaniem transmisji i innymi.

PRODUKTY DLA AUTOMATYKI I PRZEMYSŁU

W tym obszarze liczą się głównie rozwiązania komunikacyjne o dużym stopniu integracji, a więc zawierające moduł radiowy, zasilacz, sterownik i interfejs komunikacyjny odpowiedzialny za komunikację z siecią przemysłową w jednym lub kilku standardach sieci. Są też kontrolki i przełączniki i wyjście na antenę zewnętrzną.

Moduły kierowane w ten obszar zwykle mają bardzo rozbudowaną funkcjonalność w zakresie oprogramowania wewnętrznego, np. wbudowany webserwer, system operacyjny, wyświetlacz LCD i nierzadko obsługują kilka standardów radiowych i pasm częstotliwości. Często też funkcje związane z komunikacją bezprzewodową rozszerza się o porty cyfrowe i analogowe. Takie urządzenia kupowane są głównie przez integratorów systemów.

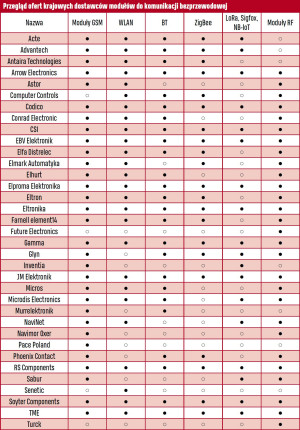

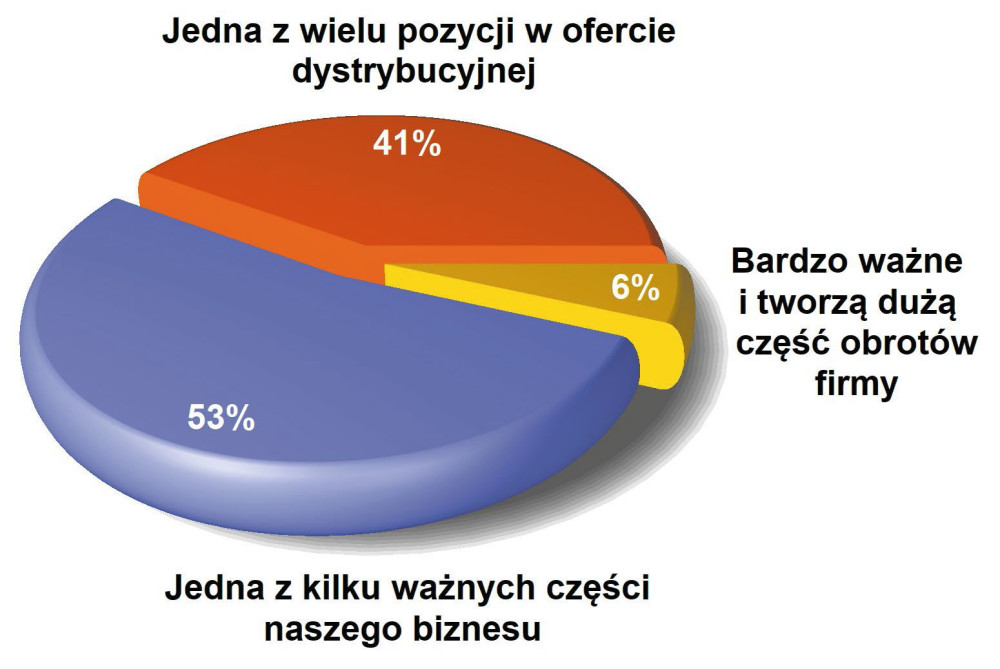

DOSTAWCY MODUŁÓW KOMUNIKACYJNYCH

Wśród firm zajmujących się sprzedażą sporą grupę tworzą dostawcy komponentów elektronicznych o szerokiej ofercie, jak firmy katalogowe: Farnell element14, Elfa Distrelec, RS Components, Conrad Electronic, TME oraz duże hurtownie i dystrybutorzy międzynarodowi (Micros i Maritex oraz Arrow Electronics, EBV).

Drugą grupę stanowią firmy dystrybucyjne o wyspecjalizowanej ofercie, dla których komunikacja bezprzewodowa jest jednym z ważniejszych obszarów aktywności, np. Elproma Elektronika, Acte, Eltronika, Microdis Electronics, Elhurt, Masters, Gamma, JM elektronik, Soyter Components, Computer Controls oraz Glyn.

Reprezentują one czołowych producentów jak Gemalto (Cinterion), SimCom, Sierra-Wireless, uBlox oraz zapewniają pełną pomoc techniczną. Pomijając najprostsze konstrukcje, moduły komunikacyjne są skomplikowane technicznie, zwłaszcza te z wbudowanym procesorem aplikacyjnym, dlatego doradztwo techniczne i postrzeganie dostawcy jako partnera w projekcie w tym obszarze jest cenione.

Trzecia grupa dostawców to firmy z obszaru automatyki przemysłowej sprzedające modułowe urządzenia komunikacyjne dla potrzeb sieci przemysłowych, do łączenia rozproszonych instalacji, obiektów i zakładów - to np. Elmark Automatyka, Eltron, Inventia, Murrelektronik, CSI i podobne.

Prezentacje przykładowych firm powiązanych z tematyką tej analizy znajdują się na stronie: |

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

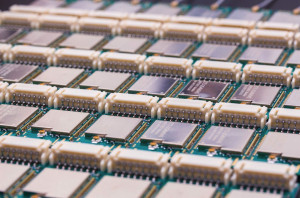

Przemysłowe pamięci Flash - szybkie i niezawodne

Karty pamięci i przemysłowe dyski SSD bardzo zyskały w ostatnich latach na popularności. Aktualnie w ten rodzaj nośników danych wyposaża się już nie tylko urządzenia przenośne, lecz także komputery stacjonarne oraz serwery oraz sprzęt przemysłowy. W odróżnieniu od wersji konsumenckich pamięci te charakteryzują się dużą niezawodnością i wytrzymałością na trudne warunki pracy.

Karty pamięci i przemysłowe dyski SSD bardzo zyskały w ostatnich latach na popularności. Aktualnie w ten rodzaj nośników danych wyposaża się już nie tylko urządzenia przenośne, lecz także komputery stacjonarne oraz serwery oraz sprzęt przemysłowy. W odróżnieniu od wersji konsumenckich pamięci te charakteryzują się dużą niezawodnością i wytrzymałością na trudne warunki pracy.

Aby takie właściwości uzyskać, wdraża się w nich różne rozwiązania sprzętowe i programowe ograniczające wpływ czynników zewnętrznych na możliwość zapisu i odczytu danych oraz ich integralność. Oprócz wzmocnienia konstrukcji stosuje się też kontrolery z algorytmami detekcji i korekcji błędów, mechanizmami zarządzania uszkodzonymi blokami pamięci i monitorowania parametrów karty, które umożliwiają m.in. określenie stopnia jej zużycia.

Niektóre rozwiązania mają też funkcje odzyskiwania danych oraz detekcji przerwy w zasilaniu. Producenci takich pamięci implementują i wdrażają w nich wiele nierzadko unikalnych technologii odpowiedzialnych za jakość i niezawodność. Za realizację tych funkcji w dużej mierze odpowiedzialny jest kontroler dysku zarządzający jego pracą.

SSD VS. HDD

Jedną z ważniejszych zalet dysków SSD jest brak ruchomych części mechanicznych. Dzięki niej m.in. dyski SSD działają szybciej od dysków magnetycznych, w których występują opóźnienia w dostępie do danych spowodowane koniecznością rozruchu ich elektromechanicznych podzespołów. Są również odporniejsze na drgania, uderzenia i upadki, w efekcie czego ich MTBF jest kilka razy dłuższy niż w przypadku dysków HDD.

Jedną z ważniejszych zalet dysków SSD jest brak ruchomych części mechanicznych. Dzięki niej m.in. dyski SSD działają szybciej od dysków magnetycznych, w których występują opóźnienia w dostępie do danych spowodowane koniecznością rozruchu ich elektromechanicznych podzespołów. Są również odporniejsze na drgania, uderzenia i upadki, w efekcie czego ich MTBF jest kilka razy dłuższy niż w przypadku dysków HDD.

Ponadto dyski SSD zużywają mniej energii elektrycznej niż HDD, które potrzebują jej więcej do zasilenia silników napędzających dysk i głowice. W rezultacie dyski magnetyczne krócej pracują na zasilaniu bateryjnym oraz silniej się nagrzewają. Przez to ostatnie potrzebują one wentylatora, który zwiększa ich koszt, wagę, pobór energii, awaryjność i głośność.

Z drugiej strony komórki pamięci półprzewodnikowych mają skończoną żywotność. To oznacza, że mogą być zapisywane i odczytywane określoną liczbę razy, zanim przeprowadzenie takich operacji stanie się niemożliwe. Przyczyną tego ograniczenia jest specyfika mechanizmu zapisu danych.

Każdą operację zapisu nowych informacji poprzedza skasowanie dotychczasowej zawartości komórek. W wyniku często powtarzających się cykli gromadzenia i usuwania ładunku z bramki pływającej w cienkiej warstwie izolatora oddzielającej bramkę pływającą od bramki sterującej powstają defekty. Gromadzą się w nich ładunki. Łatwiej również te ostatnie mogą wówczas przepływać do albo z niej odpływać.

Typowo żywotność pamięci typu NAND SLC wynosi 100 tys. cykli kasowania/zapisu, a pamięci typu NAND MLC - 10 tys. takich cykli. Po przekroczeniu tych wartości pewny oraz bezbłędny zapis oraz odczyt informacji nie jest już zagwarantowany. Dlatego w dyskach SSD implementuje się rozwiązania, które mają na celu wydłużenie czasu ich pracy, jak odśmiecanie i równoważenie zużycia.

Typowo żywotność pamięci typu NAND SLC wynosi 100 tys. cykli kasowania/zapisu, a pamięci typu NAND MLC - 10 tys. takich cykli. Po przekroczeniu tych wartości pewny oraz bezbłędny zapis oraz odczyt informacji nie jest już zagwarantowany. Dlatego w dyskach SSD implementuje się rozwiązania, które mają na celu wydłużenie czasu ich pracy, jak odśmiecanie i równoważenie zużycia.

Za wykonanie powyższych zadań i nie tylko, bo implementuje się również wiele innych technik, które mają na celu zwiększenie żywotności oraz eliminowanie błędów danych w dyskach SSD (m.in. zarządzanie uszkodzonymi blokami oraz kodowanie korekcyjne), odpowiada kontroler. Spełnia on również drugą, równie ważną funkcję, umożliwiając komunikację pomiędzy dyskiem półprzewodnikowym, a systemem nadrzędnym.

Kontroler dysku SSD to kluczowy komponent, którego część sprzętowa oraz oprogramowanie firmware powinny być wysoce zindywidualizowane oraz ściśle ze sobą powiązane. Wprawdzie od strony sprzętowej do jego budowy korzysta się ze standardowych bloków, takich jak na przykład CPU czy interfejsy, jak UART, lecz to oprogramowanie firmware determinuje najważniejsze cechy użytkowe kontrolera dysku SSD.

DYSKI SSD - FORMATY I ZASTOSOWANIA

Dyski SSD dostępne są w formatach tradycyjnych magnetycznych dysków HDD, czyli: 5,25", 3,5", 2,5" i 1,8". Największe z nich, 5,25-calowe, nie są szeroko używane, przede wszystkim korzysta się z nich w zastosowaniach specjalistycznych, natomiast z najmniejszych, 1,8-calowych, na przykład w ultrabookach. 3,5-calowe dyski SSD są instalowane w komputerach stacjonarnych, natomiast dyski 2,5-calowe w laptopach. Dyski w rozmiarach 2,5" oraz 3,5" są najpopularniejsze, dzięki rozmiarowi pasują bowiem jako zamienniki dysków HDD.

W systemach wbudowanych w przemyśle wykorzystuje się także dyski półprzewodnikowe m.in. w znanym od lat 90. zeszłego wieku formacie Disk-On-Module (DOM) i formacie MO-300. SSD drugiego typu mają wymiary 50,8 × 29,85 mm i są wyposażone w złącze mini-SATA (mSATA).

Mimo podobieństwa tego ostatniego do interfejsu Mini PCI Express, nie są one zgodne, dlatego kart pamięci obu typów domyślnie nie można używać zamiennie. W przemyśle używa się oprócz tego SSD w formacie MO-297 (slim SATA, inaczej half slim SATA) o wymiarach 39,8 × 54 mm, ze złączem takim, w jakie wyposaża się 2,5-calowe dyski SATA SSD.

W 2012 roku wprowadzono nowy format, początkowo pod nazwą Next Generation Form Factor (NGFF), którą później zmieniono na M. 2. Poza przemysłem SSD w tym rozmiarze montuje się także w ultrabookach i tabletach. Typowo dyski półprzewodnikowe w formacie M.2 mają wymiary 22 mm × 30 mm, chociaż specyfikacja dopuszcza wiele innych rozmiarów oraz złącza SATA lub PCIe.

Prezentacje przykładowych firm powiązanych z tematyką tej analizy znajdują się na stronie: |

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|