Dystrybutorzy podzespołów elektronicznych

Pandemia i związane z nią ograniczenia transportowe, zamknięcia niektórych branż oraz powszechna niepewność, jaka wdarła się w nasze życie w 2020 roku, zmieniła wiele utartych mechanizmów w światowej gospodarce. Dla jednych okazała się wielką szansą i możliwością ogromnego zarobku, innym przysporzyła wielkich strat. Jeśli chodzi o elektronikę, to patrząc z perspektywy na to, co zaszło, można powiedzieć, że dla wielu pandemia stała się zaskakująca, przynajmniej na pierwszy rzut oka.

Popyt na elektronikę, a więc w konsekwencji także na podzespoły, zamiast zmaleć, szybko zaczął się zwiększać, bo zmuszeni do pracy w domach konsumenci zaczęli kupować laptopy, smartfony, sprzęt medyczny, urządzenia telekomunikacyjne i inny sprzęt niezbędny do pracy zdalnej. Jednocześnie przestaliśmy jeździć do pracy, więc antycypując kłopoty motoryzacji, producenci półprzewodników przestawili się na produkcję komponentów dla urządzeń konsumenckich, po to, aby uniknąć zapaści sprzedaży, jaką przepowiadano w sprzedaży samochodów. Z uwagi na ograniczenia w działalności zakładów, choroby, skala działalności wielu biznesów też się zmniejszyła po to, aby jakoś przetrwać trudny okres.

Niepewność co do tego, jak długo potrwa pandemia oraz jak silnie będzie oddziaływać na światową gospodarkę, w dużej mierze przyczyniła się do obserwowanego rozchwiania rynku. To dlatego, że doprowadziła do wielu zachowań klientów, które z dzisiejszej perspektywy można by określić jako nieracjonalne, ale w tamtym okresie prowadziły one do ograniczenia ryzyka biznesowego. Część firm kupowała podzespoły na zapas, inni przestali kupować po to, aby ograniczyć potencjalne straty. Do tego doszły problemy logistyczne związane z barierami administracyjnymi oraz zamknięciem nieba dla operacji lotniczych. Pod koniec 2020 roku, gdy nastąpiło ożywienie, okazało się, że magazyny są puste, a komponentów wszędzie brakuje. Początkowo problem był z mikrokontrolerami z kwalifikacją motoryzacyjną, niedługo później zaczęło brakować wielu innych półprzewodników, bo producenci elektroniki, przewidując wychodzenie gospodarki z kryzysu, zaczęli zamawiać spore partie elementów do planowanej produkcji.

Wzrost popytu zderzył się z cały czas niepełnymi możliwościami produkcyjnymi w Azji, kłopotami z transportem z Chin (braki kontenerów). Czasy realizacji zamówień zaczęły się szybko zwiększać, a termin realizacji zamówienia sięgający 50‒70 tygodni wcale nie jest dzisiaj szokująco duży.

W efekcie kupowanie podzespołów elektronicznych zmieniło się w ostatnich miesiącach w zdobywanie, a to oznacza wiele problemów. Liczba zamówień oczekujących na realizację znacznie wzrosła, bo wiele firm wysyła zapotrzebowanie, gdzie się da, licząc, że któreś z kolei zostanie zrealizowane. Producenci podzespołów widzą takie zwielokrotnione potrzeby, wycinają cwaniaków z kolejek, tworzą specjalne warunki dostaw po to, aby ograniczyć spekulację i dać gwarancję, że rzeczywiste zamówienia zostaną zrealizowane.

Wielkie zakłady produkcyjne żądają pierwszeństwa obsługi, więc ci mniejsi zaczęli płacić więcej, aby nie wypaść na margines. Zresztą ceny wzrosły dla wszystkich, co jest naturalne w czasie niedoborów.

Podróbki wychodzą z ukrycia

Zagrożenie ze strony podrabianych podzespołów zawsze się zwiększa w czasach, gdy na rynku mamy trudności z zaopatrzeniem. Widmo przestojów w produkcji, opóźnień w realizacji projektu, groźba niedotrzymania warunków umowy oraz inne podobne zjawiska prowadzą do wzrostu presji na dział zakupów i niestety zwiększają finalnie ryzyko trafienia na bubel.

Alokacja wywołuje problem z podróbkami, bo zdesperowani klienci, walcząc o niezbędne do utrzymania produkcji podzespoły, zmagają się z rosnącymi cenami na skutek braku podaży i szukają też elementów w przypadkowych źródłach dostaw, w tym u przypadkowych sprzedawców azjatyckich. Takie okazjonalne zakupy mogą skończyć się problemami jakościowymi i tym samym alokacja w tym kontekście staje się zjawiskiem negatywnym.

W stabilnych warunkach rynkowych przed podróbkami można się skutecznie zabezpieczyć, kupując elementy w autoryzowanej sieci sprzedaży. Ale gdy nie da się kupić elementów u autoryzowanego przedstawiciela za akceptowalną cenę, pojawia się problem. Poszukiwania wówczas muszą wyjść poza ten najważniejszy element łańcucha dostaw w stronę firm brokerskich, sprzedawców niezależnych, firm specjalizujących się w sprzedaży końcówek oraz także zagranicznych portali handlowych. To, co będzie w przesyłce, nigdy nie jest z góry wiadome, bo w praktyce partie elementów są mieszane, do pełnowartościowych dodawane są części z demontażu itd.

W sytuacji, gdy towaru brakuje, ceny rosną. To oczywista zależność, która jest dzisiaj dodatkowym problemem dla rynku dystrybucji. Ceny podzespołów zwiększają się na skutek splotu wielu czynników, takich jak wzrost kosztów surowców, transportu, kosztów pracy, dużej inflacji pojawiającej się przy okazji tłumienia pandemii a także tego, że duży popyt rynku pozwala na podwyżki.

Nowe pomysły na biznes

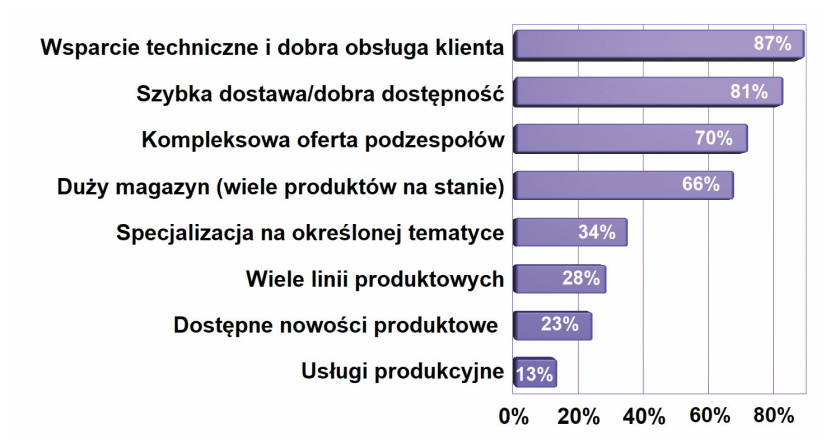

Rynek dystrybucji jest też obszarem, gdzie testuje się wiele pomysłów biznesowych. Jednym z nich jest sprzedaż bezpośrednia, a więc ta realizowana od producenta do klienta końcowego z pominięciem sieci dystrybucji. Takie pomysły są charakterystyczne dla dużych producentów półprzewodników o szerokiej ofercie, u których można sobie założyć konto i kupić komponenty przez Internet.

Specjaliści z firm dystrybucyjnych są sceptyczni co do sprzedaży direct, wskazując, że zamawianie elementów elektronicznych bezpośrednio od producenta w praktyce nie eliminuje wielu ważnych problemów związanych z kompletacją dostaw, wsparciem technicznym i dostępnością oraz ceną. Przywołują oni najczęściej do głosu aspekt kosztowy działalności i wykazują, że ktoś zawsze musi zapłacić za magazynowanie towaru, logistykę, obsługę sprzedaży, działalność sklepu internetowego, obsługę zwrotów i dziesiątki innych zadań, jakie przynależą do dystrybutora. W niektórych przypadkach sklep internetowy producenta jest w praktyce prowadzony przez dystrybutora katalogowego jako usługa i w takiej sytuacji bardziej przypomina działanie z obszaru public relations niż biznesu.

Inny pomysł to pojawiający się specjalizowani usługodawcy, którzy wyszukują na rynku optymalne warunki dostaw, wybierając najlepsze oferty spośród różnych dystrybutorów i producentów z całego świata. Sprzedają oni podzespoły w elastycznej formule, a więc z wielu źródeł podobnie jak brokerzy, tyle że korzystają z autoryzowanych kanałów. Ich działalność przypomina trochę wyszukiwarki ofert, które na bazie BOM klienta tworzą listy zakupowe, potem kupują tak, by zoptymalizować całość zamówienia pod względem terminów i kosztów.

Czy takie inicjatywy zmienią krajobraz na rynku dystrybucji komponentów? Jeśli nawet, to nieprędko.

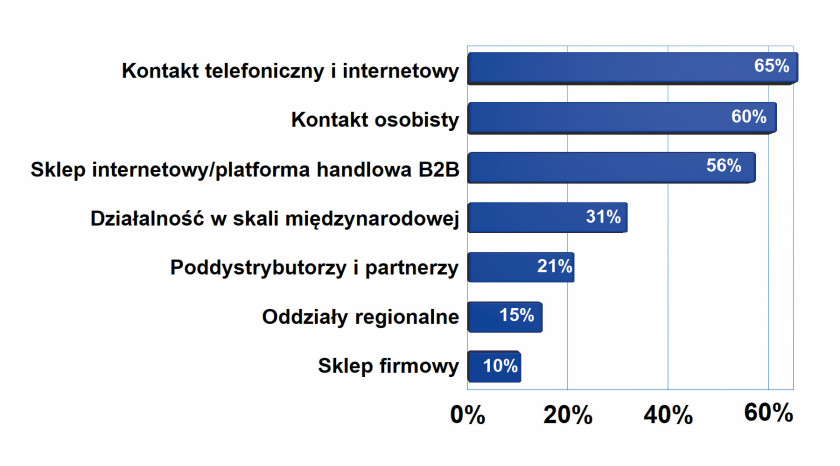

Wsparcie techniczne jest cały czas kluczową wartością

Ogromne znaczenie wsparcia technicznego w dystrybucji to skutek tego, że na rynku funkcjonuje bardzo dużo produktów i wiele z nich jest do siebie bardzo podobnych. Wybór optymalnego rozwiązania staje się niełatwy i czasochłonny, a przecież codziennym kłopotem współczesnego projektanta jest chroniczny brak czasu.

Stale zwiększa się liczba zagadnień technicznych i wymagań, o których trzeba pamiętać oraz uwzględnić, stąd ryzyko nietrafienia też nie jest wcale małe. Dlatego firmy oczekują, że dostawca nie tylko im sprzeda, ale także doradzi, co w ich przypadku byłoby najlepsze oraz skoryguje nieprawidłowy wybór.

W wyżyłowanych do granic projektach o powodzeniu decydują drobne szczegóły i mały pobór mocy jest dobrym przykładem obszaru, gdzie potrzeba konsultacji koncepcji i założeń z inżynierem wsparcia technicznego jest bardzo cenna.

Oczekiwania klientów w stosunku do dystrybutorów stale się zwiększają. Dobór najlepszego produktu to jedno, ale w praktyce trzeba dawać z siebie jeszcze więcej: próbki, narzędzia i płytki startowe to z pewnością kolejne i oczywiste rzeczy składające się na wsparcie, ale pomoc sięga też oprogramowania, dobrych praktyk projektowych, a nawet pomocy w projektowaniu, zgraniu platformy sprzętowej z oprogramowaniem i podobnych. Często wybiera się nie tyle komponent, co całe środowisko i architekturę, łącznie z oprogramowaniem narzędziowym, zestawami ewaluacyjnymi, a nawet próbkami.

Kamil Wojtenproduct manager w Masters

Rynek dystrybucji elementów elektronicznych cały czas jest pod presją zjawisk wynikających z pandemii. Zasadniczym problemem dystrybutorów jest nie tyle zaspokajanie bieżących i przyszłych potrzeb klientów, ale przede wszystkim utrzymanie ciągłości produkcji u klientów. Koniunkturę na rynku dystrybucji można by określić jako bardzo dobrą, jeżeli weźmiemy pod uwagę fakt, że popyt znacząco przewyższa podaż, ale oczywiście jest to kolosalne uproszczenie. Alokacja dostaw, która dotyczy wielu produktów, niestety jest źródłem wielu kłopotów operacyjnych. Aktualnie niedobory występują w wielu obszarach, a terminy realizacji w niektórych przypadkach mogą być liczone w latach. Przyczyn tego zjawiska należy upatrywać nie tylko w globalnej pandemii. Przyczyniły się do tego również inwestycje rządu chińskiego w rozwój technologii 5G oraz produkcję pojazdów elektrycznych. Kolejny raz przekonujemy się, jak istotna w globalnej gospodarce jest pozycja Chin i dywersyfikacja źródeł zaopatrzenia w celu realizacji skutecznej strategii zakupowej. Prognozy zakładają utrzymanie obecnego stanu alokacji w najbliższych kwartałach z tendencją do zmiany terminów realizacji w poszczególnych grupach produktowych, np. skrócenie czasu dostaw układów scalonych, a wydłużenie dla elementów pasywnych. |

W ten sposób wsparcie techniczne jako wartość dodana do handlu urasta do ważnego czynnika różnicującego poszczególne firmy i pozwalającego mniejszym firmom o specjalistycznym profilu funkcjonować przy silnej konkurencji. Bardzo szerokie portfolio produktów charakterystyczne dla rynkowych gigantów tworzy też naturalne sprzężenie zwrotne, gdyż im większa firma, tym trudniej jej poznać szczegóły tego, co oferuje.

Produkt optymalny od strony technicznej, a więc wybrany po przewertowaniu katalogów, też niekoniecznie musi być najlepszy do danej aplikacji, gdyż pewne produkty są popularne, szeroko dostępne i magazynowane, na inne trzeba czekać. To samo dotyczy cen, bowiem elementy produkowane przez wielu producentów są tańsze. Inny problem to ryzyko zakończenia produkcji. Użycie do nowego produktu części, która za niedługo wypadnie z oferty (przestanie być produkowana lub zostanie zastąpiona nową wersją), to wielkie ryzyko i koszty. Takie informacje dostępne z dużym wyprzedzeniem są u dystrybutorów, stąd wsparcie techniczne nie polega tylko na przekazaniu informacji technicznej, bo do tego służy właśnie Internet, ale pokazaniu konstruktorom, które produkty są warte zainteresowania w danych aplikacjach i perspektywiczne (bezpieczne).

Trzeba też zauważyć, że oczekiwania klientów w stosunku do dystrybutorów stale się zwiększają. Dobór najlepszego produktu to jedno, ale w praktyce trzeba dawać z siebie jeszcze więcej: próbki, narzędzia i płytki startowe to z pewnością kolejne i oczywiste rzeczy składające się na wsparcie, ale pomoc sięga też oprogramowania, dobrych praktyk projektowych, a nawet pomocy w projektowaniu. Po części wynika to ze wspomnianych wcześniej problemów z czasem i chęcią ograniczenia ryzyka, ale także z niewiedzą. Elektronika wdziera się na coraz to nowe obszary rynku techniki i przed koniecznością elektronizacji stają także producenci, dla których projektowanie i elektronika nie jest rdzeniem biznesu. Takie osoby zwykle potrzebują więcej pomocy.

Materiały magnetyczne i elementy indukcyjne

Szacuje się, że elementy indukcyjne i magnetyczne mogą stanowić około połowy całkowitej masy współczesnego układu konwersji mocy pracującego na wysokiej częstotliwości. Zasada działania tego typu komponentów wymaga zapewnienia bardzo dużego poziomu precyzji podczas całego procesu produkcyjnego, ponieważ ich właściwości ściśle zależą od posiadanych wymiarów geometrycznych. Nawet niewielkie niedokładności w procesie formowania rdzenia lub uzwojenia mogą prowadzić do znaczących różnic w rozkładzie strumienia pola magnetycznego podczas pracy układu.

Znacząca większość rdzeni elementów indukcyjnych we współczesnej elektronice wykonywana jest z wykorzystaniem jednego z kilku podstawowych rodzajów materiałów magnetycznych, takich jak ferryty oraz materiały ferromagnetyczne.

Ferryty

Ferryty to niemetaliczne materiały ceramiczne o właściwościach ferrimagnetycznych. Są one tanie oraz charakteryzują się dużą rezystywnością, co daje niewielki poziom strat. Dostępne są w ogromnej liczbie kształtów i rozmiarów, co przekłada się na dużą łatwość wykorzystania ich w konstrukcji różnego typu komponentów elektronicznych. Jako substancja niemetaliczna są również odporne na korozję.

Do wad tego typu materiałów zaliczyć można małą wartość indukcji nasycenia, co utrudnia redukcję rozmiarów komponentu oraz zastosowanie ich w układach dużej mocy.

Materiały magnetycznie o znacznie wyższej wartości indukcji nasycenia niż ferryty to substancje metaliczne, oparte na stopach żelaza z dodatkami takimi jak krzem, nikiel, chrom lub kobalt. Stopy te są stosunkowo tanie i dostępne. Mają właściwości ferromagnetyczne, w odróżnieniu od ferrytów, które są ferrimagnetykami.

Niewątpliwą wadą materiałów ferromagnetycznych z punktu widzenia konstrukcji elementów elektronicznych jest ich przewodnictwo elektryczne. Powoduje to powstawanie prądów wirowych, prowadzących do wzrostu strat energii. Z tego względu nie wytwarza się tych elementów z jednolitych brył metalu, lecz składa z mniejszych struktur, np. z pakietów cienkich blach, odizolowanych wzajemnie warstwą dielektryka (np. emalią, lakierem).

Rdzenie proszkowe

Rdzenie proszkowe wykonywane są z wielu różnych materiałów, choć wciąż najczęściej jest to żelazo lub jego stopy. Domieszka substancji niemetalicznych znacząco obniża przewodnictwo materiału oraz zmniejsza poziom powstających w rdzeniu prądów wirowych i związanych z tym strat energii.

Rdzenie proszkowe wykorzystywane są powszechnie w zastosowaniach wymagających nietypowych kształtów, ponieważ ich proces produkcyjny pozwala na swobodę w formowaniu rdzenia. Dobrze sprawdzają się w pracy ze średnimi częstotliwościami, sięgającymi dziesiątek kHz. Jedną z ich istotnych cech jest zależność wartości przenikalności magnetycznej od składowej stałej natężenia pola magnetycznego – przenikalność maleje wraz ze wzrostem natężenia pola.

Zaletą rdzeni proszkowych jest duża wartość indukcji nasycenia, sięgająca ok. 1,5 T. Pozwala to na konstruowanie elementów przeznaczonych do pracy w układach większej mocy niż w przypadku rdzeni ferrytowych, umożliwia też redukcję liczby zwojów oraz zmniejszenie rozmiarów komponentów. Konstruowaniu elementów dużej mocy sprzyja też duża wartość temperatury Curie (400–700°C).

W rdzeniach proszkowych proces nasycenia rdzenia przebiega całkiem odmiennie niż w przypadku rdzeni ferrytowych – ma on charakter stopniowy, nie zaś skokowy. Rdzenie ferrytowe po osiągnięciu określonego natężenia pola magnetycznego (indukcja nasycenia, wywołana przez przepływ tzw. prądu nasycenia) gwałtownie obniżają swoją indukcyjność. Nawet niewielki wzrost natężenia prądu powyżej wartości prądu nasycenia powoduje duży spadek indukcyjności. W przypadku rdzeni proszkowych zależność indukcyjności od natężenia prądu płynącego w uzwojeniu jest zbliżona do liniowej, bez wyraźnego punktu krytycznego. Rdzenie proszkowe nie potrzebują również szczeliny powietrznej, powszechnej w przypadku konstrukcji ferrytowych, co pozwala na zmniejszenie poziomu strat energii w rdzeniu.

Rdzenie amorficzne

W latach 60. ubiegłego wieku odkryto ciekawą właściwość niektórych stopów metali – mianowicie jeśli zostaną one stopione w odpowiednio wysokiej temperaturze, następnie zaś błyskawicznie schłodzone, to podczas procesu krzepnięcia przybierają strukturę niekrystaliczną. Materiały takie określa się mianem szkieł metalicznych lub metali amorficznych.

Niektóre z tych stopów mają interesujące właściwości magnetyczne. Są to związki ze znaczącym udziałem (ok. 80%) metali takich jak żelazo, nikiel lub kobalt, domieszkowane m.in. krzemem, węglem czy glinem. Materiały te wykazują się dobrymi właściwościami mechanicznymi – twardością oraz odpornością na uszkodzenia. Wykonane z nich rdzenie mają dużą indukcję nasycenia (1,5‒2 T), czyli większą niż proszkowe. Inne własności to niska temperatura Curie (ok. 300°C) oraz kiepska stabilność temperaturowa – wraz ze wzrostem temperatury pogarszają się ich właściwości, m.in. maleje wartość indukcji nasycenia.

Do zalet zaliczyć można dużą przenikalność magnetyczną oraz szeroki zakres częstotliwości pracy. Większość rdzeni tego typu pracuje w zakresie do 250 kHz, choć niektóre stopy amorficzne pozwalają nawet na 10 MHz.

Stopy amorficzne produkowane są zazwyczaj w formie bardzo cienkich arkuszy blachy, o grubości rzędu od kilku do kilkudziesięciu μm, co pozwala na zmniejszenie strat energii. Mały rozmiar arkuszy znacząco jednak utrudnia formowanie z nich rdzeni o dużych rozmiarach, przez co w praktyce najczęściej wykorzystywane są do konstrukcji rdzeni zwijanych. Ze względu na cenę oraz właściwości magnetyczne, rdzenie ze szkieł metalicznych stanowią atrakcyjną alternatywę dla konstrukcji żelazo-krzemowych oraz proszkowych.

Stopy nanokrystaliczne

Stopy nanokrystaliczne to materiały mające strukturę drobnokrystaliczną, o rozmiarach nieprzekraczających 100 nm. Mogą być wykonywane z różnych stopów i kombinacji pierwiastków, do najpowszechniej wykorzystywanych zalicza się finemet (stop żelaza, krzemu, boru, niobu i miedzi), nanoperm (stop żelaza, cyrkonu i boru), hitperm (stop żelaza, kobaltu, miedzi i cyrkonu) oraz nanomet (stop żelaza, krzemu, boru, fosforu i miedzi).

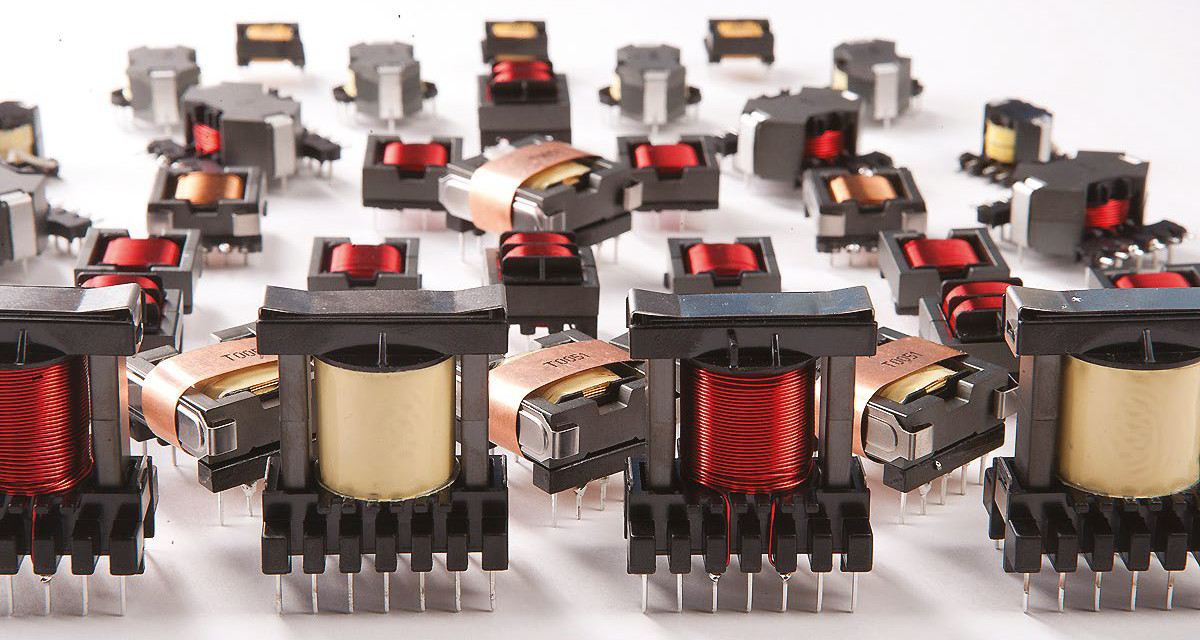

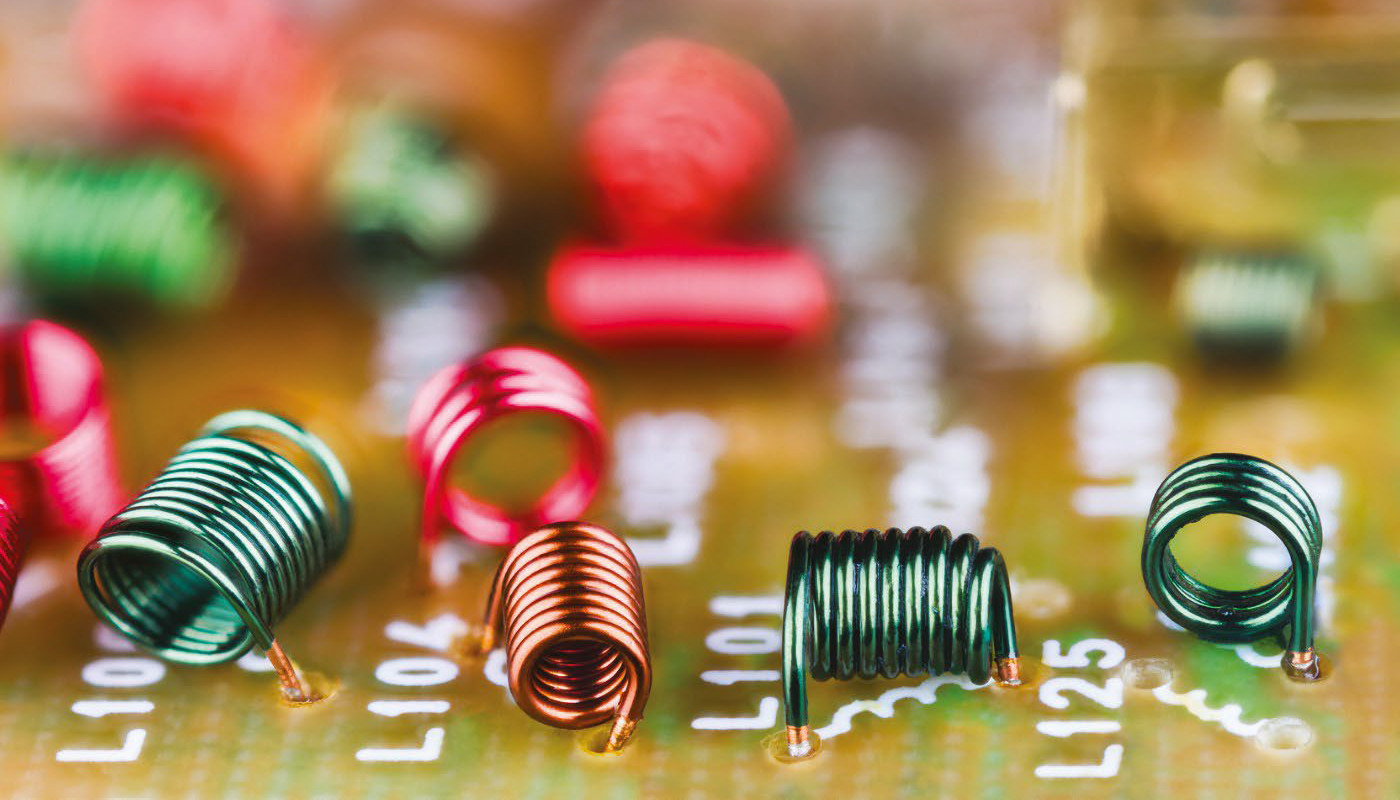

Elementy indukcyjne

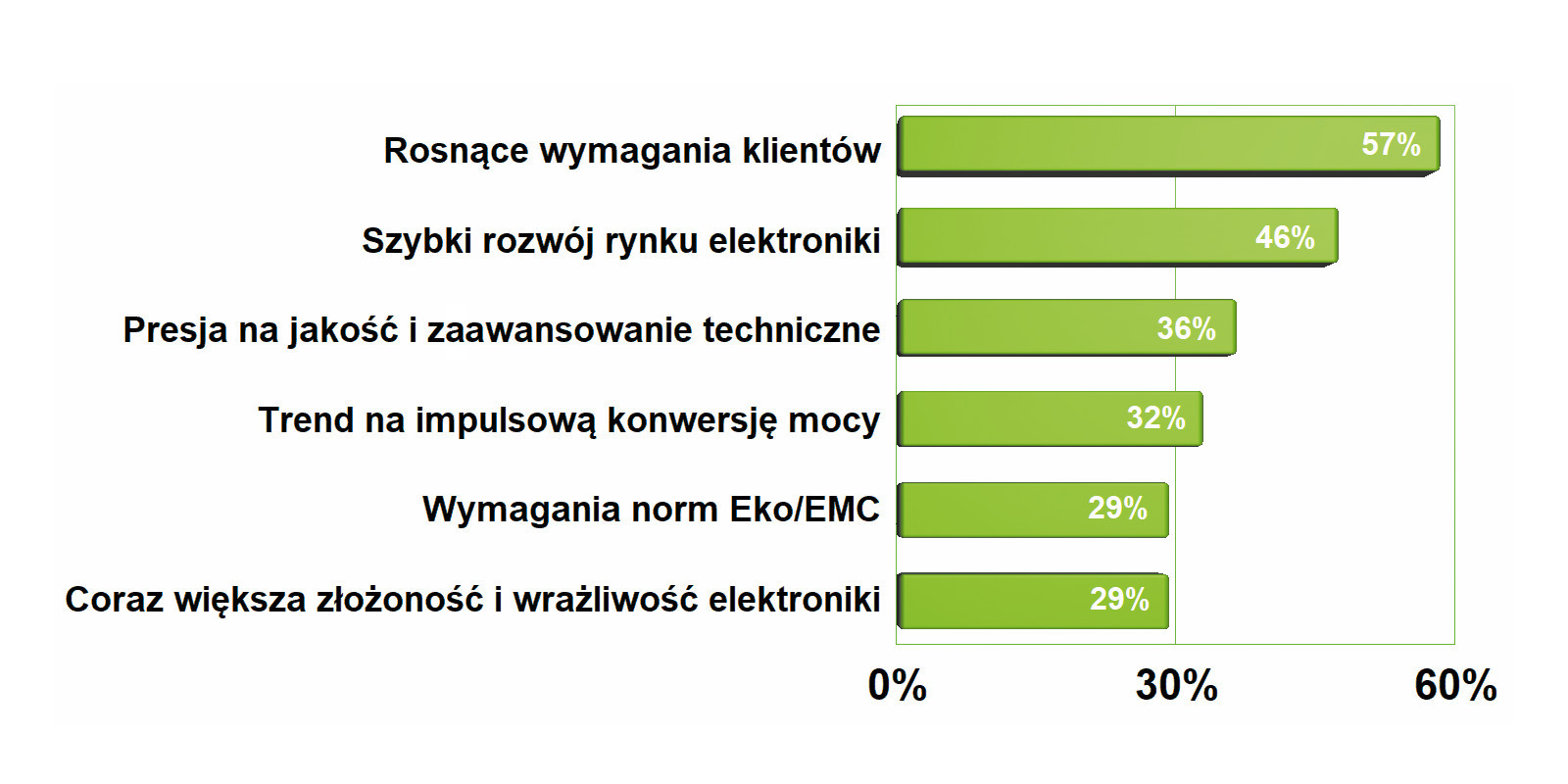

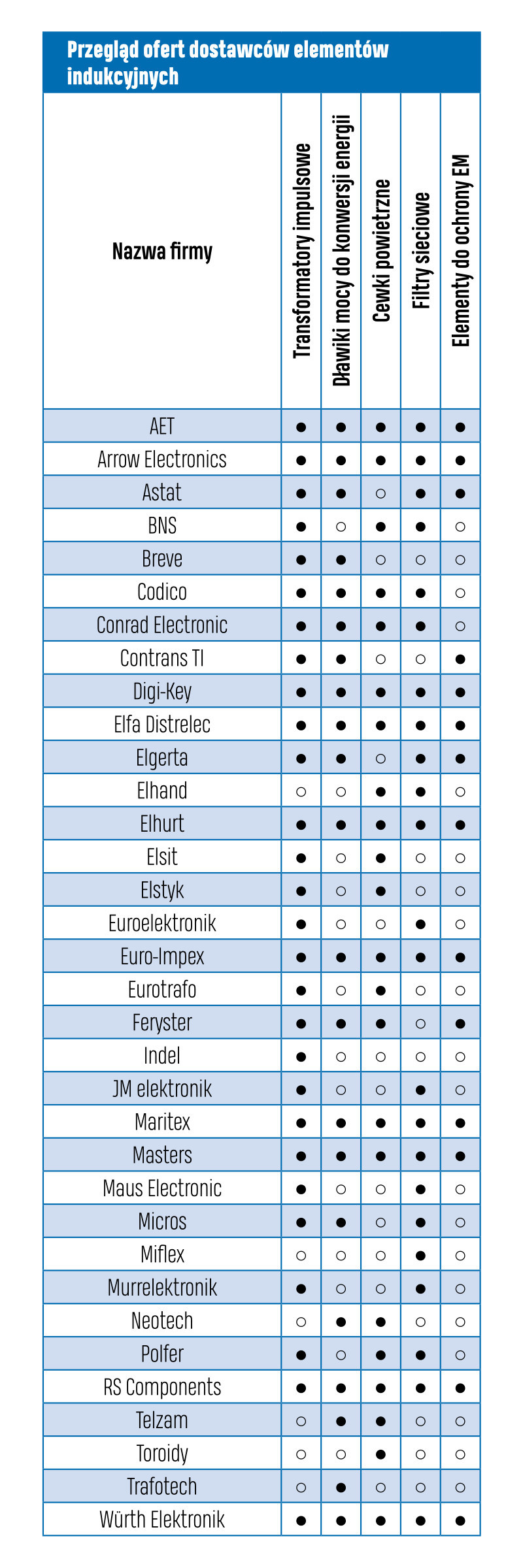

Elementy indukcyjne są kluczowym komponentem w impulsowych układach konwersji energii elektrycznej, niezbędnym składnikiem filtrów i systemów ochrony przed zakłóceniami, a także tym, co zapewnia użytkownikom sprzętu elektronicznego bezpieczeństwo oraz ochronę przed porażeniem. Komponenty te decydują o sprawności zasilaczy, wielkości, wadze urządzeń, wydajności i ogólnie pojętej jakości. Są one kluczowym podzespołem dla rynku zasilania, elektroniki przenośnej, oświetlenia LED-owego.

Cechą rynku elementów indukcyjnych jest bardzo szeroki asortyment produktów katalogowych. Z jednej strony jest to zjawisko pozytywne, bo pozwala dobrać do aplikacji najlepiej pasujący element przy minimalnym kompromisie w parametrach. Z drugiej strony na te mniej popularne typy cewek i dławików trzeba często długo czekać, bo możliwości ich magazynowania u dystrybutorów są niestety ograniczone. Dlatego w praktyce wybór produktu jest wielki tylko teoretycznie, bo ogranicza się do tego, co jest w magazynach, a nie w katalogu. Szczęśliwie ten problem dotyczy głównie małych elementów, tych do montażu na PCB, które potrzebne są w dużych ilościach. Wersje do układów dużej mocy z reguły produkowane są na zamówienie, ale granice między produkcją katalogową wydają się płynne i wszystko zależy od konkretnego przypadku.

Elementy na zamówienie

Można powiedzieć, że im bardziej wymagająca aplikacja, im większa moc, poziomy napięć i prądów, tym większe znaczenie dla zapewnienia jest dużej funkcjonalności mają elementy indukcyjne produkowane według indywidualnej specyfikacji. Zapewniają one najlepsze parametry użytkowe, dobre dopasowanie do warunków montażu w obudowie lub też do wymagań elektrycznych oraz są w najmniejszym stopniu jakimś kompromisem. Z takich przyczyn udział produkcji na zamówienie w krajowej branży podzespołów indukcyjnych jest i zawsze był bardzo duży. Dla większości krajowych firm produkcyjnych jest to wręcz podstawa aktywności biznesowej.

Produkowanie elementów indukcyjnych na zamówienie klientów, a więc wg indywidualnie przygotowanej specyfikacji, ułatwia też utrzymanie niezbędnych inwestycji w park maszynowy. Standardowe elementy takie jak dławiki do montażu na płytkach drukowanych są produkowane na wydajnych i zaawansowanych automatach. Takie urządzenia są drogie i z punktu widzenia krajowych przedsiębiorstw za bardzo wydajne, a na skutek dużej konkurencji marże przy sprzedaży są małe. Produkcja na zamówienie opiera się na znacznie mniejszych seriach, wyrobach niestandardowych, a więc wymaga maszyn o mniejszym stopniu autonomiczności, takich, które wspierają działanie ludzi. Od strony inwestycyjnej jest to rozwiązanie tańsze i znajduje się w zasięgu inwestycyjnym także mniejszych firm, bo jak wiadomo, ceny wszystkich urządzeń produkcyjnych są bardzo duże.

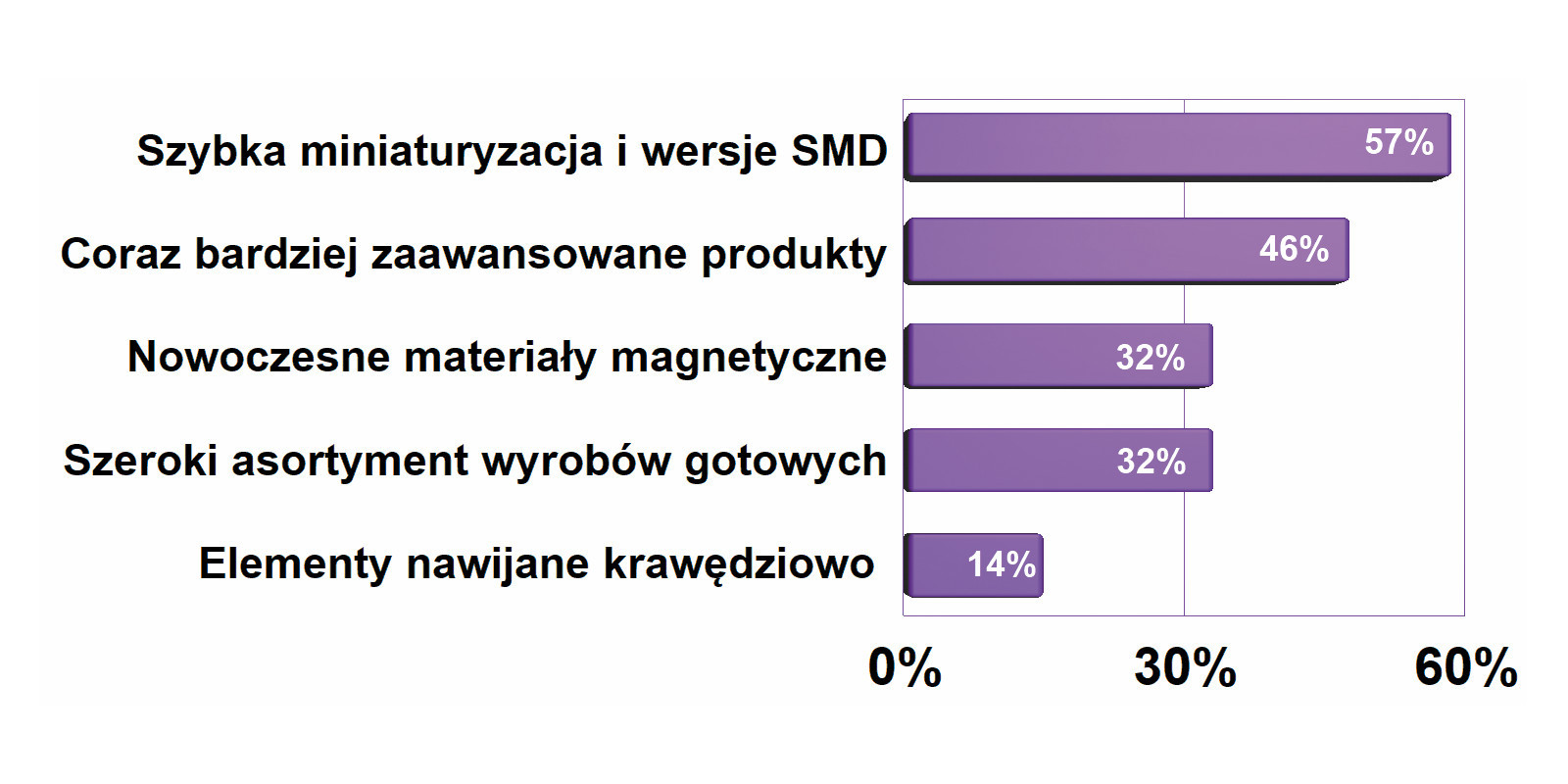

Nowości w zakresie elementów indukcyjnych

Nowości w elementach indukcyjnych są bardzo liczne, ale niestety także mało widoczne. Ogólnie są to innowacje w zakresie materiałów magnetycznych, kształtów rdzeni, a więc pośrednio sposobu wykonania uzwojenia oraz używanych materiałów nawojowych i typów kontaktów elektrycznych. W dalszej kolejności są to zaawansowane materiały izolacyjne, skomplikowane procesy impregnacji oraz montażu takich komponentów.

Nowe materiały magnetyczne zapewniają pracę przy dość dużych częstotliwościach kluczowania, mają małe straty związane z przemagnesowaniem, wysoką indukcję nasycenia i podobne właściwości. Eksperymenty prowadzone są w wielu kierunkach także w stronę rozwiązań hybrydowych, a więc bazujących na ferrytach łączonych ze sproszkowanym metalem, po to, aby zapewnić dużą indukcję nasycenia, małe straty na histerezie, a także aby uzyskać łagodną charakterystykę zapobiegającą gwałtownemu spadkowi indukcyjności przy zbliżeniu się z wartością prądu do nasycenia. Można też powiedzieć, że celem zmian w nowościach jest maksymalizacja energii, jaką można zgromadzić w danej objętości materiału magnetycznego lub uzyskanie najkorzystniejszego stosunku ceny do parametrów.

Kształt materiału magnetycznego, czyli kształtka, decyduje o możliwości nawinięcia uzwojenia o określonej objętości, możliwości integracji w obudowie a także o indukcyjności rozproszenia. W tym obszarze też sporo się dzieje, a liczba ofertowych wariacji na temat kształtów takich jak "R" lub "E" stale się zwiększa.

Druty nawojowe coraz częściej są wielokrotnie izolowane (nawet czterokrotnie), co ułatwia zapewnienie wysokiej jakości izolacji elektrycznej. Dzięki takim drutom większość zasilaczy powszechnego użytku jest dzisiaj wykonana w tzw. II klasie izolacji i nie wymaga uziemiania. Coraz częściej transformatory nawijane są licami oraz także taśmą miedzianą (drutem o przekroju prostokątnym), który pozwala lepiej wypełnić okno nawojowe.

Nowe materiały izolacyjne dają możliwość ciasnego upakowania uzwojenia i jednoczesnego zachowania bezpieczeństwa. Są one ważne, bo z roku na rok układy impulsowe pracują przy wyższych napięciach wejściowych.

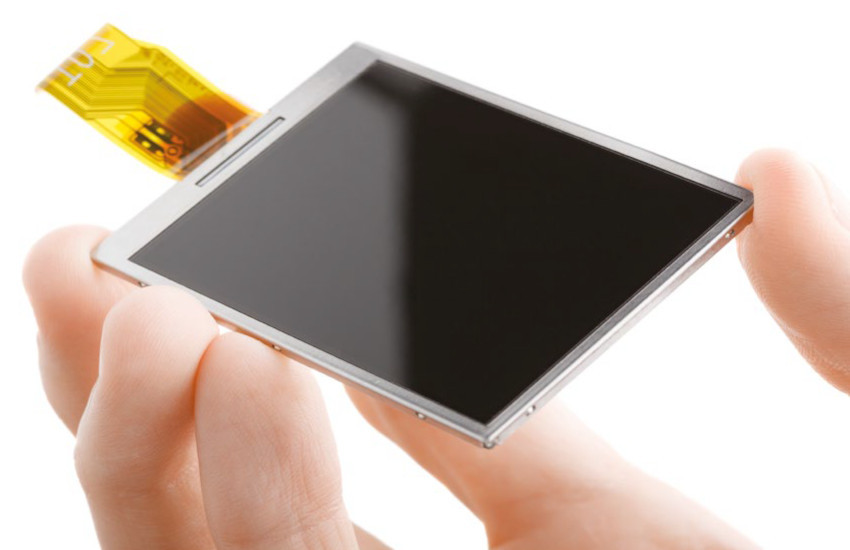

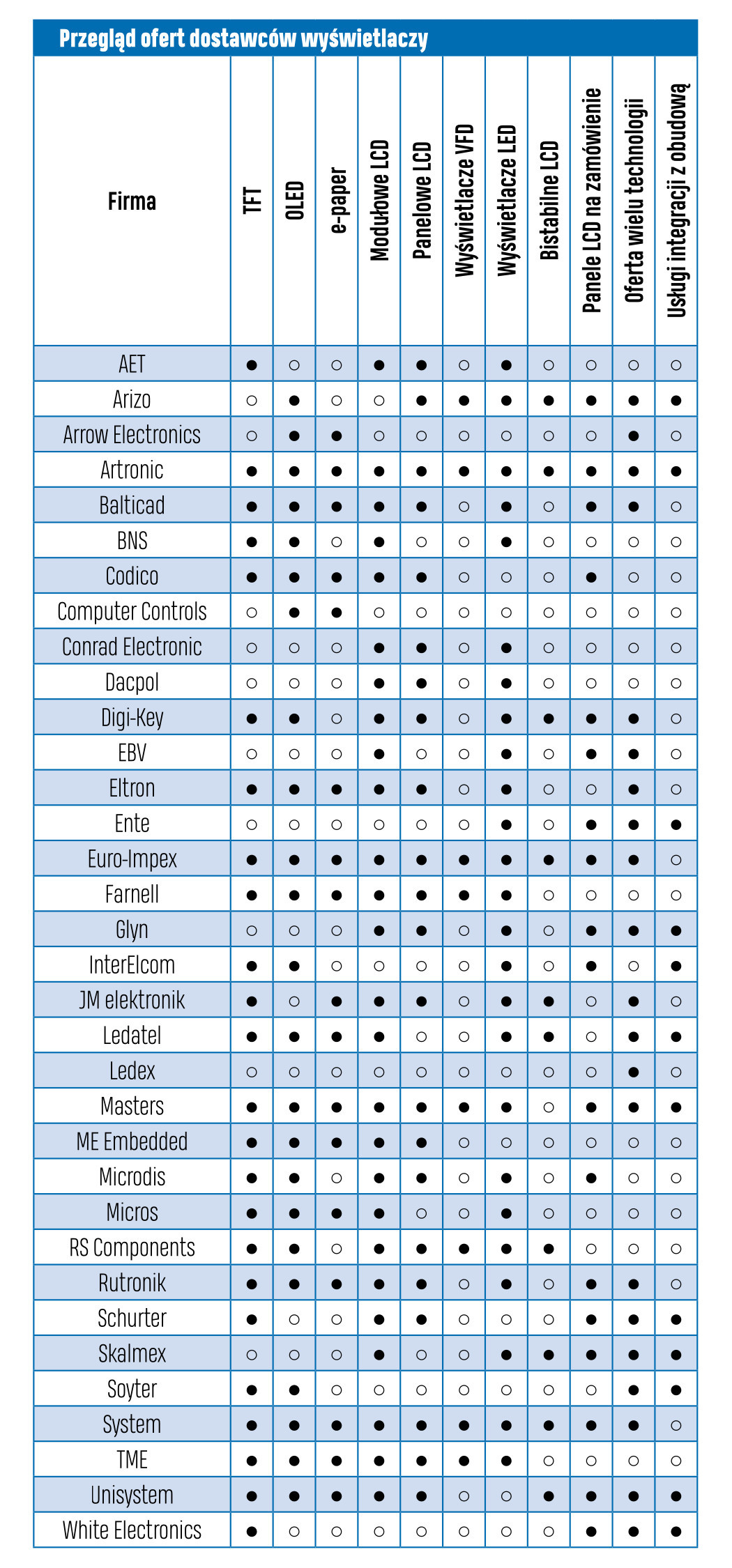

Wyświetlacze do urządzeń elektronicznych

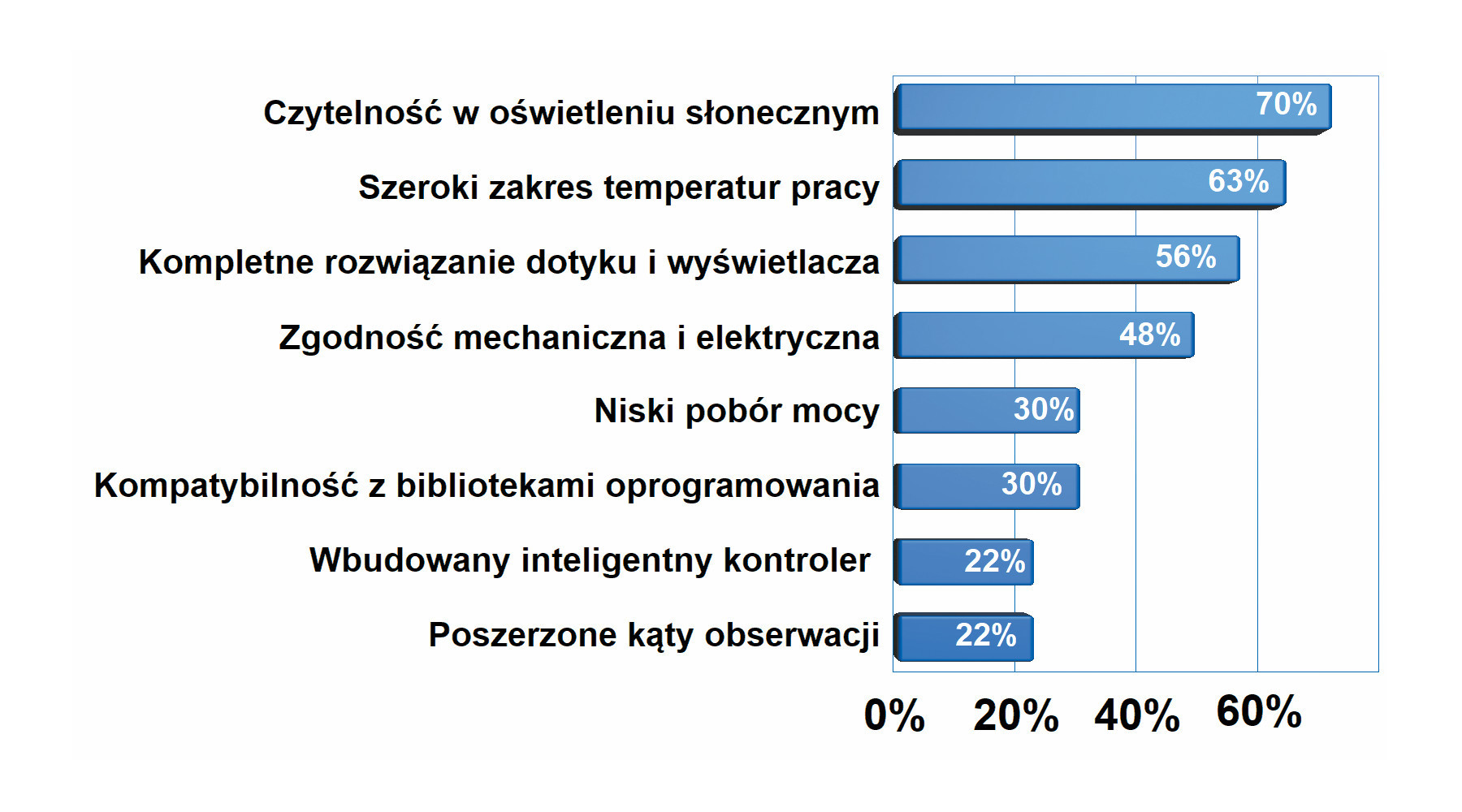

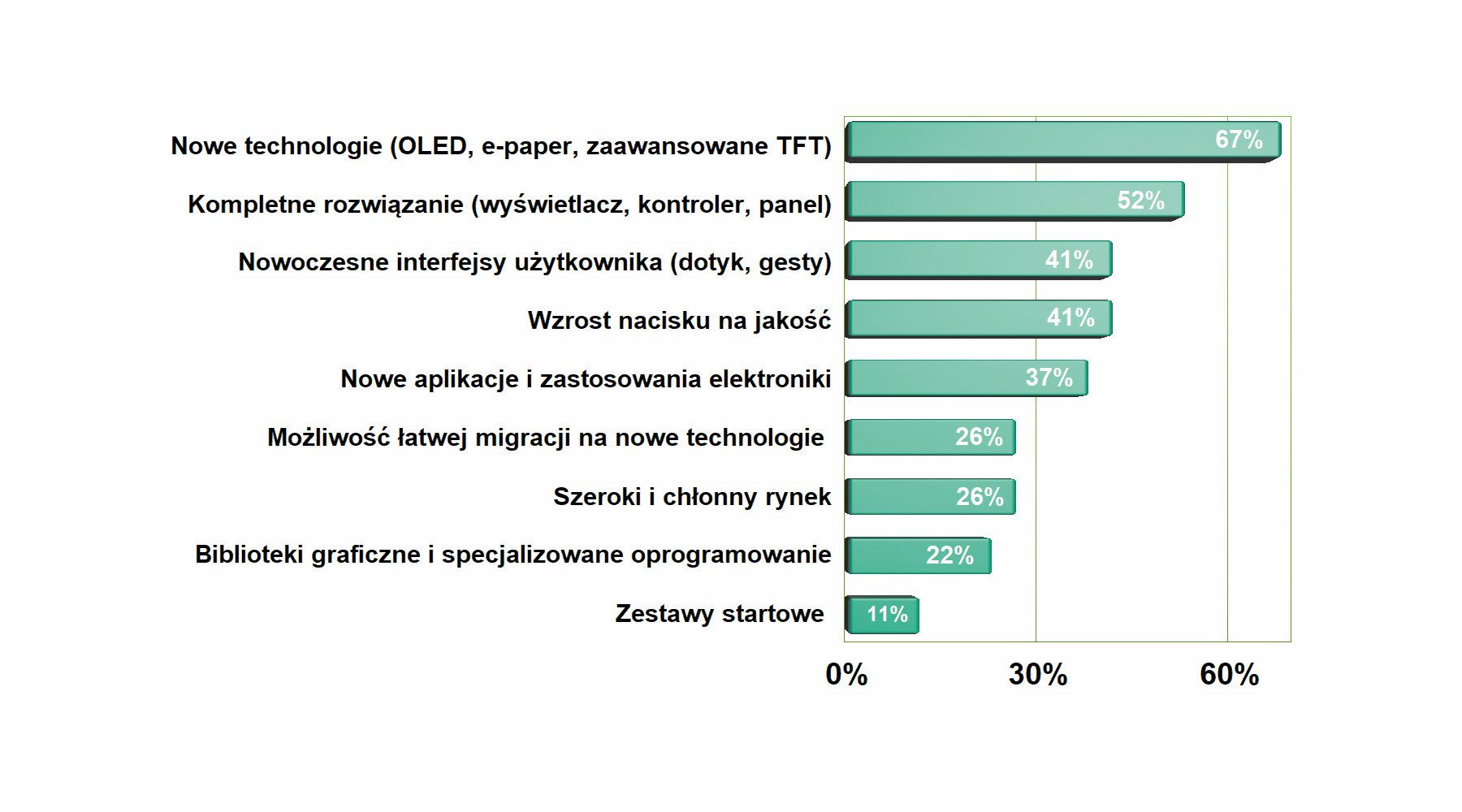

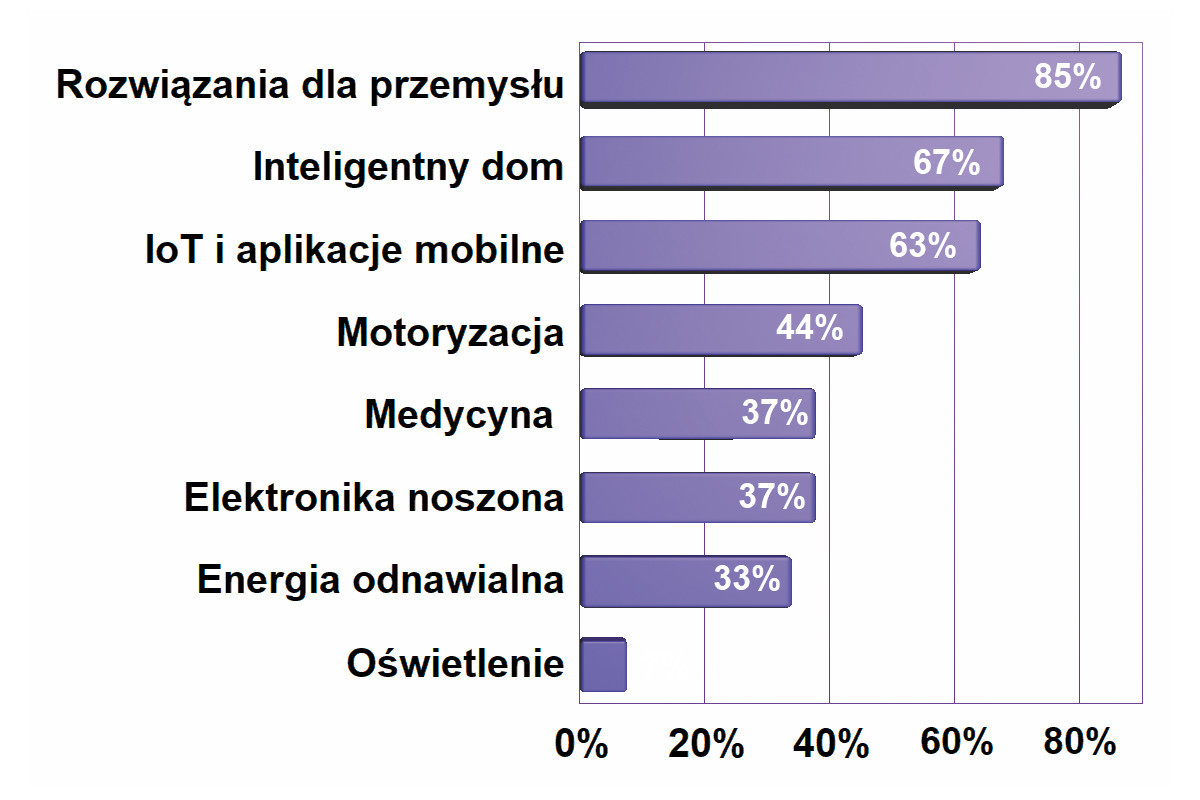

Trudno przekonująco stwierdzić, czy szeroki dostępny asortyment wyświetlaczy kreuje nowe aplikacje, czy też rozwój elektroniki i ekspansja na nowe rynki powodują, że potrzeba ich coraz więcej. W sumie sprowadza się to do tego samego: mamy coraz większy asortyment jednostek wyświetlaczy, są one coraz tańsze, a więc dostępniejsze, mają coraz lepsze parametry w zakresie wizualizacji danych oraz odporności mechanicznej i środowiskowej. Graficzny interfejs użytkownika z ekranem dotykowym, znany z urządzeń mobilnych, jest też wytrychem otwierającym drzwi do wielu nowych branż, np. inteligentnego budynku, systemów bezpieczeństwa i ochrony mienia, branży reklamy i oczywiście do przemysłu, czyli sektora w Polsce najbardziej wartościowego.

Coraz więcej wyświetlaczy trafia do aplikacji, gdzie mały pobór mocy jest kluczowy

Mały pobór mocy jest jednym z najbardziej istotnych trendów zmieniających współczesną elektronikę, a w aplikacjach mobilnych można go postrzegać jako czynnik kluczowy dla funkcjonalności. Dla rynku wyświetlaczy ograniczanie poboru mocy jest tym samym zagadnieniem bardzo istotnym, bo w większości urządzeń wyświetlacz jest obowiązkowy. Bez niego można się dzisiaj obyć praktycznie tylko w takich aplikacjach, gdzie realizowane funkcje nie wymagają zapewnienia interakcji z użytkownikiem lub takich, gdzie można zapewnić obsługę z wykorzystaniem komputera/ urządzenia mobilnego lub przez sieć. Dodatkowo rynek Internetu Rzeczy zaczął się szybko rozwijać, przez co zagadnienia energetyczne jeszcze bardziej zyskują na znaczeniu. Innymi słowy, nie ma wyjścia – wyświetlacz też musi pobierać małą moc i wiele zmian technologicznych, które można obserwować w ostatnich latach, jest temu podporządkowanych.

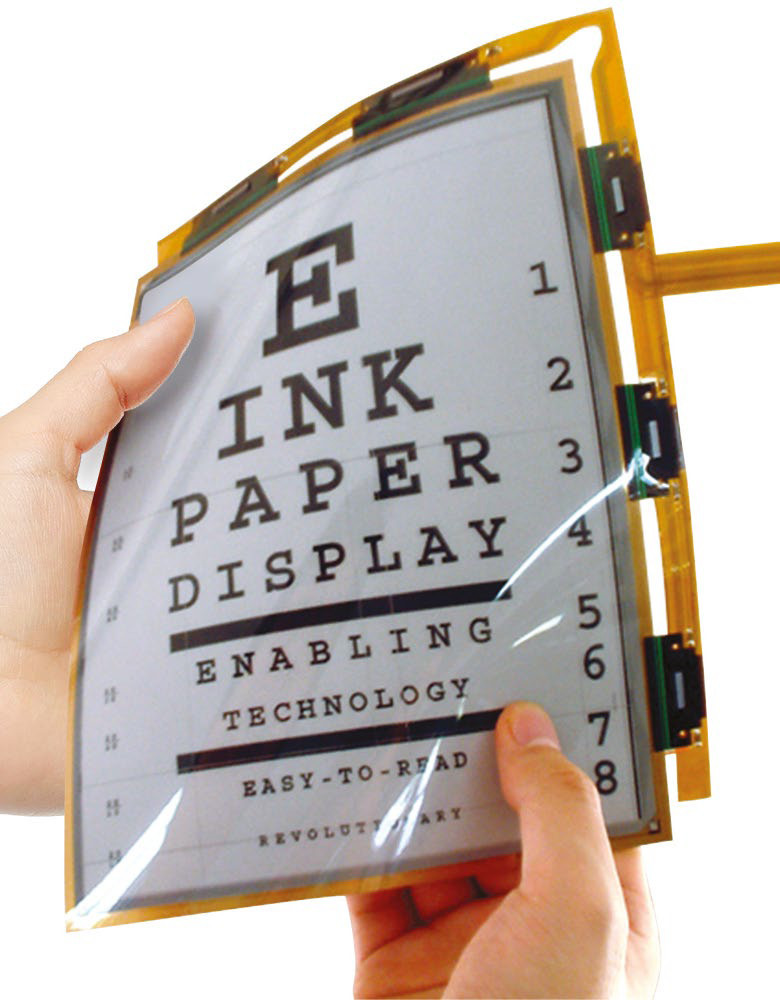

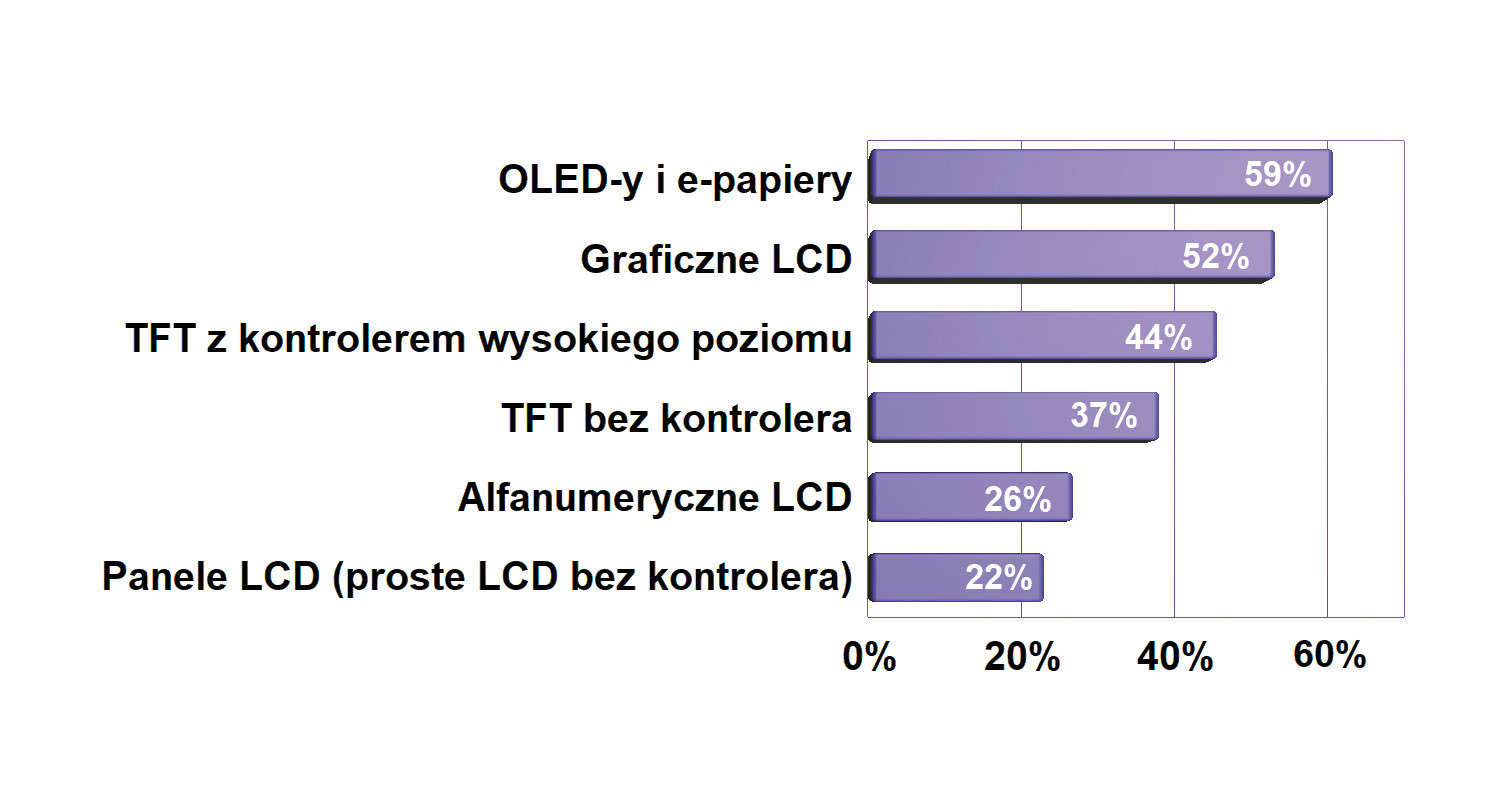

Technologie takie jak OLED, e-paper szybko zyskują popularność też na skutek tego trendu, a dzięki temu ich ceny się obniżają. Podstawowe wersje takich wyświetlaczy na tyle potaniały, że wybór OLED- a przestał mieć znamiona jakiegokolwiek luksusu. Skoro opłacalne jest produkowanie elektronicznych metek wyświetlających ceny w supermarketach bazujących na wyświetlaczach e-papierowych, to znaczy, że bariera cenowa przestała istnieć. Poza wymienionymi dwoma typami producenci proponują jeszcze wersje bistabilne, które uzupełniają elektroniczny papier tam, gdzie ma on jeszcze jakieś niedoskonałości.

Wyświetlacze z kontrolerem wysokiego poziomu

Współczesny wyświetlacz to oczywiście jednostka graficzna, pozwalająca na wyświetlanie kolorów w pełnej palecie i bardzo często współpracująca z panelem dotykowym. Za proces wyświetlania informacji oraz realizację interfejsu elektrycznego do aplikacji odpowiada w niej specjalizowany sterownik, ale bez względu na użyty układ trzeba opracować wyświetlaną grafikę, strukturę interfejsu oraz powiązać wyświetlaną treść z dotykanymi na panelu punktami. Realizacja interfejsu graficznego dla aplikacji nie jest rzeczą banalną, zwłaszcza gdy struktura menu jest rozbudowana, a pikseli do obsłużenia jest dużo. Skala trudności pogłębia się, gdy treść ma być animowana: paski postępu mają się poruszać, przyciski w czasie dotykania mają wizualnie sygnalizować reakcje, a wyświetlane treści nie są statyczne, tylko zależne od kontekstu.

Tworzenie grafiki, rysowanie elementów interfejsu takich jak przyciski, okienka, a także pisanie tekstu w trybie graficznym wymaga posiadania oprogramowania pozwalającego na rastrowanie takich elementów, wykreślanie figur i dokonywanie podstawowych operacji jak na przykład wypełnianie obszaru kolorem. W takich przypadkach cenną pomocą są biblioteki graficzne, dzięki którym nie trzeba się martwić o sterowanie poszczególnymi pikselami, skalowanie czcionek wektorowych, wybieranie tła i dziesiątki innych operacji. Na rynku jest wiele takich produktów, zarówno darmowych, jak i komercyjnych. Cechą wspólną jest to, że zwykle współpracują one z popularnymi modelami wyświetlaczy lub są dopasowane do określonej rodziny mikrokontrolerów.

Tworzenie grafiki na piechotę, a więc bez oprogramowania narzędziowego nie jest ani łatwe, ani przyjemne, a poza tym nie ma na taką "zabawę" czasu. W obszarze wyświetlaczy rozwój technologii jest dzisiaj szybki, a liczba nowych produktów, wersji kontrolerów i opcji wymagających uwagi ze strony projektantów jest bardzo duża. Standardowa biblioteka procedur pozwala opanować tę zmienność i przestać się skupiać na szczegółach. Oznacza to, że dostępność oprogramowania wspierającego tworzenie grafiki, nowoczesnego GUI i generalnie ułatwiającego komunikację z użytkownikiem staje się jednym z bardziej istotnych zagadnień i narzędziem wspierającym sprzedaż.

Z pewnością to powiązanie z popularnym hardware oraz ogromny nakład pracy, jaki wiąże się z przygotowaniem obsługi wyświetlacza w aplikacji, ma dla rynku działanie regresywne. Zmiany są pracochłonne i kosztowne, stąd wybór wyświetlacza do urządzenia, który ma zostać oprogramowany samodzielnie jest zadaniem niełatwym i wymagającym analizy wielu danych, w tym żywotności konstrukcji. Z tej też przyczyny na rynku wyświetlaczy kompatybilność mechaniczna, pinowa oraz związana ze sterownikiem jest zagadnieniem, którym poświęca się wiele uwagi.

W sytuacji, gdy skala projektu jest mała, pisanie oprogramowania pod konkretny wyświetlacz może zupełnie stracić sens i wówczas lepiej sięgnąć po wyświetlacze zintegrowane z kontrolerem wysokiego poziomu. Są to gotowe specjalizowane komputery, zawierające wyświetlacz, panel dotykowy, sterownik z oprogramowaniem, który realizuje funkcje interfejsu użytkownika. Firmware takich produktów pozwala na prostą i szybką realizację.

Są to rozwiązania idealnie pasujące do sytuacji, gdy serie produktów są małe, menu skomplikowane, a rodzina produktów zawiera wiele typów, do których trzeba przygotować oddzielną funkcjonalność.

Wersje dopasowane do aplikacji i integracja z obudową

Producenci elektroniki mają dzisiaj znacznie większe możliwości dobrania wyświetlacza do projektowanego urządzenia, tak aby pasował idealnie pod względem elektrycznym, mechanicznym i funkcjonalnym. Potocznie nazywa się to kastomizacją (customizacją), co może brzmi okropnie, ale niestety na razie tak być musi, bo nie mamy w języku polskim jednowyrazowego terminu określającego dopasowanie produktu do specyficznych wymagań klienta.

Kiedyś kastomizacja była dostępna dla dużych firm, które były w stanie wyłożyć spore sumy pieniędzy na bezzwrotne koszty przygotowania zamówienia o indywidualnych cechach i oczywiście kupić też dużą partię. Dzisiaj próg wejścia jest znacznie niższy, a ponadto część prac biorą na siebie dystrybutorzy. Bezzwrotne koszty takich modyfikacji z roku na rok maleją i tym samym usługi stają się coraz bardziej przystępne. Polegają one na zamontowaniu wyświetlacza w obudowie w przygotowanym oknie, sklejeniu ekranu z panelem za pomocą kleju przezroczystego w warunkach wykluczających pozostawienie brudu, przyklejeniu ekranu płyty frontowej i podobne. Częściowe lub pełne dopasowanie do projektu klienta wyświetlaczy TFT, OLED oraz paneli dotykowych polega dostosowaniu kształtu, rozmiaru, koloru oraz innych parametrów technicznych.

Usługi dotyczą też obudów, a więc montażu wyświetlacza w przygotowanym oknie. W przypadku wersji z dotykiem montaż ekranu jest bardzo istotny, bo musi zapewnić trwałość przy naciskaniu. Małe obudowy, trzymane w ręku są podatne na wyginanie i montaż musi kompensować niewielkie przemieszczenia.

Nowe technologie stają się coraz bardziej dostępne

Wzrost zainteresowania e-papierem i OLED widoczny w ostatnich czasach to proces wynikający z tego, że na rynku elektroniki większe znaczenie mają aplikacje zasilane z baterii, a więc zagadnienia niskiego poboru mocy wysuwają się na pierwszy plan. Druga przyczyna jest taka, że ceny tych produktów spadły i wyświetlacze te przestały być luksusem. Obie te technologie są znane od dwóch dekad, co oznacza, że właściwości, technologia, maszyny do produkcji dostały dopracowane, a wady "wieku niemowlęcego", np. związane z małą trwałością, już dzisiaj nie istnieją.

Obecnie bez problemu można kupić wyświetlacze tego typu o małych przekątnych, a więc takie, które najczęściej są używane w elektronice, zarówno jako elementy graficzne, jak i zamienniki alfanumeryczne dla typowych wersji modułowych. Podobne zjawiska można zaobserwować w zakresie wyświetlaczy typu e-papier, a więc w jednostkach, które wykorzystywane są w książkach elektronicznych.

Wersje przemysłowe i doskonalsze technologie

Na rynku jest coraz więcej typowych wyświetlaczy, np. TFT-LCD, ale w wersjach ukierunkowanych na aplikacje przemysłowe i profesjonalne. Mają one szerszy zakres dopuszczalnej temperatury pracy, większą jasność ekranu i trwałość, co pozwala używać ich przez wiele lat. W przypadku takich rozwiązań istotna jest też długoterminowa dostępność produktu (longevity), gwarantująca to, że produkt będzie dostępny w sprzedaży przez długi czas, np. 10 lat. Dla wersji konsumenckich czas ten jest znacznie krótszy, a często w ogóle niedefiniowany w specyfikacjach.

Przez wiele lat oferta rynku w zakresie wyświetlaczy przemysłowych była wyraźnie uboższa od tej dostępnej dla rynku konsumenckiego. Jednostek przemysłowych było w ofertach niewiele, zwłaszcza takich bardziej poszukiwanych: o większych rozdzielczościach, z matrycami IPS o szerokim zakresie temperatur pracy, o szerokim kącie obserwacji itd. Utrudniało to aplikację, degradowało tempo rozwoju rynku, a także tworzyło często patologie takie, że komponenty konsumenckie trafiały do urządzeń przemysłowych i aby działały poprawnie, były obudowywane dodatkowymi systemami, np. chłodzenia i podgrzewania.

Producenci wyświetlaczy w mniejszym stopniu angażowali się w rozwój takich jednostek dlatego, że wymagania rynku przemysłowego związane z koniecznością zapewnienia wieloletniej dostępności i niezmienności takich komponentów nie pasowały do strategii rozwoju opierającej się na rynku konsumenckim.

Wsparcie techniczne jest kluczowe

Znaczenie wsparcia technicznego w dystrybucji wyświetlaczy jest bardzo duże, bo są to produkty skomplikowane, w których jest wiele szczegółów i niuansów funkcjonalnych, a wybór optymalnego rozwiązania staje się niełatwy i czasochłonny, a przecież codziennym kłopotem współczesnego projektanta jest chroniczny brak czasu. Firmy oczekują, że dostawca, zanim sprzeda im produkt, skonsultuje wybór i przyspieszy pracę. W wyżyłowanych do granic projektach o powodzeniu decydują drobne szczegóły i mały pobór mocy jest dobrym przykładem obszaru, gdzie potrzeba konsultacji koncepcji i założeń z inżynierem wsparcia technicznego jest bardzo cenna. To samo dotyczy próbek, narzędzi, płytek startowych, oprogramowania.

Produkt optymalny od strony technicznej, a więc wybrany po przewertowaniu katalogów, też niekoniecznie musi być najlepszy do danej aplikacji, gdyż pewne produkty są popularne, szeroko dostępne i magazynowane, na inne trzeba czekać. To samo dotyczy cen, bowiem elementy produkowane przez wielu producentów są tańsze. Inny problem to ryzyko zakończenia produkcji. Użycie do nowego produktu wyświetlacza, który za niedługo wypadnie z oferty (przestanie być produkowany lub zostanie zastąpiony nową wersją), to wielkie ryzyko i koszty. Takie informacje są dostępne z dużym wyprzedzeniem u dystrybutorów, stąd wsparcie techniczne nie polega tylko na przekazaniu informacji technicznej, ale pokazaniu, które produkty są warte zainteresowania w danych aplikacjach i perspektywiczne (bezpieczne).

Wsparcie aplikacyjne obejmuje też coraz bardziej popularne gotowe do użycia płytki zawierające projekty referencyjne. Stanowią one przykłady do naśladowania, są demonstracją dobrych praktyk projektowych i dają szansę tego, aby na początku pracy nie popełnić drobnej, ale trudnej do znalezienia pomyłki. Liczne zestawy startowe, będące nierzadko kompletną platformą sprzętową dla aplikacji, plus dostępne oprogramowanie i biblioteki procedur w wielu przypadkach sprawiają, że nakład pracy wymaganej do obsługi wybranych popularnych modeli wyświetlaczy graficznych z panelem dotykowym jest porównywalny z tym, jaki kiedyś trzeba było poświęcić na obsługę prostych modułów znakowych z wbudowanym kontrolerem.

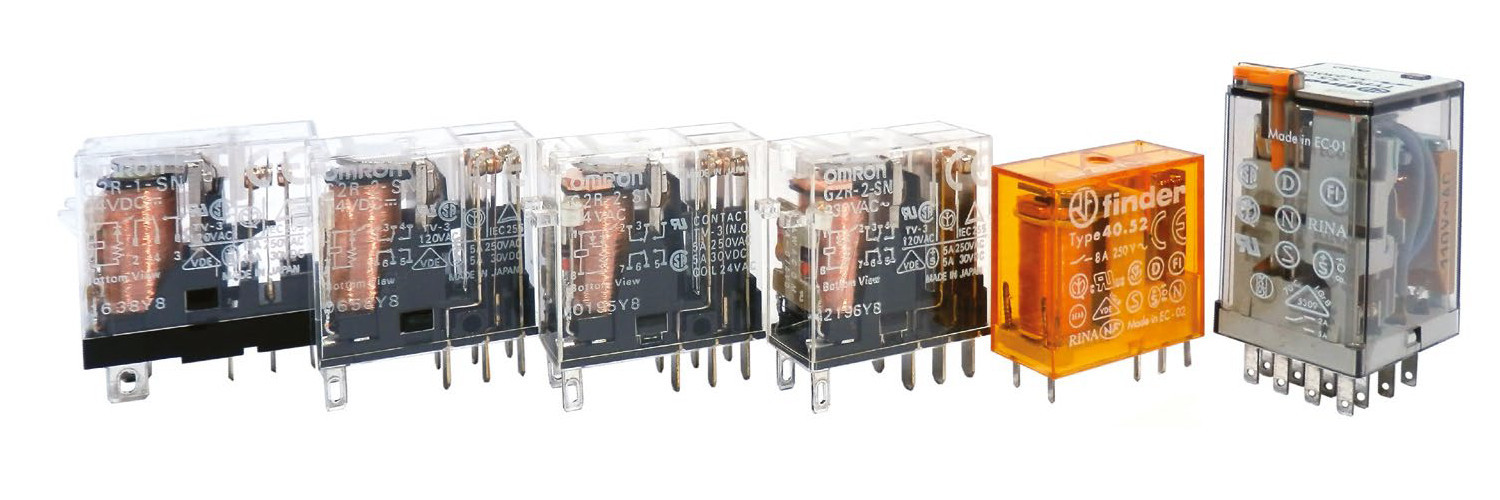

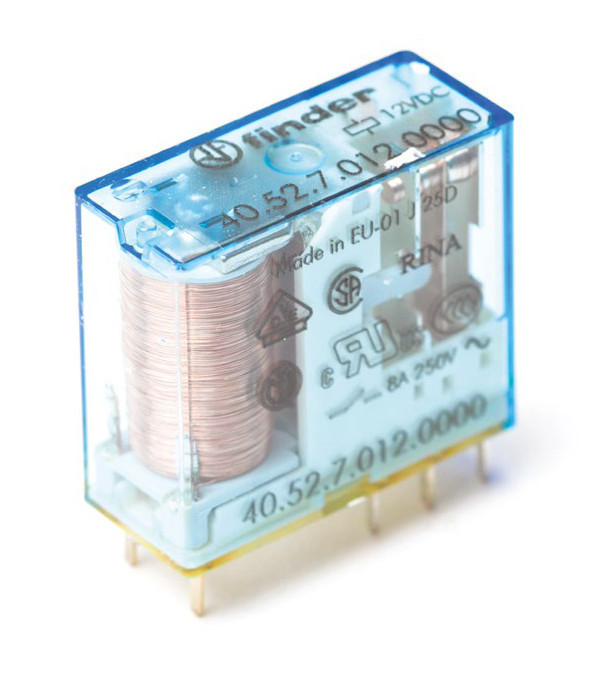

Przekaźniki elektromagnetyczne

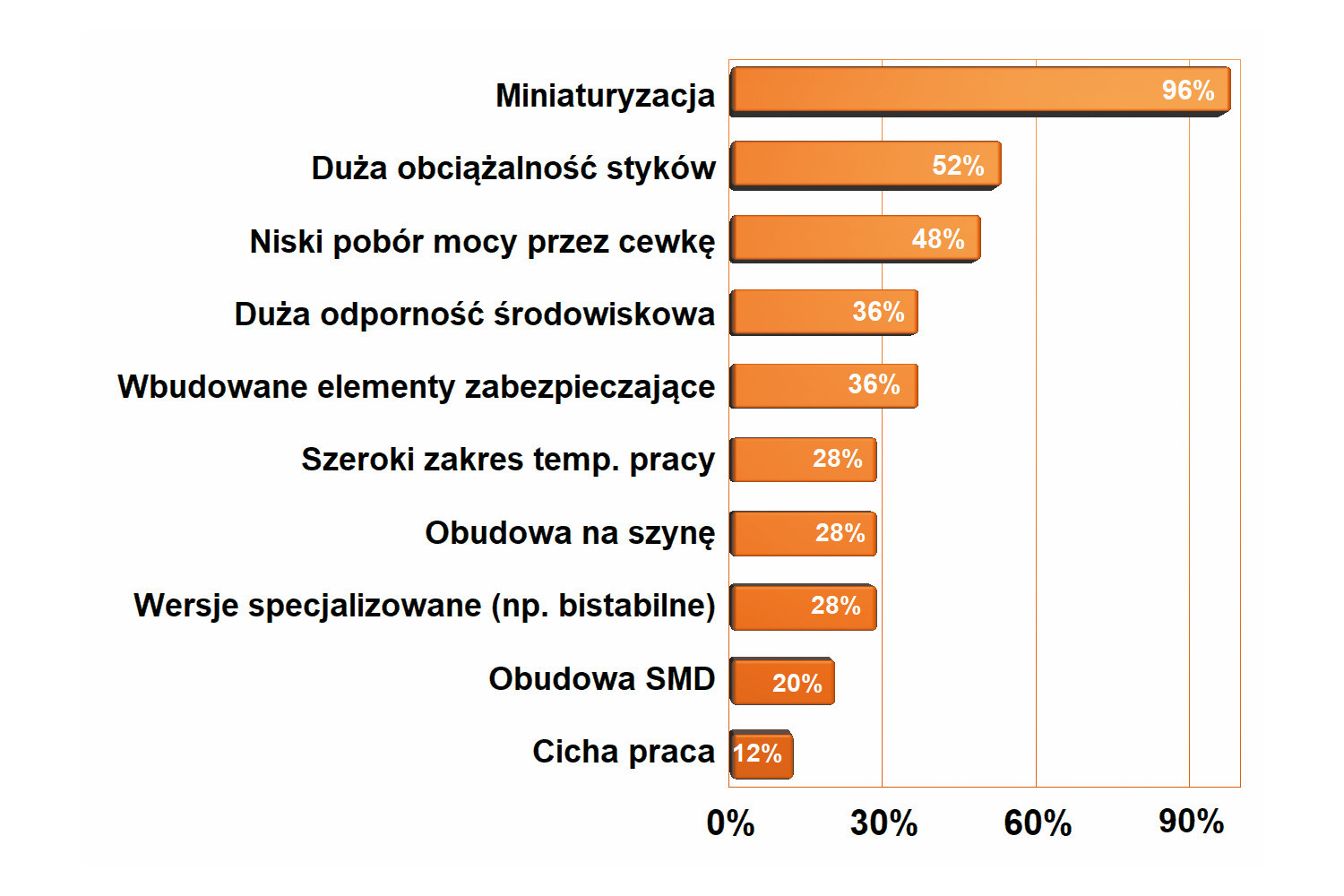

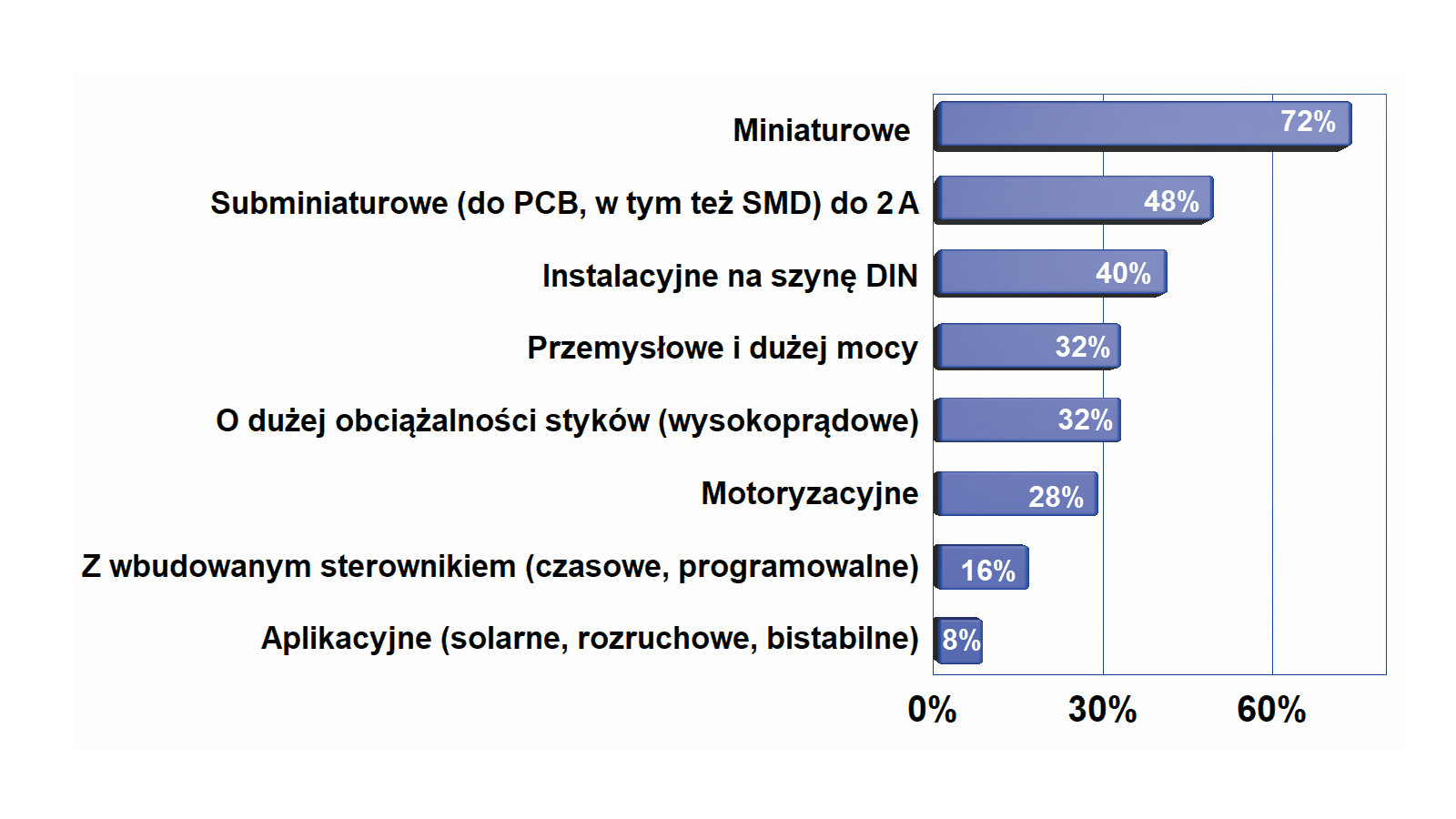

Współczesny przekaźnik elektromagnetyczny to miniaturowy element przełączający o dużej odporności elektrycznej i środowiskowej oraz szerokim spektrum aplikacyjnym. Zapewnia on wysoką funkcjonalność za niewielką cenę, przez co niezmiennie jest uznawany za produkt perspektywiczny, użyteczny, a nowe rozwiązania producentów w zakresie miniaturyzacji, wysokiej jakości wykonania, niskiego poboru mocy przez cewkę elektromagnesu sprawiają, że zawsze jest atrakcyjnym wyborem. Z każdą kolejną wersją elementy te ulegają licznym zmianom, gdyż na rynku jest wielu producentów zabiegających o klientów i proponujących lepsze wykonania.

Rynek i jego rozwój

Rozwój rynku przekaźników determinują głównie zastosowania przemysłowe, co wynika po prostu z tego, że niezmiennie od lat branża ta jest wiodącym odbiorcą tych komponentów, wykorzystując je w instalacjach, urządzeniach i maszynach oraz komponentach automatyki przemysłowej. Wiele krajowych firm produkuje i eksportuje urządzenia dla przemysłu, takie jak sterowniki, regulatory, urządzenia pomiarowe, styczniki, systemy bezpieczeństwa i nadzoru. Rośnie nieustannie skomplikowanie procesów wytwarzania, które wykorzystują coraz więcej urządzeń i sprzętu technicznego. W ramach inwestycji i modernizacji starszych zakładów i linii produkcyjnych kupowane są nowe maszyny i budowane do nich instalacje i systemy. Wiele dzisiaj się mówi o wdrażaniu inteligentnych rozwiązań produkcyjnych, koncepcji Przemysłu 4.0 i tym, że w warunkach krajowych firmy produkcyjne stawiają na jakość. Te procesy co do zasady wiążą się z użyciem coraz większej liczby urządzeń elektronicznych. W wielu z nich gdzieś jest zwykle jakiś przekaźnik.

Strumień sprzedaży dla przemysłu tworzą też elektronika profesjonalna, energoelektronika, motoryzacja, systemy alarmowe. Nie są to filary rynku odpowiedzialne za zbyt, ale z pewnością mające znaczenie. Niemniej rynek AGD wyraźnie stracił na znaczeniu, co jest skutkiem ekspansji przełączników elektronicznych i popularyzacji sterowania silnikami z wykorzystaniem falowników.

Rosnące wymagania jakościowe rozwijają rynek

W ostatniej dekadzie w technologii przekaźników zaszło sporo korzystnych zmian poprawiających jakość i trwałość tych elementów, które osiągnięto m.in. dzięki automatyzacji produkcji. W przypadku przekaźników elektromagnetycznych wymagania jakościowe mają bardzo duże znaczenie, gdyż elementy te trafiają w dużej mierze do aplikacji profesjonalnych i przemysłowych, bo elektronika konsumencka oraz motoryzacja coraz bardziej opierają się na półprzewodnikach. Obszary, gdzie tytułowe elementy trzymają się mocno, to głównie automatyka i przemysł, systemy alarmowe, automatyka budynkowa, komunalna, transportowa itp. W tych obszarach klienci szukają dzisiaj produktów wysokiej jakości i mają też środki na to, aby kupować dobre produkty i nie muszą oszczędzać na wszystkim.

Przepięcia, prądy udarowe, komutacja obwodów dużej mocy (np. w sieciach trójfazowych), załączanie elementów indukcyjnych, jak silniki oraz elektromagnesy, to przykłady aplikacji, które są sterowane przede wszystkim za pomocą wersji elektromagnetycznych. Elementy te są odporne na stany nieustalone, wyładowania, zapewniają doskonałą izolację w stanie otwartym, mają małe pojemności własne, minimalną rezystancję przejścia, a więc z punktu widzenia inżyniera i projektanta są niezawodne. Co więcej, klasyczne przekaźniki mają sporą tolerancję na przeciążenia, bo przekroczenie napięć lub prądów, nawet znaczne, nie powoduje od razu uszkodzenia (przenosi się jedynie negatywnie na trwałość). Podczas obsługi technicznej taki element można wymienić i zapewnić nieprzerwane prawidłowe działanie przez lata.

Wymagania jakościowe klientów i automatyzacja wytwarzania przyczyniają się do spadku znaczenia tanich (niemarkowych) producentów azjatyckich, bo różnice w cenach nie są już dzisiaj duże. Przez wiele lat koszty pracy w krajach azjatyckich były sporo mniejsze niż w Europie, przez co produkcja tam była opłacalna, nawet jeśli trzeba było zapłacić więcej za transport. Aktualnie praktycznie się wyrównały, a dodatkowo inwestycje producentów europejskich w automatyzację produkcji spowodowały, że przewaga kosztowa znacznie zmalała. W ostatnim roku ograniczono też konkurencję cenową ze strony okazyjnych zakupów na platformach takich jak Alibaba i pokrewnych, bo kupujący od paru miesięcy płacą VAT i cło nawet przy zakupach prywatnych. Ogranicza to zainteresowanie takimi zakupami i porządkuje rynek.

Wiele zmian na rynku, jakie zaszły w ostatnich latach też można uznać za czynniki sprzyjające dla przekaźników i także pośrednio dla jakości. Przykładem może być wzrost znaczenia specjalizacji, odchodzenie od wytwarzania długich serii na rzecz produkcji elastycznie dopasowującej się do chwilowych potrzeb rynku bądź wręcz realizowanej na zlecenie. Sprawne realizowanie projektów, zleceń integracji i usług produkcyjnych preferuje firmy lokalne, a więc zdolne do zapewnienia szybkich dostaw komponentów. Im szerszy asortyment, im więcej typów wykonań i możliwości w zakresie przekaźników mamy na rynku, tym pozycja rynkowa dużych lokalnych graczy jest lepsza, bo oni mają magazyny fabryczne blisko klienta.

Pandemia branży nie zaszkodziła

Produkcja przekaźników w dużej części bazuje na urządzeniach automatycznych, przez co nakład pracy ludzkiej nie jest na tyle duży, aby umiarkowane zachorowania wśród pracowników przeważyły na możliwości produkcyjnej zakładu. Stąd pandemia nie miała i nie ma wielkiego wpływu na działalność producentów. O wiele większą trudnością są kłopoty z zaopatrzeniem i utrzymaniem ciągłości pracy wynikające z braków towarowych i długiego czasu oczekiwania.

Można nawet powiedzieć, że na początku pandemii było nawet działać łatwiej, bo towar był w magazynach, popyt zmalał i przedsiębiorcy raczej niepokoili się głównie o utrzymanie wolumenu sprzedaży. Nawet jak dostawcy mieli problemy, przestoje lub zablokowała ich dysfunkcyjna logistyka lotnicza, niewiele to przeszkadzało, bo towar "był". Dopiero jak zapasy zostały wyprzedane, zaczęła się prawdziwa bitwa o rynek, bo jaki sens ma działalność handlowa, gdy w magazynie są pustki? W efekcie kupowanie podzespołów elektronicznych zmieniło się w ostatnich miesiącach w zdobywanie produktu i dotyczy to też przekaźników.

Kłopoty z dostępnością i rosnące ceny

Od mniej więcej roku rynek komponentów elektronicznych zmaga się z wydłużonymi czasami dostaw, gorszą dostępnością produktów i w konsekwencji rosnącymi cenami podzespołów, materiałów oraz transportu. Dotyczy to większości grup produktowych, zarówno półprzewodników, jak i elementów pasywnych oraz elektromechanicznych. W ostatnim okresie podrożała również znacząco miedź, bo jest ona niezbędna m.in. do produkcji silników elektrycznych, na które jest duże zapotrzebowanie ze strony motoryzacji. W konsekwencji drożej trzeba płacić za drut nawojowy i materiał na styki.

To prawda, że kłopoty na rynku zaczęły się od ograniczonej dostępności układów cyfrowych takich jak mikrokontrolery, ale niedługo później te pierwotne problemy rozchwiały cały rynek i zaczęło brakować wielu innych typów półprzewodników, bo producenci elektroniki, przewidując wychodzenie gospodarki z kryzysu, zaczęli zamawiać spore partie elementów do planowanej produkcji. Część firm kupowała podzespoły na zapas, inni przestali kupować po to, aby ograniczyć potencjalne straty.

Dostawcy materiałów nie wywiązują się z terminów lub nie realizują zamówień w ogóle, co podnosi koszty i utrudnia produkcję. Częściowo wynika to z tego, że sami na coś czekają, a także z tego, że w łańcuchu dostaw pojawiły się zakłócenia w płatnościach i zachwiania płynności biznesowej. Nie dotyczy to oczywiście tylko naszego rynku.

Wiele pozornie drobnych usprawnień

Przekaźnik elektromagnetyczny jest komponentem znanym od dziesiątek lat i wydawałoby się, że konstrukcja współczesnych podzespołów tego typu jest na tyle dobrze dopracowana, że trudno zaproponować coś innowacyjnego. Jest to prawda, gdy patrzy się z perspektywy na cały produkt, jego zasadę działania lub funkcjonalność. Niemniej bliższe przyjrzenie się pozwala dostrzec wiele drobnych szczegółów i niewielkich zmian, sukcesywnie wprowadzanych ulepszeń, które zapewniają, że produkty te cały czas ewoluują.

Takie usprawnienia to m.in. coraz więcej wersji, gdzie moc pobierana przez cewkę została wyraźnie ograniczona, wersje ciche, przekaźniki bistabilne, rozwiązania z przyciskiem testującym, kontrolką a nawet przezroczyste obudowy pozwalające na wizualną kontrolę stanu styków.

Sporo usprawnień dotyczy podłączenia przewodu w wersjach przemysłowych, w tym popularyzacji zacisku sprężynowego, większej liczby dostępnych akcesoriów, większej oferty w zakresie przekaźników w obudowach szczelnych.

E-mobilność też tworzy zapotrzebowanie na wersje specjalne, a więc zdolne do komutacji wysokich napięć stałych, czyli wyposażonych w systemy gaszenia łuku elektrycznego, wersje ze stykami odpornymi na sklejanie się od wysokich prądów udarowych.

Warto też dostrzec, że rośnie liczba przekaźników z wbudowaną elektroniką do montażu na szynie DIN. Są to wersje czasowe, nadzorcze, wykrywające brak fazy, włączające oświetlenie na noc itp. Są to rozwiązania klasy "małej automatyki", czyli przekaźnik z dodatkiem, użyteczne, niedrogie. Sterowanie oświetleniem w garażu, wentylacją w hali, załączanie oświetlenia przeszkodowego i podobne zadania nie wymagają złożonych sterowników wymagających programowania, ale jednocześnie czegoś więcej niż sam przekaźnik.

Poza kwestiami technicznymi przekaźniki zyskują szczelne obudowy zapewniające odporność środowiskową, mające wzmocnioną izolację między cewką i stykami, a w ich kartach katalogowych pojawiają się kolejne certyfikaty jakości potwierdzające deklaracje producenta.

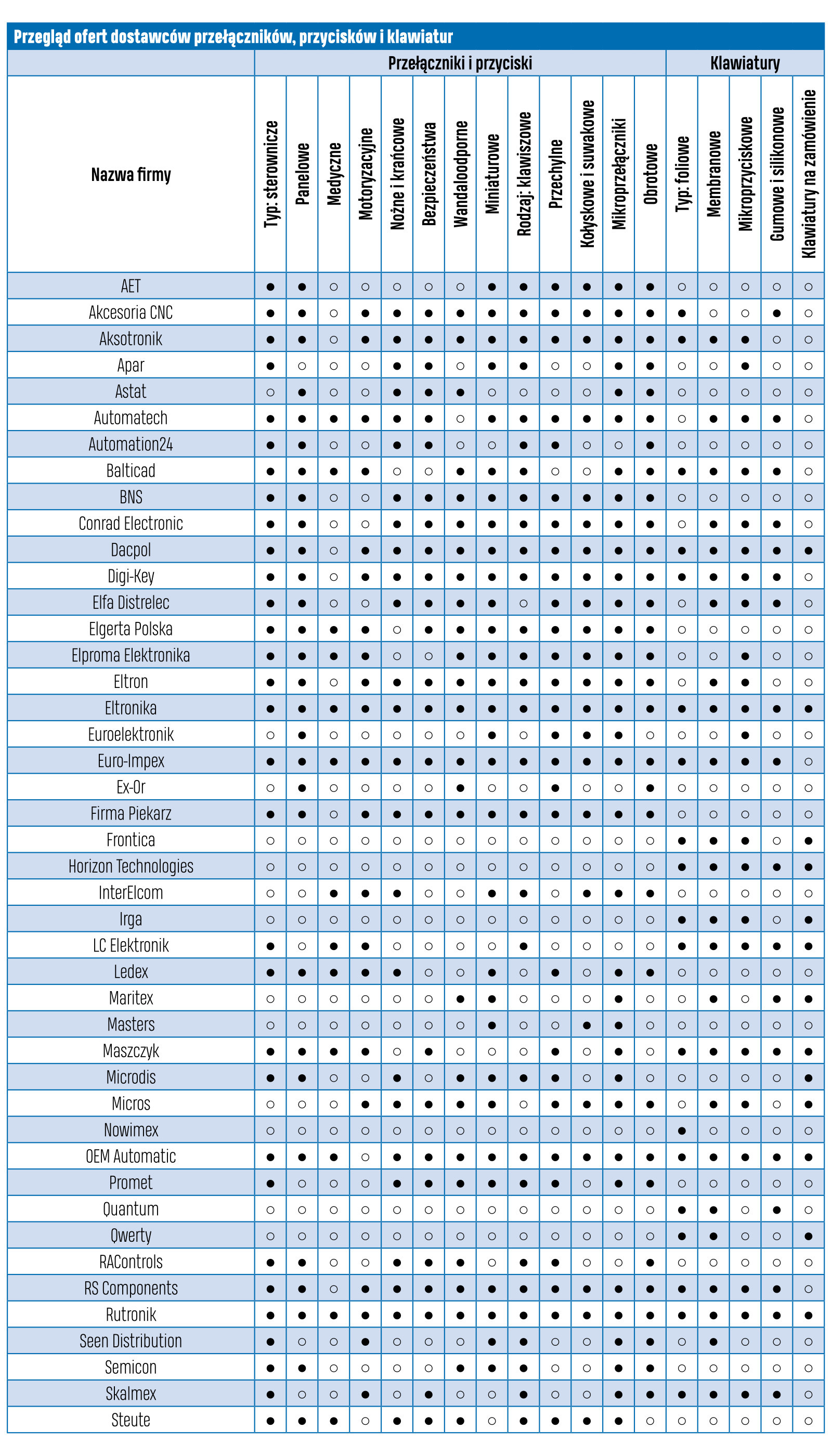

Przełączniki, przyciski i klawiatury

Ogólny rozwój rynku elementów elektromechanicznych napędzają inwestycje, modernizacje starych linii produkcyjnych, urządzeń infrastruktury, coraz to nowe obowiązki prawne związane z zapewnieniem bezpieczeństwa użytkowania oraz także rozwój usług montażu kontraktowego. Trwa dobra koniunktura na rynku profesjonalnym: wojskowym, kolejowym, komunikacji bezprzewodowej, co zawsze przekłada się w pewnym stopniu pozytywnie na sprzedaż przełączników i klawiatur.

Elementy elektromechaniczne, takie jak złącza, przełączniki, przekaźniki i klawiatury, nie są wbrew pozorom tak proste od strony technicznej, jak mogłoby się na pierwszy rzut oka wydawać. Zapewnienie w nich trwałości elektrycznej, mechanicznej, pewności działania, powtarzalności i komfortu użytkowania to zagadnienia, które wymagają od producenta wiedzy i doświadczenia, użycia dobrych materiałów i zaawansowanych maszyn. Są to aspekty, które różnicują na rynku rozwiązania dobre od słabych. Wzrost automatyzacji procesów produkcji zwiększa zapotrzebowanie na przełączniki, a coraz powszechniejsze sterowanie komputerowe wymusza stosowanie klawiatur, stąd rynek z roku na rok dla takich elementów staje się coraz większy.

Szczęśliwie dla sektora elementów elektromechanicznych, technologie dotykowe nie wypychają przełączników i klawiatur na margines. Wydawać by się mogło, że nowoczesne interfejsy człowiek-maszyna, a więc dotyk lub gesty, zdominują wszelkiego typu sterowniki komputerowe, panele sterujące i tablice rozdzielcze. Niemniej tak się nie dzieje, bo przy szybko rosnącym rynku każde rozwiązanie ma swoje miejsce i obszar aplikacyjny. Technologie dotykowe wciąż mają wady ograniczające ich przydatność w przemyśle i zastosowaniach profesjonalnych, w tym niewystarczającą niezawodność, wrażliwość na zakłócenia oraz wymuszającą konieczność obsługi gołymi palcami w technologii pojemnościowej albo z kolei wysokie koszty dla ekranów z falą powierzchniową. Tam, gdzie pewność zadziałania ma kluczowe znaczenie, a więc w sterownikach przemysłowych, aparaturze medycznej itp. pozycja tradycyjnych przełączników i klawiatur membranowych wydaje się na razie niezagrożona. Niewielka inwestycja w lepszej jakości przełącznik o wyższym stopniu ochrony IP i lepszej wytrzymałości wpływa pozytywnie na odbiór całego urządzenia, pozwala poprawić jego pozycję rynkową oraz ocenę produktu, dlatego są to cały czas produkty poszukiwane i rozwijane przez producentów.

Kiepskiej jakości przełącznik lub klawiatura są w stanie skutecznie popsuć opinię o producencie urządzenia wśród wielu klientów, a firmę wpędzić w kosztowne akcje serwisowe. W miarę upływu lat coraz więcej osób jest świadomych takiego ryzyka i co jest również ważne, ma obecnie pieniądze na to, aby je minimalizować. Temat jakości elementów elektromechanicznych jest najczęściej dyskutowanym temetem w tym sektorze rynku od wielu lat. Dystrybutorzy i producenci wkładają od lat wiele wysiłku w promocję elementów markowych wśród firm elektronicznych, cierpliwie pracując nad zmianą podejścia klientów do zakupów.

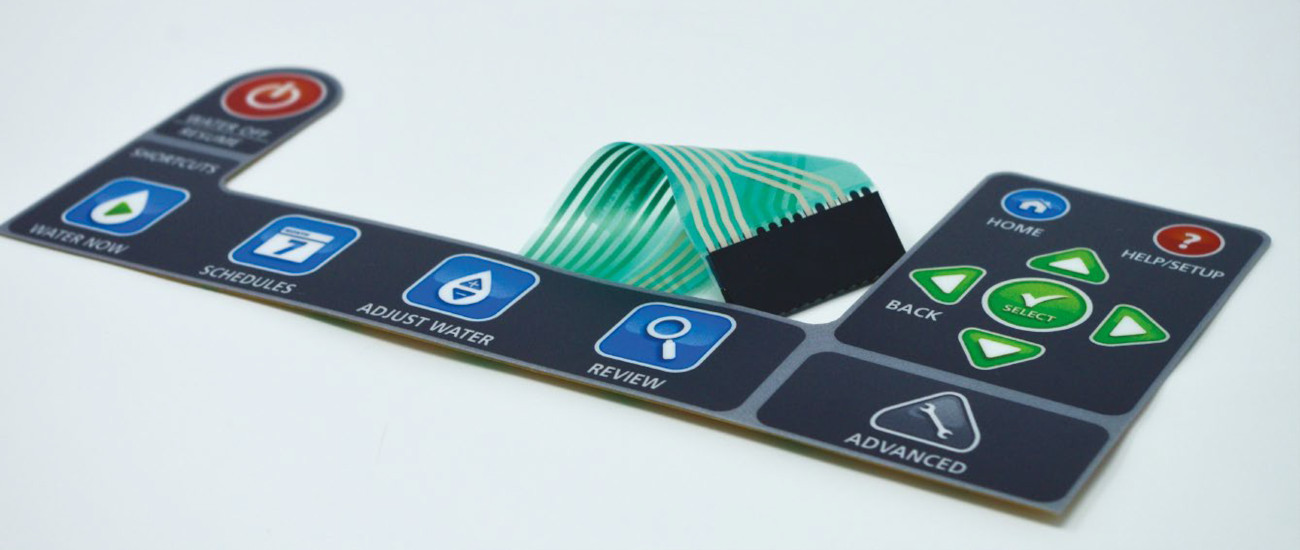

Polskie zaplecze klawiaturowe

Klawiatury foliowe (mebranowe) to podstawowe i najpopularniejsze rozwiązania interfejsu użytkownika, których głównym atutem jest to, że są produkowane na indywidualne zamówienie klientów. Mogą oni ustalić kształt klawiszy, rozkład i liczbę pól, rodzaj podświetlenia, stopień odporności środowiskowej i wiele innych podobnych szczegółów. W klawiaturach foliowych nieustannie zwiększa się funkcjonalność oraz stopień integracji dostępny w ramach jednego produktu. Wewnątrz takich konstrukcji umieszczane są elementy podświetlenia, czujniki, wyświetlacze, a nawet światłowody zapewniające punktowe podświetlenie. Zainteresowaniem rynku cieszą się także folie podgrzewające zintegrowane wyświetlacze LCD po to, aby mogły działać w niskich temperaturach, gdyż ułatwia to tworzenie aplikacji pracujących na zewnątrz, np. automatów sprzedaży. Mnogość opcji umożliwia konfigurowanie klawiatur foliowych do różnorodnych zastosowań, ale jednocześnie nie prowadzi do komplikacji procesu produkcji urządzeń, bo montaż klawiatury sprowadza się do naklejenia jej na obudowę i podłączenia wyprowadzeń do złączy w urządzeniu.

Jest to wynik tego, że klienci oczekują indywidualnego podejścia do ich projektowania i produkcji, elastyczności oraz umiejętnego wyważenia priorytetów pomiędzy możliwościami technicznymi, funkcjonalnymi, a ceną gotowego wyrobu. Technologia membranowa pozwala na produkcję klawiatur zarówno bardzo tanich, o ograniczonej żywotności, jak też konstrukcji bardzo trwałych i odpornych. Możliwości wykonania grafiki frontowej również są bardzo szerokie, bo druk cyfrowy daje znakomite możliwości wykonywania małych serii.

Na naszym rynku obecnych jest kilku producentów klawiatur: Qwerty, Horizon, Irga, Jagon i jeszcze parę mniejszych wytwórców. Firmy te zajmują się przede wszystkim ich produkcją oraz wykonywaniem płyt frontowych na indywidualne zamówienie. Większość takich firm oferuje wszystkie popularne technologie, z tym że największe znaczenie na rynku mają klawiatury foliowe. To dlatego, że są one dość tanie i jednocześnie trwałe, niewielkiej głębokości i dające duże możliwości indywidualizacji. Klawiatury tego typu wybijają się na rynku także swoją elastycznością technologiczną, gdyż mogą być wykonywane w wielu różnych opcjach, a nawet pozwalają na instalację podświetlenia dla całości klawiatury lub selektywnej iluminacji pojedynczych przycisków. Możliwe jest też łączenie klawiatury z oknem dla wyświetlacza, przez co w ten sposób daje się opracować cały panel frontowy urządzenia. Wraz z warstwami realizującymi ekranowanie elektromagnetyczne konstrukcja jest zabezpieczana przed wpływem czynników środowiskowych lakierami i warstwami ochronnymi. W połączeniu z nowymi materiałami, trwałymi tworzywami sztucznymi i silikonami daje to możliwość stworzenia trwałego interfejsu użytkownika do wielu aplikacji.

Produkcja indywidualnie dopasowanych do aplikacji klawiatur, w pełni zintegrowanych z obudową, także w małych seriach tworzonych za pomocą druku cyfrowego od wielu lat jest podstawą biznesu krajowych wytwórców. Polskim producentom udało się połączyć te wszystkie cechy, jakimi charakteryzują się współczesne klawiatury, w warunkach produkcji krótkich serii oraz bez konieczności ponoszenia wysokich kosztów charakterystycznych dla zamówień indywidualnych i bez konieczności długiego oczekiwania na prototypowanie. I tym samym solidnie sobie zapracowali na taką silną pozycję.

Brak problemów jest w cenie

W porównaniu do półprzewodników elementy elektromechaniczne charakteryzują się znacznie dłuższą żywotnością rynkową. Są produkowane przez lata, bo postęp technologiczny nie jest tutaj taki szybki, poprawa funkcjonalności jest ewolucją, a klienci w swoich wyborach mają podejście konserwatywne.

Starsze rozwiązania przełączników trzymają się mocno, gdyż klienci cenią je za niezawodność potwierdzoną latami sprzedaży i milionami sztuk. Mają one też wyśrubowaną wartość współczynnika jakości do ceny, bo przez wiele lat dla producenta koszty przygotowania produkcji i maszyny zdążyły się zamortyzować. Dotyczy to w szczególności wersji przemysłowych, bo w tym sektorze innowacje zawsze się przyjmują najwolniej. Można nazywać to inercją, konserwatywnym podejściem lub zachowawczym postępowaniem podczas selekcji produktu i dostawcy, niemniej wspólnym mianownikiem dla tych trzech określeń jest po prostu bezproblemowość aplikacyjna i małe ryzyko natknięcia się na tzw. niewypał.

Coraz więcej wersji zelektronizowanych i modułowych

Rozwój technologii półprzewodnikowej w zakresie technologii dotykowych oraz dostępność tanich rozwiązań scalonych, w których całość warstwy sprzętowej niezbędnej do realizacji elementu dotykowego doprowadziła do tego, że wielu producentów zaczęło też elektronizować przyciski i przełączniki. Zamiast konstrukcji mechanicznej przenoszącej nacisk palca na położenie styków, aktywują się one przez dotknięcie klawisza.

Korzyści takiego podejścia nie trzeba długo szukać, bo naturalnie brak elementów ruchomych zapewnia bardzo dużą trwałość mechaniczną i elektryczną, pozwala na wykonanie przycisku w wersji odpornej na wpływ środowiska (szczelnej). Ważne też jest to, że są to elementy coraz tańsze, łatwiejsze w aplikowaniu i coraz lepiej przyjmowane przez rynek.

Do budowy takich przycisków wykorzystywane są różne technologie, np. pojemnościowa lub piezoelektryczna. Te pierwsze są tańsze, bo dotyk realizują specjalizowane chipy. Korzyścią jest również, poza trwałością, brak możliwości "oszukania" przycisku np. jego fizycznego zablokowania w pozycji przyciśniętej. Minusem jest to, że reakcja na rękę ubraną w rękawiczkę jest często nieprzewidywalna. Wiele osób krytykuje też brak mechanicznego potwierdzenia zadziałania, opóźnienia pojawiające się pomiędzy dotknięciem klawisza (sensora dotykowego) a reakcją systemu. Wada to także konieczność zasilania, brak słyszalnego "kliku" oraz problem z użyciem do przełączania obwodów dużej mocy.

W praktyce przyciski pojemnościowe przeznaczone są przede wszystkim do realizacji interfejsu użytkownika. Nie nadają się do przełączania napięć zasilających, bo same wymagają zasilania, wysokich napięć, ani też czułych sygnałów z sensorów. Nie da się ich używać w aplikacjach wymagających absolutnej pewności działania (tzw. aplikacje bezpieczeństwa), w warunkach silnych zaburzeń elektromagnetycznych, na przykład blisko pracujących urządzeń do zgrzewania indukcyjnego, suszarek mikrofalowych lub w sąsiedztwie działających nadajników radiowych. W takich warunkach elementy pojemnościowe tracą czułość i mogą po prostu słabiej lub z opóźnieniem reagować na dotykający palec.

Niemniej problem z zapewnieniem reakcji na dotyk ręką w rękawiczce rozwiązują w dużej mierze technologie piezoelektryczne, gdzie dotknięcie klawisza i tym samym wywarcie nacisku na sensor piezo skutkuje powstaniem impulsu na wyjściu sensora. W tym przypadku liczy się wywarcie siły, a nie dotknięcie, stąd obsługa w rękawiczce w niczym tu nie przeszkadza.

Przełączniki w wersji elektronicznej z pewnością należy traktować jako elementy, przed którymi jest przyszłość. Problemy, jakie wiążą się z ich użyciem, są stopniowo poprawiane i ograniczane. To samo dotyczy możliwości zastosowania w aplikacjach o znaczeniu krytycznym, np. związanych z bezpieczeństwem. Kiedyś nie było to możliwe w ogóle, dzisiaj już wiele produktów ma stosowne dopuszczenia.

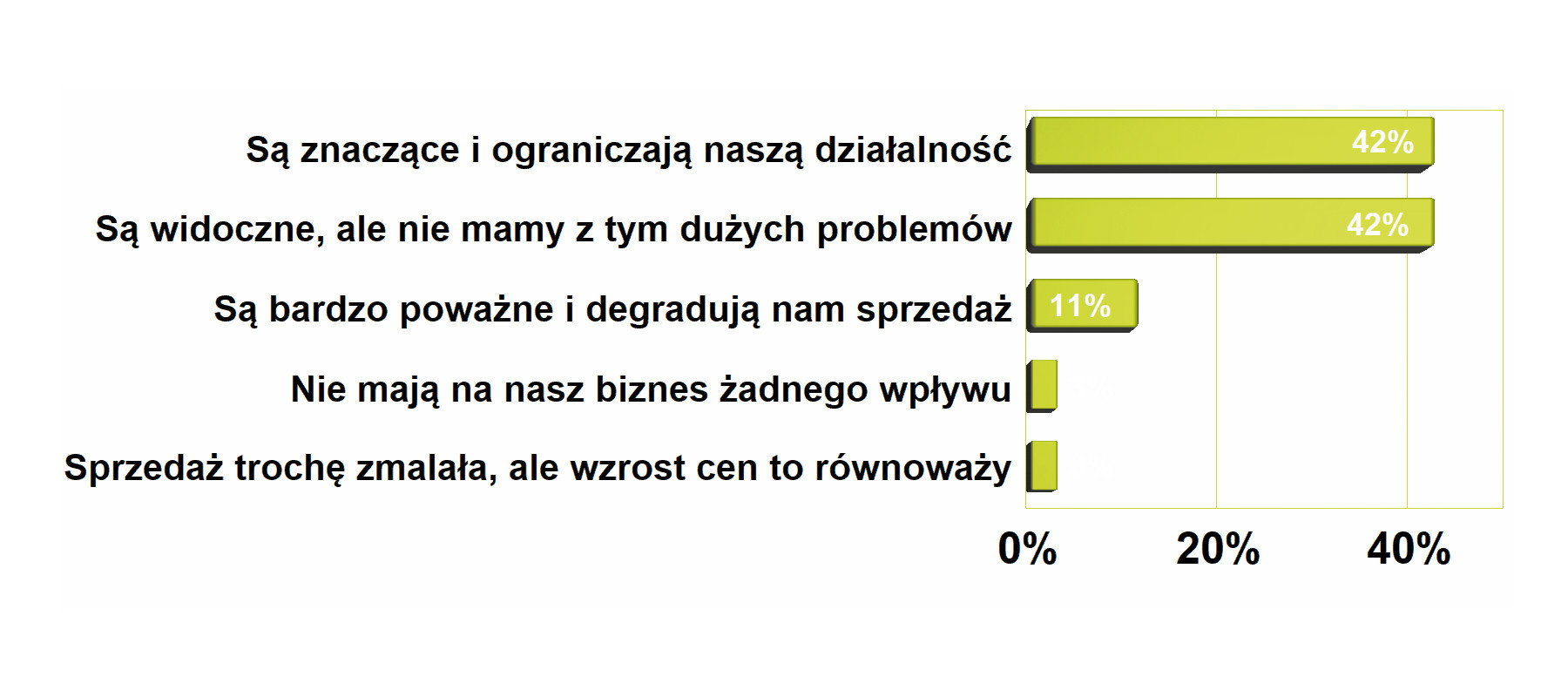

Wzrost cen i czasu dostaw

Pandemia wpływa na łańcuch dostaw komponentów elektronicznych a jej skutkiem są wydłużające się czasy dostaw, wzrost cen materiałów i podzespołów. Dotyczy to wielu grup produktowych, nie tylko elementów elektromechanicznych, bo zaopatrzenie w materiały i komponenty to wrażliwy na zakłócenia system naczyń połączonych i skomplikowanych zależności biznesowych.

Czasy dostaw się wydłużają, bo w ostatnich miesiącach popyt na wiele grup produktowych się zwiększył. Po okresie przymusowej bezczynności i siedzenia w zamknięciu wiele firm elektronicznych oczekuje, że niedługo rynek się ożywi, pandemia odpuści i konsumenci żwawiej ruszą na zakupy. Do tego trzeba się przygotować, m.in. produkując, realizując projekty i uruchamiając nowe pomysły przygotowywane w czasie, gdy można było siedzieć przy komputerze i oprogramowaniu projektowym. Wraz z tymi działaniami poszły zamówienia i okazało się, że z ich realizacją jest kłopot. Część zakładów ograniczyła działalność, bo kadra chorowała, a dodatkowo nie było popytu. Inne fabryki przestawiły maszyny na inny asortyment, a jeszcze inne pozbyły się zapasów po to, aby uwolnić zamrożony kapitał. Do tego łańcuch dostaw musiał się zmierzyć z trudniejszą logistyką towarów na skutek ograniczeń w transporcie lotniczym, zamknięć granic i podobnymi problemami. Wiele takich drobnych rzeczy w końcu dało wzrost cen, bo pojawiły się kolejki, a ceny materiałów też się zwiększyły (tworzyw i metali). Sytuacja zapewne się ustabilizuje z czasem, ale na razie jest to dla rynku główny problem.

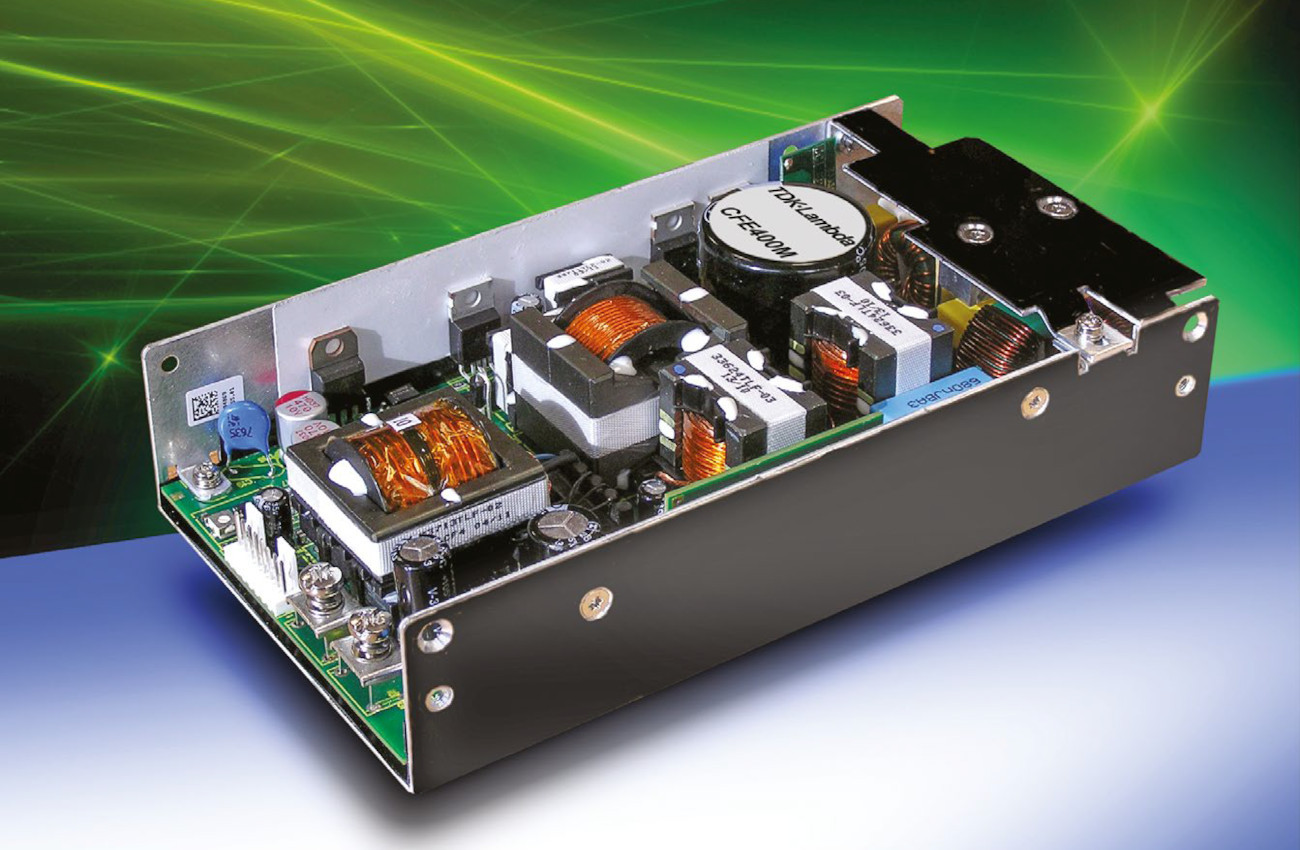

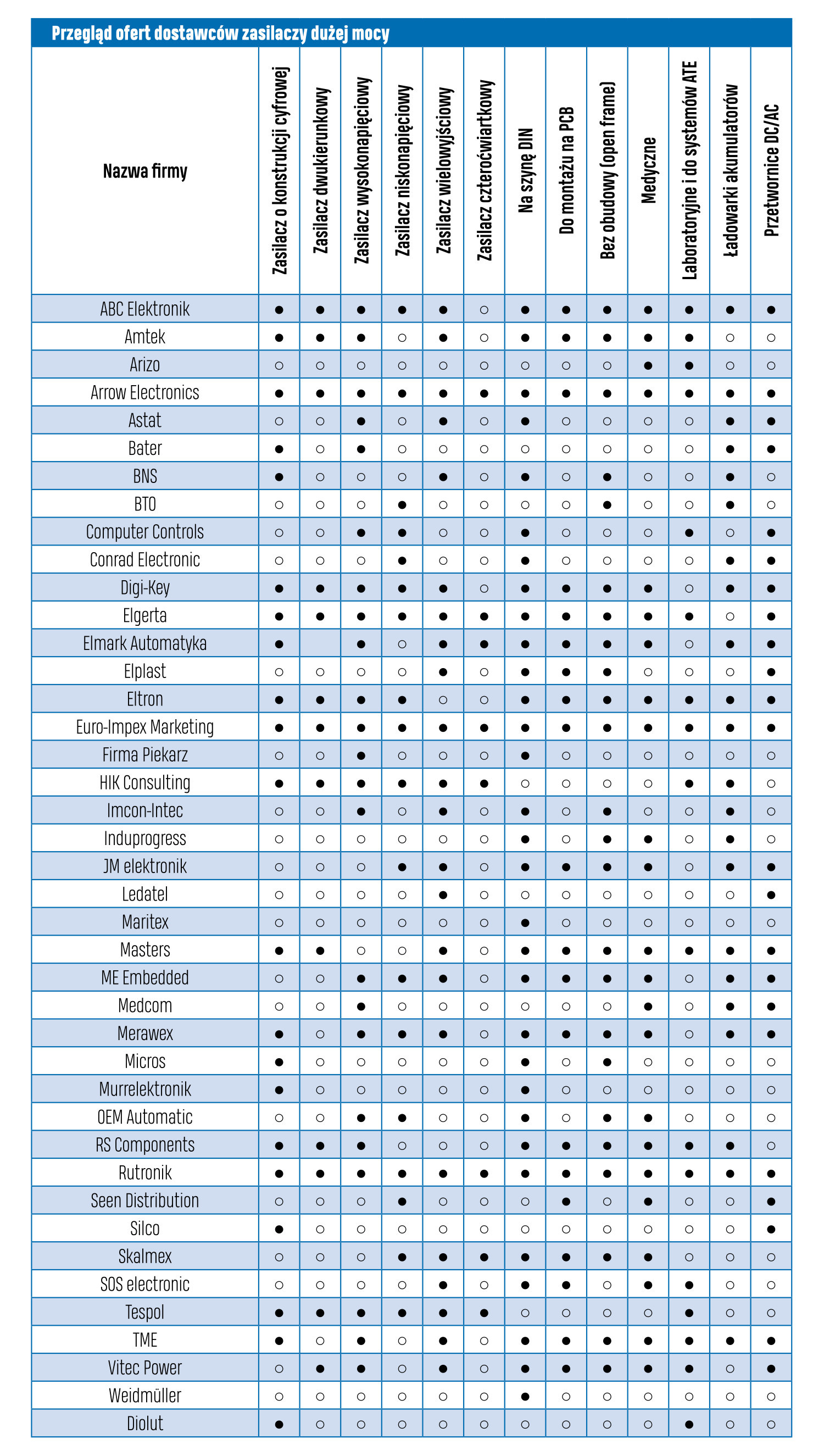

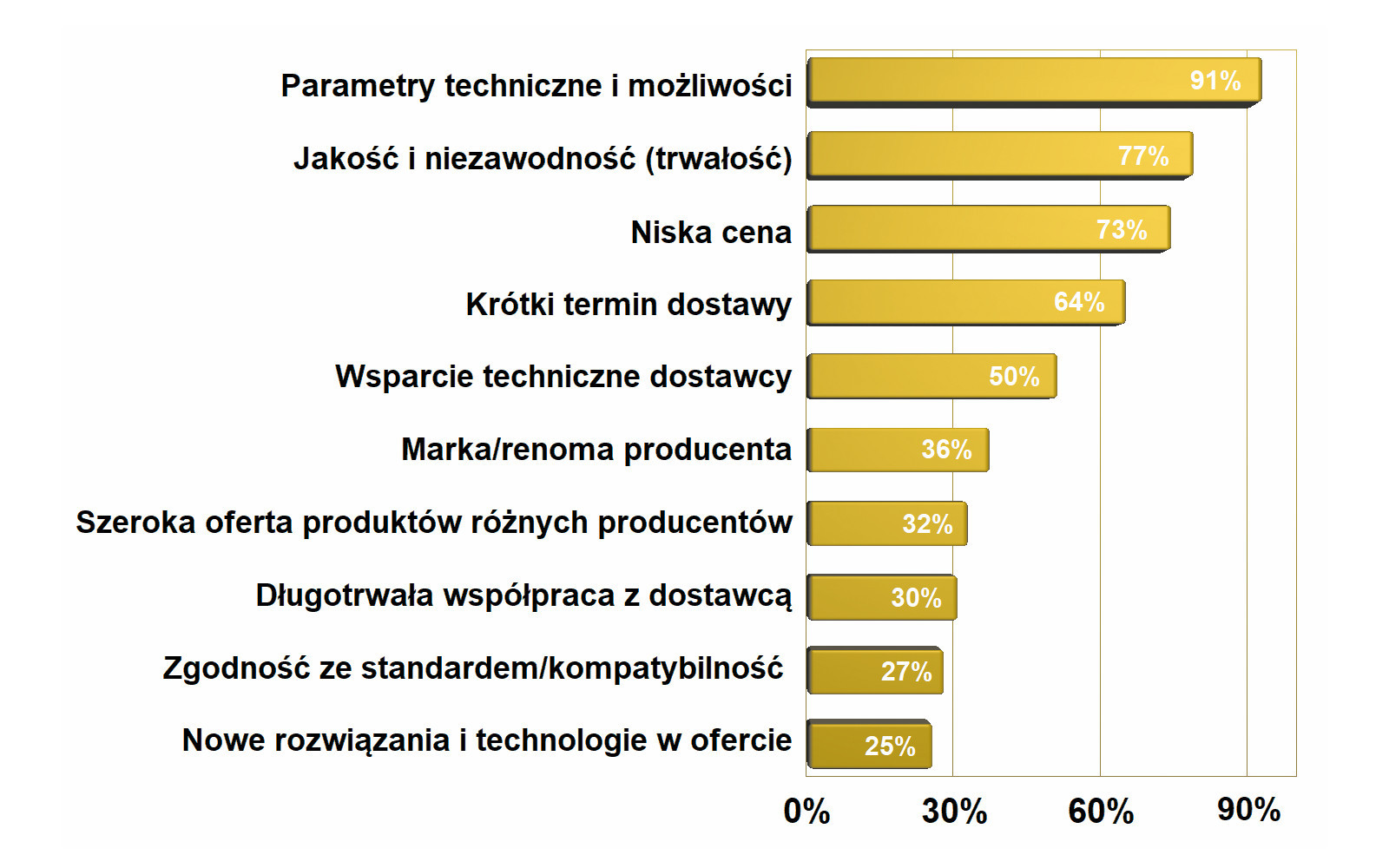

Zasilacze dużej mocy

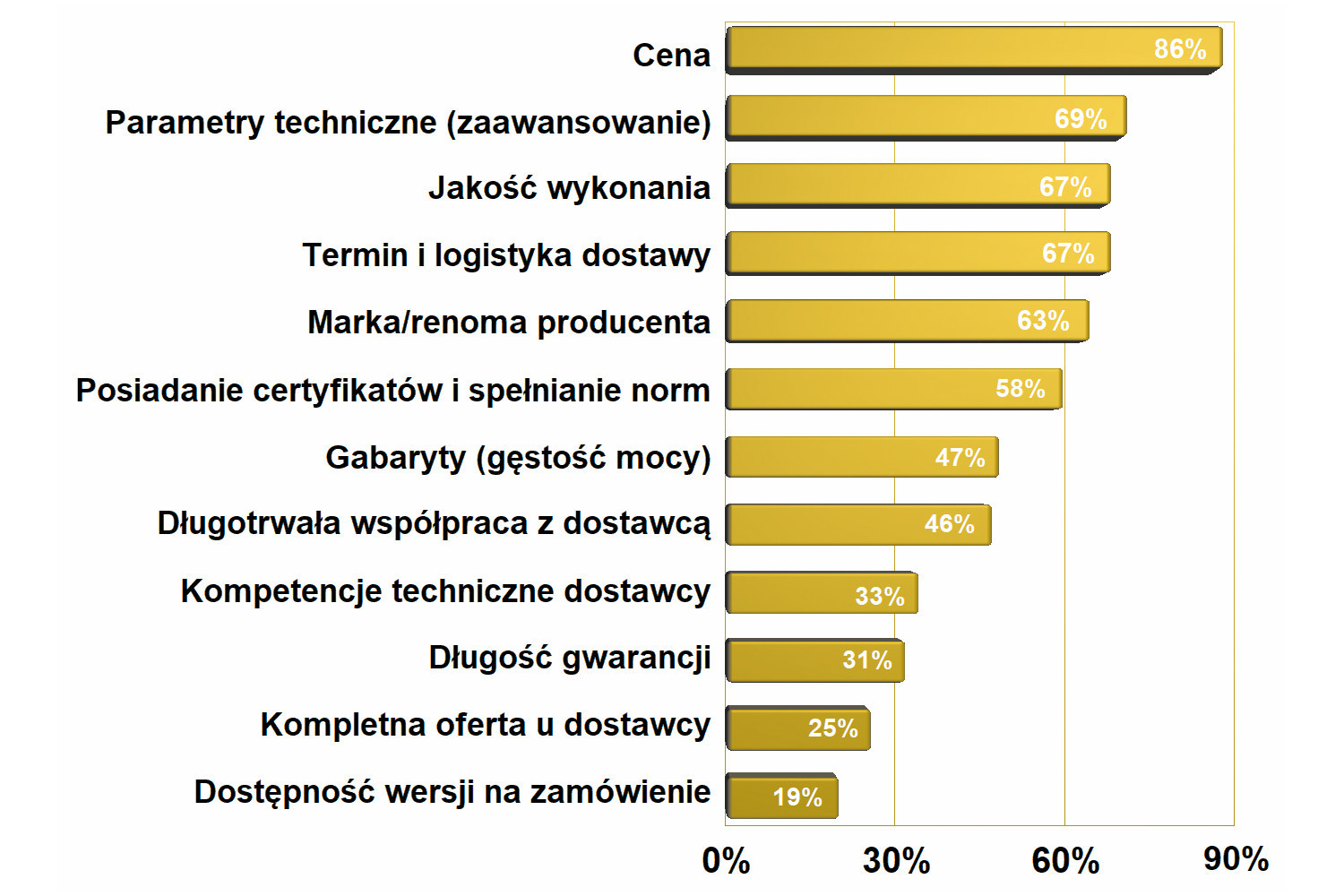

Aby działać, elektronika musi być zasilana, stąd praktycznie bez wyjątku każde współczesne urządzenie techniczne potrzebuje zasilacza. Pod tym hasłem kryją się tysiące rozwiązań różniących się parametrami, budową, przeznaczeniem i wykonaniem i coraz częściej jednostki te są wykorzystywane do zapewnienia działania krytycznych systemów i instalacji. W przypadku zasilaczy dużej mocy, takich, które kierowane są do aplikacji przemysłowych, medycznych, telekomunikacyjnych, funkcja jaką ma taki sprzęt, staje się coraz ważniejsze. Dlatego ich wybór, parametry techniczne, niezawodność i funkcjonalność mają fundamentalne znaczenie dla szeroko rozumianego bezpieczeństwa.

Kłopoty z kupnem komponentów, które stały się w ostatnich miesiącach palącym problemem dla wszystkich, dotyczą też zasilaczy. Nie ma w nich wprawdzie nowoczesnych i wydajnych mikrokontrolerów, ale jest wiele innych elementów, z którymi też jest kłopot zaopatrzeniowy, np. kondensatory, tranzystory mocy, rdzenie.

Jak i we wszystkich innych podzespołach elektroniczne, ceny zasilaczy w ostatnich miesiącach się zwiększyły. Podrożały surowce takie jak laminaty i płytki drukowane oraz stopy lutownicze. Tak samo wzrosły ceny tworzyw sztucznych. W ostatnim okresie podrożała znacząco miedź, bo jest ona niezbędna m.in. do produkcji silników elektrycznych, na które jest duże zapotrzebowanie ze strony motoryzacji. W konsekwencji drożej trzeba płacić za drut nawojowy. W kolejności większe ceny środków do produkcji, a także koszty pracy plus inflacja przełożyły się na wyższe ceny urządzeń.

Niestety wzrost cen elektroniki może wpłynąć negatywnie na popyt i zakontraktowane projekty oraz przetargi, bo zmusi do ich ponownej kalkulacji. Zmieniające się ceny tworzą też ryzyko biznesowe, zmuszają do zwiększenia marży w projektach (marginesu opłacalności), na ewentualne dalsze podwyżki cen.

Negatywnie na rynek zasilaczy wpływa też niestabilna sytuacja u inwestorów przejawiająca się przesunięciami terminów lub rezygnacją z inwestycji. Niestety fakty są takie, że wiele podzespołów, materiałów, surowców, subkomponentów jest wytwarzane w Azji, a tam sytuacja też jest daleka od równowagi. Mimo że pandemia pojawiła się na tamtym kontynencie na początku, do dzisiaj tamtejsze firmy mają problemy z osiągnięciem pełnej wydajności.

Z większości kryzysów branża elektroniki wychodziła bez strat, bo zapotrzebowanie na nowoczesne technologie było zawsze duże, a cykl projektowy liczy się w perspektywie kilku lat, czyli dłuższej niż zazwyczaj trwają problemy. Dla branży elektroniki izolacja w domach i konieczność pracy zdalnej nie okazały się wielką przeszkodą, bo dla pracowników biurowych miejsce pracy nie ma kluczowego znaczenia, a produkcja jest zautomatyzowana. Ale takich problemów z dostępnością elementów, jakie mamy teraz, jeszcze nie było, a dodatkowo zwykle mijały one szybciej.

GaN jeszcze poczeka na upowszechnienie

W przypadku zasilaczy dużej mocy poprawa wielu ważnych parametrów technicznych wiąże się z użyciem nowych generacji podzespołów półprzewodnikowych. Dotyczy to wielu zagadnień, a przykładem może być mała moc pobierana z sieci bez obciążenia, która wynosi kilkadziesiąt miliwatów nawet w wydajnych, kilkusetwatowych zasilaczach przemysłowych. Aby zapewnić taki rewelacyjny wynik, konieczne jest użycie zaawansowanych kontrolerów scalonych, które potrafią dynamicznie zmieniać topologię konwersji energii w funkcji stopnia obciążenia, uruchamiają tryby oszczędnościowe, gdy zasilacz jest nieobciążony itp.

Zaawansowany kontroler zmienia też dynamicznie częstotliwość kluczowania tranzystorów po to, aby ograniczyć straty mocy wynikające z komutacji, a więc aby zapewnić większą sprawność zasilacza. Taki układ zwykle dzisiaj pracuje w topologii rezonansowej, która zapewnia małą emisję zaburzeń elektromagnetycznych i realizuje przełączanie tranzystorów w zerze napięcia lub prądu.

Kolejnym bardzo istotnym elementem są tranzystory przełączające, które powinny zapewnić małe straty na przewodzenie (jak najmniejszy spadek napięcia w czasie przewodzenia) oraz na komutację (w czasie przełączania). Dodatkowo tranzystory takie powinny mieć jak największe napięcie znamionowe. Zapewnia to oczywiście dużą odporność na przepięcia pojawiające się w sieci energetycznej, ale także ogranicza straty energii wynikające z konieczności tłumienia przepięć na transformatorze powstających w wyniku przełączania.

Naturalnym kandydatem do nowoczesnej jednostki zasilającej są elementy wykonane z azotku galu, niemniej na razie nie widać na rynku, aby takie jednostki zasilające pojawiały się masowo w ofertach. Rynek czeka na tanie tranzystory GaN oraz na ich dobrą dostępność. Na razie trafiają one głównie do elektrycznej motoryzacji, gdzie stanowią bazę konstrukcyjną inwerterów i konwerterów. W zasilaczach też niewątpliwie będą, ale prawdopodobnie gdy rynek dystrybucji się uspokoi i ceny ustabilizują.

Zagadnienia związane z energią odnawialną i elektromobilnością

Coraz więcej systemów zasilających staje się bardziej skomplikowanych z uwagi na to, że nie bazują one już jedynie na jednym źródle energii, tj. sieci energetycznej. Popularyzacja energii odnawialnej i elektromobilności w transporcie wymusza dostosowanie zasilaczy także do takich źródeł i odbiorników. Oznacza to możliwość podłączenia akumulatora, zdolność do zasilania napięciem stałym wahającym się w szerokim zakresie, możliwość przeciążania i łączenia równoległego. To także działanie dwukierunkowe, w którym kierunek energii może zostać odwrócony po to, aby doładować akumulator jako ładowarka. Taka funkcjonalność jest podstawą działania systemów odzyskiwania energii w napędach.

Interfejs komunikacyjny

Coraz częściej zasilacze dużej mocy pozwalają na programowanie parametrów z użyciem cyfrowego interfejsu. Jest to bardzo wygodna opcja, bo pozwala na precyzyjne wyregulowanie napięcia, ustawienie progów zadziałania zabezpieczeń, sposobu stabilizacji napięcia lub też połączenie kilku zasilaczy w większy zespół pracujący równolegle. To także dotyczy chłodzenia, np. progu aktywacji wentylatora lub możliwości chwilowego przeciążenia. Interfejs komunikacyjny ułatwia użycie zasilacza klientom, a producentom zapewnia możliwość spełnienia specyficznych wymagań klientów z użyciem jednostki katalogowej, stąd rozwiązanie to szybko się popularyzuje.

Poza tym w obecnej rzeczywistości staje się standardem możliwość monitoringu zdalnego urządzeń. Sprzęt pracujący w instalacjach rozproszonych coraz częściej podłącza się do jakiejś sieci lub przynajmniej koncentratora danych lub bramki dostępowej. Dzięki temu można sprawdzić bieżące parametry, jak napięcie i prąd obciążenia, temperaturę oraz obejrzeć dane historyczne na temat np. tego, czy zasilacz wszedł w tryb awaryjny (doznał przeciążenia), ile razy i kiedy. Z punktu widzenia nowoczesnego przemysłu taki monitoring stanu wiąże się z zagadnieniami kategoryzowanymi jako predykcyjne utrzymanie ruchu, ale takie potrzeby wynikają także z przyczyn ekonomicznych. Podłączenie na stałe daje możliwość alarmowania oraz podejmowania wyprzedzających działań prowadzących do oszczędności.

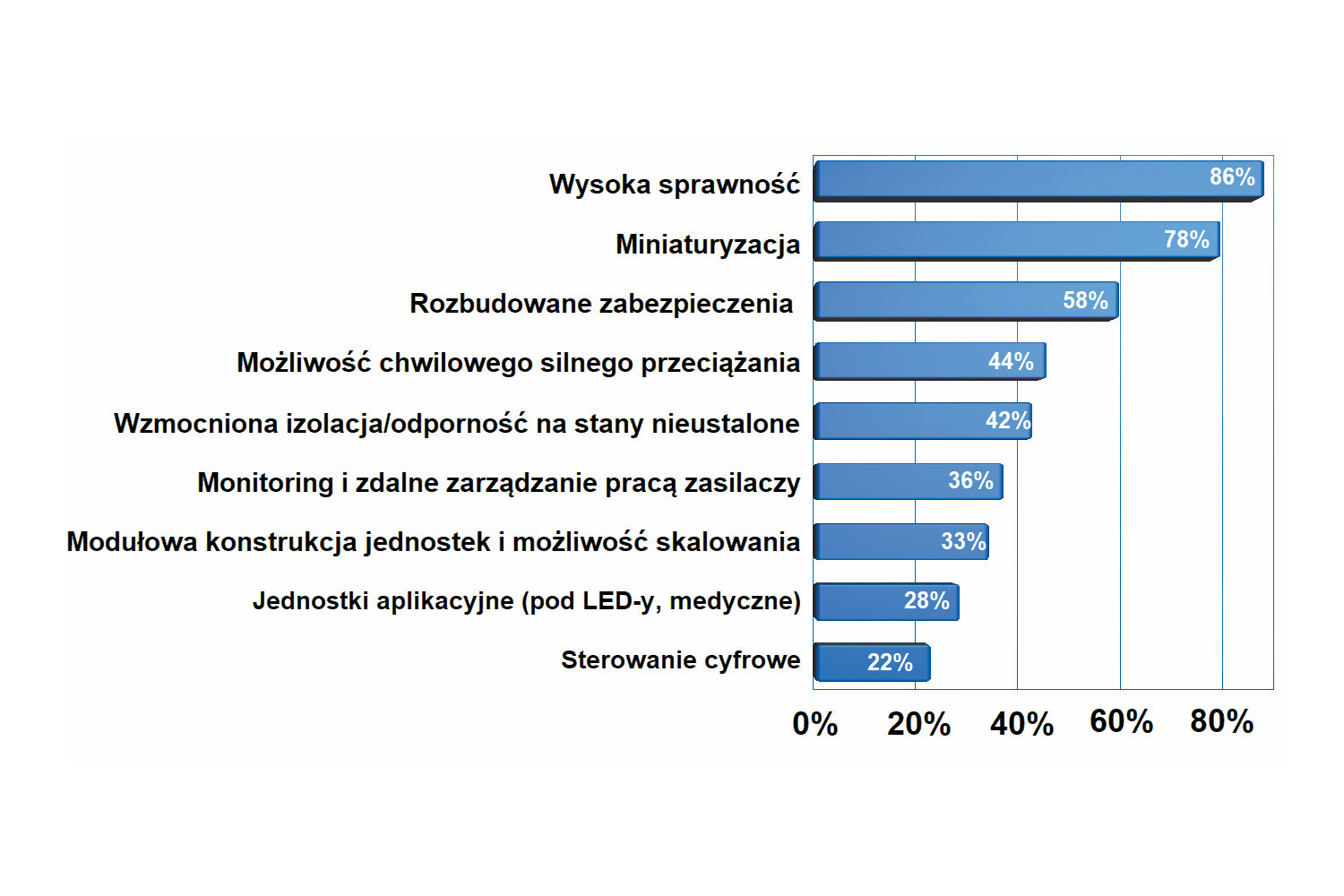

Większa odporność na stany nieustalone, lepsze zabezpieczenia, możliwość dopasowania produktu do wymagań użytkownika, zdalna kontrola stanu i wiele innych funkcji są dzisiaj także częściej brane pod uwagę.

Dalsze kryteria mają już podobne znaczenie, a wspólnym mianownikiem dla nich jest funkcjonalność charakterystyczna dla zastosowań przemysłowych, teleinformatycznych lub w medycynie.

Sprawność jest i będzie bardzo istotnym parametrem

Duża sprawność konwersji energii zawsze jest istotnym parametrem selekcji zasilacza, bez względu na przeznaczenie i moc wyjściową. W przypadku jednostek dużej mocy przekracza ona już istotnie 90%, czasem jest to już nawet ponad 95% dla pełnego obciążenia i generalnie taki rewelacyjny wynik pozwala na wykonywanie zasilaczy mniejszych, bo w nich zagadnienia związane z odprowadzaniem ciepła nie są tak bardzo uwypuklone. Większa sprawność to mniej ciepła, a więc też mniejszy zasilacz. Ponieważ mniejszy, to też tańszy, a skoro jest on podczas pracy chłodniejszy to zasilacz jest tym samym bardziej niezawodny. Są to proste zależności, które od lat zmieniają branżę od strony technologii. Mała, ale wydajna jednostka zasilająca ułatwia instalację, pozwala na lepszą integrację z konstrukcją urządzenia lub maszyny oraz z dużym prawdopodobieństwem jest nowocześniejsza od większych (starszych) rozwiązań.

Kolejny skok sprawności zapewnią nowe półprzewodniki, a więc GaN- y. Niemniej, aby trafiły pod strzechy, muszą być tańsze i dostępne, stąd cały czas zasilacze wykonane w tej technologii ogląda się niestety tylko na zdjęciach. Duża sprawność w kolejnych latach dalej będzie na topie, bo energia elektryczna drożeje. Wysoka sprawność to oszczędność energii zasilającej, a więc mniejsze rachunki, a także dzisiaj dłuższy czas pracy z danej pojemności akumulatora.

Dostępność wersji na zamówienie nie odgrywa już wielkiej roli w omawianym biznesie, bo wyrobów katalogowych jest na tyle dużo, że zawsze się da coś dopasować z typowych produktów. Podobnie jest z małymi gabarytami zasilaczy, które przy selekcji produktu nie mają wielkiego znaczenia, zapewne dlatego, że w aplikacjach przemysłowych z miejscem nie ma najczęściej problemu.

Wzmocniona izolacja, zdolność do przeciążania, superkondensatory i inne nowinki

W przypadku zasilaczy dużej mocy wiele z nowych jednostek to wersje specjalizowane, a więc takie, gdzie ich opis wymaga podania więcej informacji poza oczywistymi poziomami napięć, prądów i mocy. Trudno syntetycznie wskazać cechy, które jednoznacznie charakteryzują takie jednostki, ale można przynajmniej pokazać takie bardziej typowe.

Wiele z zasilaczy przemysłowych pozwala na chwilowe przeciążanie o kilkanaście, kilkadziesiąt procent, co jest użyteczne przy sterowaniu maszynami wyposażonymi w silniki indukcyjne lub innymi odbiornikami, np. z dużą składową pojemnościową na wejściu. Pozwala to uniknąć przewymiarowana konstrukcji i kupowania zasilacza ze sporym zapasem mocy. Wiele aplikacji potrzebuje jej przez krótki czas, a przykładem mogą być zawory, rygle oraz siłowniki i w takiej sytuacji niewielka jednostka zasilająca z możliwością przeciążania jest w rozrachunku znacznie tańsza. Gdy wymagane jest chwilowe silne przeciążanie zasilacza, w układzie najczęściej pojawiają się superkondensatory.

Zasilacze impulsowe dostarczają energii dla coraz bardziej wrażliwych układów i systemów, np. urządzeń medycznych, pomiarowych, do rozproszonych instalacji zasilanych z różnych sieci. W takich obszarach ważna jest wzmocniona izolacja, gwarantująca mały prąd upływu i potencjał resztkowy na masie. Do niedawna były one rzadkością i wykorzystywane tylko w aplikacjach medycznych, niemniej poszerzająca się oferta wskazuje, że takie jednostki trafiają także do urządzeń przemysłowych, do precyzyjnej aparatury pomiarowej oraz rozbudowanych systemów, gdzie łączone są obwody na różnych potencjałach. W takich przypadkach zasilacz o wzmocnionej izolacji jest w stanie zapewnić stabilność i jakość działania układów pomiarowych.

Użyteczna funkcjonalność, jaka pojawia się dzisiaj często w zaawansowanych jednostkach zasilających, obejmuje ponadto takie dodatki jak np. możliwość regulacji wyjściowego napięcia w niewielkim zakresie trymerem, po to, aby skompensować spadek napięcia na przewodach wyjściowych. Do tego samego celu służą zwielokrotnione zaciski wyjściowe lub też możliwość podłączenia dwóch dodatkowych przewodów pomiarowych bezpośrednio do zacisków obciążenia (tzw. połączenie kelwinowskie). Taki sposób zapewnia znakomite parametry napięcia wyjściowego (statyczne i dynamiczne) w zasilaczach dużej mocy i o niskim napięciu wyjściowym.

Za ważne uznano ponadto coraz większe znaczenie wymagań prawnych determinujących minimalne parametry zasilaczy, a więc na przykład te związane ze sprawnością, mocą pobieraną z sieci bez obciążenia, koniecznością korekcji współczynnika mocy lub też kompatybilnością elektromagnetyczną. Na razie zasilacze bazujące na najnowszych półprzewodnikach z GaN nie wpływają na rozwój rynku.

Zasilacze wyposaża się dzisiaj we wszechstronne układy zabezpieczające, rozbudowane filtry wejściowe, sterowniki zapewniające sygnalizację stanu zasilacza i podobne obwody działające na tyle skutecznie, że awaria na skutek przeciąże nia, stanu nieustalonego lub zwykłego błędu podczas montażu instalacji staje się praktycznie niemożliwa.

Szeroki zakres napięcia wejściowego to kolejny parametr, który wiele mówi o nowoczesności. Standard tanich jednostek to 100‒240 V AC, lepsze działają w zakresie 85‒265 V AC, najlepsze w jeszcze szerszych widełkach, po to, aby można było zasilać je napięciem międzyfazowym (400 V AC). Nawet jeśli nie korzystamy z sieci innej niż 230 V AC, to gdy zakres dopuszczalnych napięć jest szeroki, korzystnie przekłada się to na odporność zasilacza na krótkotrwałe zaniki napięcia i przepięcia o dużej wartości.

Od lat mówiło się, że w przyszłości instalacje elektryczne nie będą już tak bardzo scentralizowane, a więc z widocznym podziałem na elektrownie, linie przesyłowe oraz odbiorców końcowych. Jako konsekwencja tego procesu rozwój i popularność instalacji PV przyspieszyły rozwój technologii zasilania dwukierunkowego, a więc takich jednostek, które są w stanie konwertować energię w dwie strony, np. zasilając silnik napędzający urządzenie i odbierając od niego energię hamowania po to, aby ładować akumulator. Są to skomplikowane rozwiązania zasilaczy, ale powoli znajdują swoje miejsce na rynku.

Bezsprzecznie w przyszłości będziemy mieć coraz więcej instalacji lokalnych generujących prąd ze słońca lub wiatru. Dużo się też mówi o lokalnych magazynach akumulatorowych do gromadzenia nadwyżek z instalacji odnawialnych lub odzysku energii z układów mechanicznych w transporcie. Oznacza to, że falowniki dwukierunkowe i zasilacze dużej mocy będą się popularyzować.

Oświetlenie LED

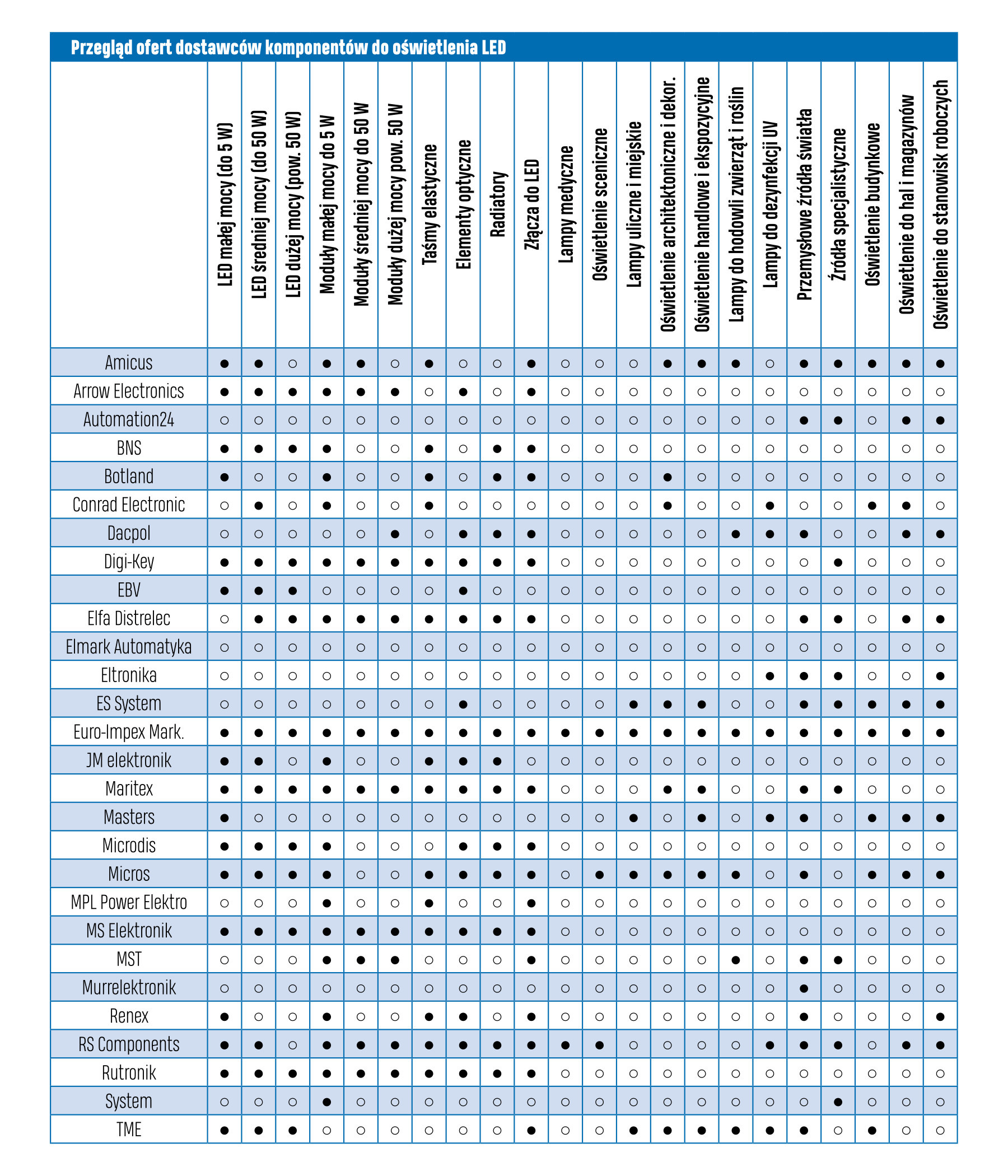

Oświetlenie LED to nie tylko diody. Nowoczesna oprawa oświetleniowa wymaga zasilania, układu optycznego, chłodzenia oraz istotnych drobiazgów, takich jak regulacja jasności, barwy lub komunikacji. W ostatnich latach coraz większe znaczenie zyskują nie tylko same źródła LED i oprawy oświetleniowe, ale przede wszystkim systemy zasilania i sterowania. Coraz bardziej liczy się integracja wszystkich komponentów w całość, aby razem dało to nowoczesny i funkcjonalny produkt.

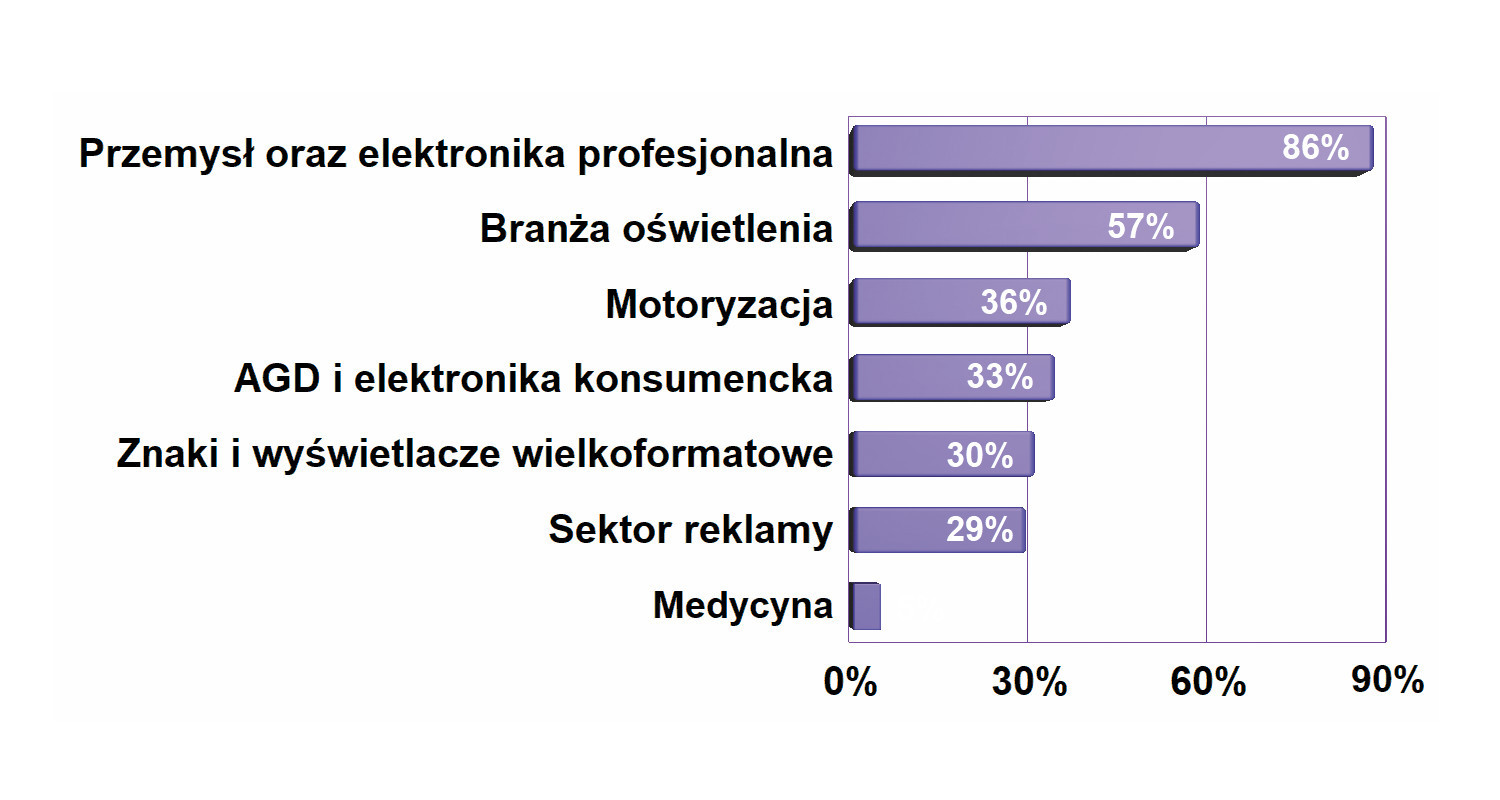

Pozytywnym zjawiskiem wspierającym branżę oświetlenia LED jest to, że mamy w kraju licznych producentów, z czego wiele tych firm zajmuje się rozwiązaniami specjalistycznymi, o dużej funkcjonalności i jakości.

Podobnie jak w wielu innych branżach zmagają się one z tanimi produktami importowanymi z Dalekiego Wschodu. Szansy szukają w dużej specjalizacji, produktach o atrakcyjnym wzornictwie lub tworząc projekty dopasowane ściśle do obiektów lub urządzeń. Częścią rynku oświetlenia diodowego są też firmy EMS-owe.

Rozwój rynku kieruje się dzisiaj w stronę zastosowań specjalistycznych, bo branża konsumencka nie daje już wielu możliwości.

Innowacyjne rozwiązania to np. lampy przemysłowe, budynkowe, z certyfikatami Atex, DNV, górniczymi, GOST-R, z wbudowaną "inteligencją" sterowania i komunikacji w sieciach mesh, o wysokiej jakości światła (oddawanie kolorów, temperatura barwowa) i podobne. Spory potencjał ma oświetlenie biurowo-budynkowe o nowoczesnym i modnym wyglądzie, które pozwala nadać pomieszczeniom indywidualny charakter i zapewnić wysoką funkcjonalność. Oprawy tego typu mają dużą powierzchnię świecącą, dzięki czemu nie wywołują cieni i nie męczą oczu, a poza tym można je wbudować w sufit lub ściany.

Przeniesienie ciężaru rozwoju rynku w taką stronę jest w części efektem tego, że klienci kupujący oświetlenie LED do zastosowań pozakonsumencko-domowymi stawiają na jakość i trwałość produktów i interesują się innowacyjnymi projektami. To zainteresowanie jakością i funkcjonalnością nie bierze się z przypadku, można je traktować jako odpowiedź rynku na zalew tanich produktów z Azji.

Wszystko dzisiaj jest "smart", oświetlenie także

Pojawiające się na rynku oświetlenie LED- owe ma coraz wyższą funkcjonalność w porównaniu do tradycyjnych źródeł, a niektóre żarówki i oprawy można już określać mianem inteligentnych. Lampy takie można łączyć w sieć za pomocą protokołu komunikacyjnego DALI, co umożliwia dalsze oszczędności poprzez dopasowywanie parametrów oświetlenia do aktualnych potrzeb, selektywne wyłączanie/ włączanie, regulację jasności. Oprawy są integrowane ze zdalnym sterowaniem opartym na transmisji przewodowej lub bezprzewodowej, co pozwala na bieżący monitoring oraz inteligentne sterowanie oświetleniem za pomocą pilota lub smartfona. Ponieważ LED- y nie mają bezwładności świetlnej, a częste gaszenie i zapalanie nie powoduje pogorszenia trwałości, mogą być tworzone systemy oświetlenia na żądanie, a więc zapalającego się tylko na chwilę i w danym miejscu, gdy jest to potrzebne, np. z wykorzystaniem zintegrowanego czujnika ruchu PIR. Inteligentne lampy pozwalają na zaprogramowanie czasu włączenia i wyłączenia, ustawienie temperatury barwowej i jasności.

Budowanie świadomości rynku

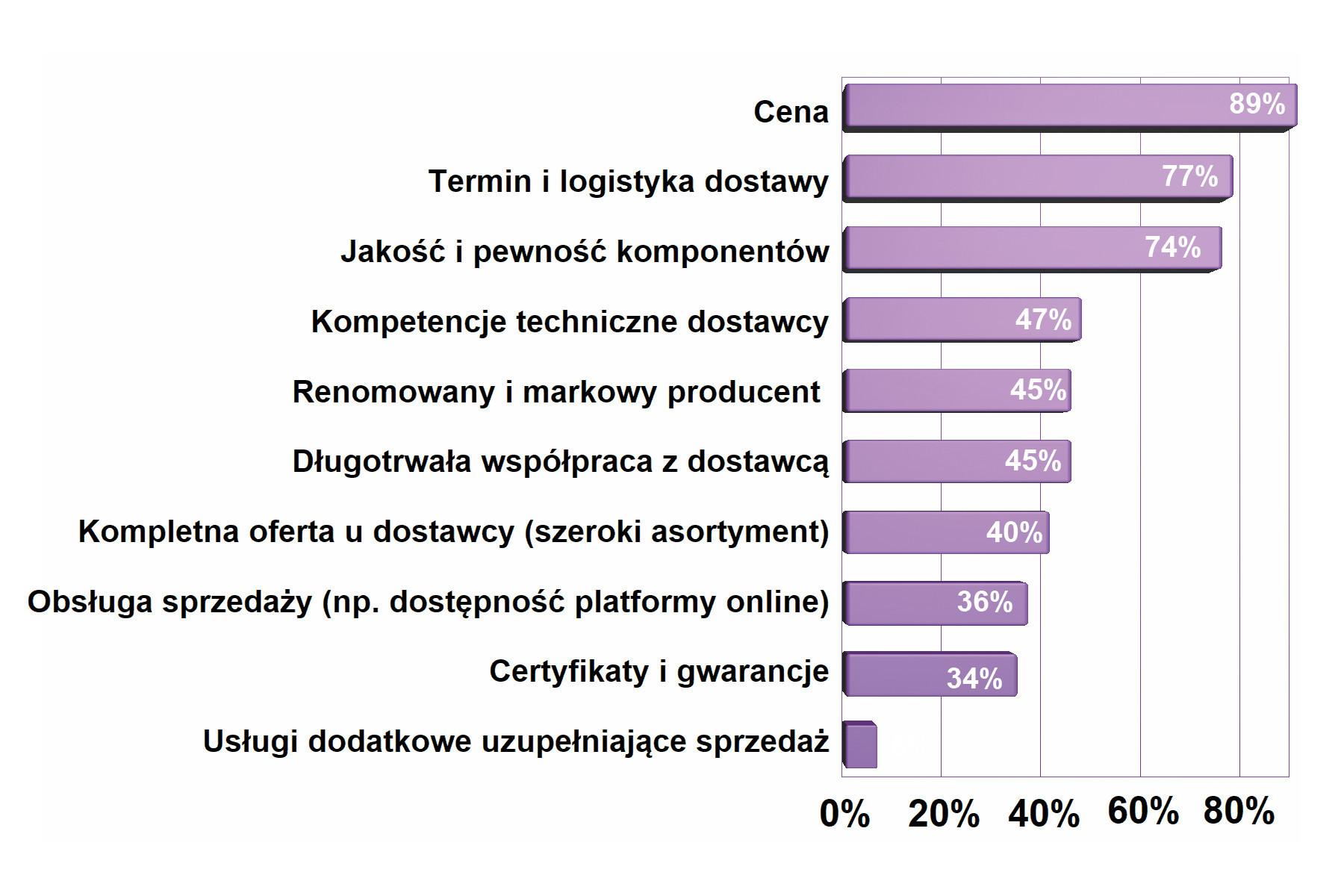

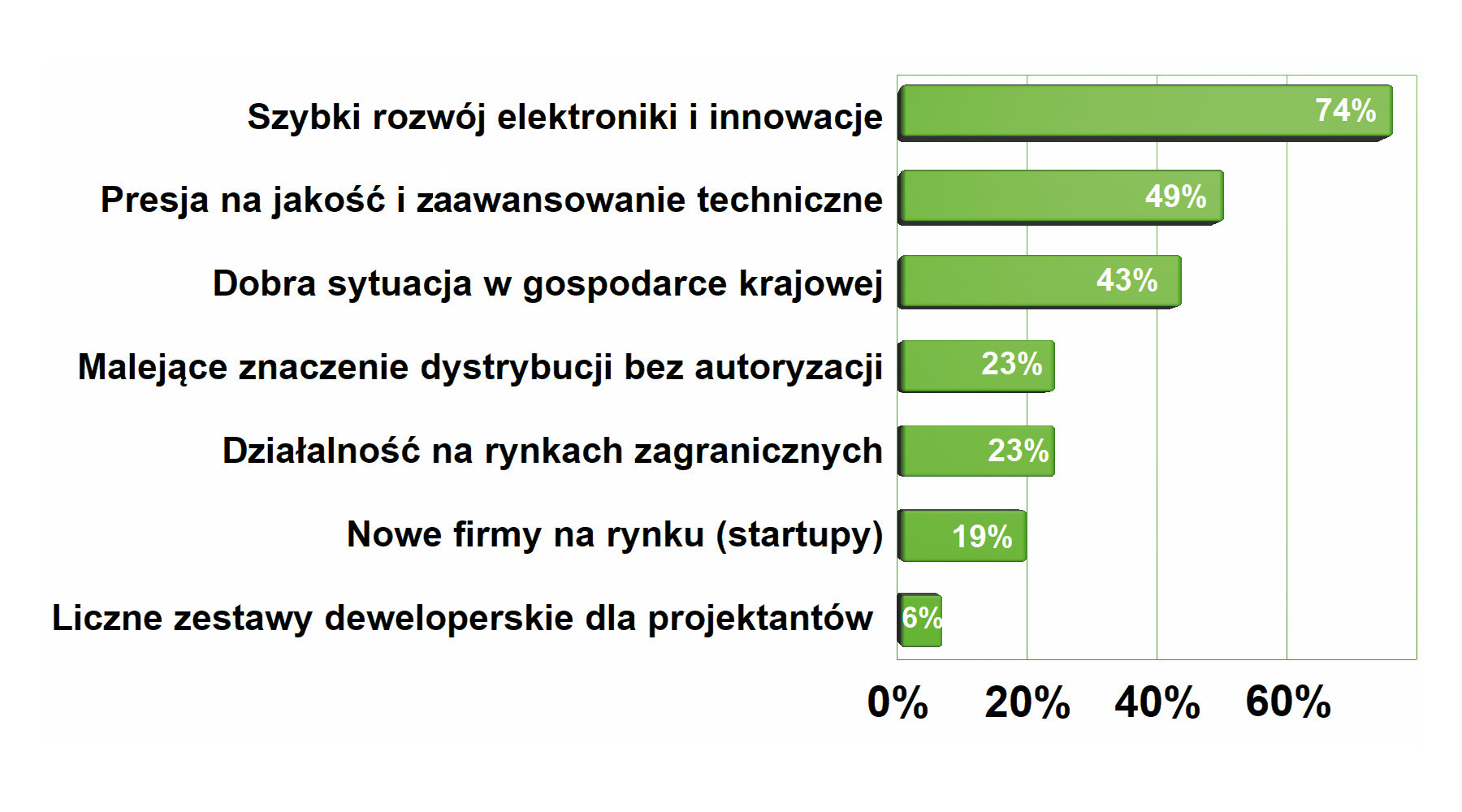

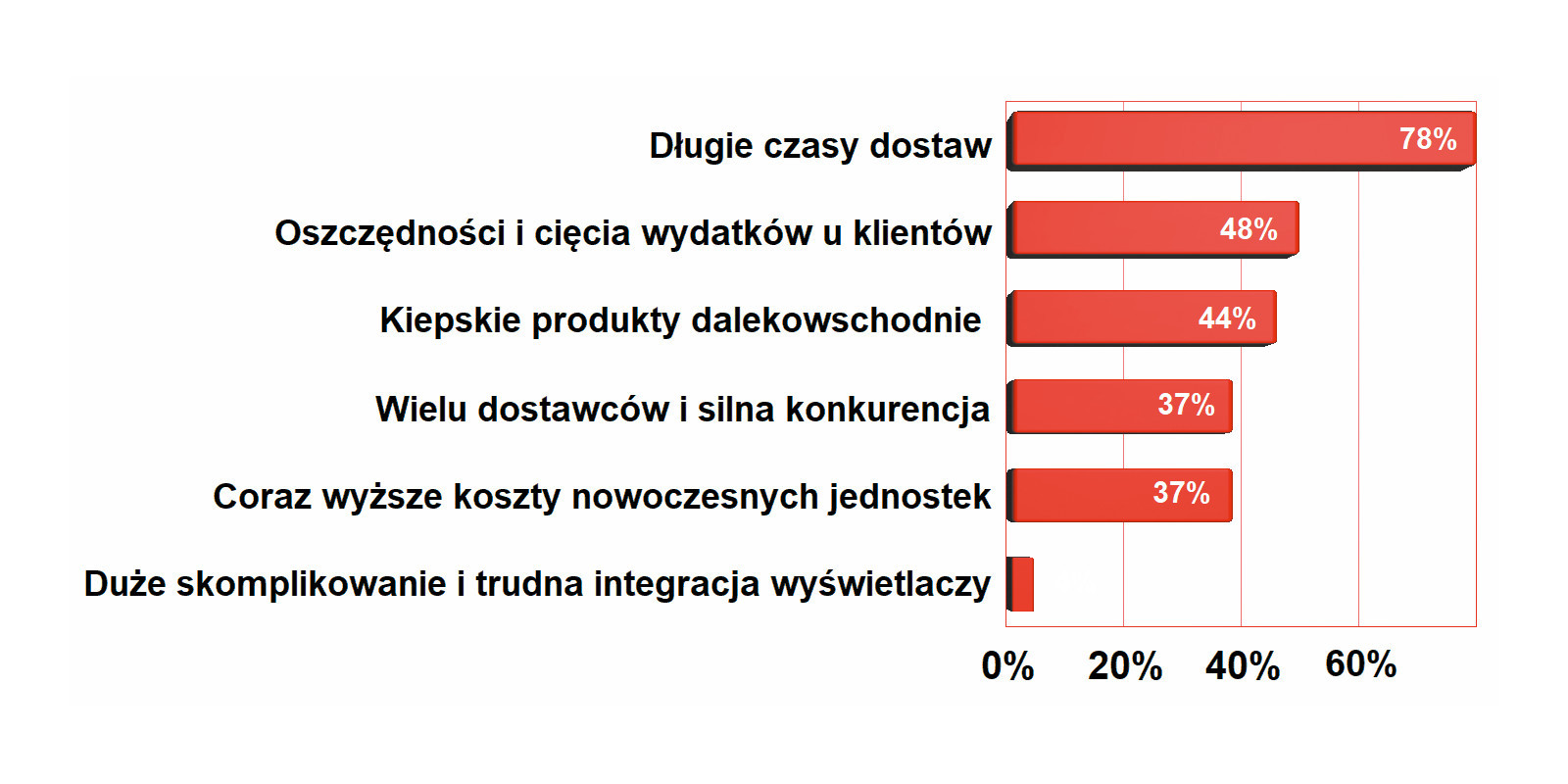

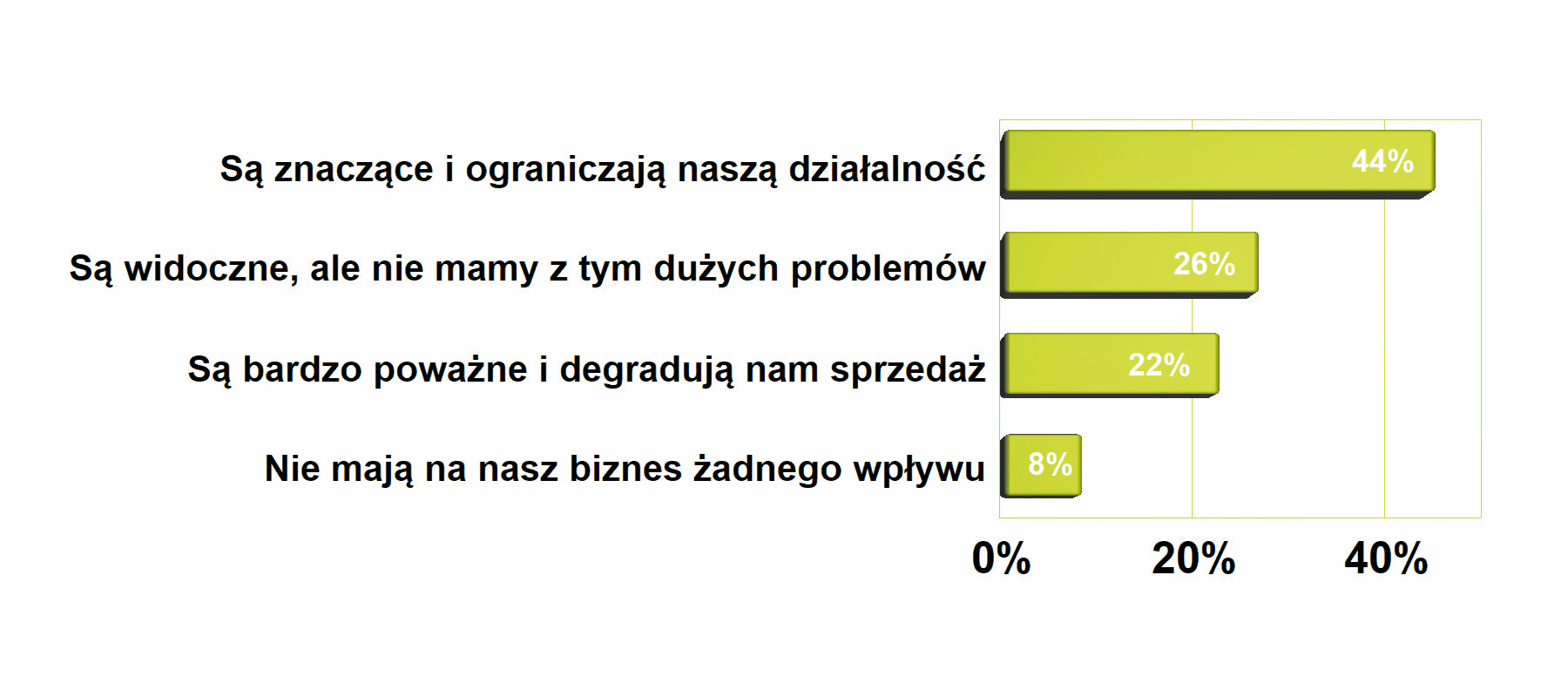

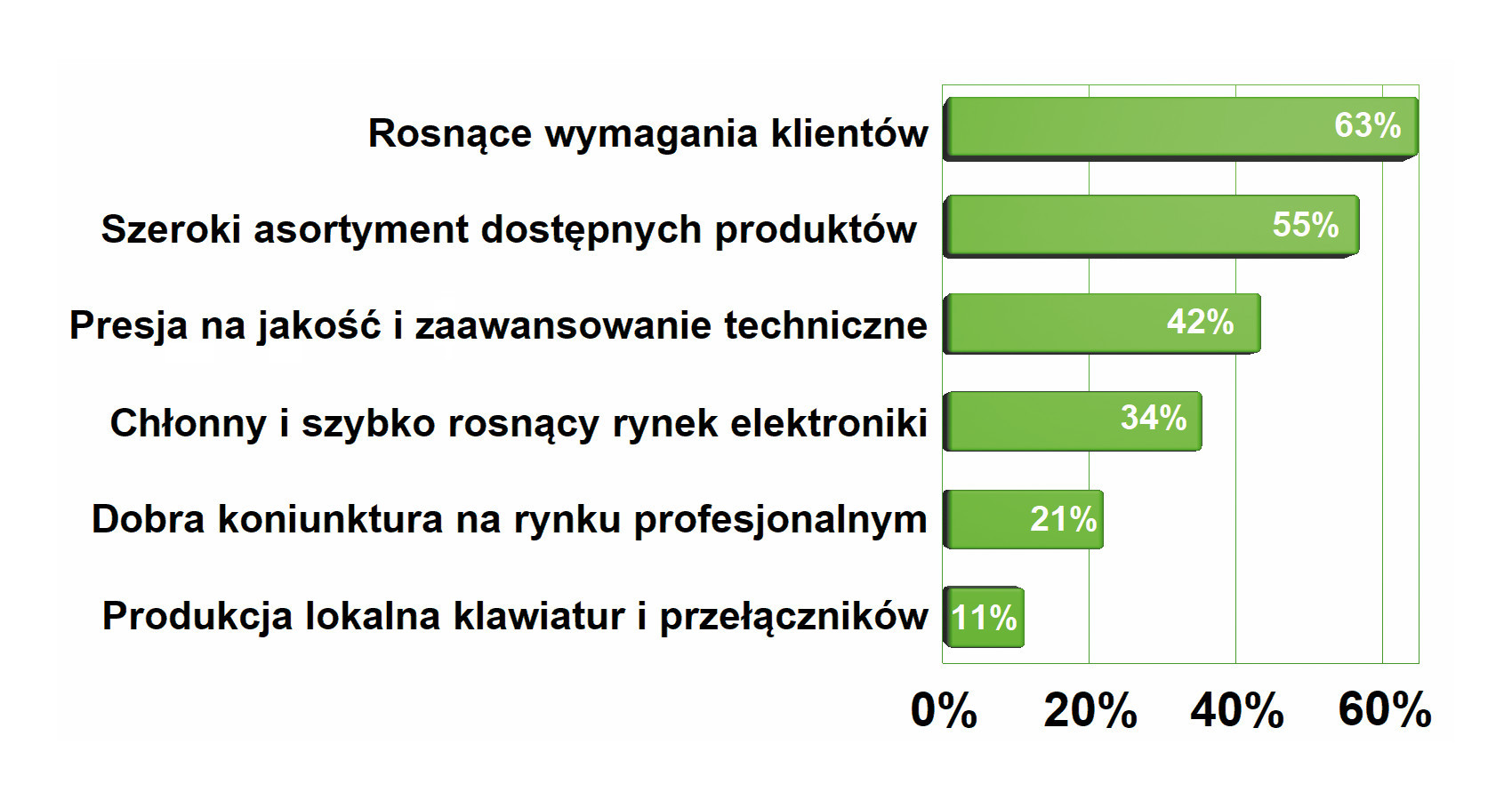

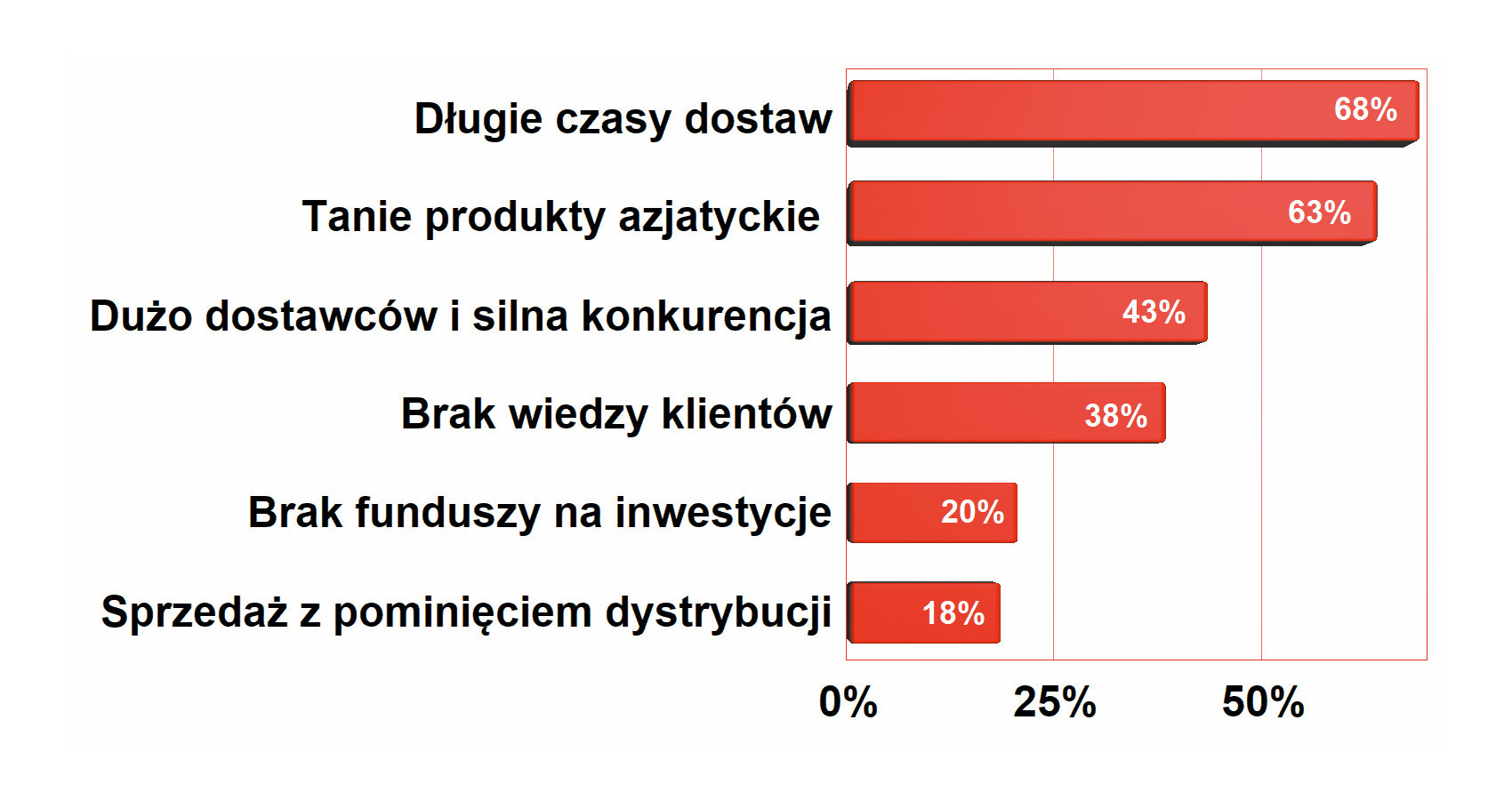

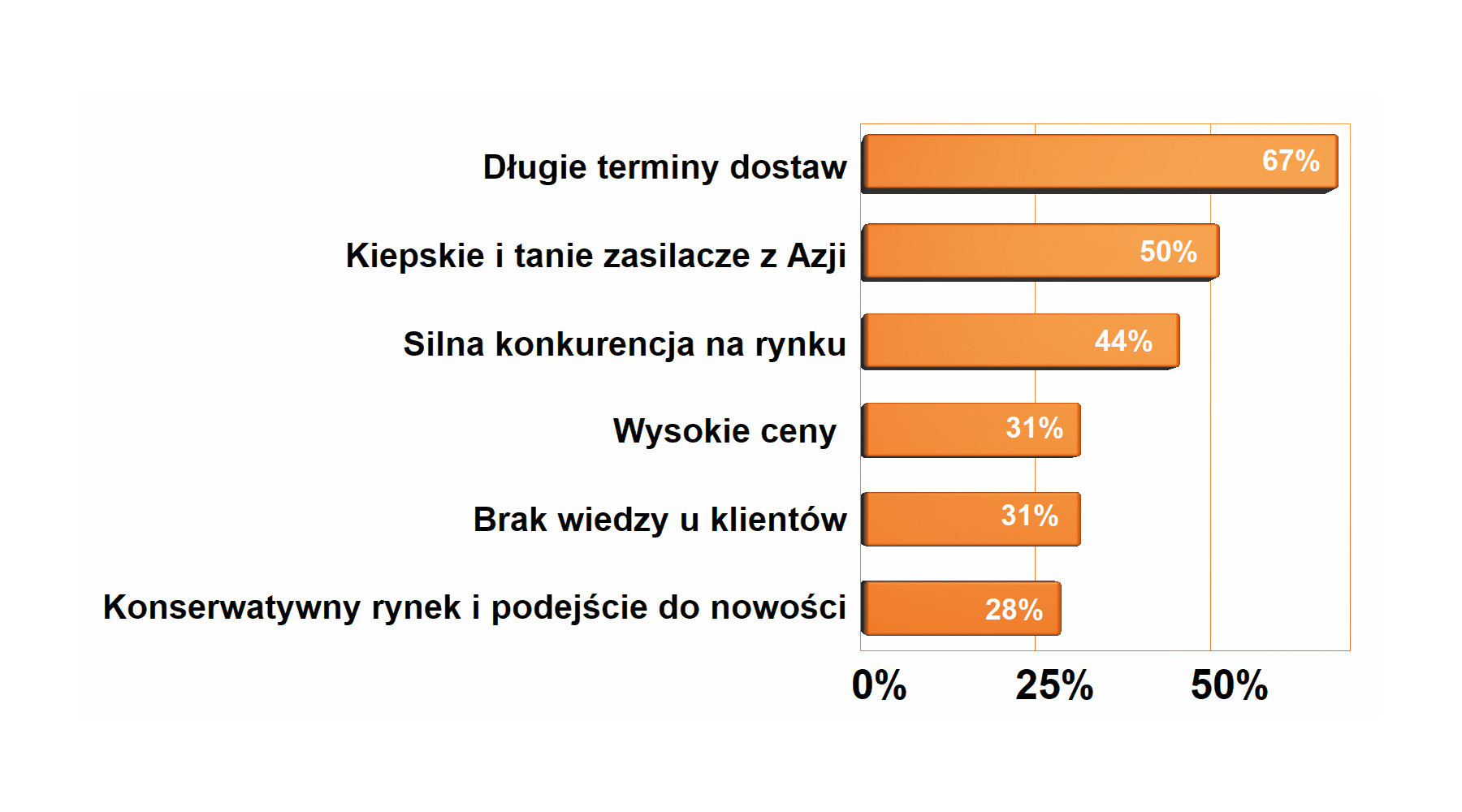

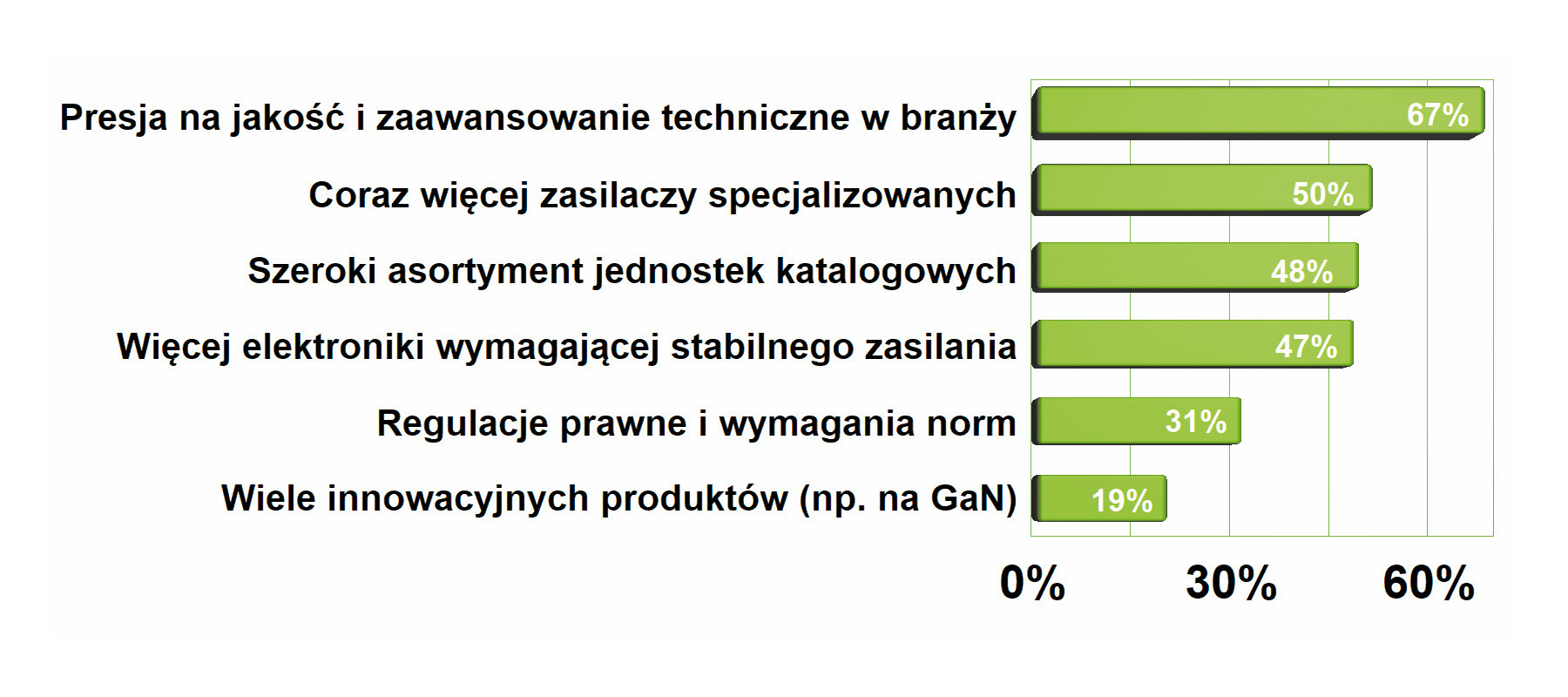

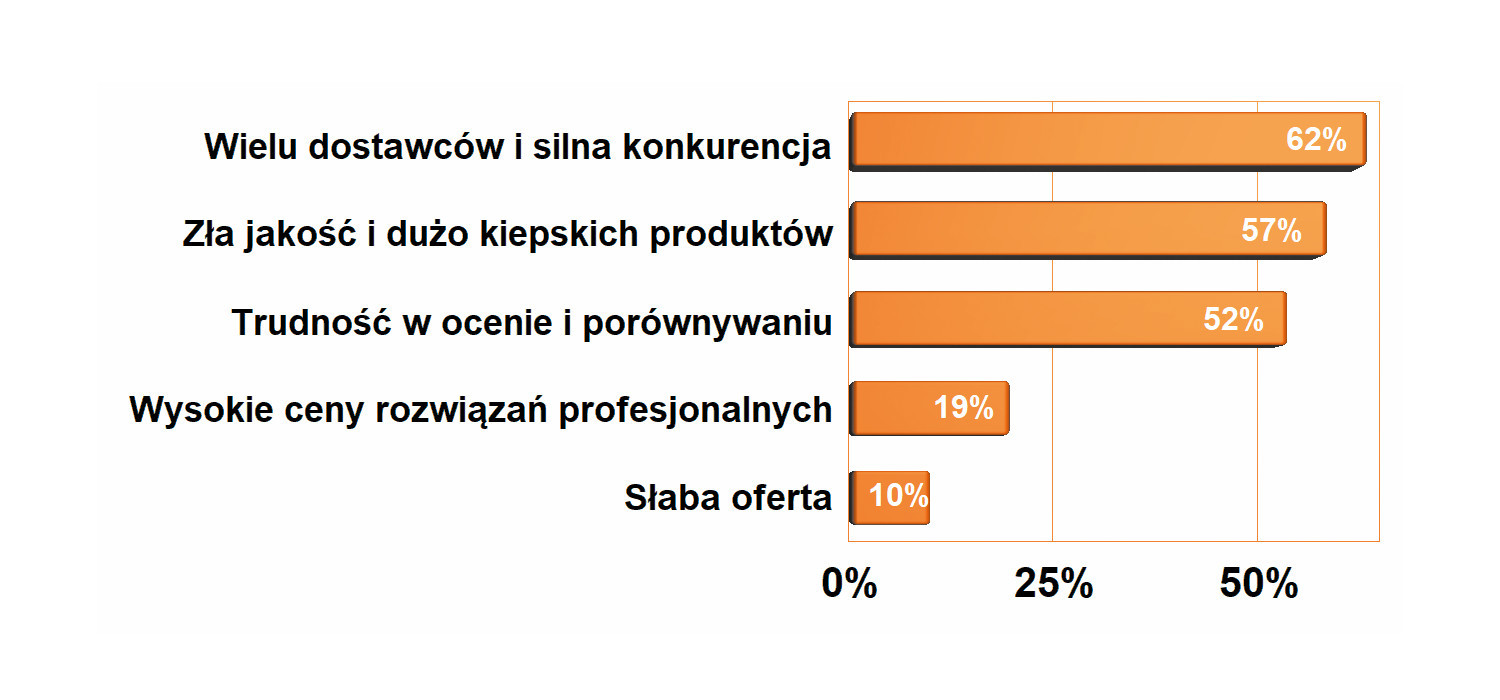

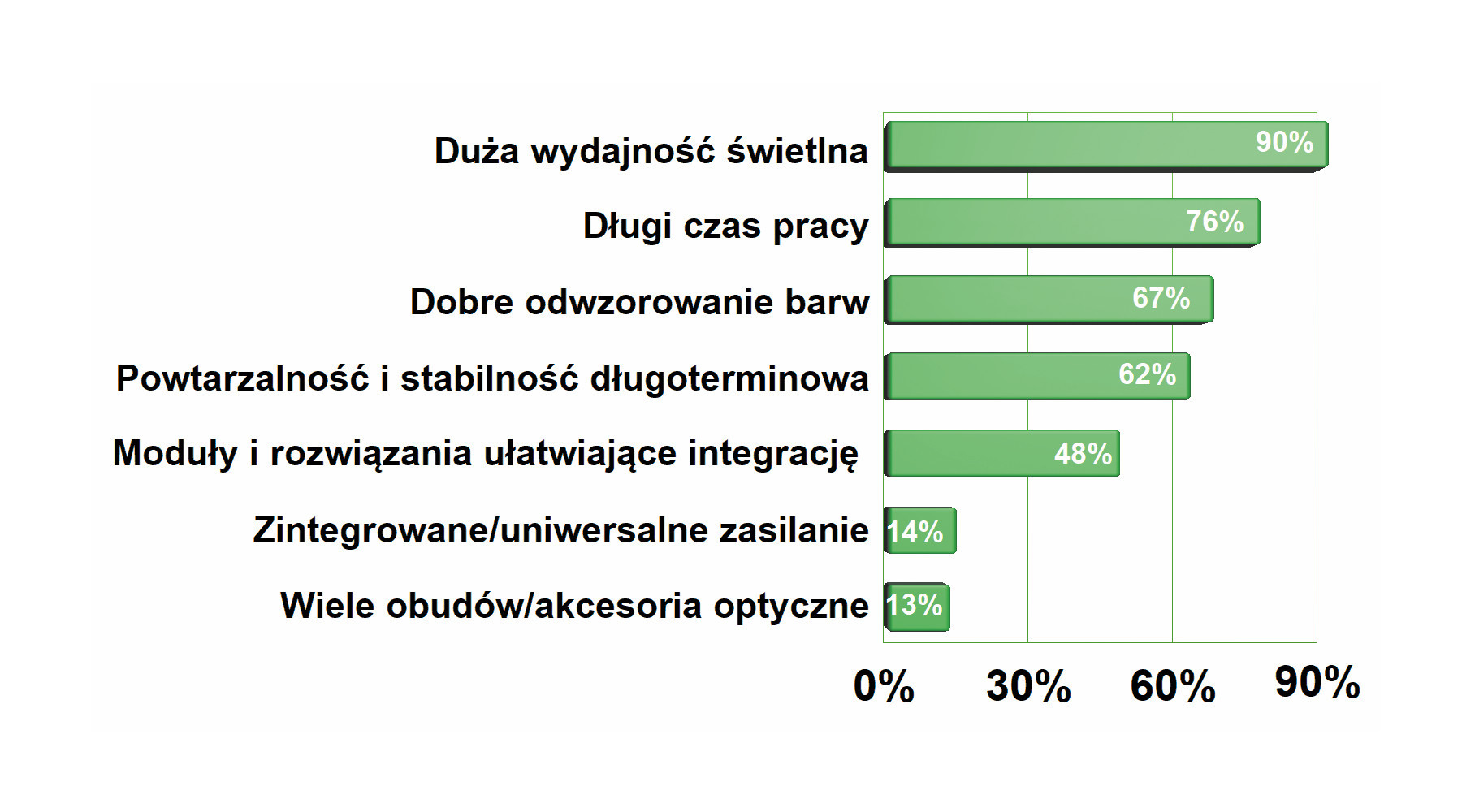

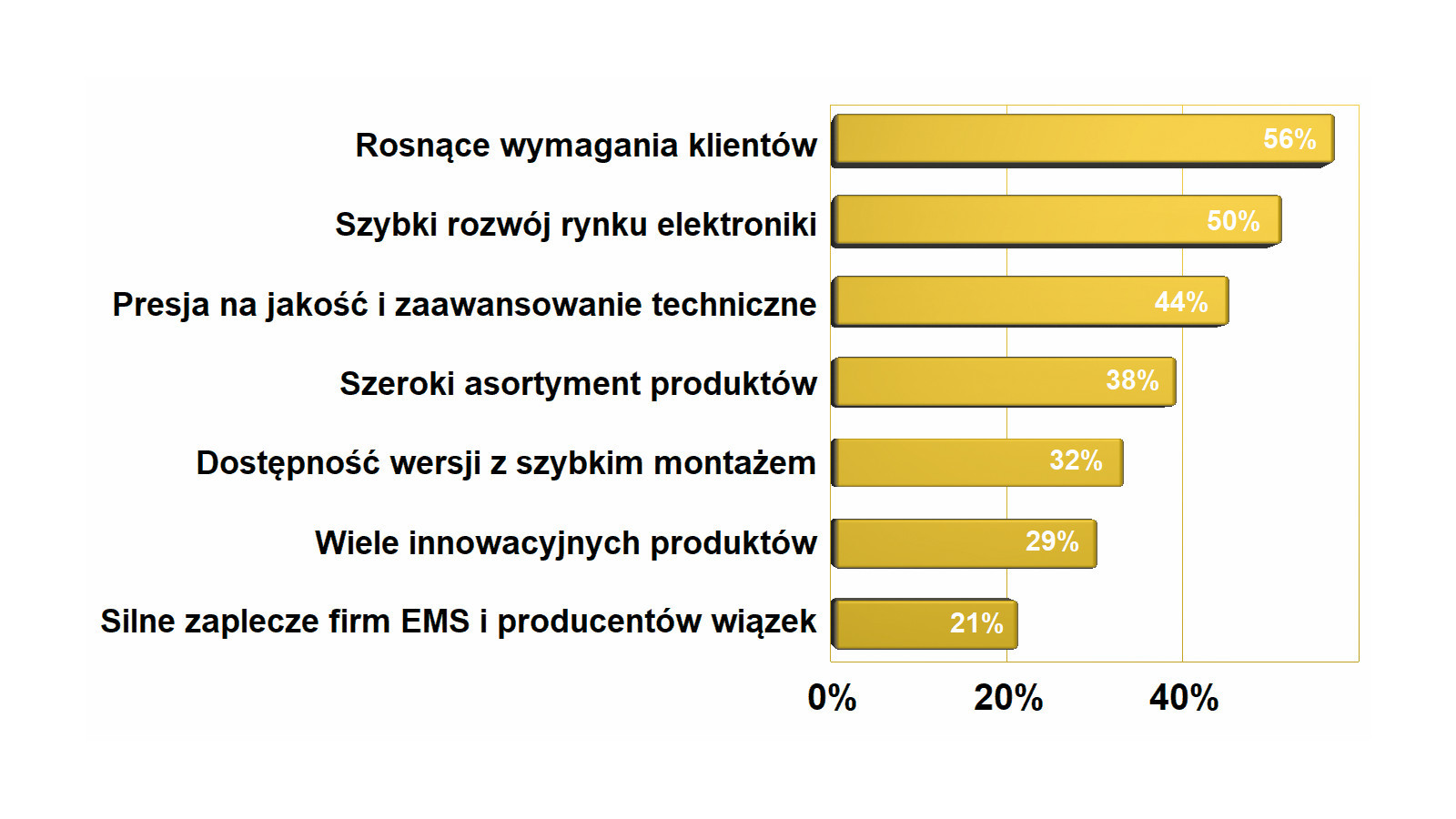

Aby zaawansowane produkty o wysokiej jakości przebijały się na rynku i były wybierane przez klientów jako te bardziej wartościowe, musi za nimi iść większa świadomość rynku, wiedza kupujących na temat, jak te dobre cechy weryfikować, na co zwracać uwagę oraz co jest istotne, a co nie. Jak wynika z naszego badania ankietowego z tą świadomością nie jest najlepiej, bo czynnik ten jest wskazywany jako jeden z najważniejszych hamulców dla rozwoju (patrz wykresy). Z tej przyczyny w tym opracowaniu koncentrujemy się głównie na aspektach technicznych oświetlenia diodowego. Opisujemy mniej znane zagadnienia, wyjaśniamy prostym językiem szczegóły związane z parametrami optycznymi, bo chcemy razem z innymi specjalistami budować tę wiedzę rynku. Wiemy też, że o fachowe publikacje nie jest łatwo i dlatego staramy się pomóc.

Produkty o złej jakości – temat wiecznie aktualny

Jednym z większych problemów trapiących rynek oświetlenia ledowego jest to, że wiele produktów to po prostu tandeta. W przypadku źródeł światła słabe parametry to głównie mała wartość współczynnika reprodukcji barw testowych CRI, brak powtarzalności tj. duże rozrzuty między kolejnymi diodami oraz mała trwałość, czyli szybki spadek wartości strumienia świetlnego w czasie. Ten ostatni parametr jest prawdopodobnie najrzadziej definiowany, a szkoda, bo przecież decyduje o opłacalności wielu inwestycji.

Zasadniczym problemem z oceną źródeł światła jest to, że przeciętny konsument nie ma żadnych narzędzi do weryfikacji tego, co podaje producent na etykiecie. W praktyce jest jeszcze gorzej, bo parametrów podaje się niewiele, te niewygodne pomija lub zbywa jakimś uogólnieniem, np. Ra>70. Na taśmach LED-owych logotyp producenta jest rzadkością, tak samo jak symbol produktu, a pojęcie karty katalogowej ze specyfikacją jest znane tylko nielicznym.

Sytuacja w zakresie jakości produktów do zastosowań przemysłowych jest lepsza, ale niestety oświetlenie ma ogromną część wspólną dla różnych branż i często aplikacje konsumenckie przeplatają się z profesjonalnymi w określonych miejscach lub u klientów i tym samym zła jakość jednych wyrobów ciąży na postrzeganiu innych. Podobnie jest z poziomem cen i oczekiwaniami kupujących, które też bywają podatne na stereotypowe podejście.

Jakość reprodukcji barw, czyli CRI

Głównym problemem tanich diod LED o kolorze białym, które są przeznaczone do celów oświetleniowych, jest reprodukcja barwy czerwonej.

Uzyskanie wysokiej wartości współczynnika CRI (Color Rendering Index) wymaga takiego przygotowania charakterystyki widmowej, żeby emisja źródła nie była "punktowa", ale była odpowiednio rozłożona w całym widmie widzialnym, od fioletu po głęboką czerwień. Rozkład energii promieniowania w widmie widzialnym (SPD, Spectral Power Distribution) musi odpowiadać czułości oka ludzkiego oraz specyfice postrzegania oświetlenia przez człowieka (tzw. charakterystyka obserwatora).

Nie wystarczy "złożyć" białego światła z trzech barw podstawowych za pomocą diody RGB z trzema chipami, gdyż wygenerowane trzy prążki nie zapewnią równomiernego pokrycia całego zakresu widzialnego. Dlatego w zastosowaniach oświetleniowych wykorzystywane są diody świecące w kolorze niebieskim lub fioletowym. Ich światło pobudza do świecenia luminofor, którym struktura półprzewodnikowa LED jest od góry przykryta. Dopiero warstwa tego materiału świeci w kolorze białym. Podobnie działają świetlówki, które wykorzystują zjawisko pobudzania luminoforu świecącego na biało za pomocą emisji w ultrafiolecie zachodzącej w parach rtęci pod niskim ciśnieniem.

Cienka warstwa luminoforu niedokładnie zasłania strukturę LED, co wywołuje wzrost emisji w zakresie barw niebieskich. W tanich diodach światło to przebija przez tę warstwę i wywołuje silny pik w zakresie krótszych długości fal. W konsekwencji relatywna emisja w całej reszcie charakterystyki widmowej staje się mniejsza, a takie zakłócenie w konsekwencji prowadzi do nierównomierności i pogorszenia parametrów takich jak CRI (patrz ramka).

Poza tym używany w diodach luminofor jest mieszaniną wielu minerałów, z których każdy świeci w określonym zakresie (barwie). Wszystkie te materiały, połączone lepiszczem w formie mieszaniny ziarenek, pobudzane są wspólnie przez światło niebieskie wytwarzane przez strukturę półprzewodnikową. Aby światło dostarczane przez luminofor było wysokiej jakości, a więc charakteryzowało się dużą wartością współczynnika CRI, proporcje składników i użyte minerały muszą zostać precyzyjnie dobrane. Największy problem jest z składnikiem od barwy czerwonej, bo luminofor w tym kolorze bazuje na pierwiastkach ziem rzadkich i jest drogi. Dodatkowo konwersja emisji niebieskiej z LED-a na czerwoną jest mniej wydajna od tej dla innych barw. Można w uproszczeniu wyjaśnić to tym, że różnica długości fali między pobudzeniem niebieskim, a emisją czerwoną jest znacznie większa niż dla np. barwy zielonej. W diodzie wystarczy więc do efektywnego działania mała ilość składowej luminoforu niebieskiego i zielonego, bo ma on dużą wydajność, ale trzeba użyć dużo ziaren czerwonych, bo tu konwersja długości fali jest znacznie gorsza.