Rynek komputerów jednopłytkowych jest bardzo rozproszony i podzielony między licznych producentów skupionych wokół branżowych organizacji zajmujących się promocją i rozwijaniem standardów (wymiary, złącza, konfiguracje), jak PICMG. Konsolidacje i akwizycje ostatnich lat także zmieniają krajobraz, a nierzadko przetasowania wynikają także z tego, że na rynku pojawiają się nowi gracze. Lista producentów jest w tym przypadku bardzo długa (blisko 40 firm), co powoduje, że konkurencja jest silna, a tempo zmian i ewolucji technicznej produktów relatywnie szybkie. Takie firmy to m.in. Digi, VersaLogic, Wandboard, Eurotech, Advantech, Kontron, Adlink, Radisys, Mercury Systems, Winsonic, Syslogic, Qbic, American Portwell, Arbor Solutions, Aaeon, Diamond Systems, iEi, Avalue, Variscite, DFI, Congatec, iBase, MPL, Protech i wiele innych. Mamy też krajowe firmy, które projektują i produkują takie jednostki, jak na przykład Grinn i SomLabs.

Bezsprzecznie sektor komputerów jednopłytkowych z każdym kolejnym rokiem staje się coraz bardziej otwarty dla przeciętnego konstruktora, a coraz niższe ceny i większa dostępność sprawiają, że dostęp do tych rozwiązań jest praktycznie nieograniczony. Rynek SBC przenika się ponadto ze światem tradycyjnych pecetów, z których rozwiązania w postaci nowych wersji miniaturowych płyt głównych stają się bazą dla komputerów przemysłowych, jak na przykład Pico-ITX (100×72 mm).

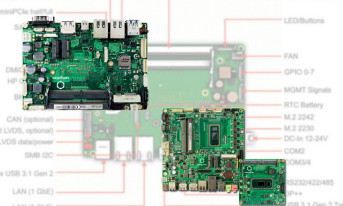

Oprócz nastawienia na coraz większą miniaturyzację, producenci zwracają uwagę głównie na możliwości rozbudowy komputera o kolejne interfejsy we/wy. Poprzez specjalizowane złącze (np. na spodzie płytki SMARC) tworzą w ten sposób rozwiązania podobne do kanapki, które do tej pory były wykorzystywane w rzadziej już stosowanych komputerach PC/104. Wprowadzanie kolejnych generacji energooszczędnych procesorów Intel Atom, Celeron czy Pentium spowodowało, że producenci wypuszczają na rynek nowe modele komputerów SBC z interfejsami do tej pory niewystępującymi, jak np. dla pamięci dyskowej w postaci złączy M2.

Konkurencja ze strony platform open source

Na rynku elektroniki profesjonalnej zawsze dało się wyróżnić trend polegający na używaniu sprzętu o gorszych parametrach w wymagających aplikacjach. Najczęściej dotyczyło to zakresu temperaturowego i urządzeń przeznaczonych do pracy na zewnątrz budynków, także tych działających w trudnych warunkach przemysłowych, systemach monitoringu i bezpieczeństwa oraz podobnych zastosowaniach.

Komputery, nośniki pamięci, kamery, sprzęt infrastruktury sieciowej i telekomunikacyjny do takich aplikacji musi mieć możliwość pracy w zakresie temperatur od –40 do +70ºC i za ten szeroki zakres trzeba było zapłacić dużo więcej niż za równoważne rozwiązania konsumenckie (0–40ºC). Przebitka była na tyle duża, że plagą rynku było aplikowanie sprzętu konsumenckiego w takich zastosowaniach, całkowicie bezmyślnie, a więc ze złudną nadzieją, że będzie mimo to działać lub ze wspomaganiem w postaci np. termostatu, dodatkowego chłodzenia itd. To samo dotyczyło nośników pamięci Flash, gdzie tanie produkty konsumenckie trafiały do wymagających rozwiązań profesjonalnych. Podobne działania miały miejsce w urządzeniach wojskowych, gdzie mówiło się o produktach COTS, a więc właśnie zmodernizowanych, ulepszonych urządzeniach komercyjnych, które przystosowano do pracy w sprzęcie wojskowym. To dostosowanie polegało na rozbudowie chłodzenia, hermetyzacji itd. Tematy te były bardzo nośne jeszcze dekadę temu, ale obecnie kompletnie zeszły na margines.

Powody mają charakter ekonomiczny i techniczny. Ten pierwszy wiąże się z tym, że większa konkurencja, szersza oferta rynku, większa liczba producentów i dystrybutorów aktywnych w temacie komputerów jednopłytkowych zmniejszyła różnicę między produktami różnych typów. Można powiedzieć, że to te profesjonalne są dzisiaj relatywnie tańsze, zwłaszcza w odniesieniu do zarobków, poziomu cen innego sprzętu technicznego itd. Sam rynek elektroniki jest dzisiaj znacznie większy i stąd wolumeny sprzedaży są większe, dzięki czemu koszty stałe przedsiębiorstw rozkładają się na większą liczbę sztuk.

Druga przyczyna ma charakter techniczny i wiąże się ze wzrostem zaawansowania technologii półprzewodnikowej. Nawet tanie chipy działają w szerokim zakresie temperatur i granice między tymi do zastosowań profesjonalnych i konsumenckimi nie są tak wyraźnie rozdzielone. Procesory nie zawsze są też wydzielonymi chipami, a więc wykonywanymi w osobnym procesie i zamykane w obudowach. Wiele produktów ma je zintegrowane w ramach układu SoC razem z pamięcią, pomocniczą logiką itp. Jest to możliwe, ponieważ procesor można kupić jako kod VHDL w postaci bloku IP i zintegrować go z niezbędną resztą na jednym płatku krzemu. Takie SoC produkowane są na tych samych urządzeniach co inne i stąd zwykle mają doskonałe parametry temperaturowe.

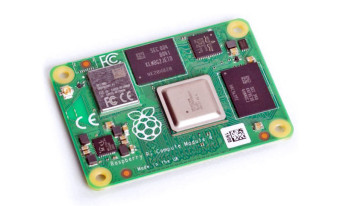

Skutkiem tych procesów jest to, że tanie i popularne komputery jednopłytkowe, czego doskonałym przykładem może być Raspberry Pi, mają całkiem dobre parametry środowiskowe i są z powodzeniem aplikowane w aplikacjach komercyjnych, odbierając rynek rozwiązaniom specjalizowanym (dedykowanym).

Platformom open source najbardziej brakuje wieloletniej dostępności, przez co ich możliwości aplikacyjne sięgają jedynie obszaru półprofesjonalnego, a więc takiego o łagodnych wymaganiach.

Customizacja

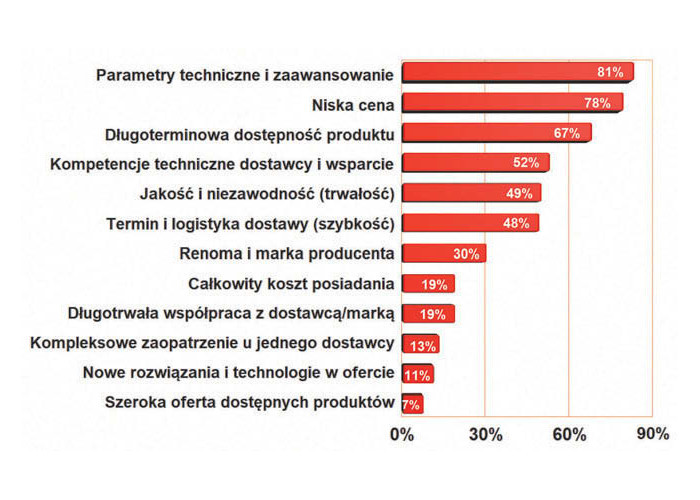

Komputer jednopłytkowy to dzisiaj produkt, który jest dostępny w bardzo wielu wykonaniach, wersjach, typach, różniących się wyposażeniem, możliwościami i ceną. Celem jest to, aby zaproponować klientowi produkt jak najlepiej dopasowany do jego potrzeb, bez konieczności przepłacania za niewykorzystywane interfejsy, złącza, pamięć, komunikację itd. Ponieważ cena takiego produktu jest ważnym czynnikiem aplikacyjnym, takie działania sprzyjają konkurencyjności komputerów jednopłytkowych w porównaniu do innych rozwiązań.

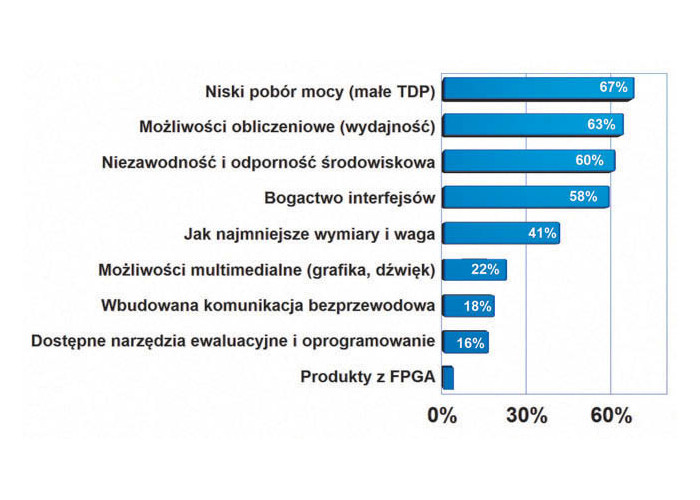

Istotność danej cechy komputera SBC zależy od typu rynku, na jakim działa klient, czy ma dużą konkurencję oraz przeznaczenia produktu. Mnogość różnych modeli, formatów płytek, pozwala na dobór odpowiedniego rozwiązania, a przy większych zamówieniach jest możliwość modyfikacji w postaci dodania czy usunięcia interfejsów, dodania funkcjonalności BIOS-u itp.). Niektórzy producenci idą jeszcze dalej i podejmują się produkcji rozwiązania typu custom lub semi-custom nawet dla małych zamówień. Wymaga to od nich odpowiedniej organizacji, ale można podać przynajmniej jeden przykład firmy, która się tego podejmuje (Advantech).

Mała seria = duży problem

W warunkach krajowych komputery jednopłytkowe są postrzegane jako istotny produkt, bo wytwarza się krótkie serie specjalistycznych urządzeń, do których nie opłaca się tworzyć własnego sterownika. Próg opłacalności określający minimalną skalę realizowanej produkcji własnej, która jest niezbędna do tego, aby taka konstrukcja miała sens ekonomiczny, z upływem lat jest coraz mniejszy i określa się na około 4–5 tys. sztuk rocznie. W realiach krajowych to dość dużo, co skutecznie wybija z głowy pomysły rozwijania własnych platform.

Niemniej duża część rozwiązań przemysłowych jest w Polsce realizowana jako projekty tworzone przez integratorów, firmy inżynierskie lub producentów specjalistycznych urządzeń na zamówienie. Tak zdefiniowany obszar działania obejmuje rozwiązania liczone w pojedynczych sztukach, przez co nawet aplikacja komputerów jednopłytkowych napotyka barierę opłacalności i czasu.

Przy takich małych ilościach w zdecydowanej większości przypadków zastosowanie komputera jednopłytkowego wiąże się z ogromem dodatkowej pracy niezbędnej do przygotowania obudowy zapewniającej wymaganą ochronę przed oddziaływaniem środowiska zewnętrznego, dobrej jakości układu zasilania, wymaganych peryferii oraz przygotowania płytki bazowej. Dodatkowo takie urządzenie w celu uzyskania odpowiedniego certyfikatu musi zostać przetestowanie pod względem prawnej pracy w różnych warunkach np. pod wpływem niskiej lub wysokiej temperatury. Cały ten proces jest kosztowny i pracochłonny. W przypadku większych projektów jest to opłacalne, bo dostarczane jest urządzenie szyte na miarę. Niemniej wielu klientów woli drogę na skróty, czyli użycie gotowego komputera z półki (typu Box). W przypadku niewielkiego projektu fakt, że dane urządzenie nie będzie idealnie dopasowane do danej aplikacji (przykładowo tylko niewielka liczba dostępny portów będzie wykorzystana), nie jest taki istotny, ponieważ w porównaniu do rozwiązania opartego na SBC, relatywne koszty integracji będą niższe, a czas wprowadzenia produktu na rynek (time to market) zdecydowanie krótszy. Koszt pracy inżynierskiej ma coraz większy udział w przygotowaniu produktu i każde działanie, które prowadzi do oszczędności czasu i wysiłku włożonego w przygotowanie sprzedaży, ma realny wymiar cenowy.

Miniaturyzacja i mały pobór mocy

Niewielki pobór mocy przy zachowaniu dużej wydajności obliczeniowej jest najważniejszym trendem technicznym zmieniającym nie tylko rynek komputerów jednopłytkowych, ale całą elektronikę. Efektem tego procesu jest to, że wielkość komputerów głównie ograniczają złącza i obudowa, a wzrost wydajności obliczeniowej przestał być czymś, do czego się bardzo dąży. Najbardziej widać to w zakresie pecetów, ale w przypadku omawianych urządzeń też daje się to dostrzec.

Skoro można kupić peceta w obudowie wielkości pendrive'a, to także w zakresie komputerów do zastosowań embedded gotowe rozwiązania są nieduże. To po raz kolejny potwierdza, że w wielu zastosowaniach dobrym wyborem staje się wykorzystanie komputera typu Box, a więc małe jednostki w obudowie chłodzone pasywnie, bo jest ona tylko nieznacznie większa, tylko trochę droższa, ale ma już rozwiązany problem chłodzenia, zasilania, złączy i mocowania (np. na szynę DIN, VESA itd.). A do komputera jednopłytkowego, np. takiego w postaci modułu o wielkości równoważnej pamięci DRAM, do urządzenia trzeba jeszcze dodać płytę bazową, której przygotowanie też jest czasochłonne i kosztowne, zwłaszcza gdy seria jest mała.

IoT i Przemysł 4.0

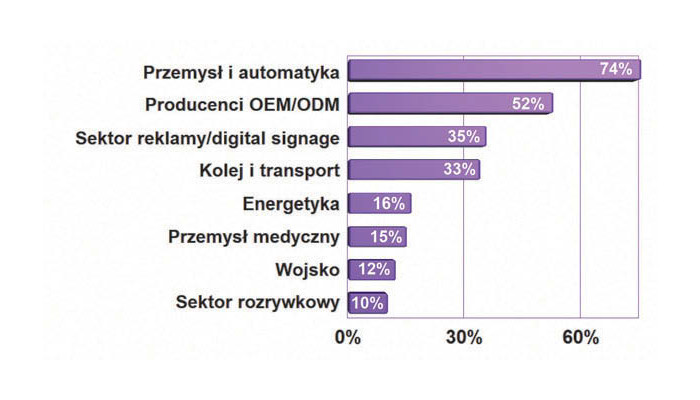

Przemysłowy Internet Rzeczy oraz Przemysł 4.0 to dwa ważne trendy, które zmieniają współczesny rynek elektroniki. Oba wiążą się w pewnym zakresie z obszarem komputerów jednopłytkowych, gdyż tytułowe produkty są aplikowane w takich obszarach. Niemniej granice są tu bardzo płynne – cały obszar IoT oraz przemysłowego IoT (IIoT) jest nieprecyzyjnie zdefiniowany i w praktyce wrzuca się do niego miniaturowe rozwiązania czujnikowe zasilane z baterii i bardzo wysoko zintegrowane (do jednego chipu najczęściej), a także komputery do zastosowań embedded wykorzystywane w automatyce przemysłowej, sieciach komputerowych i telekomunikacyjnych, a także wszystkich aplikacjach "smart". Jest oczywiste, że dla rynku SBC te rozwiązania najbardziej bliskie idei IoT, a więc maksymalnie zintegrowane, są niedostępne, obojętnie, kto i jak by je kategoryzował i naciągał. W omawianym temacie prędzej chodzi o koncepcję Przemysłu 4.0 oraz ogólną automatyzację i podłączanie do sieci. Myjnia samochodowa, automat sprzedaży, stacja pomiarowa monitoringu czy aparat EKG to przykłady takich rozwiązań, gdzie potrzebny jest jakiś komputer. Można dyskutować, czy w danym zastosowaniu wystarczy jeszcze mikrokontroler, czy już potrzebna jest większa wydajność, ale w praktyce decyzje są wielowymiarowym zagadnieniem. Proste zdalne sterowanie automatem sprzedaży z kontrolą przez sieć można zrealizować na kilkanaście możliwych sposobów z użyciem gotowych modułów z mikrokontrolerami, sprzęt medyczny być może będzie wymagał komputera SBC, który zapewni pamięć, wydajność i grafikę, natomiast aplikacja klasy digital signage być może najprościej powstanie z użyciem komputera box. Bezsprzecznie mamy dzisiaj bardzo dużo możliwości realizacji urządzeń i nie ma jednego uniwersalnego podejścia.

Rola standardu

W obszarze komputerów jednopłytkowych ważną rolę odgrywają standardy zapewniające możliwość korzystania z produktów wielu producentów. Chodzi o zapewnienie zgodności mechanicznej i pinowej, użycie jednakowego złącza, zasilania itd. Korzystając z rozwiązań standardowych, można zapewnić sobie większą swobodę wyboru producenta. Standardy w tym obszarze są także istotne dla tych, którzy wytwarzają urządzenia oparte na danym typie przez wiele lat, np. w obszarze medycyny.

Za pozytywną wiadomość można uznać to, że tych standardów definiujących obszar SBC nie ma już dzisiaj wcale tak wiele, przez co funkcja, jaką pełnią one w branży, się zwiększa. Być może wynika to z tego, że w mniejszym stopniu są one wynikiem narzucenia przez duże firmy swoich pomysłów, a w większym stopniu, że jest to wspólny projekt stowarzyszenia lub organizacji branżowej. Ostatnim ważniejszym wydarzeniem sprzed kilku lat był tutaj debiut SMARC, teraz nadchodzi COM-HPC. Nazwa taka w praktyce określa tzw. form factor, czyli wymiary, rozkład złączy, możliwości w zakresie chłodzenia, tak aby zapewniona była możliwość wymiany produktów kompatybilnych.

Nie da się jednak ukryć, że część producentów nie zaprząta sobie głowy normalizacją i tworzy własne konstrukcje. Popularnym formatem jest płytka o wielkości pamięci DRAM do peceta, bo łatwo dla niej kupić złącza i dużo oprogramowania inżynierskiego ma takie komponenty w bibliotekach.

TDP

Jednym z ważniejszych parametrów determinujących przydatność aplikacyjną komputerów jednopłytkowych jest TDP. Skrót ten opisuje maksymalną moc strat cieplnych dla procesora, czyli taką wartość, jaka może w systemie pojawić się w najbardziej niekorzystnym przypadku. W tym chodzi o pełne obciążenie obliczeniowe i komunikacyjne tego układu. TDP jest wartością rzadko pojawiającą się w normalnym działaniu, bo wykorzystywane techniki oszczędzania energii, np. poprzez wyłączanie bloków nieużywanych lub ograniczanie taktowania, powodują, że podczas realizacji typowych zadań pobór mocy jest ułamkiem wartości maksymalnej. Dla komputera z TDP 15 watów, typowy pobór mocy (run mode) może być na poziomie 1–3 watów, a w czasie hibernacji poniżej 0,1 W. Ale komputer musi być zaprojektowany na to, aby taką moc ciepła rozproszyć, stąd wartość TDP jest istotna w omawianym obszarze, gdyż determinuje wielkość konstrukcji i pośrednio także wiele innych parametrów. Procesory do komputerów desktop mają TDP z przedziału 50–100 W, wersje mobilne 20–40 W, te dla komputerów SBC zwykle mają TDP poniżej 15 W, najlepsze poniżej 10 W.

Longevity

Komputery jednopłytkowe są produktami z założenia trafiającymi do urządzeń i aplikacji profesjonalnych, a więc takich, które są używane przez wiele lat. Możliwość utrzymania w ruchu maszyny lub innego sprzętu działającego w hali produkcyjnej przez długie lata jest bardzo istotna, stąd możliwość kupienia produktu po długim czasie od rynkowego debiutu jest tutaj ważna, bo ogranicza ryzyko przeprojektowania konstrukcji lub też uzyskania nowej certyfikacji. Koszty serwisowania urządzeń są również istotne, szczególnie jeżeli producent działa na rynku międzynarodowym. W tym przypadku pojedynczy serwis urządzenia komercyjnego może wynieść więcej niż różnica cen w zakupie. Stąd w cechach produktu pojawia się parametr określający, przez ile lat producent gwarantuje dostępność tego modelu na rynku (longevity).

Oferta produktów, które mają gwarantowaną długą dostępność, systematycznie się zwiększa. Kiedyś było to 5 lat, potem 7 a następnie 10 lat. Dekada też nie jest jakimś rekordem, bo wystarczy poszperać chwilę, aby znaleźć na przykład wersje z gwarantowaną 15-letnią dostępnością. To na tym rynku bardzo długo.

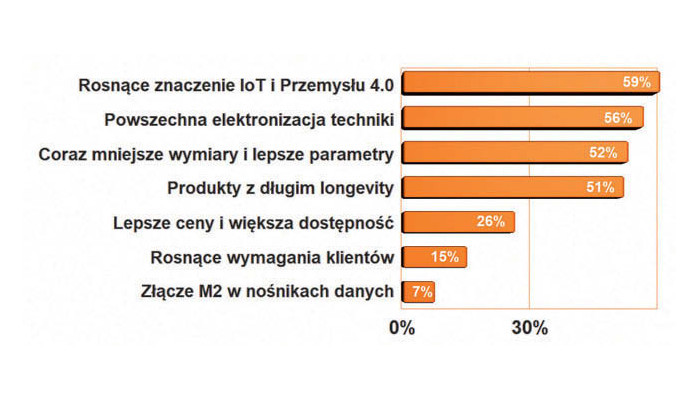

Pomocne jest też to, że często nowe wersje wprowadzane na rynek są zgodne mechanicznie, elektrycznie i programowo ze starymi rozwiązaniami. Ta pełna kompatybilność nie zawsze obowiązuje i nie przez cały czas, ale zasada jest taka, że jeśli w nowej wersji daje się zapewnić zgodność, to zwykle producenci ją zapewniają i nie zmieniają cech tak sobie. Jest to zupełnie odmienne podejście w porównaniu do rynku konsumenckiego, gdzie niekompatybilność nowych wersji jest celowo wprowadzana przez producentów, po to, aby zmusić użytkowników do wymiany. Najważniejsze zjawiska pozytywne dla rozwoju rynku SBC Najważniejsze czynniki negatywne dla rynku SBC Komputery jednopłytkowe już dawno przestały być dobrem luksusowym i wraz z otwarciem się rynku na procesory produkowane przez inne firmy niż Intel można powiedzieć, że trafiły pod strzechy. Dla rynku IoT, aplikacji kategoryzowanych jako Przemysł 4.0, stały się one kołem zamachowym zapewniającym rozwój. Jako drugi czynnik, prawie tak samo istotny, wymieniano w ankietach coraz większe nasycenie naszego otoczenia elektroniką, w czym kryją się wszystkie koncepcje z przedrostkiem "smart". Pomaga też to, że przemysł już rozwiązał problemy z wydzielaniem się ciepła i hasło "bezwentylatorowy" już wyblakło. Cały czas maleją wymiary takich komputerków. Całkiem wydajne jednostki mogą być dzisiaj niewiele większe od pudełka zapałek. Za najważniejsze czynniki wpływające negatywnie na tempo rozwoju rynku komputerów jednopłytkowych uznano silnie konkurencyjny rynek, na którym działa wiele firm oraz to, że klientom brakuje wiedzy na temat oferty rynku, możliwości technicznych poszczególnych rozwiązań oraz umiejętności oceny ich potencjału. Przeszkadzają też długie terminy dostaw, w tym te wywołane koronawirusem. Platformy open source, a więc komputery takie jak Raspberry Pi, także przez co trzeciego pytanego zostały uznane za istotny czynnik wpływający na rozwój systemów komercyjnych.

Pamięci przemysłowe Flash

Tak jak z małych komputerów przemysłowych zniknęły wentylatory, tak dzisiaj widać odwrót od klasycznych nośników danych, czyli napędów HDD, które zastąpiły pamięci Flash, a więc karty i dyski. W ostatnich latach dostępne pojemności nośników wzrosły na tyle, że nie ma problemu nawet, gdy trzeba przechować terabajty danych. Dyżurnym tematem jest trwałość i niezawodność zapisu, a także zakres temperatur pracy. No i oczywiście cena, bo ona zawsze się liczy, ale podobnie jak w przypadku komputerów, pamięci przemysłowe Flash też przestały być zaporowo drogie. Dodatkowo nośniki ze złączem M2 pozwalają na łatwą integrację pamięci z płytami głównymi i szybko zyskują popularność.

W przemyśle najczęściej wykorzystywane są pamięci NAND Flash SLC, ponieważ charakteryzują się one niską awaryjnością i bardzo dużą liczbą cykli zapisu. Są też odporne na różnego rodzaju zakłócenia. Produkty oparte na pamięciach MLC stosowane są natomiast w aplikacjach budżetowych, gdzie pewność zapisu danych ma mniejsze znaczenie, natomiast wymagana jest duża pojemność.

Od strony technologii rynek przemysłowych Flash szybko migruje z technologii NAND 2D do 3D, a więc w kierunku struktur spiętrzonych w wielowarstwowe pakiety krzemu. Ten trend dotyczy głównie rynku konsumenckiego, jednak ma on duży wpływ również na aplikacje przemysłowe.

Podobnie jak jest to w zakresie komputerów, ze względu na niską cenę zakupu pamięci konsumenckich część klientów używa ich w aplikacjach przemysłowych. W pierwszym okresie użytkowania nie widać między nimi znacznej różnicy. Niestety charakteryzują się one większą awaryjnością i nie zawsze prawidłowo pracują w trudnych warunkach środowiskowych. Nie zawsze występuje też możliwość zgłoszenia reklamacji produktów z pamięciami konsumenckimi, które były wykorzystane w warunkach profesjonalnych, ponieważ część producentów stosuje zapisy o ograniczonej gwarancji.

Przegląd rynku w tabeli

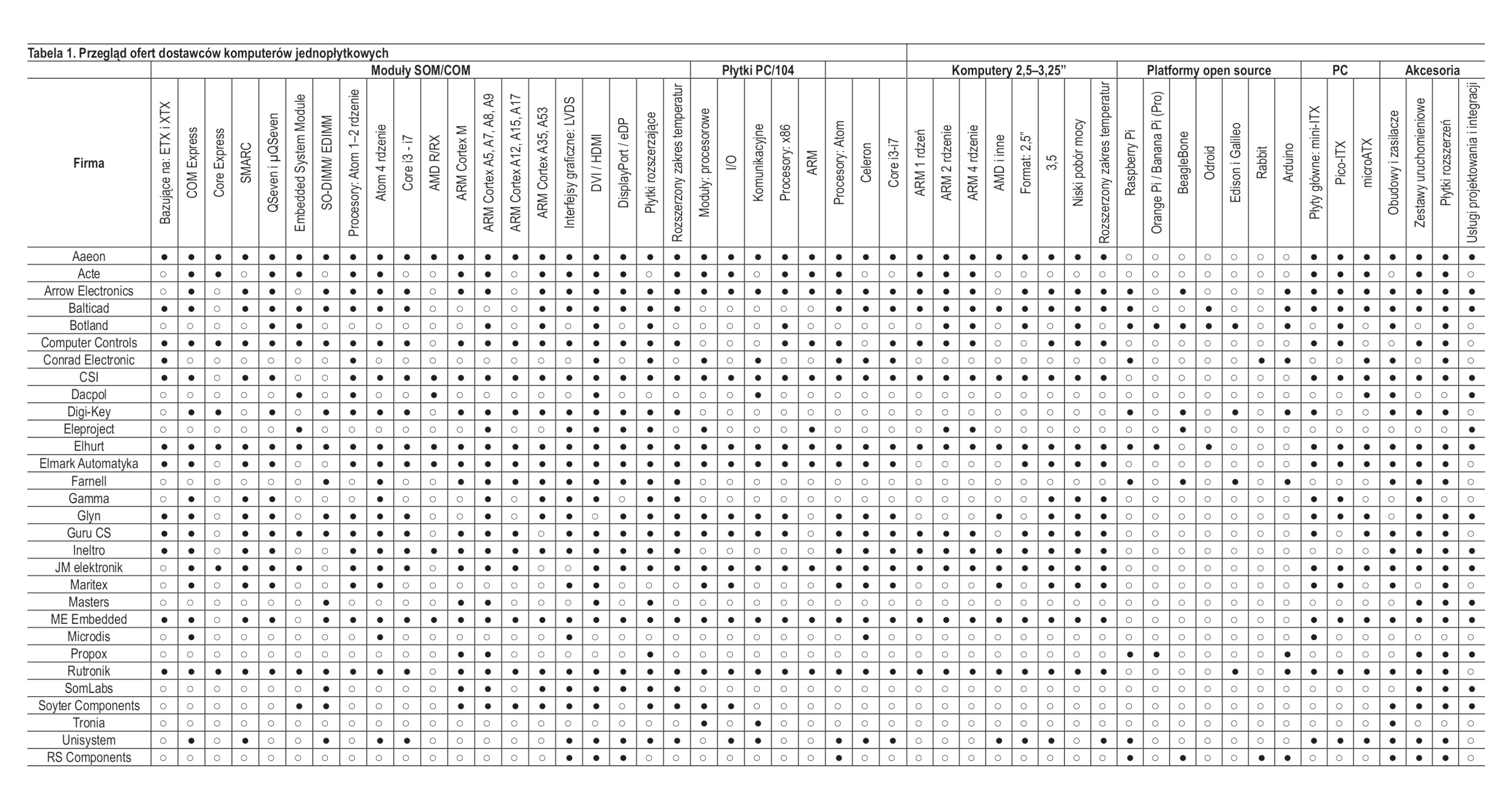

Dane z przeglądem ofert dostawców komputerów jednopłytkowych oraz pamięci Flash podajemy w tabeli 1. Została ona podzielona na kilka części poświęconych głównym grupom produktowym z tego obszaru, takim jak: moduły SOM/ COM, płytki PC/104, komputery w formacie 2,5–3,25", platformy open source i podobne do nich rozwiązania a także płyty pecetowe. W tabeli 2 podajemy dane kontaktowe do firm, które nadesłały wypełnione ankiety.

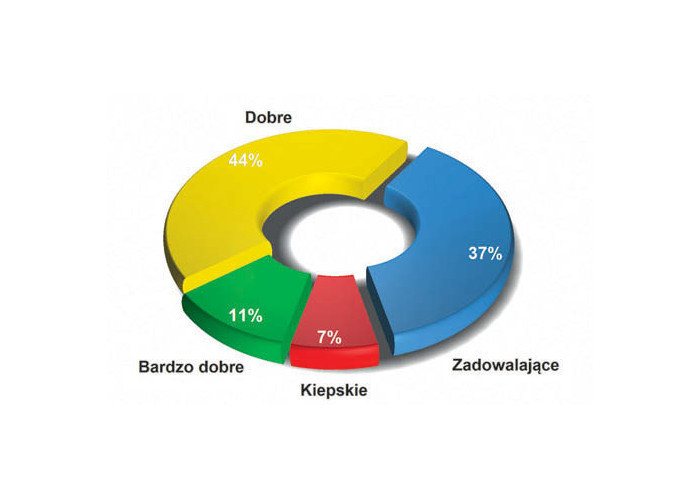

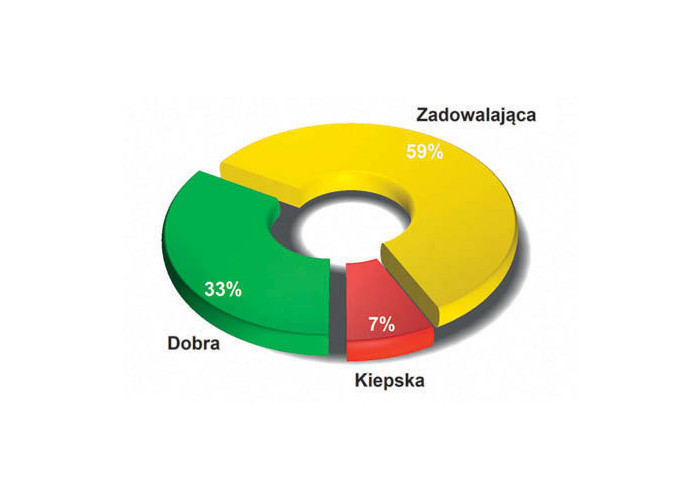

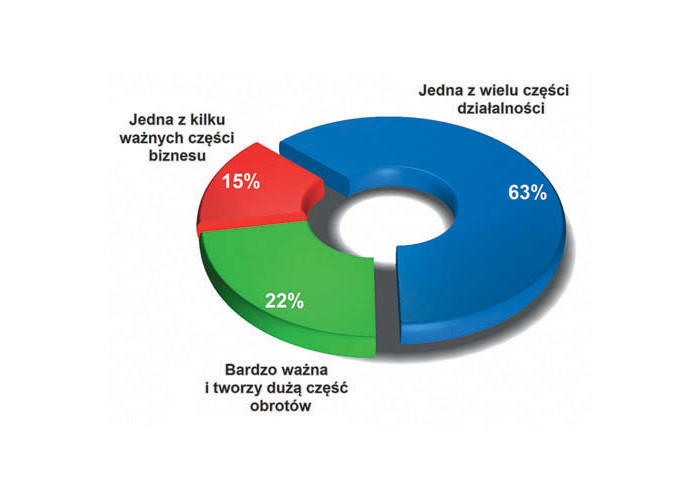

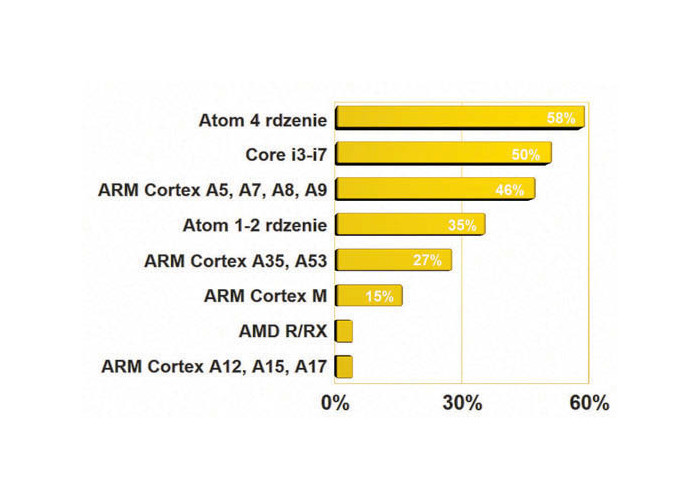

Źródłem wszystkich danych przedstawionych w tabelach oraz na wykresach są wyniki uzyskane w badaniu ankietowym przeprowadzonym wśród dostawców komputerów jednopłytkowych i pamięci Flash w Polsce.