Jako miarę tzn. ocenę poziomu niezawodności przyjmuje się prawdopodobieństwo spełnienia przez dany obiekt, np. prosty element elektroniczny, złożony mikroukład, moduł elektroniczny lub urządzenie, wymaganej funkcji w określonym przedziale czasu i w określonych warunkach użytkowania.

Dla wielu podzespołów elektronicznych, a zwłaszcza przyrządów półprzewodnikowych, prawdopodobieństwo to w wielu zastosowaniach tylko nieznacznie odbiega od jedności w okresie tak długim jak kilkanaście lub nawet kilkadziesiąt lat. Ze względów praktycznych, w tym także w celach porównawczych, do określania poziomu niezawodności stosuje się więc inne wskaźniki niż prawdopodobieństwo poprawnej pracy danego obiektu.

Dla wielu podzespołów elektronicznych, a zwłaszcza przyrządów półprzewodnikowych, prawdopodobieństwo to w wielu zastosowaniach tylko nieznacznie odbiega od jedności w okresie tak długim jak kilkanaście lub nawet kilkadziesiąt lat. Ze względów praktycznych, w tym także w celach porównawczych, do określania poziomu niezawodności stosuje się więc inne wskaźniki niż prawdopodobieństwo poprawnej pracy danego obiektu.

W przypadku podzespołów mechanicznych lub elektromechanicznych po pewnym okresie użytkowania występują objawy ich zużywania się, np. wskutek zmęczenia materiałowego, ścierania się albo odkształcenia. Natomiast w przypadku podzespołów elektronicznych zakończenie możliwości ich użytkowania jest, z reguły, spowodowane innymi przyczynami.

Mogą nimi być w szczególności różne procesy fizyczne i chemiczne lub elektrochemiczne, zachodzące wewnątrz tych obiektów lub w obrębie ich połączeń z otoczeniem, takie jak np. przebicie elektryczne, upływności lub elektromigracja. Związane z tymi procesami zmiany parametrów elektrycznych tzn. ich niestabilność, znana też jako płynięcie parametrów, istotne są zwłaszcza w przypadku układów analogowych lub analogowo-cyfrowych.

Przejście danego podzespołu lub urządzenia ze stanu poprawnej pracy do stanu, gdy przestają one funkcjonować prawidłowo (inaczej - wchodzą w stan niezdatności), określa się jako uszkodzenie (failure). Stosowane czasami zamiennie pojęcie "awaria" to raczej rozległe uszkodzenie. Prawdopodobieństwo wystąpienia uszkodzenia danego obiektu w określonej jednostce czasu pracy nazywane jest intensywnością uszkodzeń (failure rate lub hazard) i oznaczane zwyczajowo jako λ lub λ(t).

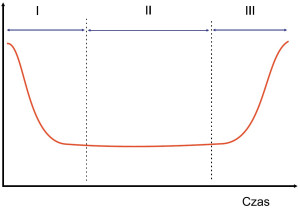

Zmiany intensywności uszkodzeń w czasie

Charakterystyczny i stąd często przywoływany i analizowany w publikacjach jest przebieg zmian w czasie intensywności uszkodzeń podzespołów i urządzeń elektronicznych, zachodzących w ich cyklu życia - od rozpoczęcia użytkowania do wystąpienia symptomów zużywania się, rysunek 1. Jest to tzw. krzywa wannowa.

Początkowa, stosunkowo krótka i opadająca część charakterystyki odnosi się do okresu rozpoczęcia użytkowania danego obiektu, gdy mogą zostać ujawnione pewne słabsze fizycznie egzemplarze np. z jakimiś wadami materiałowymi lub nieprawidłowościami w technologii albo konstrukcji. Aby wyeliminować takie słabsze egzemplarze, producenci wyrobów mogą (lub wymusza to konkurencja na rynku) podejmować odpowiednie działania, zmierzające do skrócenia tego okresu i obniżenia wartości λ.

Działania te określa się jako testy selekcyjne. Obejmują one m.in. wstępne obciążenie elektryczne (wygrzewanie wstępne - burn-in), cykliczne obciążanie mocą elektryczną, cykliczne zmiany temperatury otoczenia, wibracje, krótkotrwałe przeciążenia. Ten początkowy okres użytkowania jest nazywany również okresem adaptacji lub okresem "chorób wieku dziecięcego".

Poza okresem wstępnym, producenci mogą również znacząco wpływać na długość okresu praktycznego użytkowania, czyli na trwałość lub inaczej czas życia wyrobów (2. okres na rys. 1). Po nim rozpoczyna się 3. okres w cyklu eksploatacji wyrobów tzn. okres ich zużywania się. Wtedy intensywność uszkodzeń zaczyna narastać w czasie.

Decydujące znaczenie dla wystąpienia i sposobu rozwijania się opisanych sytuacji mają m.in. zastosowane do produkcji materiały, wybór rozwiązań technologicznych, przyjęte rozwiązania konstrukcyjne i układowe oraz jakość i efektywność pośrednich i końcowych operacji pomiarowo-kontrolnych.

Dla użytkowników różnych podzespołów, modułów, urządzeń i systemów elektronicznych najbardziej interesujące jest, jak będą zachowywać się te obiekty w 2. z wyróżnionych okresów w przebiegu zmian intensywności uszkodzeń λ. Ten okres praktycznego użytkowania, następujący po stosunkowo krótkim okresie adaptacji, powinien być, ogólnie biorąc, dostatecznie długi i dostosowany do przeznaczenia wyrobu.

Obserwuje się najczęściej, że pojawiające się wówczas uszkodzenia występują stosunkowo rzadko i są wywołane przyczynami losowymi. Stąd, jak pokazano na rysunku 1, wykres λ w funkcji czasu jest w tym przedziale płaski i przebiega na stosunkowo niskich poziomach. Użytkownicy wyrobów mogą w pewnym stopniu wpływać na przebieg zmian intensywności uszkodzeń, jakby przesuwając poziom λ w górę lub w dół, przez dobór warunków pracy np. zmniejszenie obciążeń elektrycznych i/lub zmianę warunków środowiskowych (zwykle obniżenie temperatury otoczenia).

Występowanie uszkodzeń wywołanych przyczynami losowymi, a nie np. jakąś powtarzającą się wadą lub niedostosowaniem do warunków zewnętrznych, uzasadnia przyjęcie w analizach i obliczeniach liczbowych niezwykle ważnego w praktyce upraszczającego założenia o tzw. wykładniczym prawie niezawodności.

Zależności liczbowe i parametry niezawodnościowe

Sporządzenie ilościowego opisu procesu występowania uszkodzeń i niezawodności wyrobów wymaga przyjęcia określonych modeli statystycznych, które powinny także wiązać się ze zjawiskami fizycznymi zachodzącymi podczas użytkowania danych wyrobów.

Badania próbek (badania laboratoryjne) lub dane z eksploatacji wyrobów pozwalają oszacować częstość występowania uszkodzeń jako iloraz liczby uszkodzeń z i liczności próbki n, a więc h = z/n. Niekiedy ten iloraz wyraża się w procentach.

Liczba uszkodzeń zwiększa się z upływem czasu eksploatacji i skumulowana częstość uszkodzeń (1/n, 2/n, 3/n...) wyznacza dystrybuantę trwałości F(t). Przyjmujemy, że dany wyrób może być w jednym z dwu stanów: jest zdatny do poprawnej pracy albo uległ uszkodzeniu i jest niezdatny do prawidłowego funkcjonowania, przeto sumując prawdopodobieństwa, będziemy mieli R(t) + F(t) = 1.

Przechodząc do intensywności uszkodzeń λ, jej oszacowanie na podstawie badań lub eksploatacji możemy otrzymać, odnosząc częstość uszkodzeń do określonego przedziału czasu λ = z/n · 1/Δt = z/n·t. W praktyce dla większości podzespołów elektronicznych podaje się intensywność uszkodzeń jako stosunek liczby uszkodzeń badanych podzespołów na milion roboczogodzin λ = z/106 h albo - co ma miejsce w przypadku wielu elementów i modułów półprzewodnikowych - jako parametr zwany FIT (failures in time) o wartości wynikającej ze stosunku liczby uszkodzeń, które mogą wystąpić w czasie miliarda roboczogodzin tzn. FIT = z/109 h.

Założenie o losowym i stosunkowo rzadkim występowaniu uszkodzeń w trakcie normalnego użytkowania podzespołów i urządzeń elektronicznych pozwala prowadzić badania niezawodności w dość elastyczny sposób. Można przykładowo przyjąć, że intensywność λ = 3×10-6 h, jeśli 3 uszkodzenia zaobserwowano w grupie 100 wyrobów, które pracowały (lub były badane laboratoryjnie) przez 10 000 godzin, albo gdy 3 uszkodzenia zaobserwowano wśród 1000 egzemplarzy wyrobów pracujących w przedziale czasu 1000 godzin.

Wykorzystanie wartości intensywności uszkodzeń λ poszczególnych podzespołów składowych stanowi jedną z metod przewidywania niezawodności zbudowanych z nich urządzeń i systemów elektronicznych. Wartości λ są na ogół podawane przez producentów podzespołów na bazie prowadzonych badań laboratoryjnych.

Należy jednak pamiętać, że dotyczą one określonych warunków badania. W konkretnych zastosowaniach należy wziąć pod uwagę procedury uściślające takie dane bazowe. W procedurach podanych w wojskowych normach amerykańskich MIL-HDBK-217 wylicza się przykładowo końcową wartość λ, posługując się iloczynowym wyrażeniem ze współczynnikami wynikającymi z bliższego określenia typu podzespołu (np. układy scalone analogowe lub cyfrowe, rodzaje kondensatorów, rezystorów, tranzystorów itp.), a dalej warunkami jego pracy i warunkami środowiskowymi, a nawet warunkami techniczno-organizacyjnymi dotyczącymi eksploatacji.

Może to znacząco zmieniać publikowane wartości bazowe λ. Procedury szacowania parametrów niezawodnościowych opracowane zostały także w różnych firmach, głównie amerykańskich, jak np. Telcordia Technical Reference TR-232 Reliability Prediction Procedure for Electronic Equipment, Vicor i in.

Osiągnięcia inżynierii materiałowej i postęp w technologii przyczyniają się do obniżania intensywności uszkodzeń podzespołów. Dla dużej grupy różnorodnych podzespołów można przyjąć, że obserwowane wartości λ nie przekraczają obecnie poziomu 10-6 h, co oznacza, że jedno uszkodzenie występuje przeciętnie w ciągu miliona lub nawet dopiero miliarda roboczogodzin.

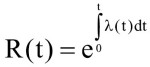

Ogólna zależność wiążąca niezawodność z intensywnością uszkodzeń ma postać:

|

W szczególnym przypadku, przyjmowanym jako dobre przybliżenie rzeczywistej sytuacji w 2. okresie czasowego przebiegu zmian λ, pokazanym na rysunku 1, gdy intensywność uszkodzeń nie zależy od czasu t, możemy przyjąć

Ta wykładnicza zależność jest chętnie i często wykorzystywana w praktyce, ze względu na znaczne ułatwienie ilościowego opisu przy ocenie, przewidywaniu i porównywaniu niezawodności.

Do opisu niezawodnościowych cech wyrobów stosuje się również grupę parametrów związanych z charakterystycznymi wielkościami i zależnościami czasowymi. Można je podzielić na te, które odnoszą się do wyrobów nienaprawialnych i te dotyczące wyrobów naprawialnych. Podzespoły elektroniczne są w zasadzie wyrobami nienaprawialnymi (i w związku z tym nie są naprawiane), podczas gdy urządzenia i systemy elektroniczne są w większości wyrobami naprawialnymi i wobec tego po wystąpieniu uszkodzenia poddaje się je naprawie, w celu przywrócenia do stanu zdatności.

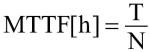

Podstawowym parametrem w przypadku obiektów nienaprawialnych jest średni (przeciętny) czas do wystąpienia uszkodzenia MTTF (mean time to failure). Jest to wartość przeciętna czasu do wystąpienia uszkodzenia danych wyrobów pracujących w określonych warunkach.

Oszacowanie tego czasu wymaga zwykle kontroli znacznej liczby analizowanych wyrobów w stosunkowo długim czasie. Wartość liczbową MTTF uzyskuje się jako iloraz całkowitego czasu pracy analizowanych wyrobów T przez liczbę tych wyrobów N:

|

Jeśli można przyjąć założenie o stałej wartości intensywności uszkodzeń, to MTTF jest równe odwrotności intensywności uszkodzeń λ. Zakładając, że intensywność uszkodzeń jest wyrażona w liczbie uszkodzeń na milion godzin, otrzymamy MTTF = 1 000 000/λ godzin. Parametr MTTF można utożsamiać z przeciętną wartością trwałości (czasu życia) wyrobów.

Przykład. Załóżmy, że 10 sztuk wyrobów było badane przez 1 rok i w tym czasie zaobserwowano 2 uszkodzenia po 2500 i 7000 godzinach pracy, a zatem

MTTF = [(8×8 760) + 2500 + 7000] / 10 = 79 080/10 = 7908 h

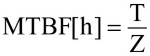

Co się tyczy obiektów naprawialnych (jak np. złożone moduły, pakiety z obwodami drukowanymi, różnorodne urządzenia i systemy elektroniczne), to za główny parametr niezawodnościowy należy uznać średni (przeciętny) czas między uszkodzeniami MTBF (mean time between failures). Jest to wartość przeciętna czasu między kolejnymi uszkodzeniami podzespołów lub innych elementów składowych danego obiektu. Po wystąpieniu uszkodzenia obiekt jest naprawiany, najczęściej przez wymianę uszkodzonego elementu składowego na nowy. Parametr MTBF oblicza się jako stosunek całkowitego czasu badania (lub eksploatacji) T do liczby uszkodzeń Z

|

Przykład. Posłużmy się danymi podanymi powyżej, przyjmując, że całkowity czas pracy próbki 10 wyrobów wyniósł 79 080 godzin i że podczas badania zaobserwowano 2 uszkodzenia. Stąd MTBF = 79 080 / 2 = 39 540 h.

Jeśli badania (lub obserwacja pracujących wyrobów) zostałyby przedłużone do 1,5 roku, a w tym czasie nie wystąpiłyby dalsze uszkodzenia, wówczas parametr MTBF byłby równy 57 310 h.

Czasu MTBF nie należy traktować jako minimalny albo gwarantowany czas do uszkodzenia lub między uszkodzeniami, a jego statystyczny charakter nie daje możliwości wykorzystania go do prognozowania niezawodności pojedynczych egzemplarzy wyrobów. Poza tym, czasu MTBF nie można mylić z trwałością (czasem życia) wyrobów - niektóre elementy jak np. baterie mogą mieć czas życia rzędu kilku godzin, a MTBF na poziomie 100 000 h.

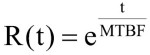

Dla modelu z wykładniczym rozkładem czasu życia wyrobów, gdy przyjmuje się, że λ = const, czyli że intensywność uszkodzeń nie zależy od czasu pracy lub badania, MTBF będzie równy odwrotności λ MTBF = 1/ λ.

Natomiast prawdopodobieństwo, że dany wyrób będzie pracował poprawnie przez czas t, wyniesie:

|

Przykładowo oznacza to, że jeśli dostępne będą dwa rodzaje dysków twardych o MTBF odpowiednio 250 000 godzin (ok. 28,5 roku) i 500 000 godzin (57 lat), wówczas po 5 latach (czyli 43 800 h) eksploatacji prawdopodobieństwo poprawnej pracy tych dysków będzie: I grupa R(t) = 0,839, II grupa R(t) = 0,916. Innymi słowy, można stwierdzić, że wyroby te po 5 latach eksploatacji będą jeszcze pracowały poprawnie z prawdopodobieństwem odpowiednio 83,9% i 91,6% albo że 83,9% (91,6%) tych wyrobów będzie nadal pracowało poprawnie po upływie 5 lat.

Należy mieć na uwadze, że czasy MTBF podawane są przez producentów na podstawie badań lub w oparciu o dane z eksploatacji wyrobów, które pracowały w określonych warunkach na ogół przyjmowanych jako przeciętne, np. w temperaturze otoczenia nieprzekraczającej zwykle 70°C.

Rozkłady czasu życia wyrobów

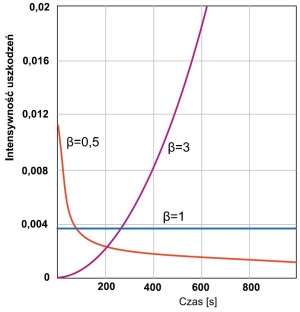

Rys. 2. Gęstość prawdopodobieństwa uszkodzeń w rozkładzie Weibulla w zależności od wartości parametru β

Przyjęcie założenia o niezależności od czasu częstości pojawiania się uszkodzeń pracujących obiektów i akceptacja wykładniczej zależności dla ich niezawodności stanowi - jak to już wspomniano - wygodny model do opisu procesu eksploatacji, zwłaszcza w zasadniczej dla użytkowników fazie tego procesu.

Jednakże gdy zachodzi potrzeba opisu początkowej lub końcowej fazy eksploatacji albo też łącznego potraktowania wyróżnionych faz, a także przy porównawczych ocenach poziomu niezawodności - wówczas przydatne mogą się okazać jeszcze inne (poza wykładniczym) rozkłady trwałości (czasu życia). Warto wśród nich wymienić rozkład logarytmo-normalny i rozkład Weibulla. Aby ocenić przydatność danego rozkładu w konkretnym zastosowaniu, analizuje się teoretyczną funkcję λ(t) wynikającą z rozkładu i porównuje jej przebieg z przebiegiem doświadczalnym.

Zmienna losowa, jaką jest czas życia, ma rozkład logarytmo-normalny, jeśli wartości tego czasu uzyskane z badań lub eksploatacji mają po zlogarytmowaniu (logarytm dziesiętny lub naturalny) rozkład normalny. Rozkład logarytmonormalny może być wykorzystany do opisu trwałości w sytuacji, gdy λ początkowo bardzo szybko narasta (praktycznie od pewnej większej wartości), a następnie maleje w czasie. Odpowiada to przykładowo przebiegowi zaznaczonemu jako okres I w pierwszej części krzywej na rysunku 1.

Ze względu na możliwość zastosowania w wielu praktycznych sytuacjach, dużą popularność uzyskał rozkład Weibulla. Gęstość prawdopodobieństwa w rozkładzie Weibulla ma kształt przedstawiony na rysunku 2 i zależy od 3 parametrów: kształtu β, skali η i parametru początkowego γ. Gdy parametr kształtu β = 1, wówczas rozkład Weibulla przechodzi w rozkład wykładniczy.

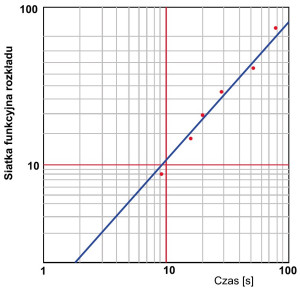

Wykorzystanie rozkładu Weibulla zapewnia dobrą analizę procesu uszkodzeń i przewidywanie niezawodności już na podstawie stosunkowo małych próbek. Praktycznie stosowane są przy tym metody graficzne. Przykładem może być siatka funkcyjna rozkładu (reliability plot), pokazująca zmiany dystrybuanty F(t) = 1 - R(t) w funkcji czasu (rys. 4). Nanosi się na nią dane doświadczalne, co pozwala ocenić zgodność lub odchylenia od linii prostej, odpowiadającej rozkładowi Weibulla.

Przyspieszone badania niezawodności

Celem przyspieszonych (forsownych) badań niezawodności wyrobów jest stworzenie takich warunków, które pozwoliłyby na uzyskanie informacji o trwałości w krótszym czasie, niż miałoby to miejsce przy normalnych (typowych) obciążeniach tych wyrobów, związanych z ich określonym zastosowaniem.

Cel ten jest więc różny od tego, który realizuje się podczas wspomnianych wcześniej testów selekcyjnych. W obu jednak przypadkach stosuje się - choć na różne sposoby - obostrzone warunki pracy (badania) wyrobów, podnosząc poziomy obciążeń roboczych i ustalając trudniejsze warunki zewnętrzne (warunki środowiskowe).

W badaniach przyspieszonych doprowadza się do wystąpienia uszkodzeń, aby uzyskać dane o czasie życia wyrobów. Żeby przenieść wyniki w odpowiedniej skali na normalne warunki użytkowania, należy zadbać o zachowanie takich samych mechanizmów uszkodzeń. Często ogranicza to możliwość uzyskania dostatecznie dużych współczynników przyspieszenia.

Czynnikiem powodującym przyspieszenie przebiegu procesów fizykochemicznych prowadzących do wystąpienia uszkodzenia jest niewątpliwie podwyższona temperatura. Zależność współczynnika przyspieszenia od przyrostu temperatury ma charakter wykładniczy i jest znana jako równanie Arrheniusa.

Uwzględnienie występujących jednocześnie innych obciążeń, jak np. podwyższony poziom napięć, można przedstawić wykorzystując równanie Eyringa. Opracowane zostały również oddzielne modele ilościowe dla innych czynników, oddziaływających na zmiany szybkości przebiegu procesów prowadzących do wystąpienia uszkodzeń.

Dotyczy to m.in. takiego obciążenia (stresora) jak cykle termiczne, gdzie ilościowy model oddziaływania jest opisywany za pomocą równania Coffina-Mansona. Z kolei efekt łącznego oddziaływania temperatury i wilgoci przedstawia równanie Hallberga-Pecka.

W zależności od przewidywanych zastosowań, w badaniach bierze się również pod uwagę wpływ takich czynników jak wspomniane już poziomy napięć roboczych i prądów, wibracje i wilgotność. Charakterystyczną wielkością odnoszącą się do pobudzenia jakiegoś mechanizmu uszkodzeń jest energia aktywacji danego procesu, której wartość ustala się doświadczalnie dla badanych typów podzespołów.

Niezawodność urządzeń i systemów elektronicznych

Urządzenia i systemy elektroniczne zbudowane są z wielu współpracujących elementów składowych, przede wszystkim podzespołów elektronicznych oraz elektromechanicznych i mechanicznych. Niezawodność tych elementów składowych wpływa znacząco na niezawodność urządzeń i systemów. Uwzględnić to należy podczas przewidywania i obliczeń niezawodności już w fazie projektowania tych wyrobów.

W tym celu korzysta się zwykle z informacji o intensywności uszkodzeń - publikowanych lub udostępnianych kupującym na życzenie przez producentów podzespołów. Jeśli takie informacje nie są jednak dostępne, można posłużyć się danymi porównawczymi, pochodzącymi z wcześniejszych podobnych rozwiązań.

Bazowa intensywność uszkodzeń wymaga modyfikacji związanej z danym zastosowaniem. Wprowadzenie współczynników korekcyjnych wynika z przewidywanego obciążenia podzespołów, w tym zwłaszcza przyjętego poziomu sygnałów roboczych i napięć zasilających oraz dopuszczalnej temperatury pracy, a także warunków środowiskowych - takich jak temperatura otoczenia, wibracje, wilgotność, ciśnienie, zaburzenia EM itd.

W tych wstępnych oszacowaniach efektywną wartość intensywności uszkodzeń oblicza się zwykle jako sumę intensywności uszkodzeń wszystkich indywidualnych elementów składowych, a więc przyjmuje się szeregową strukturę niezawodnościową obiektów złożonych λef = Σλi.

Przykład. Do budowy modułu funkcjonalnego na płytce drukowanej wykorzystano podzespoły o znanej intensywności uszkodzeń λ wyrażonej w jednostkach FIT (liczba uszkodzeń na miliard roboczo- godzin). Specyfikacja obejmuje: 1 transceiver - 0,437, 1 przesuwnik poziomu napięcia (translator napięcia) - 0,35, 1 regulator napięcia 3,3 V - 0,746, 1 dioda - 10,2, 2 tranzystory - 2×2,7 = 5,4, 10 rezystorów - 10×3,7 = 37, 15 kondensatorów - 15×0,373 = 5,591.

Suma tych cząstkowych intensywności uszkodzeń wynosi 60,409 FIT, co odpowiada czasowi MTBF równemu 16 553 825 godzin. Obliczone wartości parametrów niezawodnościowych należy oczywiście traktować jako orientacyjne.

W podanym przykładzie przyjęto bowiem przybliżone założenie o wykładniczym rozkładzie niezawodności, a z kolei pominięto wiele innych elementów składowych jak np. połączenia na płytce drukowanej i połączenia zewnętrzne modułu (gniazda, wtyki, kable) oraz nie uwzględniono instalowanych zwykle w układach zabezpieczeń od przepięć i wyładowań ESD.

Wstępną, zgrubną ocenę niezawodności projektowanego urządzenia można także podejmować na bazie wcześniejszych opracowań o podobnej złożoności układowej i realizowanych funkcjach.

Szereg ogólnych zaleceń mających na celu uzyskanie wysokiego poziomu niezawodności projektowanych urządzeń i systemów:

- Właściwy dobór podzespołów ze względu na przewidywane funkcje urządzenia i oczekiwane warunki użytkowania. Podejmowane decyzje powinny wynikać z analizy szerokiego zakresu zagadnień, a w tym wyboru typu podzespołów np. rodzaju układów scalonych albo rodzaju kondensatorów (elektrolityczne mają na ogół większą intensywność uszkodzeń), poziomu technicznego zaawansowania producenta podzespołów, zastosowania testów selekcyjnych, warunków osiągnięcia kompromisu cena - jakość itd.

- Odrębną sprawą dotyczącą niezawodności podzespołów jest zastosowanie ich odciążenia (derating) przez ustalenie mniej ostrych warunków pracy i/lub warunków otoczenia tak, aby spowolnić procesy prowadzące do wystąpienia uszkodzeń; zwykle polega to na obniżeniu temperatury pracy podzespołów lub na obniżeniu poziomu i częstotliwości sygnałów.

- Przyjęcie ukierunkowanych na niezawodność rozwiązań układowych - najlepiej prostych i sprawdzonych, z użyciem standardowych podzespołów lub scalonych modułów (wyłączając rozwiązania i wyroby specjalne), z kompensacją możliwych zmian parametrów w czasie (głównie w układach analogowych). W przypadku wysokich wymagań dotyczących niezawodności można zastosować w projekcie rozwiązania nadmiarowe, polegające na układowym lub programowym zwielokrotnieniu (zwykle zdublowaniu) realizowanych funkcji. Zwielokrotnienie układowe może mieć formę rezerwy aktywnej (gorącej), gdy zdublowane układy pracują cały czas jednocześnie lub rezerwy biernej (zimnej) - gdy nadmiarowy układ jest włączany do pracy po wystąpieniu uszkodzenia w podstawowej gałęzi układowej.

- Ograniczanie i unikanie wpływu przepięć wynikających z wyładowań ESD i wyładowań atmosferycznych oraz przełączania obwodów prądowych np. w zasilaniu. Ochronę uzyskuje się przez instalowanie w układach specjalizowanych elementów zabezpieczających oraz ograniczających rezystorów, kondensatorów i sprzęgaczy optycznych (transoptorów).

- Odprowadzanie ciepła, chłodzenie. Konieczność utrzymania ograniczonej temperatury pracy podzespołów (zwykle w zakresie 70-150°C) wiąże się z potrzebą zastosowania radiatorów, płaszczyzn na płytkach do odprowadzania ciepła, wentylatorów, elementów chłodzących (Peltiera) i ewentualnie chłodzenia cieczą. W niektórych przypadkach zadbać należy o odpowiednie osłony przeciw promieniowaniu słonecznemu.

- Ograniczenie wpływu zaburzeń elektromagnetycznych. Do środków zaradczych zaliczyć należy ekranowanie, zastosowanie specjalizowanych elementów ochronnych, filtrów i sprzęgaczy optycznych oraz staranne projektowanie płytek zwłaszcza pod kątem poprawnego rozprowadzenia sygnałów roboczych i rozmieszczenia ścieżek uziemiających.

- Staranne wykonawstwo - można tu wskazać znaczenie montażu podzespołów na płytkach drukowanych (lutowanie, połączenia owijane) oraz wykonywanie połączeń zewnętrznych (z gniazdami, wtykami i kablami). W laptopach obserwuje się, przykładowo, uszkodzenia elektryczne i mechaniczne, wynikające z konstrukcji obudowy zawierającej część bazową i otwieraną pokrywę z ekranem. Warto pamiętać, że obudowa powinna na ogół stanowić stabilny element konstrukcyjny i służyć także jako osłona przed promieniowaniem EM.

- Dobra organizacja procesu napraw przy wykorzystaniu zgromadzonych (magazynowanych) lub łatwo i szybko dostępnych części zapasowych, potrzebnych na wymianę uszkodzonych podzespołów.

Ogólnie biorąc, wymagania na trwałość (czas życia) urządzeń i systemów są bardzo zróżnicowane i zależą zarówno od indywidualnych zastosowań i potrzeb, jak i różnych dziedzin aktywności technicznej. W technice kosmicznej, w energetyce i w zastosowaniach militarnych może to być kilkadziesiąt lat.

Mniejsze wartości przewiduje się w przypadku urządzeń medycznych, systemów automatyki i sterowania oraz w telekomunikacji. Kolejne miejsca można przypisać wyrobom dla motoryzacji (przeciętnie 10-15 lat) i wyrobom powszechnego użytku (kilka-kilkanaście lat lub krócej). W tej ostatniej grupie wyrobów zakończenie eksploatacji nie zawsze jest spowodowane wystąpieniem jakichś uszkodzeń, lecz np. chęcią wymiany na urządzenie ulepszone technicznie.

Przykładem skuteczności kompleksowych i rozległych działań na rzecz niezawodności obiektów elektronicznych mogą być bezzałogowe sondy kosmiczne Voyager I i II, wysłane przez NASA w 1977 roku. Pomimo upływu 40 lat i przebyciu przez nie ponad 18 mld km w niesprzyjającym środowisku, duża część urządzeń elektronicznych (w większości zdublowanych) nadal pracuje, a pokładowy reaktor termoelektryczny powinien zapewnić zasilanie i działanie aż do 2025 roku.

Jerzy F. Kołodziejski